Anlise de agrupamentos Prof Jos Francisco Moreira Pessanha

- Slides: 113

Análise de agrupamentos Prof. José Francisco Moreira Pessanha professorjfmp@hotmail. com

Análise de agrupamentos Cluster Analysis Abrange uma variedade de métodos que têm por objetivo fracionar um conjunto de objetos em um determinado nº de subconjuntos mutuamente exclusivos (agrupamentos ou clusters), de tal forma que os objetos em um mesmo cluster sejam semelhantes entre si, porém diferentes dos objetos dos outros clusters. Os clusters devem exibir elevada homogeneidade interna (pequena variabilidade dentro de cada grupo) e elevada heterogeneidade externa (grande separação entre os grupos). Os clusters não são conhecidos previamente, mas são obtidos pela análise das semelhanças ou diferenças entre os objetos do conjunto de dados. Os métodos de análise de agrupamentos têm por objetivo determinar uma estrutura de grupos que se ajuste aos dados disponíveis, i. e. , classificar os objetos de acordo com o agrupamento natural dos dados.

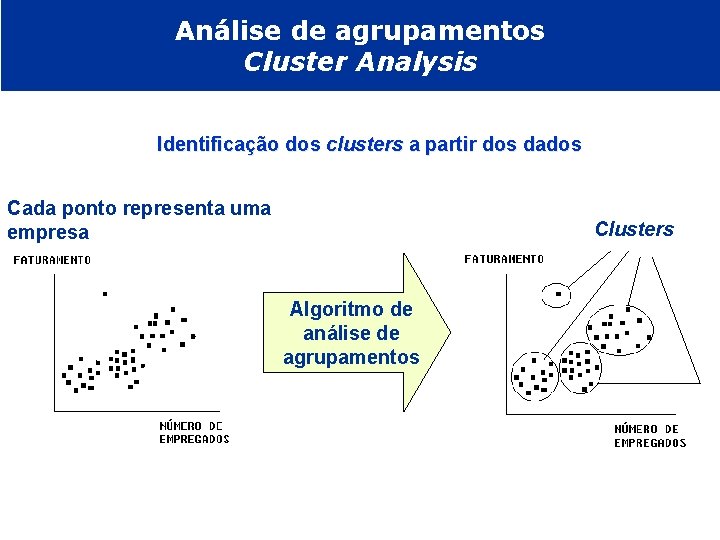

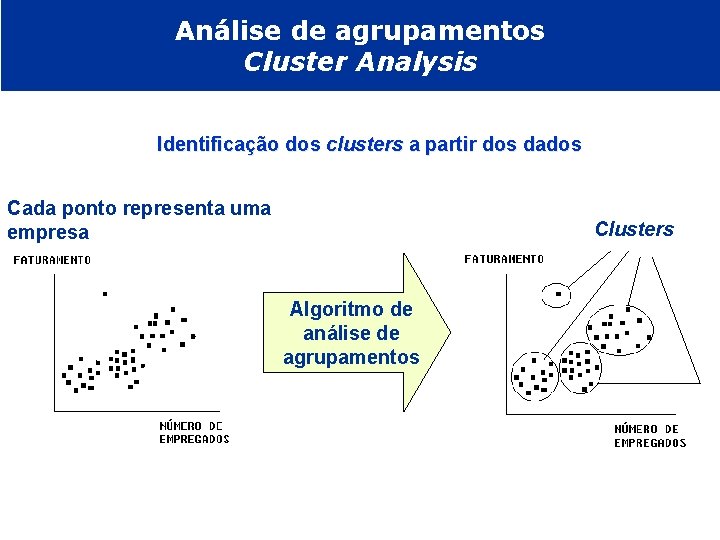

Análise de agrupamentos Cluster Analysis Identificação dos clusters a partir dos dados Cada ponto representa uma empresa Clusters Algoritmo de análise de agrupamentos

O que é possível fazer com a análise de agrupamentos ? § Formar uma taxonomia das observações Identificar grupos naturais no interior dos dados, i. e. , uma classificação empírica dos objetos. § Simplificar os dados (compressão de dados)

Características da análise de agrupamentos § É descritiva, os métodos são exploratórios e a idéia é gerar hipóteses. § Cria grupos indiferentemente a existência de alguma estrutura nos dados. § Variedade de vias e critérios para definição dos grupos o que implica na possibilidade de obter soluções diferentes variando-se um ou mais critérios. § A solução da análise de agrupamentos não é generalizável por que ela é totalmente dependente tanto das variáveis usadas como dos critérios em que ela se baseia.

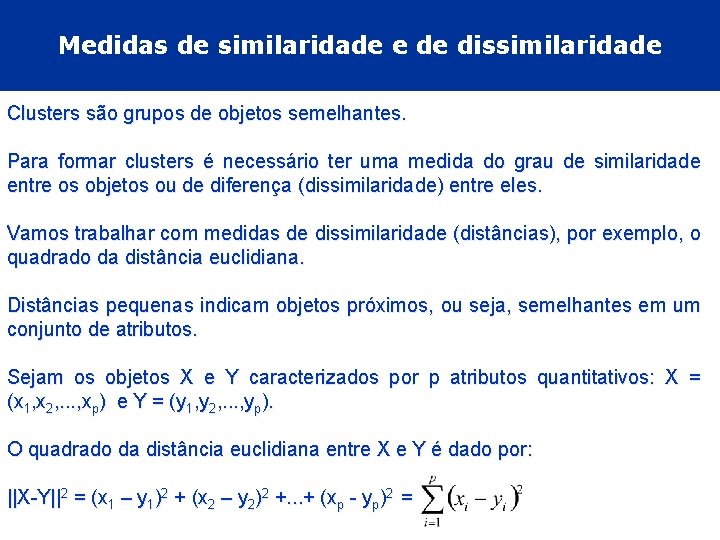

Medidas de similaridade e de dissimilaridade Clusters são grupos de objetos semelhantes. Para formar clusters é necessário ter uma medida do grau de similaridade entre os objetos ou de diferença (dissimilaridade) entre eles. Vamos trabalhar com medidas de dissimilaridade (distâncias), por exemplo, o quadrado da distância euclidiana. Distâncias pequenas indicam objetos próximos, ou seja, semelhantes em um conjunto de atributos. Sejam os objetos X e Y caracterizados por p atributos quantitativos: X = (x 1, x 2, . . . , xp) e Y = (y 1, y 2, . . . , yp). O quadrado da distância euclidiana entre X e Y é dado por: ||X-Y||2 = (x 1 – y 1)2 + (x 2 – y 2)2 +. . . + (xp - yp)2 =

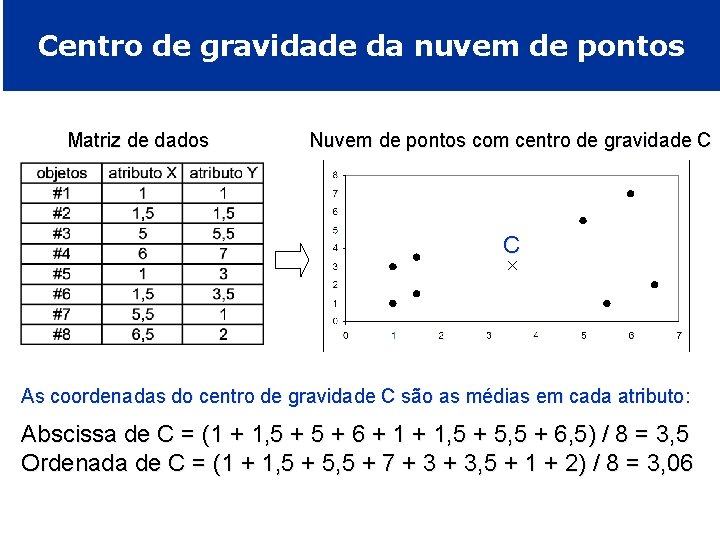

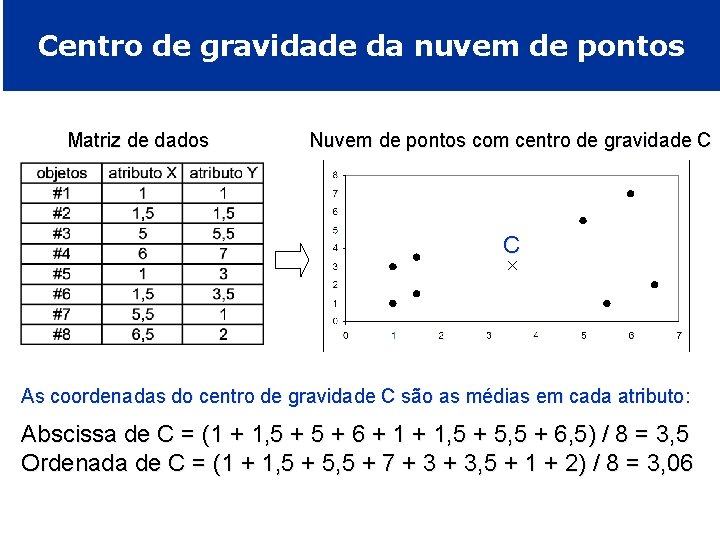

Centro de gravidade da nuvem de pontos Matriz de dados Nuvem de pontos com centro de gravidade C C As coordenadas do centro de gravidade C são as médias em cada atributo: Abscissa de C = (1 + 1, 5 + 6 + 1, 5 + 5, 5 + 6, 5) / 8 = 3, 5 Ordenada de C = (1 + 1, 5 + 5, 5 + 7 + 3, 5 + 1 + 2) / 8 = 3, 06

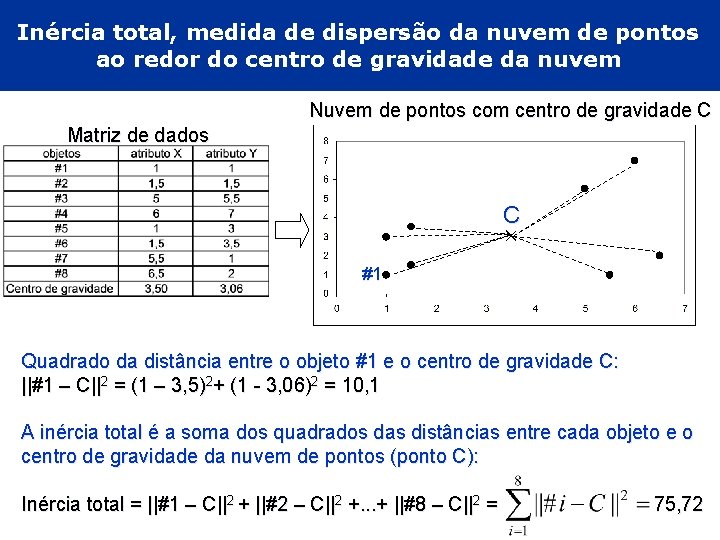

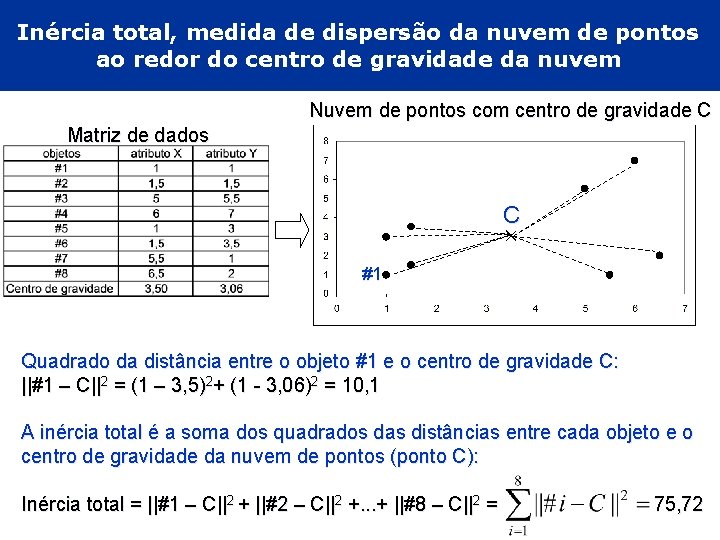

Inércia total, medida de dispersão da nuvem de pontos ao redor do centro de gravidade da nuvem Nuvem de pontos com centro de gravidade C Matriz de dados C #1 Quadrado da distância entre o objeto #1 e o centro de gravidade C: ||#1 – C||2 = (1 – 3, 5)2+ (1 - 3, 06)2 = 10, 1 A inércia total é a soma dos quadrados das distâncias entre cada objeto e o centro de gravidade da nuvem de pontos (ponto C): Inércia total = ||#1 – C||2 + ||#2 – C||2 +. . . + ||#8 – C||2 = 75, 72

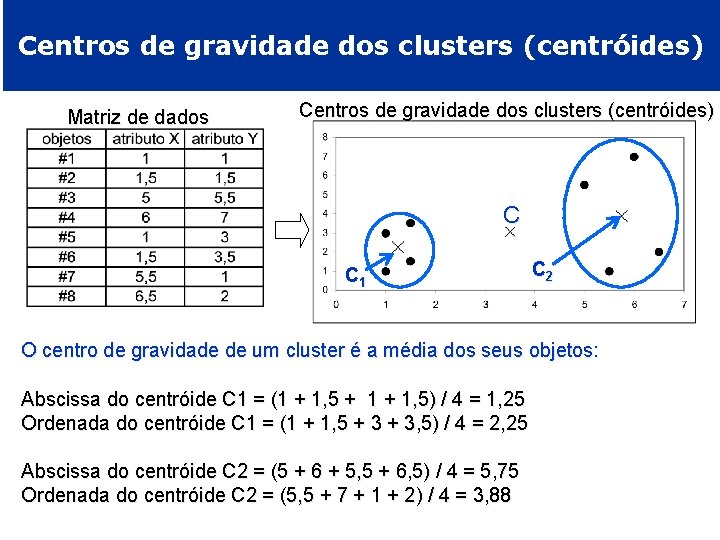

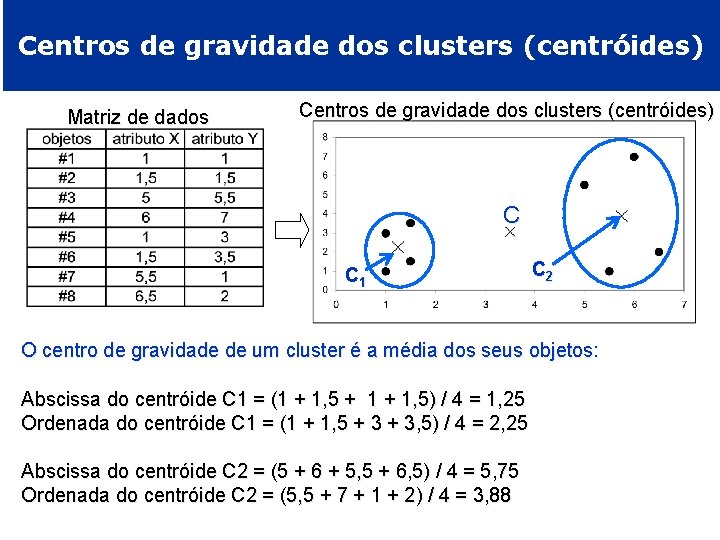

Centros de gravidade dos clusters (centróides) Matriz de dados Centros de gravidade dos clusters (centróides) C C 1 C 2 O centro de gravidade de um cluster é a média dos seus objetos: Abscissa do centróide C 1 = (1 + 1, 5) / 4 = 1, 25 Ordenada do centróide C 1 = (1 + 1, 5 + 3, 5) / 4 = 2, 25 Abscissa do centróide C 2 = (5 + 6 + 5, 5 + 6, 5) / 4 = 5, 75 Ordenada do centróide C 2 = (5, 5 + 7 + 1 + 2) / 4 = 3, 88

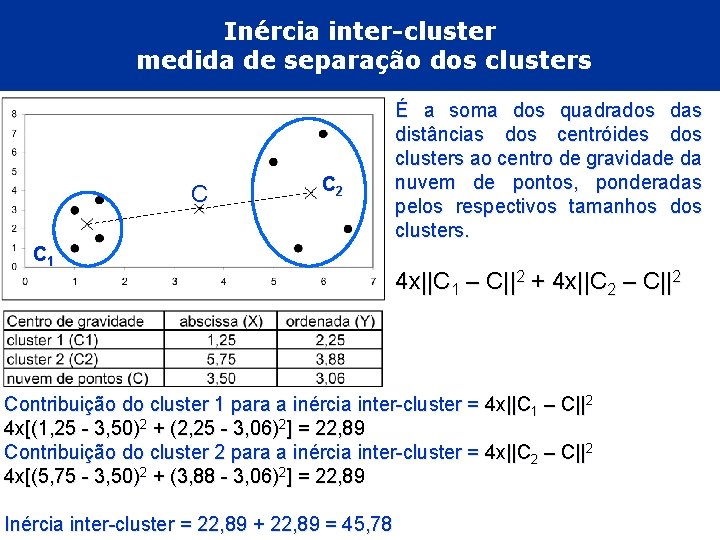

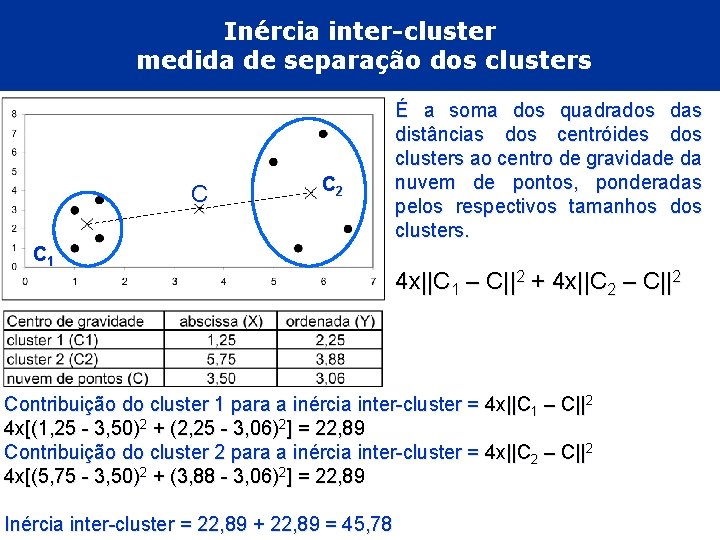

Inércia inter-cluster medida de separação dos clusters C C 2 C 1 É a soma dos quadrados das distâncias dos centróides dos clusters ao centro de gravidade da nuvem de pontos, ponderadas pelos respectivos tamanhos dos clusters. 4 x||C 1 – C||2 + 4 x||C 2 – C||2 Contribuição do cluster 1 para a inércia inter-cluster = 4 x||C 1 – C||2 4 x[(1, 25 - 3, 50)2 + (2, 25 - 3, 06)2] = 22, 89 Contribuição do cluster 2 para a inércia inter-cluster = 4 x||C 2 – C||2 4 x[(5, 75 - 3, 50)2 + (3, 88 - 3, 06)2] = 22, 89 Inércia inter-cluster = 22, 89 + 22, 89 = 45, 78

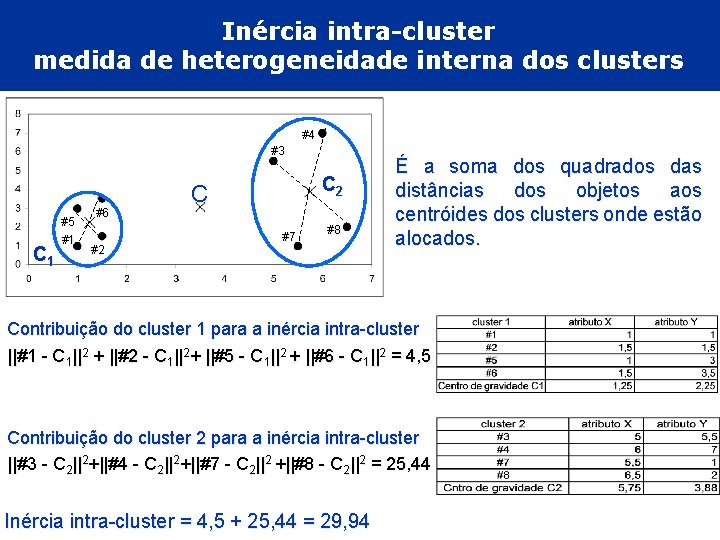

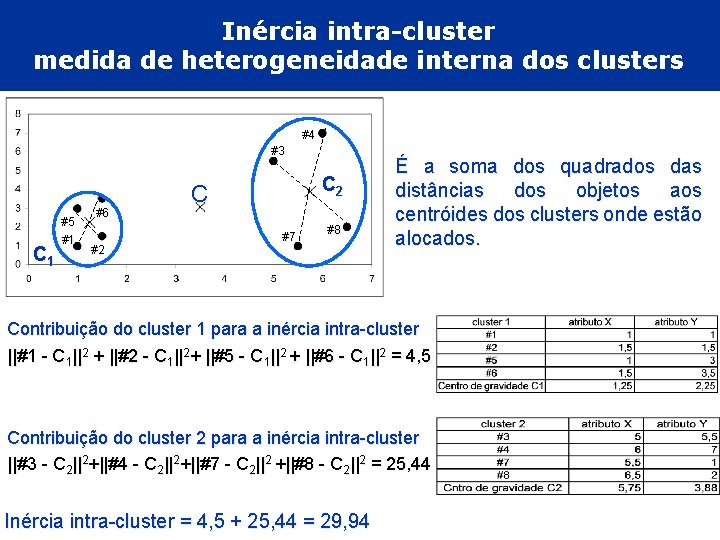

Inércia intra-cluster medida de heterogeneidade interna dos clusters #4 #3 C 1 #5 #1 #6 #2 C #7 #8 É a soma dos quadrados das distâncias dos objetos aos centróides dos clusters onde estão alocados. Contribuição do cluster 1 para a inércia intra-cluster ||#1 - C 1||2 + ||#2 - C 1||2+ ||#5 - C 1||2 + ||#6 - C 1||2 = 4, 5 Contribuição do cluster 2 para a inércia intra-cluster ||#3 - C 2||2+||#4 - C 2||2+||#7 - C 2||2 +||#8 - C 2||2 = 25, 44 Inércia intra-cluster = 4, 5 + 25, 44 = 29, 94

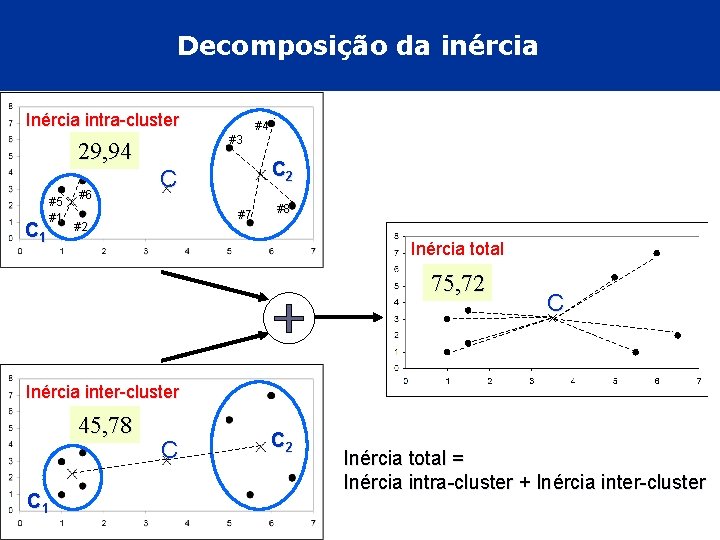

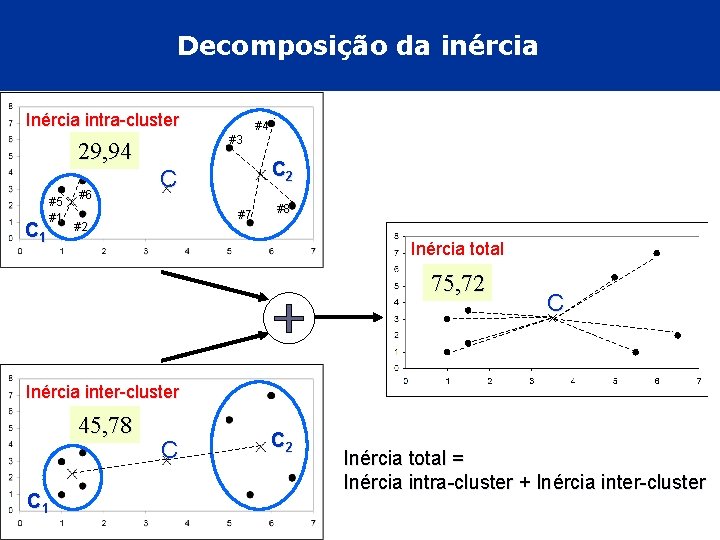

Decomposição da inércia Inércia intra-cluster 29, 94 C 1 #5 #1 #6 #4 #3 C 2 C #7 #2 #8 Inércia total 75, 72 C Inércia inter-cluster 45, 78 C 1 C C 2 Inércia total = Inércia intra-cluster + Inércia inter-cluster

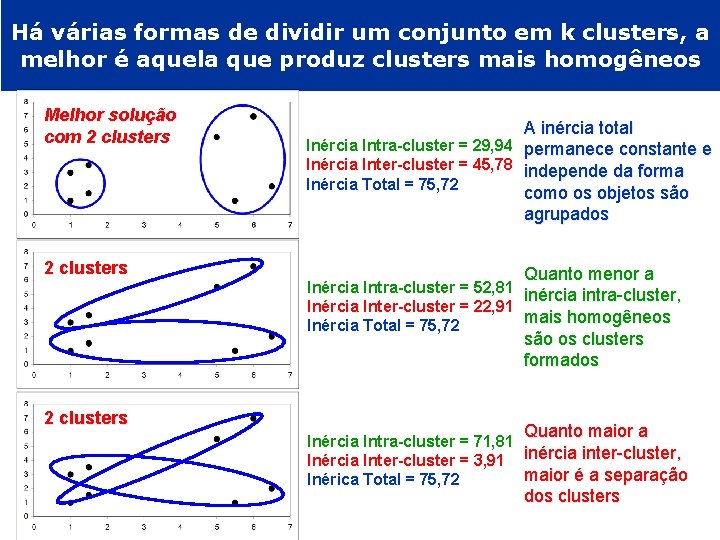

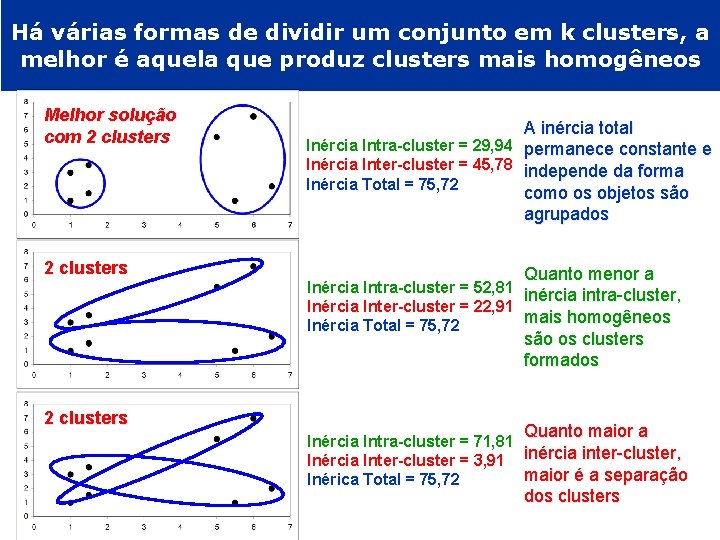

Há várias formas de dividir um conjunto em k clusters, a melhor é aquela que produz clusters mais homogêneos Melhor solução com 2 clusters A inércia total Inércia Intra-cluster = 29, 94 permanece constante e Inércia Inter-cluster = 45, 78 independe da forma Inércia Total = 75, 72 como os objetos são agrupados Quanto menor a Inércia Intra-cluster = 52, 81 inércia intra-cluster, Inércia Inter-cluster = 22, 91 mais homogêneos Inércia Total = 75, 72 são os clusters formados Quanto maior a Inércia Intra-cluster = 71, 81 Inércia Inter-cluster = 3, 91 inércia inter-cluster, maior é a separação Inérica Total = 75, 72 dos clusters

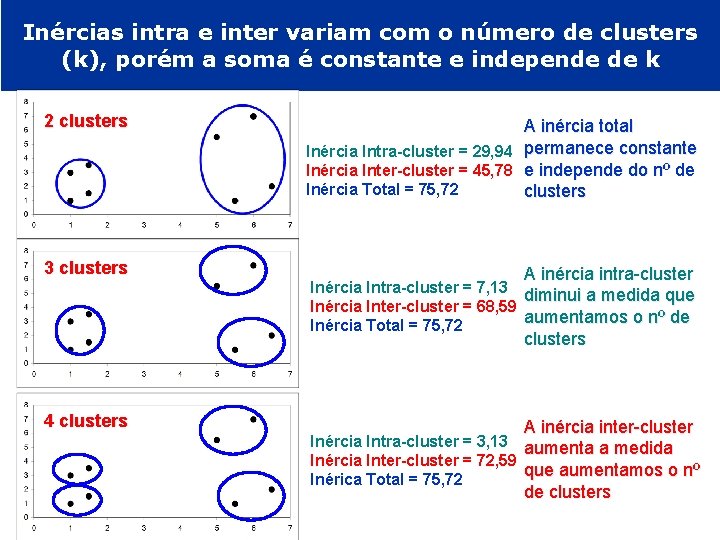

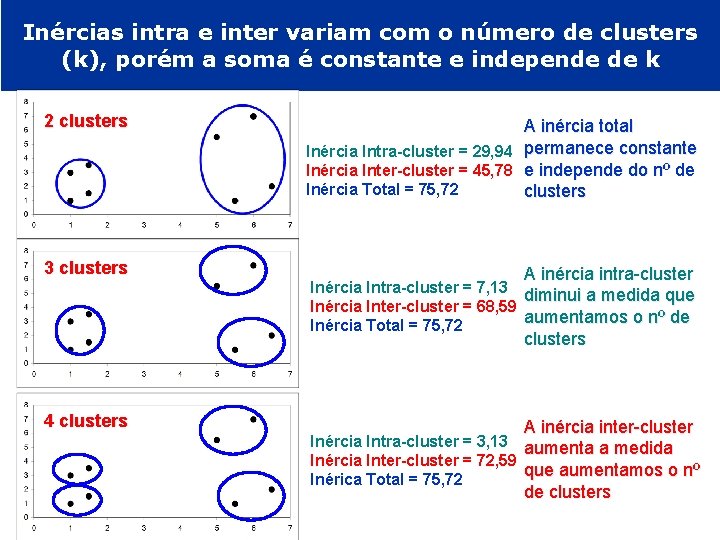

Inércias intra e inter variam com o número de clusters (k), porém a soma é constante e independe de k 2 clusters A inércia total Inércia Intra-cluster = 29, 94 permanece constante Inércia Inter-cluster = 45, 78 e independe do nº de Inércia Total = 75, 72 clusters 3 clusters A inércia intra-cluster Inércia Intra-cluster = 7, 13 diminui a medida que Inércia Inter-cluster = 68, 59 aumentamos o nº de Inércia Total = 75, 72 clusters 4 clusters A inércia inter-cluster Inércia Intra-cluster = 3, 13 aumenta a medida Inércia Inter-cluster = 72, 59 que aumentamos o nº Inérica Total = 75, 72 de clusters

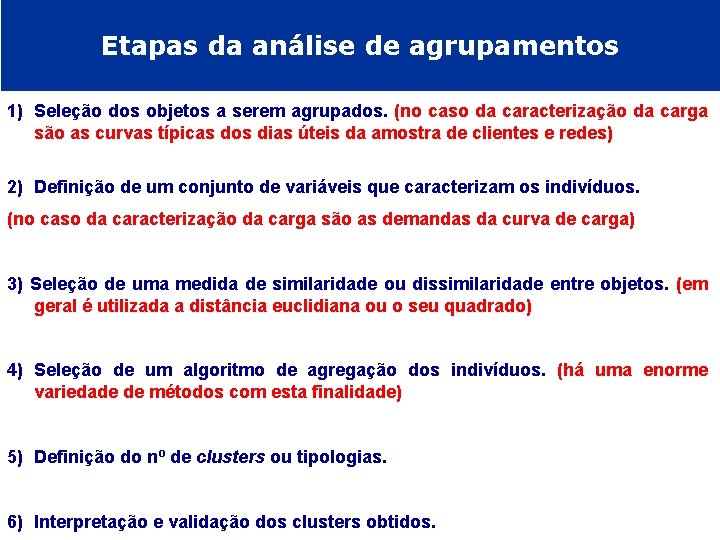

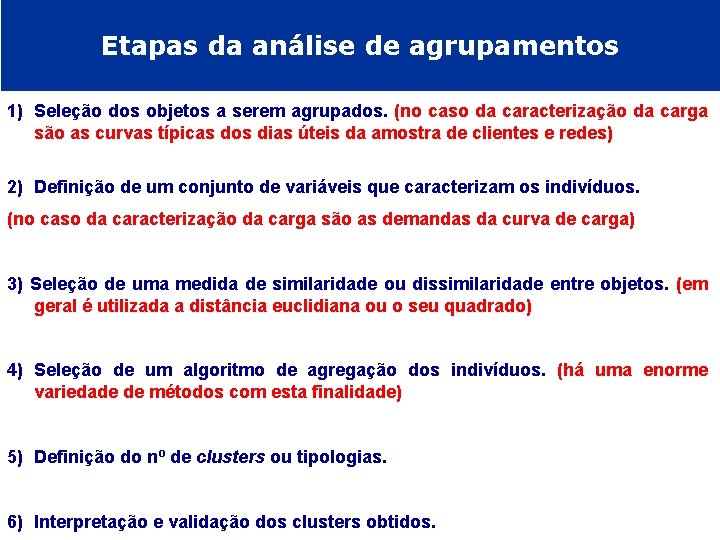

Etapas da análise de agrupamentos 1) Seleção dos objetos a serem agrupados. (no caso da caracterização da carga são as curvas típicas dos dias úteis da amostra de clientes e redes) 2) Definição de um conjunto de variáveis que caracterizam os indivíduos. (no caso da caracterização da carga são as demandas da curva de carga) 3) Seleção de uma medida de similaridade ou dissimilaridade entre objetos. (em geral é utilizada a distância euclidiana ou o seu quadrado) 4) Seleção de um algoritmo de agregação dos indivíduos. (há uma enorme variedade de métodos com esta finalidade) 5) Definição do nº de clusters ou tipologias. 6) Interpretação e validação dos clusters obtidos.

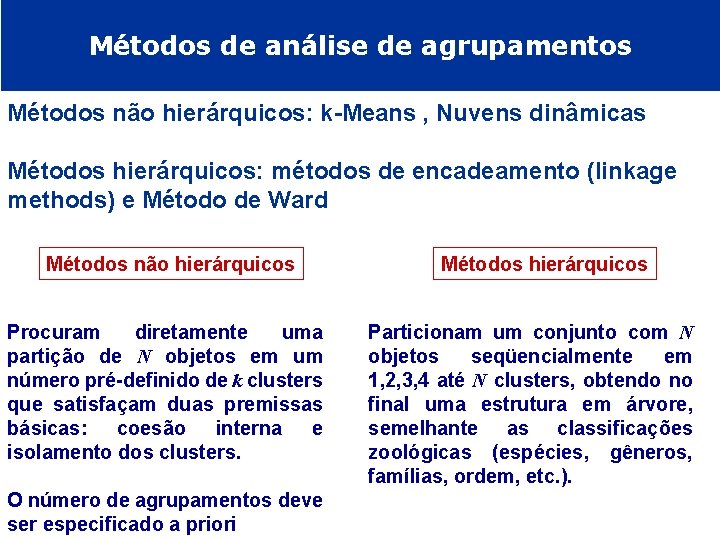

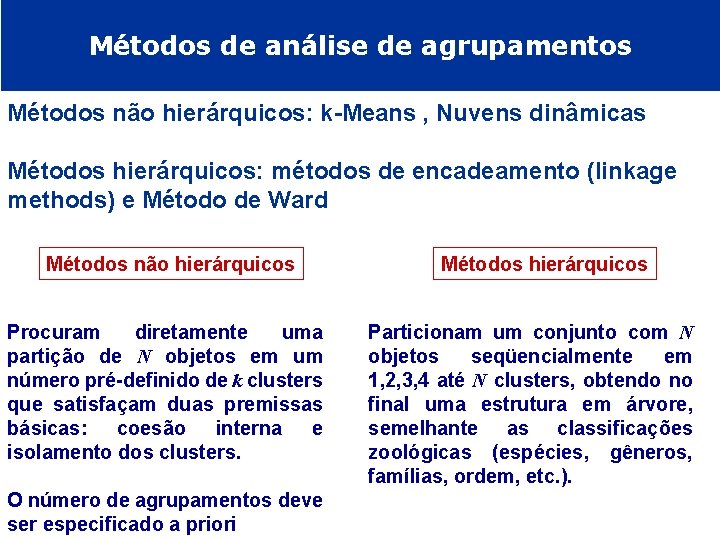

Métodos de análise de agrupamentos Métodos não hierárquicos: k-Means , Nuvens dinâmicas Métodos hierárquicos: métodos de encadeamento (linkage methods) e Método de Ward Métodos não hierárquicos Procuram diretamente uma partição de N objetos em um número pré-definido de k clusters que satisfaçam duas premissas básicas: coesão interna e isolamento dos clusters. O número de agrupamentos deve ser especificado a priori Métodos hierárquicos Particionam um conjunto com N objetos seqüencialmente em 1, 2, 3, 4 até N clusters, obtendo no final uma estrutura em árvore, semelhante as classificações zoológicas (espécies, gêneros, famílias, ordem, etc. ).

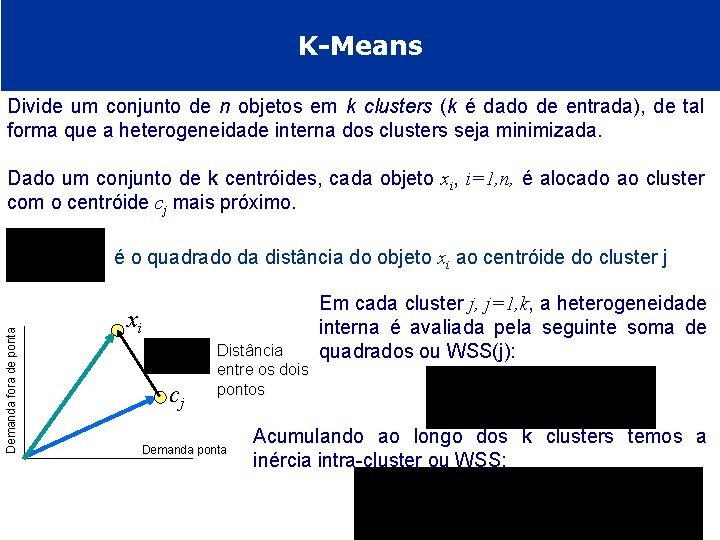

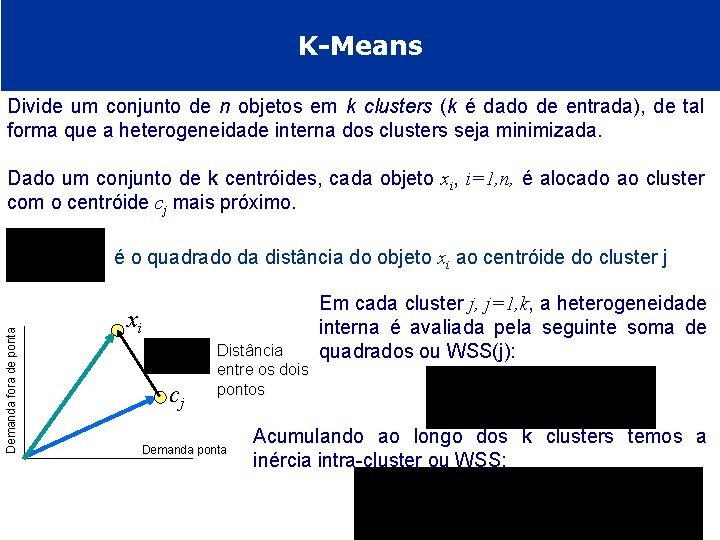

K-Means Divide um conjunto de n objetos em k clusters (k é dado de entrada), de tal forma que a heterogeneidade interna dos clusters seja minimizada. Dado um conjunto de k centróides, cada objeto xi, i=1, n, é alocado ao cluster com o centróide cj mais próximo. Demanda fora de ponta é o quadrado da distância do objeto xi ao centróide do cluster j xi cj Distância entre os dois pontos Demanda ponta Em cada cluster j, j=1, k, a heterogeneidade interna é avaliada pela seguinte soma de quadrados ou WSS(j): Acumulando ao longo dos k clusters temos a inércia intra-cluster ou WSS:

K-Means Quanto menor WSS(j), menor é a heterogeneidade do j-ésimo cluster. Logo, para minimizar a heterogeneidade interna dos clusters devemos minimizar a inércia intra-cluster (WSS). Menor heterogeneidade interna dos clusters Menor Inércia Intra-cluster (WSS) Dado que o objetivo é dividir o conjunto de n objetos em k clusters tal que a heterogeneidade interna dos clusters seja mínima, devemos identificar os k centróides cj , j=1, k , que minimizem a inércia intra-cluster (WSS).

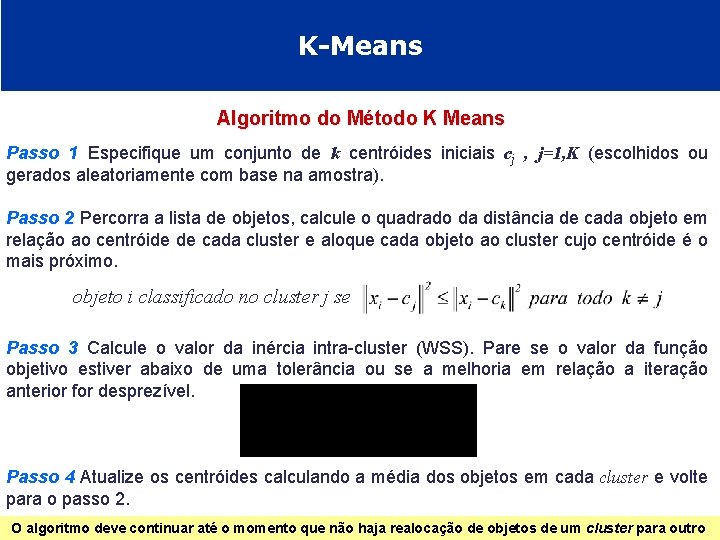

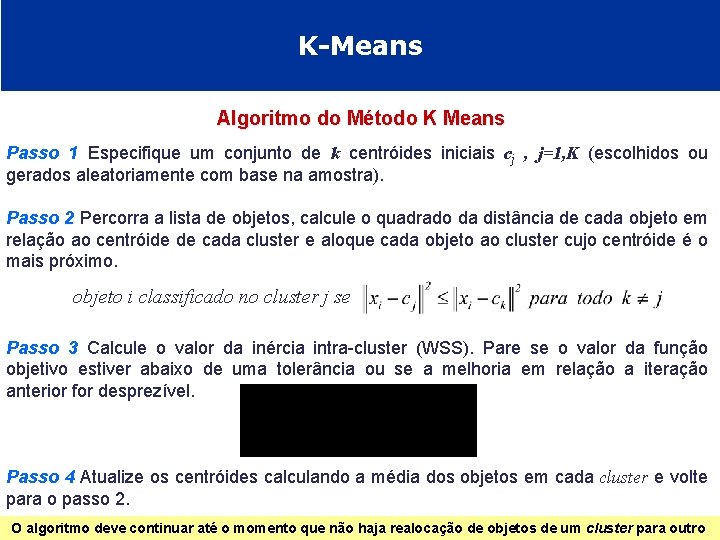

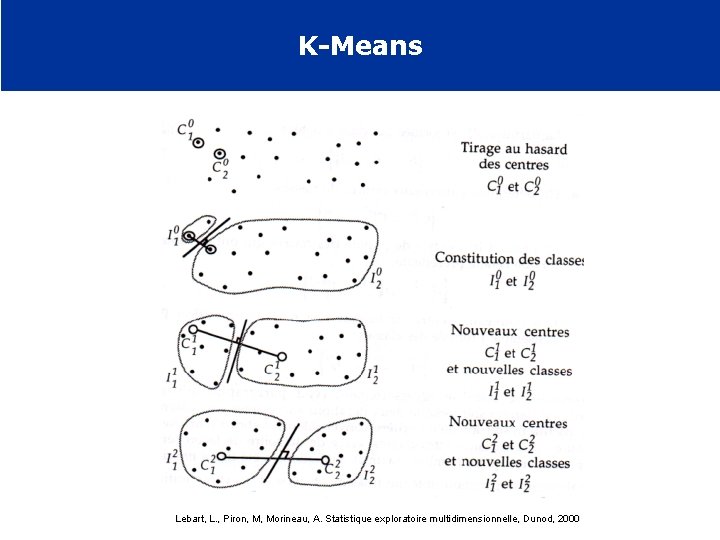

K-Means Algoritmo do Método K Means Passo 1 Especifique um conjunto de k centróides iniciais cj , j=1, K (escolhidos ou gerados aleatoriamente com base na amostra). Passo 2 Percorra a lista de objetos, calcule o quadrado da distância de cada objeto em relação ao centróide de cada cluster e aloque cada objeto ao cluster cujo centróide é o mais próximo. objeto i classificado no cluster j se Passo 3 Calcule o valor da inércia intra-cluster (WSS). Pare se o valor da função objetivo estiver abaixo de uma tolerância ou se a melhoria em relação a iteração anterior for desprezível. Passo 4 Atualize os centróides calculando a média dos objetos em cada cluster e volte para o passo 2. O algoritmo deve continuar até o momento que não haja realocação de objetos de um cluster para outro

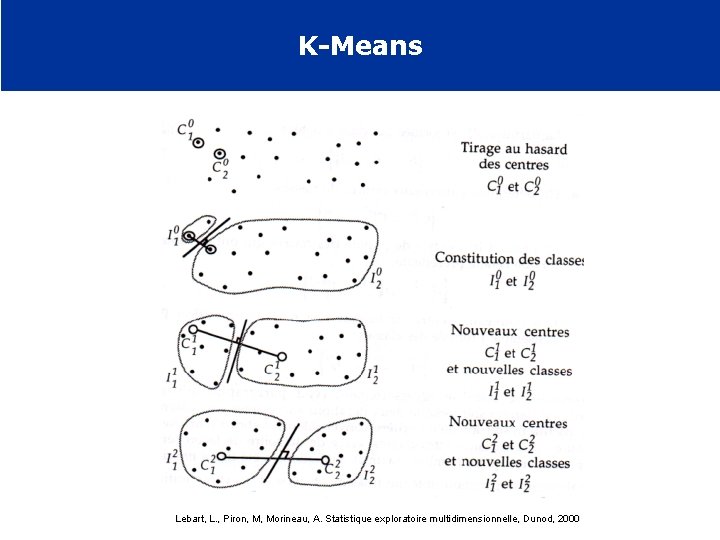

K-Means Lebart, L. , Piron, M, Morineau, A. Statistique exploratoire multidimensionnelle, Dunod, 2000

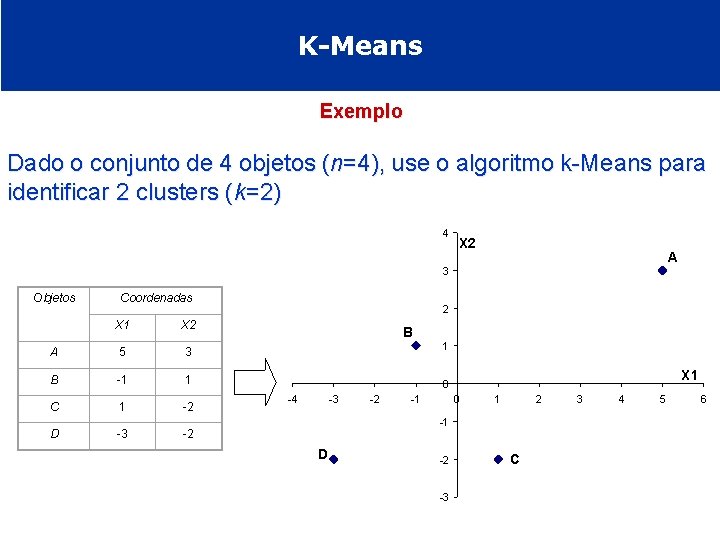

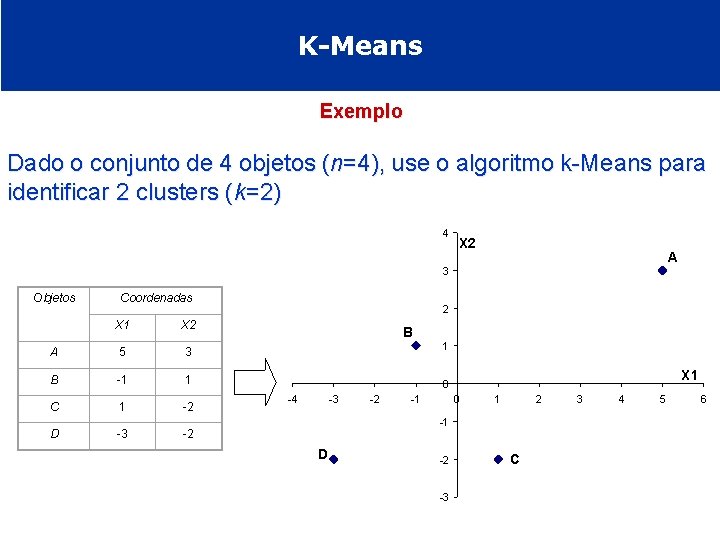

K-Means Exemplo Dado o conjunto de 4 objetos (n=4), use o algoritmo k-Means para identificar 2 clusters (k=2) 4 X 2 A 3 Objetos Coordenadas X 1 X 2 A 5 3 B -1 1 C 1 -2 D -3 -2 2 B 1 X 1 0 -4 -3 -2 -1 0 1 2 -1 D -2 -3 C 3 4 5 6

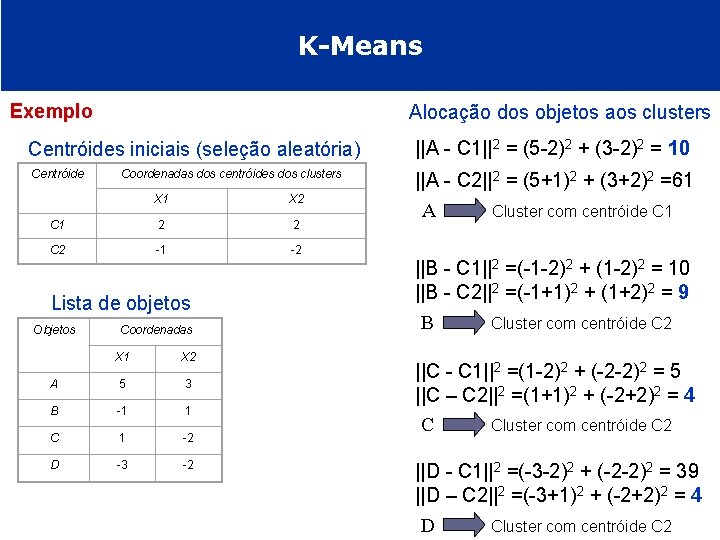

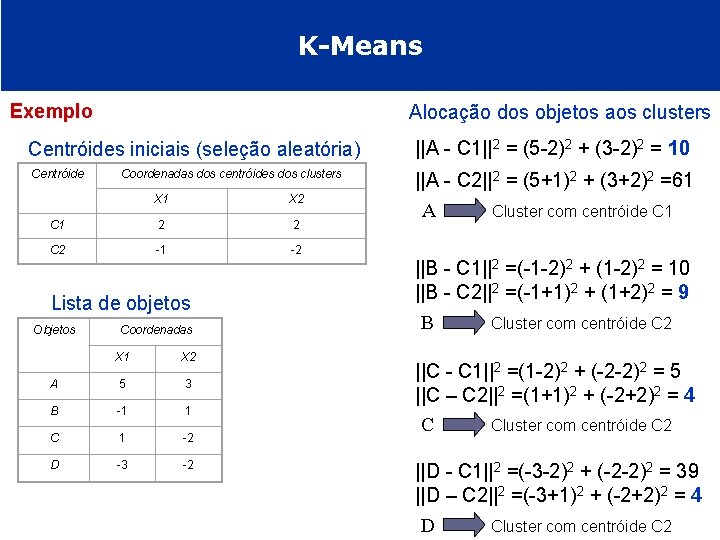

K-Means Exemplo Alocação dos objetos aos clusters Centróides iniciais (seleção aleatória) ||A - C 1||2 = (5 -2)2 + (3 -2)2 = 10 Centróide ||A - C 2||2 = (5+1)2 + (3+2)2 =61 Coordenadas dos centróides dos clusters X 1 X 2 C 1 2 2 C 2 -1 -2 Lista de objetos Objetos Coordenadas X 1 X 2 A 5 3 B -1 1 C 1 -2 D -3 -2 A Cluster com centróide C 1 ||B - C 1||2 =(-1 -2)2 + (1 -2)2 = 10 ||B - C 2||2 =(-1+1)2 + (1+2)2 = 9 B Cluster com centróide C 2 ||C - C 1||2 =(1 -2)2 + (-2 -2)2 = 5 ||C – C 2||2 =(1+1)2 + (-2+2)2 = 4 C Cluster com centróide C 2 ||D - C 1||2 =(-3 -2)2 + (-2 -2)2 = 39 ||D – C 2||2 =(-3+1)2 + (-2+2)2 = 4 D Cluster com centróide C 2

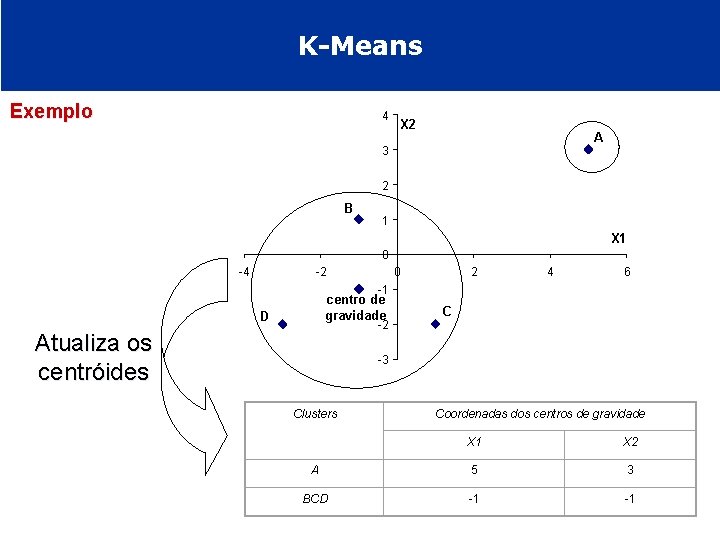

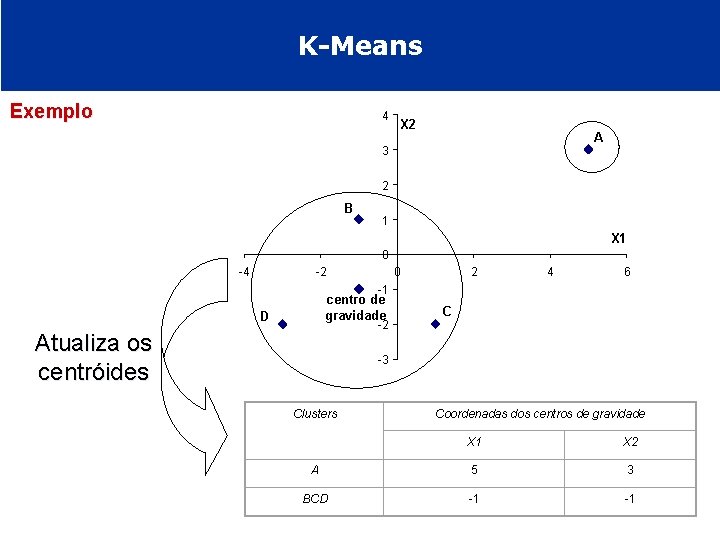

K-Means Exemplo 4 X 2 A 3 2 B 1 X 1 0 -4 -2 0 2 4 6 -1 centro de gravidade D C -2 Atualiza os centróides -3 Clusters Coordenadas dos centros de gravidade X 1 X 2 A 5 3 BCD -1 -1

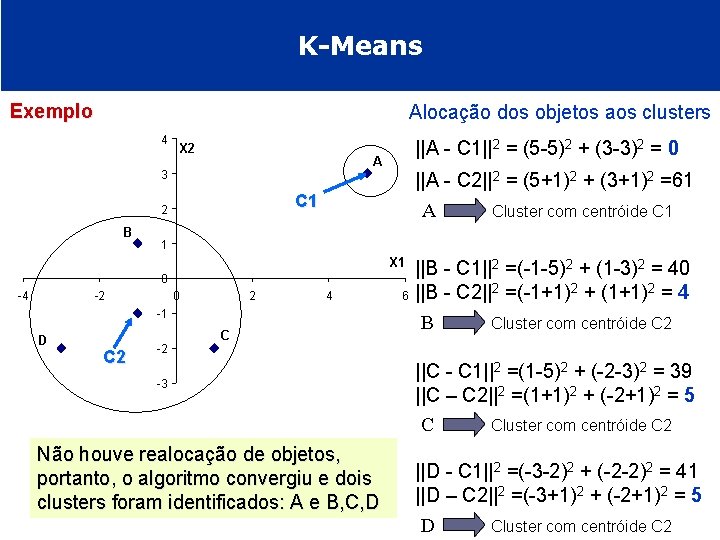

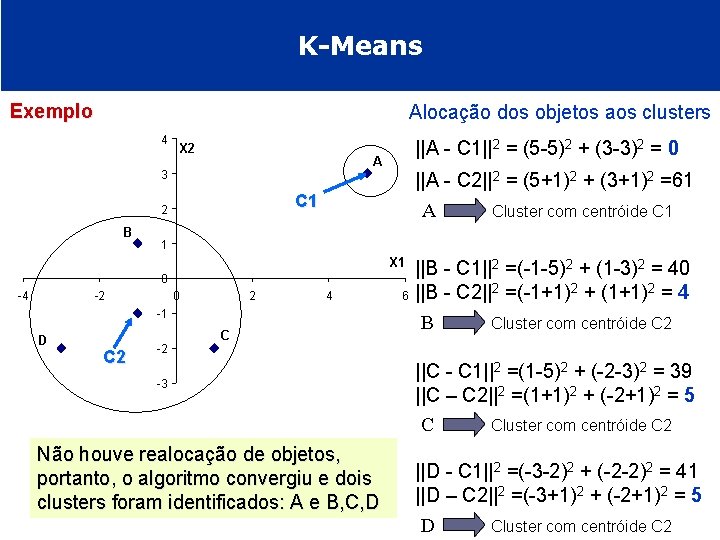

K-Means Exemplo Alocação dos objetos aos clusters 4 X 2 A 3 ||A - C 2||2 = (5+1)2 + (3+1)2 =61 C 1 2 B ||A - C 1||2 = (5 -5)2 + (3 -3)2 = 0 A Cluster com centróide C 1 1 X 1 0 -4 -2 0 2 4 -1 D C C 2 ||B - C 1||2 =(-1 -5)2 + (1 -3)2 = 40 2 2 2 6 ||B - C 2|| =(-1+1) + (1+1) = 4 B Cluster com centróide C 2 -2 -3 Não houve realocação de objetos, portanto, o algoritmo convergiu e dois clusters foram identificados: A e B, C, D ||C - C 1||2 =(1 -5)2 + (-2 -3)2 = 39 ||C – C 2||2 =(1+1)2 + (-2+1)2 = 5 C Cluster com centróide C 2 ||D - C 1||2 =(-3 -2)2 + (-2 -2)2 = 41 ||D – C 2||2 =(-3+1)2 + (-2+1)2 = 5 D Cluster com centróide C 2

K-Means Vantagens § Tendem a maximizar a dispersão entre os centros de gravidade dos clusters (clusters bem separados). § Simplicidade de cálculo, calcula somente as distâncias entre os objetos e os centros de gravidade dos clusters. Desvantagens § A solução é dependente dos conjuntos de sementes iniciais, principalmente se a seleção das sementes é aleatória. § Não há garantias de um agrupamento ótimo dos objetos.

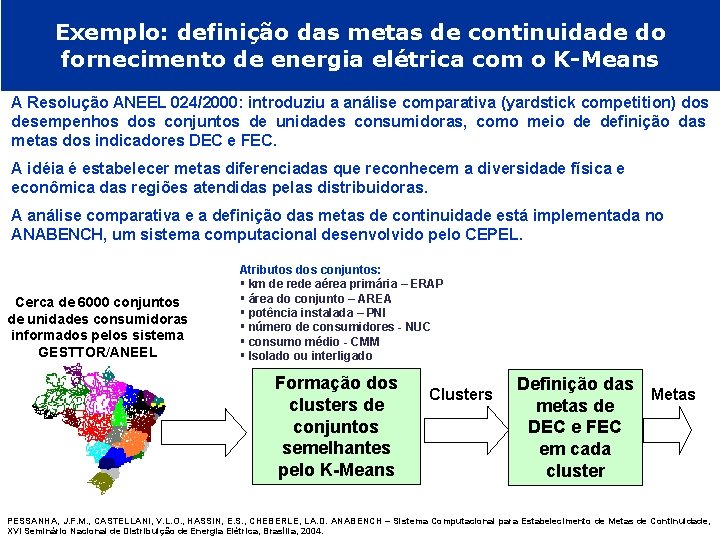

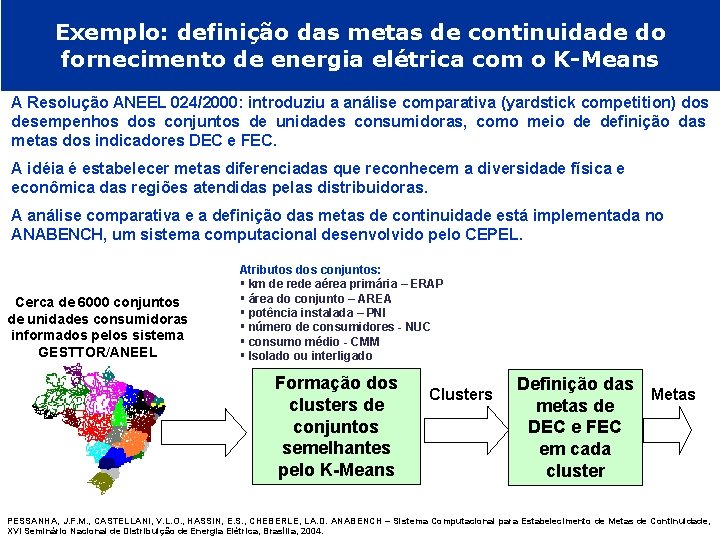

Exemplo: definição das metas de continuidade do fornecimento de energia elétrica com o K-Means A Resolução ANEEL 024/2000: introduziu a análise comparativa (yardstick competition) dos desempenhos dos conjuntos de unidades consumidoras, como meio de definição das metas dos indicadores DEC e FEC. A idéia é estabelecer metas diferenciadas que reconhecem a diversidade física e econômica das regiões atendidas pelas distribuidoras. A análise comparativa e a definição das metas de continuidade está implementada no ANABENCH, um sistema computacional desenvolvido pelo CEPEL. Cerca de 6000 conjuntos de unidades consumidoras informados pelos sistema GESTTOR/ANEEL Atributos dos conjuntos: § km de rede aérea primária – ERAP § área do conjunto – AREA § potência instalada – PNI § número de consumidores - NUC § consumo médio - CMM § Isolado ou interligado Formação dos clusters de conjuntos semelhantes pelo K-Means Clusters Definição das Metas metas de DEC e FEC em cada cluster PESSANHA, J. F. M. , CASTELLANI, V. L. O. , HASSIN, E. S. , CHEBERLE, LA. D. ANABENCH – Sistema Computacional para Estabelecimento de Metas de Continuidade, XVI Seminário Nacional de Distribuição de Energia Elétrica, Brasília, 2004.

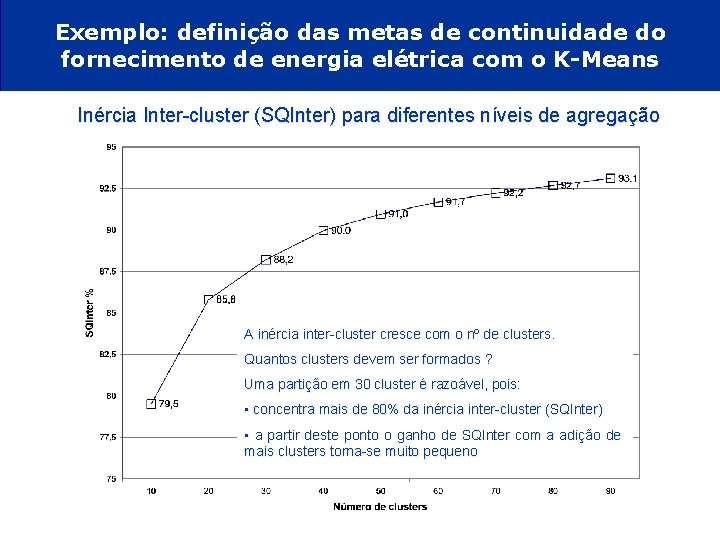

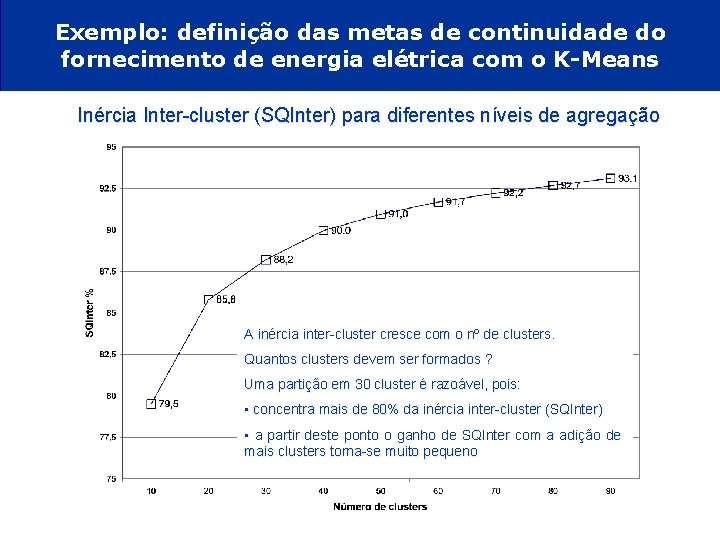

Exemplo: definição das metas de continuidade do fornecimento de energia elétrica com o K-Means Inércia Inter-cluster (SQInter) para diferentes níveis de agregação A inércia inter-cluster cresce com o nº de clusters. Quantos clusters devem ser formados ? Uma partição em 30 cluster é razoável, pois: • concentra mais de 80% da inércia inter-cluster (SQInter) • a partir deste ponto o ganho de SQInter com a adição de mais clusters torna-se muito pequeno

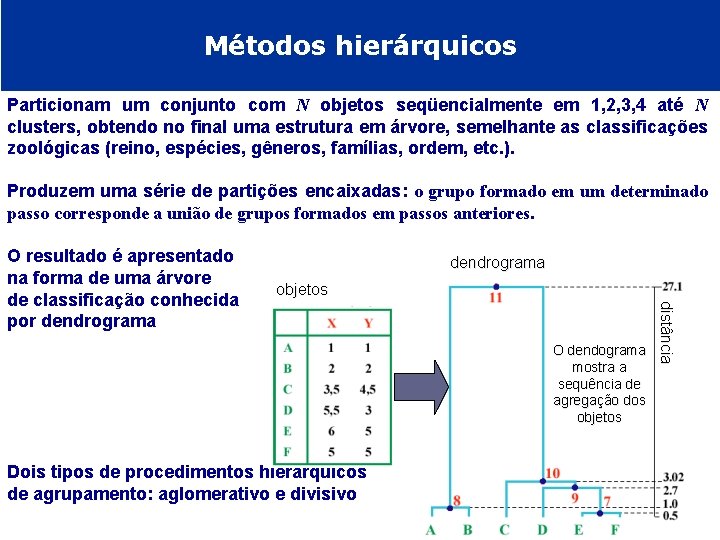

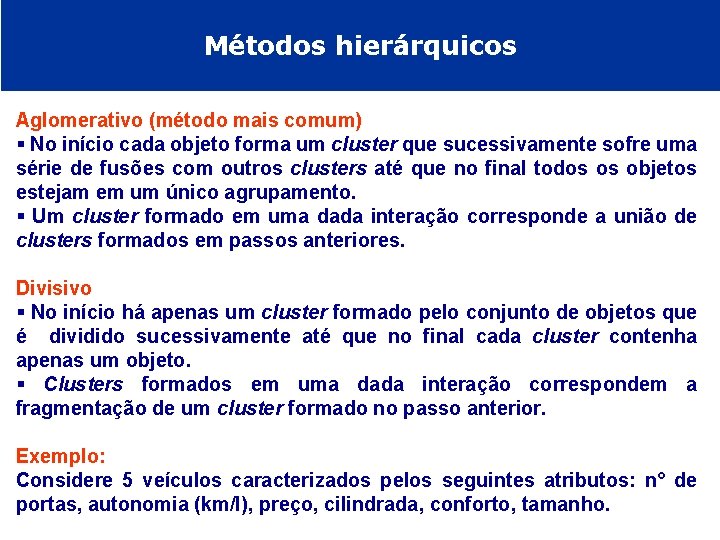

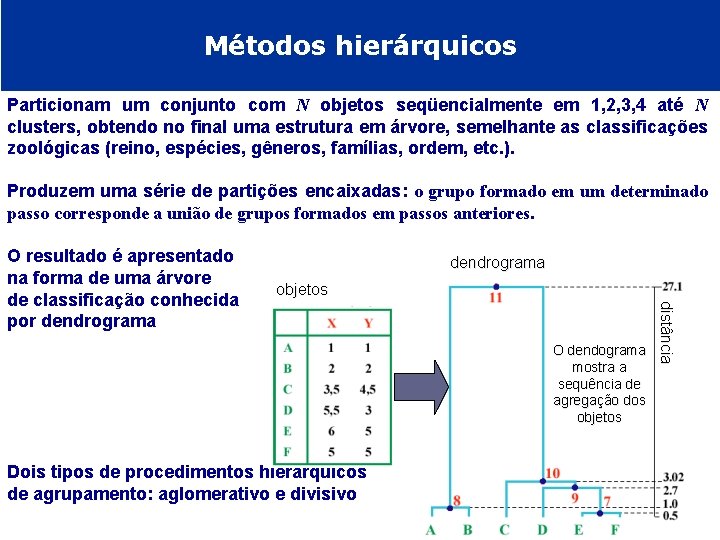

Métodos hierárquicos Particionam um conjunto com N objetos seqüencialmente em 1, 2, 3, 4 até N clusters, obtendo no final uma estrutura em árvore, semelhante as classificações zoológicas (reino, espécies, gêneros, famílias, ordem, etc. ). Produzem uma série de partições encaixadas: o grupo formado em um determinado passo corresponde a união de grupos formados em passos anteriores. dendrograma objetos O dendograma mostra a sequência de agregação dos objetos Dois tipos de procedimentos hierárquicos de agrupamento: aglomerativo e divisivo distância O resultado é apresentado na forma de uma árvore de classificação conhecida por dendrograma

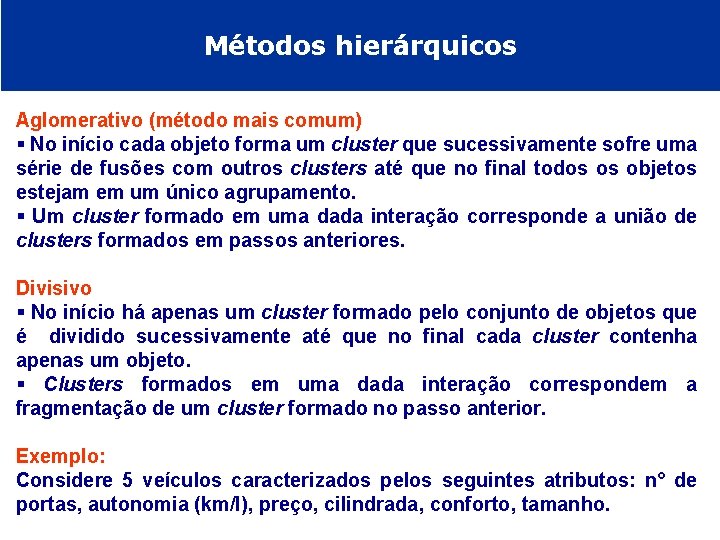

Métodos hierárquicos Aglomerativo (método mais comum) § No início cada objeto forma um cluster que sucessivamente sofre uma série de fusões com outros clusters até que no final todos os objetos estejam em um único agrupamento. § Um cluster formado em uma dada interação corresponde a união de clusters formados em passos anteriores. Divisivo § No início há apenas um cluster formado pelo conjunto de objetos que é dividido sucessivamente até que no final cada cluster contenha apenas um objeto. § Clusters formados em uma dada interação correspondem a fragmentação de um cluster formado no passo anterior. Exemplo: Considere 5 veículos caracterizados pelos seguintes atributos: n° de portas, autonomia (km/l), preço, cilindrada, conforto, tamanho.

Métodos hierárquicos divisivos

Métodos hierárquicos aglomerativos

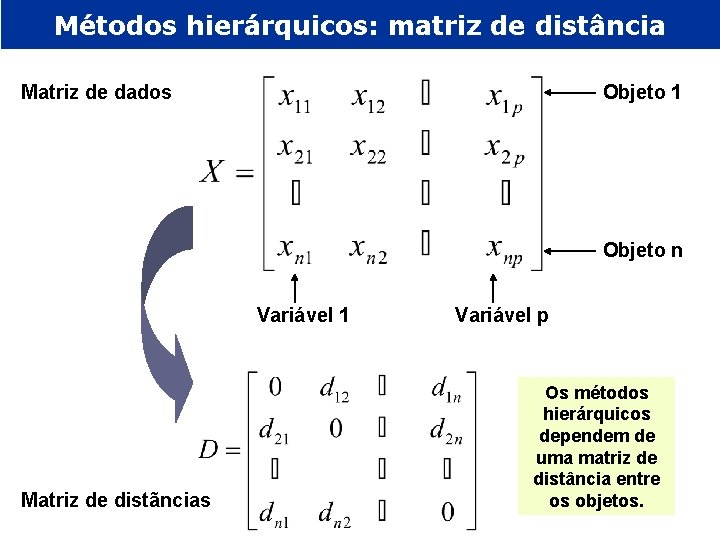

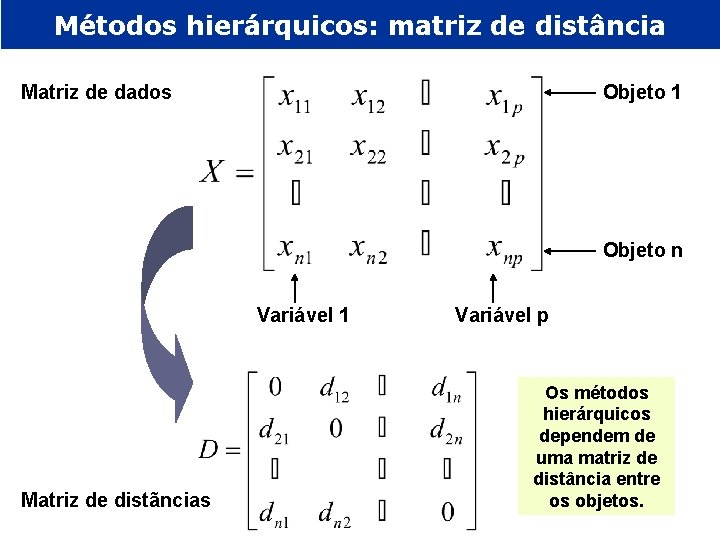

Métodos hierárquicos: matriz de distância Objeto 1 Matriz de dados Objeto n Variável 1 Matriz de distãncias Variável p Os métodos hierárquicos dependem de uma matriz de distância entre os objetos.

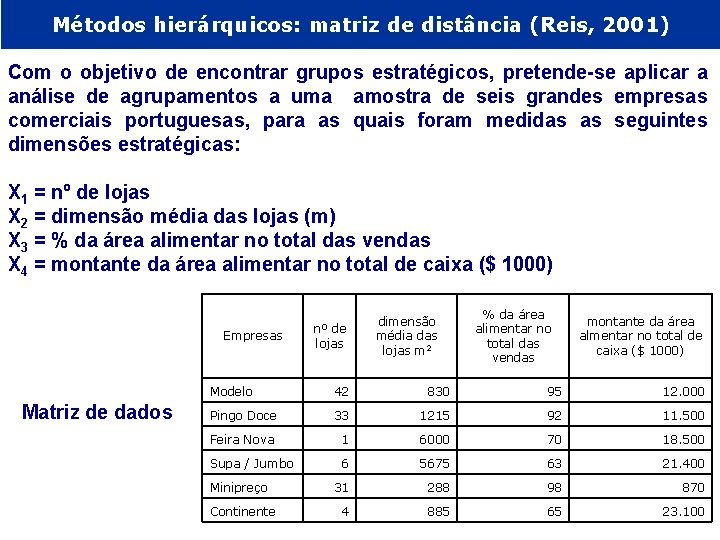

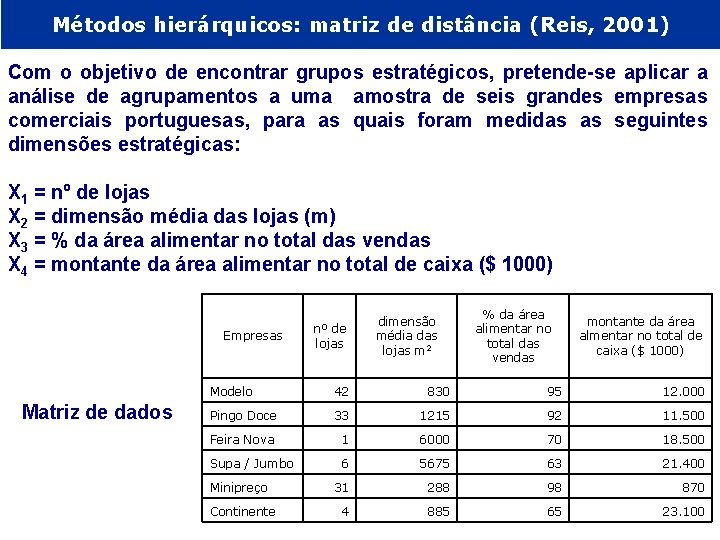

Métodos hierárquicos: matriz de distância (Reis, 2001) Com o objetivo de encontrar grupos estratégicos, pretende-se aplicar a análise de agrupamentos a uma amostra de seis grandes empresas comerciais portuguesas, para as quais foram medidas as seguintes dimensões estratégicas: X 1 = nº de lojas X 2 = dimensão média das lojas (m) X 3 = % da área alimentar no total das vendas X 4 = montante da área alimentar no total de caixa ($ 1000) Empresas Matriz de dados nº de lojas dimensão média das lojas m 2 % da área alimentar no total das vendas montante da área almentar no total de caixa ($ 1000) Modelo 42 830 95 12. 000 Pingo Doce 33 1215 92 11. 500 Feira Nova 1 6000 70 18. 500 Supa / Jumbo 6 5675 63 21. 400 31 288 98 870 4 885 65 23. 100 Minipreço Continente

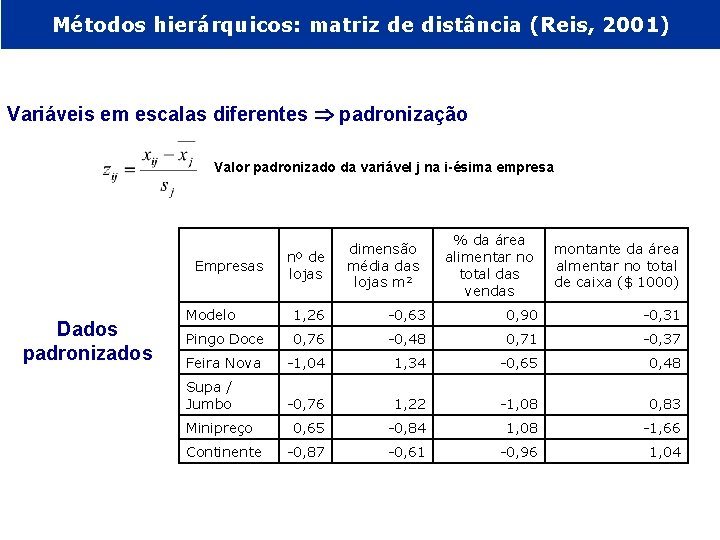

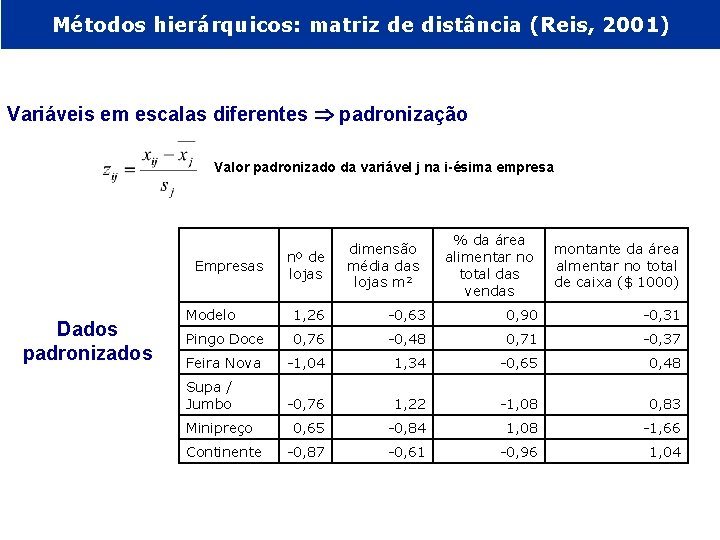

Métodos hierárquicos: matriz de distância (Reis, 2001) Variáveis em escalas diferentes padronização Valor padronizado da variável j na i-ésima empresa Empresas Dados padronizados nº de lojas dimensão média das lojas m 2 % da área alimentar no total das vendas montante da área almentar no total de caixa ($ 1000) Modelo 1, 26 -0, 63 0, 90 -0, 31 Pingo Doce 0, 76 -0, 48 0, 71 -0, 37 Feira Nova -1, 04 1, 34 -0, 65 0, 48 Supa / Jumbo -0, 76 1, 22 -1, 08 0, 83 0, 65 -0, 84 1, 08 -1, 66 -0, 87 -0, 61 -0, 96 1, 04 Minipreço Continente

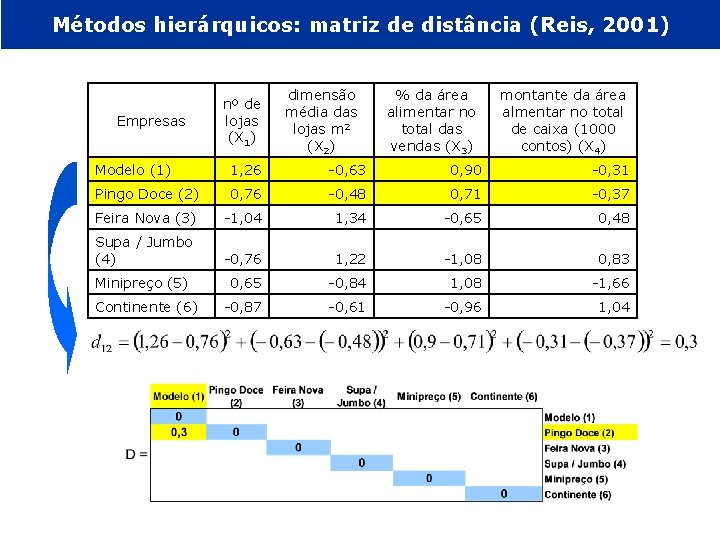

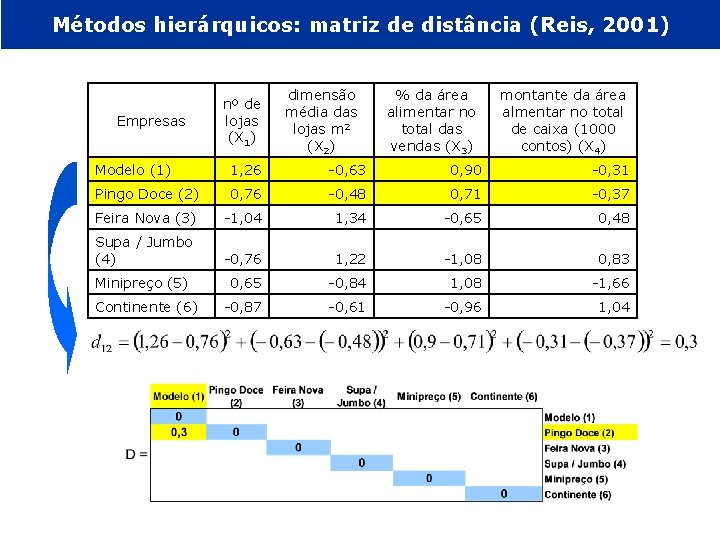

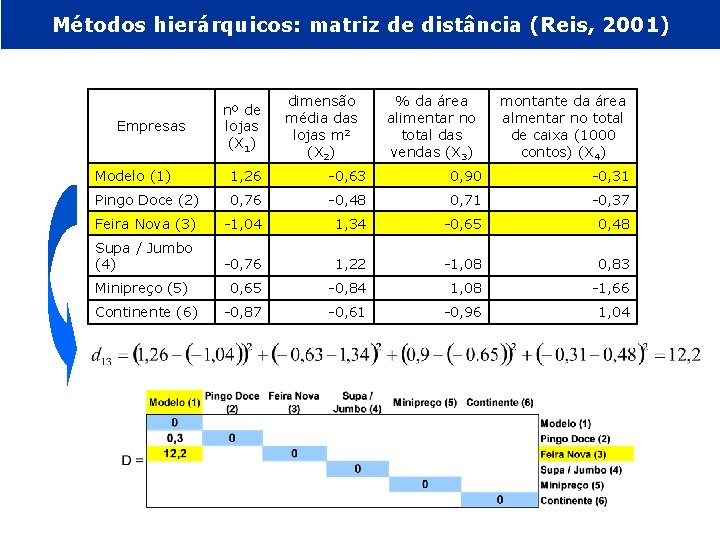

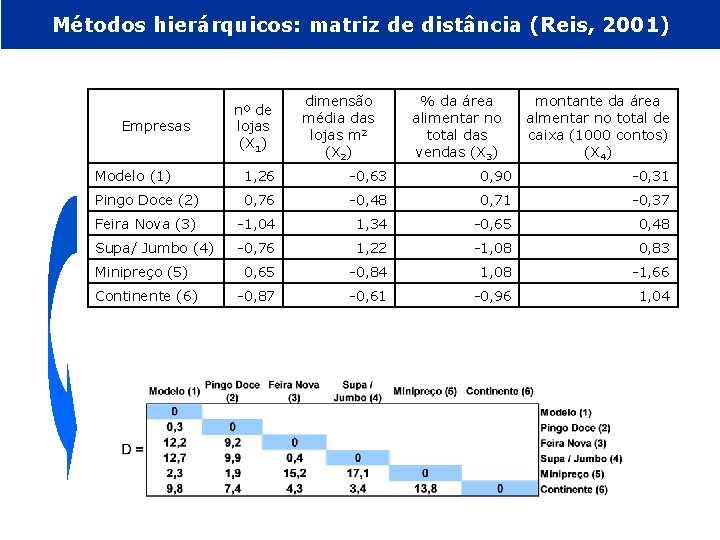

Métodos hierárquicos: matriz de distância (Reis, 2001) Empresas nº de lojas (X 1) dimensão média das lojas m 2 (X 2) % da área alimentar no total das vendas (X 3) montante da área almentar no total de caixa (1000 contos) (X 4) Modelo (1) 1, 26 -0, 63 0, 90 -0, 31 Pingo Doce (2) 0, 76 -0, 48 0, 71 -0, 37 Feira Nova (3) -1, 04 1, 34 -0, 65 0, 48 Supa / Jumbo (4) -0, 76 1, 22 -1, 08 0, 83 Minipreço (5) 0, 65 -0, 84 1, 08 -1, 66 -0, 87 -0, 61 -0, 96 1, 04 Continente (6)

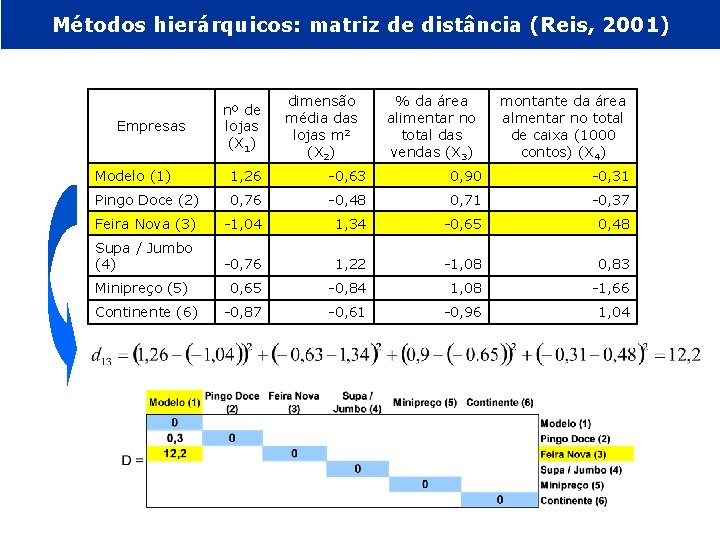

Métodos hierárquicos: matriz de distância (Reis, 2001) Empresas nº de lojas (X 1) dimensão média das lojas m 2 (X 2) % da área alimentar no total das vendas (X 3) montante da área almentar no total de caixa (1000 contos) (X 4) Modelo (1) 1, 26 -0, 63 0, 90 -0, 31 Pingo Doce (2) 0, 76 -0, 48 0, 71 -0, 37 Feira Nova (3) -1, 04 1, 34 -0, 65 0, 48 Supa / Jumbo (4) -0, 76 1, 22 -1, 08 0, 83 Minipreço (5) 0, 65 -0, 84 1, 08 -1, 66 -0, 87 -0, 61 -0, 96 1, 04 Continente (6)

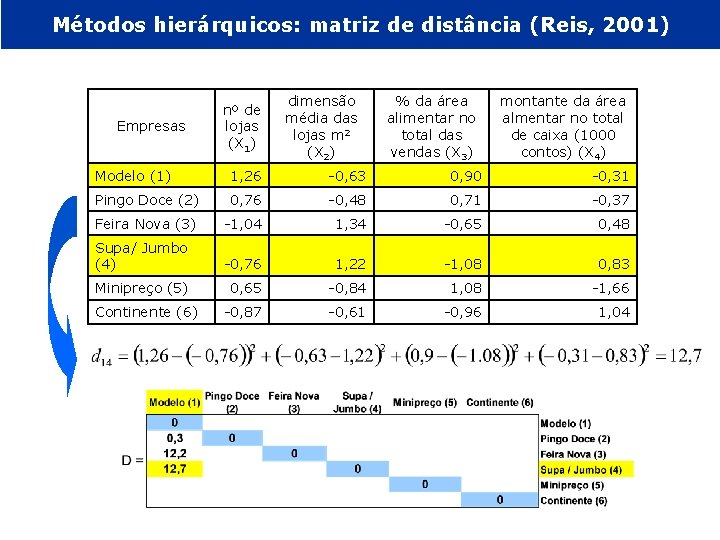

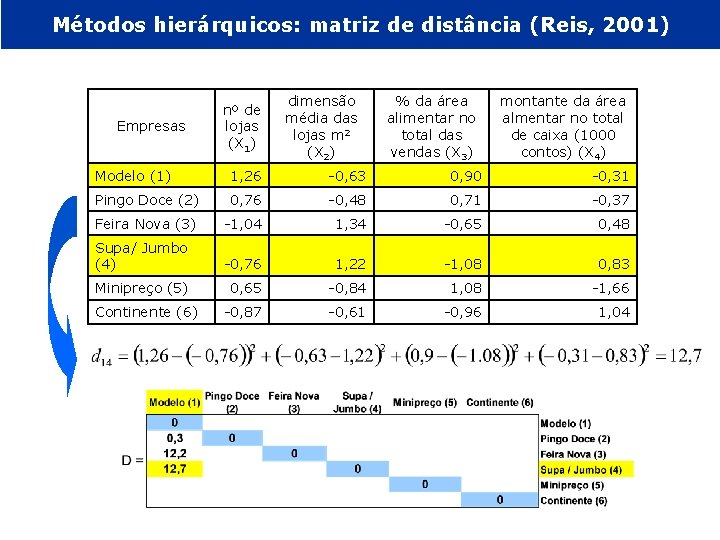

Métodos hierárquicos: matriz de distância (Reis, 2001) Empresas nº de lojas (X 1) dimensão média das lojas m 2 (X 2) % da área alimentar no total das vendas (X 3) montante da área almentar no total de caixa (1000 contos) (X 4) Modelo (1) 1, 26 -0, 63 0, 90 -0, 31 Pingo Doce (2) 0, 76 -0, 48 0, 71 -0, 37 Feira Nova (3) -1, 04 1, 34 -0, 65 0, 48 Supa/ Jumbo (4) -0, 76 1, 22 -1, 08 0, 83 Minipreço (5) 0, 65 -0, 84 1, 08 -1, 66 -0, 87 -0, 61 -0, 96 1, 04 Continente (6)

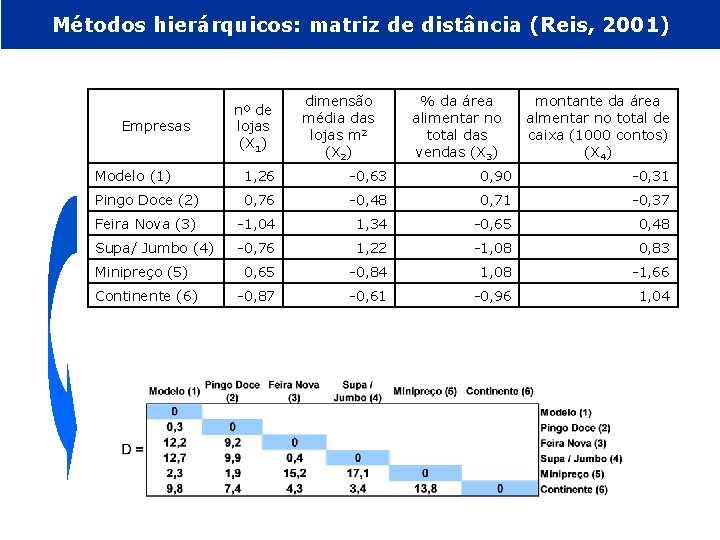

Métodos hierárquicos: matriz de distância (Reis, 2001) Empresas nº de lojas (X 1) dimensão média das lojas m 2 (X 2) % da área alimentar no total das vendas (X 3) montante da área almentar no total de caixa (1000 contos) (X 4) Modelo (1) 1, 26 -0, 63 0, 90 -0, 31 Pingo Doce (2) 0, 76 -0, 48 0, 71 -0, 37 Feira Nova (3) -1, 04 1, 34 -0, 65 0, 48 Supa/ Jumbo (4) -0, 76 1, 22 -1, 08 0, 83 0, 65 -0, 84 1, 08 -1, 66 -0, 87 -0, 61 -0, 96 1, 04 Minipreço (5) Continente (6)

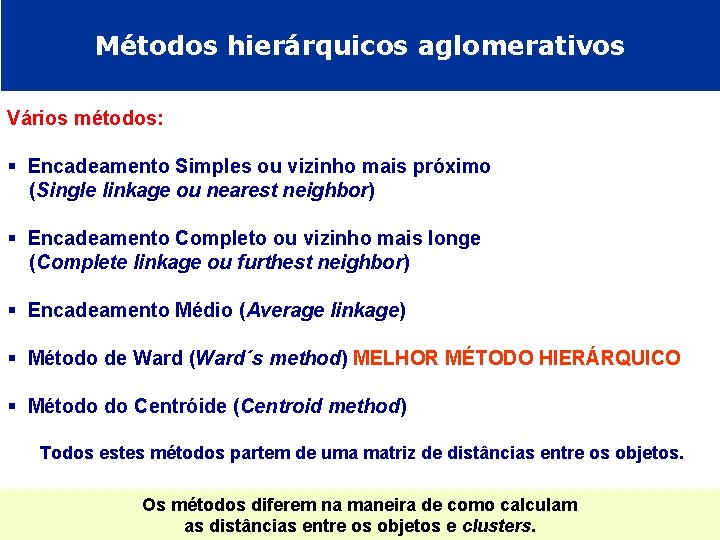

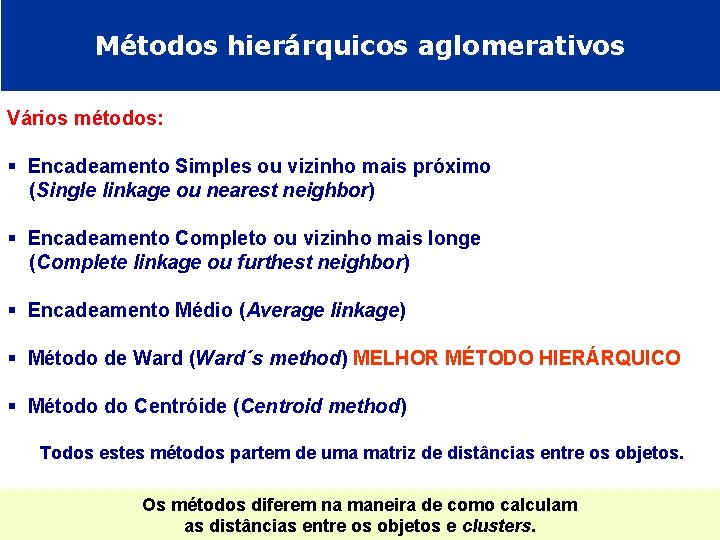

Métodos hierárquicos aglomerativos Vários métodos: § Encadeamento Simples ou vizinho mais próximo (Single linkage ou nearest neighbor) § Encadeamento Completo ou vizinho mais longe (Complete linkage ou furthest neighbor) § Encadeamento Médio (Average linkage) § Método de Ward (Ward´s method) MELHOR MÉTODO HIERÁRQUICO § Método do Centróide (Centroid method) Todos estes métodos partem de uma matriz de distâncias entre os objetos. Os métodos diferem na maneira de como calculam as distâncias entre os objetos e clusters.

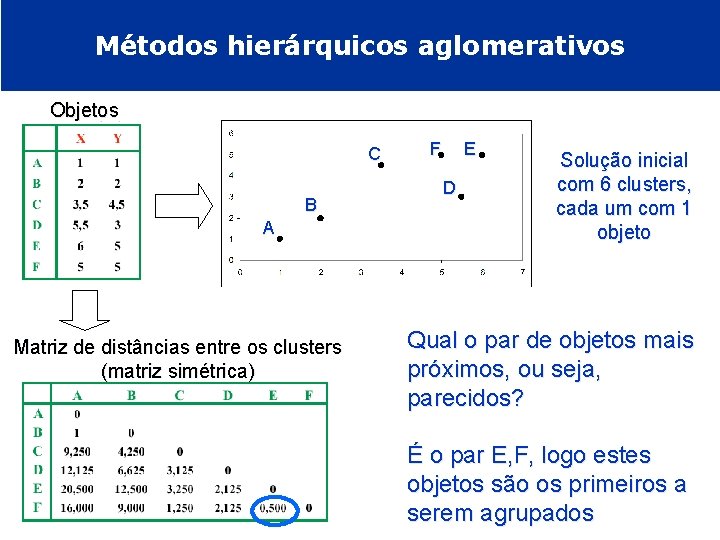

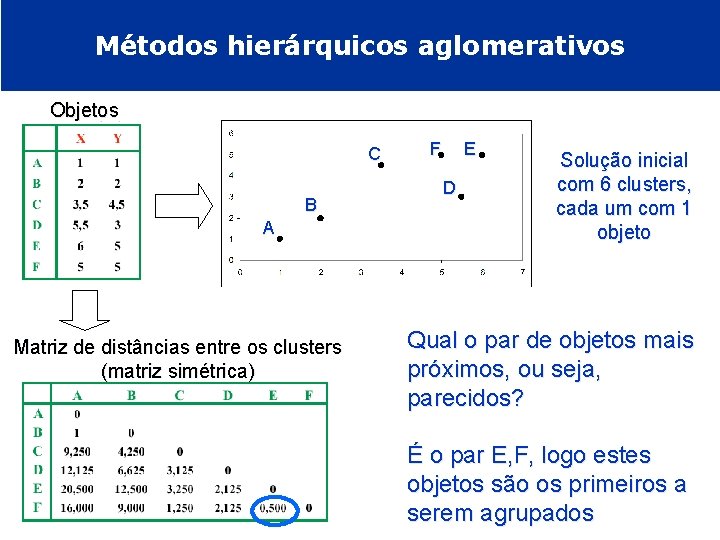

Métodos hierárquicos aglomerativos Objetos C B A Matriz de distâncias entre os clusters (matriz simétrica) F E D Solução inicial com 6 clusters, cada um com 1 objeto Qual o par de objetos mais próximos, ou seja, parecidos? É o par E, F, logo estes objetos são os primeiros a serem agrupados

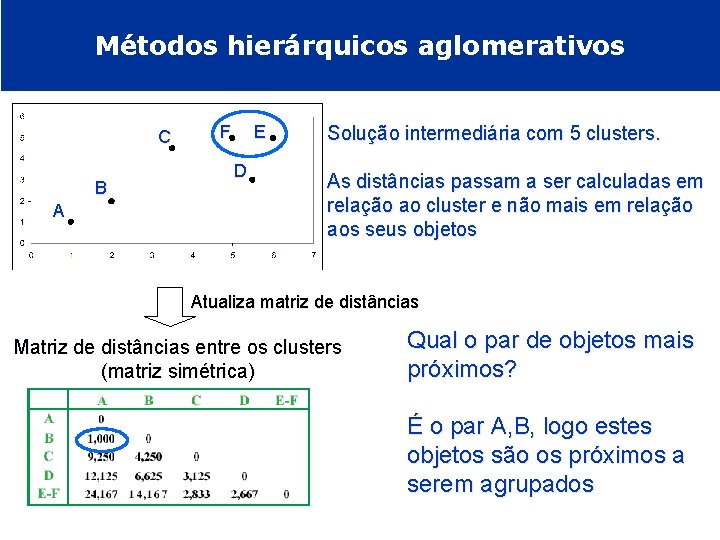

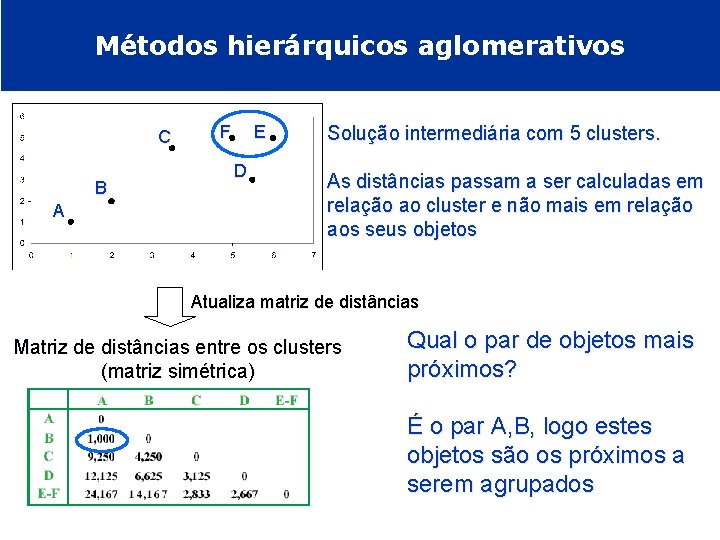

Métodos hierárquicos aglomerativos C B A F E D Solução intermediária com 5 clusters. As distâncias passam a ser calculadas em relação ao cluster e não mais em relação aos seus objetos Atualiza matriz de distâncias Matriz de distâncias entre os clusters (matriz simétrica) Qual o par de objetos mais próximos? É o par A, B, logo estes objetos são os próximos a serem agrupados

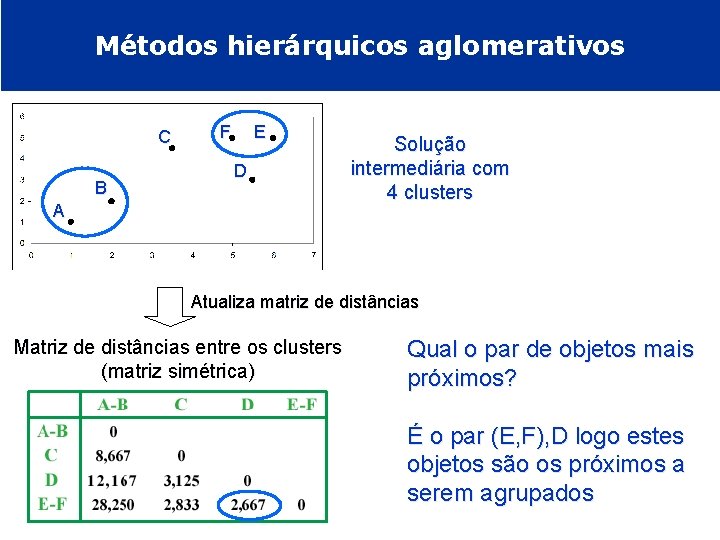

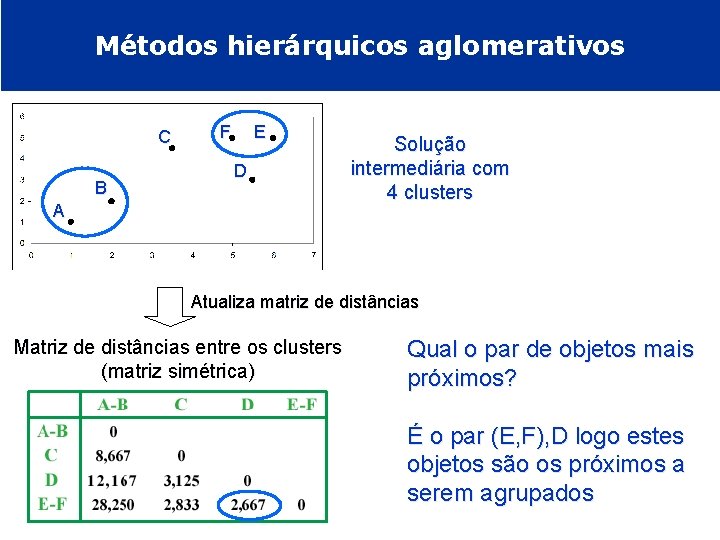

Métodos hierárquicos aglomerativos C B F E D A Solução intermediária com 4 clusters Atualiza matriz de distâncias Matriz de distâncias entre os clusters (matriz simétrica) Qual o par de objetos mais próximos? É o par (E, F), D logo estes objetos são os próximos a serem agrupados

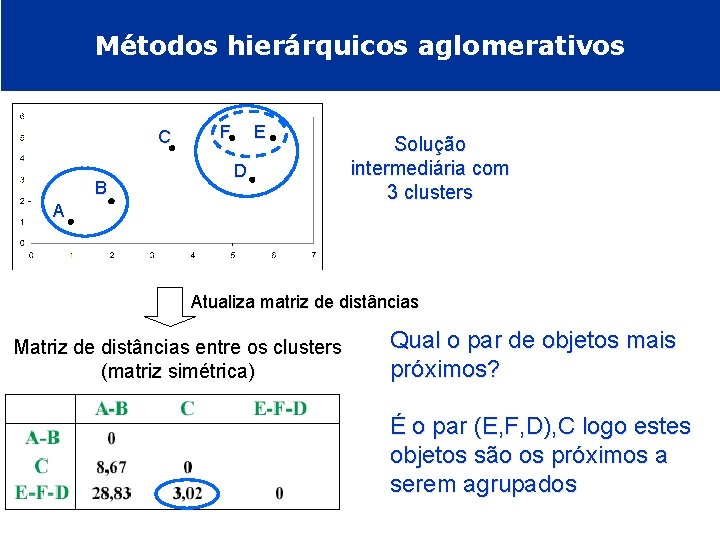

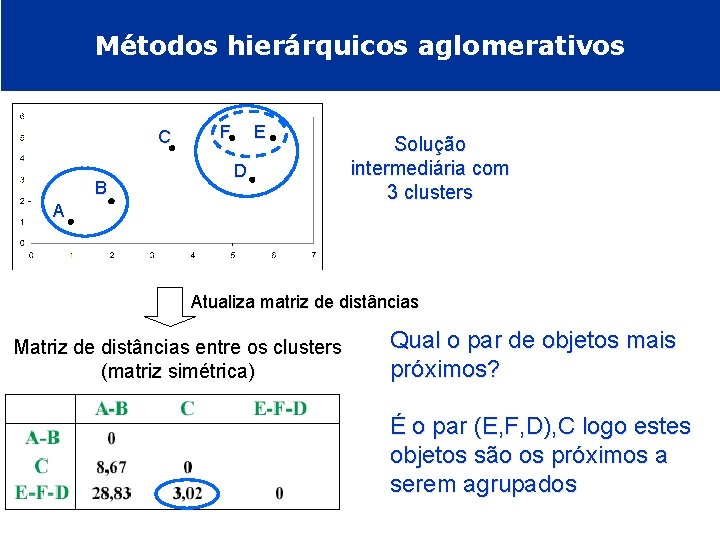

Métodos hierárquicos aglomerativos C B F E D A Solução intermediária com 3 clusters Atualiza matriz de distâncias Matriz de distâncias entre os clusters (matriz simétrica) Qual o par de objetos mais próximos? É o par (E, F, D), C logo estes objetos são os próximos a serem agrupados

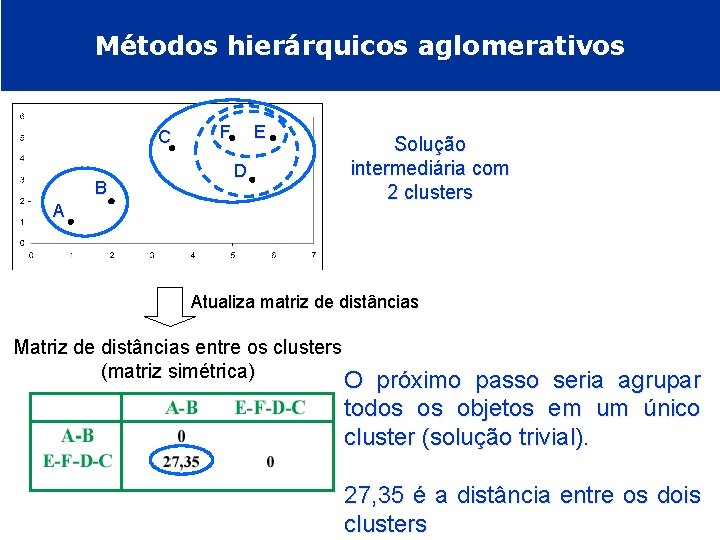

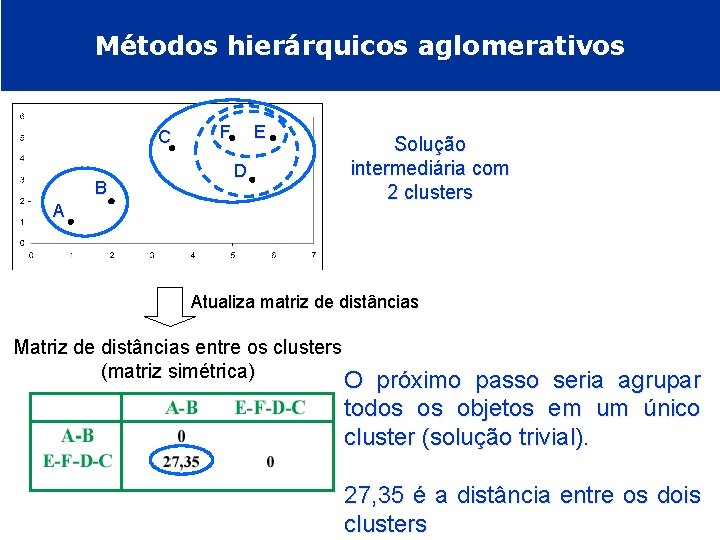

Métodos hierárquicos aglomerativos C B A F E D Solução intermediária com 2 clusters Atualiza matriz de distâncias Matriz de distâncias entre os clusters (matriz simétrica) O O próximo passo seria agrupar todos os objetos em um único cluster (solução trivial). 27, 35 é a distância entre os dois clusters

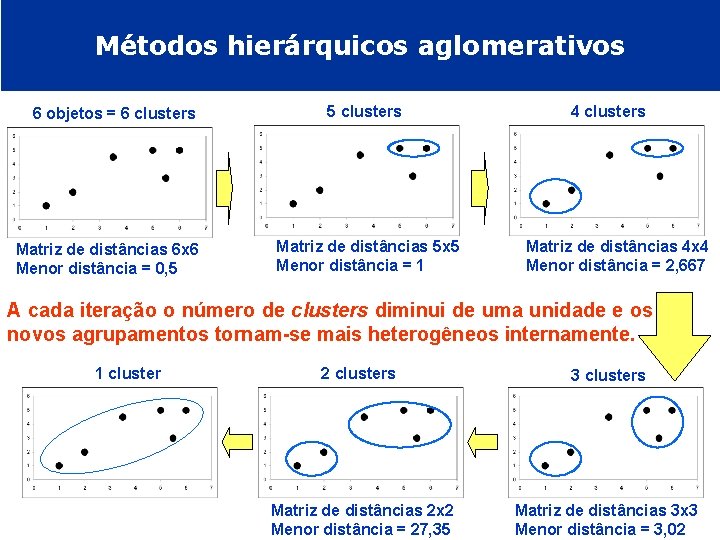

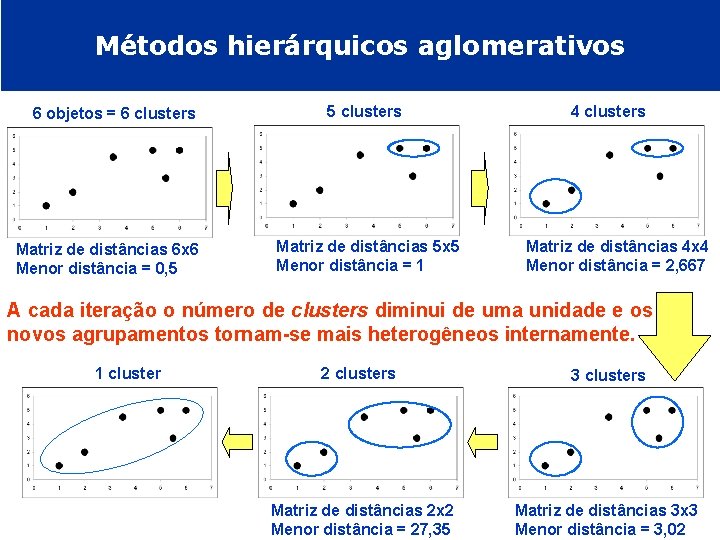

Métodos hierárquicos aglomerativos 6 objetos = 6 clusters Matriz de distâncias 6 x 6 Menor distância = 0, 5 5 clusters Matriz de distâncias 5 x 5 Menor distância = 1 4 clusters Matriz de distâncias 4 x 4 Menor distância = 2, 667 A cada iteração o número de clusters diminui de uma unidade e os novos agrupamentos tornam-se mais heterogêneos internamente. 1 cluster 2 clusters 3 clusters Matriz de distâncias 2 x 2 Menor distância = 27, 35 Matriz de distâncias 3 x 3 Menor distância = 3, 02

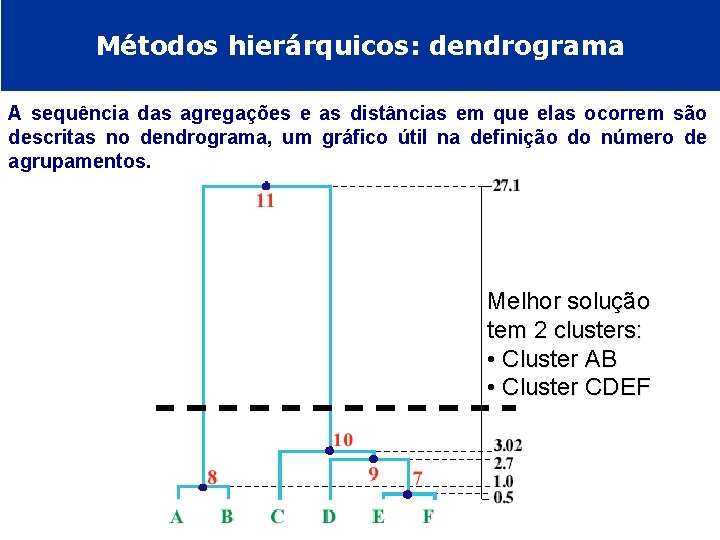

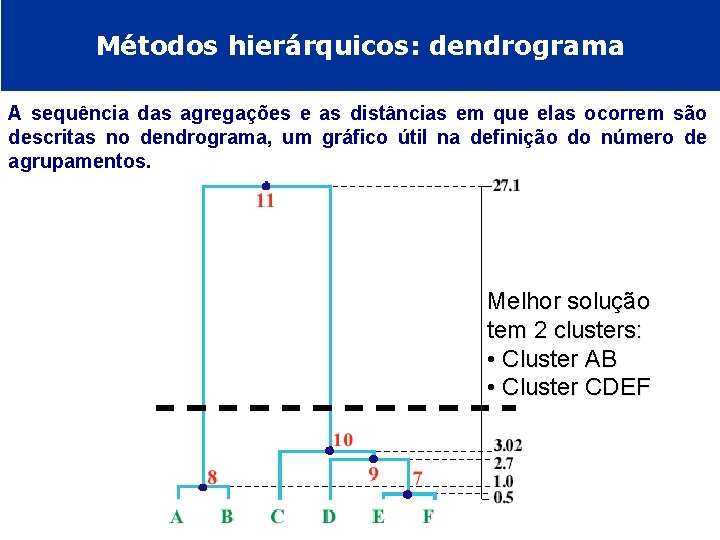

Métodos hierárquicos: dendrograma A sequência das agregações e as distâncias em que elas ocorrem são descritas no dendrograma, um gráfico útil na definição do número de agrupamentos. Melhor solução tem 2 clusters: • Cluster AB • Cluster CDEF

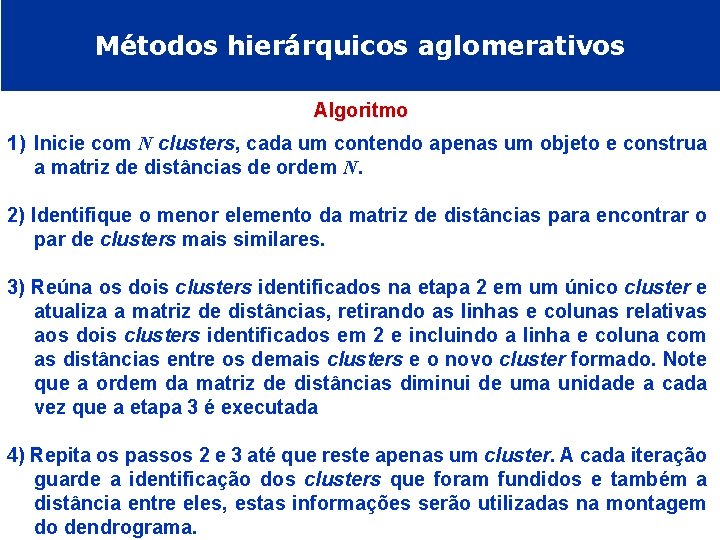

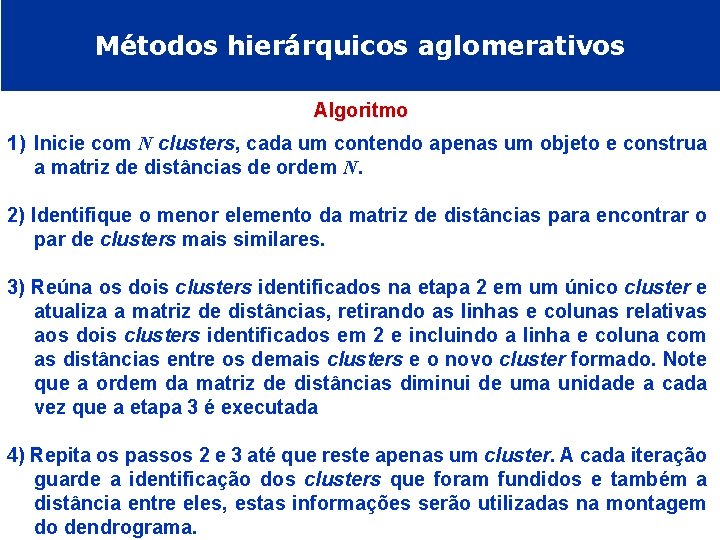

Métodos hierárquicos aglomerativos Algoritmo 1) Inicie com N clusters, cada um contendo apenas um objeto e construa a matriz de distâncias de ordem N. 2) Identifique o menor elemento da matriz de distâncias para encontrar o par de clusters mais similares. 3) Reúna os dois clusters identificados na etapa 2 em um único cluster e atualiza a matriz de distâncias, retirando as linhas e colunas relativas aos dois clusters identificados em 2 e incluindo a linha e coluna com as distâncias entre os demais clusters e o novo cluster formado. Note que a ordem da matriz de distâncias diminui de uma unidade a cada vez que a etapa 3 é executada 4) Repita os passos 2 e 3 até que reste apenas um cluster. A cada iteração guarde a identificação dos clusters que foram fundidos e também a distância entre eles, estas informações serão utilizadas na montagem do dendrograma.

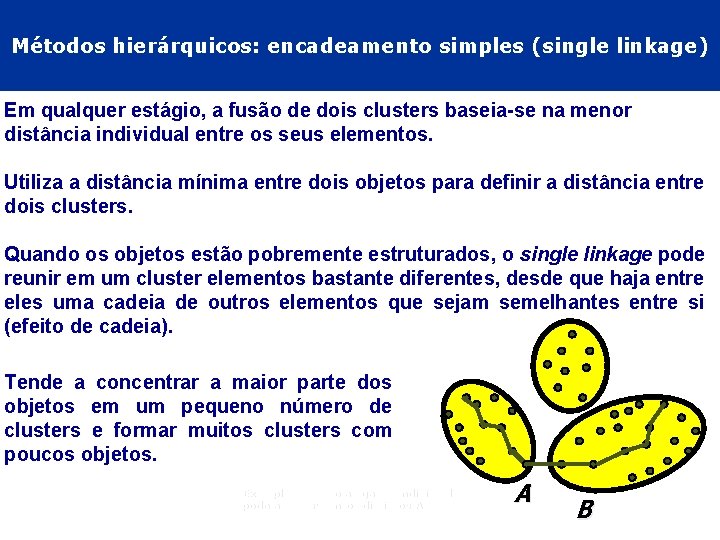

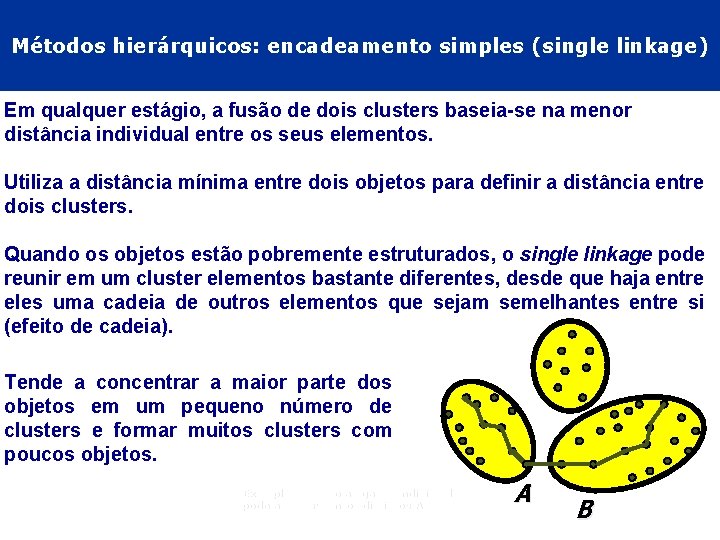

Métodos hierárquicos: encadeamento simples (single linkage) Em qualquer estágio, a fusão de dois clusters baseia-se na menor distância individual entre os seus elementos. Utiliza a distância mínima entre dois objetos para definir a distância entre dois clusters. Quando os objetos estão pobremente estruturados, o single linkage pode reunir em um cluster elementos bastante diferentes, desde que haja entre eles uma cadeia de outros elementos que sejam semelhantes entre si (efeito de cadeia). Tende a concentrar a maior parte dos objetos em um pequeno número de clusters e formar muitos clusters com poucos objetos. Exemplo de como a ligação individual pode agregar pontos distintos A e B A B

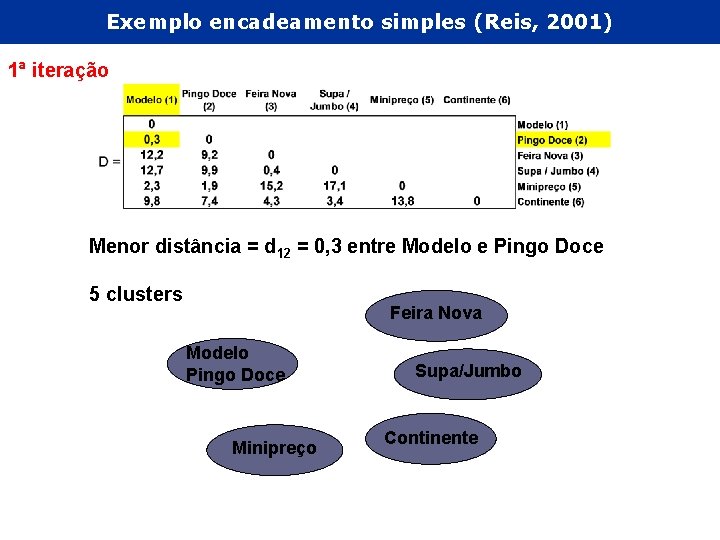

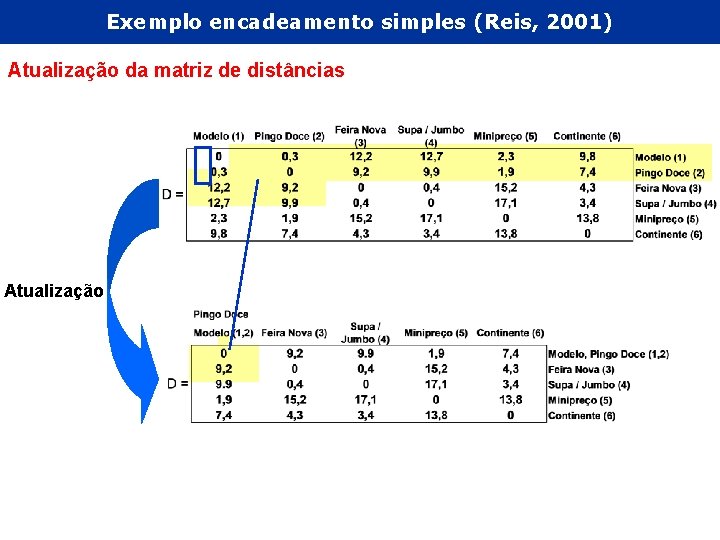

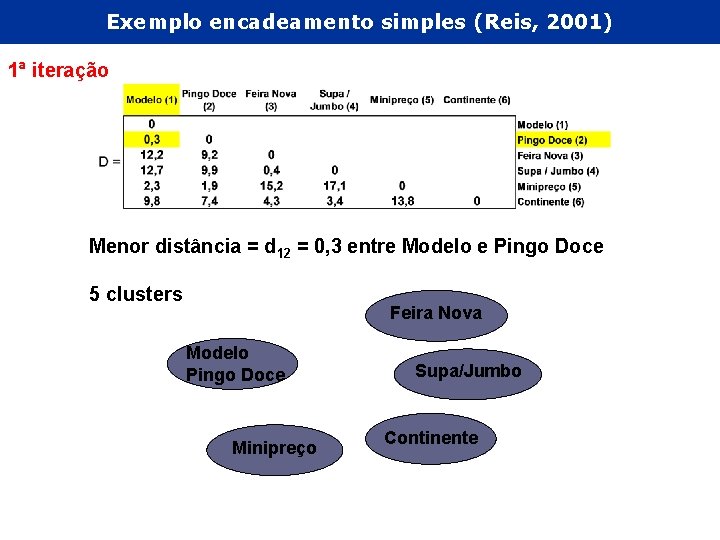

Exemplo encadeamento simples (Reis, 2001) 1ª iteração Menor distância = d 12 = 0, 3 entre Modelo e Pingo Doce 5 clusters Feira Nova Modelo Pingo Doce Minipreço Supa/Jumbo Continente

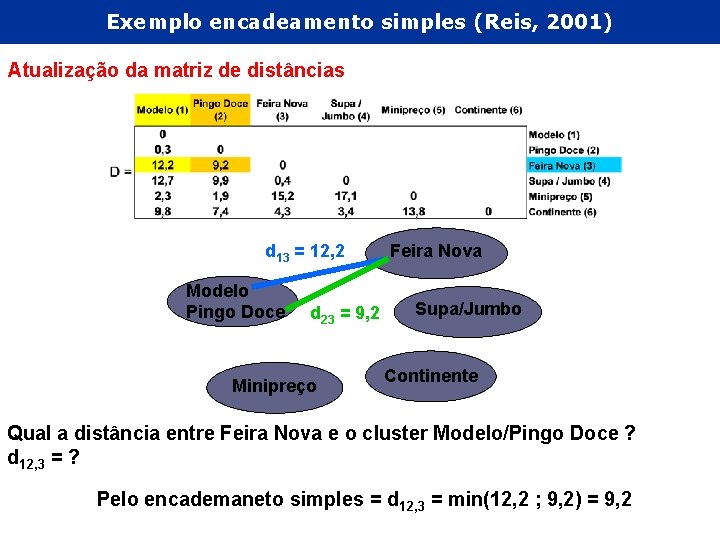

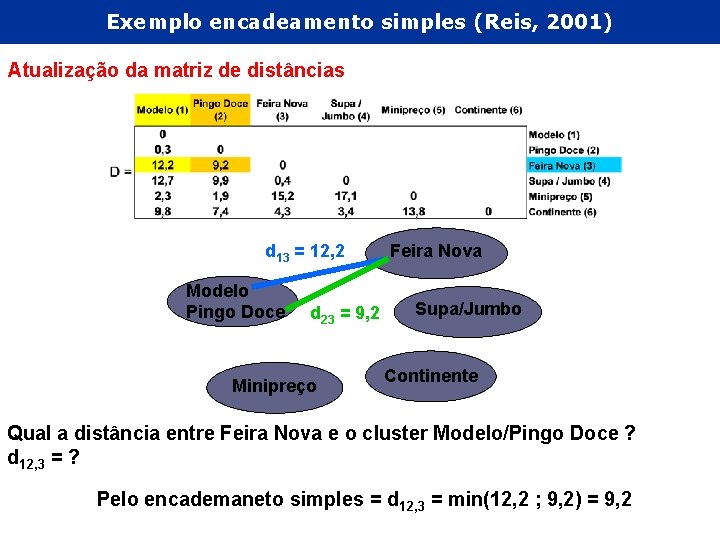

Exemplo encadeamento simples (Reis, 2001) Atualização da matriz de distâncias d 13 = 12, 2 Modelo Pingo Doce d 23 = 9, 2 Minipreço Feira Nova Supa/Jumbo Continente Qual a distância entre Feira Nova e o cluster Modelo/Pingo Doce ? d 12, 3 = ? Pelo encademaneto simples = d 12, 3 = min(12, 2 ; 9, 2) = 9, 2

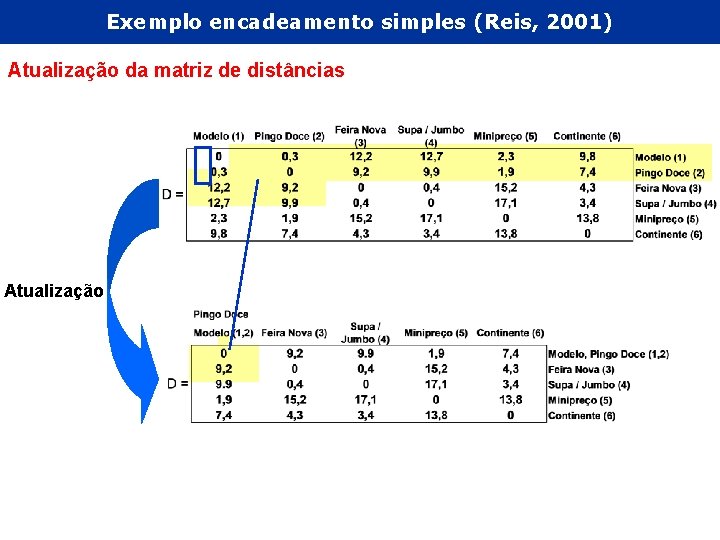

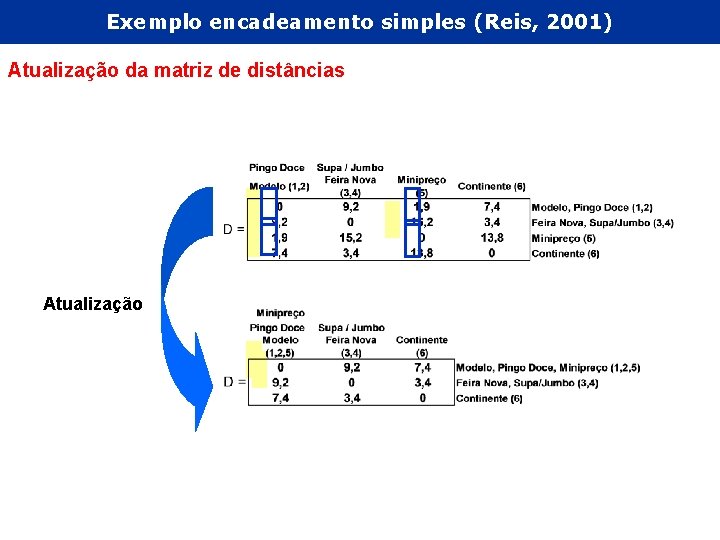

Exemplo encadeamento simples (Reis, 2001) Atualização da matriz de distâncias Atualização

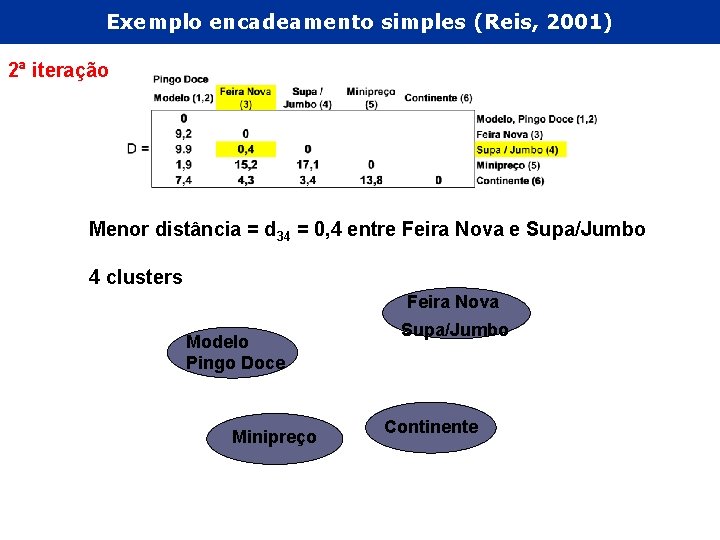

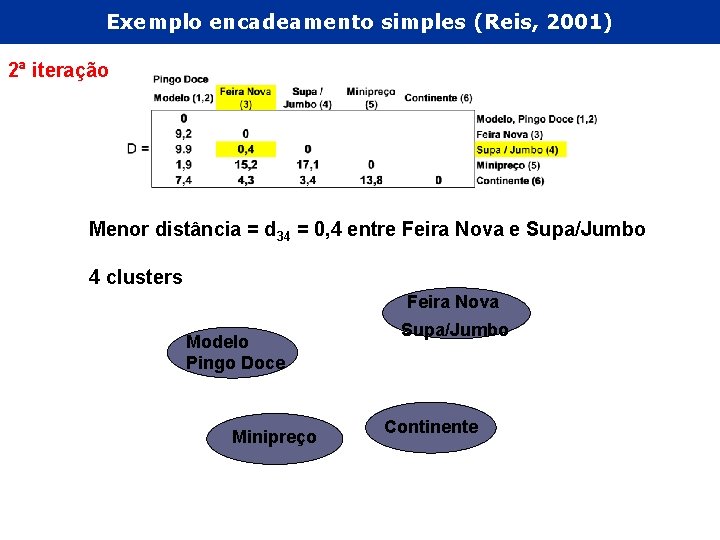

Exemplo encadeamento simples (Reis, 2001) 2ª iteração Menor distância = d 34 = 0, 4 entre Feira Nova e Supa/Jumbo 4 clusters Feira Nova Modelo Pingo Doce Minipreço Supa/Jumbo Continente

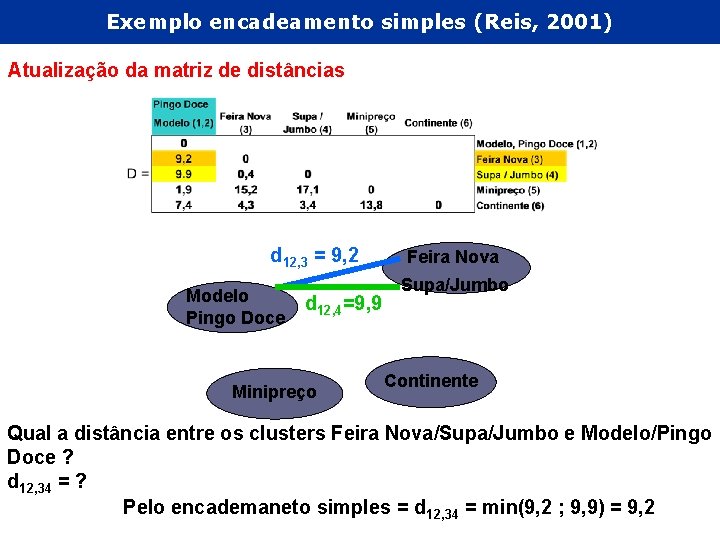

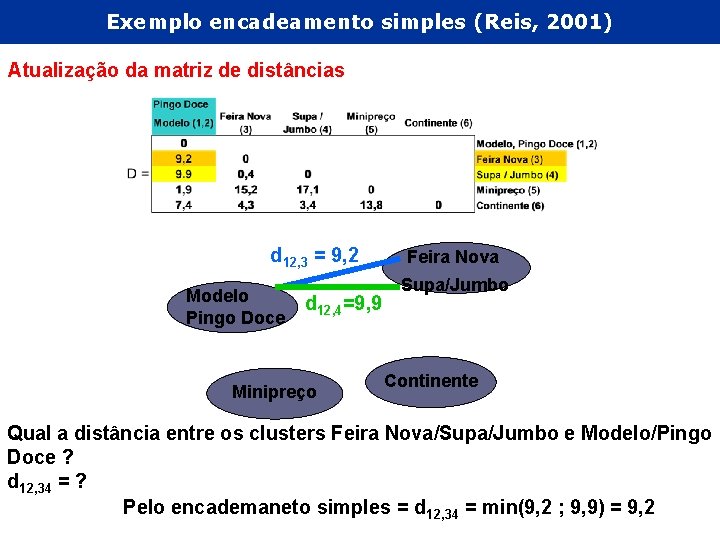

Exemplo encadeamento simples (Reis, 2001) Atualização da matriz de distâncias d 12, 3 = 9, 2 Modelo Pingo Doce d 12, 4=9, 9 Minipreço Feira Nova Supa/Jumbo Continente Qual a distância entre os clusters Feira Nova/Supa/Jumbo e Modelo/Pingo Doce ? d 12, 34 = ? Pelo encademaneto simples = d 12, 34 = min(9, 2 ; 9, 9) = 9, 2

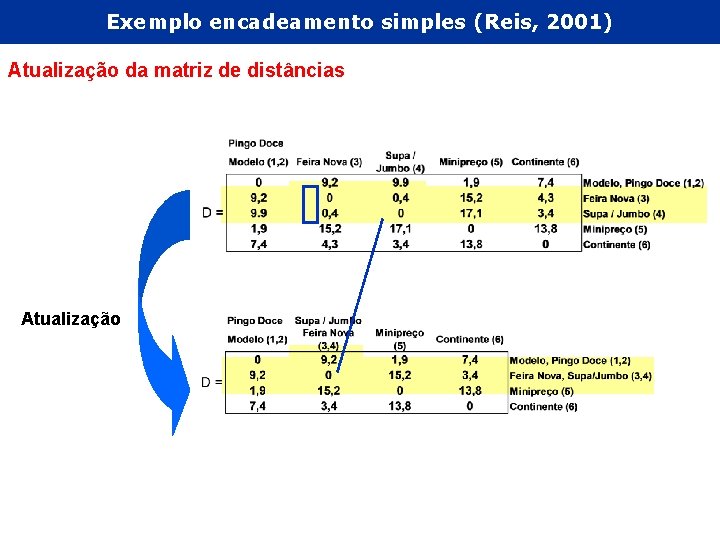

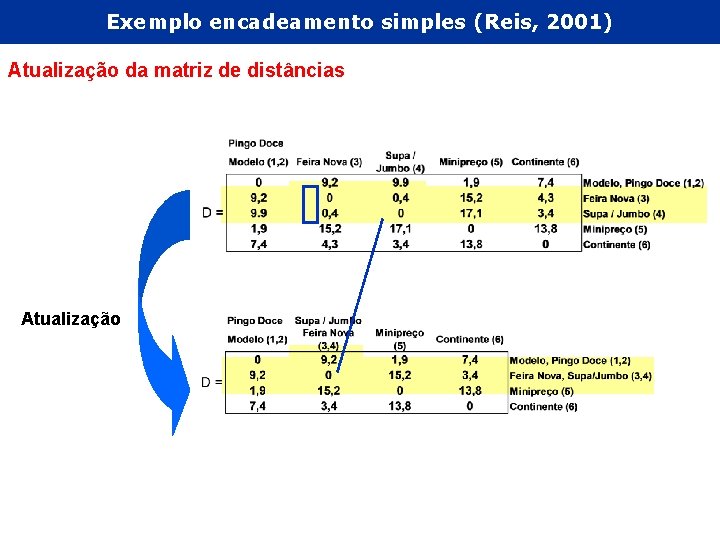

Exemplo encadeamento simples (Reis, 2001) Atualização da matriz de distâncias Atualização

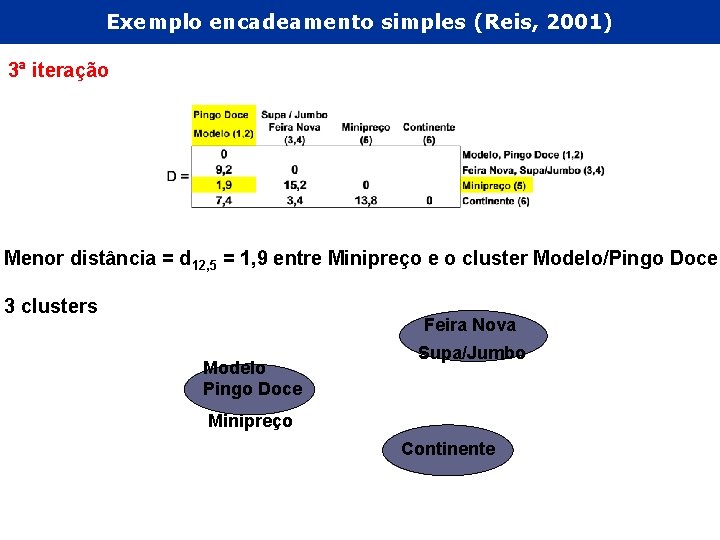

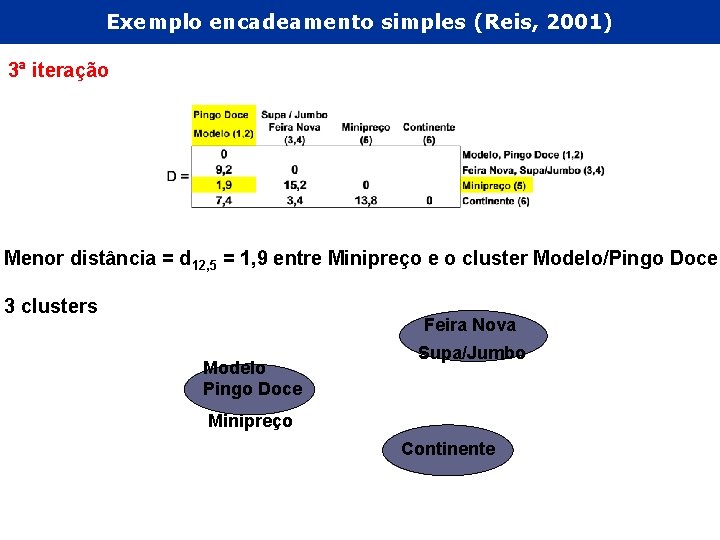

Exemplo encadeamento simples (Reis, 2001) 3ª iteração Menor distância = d 12, 5 = 1, 9 entre Minipreço e o cluster Modelo/Pingo Doce 3 clusters Feira Nova Modelo Pingo Doce Supa/Jumbo Minipreço Continente

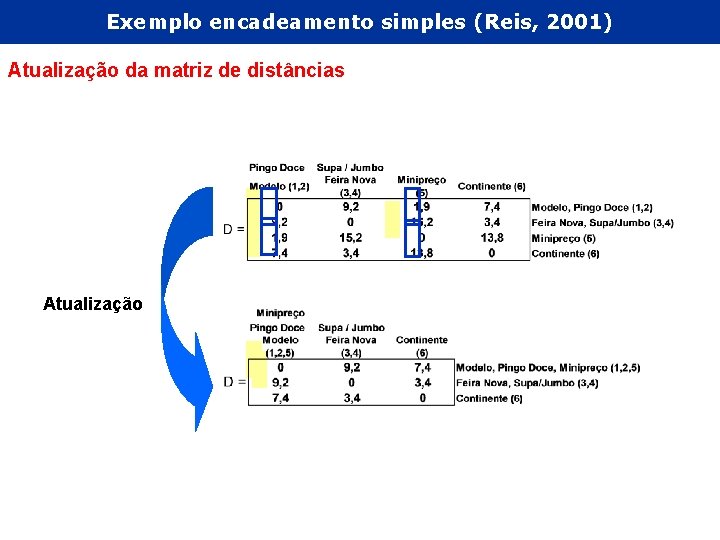

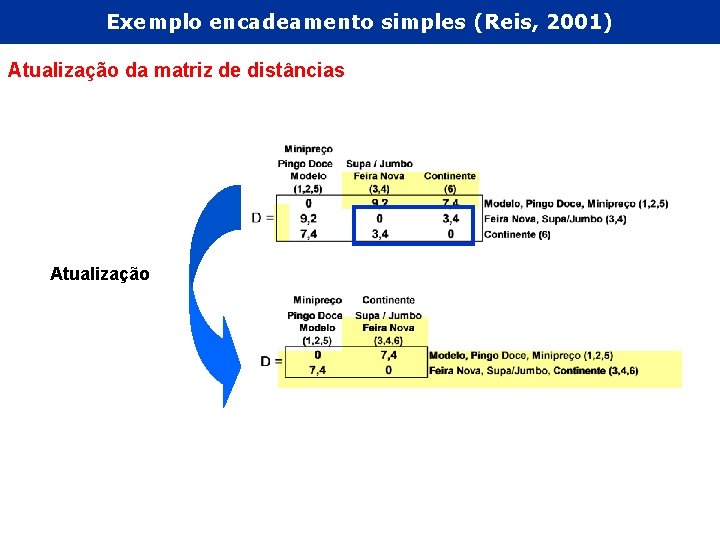

Exemplo encadeamento simples (Reis, 2001) Atualização da matriz de distâncias Atualização

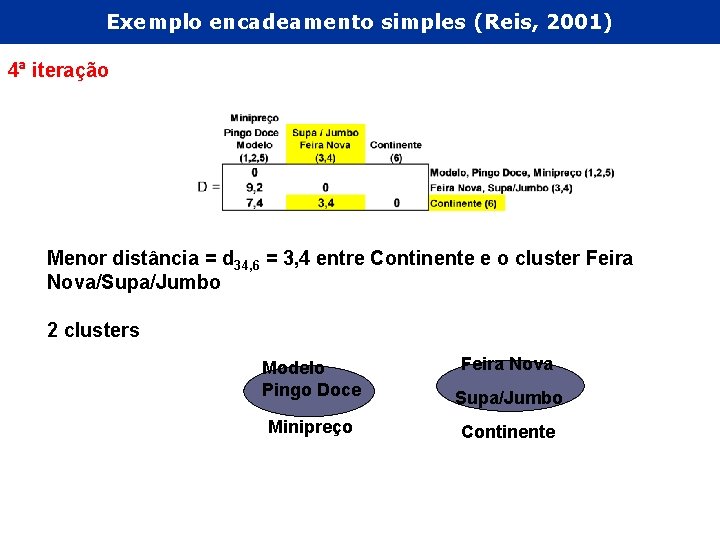

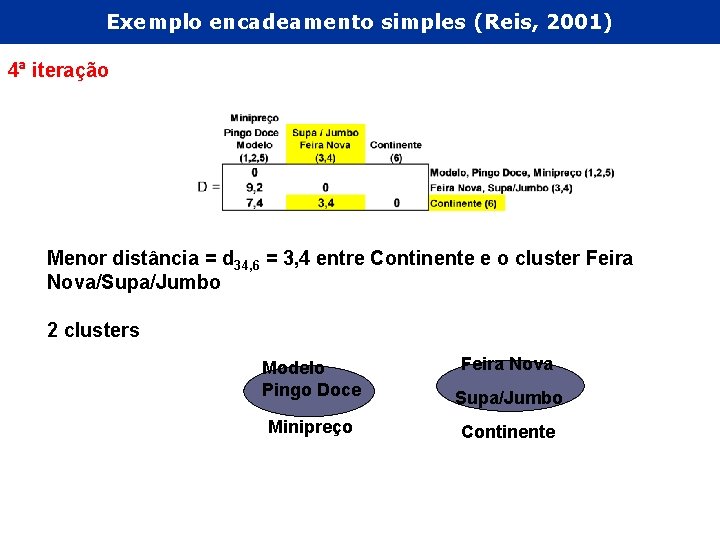

Exemplo encadeamento simples (Reis, 2001) 4ª iteração Menor distância = d 34, 6 = 3, 4 entre Continente e o cluster Feira Nova/Supa/Jumbo 2 clusters Feira Nova Modelo Pingo Doce Supa/Jumbo Minipreço Continente

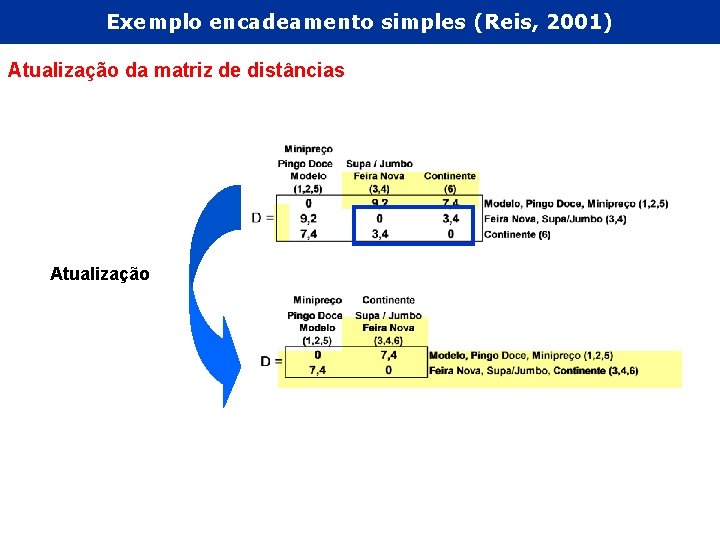

Exemplo encadeamento simples (Reis, 2001) Atualização da matriz de distâncias Atualização

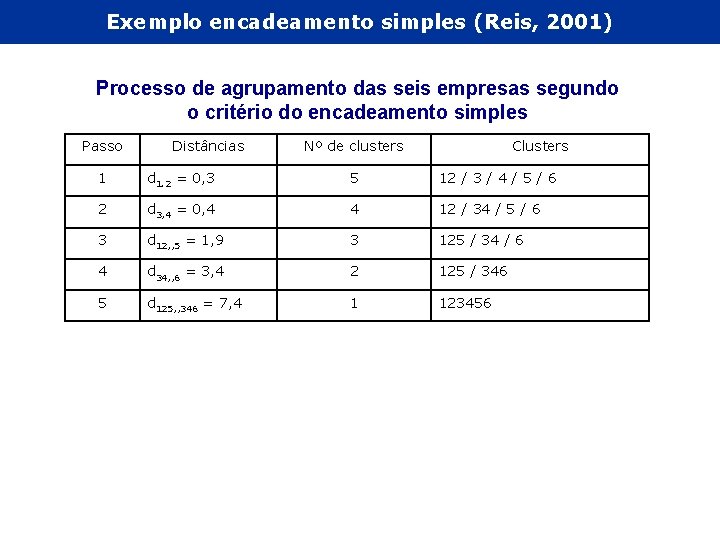

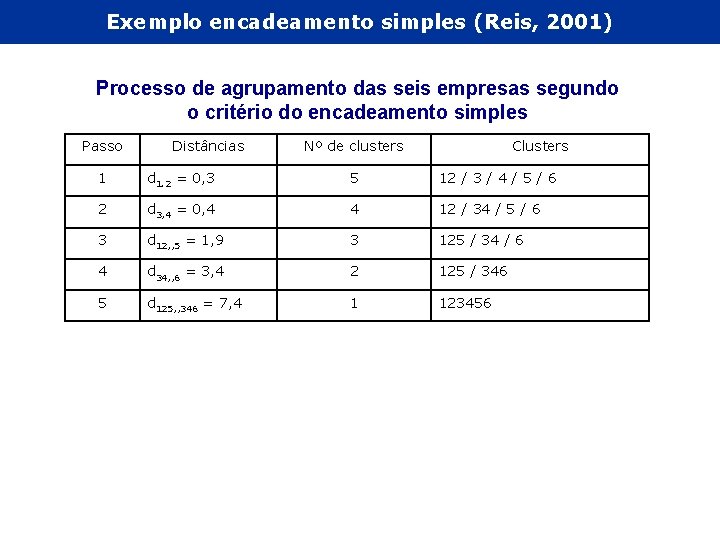

Exemplo encadeamento simples (Reis, 2001) Processo de agrupamento das seis empresas segundo o critério do encadeamento simples Passo Distâncias Nº de clusters Clusters 1 d 1. 2 = 0, 3 5 12 / 3 / 4 / 5 / 6 2 d 3, 4 = 0, 4 4 12 / 34 / 5 / 6 3 d 12, , 5 = 1, 9 3 125 / 34 / 6 4 d 34, , 6 = 3, 4 2 125 / 346 5 d 125, , 346 = 7, 4 1 123456

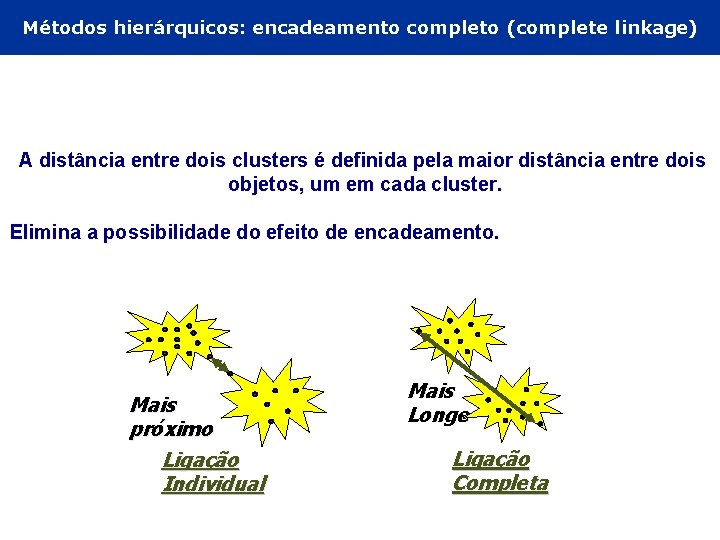

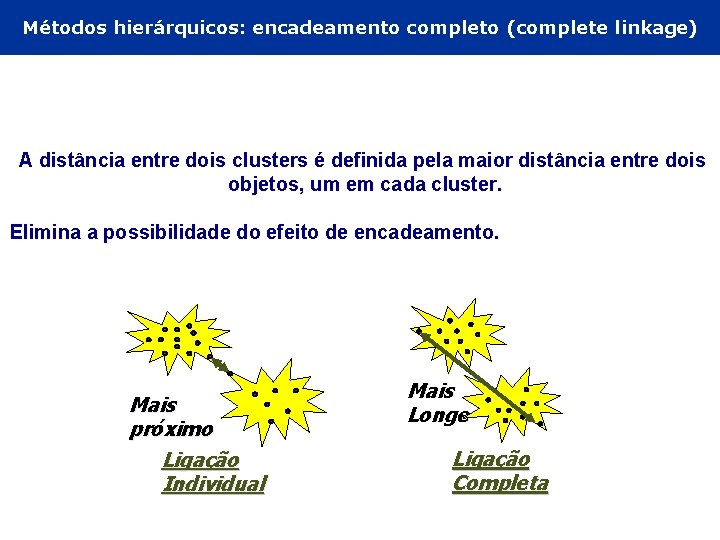

Métodos hierárquicos: encadeamento completo (complete linkage) A distância entre dois clusters é definida pela maior distância entre dois objetos, um em cada cluster. Elimina a possibilidade do efeito de encadeamento. Mais próximo Ligação Individual Mais Longe Ligação Completa

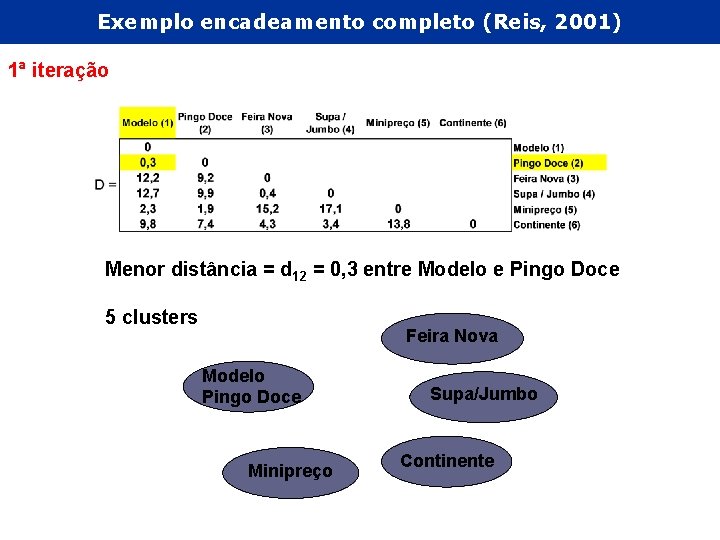

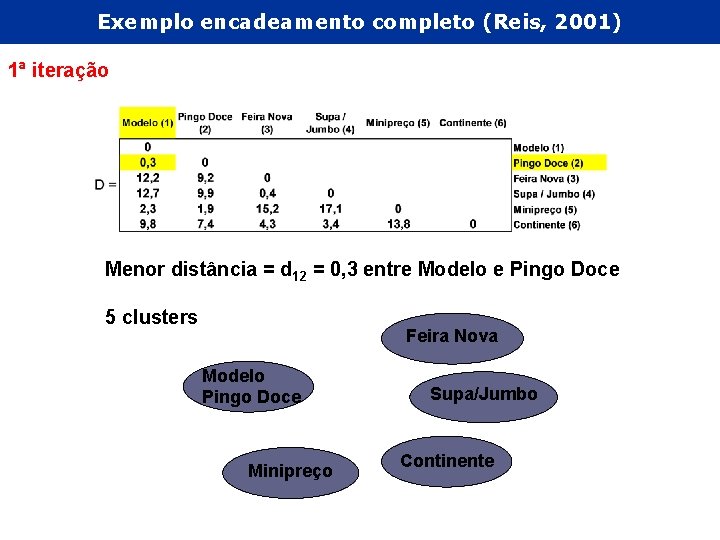

Exemplo encadeamento completo (Reis, 2001) 1ª iteração Menor distância = d 12 = 0, 3 entre Modelo e Pingo Doce 5 clusters Feira Nova Modelo Pingo Doce Minipreço Supa/Jumbo Continente

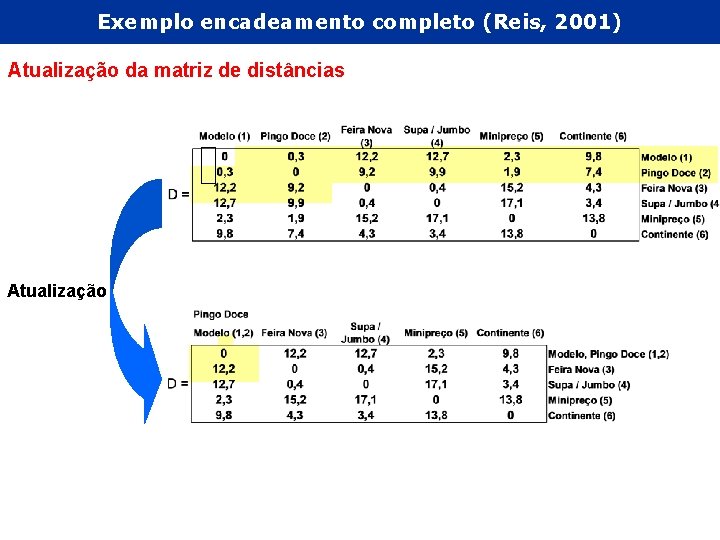

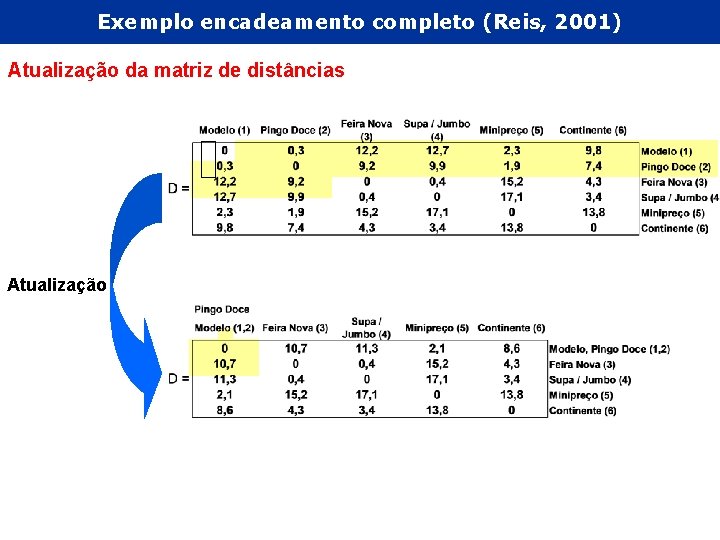

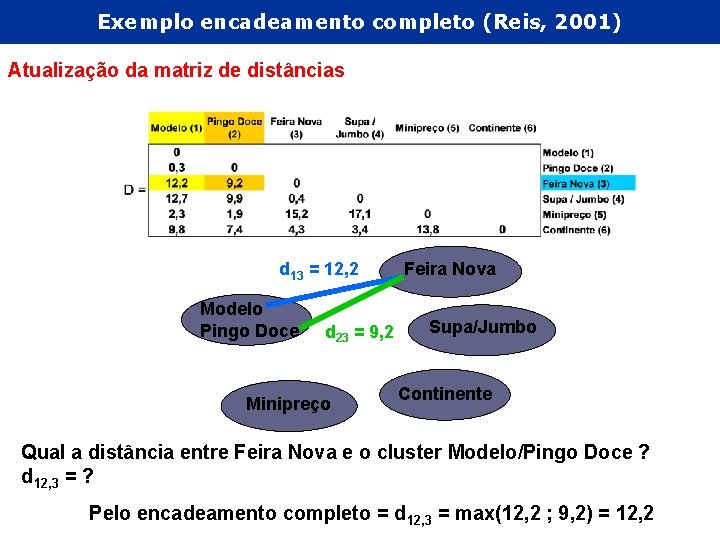

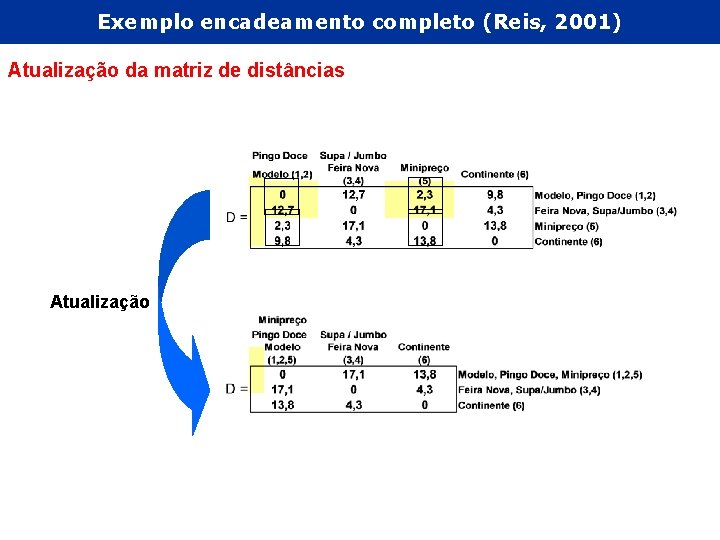

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias d 13 = 12, 2 Modelo Pingo Doce d 23 = 9, 2 Minipreço Feira Nova Supa/Jumbo Continente Qual a distância entre Feira Nova e o cluster Modelo/Pingo Doce ? d 12, 3 = ? Pelo encadeamento completo = d 12, 3 = max(12, 2 ; 9, 2) = 12, 2

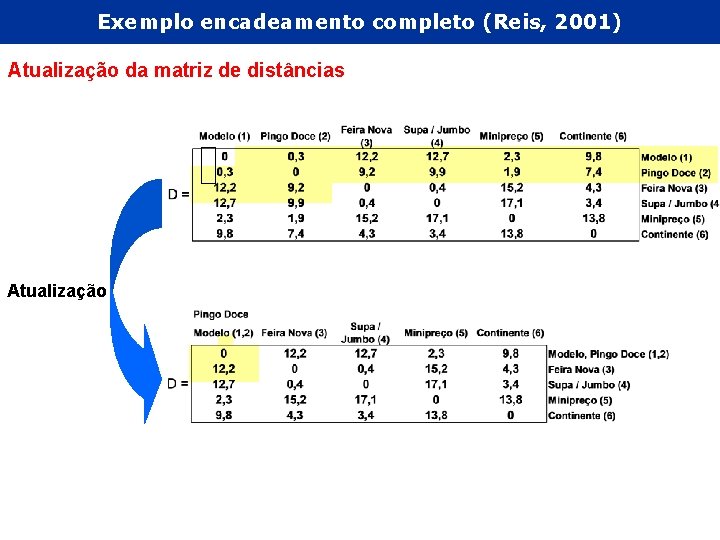

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias Atualização

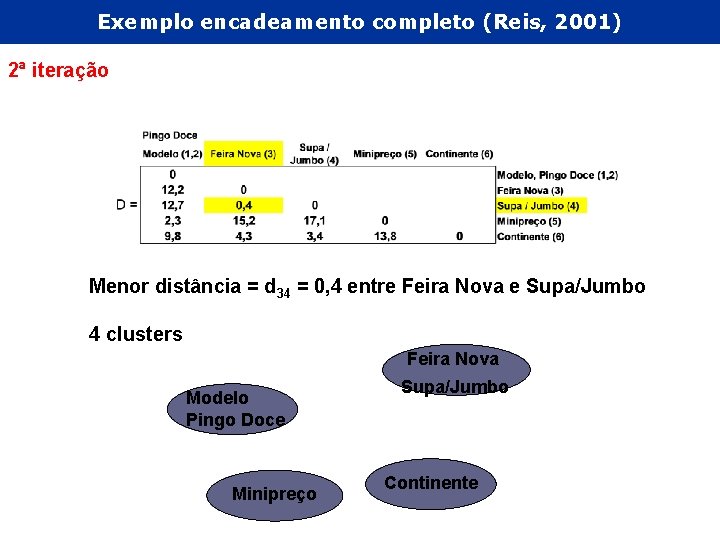

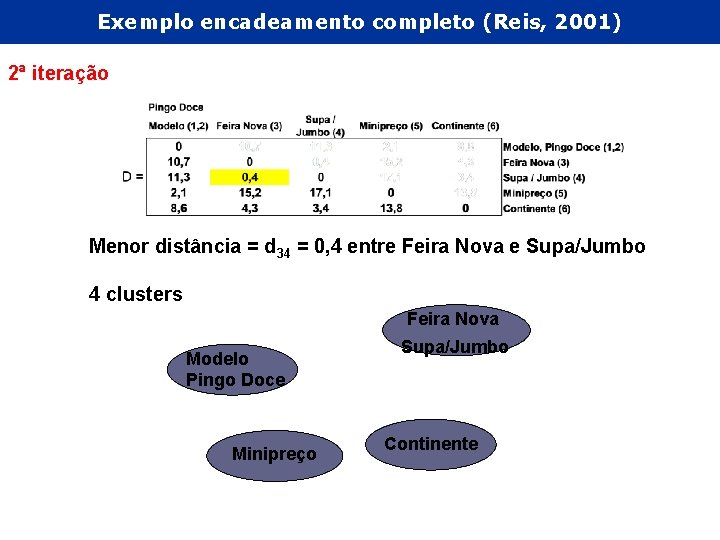

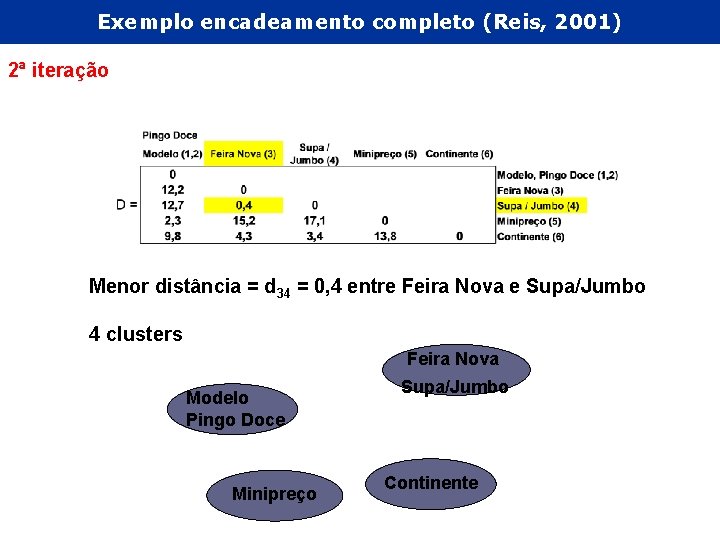

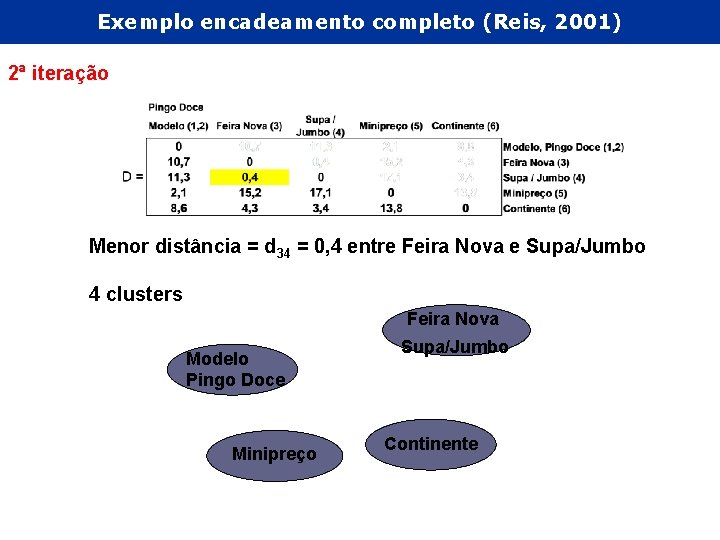

Exemplo encadeamento completo (Reis, 2001) 2ª iteração Menor distância = d 34 = 0, 4 entre Feira Nova e Supa/Jumbo 4 clusters Feira Nova Modelo Pingo Doce Minipreço Supa/Jumbo Continente

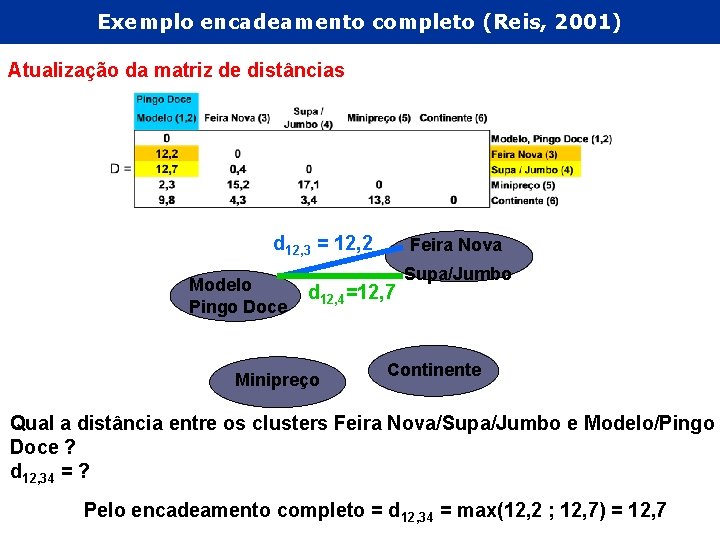

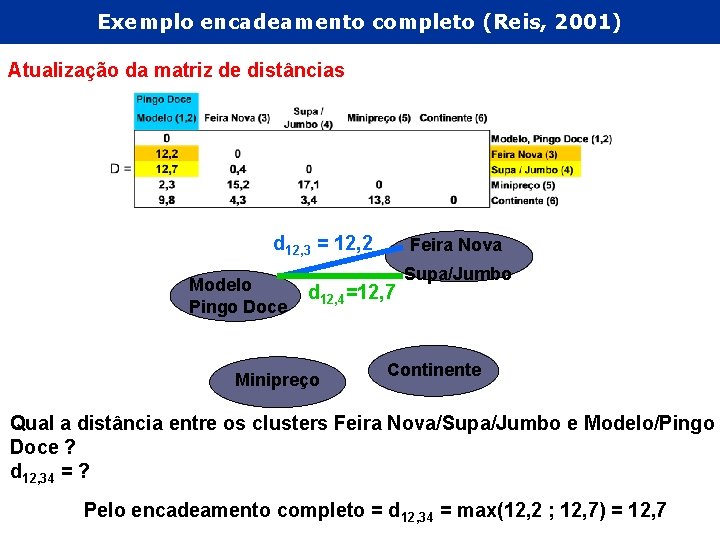

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias d 12, 3 = 12, 2 Modelo Pingo Doce Feira Nova d 12, 4=12, 7 Minipreço Supa/Jumbo Continente Qual a distância entre os clusters Feira Nova/Supa/Jumbo e Modelo/Pingo Doce ? d 12, 34 = ? Pelo encadeamento completo = d 12, 34 = max(12, 2 ; 12, 7) = 12, 7

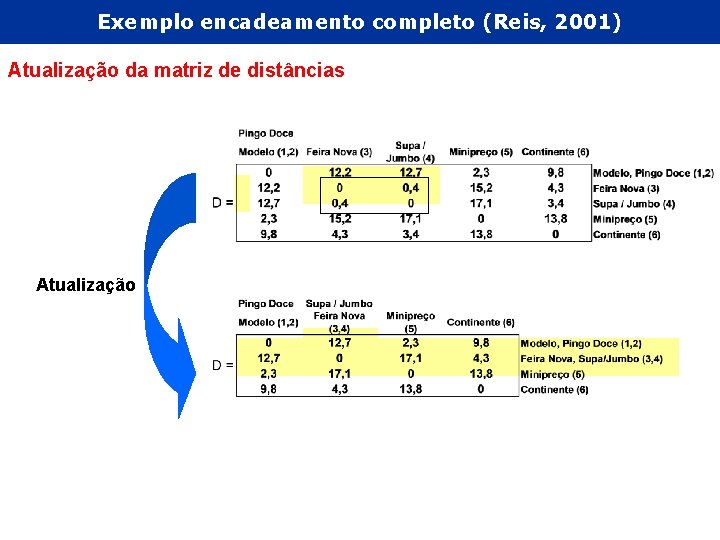

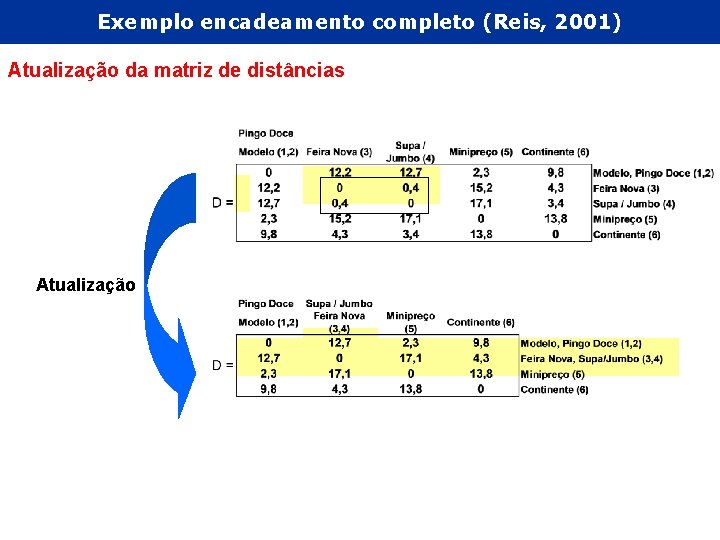

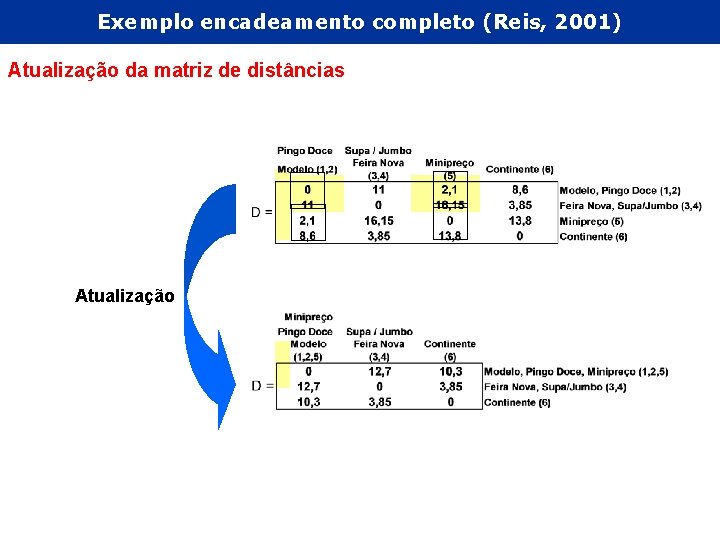

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias Atualização

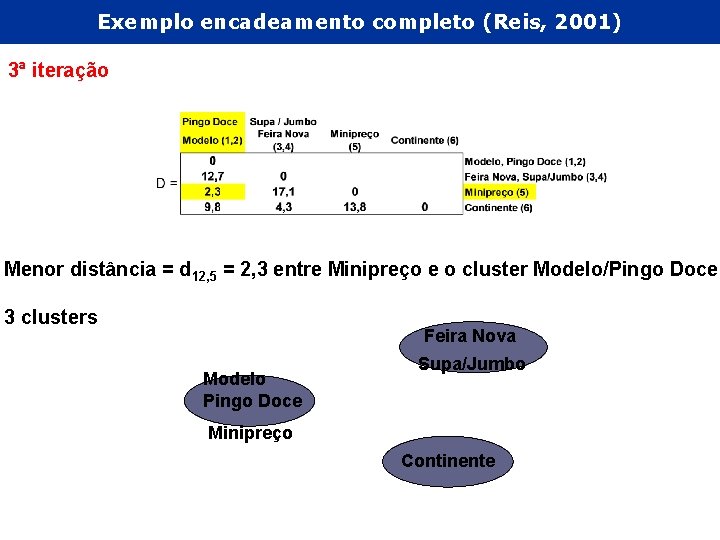

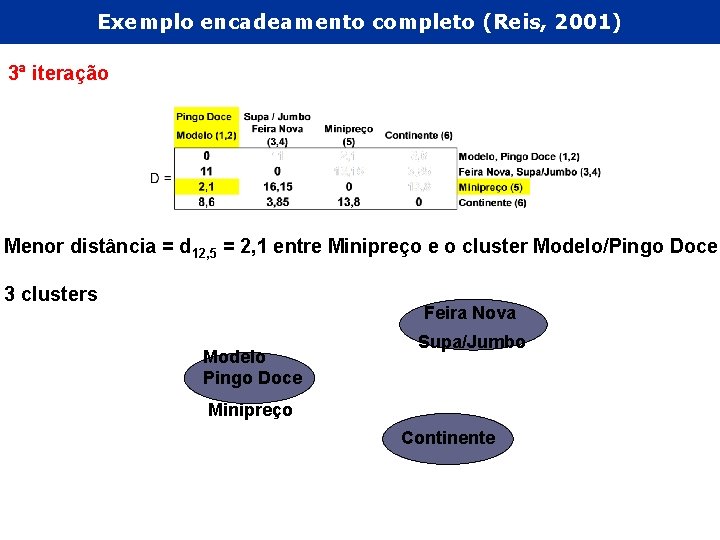

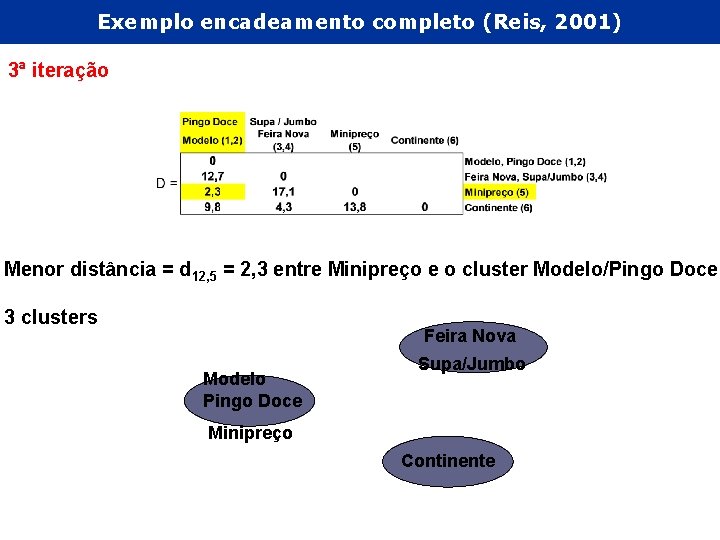

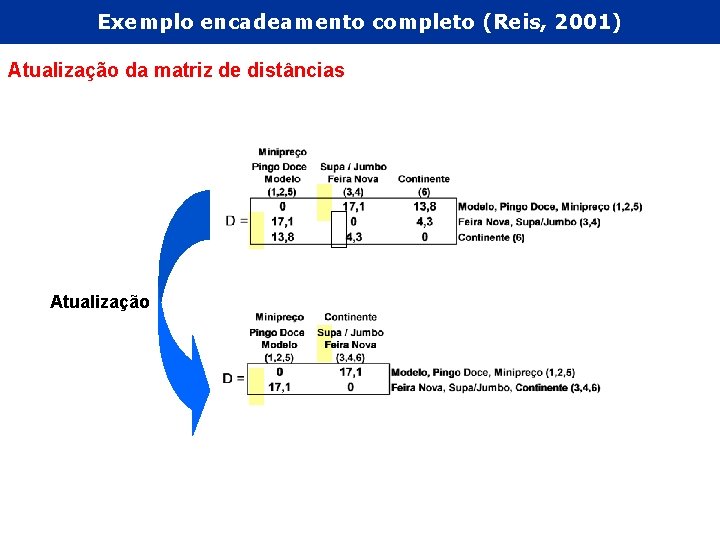

Exemplo encadeamento completo (Reis, 2001) 3ª iteração Menor distância = d 12, 5 = 2, 3 entre Minipreço e o cluster Modelo/Pingo Doce 3 clusters Feira Nova Modelo Pingo Doce Supa/Jumbo Minipreço Continente

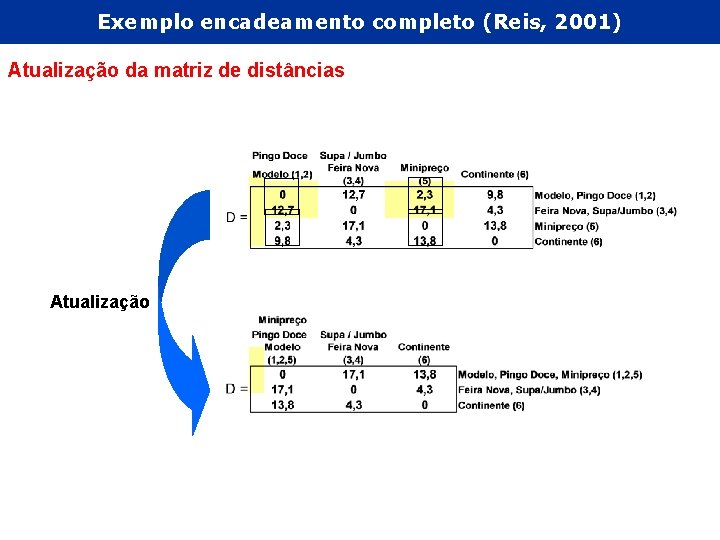

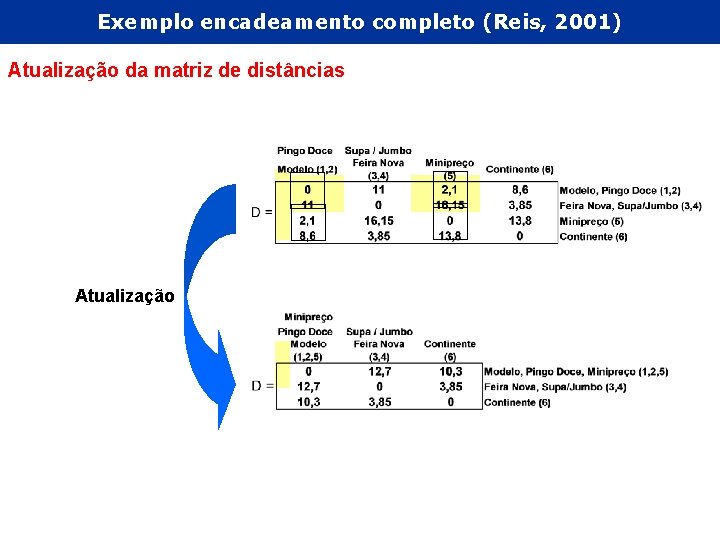

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias Atualização

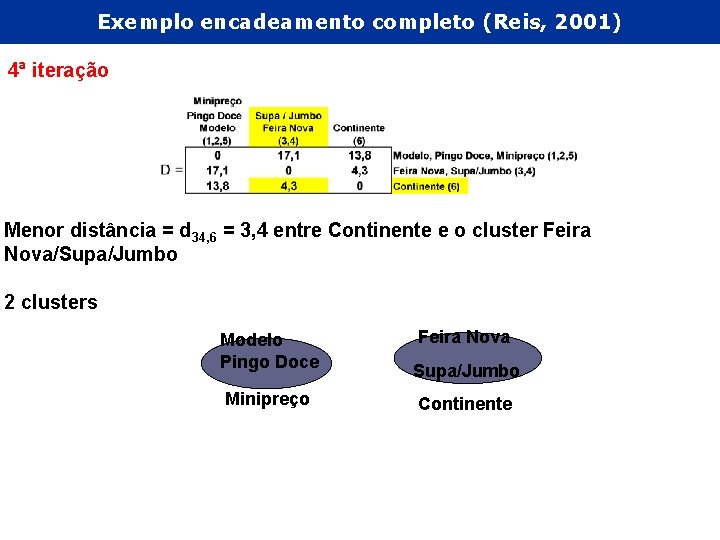

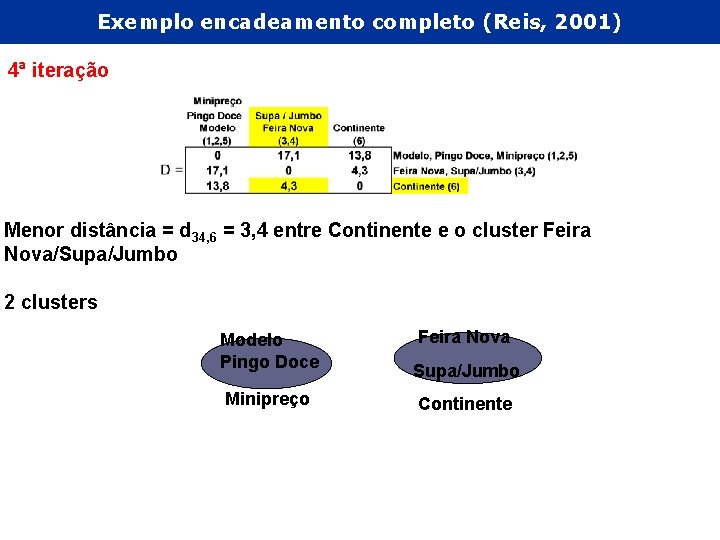

Exemplo encadeamento completo (Reis, 2001) 4ª iteração Menor distância = d 34, 6 = 3, 4 entre Continente e o cluster Feira Nova/Supa/Jumbo 2 clusters Feira Nova Modelo Pingo Doce Supa/Jumbo Minipreço Continente

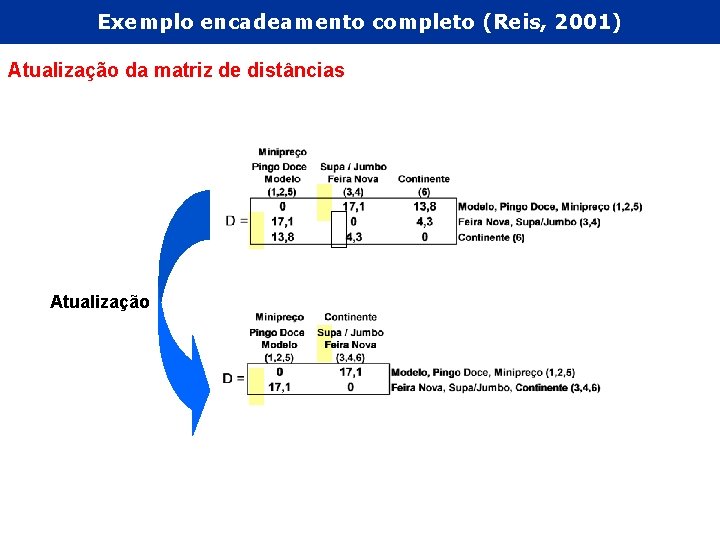

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias Atualização

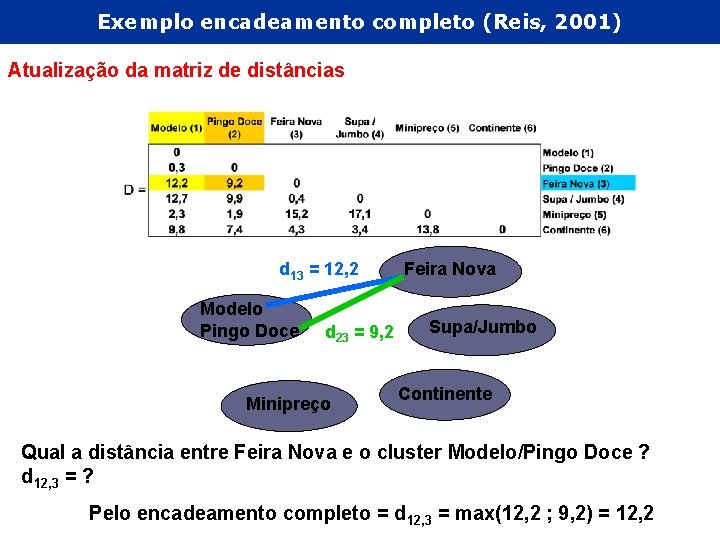

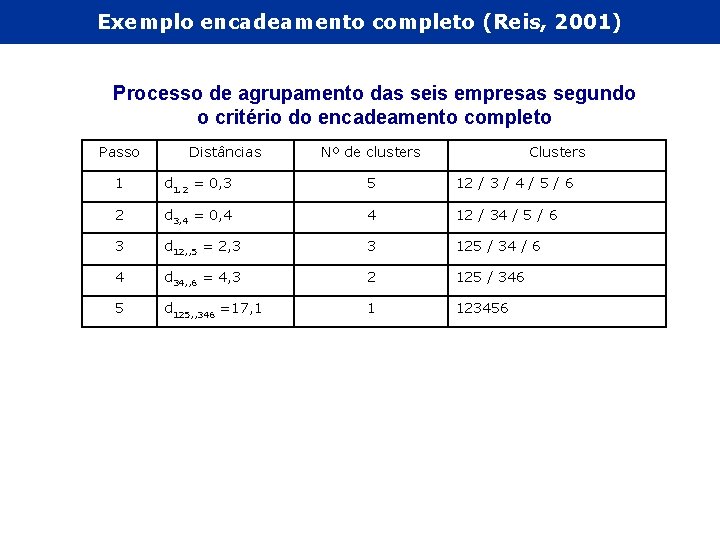

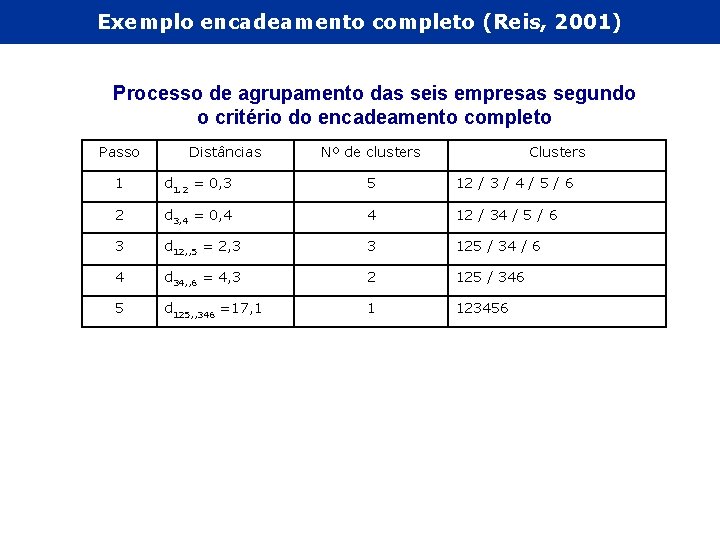

Exemplo encadeamento completo (Reis, 2001) Processo de agrupamento das seis empresas segundo o critério do encadeamento completo Passo Distâncias Nº de clusters Clusters 1 d 1. 2 = 0, 3 5 12 / 3 / 4 / 5 / 6 2 d 3, 4 = 0, 4 4 12 / 34 / 5 / 6 3 d 12, , 5 = 2, 3 3 125 / 34 / 6 4 d 34, , 6 = 4, 3 2 125 / 346 5 d 125, , 346 =17, 1 1 123456

Métodos hierárquicos: encadeamento médio (average linkage) A distância entre dois clusters é definida como a média das distância entre os elementos dois grupos. Tende a enviesar em direção à aproximadamente a mesma variância produção de grupos com

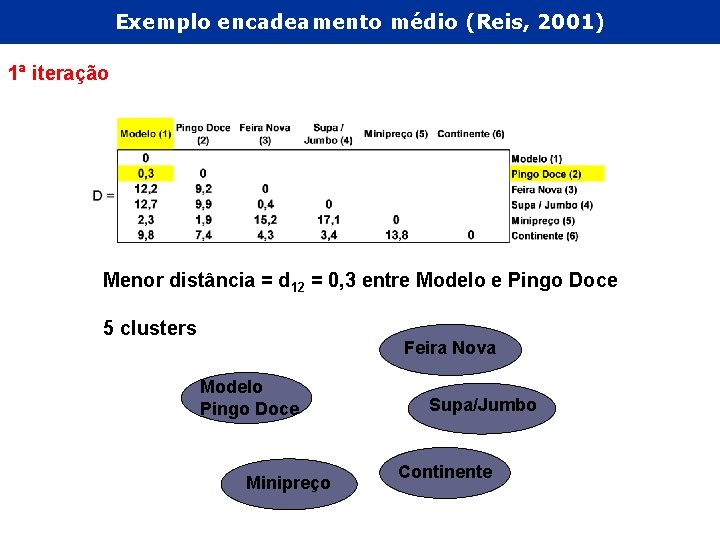

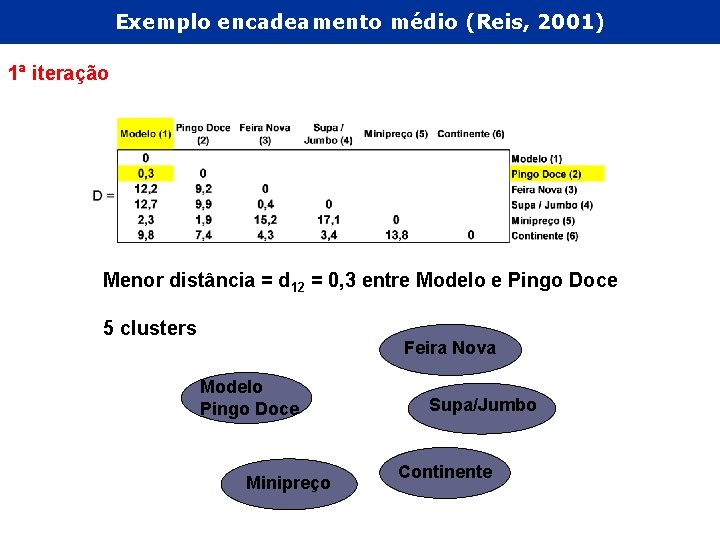

Exemplo encadeamento médio (Reis, 2001) 1ª iteração Menor distância = d 12 = 0, 3 entre Modelo e Pingo Doce 5 clusters Feira Nova Modelo Pingo Doce Minipreço Supa/Jumbo Continente

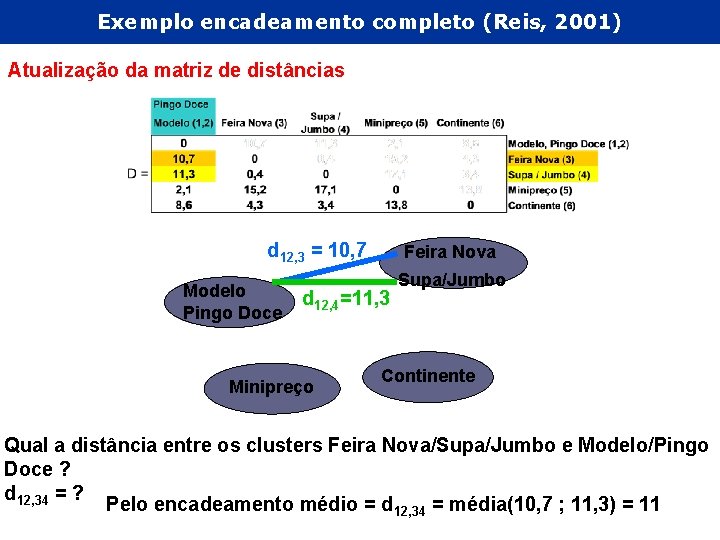

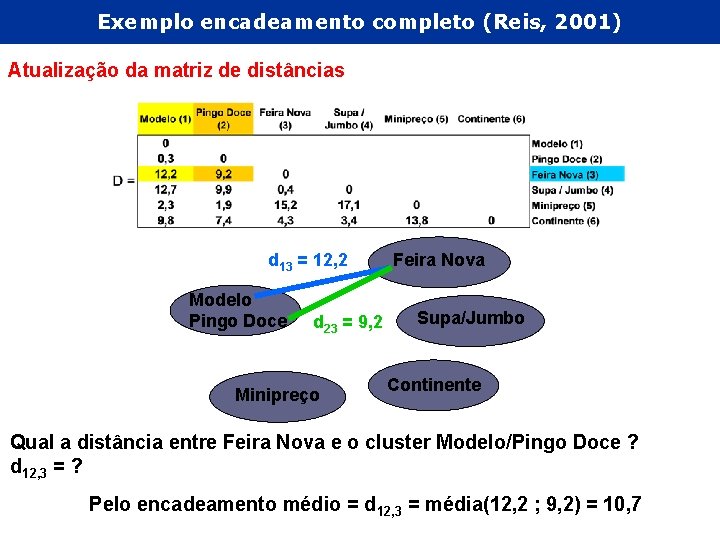

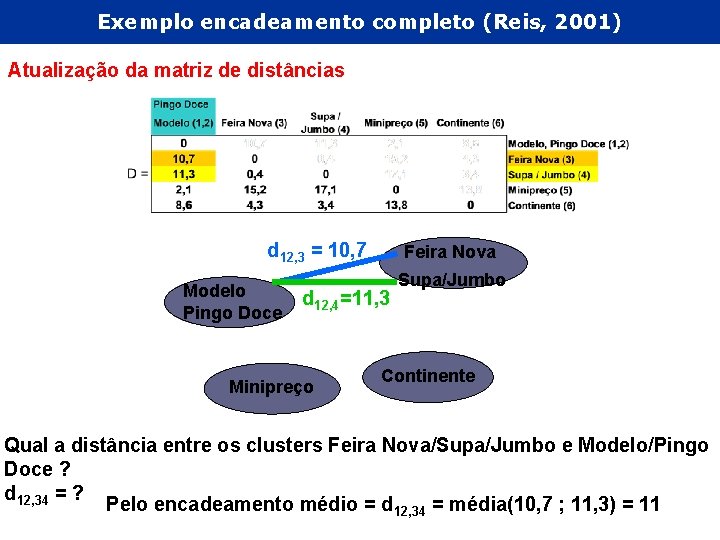

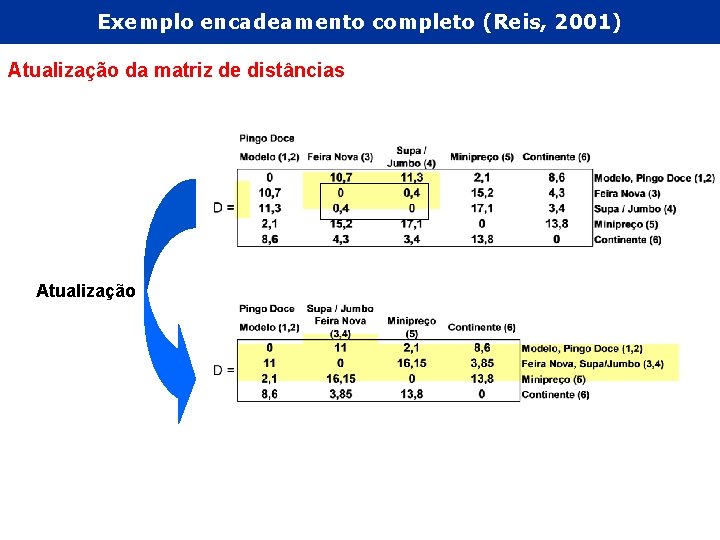

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias d 13 = 12, 2 Modelo Pingo Doce d 23 = 9, 2 Minipreço Feira Nova Supa/Jumbo Continente Qual a distância entre Feira Nova e o cluster Modelo/Pingo Doce ? d 12, 3 = ? Pelo encadeamento médio = d 12, 3 = média(12, 2 ; 9, 2) = 10, 7

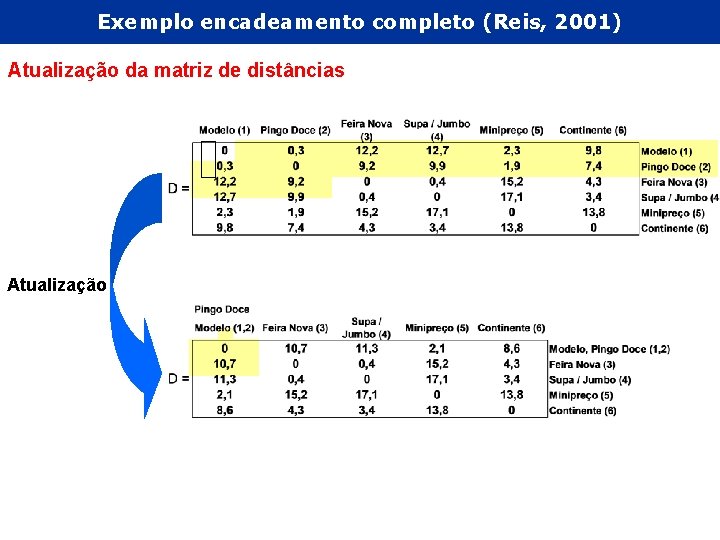

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias Atualização

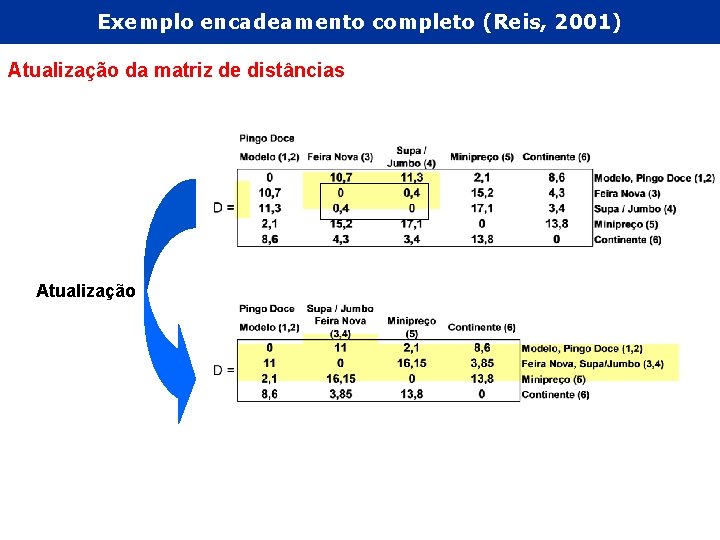

Exemplo encadeamento completo (Reis, 2001) 2ª iteração Menor distância = d 34 = 0, 4 entre Feira Nova e Supa/Jumbo 4 clusters Feira Nova Modelo Pingo Doce Minipreço Supa/Jumbo Continente

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias d 12, 3 = 10, 7 Modelo Pingo Doce Feira Nova d 12, 4=11, 3 Minipreço Supa/Jumbo Continente Qual a distância entre os clusters Feira Nova/Supa/Jumbo e Modelo/Pingo Doce ? d 12, 34 = ? Pelo encadeamento médio = d 12, 34 = média(10, 7 ; 11, 3) = 11

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias Atualização

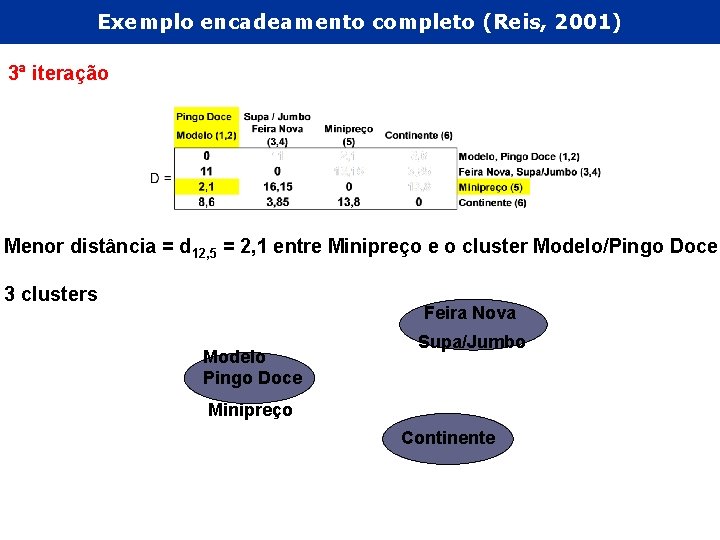

Exemplo encadeamento completo (Reis, 2001) 3ª iteração Menor distância = d 12, 5 = 2, 1 entre Minipreço e o cluster Modelo/Pingo Doce 3 clusters Feira Nova Modelo Pingo Doce Supa/Jumbo Minipreço Continente

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias Atualização

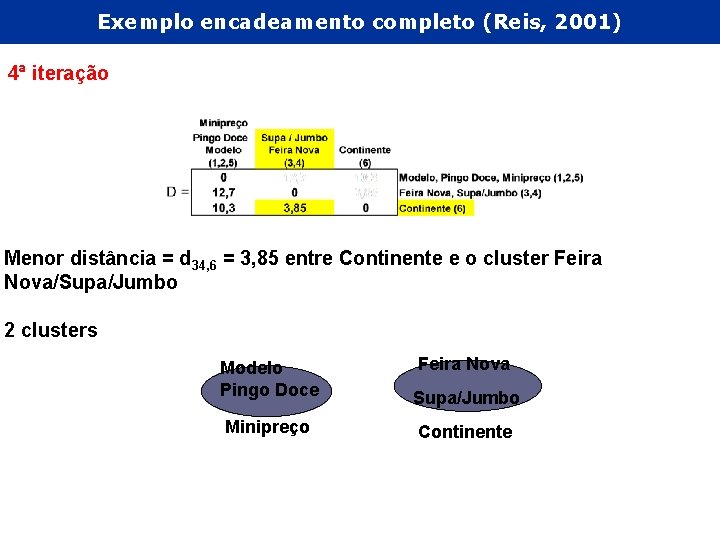

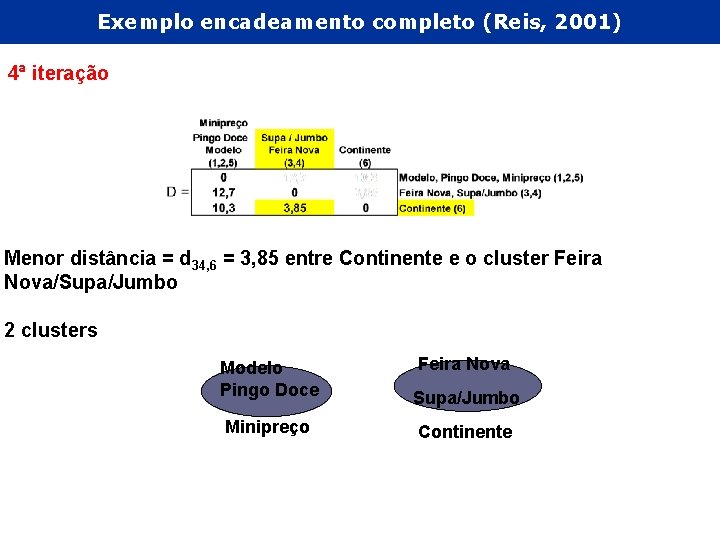

Exemplo encadeamento completo (Reis, 2001) 4ª iteração Menor distância = d 34, 6 = 3, 85 entre Continente e o cluster Feira Nova/Supa/Jumbo 2 clusters Feira Nova Modelo Pingo Doce Supa/Jumbo Minipreço Continente

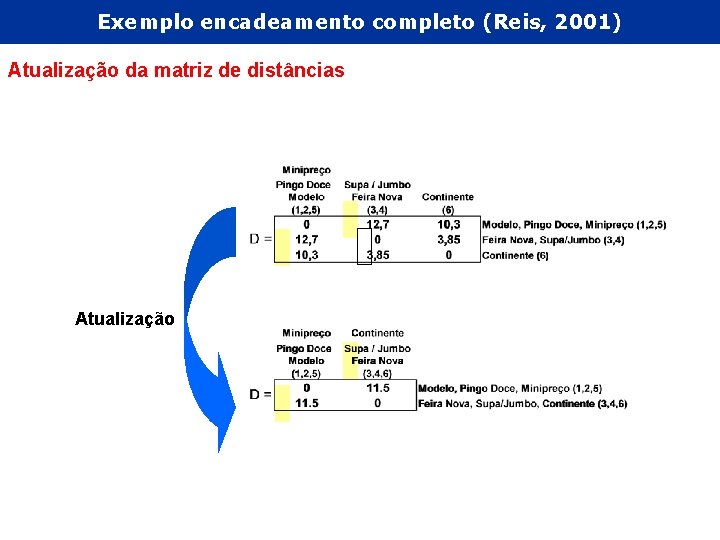

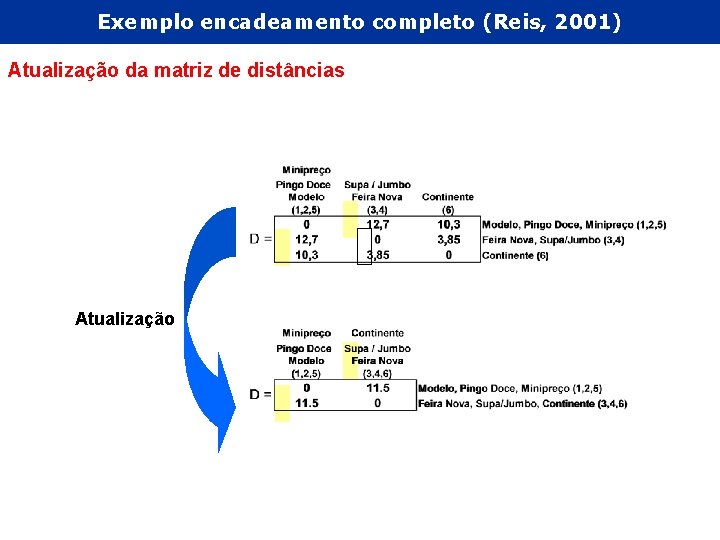

Exemplo encadeamento completo (Reis, 2001) Atualização da matriz de distâncias Atualização

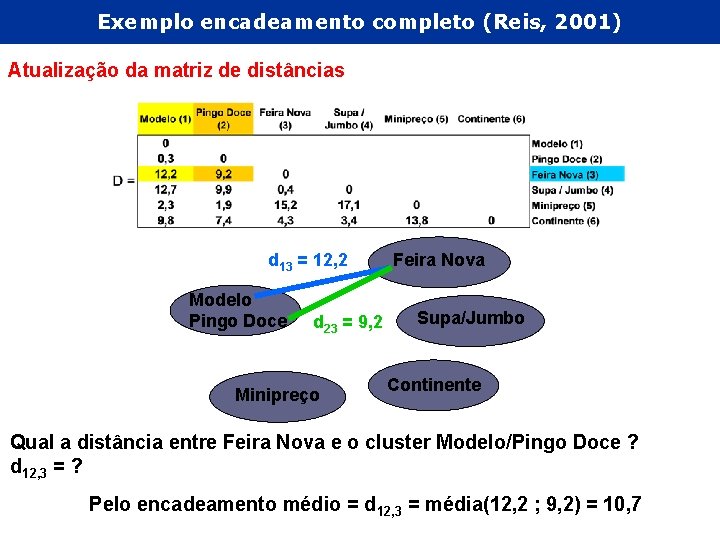

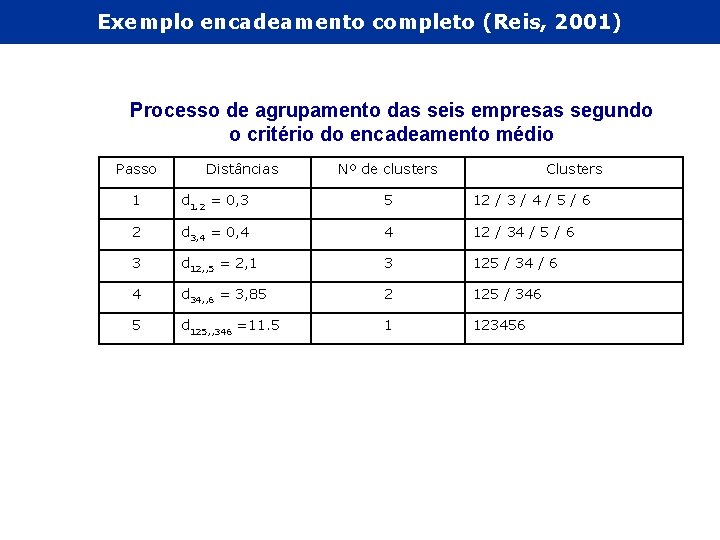

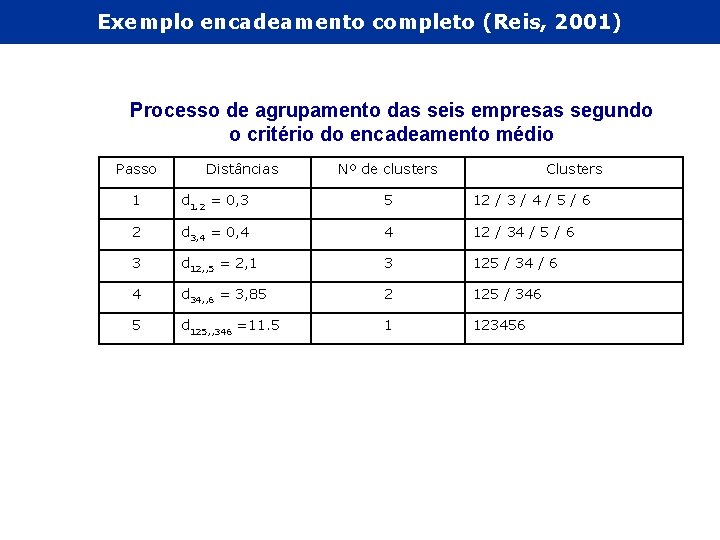

Exemplo encadeamento completo (Reis, 2001) Processo de agrupamento das seis empresas segundo o critério do encadeamento médio Passo Distâncias Nº de clusters Clusters 1 d 1. 2 = 0, 3 5 12 / 3 / 4 / 5 / 6 2 d 3, 4 = 0, 4 4 12 / 34 / 5 / 6 3 d 12, , 5 = 2, 1 3 125 / 34 / 6 4 d 34, , 6 = 3, 85 2 125 / 346 5 d 125, , 346 =11. 5 1 123456

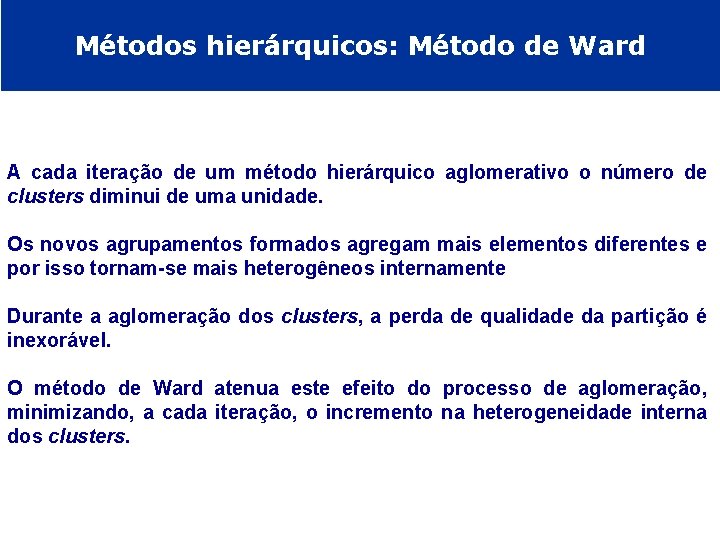

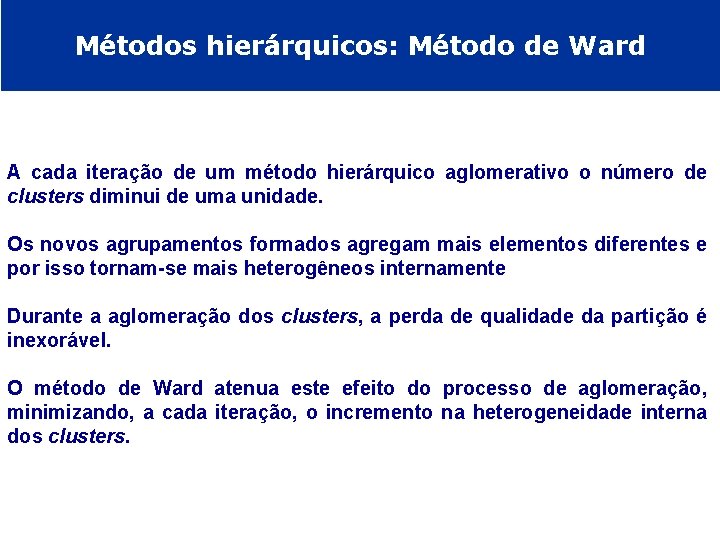

Métodos hierárquicos: Método de Ward A cada iteração de um método hierárquico aglomerativo o número de clusters diminui de uma unidade. Os novos agrupamentos formados agregam mais elementos diferentes e por isso tornam-se mais heterogêneos internamente Durante a aglomeração dos clusters, a perda de qualidade da partição é inexorável. O método de Ward atenua este efeito do processo de aglomeração, minimizando, a cada iteração, o incremento na heterogeneidade interna dos clusters.

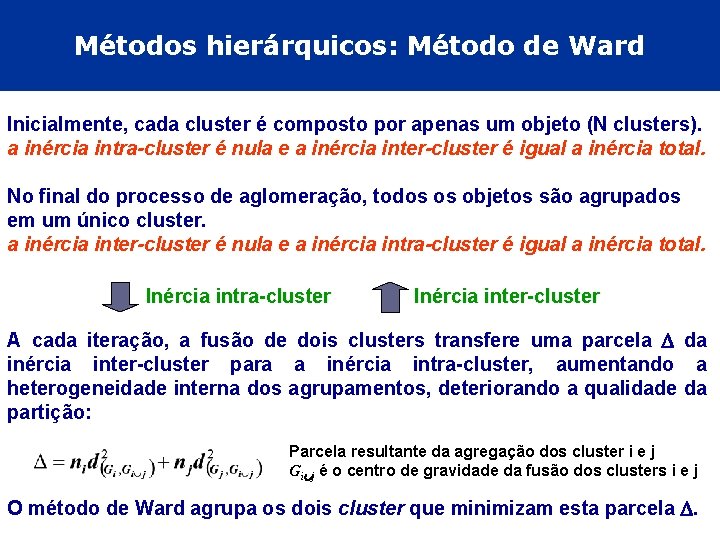

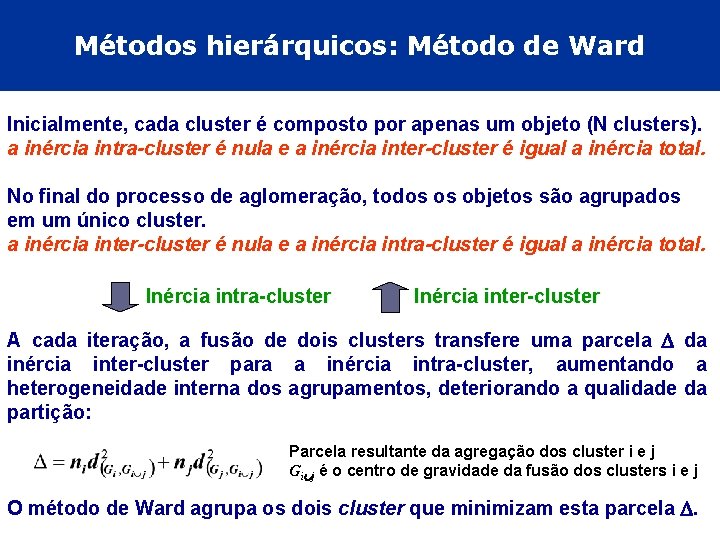

Métodos hierárquicos: Método de Ward Inicialmente, cada cluster é composto por apenas um objeto (N clusters). a inércia intra-cluster é nula e a inércia inter-cluster é igual a inércia total. No final do processo de aglomeração, todos os objetos são agrupados em um único cluster. a inércia inter-cluster é nula e a inércia intra-cluster é igual a inércia total. Inércia intra-cluster Inércia inter-cluster A cada iteração, a fusão de dois clusters transfere uma parcela da inércia inter-cluster para a inércia intra-cluster, aumentando a heterogeneidade interna dos agrupamentos, deteriorando a qualidade da partição: Parcela resultante da agregação dos cluster i e j Gi j é o centro de gravidade da fusão dos clusters i e j O método de Ward agrupa os dois cluster que minimizam esta parcela .

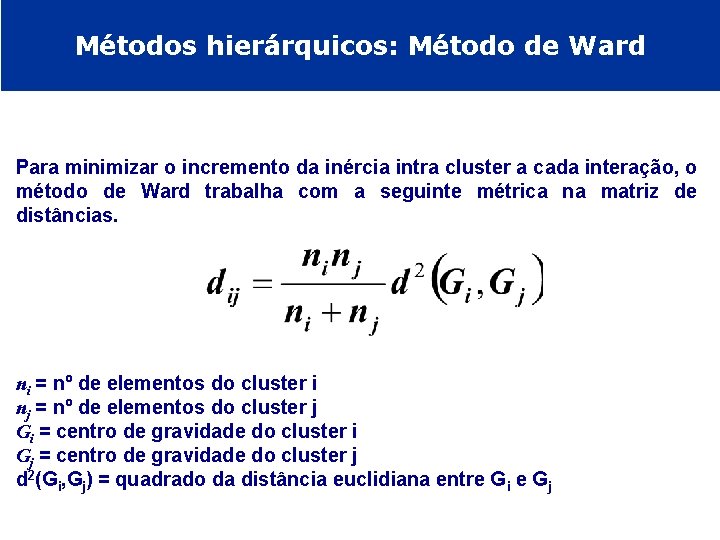

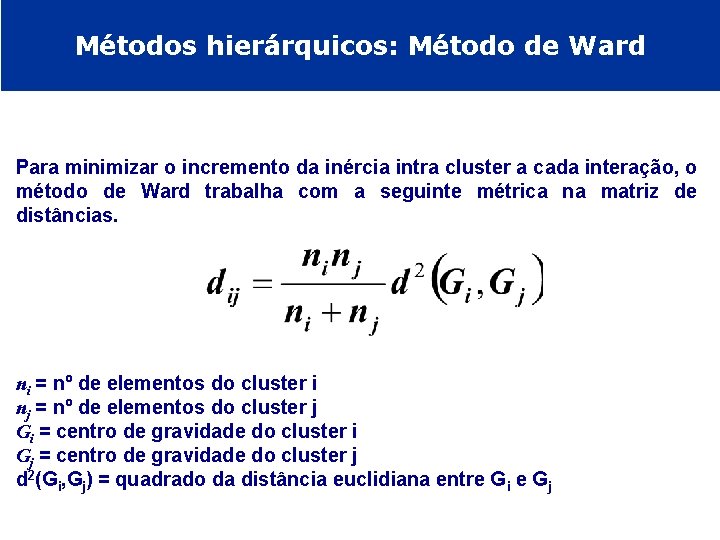

Métodos hierárquicos: Método de Ward Para minimizar o incremento da inércia intra cluster a cada interação, o método de Ward trabalha com a seguinte métrica na matriz de distâncias. ni = nº de elementos do cluster i nj = nº de elementos do cluster j Gi = centro de gravidade do cluster i Gj = centro de gravidade do cluster j d 2(Gi, Gj) = quadrado da distância euclidiana entre Gi e Gj

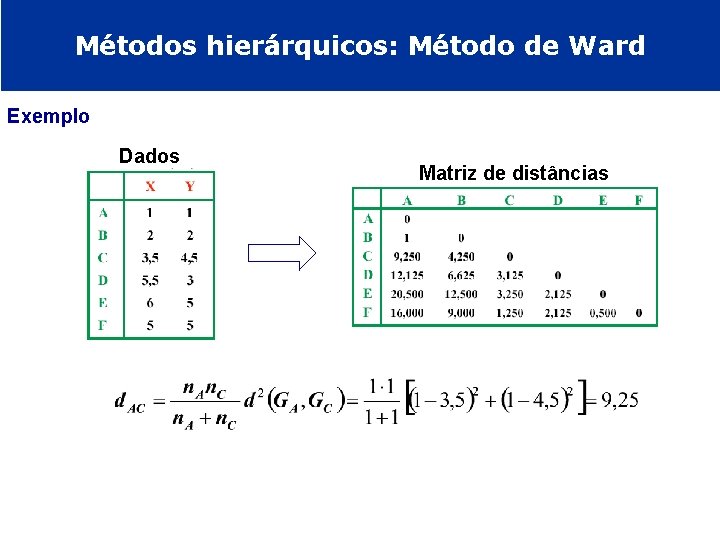

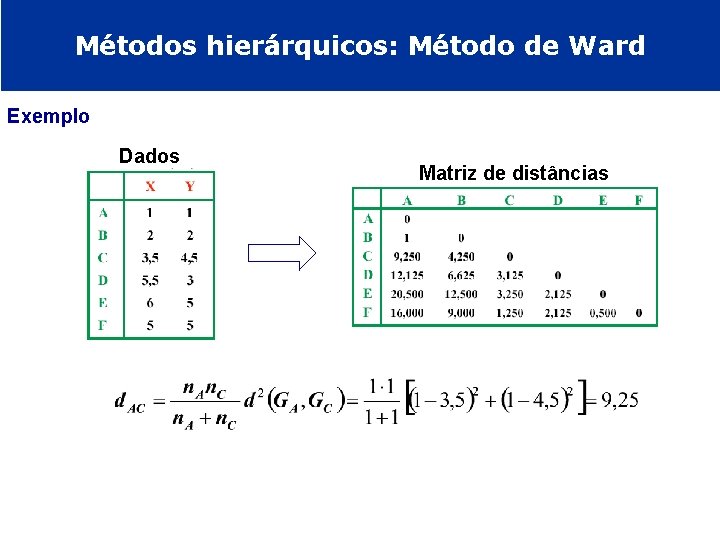

Métodos hierárquicos: Método de Ward Exemplo Dados Matriz de distâncias

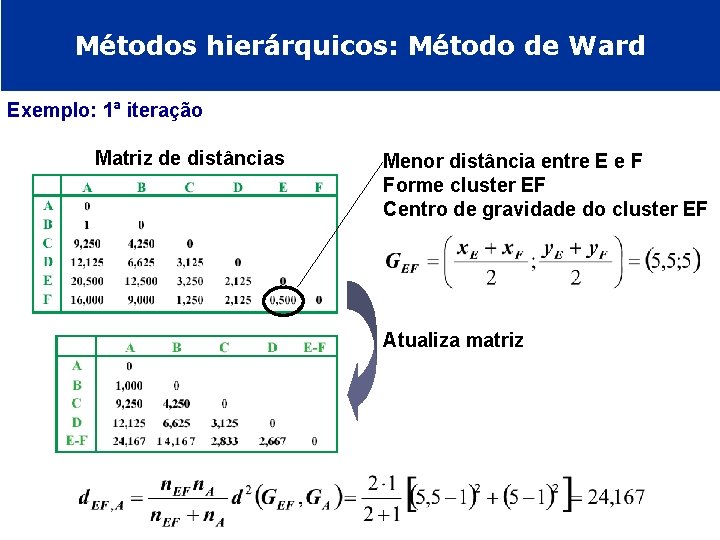

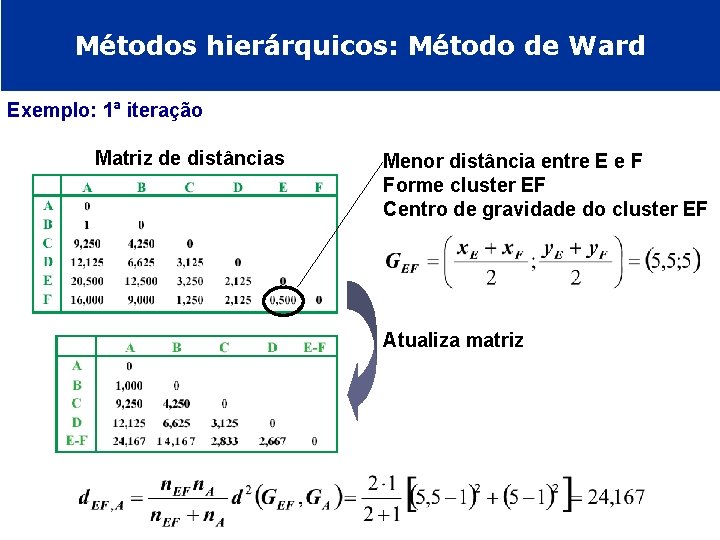

Métodos hierárquicos: Método de Ward Exemplo: 1ª iteração Matriz de distâncias Menor distância entre E e F Forme cluster EF Centro de gravidade do cluster EF Atualiza matriz

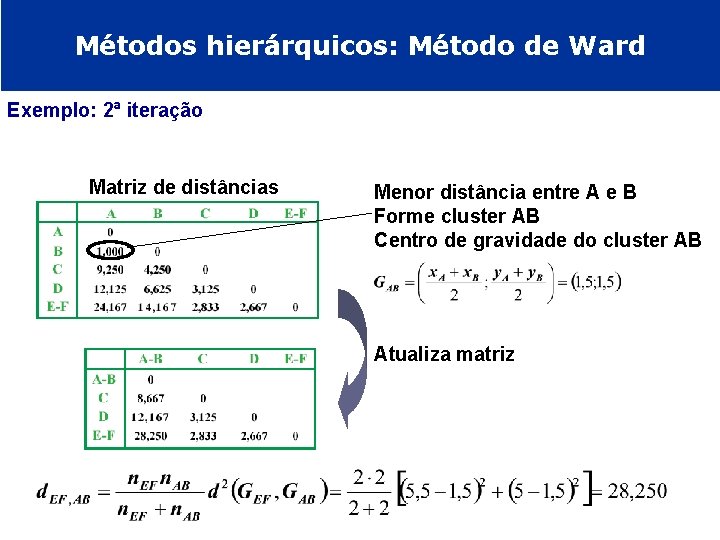

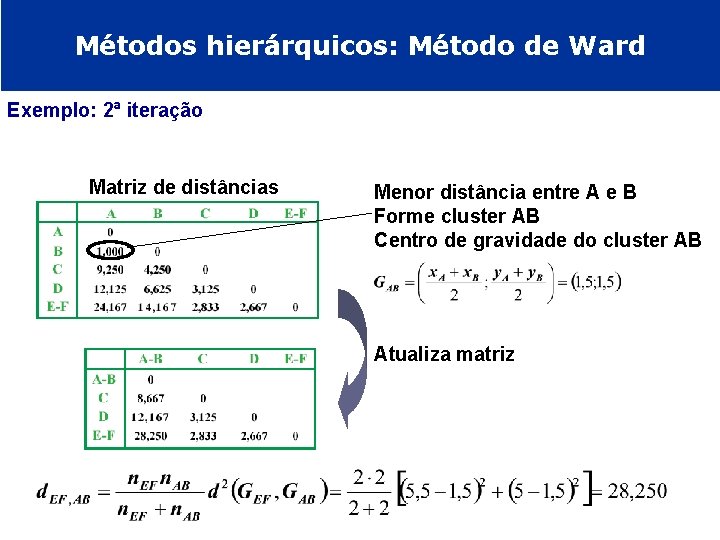

Métodos hierárquicos: Método de Ward Exemplo: 2ª iteração Matriz de distâncias Menor distância entre A e B Forme cluster AB Centro de gravidade do cluster AB Atualiza matriz

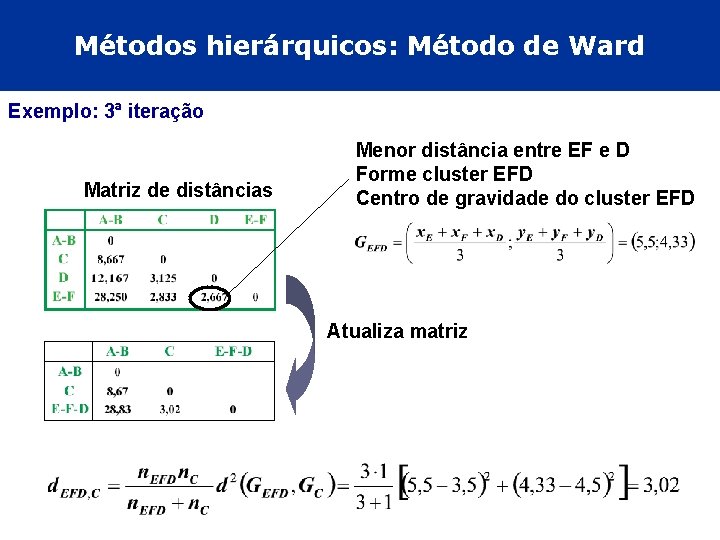

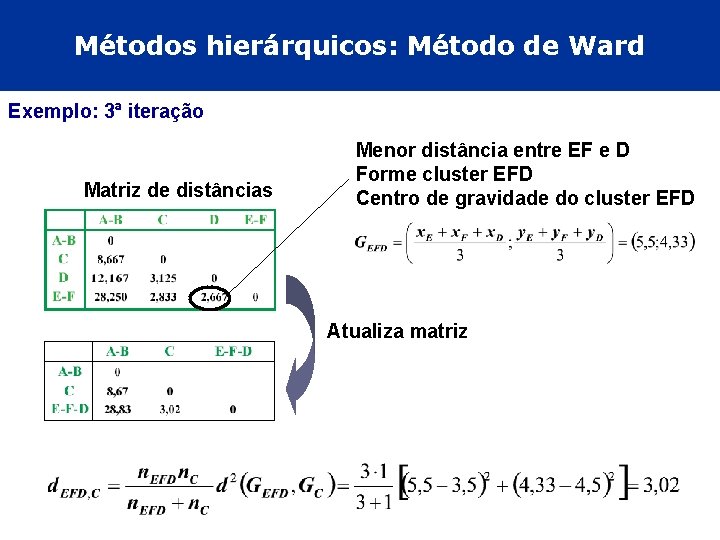

Métodos hierárquicos: Método de Ward Exemplo: 3ª iteração Matriz de distâncias Menor distância entre EF e D Forme cluster EFD Centro de gravidade do cluster EFD Atualiza matriz

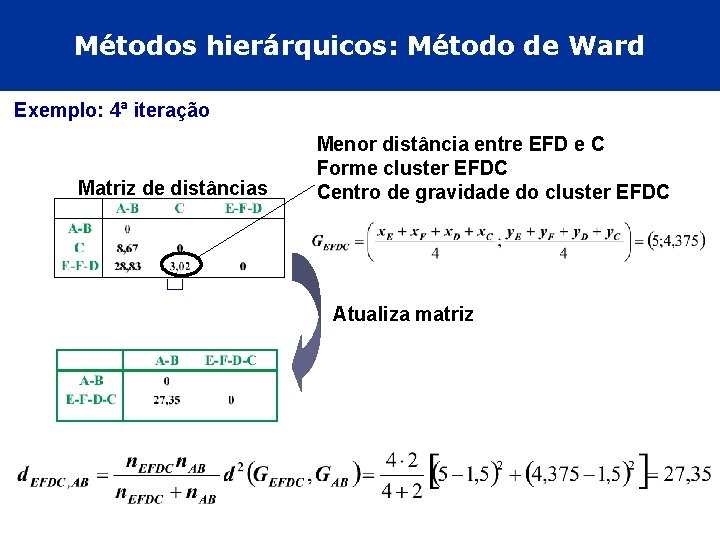

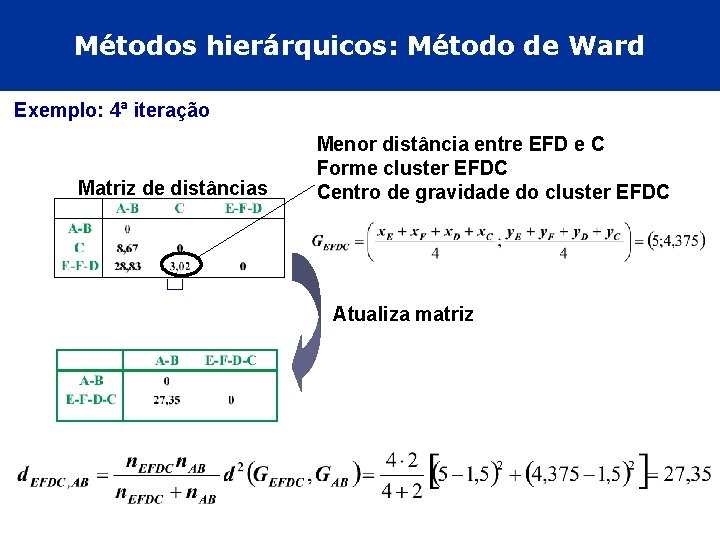

Métodos hierárquicos: Método de Ward Exemplo: 4ª iteração Matriz de distâncias Menor distância entre EFD e C Forme cluster EFDC Centro de gravidade do cluster EFDC Atualiza matriz

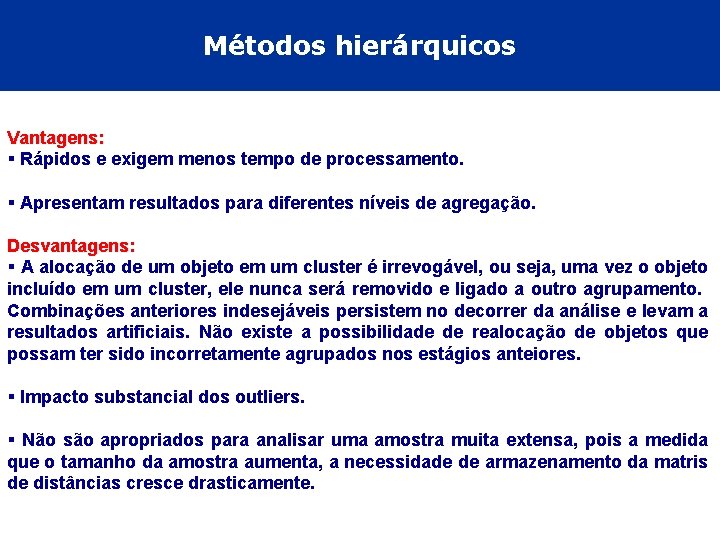

Métodos hierárquicos Vantagens: § Rápidos e exigem menos tempo de processamento. § Apresentam resultados para diferentes níveis de agregação. Desvantagens: § A alocação de um objeto em um cluster é irrevogável, ou seja, uma vez o objeto incluído em um cluster, ele nunca será removido e ligado a outro agrupamento. Combinações anteriores indesejáveis persistem no decorrer da análise e levam a resultados artificiais. Não existe a possibilidade de realocação de objetos que possam ter sido incorretamente agrupados nos estágios anteiores. § Impacto substancial dos outliers. § Não são apropriados para analisar uma amostra muita extensa, pois a medida que o tamanho da amostra aumenta, a necessidade de armazenamento da matris de distâncias cresce drasticamente.

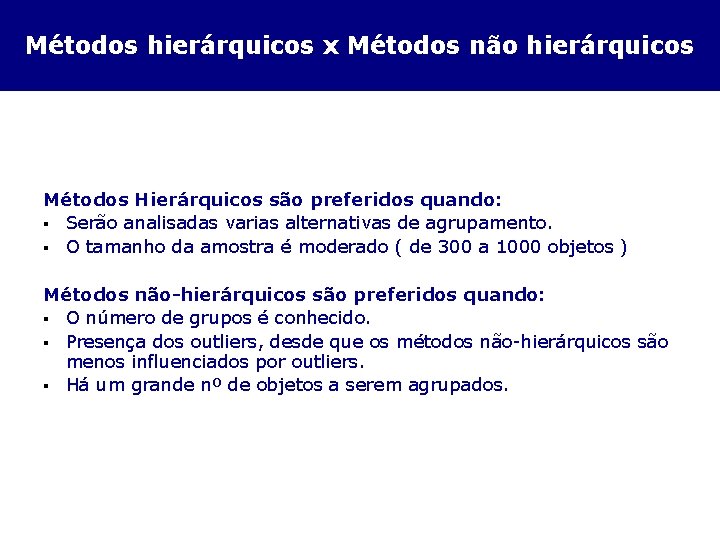

Métodos hierárquicos x Métodos não hierárquicos Métodos Hierárquicos são preferidos quando: § Serão analisadas varias alternativas de agrupamento. § O tamanho da amostra é moderado ( de 300 a 1000 objetos ) Métodos não-hierárquicos são preferidos quando: § O número de grupos é conhecido. § Presença dos outliers, desde que os métodos não-hierárquicos são menos influenciados por outliers. § Há um grande nº de objetos a serem agrupados.

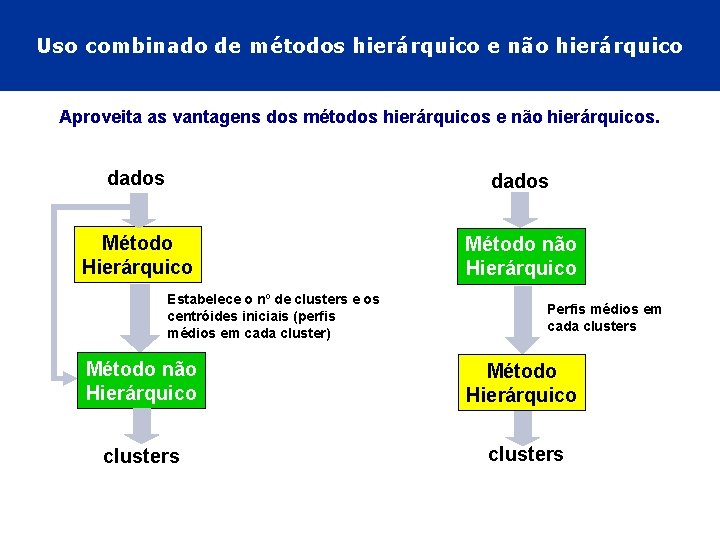

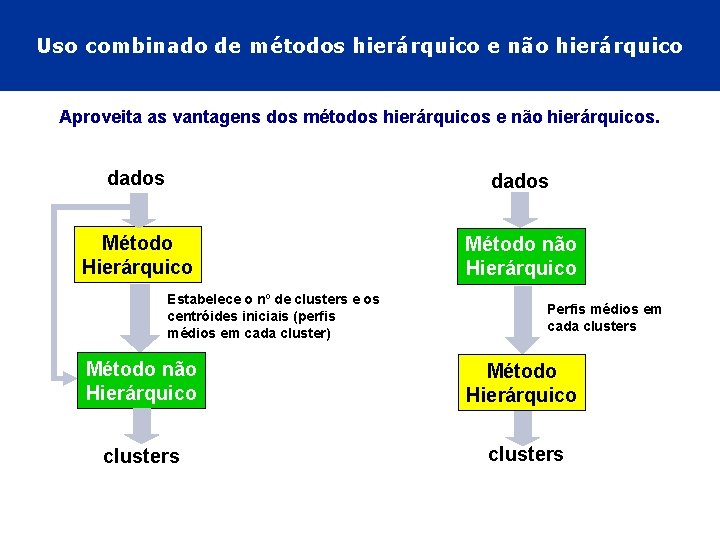

Uso combinado de métodos hierárquico e não hierárquico Aproveita as vantagens dos métodos hierárquicos e não hierárquicos. dados Método Hierárquico Método não Hierárquico Estabelece o nº de clusters e os centróides iniciais (perfis médios em cada cluster) Perfis médios em cada clusters Método não Hierárquico Método Hierárquico clusters

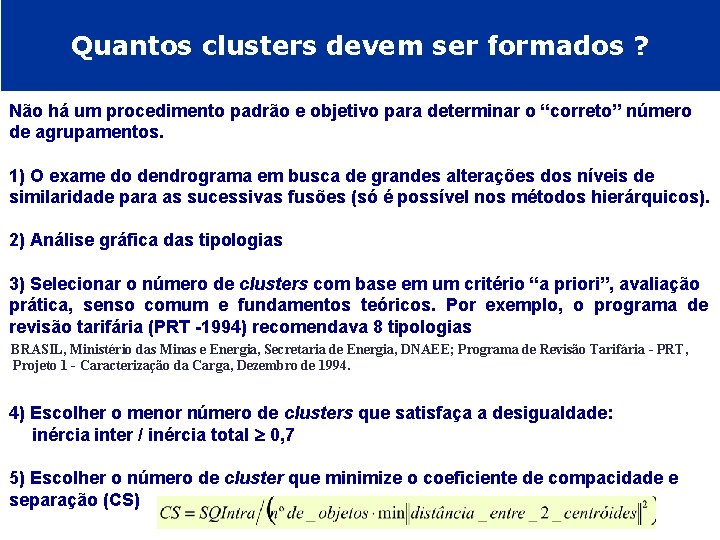

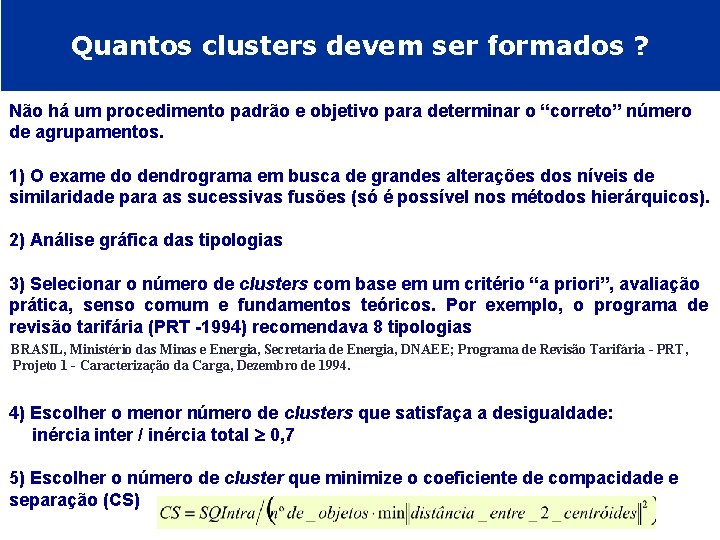

Quantos clusters devem ser formados ? Não há um procedimento padrão e objetivo para determinar o “correto” número de agrupamentos. 1) O exame do dendrograma em busca de grandes alterações dos níveis de similaridade para as sucessivas fusões (só é possível nos métodos hierárquicos). 2) Análise gráfica das tipologias 3) Selecionar o número de clusters com base em um critério “a priori”, avaliação prática, senso comum e fundamentos teóricos. Por exemplo, o programa de revisão tarifária (PRT -1994) recomendava 8 tipologias BRASIL, Ministério das Minas e Energia, Secretaria de Energia, DNAEE; Programa de Revisão Tarifária - PRT, Projeto 1 - Caracterização da Carga, Dezembro de 1994. 4) Escolher o menor número de clusters que satisfaça a desigualdade: inércia inter / inércia total 0, 7 5) Escolher o número de cluster que minimize o coeficiente de compacidade e separação (CS)

Análise de agrupamentos no SPSS

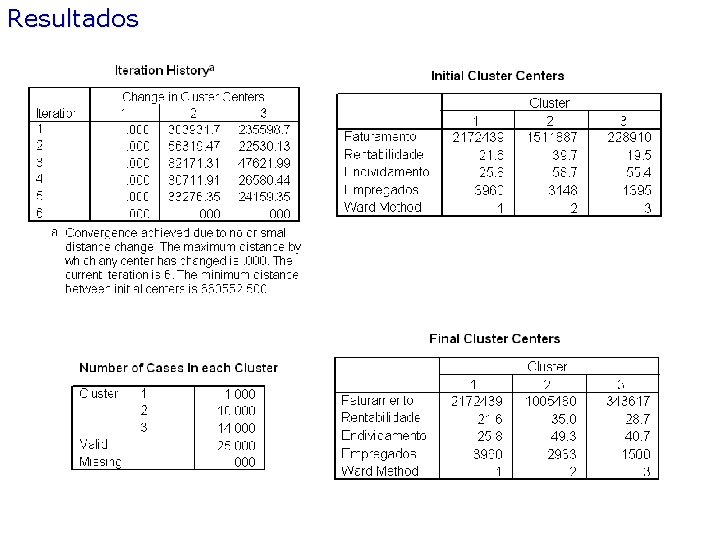

Exemplo: (Fávero et al, 2009) Imagine que um analista de mercado está interessado em segmentar um conjunto de empresas que atuam no setor de siderúrgia e metalurgia, com base em informações financeiras publicadas. Foram selecionadas 25 empresas que atuam nestes setores. Os dados foram obtidos na revista exame – Melhores e Maiores de 2005. Foram escolhidos quatro indicadores: Faturamento (US$ milhões), Rentabilidade do patrimônio líquido (%), Endividamento geral da empresa (%) e número de empregados.

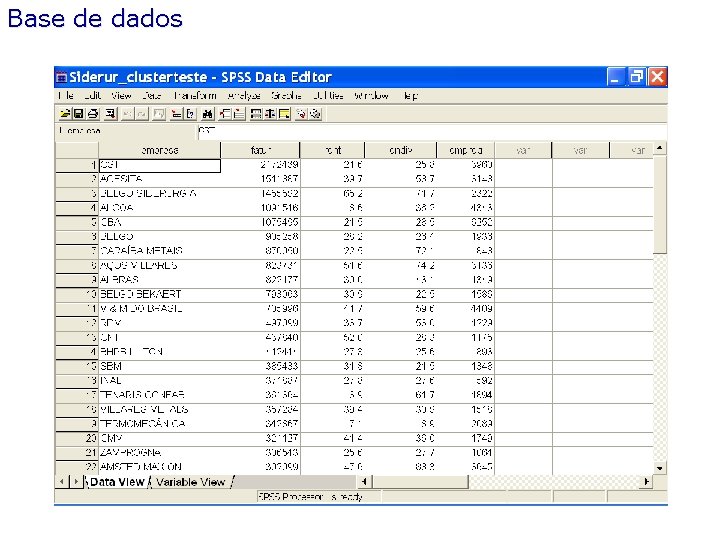

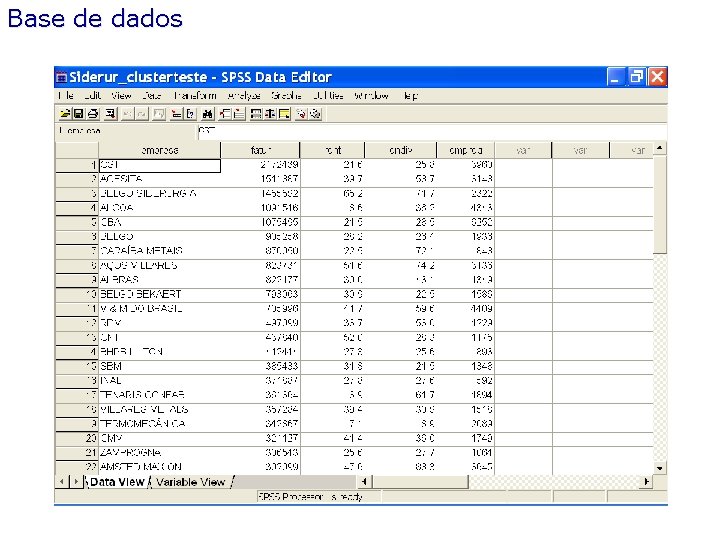

Base de dados

Métodos hierárquicos

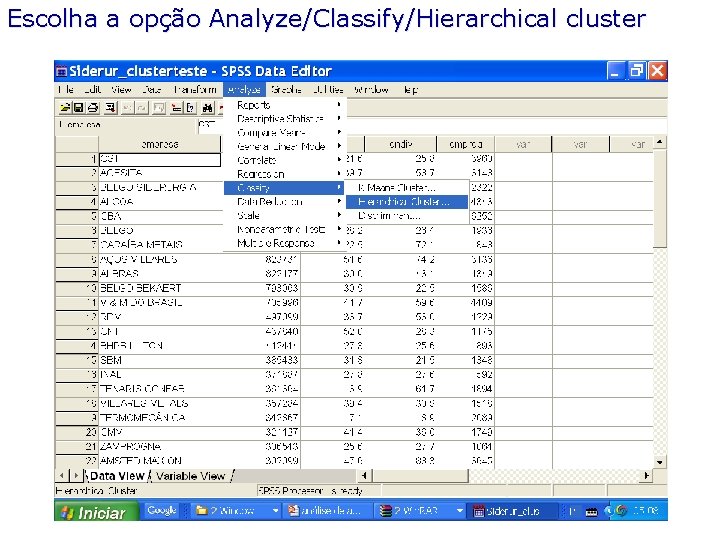

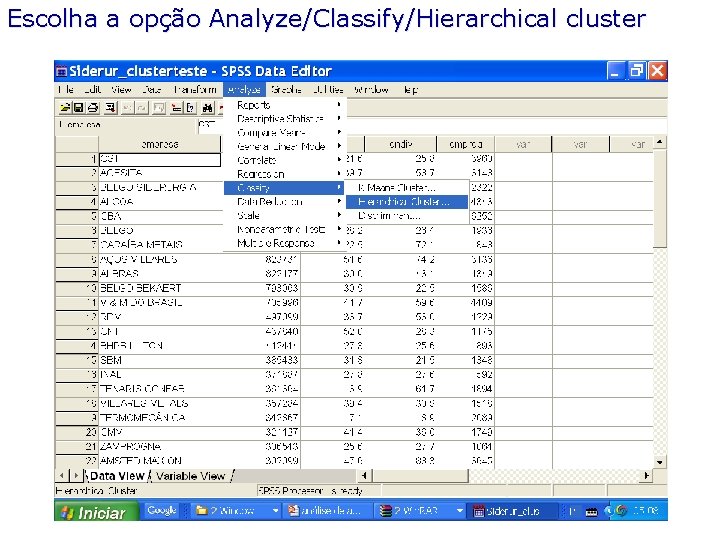

Escolha a opção Analyze/Classify/Hierarchical cluster

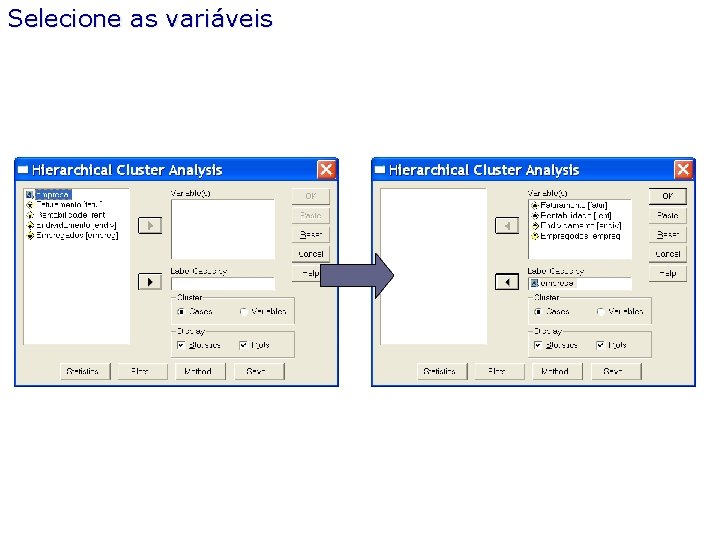

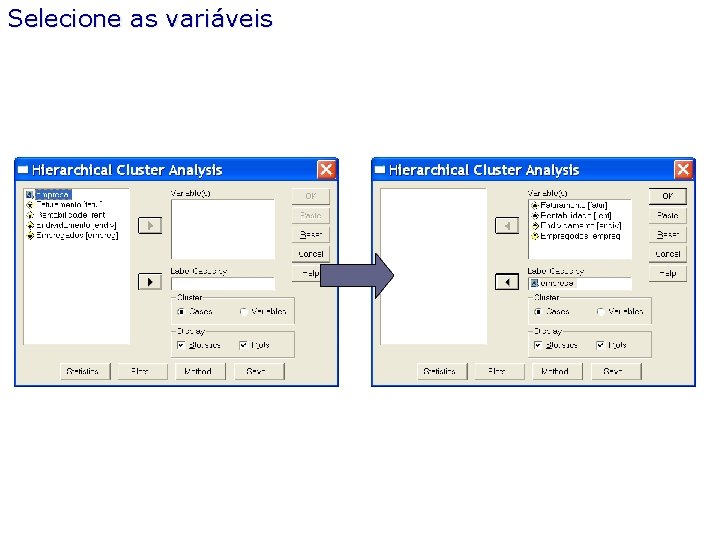

Selecione as variáveis

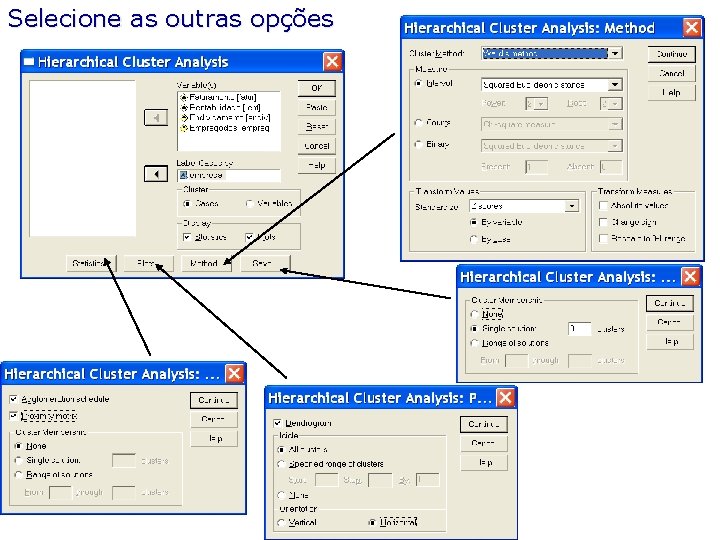

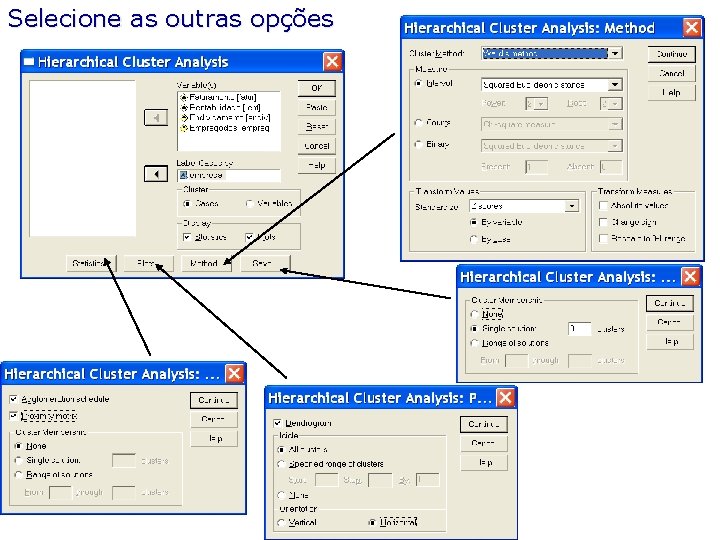

Selecione as outras opções

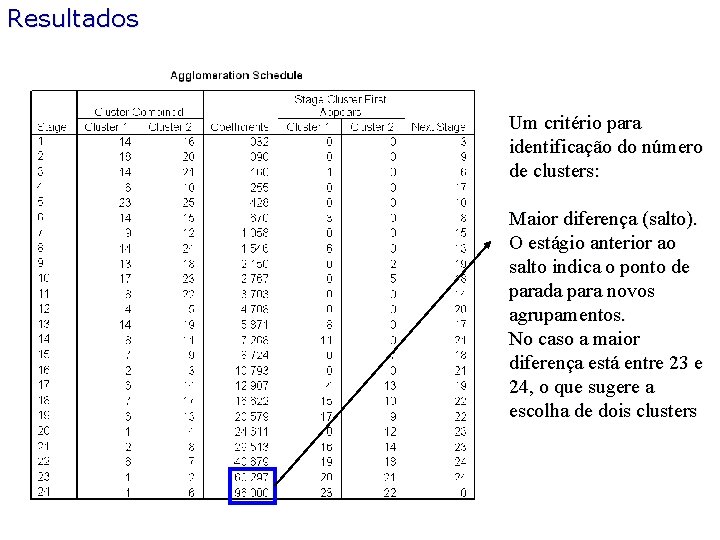

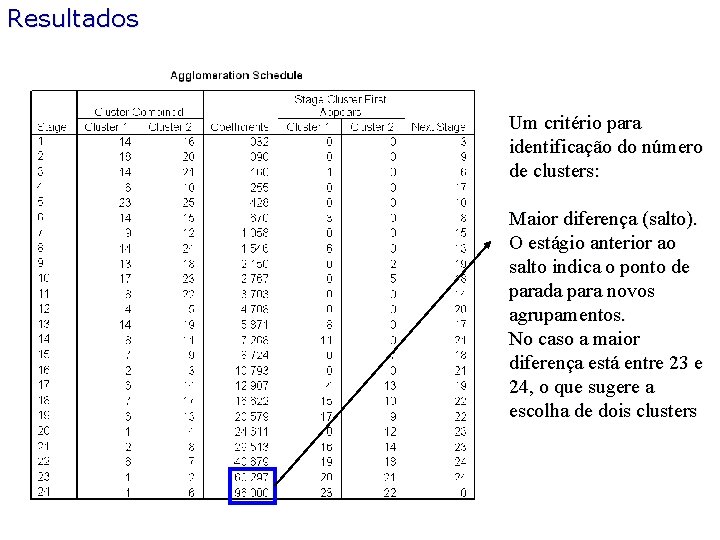

Resultados Um critério para identificação do número de clusters: Maior diferença (salto). O estágio anterior ao salto indica o ponto de parada para novos agrupamentos. No caso a maior diferença está entre 23 e 24, o que sugere a escolha de dois clusters

Resultados

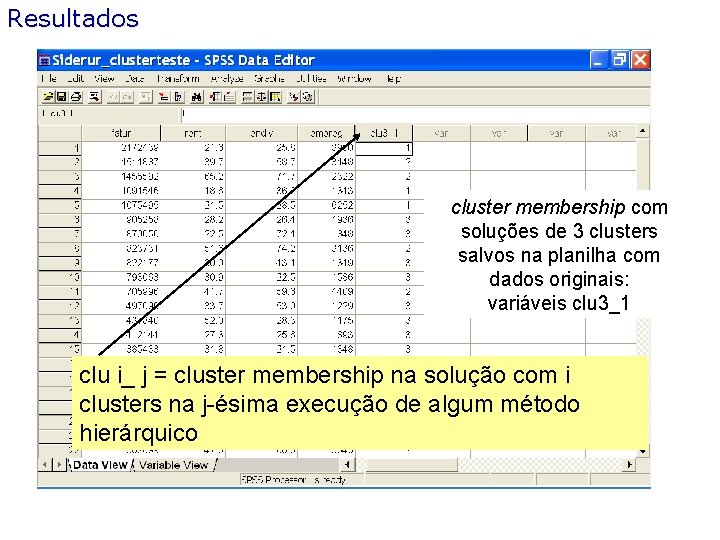

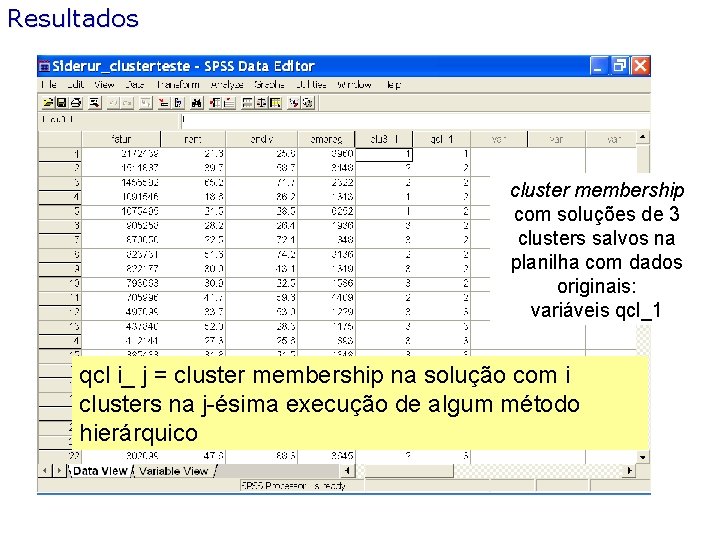

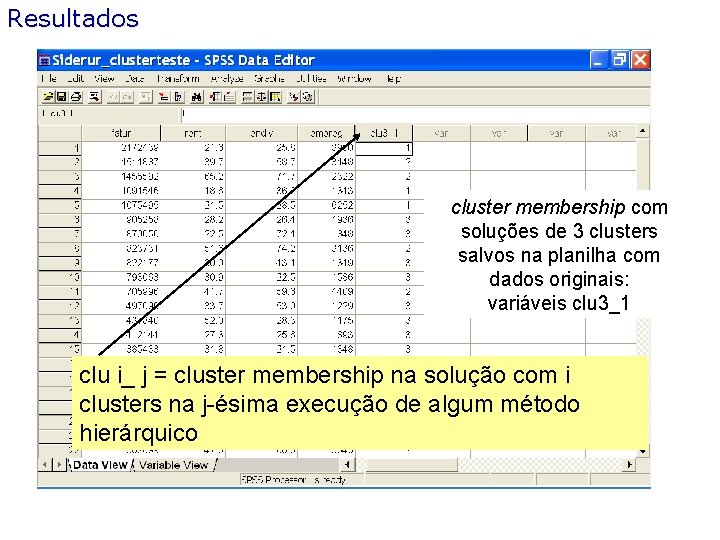

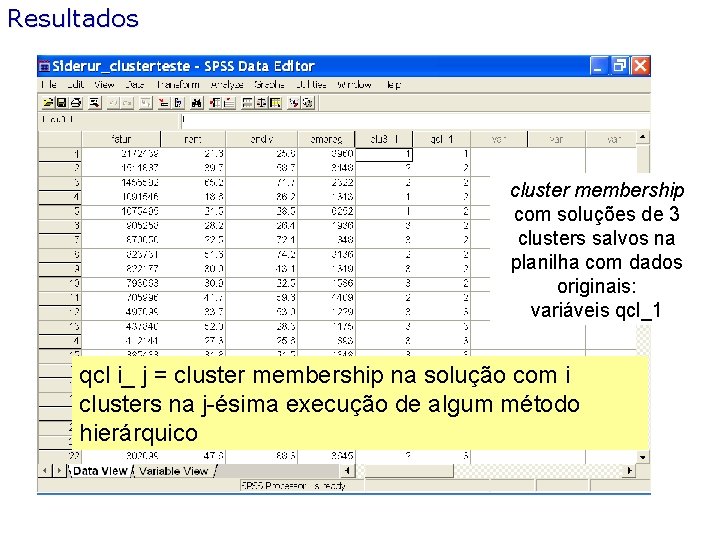

Resultados cluster membership com soluções de 3 clusters salvos na planilha com dados originais: variáveis clu 3_1 clu i_ j = cluster membership na solução com i clusters na j-ésima execução de algum método hierárquico

K-Means

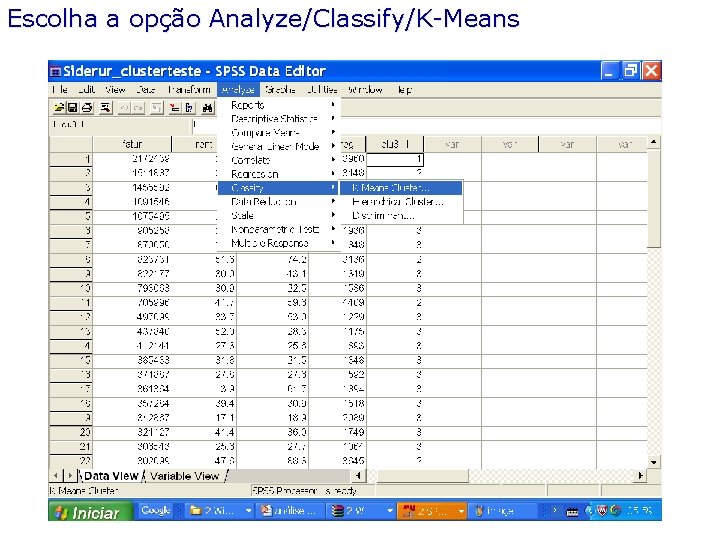

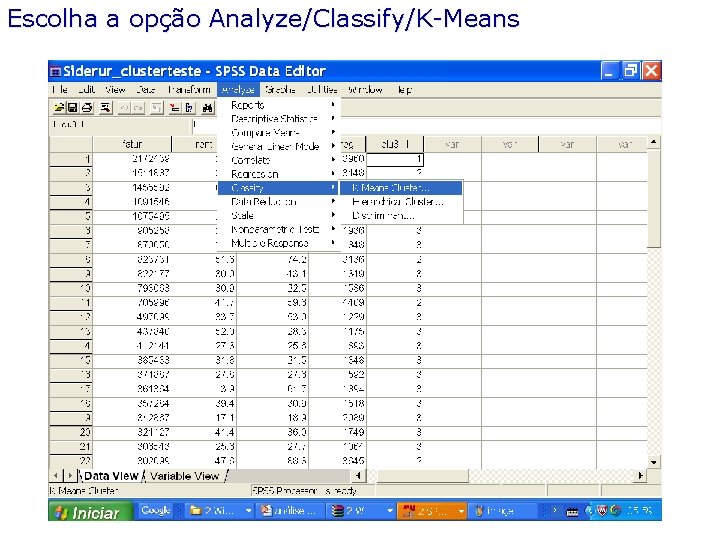

Escolha a opção Analyze/Classify/K-Means

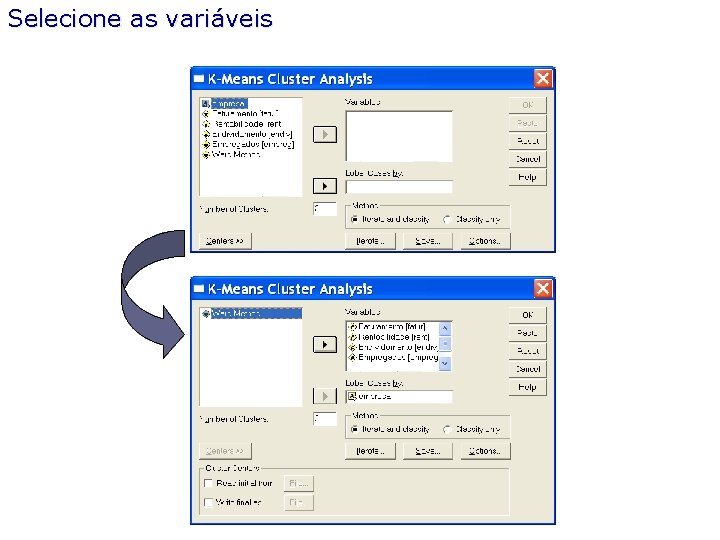

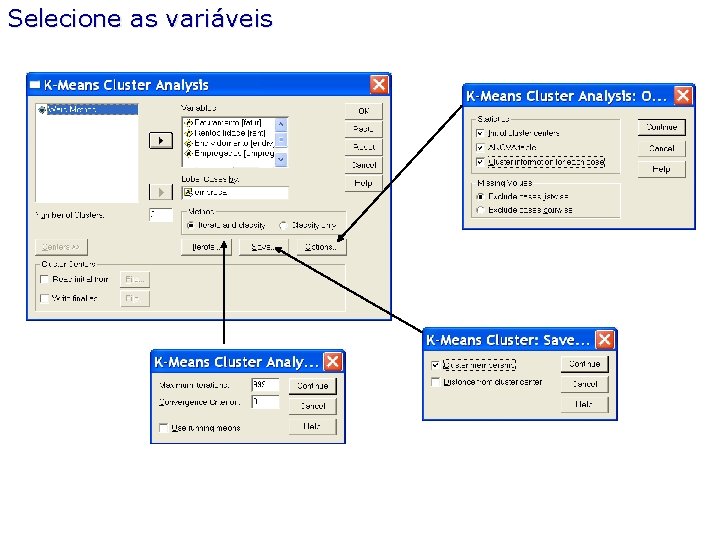

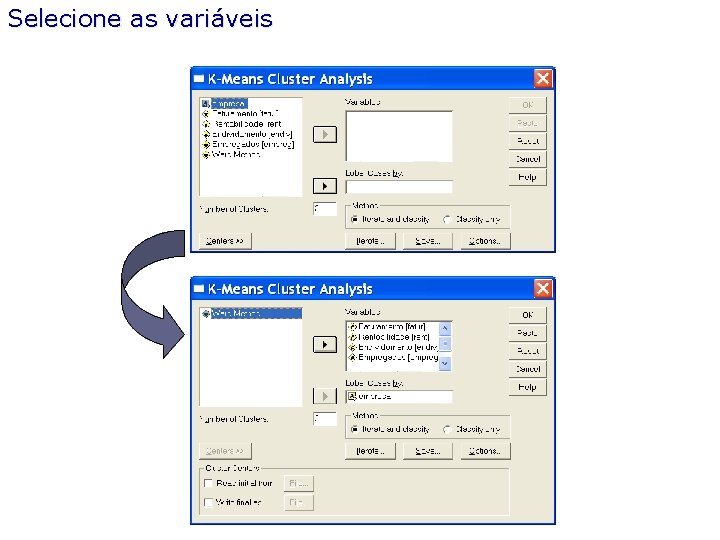

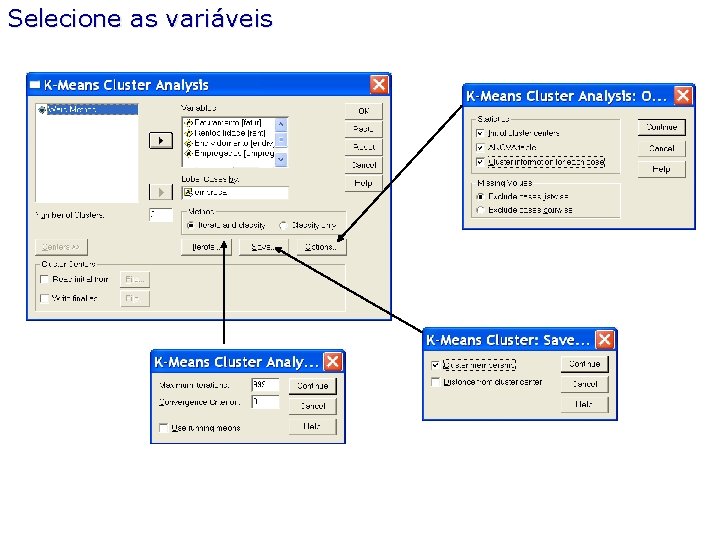

Selecione as variáveis

Selecione as variáveis

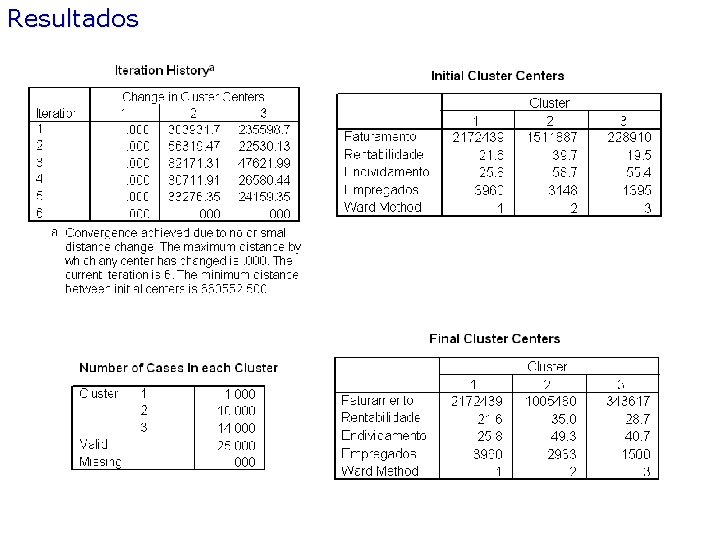

Resultados

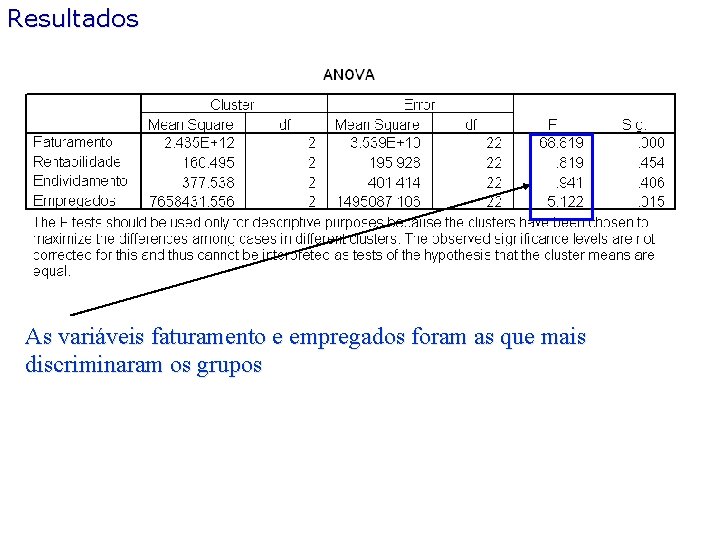

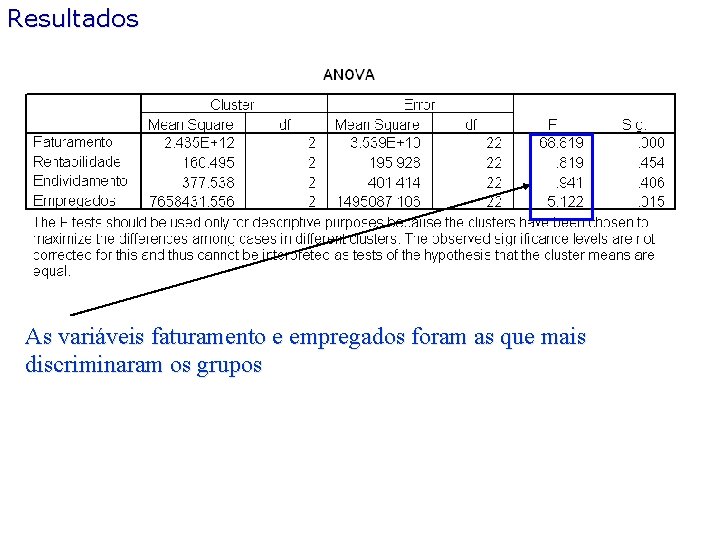

Resultados As variáveis faturamento e empregados foram as que mais discriminaram os grupos

Resultados cluster membership com soluções de 3 clusters salvos na planilha com dados originais: variáveis qcl_1 qcl i_ j = cluster membership na solução com i clusters na j-ésima execução de algum método hierárquico

Bibliografia CORRAR, L. J. ; PAULO, E. ; DIAS FILHO, J. M. (coordenadores) Análise Multivariada para os cursos de administração, ciências contábeis e esconomia, Editora Atlas, São Paulo, 2007. FÁVERO, L. P. ; BELFIORE, P. ; SILVA, F. L. ; CHAN, B. L. Análise de dados: modelagem multivariada para tomada de decisões, Campus, Rio de Janeiro, 2009. HAIR, J. F. ; ANDERSON, R. E. ; TATHAM R. L. ; BLACK W. O. Análise Multivariada de Dados, Bookman, 2005. JOHNSON, R. A. & WICHERN, D. W. Applied Multivariate Statistical Analysis, 5 th edition, Prentice Hall, New Jersey, 2002. LEBART, L. ; MORINEAU, A. ; PIRON, M. Statistique Multidimensionnelle, 3 e édition, Dunod, Paris, 2004. Exploratoira MINGOTI, S. A. Análise de dados através de métodos de estatística multivariada: uma abordagem aplicada, Editora UFMG, Belo Horizonte, 2005. REIS, E. Estatística multivariada aplicada, 2ª edição, Edições Sílabo, Lisboa, 2001.