19 Les entrepts de donnes et lanalyse de

![Classe d’équivalence des concepts qui ont le même extent [59]= Générateurs = minimaux NB Classe d’équivalence des concepts qui ont le même extent [59]= Générateurs = minimaux NB](https://slidetodoc.com/presentation_image_h/199b2723d671f5cd1f944cfe84e2739d/image-49.jpg)

- Slides: 115

19 Les entrepôts de données et l'analyse de données 28/02/2021 © Robert Godin. Tous droits réservés. 1

Entrepôt de données (datawarehouse) n Objectif : support à la prise de décision – Analyse de grand volume de données historiques Archivage de données opérationnelles et externes n Organisation pour analyse des données n Requêtes complexes sur gros volume n – Eviter de congestionner les BD opérationnelles Outils intégrés de construction et 28/02/2021 © Robert Godin. Tous droits réservés. n 2

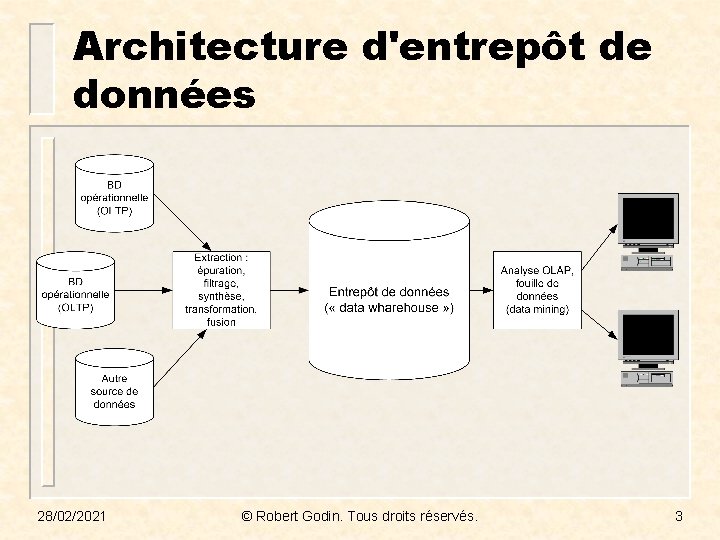

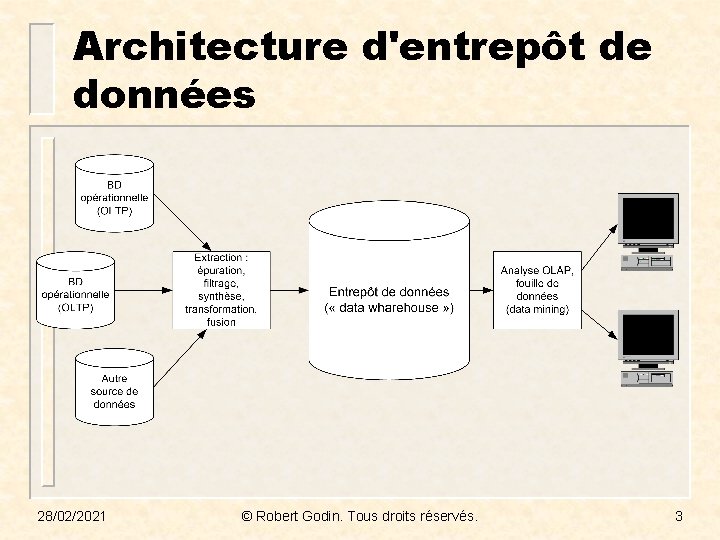

Architecture d'entrepôt de données 28/02/2021 © Robert Godin. Tous droits réservés. 3

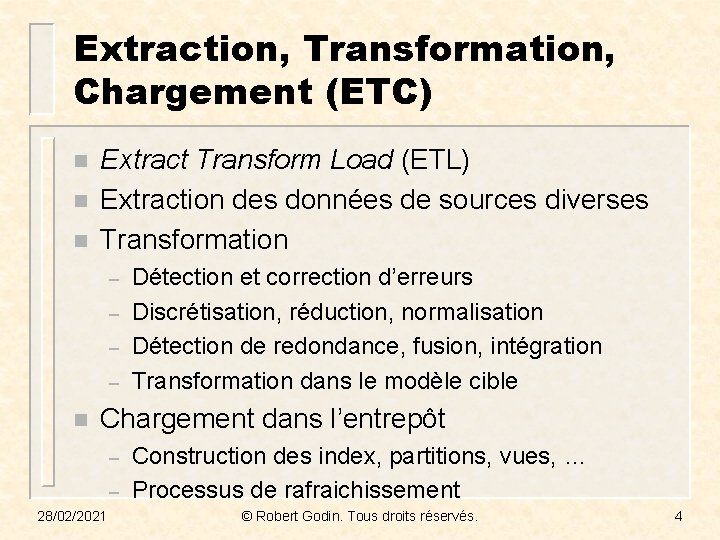

Extraction, Transformation, Chargement (ETC) n n n Extract Transform Load (ETL) Extraction des données de sources diverses Transformation – – n Détection et correction d’erreurs Discrétisation, réduction, normalisation Détection de redondance, fusion, intégration Transformation dans le modèle cible Chargement dans l’entrepôt – – 28/02/2021 Construction des index, partitions, vues, … Processus de rafraichissement © Robert Godin. Tous droits réservés. 4

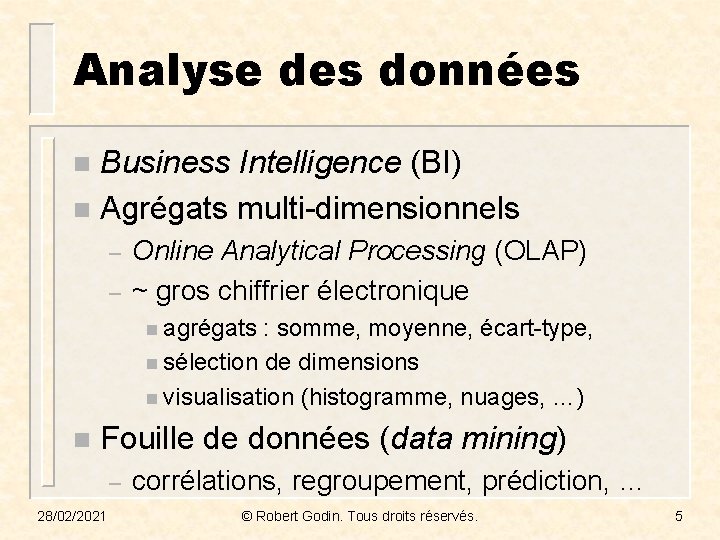

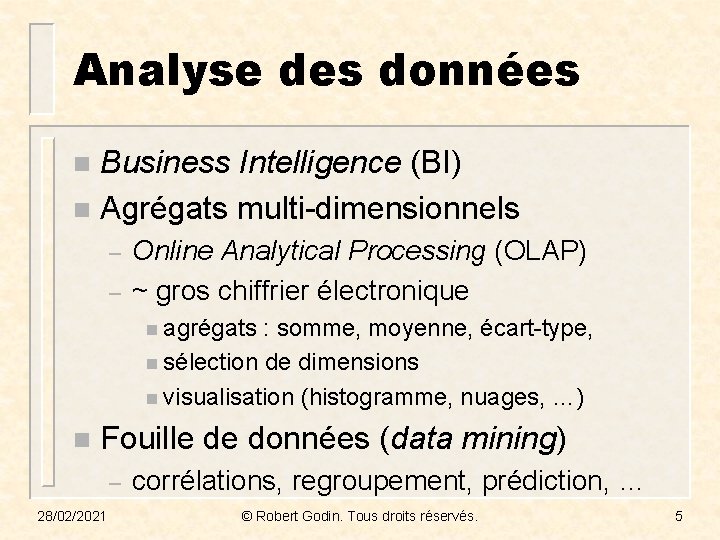

Analyse des données Business Intelligence (BI) n Agrégats multi-dimensionnels n – – Online Analytical Processing (OLAP) ~ gros chiffrier électronique n agrégats : somme, moyenne, écart-type, n sélection de dimensions n visualisation (histogramme, nuages, …) n Fouille de données (data mining) – 28/02/2021 corrélations, regroupement, prédiction, … © Robert Godin. Tous droits réservés. 5

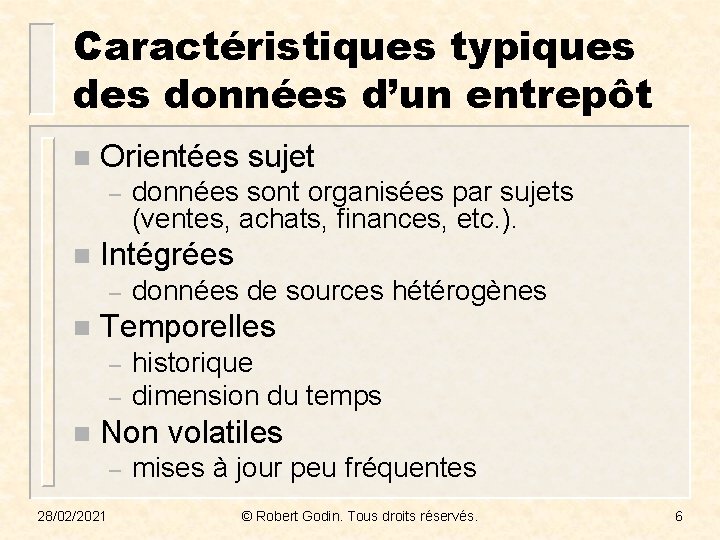

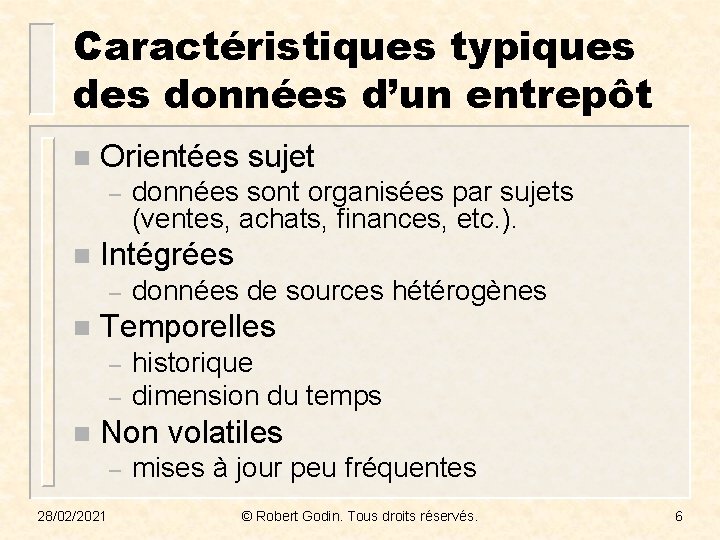

Caractéristiques typiques données d’un entrepôt n Orientées sujet – n Intégrées – n données de sources hétérogènes Temporelles – – n données sont organisées par sujets (ventes, achats, finances, etc. ). historique dimension du temps Non volatiles – 28/02/2021 mises à jour peu fréquentes © Robert Godin. Tous droits réservés. 6

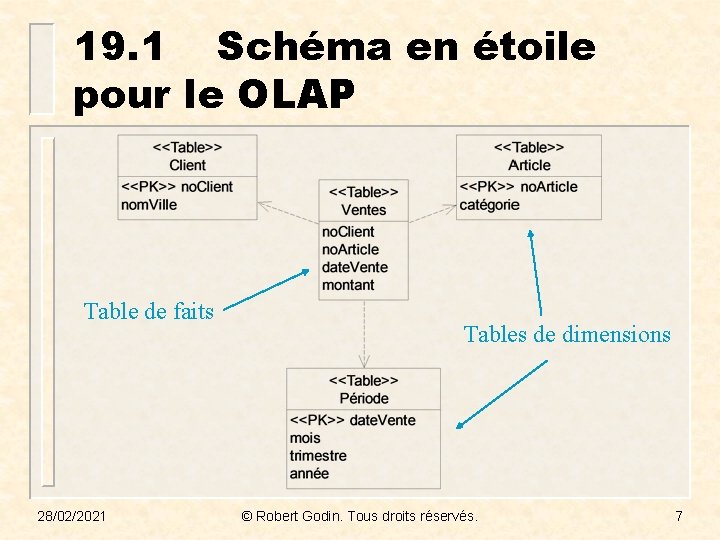

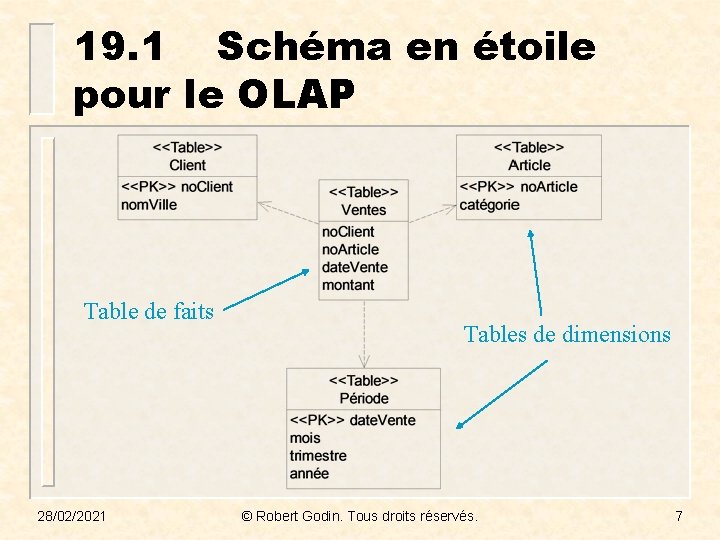

19. 1 Schéma en étoile pour le OLAP Table de faits 28/02/2021 Tables de dimensions © Robert Godin. Tous droits réservés. 7

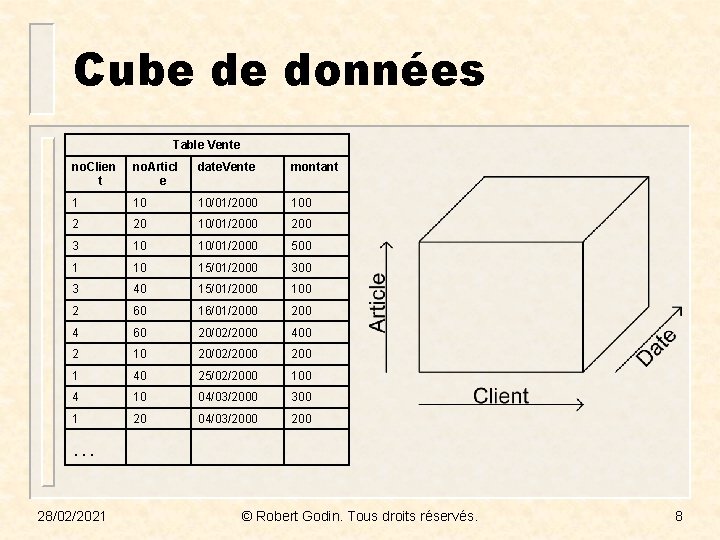

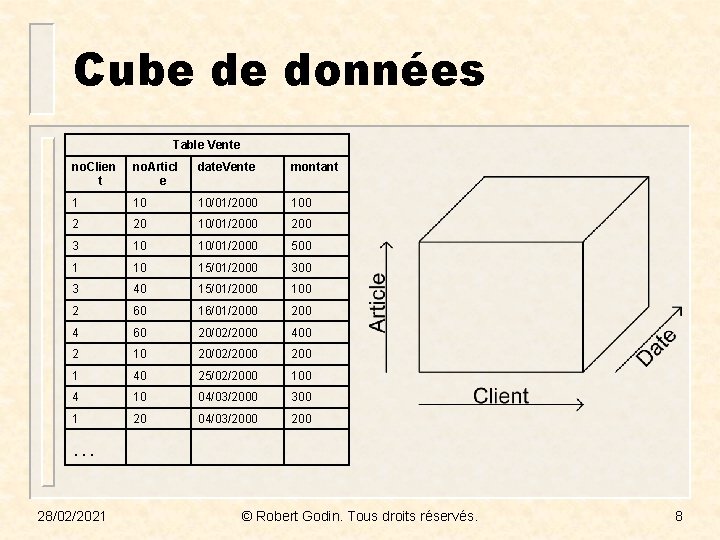

Cube de données Table Vente no. Clien t no. Articl e date. Vente montant 1 10 10/01/2000 100 2 20 10/01/2000 200 3 10 10/01/2000 500 1 10 15/01/2000 3 40 15/01/2000 100 2 60 16/01/2000 200 4 60 20/02/2000 400 2 10 20/02/2000 200 1 40 25/02/2000 100 4 10 04/03/2000 300 1 20 04/03/2000 200 … 28/02/2021 © Robert Godin. Tous droits réservés. 8

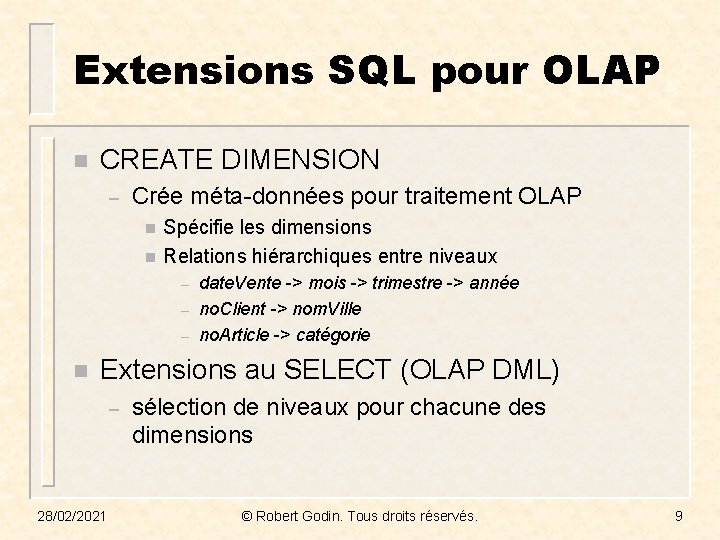

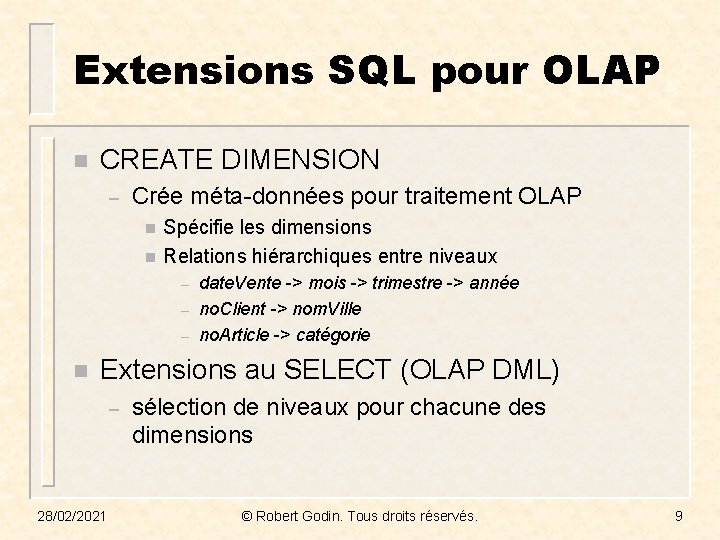

Extensions SQL pour OLAP n CREATE DIMENSION – Crée méta-données pour traitement OLAP n n Spécifie les dimensions Relations hiérarchiques entre niveaux – – – n date. Vente -> mois -> trimestre -> année no. Client -> nom. Ville no. Article -> catégorie Extensions au SELECT (OLAP DML) – 28/02/2021 sélection de niveaux pour chacune des dimensions © Robert Godin. Tous droits réservés. 9

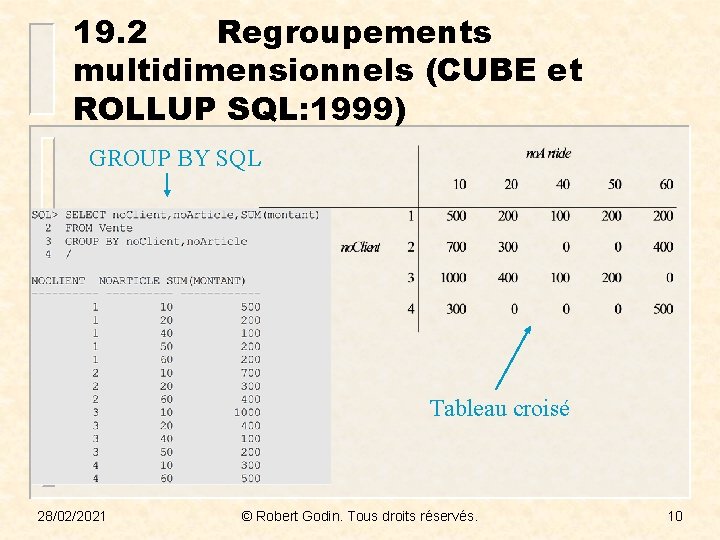

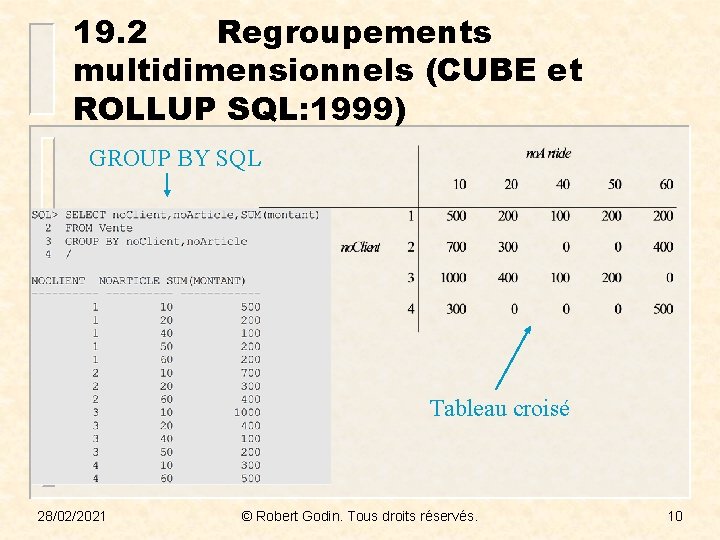

19. 2 Regroupements multidimensionnels (CUBE et ROLLUP SQL: 1999) GROUP BY SQL Tableau croisé 28/02/2021 © Robert Godin. Tous droits réservés. 10

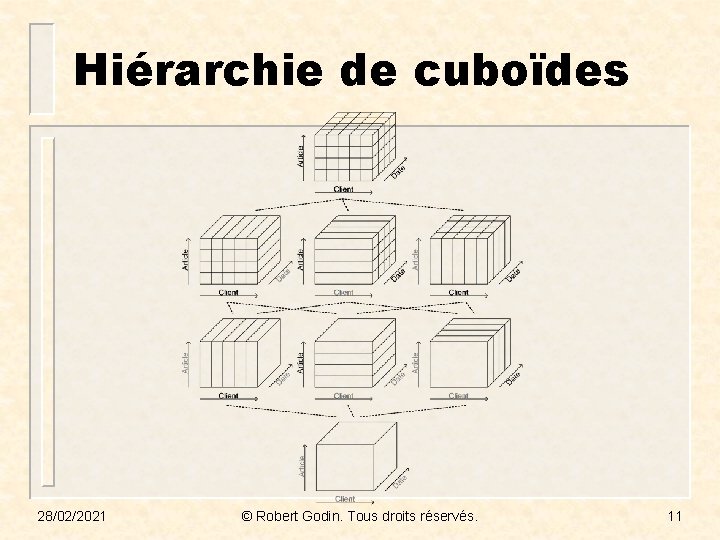

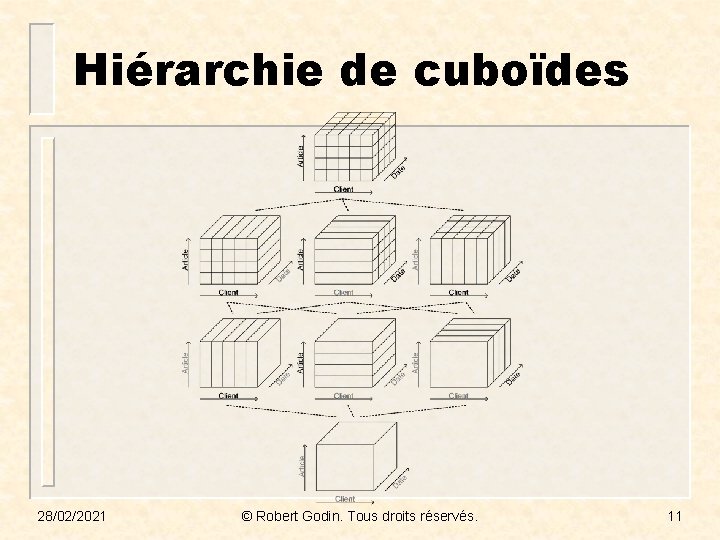

Hiérarchie de cuboïdes 28/02/2021 © Robert Godin. Tous droits réservés. 11

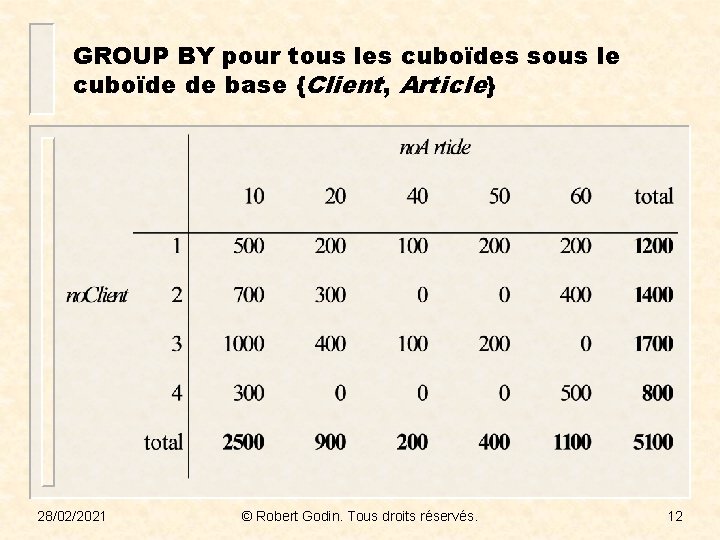

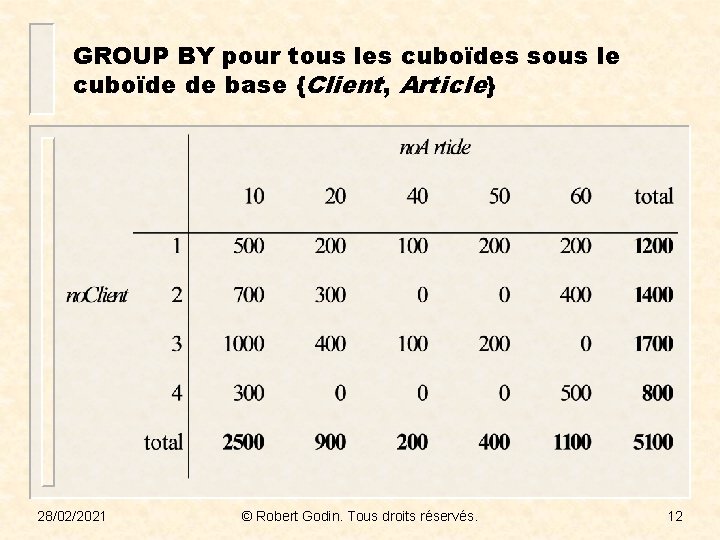

GROUP BY pour tous les cuboïdes sous le cuboïde de base {Client, Article} 28/02/2021 © Robert Godin. Tous droits réservés. 12

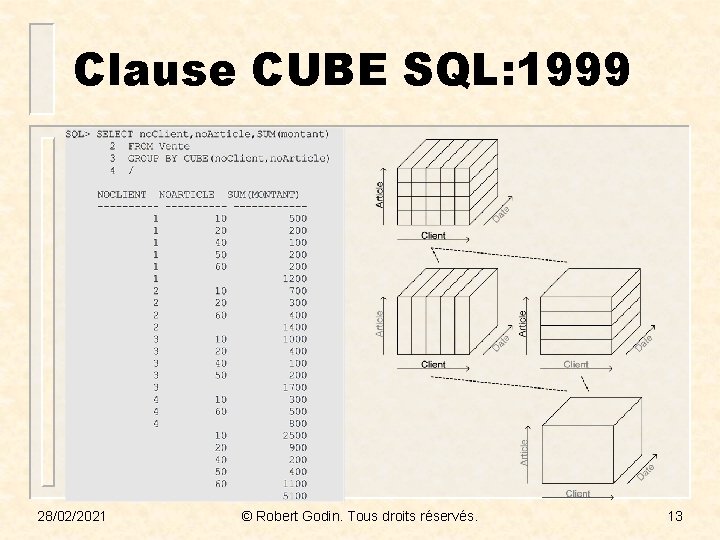

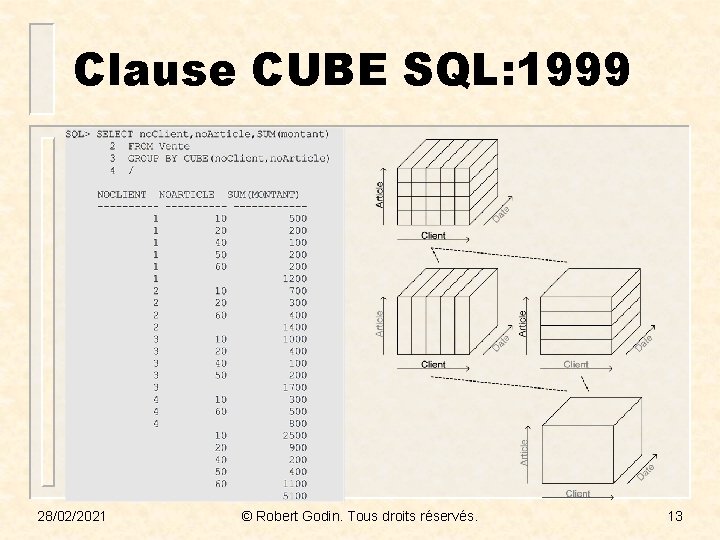

Clause CUBE SQL: 1999 28/02/2021 © Robert Godin. Tous droits réservés. 13

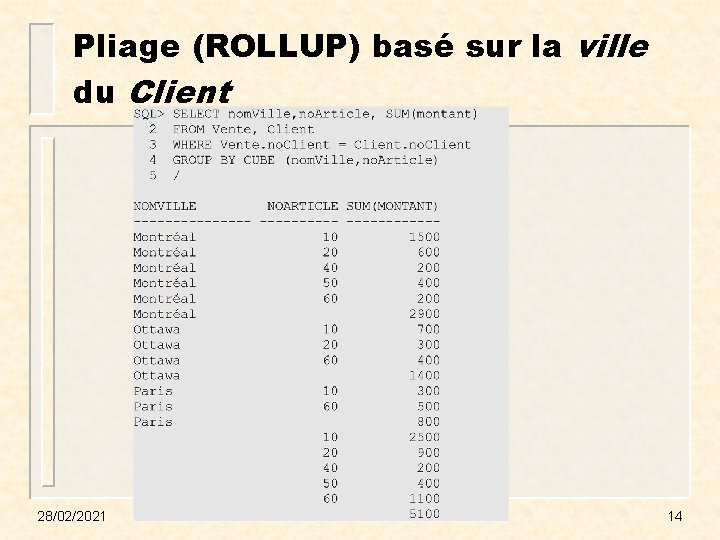

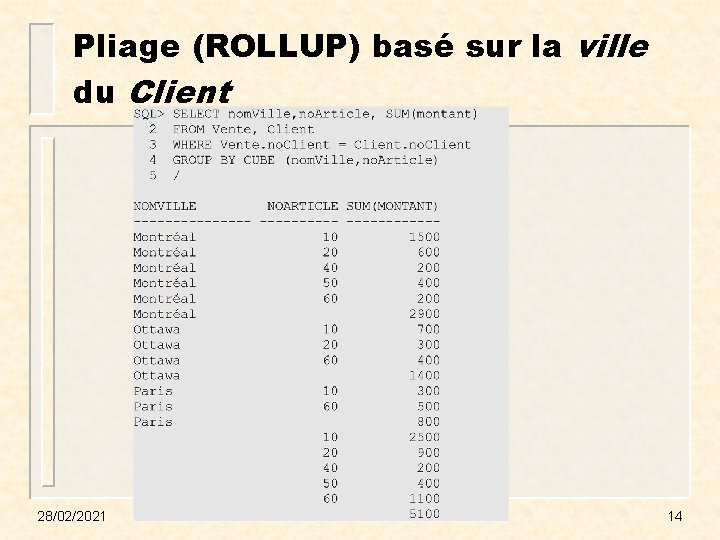

Pliage (ROLLUP) basé sur la ville du Client 28/02/2021 © Robert Godin. Tous droits réservés. 14

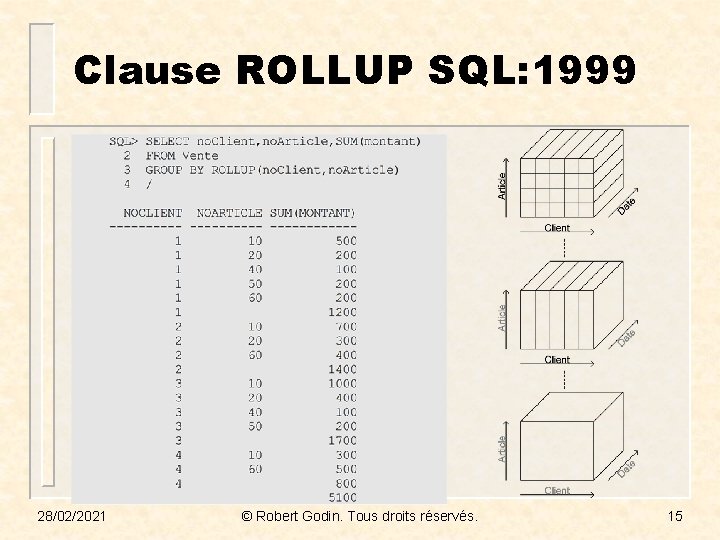

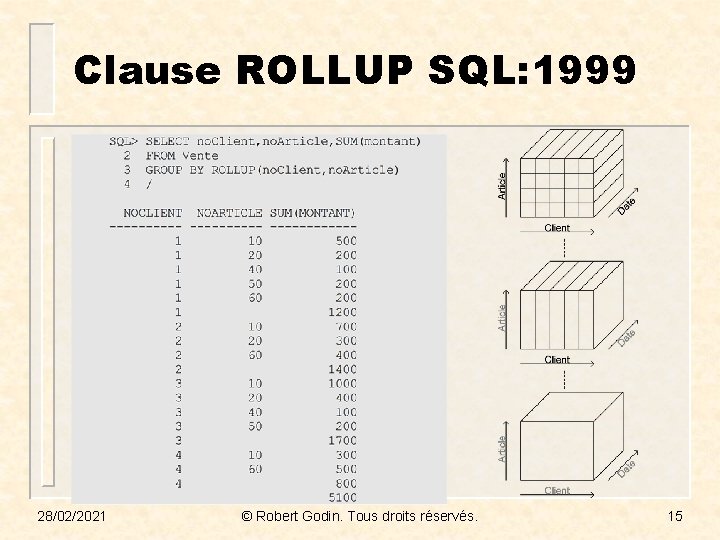

Clause ROLLUP SQL: 1999 28/02/2021 © Robert Godin. Tous droits réservés. 15

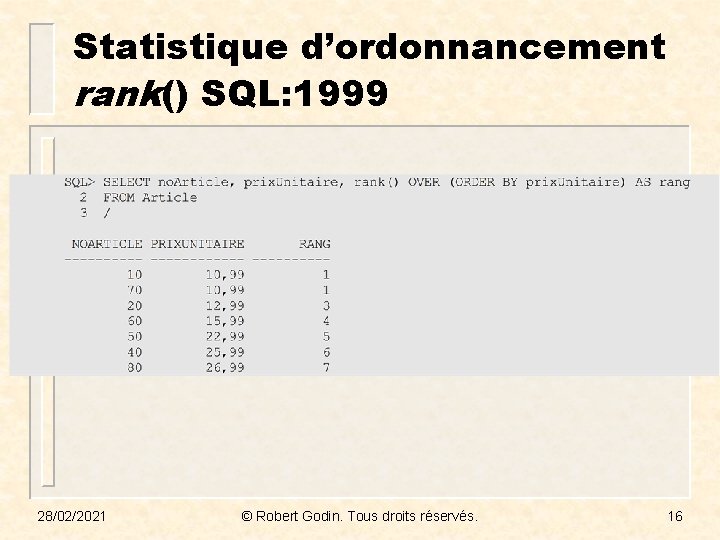

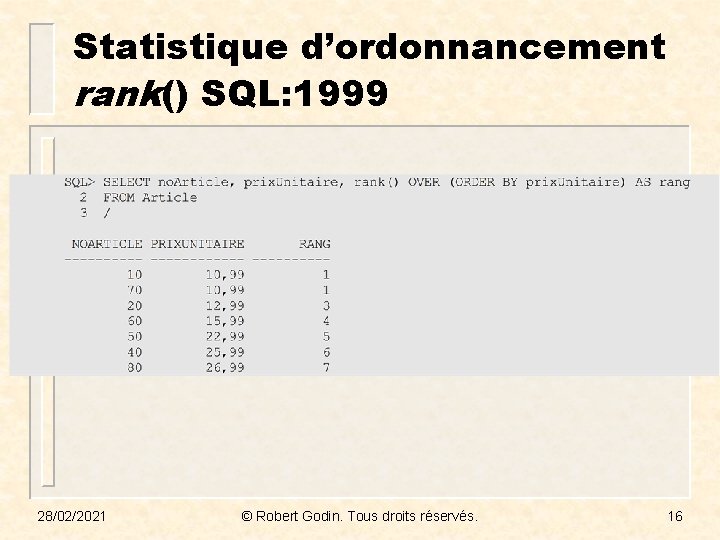

Statistique d’ordonnancement rank() SQL: 1999 28/02/2021 © Robert Godin. Tous droits réservés. 16

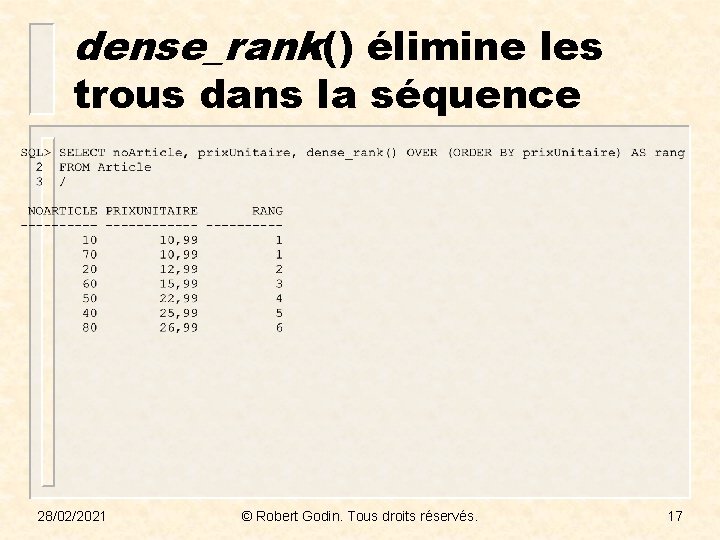

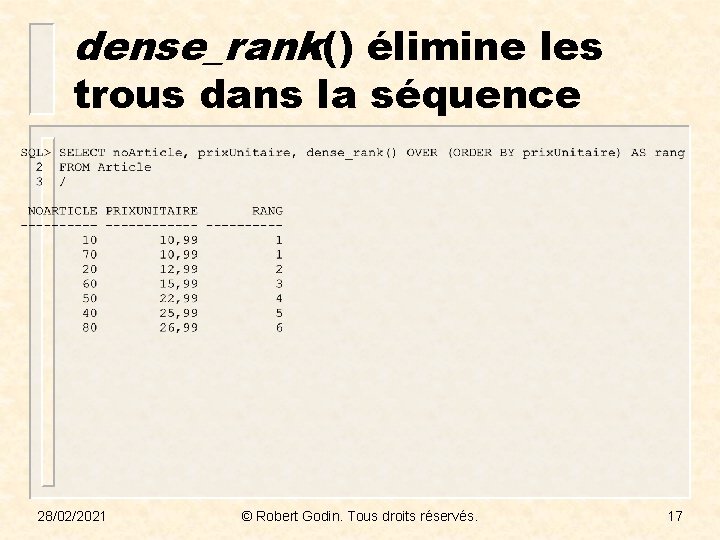

dense_rank() élimine les trous dans la séquence 28/02/2021 © Robert Godin. Tous droits réservés. 17

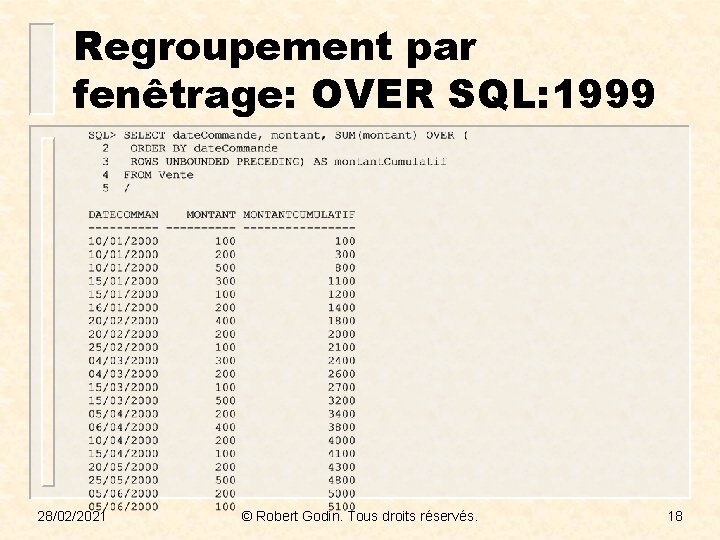

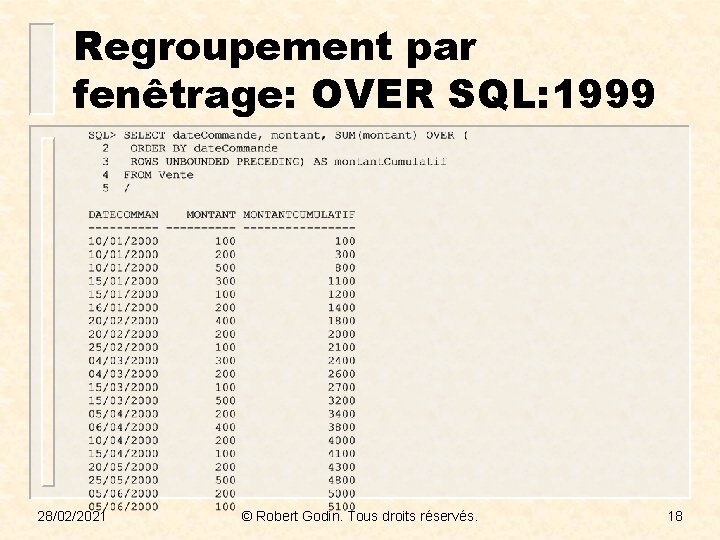

Regroupement par fenêtrage: OVER SQL: 1999 28/02/2021 © Robert Godin. Tous droits réservés. 18

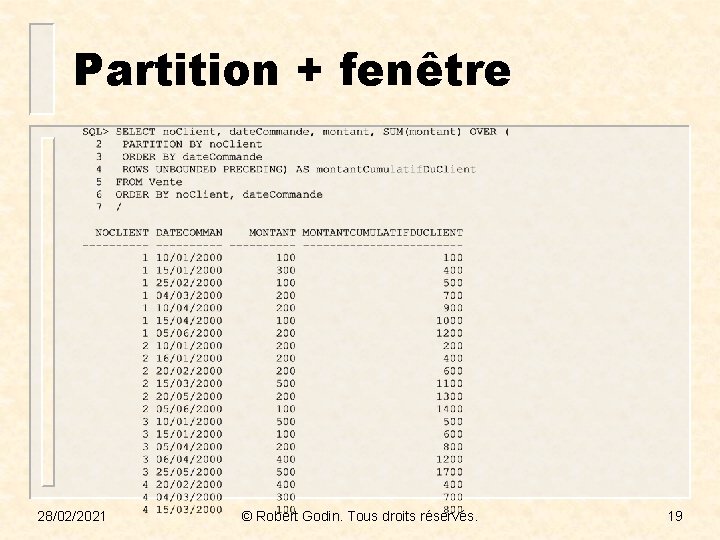

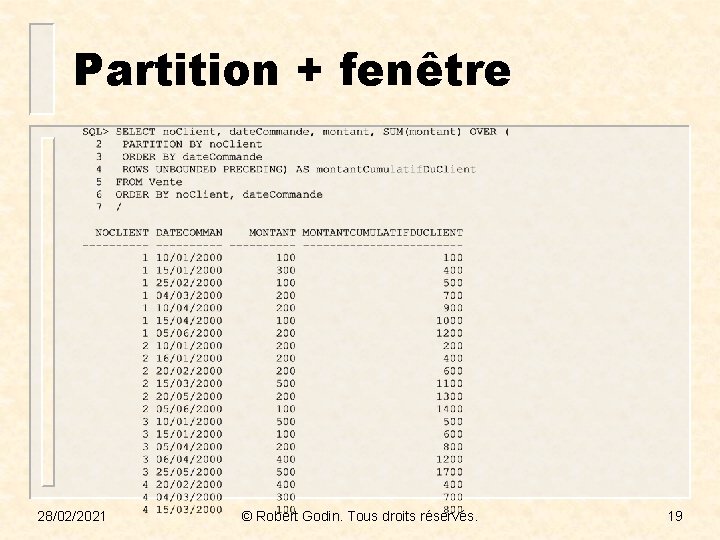

Partition + fenêtre 28/02/2021 © Robert Godin. Tous droits réservés. 19

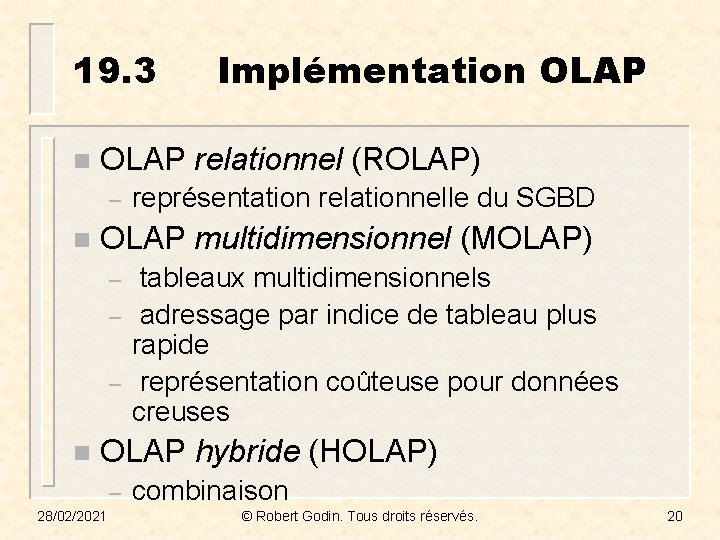

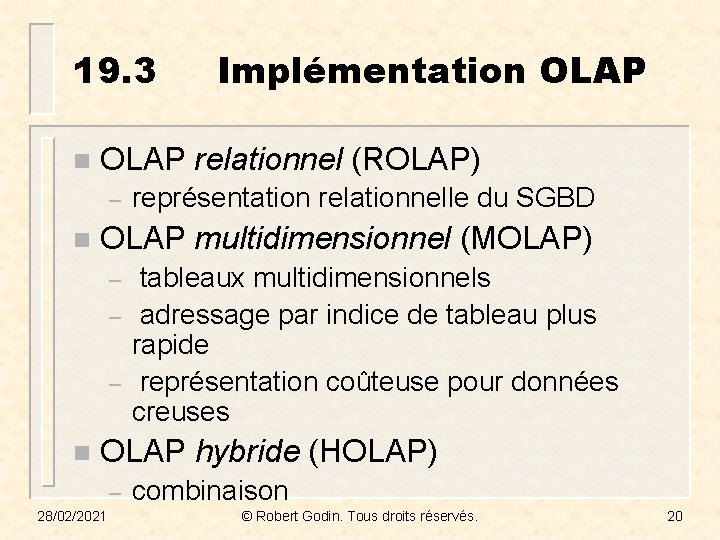

19. 3 n OLAP relationnel (ROLAP) – n représentation relationnelle du SGBD OLAP multidimensionnel (MOLAP) – – – n Implémentation OLAP tableaux multidimensionnels adressage par indice de tableau plus rapide représentation coûteuse pour données creuses OLAP hybride (HOLAP) – 28/02/2021 combinaison © Robert Godin. Tous droits réservés. 20

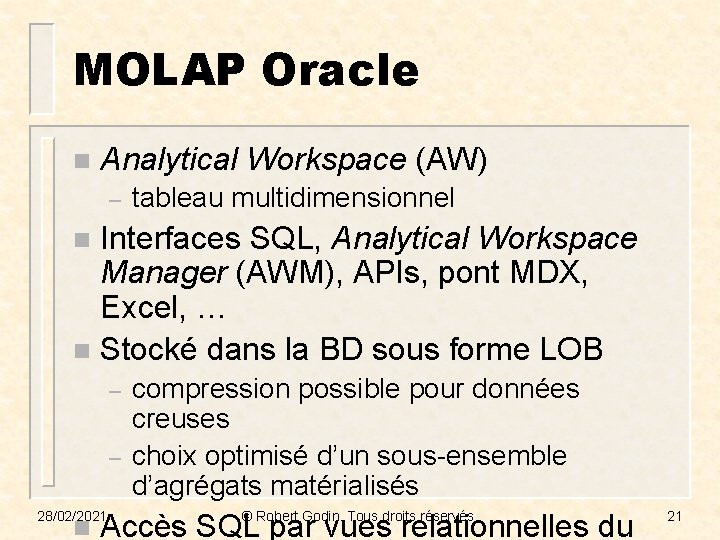

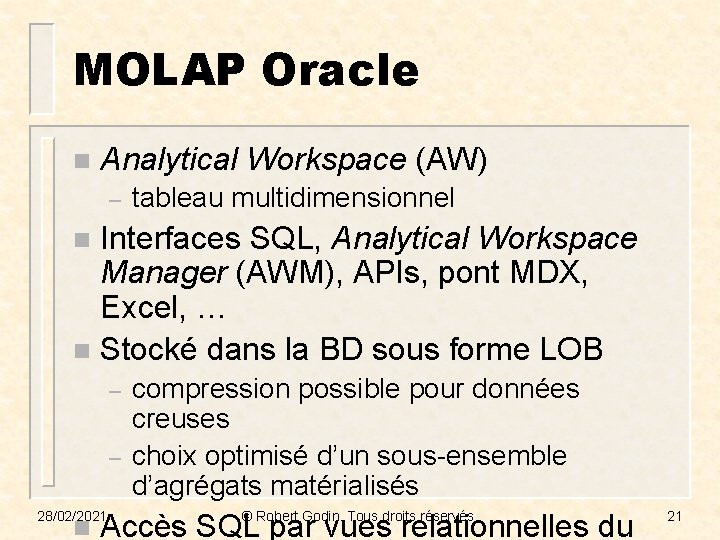

MOLAP Oracle n Analytical Workspace (AW) – tableau multidimensionnel Interfaces SQL, Analytical Workspace Manager (AWM), APIs, pont MDX, Excel, … n Stocké dans la BD sous forme LOB n – – Accès SQL par vues relationnelles du 28/02/2021 n compression possible pour données creuses choix optimisé d’un sous-ensemble d’agrégats matérialisés © Robert Godin. Tous droits réservés. 21

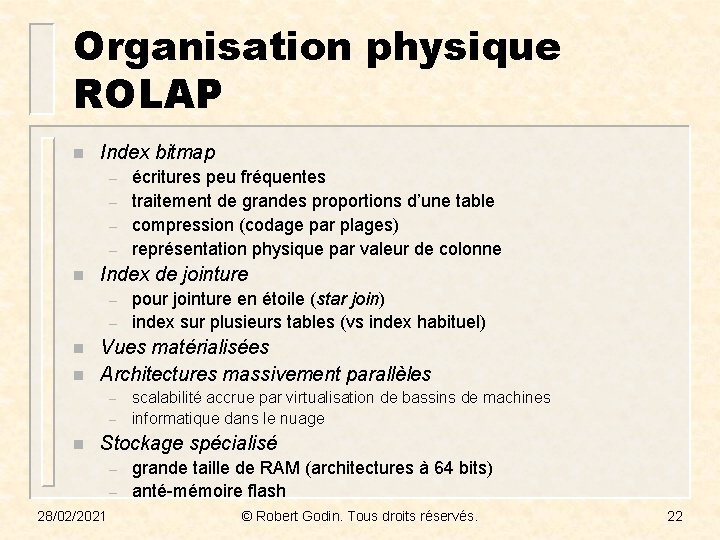

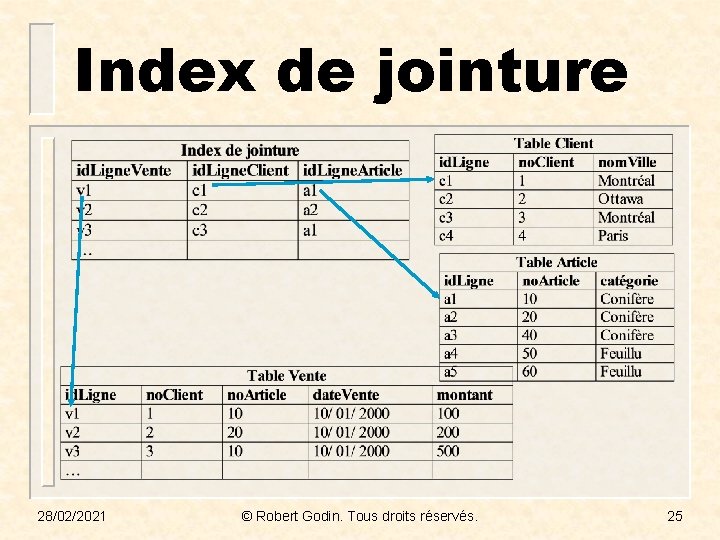

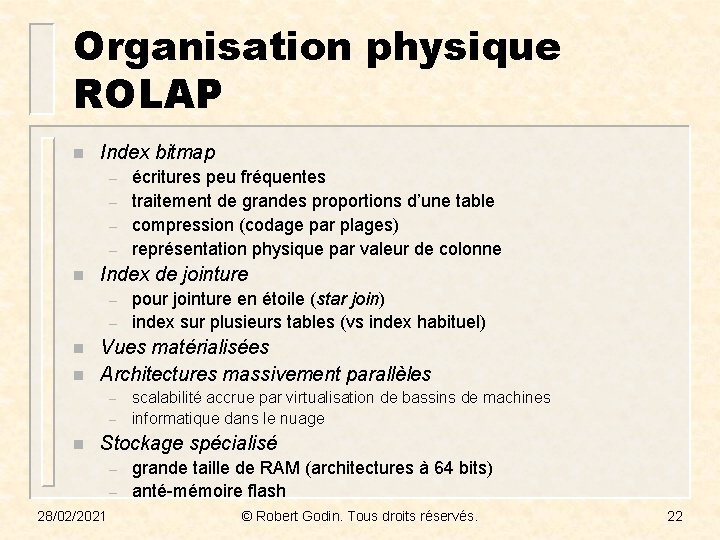

Organisation physique ROLAP n Index bitmap – – n écritures peu fréquentes traitement de grandes proportions d’une table compression (codage par plages) représentation physique par valeur de colonne Index de jointure pour jointure en étoile (star join) – index sur plusieurs tables (vs index habituel) n Vues matérialisées – n Architectures massivement parallèles – – n scalabilité accrue par virtualisation de bassins de machines informatique dans le nuage Stockage spécialisé – – 28/02/2021 grande taille de RAM (architectures à 64 bits) anté-mémoire flash © Robert Godin. Tous droits réservés. 22

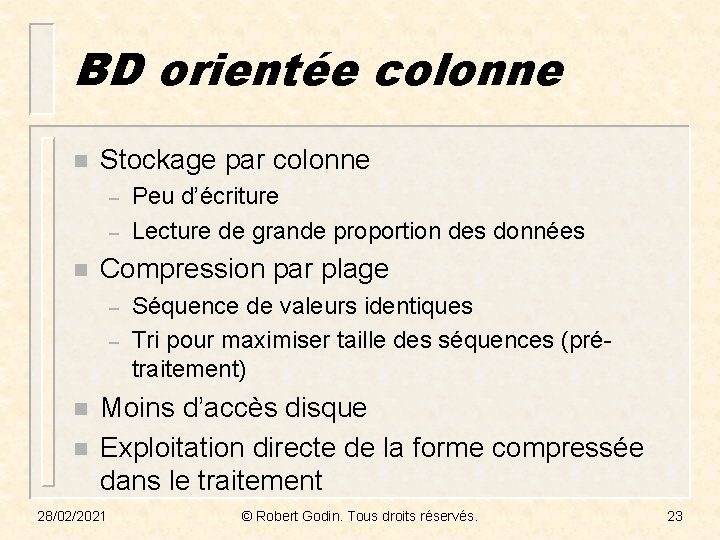

BD orientée colonne n Stockage par colonne – – n Compression par plage – – n n Peu d’écriture Lecture de grande proportion des données Séquence de valeurs identiques Tri pour maximiser taille des séquences (prétraitement) Moins d’accès disque Exploitation directe de la forme compressée dans le traitement 28/02/2021 © Robert Godin. Tous droits réservés. 23

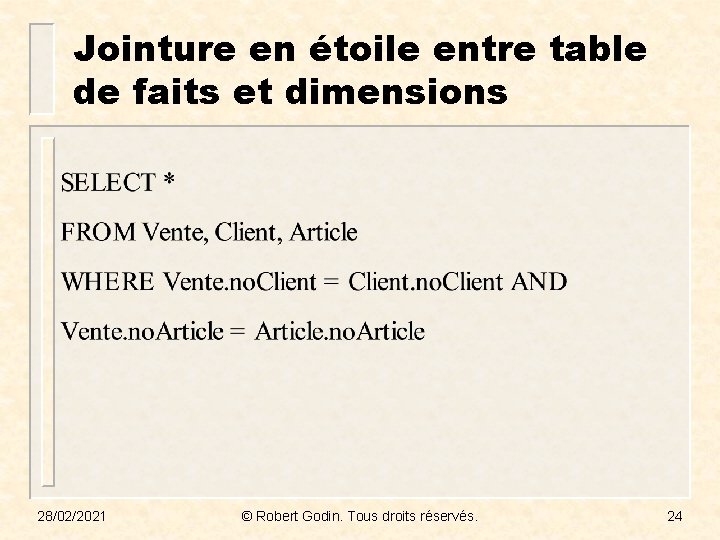

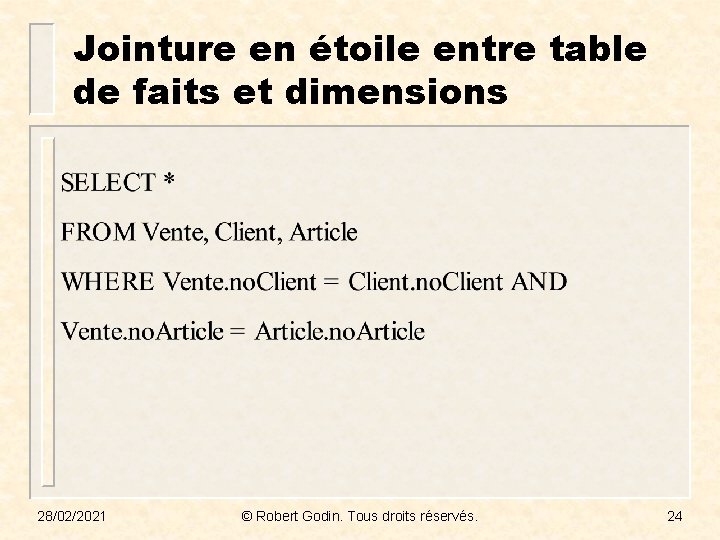

Jointure en étoile entre table de faits et dimensions 28/02/2021 © Robert Godin. Tous droits réservés. 24

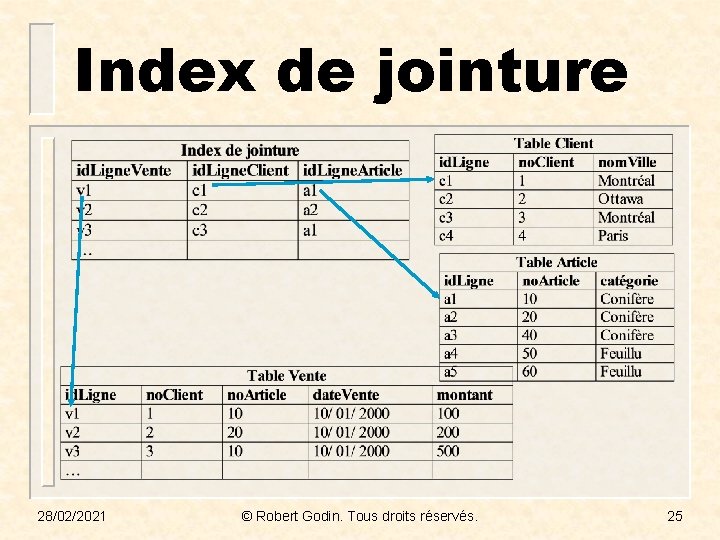

Index de jointure 28/02/2021 © Robert Godin. Tous droits réservés. 25

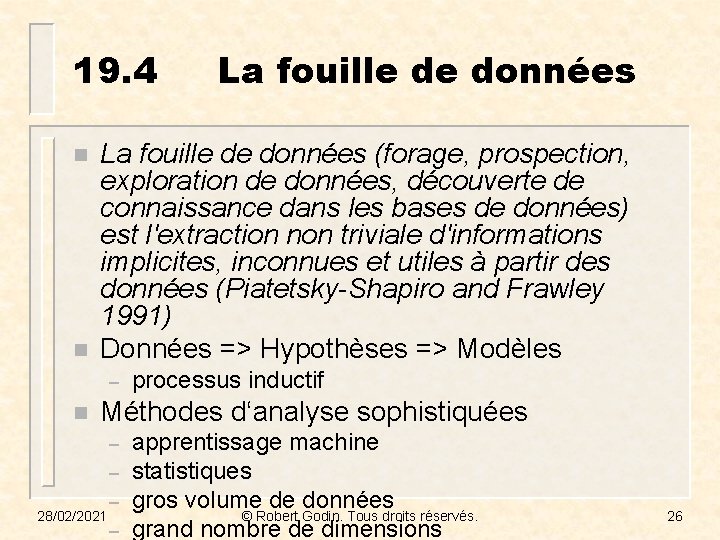

19. 4 n n La fouille de données (forage, prospection, exploration de données, découverte de connaissance dans les bases de données) est l'extraction non triviale d'informations implicites, inconnues et utiles à partir des données (Piatetsky-Shapiro and Frawley 1991) Données => Hypothèses => Modèles – n La fouille de données processus inductif Méthodes d‘analyse sophistiquées – – 28/02/2021 – – apprentissage machine statistiques gros volume de données © Robert Godin. Tous droits réservés. grand nombre de dimensions 26

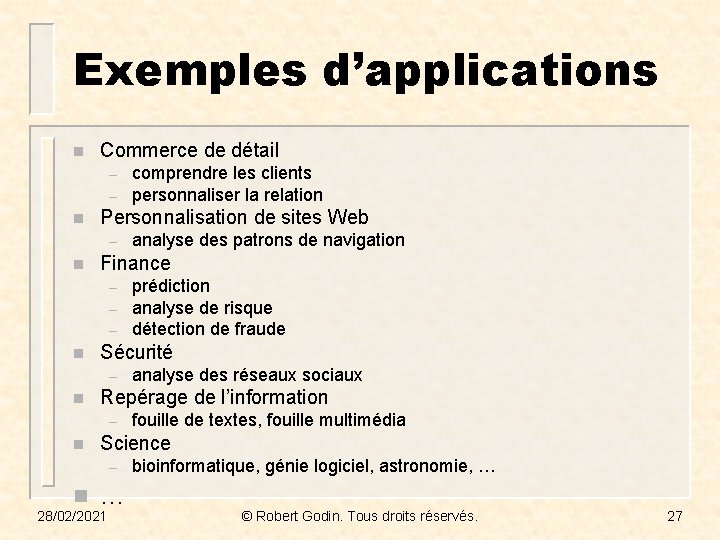

Exemples d’applications n Commerce de détail – – n Personnalisation de sites Web – n – – fouille de textes, fouille multimédia Science – n analyse des réseaux sociaux Repérage de l’information – n prédiction analyse de risque détection de fraude Sécurité – n analyse des patrons de navigation Finance – n comprendre les clients personnaliser la relation … 28/02/2021 bioinformatique, génie logiciel, astronomie, … © Robert Godin. Tous droits réservés. 27

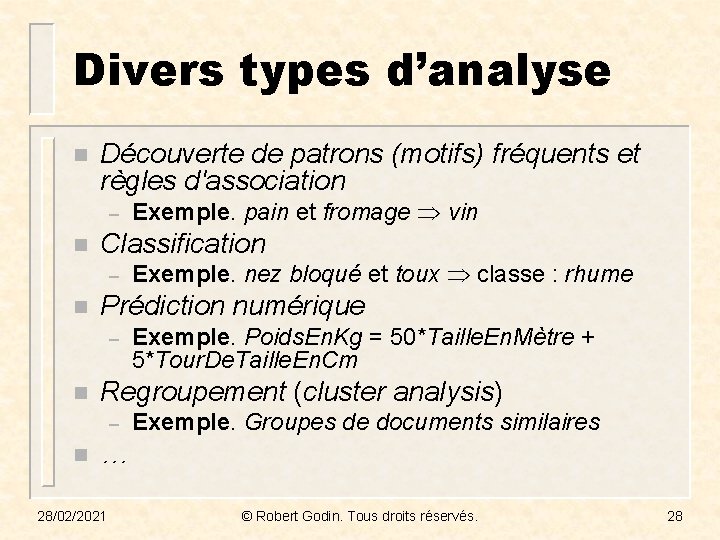

Divers types d’analyse n Découverte de patrons (motifs) fréquents et règles d'association – n Classification – n Exemple. Poids. En. Kg = 50*Taille. En. Mètre + 5*Tour. De. Taille. En. Cm Regroupement (cluster analysis) – n Exemple. nez bloqué et toux classe : rhume Prédiction numérique – n Exemple. pain et fromage vin Exemple. Groupes de documents similaires … 28/02/2021 © Robert Godin. Tous droits réservés. 28

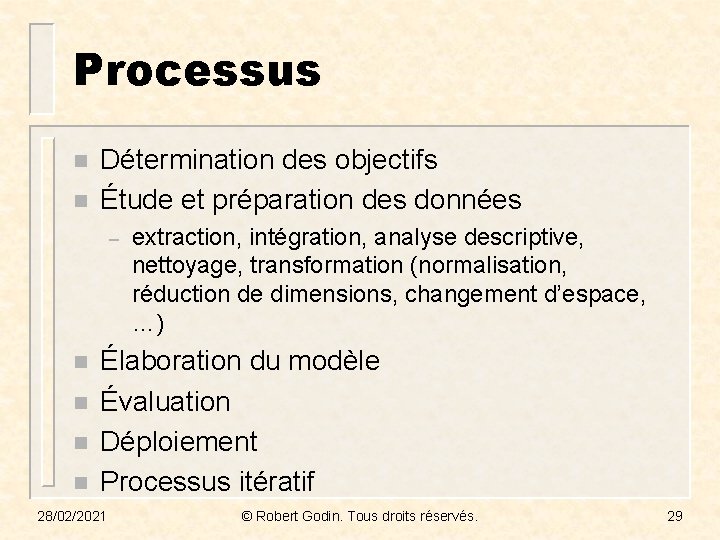

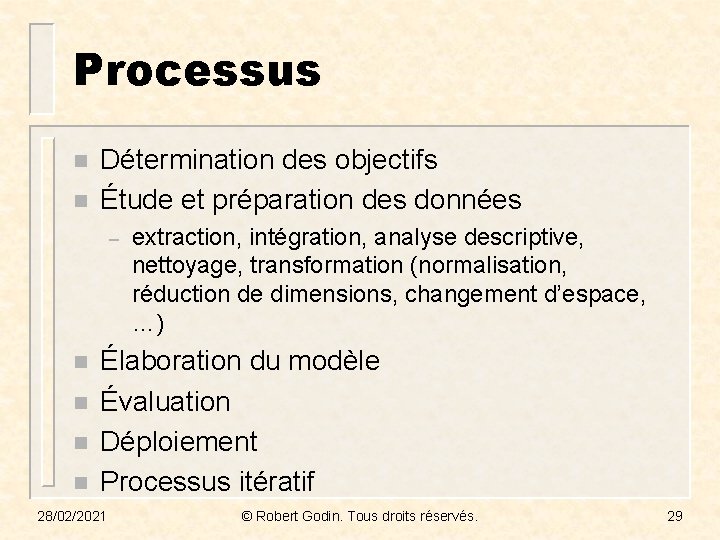

Processus n n Détermination des objectifs Étude et préparation des données – n n extraction, intégration, analyse descriptive, nettoyage, transformation (normalisation, réduction de dimensions, changement d’espace, …) Élaboration du modèle Évaluation Déploiement Processus itératif 28/02/2021 © Robert Godin. Tous droits réservés. 29

Ressources n Processus normalisé – n Predictive Model Markup Language (PPML) – n http: //www. crisp-dm. org/ http: //www. dmg. org/ Logiciels, emplois, tutoriels, données, . . . – 28/02/2021 http: //www. kdnuggets. com/ © Robert Godin. Tous droits réservés. 30

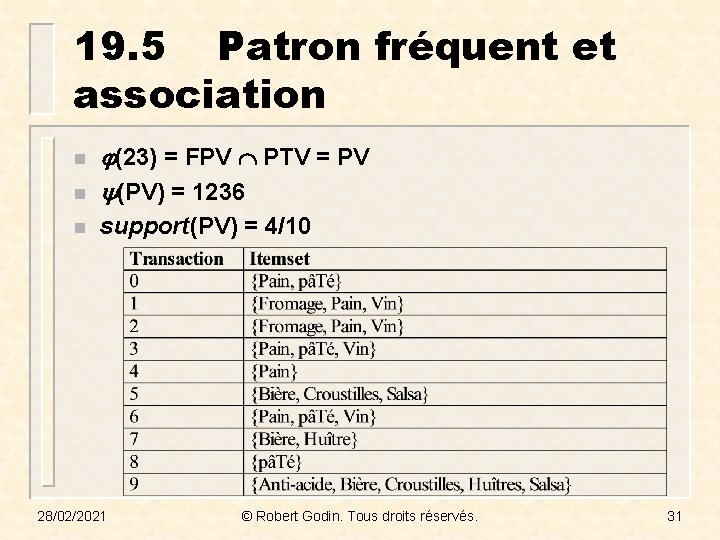

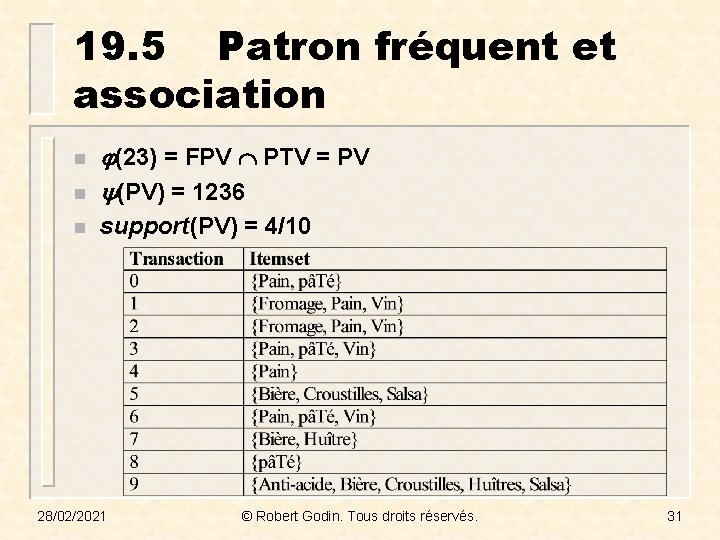

19. 5 Patron fréquent et association n (23) = FPV PTV = PV (PV) = 1236 n support(PV) = 4/10 n 28/02/2021 © Robert Godin. Tous droits réservés. 31

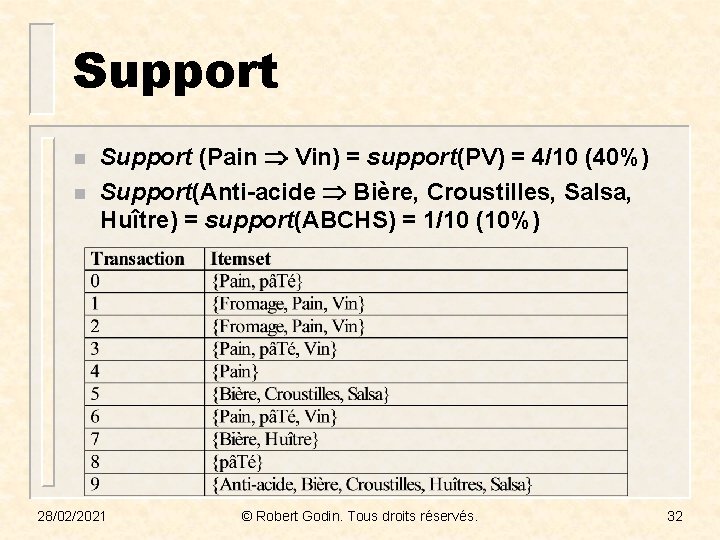

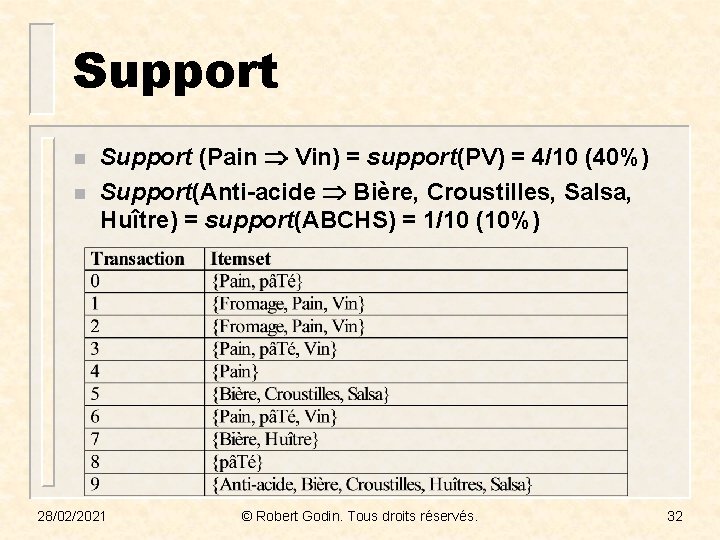

Support n n Support (Pain Vin) = support(PV) = 4/10 (40%) Support(Anti-acide Bière, Croustilles, Salsa, Huître) = support(ABCHS) = 1/10 (10%) 28/02/2021 © Robert Godin. Tous droits réservés. 32

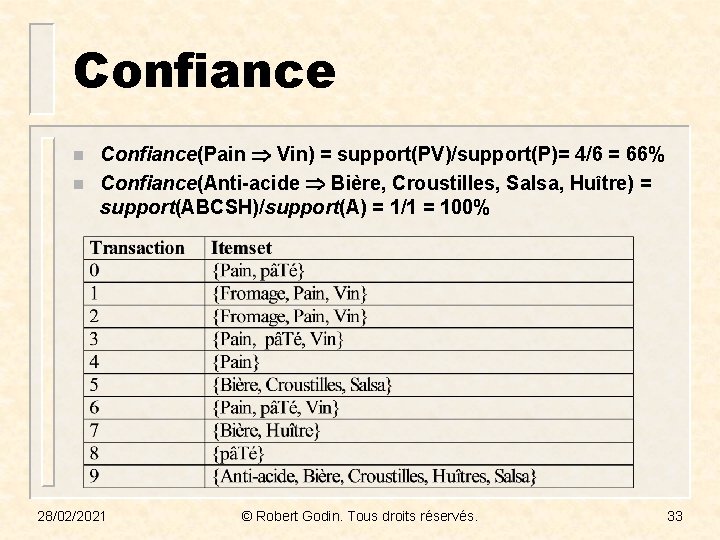

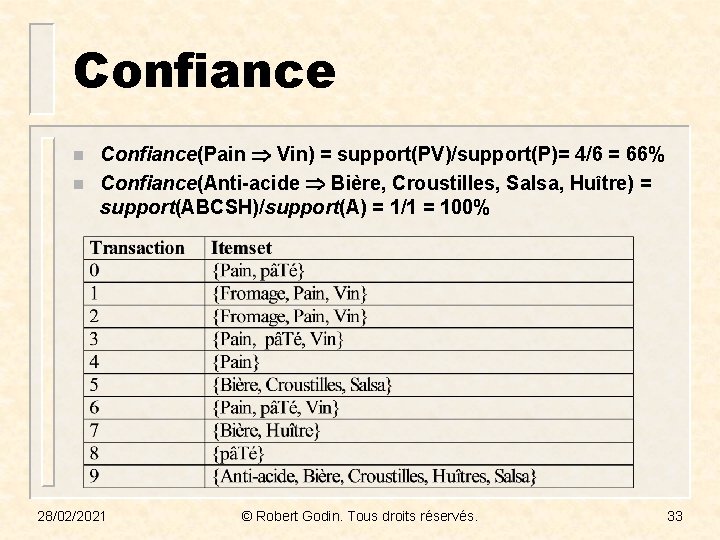

Confiance n n Confiance(Pain Vin) = support(PV)/support(P)= 4/6 = 66% Confiance(Anti-acide Bière, Croustilles, Salsa, Huître) = support(ABCSH)/support(A) = 1/1 = 100% 28/02/2021 © Robert Godin. Tous droits réservés. 33

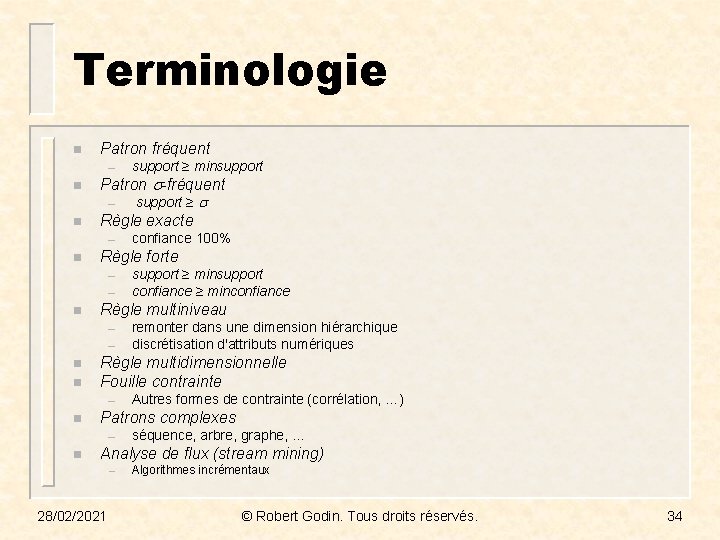

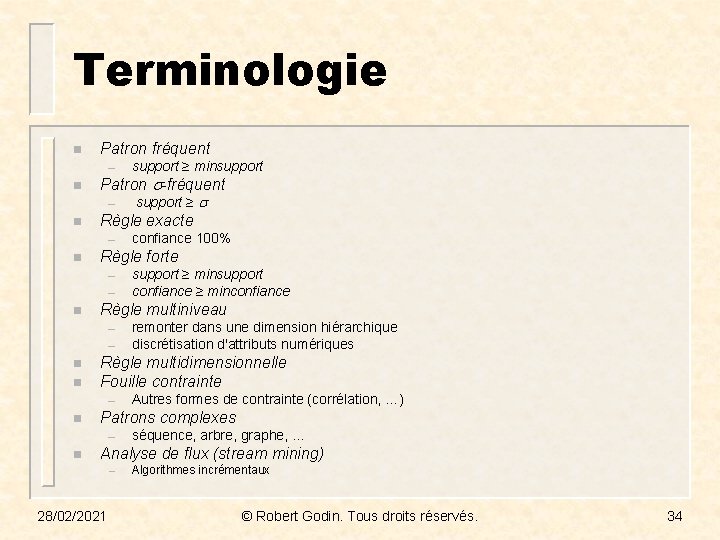

Terminologie n Patron fréquent – n Patron -fréquent – n – – n Autres formes de contrainte (corrélation, …) Patrons complexes – n remonter dans une dimension hiérarchique discrétisation d'attributs numériques Règle multidimensionnelle Fouille contrainte – n support ≥ minsupport confiance ≥ minconfiance Règle multiniveau – n confiance 100% Règle forte – n support ≥ Règle exacte – n support ≥ minsupport séquence, arbre, graphe, … Analyse de flux (stream mining) – 28/02/2021 Algorithmes incrémentaux © Robert Godin. Tous droits réservés. 34

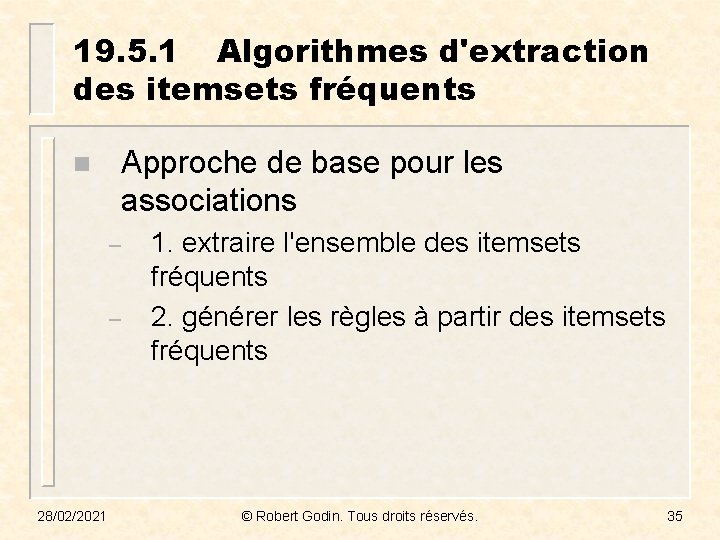

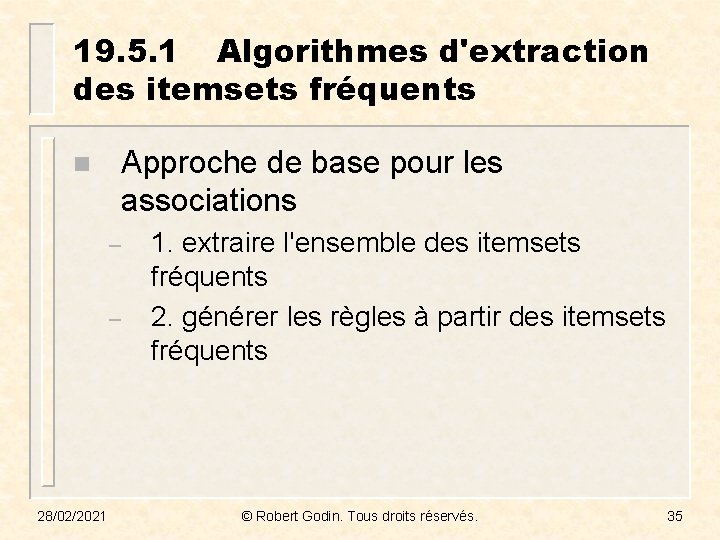

19. 5. 1 Algorithmes d'extraction des itemsets fréquents Approche de base pour les associations n – – 28/02/2021 1. extraire l'ensemble des itemsets fréquents 2. générer les règles à partir des itemsets fréquents © Robert Godin. Tous droits réservés. 35

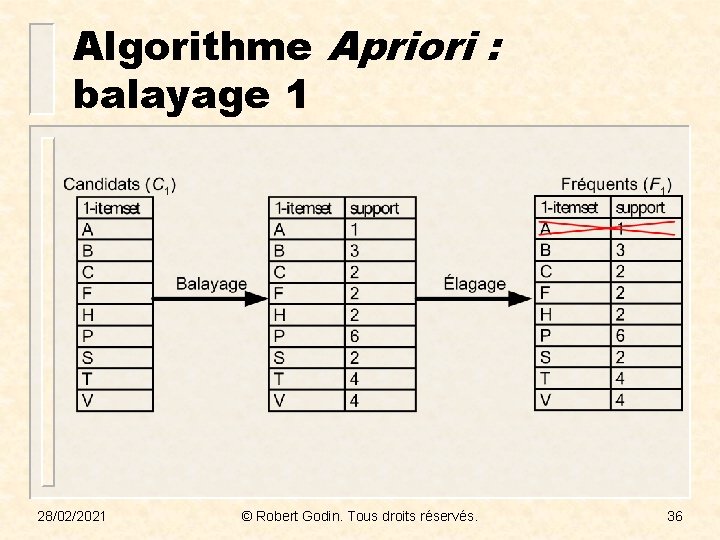

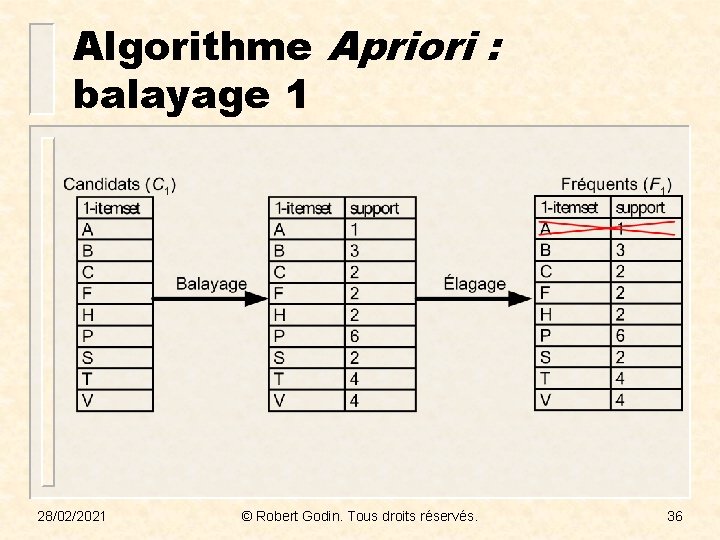

Algorithme Apriori : balayage 1 28/02/2021 © Robert Godin. Tous droits réservés. 36

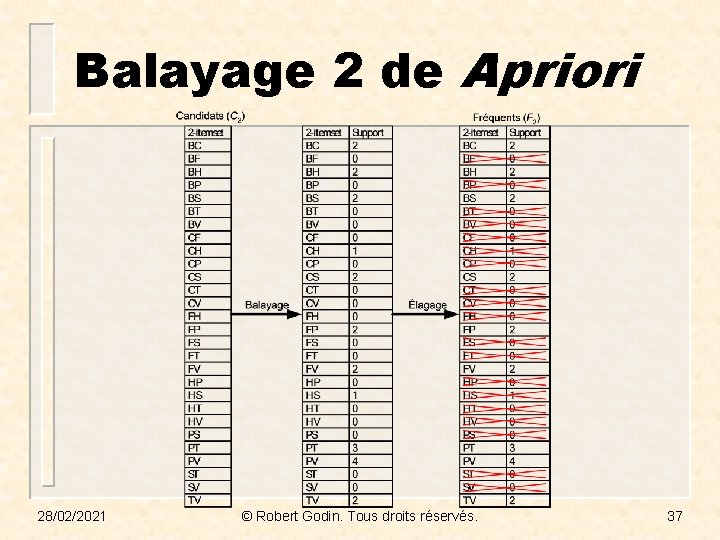

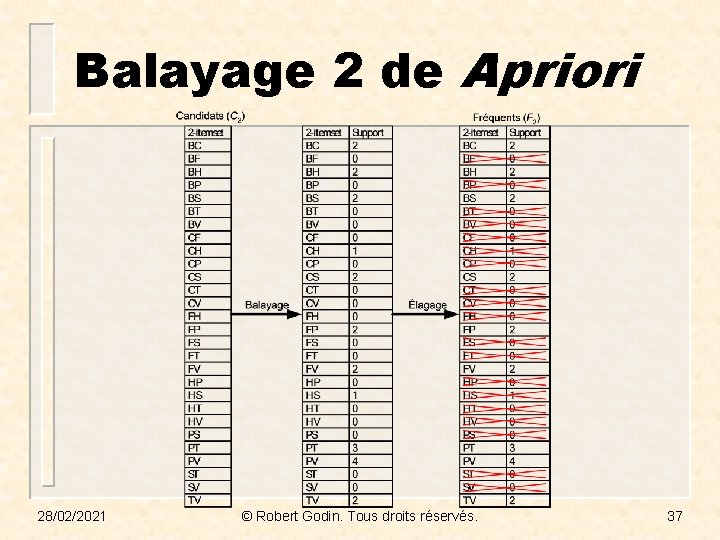

Balayage 2 de Apriori 28/02/2021 © Robert Godin. Tous droits réservés. 37

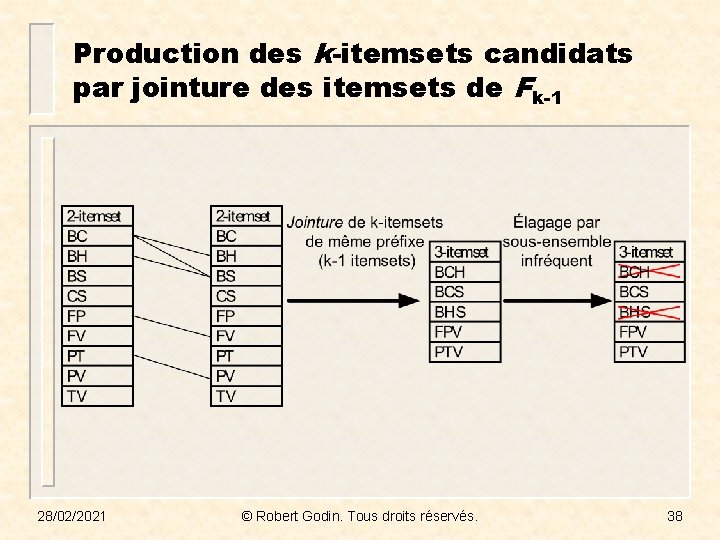

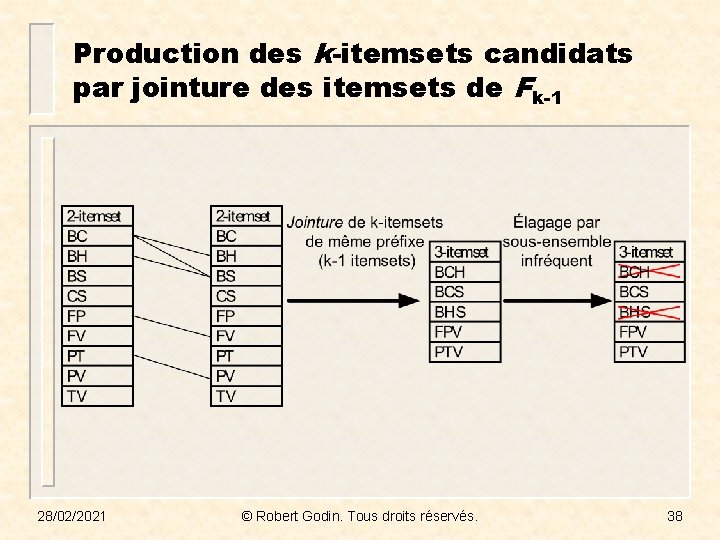

Production des k-itemsets candidats par jointure des itemsets de Fk-1 28/02/2021 © Robert Godin. Tous droits réservés. 38

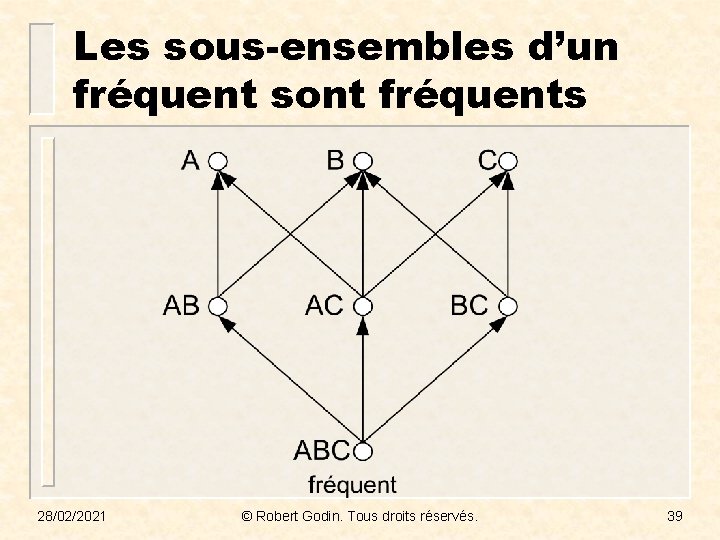

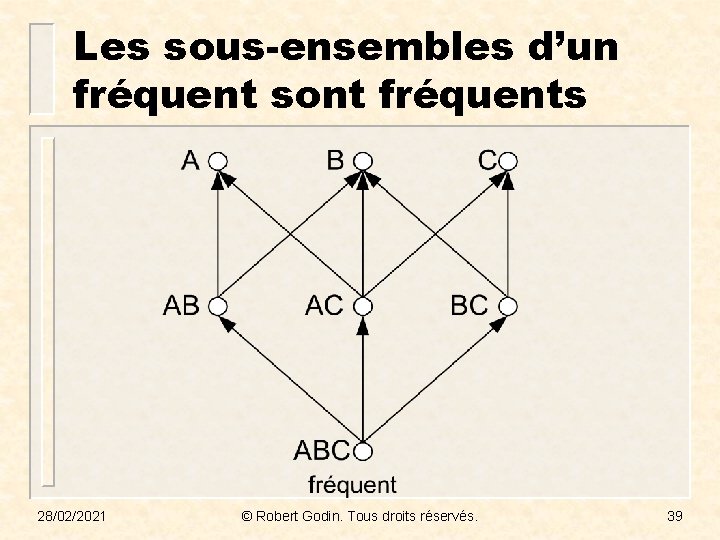

Les sous-ensembles d’un fréquent sont fréquents 28/02/2021 © Robert Godin. Tous droits réservés. 39

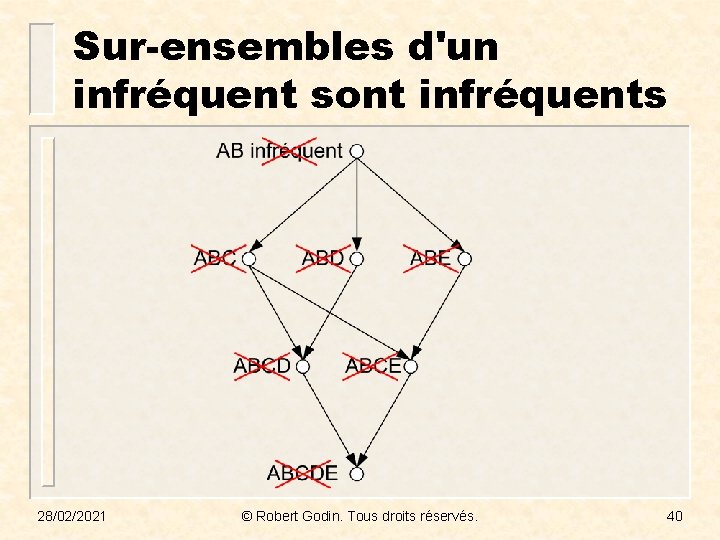

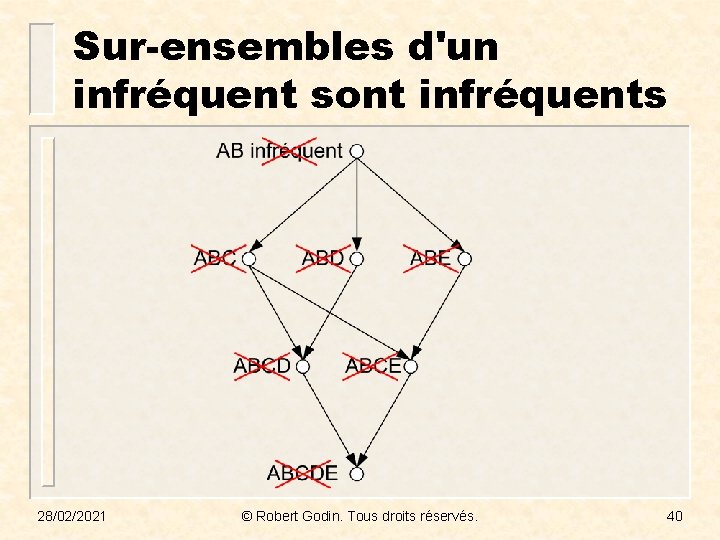

Sur-ensembles d'un infréquent sont infréquents 28/02/2021 © Robert Godin. Tous droits réservés. 40

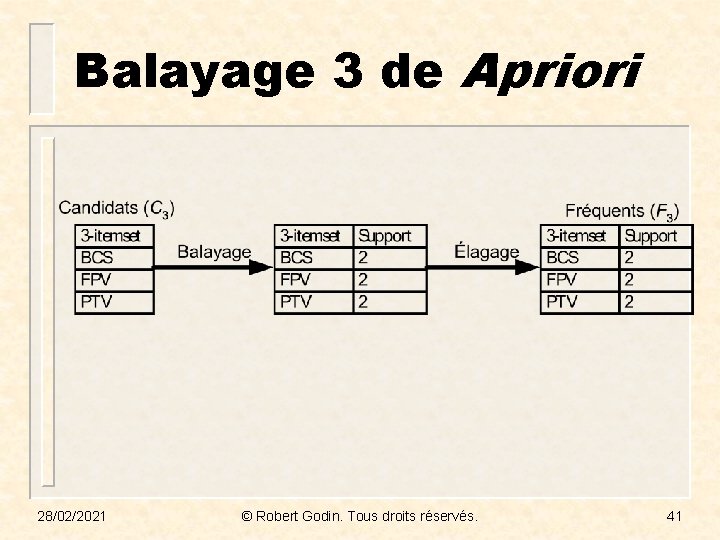

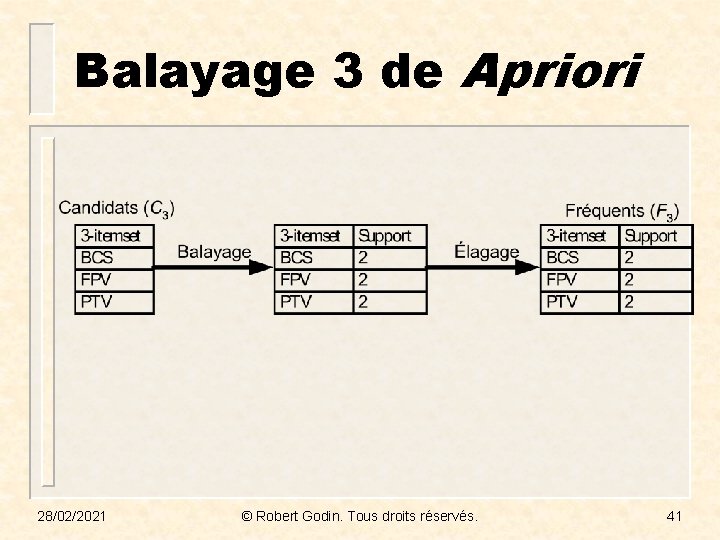

Balayage 3 de Apriori 28/02/2021 © Robert Godin. Tous droits réservés. 41

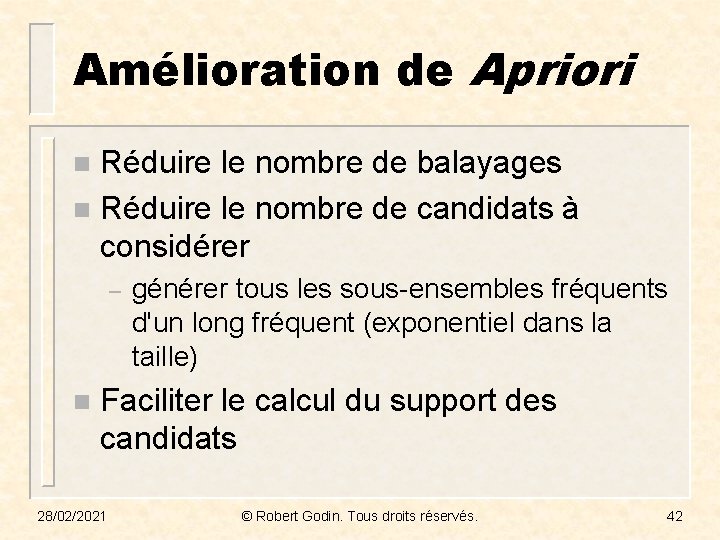

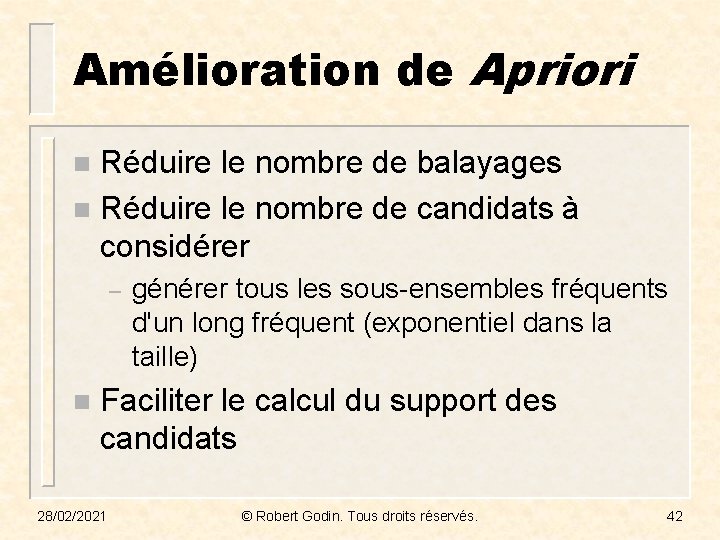

Amélioration de Apriori Réduire le nombre de balayages n Réduire le nombre de candidats à considérer n – n générer tous les sous-ensembles fréquents d'un long fréquent (exponentiel dans la taille) Faciliter le calcul du support des candidats 28/02/2021 © Robert Godin. Tous droits réservés. 42

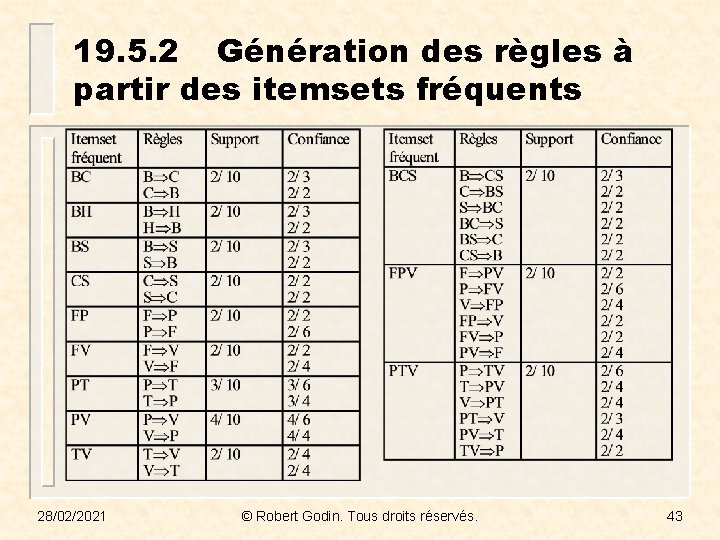

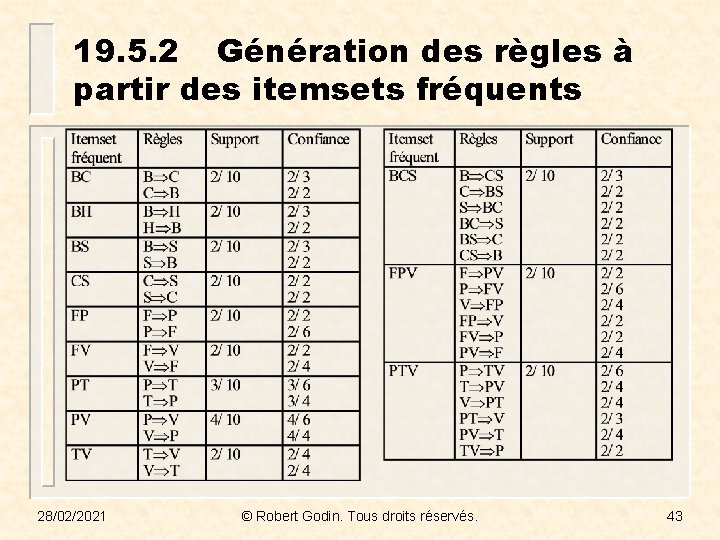

19. 5. 2 Génération des règles à partir des itemsets fréquents 28/02/2021 © Robert Godin. Tous droits réservés. 43

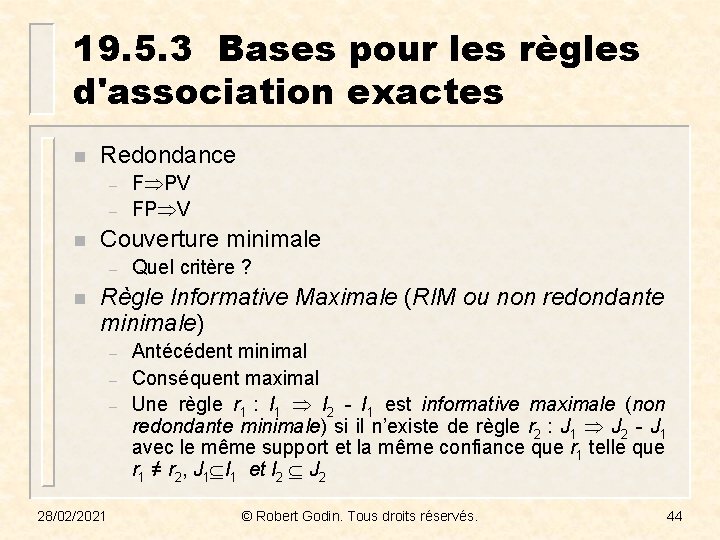

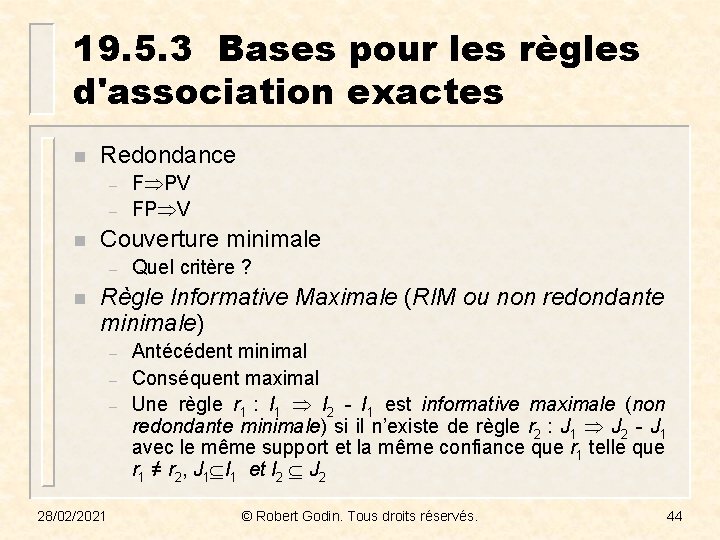

19. 5. 3 Bases pour les règles d'association exactes n Redondance – – n Couverture minimale – n F PV FP V Quel critère ? Règle Informative Maximale (RIM ou non redondante minimale) – – – 28/02/2021 Antécédent minimal Conséquent maximal Une règle r 1 : I 1 I 2 - I 1 est informative maximale (non redondante minimale) si il n’existe de règle r 2 : J 1 J 2 - J 1 avec le même support et la même confiance que r 1 telle que r 1 ≠ r 2, J 1 I 1 et I 2 J 2 © Robert Godin. Tous droits réservés. 44

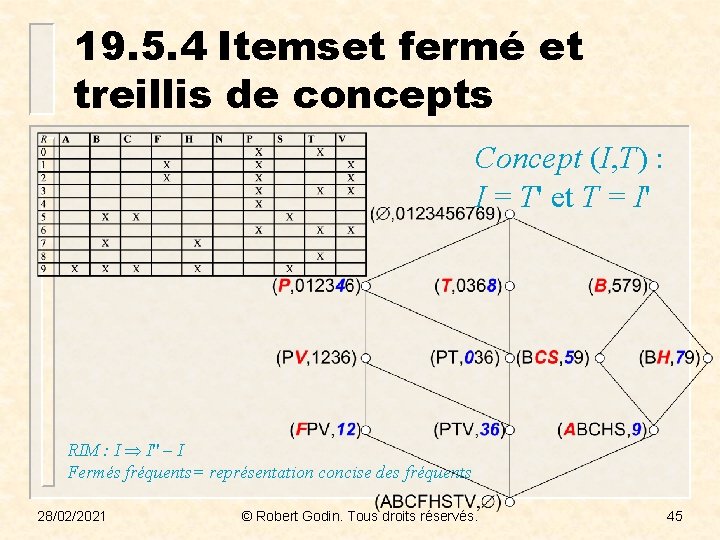

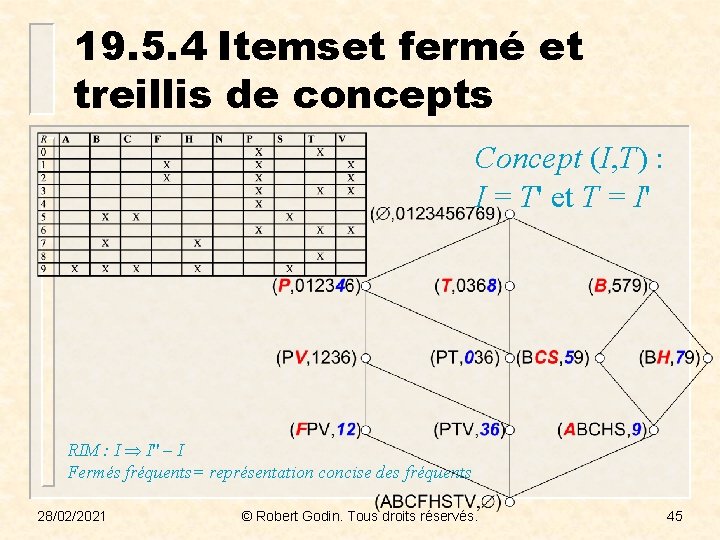

19. 5. 4 Itemset fermé et treillis de concepts Concept (I, T) : I = T' et T = I' RIM : I I'' – I Fermés fréquents= représentation concise des fréquents 28/02/2021 © Robert Godin. Tous droits réservés. 45

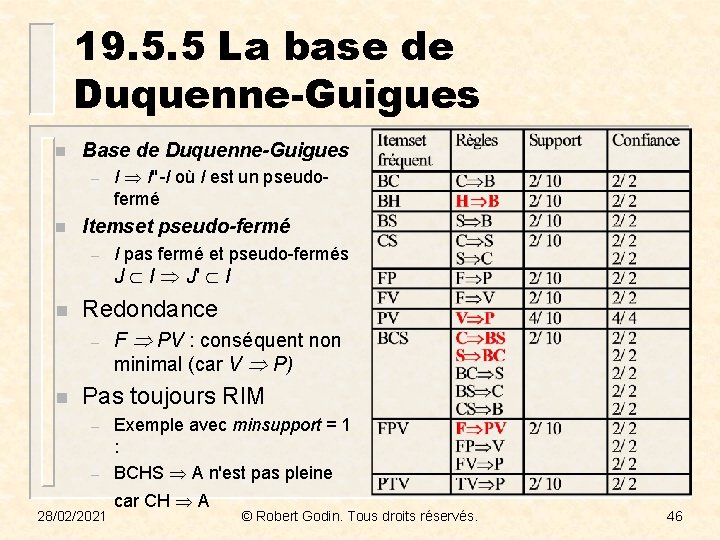

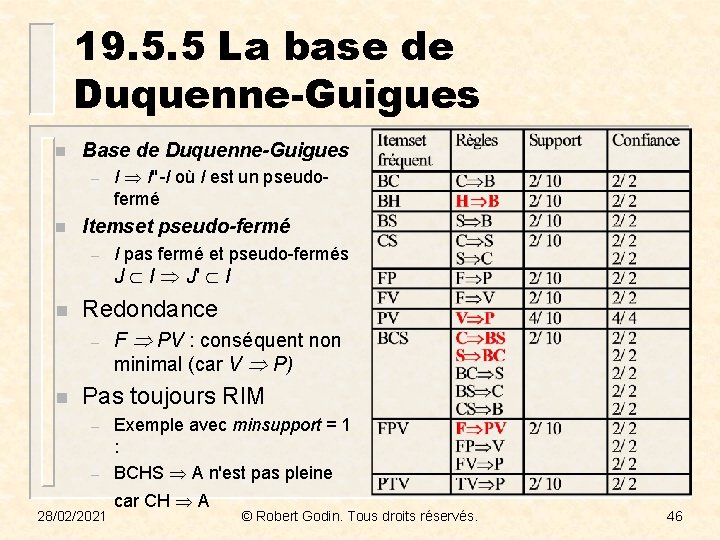

19. 5. 5 La base de Duquenne-Guigues n Base de Duquenne-Guigues – n I I''-I où I est un pseudofermé Itemset pseudo-fermé – I pas fermé et pseudo-fermés J I J' I n Redondance – n F PV : conséquent non minimal (car V P) Pas toujours RIM – – 28/02/2021 Exemple avec minsupport = 1 : BCHS A n'est pas pleine car CH A © Robert Godin. Tous droits réservés. 46

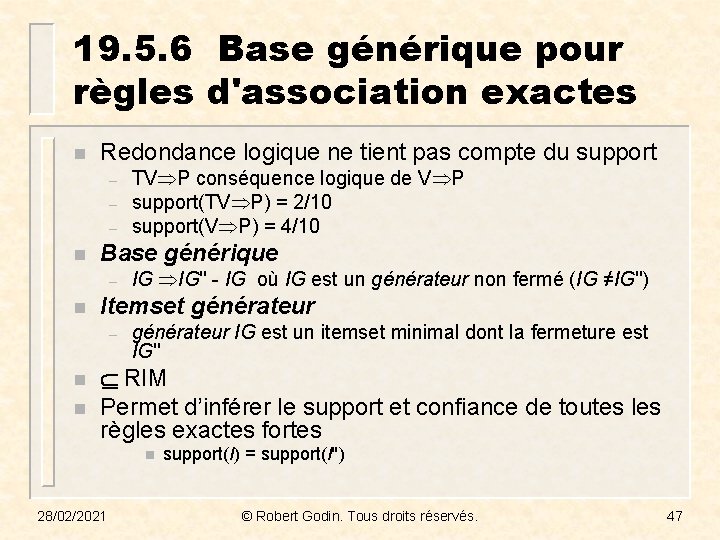

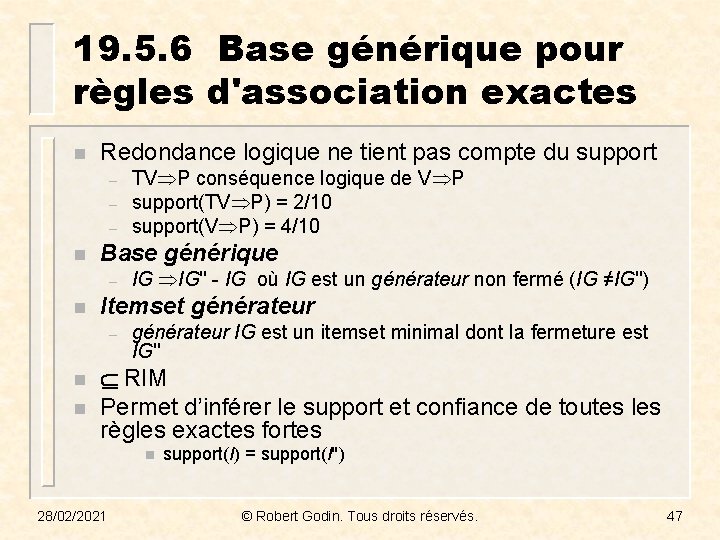

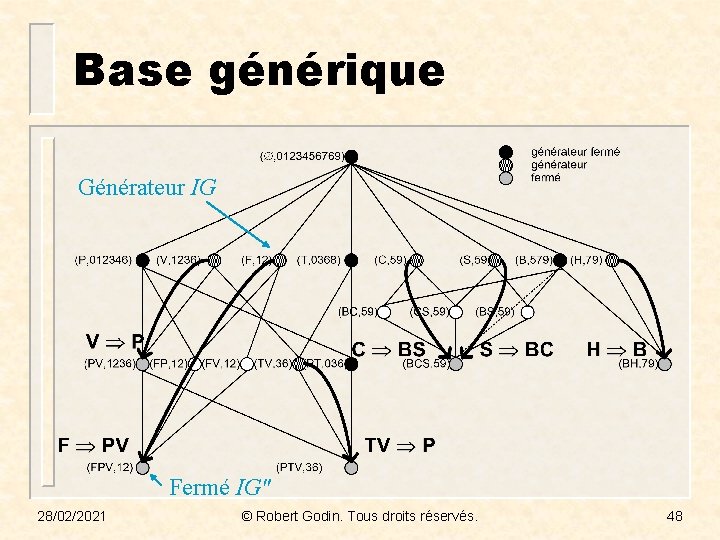

19. 5. 6 Base générique pour règles d'association exactes n Redondance logique ne tient pas compte du support – – – n Base générique – n n IG IG'' - IG où IG est un générateur non fermé (IG ≠IG'') Itemset générateur – n TV P conséquence logique de V P support(TV P) = 2/10 support(V P) = 4/10 générateur IG est un itemset minimal dont la fermeture est IG'' RIM Permet d’inférer le support et confiance de toutes les règles exactes fortes n 28/02/2021 support(I) = support(I'') © Robert Godin. Tous droits réservés. 47

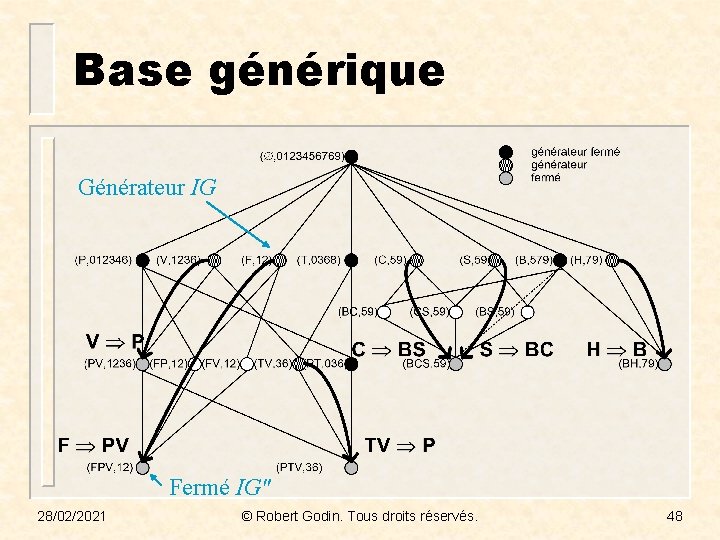

Base générique Générateur IG Fermé IG" 28/02/2021 © Robert Godin. Tous droits réservés. 48

![Classe déquivalence des concepts qui ont le même extent 59 Générateurs minimaux NB Classe d’équivalence des concepts qui ont le même extent [59]= Générateurs = minimaux NB](https://slidetodoc.com/presentation_image_h/199b2723d671f5cd1f944cfe84e2739d/image-49.jpg)

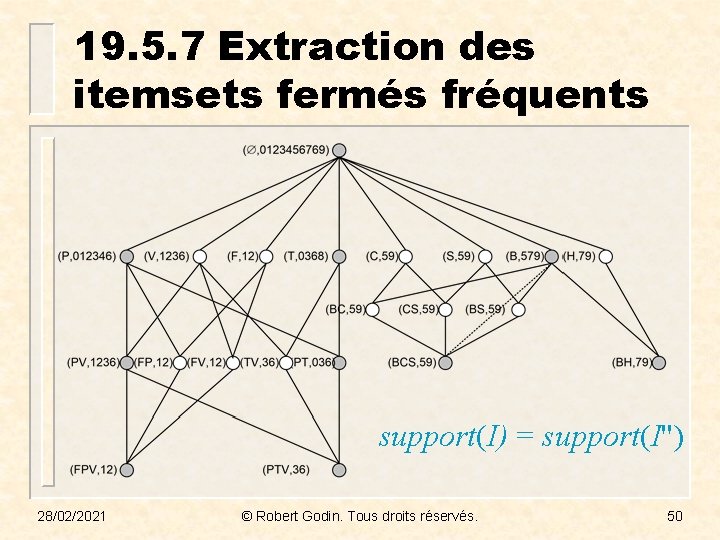

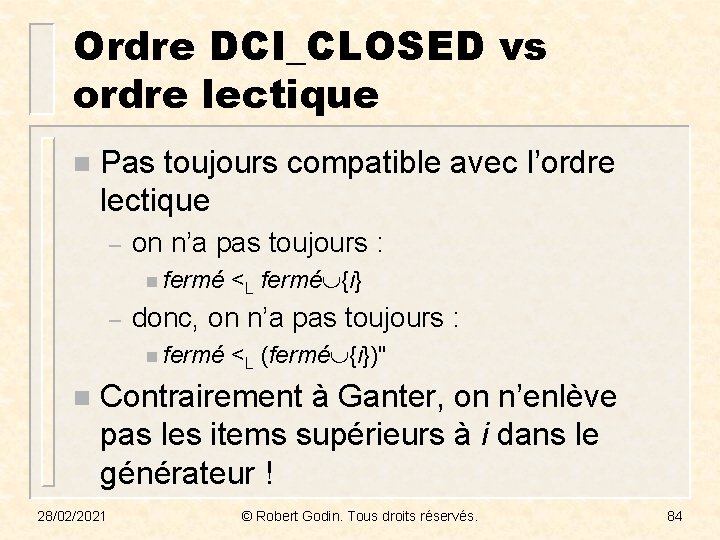

Classe d’équivalence des concepts qui ont le même extent [59]= Générateurs = minimaux NB Pas de règle exacte X a parmi les items du générateur (0 -free set) Fermé = maximal (toujours unique) NB aucun itemset plus grand n’a le même support 28/02/2021 © Robert Godin. Tous droits réservés. 49

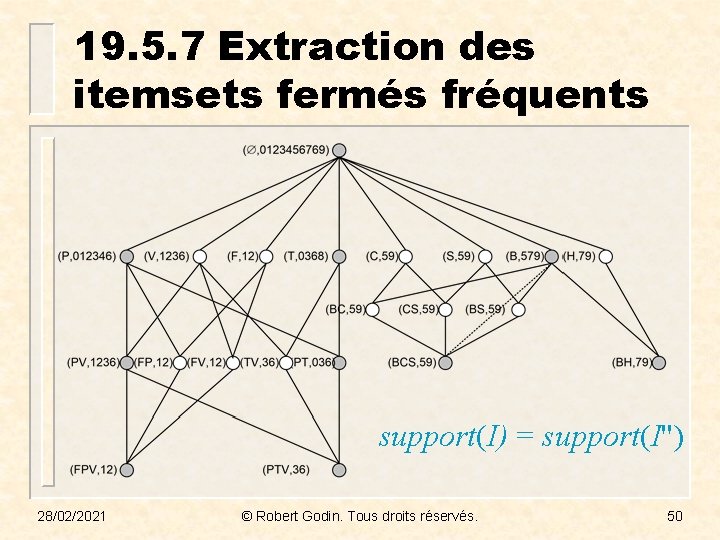

19. 5. 7 Extraction des itemsets fermés fréquents support(I) = support(I'') 28/02/2021 © Robert Godin. Tous droits réservés. 50

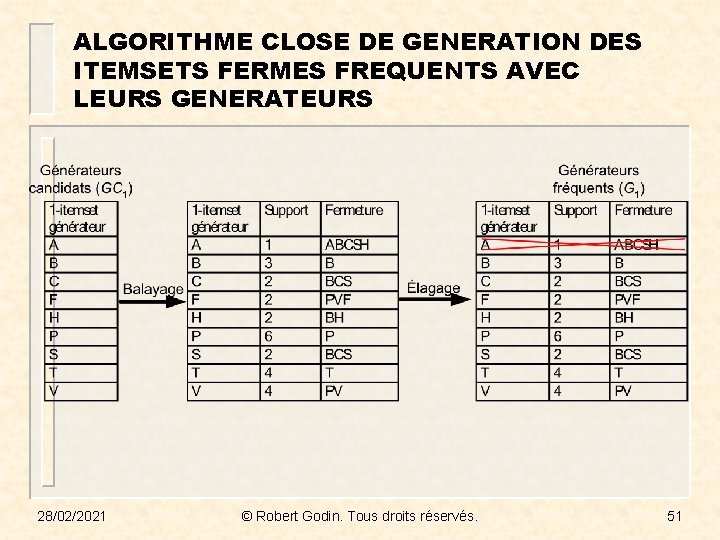

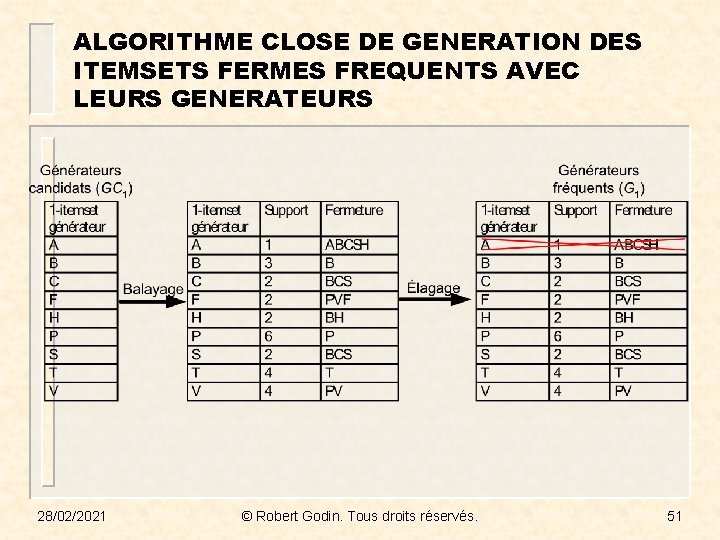

ALGORITHME CLOSE DE GENERATION DES ITEMSETS FERMES FREQUENTS AVEC LEURS GENERATEURS 28/02/2021 © Robert Godin. Tous droits réservés. 51

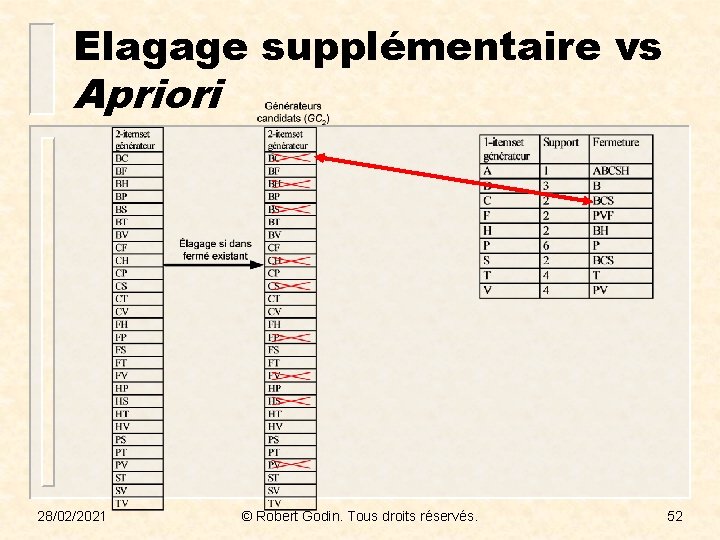

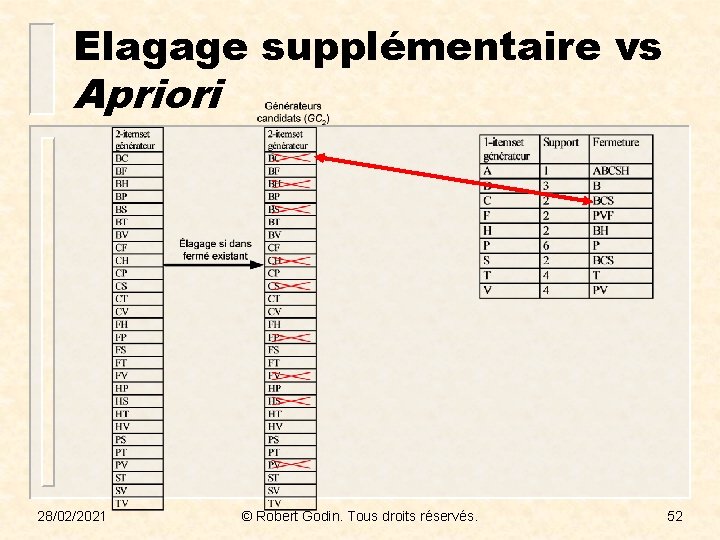

Elagage supplémentaire vs Apriori 28/02/2021 © Robert Godin. Tous droits réservés. 52

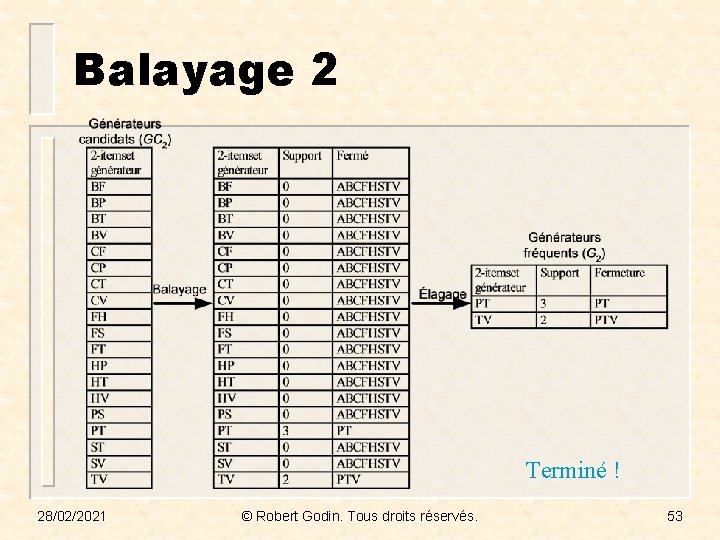

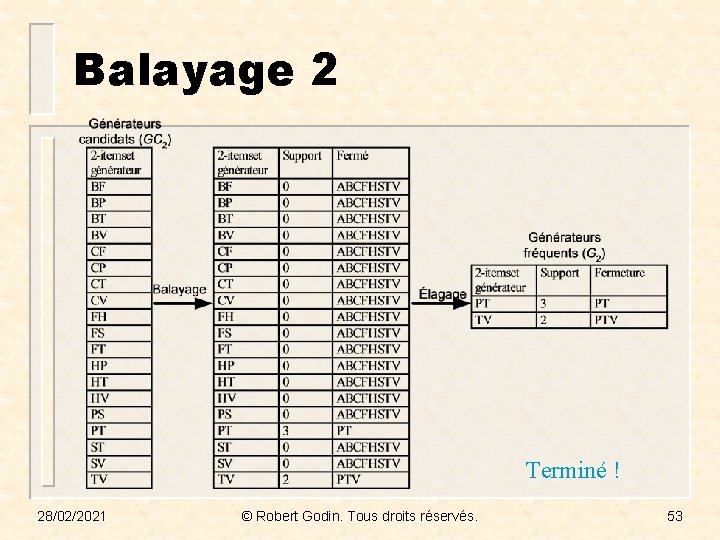

Balayage 2 Terminé ! 28/02/2021 © Robert Godin. Tous droits réservés. 53

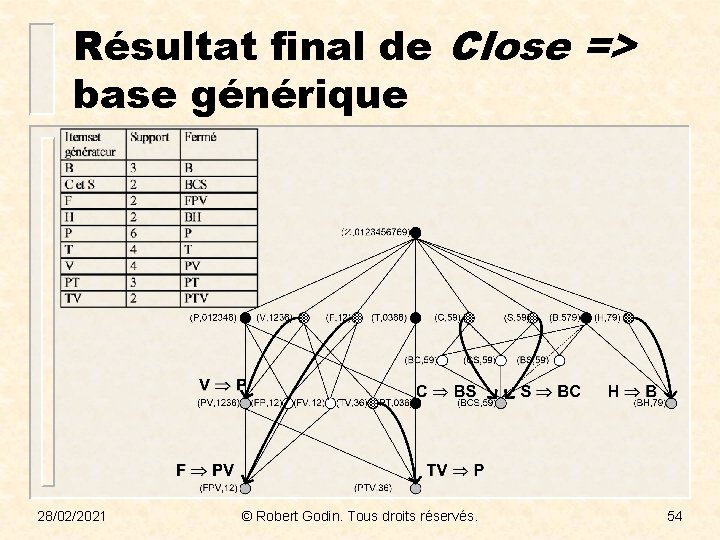

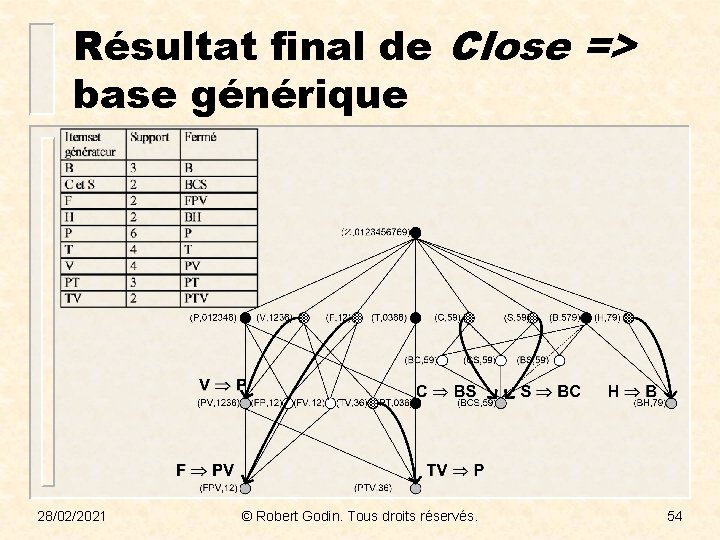

Résultat final de Close => base générique 28/02/2021 © Robert Godin. Tous droits réservés. 54

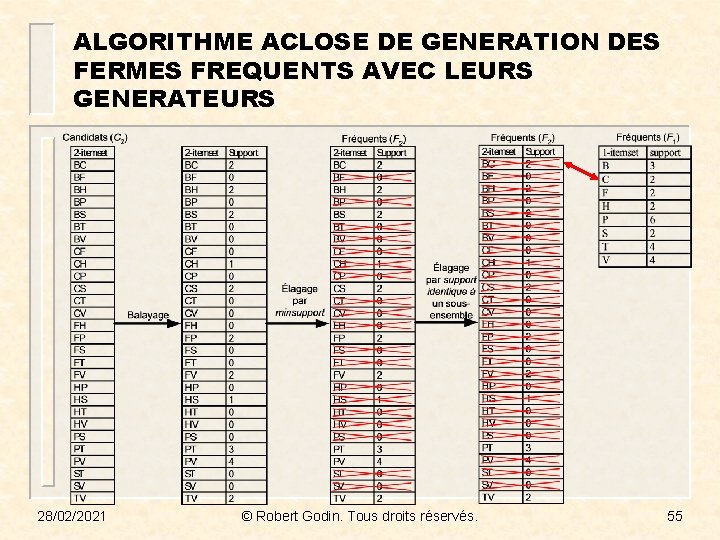

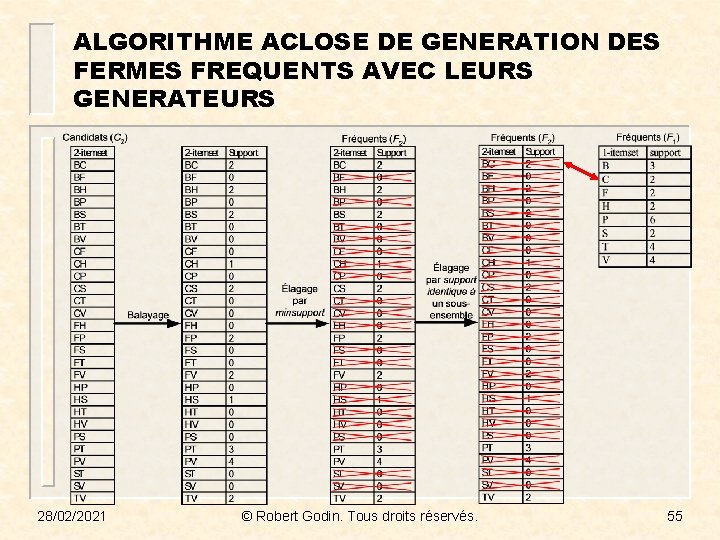

ALGORITHME ACLOSE DE GENERATION DES FERMES FREQUENTS AVEC LEURS GENERATEURS 28/02/2021 © Robert Godin. Tous droits réservés. 55

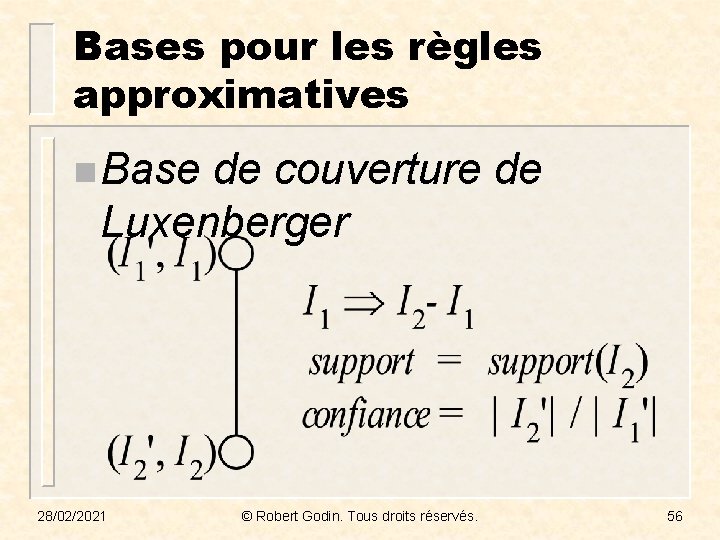

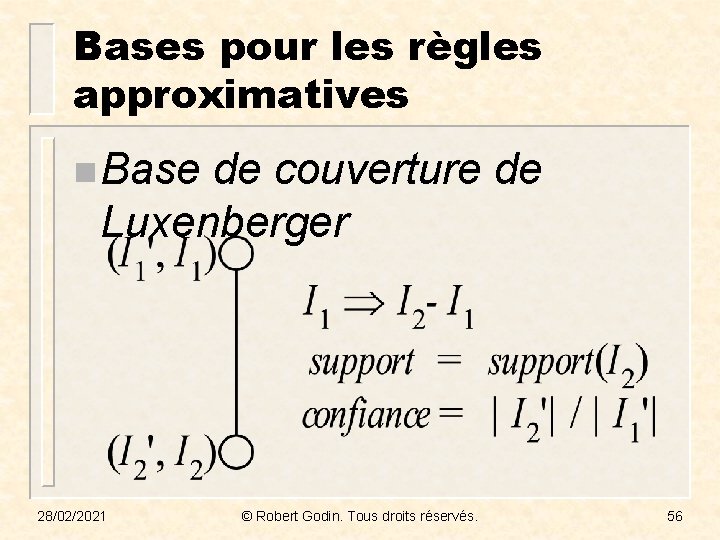

Bases pour les règles approximatives n Base de couverture de Luxenberger 28/02/2021 © Robert Godin. Tous droits réservés. 56

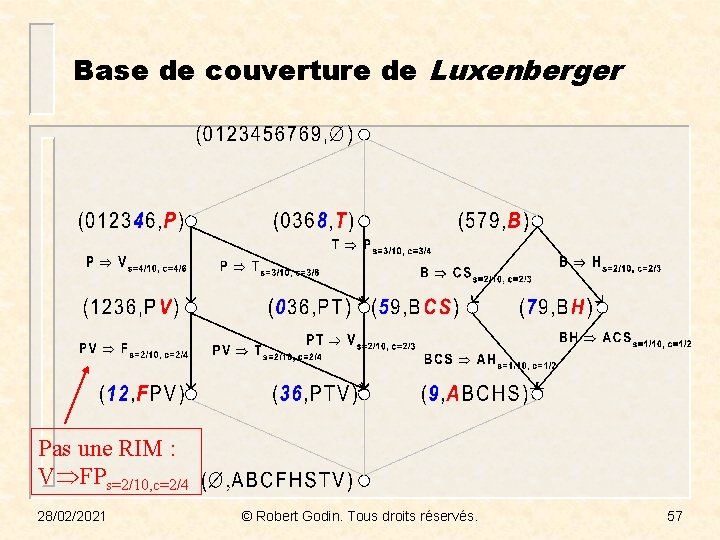

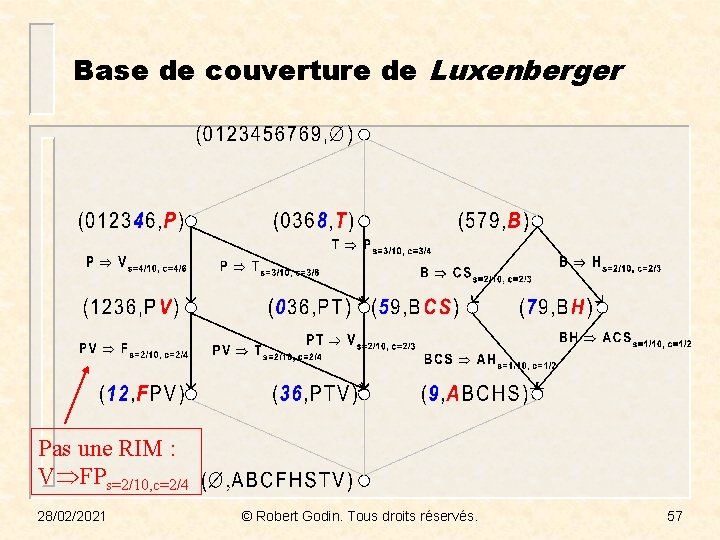

Base de couverture de Luxenberger Pas une RIM : V FPs=2/10, c=2/4 28/02/2021 © Robert Godin. Tous droits réservés. 57

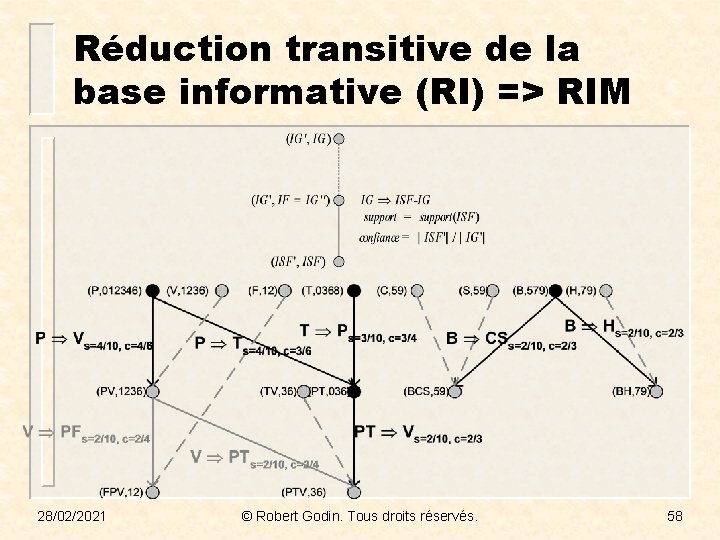

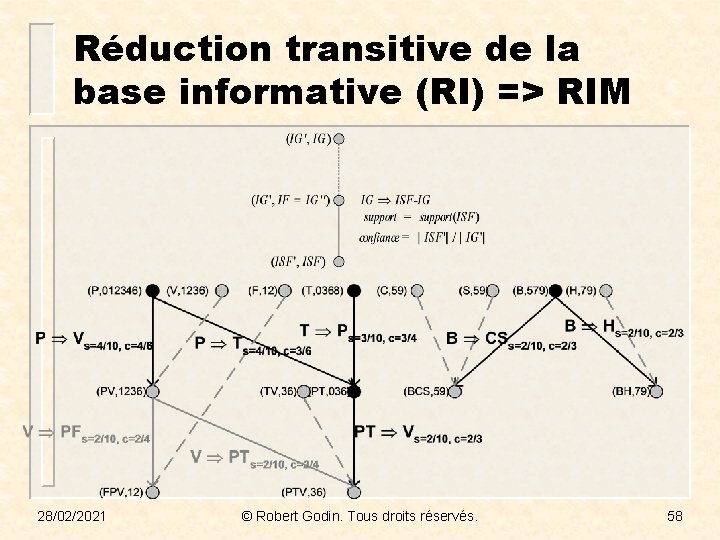

Réduction transitive de la base informative (RI) => RIM 28/02/2021 © Robert Godin. Tous droits réservés. 58

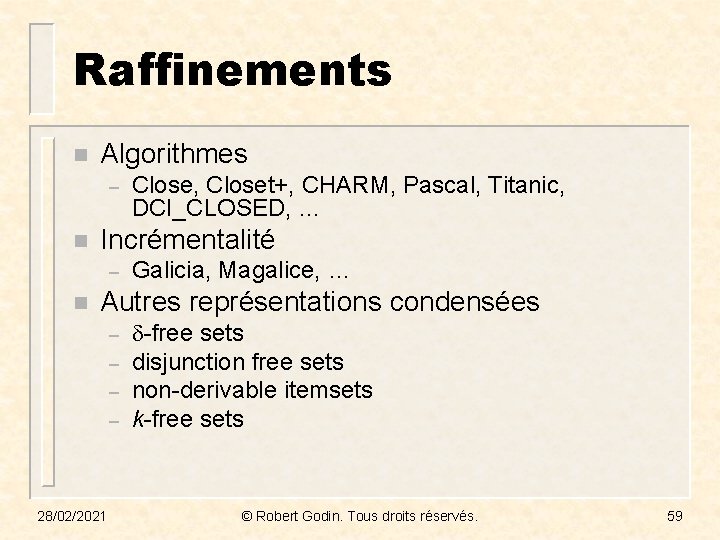

Raffinements n Algorithmes – n Incrémentalité – n Close, Closet+, CHARM, Pascal, Titanic, DCI_CLOSED, … Galicia, Magalice, … Autres représentations condensées – – 28/02/2021 -free sets disjunction free sets non-derivable itemsets k-free sets © Robert Godin. Tous droits réservés. 59

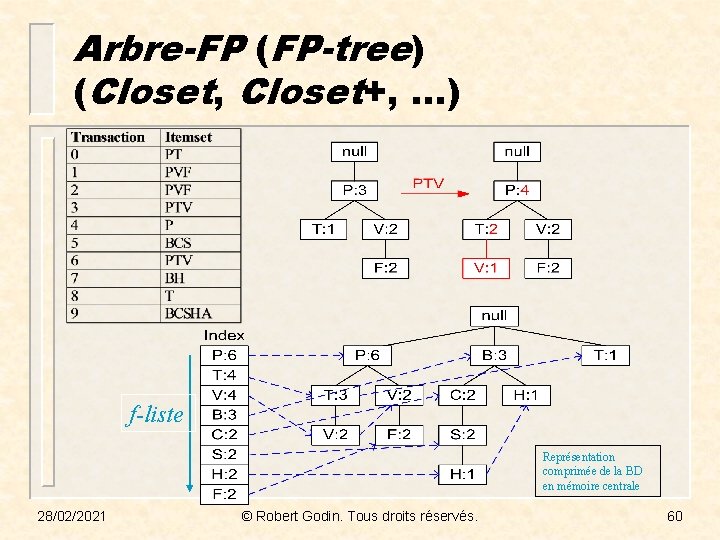

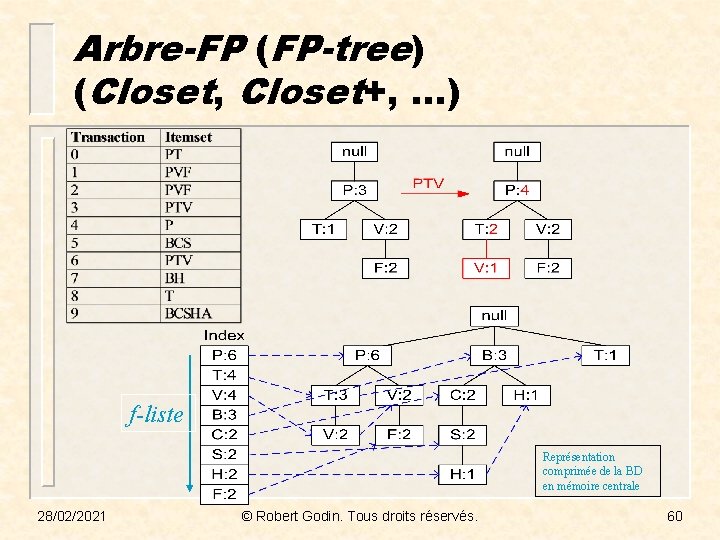

Arbre-FP (FP-tree) (Closet, Closet+, …) f-liste Représentation comprimée de la BD en mémoire centrale 28/02/2021 © Robert Godin. Tous droits réservés. 60

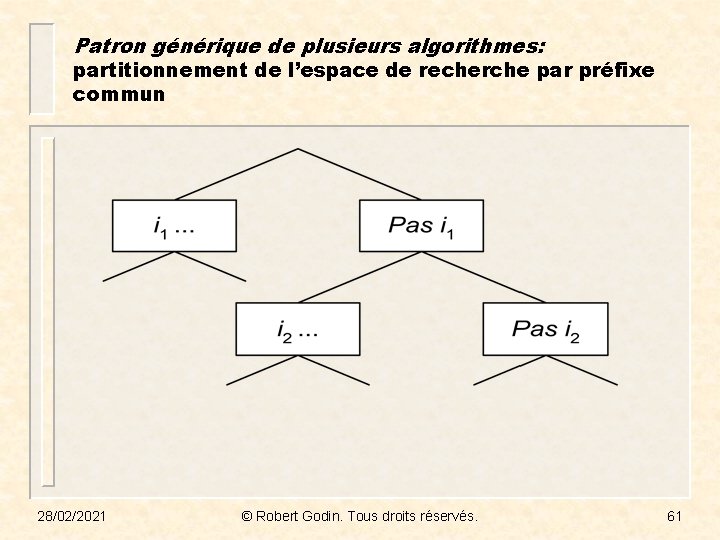

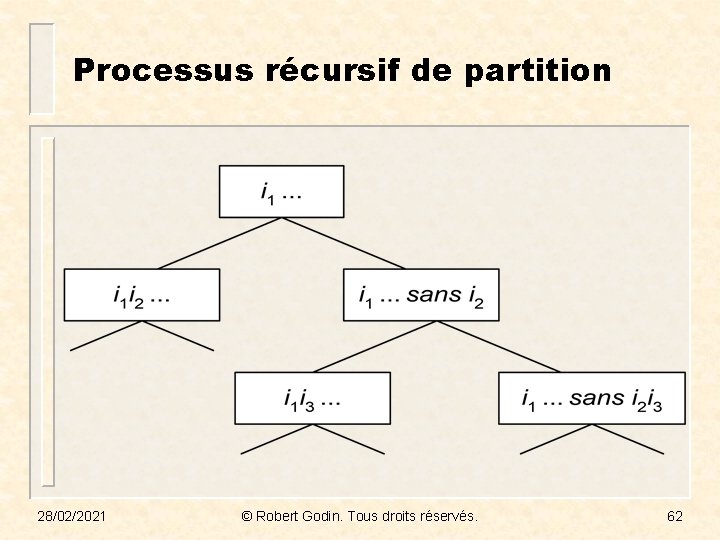

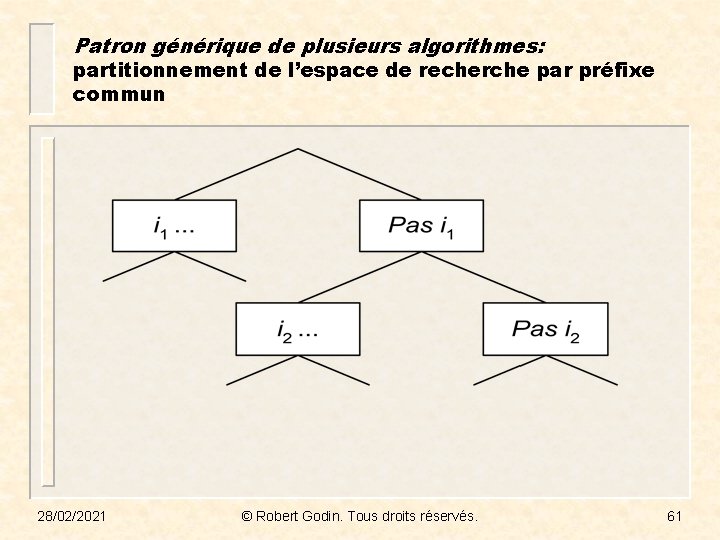

Patron générique de plusieurs algorithmes: partitionnement de l’espace de recherche par préfixe commun 28/02/2021 © Robert Godin. Tous droits réservés. 61

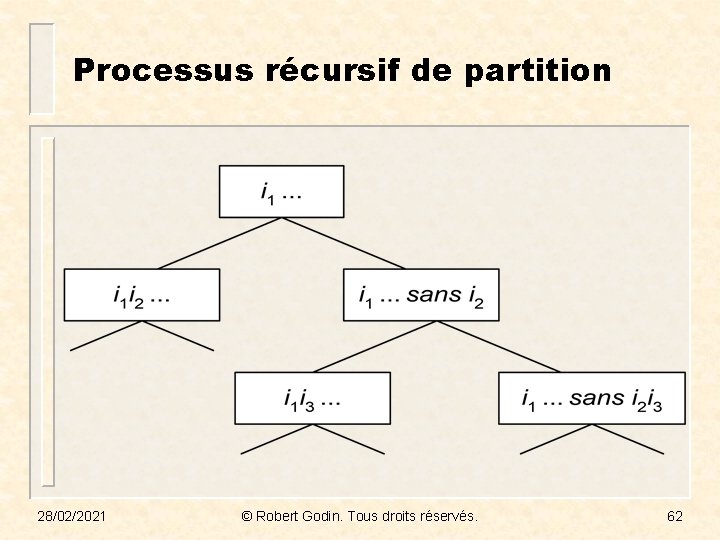

Processus récursif de partition 28/02/2021 © Robert Godin. Tous droits réservés. 62

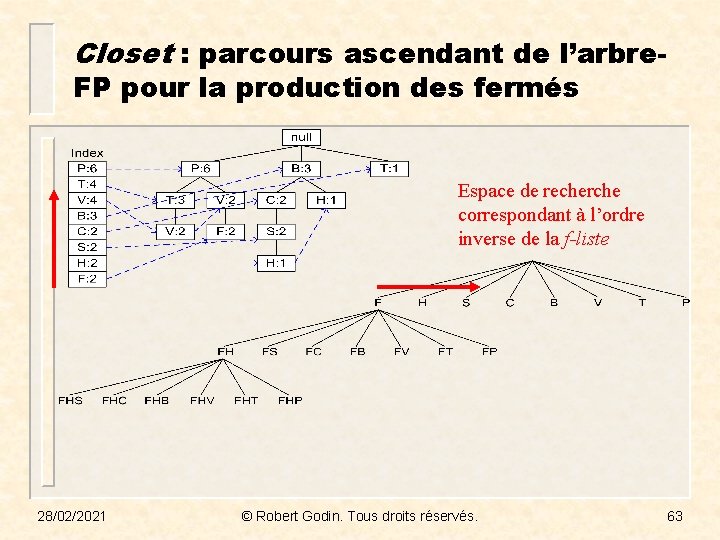

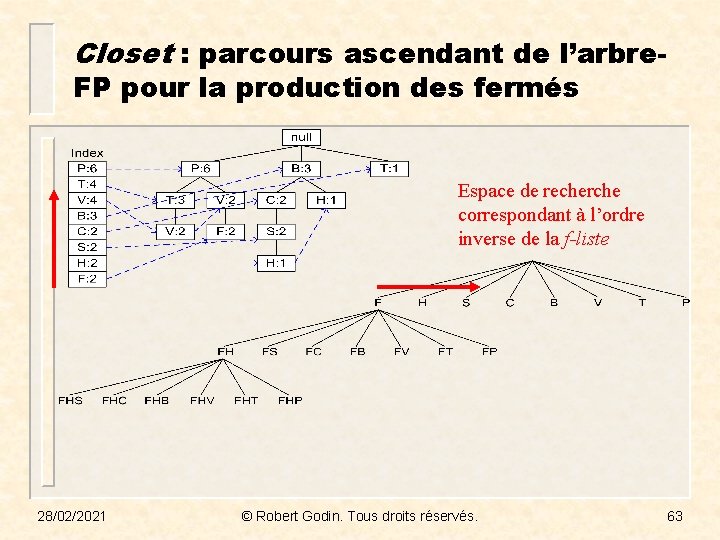

Closet : parcours ascendant de l’arbre. FP pour la production des fermés Espace de recherche correspondant à l’ordre inverse de la f-liste 28/02/2021 © Robert Godin. Tous droits réservés. 63

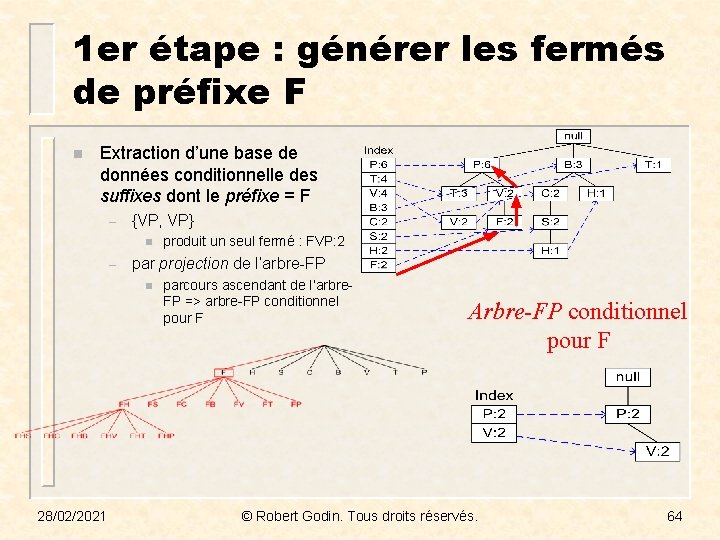

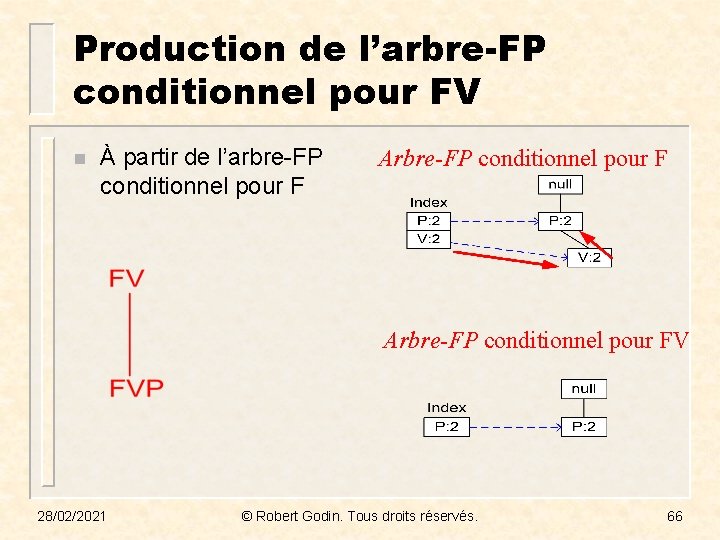

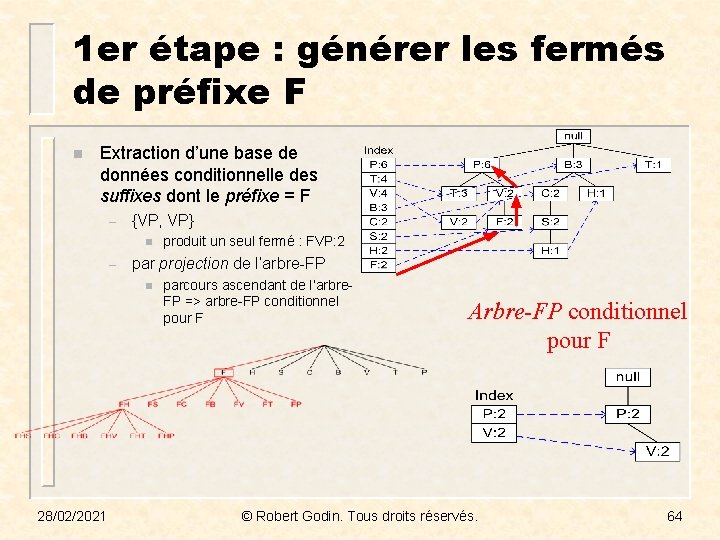

1 er étape : générer les fermés de préfixe F n Extraction d’une base de données conditionnelle des suffixes dont le préfixe = F – {VP, VP} n – par projection de l’arbre-FP n 28/02/2021 produit un seul fermé : FVP: 2 parcours ascendant de l’arbre. FP => arbre-FP conditionnel pour F Arbre-FP conditionnel pour F © Robert Godin. Tous droits réservés. 64

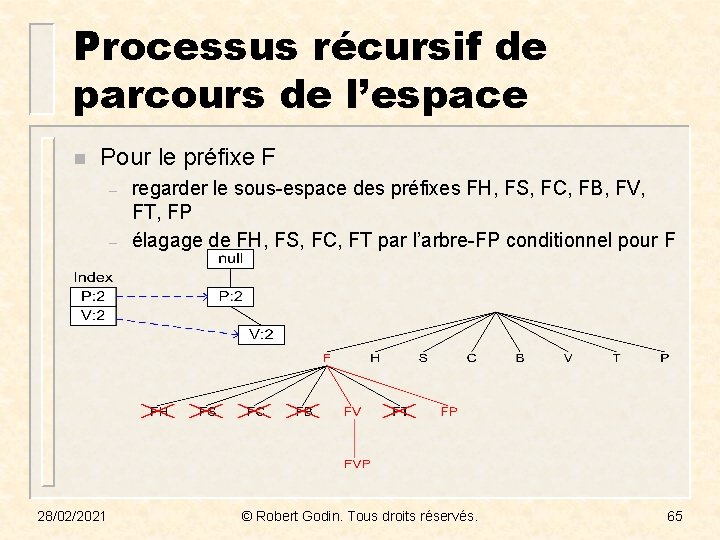

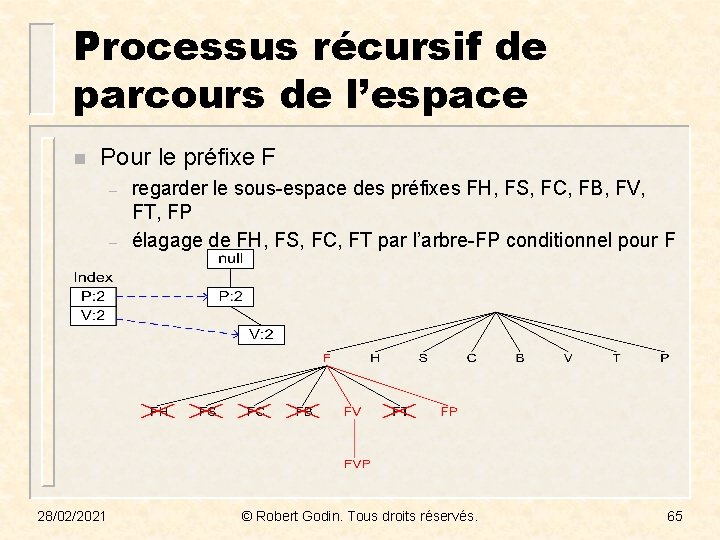

Processus récursif de parcours de l’espace n Pour le préfixe F – – 28/02/2021 regarder le sous-espace des préfixes FH, FS, FC, FB, FV, FT, FP élagage de FH, FS, FC, FT par l’arbre-FP conditionnel pour F © Robert Godin. Tous droits réservés. 65

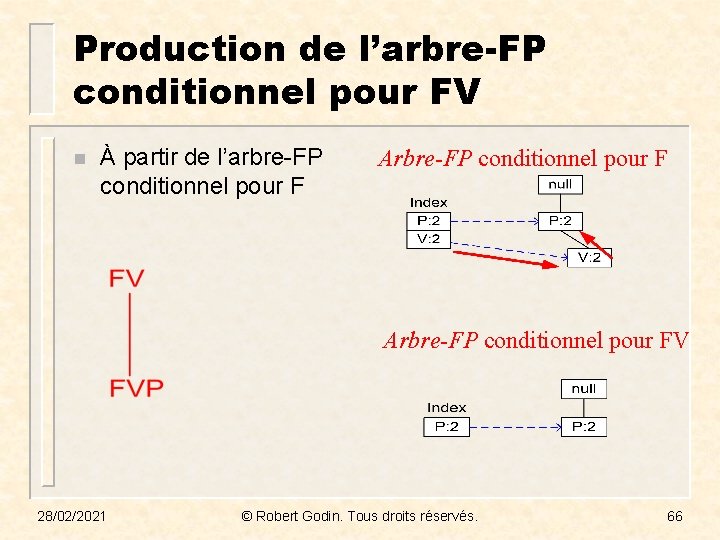

Production de l’arbre-FP conditionnel pour FV n À partir de l’arbre-FP conditionnel pour F Arbre-FP conditionnel pour FV 28/02/2021 © Robert Godin. Tous droits réservés. 66

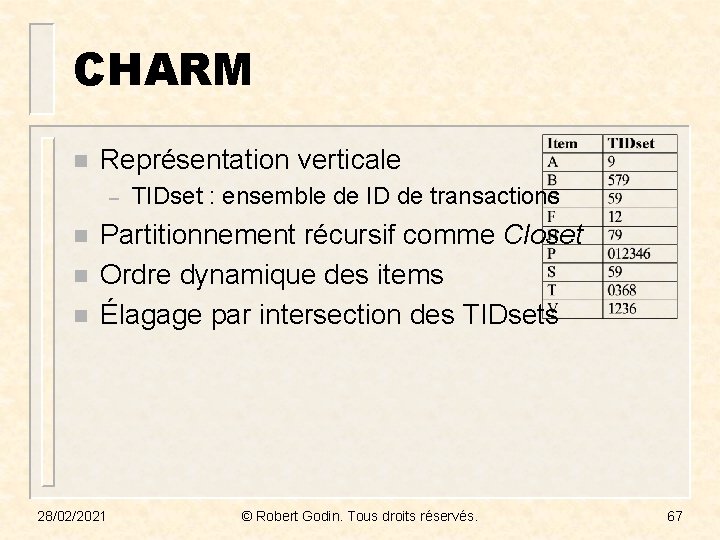

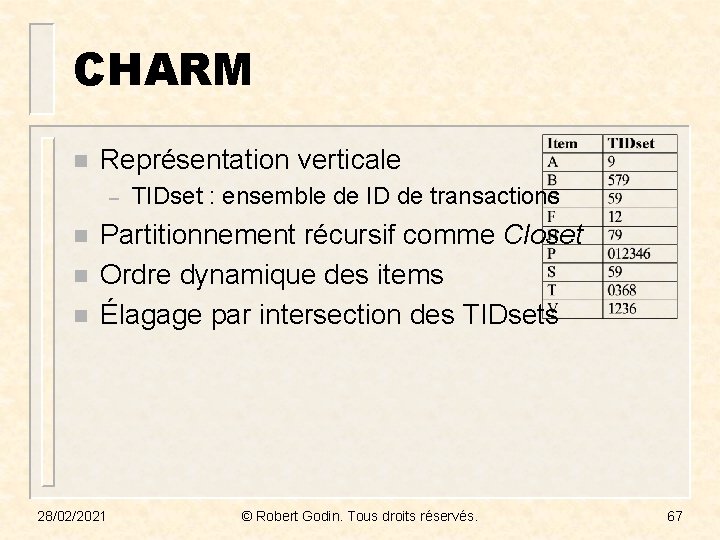

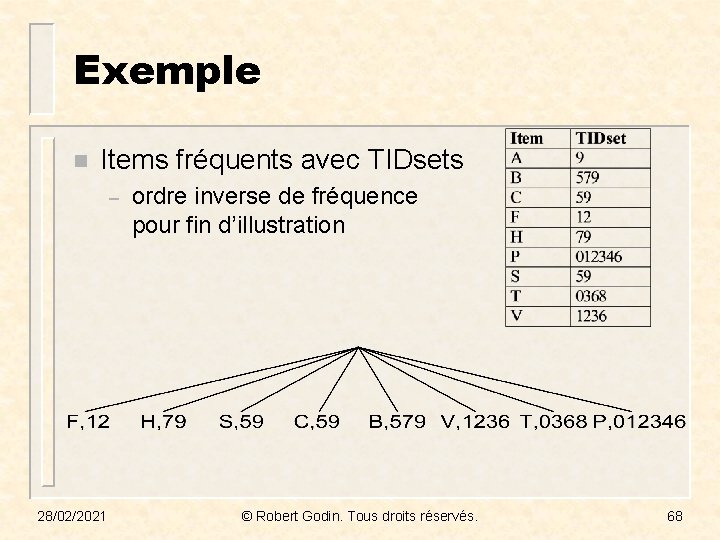

CHARM n Représentation verticale – n n n TIDset : ensemble de ID de transactions Partitionnement récursif comme Closet Ordre dynamique des items Élagage par intersection des TIDsets 28/02/2021 © Robert Godin. Tous droits réservés. 67

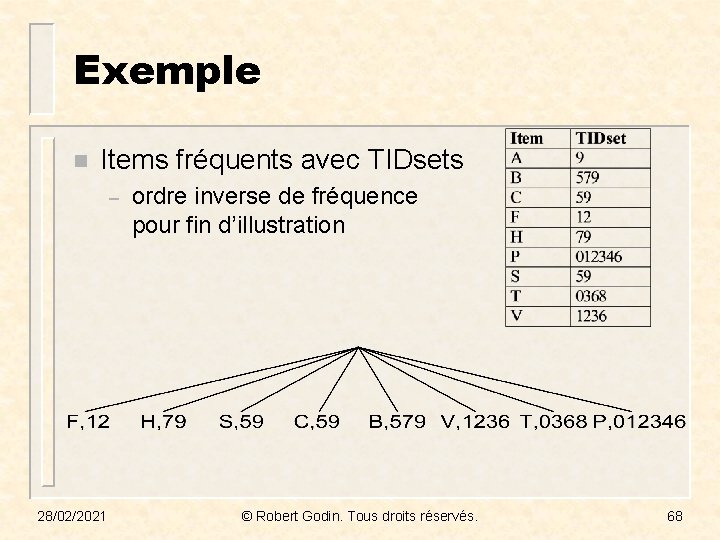

Exemple n Items fréquents avec TIDsets – 28/02/2021 ordre inverse de fréquence pour fin d’illustration © Robert Godin. Tous droits réservés. 68

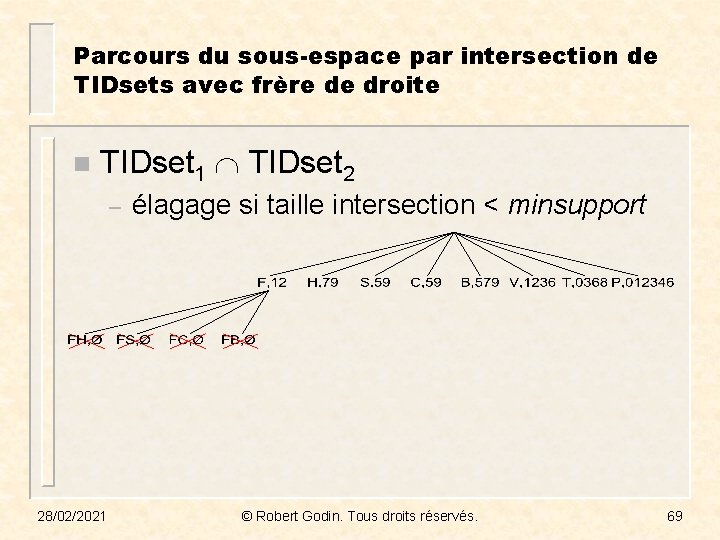

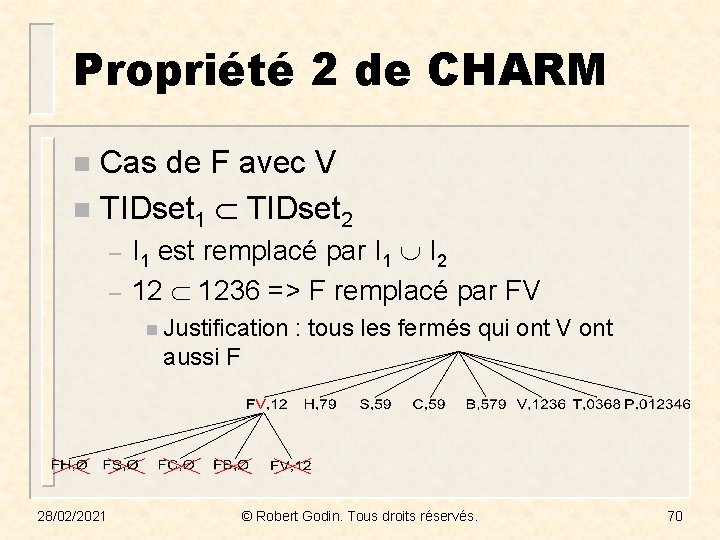

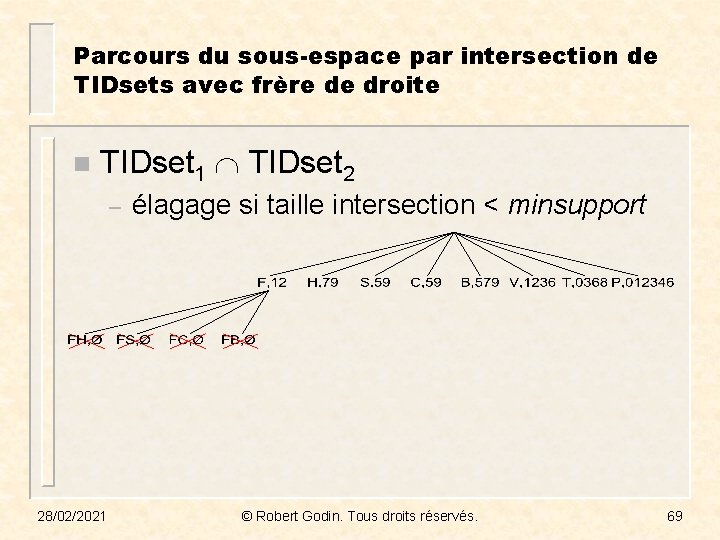

Parcours du sous-espace par intersection de TIDsets avec frère de droite n TIDset 1 TIDset 2 – 28/02/2021 élagage si taille intersection < minsupport © Robert Godin. Tous droits réservés. 69

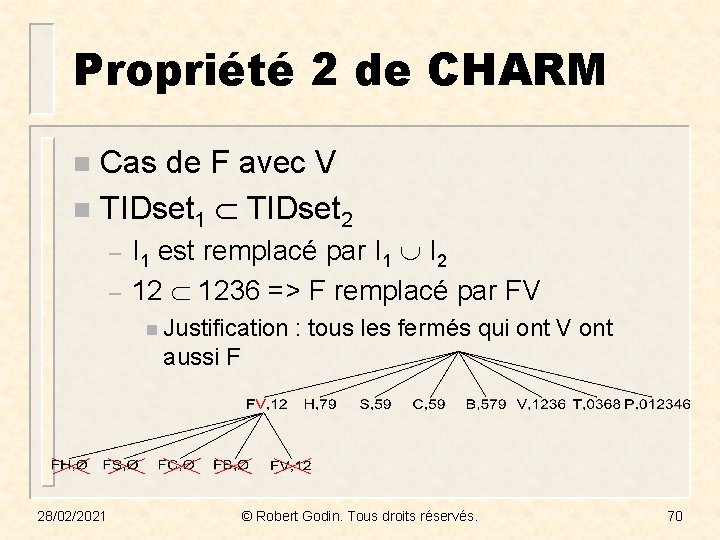

Propriété 2 de CHARM Cas de F avec V n TIDset 1 TIDset 2 n – I 1 est remplacé par I 1 I 2 – 12 1236 => F remplacé par FV n Justification : tous les fermés qui ont V ont aussi F 28/02/2021 © Robert Godin. Tous droits réservés. 70

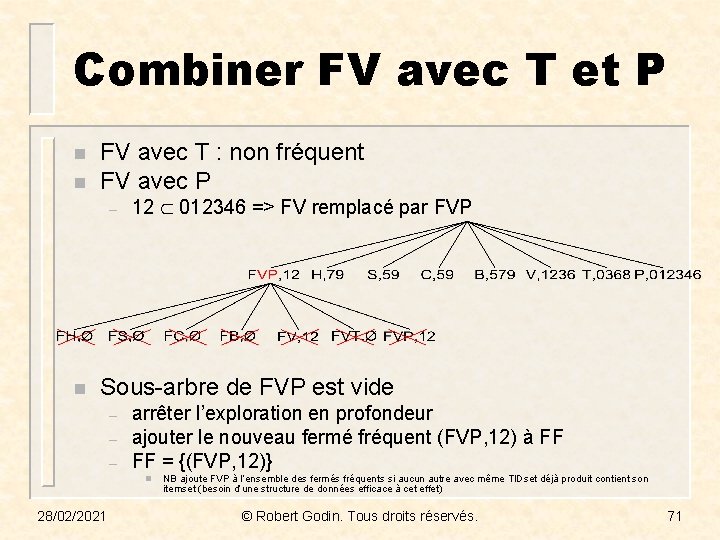

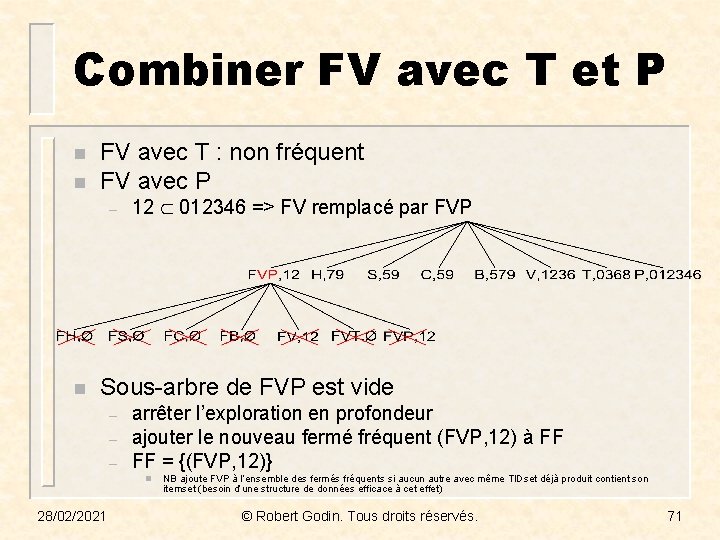

Combiner FV avec T et P n n FV avec T : non fréquent FV avec P – n 12 012346 => FV remplacé par FVP Sous-arbre de FVP est vide – – – arrêter l’exploration en profondeur ajouter le nouveau fermé fréquent (FVP, 12) à FF FF = {(FVP, 12)} n 28/02/2021 NB ajoute FVP à l’ensemble des fermés fréquents si aucun autre avec même TIDset déjà produit contient son itemset (besoin d’une structure de données efficace à cet effet) © Robert Godin. Tous droits réservés. 71

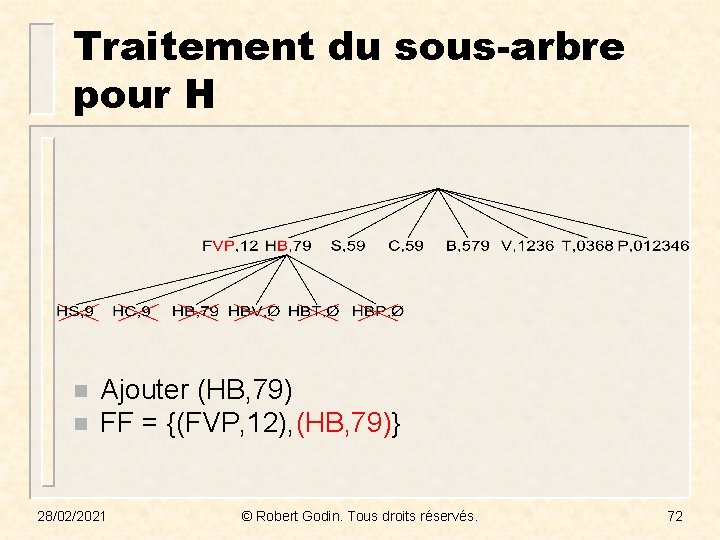

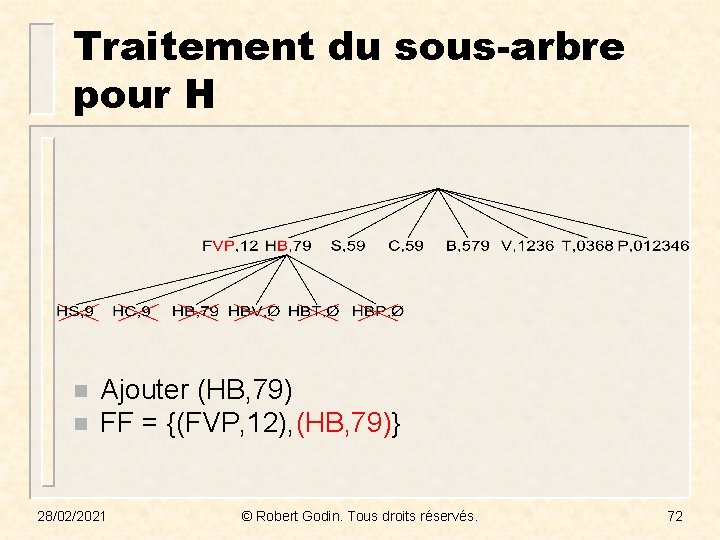

Traitement du sous-arbre pour H n n Ajouter (HB, 79) FF = {(FVP, 12), (HB, 79)} 28/02/2021 © Robert Godin. Tous droits réservés. 72

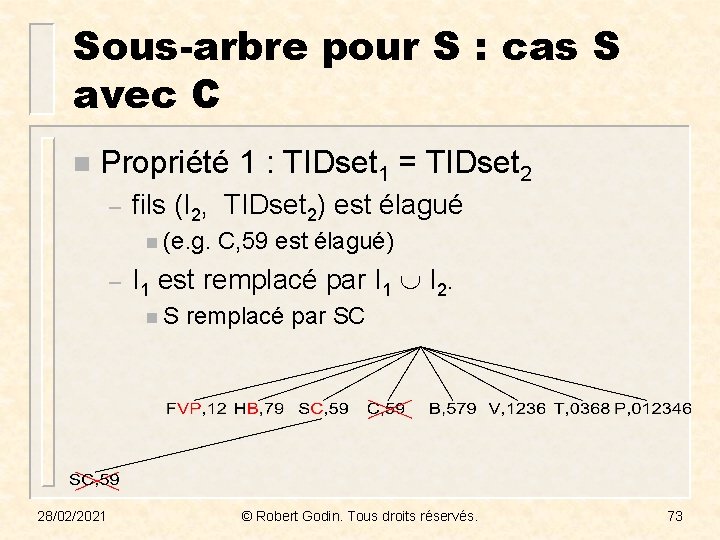

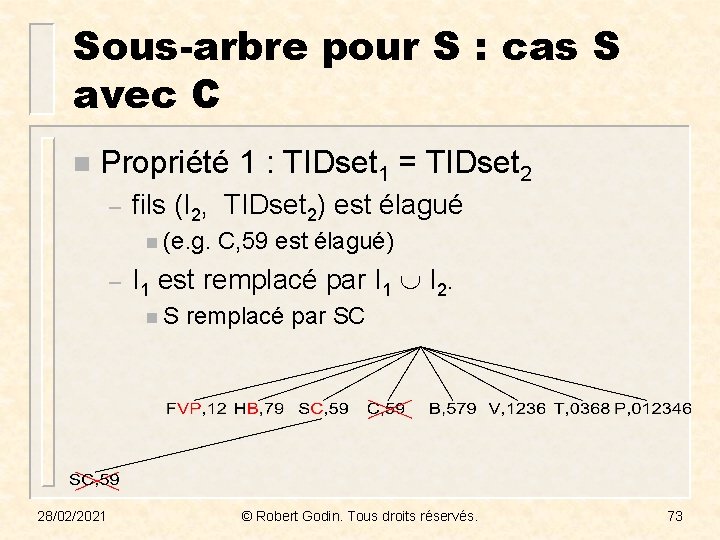

Sous-arbre pour S : cas S avec C n Propriété 1 : TIDset 1 = TIDset 2 – fils (I 2, TIDset 2) est élagué n (e. g. C, 59 est élagué) – I 1 est remplacé par I 1 I 2. n S remplacé par SC 28/02/2021 © Robert Godin. Tous droits réservés. 73

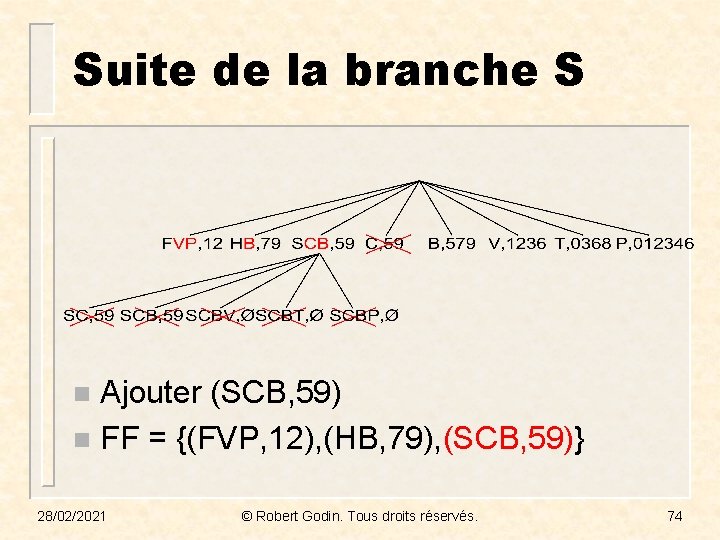

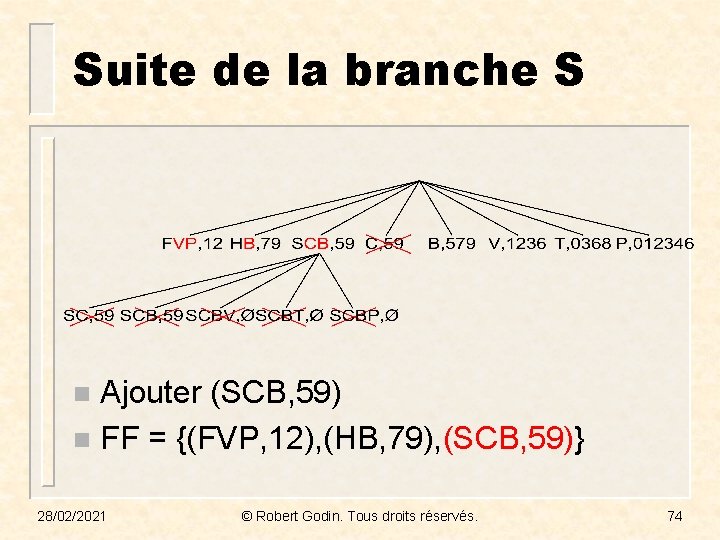

Suite de la branche S Ajouter (SCB, 59) n FF = {(FVP, 12), (HB, 79), (SCB, 59)} n 28/02/2021 © Robert Godin. Tous droits réservés. 74

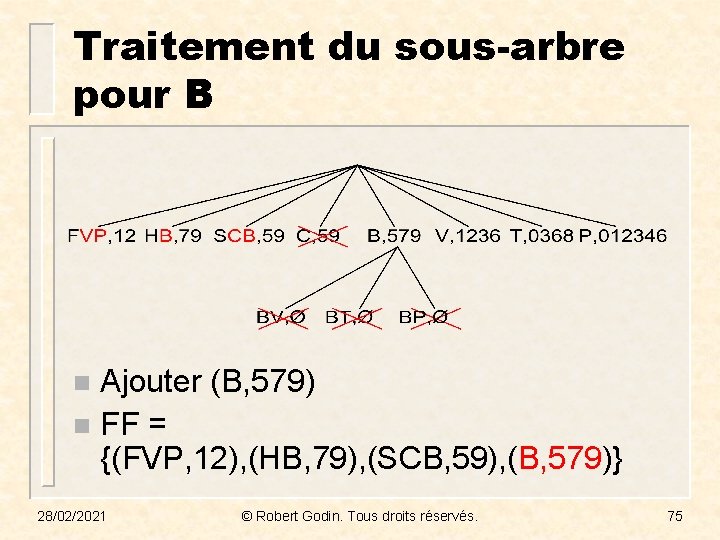

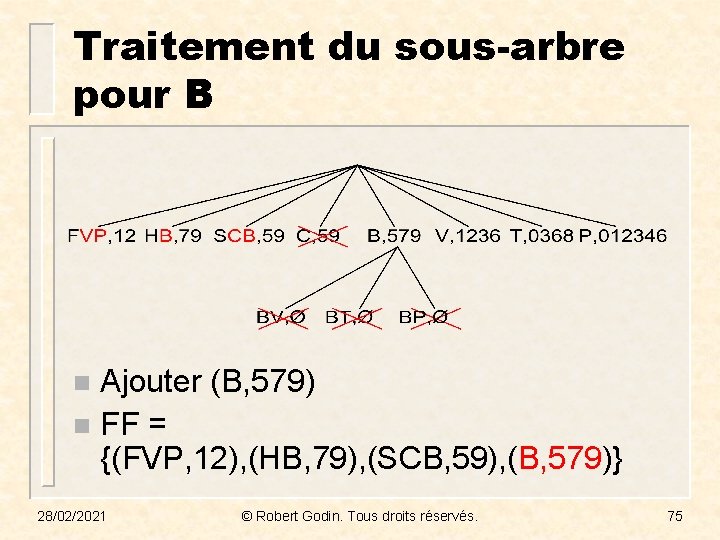

Traitement du sous-arbre pour B Ajouter (B, 579) n FF = {(FVP, 12), (HB, 79), (SCB, 59), (B, 579)} n 28/02/2021 © Robert Godin. Tous droits réservés. 75

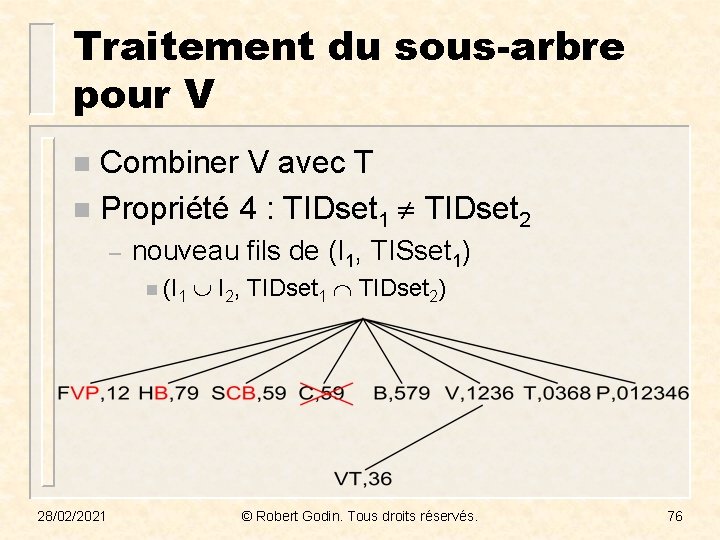

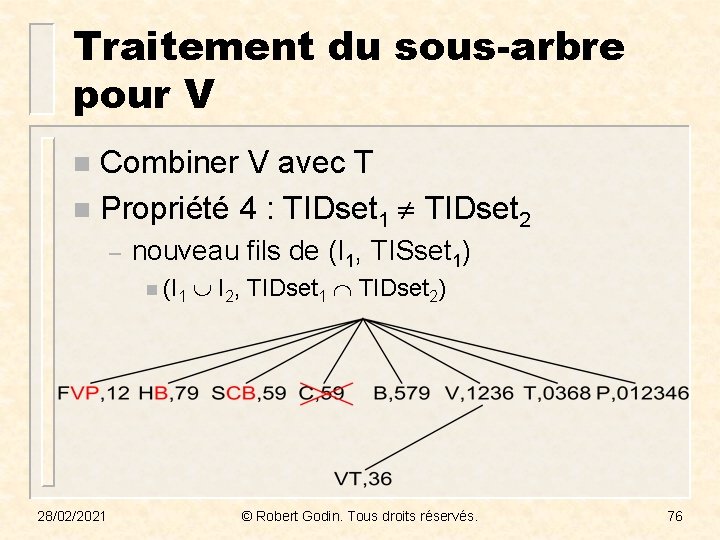

Traitement du sous-arbre pour V Combiner V avec T n Propriété 4 : TIDset 1 TIDset 2 n – nouveau fils de (I 1, TISset 1) n (I 1 I 2, TIDset 1 TIDset 2) 28/02/2021 © Robert Godin. Tous droits réservés. 76

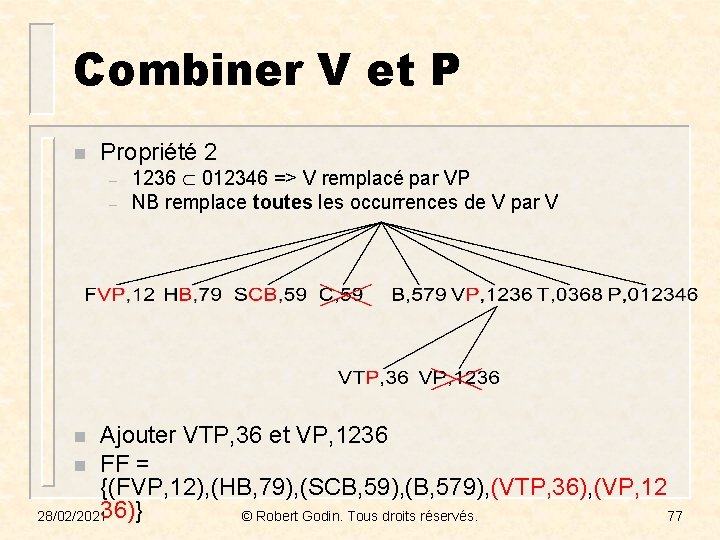

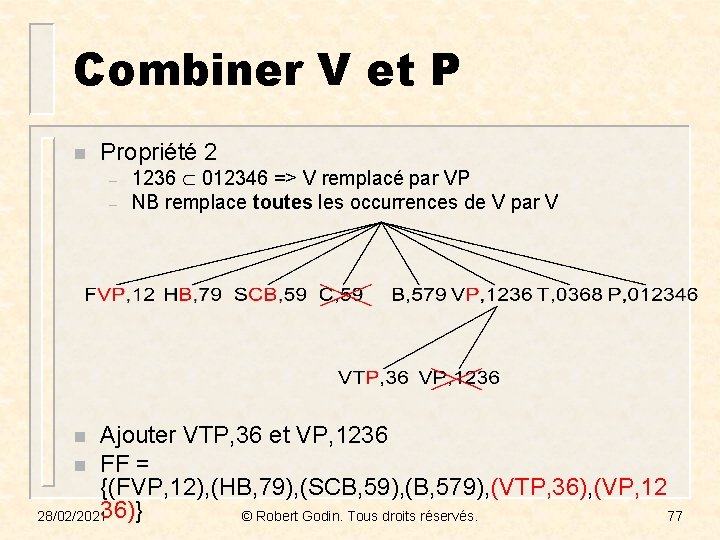

Combiner V et P n Propriété 2 – – 1236 012346 => V remplacé par VP NB remplace toutes les occurrences de V par V Ajouter VTP, 36 et VP, 1236 n FF = {(FVP, 12), (HB, 79), (SCB, 59), (B, 579), (VTP, 36), (VP, 12 36)} 28/02/2021 © Robert Godin. Tous droits réservés. 77 n

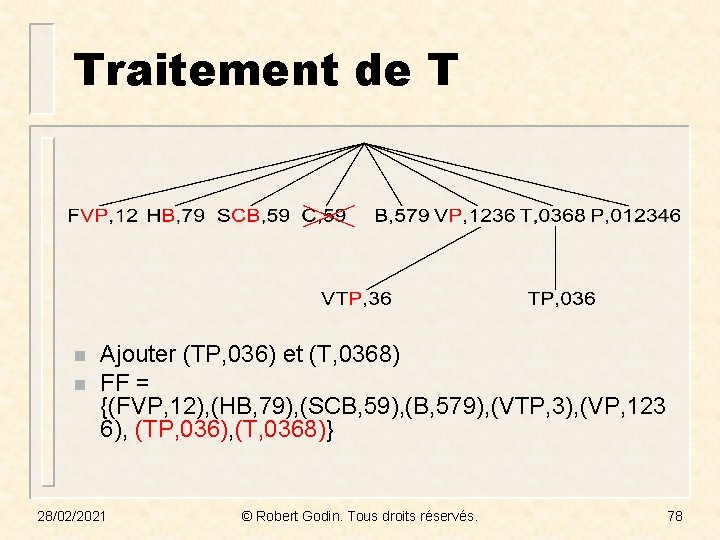

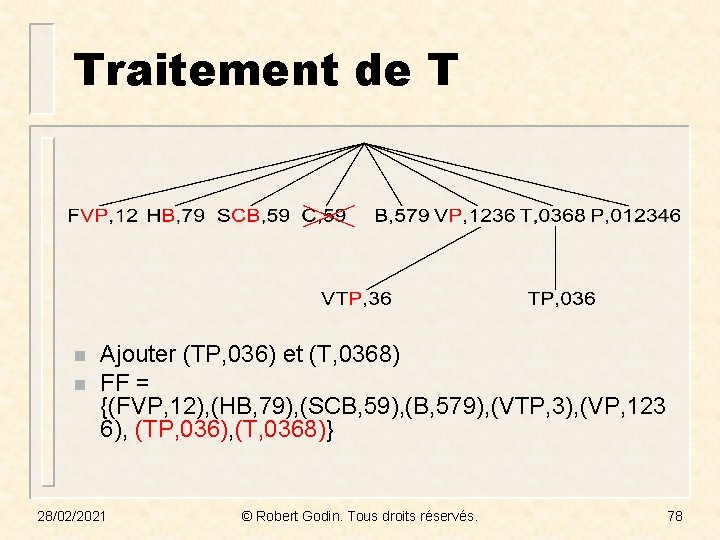

Traitement de T n n Ajouter (TP, 036) et (T, 0368) FF = {(FVP, 12), (HB, 79), (SCB, 59), (B, 579), (VTP, 3), (VP, 123 6), (TP, 036), (T, 0368)} 28/02/2021 © Robert Godin. Tous droits réservés. 78

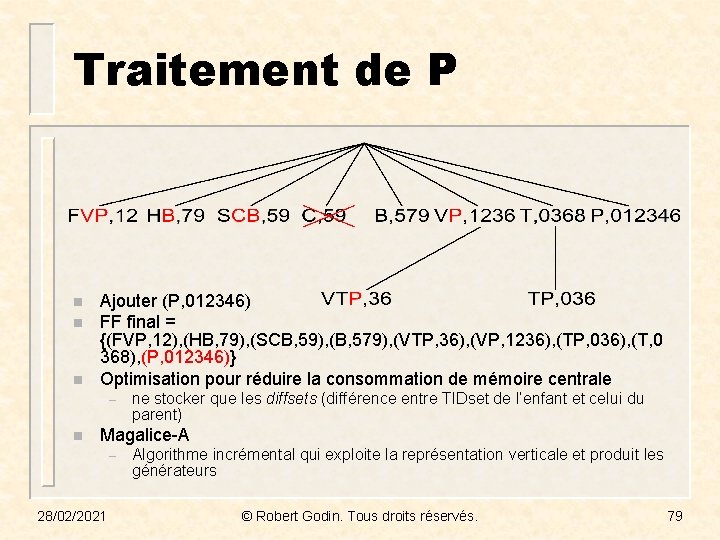

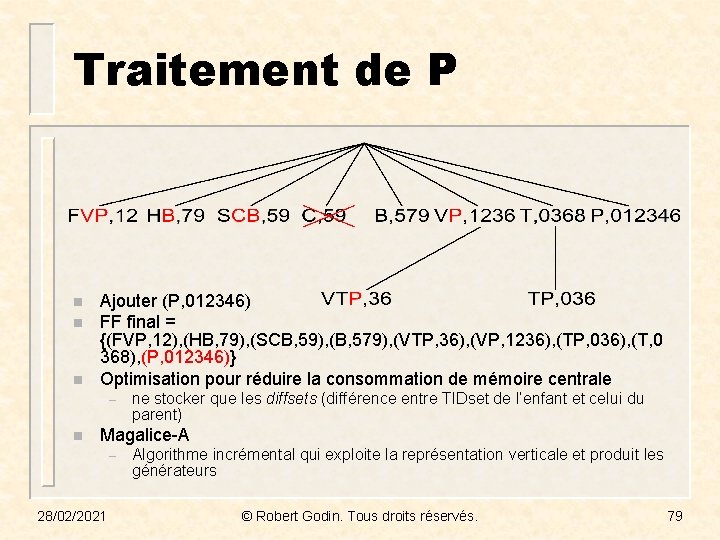

Traitement de P n n n Ajouter (P, 012346) FF final = {(FVP, 12), (HB, 79), (SCB, 59), (B, 579), (VTP, 36), (VP, 1236), (TP, 036), (T, 0 368), (P, 012346)} Optimisation pour réduire la consommation de mémoire centrale – n ne stocker que les diffsets (différence entre TIDset de l’enfant et celui du parent) Magalice-A – 28/02/2021 Algorithme incrémental qui exploite la représentation verticale et produit les générateurs © Robert Godin. Tous droits réservés. 79

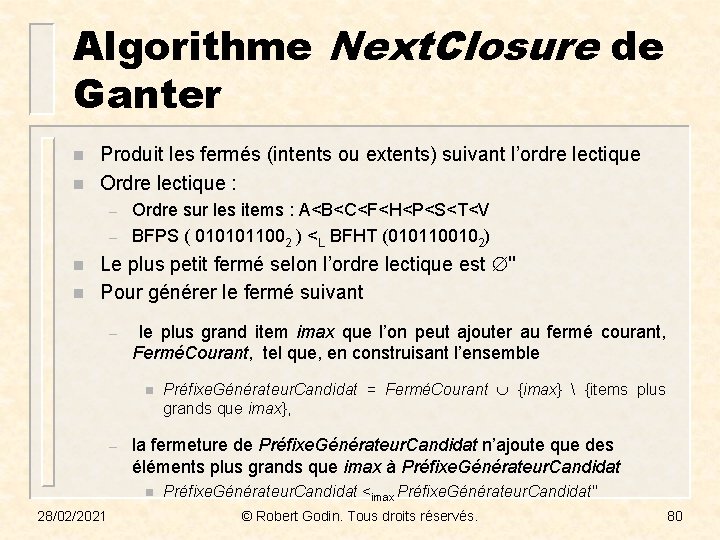

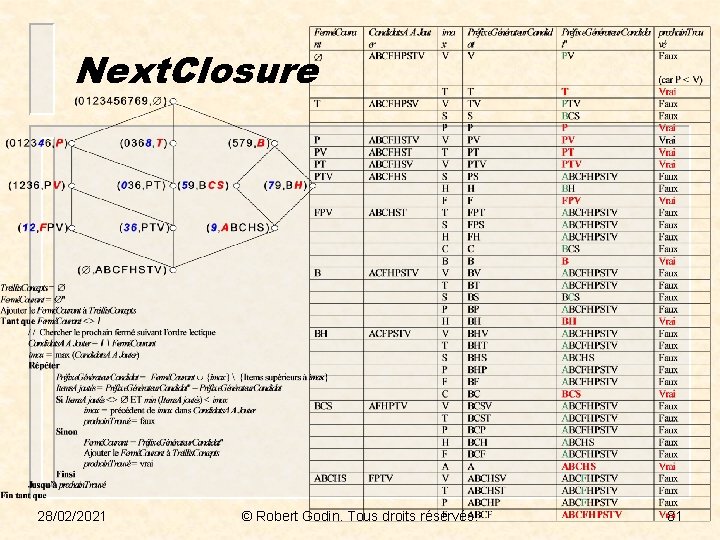

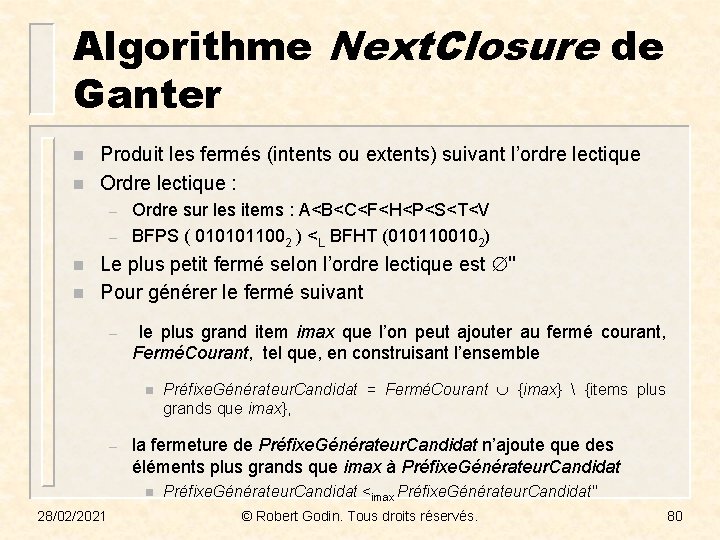

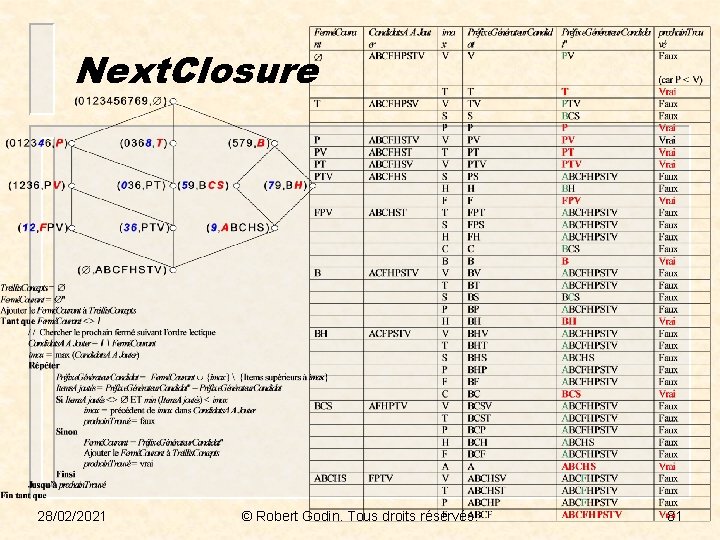

Algorithme Next. Closure de Ganter n n Produit les fermés (intents ou extents) suivant l’ordre lectique Ordre lectique : – – n n Ordre sur les items : A<B<C<F<H<P<S<T<V BFPS ( 0101011002 ) <L BFHT (0101100102) Le plus petit fermé selon l’ordre lectique est '' Pour générer le fermé suivant – le plus grand item imax que l’on peut ajouter au fermé courant, FerméCourant, tel que, en construisant l’ensemble n – la fermeture de Préfixe. Générateur. Candidat n’ajoute que des éléments plus grands que imax à Préfixe. Générateur. Candidat n 28/02/2021 Préfixe. Générateur. Candidat = FerméCourant {imax} {items plus grands que imax}, Préfixe. Générateur. Candidat <imax Préfixe. Générateur. Candidat'' © Robert Godin. Tous droits réservés. 80

Next. Closure 28/02/2021 © Robert Godin. Tous droits réservés. 81

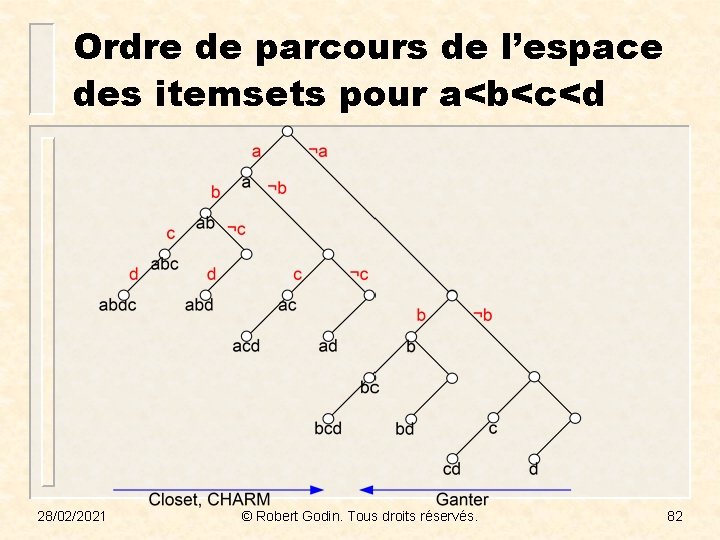

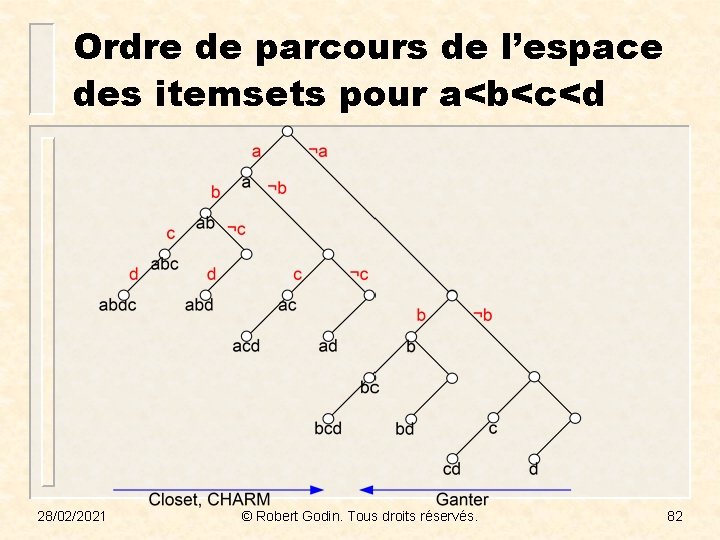

Ordre de parcours de l’espace des itemsets pour a<b<c<d 28/02/2021 © Robert Godin. Tous droits réservés. 82

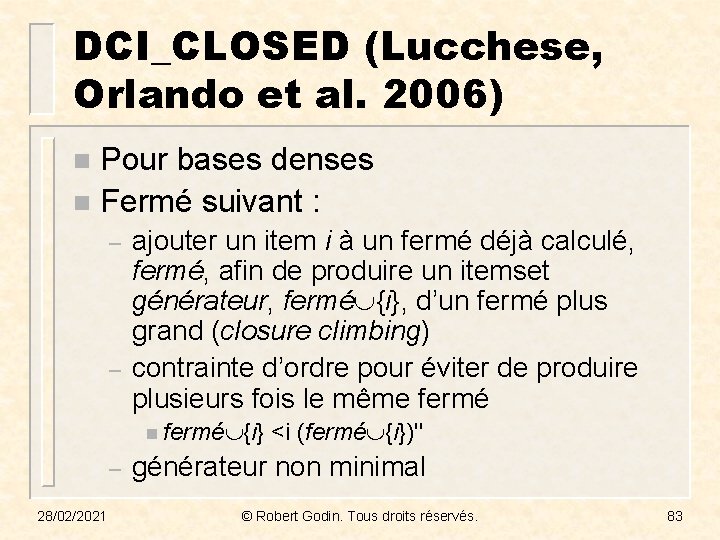

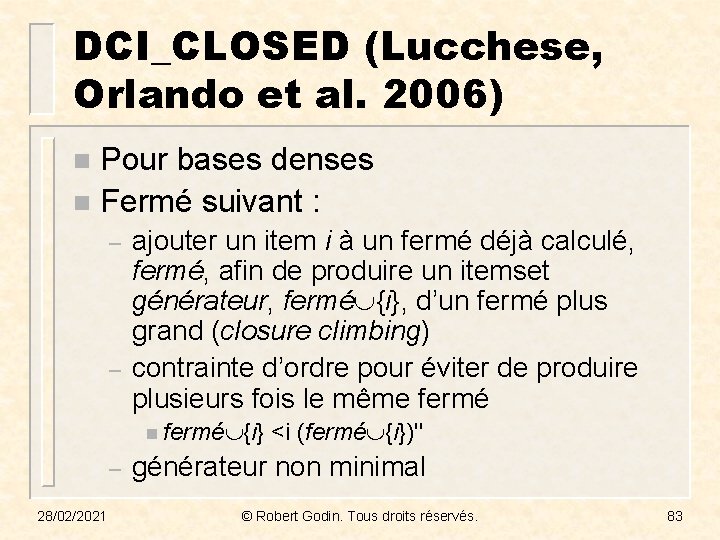

DCI_CLOSED (Lucchese, Orlando et al. 2006) Pour bases denses n Fermé suivant : n – – ajouter un item i à un fermé déjà calculé, fermé, afin de produire un itemset générateur, fermé {i}, d’un fermé plus grand (closure climbing) contrainte d’ordre pour éviter de produire plusieurs fois le même fermé n fermé {i} <i (fermé {i})'' – 28/02/2021 générateur non minimal © Robert Godin. Tous droits réservés. 83

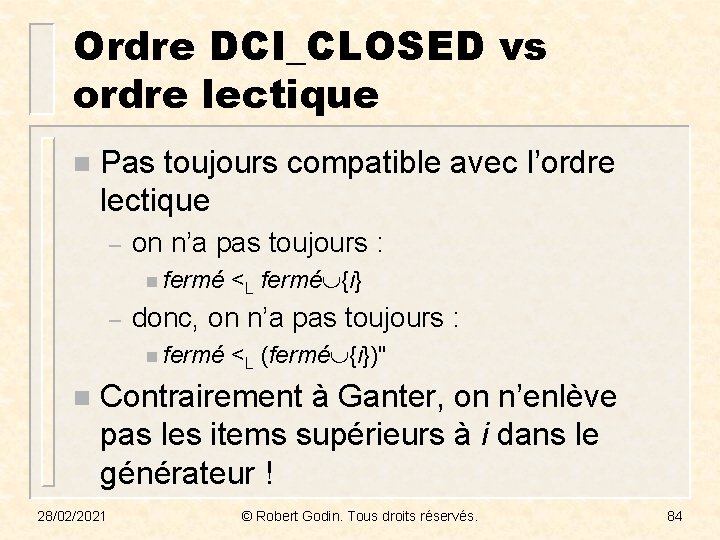

Ordre DCI_CLOSED vs ordre lectique n Pas toujours compatible avec l’ordre lectique – on n’a pas toujours : n fermé <L fermé {i} – donc, on n’a pas toujours : n fermé <L (fermé {i})'' n Contrairement à Ganter, on n’enlève pas les items supérieurs à i dans le générateur ! 28/02/2021 © Robert Godin. Tous droits réservés. 84

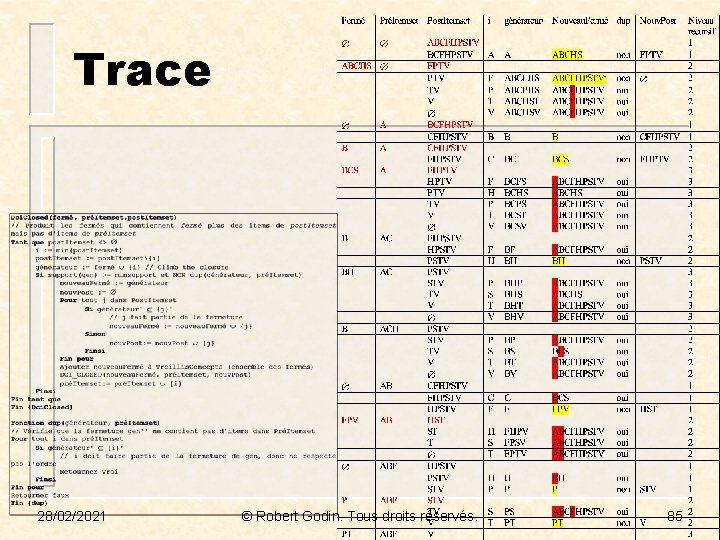

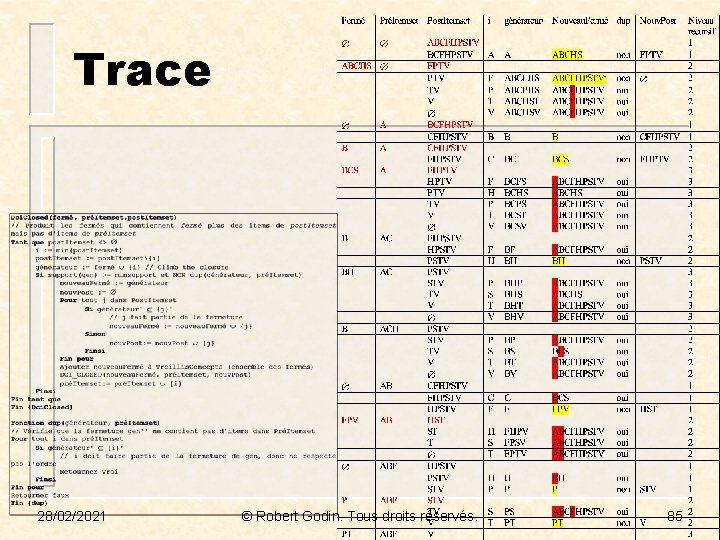

Trace 28/02/2021 © Robert Godin. Tous droits réservés. 85

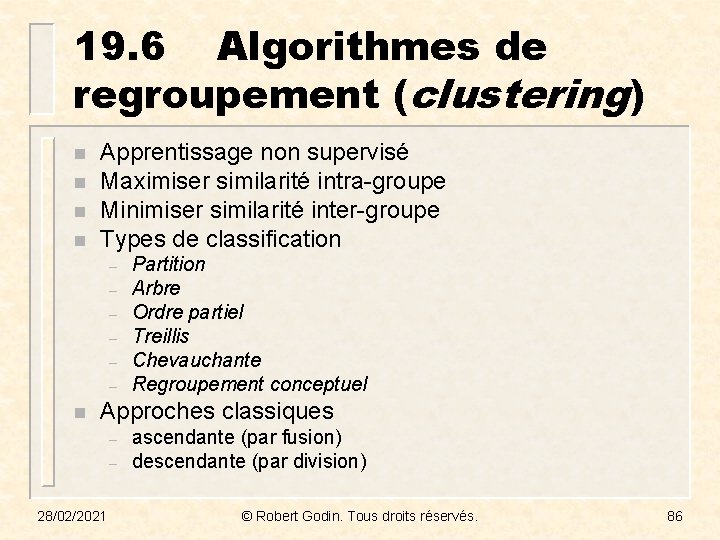

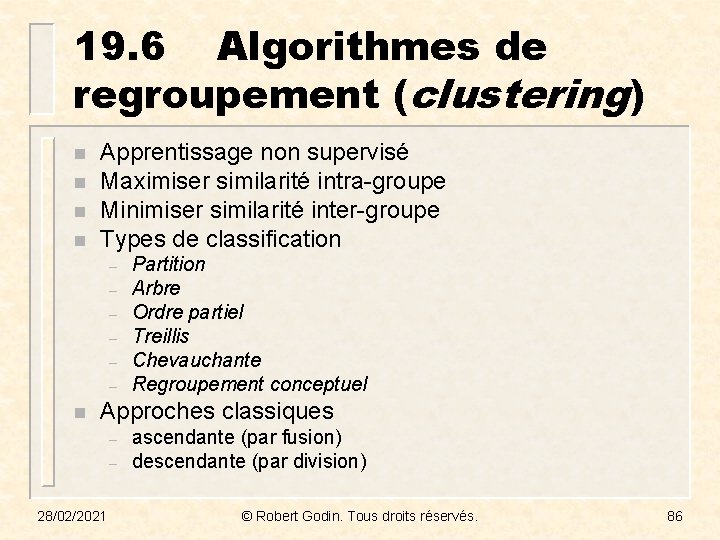

19. 6 Algorithmes de regroupement (clustering) n n Apprentissage non supervisé Maximiser similarité intra-groupe Minimiser similarité inter-groupe Types de classification – – – n Partition Arbre Ordre partiel Treillis Chevauchante Regroupement conceptuel Approches classiques – – 28/02/2021 ascendante (par fusion) descendante (par division) © Robert Godin. Tous droits réservés. 86

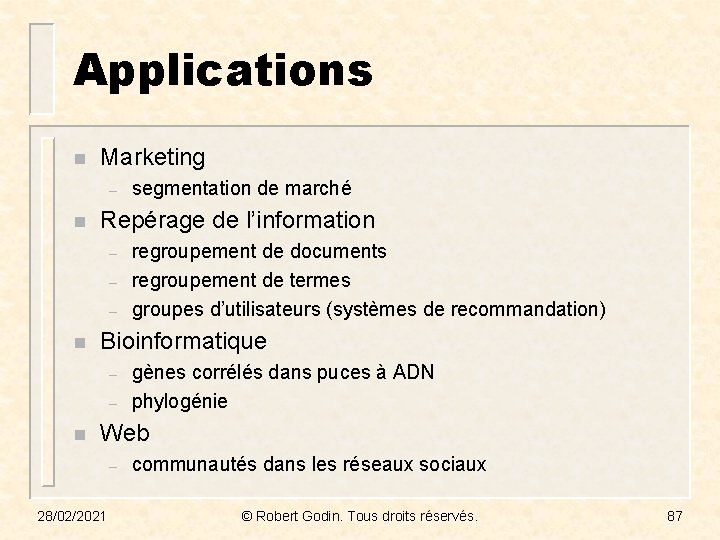

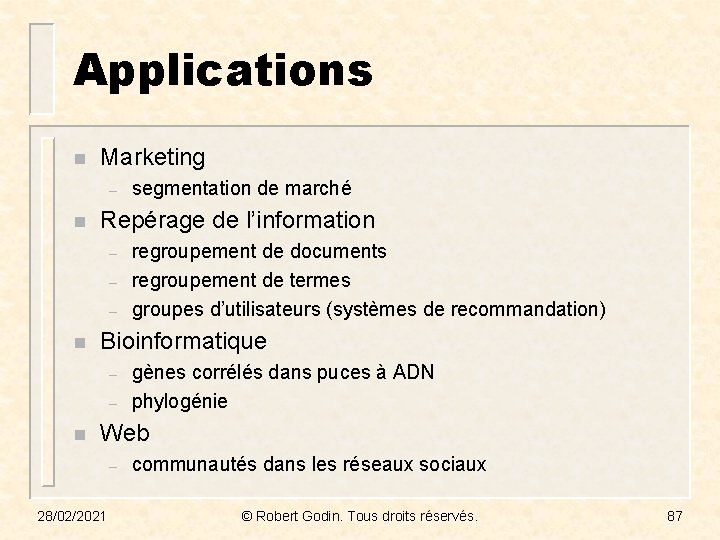

Applications n Marketing – n Repérage de l’information – – – n regroupement de documents regroupement de termes groupes d’utilisateurs (systèmes de recommandation) Bioinformatique – – n segmentation de marché gènes corrélés dans puces à ADN phylogénie Web – 28/02/2021 communautés dans les réseaux sociaux © Robert Godin. Tous droits réservés. 87

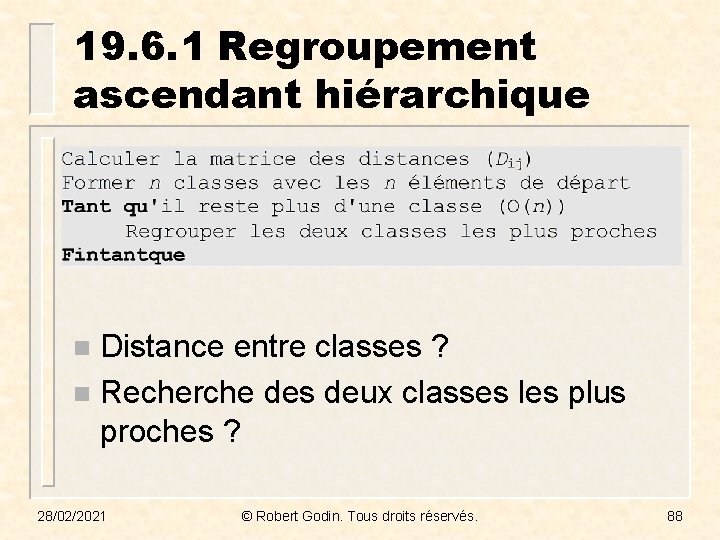

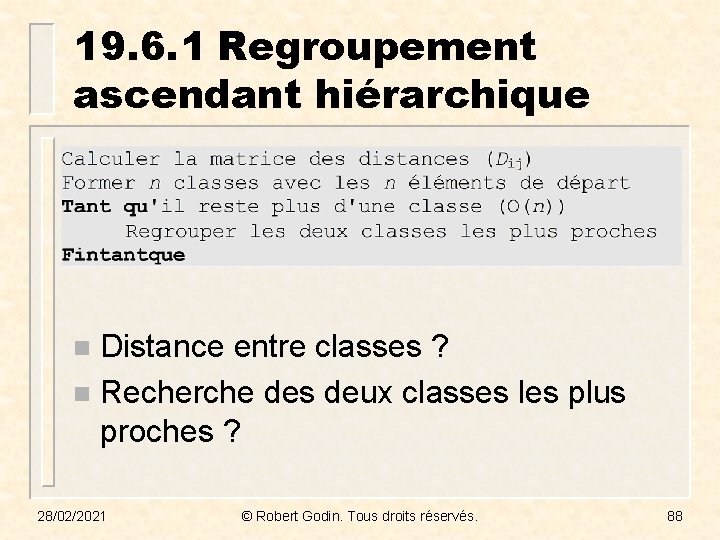

19. 6. 1 Regroupement ascendant hiérarchique Distance entre classes ? n Recherche des deux classes les plus proches ? n 28/02/2021 © Robert Godin. Tous droits réservés. 88

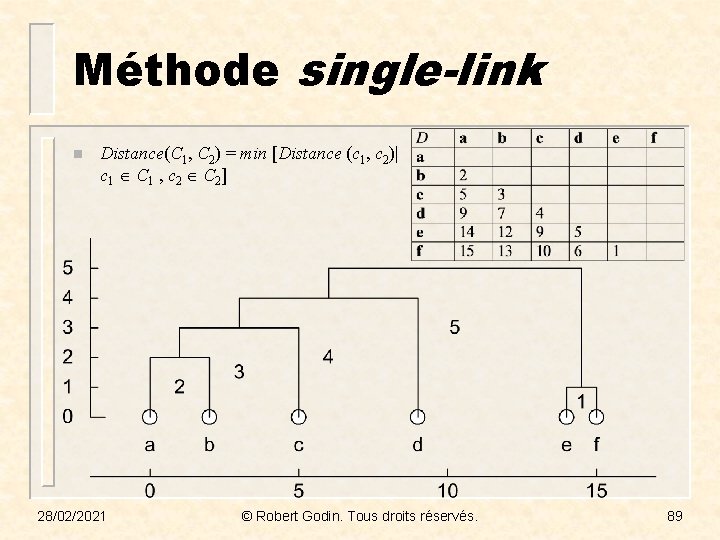

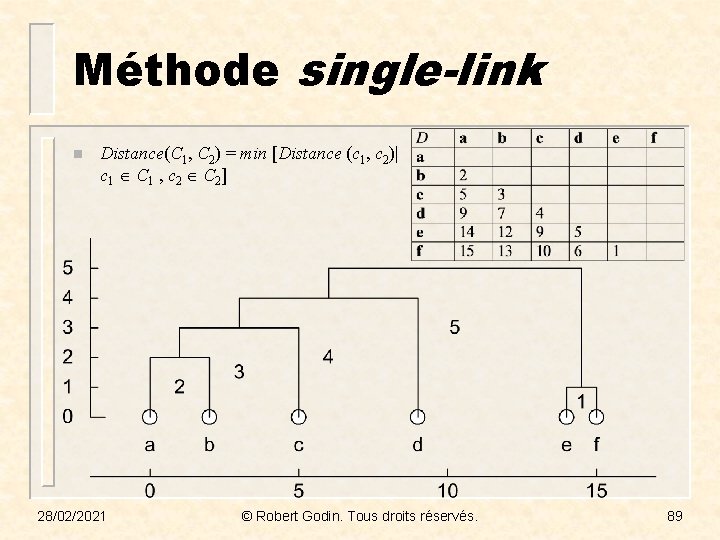

Méthode single-link n Distance(C 1, C 2) = min [Distance (c 1, c 2)| c 1 C 1 , c 2 C 2 ] 28/02/2021 © Robert Godin. Tous droits réservés. 89

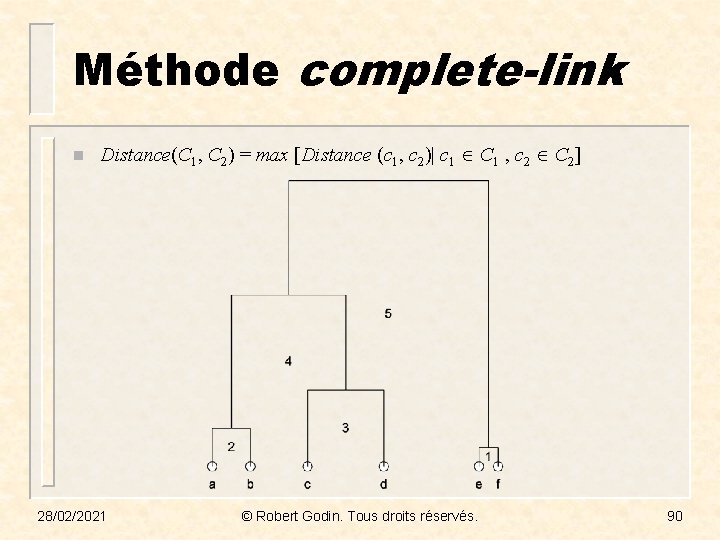

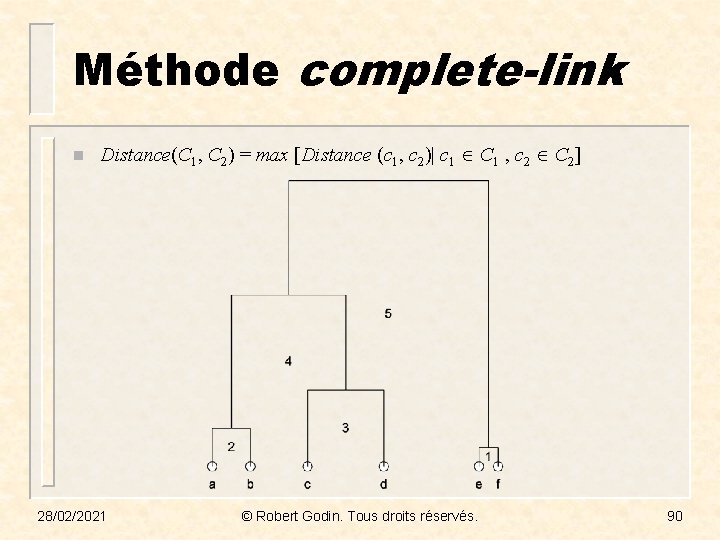

Méthode complete-link n Distance(C 1, C 2) = max [Distance (c 1, c 2)| c 1 C 1 , c 2 C 2] 28/02/2021 © Robert Godin. Tous droits réservés. 90

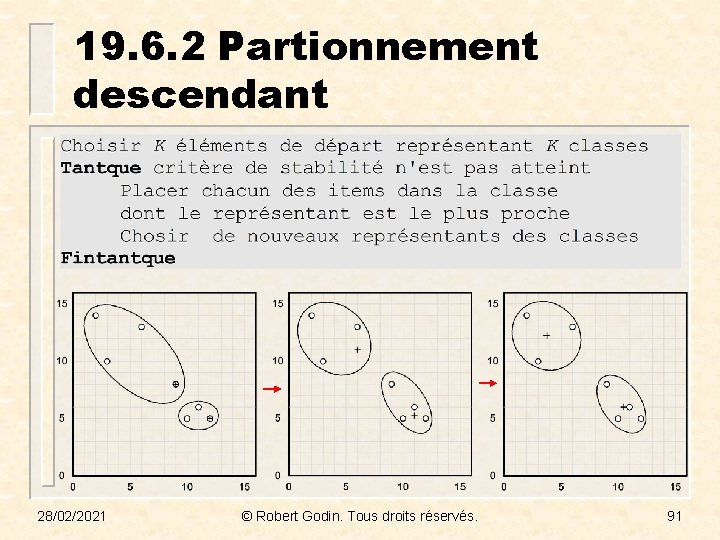

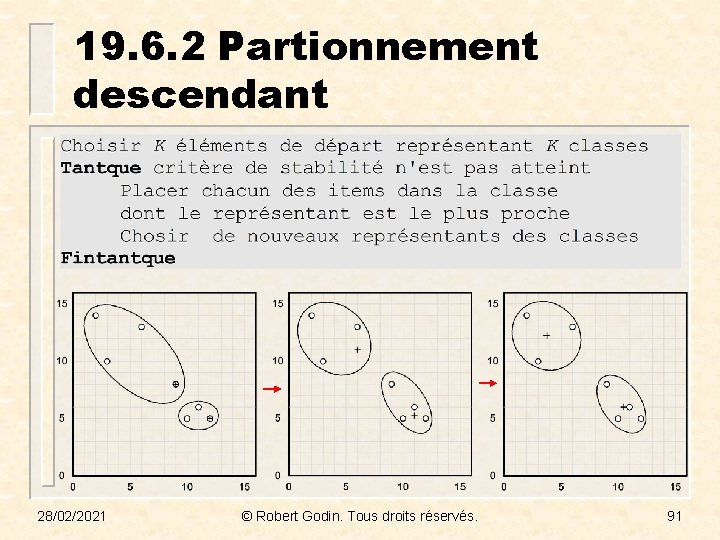

19. 6. 2 Partionnement descendant 28/02/2021 © Robert Godin. Tous droits réservés. 91

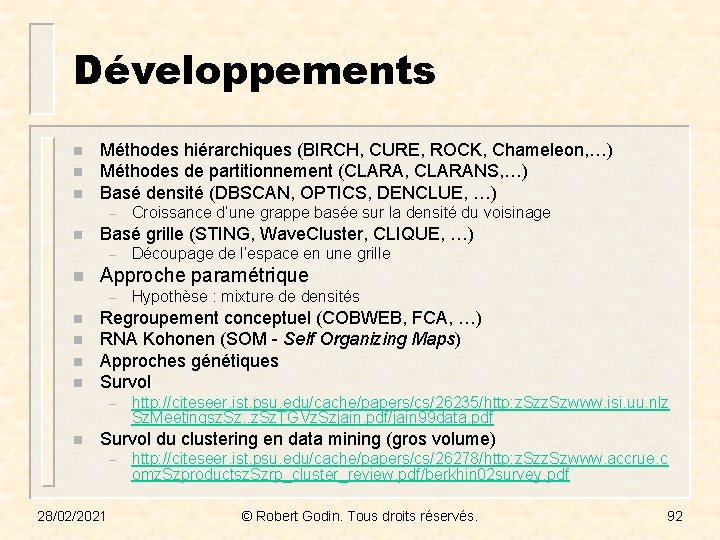

Développements n n n Méthodes hiérarchiques (BIRCH, CURE, ROCK, Chameleon, …) Méthodes de partitionnement (CLARA, CLARANS, …) Basé densité (DBSCAN, OPTICS, DENCLUE, …) – n Basé grille (STING, Wave. Cluster, CLIQUE, …) – n n Hypothèse : mixture de densités Regroupement conceptuel (COBWEB, FCA, …) RNA Kohonen (SOM - Self Organizing Maps) Approches génétiques Survol – n Découpage de l’espace en une grille Approche paramétrique – n Croissance d’une grappe basée sur la densité du voisinage http: //citeseer. ist. psu. edu/cache/papers/cs/26235/http: z. Szwww. isi. uu. nlz Sz. Meetingsz. Sz. TGVz. Szjain. pdf/jain 99 data. pdf Survol du clustering en data mining (gros volume) – 28/02/2021 http: //citeseer. ist. psu. edu/cache/papers/cs/26278/http: z. Szwww. accrue. c omz. Szproductsz. Szrp_cluster_review. pdf/berkhin 02 survey. pdf © Robert Godin. Tous droits réservés. 92

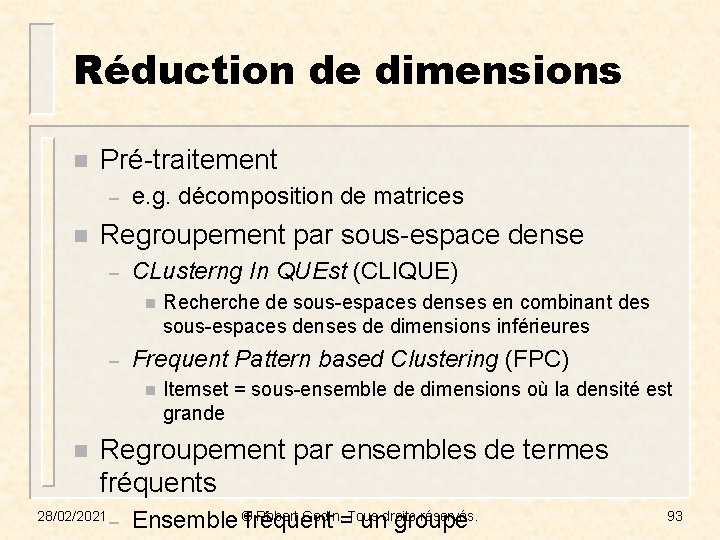

Réduction de dimensions n Pré-traitement – n e. g. décomposition de matrices Regroupement par sous-espace dense – CLusterng In QUEst (CLIQUE) n – Frequent Pattern based Clustering (FPC) n n Recherche de sous-espaces denses en combinant des sous-espaces denses de dimensions inférieures Itemset = sous-ensemble de dimensions où la densité est grande Regroupement par ensembles de termes fréquents 28/02/2021 – © Robert Godin. Tous droits réservés. Ensemble fréquent = un groupe 93

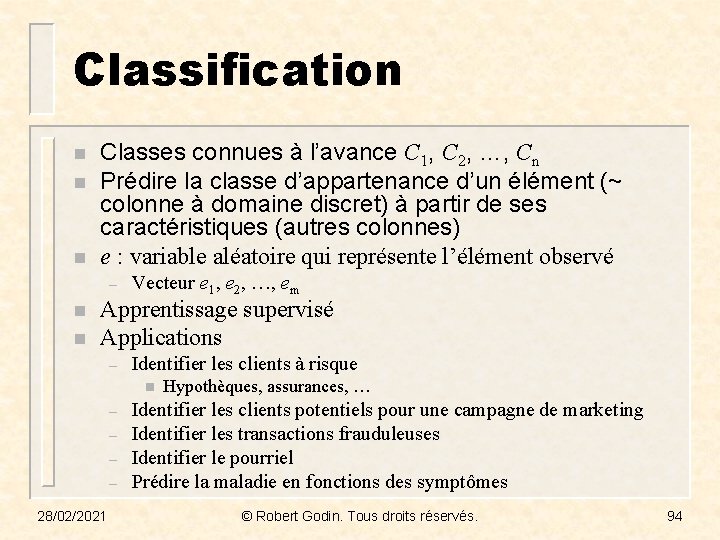

Classification n Classes connues à l’avance C 1, C 2, …, Cn Prédire la classe d’appartenance d’un élément (~ colonne à domaine discret) à partir de ses caractéristiques (autres colonnes) e : variable aléatoire qui représente l’élément observé – n n Vecteur e 1, e 2, …, em Apprentissage supervisé Applications – Identifier les clients à risque n – – 28/02/2021 Hypothèques, assurances, … Identifier les clients potentiels pour une campagne de marketing Identifier les transactions frauduleuses Identifier le pourriel Prédire la maladie en fonctions des symptômes © Robert Godin. Tous droits réservés. 94

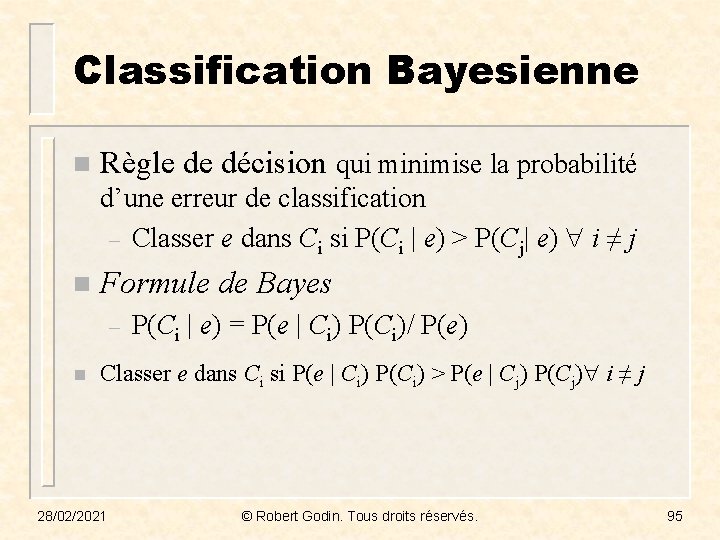

Classification Bayesienne n Règle de décision qui minimise la probabilité d’une erreur de classification – Classer e dans Ci si P(Ci | e) > P(Cj| e) i ≠ j n Formule de Bayes – n P(Ci | e) = P(e | Ci) P(Ci)/ P(e) Classer e dans Ci si P(e | Ci) P(Ci) > P(e | Cj) P(Cj) i ≠ j 28/02/2021 © Robert Godin. Tous droits réservés. 95

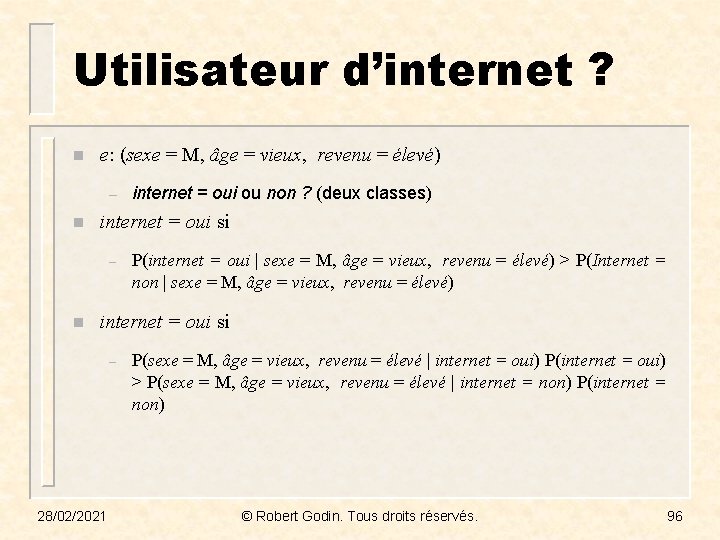

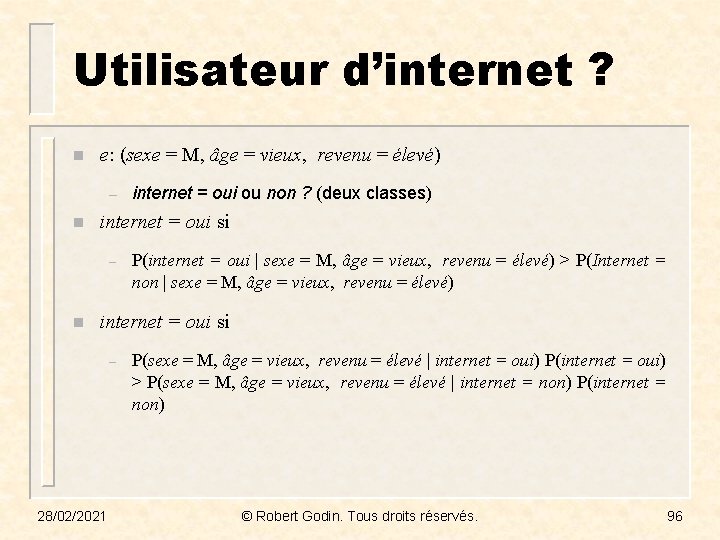

Utilisateur d’internet ? n e: (sexe = M, âge = vieux, revenu = élevé) – n internet = oui si – n internet = oui ou non ? (deux classes) P(internet = oui | sexe = M, âge = vieux, revenu = élevé) > P(Internet = non | sexe = M, âge = vieux, revenu = élevé) internet = oui si – 28/02/2021 P(sexe = M, âge = vieux, revenu = élevé | internet = oui) P(internet = oui) > P(sexe = M, âge = vieux, revenu = élevé | internet = non) P(internet = non) © Robert Godin. Tous droits réservés. 96

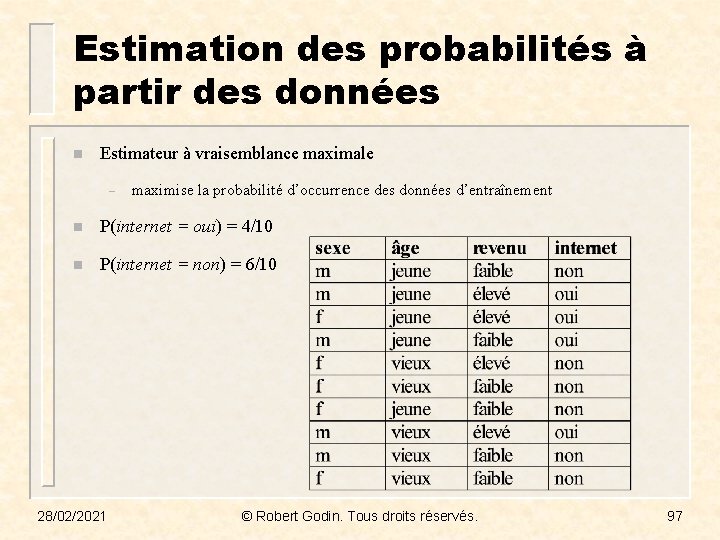

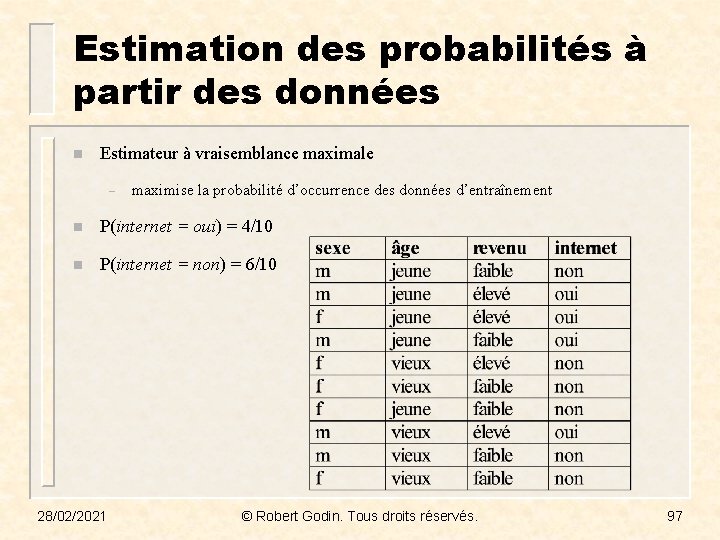

Estimation des probabilités à partir des données n Estimateur à vraisemblance maximale – maximise la probabilité d’occurrence des données d’entraînement n P(internet = oui) = 4/10 n P(internet = non) = 6/10 28/02/2021 © Robert Godin. Tous droits réservés. 97

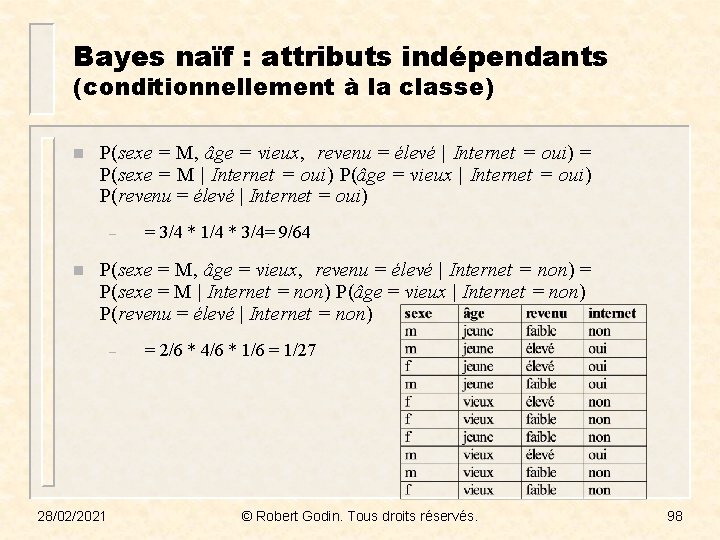

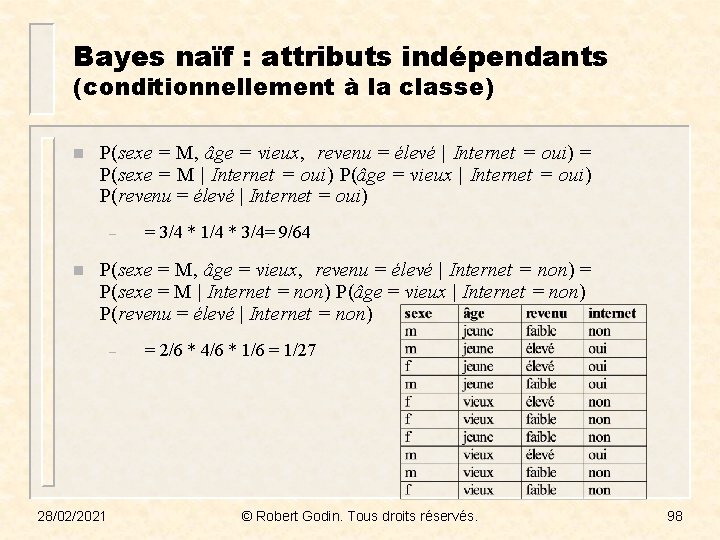

Bayes naïf : attributs indépendants (conditionnellement à la classe) n P(sexe = M, âge = vieux, revenu = élevé | Internet = oui) = P(sexe = M | Internet = oui) P(âge = vieux | Internet = oui) P(revenu = élevé | Internet = oui) – n = 3/4 * 1/4 * 3/4= 9/64 P(sexe = M, âge = vieux, revenu = élevé | Internet = non) = P(sexe = M | Internet = non) P(âge = vieux | Internet = non) P(revenu = élevé | Internet = non) – 28/02/2021 = 2/6 * 4/6 * 1/6 = 1/27 © Robert Godin. Tous droits réservés. 98

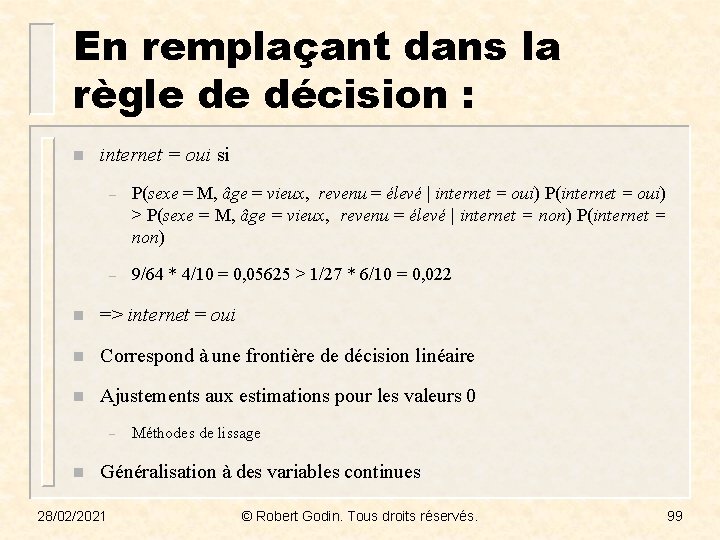

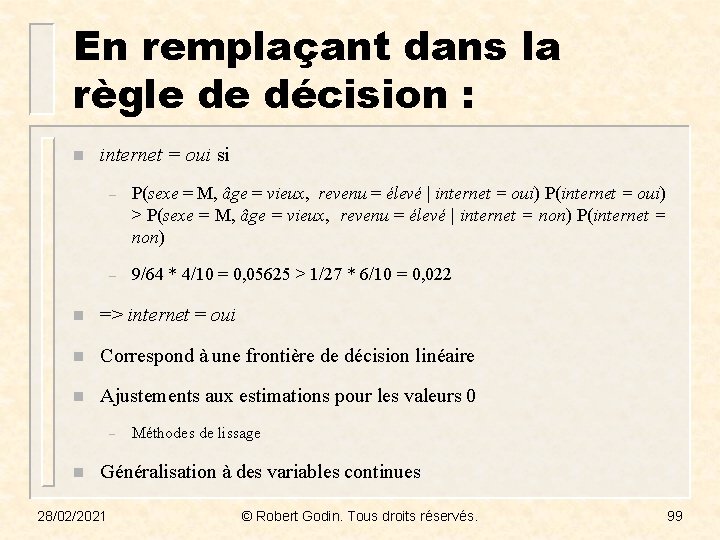

En remplaçant dans la règle de décision : n internet = oui si – P(sexe = M, âge = vieux, revenu = élevé | internet = oui) P(internet = oui) > P(sexe = M, âge = vieux, revenu = élevé | internet = non) P(internet = non) – 9/64 * 4/10 = 0, 05625 > 1/27 * 6/10 = 0, 022 n => internet = oui n Correspond à une frontière de décision linéaire n Ajustements aux estimations pour les valeurs 0 – n Méthodes de lissage Généralisation à des variables continues 28/02/2021 © Robert Godin. Tous droits réservés. 99

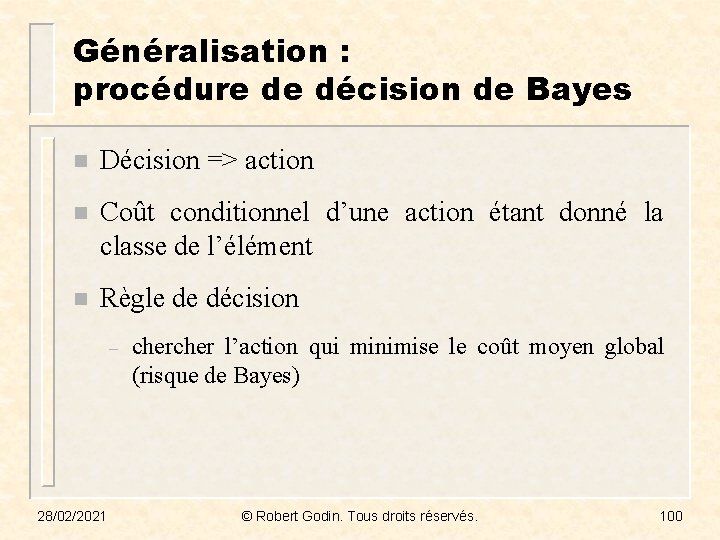

Généralisation : procédure de décision de Bayes n Décision => action n Coût conditionnel d’une action étant donné la classe de l’élément n Règle de décision – 28/02/2021 cher l’action qui minimise le coût moyen global (risque de Bayes) © Robert Godin. Tous droits réservés. 100

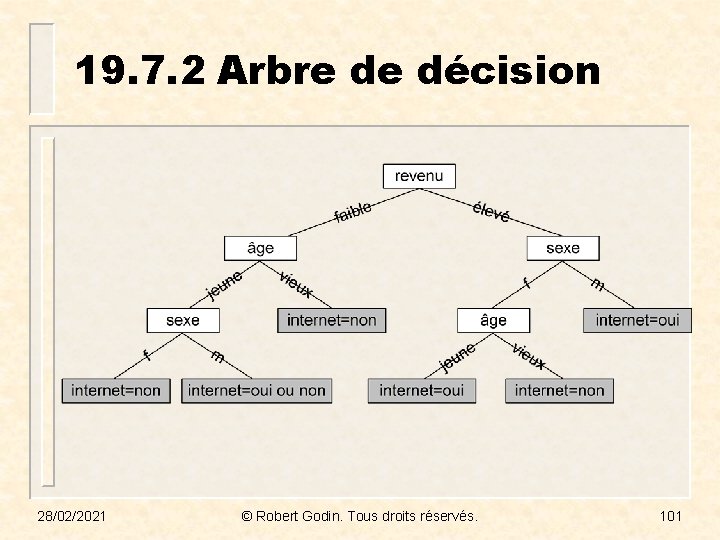

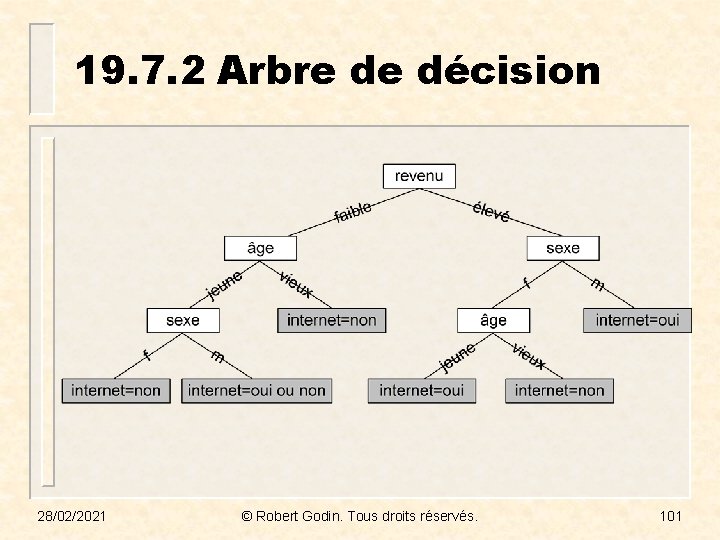

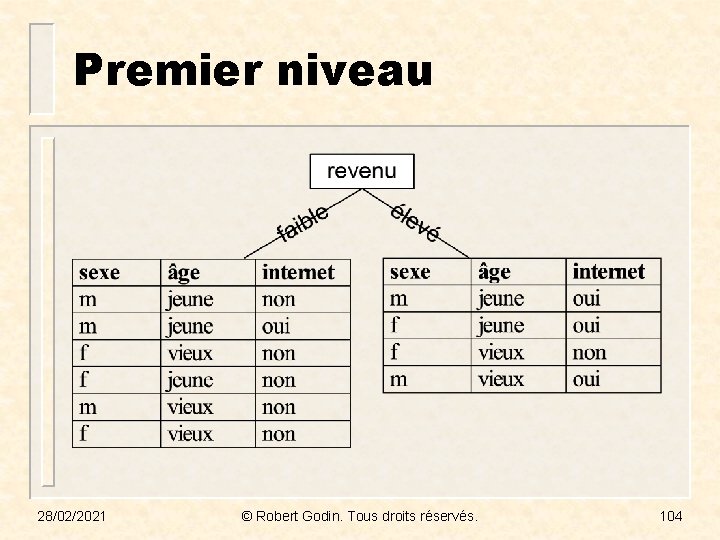

19. 7. 2 Arbre de décision 28/02/2021 © Robert Godin. Tous droits réservés. 101

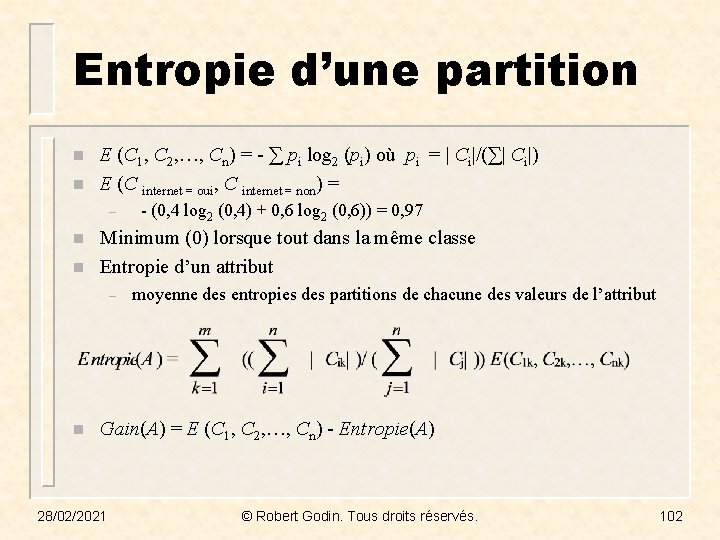

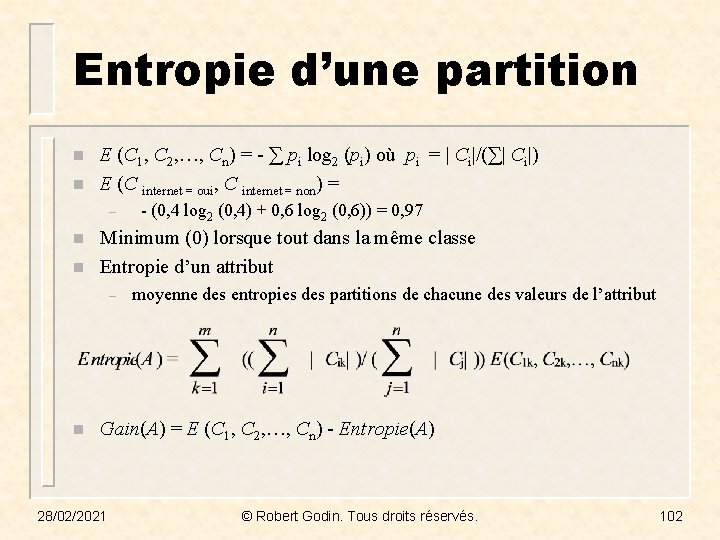

Entropie d’une partition n n E (C 1, C 2, …, Cn) = - ∑ pi log 2 (pi) où pi = | Ci|/(∑| Ci|) E (C internet = oui, C internet = non) = – n n Minimum (0) lorsque tout dans la même classe Entropie d’un attribut – n - (0, 4 log 2 (0, 4) + 0, 6 log 2 (0, 6)) = 0, 97 moyenne des entropies des partitions de chacune des valeurs de l’attribut Gain(A) = E (C 1, C 2, …, Cn) - Entropie(A) 28/02/2021 © Robert Godin. Tous droits réservés. 102

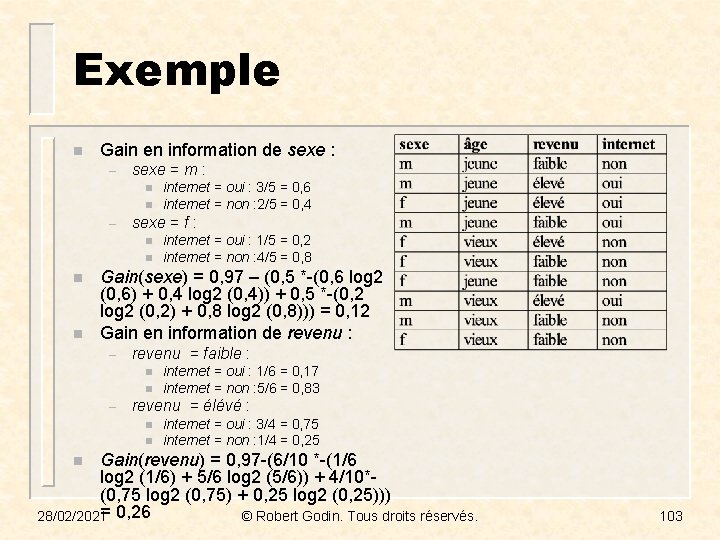

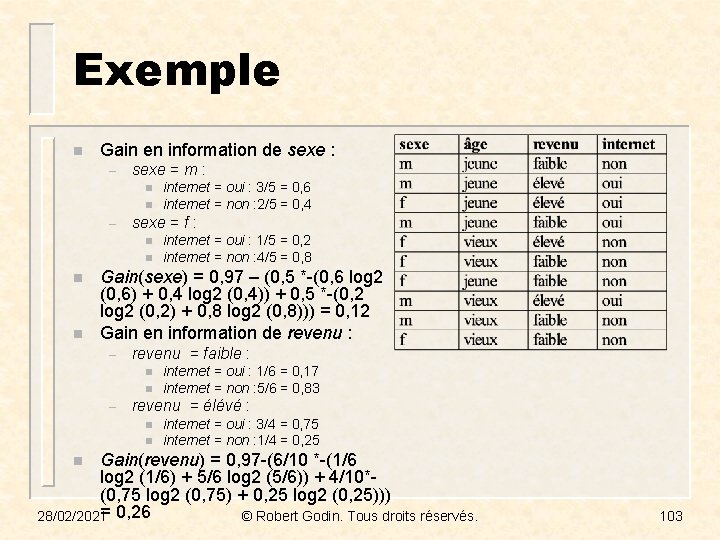

Exemple n Gain en information de sexe : – sexe = m : n n – sexe = f : n n internet = oui : 3/5 = 0, 6 internet = non : 2/5 = 0, 4 internet = oui : 1/5 = 0, 2 internet = non : 4/5 = 0, 8 Gain(sexe) = 0, 97 – (0, 5 *-(0, 6 log 2 (0, 6) + 0, 4 log 2 (0, 4)) + 0, 5 *-(0, 2 log 2 (0, 2) + 0, 8 log 2 (0, 8))) = 0, 12 Gain en information de revenu : – revenu = faible : n n – internet = oui : 1/6 = 0, 17 internet = non : 5/6 = 0, 83 revenu = élévé : n n internet = oui : 3/4 = 0, 75 internet = non : 1/4 = 0, 25 Gain(revenu) = 0, 97 -(6/10 *-(1/6 log 2 (1/6) + 5/6 log 2 (5/6)) + 4/10*(0, 75 log 2 (0, 75) + 0, 25 log 2 (0, 25))) = 0, 26 28/02/2021 © Robert Godin. Tous droits réservés. n 103

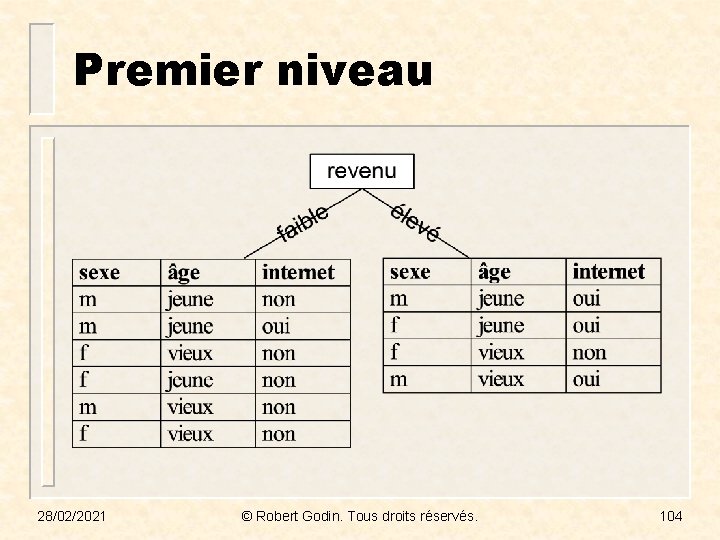

Premier niveau 28/02/2021 © Robert Godin. Tous droits réservés. 104

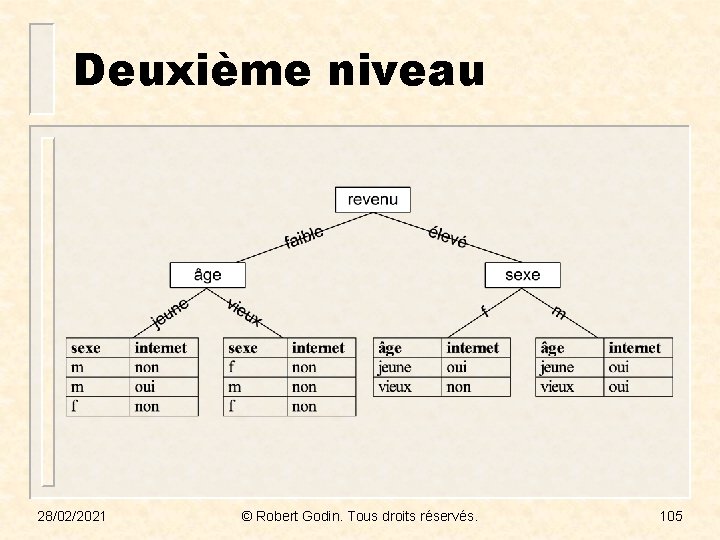

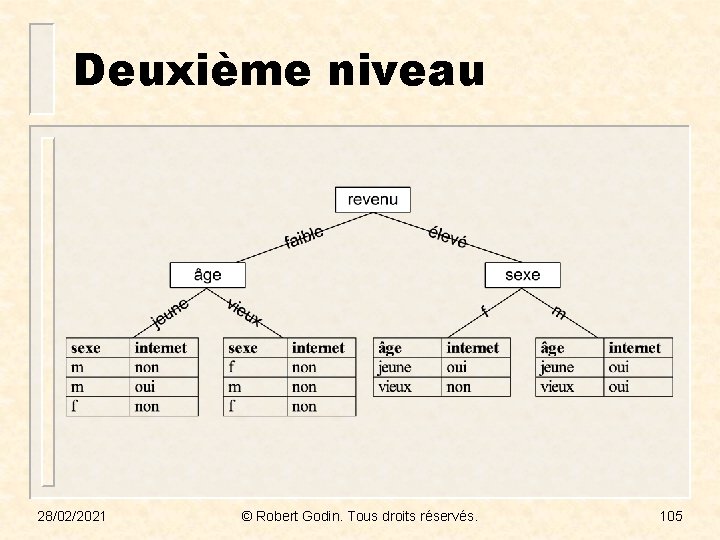

Deuxième niveau 28/02/2021 © Robert Godin. Tous droits réservés. 105

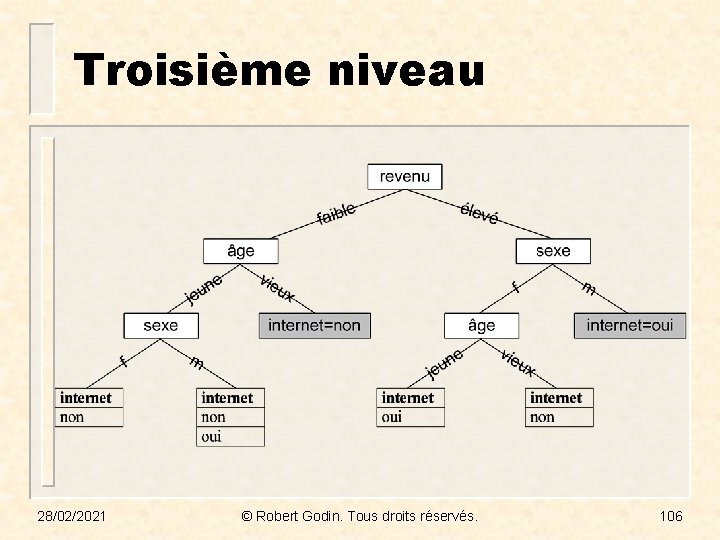

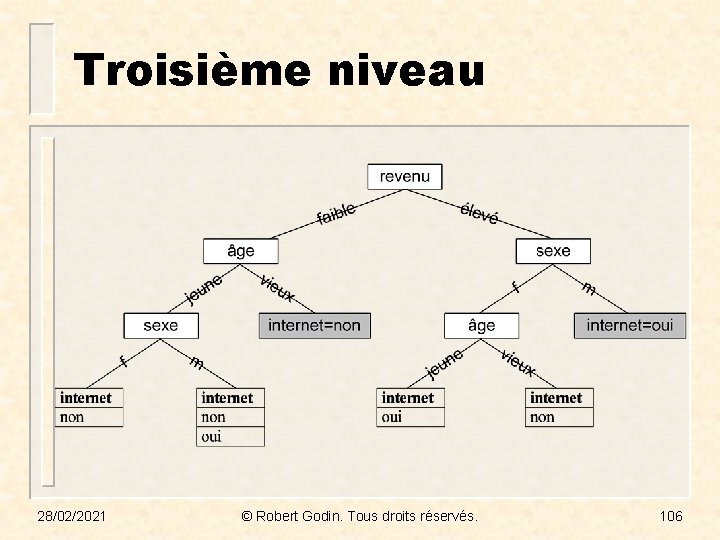

Troisième niveau 28/02/2021 © Robert Godin. Tous droits réservés. 106

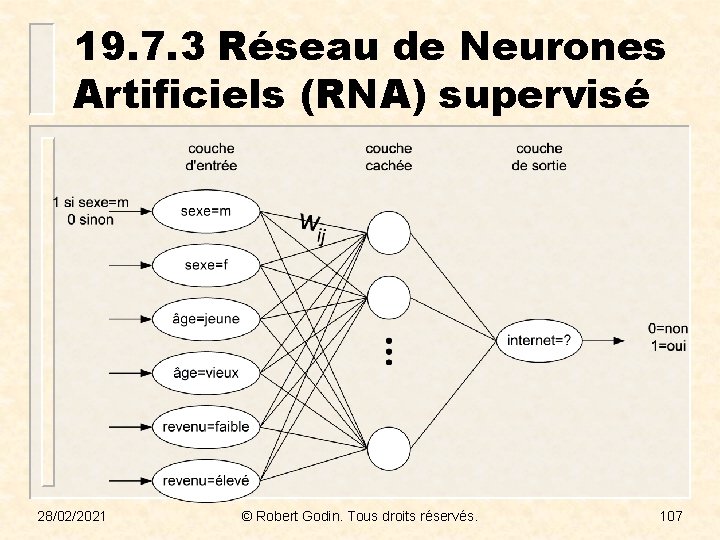

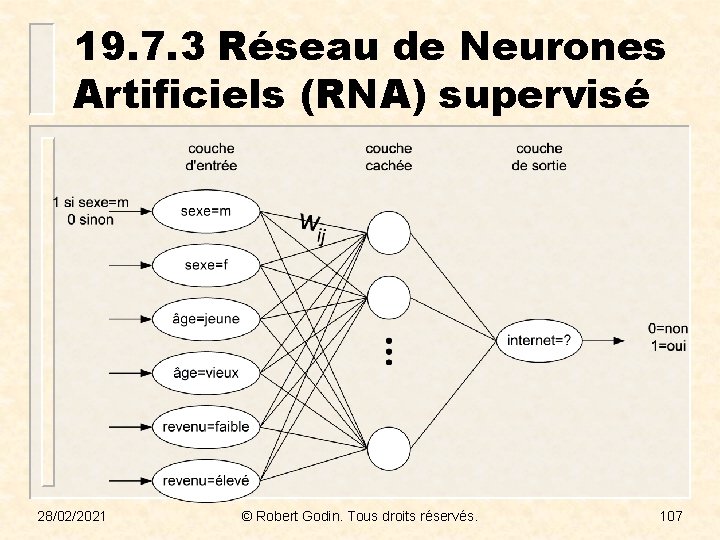

19. 7. 3 Réseau de Neurones Artificiels (RNA) supervisé 28/02/2021 © Robert Godin. Tous droits réservés. 107

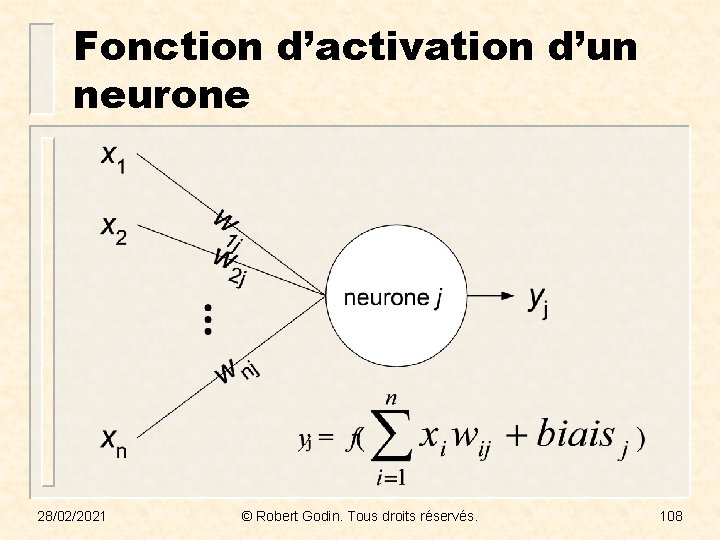

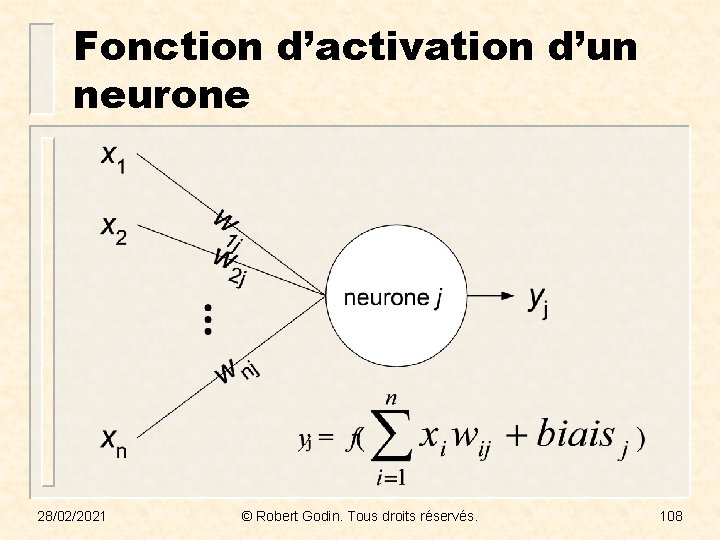

Fonction d’activation d’un neurone 28/02/2021 © Robert Godin. Tous droits réservés. 108

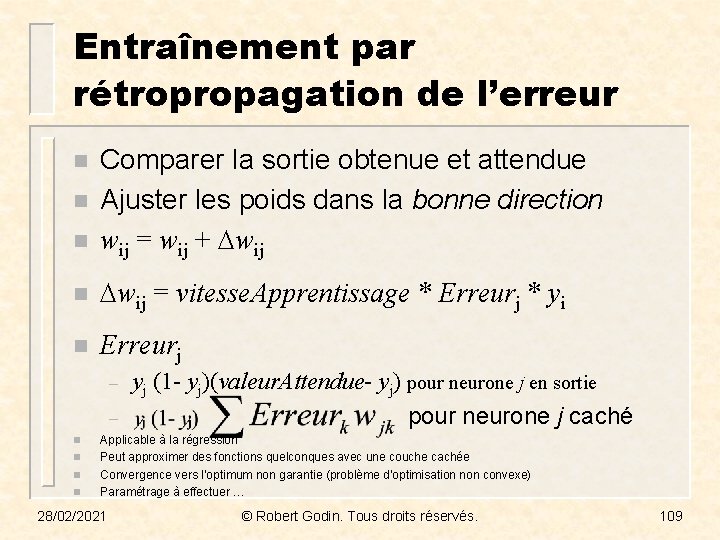

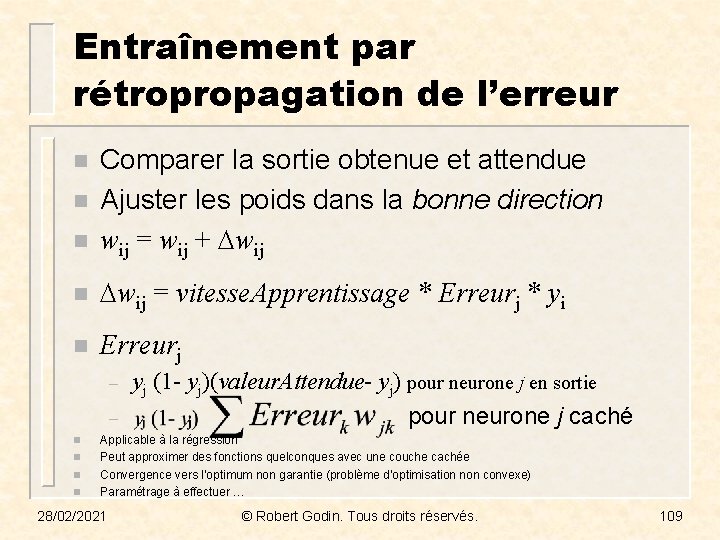

Entraînement par rétropropagation de l’erreur n Comparer la sortie obtenue et attendue Ajuster les poids dans la bonne direction wij = wij + wij n wij = vitesse. Apprentissage * Erreurj * yi n Erreurj n n – – n n yj (1 - yj)(valeur. Attendue- yj) pour neurone j en sortie pour neurone j caché Applicable à la régression Peut approximer des fonctions quelconques avec une couche cachée Convergence vers l’optimum non garantie (problème d’optimisation non convexe) Paramétrage à effectuer … 28/02/2021 © Robert Godin. Tous droits réservés. 109

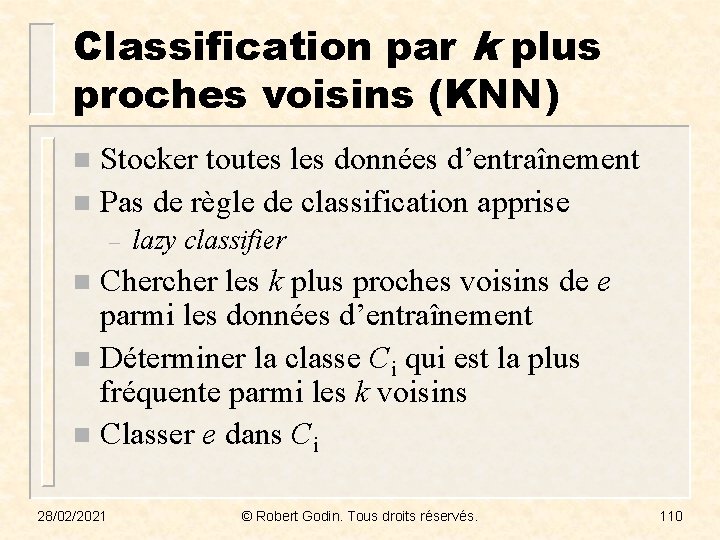

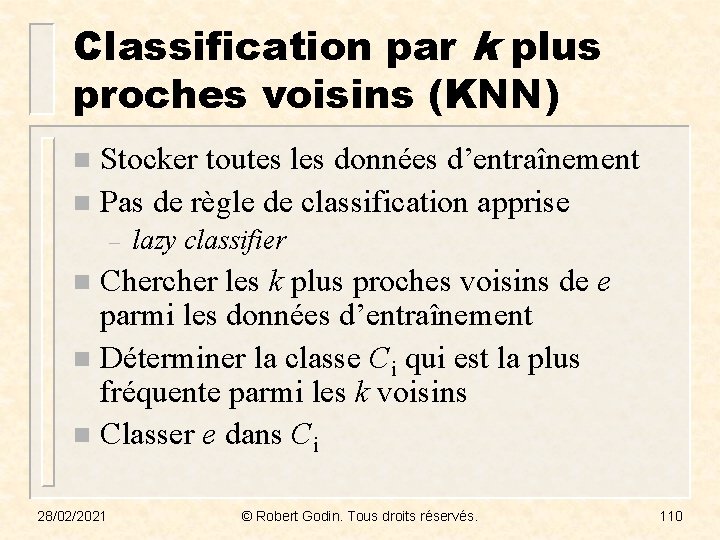

Classification par k plus proches voisins (KNN) Stocker toutes les données d’entraînement n Pas de règle de classification apprise n – lazy classifier Chercher les k plus proches voisins de e parmi les données d’entraînement n Déterminer la classe Ci qui est la plus fréquente parmi les k voisins n Classer e dans Ci n 28/02/2021 © Robert Godin. Tous droits réservés. 110

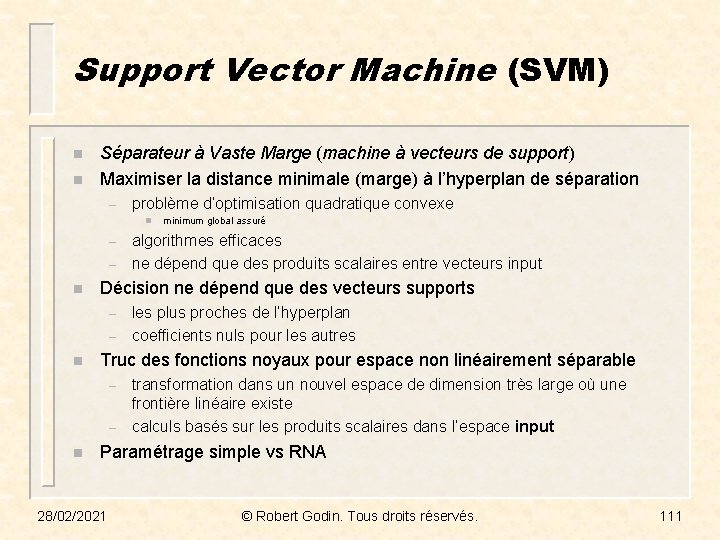

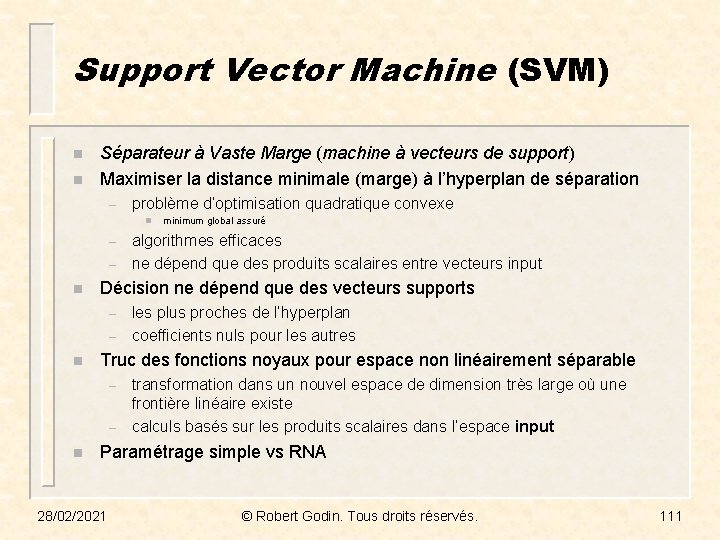

Support Vector Machine (SVM) n n Séparateur à Vaste Marge (machine à vecteurs de support) Maximiser la distance minimale (marge) à l’hyperplan de séparation – problème d’optimisation quadratique convexe n – – n – les plus proches de l’hyperplan coefficients nuls pour les autres Truc des fonctions noyaux pour espace non linéairement séparable – – n algorithmes efficaces ne dépend que des produits scalaires entre vecteurs input Décision ne dépend que des vecteurs supports – n minimum global assuré transformation dans un nouvel espace de dimension très large où une frontière linéaire existe calculs basés sur les produits scalaires dans l’espace input Paramétrage simple vs RNA 28/02/2021 © Robert Godin. Tous droits réservés. 111

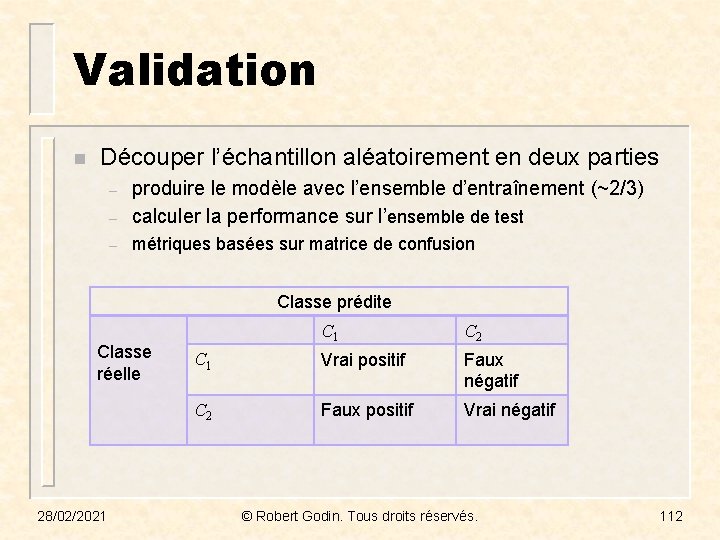

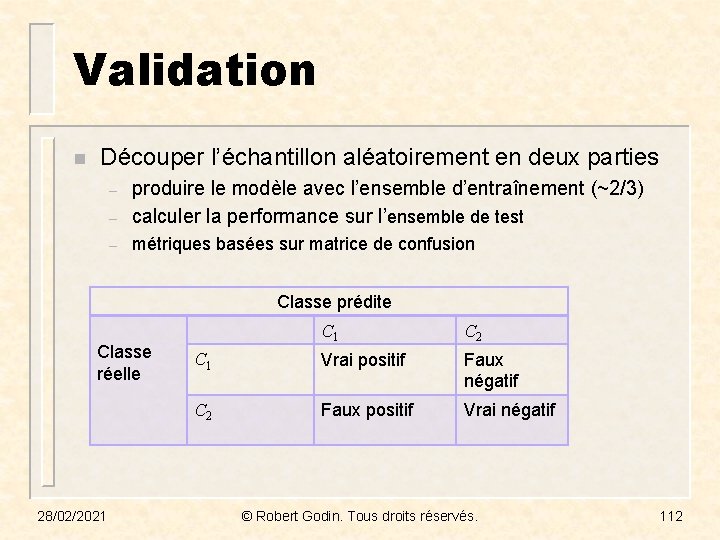

Validation n Découper l’échantillon aléatoirement en deux parties – produire le modèle avec l’ensemble d’entraînement (~2/3) calculer la performance sur l’ensemble de test – métriques basées sur matrice de confusion – Classe prédite Classe réelle 28/02/2021 C 2 C 1 Vrai positif Faux négatif C 2 Faux positif Vrai négatif © Robert Godin. Tous droits réservés. 112

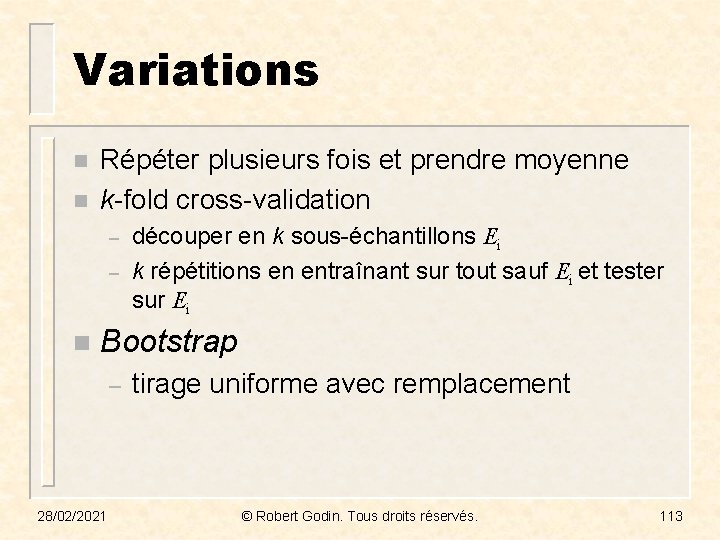

Variations n n Répéter plusieurs fois et prendre moyenne k-fold cross-validation – – n découper en k sous-échantillons Ei k répétitions en entraînant sur tout sauf Ei et tester sur Ei Bootstrap – 28/02/2021 tirage uniforme avec remplacement © Robert Godin. Tous droits réservés. 113

Combinaison de modèles Pas de meilleure méthode dans tous les cas n Combinaison de méthode peut être meilleure n – – méthode d’ensemble plusieurs modèles ajustés sur des portions de l’échantillon et combinés n bootstrap – 28/02/2021 aggregating (bagging) boosting : surpondérer les cas les plus difficiles dans les passes subséquentes © Robert Godin. Tous droits réservés. 114

Régression n n Trouver une fonction qui produit le bon résultat y = f(X) – n Régression linéaire : f = a 0+a 1 x 1+a 2 x 2 +. . . +an xn – n estimer les paramètres ai de manière à minimiser l’erreur pour les données d’entrainement Régression applicable à la classification – n y régression logistique Séries chronologiques – – 28/02/2021 xn = f(xn-1, xn-2, … ) auto-régression © Robert Godin. Tous droits réservés. 115