formalnie Zastosowanie sieci neuronowych do wspomagania decyzji biznesowych

formalnie: Zastosowanie sieci neuronowych do wspomagania decyzji biznesowych Dorota Cendrowska dc@pjwstk. edu. pl nieformalnie: Wspomaganie decyzji nie zwalnia od decyzji. . .

Plan wykładu z Zastosowania sieci neuronowych: ¥ klasyfikacja ¥ aproksymacja ¥ prognozowanie ¥ filtrowanie ¥ asocjacje ¥ grupowanie

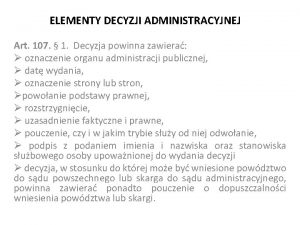

zagadnienie klasyfikacji z wymagania: ¥ znane kategorie ¥ zbiór uczący (reprezentatywny) z decyzja do podjęcia: ¥ kodowanie wyjścia z stosowane sieci: ¥ jednokierunkowe sieci neuronowe z przykład: ¥ klasyfikacja formacji giełdowych

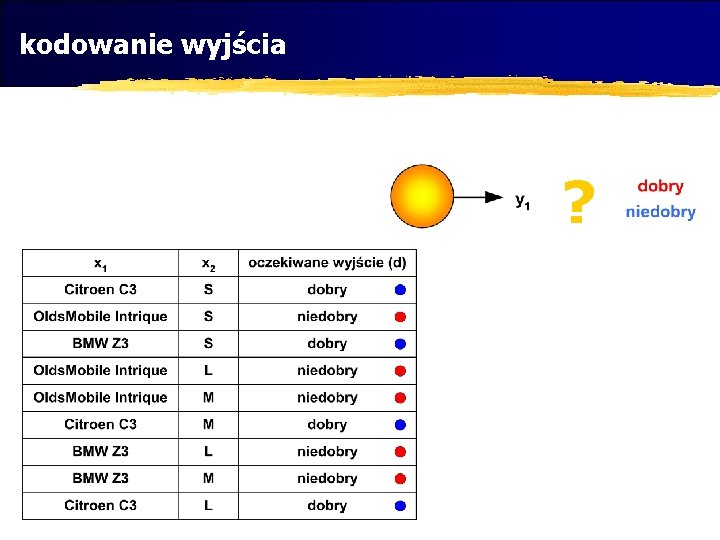

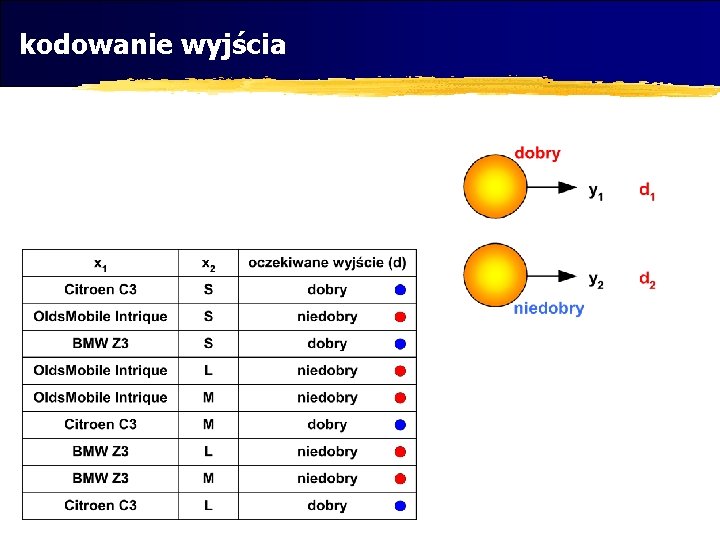

kodowanie wyjścia ?

kodowanie wyjścia

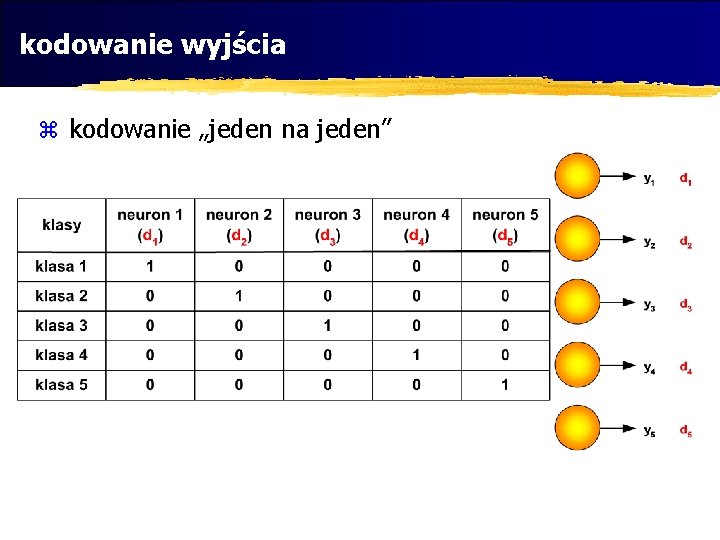

kodowanie wyjścia z kodowanie „jeden na jeden”

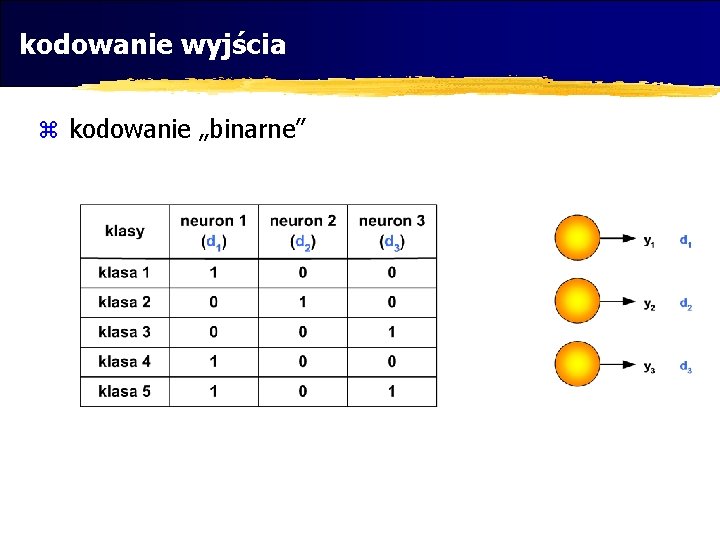

kodowanie wyjścia z kodowanie „binarne”

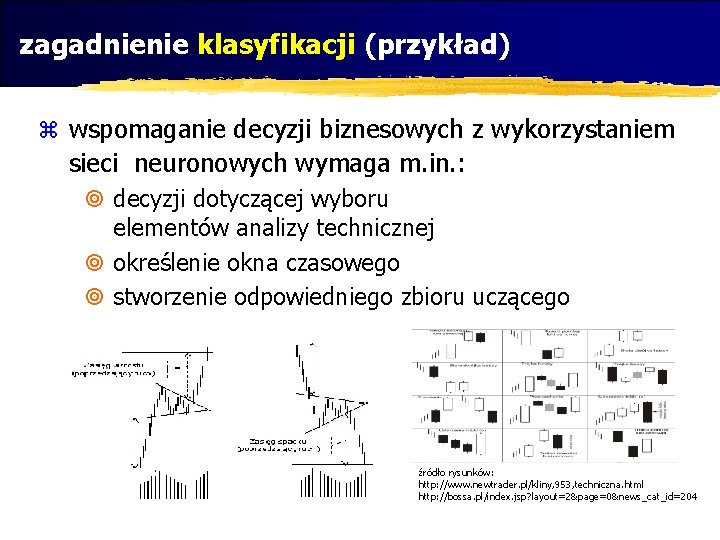

zagadnienie klasyfikacji (przykład) z wspomaganie decyzji biznesowych z wykorzystaniem sieci neuronowych wymaga m. in. : ¥ decyzji dotyczącej wyboru elementów analizy technicznej ¥ określenie okna czasowego ¥ stworzenie odpowiedniego zbioru uczącego źródło rysunków: http: //www. newtrader. pl/kliny, 953, techniczna. html http: //bossa. pl/index. jsp? layout=2&page=0&news_cat_id=204

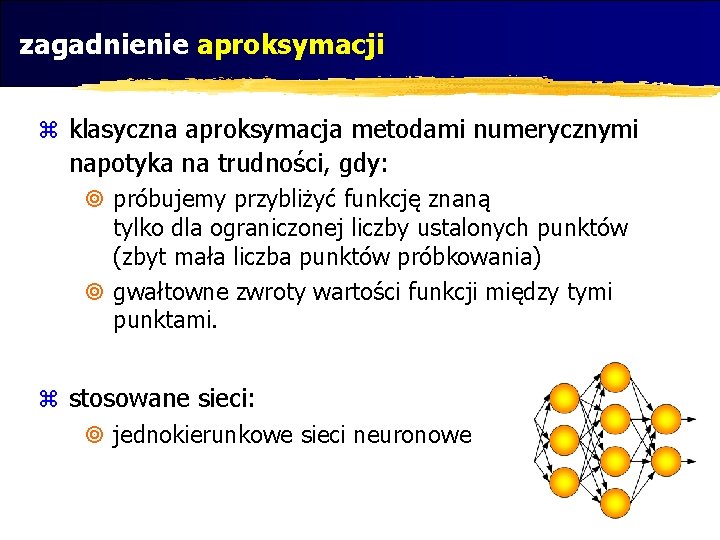

zagadnienie aproksymacji z klasyczna aproksymacja metodami numerycznymi napotyka na trudności, gdy: ¥ próbujemy przybliżyć funkcję znaną tylko dla ograniczonej liczby ustalonych punktów (zbyt mała liczba punktów próbkowania) ¥ gwałtowne zwroty wartości funkcji między tymi punktami. z stosowane sieci: ¥ jednokierunkowe sieci neuronowe

zagadnienie prognozowania z prognozowanie jako szczególny rodzaj aproksymacji z stosowane sieci: ¥ jednokierunkowe sieci neuronowe z przykład: ¥ prognozowanie notowań giełdowych

zagadnienie prognozowania (przykład) z wspomaganie decyzji biznesowych z wykorzystaniem sieci neuronowych wymaga m. in. : ¥ decyzji dotyczącej wyboru szeregu czasowego ¥ liczby punktów z przeszłości (opóźnień) ¥ liczby punktów z przyszłości (np. prognozowanie na podstawie danych miesięcznych tego, co będzie się działo za rok) z w przypadku notowań giełdowych: ¥ określenie okna czasowego ¥ eliminacja trendu

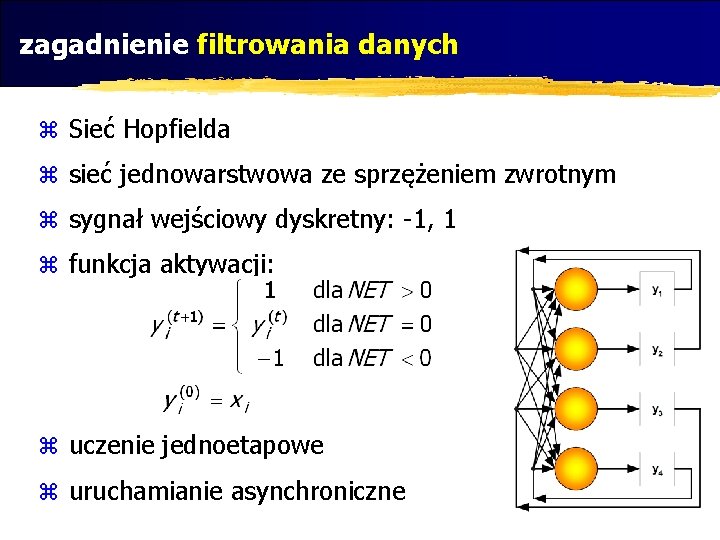

zagadnienie filtrowania danych z Sieć Hopfielda z sieć jednowarstwowa ze sprzężeniem zwrotnym z sygnał wejściowy dyskretny: -1, 1 z funkcja aktywacji: z uczenie jednoetapowe z uruchamianie asynchroniczne

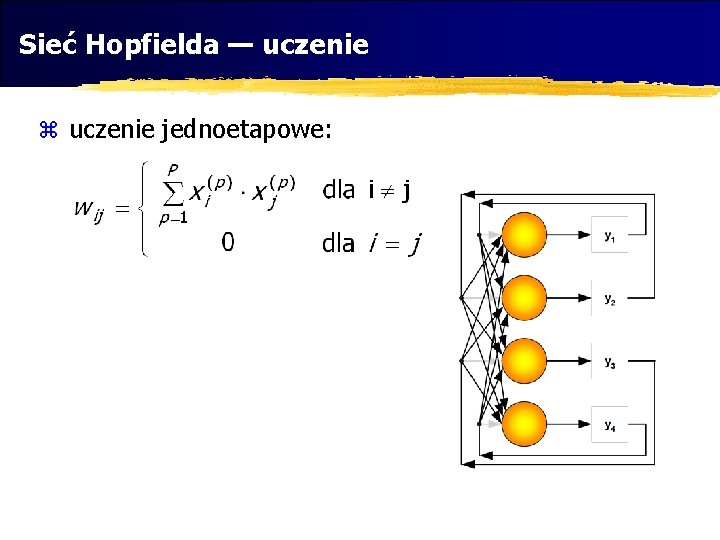

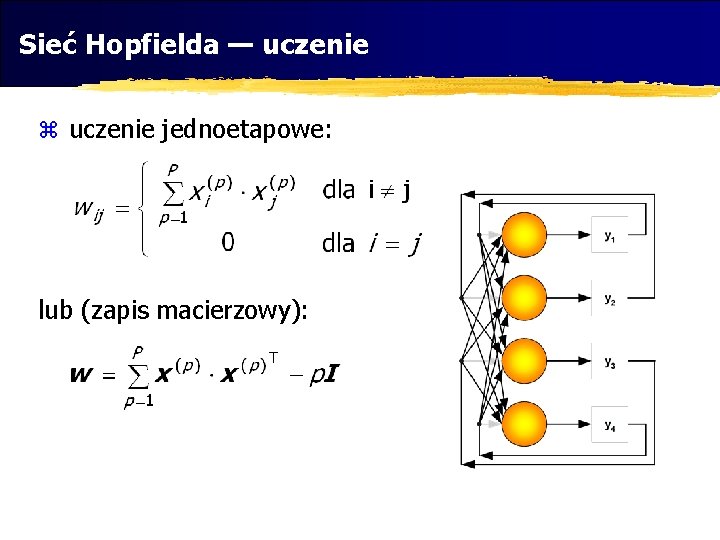

Sieć Hopfielda — uczenie z uczenie jednoetapowe:

Sieć Hopfielda — uczenie z uczenie jednoetapowe: lub (zapis macierzowy):

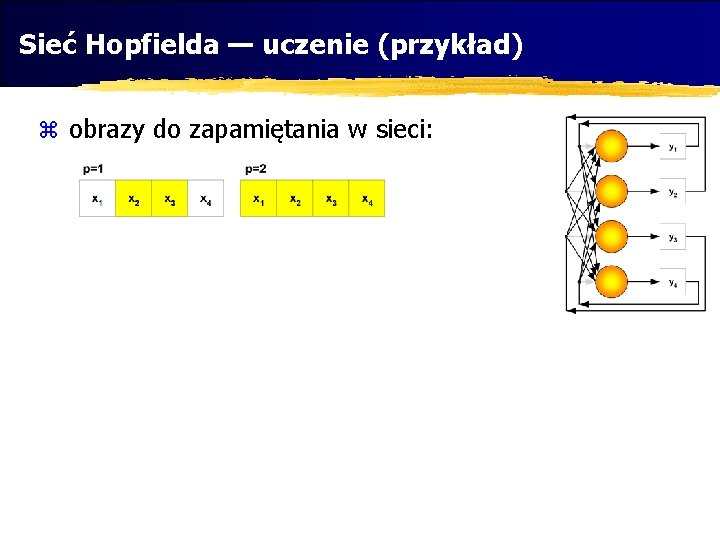

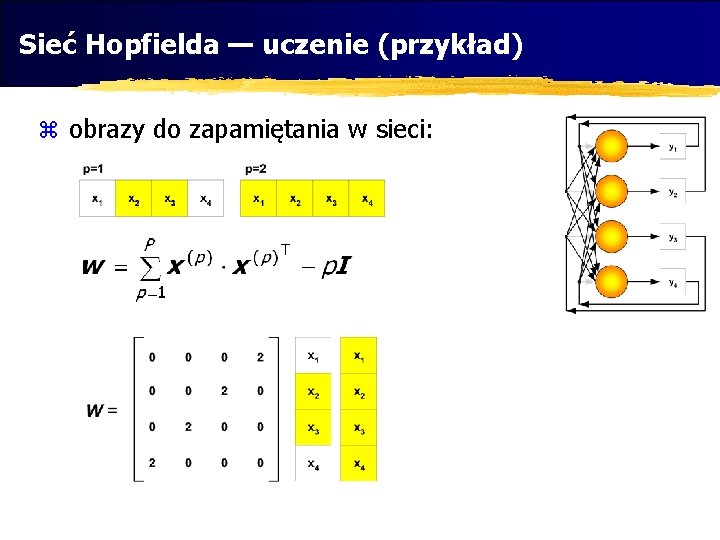

Sieć Hopfielda — uczenie (przykład) z obrazy do zapamiętania w sieci:

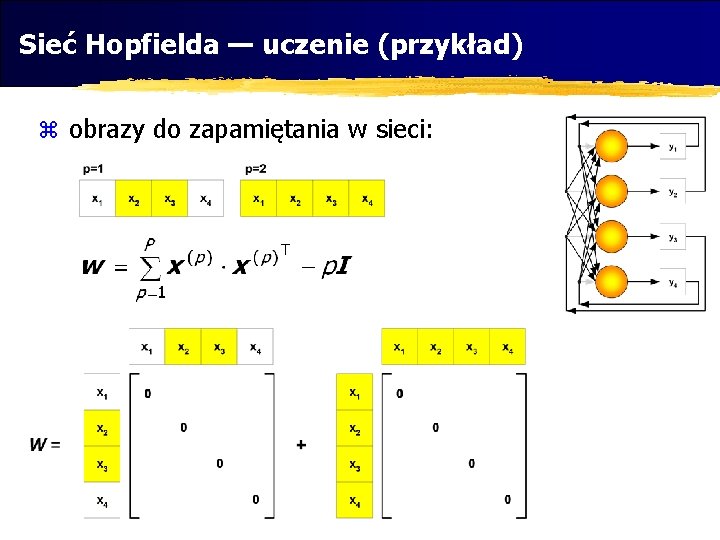

Sieć Hopfielda — uczenie (przykład) z obrazy do zapamiętania w sieci:

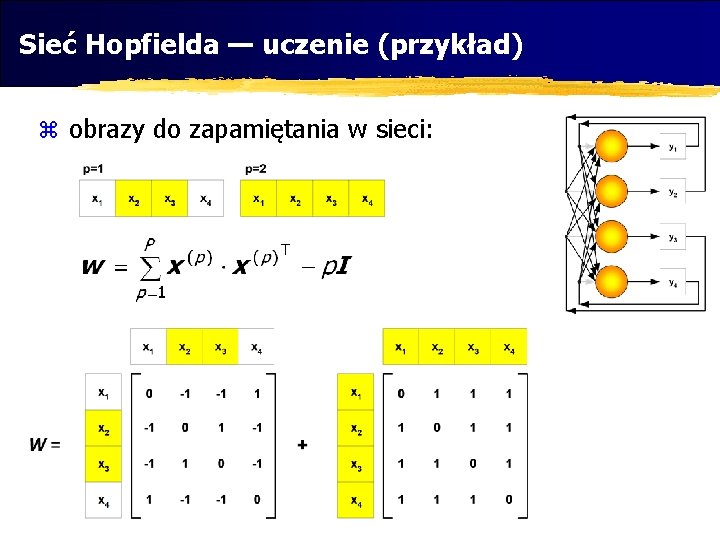

Sieć Hopfielda — uczenie (przykład) z obrazy do zapamiętania w sieci:

Sieć Hopfielda — uczenie (przykład) z obrazy do zapamiętania w sieci:

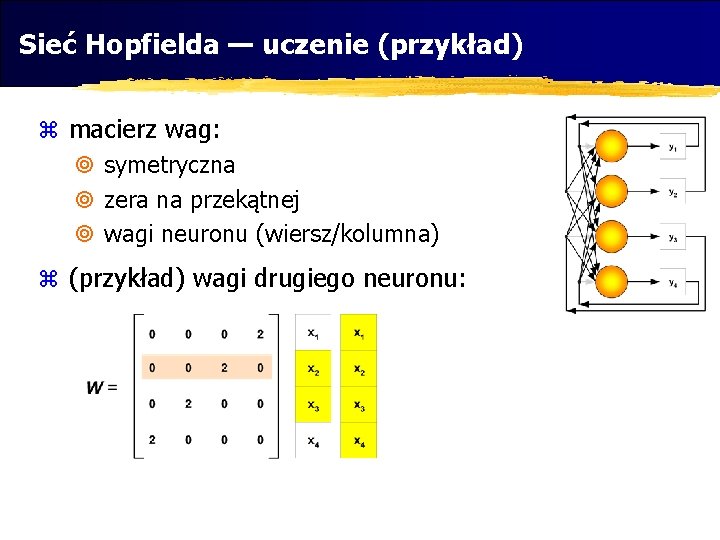

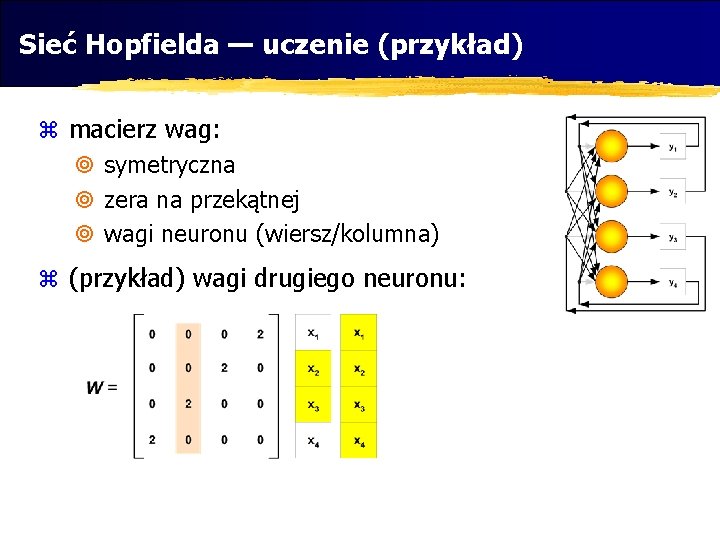

Sieć Hopfielda — uczenie (przykład) z macierz wag: ¥ symetryczna ¥ zera na przekątnej ¥ wagi neuronu (wiersz/kolumna) z (przykład) wagi drugiego neuronu:

Sieć Hopfielda — uczenie (przykład) z macierz wag: ¥ symetryczna ¥ zera na przekątnej ¥ wagi neuronu (wiersz/kolumna) z (przykład) wagi drugiego neuronu:

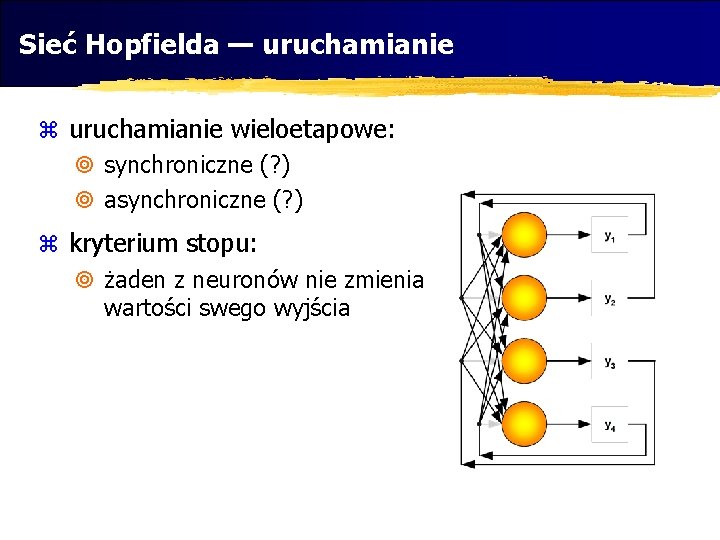

Sieć Hopfielda — uruchamianie z uruchamianie wieloetapowe: ¥ synchroniczne (? ) ¥ asynchroniczne (? ) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia

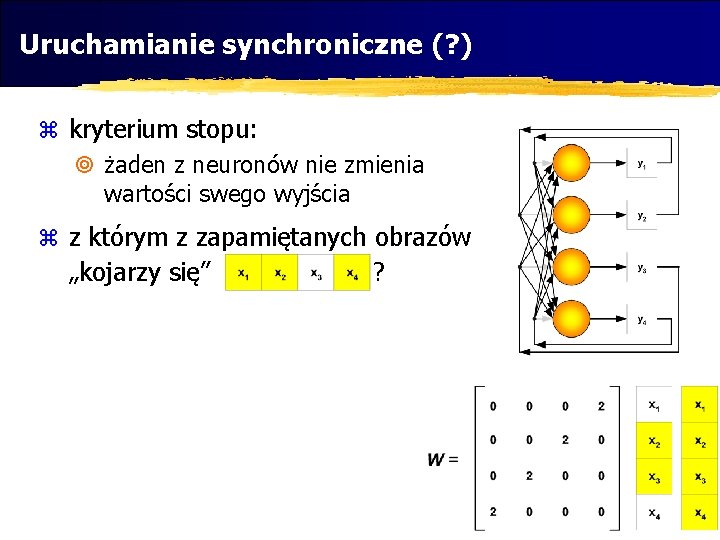

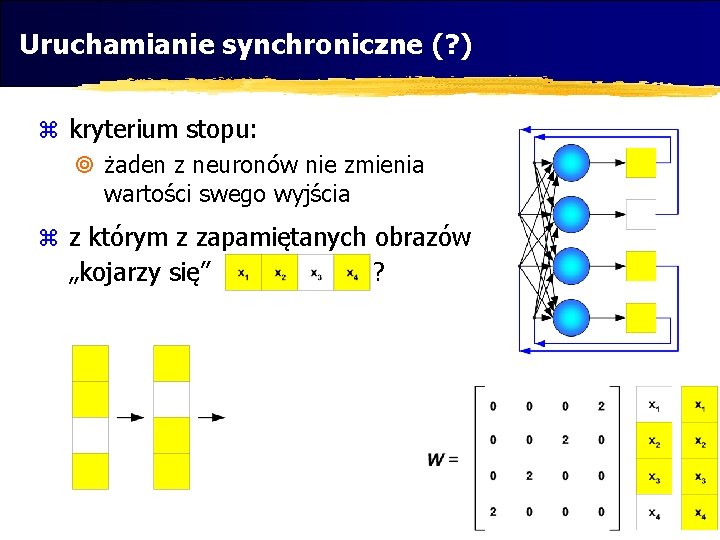

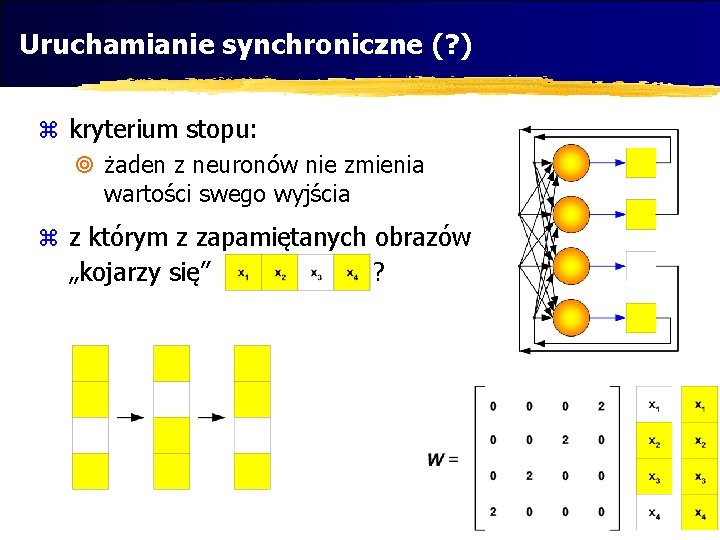

Uruchamianie synchroniczne (? ) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z z którym z zapamiętanych obrazów „kojarzy się” ?

Uruchamianie synchroniczne (? ) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z z którym z zapamiętanych obrazów „kojarzy się” ?

Uruchamianie synchroniczne (? ) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z z którym z zapamiętanych obrazów „kojarzy się” ?

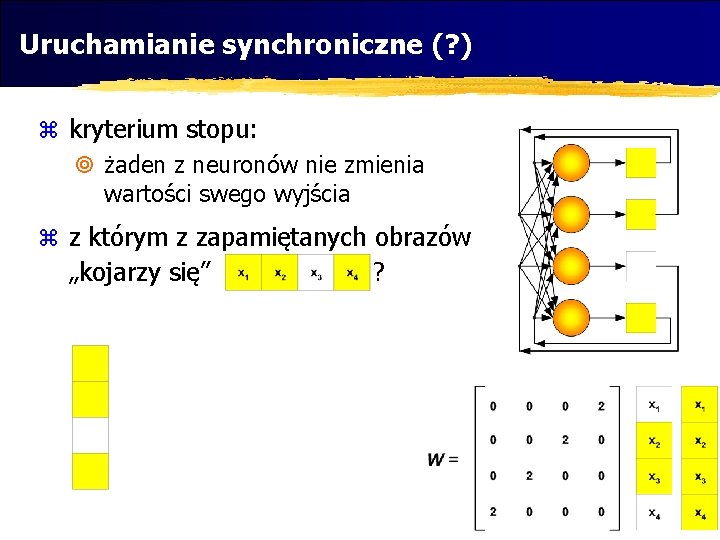

Uruchamianie synchroniczne (? ) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z z którym z zapamiętanych obrazów „kojarzy się” ?

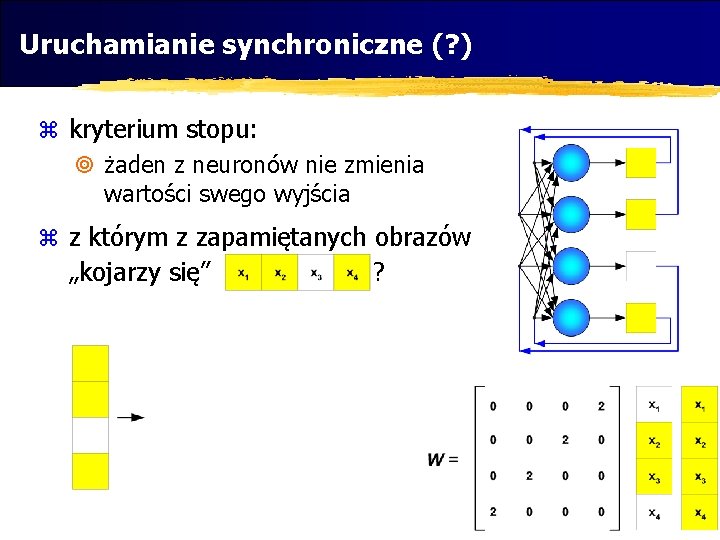

Uruchamianie synchroniczne (? ) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z z którym z zapamiętanych obrazów „kojarzy się” ?

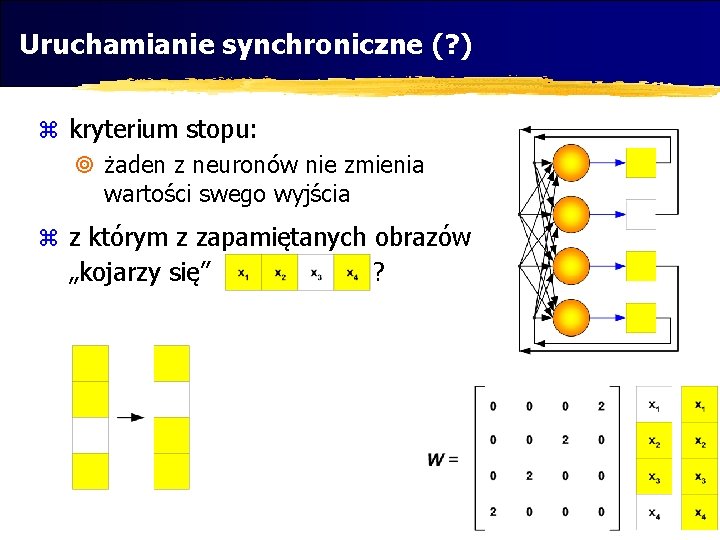

Uruchamianie synchroniczne (? ) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z z którym z zapamiętanych obrazów „kojarzy się” ?

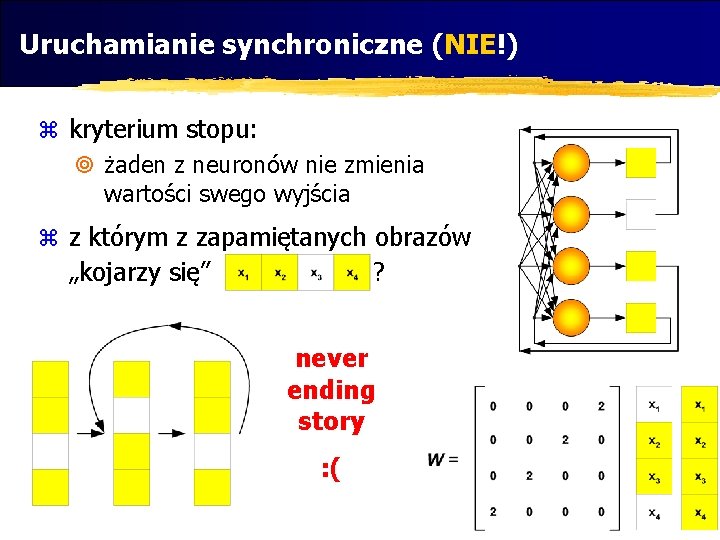

Uruchamianie synchroniczne (NIE!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z z którym z zapamiętanych obrazów „kojarzy się” ? never ending story : (

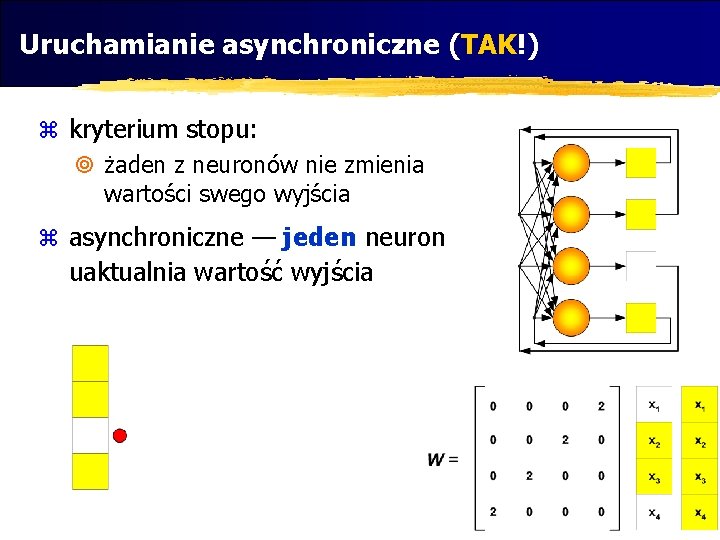

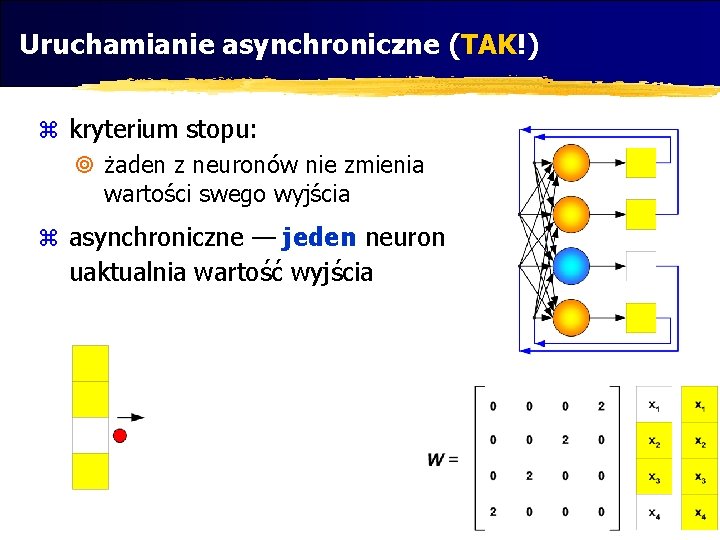

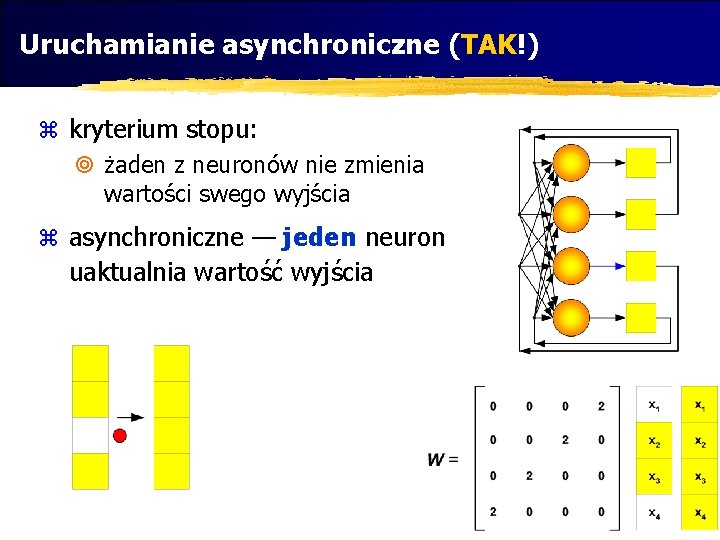

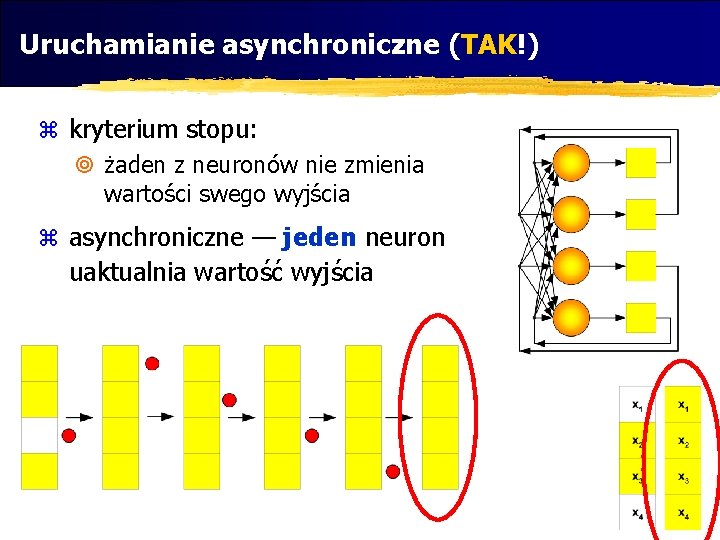

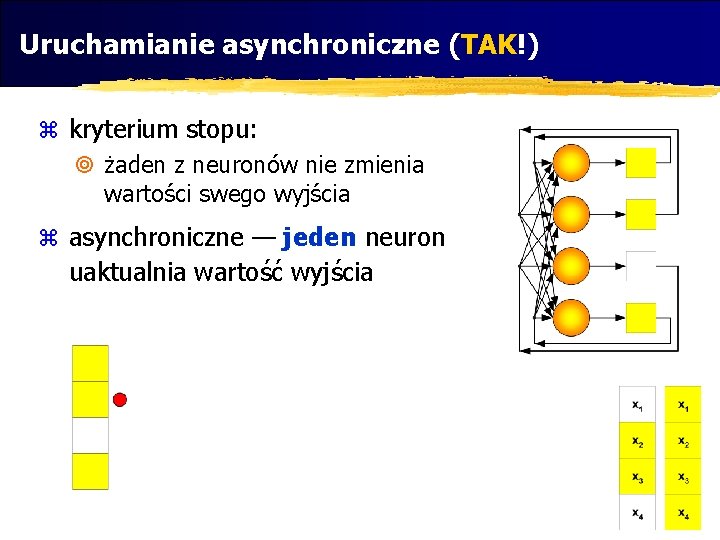

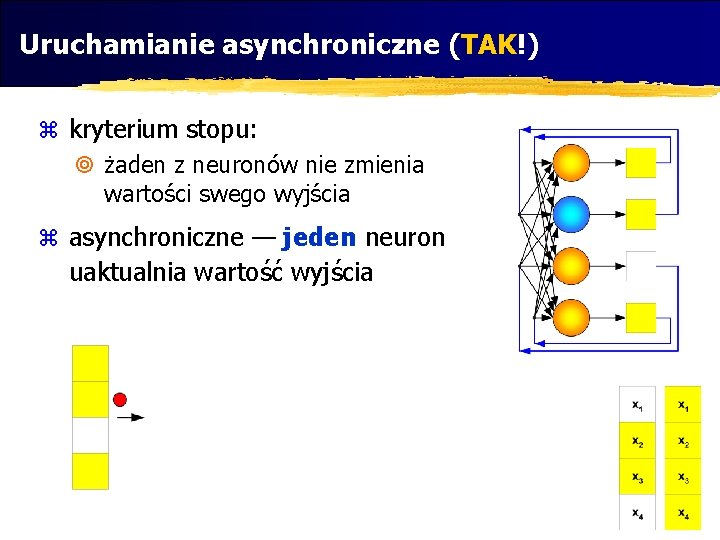

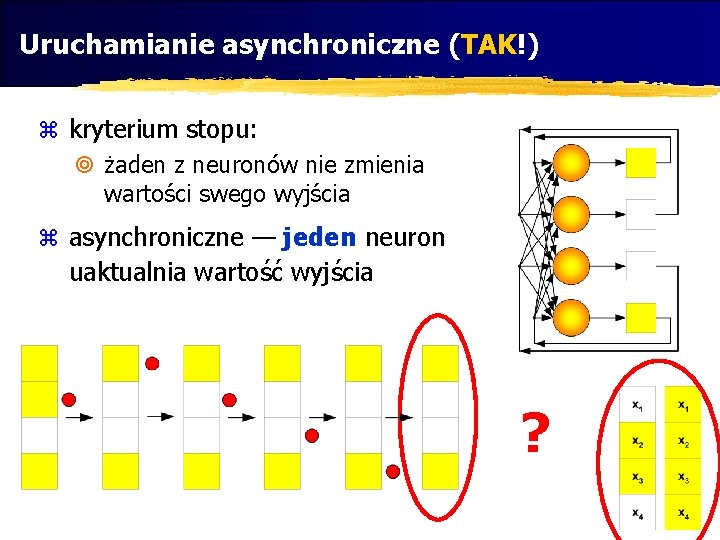

Uruchamianie asynchroniczne (TAK!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z asynchroniczne — jeden neuron uaktualnia wartość wyjścia

Uruchamianie asynchroniczne (TAK!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z asynchroniczne — jeden neuron uaktualnia wartość wyjścia

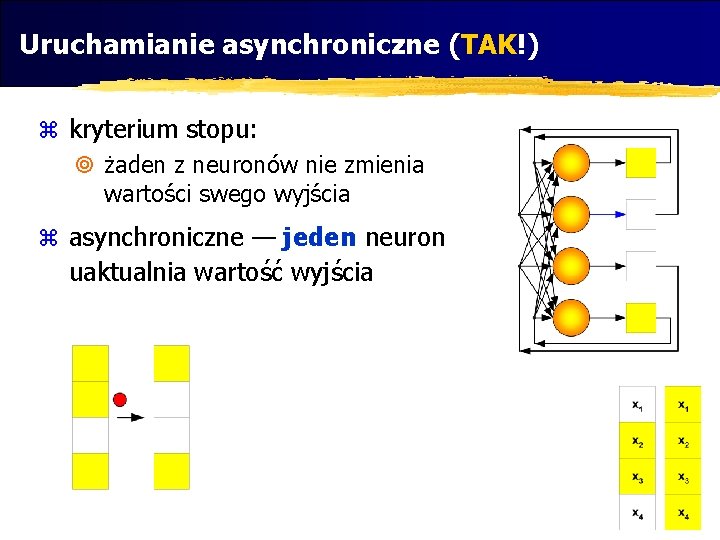

Uruchamianie asynchroniczne (TAK!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z asynchroniczne — jeden neuron uaktualnia wartość wyjścia

Uruchamianie asynchroniczne (TAK!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z asynchroniczne — jeden neuron uaktualnia wartość wyjścia

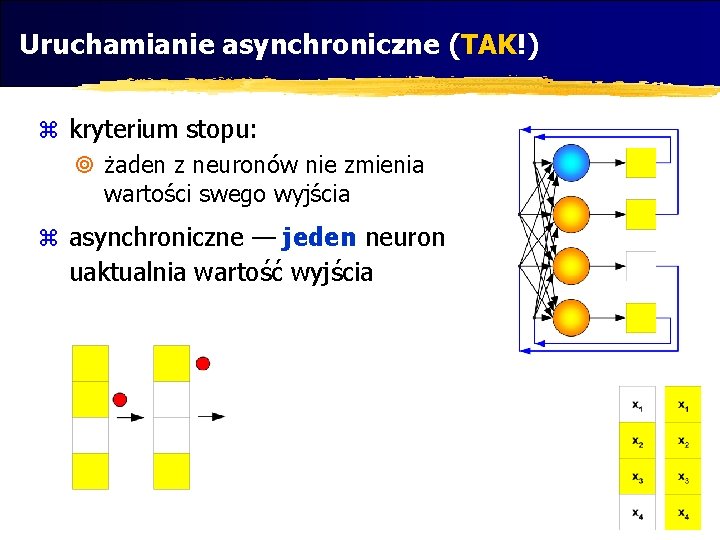

Uruchamianie asynchroniczne (TAK!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z asynchroniczne — jeden neuron uaktualnia wartość wyjścia

Uruchamianie asynchroniczne (TAK!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z asynchroniczne — jeden neuron uaktualnia wartość wyjścia

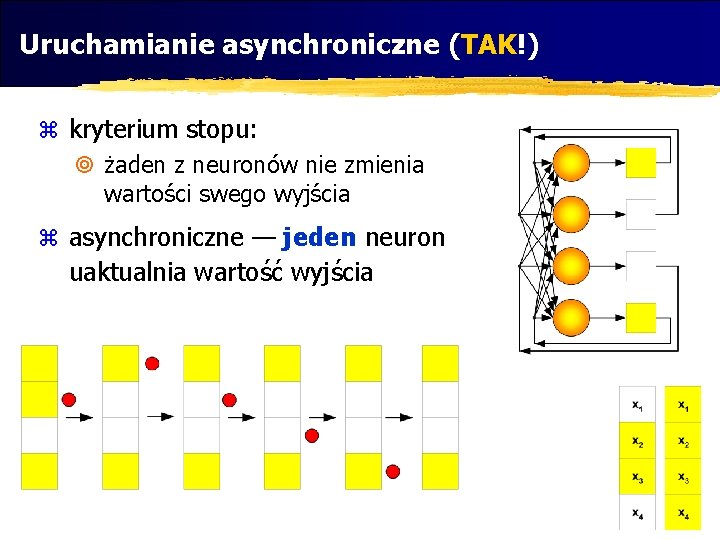

Uruchamianie asynchroniczne (TAK!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z asynchroniczne — jeden neuron uaktualnia wartość wyjścia

Uruchamianie asynchroniczne (TAK!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z asynchroniczne — jeden neuron uaktualnia wartość wyjścia

Uruchamianie asynchroniczne (TAK!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z asynchroniczne — jeden neuron uaktualnia wartość wyjścia

Uruchamianie asynchroniczne (TAK!) z kryterium stopu: ¥ żaden z neuronów nie zmienia wartości swego wyjścia z asynchroniczne — jeden neuron uaktualnia wartość wyjścia ?

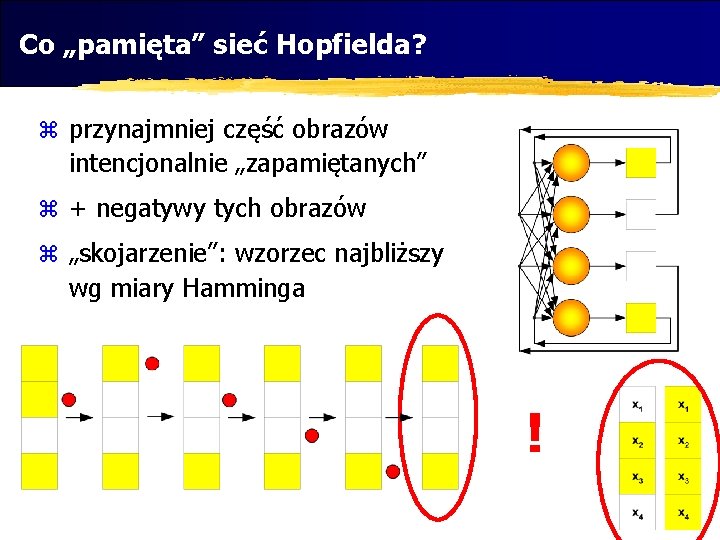

Co „pamięta” sieć Hopfielda? z przynajmniej część obrazów intencjonalnie „zapamiętanych” z + negatywy tych obrazów z „skojarzenie”: wzorzec najbliższy wg miary Hamminga !

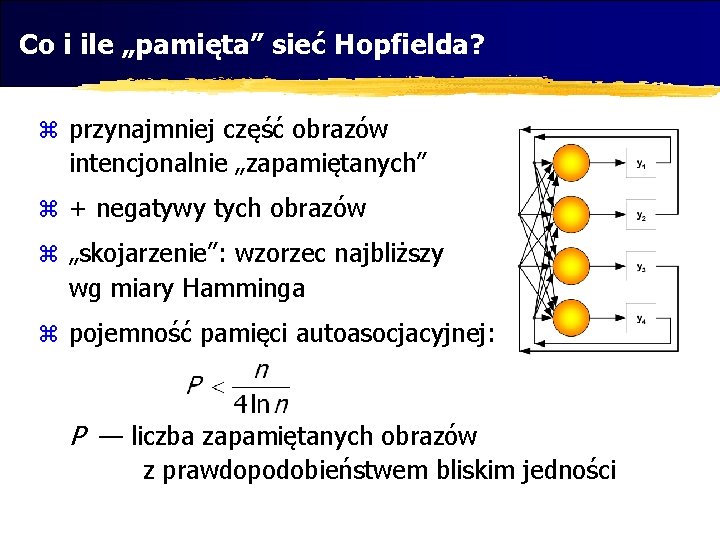

Co i ile „pamięta” sieć Hopfielda? z przynajmniej część obrazów intencjonalnie „zapamiętanych” z + negatywy tych obrazów z „skojarzenie”: wzorzec najbliższy wg miary Hamminga z pojemność pamięci autoasocjacyjnej: P — liczba zapamiętanych obrazów z prawdopodobieństwem bliskim jedności

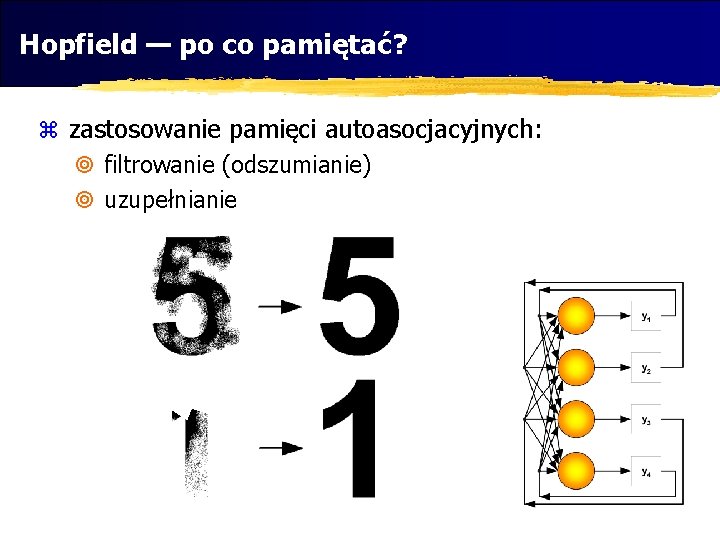

Hopfield — po co pamiętać? z zastosowanie pamięci autoasocjacyjnych: ¥ filtrowanie (odszumianie) ¥ uzupełnianie

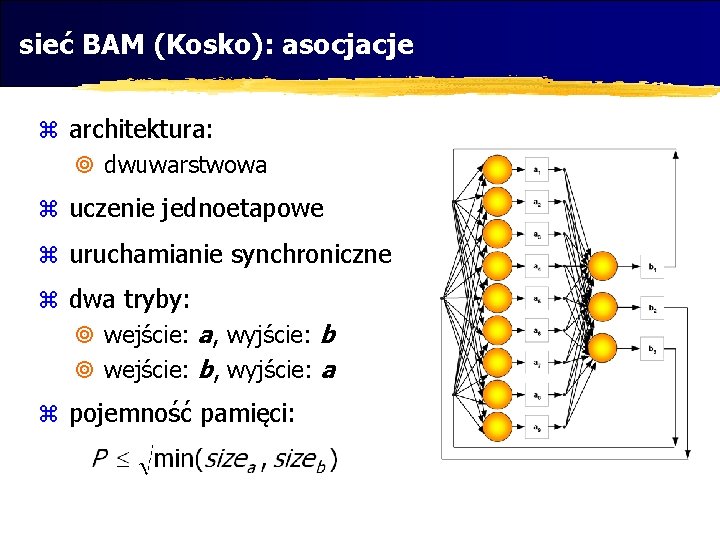

sieć BAM (Kosko): asocjacje z architektura: ¥ dwuwarstwowa z uczenie jednoetapowe z uruchamianie synchroniczne z dwa tryby: ¥ wejście: a, wyjście: b ¥ wejście: b, wyjście: a z pojemność pamięci:

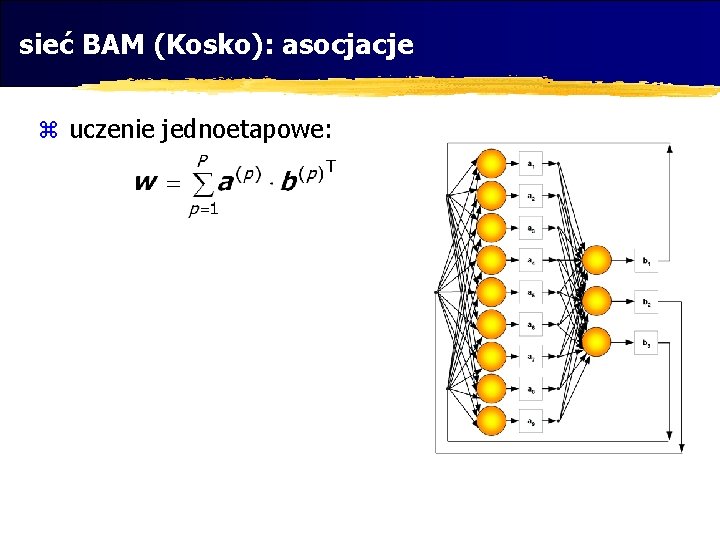

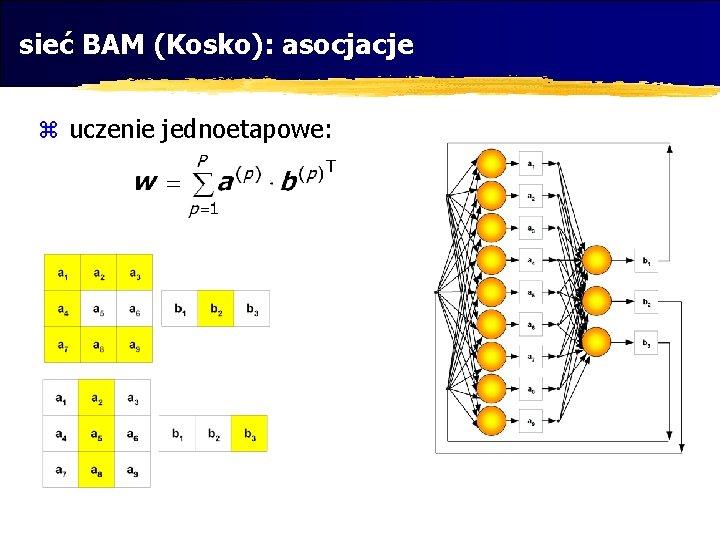

sieć BAM (Kosko): asocjacje z uczenie jednoetapowe:

sieć BAM (Kosko): asocjacje z uczenie jednoetapowe:

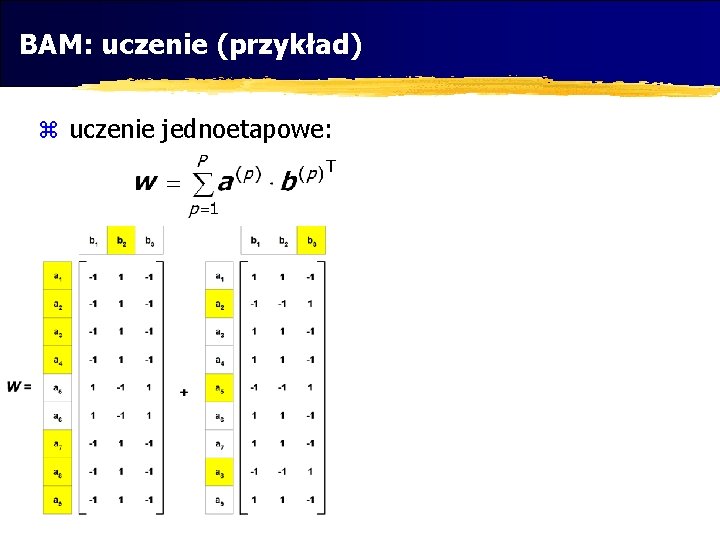

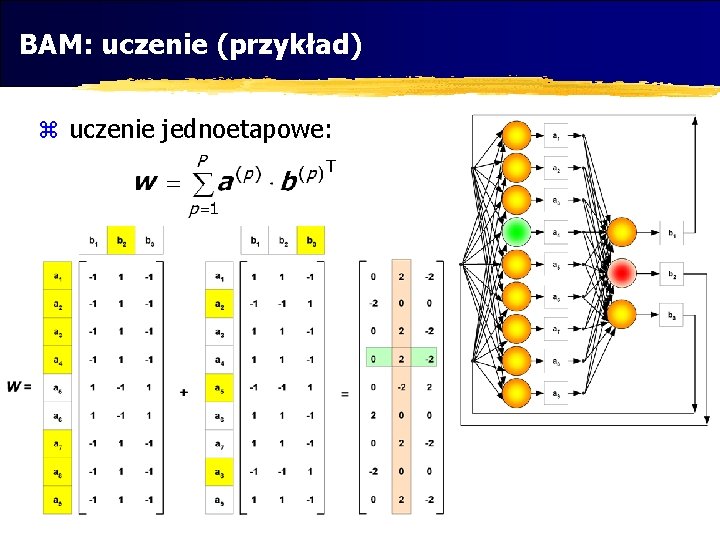

BAM: uczenie (przykład) z uczenie jednoetapowe:

BAM: uczenie (przykład) z uczenie jednoetapowe:

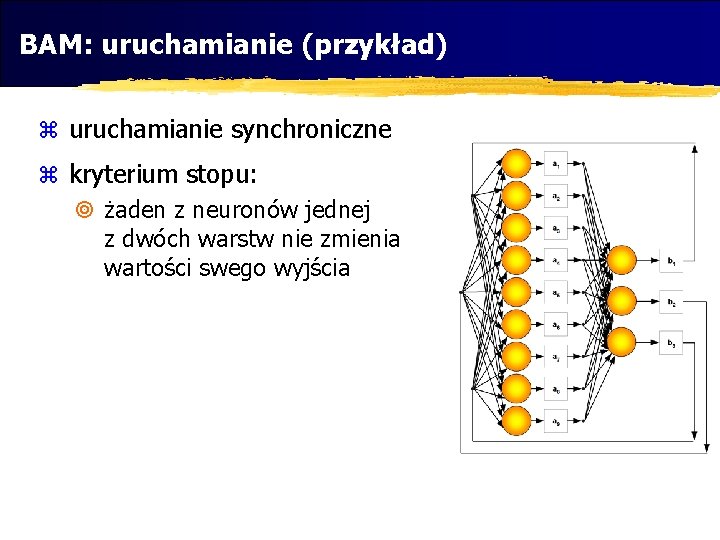

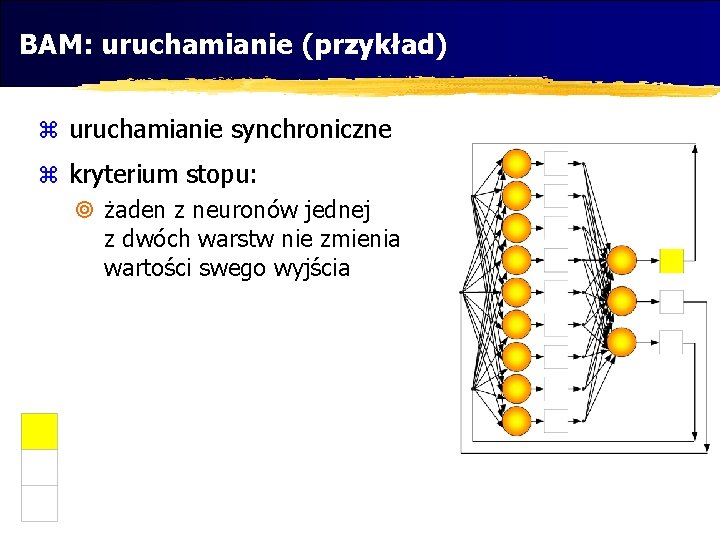

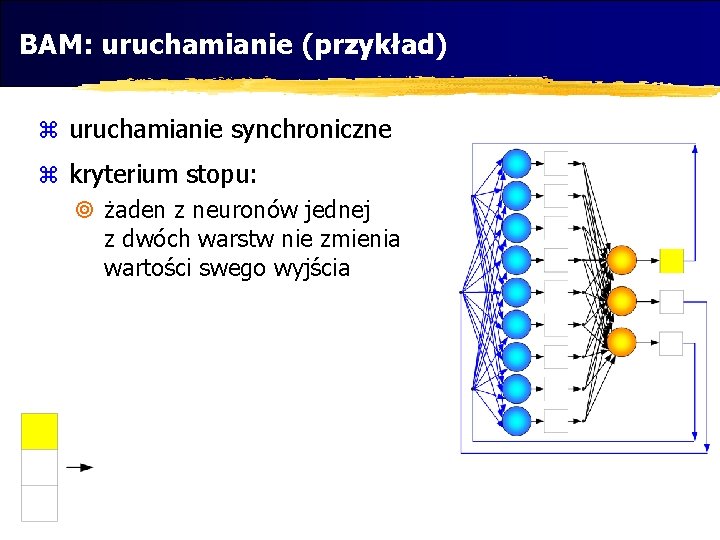

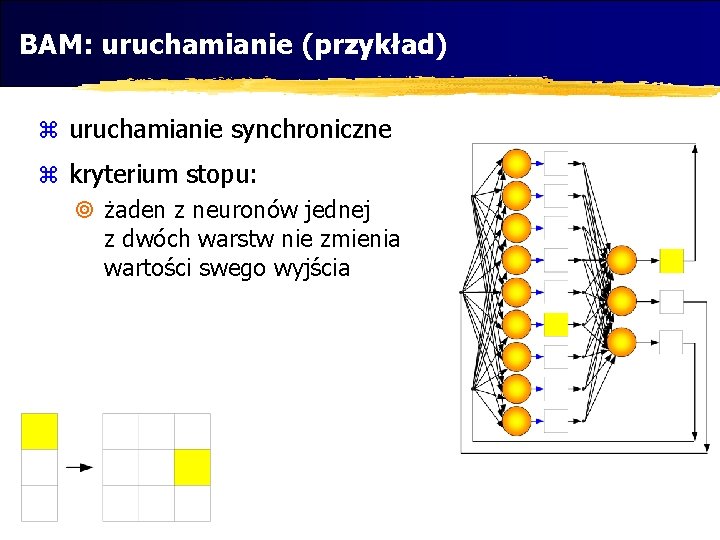

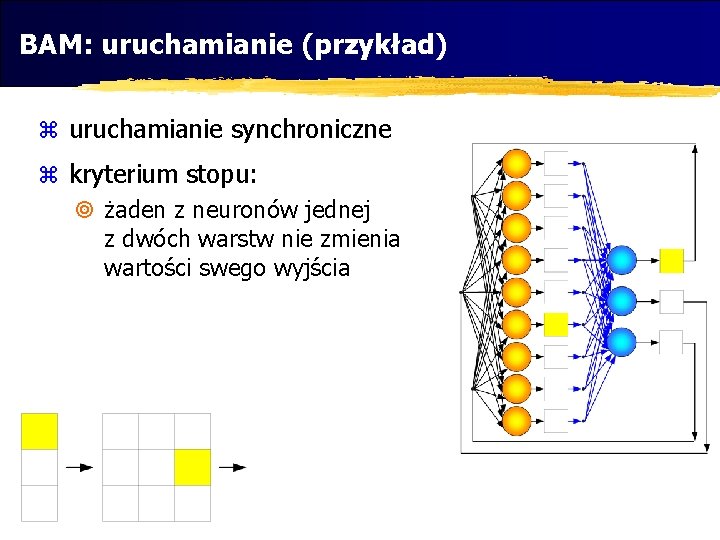

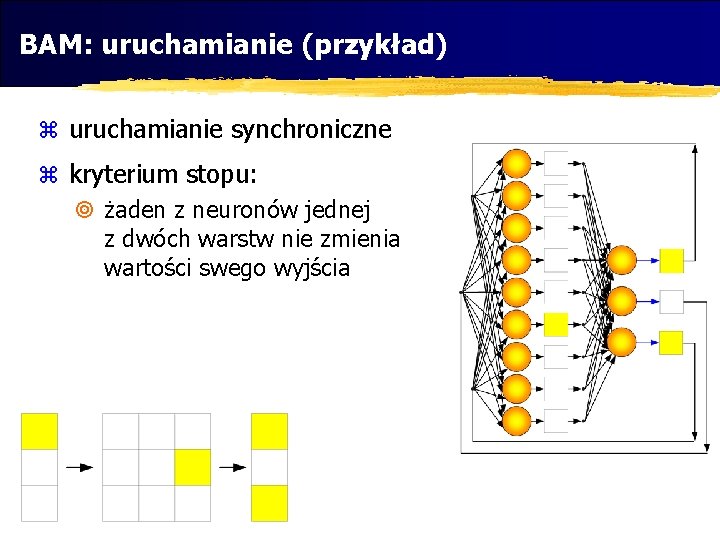

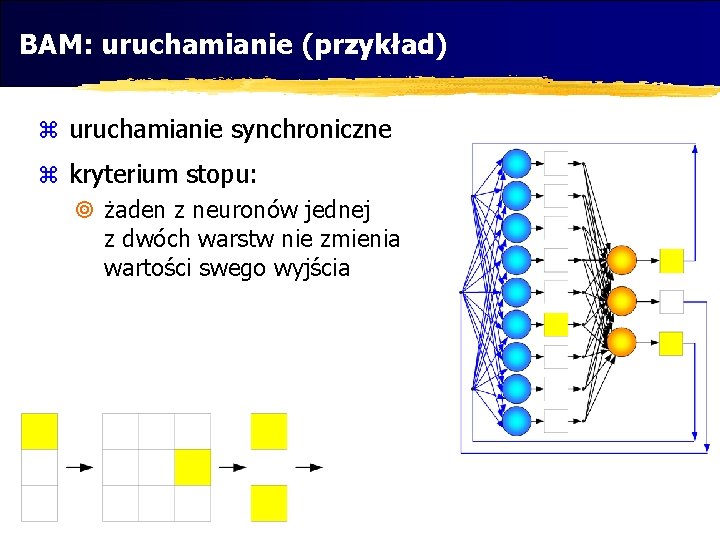

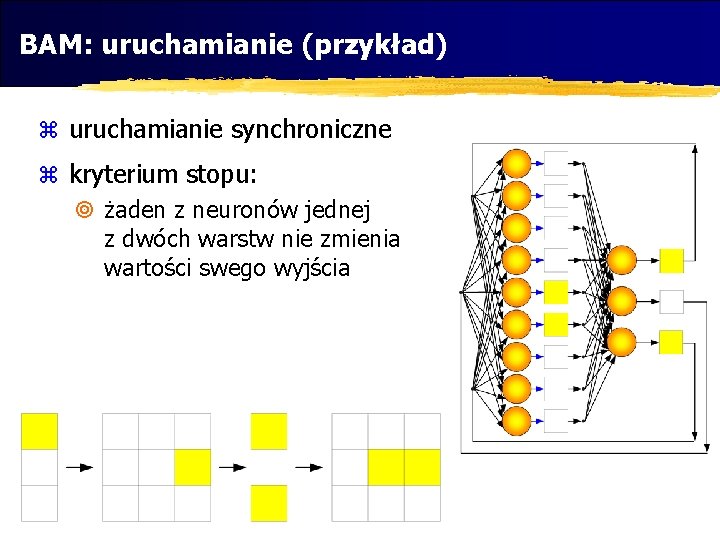

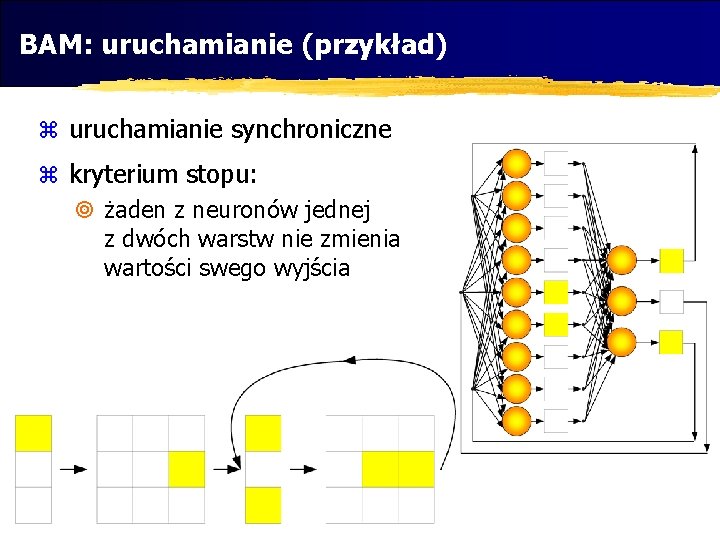

BAM: uruchamianie (przykład) z uruchamianie synchroniczne z kryterium stopu: ¥ żaden z neuronów jednej z dwóch warstw nie zmienia wartości swego wyjścia

BAM: uruchamianie (przykład) z uruchamianie synchroniczne z kryterium stopu: ¥ żaden z neuronów jednej z dwóch warstw nie zmienia wartości swego wyjścia

BAM: uruchamianie (przykład) z uruchamianie synchroniczne z kryterium stopu: ¥ żaden z neuronów jednej z dwóch warstw nie zmienia wartości swego wyjścia

BAM: uruchamianie (przykład) z uruchamianie synchroniczne z kryterium stopu: ¥ żaden z neuronów jednej z dwóch warstw nie zmienia wartości swego wyjścia

BAM: uruchamianie (przykład) z uruchamianie synchroniczne z kryterium stopu: ¥ żaden z neuronów jednej z dwóch warstw nie zmienia wartości swego wyjścia

BAM: uruchamianie (przykład) z uruchamianie synchroniczne z kryterium stopu: ¥ żaden z neuronów jednej z dwóch warstw nie zmienia wartości swego wyjścia

BAM: uruchamianie (przykład) z uruchamianie synchroniczne z kryterium stopu: ¥ żaden z neuronów jednej z dwóch warstw nie zmienia wartości swego wyjścia

BAM: uruchamianie (przykład) z uruchamianie synchroniczne z kryterium stopu: ¥ żaden z neuronów jednej z dwóch warstw nie zmienia wartości swego wyjścia

BAM: uruchamianie (przykład) z uruchamianie synchroniczne z kryterium stopu: ¥ żaden z neuronów jednej z dwóch warstw nie zmienia wartości swego wyjścia

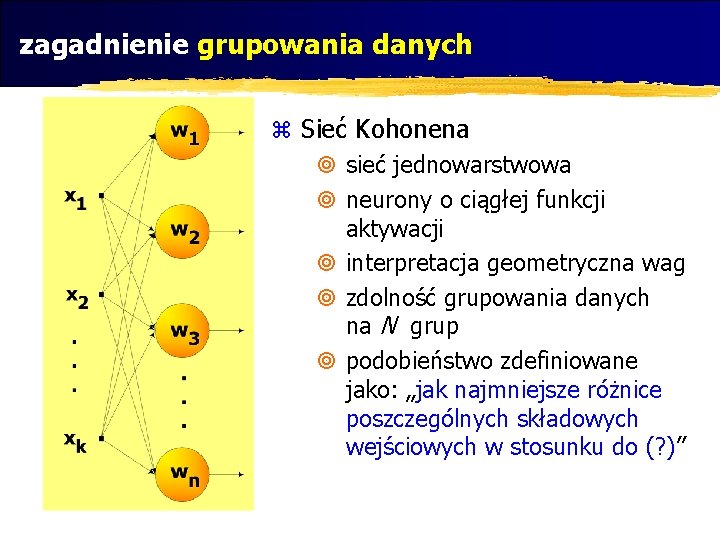

zagadnienie grupowania danych z Sieć Kohonena ¥ sieć jednowarstwowa ¥ neurony o ciągłej funkcji aktywacji ¥ interpretacja geometryczna wag ¥ zdolność grupowania danych na N grup ¥ podobieństwo zdefiniowane jako: „jak najmniejsze różnice poszczególnych składowych wejściowych w stosunku do (? )”

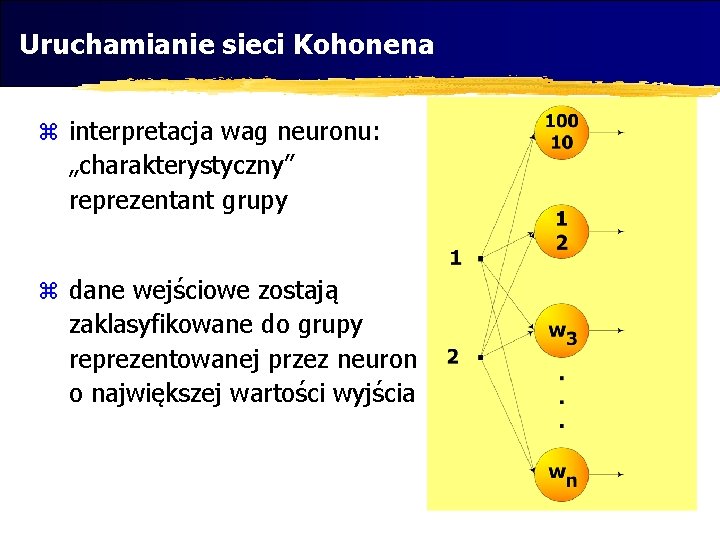

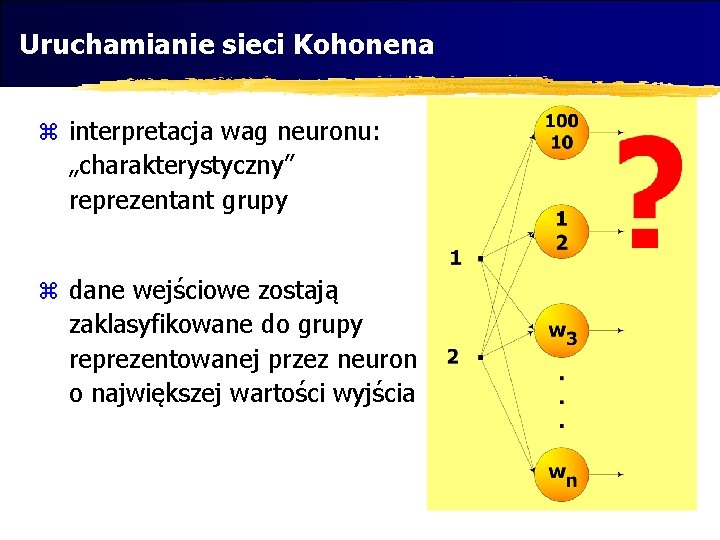

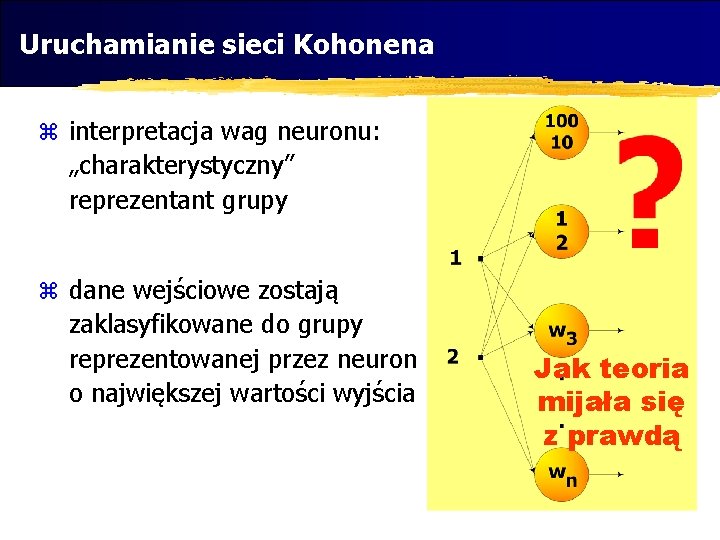

Uruchamianie sieci Kohonena z interpretacja wag neuronu: „charakterystyczny” reprezentant grupy z dane wejściowe zostają zaklasyfikowane do grupy reprezentowanej przez neuron o największej wartości wyjścia

Uruchamianie sieci Kohonena z interpretacja wag neuronu: „charakterystyczny” reprezentant grupy z dane wejściowe zostają zaklasyfikowane do grupy reprezentowanej przez neuron o największej wartości wyjścia

Uruchamianie sieci Kohonena z interpretacja wag neuronu: „charakterystyczny” reprezentant grupy z dane wejściowe zostają zaklasyfikowane do grupy reprezentowanej przez neuron o największej wartości wyjścia Jak teoria mijała się z prawdą

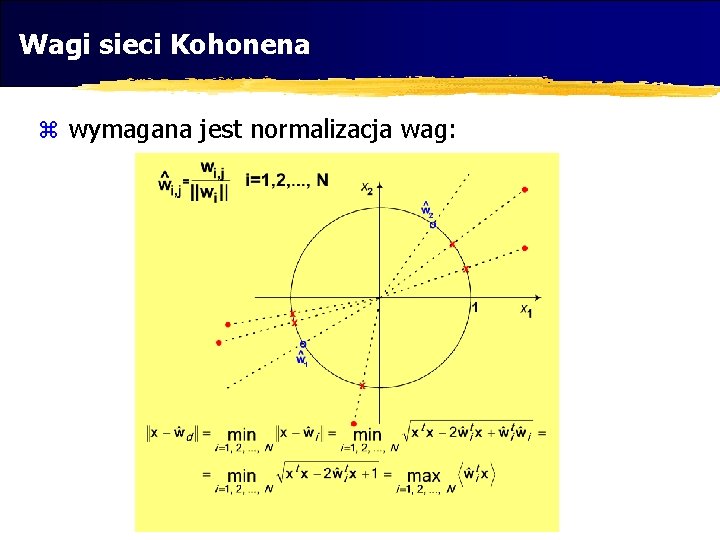

Wagi sieci Kohonena z wymagana jest normalizacja wag:

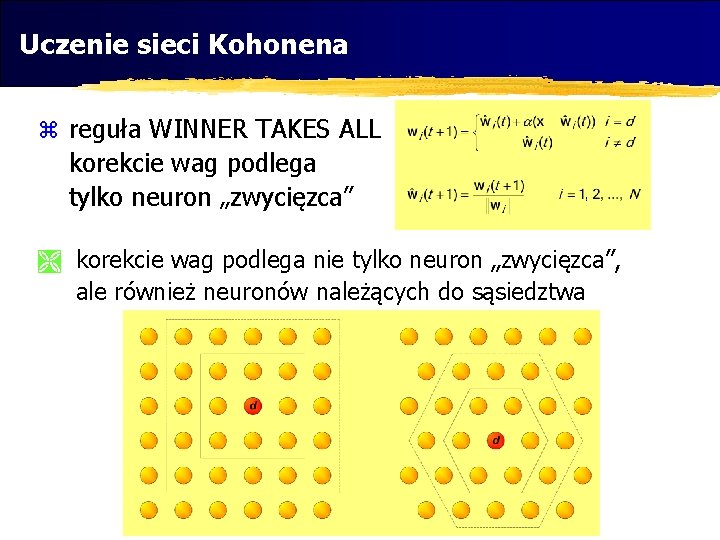

Uczenie sieci Kohonena z reguła WINNER TAKES ALL korekcie wag podlega tylko neuron „zwycięzca” Ì korekcie wag podlega nie tylko neuron „zwycięzca”, ale również neuronów należących do sąsiedztwa

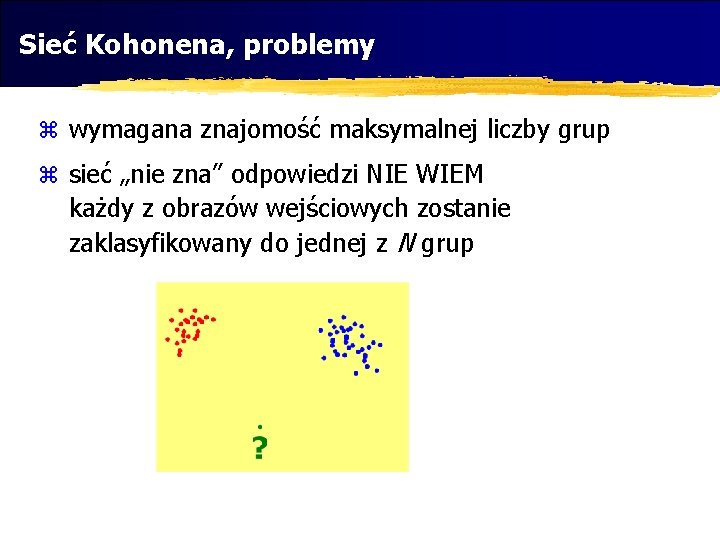

Sieć Kohonena, problemy z wymagana znajomość maksymalnej liczby grup z sieć „nie zna” odpowiedzi NIE WIEM każdy z obrazów wejściowych zostanie zaklasyfikowany do jednej z N grup

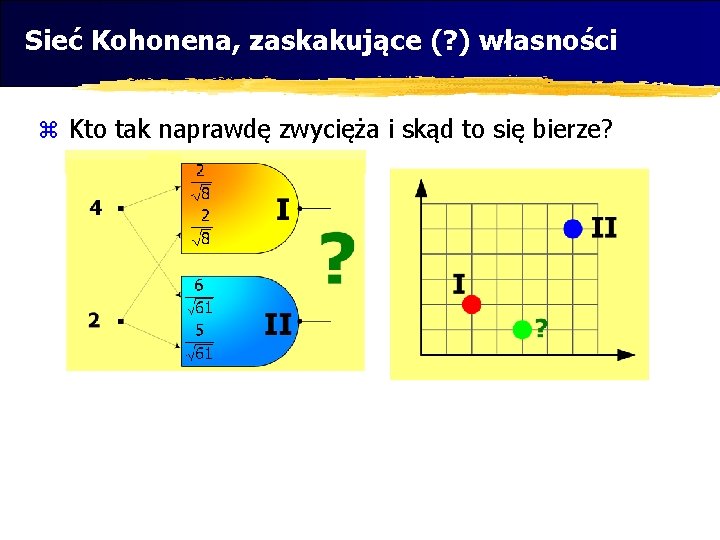

Sieć Kohonena, zaskakujące (? ) własności z Kto tak naprawdę zwycięża i skąd to się bierze?

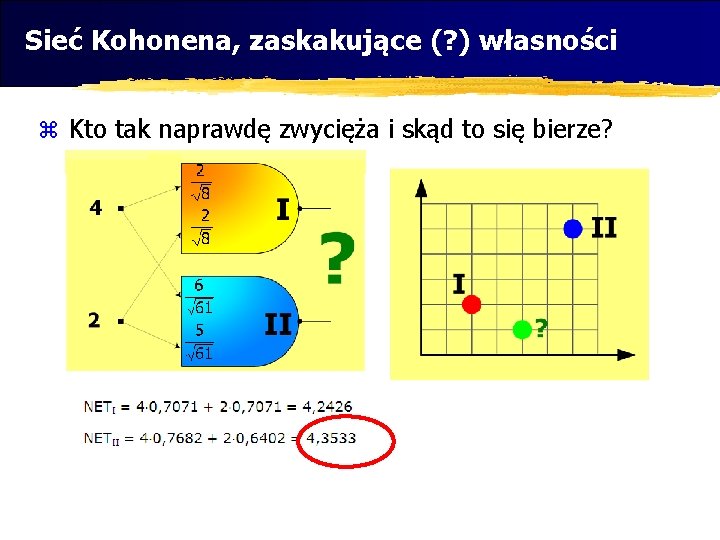

Sieć Kohonena, zaskakujące (? ) własności z Kto tak naprawdę zwycięża i skąd to się bierze?

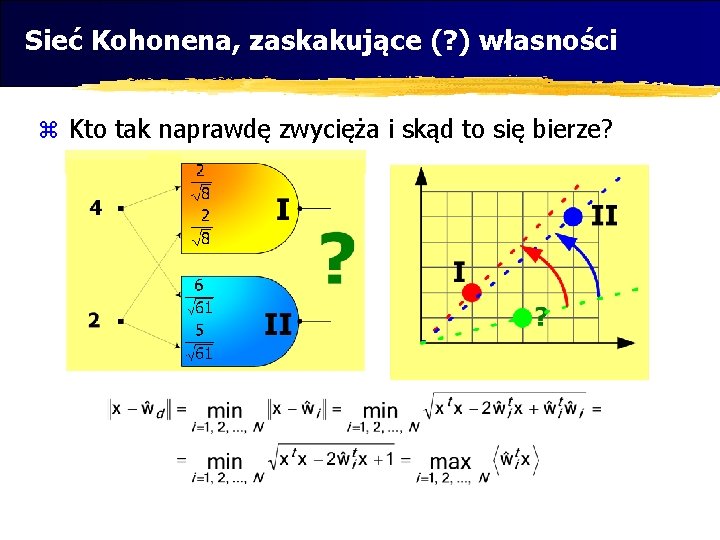

Sieć Kohonena, zaskakujące (? ) własności z Kto tak naprawdę zwycięża i skąd to się bierze?

Sieci neuronowe (podsumowanie) z architektura: ¥ jednowarstowe/wielowarstwowe ¥ z/bez sprzężenia zwrotnego z uczenie z/bez nauczyciela z zastosowania: ¥ klasyfikacja ¥ aproksymacja, prognozowanie ¥ filtrowanie (auto/heteroasocjacja) ¥ grupowanie (detekcja regularności)

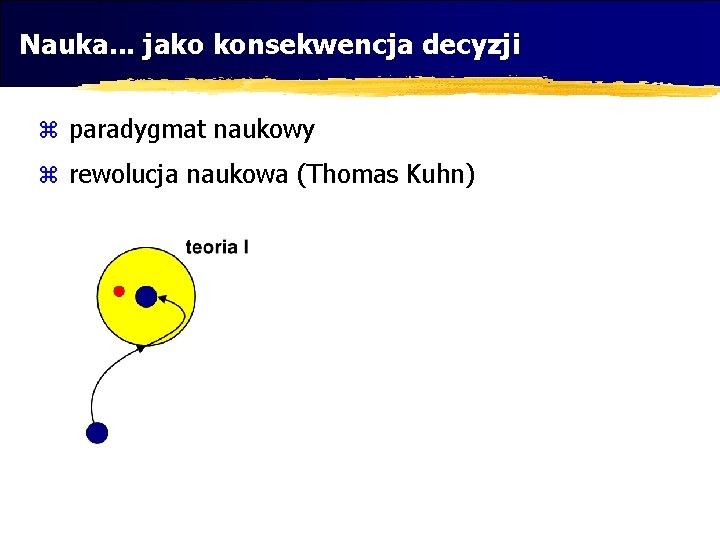

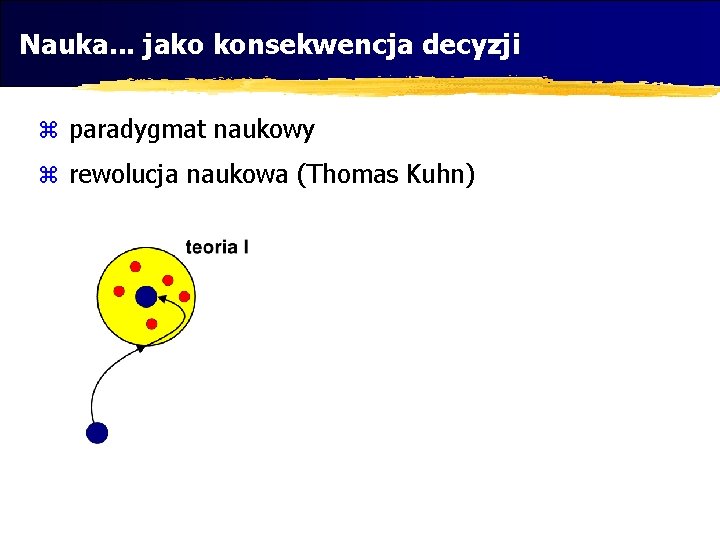

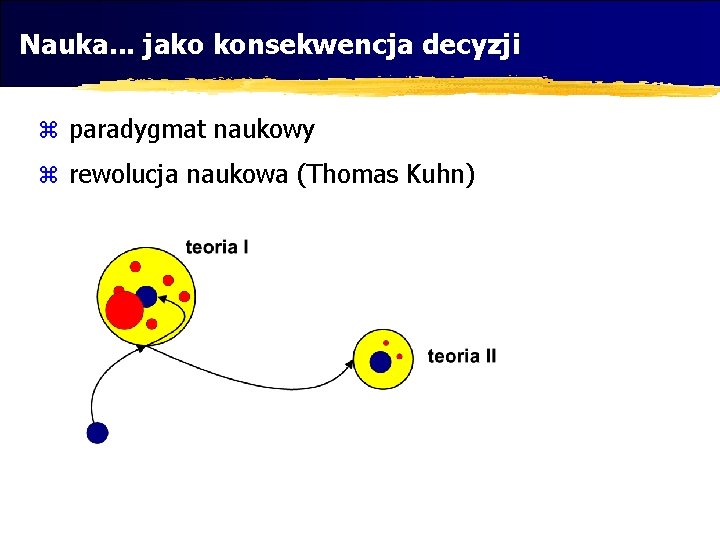

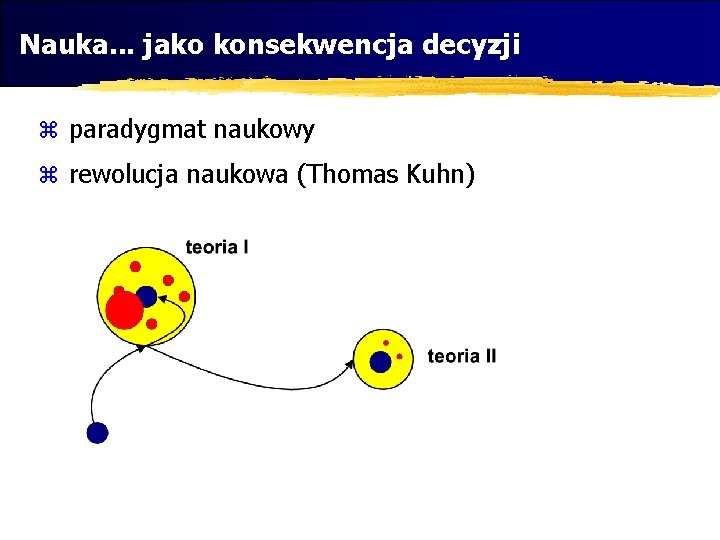

Nauka. . . jako konsekwencja decyzji z paradygmat naukowy z rewolucja naukowa (Thomas Kuhn)

Nauka. . . jako konsekwencja decyzji z paradygmat naukowy z rewolucja naukowa (Thomas Kuhn)

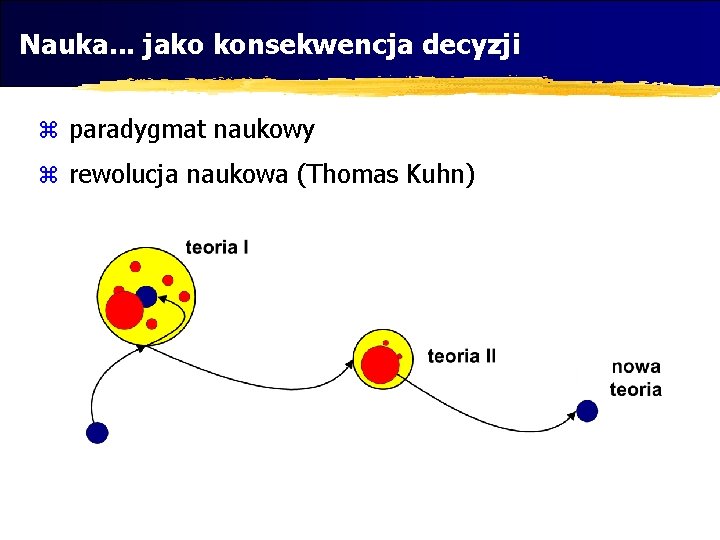

Nauka. . . jako konsekwencja decyzji z paradygmat naukowy z rewolucja naukowa (Thomas Kuhn)

Nauka. . . jako konsekwencja decyzji z paradygmat naukowy z rewolucja naukowa (Thomas Kuhn)

Nauka. . . jako konsekwencja decyzji z paradygmat naukowy z rewolucja naukowa (Thomas Kuhn)

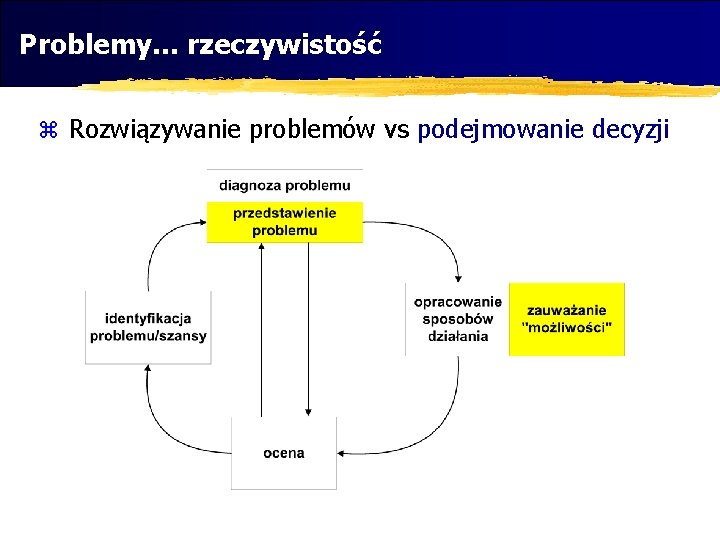

Problemy. . . rzeczywistość z Rozwiązywanie problemów vs podejmowanie decyzji

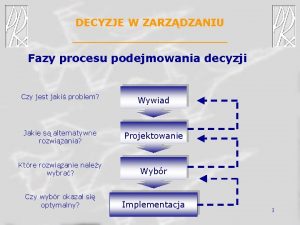

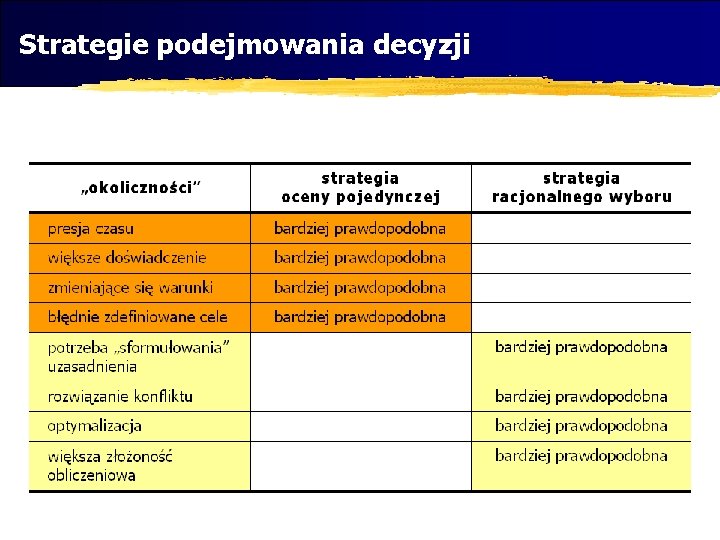

Strategie podejmowania decyzji

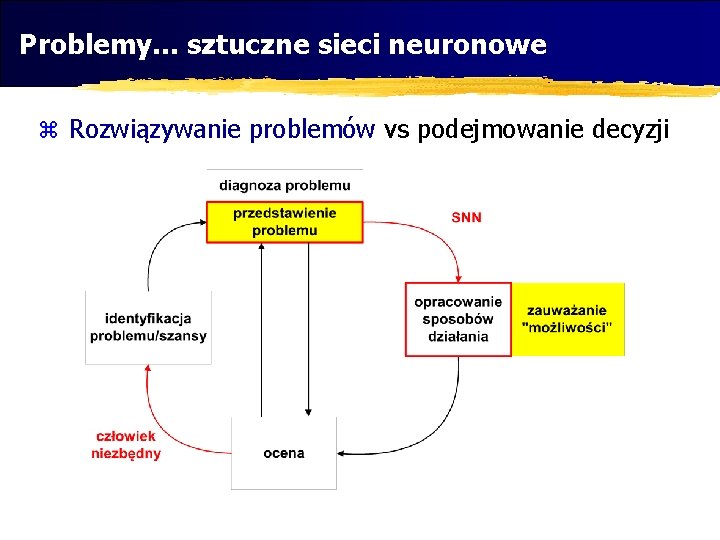

Problemy. . . sztuczne sieci neuronowe z Rozwiązywanie problemów vs podejmowanie decyzji

- Slides: 74