INTELLIGENCE ARTIFICIELLE IAR1001 Contenu du cours 1 Prsentation

![Agents Intelligents • Notions d’agents intelligents (exemple: Aspirateur robotisé) [ Positions, États] Agents Intelligents • Notions d’agents intelligents (exemple: Aspirateur robotisé) [ Positions, États]](https://slidetodoc.com/presentation_image_h/0f2e8b85d60511938aa3b987c9fe8ef8/image-20.jpg)

- Slides: 45

INTELLIGENCE ARTIFICIELLE IAR-1001

Contenu du cours 1 • Présentation du plan de cours • Informations utiles – Source des notes de cours • ftp: //dmiftp. uqtr. ca/FMeunier/iar 1001/ – Local: 3081 R – Email: Francois. Meunier@uqtr. ca – No. de téléphone: 819 376 5011 ext. 3833 – Laboratoires: 3038 R, 3043 R, 3045 R (accès: 1 -5 -32 -4)

Contenu du cours 1 • Introduction à l’Intelligence Artificielle (IA) – Définitions de l’IA – L’intelligence Humaine – Notions de rationalité – Intelligence computationnelle – Niveaux d’intelligence • Agents Intelligents – Notions d’agents intelligents – Types d’agent • LECTURES: Chapitres 1 et 2 Russell & Norvig • Notes de cours (site ftp UQTR)

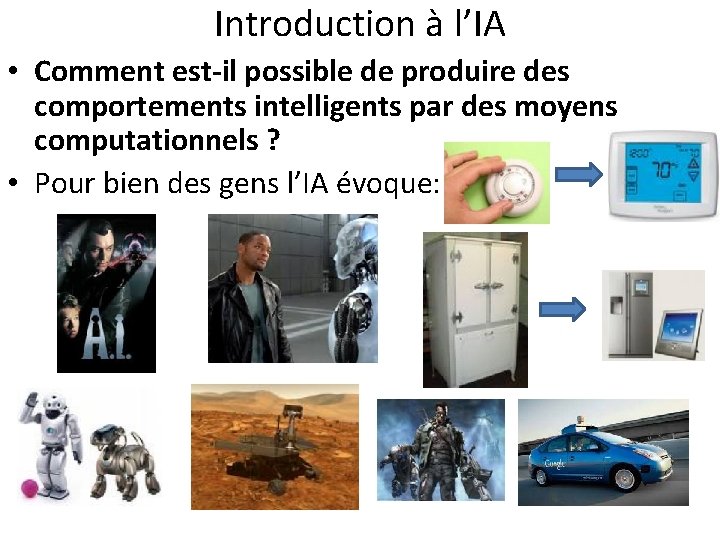

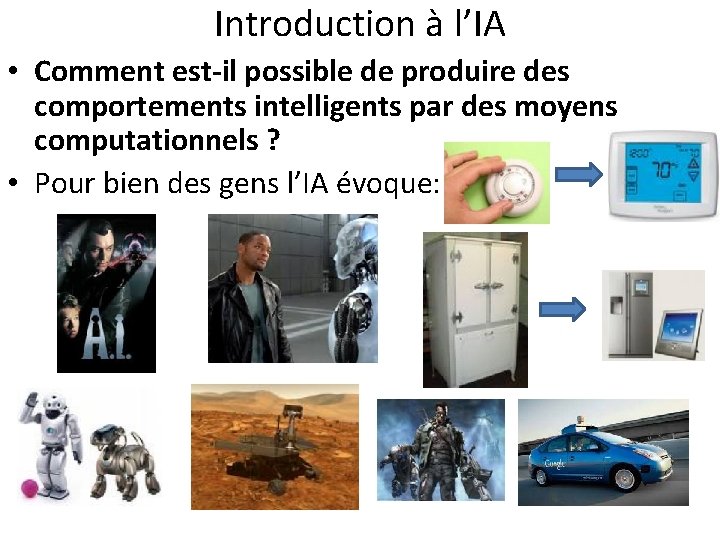

Introduction à l’IA • Comment est-il possible de produire des comportements intelligents par des moyens computationnels ? • Pour bien des gens l’IA évoque:

Introduction à l’IA • Domaines de l’IA: – Perception: vision , voix, paroles, texte, touché etc. Apprentissage automatique, Réseaux de Neurones – Robotique – Traitement du langage naturel – Raisonnement et prise de décision • Représentation de la connaissance • Raisonnement (logique/probabiliste) • Prise de décision (recherche, prédiction, théorie de la décision)

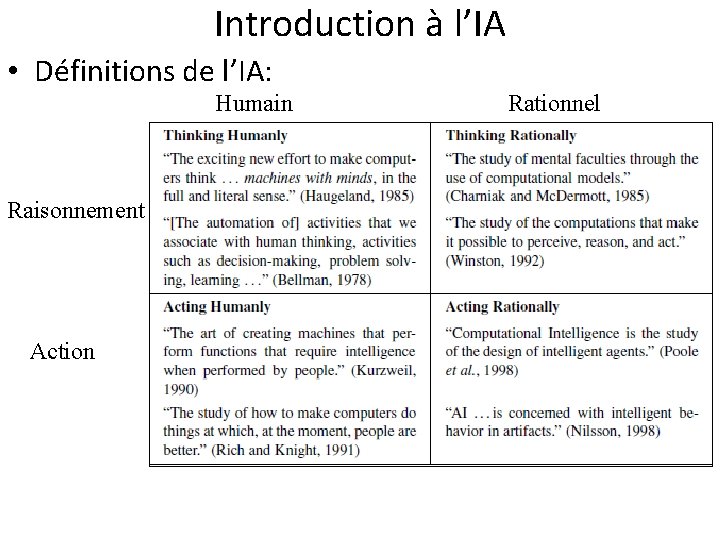

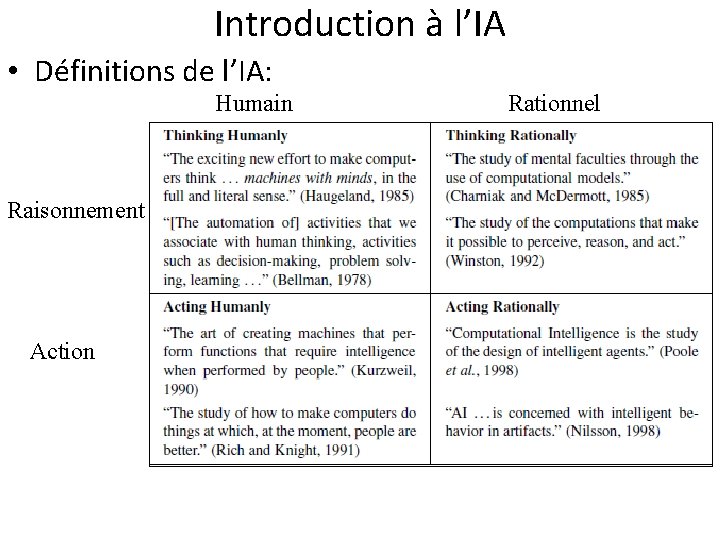

Introduction à l’IA • Définitions de l’IA: Humain Raisonnement Action Rationnel

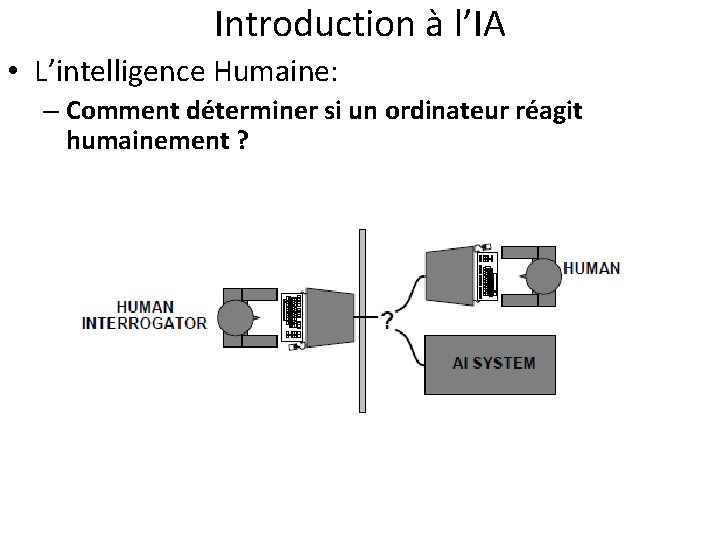

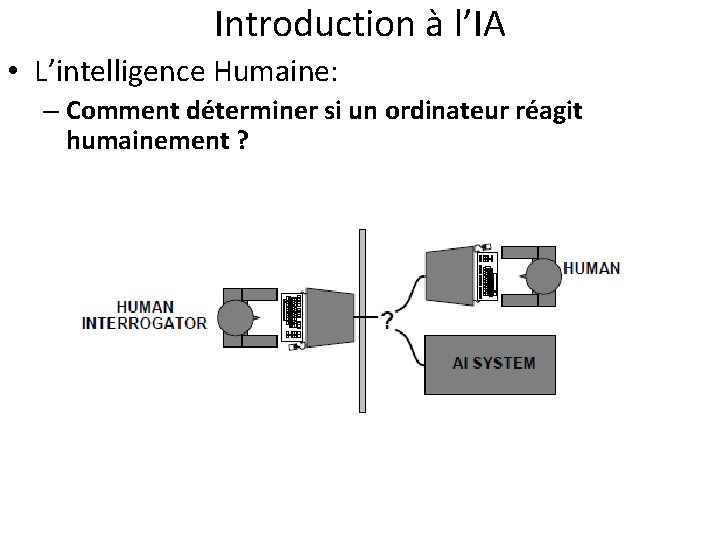

Introduction à l’IA • L’intelligence Humaine: – Comment déterminer si un ordinateur réagit humainement ?

Introduction à l’IA • L’intelligence Humaine: – Comment déterminer si un ordinateur réagit humainement ? – Le test de Turing (1950): Un interrogateur humain communique avec un sujet caché qui est soit un humain ou un ordinateur. Si l’interrogateur humain ne peut pas distinguer quel sujet représente la machine, l’ordinateur a alors passé avec succès le test de Turing. – Turing soulèvent quelques arguments persuasifs pour qualifier une machine passant le test de Turing d’intelligente. – Ce test ne donne pas d’indices sur comment est construit ce système intelligent.

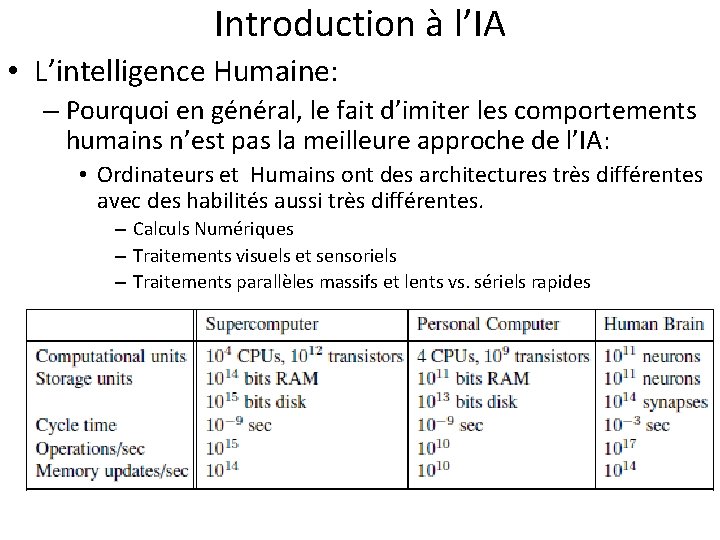

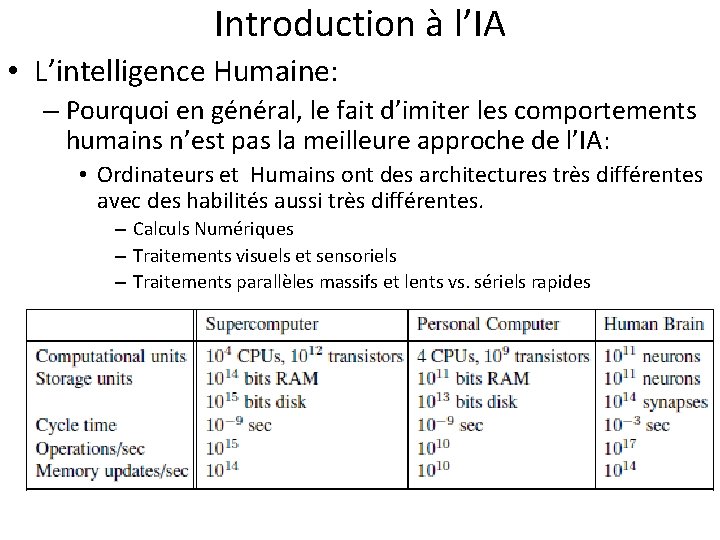

Introduction à l’IA • L’intelligence Humaine: – Pourquoi en général, le fait d’imiter les comportements humains n’est pas la meilleure approche de l’IA: • Ordinateurs et Humains ont des architectures très différentes avec des habilités aussi très différentes. – Calculs Numériques – Traitements visuels et sensoriels – Traitements parallèles massifs et lents vs. sériels rapides

Introduction à l’IA • L’intelligence Humaine: – Pourquoi en général, le fait d’imiter les comportements humains n’est pas la meilleure approche de l’IA: • De plus, notre connaissance de la façon que le cerveau humain accomplit les processus de hauts niveaux est assez limitée. Dans ces circonstances, Il est alors plus difficile pour les scientifiques du domaine de l’IA de modéliser ces processus. • Par contre, les neurosciences ont grandement influencées le développement de certaines spécialités liées à l’IA, dont le “robotic sensing”, le traitement visuel (vision processing), etc. • Les neurosciences computationelles permettent de développer des modèles mathématiques du fonctionnement du cerveau au niveau neuronal

Introduction à l’IA • Notions de rationalité – La notion de rationalité est typiquement une notion mathématique qui implique de réagir donc agir avec précision à toutes circonstances particulières. – Offre un mécanisme précis pour analyser et comprendre les propriétés d’un comportement idéal que nous tentons de reproduire. – Offre aussi, des références (benchmarks) précises à partir desquelles nous pouvons mesurer le comportement du système à reproduire.

Introduction à l’IA • Notions de rationalité – Le formalisme Mathématique de la rationalité découlent entre autres de la logique (lois de la pensée) et l’économie (théorie de l’utilité: comment le mieux agir dans l’incertude, théorie des jeux: comment des agents ayant des intérêts propres interagissent). – Les notions de rationalité étant présices il est alors possible d’en faire l’étude et ainsi permettre la caractérisation exacte de leurs propriétés, bonnes ou mauvaises. – Le fait d’agir rationellement aura alors des implications sur la pensée/raisonnement

Introduction à l’IA • Intelligence computationnelle – L’IA tente de comprendre et modéliser l’intelligence sous forme de processus computationnels – Nous développons alors des systèmes dont le code permet d’accomplir parfaitement ou approximativement une notion de rationalité désirée. – Donc l’IA fait partie de la science informatique (Computer Science). – D’autre part, les sciences cognitives, la psychologie permettent de comprendre le raisonnement humain et à prédire la performance d’un humain à effectuer une tâche.

Introduction à l’IA • Niveau d’Intelligence – Le développement d’un système intelligent aussi performant que celui d’un humain reste un but encore inaccessible. – Mais, certains systèmes implémentent divers niveaux d’intelligence spécialisés. – Des concepts de formalismes mathématiques et algorithmiques ont été identifiés comme étant utiles à la construction de ces sytèmes “intelligents”. – Ensemble, ces formalismes et algorithmes constituent le fondement à partir duquel nous tentons de comprendre l’intelligence sous forme de processus computationnels. – Nous étudierons alors certains de ces formalismes et algorithmes pour accomplir certains niveaux d’intelligence.

Agents Intelligents • Notions d’agents intelligents – Nous pouvons alors imaginer les systèmes intelligents comme étant des agents intelligents , soient: avec ses propres buts à atteindre ou qui agissent au nom de quelqu’un (un “utilisateur”) – Un agent est une entité qui existe dans un environnement et qui agit sur cet environnement selon sa perception de cet environnement. – Un agent intelligent agit pour faire avancer ses propres intérêts (ou ceux d’un utilisateur).

Agents Intelligents • Notions d’agents intelligents – Capacités fondamentales d’un agent : • • • Perception Représentation des connaissances (modélisation) Apprentissage Raisonnement Prise de décisions

Agents Intelligents • Notions d’agents intelligents – Un agent est n’importe quelle entité qui perçoit son environnement par des capteurs (sensors) et agit sur cet environnement par des actionneurs (actuators) – Un agent humain a des yeux, des oreilles, un nez, et d’autres senseurs, des mains, des jambes, une bouche, une langue, des cordes vocales et d’autres actionneurs – Un agent robot a des caméras, des capteurs infra rouges (NIR, MIR et FIR) et autres capteurs, des roues, des jambes, des bras-articulés, et d’autres actionneurs – Un agent logiciel a un clavier, un accès en lecture a un disque dur et autres capteurs, un écran, un accès en écriture a un disque dur comme actionneurs

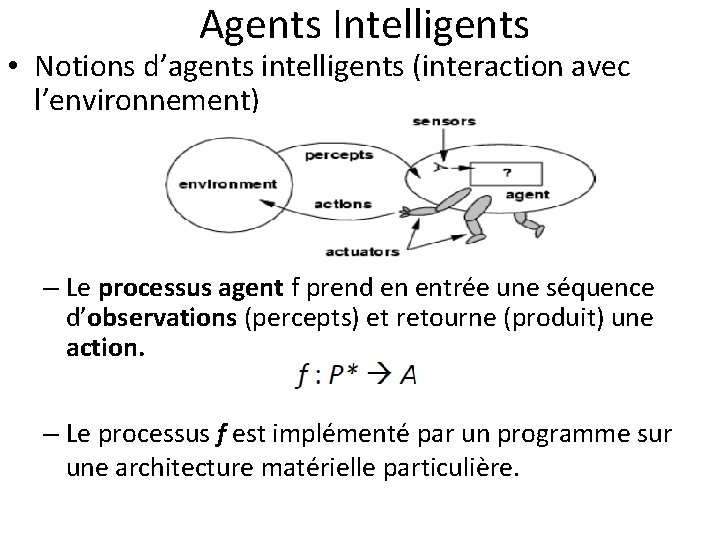

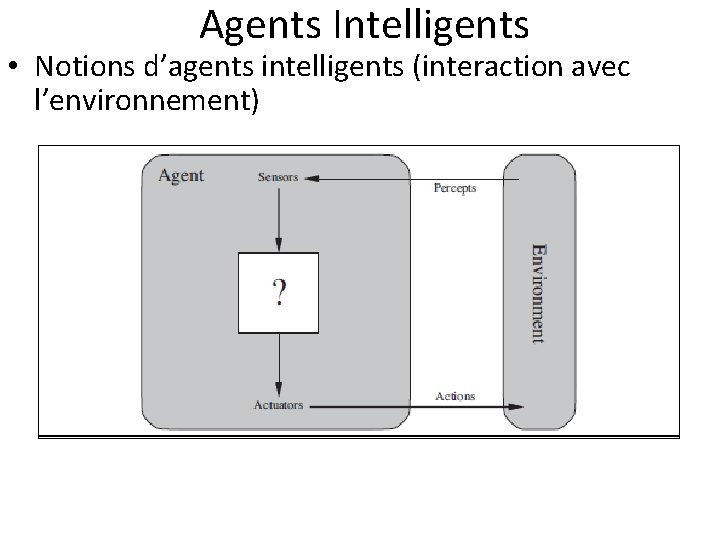

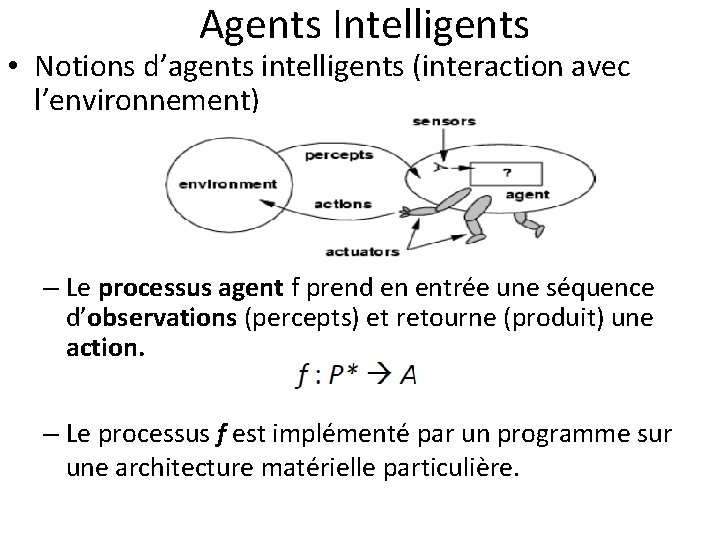

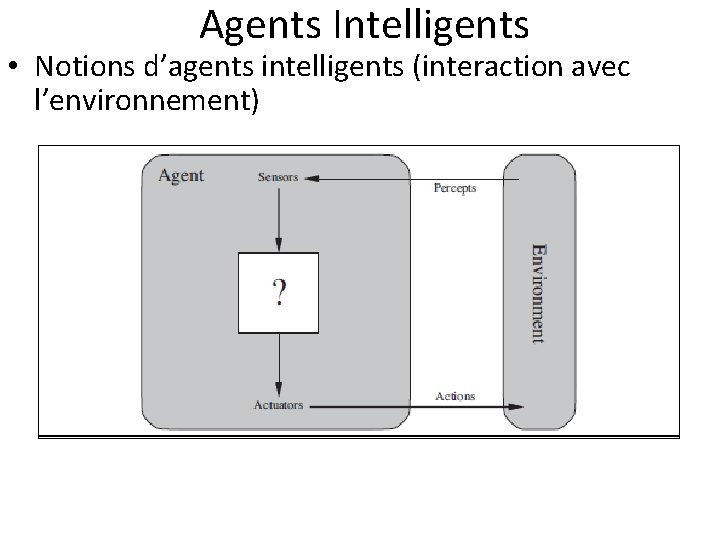

Agents Intelligents • Notions d’agents intelligents (interaction avec l’environnement) – Le processus agent f prend en entrée une séquence d’observations (percepts) et retourne (produit) une action. – Le processus f est implémenté par un programme sur une architecture matérielle particulière.

Agents Intelligents • Notions d’agents intelligents (interaction avec l’environnement)

![Agents Intelligents Notions dagents intelligents exemple Aspirateur robotisé Positions États Agents Intelligents • Notions d’agents intelligents (exemple: Aspirateur robotisé) [ Positions, États]](https://slidetodoc.com/presentation_image_h/0f2e8b85d60511938aa3b987c9fe8ef8/image-20.jpg)

Agents Intelligents • Notions d’agents intelligents (exemple: Aspirateur robotisé) [ Positions, États]

Agents Intelligents • Agents rationnels – Un agent rationnel agit « correctement » et ce en fonction de ce qu’il perçoit et de ses capacités d’action, une action étant dite correcte si elle permet à l’agent de réagir le mieux et ce en toutes circonstances. – La performance de l’agent peut être mesurée en utilisant une fonction objective. – La performance d’un robot aspirateur pourrait être : la quantité de poussière amassée, la propreté des lieux, la durée d’aspiration etc. – Étant donnée une séquence d’observations (données sensorielles) et de ses connaissances, un agent rationnel devrait choisir une action maximisant la mesure de performance

Agents Intelligents • Agents rationnels – Rationnel ne signifie pas nécessairement perfection, mais la maximisation de la performance espérée. – Un agent pourrait avoir à effectuer des actions d’observation pour recueillir des informations nécessaires a une tâche. – Un agent est qualifié d’autonome si il est capable d’adapter son comportement en fonction de son expérience (capacité d’apprentissage et d’adaptation).

Agents Intelligents • Modélisation d’un agent (modèle PEAS) – Performance: mesure de performances – Environnement: éléments de l’environnement – Actions (actionneurs/actuators): actions que peut effectuer l’agent – Capteurs (Sensors): séquence des observations/percepts de l’agent

Agents Intelligents • Modélisation d’un agent (modèle PEAS: Robot Taxi) – Agent: robot taxi (ex: Johnny Cab) – Mesure de performance: sécurité, vitesse, confort, respect du code de la sécurité routière, maximisation des profits – Environnement: route, trafic, piétons, clients – Actionneurs: volant, accélérateur, freins, clignotants, changement de rapport de vitesse, klaxon – Senseurs: caméras, sonar, radar, Lidar, GPS, odomètre, capteurs du moteur, indicateur de vitesse

Agents Intelligents • Caractéristiques d’environnement – Complètement observable VS partiellement observable – Déterministe VS stochastique – Épisodique VS séqentiel – Statique VS dynamique – Discret VS continu – Agent unique VS multi-agent

Agents Intelligents • Caractéristiques d’environnement – Complètement observable VS partiellement observable • Avec ses capteurs, l’agent a accès à l’état complet de l’environnement à chaque instant. • Le jeu d’échec est complètement observable, les pièces sur l’échiquier étant toutes visibles ainsi que leur position respective. • Le jeu de poker est partiellement observable puisque nous ne connaissons pas les cartes de nos adversaires, ainsi que les cartes non tirées du croupier.

Agents Intelligents • Caractéristiques d’environnement – Déterministe (vs. stochastique) • L’état suivant de l’environnement est entièrement déterminé par l’état courant et l’action effectuée par le ou les agents. • Le jeu d’échec est déterministe puisque le déplacement de chaque pièce produit toujours le même résultat. • Le jeu de poker est stochastique puisque la distribution des cartes est aléatoire.

Agents Intelligents • Caractéristiques d’environnement – Épisodique (vs. séquentiel) • Les opérations/comportements de l’agent sont divisés en épisodes : – Chaque épisode consiste à observer l’environnement et effectuer une seule action, cette action n’a pas d’influence sur l’environnement durant l’épisode suivant. – La reconnaissance de caractères est épisodique puisque la détection d’un caractère n’influence pas la détection du suivant. – Le jeu de poker est séquentiel puisque je peux décider de miser ou non ce qui aura un impact sur l’état suivant de la partie.

Agents Intelligents • Caractéristiques d’environnement – Statique (vs. dynamique) • L’environnement ne change pas quand le/les agent(s) ne font pas d’actions: – Le jeu d’échec est statique puisqu’il ne change pas si les joueurs ne jouent pas. – Le jeu de Pong est dynamique puisque la balle bouge même si le joueur ne fait rien.

Agents Intelligents • Caractéristiques d’environnement – Discret (vs. continu) • L’environnement est influencé par un nombre limité de données sensorielles et d’actions: – Le jeu d’échec est discret puisqu’il possible d’énumérer toutes les actions ainsi que tous les états du jeu (configuration) possibles. – Une voiture autonome se déploie dans un environnement continu, beaucoup de données sensorielles étant des valeurs réelles: ex. Braquage du volant, distances mesurées par les systèmes ultrasonores, radar, lidar etc. – Le jeu de Pong est dans un environnement continu puisque la position de balle (x, y) est une paire de nombres réels.

Agents Intelligents • Caractéristiques d’environnement – Unique (vs. Multi-agent) • Un agent agissant dans l’environnement : – Le jeu de Sudoku est à agent unique puisqu’il n’implique pas un adversaire. – Le jeu d’échec est multi-agent puisqu’il implique toujours un adversaire. – Il est aussi possible que les caractéristiques soient différentes selon les situations: • La position dans le jeu de Pong est normalement représentée par des nombres réels (coordonnées normalisées) mais pourrait être discrète si donnée en pixels. • Pour un robot les déplacements sont théoriquement déterministes mais si ces déplacements ne sont pas contrôlés parfaitement (ex: selon la charge transportée) ils devraient alors être modélisés stochatisquement.

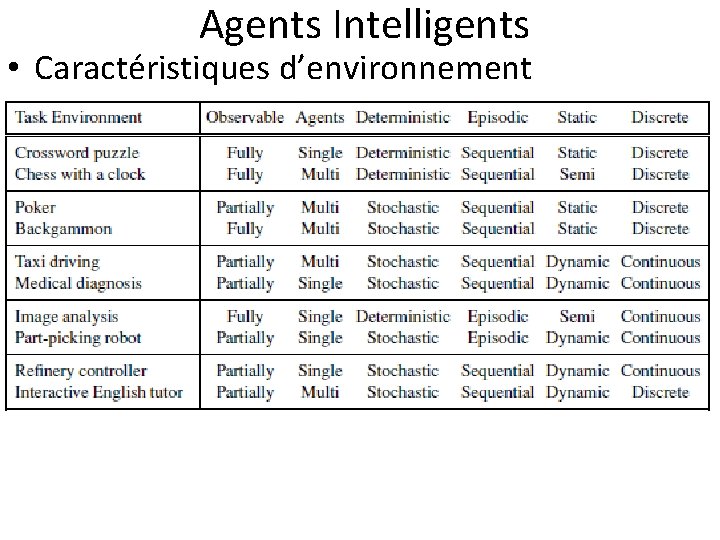

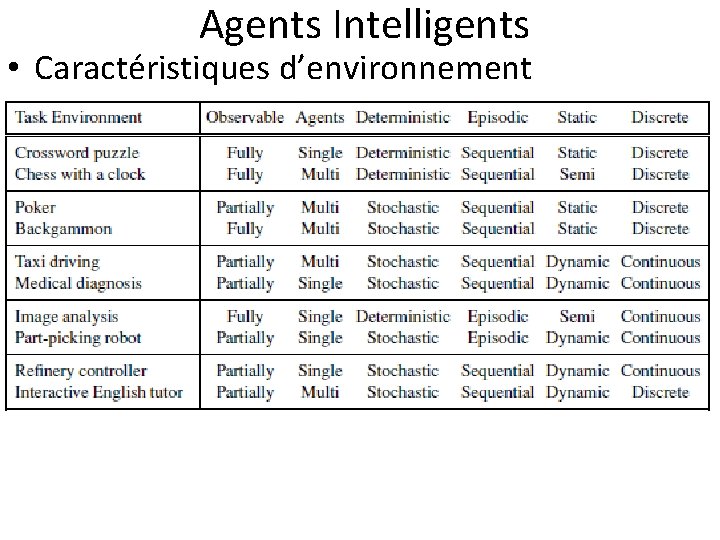

Agents Intelligents • Caractéristiques d’environnement

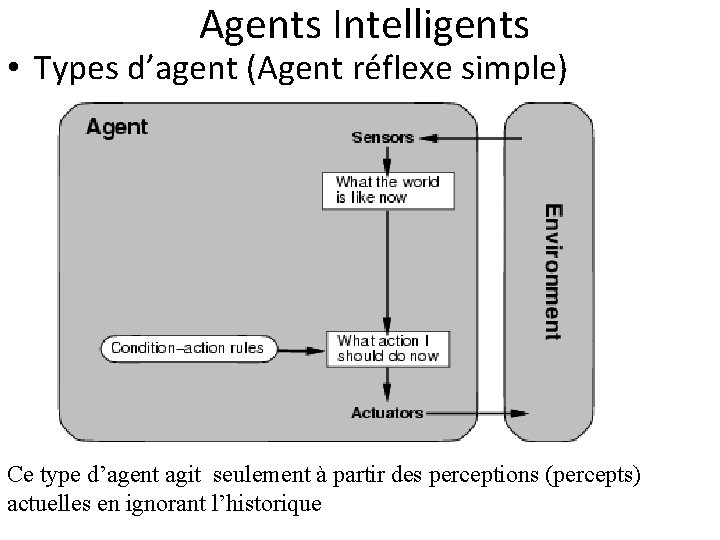

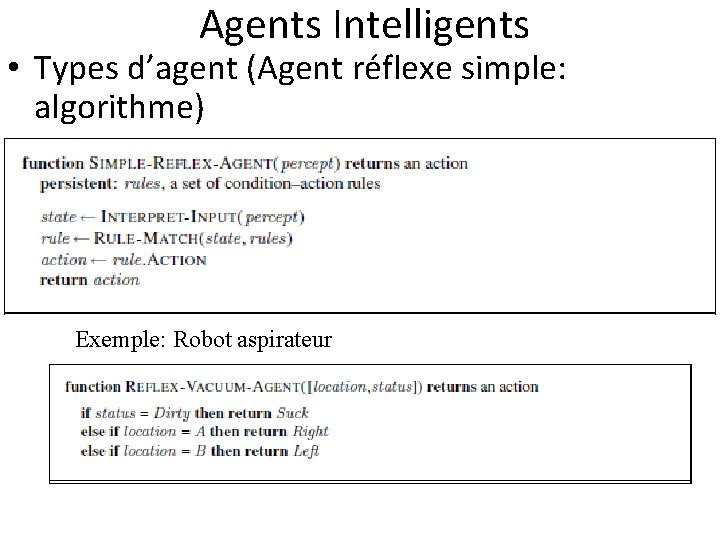

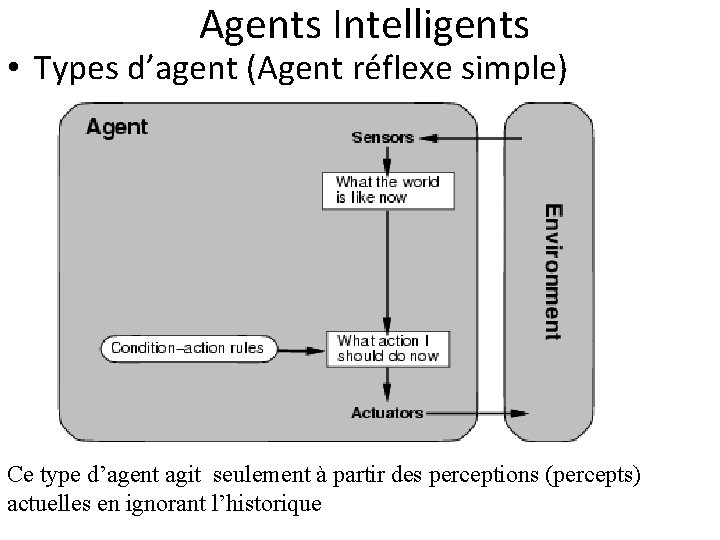

Agents Intelligents • Types d’agent (Agent réflexe simple) Ce type d’agent agit seulement à partir des perceptions (percepts) actuelles en ignorant l’historique

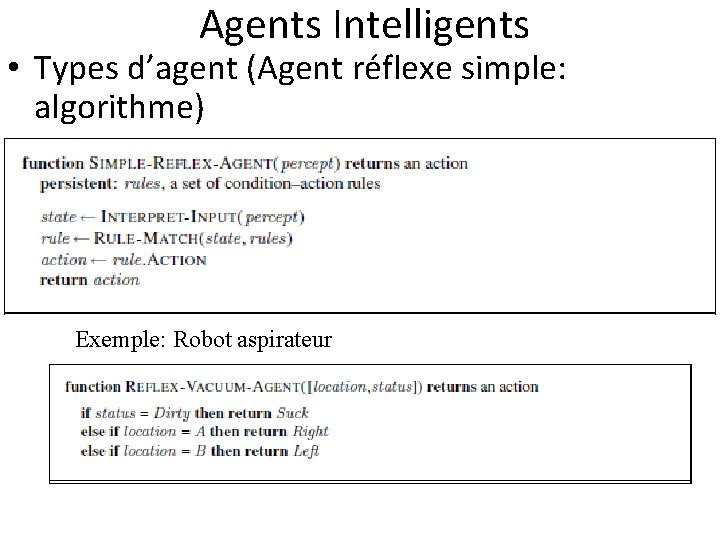

Agents Intelligents • Types d’agent (Agent réflexe simple: algorithme) Exemple: Robot aspirateur

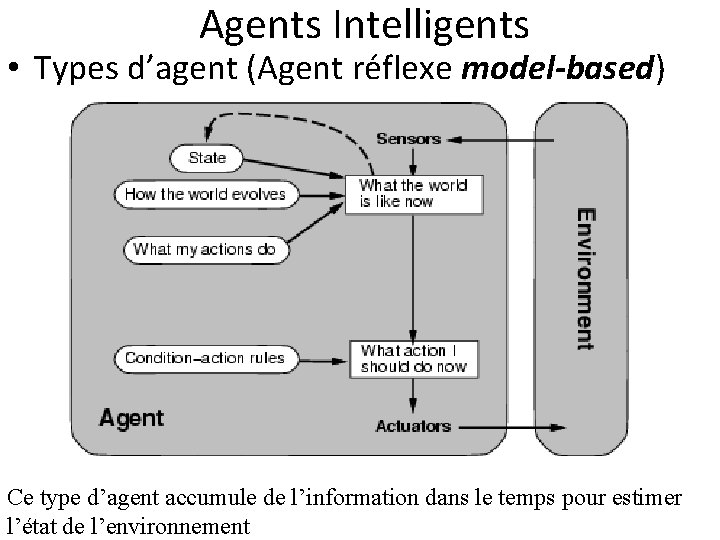

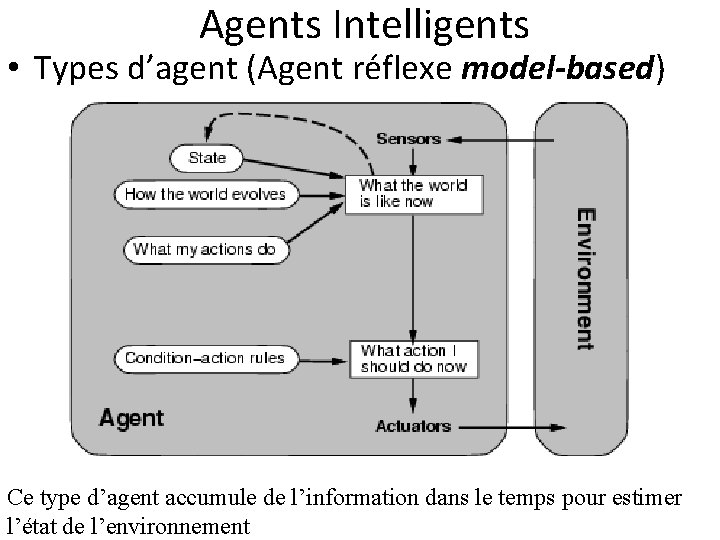

Agents Intelligents • Types d’agent (Agent réflexe model-based) Ce type d’agent accumule de l’information dans le temps pour estimer l’état de l’environnement

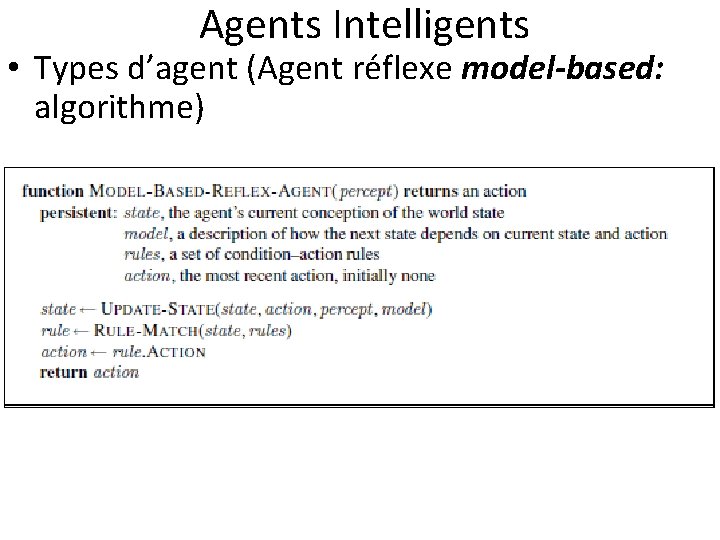

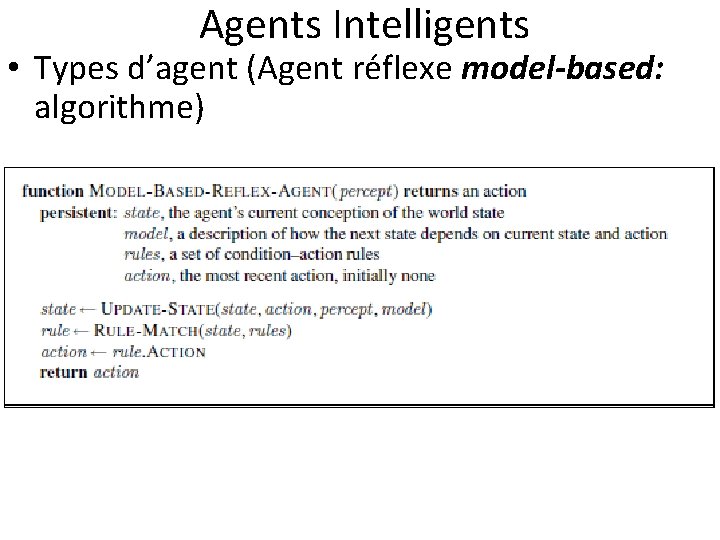

Agents Intelligents • Types d’agent (Agent réflexe model-based: algorithme)

Agents Intelligents • Types d’agent (Agent réflexe model-based) • Ce type d’agent doit maintenir un état (state) interne qui dépend de l’historique de ses perceptions (percepts) et reflète au moins une partie des aspects non observés de l’état courant. • Pour un système de freinage de voiture, l’état interne pourrait être l’image capturée au temps ti-1, permettant à l’agent de détecter quand les feux arrière d’un véhicule virent au rouge simultanément.

Agents Intelligents • Types d’agent (Agent réflexe model-based) • Durant les changements de voies d’un véhicule, l’agent doit faire un suivi dans le temps de la position des autres véhicules environnants et ce même si il ne peut les voire tous en même temps. • La mise-à-jour de l’état interne dans le temps requiert deux types de connaissances devant être encodées par le programme de l’agent: 1) Des informations sur la façon que l’environnement a évolué et ce indépendamment de l’agent (ex: un véhicule qui se rapproche par l’arrière à un temps t-1 devrait être plus proche au temps t).

Agents Intelligents • Types d’agent (Agent réflexe model-based) • La mise-à-jour de l’état interne dans le temps requiert deux types de connaissances devant être encodées par le programme de l’agent: 2) De l’information sur comment l’agent par ses actions change le monde environnant (ex: quand l’agent braque le volant dans le sens horaire, le véhicule tourne vers la droite, ou après un déplacement de 5 min en direction Nord sur l’autoroute, le véhicule est environ 10 km (120 km/h) du point où il était 5 min auparavant. • Cette connaissance de comment le monde fonctionne est appelée un modèle du monde

Agents Intelligents • Types d’agent (Agent réflexe model-based) • La structure de l’agent model-based est formée d’un état interne, dont la description est mise-àjour lorsque ses perceptions actuelles (current percepts) sont combinées à son état interne antérieur, et ce basé sur le modèle de l’agent sur comment le monde fonctionne. • Dans le programme de ce type d’agent la fonction UPDATE-STATE() est responsable de la création du nouvel état interne.

Agents Intelligents • Types d’agent (Agent réflexe model-based) • Indépendamment de la réprésentation utilisée pour modéliser l’état d’un agent, il est difficile de déterminer avec exactitude son état courant dans un environnement partiellement observable. • Donc “what the world is like now” représentera alors un “best guess” (un taxi autonome ne verra peut être pas en avant d’un gros camion arrêté en avant de lui et ne pourra alors que deviner ce qui peut causer ce ralentissement (blocage) de la circulation). Donc une incertitude sur l’état de l’agent est parfois inévitable, mais il devra quand même prendre certaines décisions sur les actions à prendre ou ne pas prendre.

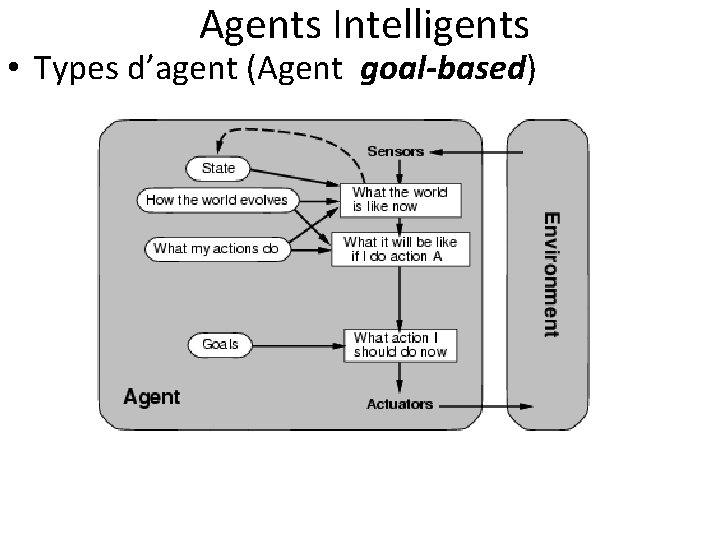

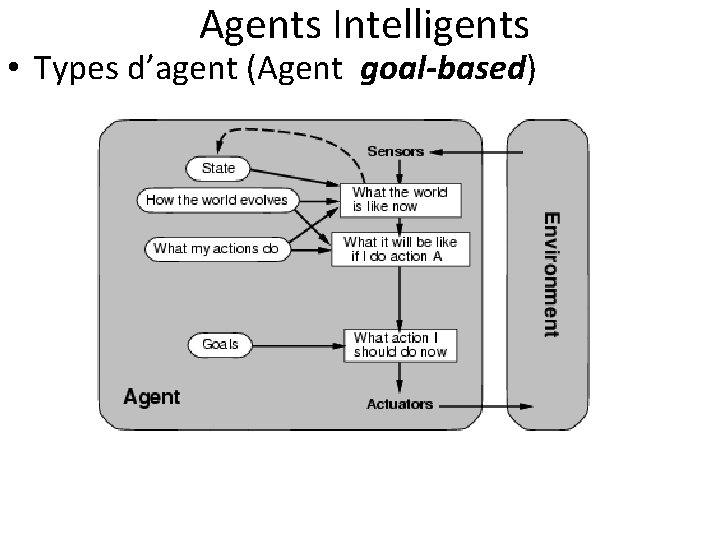

Agents Intelligents • Types d’agent (Agent goal-based)

Agents Intelligents • Types d’agent (Agent goal-based) • Le fait de connaître l’état actuel de l’environnement n’est pas toujours suffisant pour décider quelle(s) action(s) prendre. (ex: à une intersection, le taxi peut tourner à gauche, à droite, ou continuer tout droit). • La décision dépend alors de la destination où doit aller le taxi. • Pour un agent GOAL requiert de l’information sur les buts recherchés pour atteindre une situation désirable (ex: un taxi devant se rendre au domicile d’un passager).

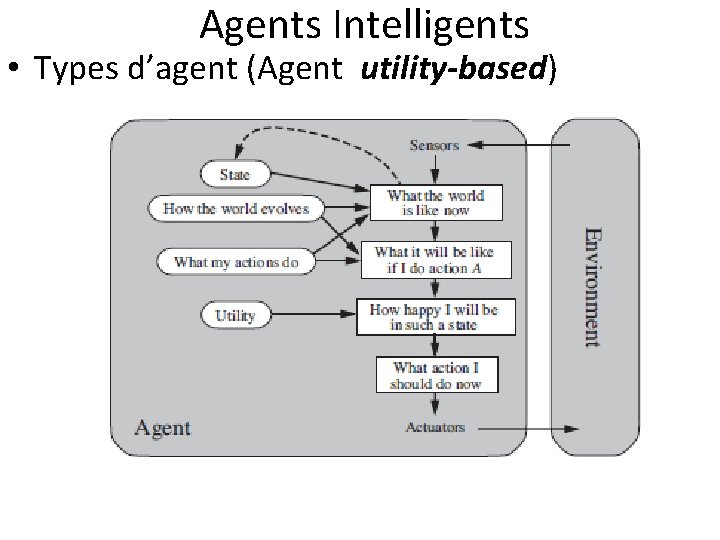

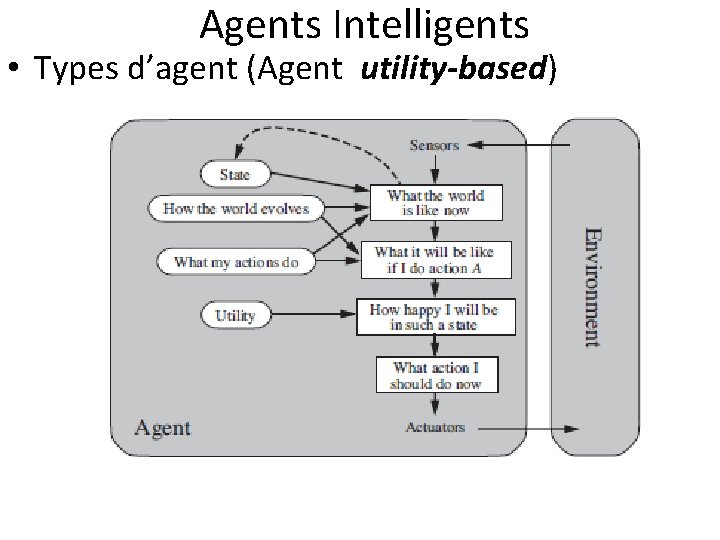

Agents Intelligents • Types d’agent (Agent utility-based)

Agents Intelligents • Types d’agent (Agent utility-based) • Les Buts seuls ne sont généralement pas suffisants pour générer des comportements adéquats dans la plupart des environnements (ex: plusieurs séquences d’actions peuvent amener le taxi à sa destination donc atteindre son but, mais quelle séquence d’actions est optimale? ). • Une mesure plus générale de la performance est alors requise pour ainsi maximiser le niveau de satisfaction (maximizing the expected utility) dans la recherche d’un but à atteindre. • Sachant que la perception du monde est partielle et stochastique les décisions prises comportent alors de l’incertitude. Les actions choisies maximisent alors l’expected utility (utilité espérée)