Les rseaux de neurones pour lapprentissage ESSEC le

- Slides: 73

Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Réseaux de neurones artificiels « programmation par l’exemple » S. Canu, laboratoire PSI, INSA de Rouen équipe « systèmes d’information pour l’environnement » asi. insa-rouen. fr/~scanu

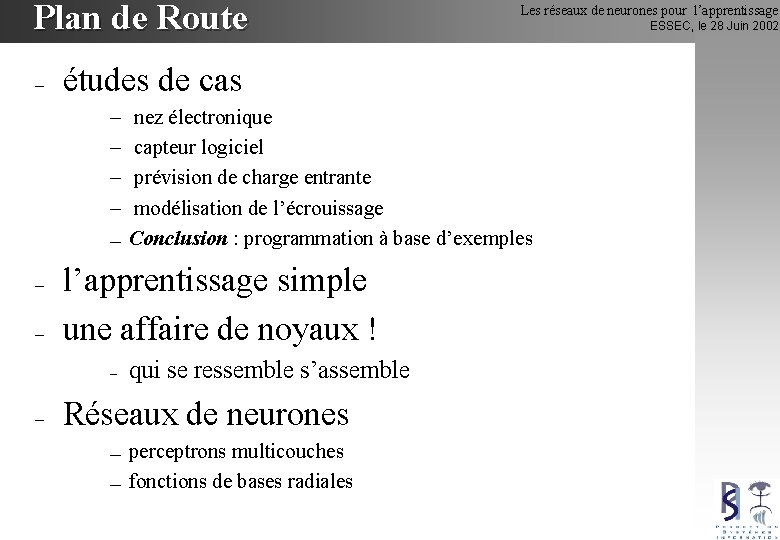

Plan de Route – études de cas – – — – – nez électronique capteur logiciel prévision de charge entrante modélisation de l’écrouissage Conclusion : programmation à base d’exemples l’apprentissage simple une affaire de noyaux ! – – Les réseaux de neurones pour l’apprentissage qui se ressemble s’assemble Réseaux de neurones — — perceptrons multicouches fonctions de bases radiales ESSEC, le 28 Juin 2002

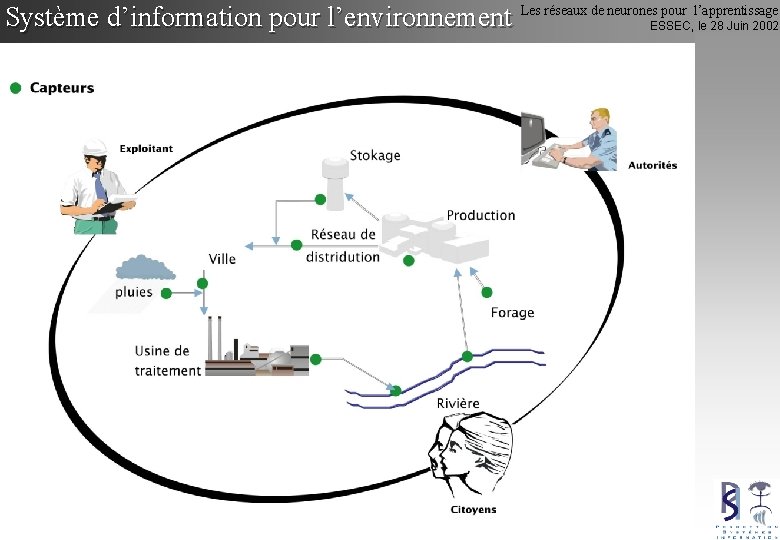

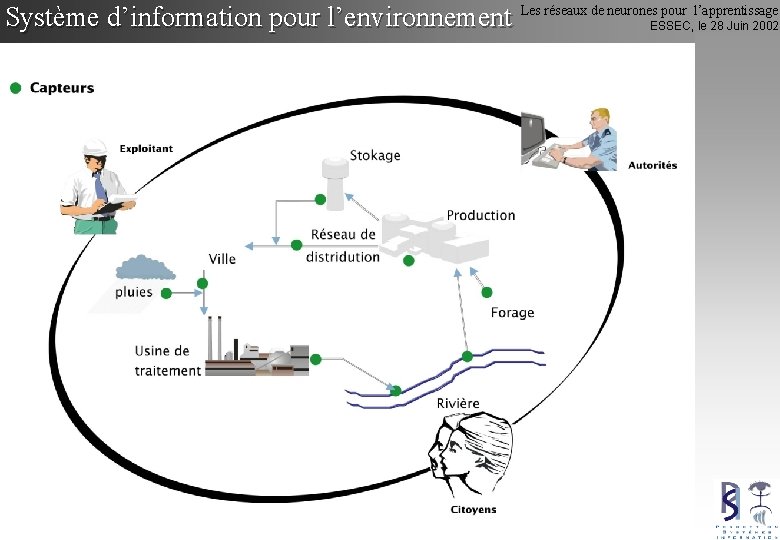

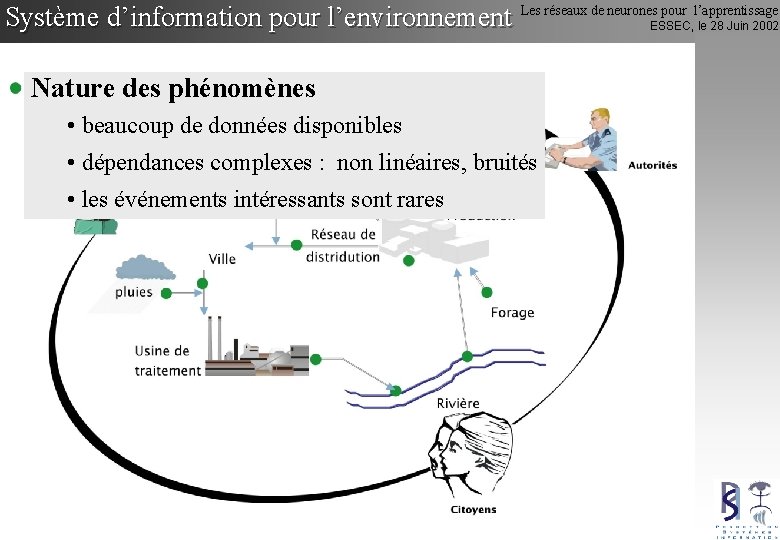

Système d’information pour l’environnement Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

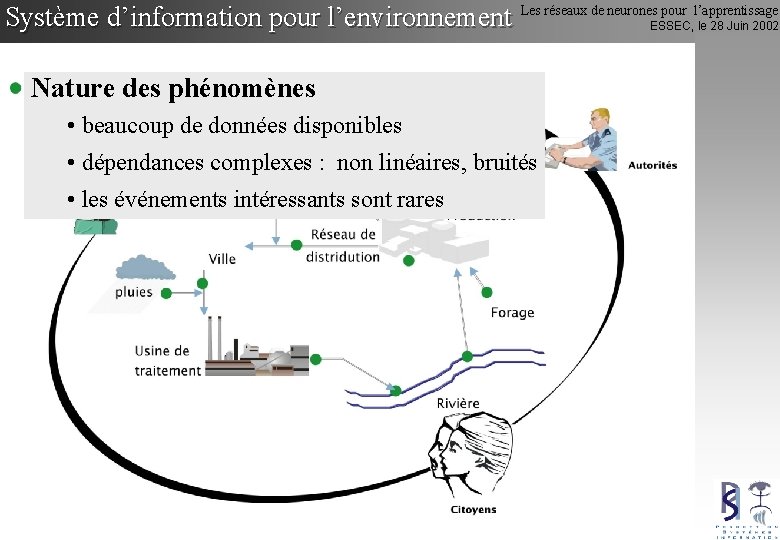

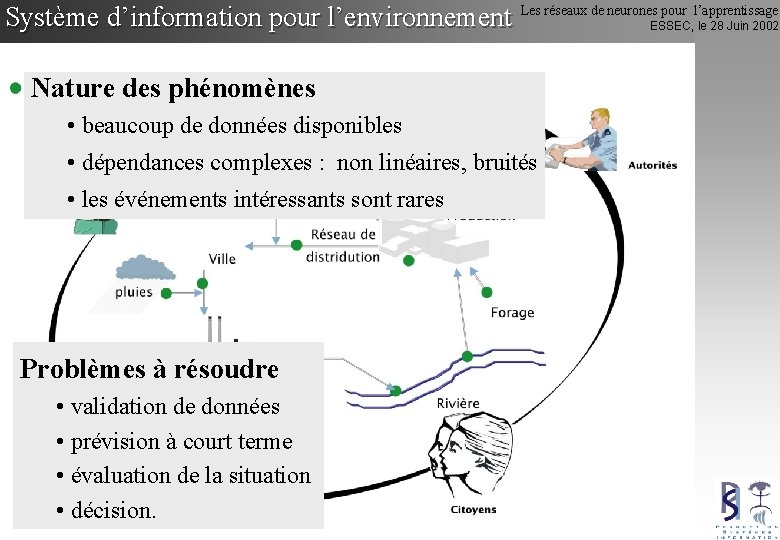

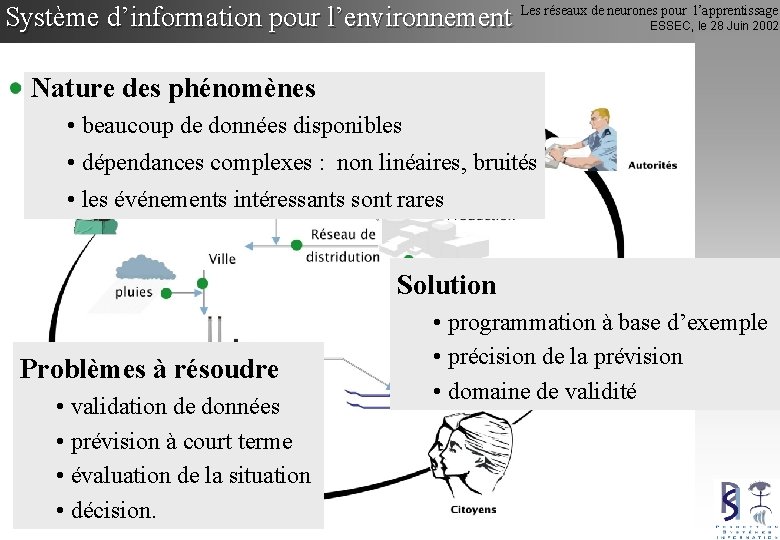

Système d’information pour l’environnement Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Nature des phénomènes • beaucoup de données disponibles • dépendances complexes : non linéaires, bruités • les événements intéressants sont rares

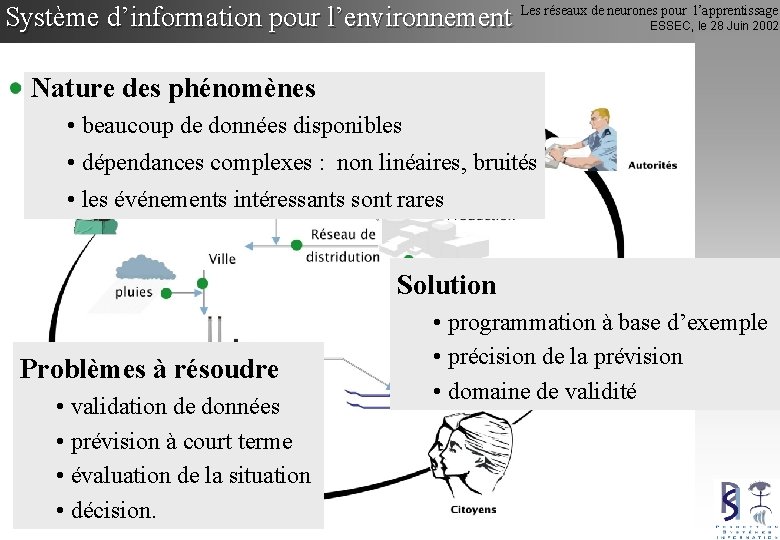

Système d’information pour l’environnement Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Nature des phénomènes • beaucoup de données disponibles • dépendances complexes : non linéaires, bruités • les événements intéressants sont rares Problèmes à résoudre • validation de données • prévision à court terme • évaluation de la situation • décision.

Système d’information pour l’environnement Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Nature des phénomènes • beaucoup de données disponibles • dépendances complexes : non linéaires, bruités • les événements intéressants sont rares Solution Problèmes à résoudre • validation de données • prévision à court terme • évaluation de la situation • décision. • programmation à base d’exemple • précision de la prévision • domaine de validité

Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Quelques exemples

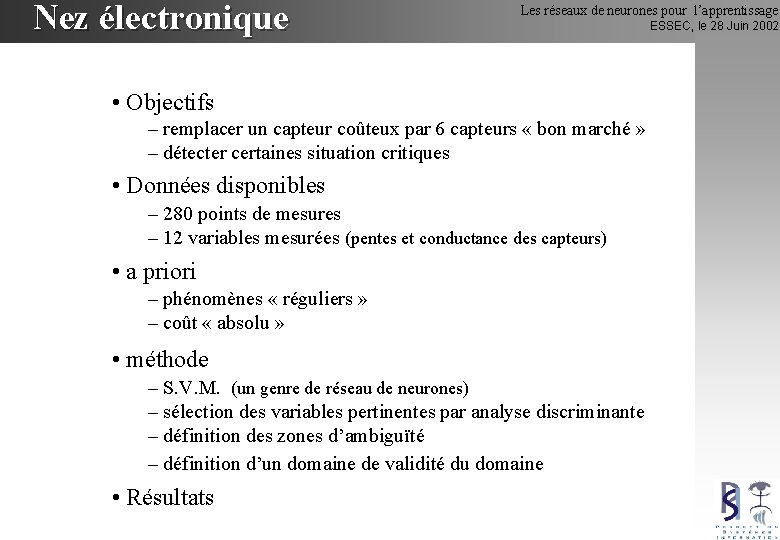

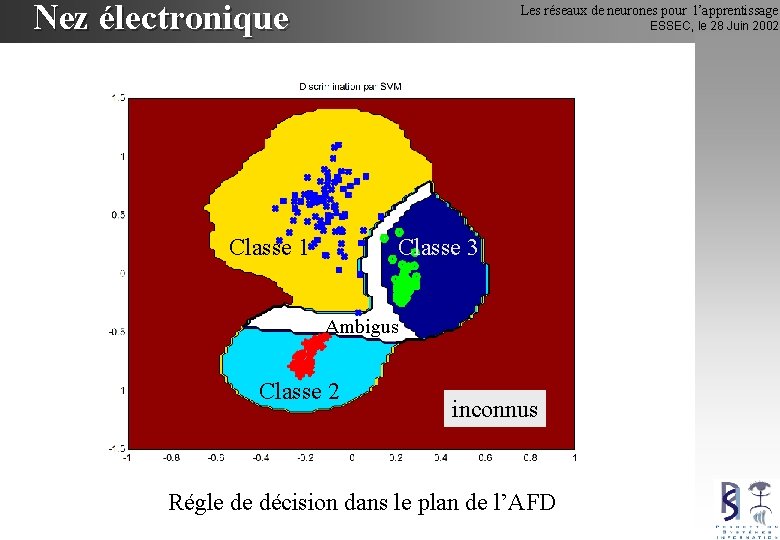

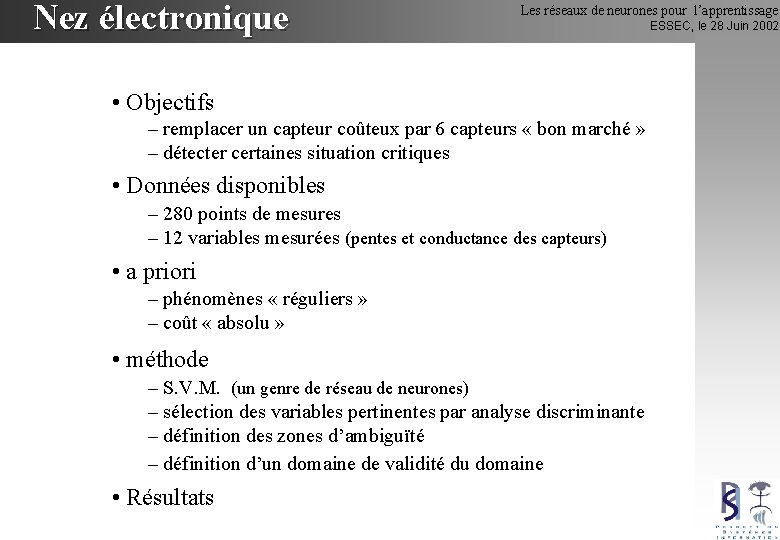

Nez électronique Les réseaux de neurones pour l’apprentissage • Objectifs – remplacer un capteur coûteux par 6 capteurs « bon marché » – détecter certaines situation critiques • Données disponibles – 280 points de mesures – 12 variables mesurées (pentes et conductance des capteurs) • a priori – phénomènes « réguliers » – coût « absolu » • méthode – S. V. M. (un genre de réseau de neurones) – sélection des variables pertinentes par analyse discriminante – définition des zones d’ambiguïté – définition d’un domaine de validité du domaine • Résultats ESSEC, le 28 Juin 2002

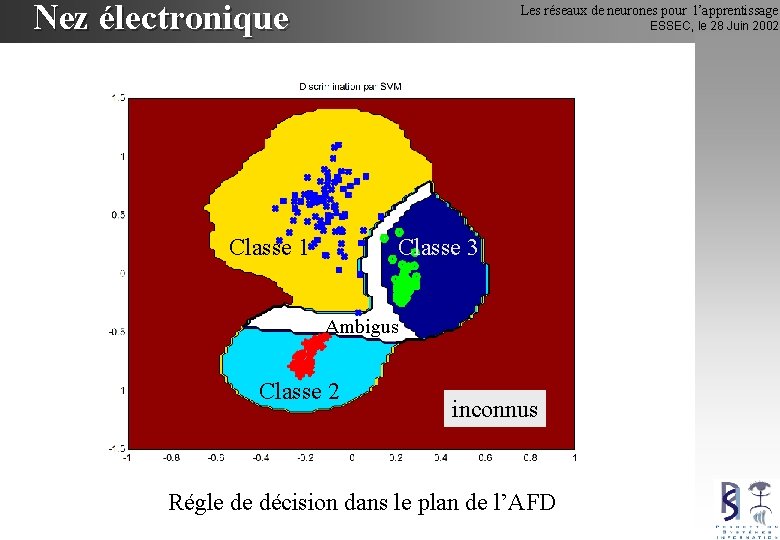

Nez électronique Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Classe 1 Classe 3 Ambigus Classe 2 inconnus Régle de décision dans le plan de l’AFD

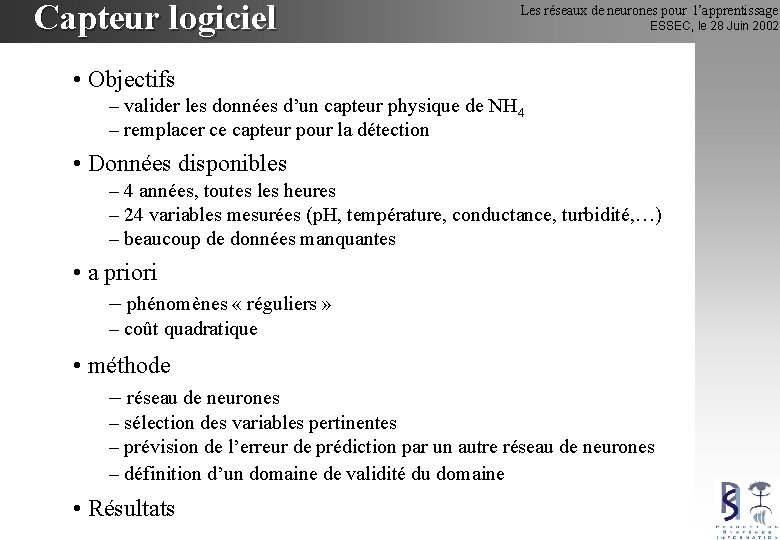

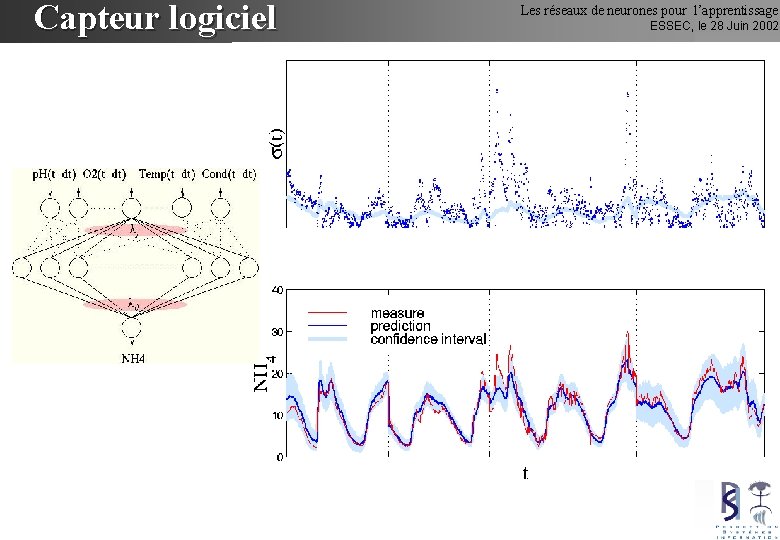

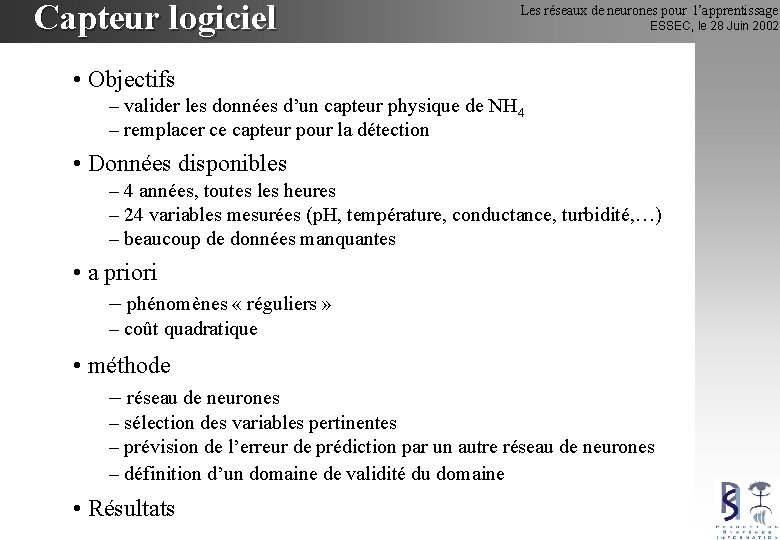

Capteur logiciel Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 • Objectifs – valider les données d’un capteur physique de NH 4 – remplacer ce capteur pour la détection • Données disponibles – 4 années, toutes les heures – 24 variables mesurées (p. H, température, conductance, turbidité, …) – beaucoup de données manquantes • a priori – phénomènes « réguliers » – coût quadratique • méthode – réseau de neurones – sélection des variables pertinentes – prévision de l’erreur de prédiction par un autre réseau de neurones – définition d’un domaine de validité du domaine • Résultats

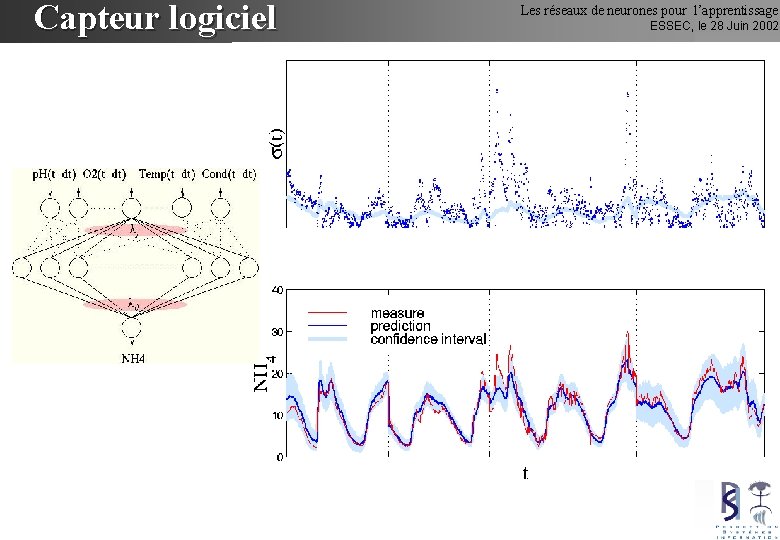

Capteur logiciel Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

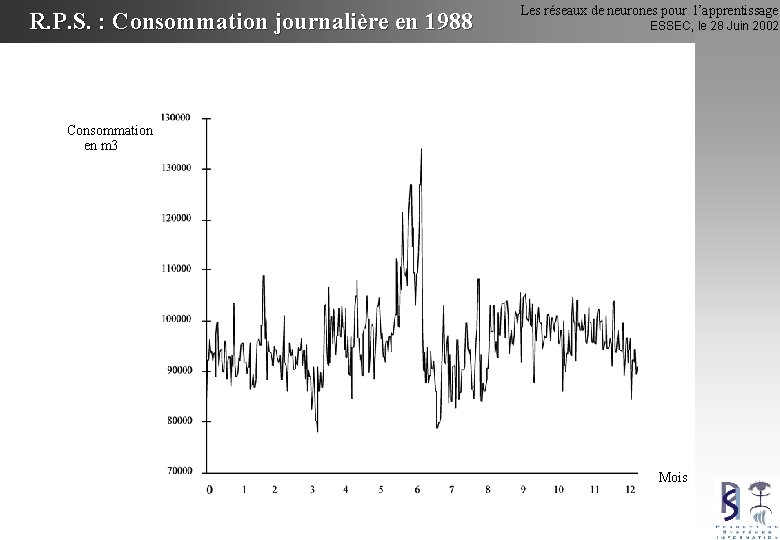

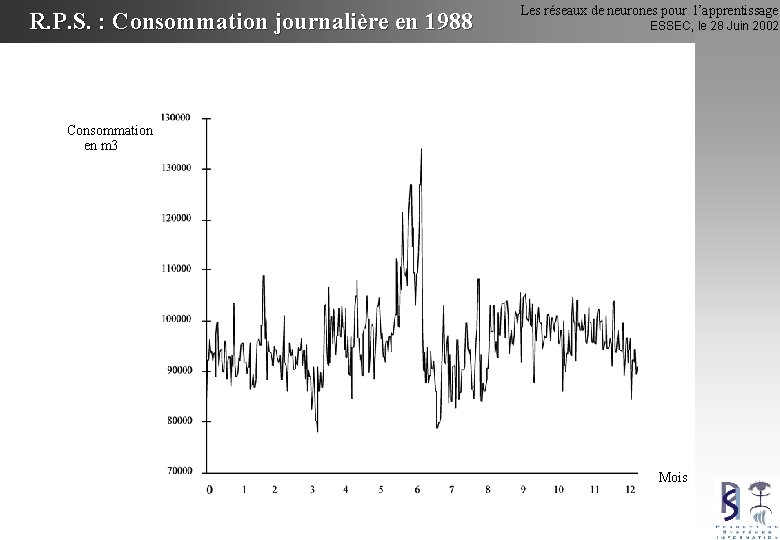

R. P. S. : Consommation journalière en 1988 Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Consommation en m 3 Mois

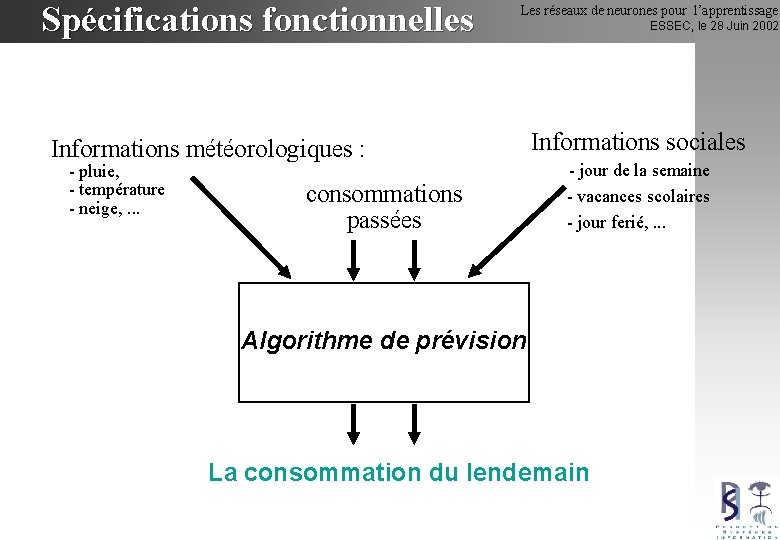

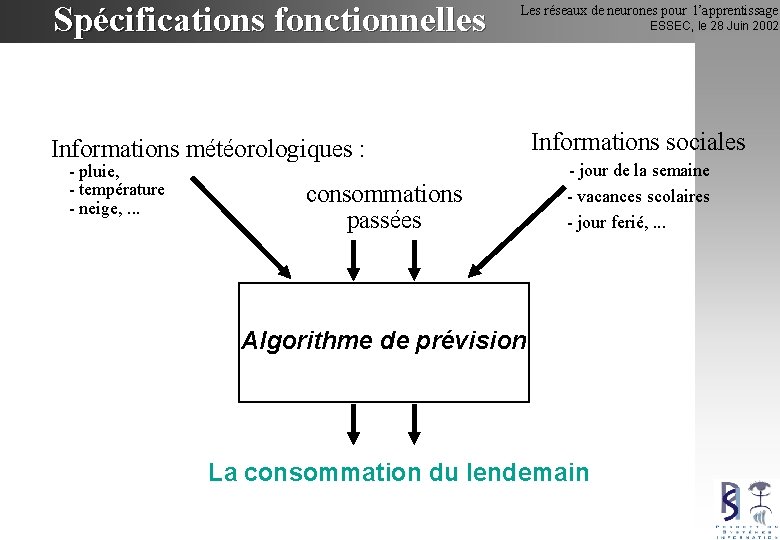

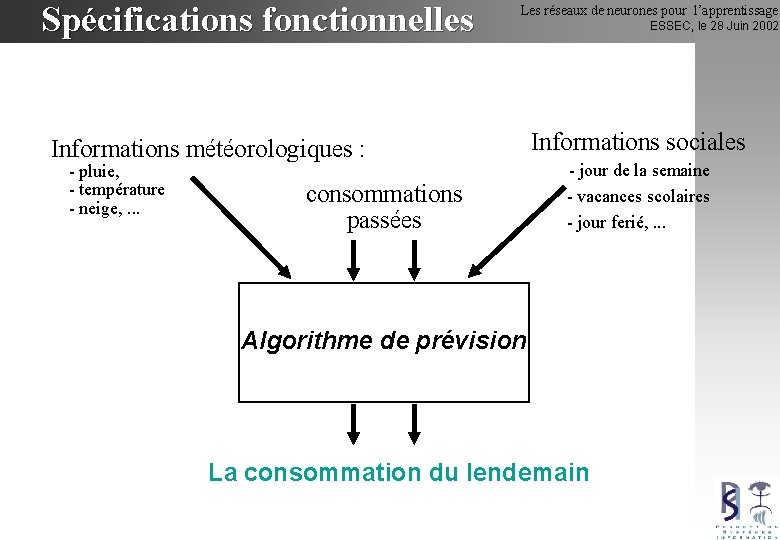

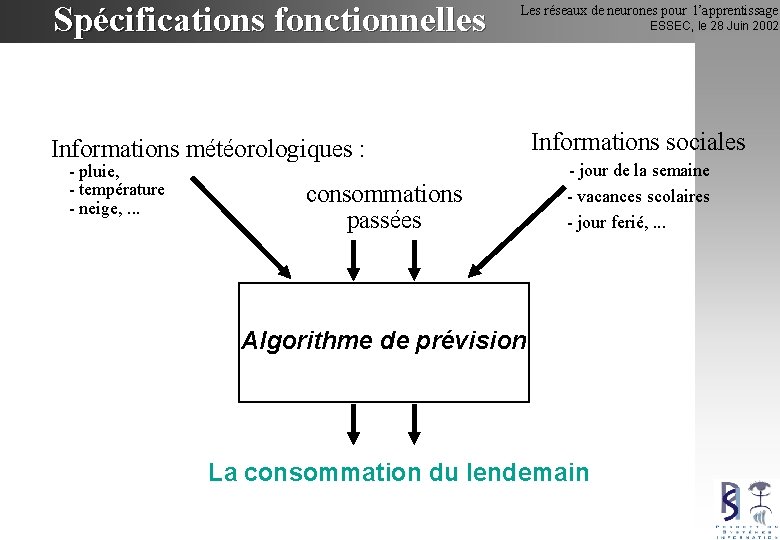

Spécifications fonctionnelles Informations météorologiques : - pluie, - température - neige, . . . consommations passées Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Informations sociales - jour de la semaine - vacances scolaires - jour ferié, . . . Algorithme de prévision La consommation du lendemain

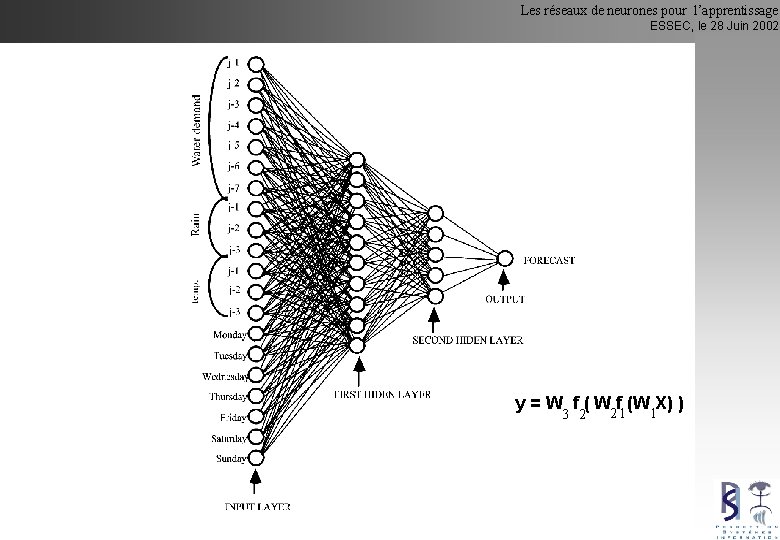

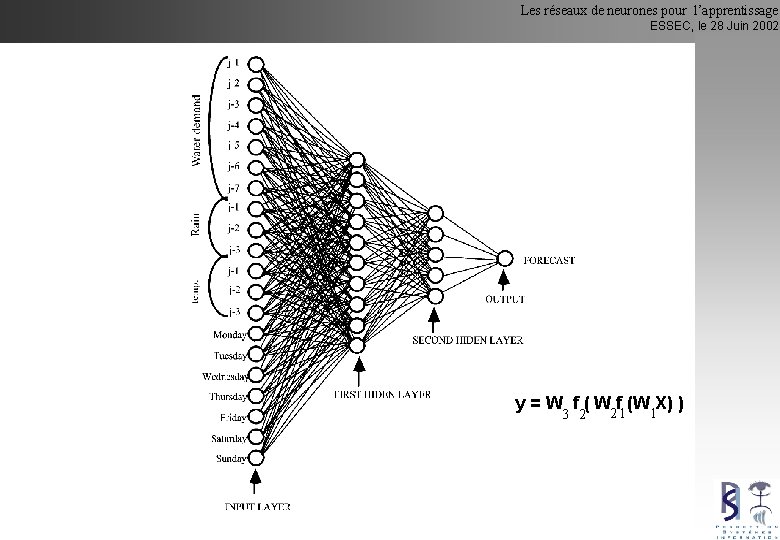

Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 RNA y = W f ( W 2 f 1 (W 1 X) ) 3 2

Spécifications fonctionnelles Informations météorologiques : - pluie, - température - neige, . . . consommations passées Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Informations sociales - jour de la semaine - vacances scolaires - jour ferié, . . . Algorithme de prévision La consommation du lendemain

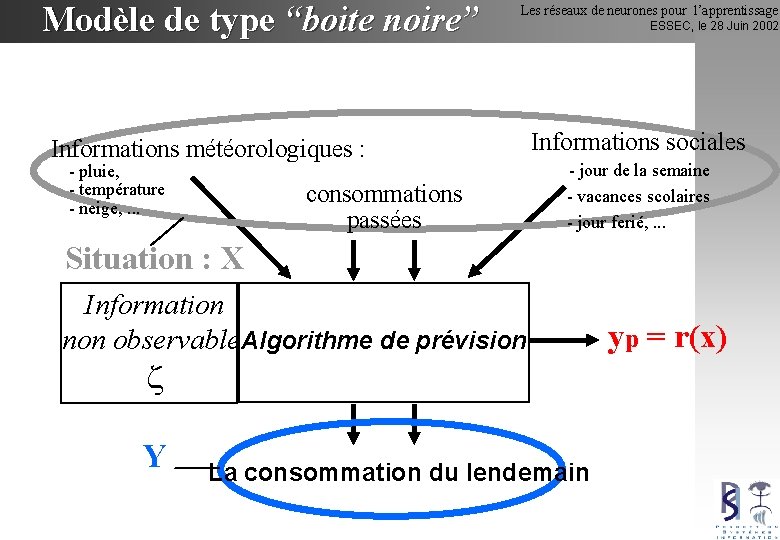

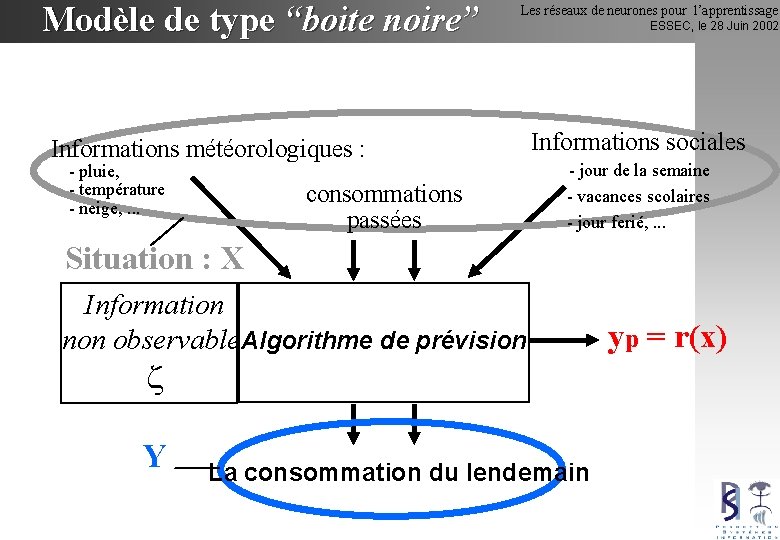

Modèle de type “boite noire” Informations météorologiques : - pluie, - température - neige, . . . consommations passées Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Informations sociales - jour de la semaine - vacances scolaires - jour ferié, . . . Situation : X Information non observable. Algorithme de prévision Y La consommation du lendemain yp = r(x)

Les réseaux de neurones pour l’apprentissage Prévision de la classe de qualité du bois ESSEC, le 28 Juin 2002 • But : Minimiser les erreurs de classement • Données : – 550 points de mesures – Entrées : mesures physique sur les planches – Sorties : point de rupture Classe • Informations a priori – nature des classes

Prévision de la charge entrante Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 • Objectifs – prévoir quand et quelle quantité de polluant va arriver à . la station d’épuration • Données disponibles – 12 années, toutes les heures – 24 variables mesurées : pluie, charge entrante, température • a priori – phénomènes « réguliers » – coût quadratique • méthode – prévision de la pluie par un réseau de neurones – prévision de la charge par un second réseau de neurones – structurer les réseaux de neurones à priori – définition d’un domaine de validité du domaine

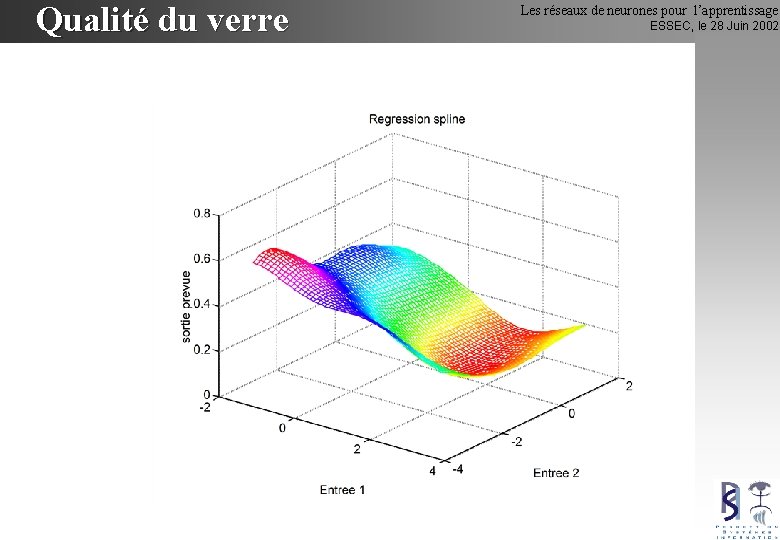

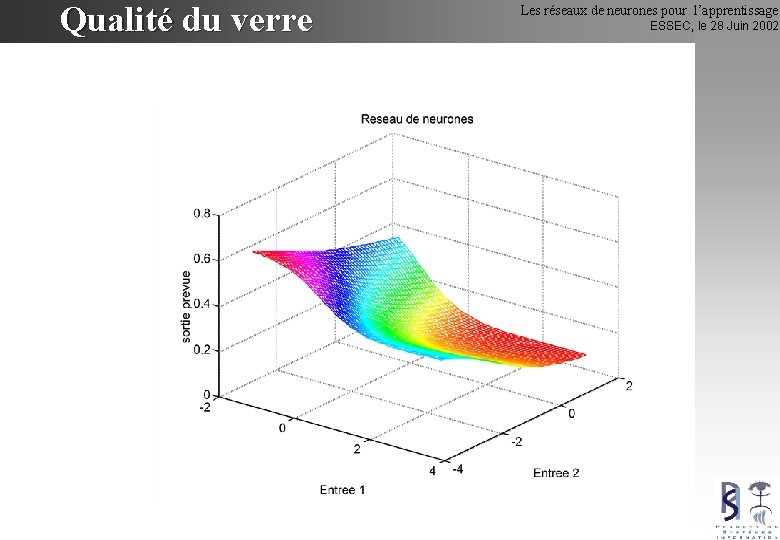

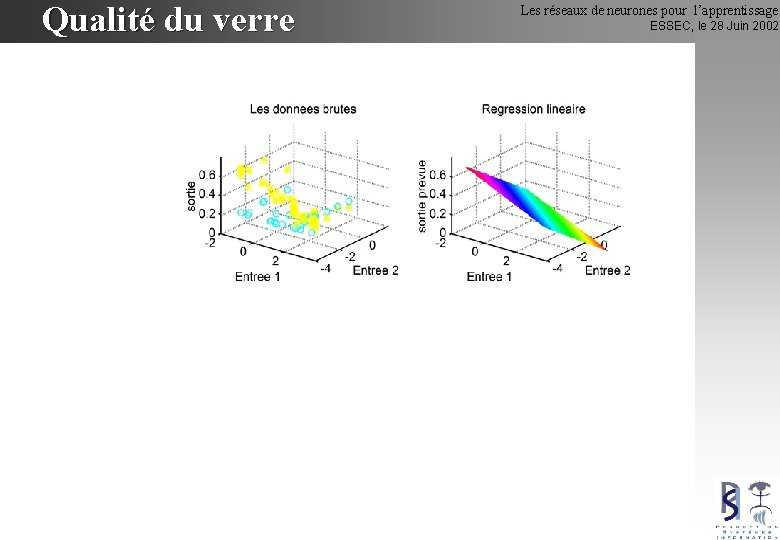

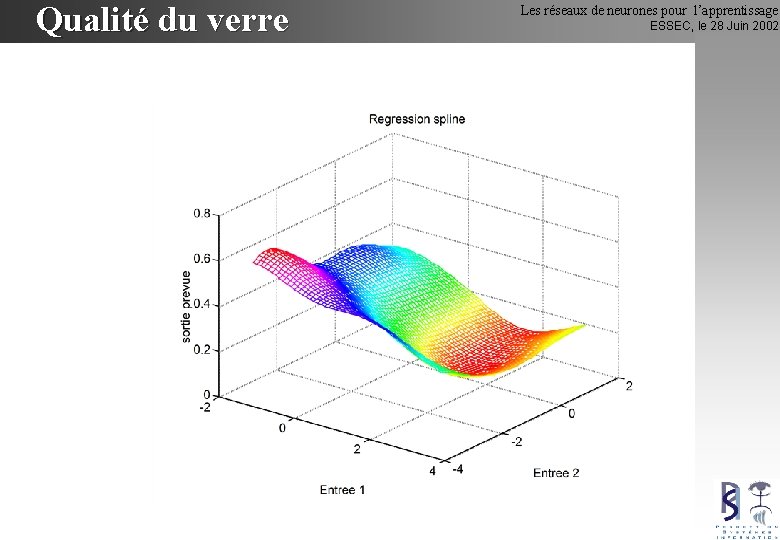

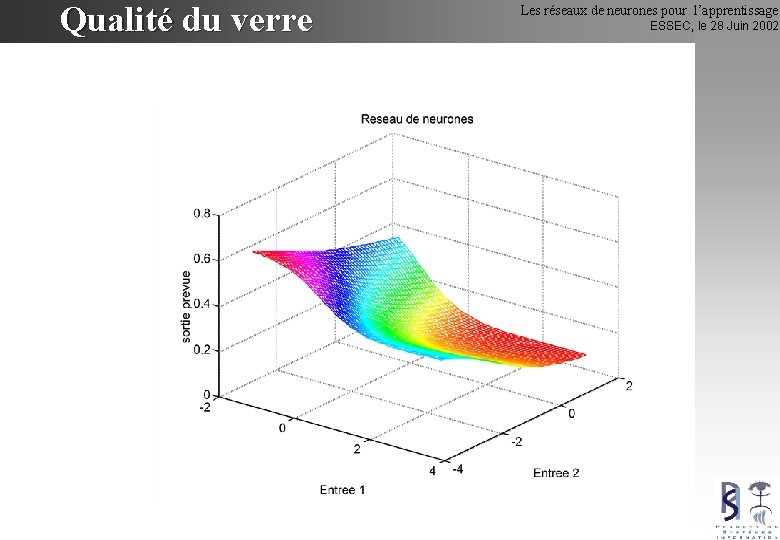

Optimisation de la qualité du verre (Saint Gobain) Les réseaux de neurones pour l’apprentissage • But : Optimiser la fabrication • Données : – 127 points de mesures (plan d’expérience) – Entrées : quantités de “sables” – Sorties : mesures physiques • Informations a priori – pas de variations brusques (monotonie) ESSEC, le 28 Juin 2002

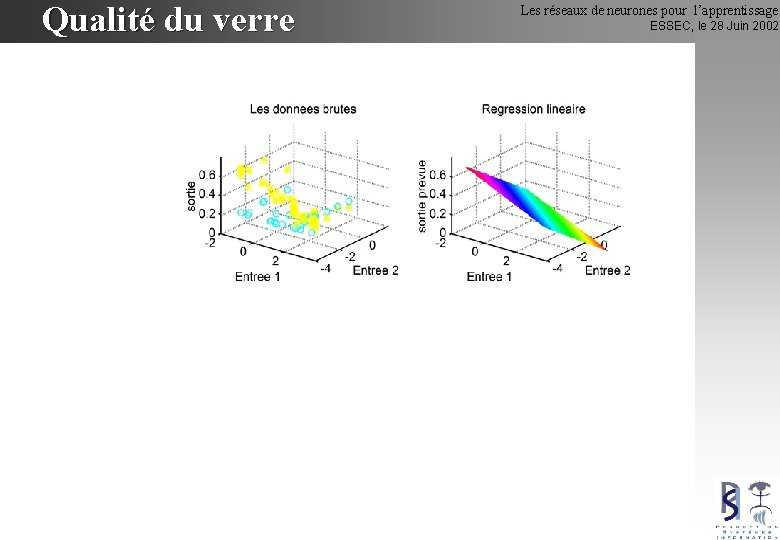

Qualité du verre Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

Qualité du verre Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

Qualité du verre Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

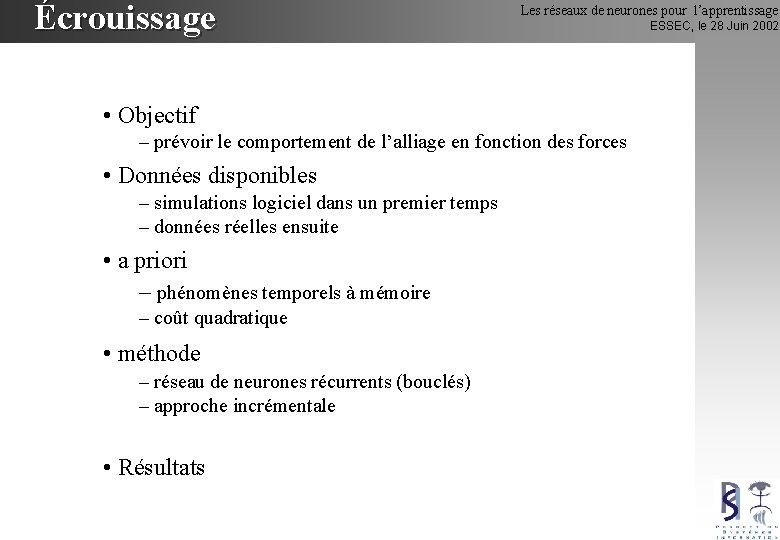

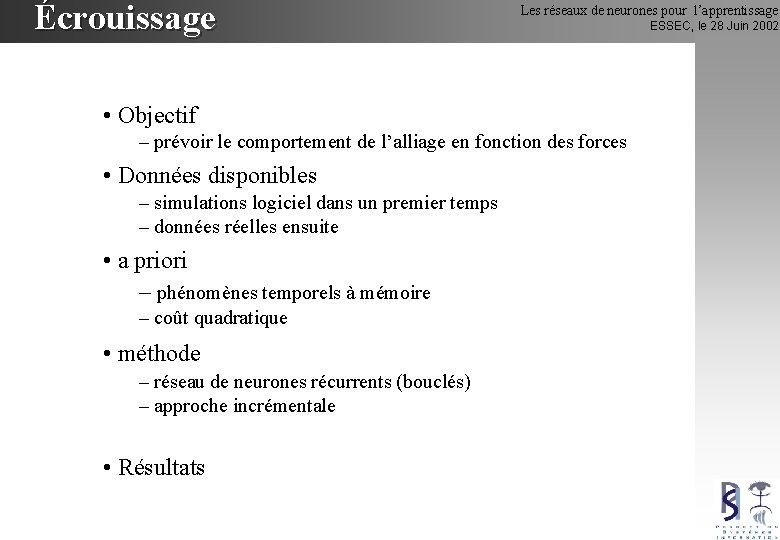

Écrouissage Les réseaux de neurones pour l’apprentissage • Objectif – prévoir le comportement de l’alliage en fonction des forces • Données disponibles – simulations logiciel dans un premier temps – données réelles ensuite • a priori – phénomènes temporels à mémoire – coût quadratique • méthode – réseau de neurones récurrents (bouclés) – approche incrémentale • Résultats ESSEC, le 28 Juin 2002

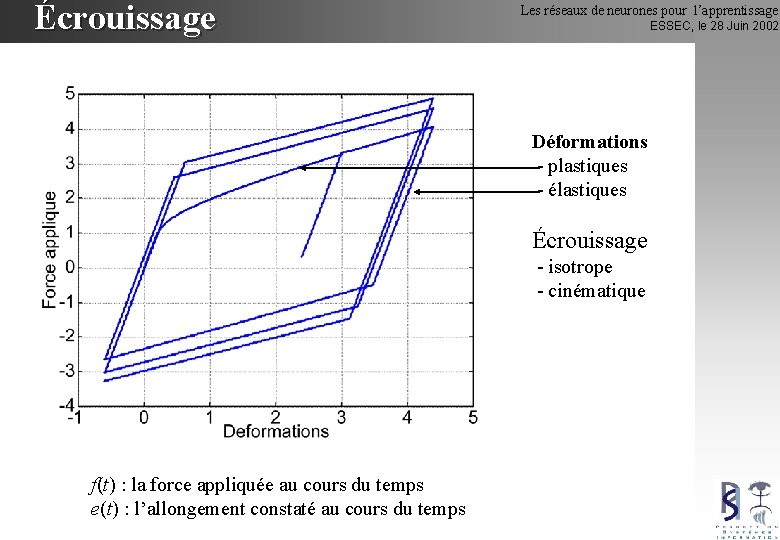

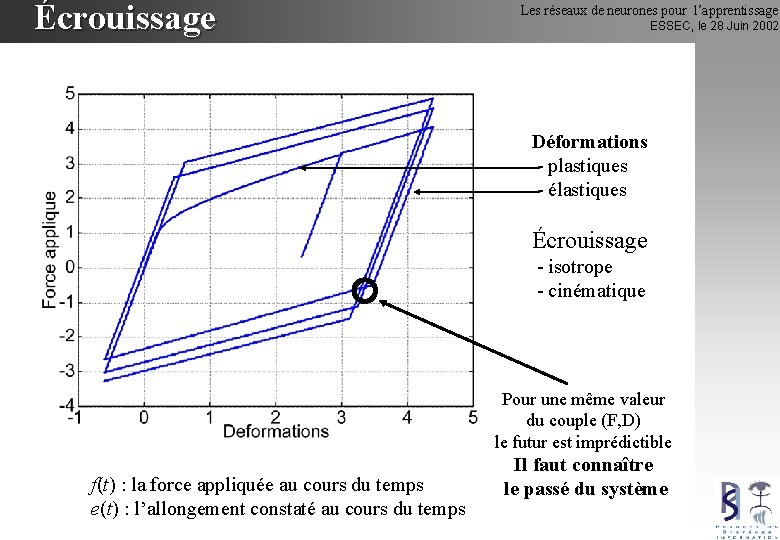

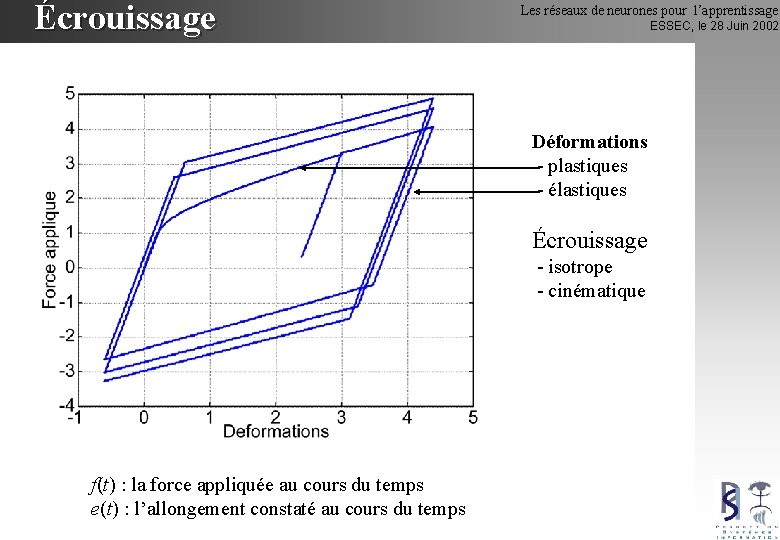

Écrouissage Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Déformations - plastiques - élastiques Écrouissage - isotrope - cinématique f(t) : la force appliquée au cours du temps e(t) : l’allongement constaté au cours du temps

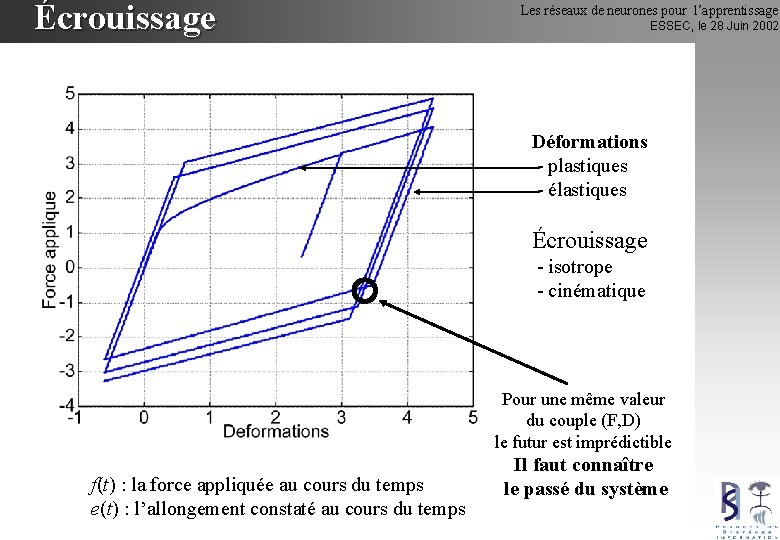

Écrouissage Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Déformations - plastiques - élastiques Écrouissage - isotrope - cinématique Pour une même valeur du couple (F, D) le futur est imprédictible f(t) : la force appliquée au cours du temps e(t) : l’allongement constaté au cours du temps Il faut connaître le passé du système

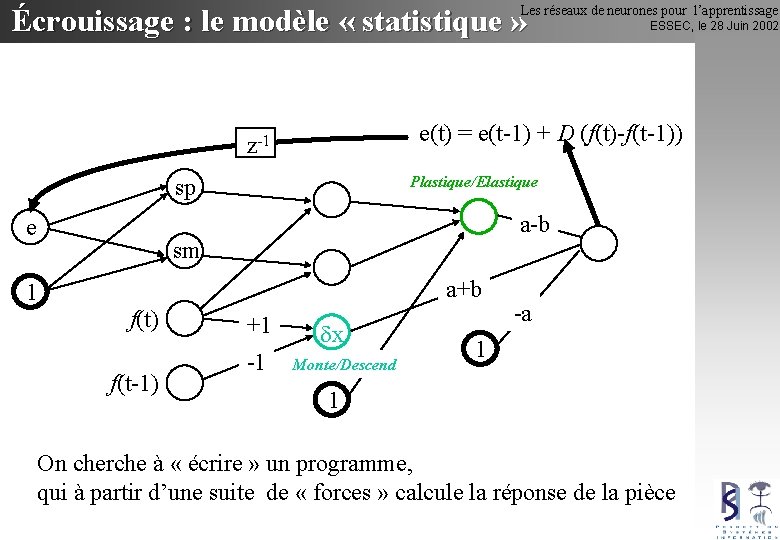

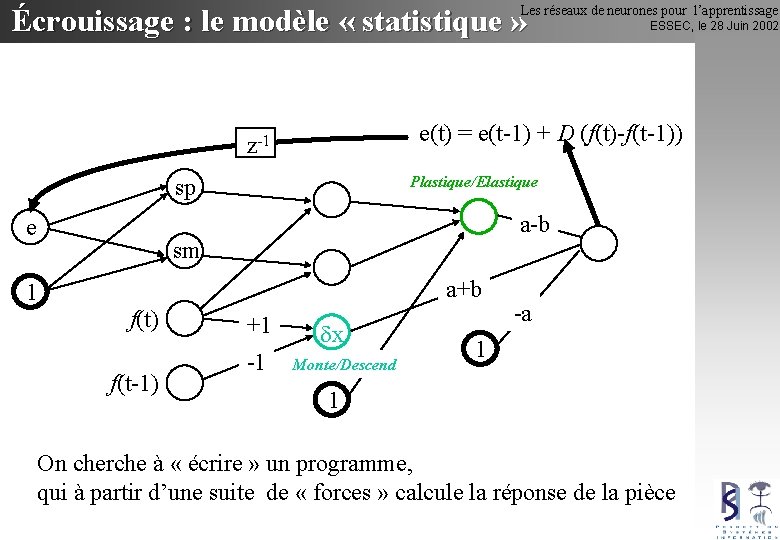

Écrouissage : le modèle « statistique » Les réseaux de neurones pour l’apprentissage e(t) = e(t-1) + D (f(t)-f(t-1)) z-1 Plastique/Elastique sp e a-b sm a+b 1 f(t) f(t-1) ESSEC, le 28 Juin 2002 +1 -1 x Monte/Descend -a 1 1 On cherche à « écrire » un programme, qui à partir d’une suite de « forces » calcule la réponse de la pièce

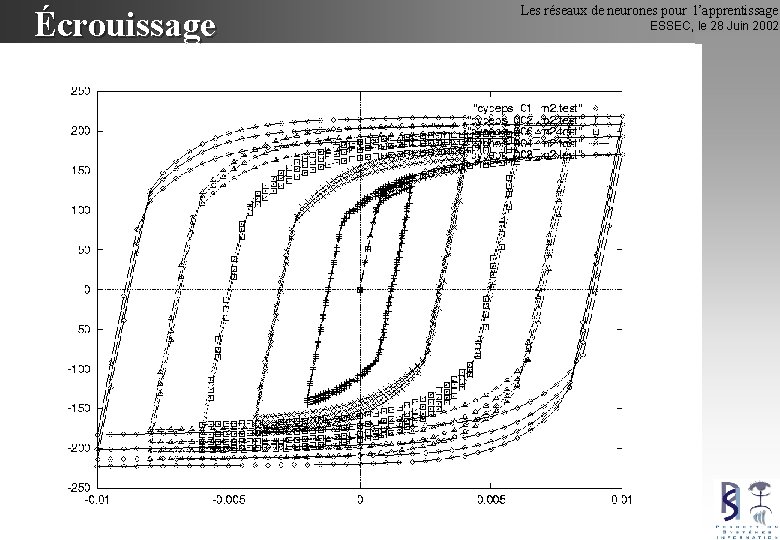

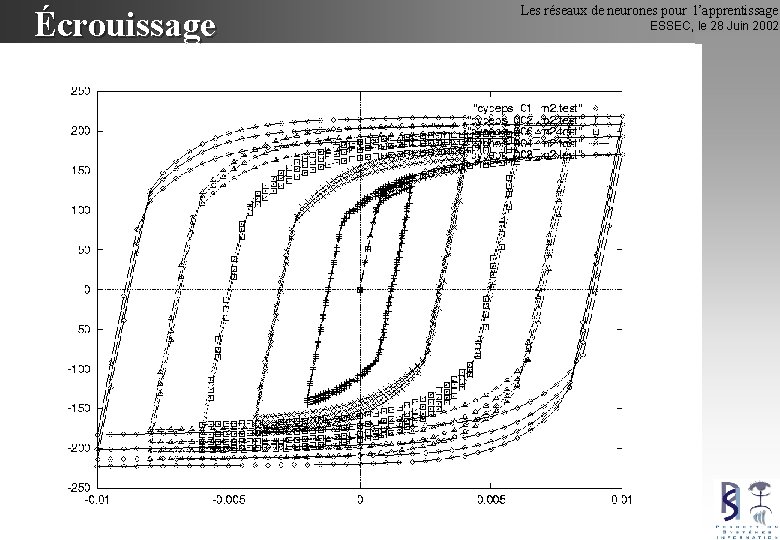

Écrouissage Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

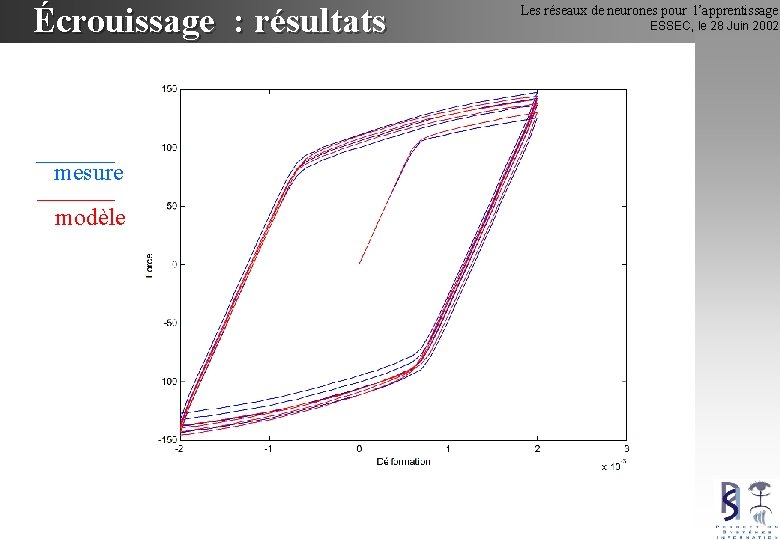

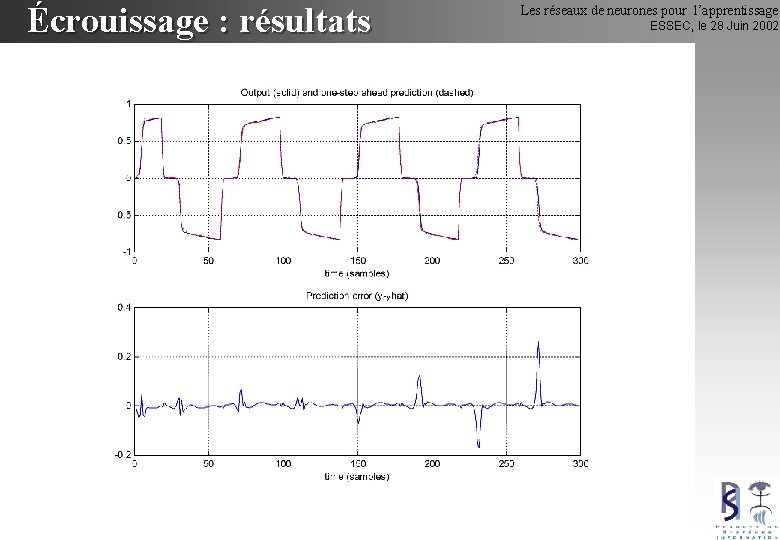

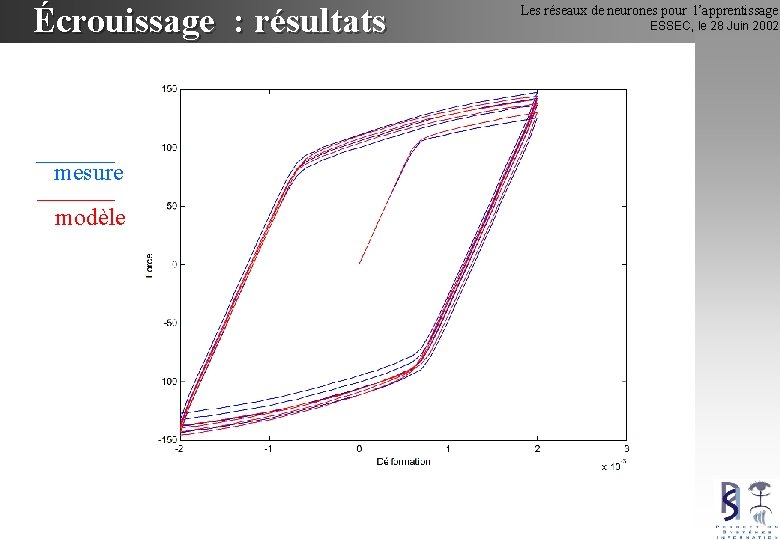

Écrouissage : résultats mesure modèle Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

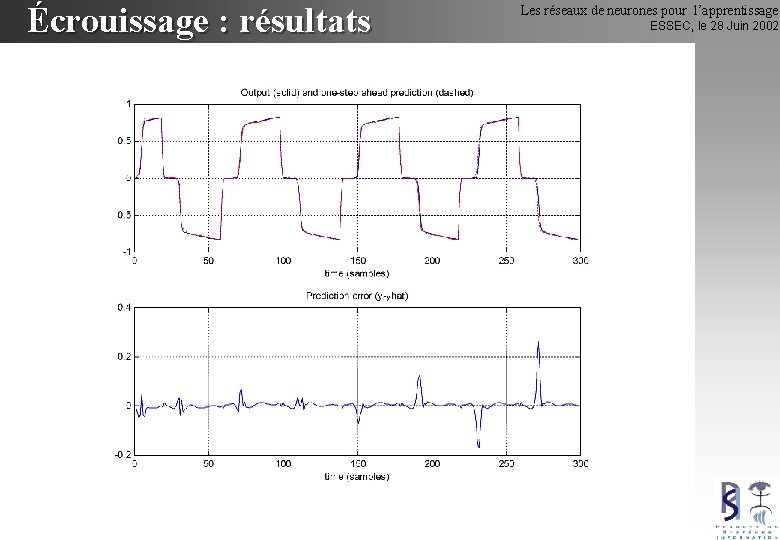

Écrouissage : résultats Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

Programmation à base d’exemples Les réseaux de neurones pour l’apprentissage • • ESSEC, le 28 Juin 2002 Apprendre : des entrées : X, et des sorties : Y But : trouver une dépendance : r(X) Utilisation : pour un X donné : prévoir Y Connaissance : données : (Xi, Yi), i=1, n cout : C(x, r(x), y) a priori sur la structure du modèle • Difficultés : Généralisation données limitées remplir les trous • Tâches génériques : Discrimination, Régression, Prévision à un pas de temps, Identification

Programmation à base d’exemples Les réseaux de neurones pour l’apprentissage • • ESSEC, le 28 Juin 2002 Apprendre : des entrées : X, et des sorties : Y But : trouver une dépendance : r(X) Utilisation : pour un X donné : prévoir Y Connaissance : données : (Xi, Yi), i=1, n cout : C(x, r(x), y) a priori sur la structure du modèle • Difficultés : Généralisation données limitées remplir les trous • Tâches génériques : Discrimination, Régression, Prévision à un pas de temps, Identification Modules logiciels

Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Que peut on faire ?

Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Que peut on faire ? – résumer – classer – prévoir

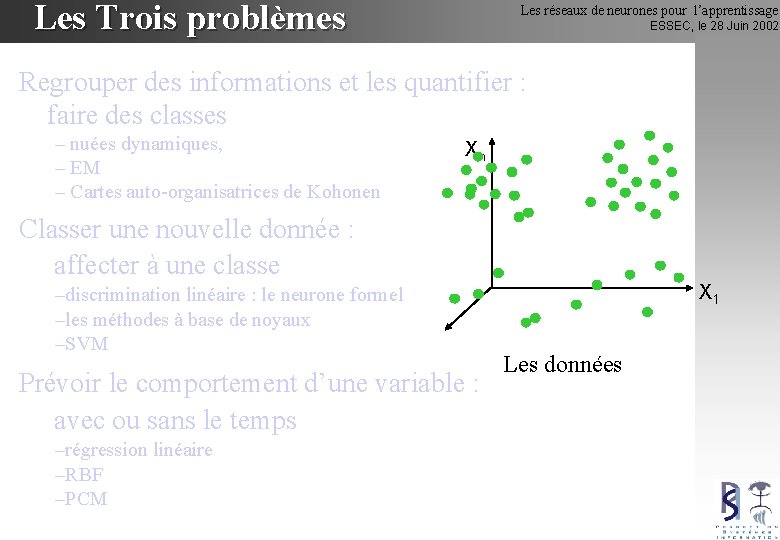

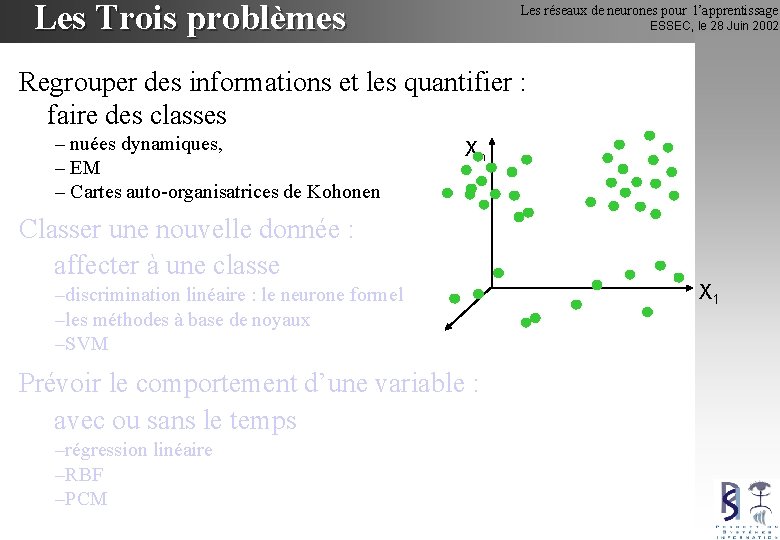

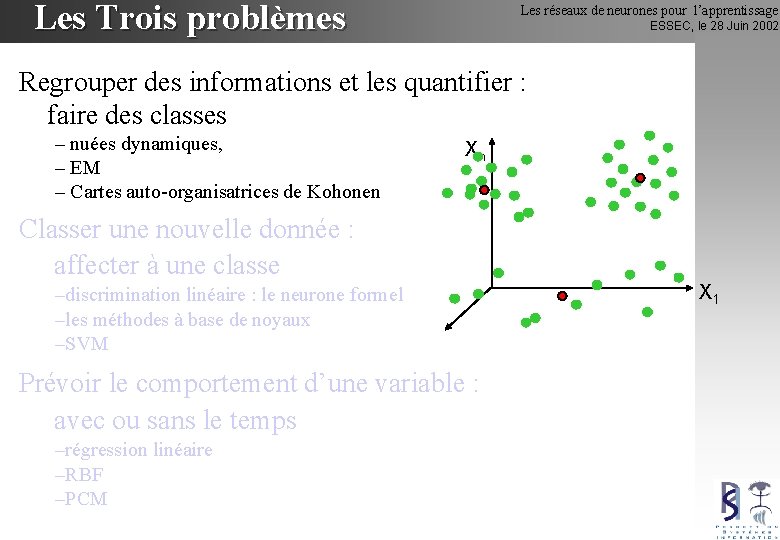

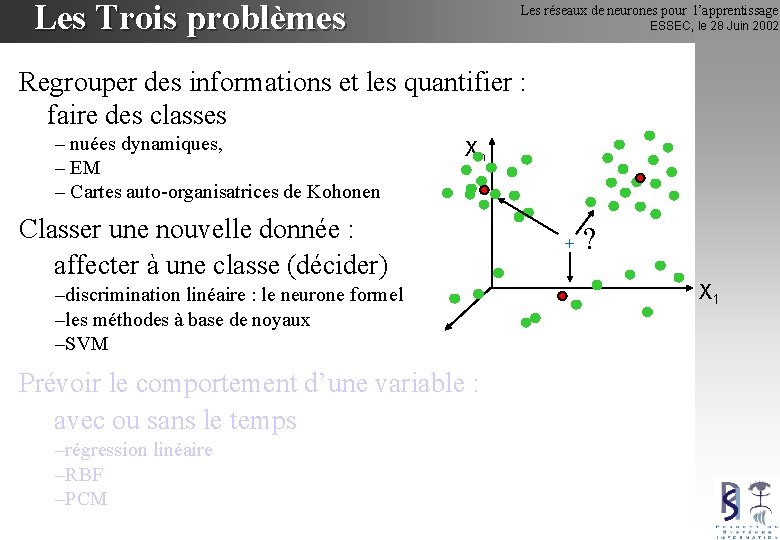

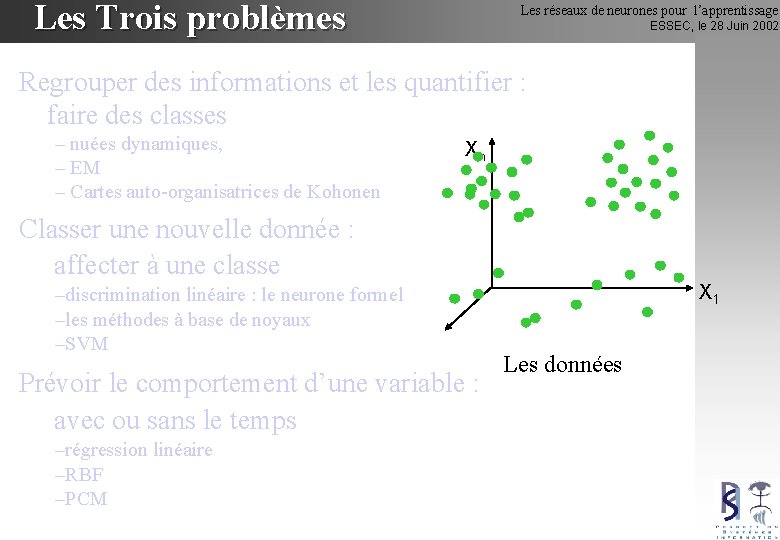

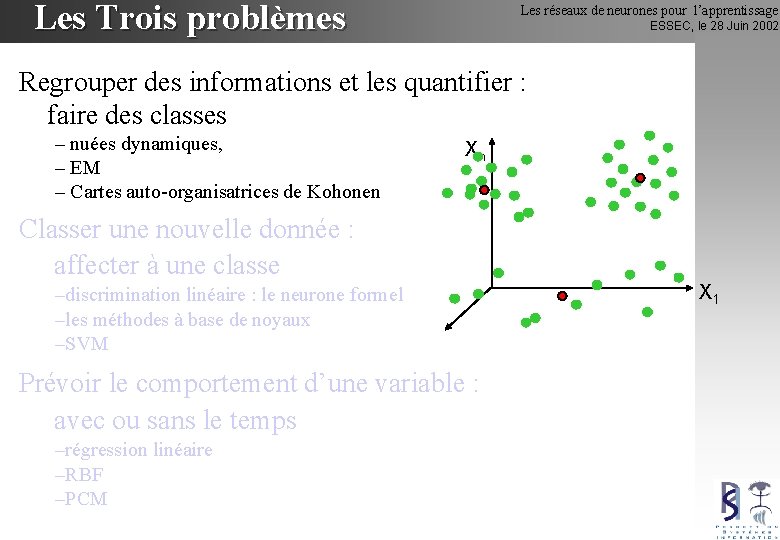

Les Trois problèmes Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Regrouper des informations et les quantifier : faire des classes – nuées dynamiques, – EM – Cartes auto-organisatrices de Kohonen Xn Classer une nouvelle donnée : affecter à une classe –discrimination linéaire : le neurone formel –les méthodes à base de noyaux –SVM Prévoir le comportement d’une variable : avec ou sans le temps –régression linéaire –RBF –PCM X 1 Les données

Les Trois problèmes Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Regrouper des informations et les quantifier : faire des classes – nuées dynamiques, – EM – Cartes auto-organisatrices de Kohonen Xn Classer une nouvelle donnée : affecter à une classe –discrimination linéaire : le neurone formel –les méthodes à base de noyaux –SVM Prévoir le comportement d’une variable : avec ou sans le temps –régression linéaire –RBF –PCM X 1

Les Trois problèmes Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Regrouper des informations et les quantifier : faire des classes – nuées dynamiques, – EM – Cartes auto-organisatrices de Kohonen Xn Classer une nouvelle donnée : affecter à une classe –discrimination linéaire : le neurone formel –les méthodes à base de noyaux –SVM Prévoir le comportement d’une variable : avec ou sans le temps –régression linéaire –RBF –PCM X 1

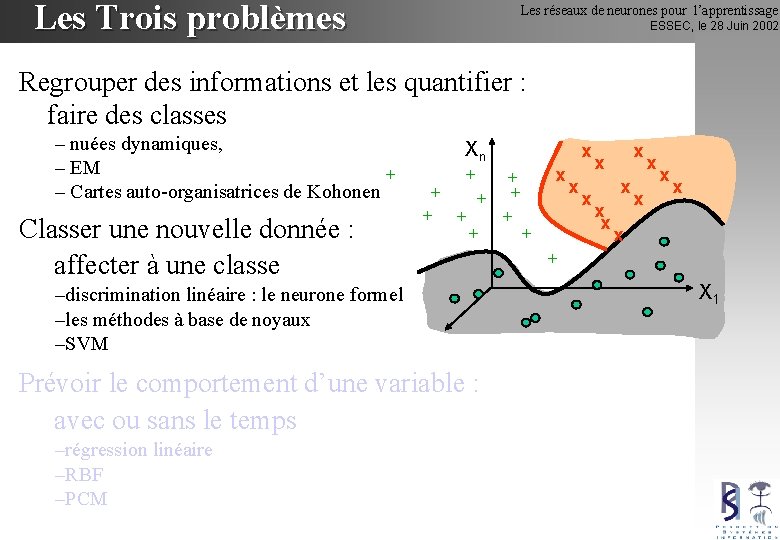

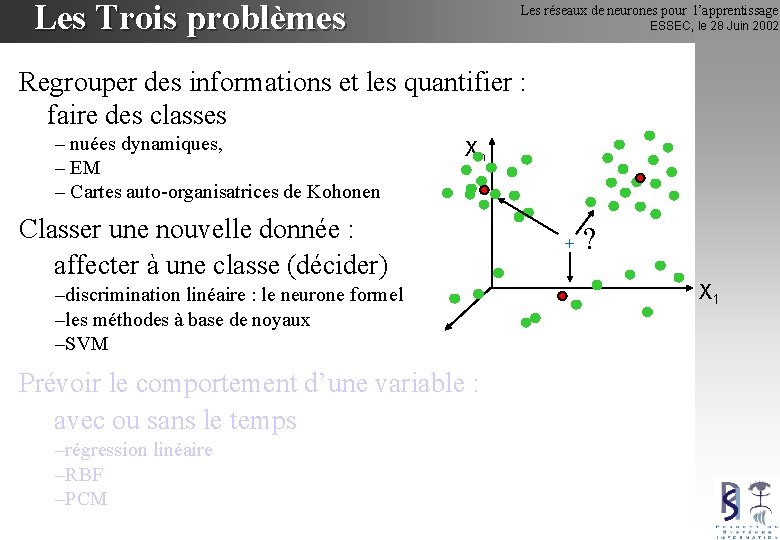

Les Trois problèmes Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Regrouper des informations et les quantifier : faire des classes – nuées dynamiques, – EM – Cartes auto-organisatrices de Kohonen Xn Classer une nouvelle donnée : affecter à une classe (décider) –discrimination linéaire : le neurone formel –les méthodes à base de noyaux –SVM Prévoir le comportement d’une variable : avec ou sans le temps –régression linéaire –RBF –PCM + ? X 1

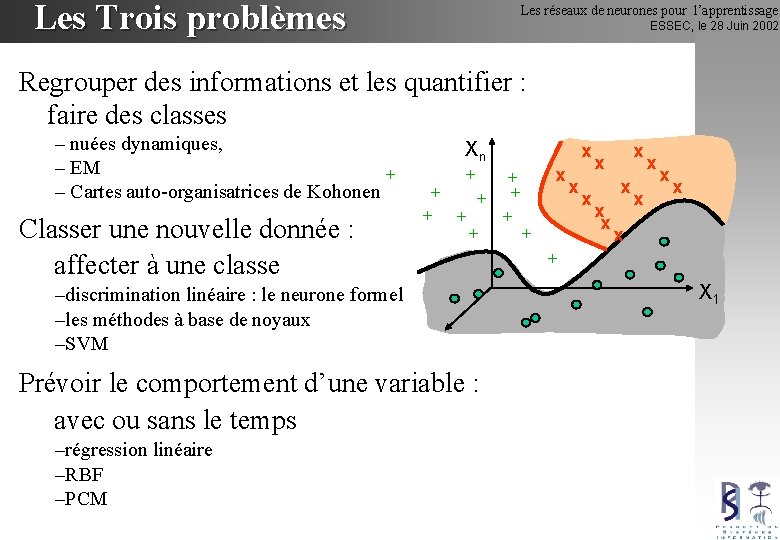

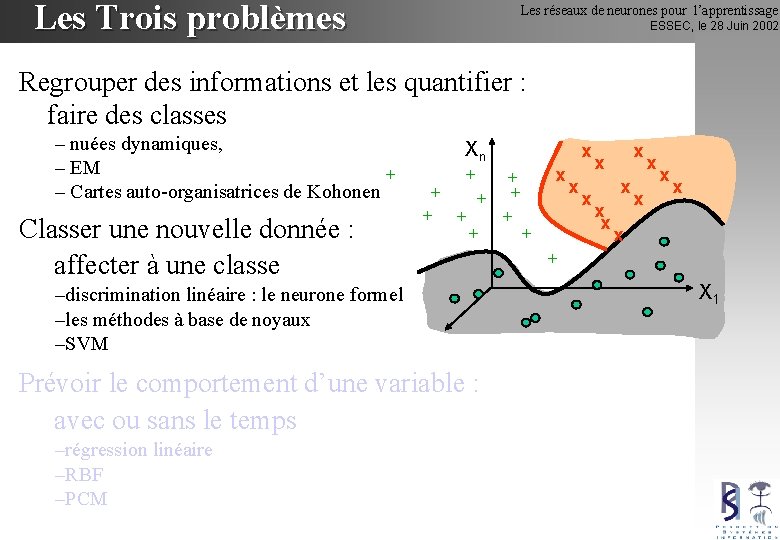

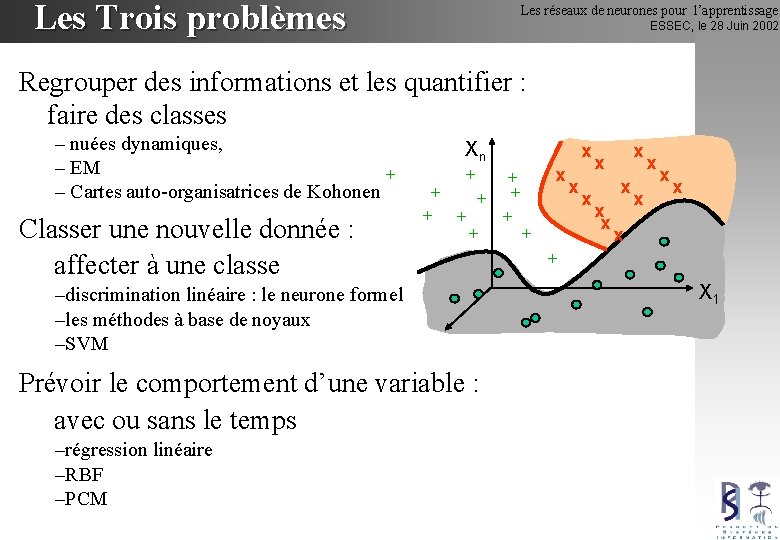

Les Trois problèmes Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Regrouper des informations et les quantifier : faire des classes – nuées dynamiques, – EM + – Cartes auto-organisatrices de Kohonen Classer une nouvelle donnée : affecter à une classe Xn + + + + + –discrimination linéaire : le neurone formel –les méthodes à base de noyaux –SVM Prévoir le comportement d’une variable : avec ou sans le temps –régression linéaire –RBF –PCM x x x x + X 1

Les Trois problèmes Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Regrouper des informations et les quantifier : faire des classes – nuées dynamiques, – EM + – Cartes auto-organisatrices de Kohonen Classer une nouvelle donnée : affecter à une classe Xn + + + + + –discrimination linéaire : le neurone formel –les méthodes à base de noyaux –SVM Prévoir le comportement d’une variable : avec ou sans le temps –régression linéaire –RBF –PCM x x x x + X 1

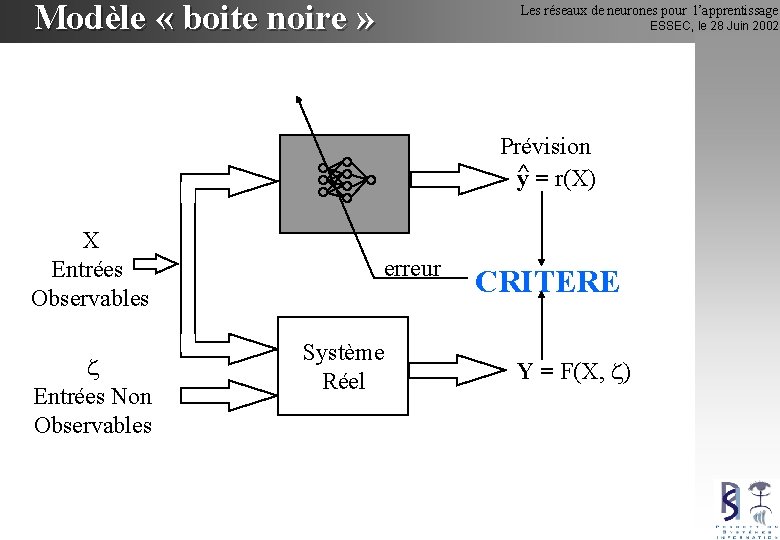

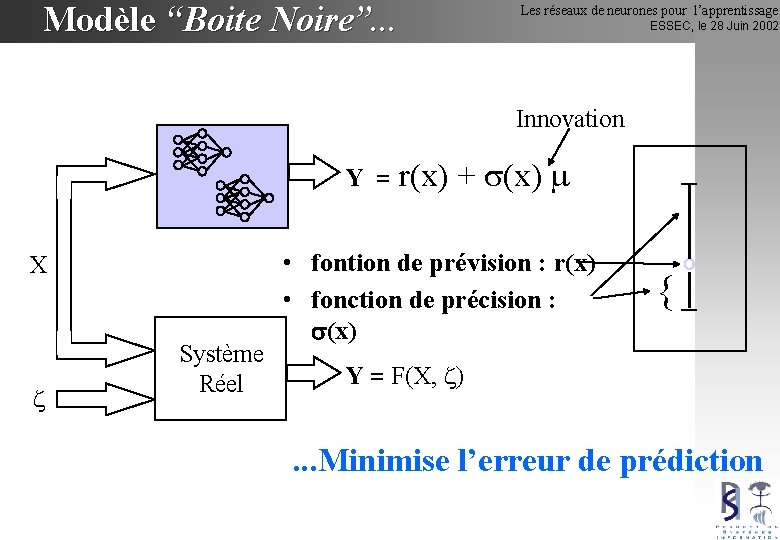

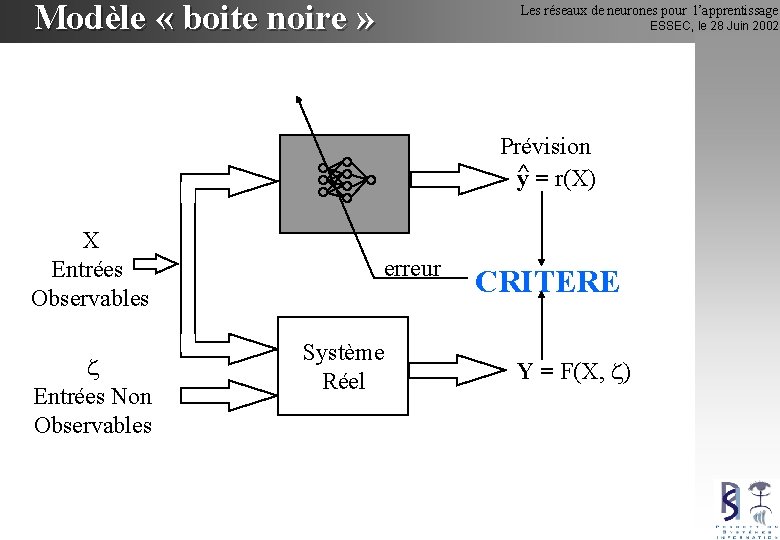

Modèle « boite noire » Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Prévision ^ y = r(X) X Entrées Observables Entrées Non Observables erreur Système Réel CRITERE Y = F(X, )

Les différentes étapes d’une application Les réseaux de neurones pour l’apprentissage – Recueil des données brutes – génération de caractéristiques – sélection des caractéristiques pertinentes – étiquetage des classes – conception du classifieur – évaluation du système ESSEC, le 28 Juin 2002

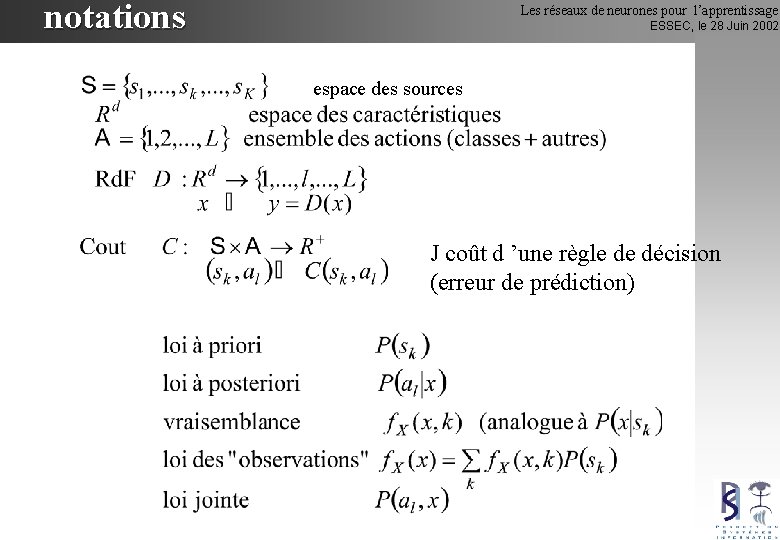

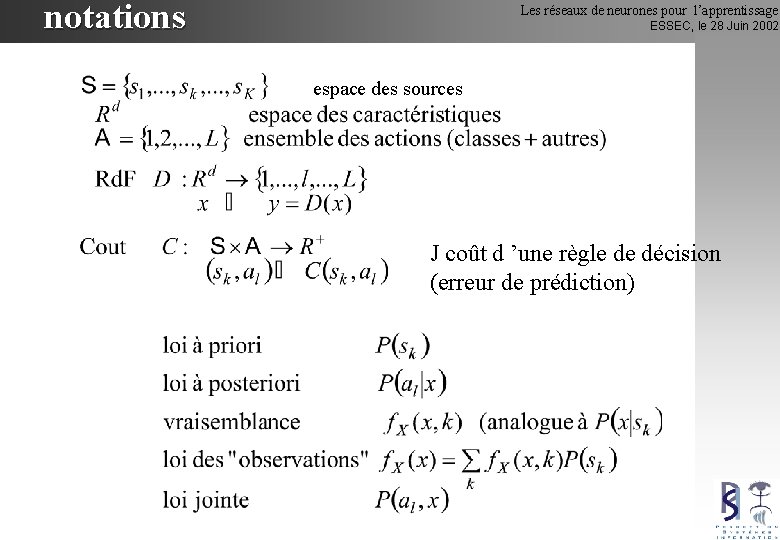

notations Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 espace des sources J coût d ’une règle de décision (erreur de prédiction)

Conclusion Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 C’est un outil dont il ne faut pas se priver Les méthodes statistiques peuvent dans certains cas apporter des solution originales à des problèmes « difficiles » il faut disposer de données on fait de la programmation à partir de données la notion de « coût » est fondamentale il faut disposer d’une bonne méthodologie il était une fois un concours de prévision. . .

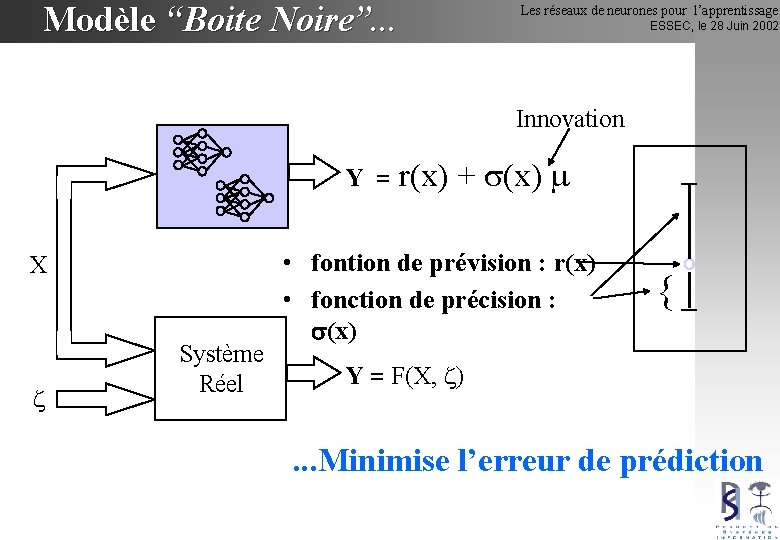

Modèle “Boite Noire”. . . Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Innovation Y = r(x) + (x) X Système Réel • fontion de prévision : r(x) • fonction de précision : (x) { Y = F(X, ) . . . Minimise l’erreur de prédiction

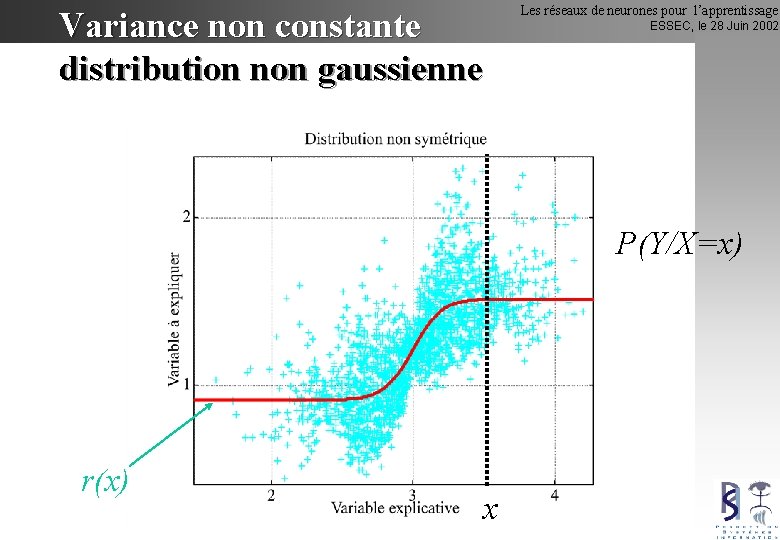

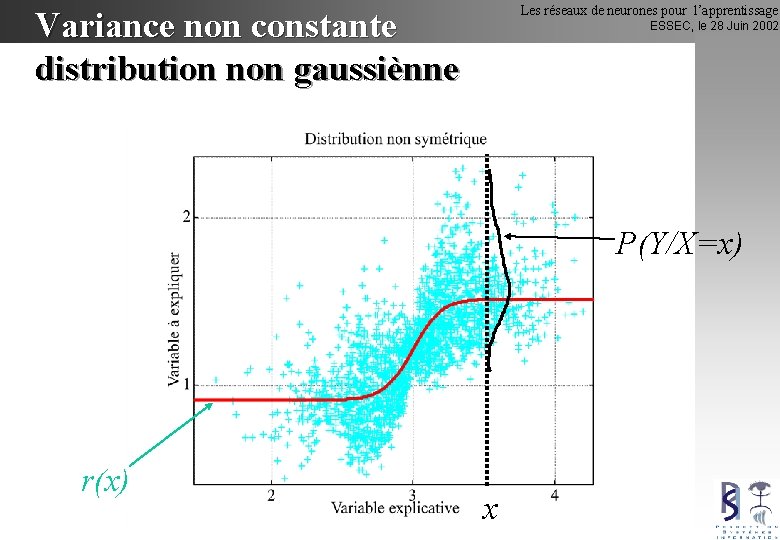

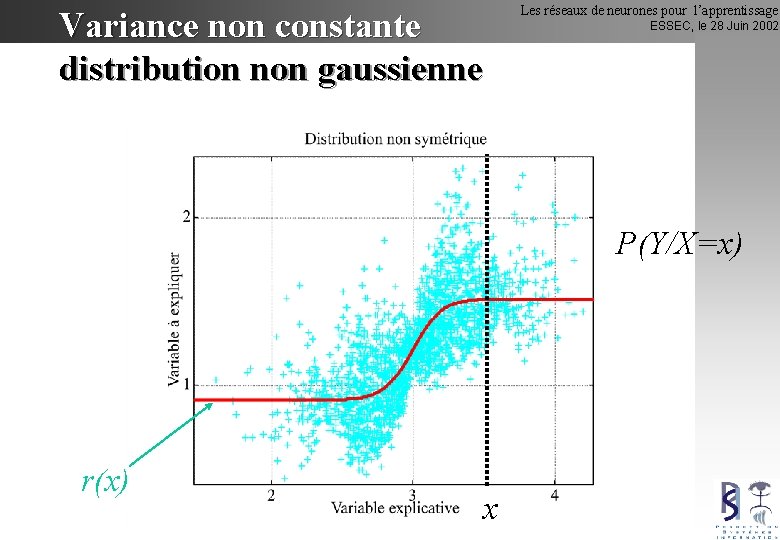

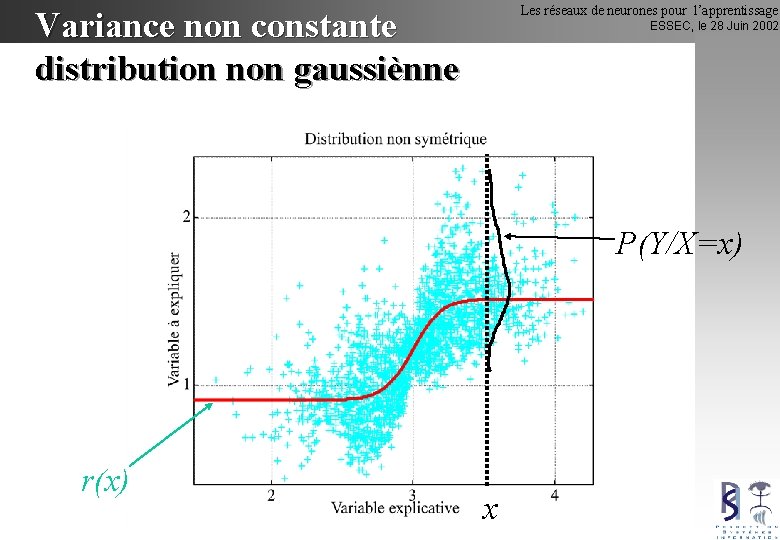

Variance non constante distribution non gaussienne Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 P(Y/X=x) r(x) x

Les réseaux de neurones pour l’apprentissage Variance non constante distribution non gaussiènne ESSEC, le 28 Juin 2002 P(Y/X=x) r(x) x

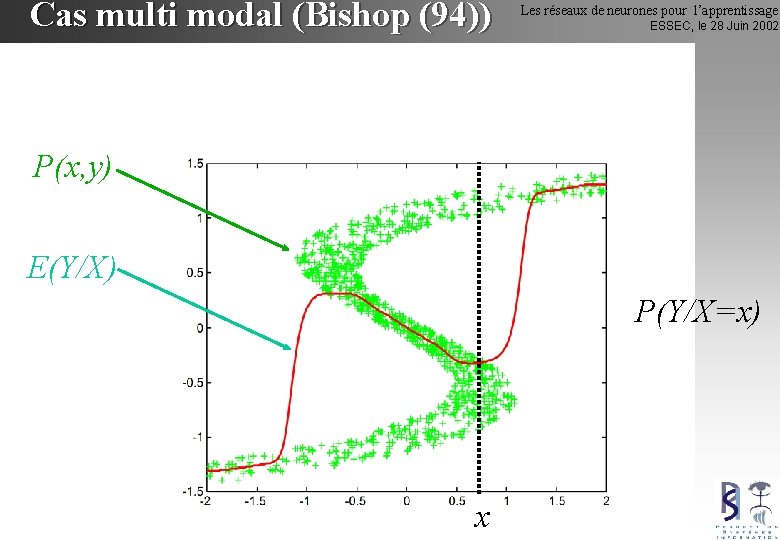

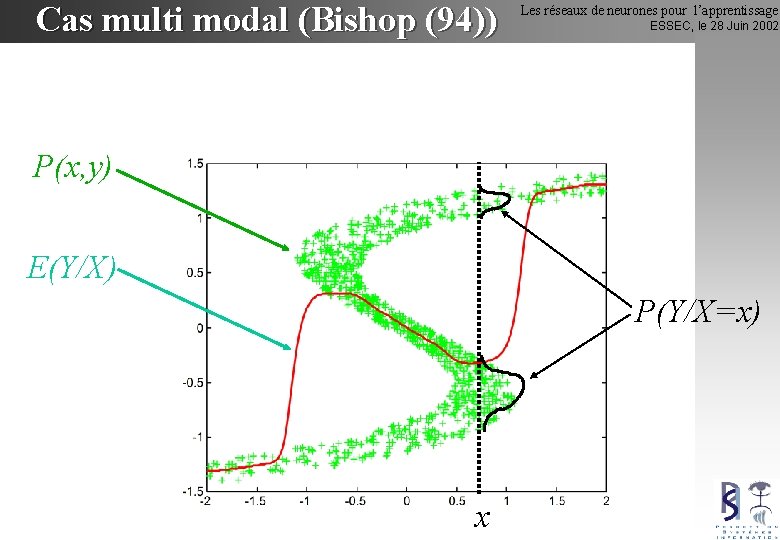

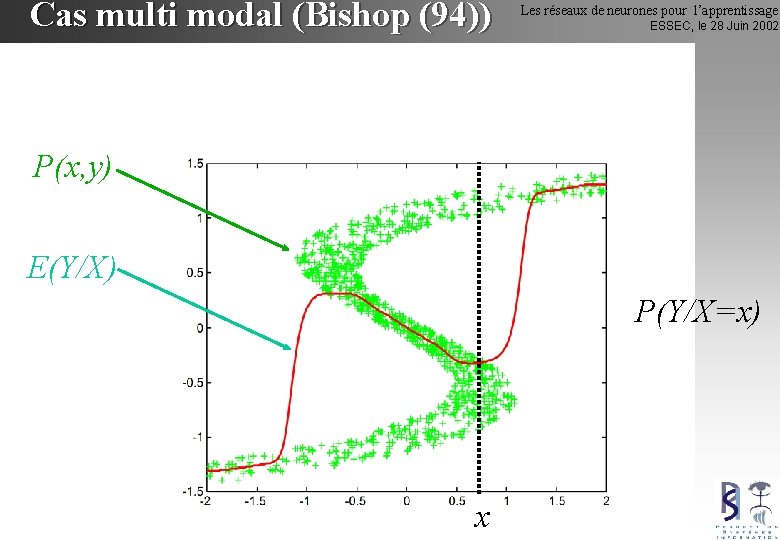

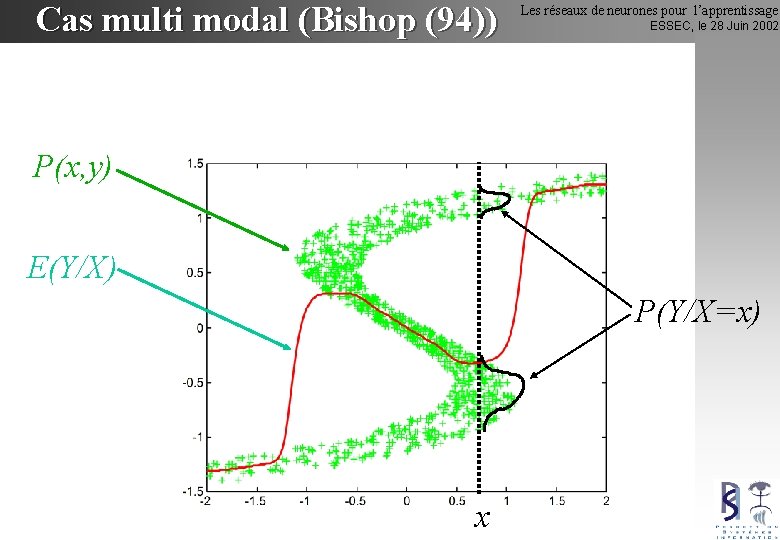

Cas multi modal (Bishop (94)) Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 P(x, y) E(Y/X) P(Y/X=x) x

Cas multi modal (Bishop (94)) Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 P(x, y) E(Y/X) P(Y/X=x) x

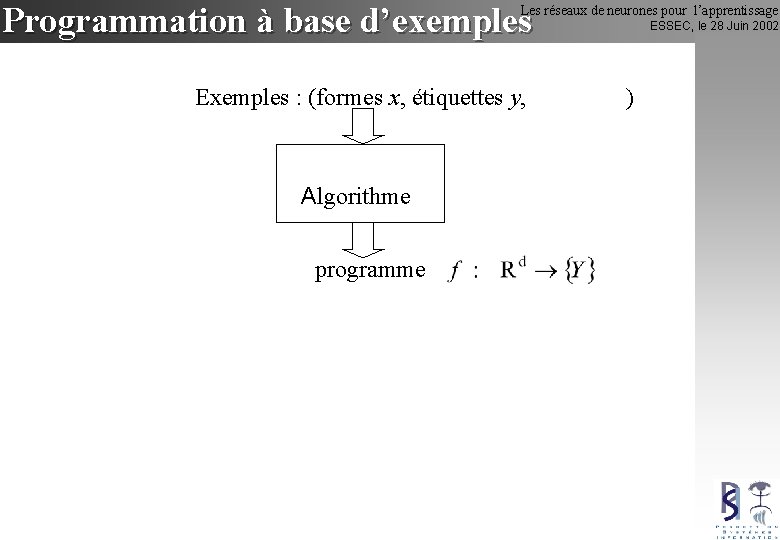

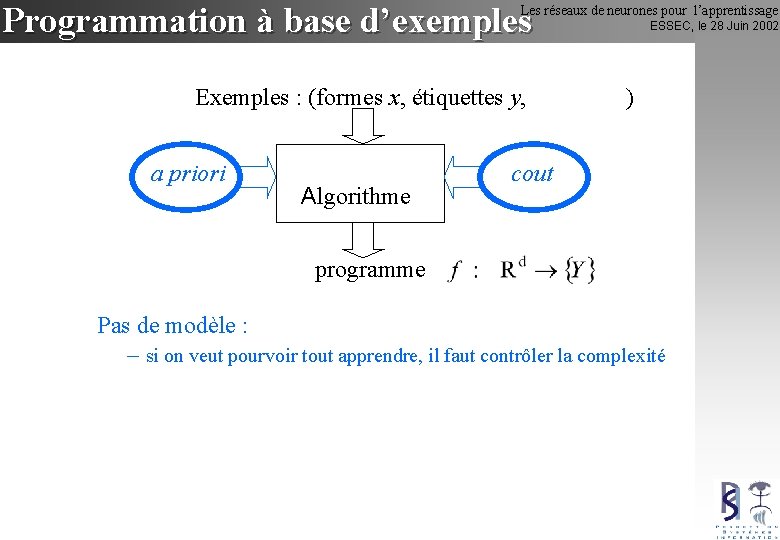

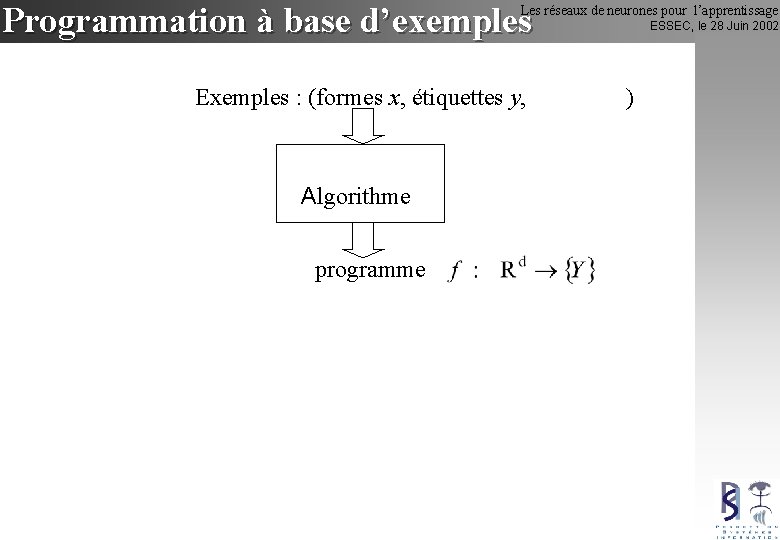

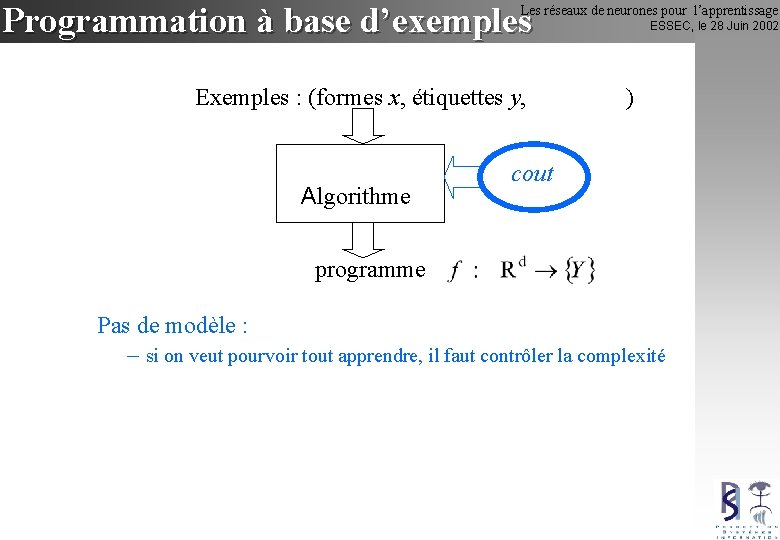

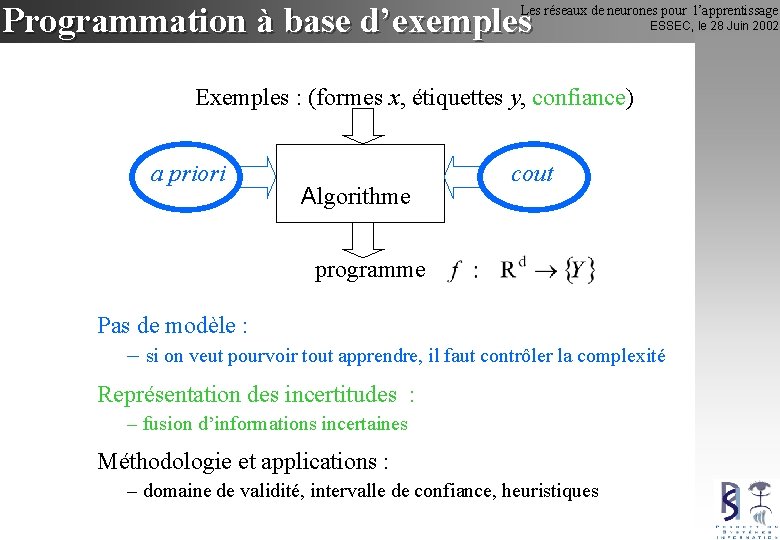

Programmation à base d’exemples Les réseaux de neurones pour l’apprentissage Exemples : (formes x, étiquettes y, confiance) Algorithme programme ESSEC, le 28 Juin 2002

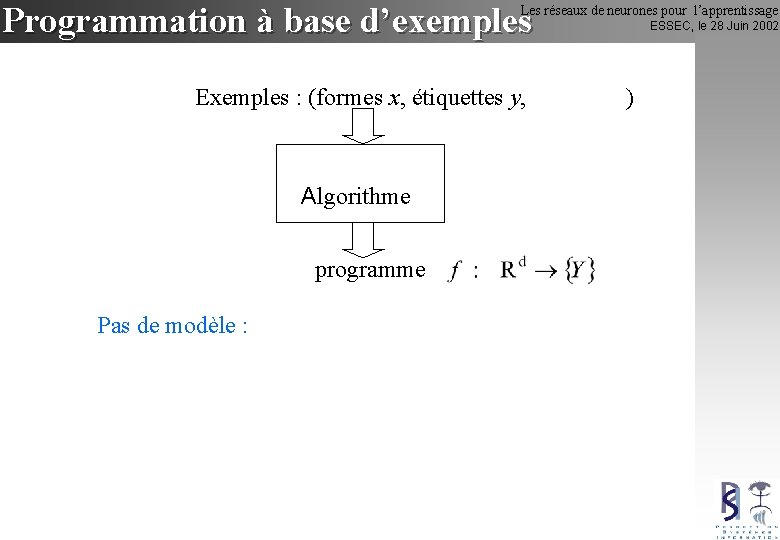

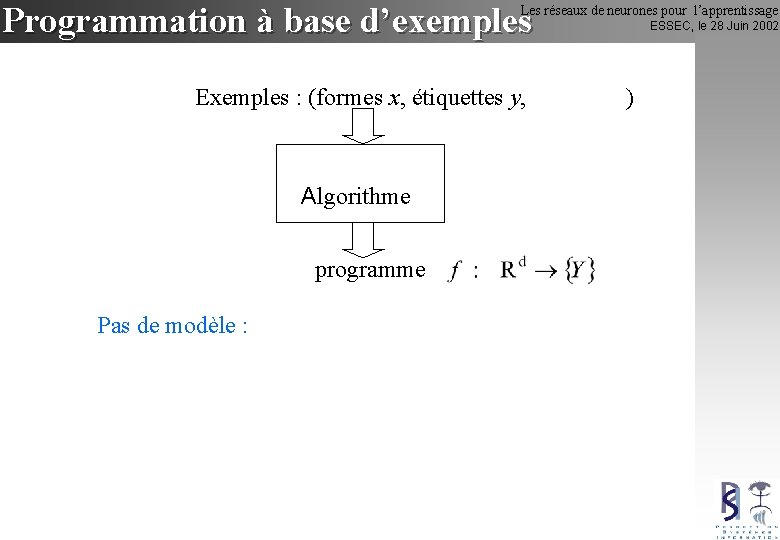

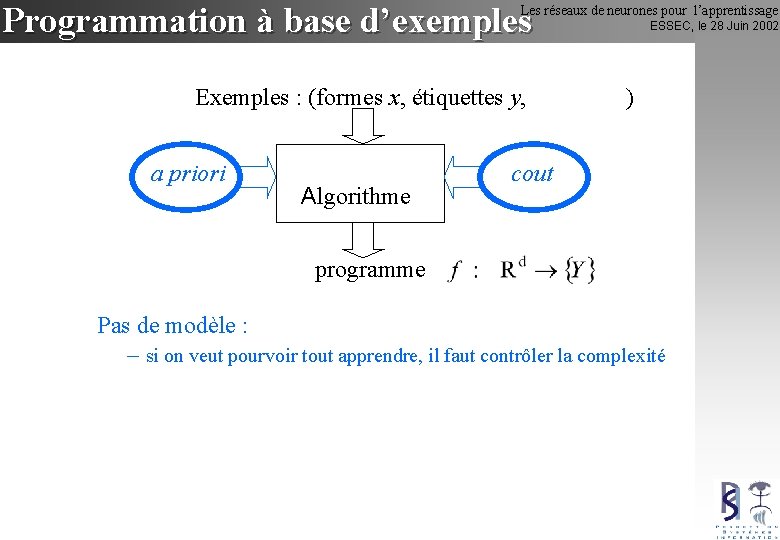

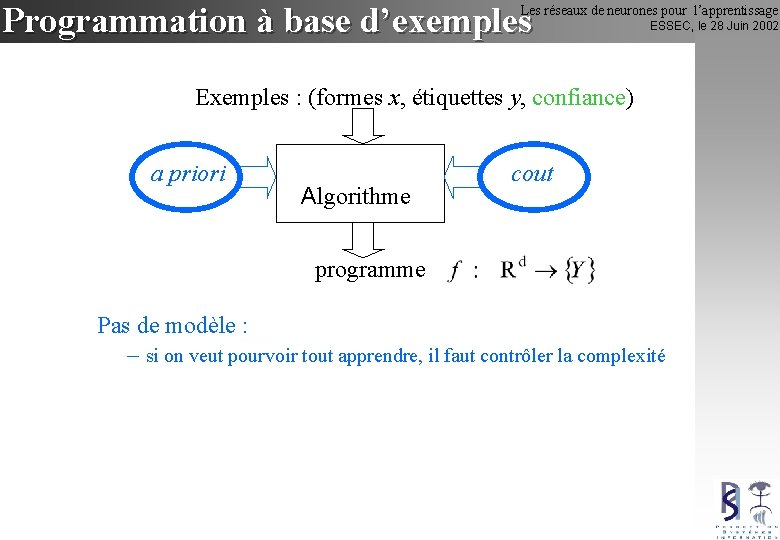

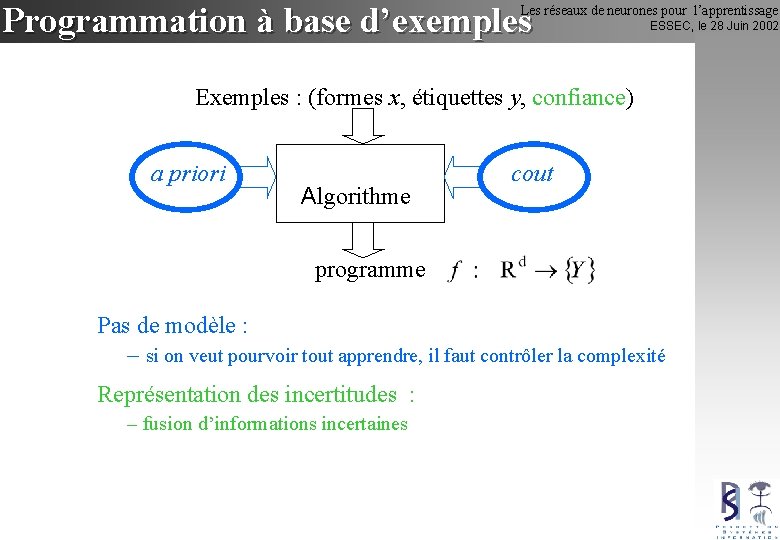

Programmation à base d’exemples Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Exemples : (formes x, étiquettes y, confiance) Algorithme programme Pas de modèle : – si on veut pourvoir tout apprendre, il faut contrôler la complexité Représentation des incertitudes : – fusion d’informations incertaines Méthodologie et applications : – domaine de validité, intervalle de confiance, heuristiques

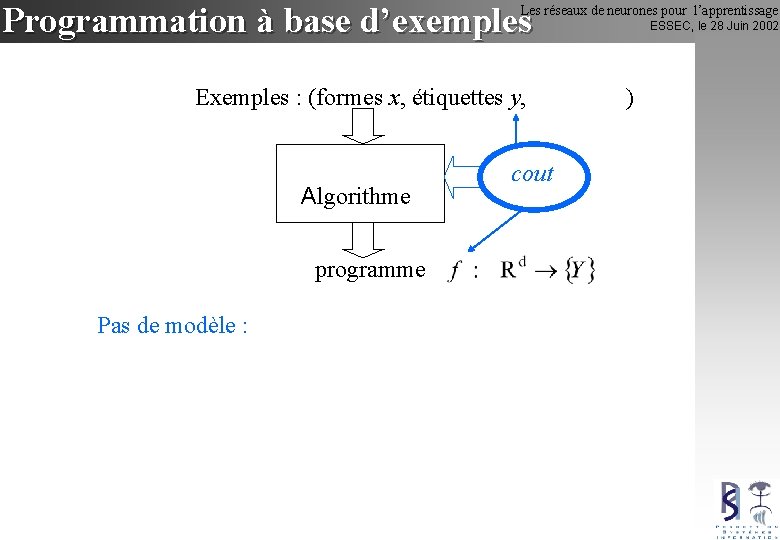

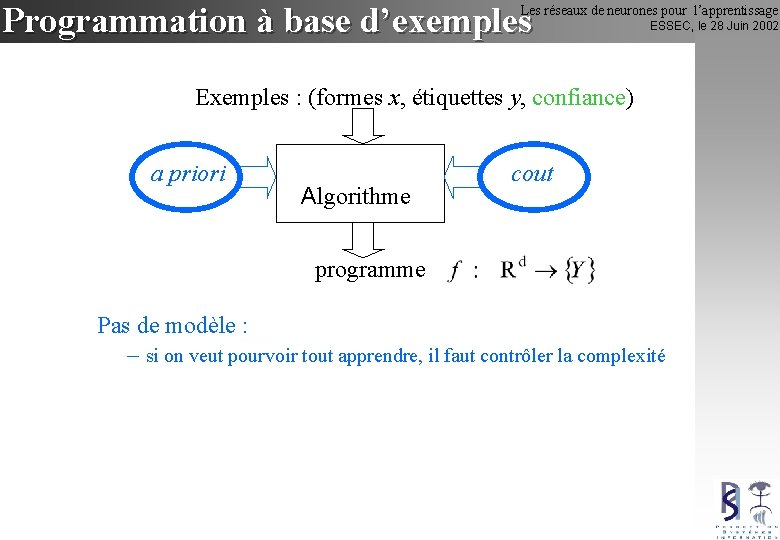

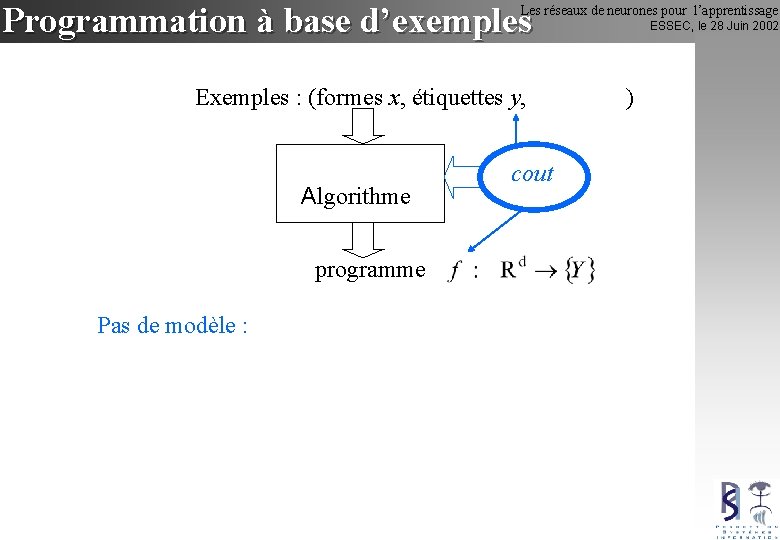

Programmation à base d’exemples Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Exemples : (formes x, étiquettes y, confiance) Algorithme cout programme Pas de modèle : – si on veut pourvoir tout apprendre, il faut contrôler la complexité Représentation des incertitudes : – fusion d’informations incertaines Méthodologie et applications : – domaine de validité, intervalle de confiance, heuristiques

Programmation à base d’exemples Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Exemples : (formes x, étiquettes y, confiance) Algorithme cout programme Pas de modèle : – si on veut pourvoir tout apprendre, il faut contrôler la complexité Représentation des incertitudes : – fusion d’informations incertaines Méthodologie et applications : – domaine de validité, intervalle de confiance, heuristiques

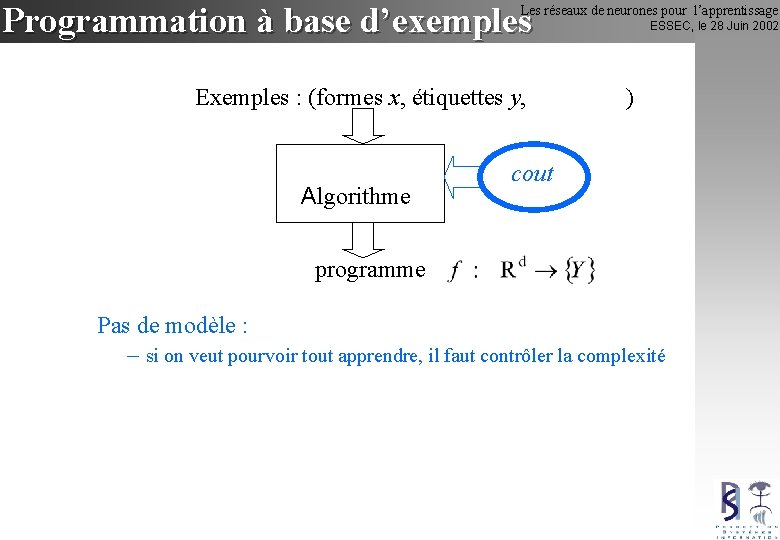

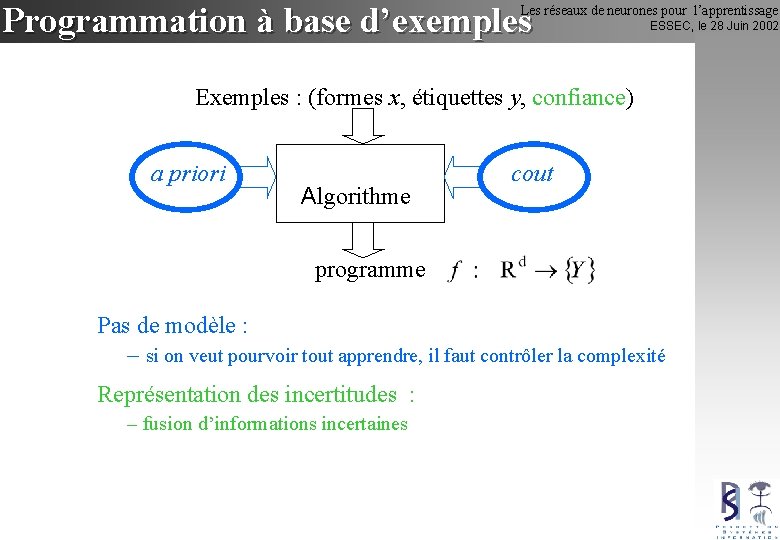

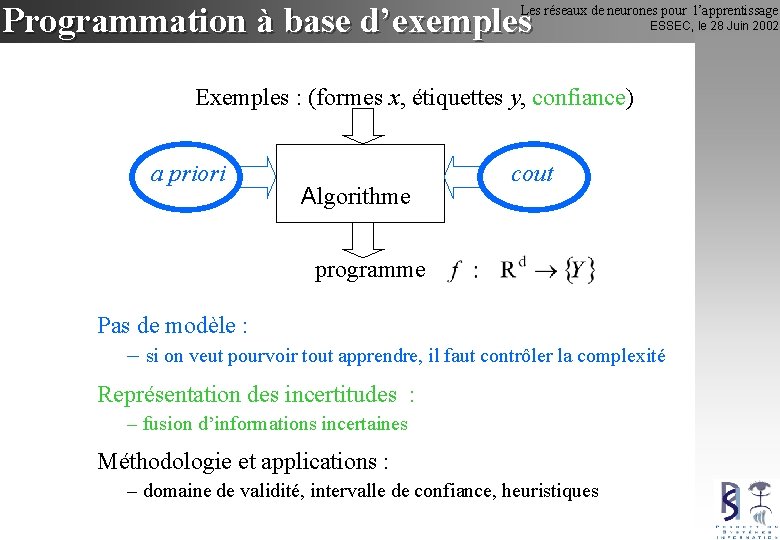

Programmation à base d’exemples Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Exemples : (formes x, étiquettes y, confiance) a priori Algorithme cout programme Pas de modèle : – si on veut pourvoir tout apprendre, il faut contrôler la complexité Représentation des incertitudes : – fusion d’informations incertaines Méthodologie et applications : – domaine de validité, intervalle de confiance, heuristiques

Programmation à base d’exemples Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Exemples : (formes x, étiquettes y, confiance) a priori Algorithme cout programme Pas de modèle : – si on veut pourvoir tout apprendre, il faut contrôler la complexité Représentation des incertitudes : – fusion d’informations incertaines Méthodologie et applications : – domaine de validité, intervalle de confiance, heuristiques

Programmation à base d’exemples Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Exemples : (formes x, étiquettes y, confiance) a priori Algorithme cout programme Pas de modèle : – si on veut pourvoir tout apprendre, il faut contrôler la complexité Représentation des incertitudes : – fusion d’informations incertaines Méthodologie et applications : – domaine de validité, intervalle de confiance, heuristiques

Programmation à base d’exemples Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Exemples : (formes x, étiquettes y, confiance) a priori Algorithme cout programme Pas de modèle : – si on veut pourvoir tout apprendre, il faut contrôler la complexité Représentation des incertitudes : – fusion d’informations incertaines Méthodologie et applications : – domaine de validité, intervalle de confiance, heuristiques

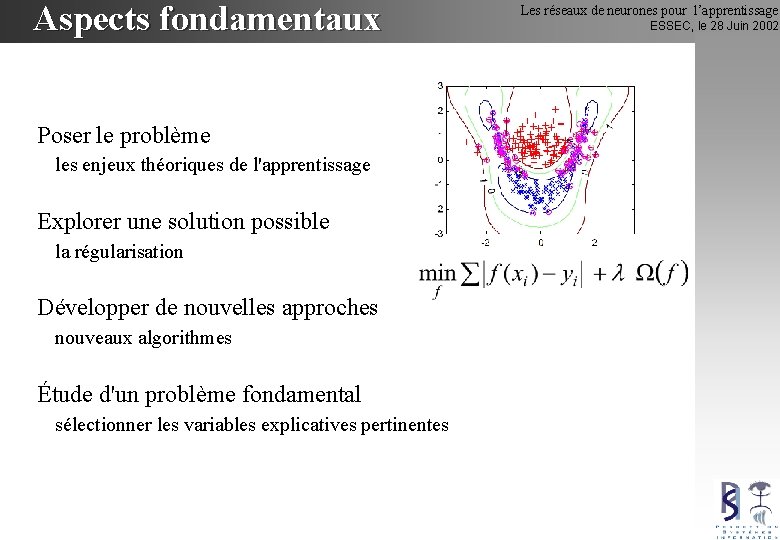

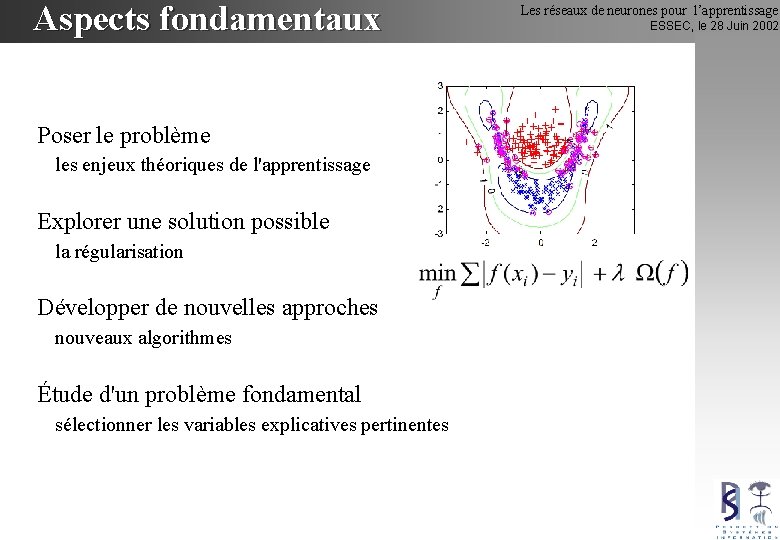

Aspects fondamentaux Poser le problème les enjeux théoriques de l'apprentissage Explorer une solution possible la régularisation Développer de nouvelles approches nouveaux algorithmes Étude d'un problème fondamental sélectionner les variables explicatives pertinentes Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

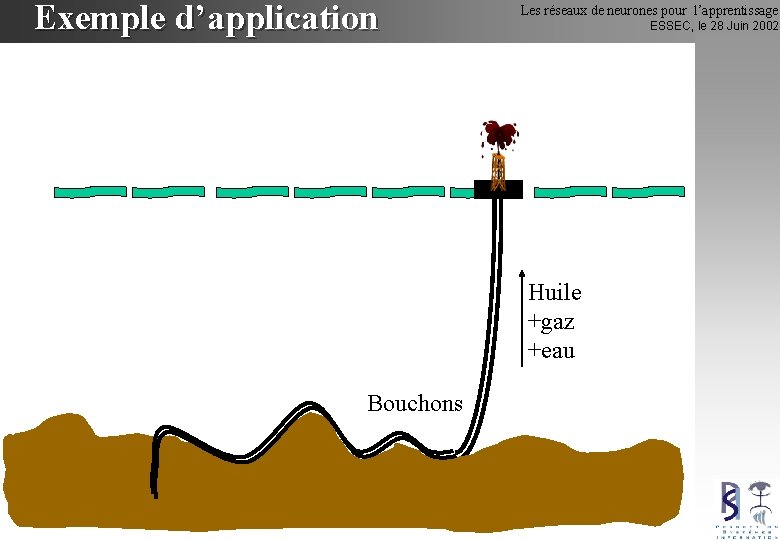

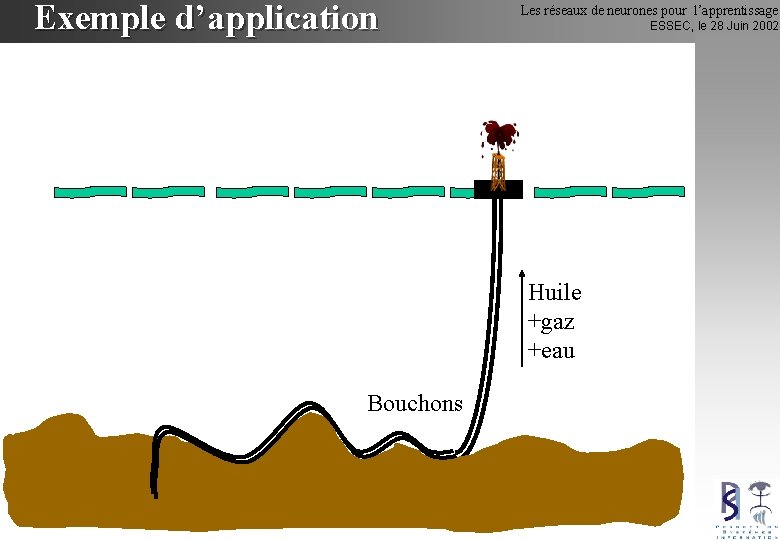

Exemple d’application Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Huile +gaz +eau Bouchons

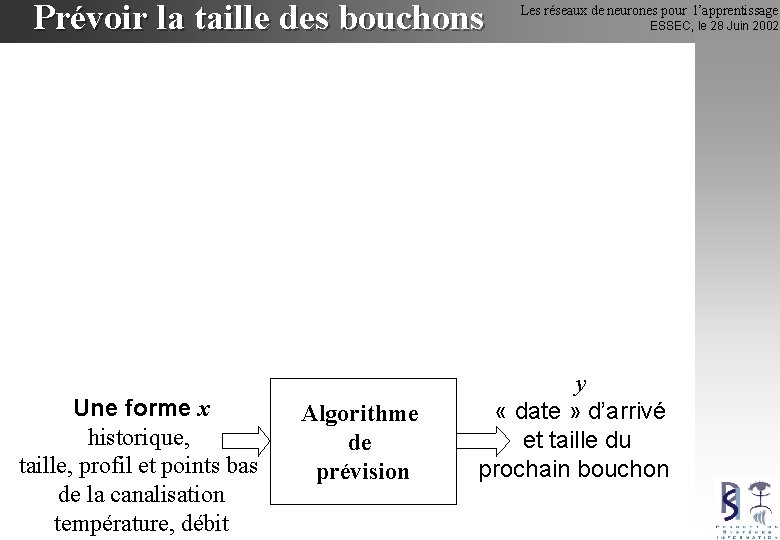

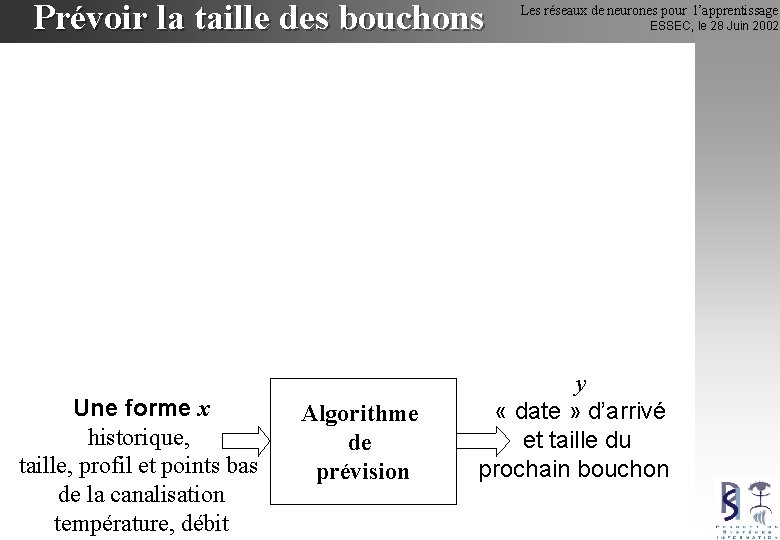

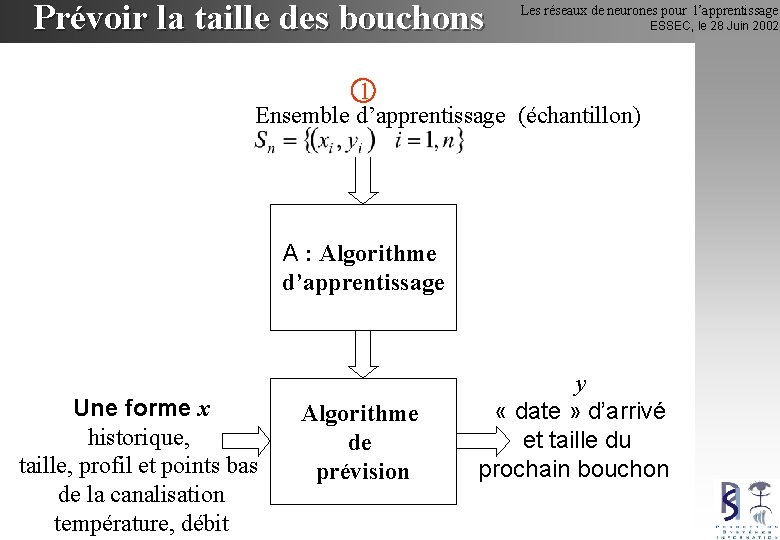

Prévoir la taille des bouchons Une forme x historique, taille, profil et points bas de la canalisation température, débit Algorithme de prévision Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 y « date » d’arrivé et taille du prochain bouchon

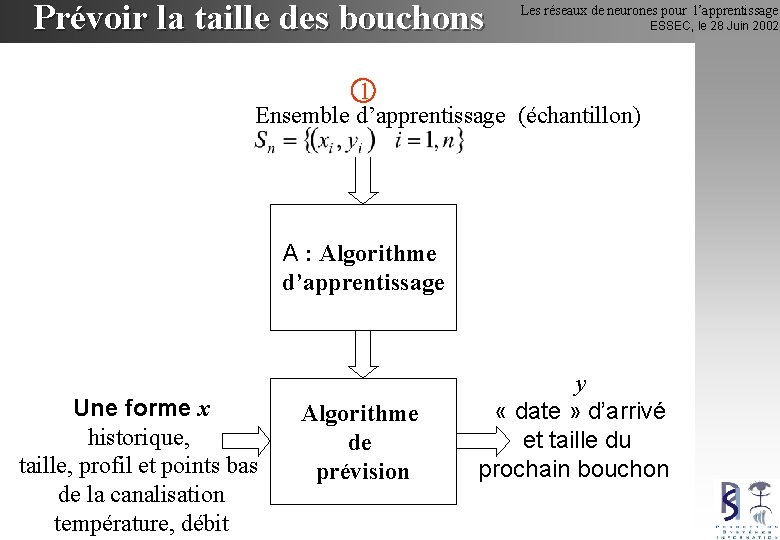

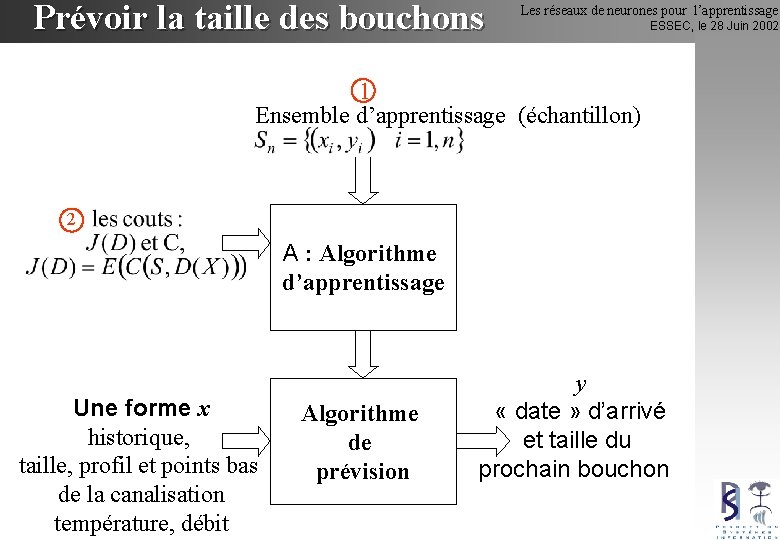

Prévoir la taille des bouchons Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 1 Ensemble d’apprentissage (échantillon) A : Algorithme d’apprentissage Une forme x historique, taille, profil et points bas de la canalisation température, débit Algorithme de prévision y « date » d’arrivé et taille du prochain bouchon

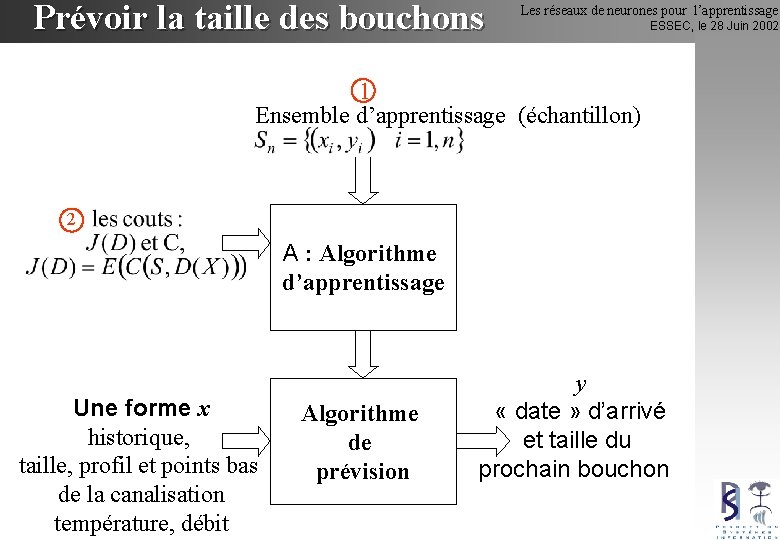

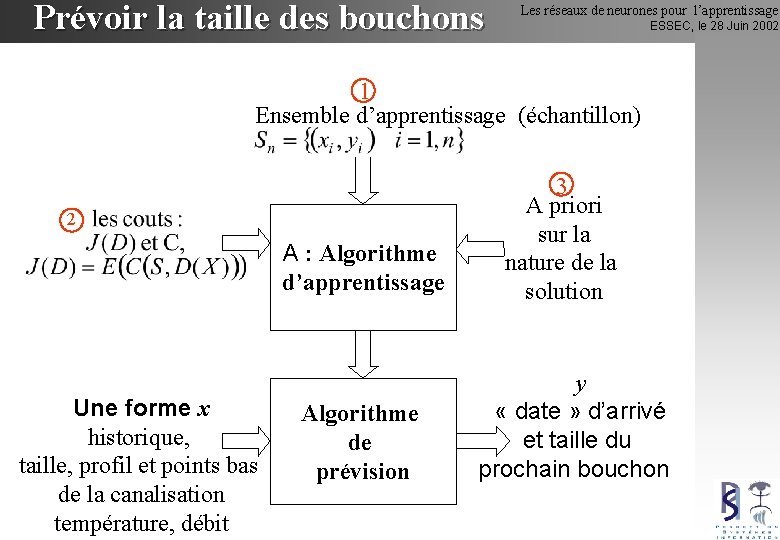

Prévoir la taille des bouchons Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 1 Ensemble d’apprentissage (échantillon) 2 A : Algorithme d’apprentissage Une forme x historique, taille, profil et points bas de la canalisation température, débit Algorithme de prévision y « date » d’arrivé et taille du prochain bouchon

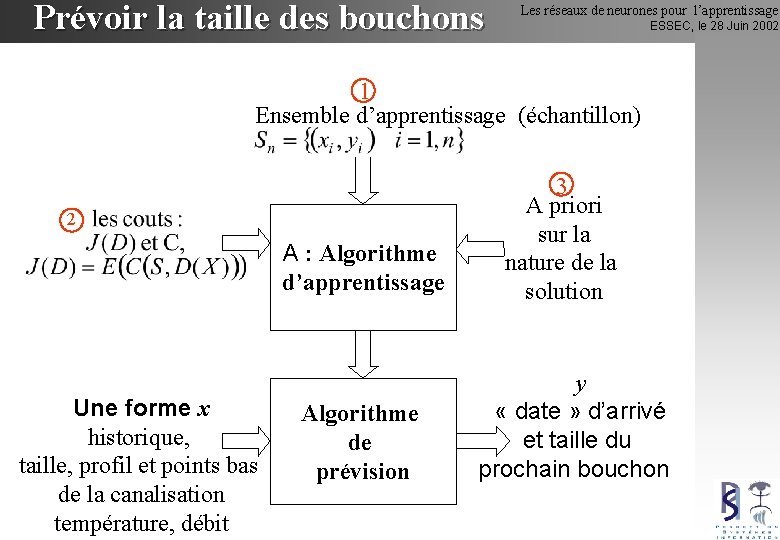

Prévoir la taille des bouchons Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 1 Ensemble d’apprentissage (échantillon) 2 A : Algorithme d’apprentissage Une forme x historique, taille, profil et points bas de la canalisation température, débit Algorithme de prévision 3 A priori sur la nature de la solution y « date » d’arrivé et taille du prochain bouchon

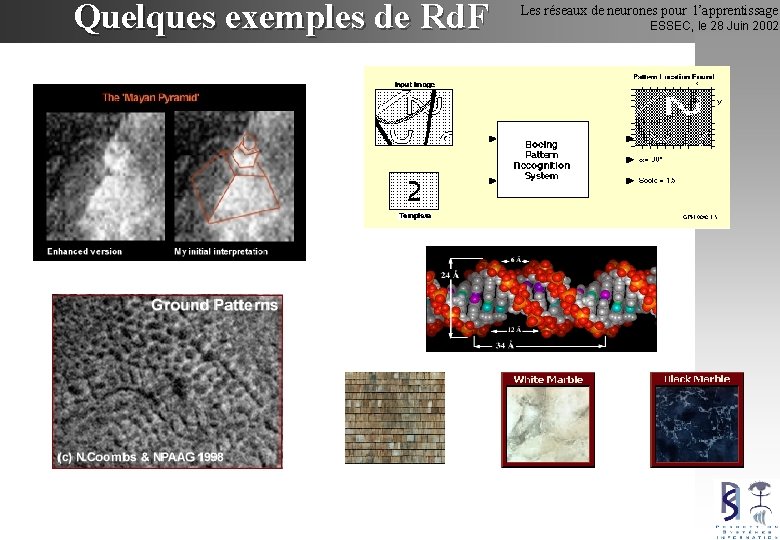

Quelques exemples de Rd. F Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

Quelques exemples de Rd. F Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002

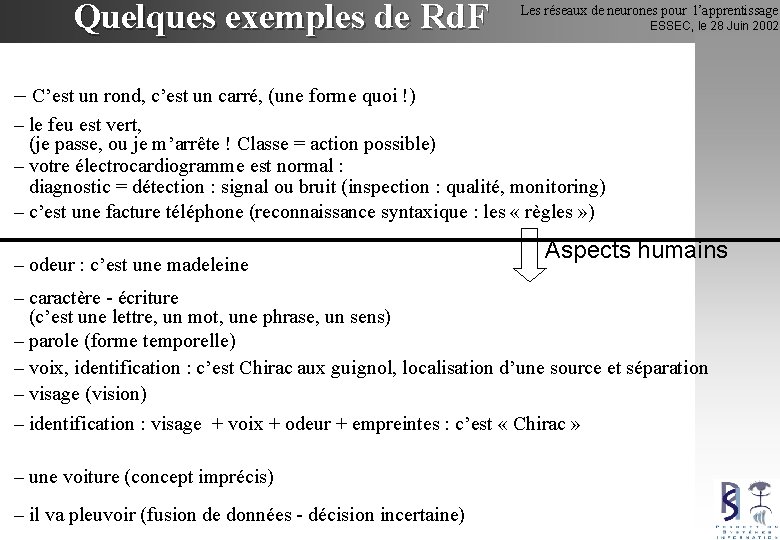

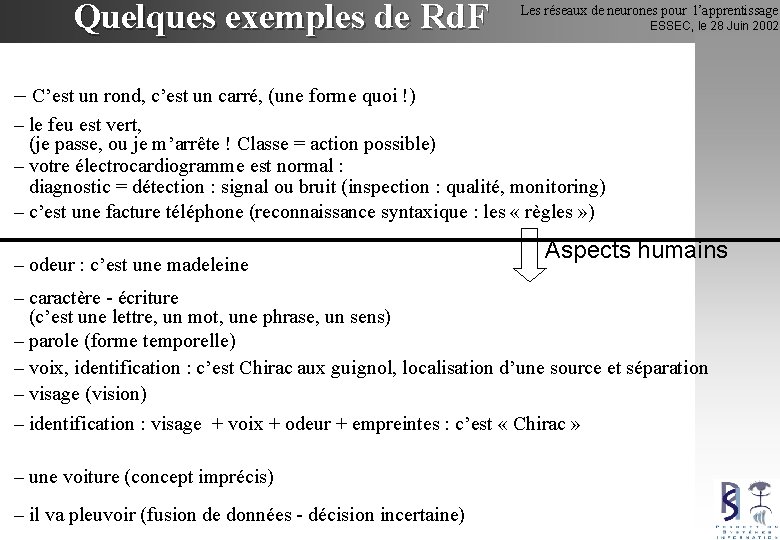

Quelques exemples de Rd. F Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 – C’est un rond, c’est un carré, (une forme quoi !) – le feu est vert, (je passe, ou je m’arrête ! Classe = action possible) – votre électrocardiogramme est normal : diagnostic = détection : signal ou bruit (inspection : qualité, monitoring) – c’est une facture téléphone (reconnaissance syntaxique : les « règles » ) – odeur : c’est une madeleine Aspects humains – caractère - écriture (c’est une lettre, un mot, une phrase, un sens) – parole (forme temporelle) – voix, identification : c’est Chirac aux guignol, localisation d’une source et séparation – visage (vision) – identification : visage + voix + odeur + empreintes : c’est « Chirac » – une voiture (concept imprécis) – il va pleuvoir (fusion de données - décision incertaine)

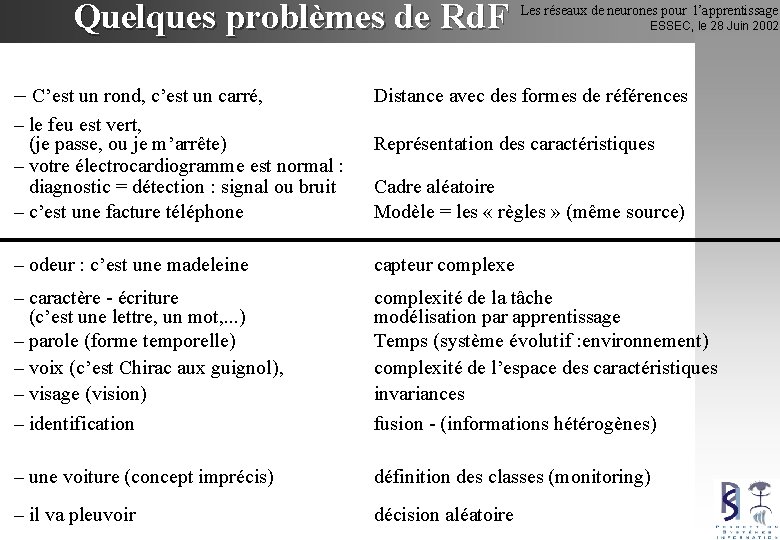

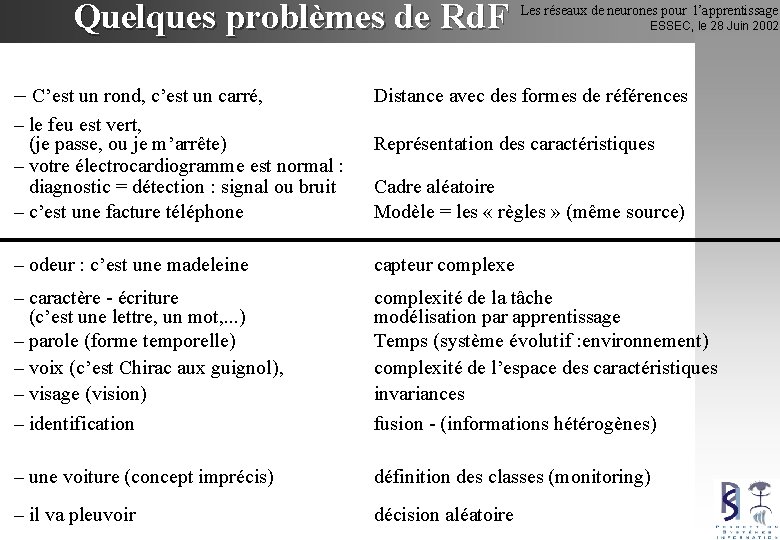

Quelques problèmes de Rd. F – C’est un rond, c’est un carré, – le feu est vert, (je passe, ou je m’arrête) – votre électrocardiogramme est normal : diagnostic = détection : signal ou bruit – c’est une facture téléphone Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Distance avec des formes de références Représentation des caractéristiques Cadre aléatoire Modèle = les « règles » (même source) – odeur : c’est une madeleine capteur complexe – caractère - écriture (c’est une lettre, un mot, . . . ) – parole (forme temporelle) – voix (c’est Chirac aux guignol), – visage (vision) – identification complexité de la tâche modélisation par apprentissage Temps (système évolutif : environnement) complexité de l’espace des caractéristiques invariances – une voiture (concept imprécis) définition des classes (monitoring) – il va pleuvoir décision aléatoire fusion - (informations hétérogènes)

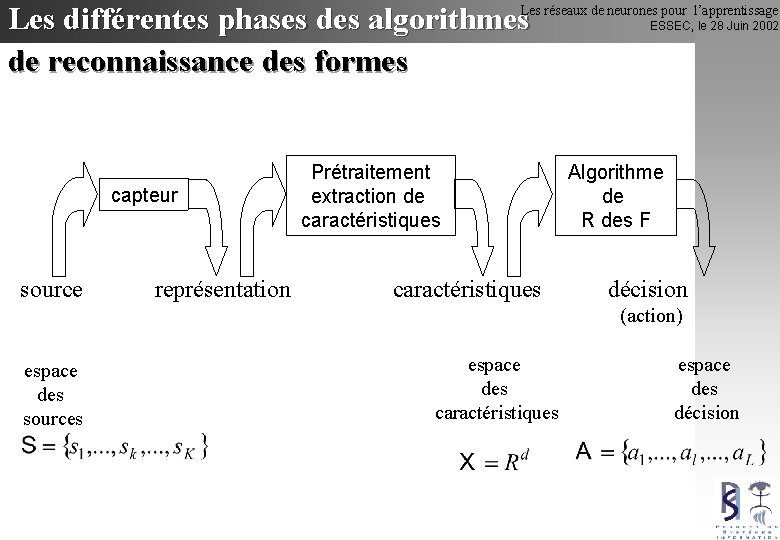

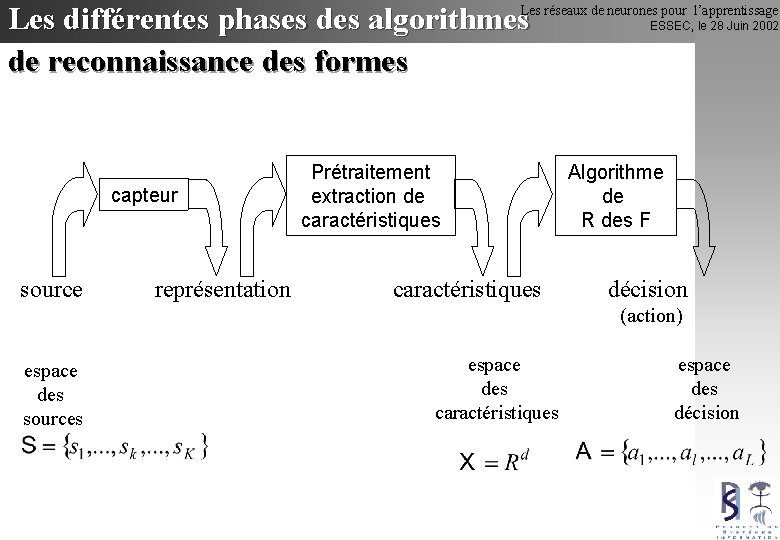

Les différentes phases des algorithmes de reconnaissance des formes Les réseaux de neurones pour l’apprentissage capteur Prétraitement extraction de caractéristiques ESSEC, le 28 Juin 2002 Algorithme de R des F source représentation caractéristiques décision (action) espace des sources espace des caractéristiques espace des décision

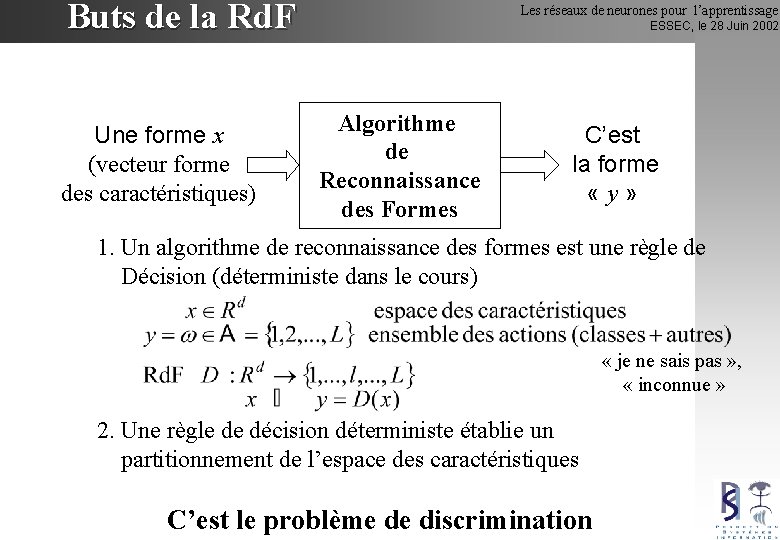

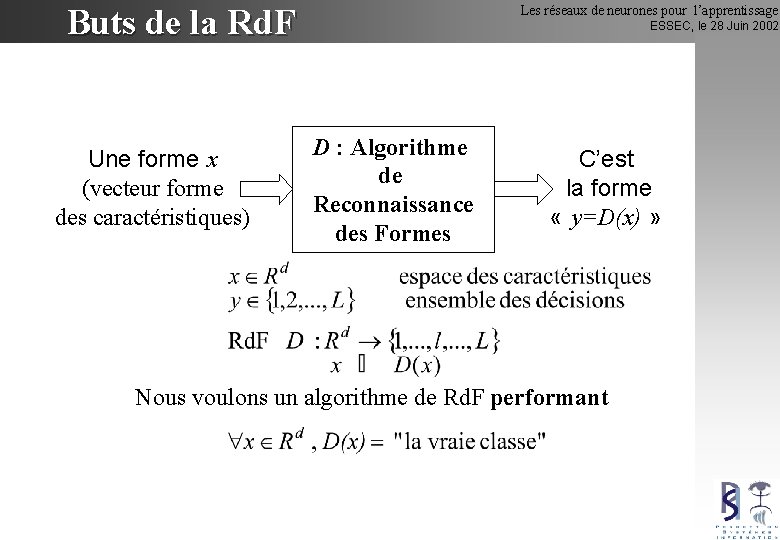

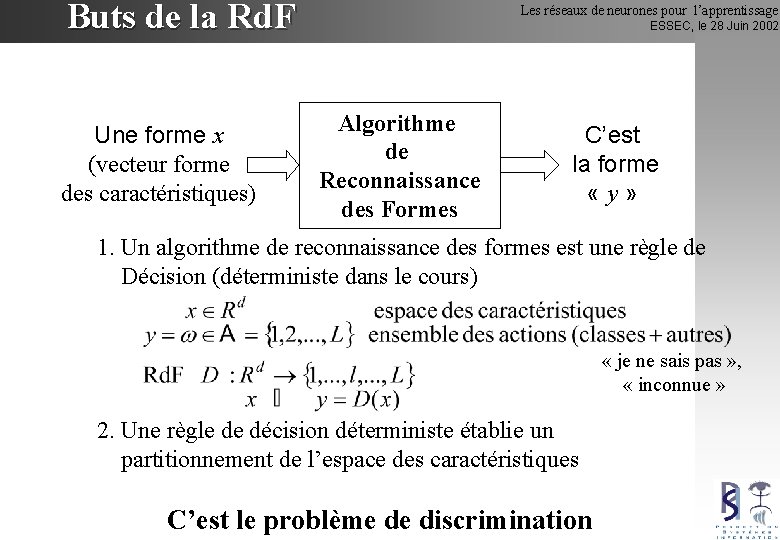

Buts de la Rd. F Une forme x (vecteur forme des caractéristiques) Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Algorithme de Reconnaissance des Formes C’est la forme « y » 1. Un algorithme de reconnaissance des formes est une règle de Décision (déterministe dans le cours) « je ne sais pas » , « inconnue » 2. Une règle de décision déterministe établie un partitionnement de l’espace des caractéristiques C’est le problème de discrimination

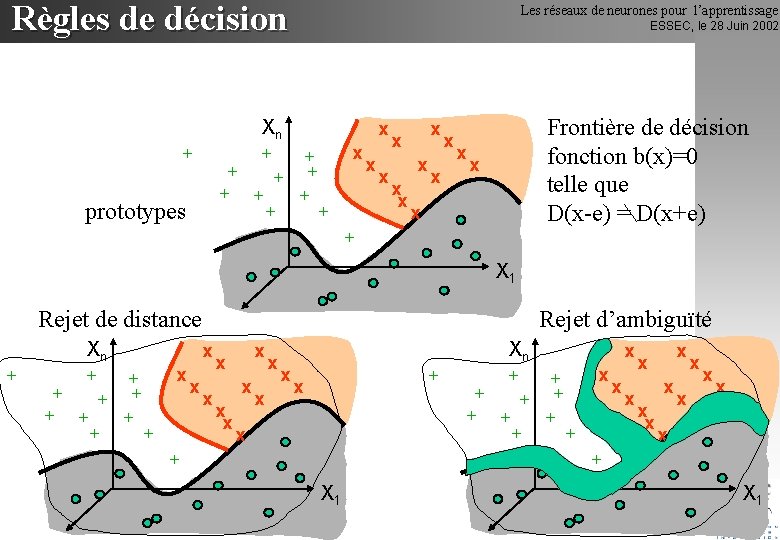

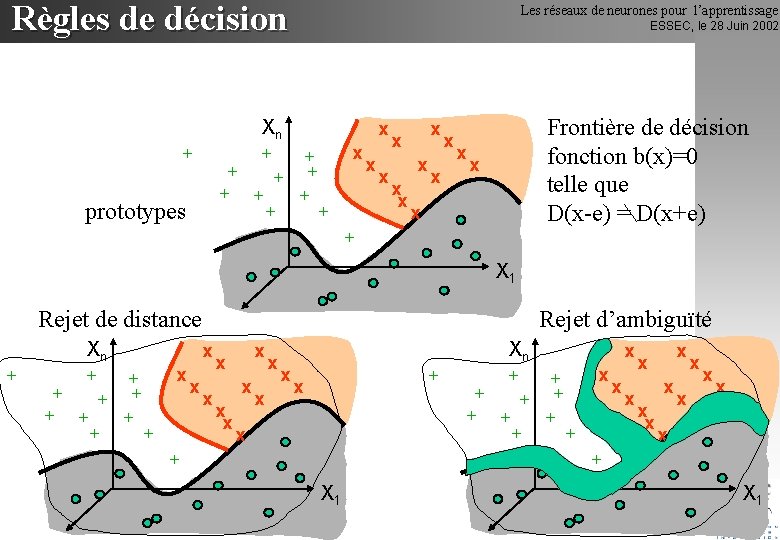

Règles de décision Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Xn + x + + + + + prototypes x x x Frontière de décision fonction b(x)=0 telle que D(x-e) = D(x+e) x x + X 1 Rejet de distance Xn + + + Rejet d’ambiguïté x x x Xn x + x x + + + x x x x + X 1

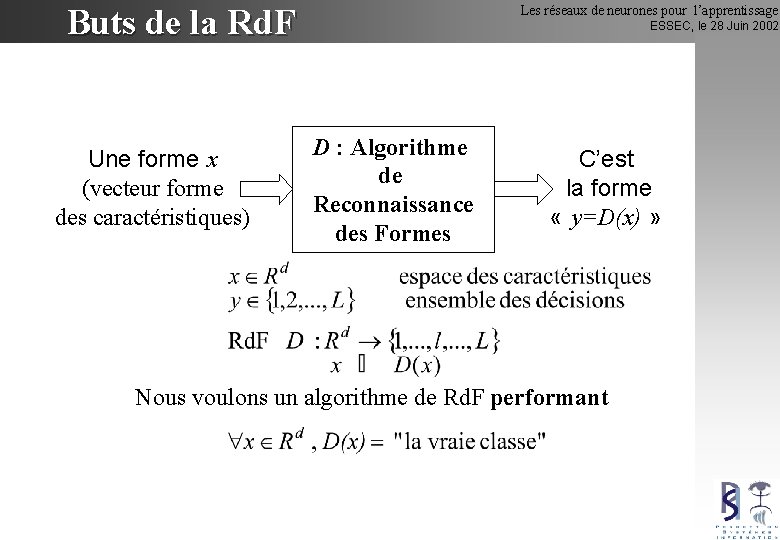

Buts de la Rd. F Une forme x (vecteur forme des caractéristiques) Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 D : Algorithme de Reconnaissance des Formes C’est la forme « y=D(x) » Nous voulons un algorithme de Rd. F performant

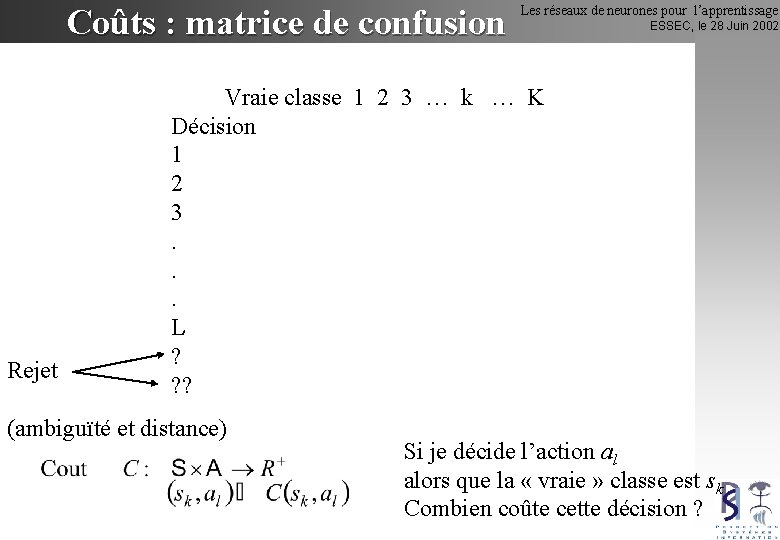

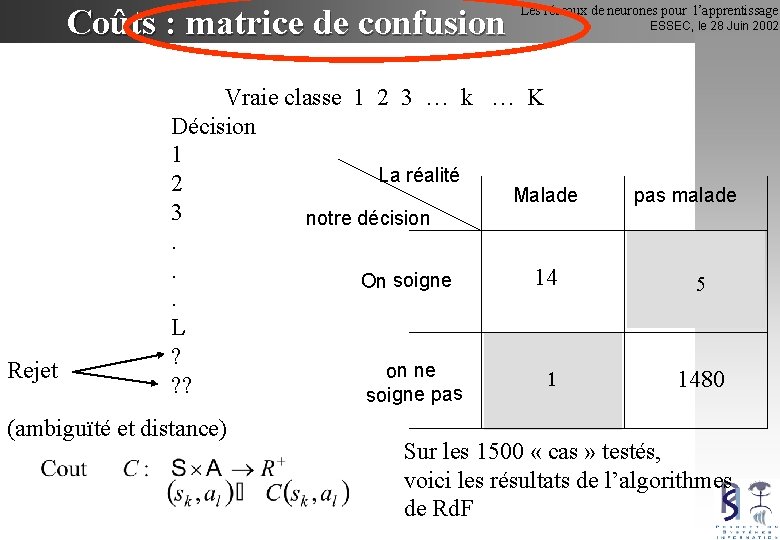

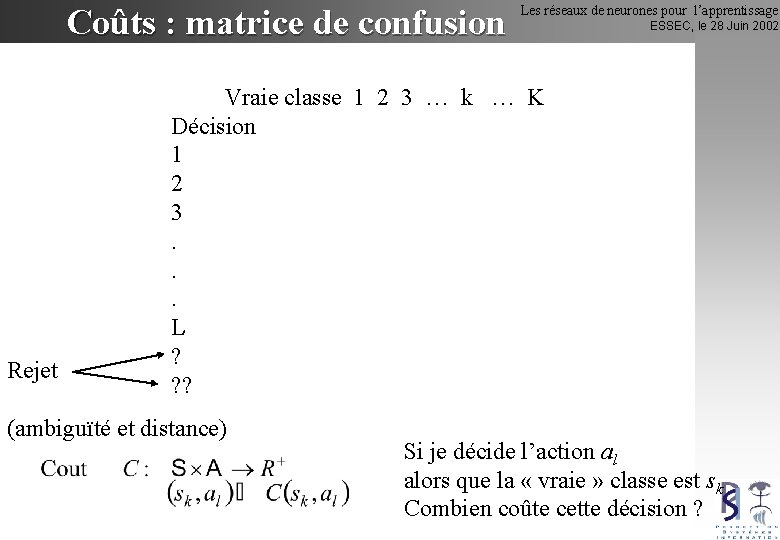

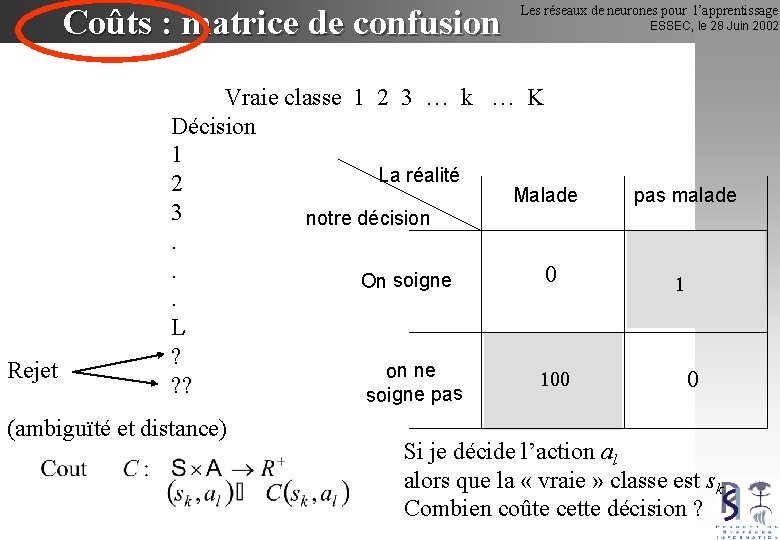

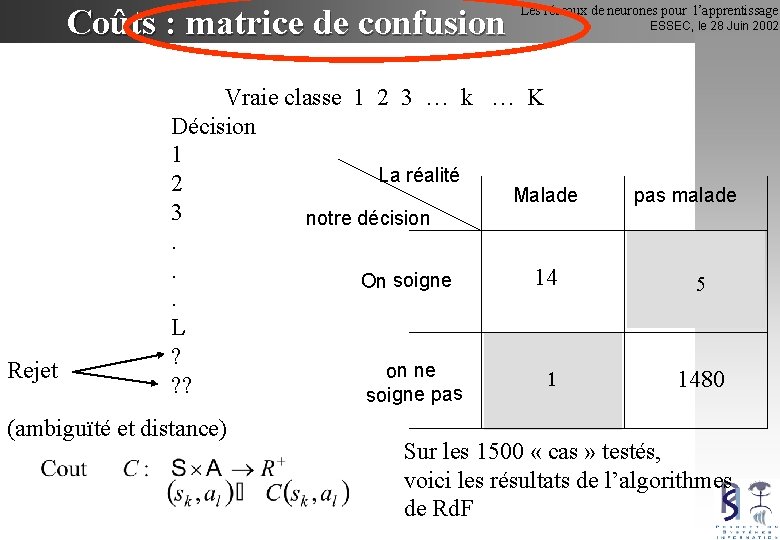

Coûts : matrice de confusion Rejet Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Vraie classe 1 2 3 … k … K Décision 1 2 3. . . L ? ? ? (ambiguïté et distance) Si je décide l’action al alors que la « vraie » classe est sk Combien coûte cette décision ?

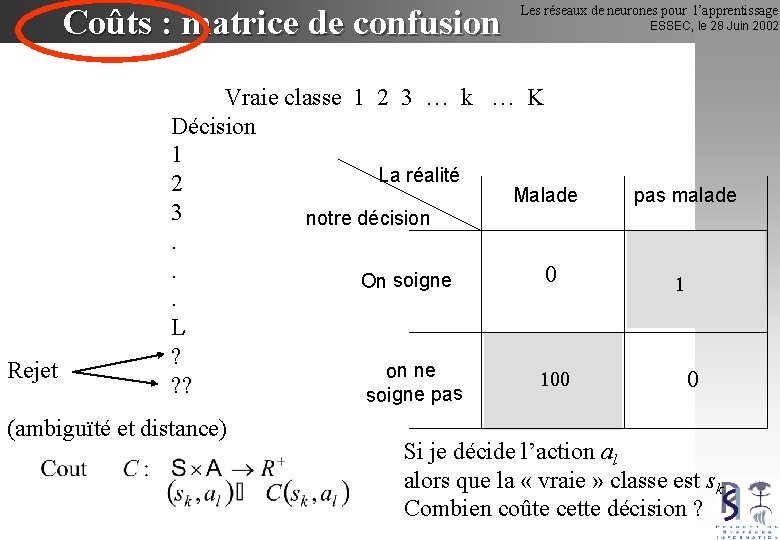

Coûts : matrice de confusion Rejet Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Vraie classe 1 2 3 … k … K Décision 1 La réalité 2 Malade pas malade 3 notre décision. . 0 On soigne 1. L ? on ne 100 0 ? ? soigne pas (ambiguïté et distance) Si je décide l’action al alors que la « vraie » classe est sk Combien coûte cette décision ?

Coûts : matrice de confusion Rejet Les réseaux de neurones pour l’apprentissage ESSEC, le 28 Juin 2002 Vraie classe 1 2 3 … k … K Décision 1 La réalité 2 Malade pas malade 3 notre décision. . 14 On soigne 5. L ? on ne 1 1480 ? ? soigne pas (ambiguïté et distance) Sur les 1500 « cas » testés, voici les résultats de l’algorithmes de Rd. F