Metody analizy i odkrywania wiedzy w niekompletynych zbiorach

Metody analizy i odkrywania wiedzy w niekompletynych zbiorach danych Łukasz Ryniewicz 25. 04. 2007

Plan prezentacji • Typy niekompletności informacji • Metody uzupełniania danych • Statystyczne • k-najbliższych sąsiadów, drzewa decyzyjne • Metody analizy niekompletnych danych • Rozmyte reguły asocjacyjne • Zbiory przybliżone i modyfikacje • Modyfikacje algorytmów

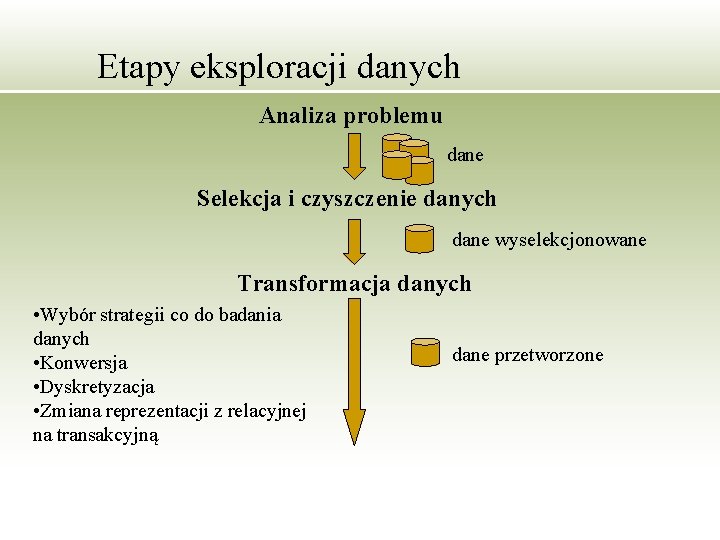

Etapy eksploracji danych Analiza problemu dane Selekcja i czyszczenie danych dane wyselekcjonowane Transformacja danych • Wybór strategii co do badania danych • Konwersja • Dyskretyzacja • Zmiana reprezentacji z relacyjnej na transakcyjną dane przetworzone

Etapy eksploracji danych Eksploracja danych • Wybór narzędzi • Wybór algorytmów • Zastosowania ich wzorce Przygotowanie wyników do oceny Obróbka żeby było miłe dla oka dane wygodne do analizowania Analiza wyników Zastosowanie uzyskanej wiedzy w praktyce

Typy niepełności danych • Niepewność – gdy nie wiemy czy dane są poprawne • Niedokładność – np. gdy mamy dane w postaci przedziałów: 100 -200, dane opisowe : dość ciepło • Niekompletność – nie znamy wartości atrybutu • Niespójność – np. jednemu obiektowi są przypisane różne wartości • Ignorancja – gdy mamy brak wiedzy

Niekompletność • Brakujące dane – są możliwe do uzupełnienia • chwilowa – nie jest dostępna dana w momencie jej wstawiania • niedokładność urządzeń, metod – możliwe do oszacowania • Niedostępne dane • nie są możliwe do uzupełnienia, • gdy są instancje do których nie mają zastosowania wartości atrybutów (np. baza z polami: bramki, strzelcy w przypadku meczu bezbramkowego)

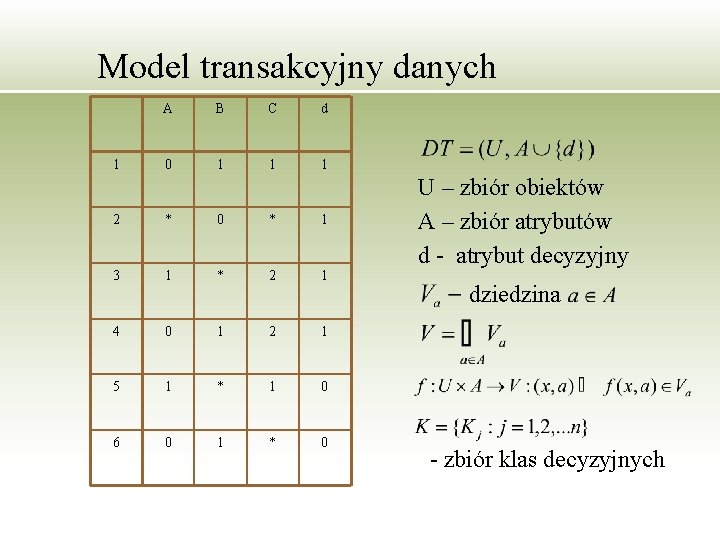

Model transakcyjny danych 1 A B C d 0 1 1 1 2 * 0 * 1 3 1 * 2 1 4 0 1 2 1 5 1 * 1 0 6 0 1 * 0 U – zbiór obiektów A – zbiór atrybutów d - atrybut decyzyjny dziedzina - zbiór klas decyzyjnych

Metody stosowane podczas transformacji danych • Usuwanie niekompletności danych • Pomijanie obiektów zawierających braki danych • W bazach traznsakcyjnych pomijanie brakującego atrybutu • Zastępowanie brakujących wartości • Użycie stałej – np. nowej nie występującej w zbiorze wartości danego atrybutu • Użycie mody, mediany, wartości średniej dla wartości danego atrybutu • Użycie metod data mining – np. k-najbliższych sąsiadów gdzie porównujemy obiekt z brakującą wartością z obiektami sąsiednimi i na ich podstawie odtwarzamy brakujący atrybut

Metody statystyczne • Procedury oparte na kompletnych rekordach – gdy mało braków • Procedury ważące – ustawiane są wagi rekordów by zminimalizować odchylenia związane z brakami • Procedury oparte o uzupełnianie danych • Jawne w postaci formalnego modelu (średnia, mediana, regresja, badanie korelacji) • Niejawne ukierunkowane na algorytmy implikujące modele (uzupełnianie na podstawie podobieństw, zastępowanie innymi rekordami, zastępowanie stałymi) • Procedury oparte o modele – definiuje się model kompletnych danych i zależności są wyliczane na podstawie rozkładu prawdopodobieństw

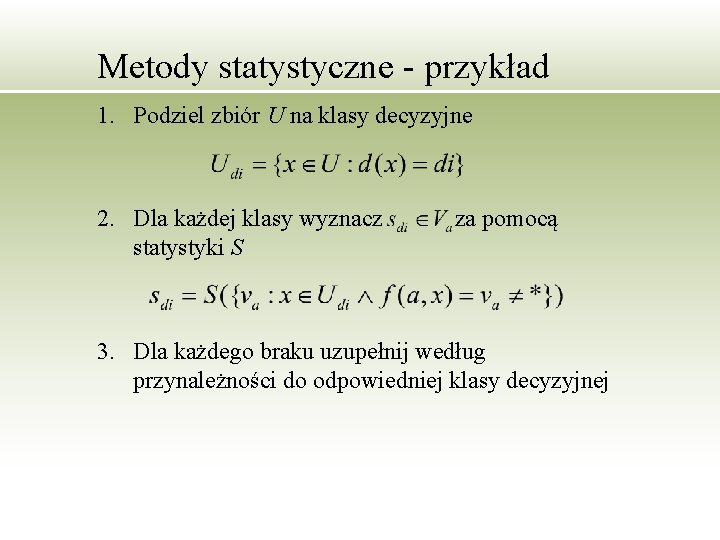

Metody statystyczne - przykład 1. Podziel zbiór U na klasy decyzyjne 2. Dla każdej klasy wyznacz statystyki S za pomocą 3. Dla każdego braku uzupełnij według przynależności do odpowiedniej klasy decyzyjnej

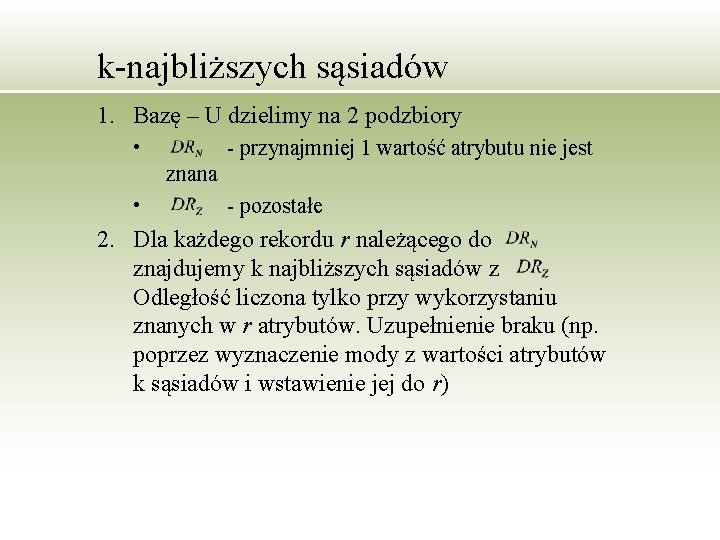

k-najbliższych sąsiadów 1. Bazę – U dzielimy na 2 podzbiory • - przynajmniej 1 wartość atrybutu nie jest znana • - pozostałe 2. Dla każdego rekordu r należącego do znajdujemy k najbliższych sąsiadów z Odległość liczona tylko przy wykorzystaniu znanych w r atrybutów. Uzupełnienie braku (np. poprzez wyznaczenie mody z wartości atrybutów k sąsiadów i wstawienie jej do r)

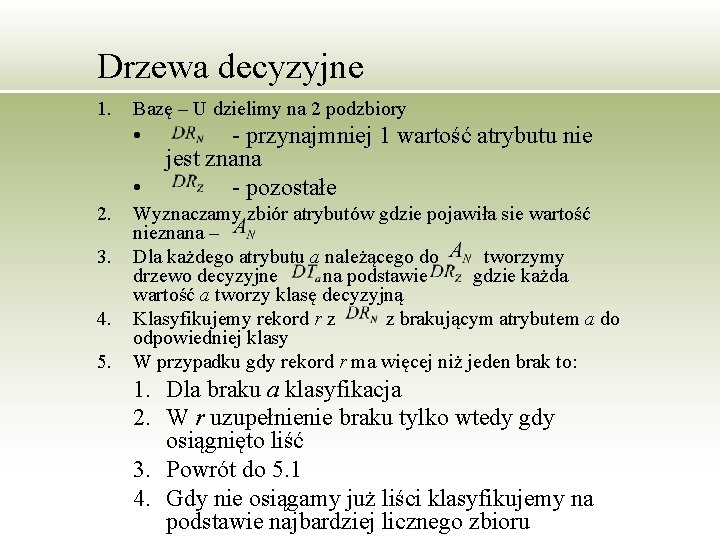

Drzewa decyzyjne 1. Bazę – U dzielimy na 2 podzbiory • • 2. 3. 4. 5. - przynajmniej 1 wartość atrybutu nie jest znana - pozostałe Wyznaczamy zbiór atrybutów gdzie pojawiła sie wartość nieznana – Dla każdego atrybutu a należącego do tworzymy drzewo decyzyjne na podstawie gdzie każda wartość a tworzy klasę decyzyjną Klasyfikujemy rekord r z z brakującym atrybutem a do odpowiedniej klasy W przypadku gdy rekord r ma więcej niż jeden brak to: 1. Dla braku a klasyfikacja 2. W r uzupełnienie braku tylko wtedy gdy osiągnięto liść 3. Powrót do 5. 1 4. Gdy nie osiągamy już liści klasyfikujemy na podstawie najbardziej licznego zbioru

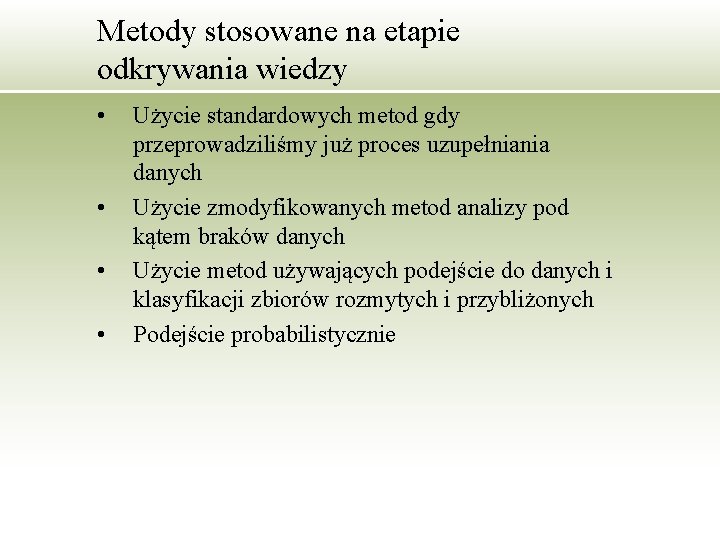

Metody stosowane na etapie odkrywania wiedzy • • Użycie standardowych metod gdy przeprowadziliśmy już proces uzupełniania danych Użycie zmodyfikowanych metod analizy pod kątem braków danych Użycie metod używających podejście do danych i klasyfikacji zbiorów rozmytych i przybliżonych Podejście probabilistycznie

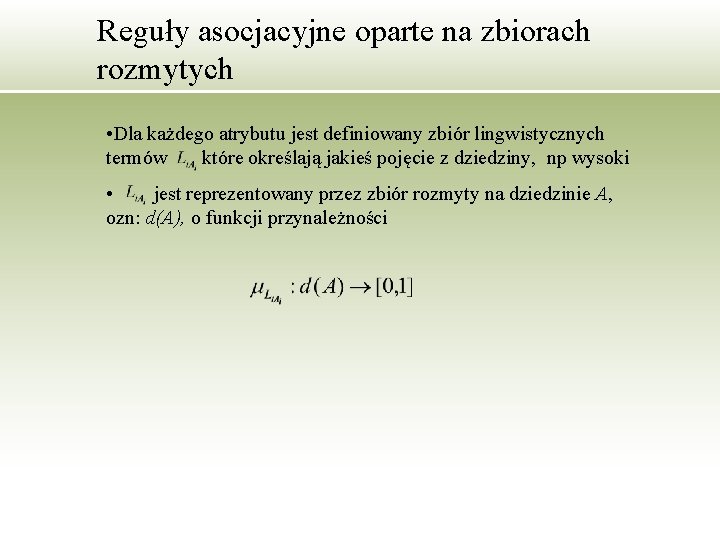

Reguły asocjacyjne oparte na zbiorach rozmytych • Dla każdego atrybutu jest definiowany zbiór lingwistycznych termów które określają jakieś pojęcie z dziedziny, np wysoki • jest reprezentowany przez zbiór rozmyty na dziedzinie A, ozn: d(A), o funkcji przynależności

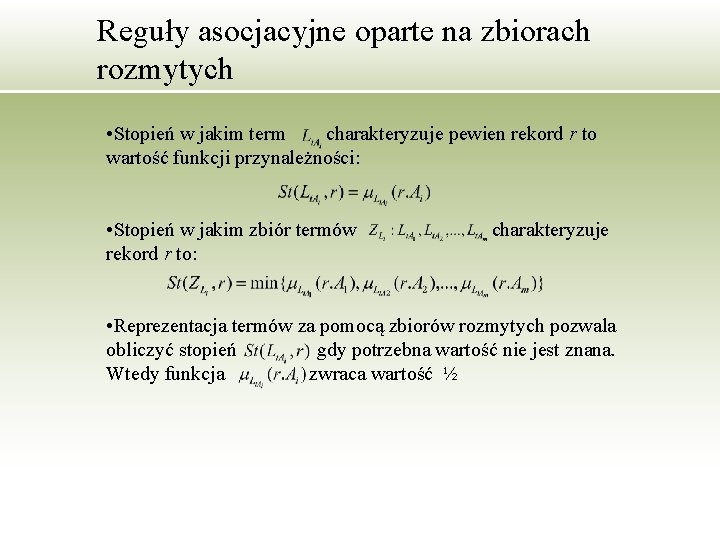

Reguły asocjacyjne oparte na zbiorach rozmytych • Stopień w jakim term charakteryzuje pewien rekord r to wartość funkcji przynależności: • Stopień w jakim zbiór termów rekord r to: charakteryzuje • Reprezentacja termów za pomocą zbiorów rozmytych pozwala obliczyć stopień gdy potrzebna wartość nie jest znana. Wtedy funkcja zwraca wartość ½

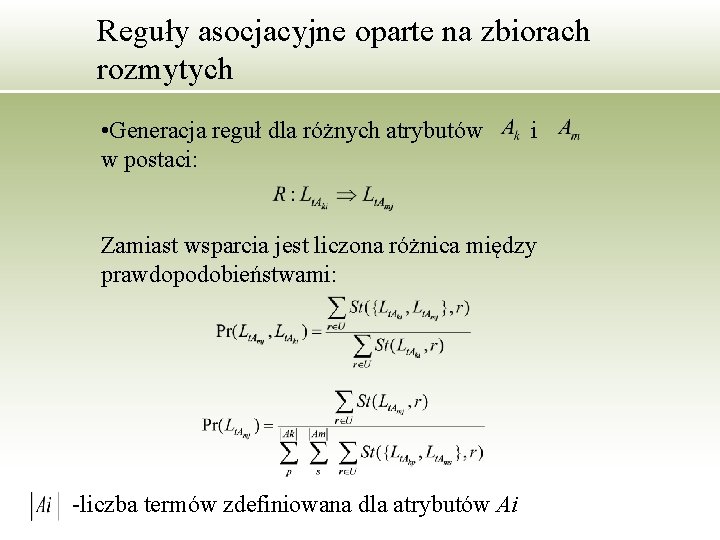

Reguły asocjacyjne oparte na zbiorach rozmytych • Generacja reguł dla różnych atrybutów w postaci: i Zamiast wsparcia jest liczona różnica między prawdopodobieństwami: -liczba termów zdefiniowana dla atrybutów Ai

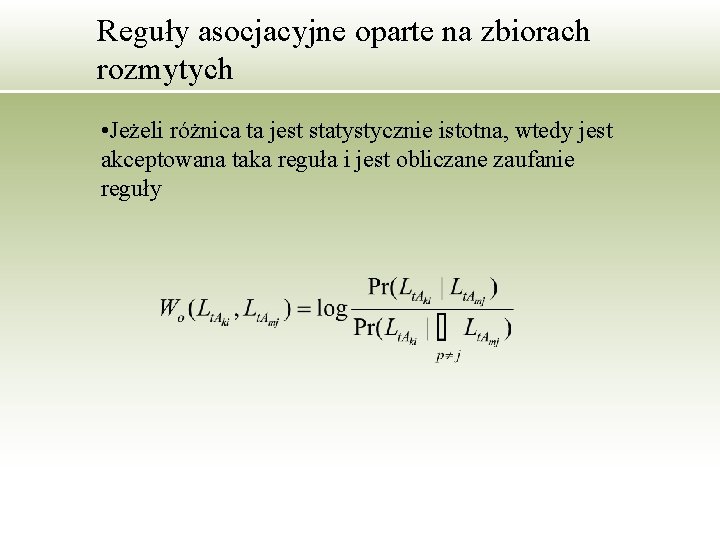

Reguły asocjacyjne oparte na zbiorach rozmytych • Jeżeli różnica ta jest statystycznie istotna, wtedy jest akceptowana taka reguła i jest obliczane zaufanie reguły

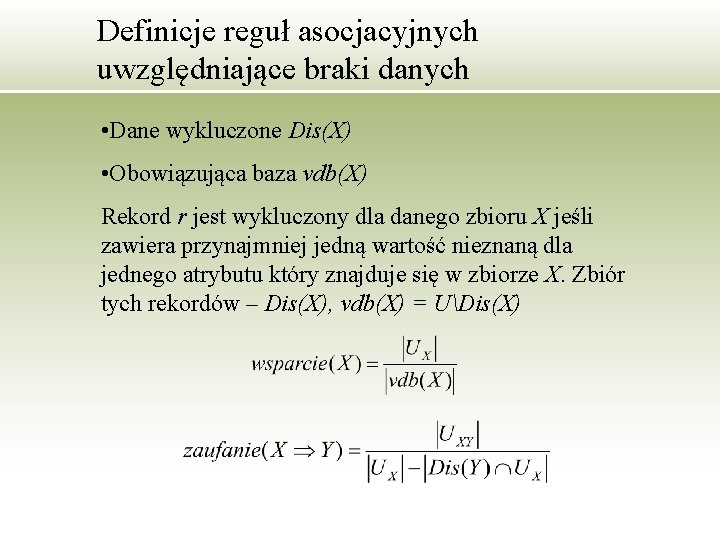

Definicje reguł asocjacyjnych uwzględniające braki danych • Dane wykluczone Dis(X) • Obowiązująca baza vdb(X) Rekord r jest wykluczony dla danego zbioru X jeśli zawiera przynajmniej jedną wartość nieznaną dla jednego atrybutu który znajduje się w zbiorze X. Zbiór tych rekordów – Dis(X), vdb(X) = UDis(X)

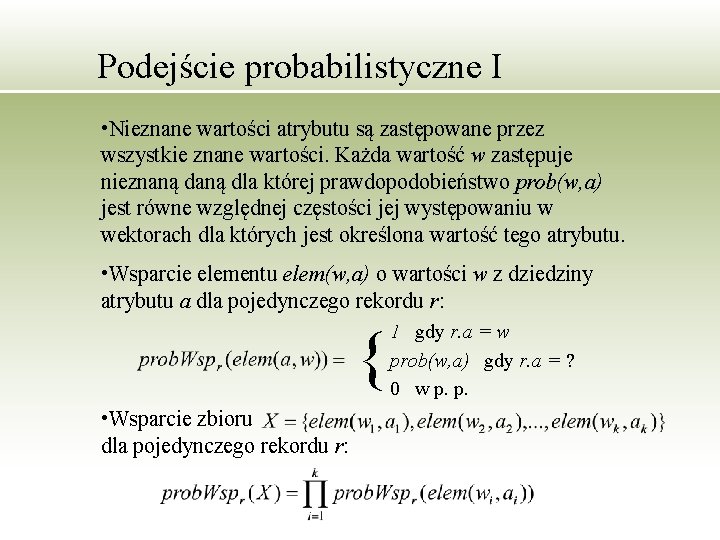

Podejście probabilistyczne I • Nieznane wartości atrybutu są zastępowane przez wszystkie znane wartości. Każda wartość w zastępuje nieznaną dla której prawdopodobieństwo prob(w, a) jest równe względnej częstości jej występowaniu w wektorach dla których jest określona wartość tego atrybutu. • Wsparcie elementu elem(w, a) o wartości w z dziedziny atrybutu a dla pojedynczego rekordu r: { • Wsparcie zbioru dla pojedynczego rekordu r: 1 gdy r. a = w prob(w, a) gdy r. a = ? 0 w p. p.

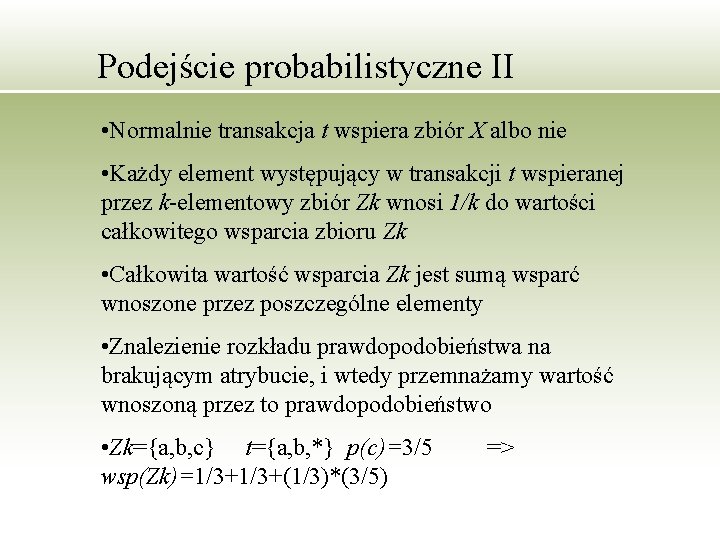

Podejście probabilistyczne II • Normalnie transakcja t wspiera zbiór X albo nie • Każdy element występujący w transakcji t wspieranej przez k-elementowy zbiór Zk wnosi 1/k do wartości całkowitego wsparcia zbioru Zk • Całkowita wartość wsparcia Zk jest sumą wsparć wnoszone przez poszczególne elementy • Znalezienie rozkładu prawdopodobieństwa na brakującym atrybucie, i wtedy przemnażamy wartość wnoszoną przez to prawdopodobieństwo • Zk={a, b, c} t={a, b, *} p(c)=3/5 wsp(Zk)=1/3+(1/3)*(3/5) =>

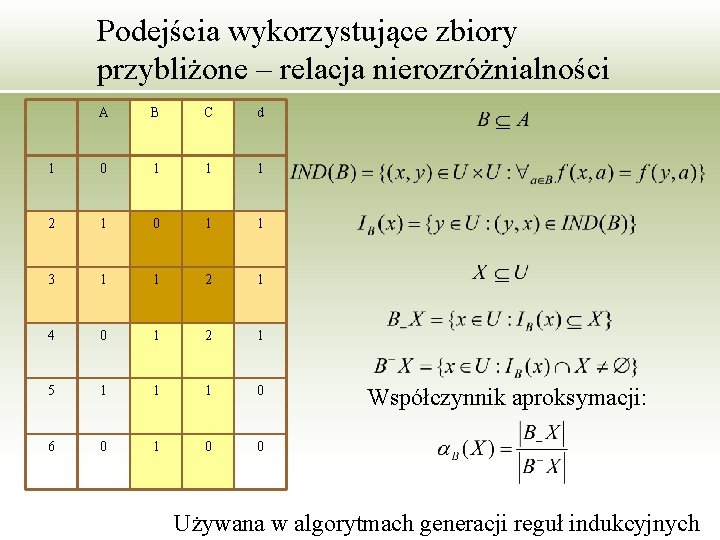

Podejścia wykorzystujące zbiory przybliżone – relacja nierozróżnialności A B C d 1 0 1 1 1 2 1 0 1 1 3 1 1 2 1 4 0 1 2 1 5 1 1 1 0 6 0 1 0 0 Współczynnik aproksymacji: Używana w algorytmach generacji reguł indukcyjnych

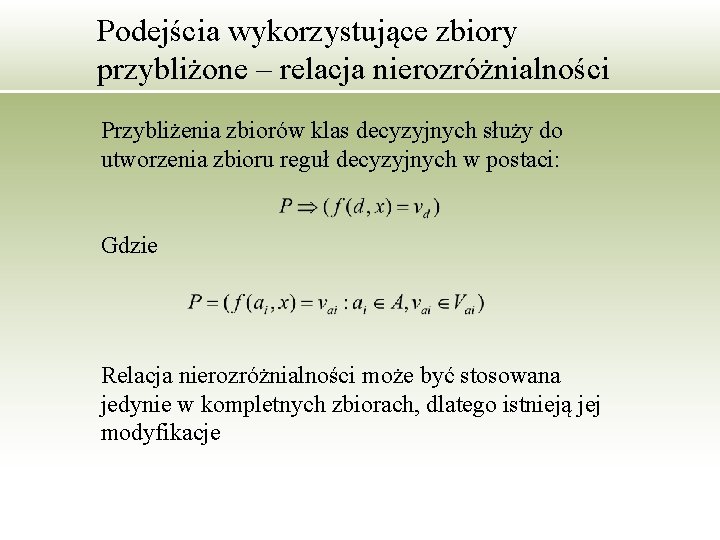

Podejścia wykorzystujące zbiory przybliżone – relacja nierozróżnialności Przybliżenia zbiorów klas decyzyjnych służy do utworzenia zbioru reguł decyzyjnych w postaci: Gdzie Relacja nierozróżnialności może być stosowana jedynie w kompletnych zbiorach, dlatego istnieją jej modyfikacje

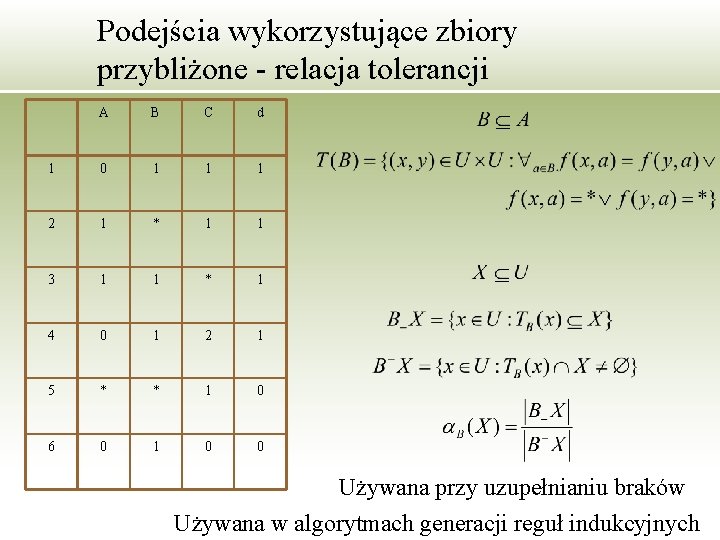

Podejścia wykorzystujące zbiory przybliżone - relacja tolerancji A B C d 1 0 1 1 1 2 1 * 1 1 3 1 1 * 1 4 0 1 2 1 5 * * 1 0 6 0 1 0 0 Używana przy uzupełnianiu braków Używana w algorytmach generacji reguł indukcyjnych

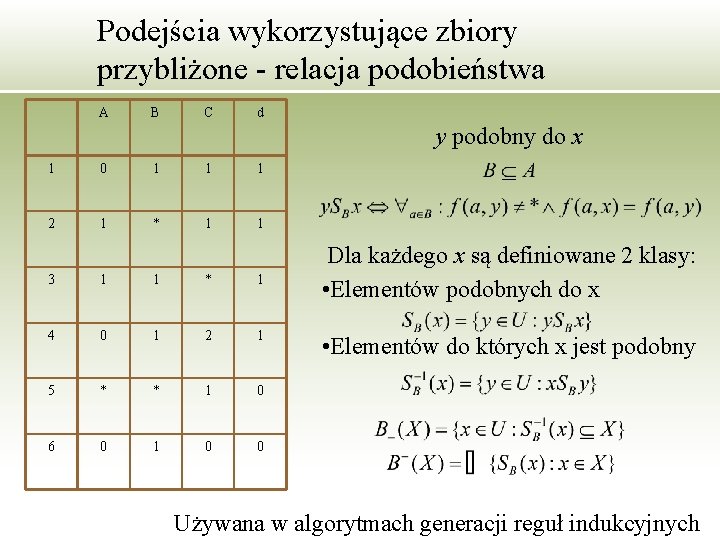

Podejścia wykorzystujące zbiory przybliżone - relacja podobieństwa A B C d y podobny do x 1 0 1 1 1 2 1 * 1 1 3 1 1 * 1 4 0 1 2 1 5 * * 1 0 6 0 1 0 0 Dla każdego x są definiowane 2 klasy: • Elementów podobnych do x • Elementów do których x jest podobny Używana w algorytmach generacji reguł indukcyjnych

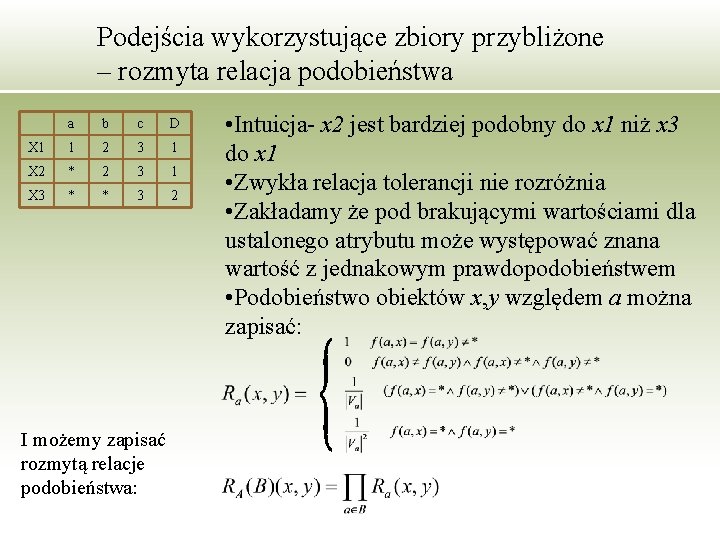

Podejścia wykorzystujące zbiory przybliżone – rozmyta relacja podobieństwa a b c D X 1 1 2 3 1 X 2 * 2 3 1 X 3 * * 3 2 I możemy zapisać rozmytą relacje podobieństwa: • Intuicja- x 2 jest bardziej podobny do x 1 niż x 3 do x 1 • Zwykła relacja tolerancji nie rozróżnia • Zakładamy że pod brakującymi wartościami dla ustalonego atrybutu może występować znana wartość z jednakowym prawdopodobieństwem • Podobieństwo obiektów x, y względem a można zapisać:

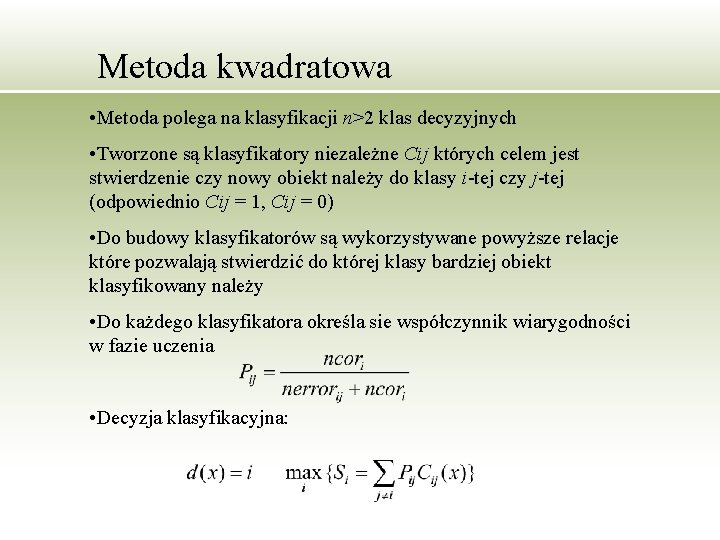

Metoda kwadratowa • Metoda polega na klasyfikacji n>2 klas decyzyjnych • Tworzone są klasyfikatory niezależne Cij których celem jest stwierdzenie czy nowy obiekt należy do klasy i-tej czy j-tej (odpowiednio Cij = 1, Cij = 0) • Do budowy klasyfikatorów są wykorzystywane powyższe relacje które pozwalają stwierdzić do której klasy bardziej obiekt klasyfikowany należy • Do każdego klasyfikatora określa sie współczynnik wiarygodności w fazie uczenia • Decyzja klasyfikacyjna:

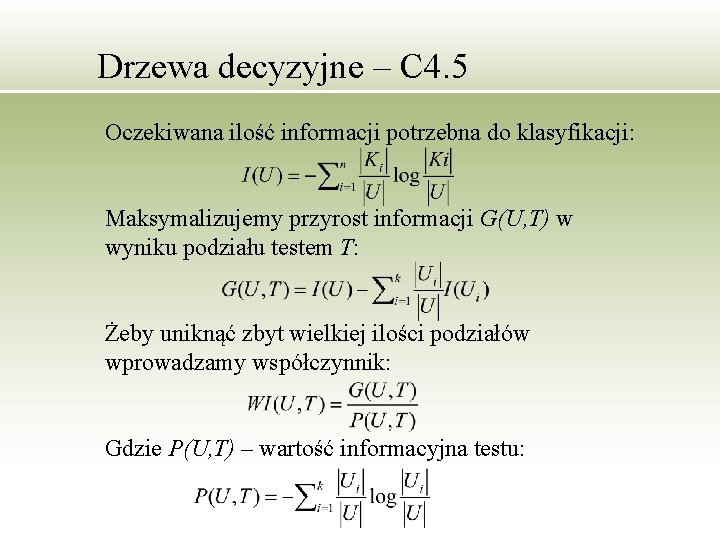

Drzewa decyzyjne – C 4. 5 Oczekiwana ilość informacji potrzebna do klasyfikacji: Maksymalizujemy przyrost informacji G(U, T) w wyniku podziału testem T: Żeby uniknąć zbyt wielkiej ilości podziałów wprowadzamy współczynnik: Gdzie P(U, T) – wartość informacyjna testu:

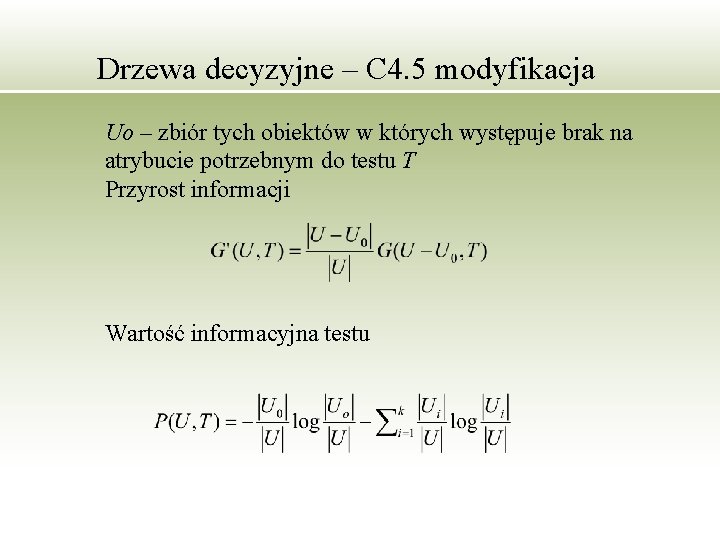

Drzewa decyzyjne – C 4. 5 modyfikacja Uo – zbiór tych obiektów w których występuje brak na atrybucie potrzebnym do testu T Przyrost informacji Wartość informacyjna testu

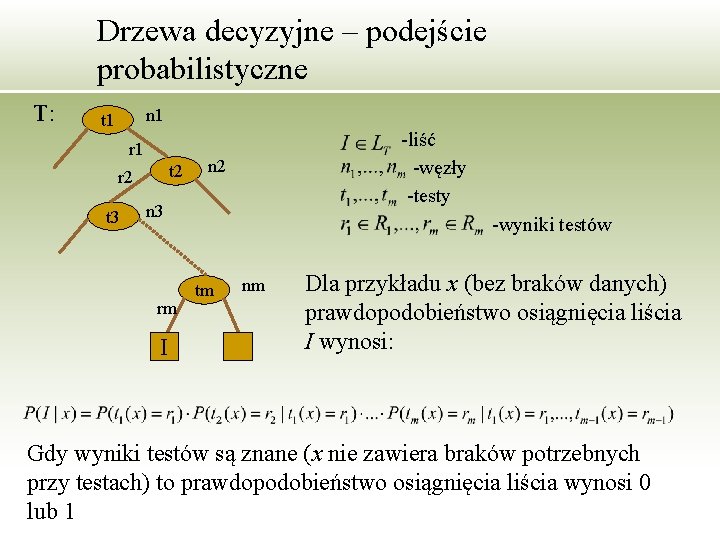

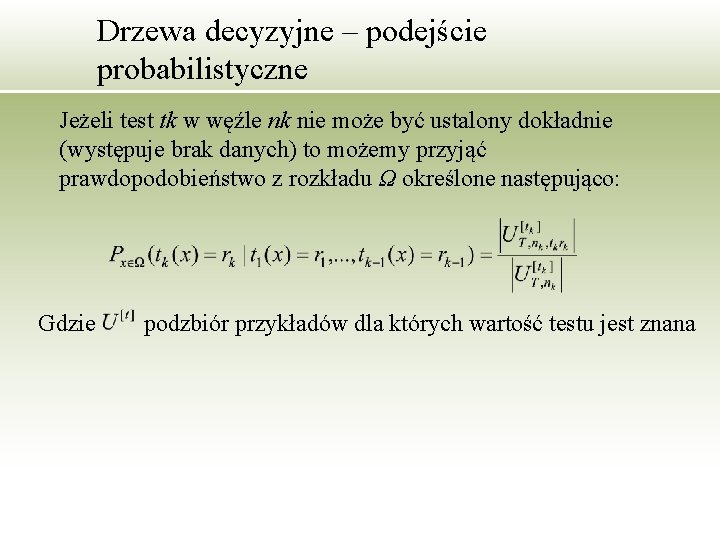

Drzewa decyzyjne – podejście probabilistyczne T: n 1 t 1 r 1 t 2 r 2 t 3 -liść -węzły -testy n 2 n 3 rm I -wyniki testów tm nm Dla przykładu x (bez braków danych) prawdopodobieństwo osiągnięcia liścia I wynosi: Gdy wyniki testów są znane (x nie zawiera braków potrzebnych przy testach) to prawdopodobieństwo osiągnięcia liścia wynosi 0 lub 1

Drzewa decyzyjne – podejście probabilistyczne Jeżeli test tk w węźle nk nie może być ustalony dokładnie (występuje brak danych) to możemy przyjąć prawdopodobieństwo z rozkładu Ω określone następująco: Gdzie podzbiór przykładów dla których wartość testu jest znana

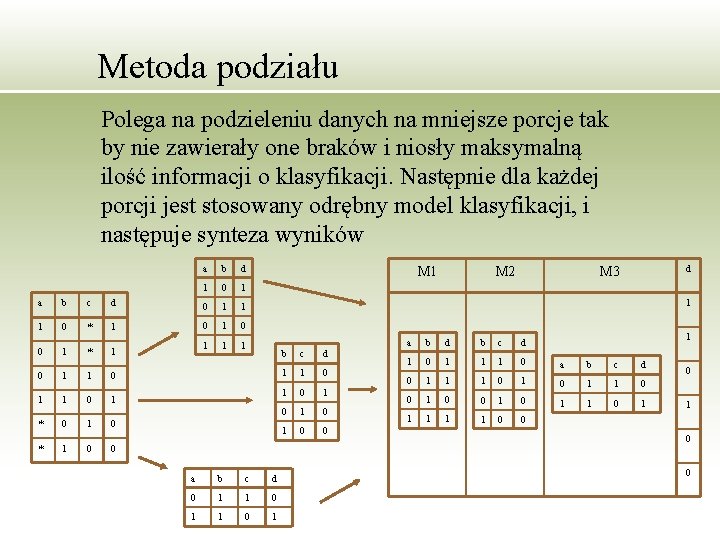

Metoda podziału Polega na podzieleniu danych na mniejsze porcje tak by nie zawierały one braków i niosły maksymalną ilość informacji o klasyfikacji. Następnie dla każdej porcji jest stosowany odrębny model klasyfikacji, i następuje synteza wyników a b d 1 0 1 a b c d 0 1 1 1 0 * 1 0 1 1 1 0 1 * 1 0 1 * 0 1 0 * 1 0 0 M 1 M 2 d M 3 1 a b c d 0 1 1 0 1 b c d 1 1 0 1 0 1 0 0 1 a b d b c d 1 0 1 1 1 0 a b c d 0 1 1 1 0 0 1 0 1 1 1 0 0 0 1 0 0

Literatura • Imieliński T. , Lipiński W. , Incomplete Information in Relational Databases, Journal of the AEM, tom 31, 1984 • Chan K. C. C. , Wai-Ho A. , Mining Fuzzy Association Rules, Proceedings of the Sixth International Conference on Information and Knowledge Managment, Las Vegas, 1997 • Regel A. , Cremilleux B. , Treatment of Missing Values for Association Rules, Proceedings of Research and Development in Knowledge Discovery and Data Mining, Second Pacific. Asia Conference, PAKDD-98, Melbourne, 1998 • Protaziuk G. , Odkrywanie wiedzy w niekopletnych zbiorach danych, rozprawa doktorska, Warszawa 2005 • Kryszewicz M. , Rybiński H. , Incomplete database issues for representative association rules, Proceedings of Foundations of Inteligent Systems, 11 th International Symposium, Warszawa 1999 • Nayak J. R. , Cook D. J. , Approximate Association Rule Mining, Proceedings of the Fourteenth International Articital Inteligence Research Society Conference, Key West, Floryda, 2001 • Feelders A. , Handling missing data in trees: surrogate splits of statistical ipmutation? , Proceedings of Principles of Data Mining and Knowledge Discovery Third European Confereance, PKDD ’ 99, Praga, 1999

Dziękuję za uwagę

- Slides: 33