SudEst Intelligence Artificielle Rseaux neuronaux JeanJacques Legoll jj

- Slides: 66

Sud-Est Intelligence Artificielle Réseaux neuronaux Jean-Jacques Legoll jj. legoll@outlook. com 23 -06 -2020

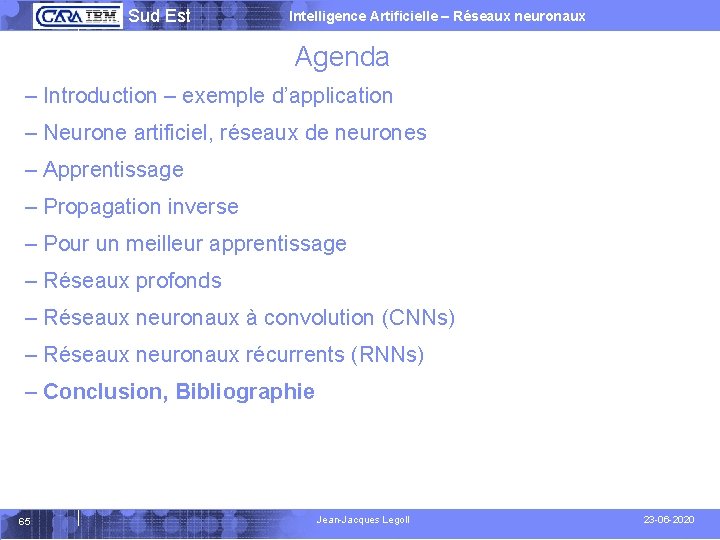

Sud Est Intelligence Artificielle – Réseaux neuronaux Agenda – Introduction – exemple d’application – Neurone artificiel, réseaux de neurones – Apprentissage – Propagation inverse – Pour un meilleur apprentissage – Réseaux profonds – Réseaux neuronaux à convolution (CNNs) – Réseaux neuronaux récurrents (RNNs) – Conclusion, Bibliographie 2 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux IA - Définition ‘La construction de programmes informatiques qui s’adonnent à des tâches qui sont, pour l’instant, accomplies de façon plus satisfaisante par des êtres humains car elles demandent des processus mentaux de haut niveau tels que : l’apprentissage perceptuel, l’organisation de la mémoire et le raisonnement critique’ (Marvin Lee Minsky, 1956) – Au-delà du calcul et de la logique strictement déductive – Objectif – un agent intelligent – optimise les chances d’atteindre un but fixé – maximise l’utilité espérée > fonction d’utilité: mesure de performance de l’agent > espérance: intègre l’incertitude – Systèmes Intelligents - caractéristiques > Capables d’apprendre (améliorer les performances par l’observation) > Modélisation de l’incertain > Résultats probabilistes 3 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Types d’apprentissage • Chaque type caractérisé par un mode d’acquisition des connaissances • Non supervisé – L’agent apprend par lui-même > découverte de corrélations, de similitudes, de classifications. . . • Renforcement (expérience) – L’agent apprend par succès / échec, récompense / punition • Supervisé – Phase d’entraînement de l’agent, au moyen d’exemples fournis par un ‘instructeur’ – Phase opérationnelle • Un réseau de neurones artificiels est un modèle mathématique – Capable d’apprentissage – Capable de représenter toute fonction continue (approximation universelle, Hornik – 1991) 4 Jean-Jacques Legoll 23 -06 -2020

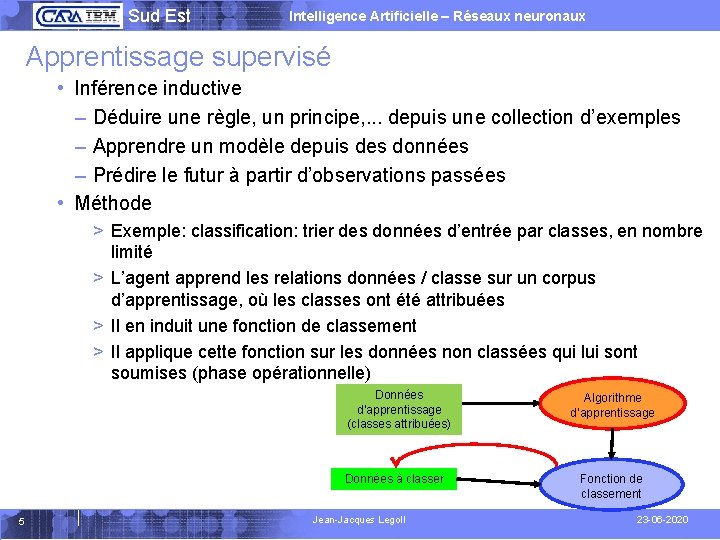

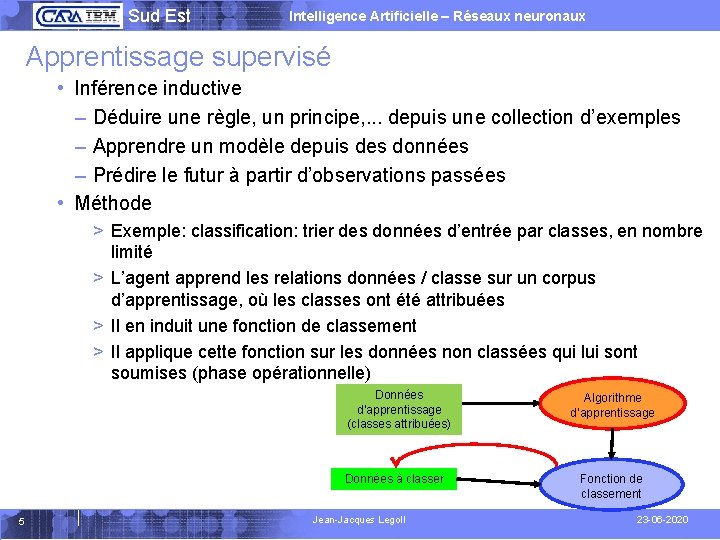

Sud Est Intelligence Artificielle – Réseaux neuronaux Apprentissage supervisé • Inférence inductive – Déduire une règle, un principe, . . . depuis une collection d’exemples – Apprendre un modèle depuis des données – Prédire le futur à partir d’observations passées • Méthode > Exemple: classification: trier des données d’entrée par classes, en nombre limité > L’agent apprend les relations données / classe sur un corpus d’apprentissage, où les classes ont été attribuées > Il en induit une fonction de classement > Il applique cette fonction sur les données non classées qui lui sont soumises (phase opérationnelle) Données d’apprentissage (classes attribuées) Données à classer 5 Jean-Jacques Legoll Algorithme d’apprentissage Fonction de classement 23 -06 -2020

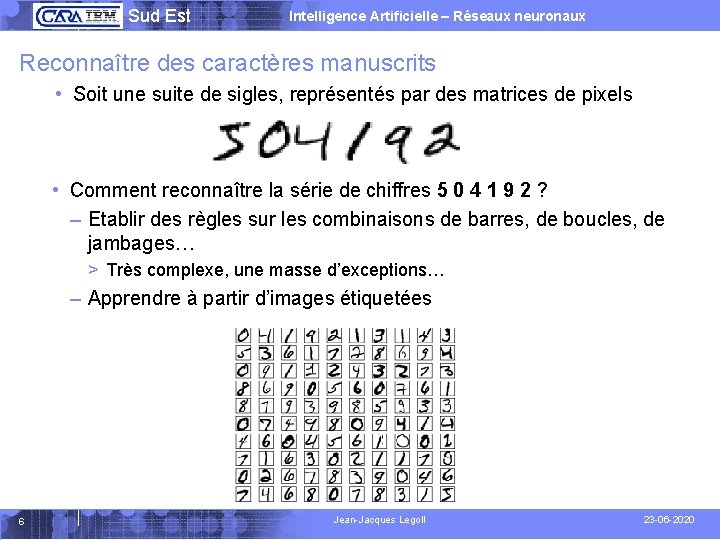

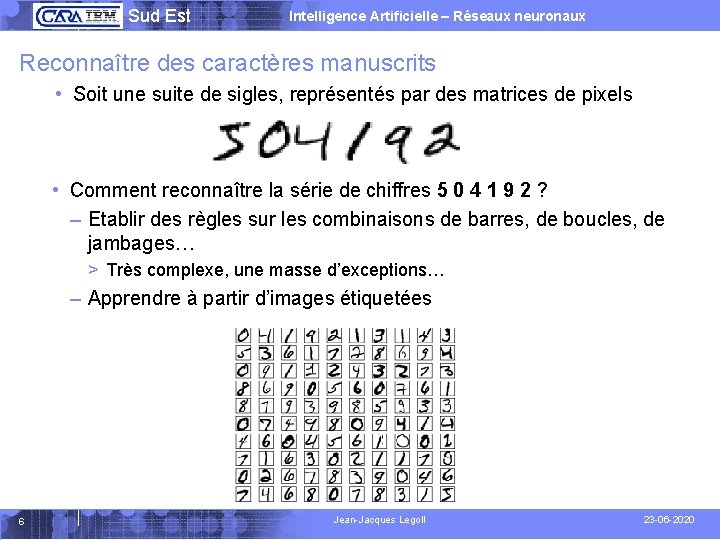

Sud Est Intelligence Artificielle – Réseaux neuronaux Reconnaître des caractères manuscrits • Soit une suite de sigles, représentés par des matrices de pixels • Comment reconnaître la série de chiffres 5 0 4 1 9 2 ? – Etablir des règles sur les combinaisons de barres, de boucles, de jambages… > Très complexe, une masse d’exceptions… – Apprendre à partir d’images étiquetées 6 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Agenda – Introduction – exemple d’application – Neurone artificiel, réseaux de neurones – Apprentissage – Propagation inverse – Pour un meilleur apprentissage – Réseaux profonds – Réseaux neuronaux à convolution (CNNs) – Réseaux neuronaux récurrents (RNNs) – Conclusion, Bibliographie 7 Jean-Jacques Legoll 23 -06 -2020

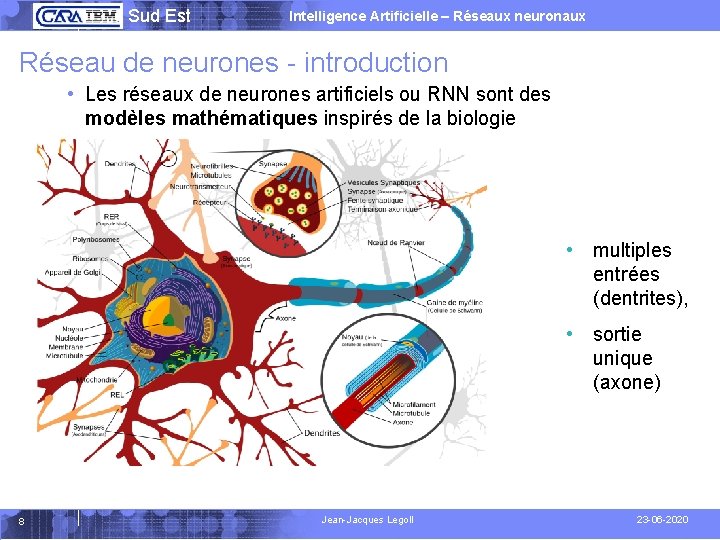

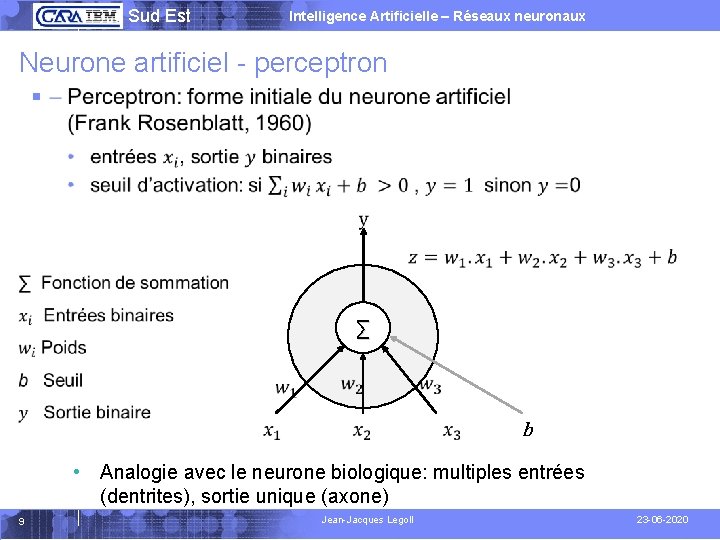

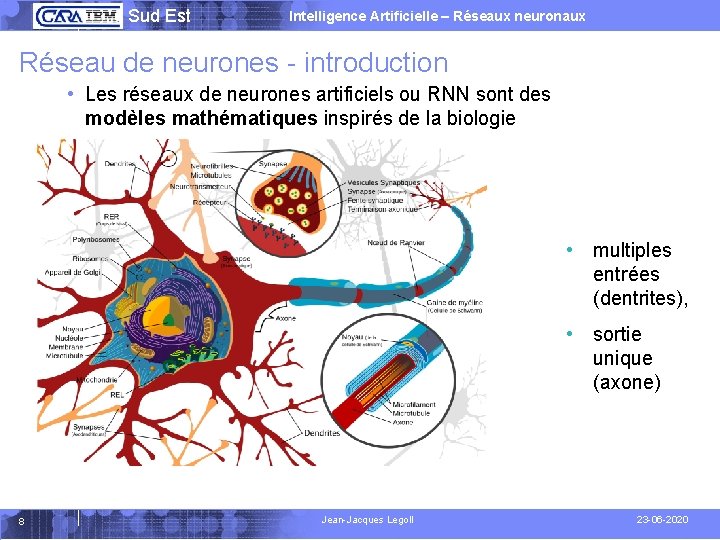

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseau de neurones - introduction • Les réseaux de neurones artificiels ou RNN sont des modèles mathématiques inspirés de la biologie • multiples entrées (dentrites), • sortie unique (axone) 8 Jean-Jacques Legoll 23 -06 -2020

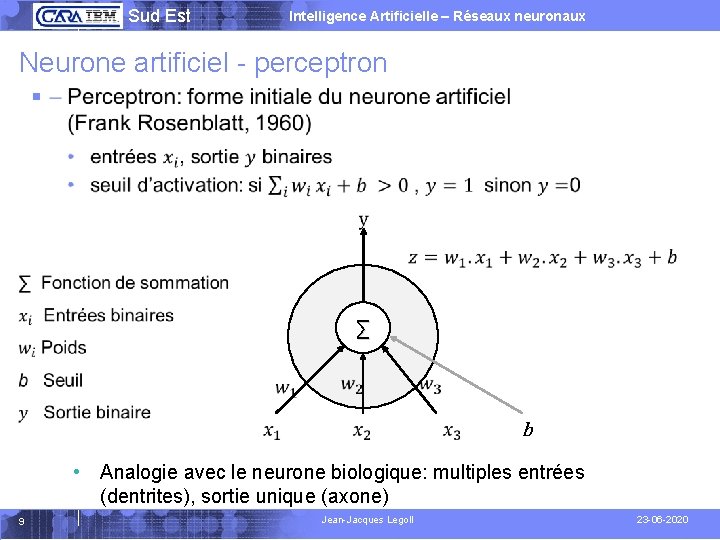

Sud Est Intelligence Artificielle – Réseaux neuronaux Neurone artificiel - perceptron § ∑ b • Analogie avec le neurone biologique: multiples entrées (dentrites), sortie unique (axone) 9 Jean-Jacques Legoll 23 -06 -2020

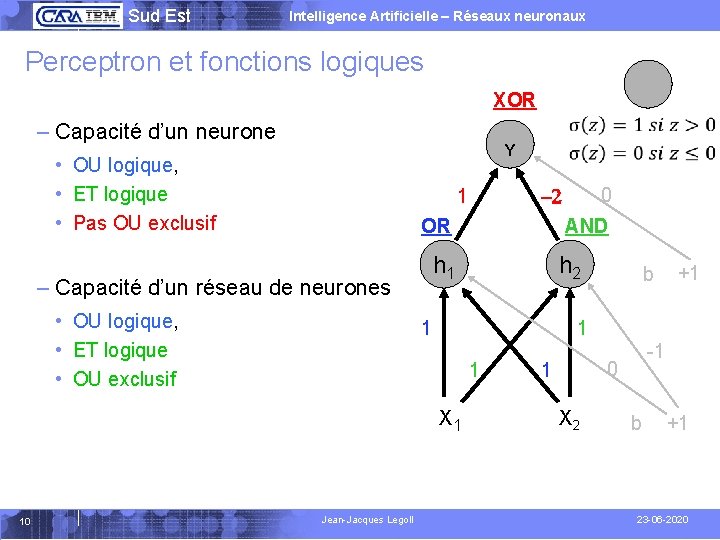

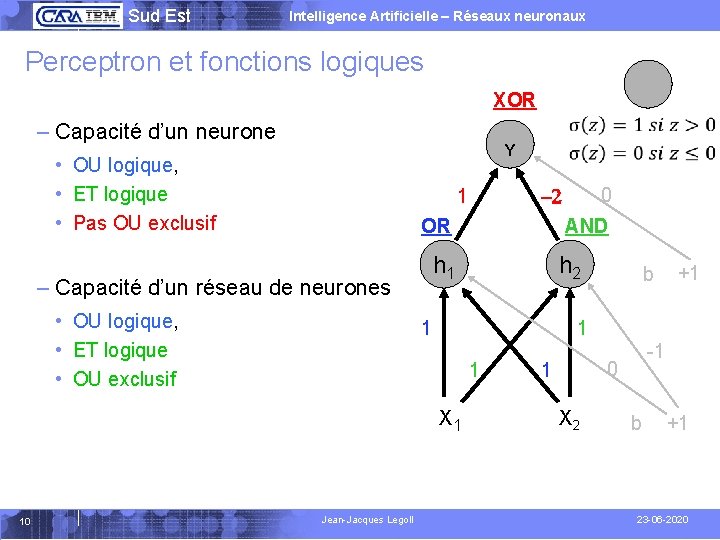

Sud Est Intelligence Artificielle – Réseaux neuronaux Perceptron et fonctions logiques XOR – Capacité d’un neurone Y • OU logique, • ET logique • Pas OU exclusif -2 1 OR • OU logique, • ET logique • OU exclusif h 2 1 b +1 1 1 X 1 Jean-Jacques Legoll 0 AND h 1 – Capacité d’un réseau de neurones 10 -1 0 1 X 2 b +1 23 -06 -2020

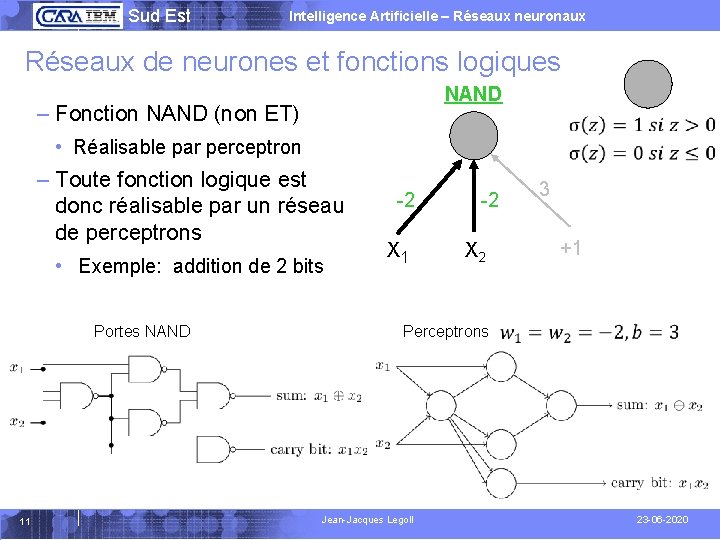

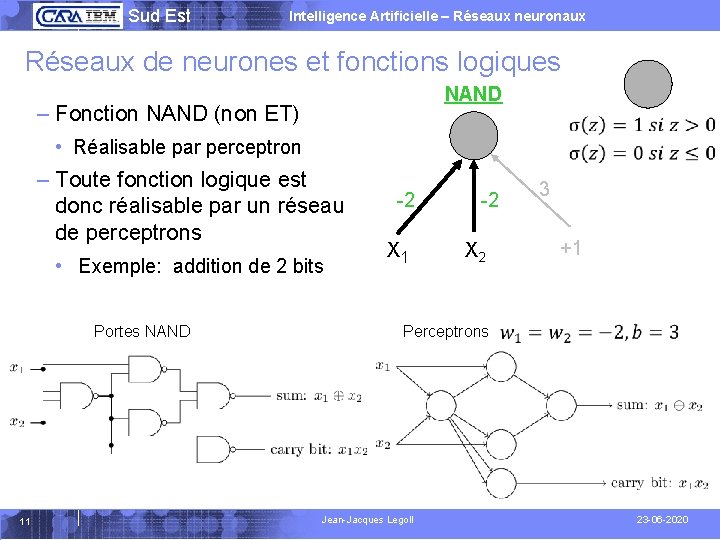

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux de neurones et fonctions logiques NAND – Fonction NAND (non ET) • Réalisable par perceptron – Toute fonction logique est donc réalisable par un réseau de perceptrons • Exemple: addition de 2 bits Portes NAND 11 -2 X 2 3 +1 Perceptrons Jean-Jacques Legoll 23 -06 -2020

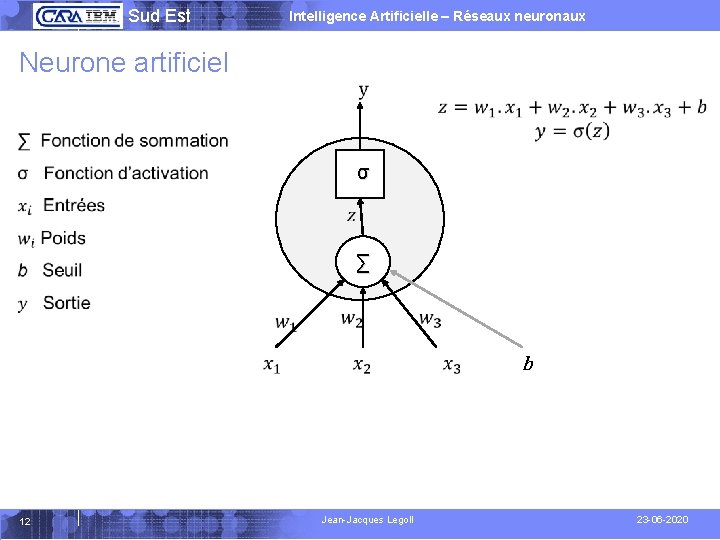

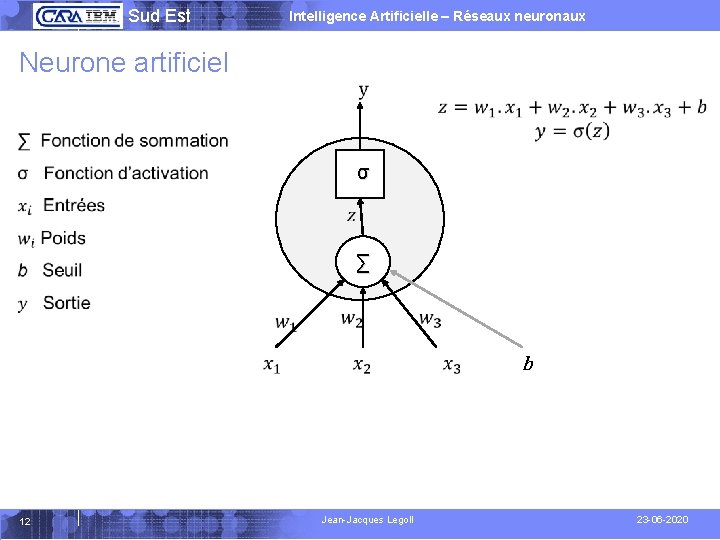

Sud Est Intelligence Artificielle – Réseaux neuronaux Neurone artificiel σ ∑ 12 Jean-Jacques Legoll b 23 -06 -2020

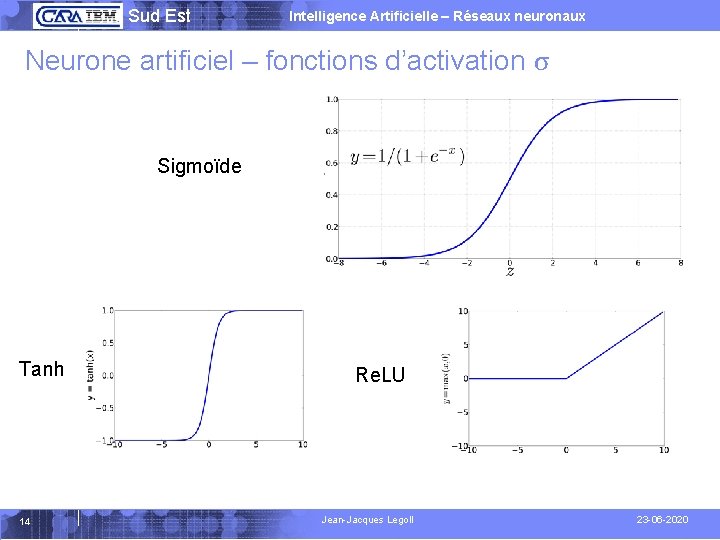

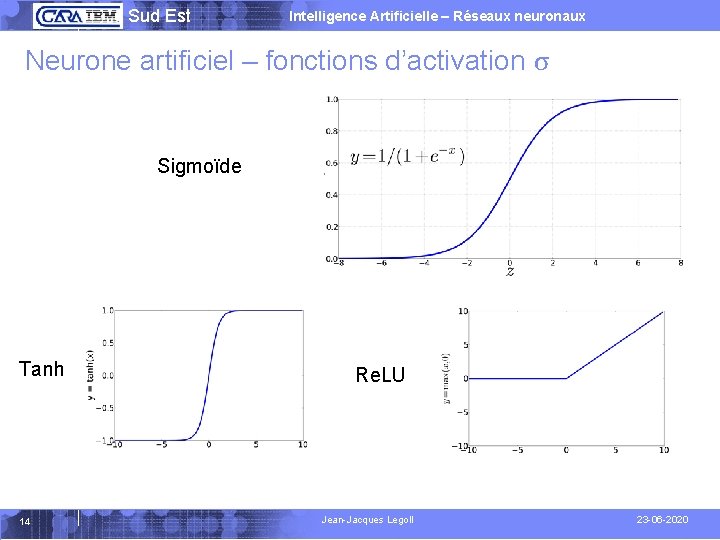

Sud Est Intelligence Artificielle – Réseaux neuronaux Neurone artificiel – fonctions d’activation σ Sigmoïde Tanh 14 Re. LU Jean-Jacques Legoll 23 -06 -2020

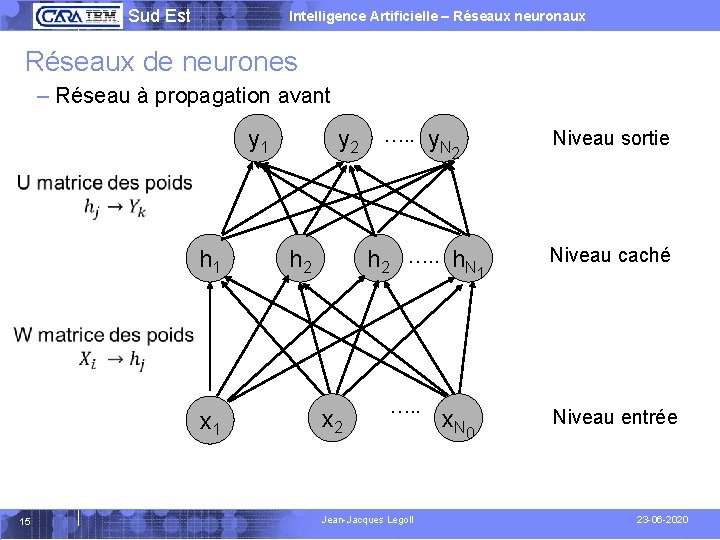

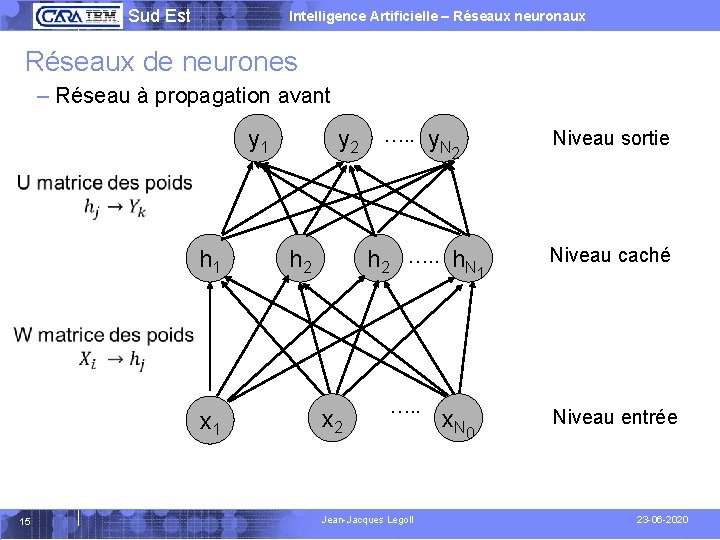

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux de neurones – Réseau à propagation avant y 1 y 2 …. . y. N 2 Niveau sortie h 1 h 2 …. . h. N 1 h 2 Niveau caché x 1 15 x 2 …. . Jean-Jacques Legoll x. N 0 Niveau entrée 23 -06 -2020

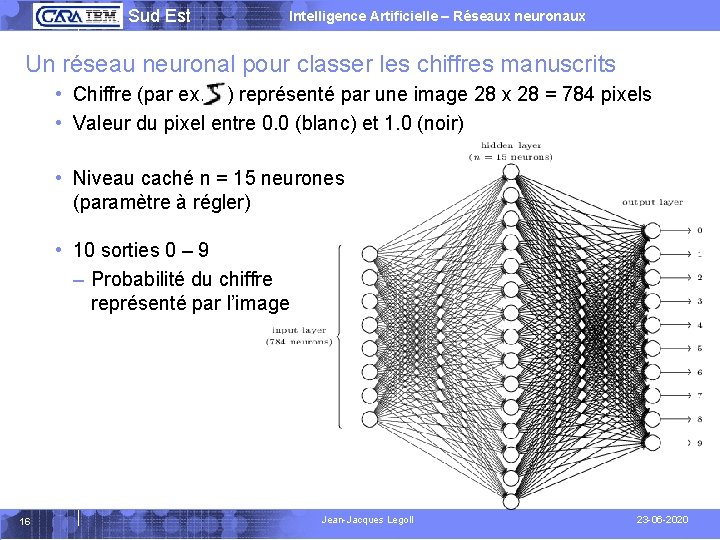

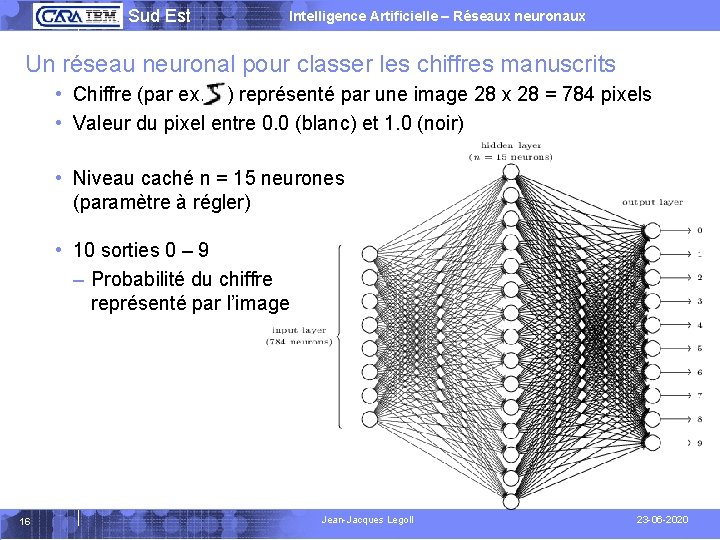

Sud Est Intelligence Artificielle – Réseaux neuronaux Un réseau neuronal pour classer les chiffres manuscrits • Chiffre (par ex. ) représenté par une image 28 x 28 = 784 pixels • Valeur du pixel entre 0. 0 (blanc) et 1. 0 (noir) • Niveau caché n = 15 neurones (paramètre à régler) • 10 sorties 0 – 9 – Probabilité du chiffre représenté par l’image 16 Jean-Jacques Legoll 23 -06 -2020

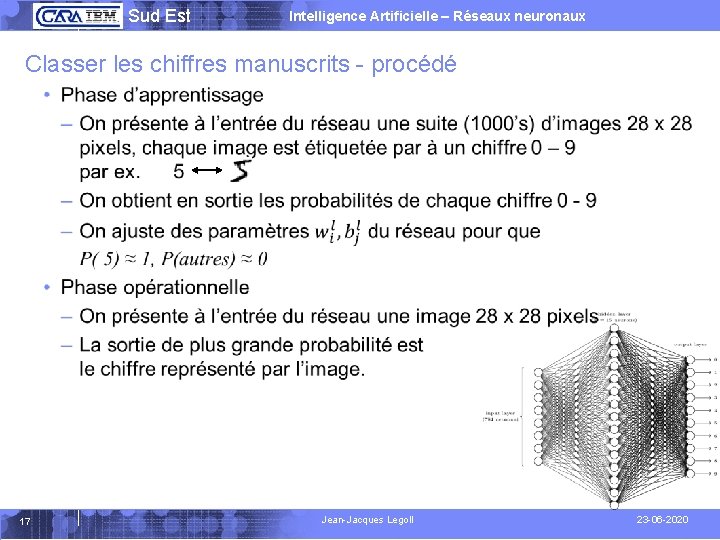

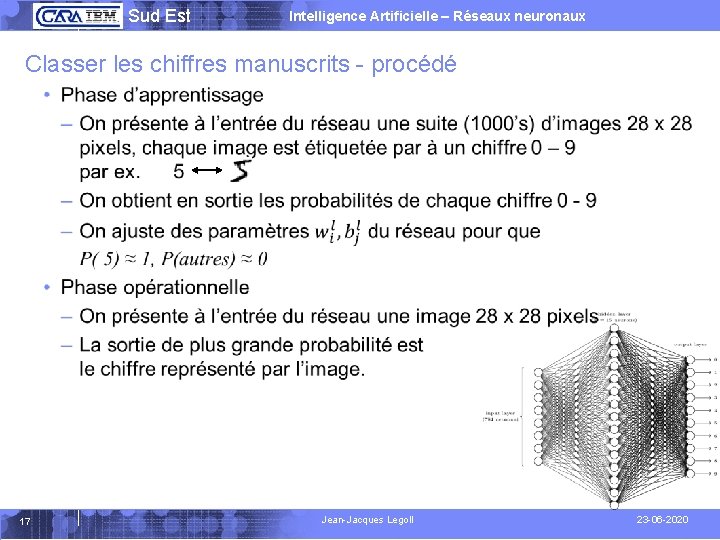

Sud Est Intelligence Artificielle – Réseaux neuronaux Classer les chiffres manuscrits - procédé 17 Jean-Jacques Legoll 23 -06 -2020

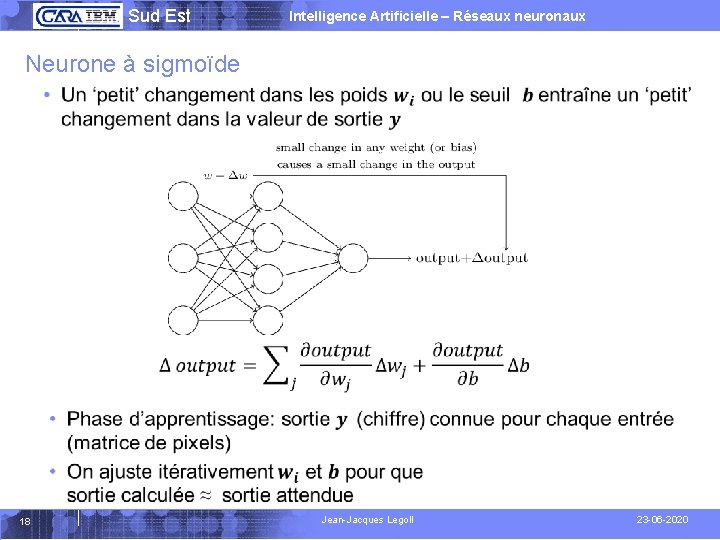

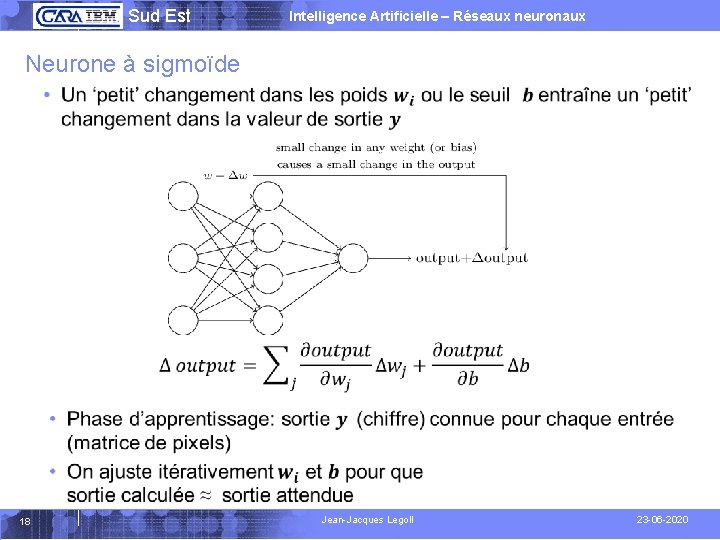

Sud Est Intelligence Artificielle – Réseaux neuronaux Neurone à sigmoïde 18 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Agenda – Introduction – exemple d’application – Neurone artificiel, réseaux de neurones – Apprentissage – Propagation inverse – Pour un meilleur apprentissage – Réseaux profonds – Réseaux neuronaux à convolution (CNNs) – Réseaux neuronaux récurrents (RNNs) – Conclusion, Bibliographie 19 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Apprentissage – le corpus • Corpus d’apprentissage, utilisé pour ajuster les paramètres du réseau – MNIST ( Modified National Institute of Standard): 60000 images de chiffres, écrites par 250 personnes – Images 28 x 28 pixels – Chaque image est étiquetée par le chiffre qu’elle représente • Corpus de test, utilisé pour vérifier les paramètres, avant mise en opération du réseau – MNIST: 10000 images de chiffres, écrites par 250 personnes – Images 28 x 28 pixels – Images et personnes différentes de celles du corpus d’apprentissage 20 Jean-Jacques Legoll 23 -06 -2020

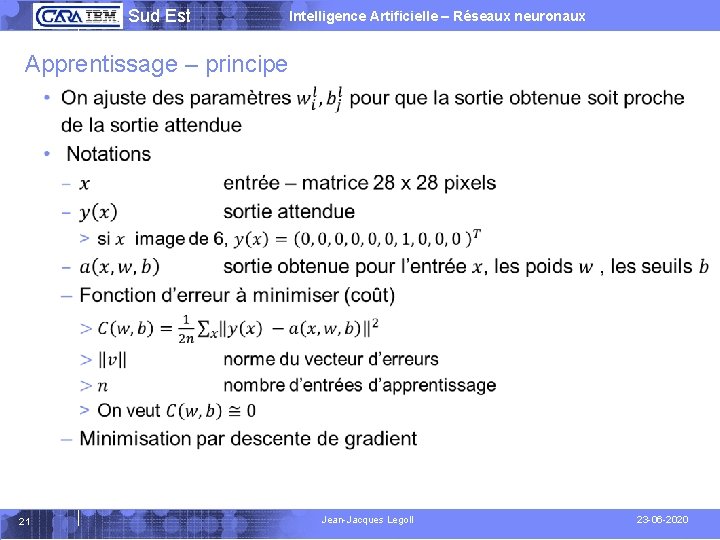

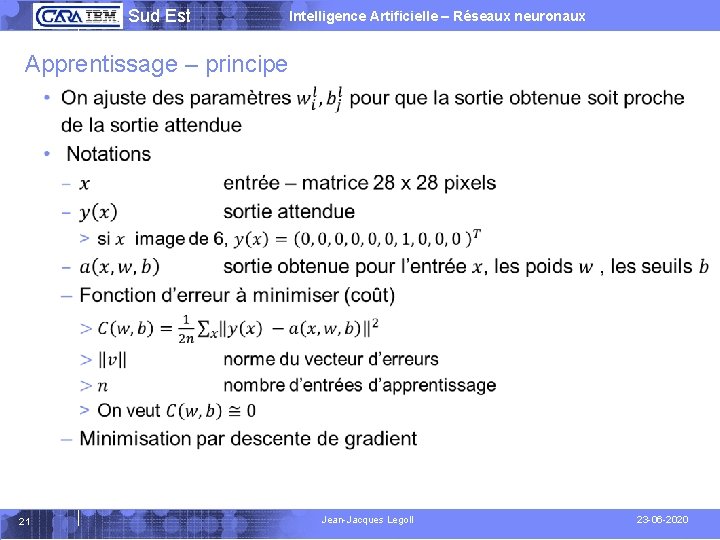

Sud Est Intelligence Artificielle – Réseaux neuronaux Apprentissage – principe 21 Jean-Jacques Legoll 23 -06 -2020

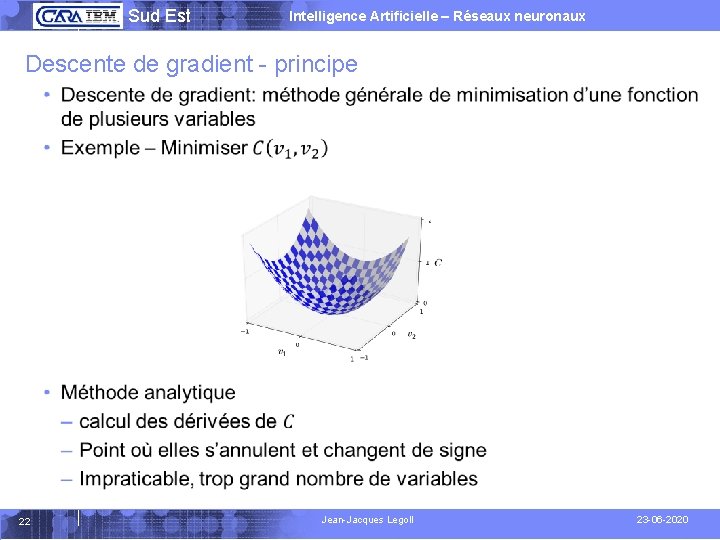

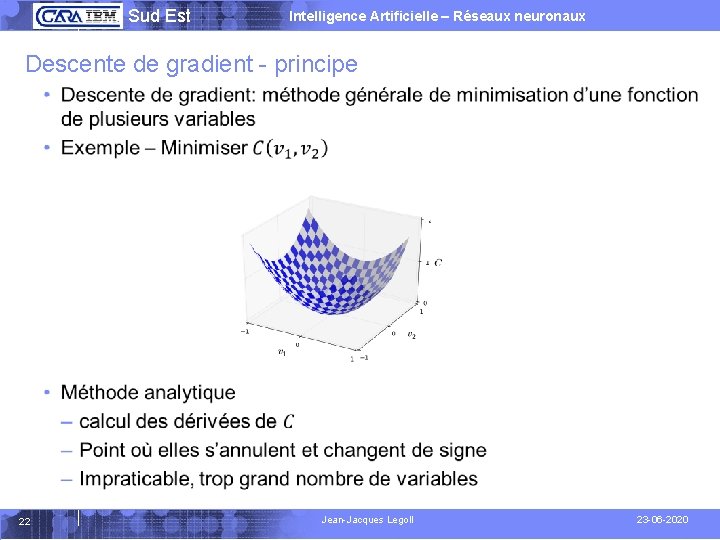

Sud Est Intelligence Artificielle – Réseaux neuronaux Descente de gradient - principe 22 Jean-Jacques Legoll 23 -06 -2020

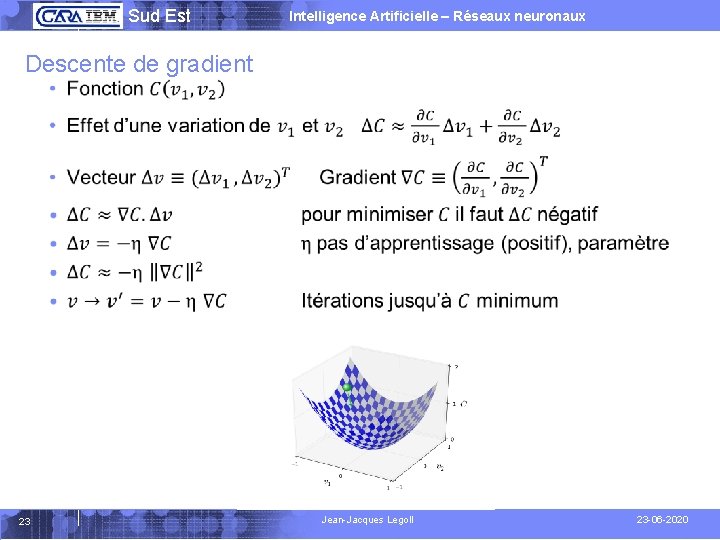

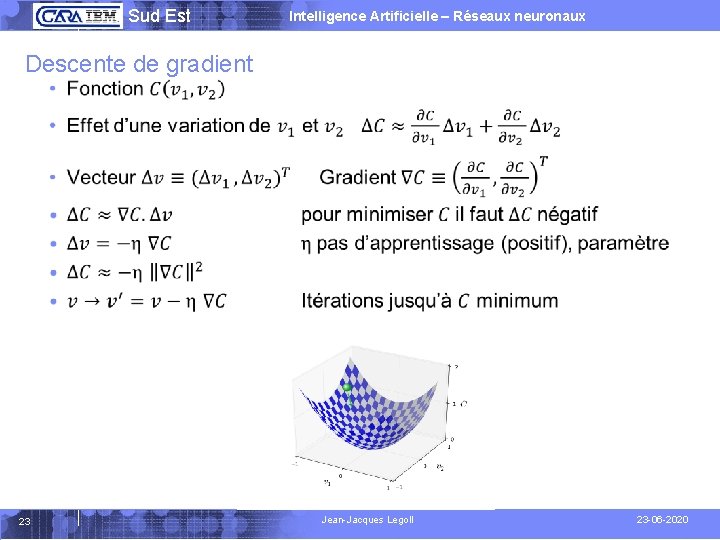

Sud Est Intelligence Artificielle – Réseaux neuronaux Descente de gradient 23 Jean-Jacques Legoll 23 -06 -2020

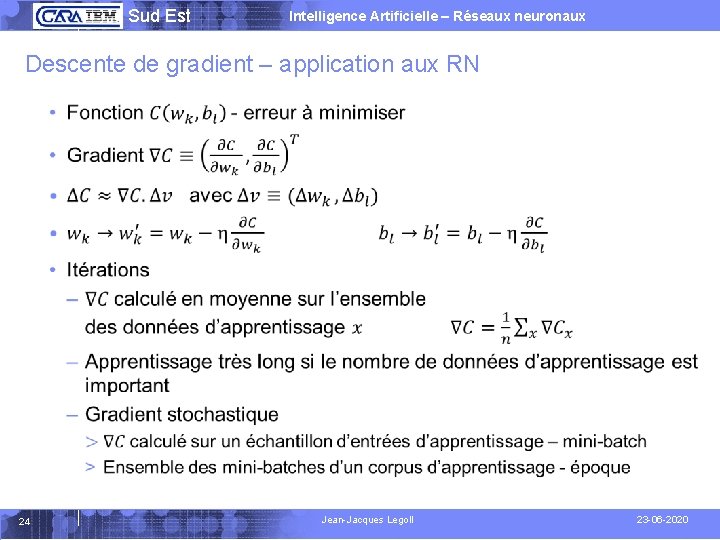

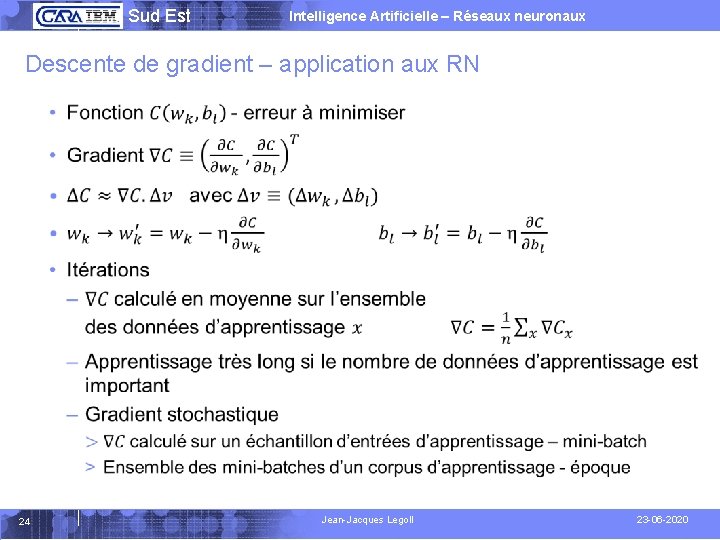

Sud Est Intelligence Artificielle – Réseaux neuronaux Descente de gradient – application aux RN 24 Jean-Jacques Legoll 23 -06 -2020

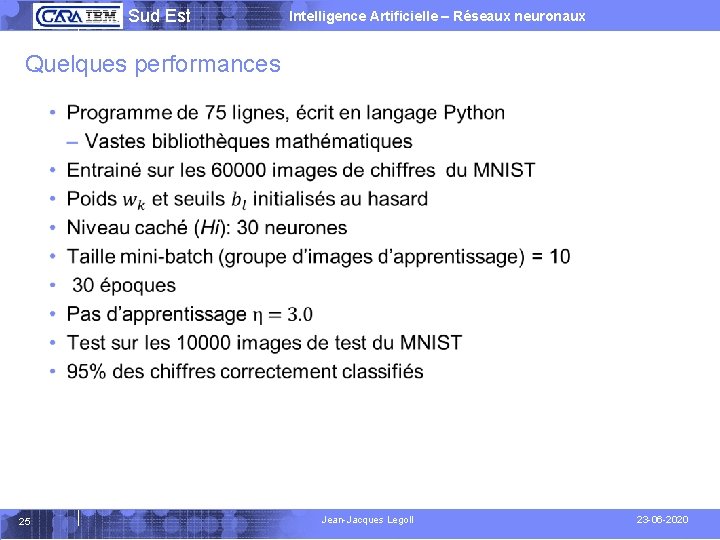

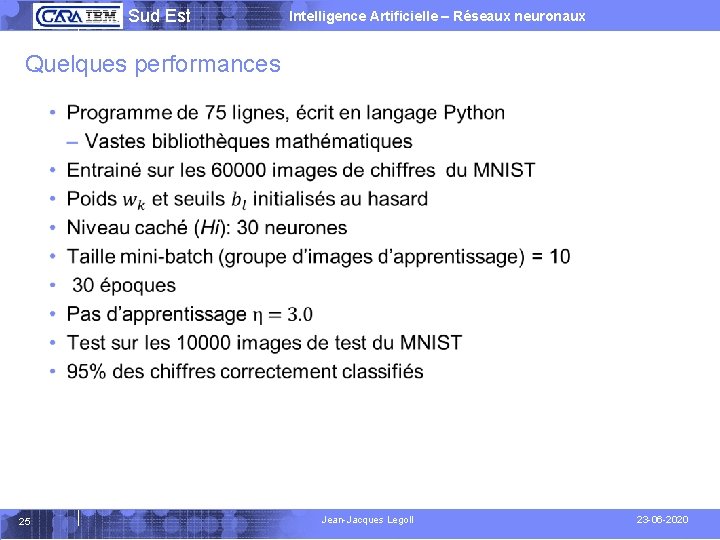

Sud Est Intelligence Artificielle – Réseaux neuronaux Quelques performances 25 Jean-Jacques Legoll 23 -06 -2020

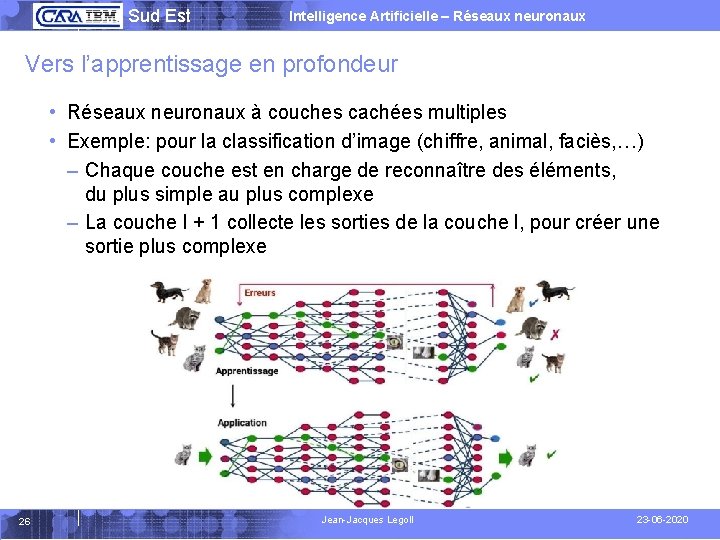

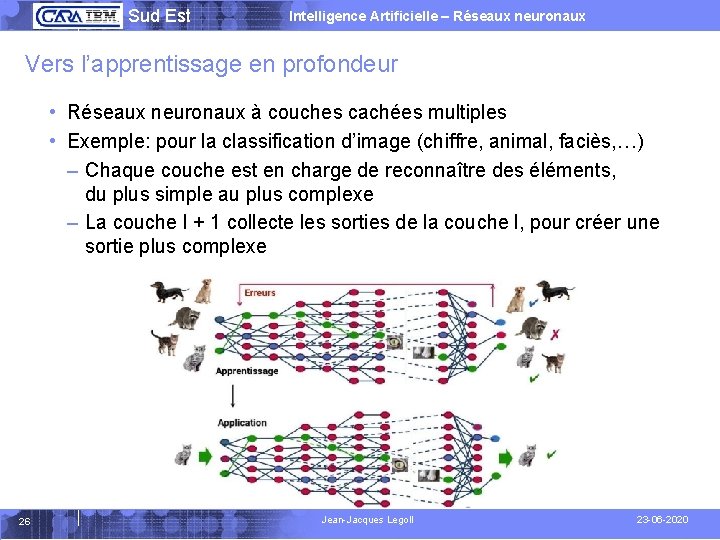

Sud Est Intelligence Artificielle – Réseaux neuronaux Vers l’apprentissage en profondeur • Réseaux neuronaux à couches cachées multiples • Exemple: pour la classification d’image (chiffre, animal, faciès, …) – Chaque couche est en charge de reconnaître des éléments, du plus simple au plus complexe – La couche l + 1 collecte les sorties de la couche l, pour créer une sortie plus complexe 26 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Agenda – Introduction – exemple d’application – Neurone artificiel, réseaux de neurones – Apprentissage – Propagation inverse – Pour un meilleur apprentissage – Réseaux profonds – Réseaux neuronaux à convolution (CNNs) – Réseaux neuronaux récurrents (RNNs) – Conclusion, Bibliographie 27 Jean-Jacques Legoll 23 -06 -2020

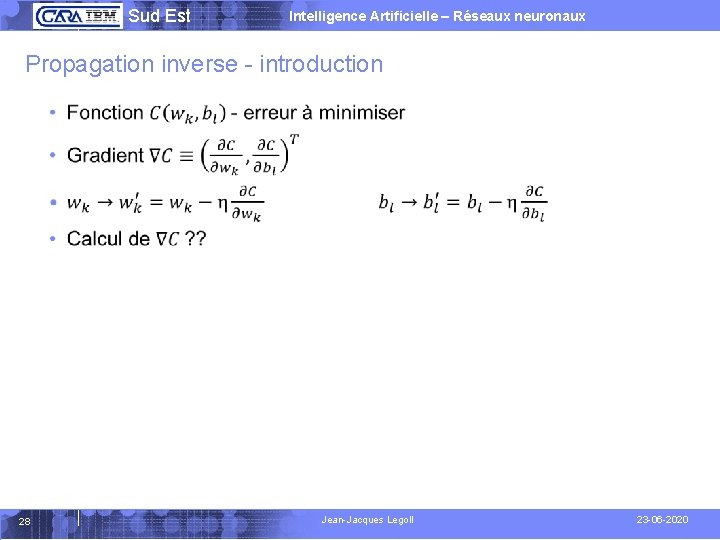

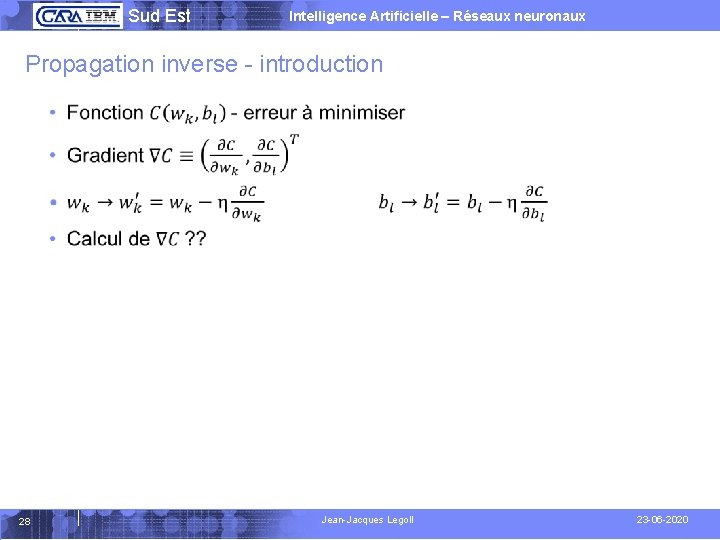

Sud Est Intelligence Artificielle – Réseaux neuronaux Propagation inverse - introduction 28 Jean-Jacques Legoll 23 -06 -2020

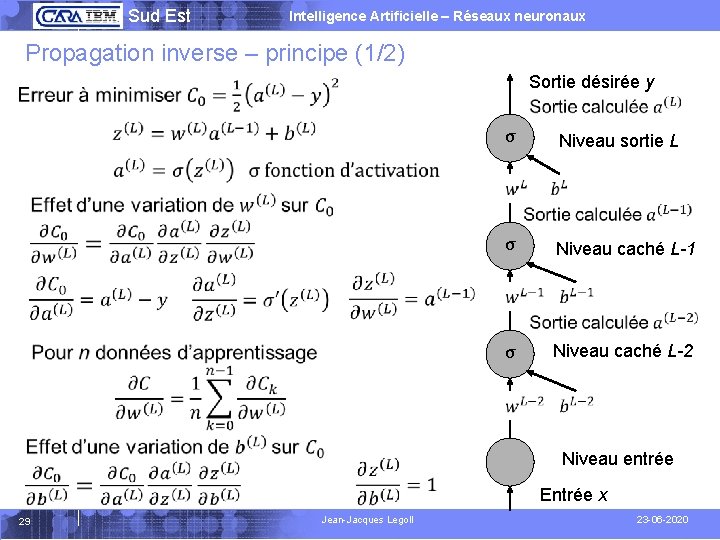

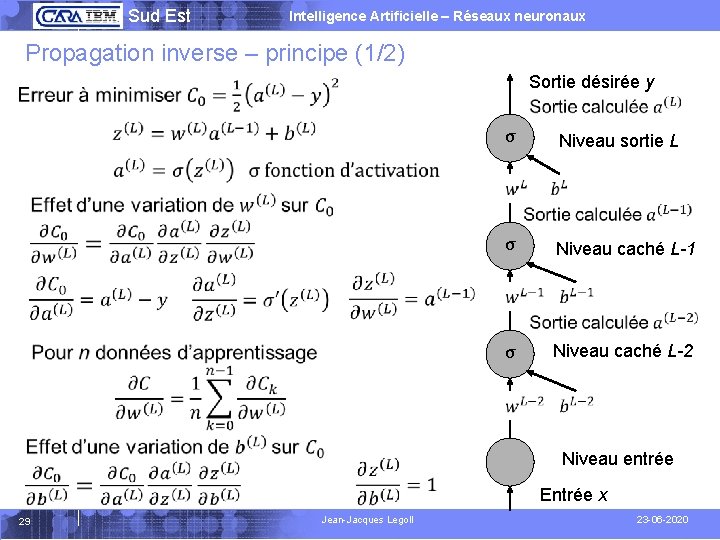

Sud Est Intelligence Artificielle – Réseaux neuronaux Propagation inverse – principe (1/2) Sortie désirée y σ Niveau sortie L σ Niveau caché L-1 σ Niveau caché L-2 Niveau entrée Entrée x 29 Jean-Jacques Legoll 23 -06 -2020

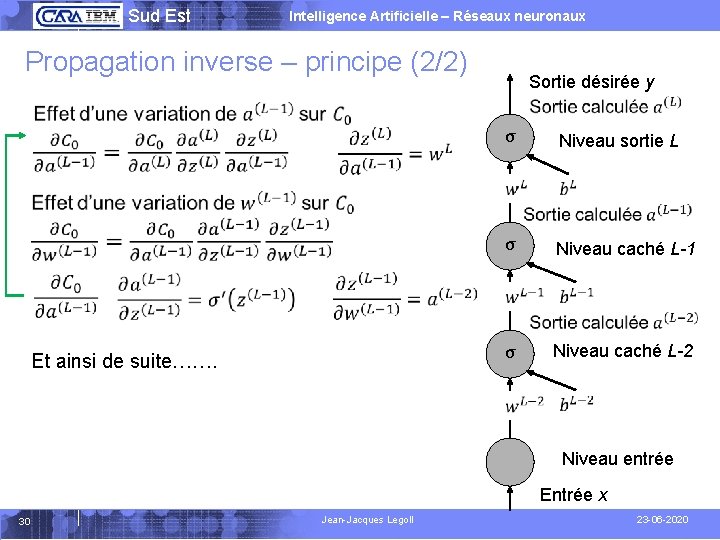

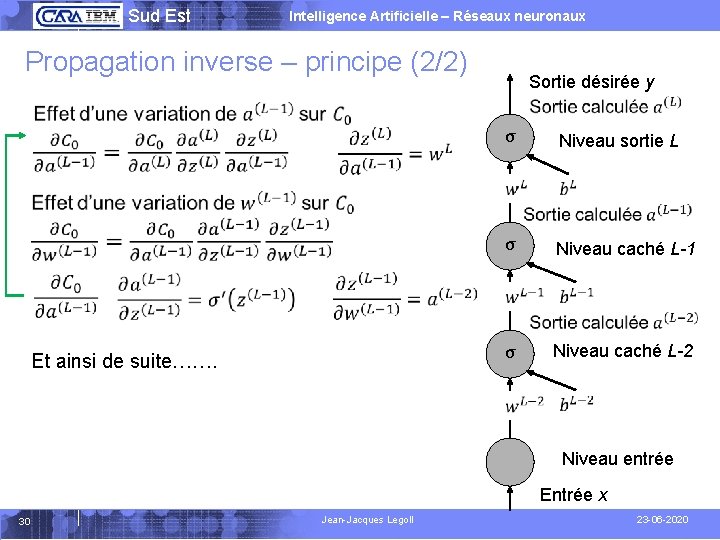

Sud Est Intelligence Artificielle – Réseaux neuronaux Propagation inverse – principe (2/2) Sortie désirée y σ Niveau sortie L σ Niveau caché L-1 σ Et ainsi de suite……. Niveau caché L-2 Niveau entrée Entrée x 30 Jean-Jacques Legoll 23 -06 -2020

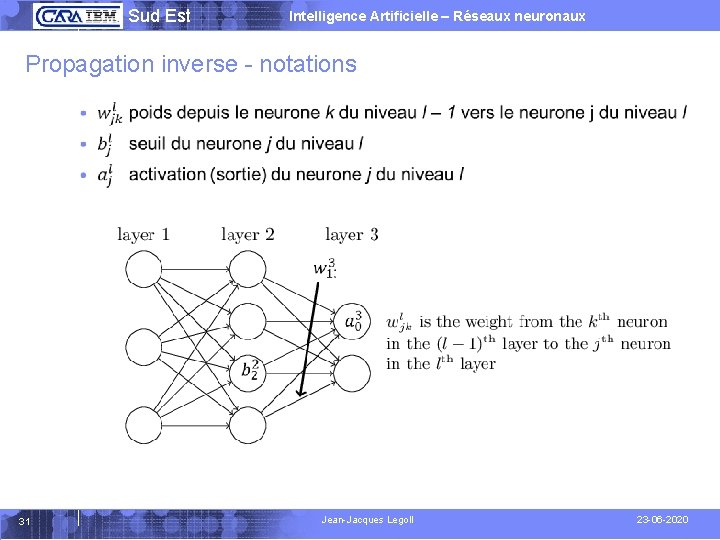

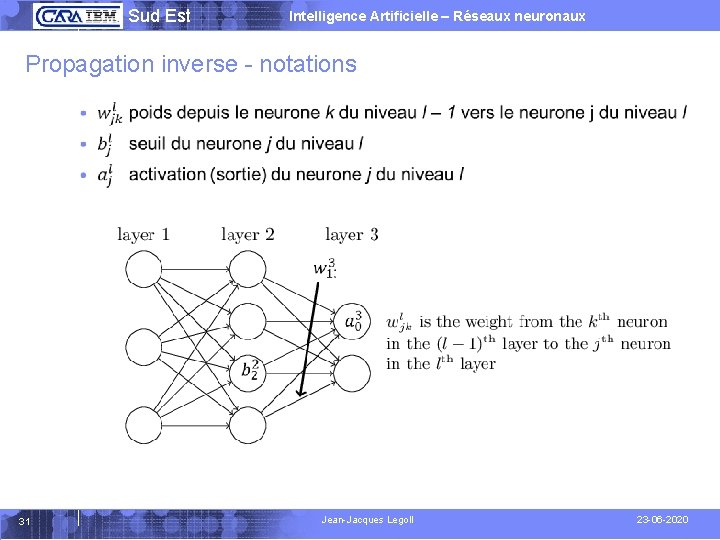

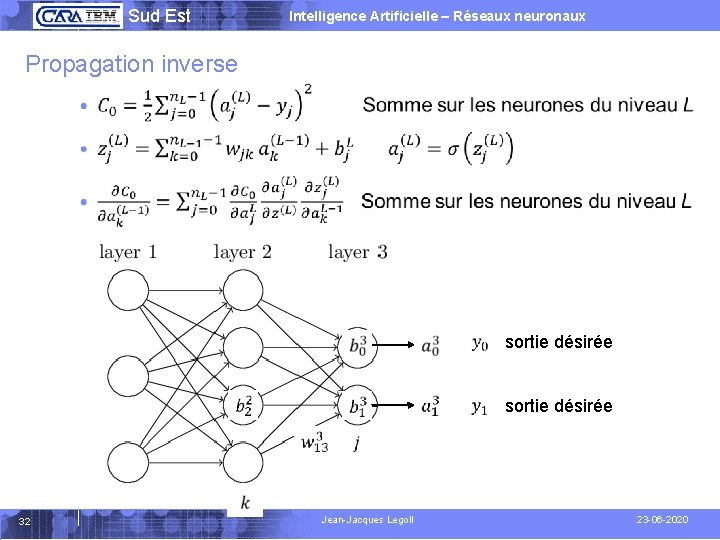

Sud Est Intelligence Artificielle – Réseaux neuronaux Propagation inverse - notations 31 Jean-Jacques Legoll 23 -06 -2020

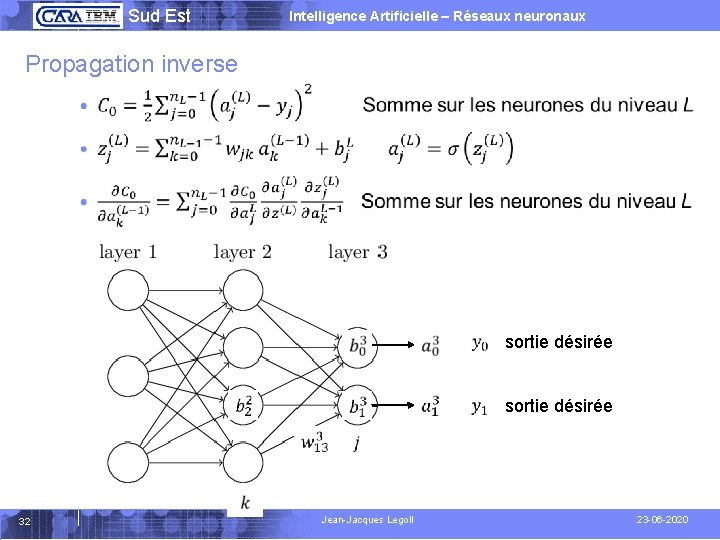

Sud Est Intelligence Artificielle – Réseaux neuronaux Propagation inverse 32 sortie désirée Jean-Jacques Legoll 23 -06 -2020

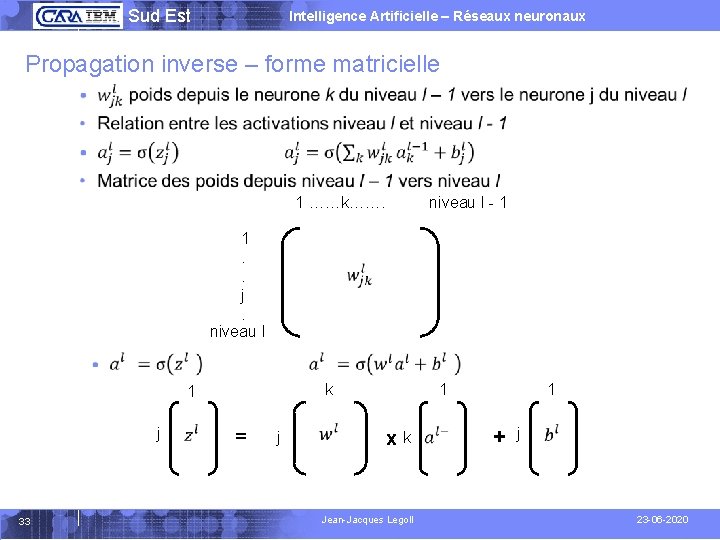

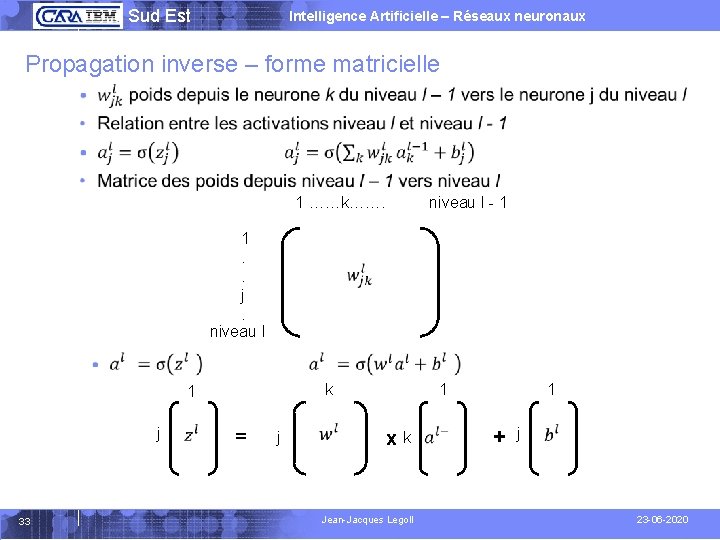

Sud Est Intelligence Artificielle – Réseaux neuronaux Propagation inverse – forme matricielle 1 ……k……. niveau l - 1 1. . j. niveau l k 1 j 33 = j 1 x k Jean-Jacques Legoll 1 j + 23 -06 -2020

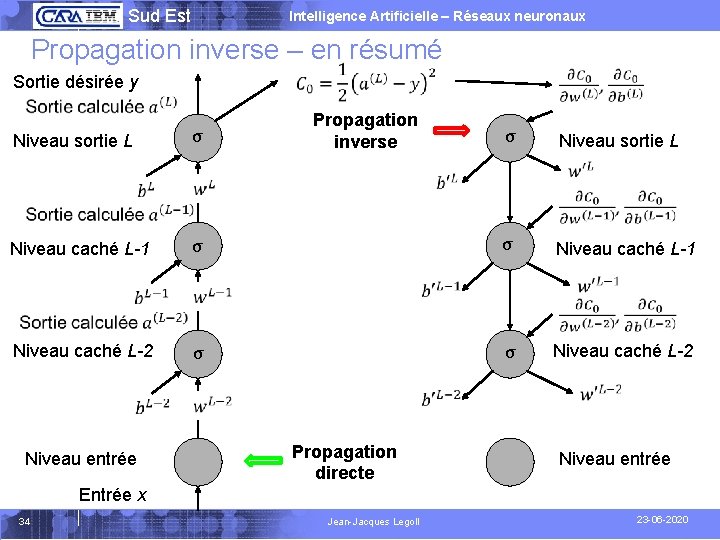

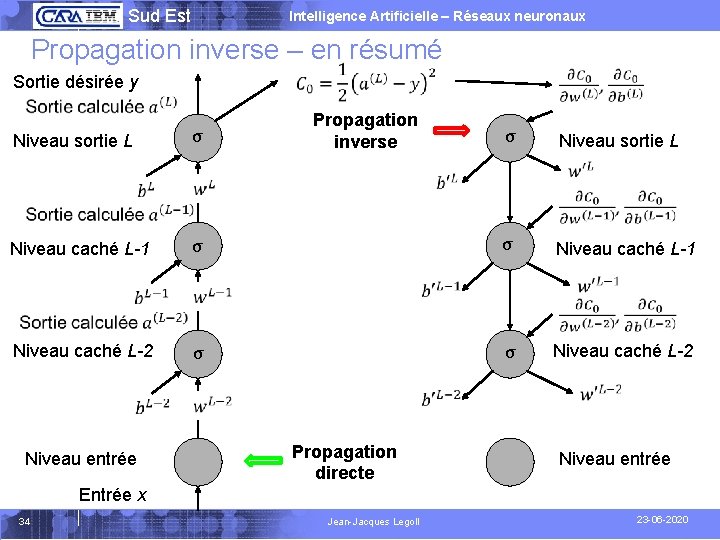

Sud Est Intelligence Artificielle – Réseaux neuronaux Propagation inverse – en résumé Sortie désirée y σ Niveau sortie L Propagation inverse Niveau caché L-2 Niveau entrée Propagation directe Niveau caché L-1 σ σ Niveau sortie L σ σ σ Niveau caché L-1 Niveau caché L-2 Niveau entrée Entrée x 34 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Agenda – Introduction – exemple d’application – Neurone artificiel, réseaux de neurones – Apprentissage – Propagation inverse – Pour un meilleur apprentissage – Réseaux profonds – Réseaux neuronaux à convolution (CNNs) – Réseaux neuronaux récurrents (RNNs) – Conclusion, Bibliographie 35 Jean-Jacques Legoll 23 -06 -2020

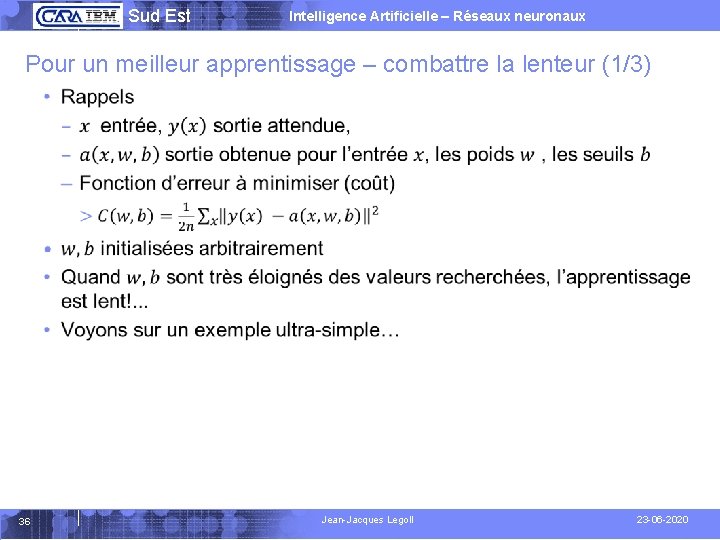

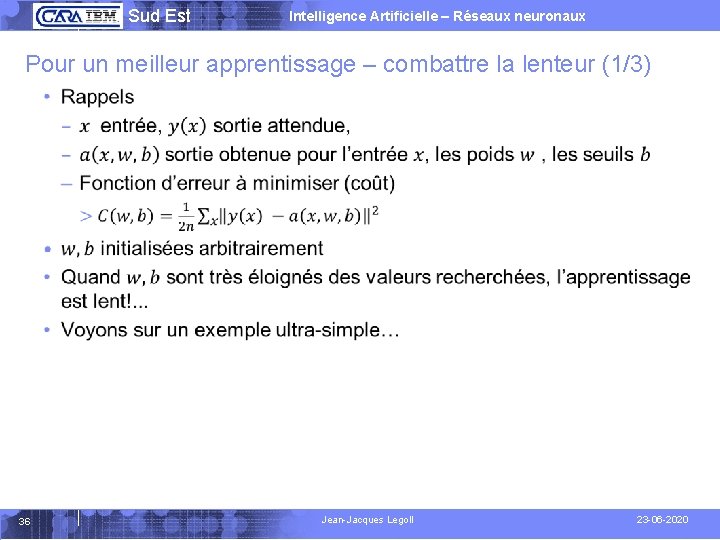

Sud Est Intelligence Artificielle – Réseaux neuronaux Pour un meilleur apprentissage – combattre la lenteur (1/3) 36 Jean-Jacques Legoll 23 -06 -2020

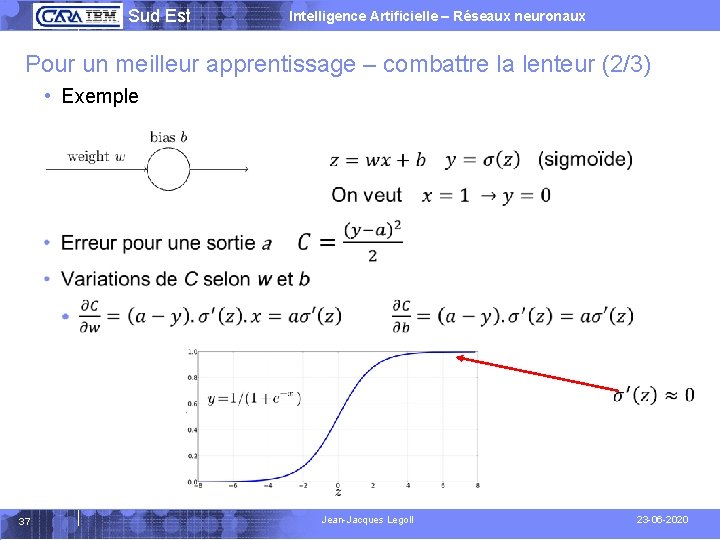

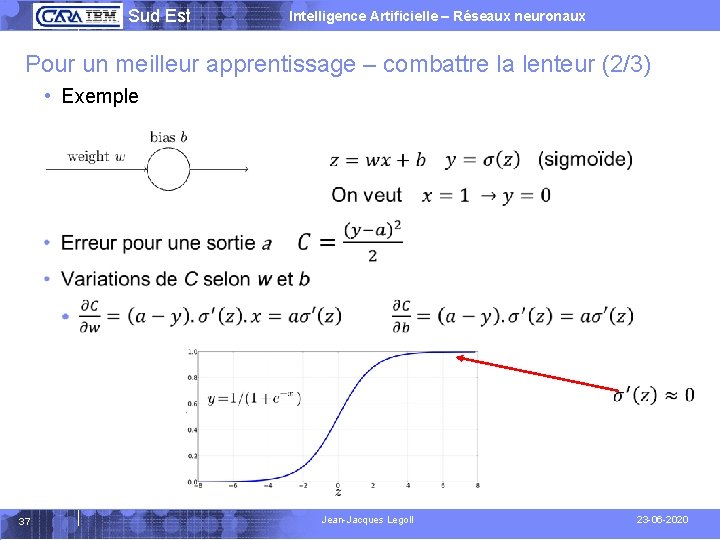

Sud Est Intelligence Artificielle – Réseaux neuronaux Pour un meilleur apprentissage – combattre la lenteur (2/3) • Exemple 37 Jean-Jacques Legoll 23 -06 -2020

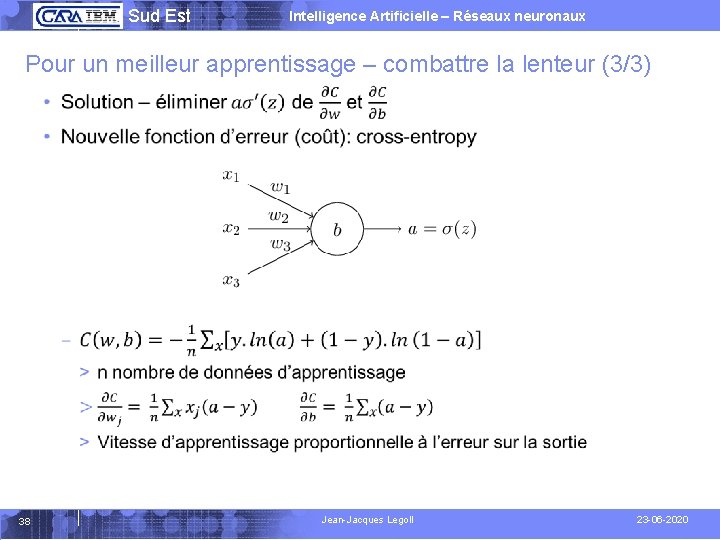

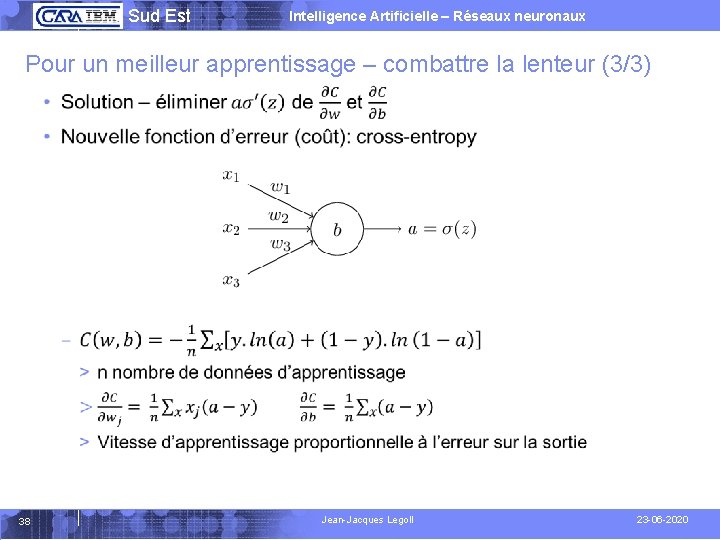

Sud Est Intelligence Artificielle – Réseaux neuronaux Pour un meilleur apprentissage – combattre la lenteur (3/3) 38 Jean-Jacques Legoll 23 -06 -2020

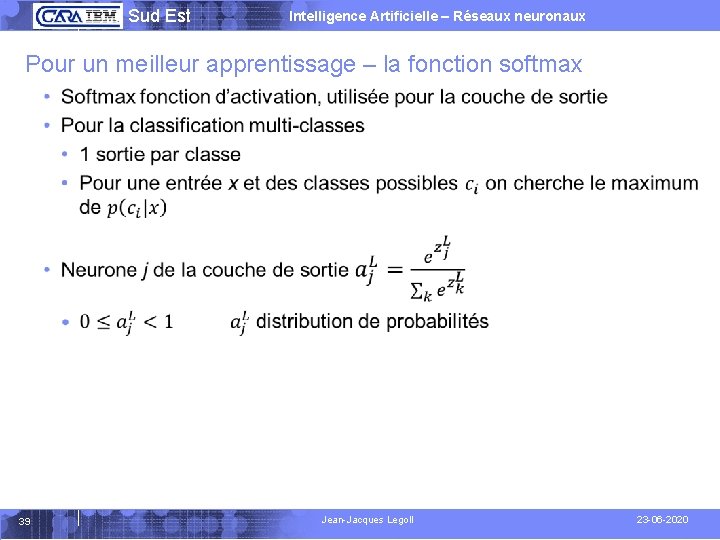

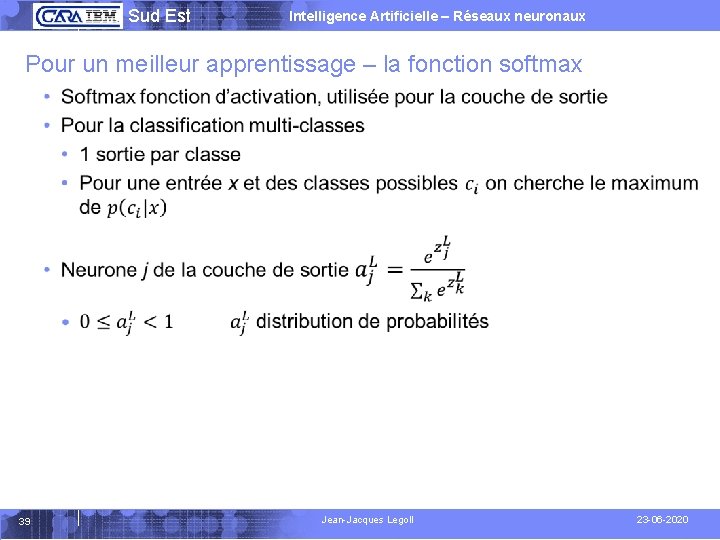

Sud Est Intelligence Artificielle – Réseaux neuronaux Pour un meilleur apprentissage – la fonction softmax 39 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Agenda – Introduction – exemple d’application – Neurone artificiel, réseaux de neurones – Apprentissage – Propagation inverse – Pour un meilleur apprentissage – Réseaux profonds – Réseaux neuronaux à convolution (CNNs) – Réseaux neuronaux récurrents (RNNs) – Conclusion, Bibliographie 40 Jean-Jacques Legoll 23 -06 -2020

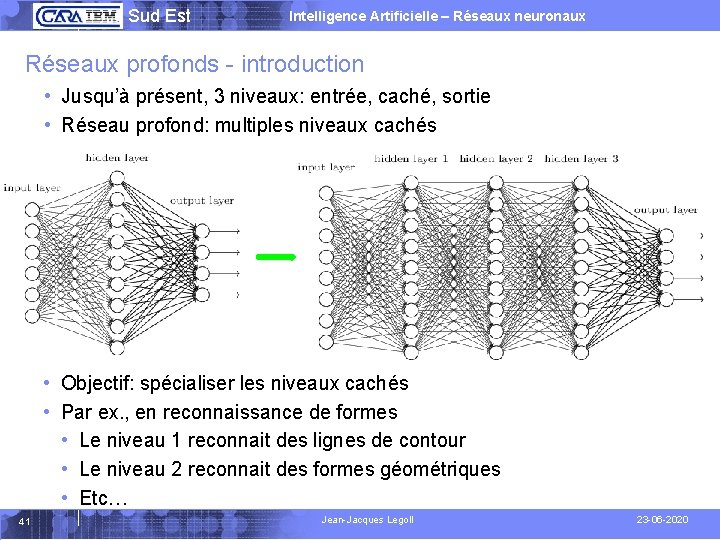

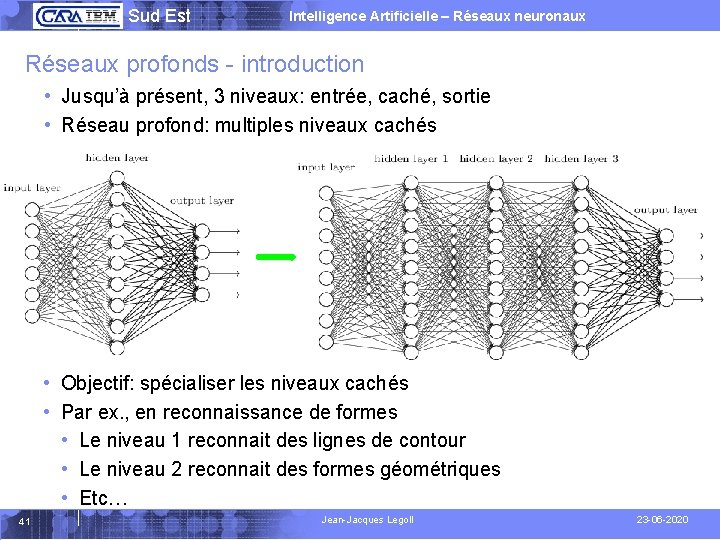

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux profonds - introduction • Jusqu’à présent, 3 niveaux: entrée, caché, sortie • Réseau profond: multiples niveaux cachés • Objectif: spécialiser les niveaux cachés • Par ex. , en reconnaissance de formes • Le niveau 1 reconnait des lignes de contour • Le niveau 2 reconnait des formes géométriques • Etc… 41 Jean-Jacques Legoll 23 -06 -2020

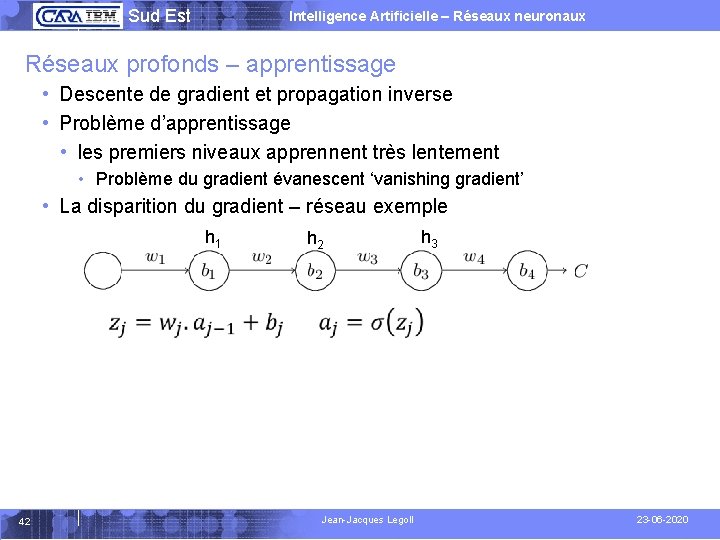

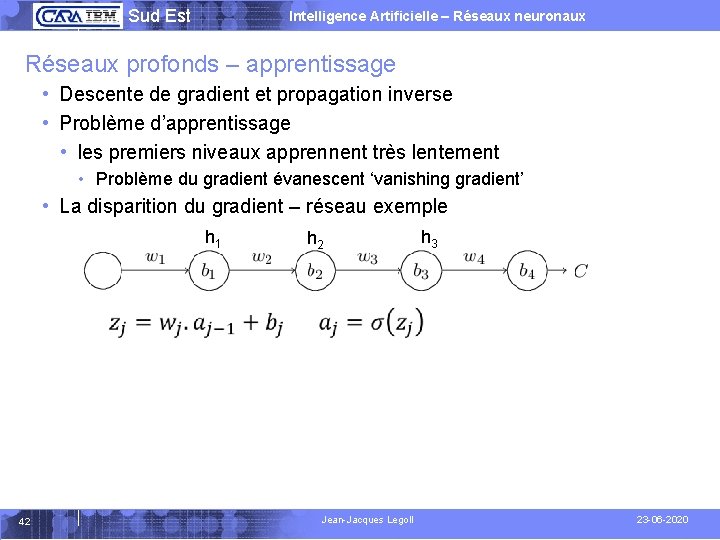

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux profonds – apprentissage • Descente de gradient et propagation inverse • Problème d’apprentissage • les premiers niveaux apprennent très lentement • Problème du gradient évanescent ‘vanishing gradient’ • La disparition du gradient – réseau exemple h 1 h 2 h 3 42 Jean-Jacques Legoll 23 -06 -2020

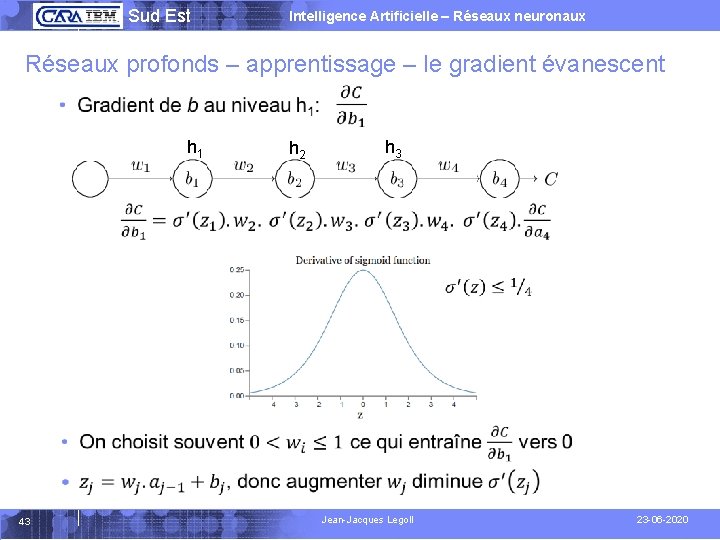

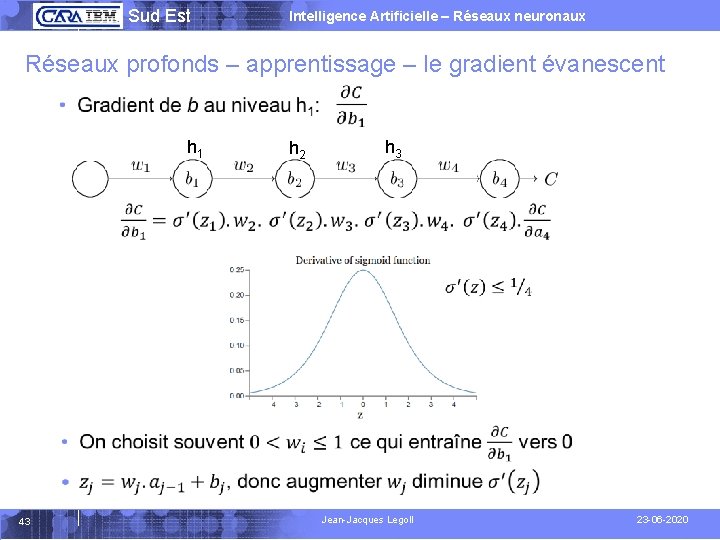

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux profonds – apprentissage – le gradient évanescent h 1 h 2 h 3 43 Jean-Jacques Legoll 23 -06 -2020

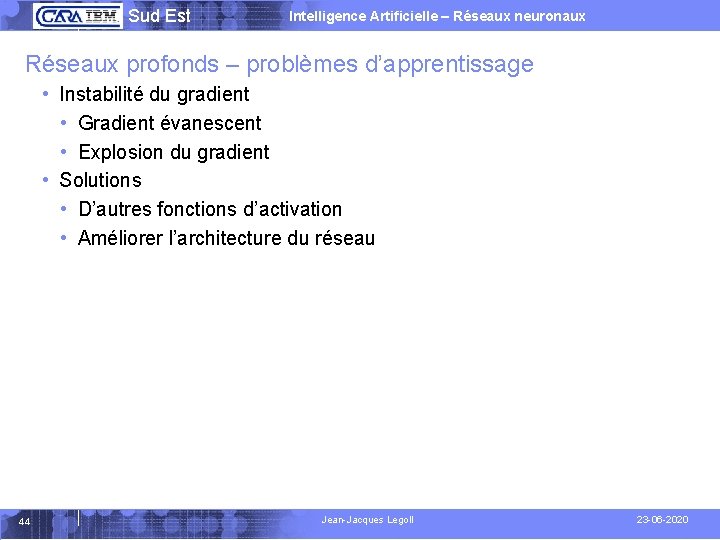

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux profonds – problèmes d’apprentissage • Instabilité du gradient • Gradient évanescent • Explosion du gradient • Solutions • D’autres fonctions d’activation • Améliorer l’architecture du réseau 44 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Agenda – Introduction – exemple d’application – Neurone artificiel, réseaux de neurones – Apprentissage – Propagation inverse – Pour un meilleur apprentissage – Réseaux profonds – Réseaux neuronaux à convolution (CNNs) – Réseaux neuronaux récurrents (RNNs) – Conclusion, Bibliographie 45 Jean-Jacques Legoll 23 -06 -2020

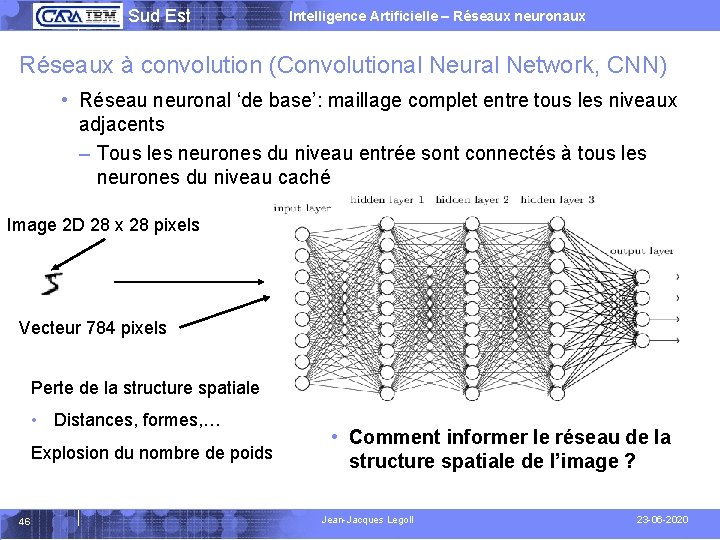

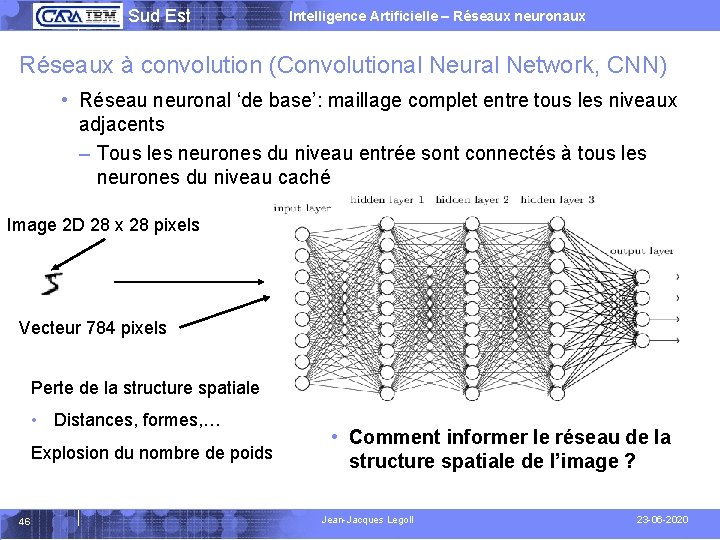

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux à convolution (Convolutional Neural Network, CNN) • Réseau neuronal ‘de base’: maillage complet entre tous les niveaux adjacents – Tous les neurones du niveau entrée sont connectés à tous les neurones du niveau caché Image 2 D 28 x 28 pixels Vecteur 784 pixels Perte de la structure spatiale • Distances, formes, … Explosion du nombre de poids 46 • Comment informer le réseau de la structure spatiale de l’image ? Jean-Jacques Legoll 23 -06 -2020

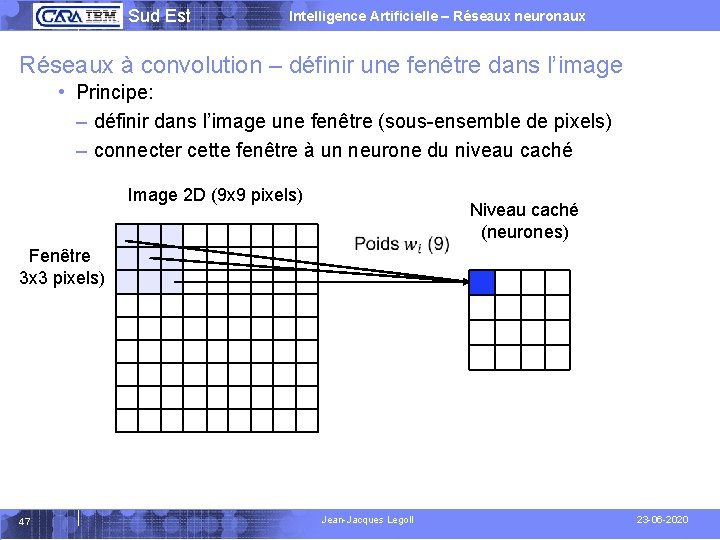

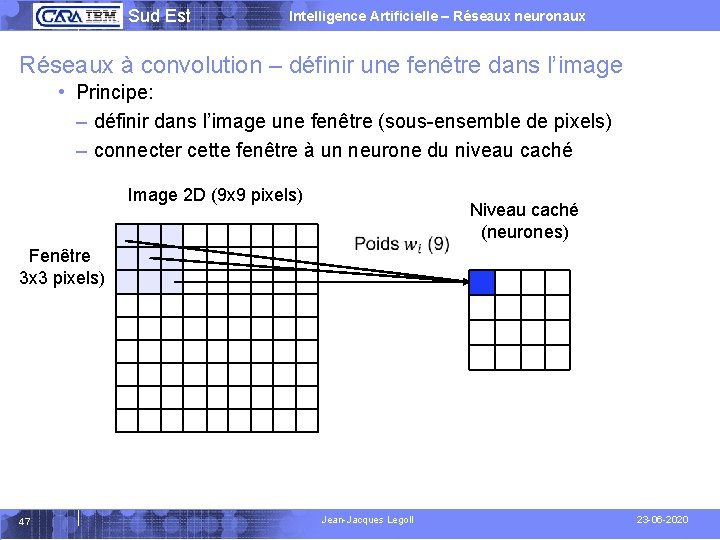

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux à convolution – définir une fenêtre dans l’image • Principe: – définir dans l’image une fenêtre (sous-ensemble de pixels) – connecter cette fenêtre à un neurone du niveau caché Image 2 D (9 x 9 pixels) Fenêtre 3 x 3 pixels) 47 Niveau caché (neurones) Jean-Jacques Legoll 23 -06 -2020

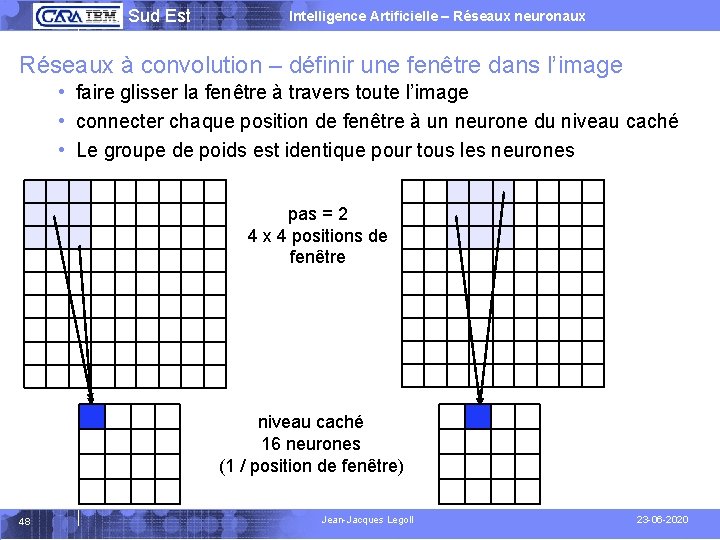

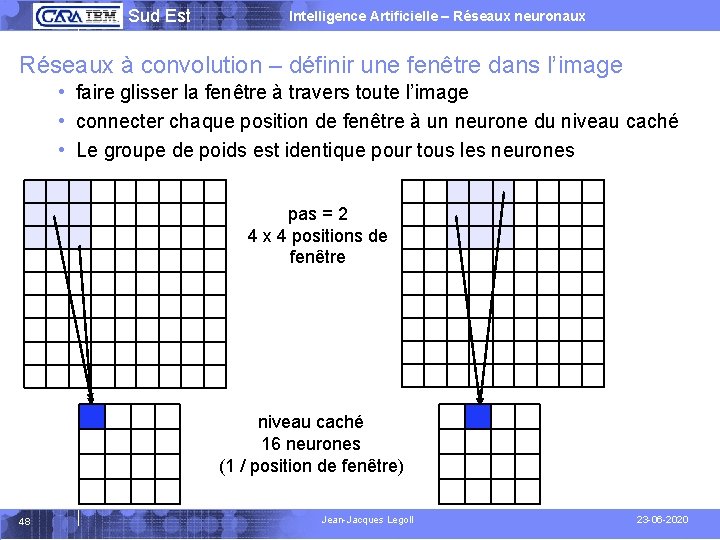

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux à convolution – définir une fenêtre dans l’image • faire glisser la fenêtre à travers toute l’image • connecter chaque position de fenêtre à un neurone du niveau caché • Le groupe de poids est identique pour tous les neurones pas = 2 4 x 4 positions de fenêtre 48 niveau caché 16 neurones (1 / position de fenêtre) Jean-Jacques Legoll 23 -06 -2020

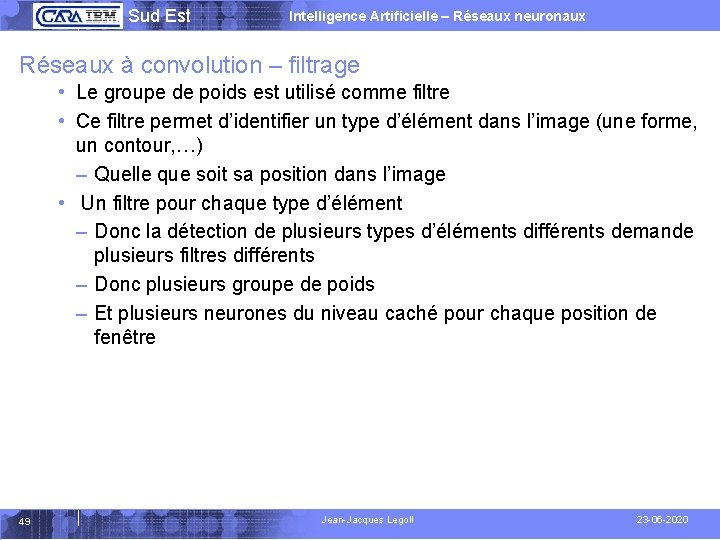

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux à convolution – filtrage • Le groupe de poids est utilisé comme filtre • Ce filtre permet d’identifier un type d’élément dans l’image (une forme, un contour, …) – Quelle que soit sa position dans l’image • Un filtre pour chaque type d’élément – Donc la détection de plusieurs types d’éléments différents demande plusieurs filtres différents – Donc plusieurs groupe de poids – Et plusieurs neurones du niveau caché pour chaque position de fenêtre 49 Jean-Jacques Legoll 23 -06 -2020

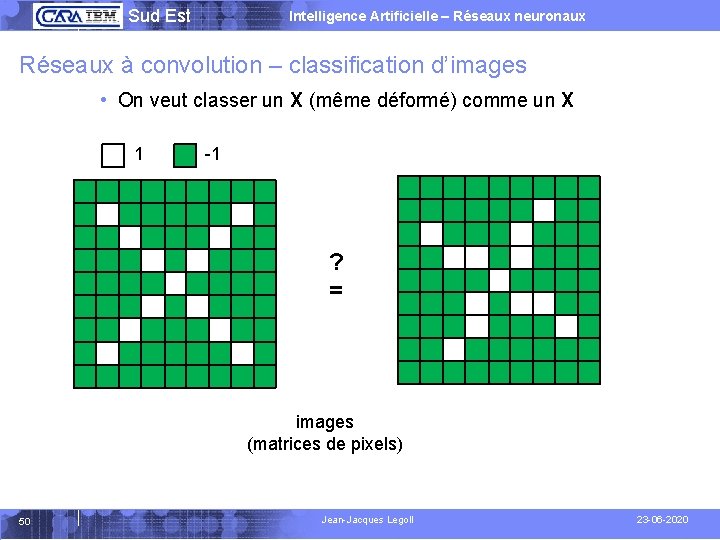

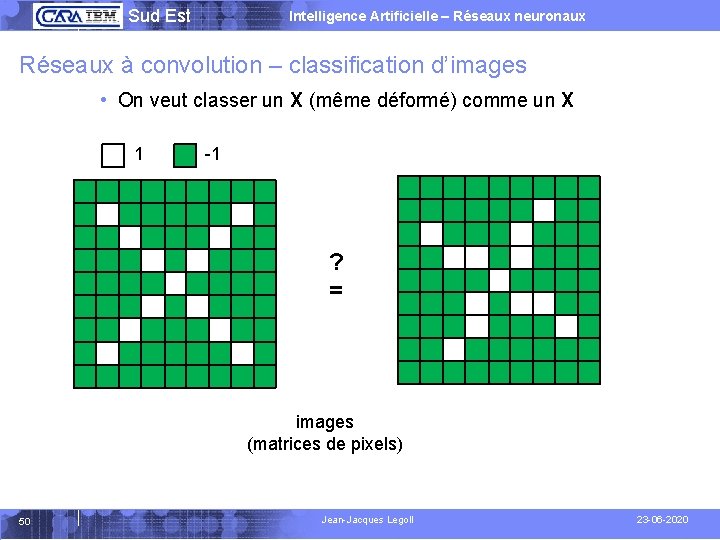

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux à convolution – classification d’images • On veut classer un X (même déformé) comme un X 1 -1 ? = images (matrices de pixels) 50 Jean-Jacques Legoll 23 -06 -2020

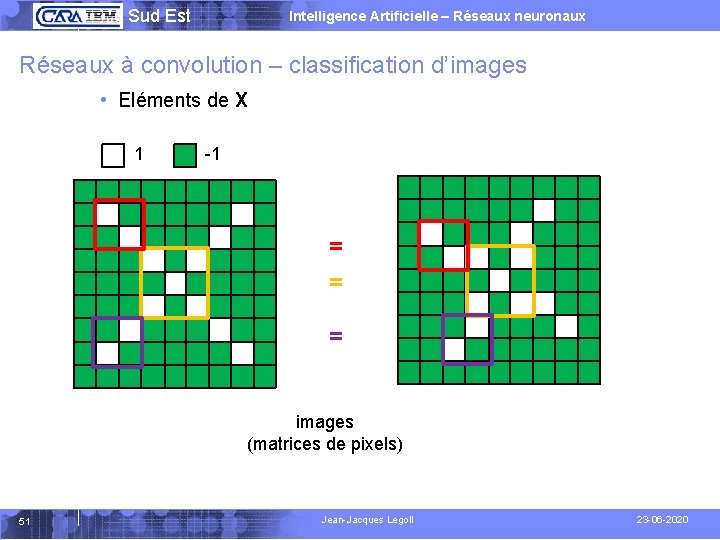

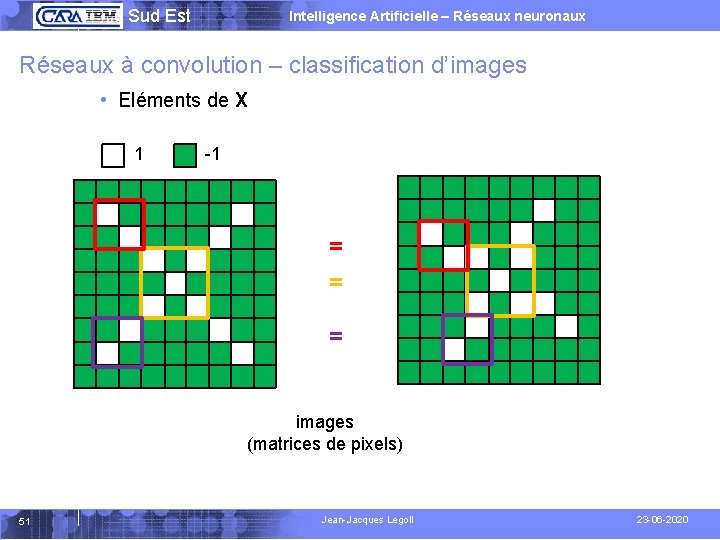

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux à convolution – classification d’images • Eléments de X 1 -1 = = = images (matrices de pixels) 51 Jean-Jacques Legoll 23 -06 -2020

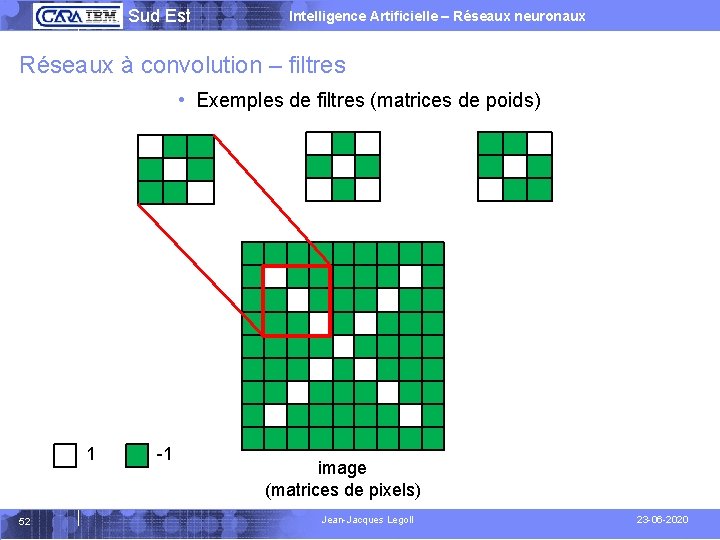

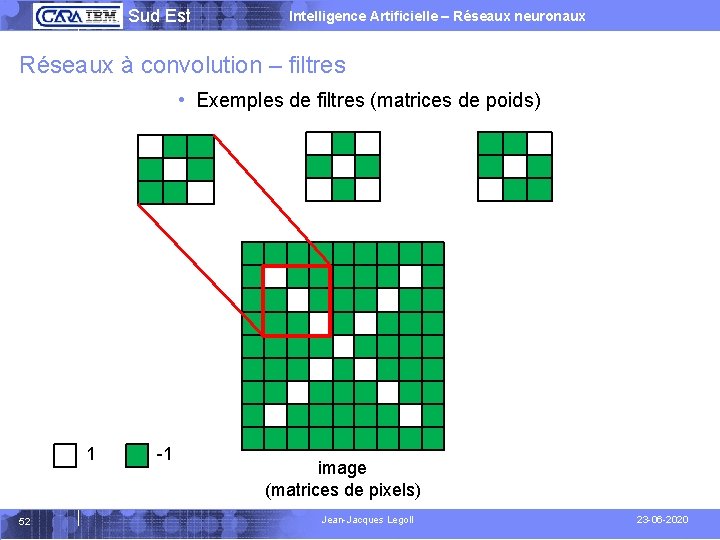

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux à convolution – filtres • Exemples de filtres (matrices de poids) 52 1 -1 image (matrices de pixels) Jean-Jacques Legoll 23 -06 -2020

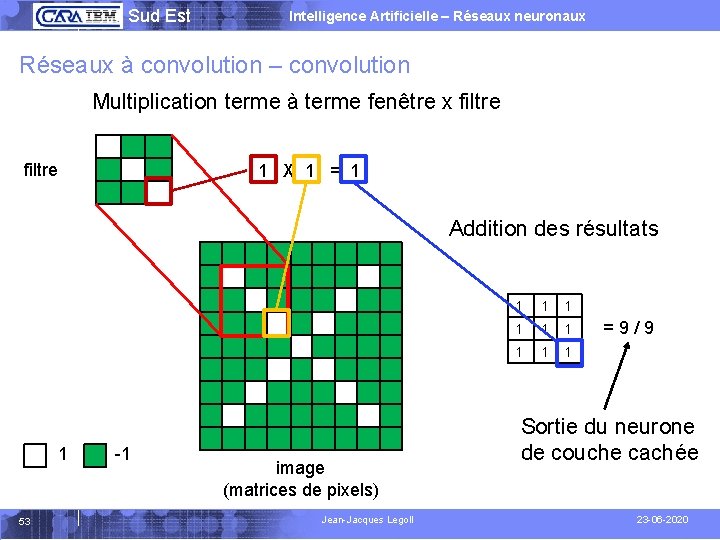

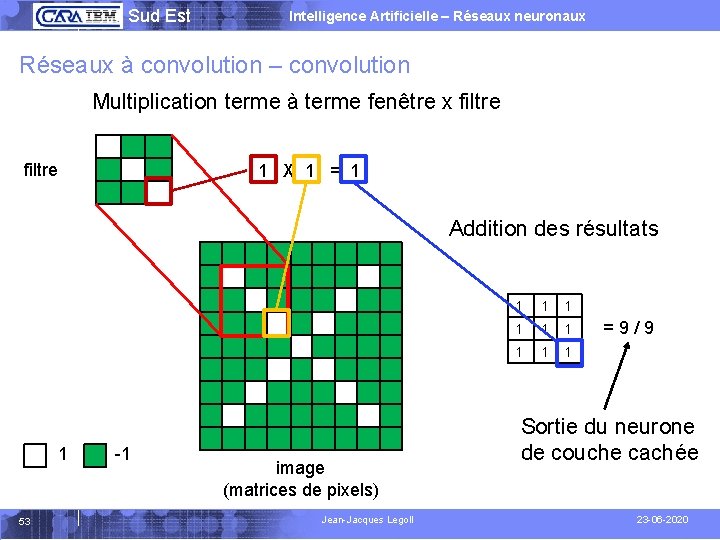

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux à convolution – convolution Multiplication terme à terme fenêtre x filtre 1 X 1 = 1 Addition des résultats 53 1 -1 image (matrices de pixels) Jean-Jacques Legoll 1 1 1 1 1 = 9 / 9 Sortie du neurone de couche cachée 23 -06 -2020

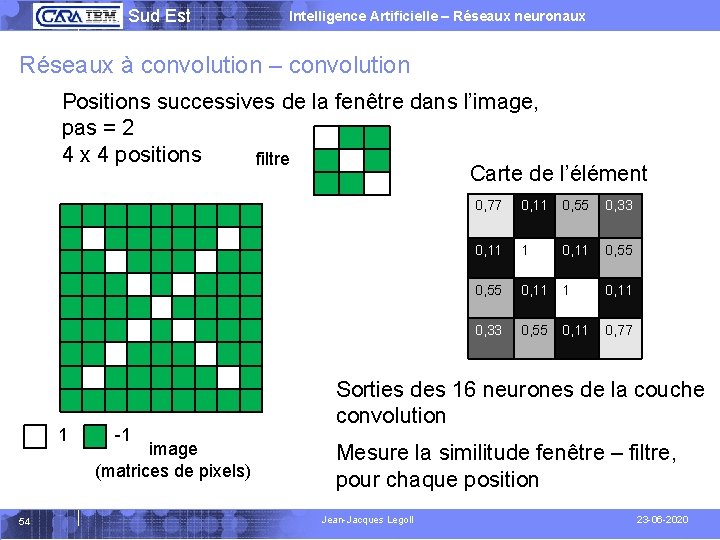

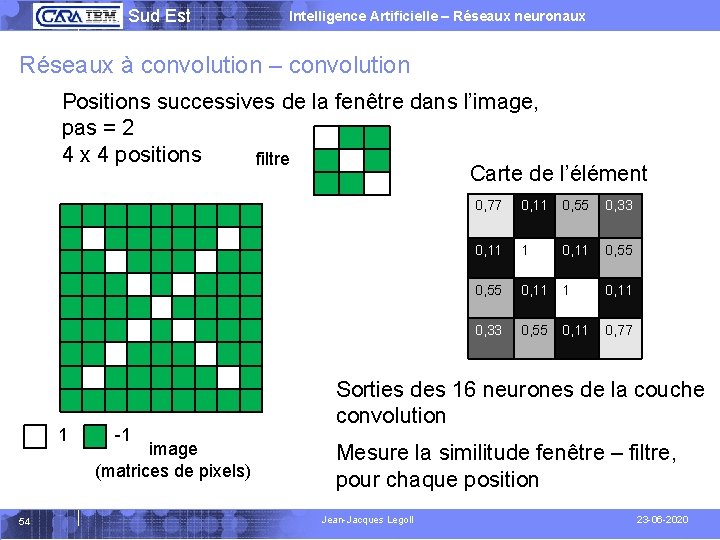

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux à convolution – convolution Positions successives de la fenêtre dans l’image, pas = 2 4 x 4 positions filtre Carte de l’élément 54 1 -1 image (matrices de pixels) 0, 77 0, 11 0, 55 0, 33 0, 11 1 0, 55 0, 11 1 0, 11 0, 33 0, 55 0, 11 0, 77 0, 11 Sorties des 16 neurones de la couche convolution Mesure la similitude fenêtre – filtre, pour chaque position Jean-Jacques Legoll 23 -06 -2020

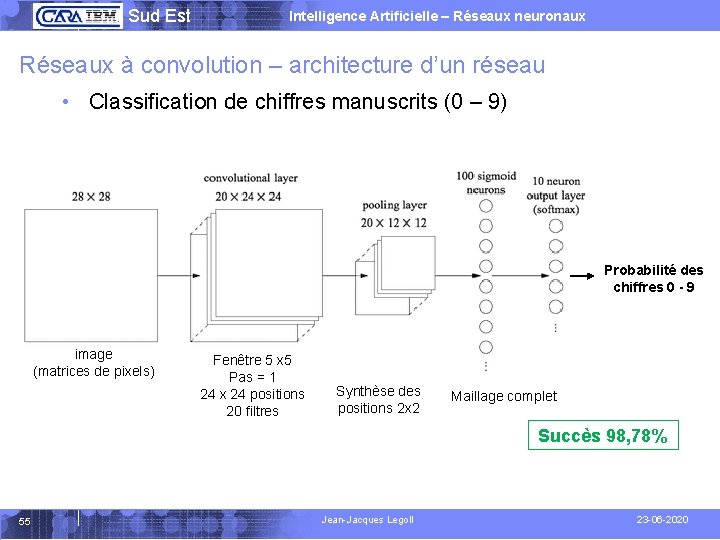

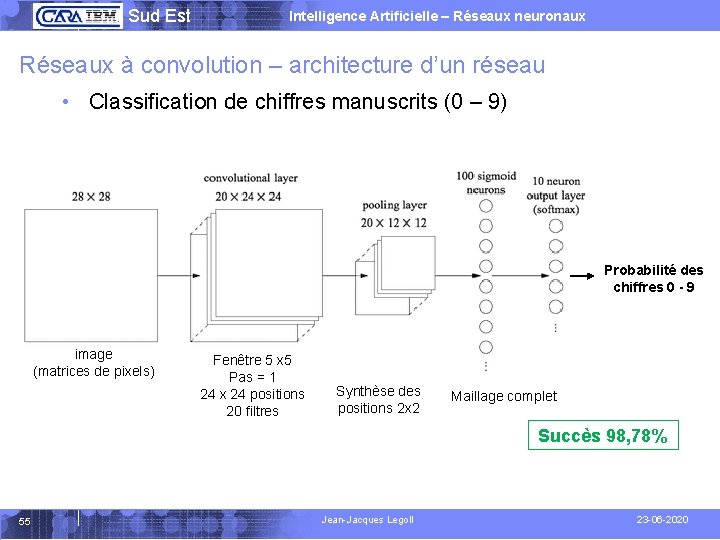

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux à convolution – architecture d’un réseau • Classification de chiffres manuscrits (0 – 9) Probabilité des chiffres 0 - 9 image (matrices de pixels) Fenêtre 5 x 5 Pas = 1 24 x 24 positions 20 filtres Synthèse des positions 2 x 2 Maillage complet Succès 98, 78% 55 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Agenda – Introduction – exemple d’application – Neurone artificiel, réseaux de neurones – Apprentissage – Propagation inverse – Pour un meilleur apprentissage – Réseaux profonds – Réseaux neuronaux à convolution (CNNs) – Réseaux neuronaux récurrents (RNNs) – Conclusion, Bibliographie 56 Jean-Jacques Legoll 23 -06 -2020

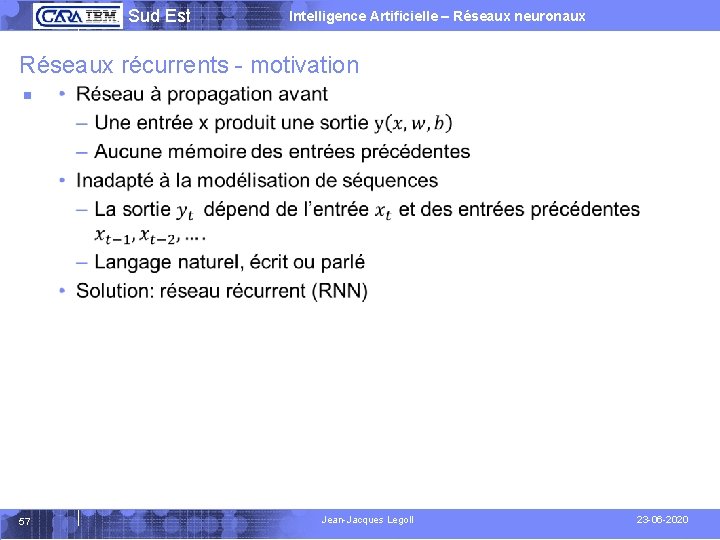

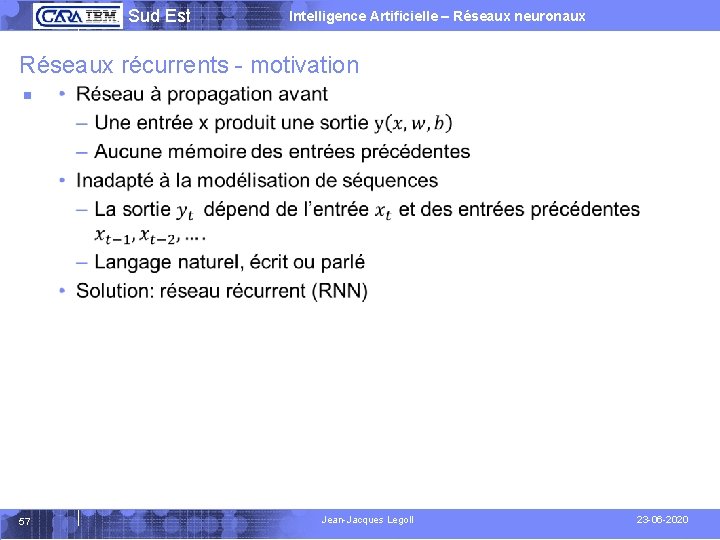

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux récurrents - motivation § 57 Jean-Jacques Legoll 23 -06 -2020

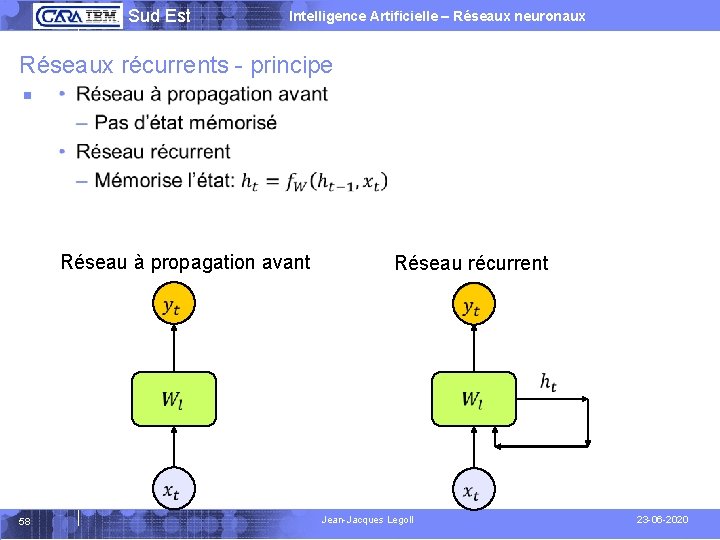

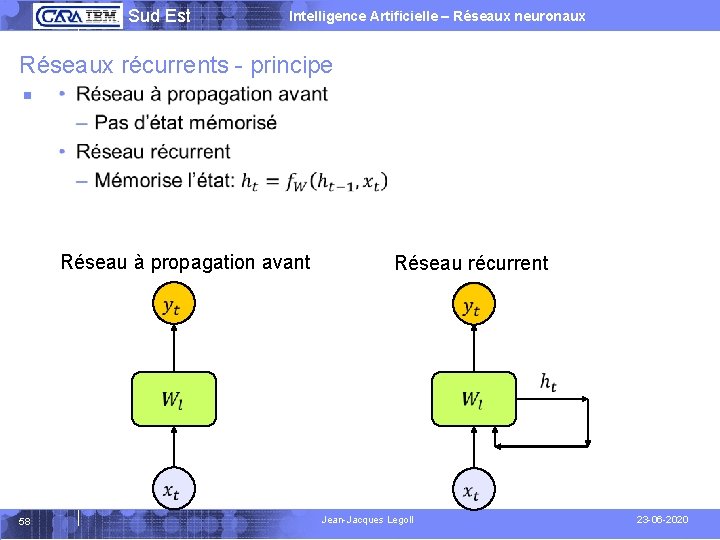

Sud Est Intelligence Artificielle – Réseaux neuronaux Réseaux récurrents - principe § Réseau à propagation avant Réseau récurrent 58 Jean-Jacques Legoll 23 -06 -2020

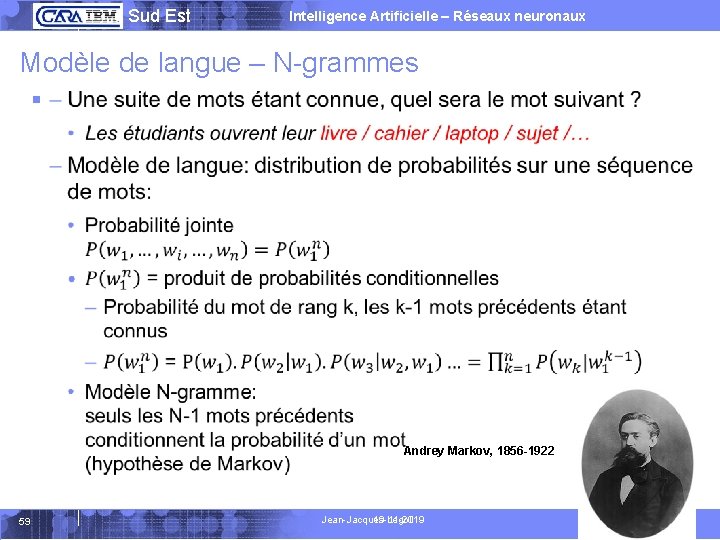

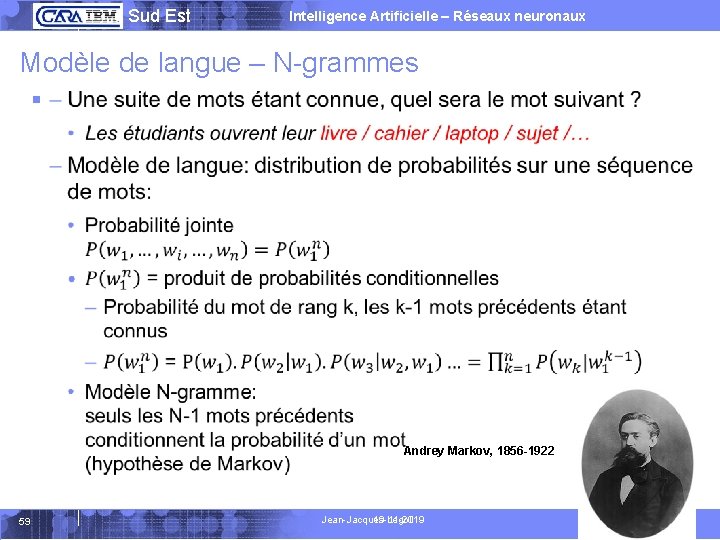

Sud Est Intelligence Artificielle – Réseaux neuronaux Modèle de langue – N-grammes § Andrey Markov, 1856 -1922 59 Jean-Jacques Legoll 19 -11 -2019

Sud Est Intelligence Artificielle – Réseaux neuronaux Modèle de langue • Vous utilisez tous les jours un modèle de langue!. . – Les mots que vous propose votre smartphone quand vous entrez un SMS – Les mots que vous propose la recherche Google quand vous entrez une requête 60 Jean-Jacques Legoll 19 -11 -2019

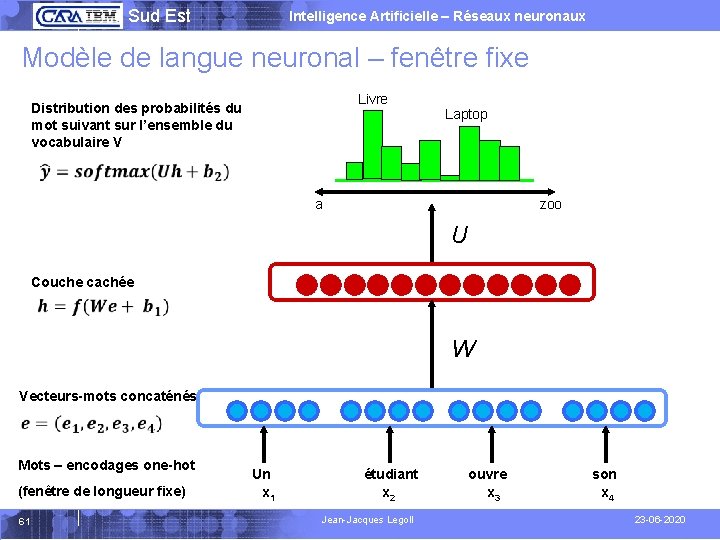

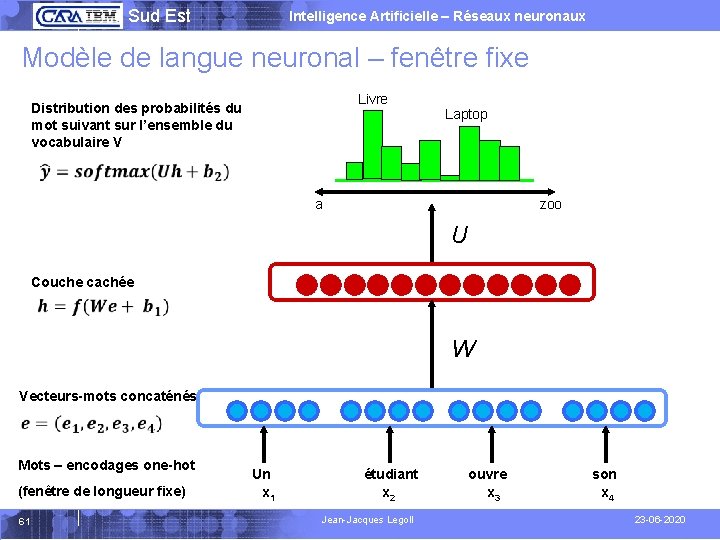

Sud Est Intelligence Artificielle – Réseaux neuronaux Modèle de langue neuronal – fenêtre fixe Livre Distribution des probabilités du mot suivant sur l’ensemble du vocabulaire V Laptop a zoo U Couche cachée W Vecteurs-mots concaténés Mots – encodages one-hot (fenêtre de longueur fixe) 61 Un étudiant ouvre son x 1 x 2 x 3 x 4 Jean-Jacques Legoll 23 -06 -2020

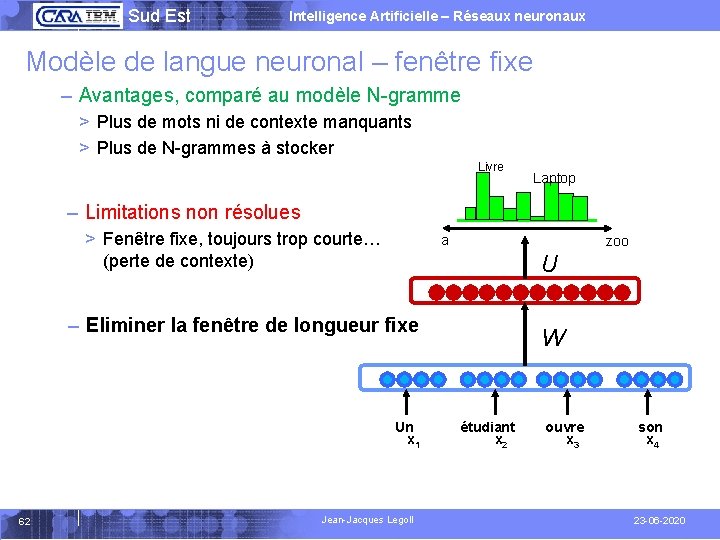

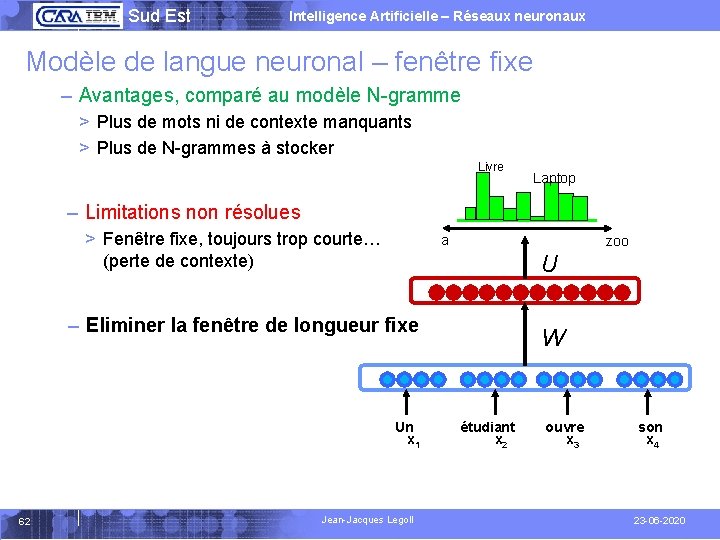

Sud Est Intelligence Artificielle – Réseaux neuronaux Modèle de langue neuronal – fenêtre fixe – Avantages, comparé au modèle N-gramme > Plus de mots ni de contexte manquants > Plus de N-grammes à stocker Livre Laptop – Limitations non résolues > Fenêtre fixe, toujours trop courte… (perte de contexte) – Eliminer la fenêtre de longueur fixe a zoo U W Un étudiant ouvre son x 1 x 2 x 3 x 4 62 Jean-Jacques Legoll 23 -06 -2020

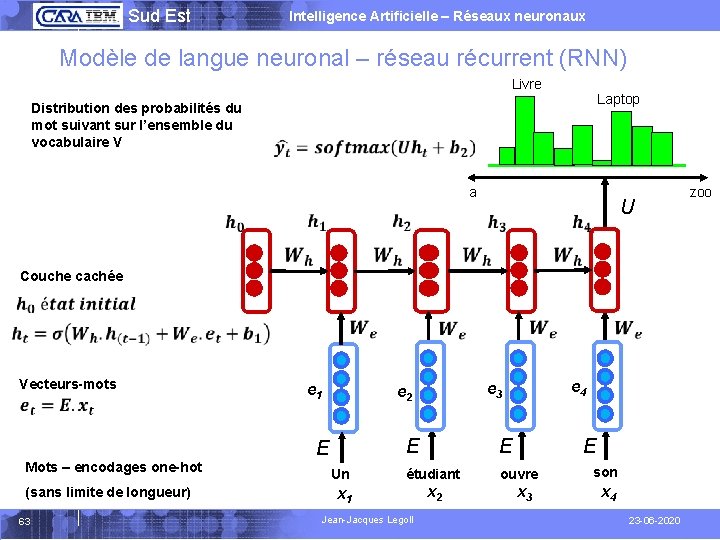

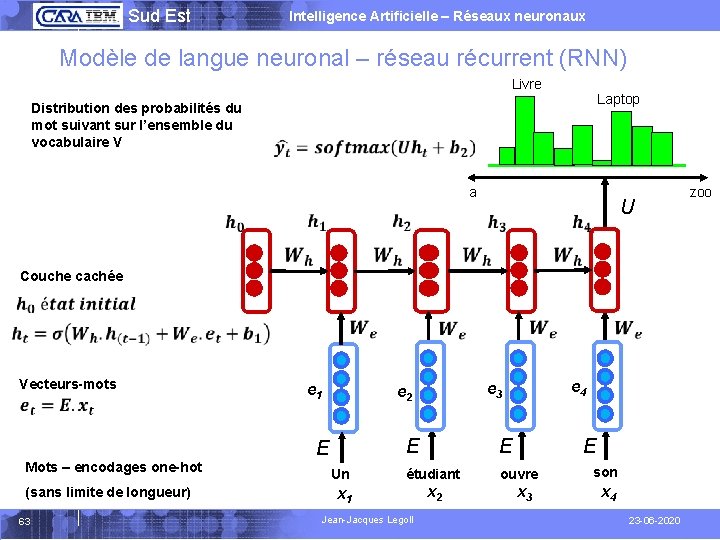

Sud Est Intelligence Artificielle – Réseaux neuronaux Modèle de langue neuronal – réseau récurrent (RNN) Livre Distribution des probabilités du mot suivant sur l’ensemble du vocabulaire V Laptop a Couche cachée Vecteurs-mots Mots – encodages one-hot (sans limite de longueur) 63 e 1 x 1 Jean-Jacques Legoll e 4 E étudiant x 2 e 3 E Un e 2 E U E ouvre x 3 son x 4 23 -06 -2020 zoo

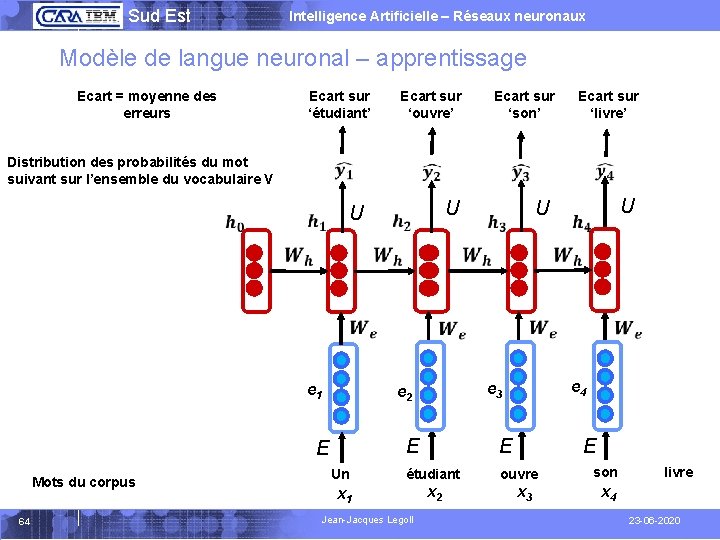

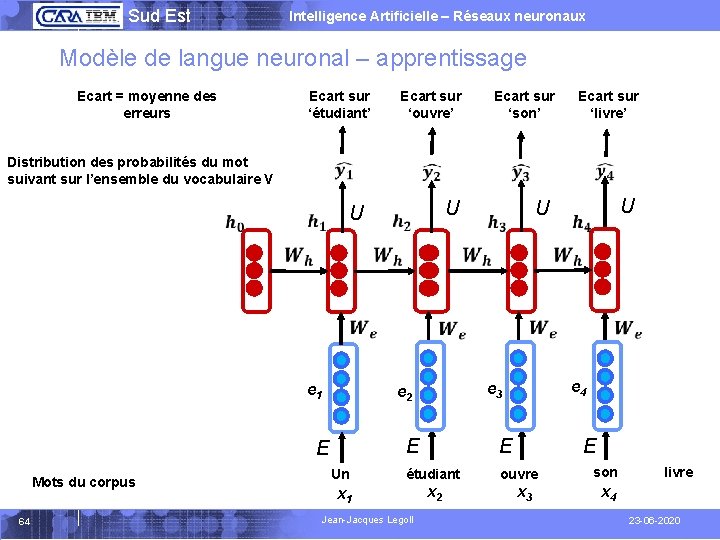

Sud Est Intelligence Artificielle – Réseaux neuronaux Modèle de langue neuronal – apprentissage Ecart = moyenne des erreurs Ecart sur ‘ouvre’ Ecart sur ‘étudiant’ Distribution des probabilités du mot suivant sur l’ensemble du vocabulaire V U e 1 Mots du corpus 64 x 1 Jean-Jacques Legoll x 2 e 4 E étudiant U e 3 E Un U e 2 E Ecart sur ‘livre’ U Ecart sur ‘son’ E ouvre x 3 son livre x 4 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Agenda – Introduction – exemple d’application – Neurone artificiel, réseaux de neurones – Apprentissage – Propagation inverse – Pour un meilleur apprentissage – Réseaux profonds – Réseaux neuronaux à convolution (CNNs) – Réseaux neuronaux récurrents (RNNs) – Conclusion, Bibliographie 65 Jean-Jacques Legoll 23 -06 -2020

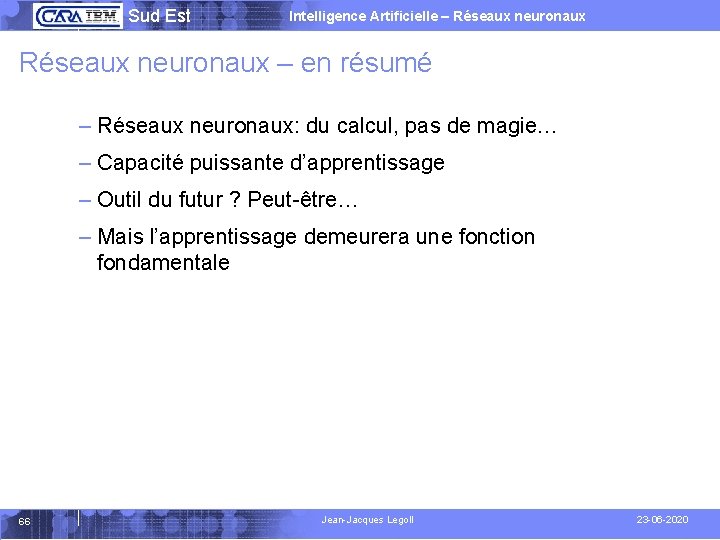

Sud Est Intelligence Artificielle – Réseaux neuronaux – en résumé – Réseaux neuronaux: du calcul, pas de magie… – Capacité puissante d’apprentissage – Outil du futur ? Peut-être… – Mais l’apprentissage demeurera une fonction fondamentale 66 Jean-Jacques Legoll 23 -06 -2020

Sud Est Intelligence Artificielle – Réseaux neuronaux Bibliographie – Neural networks and deep learning Michael Nielsen - ‘NN-DL Book’ http: //neuralnetworksanddeeplearning. com/ – Neural networks 3 Blue 1 Brown https: //www. youtube. com/playlist? list=PLZHQOb. OWTQDNU 6 R 1_670 00 Dx_ZCJB-3 pi – Brandon Rohrer on deep NNs, CNNs, RNNs https: //www. youtube. com/watch? v=ILs. A 4 ny. G 7 I 0 – MOOC’s > MIT 6. S 191 Introduction to deep learning http: //introtodeeplearning. com/ 67 Jean-Jacques Legoll 23 -06 -2020