Optimisation statistique de stratifis composites Laurent Grosset Grossetemse

- Slides: 30

Optimisation statistique de stratifiés composites Laurent Grosset (Grosset@emse. fr) R. Le Riche R. Haftka Groupe de travail Optimisation

Plan • Présentation générale de l’optimisation statistique • Modèle simple : cas linéaire • Application à un problème d’optimisation de stratifiés composites • Introduction de variables intermédiaires pour améliorer le modèle • Résumé, prochains développements de la recherche 2/22/2021 Groupe de travail Optimisation 2

Introduction • Algorithmes génétiques : basés sur une simulation d’un phénomène naturel (sélection naturelle), mais pas de justification mathématique • Baluja, Mühlenbein : modèles statistiques des AGs. Proposent des algorithmes où les opérateurs standards (croisement, mutation…) sont remplacés par un modèle statistique 2/22/2021 Groupe de travail Optimisation 3

Références • Baluja, S. , 1994, « Population-based Incremental Learning » • Mühlenbein, H. , 1996, Univariate Marginal Distribution Algorithm, Factorized Distribution Algorithm • Pelikan, M. , 1999, Bayesian Optimization Algorithm 2/22/2021 Groupe de travail Optimisation 4

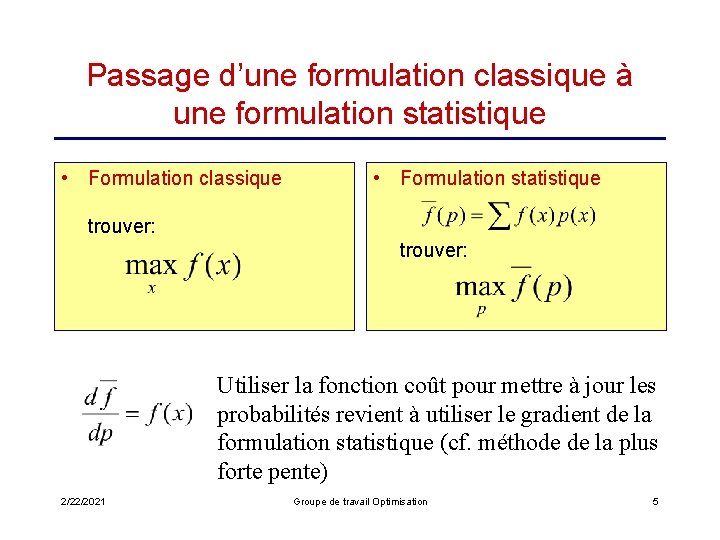

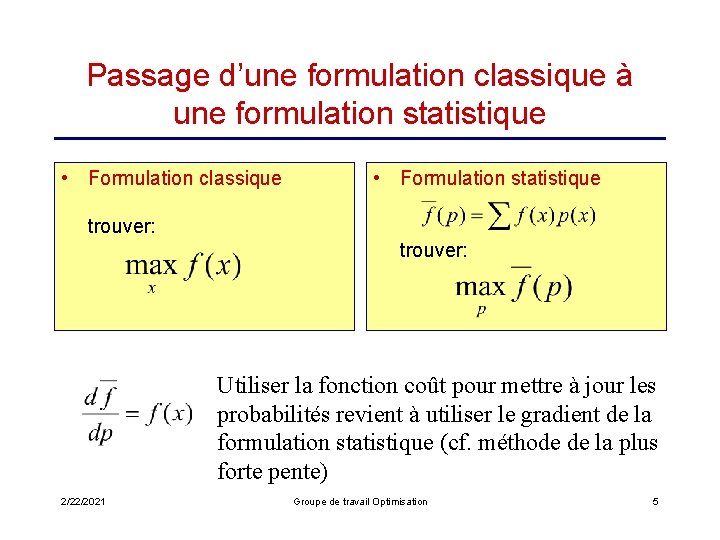

Passage d’une formulation classique à une formulation statistique • Formulation classique • Formulation statistique trouver: Utiliser la fonction coût pour mettre à jour les probabilités revient à utiliser le gradient de la formulation statistique (cf. méthode de la plus forte pente) 2/22/2021 Groupe de travail Optimisation 5

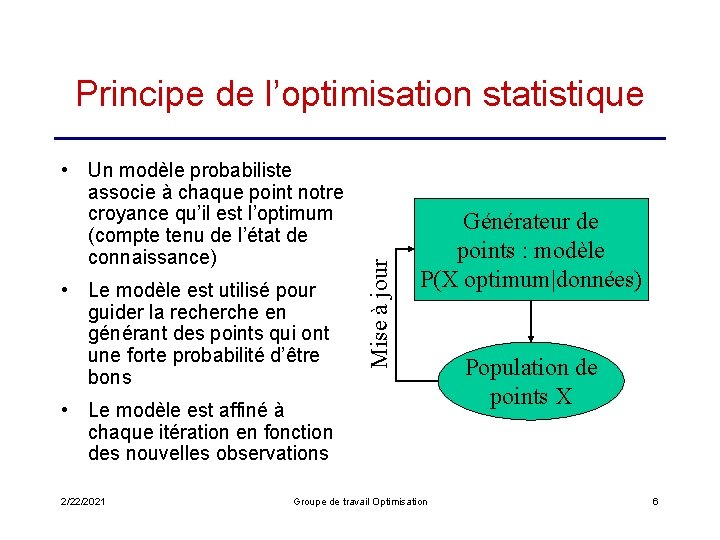

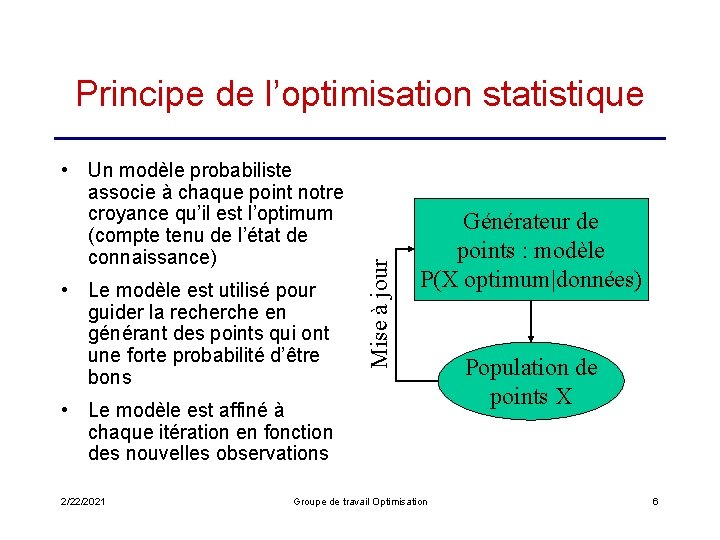

• Un modèle probabiliste associe à chaque point notre croyance qu’il est l’optimum (compte tenu de l’état de connaissance) • Le modèle est utilisé pour guider la recherche en générant des points qui ont une forte probabilité d’être bons Mise à jour Principe de l’optimisation statistique Générateur de points : modèle P(X optimum|données) • Le modèle est affiné à chaque itération en fonction des nouvelles observations 2/22/2021 Groupe de travail Optimisation Population de points X 6

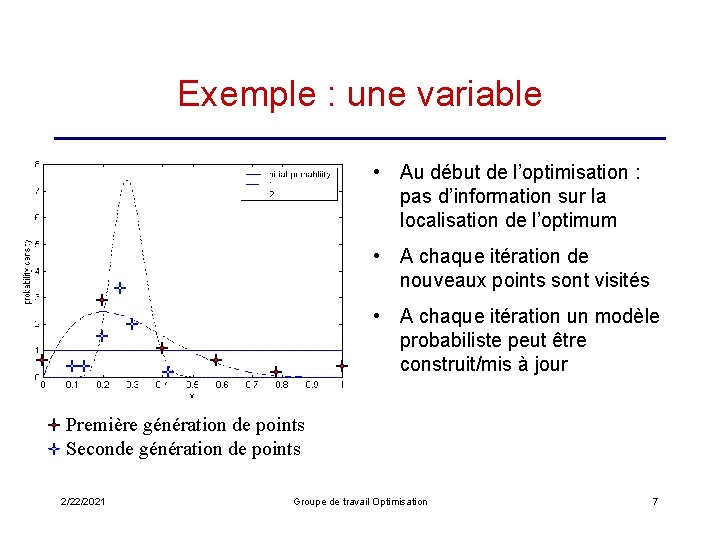

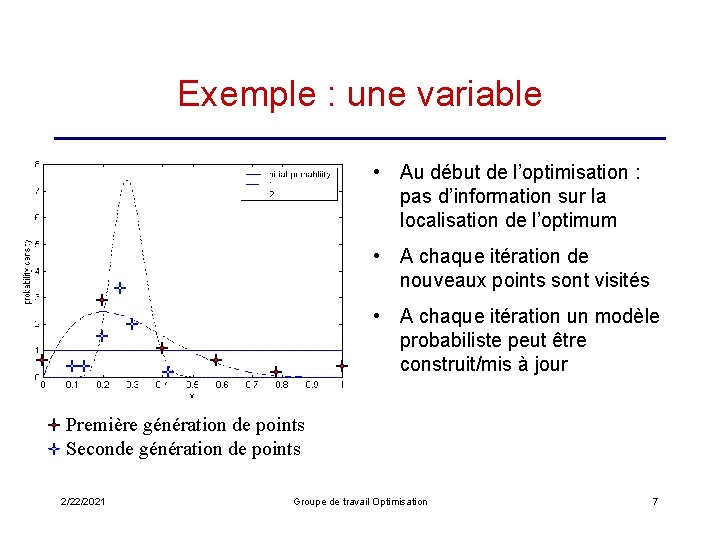

Exemple : une variable • Au début de l’optimisation : pas d’information sur la localisation de l’optimum • A chaque itération de nouveaux points sont visités • A chaque itération un modèle probabiliste peut être construit/mis à jour Première génération de points Seconde génération de points 2/22/2021 Groupe de travail Optimisation 7

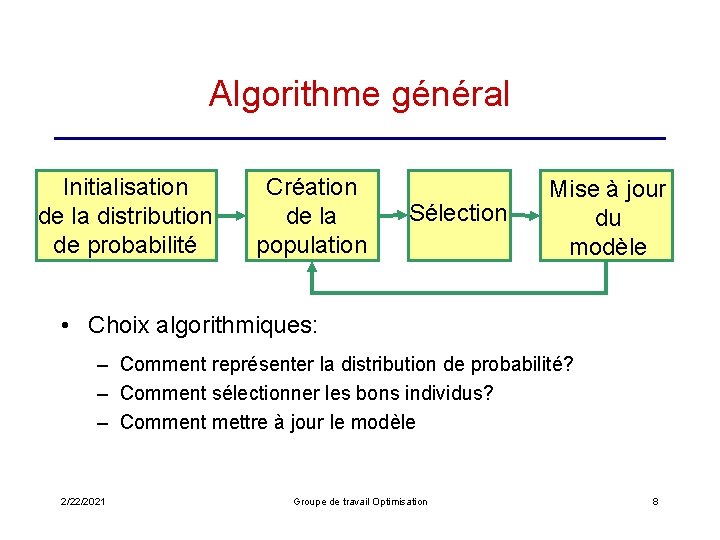

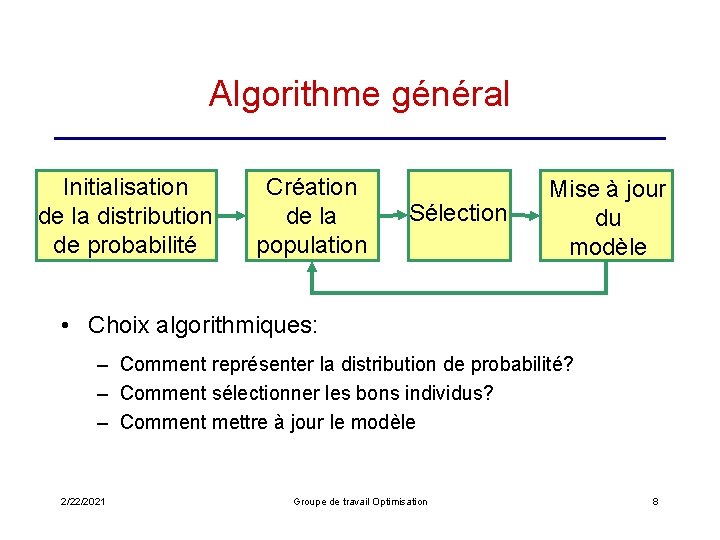

Algorithme général Initialisation de la distribution de probabilité Création de la population Sélection Mise à jour du modèle • Choix algorithmiques: – Comment représenter la distribution de probabilité? – Comment sélectionner les bons individus? – Comment mettre à jour le modèle 2/22/2021 Groupe de travail Optimisation 8

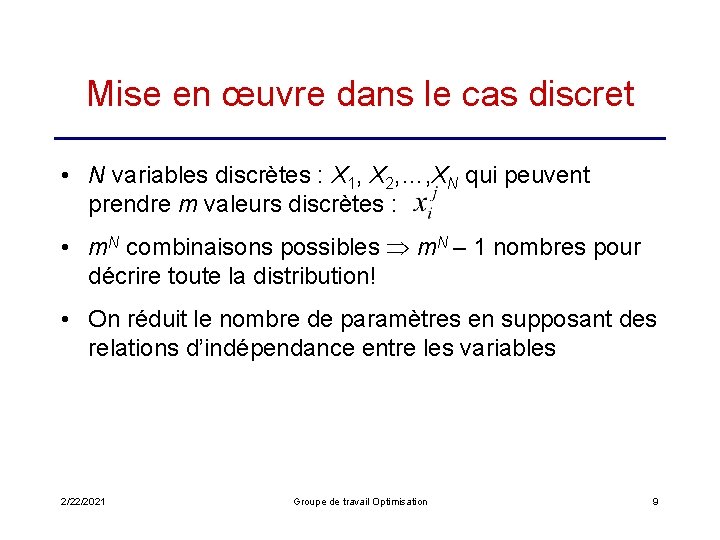

Mise en œuvre dans le cas discret • N variables discrètes : X 1, X 2, …, XN qui peuvent prendre m valeurs discrètes : • m. N combinaisons possibles m. N – 1 nombres pour décrire toute la distribution! • On réduit le nombre de paramètres en supposant des relations d’indépendance entre les variables 2/22/2021 Groupe de travail Optimisation 9

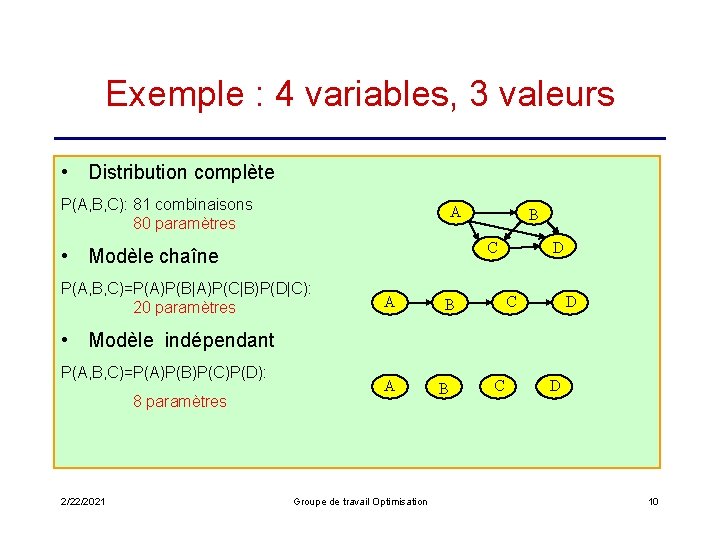

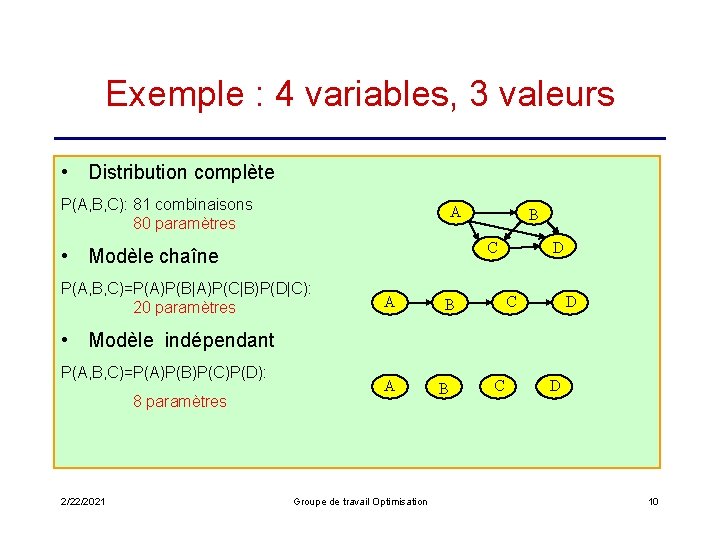

Exemple : 4 variables, 3 valeurs • Distribution complète P(A, B, C): 81 combinaisons 80 paramètres A B C • Modèle chaîne P(A, B, C)=P(A)P(B|A)P(C|B)P(D|C): 20 paramètres A D C B D • Modèle indépendant P(A, B, C)=P(A)P(B)P(C)P(D): 8 paramètres 2/22/2021 A Groupe de travail Optimisation B C D 10

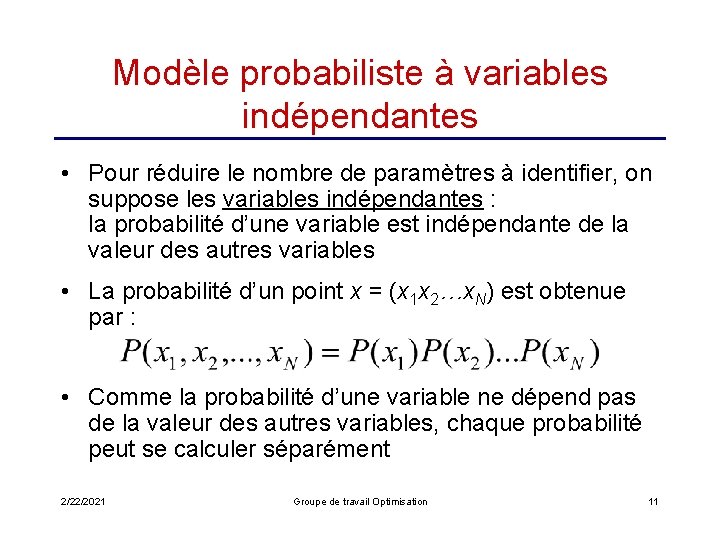

Modèle probabiliste à variables indépendantes • Pour réduire le nombre de paramètres à identifier, on suppose les variables indépendantes : la probabilité d’une variable est indépendante de la valeur des autres variables • La probabilité d’un point x = (x 1 x 2…x. N) est obtenue par : • Comme la probabilité d’une variable ne dépend pas de la valeur des autres variables, chaque probabilité peut se calculer séparément 2/22/2021 Groupe de travail Optimisation 11

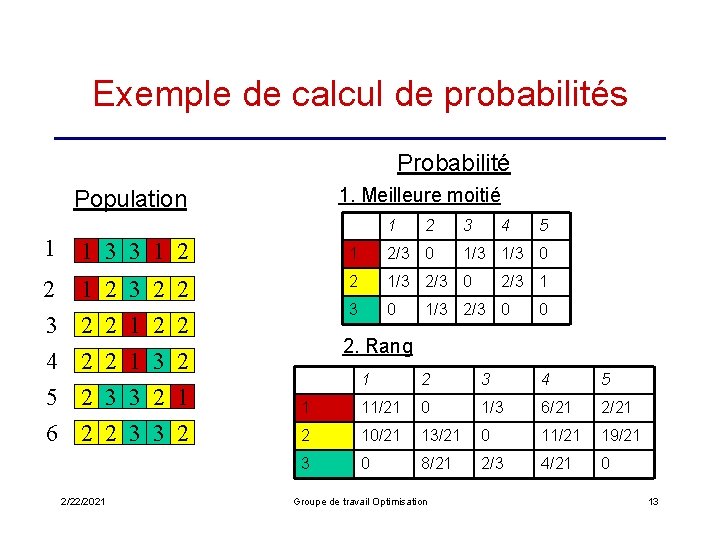

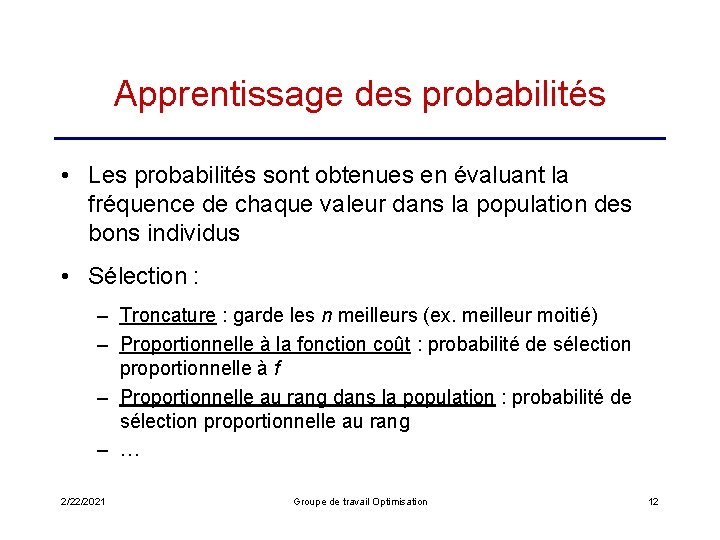

Apprentissage des probabilités • Les probabilités sont obtenues en évaluant la fréquence de chaque valeur dans la population des bons individus • Sélection : – Troncature : garde les n meilleurs (ex. meilleur moitié) – Proportionnelle à la fonction coût : probabilité de sélection proportionnelle à f – Proportionnelle au rang dans la population : probabilité de sélection proportionnelle au rang – … 2/22/2021 Groupe de travail Optimisation 12

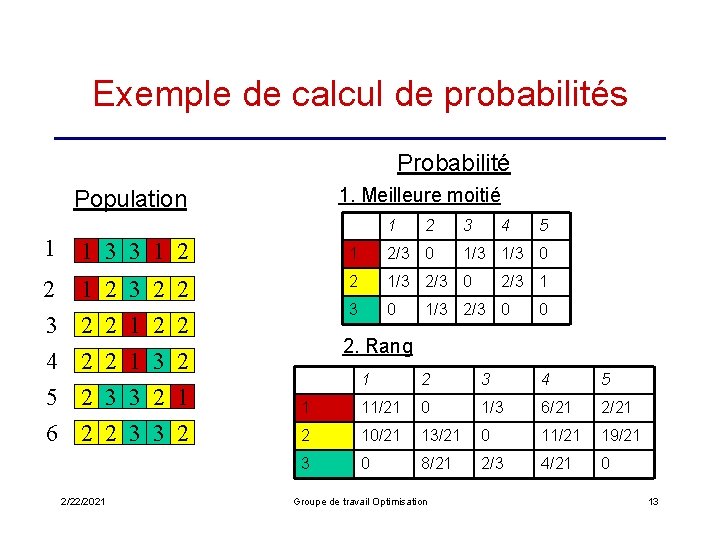

Exemple de calcul de probabilités Probabilité 1. Meilleure moitié Population 1 2 3 1 1 3 3 1 2/3 0 2 3 4 5 6 1 2 2 2 1/3 2/3 0 2 2 2 3 2 2/22/2021 3 1 1 3 3 2 2 2 1 2 4 5 1/3 0 2/3 1 1/3 2/3 0 0 1 2 3 4 5 1 11/21 0 1/3 6/21 2 10/21 13/21 0 11/21 19/21 3 0 8/21 2/3 4/21 0 2. Rang Groupe de travail Optimisation 13

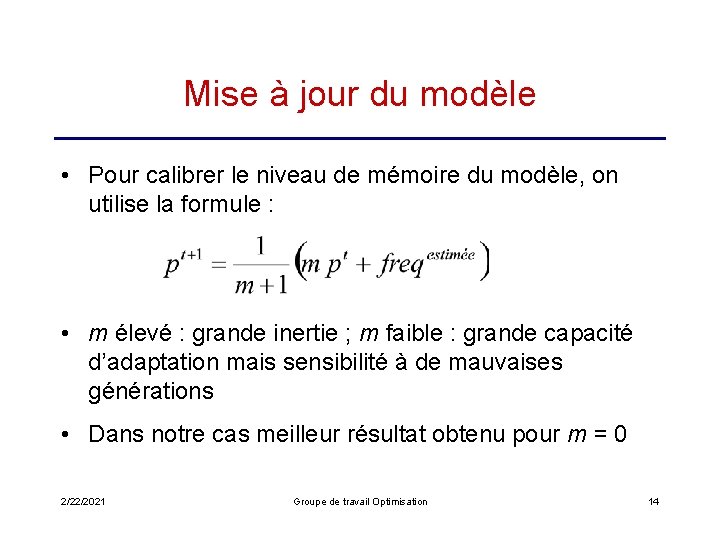

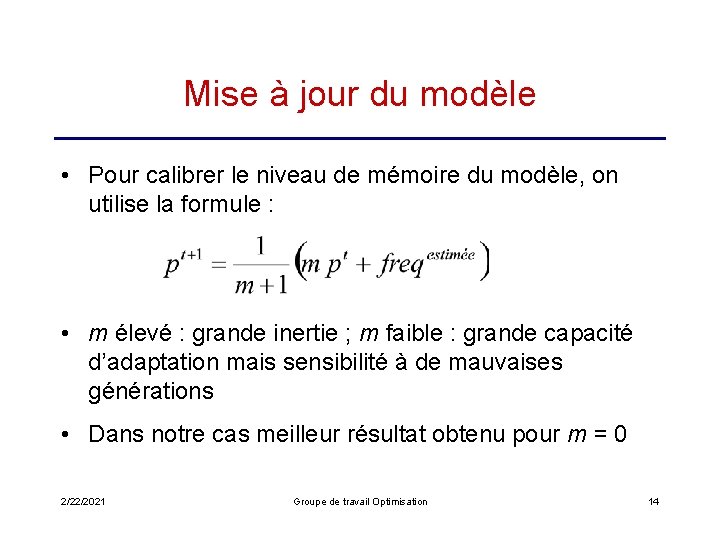

Mise à jour du modèle • Pour calibrer le niveau de mémoire du modèle, on utilise la formule : • m élevé : grande inertie ; m faible : grande capacité d’adaptation mais sensibilité à de mauvaises générations • Dans notre cas meilleur résultat obtenu pour m = 0 2/22/2021 Groupe de travail Optimisation 14

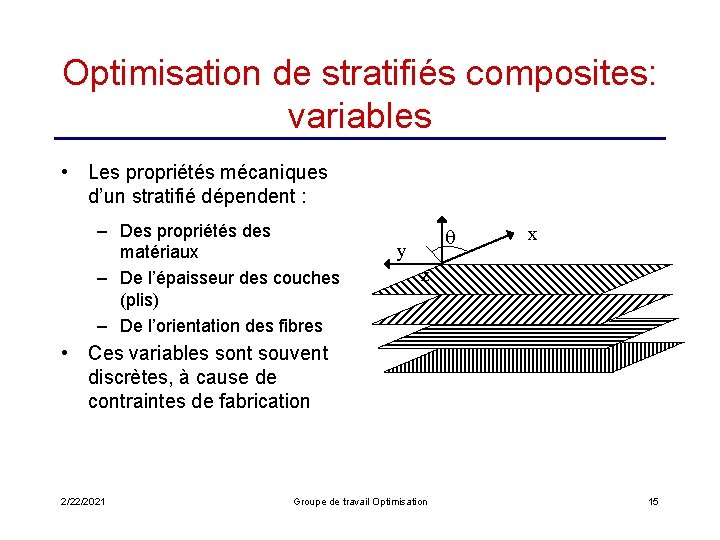

Optimisation de stratifiés composites: variables • Les propriétés mécaniques d’un stratifié dépendent : – Des propriétés des matériaux – De l’épaisseur des couches (plis) – De l’orientation des fibres y x z • Ces variables sont souvent discrètes, à cause de contraintes de fabrication 2/22/2021 Groupe de travail Optimisation 15

Optimisation de stratifiés composites: fonction coût et contraintes • Critères d’optimisation : – – – Poids ou coût Charge de flambement Fréquences propres Résistance … • Les problèmes d’optimisation de stratifiés sont des problèmes combinatoires 2/22/2021 Groupe de travail Optimisation 16

Problème test non couplé • Problème : maximiser la rigidité longitudinale A 11 • Solution : toutes les fibres alignées selon x : [0°/0°/ 0°/0°] • Particularité : ce problème est découplé car on augmente A 11 en diminuant n’importe quel angle indépendamment de la valeur des autres angles 2/22/2021 Groupe de travail Optimisation 17

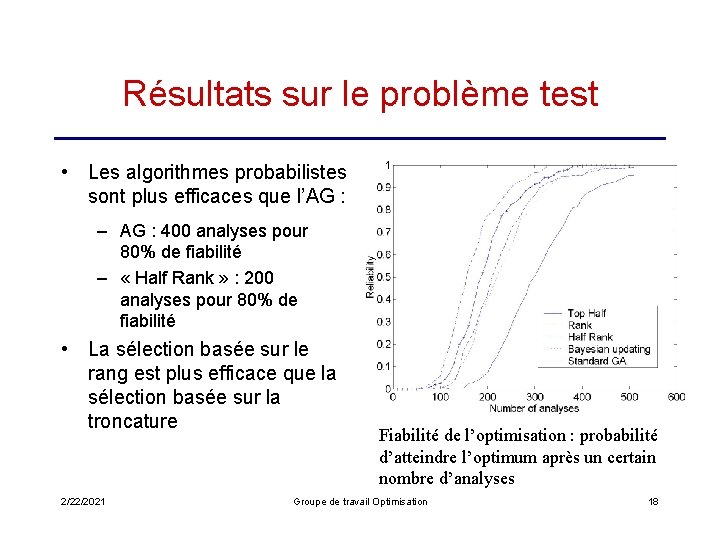

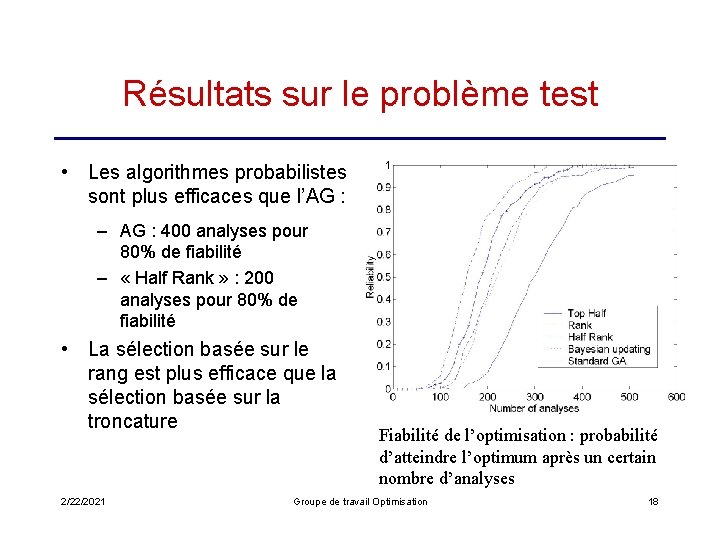

Résultats sur le problème test • Les algorithmes probabilistes sont plus efficaces que l’AG : – AG : 400 analyses pour 80% de fiabilité – « Half Rank » : 200 analyses pour 80% de fiabilité • La sélection basée sur le rang est plus efficace que la sélection basée sur la troncature 2/22/2021 Fiabilité de l’optimisation : probabilité d’atteindre l’optimum après un certain nombre d’analyses Groupe de travail Optimisation 18

Problème couplé • Problème : maximiser contraintes rigidité longitudinale A 11 rigidité transversale A 22 min rigidité en cisaillement A 66 min • Optimum : [02/ 153/ 30/ 45/908] ou une de ses permutations • Particularité : ce problème comporte des interactions entre les variables car si une variable a pour valeur 02, la probabilité de 0 pour les autres variables sera nulle 2/22/2021 Groupe de travail Optimisation 19

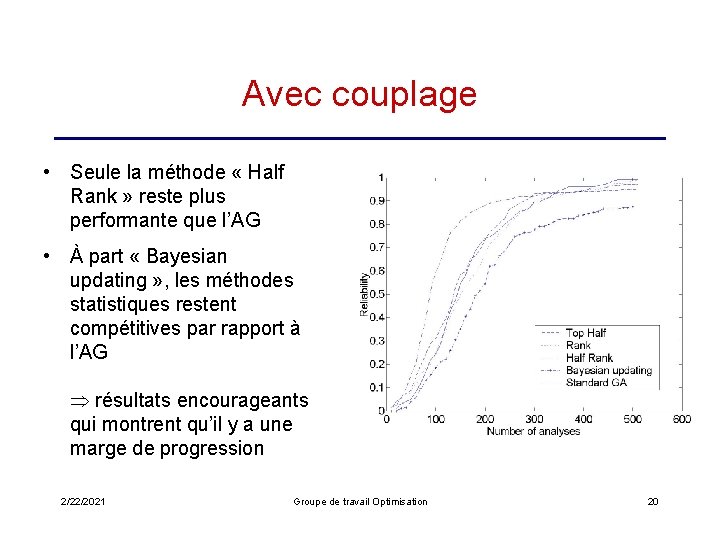

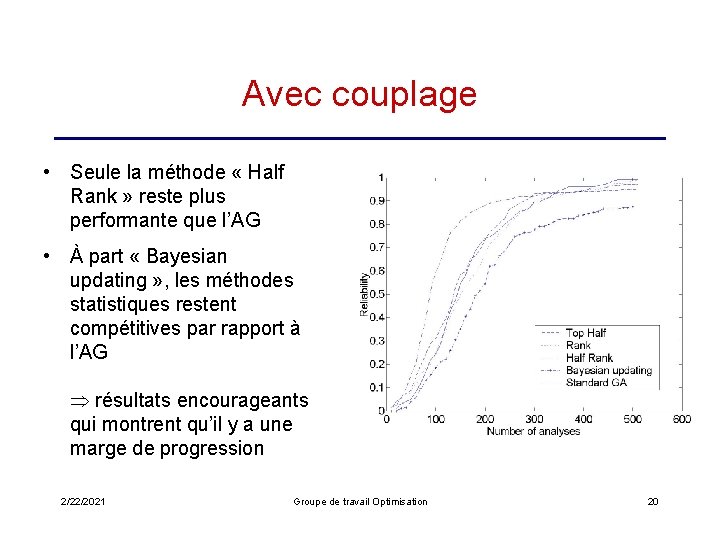

Avec couplage • Seule la méthode « Half Rank » reste plus performante que l’AG • À part « Bayesian updating » , les méthodes statistiques restent compétitives par rapport à l’AG résultats encourageants qui montrent qu’il y a une marge de progression 2/22/2021 Groupe de travail Optimisation 20

Commentaires • Modèle très simple, facile à mettre en œuvre • Problème : modèle basé sur l’hypothèse d’indépendance des variables pas vérifié en général • Prendre en compte le couplage : modèle probabiliste plus complexe, type réseau bayesien difficile à mettre en œuvre • Autre alternative : introduire des variables intermédiaires qui synthétisent les couplages 2/22/2021 Groupe de travail Optimisation 21

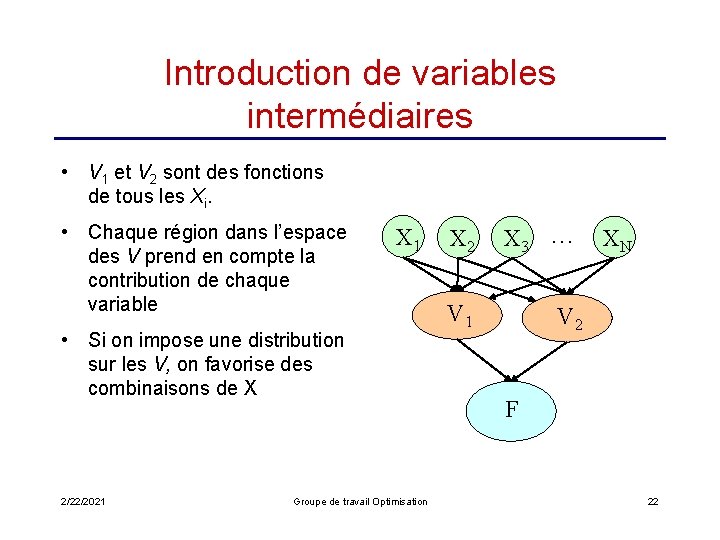

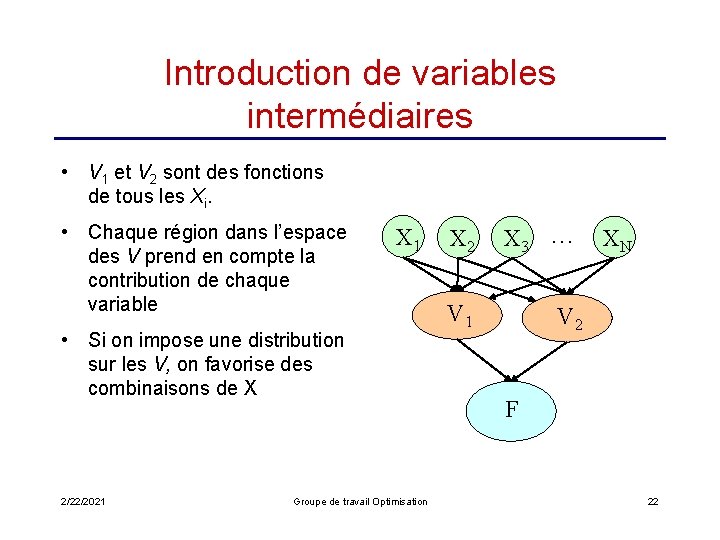

Introduction de variables intermédiaires • V 1 et V 2 sont des fonctions de tous les Xi. • Chaque région dans l’espace des V prend en compte la contribution de chaque variable X 1 • Si on impose une distribution sur les V, on favorise des combinaisons de X 2/22/2021 Groupe de travail Optimisation X 2 X 3 … V 1 XN V 2 F 22

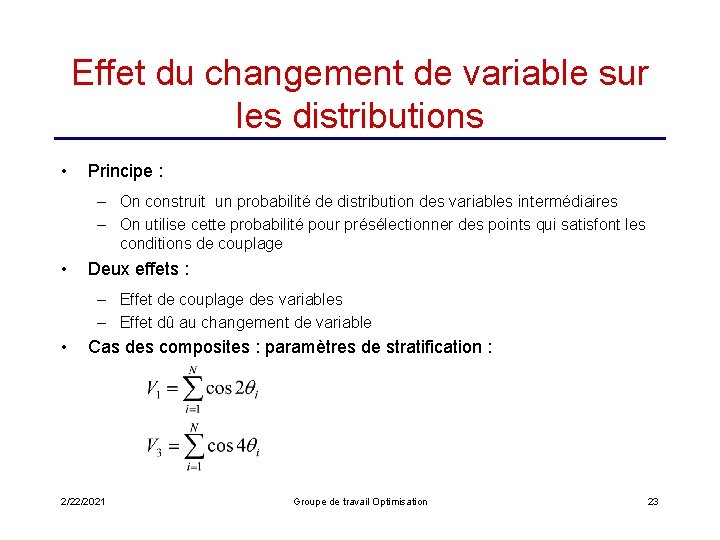

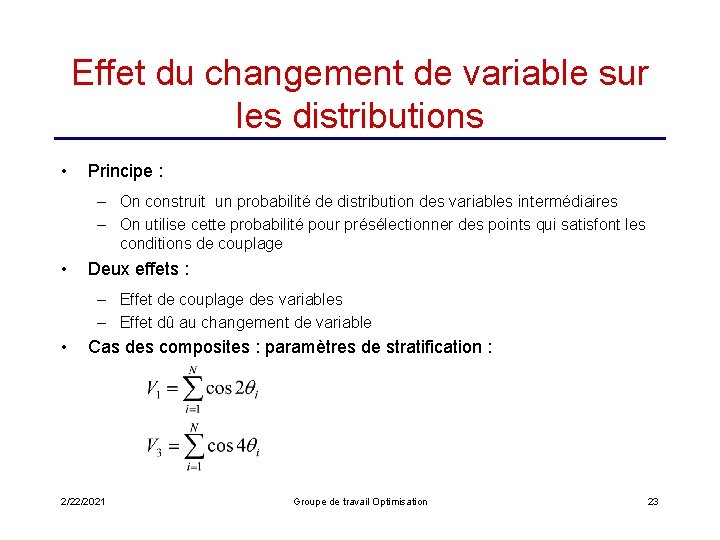

Effet du changement de variable sur les distributions • Principe : – On construit un probabilité de distribution des variables intermédiaires – On utilise cette probabilité pour présélectionner des points qui satisfont les conditions de couplage • Deux effets : – Effet de couplage des variables – Effet dû au changement de variable • Cas des composites : paramètres de stratification : 2/22/2021 Groupe de travail Optimisation 23

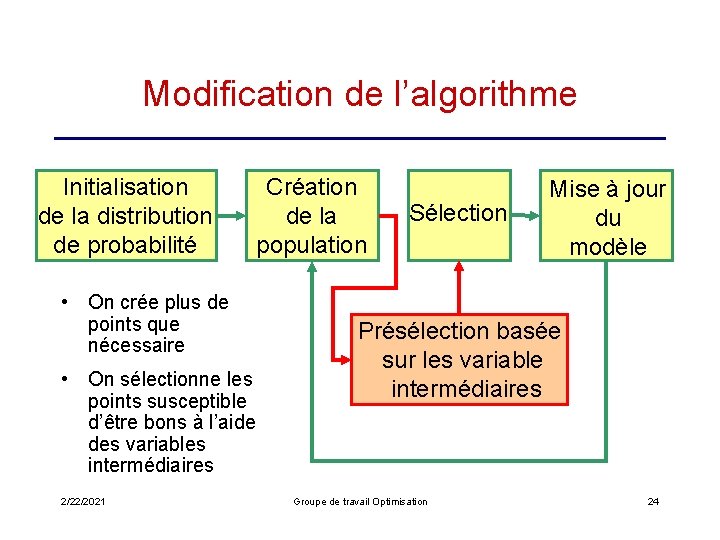

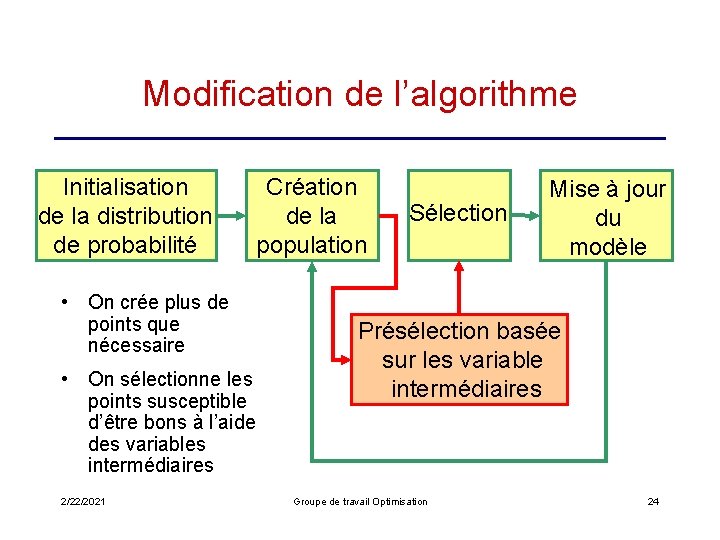

Modification de l’algorithme Initialisation de la distribution de probabilité Création de la population • On crée plus de points que nécessaire • On sélectionne les points susceptible d’être bons à l’aide des variables intermédiaires 2/22/2021 Sélection Mise à jour du modèle Présélection basée sur les variable intermédiaires Groupe de travail Optimisation 24

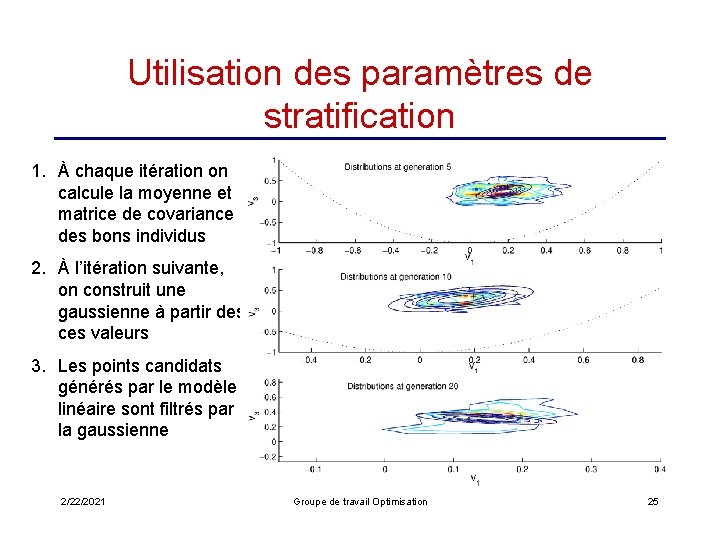

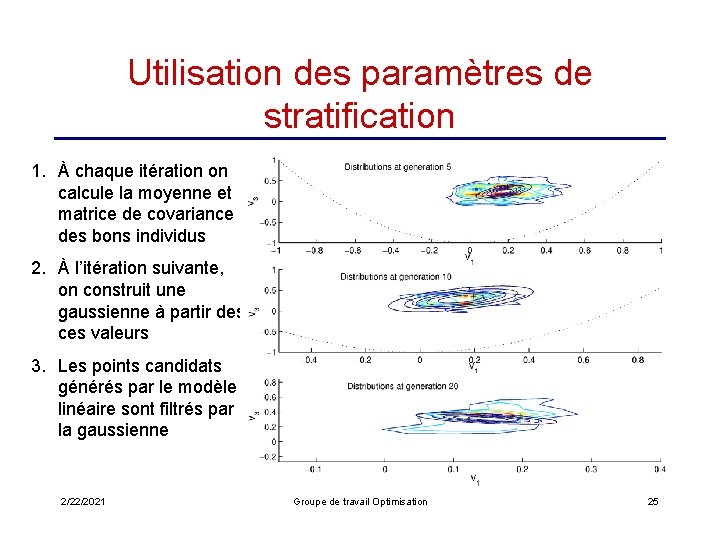

Utilisation des paramètres de stratification 1. À chaque itération on calcule la moyenne et matrice de covariance des bons individus 2. À l’itération suivante, on construit une gaussienne à partir des ces valeurs 3. Les points candidats générés par le modèle linéaire sont filtrés par la gaussienne 2/22/2021 Groupe de travail Optimisation 25

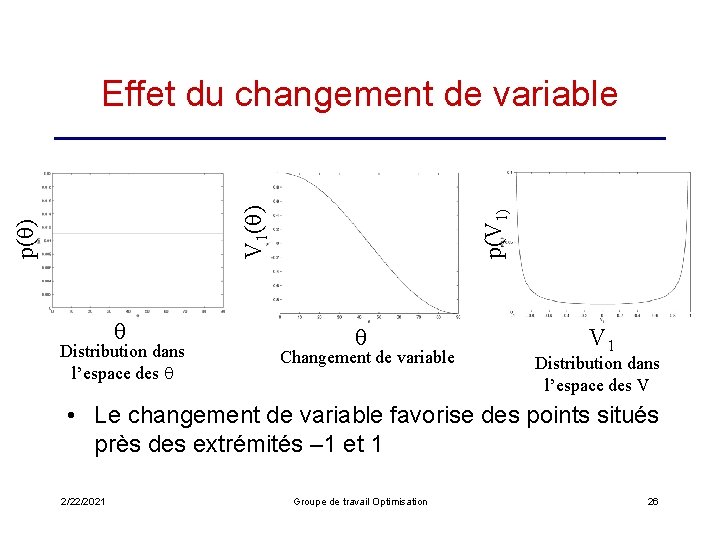

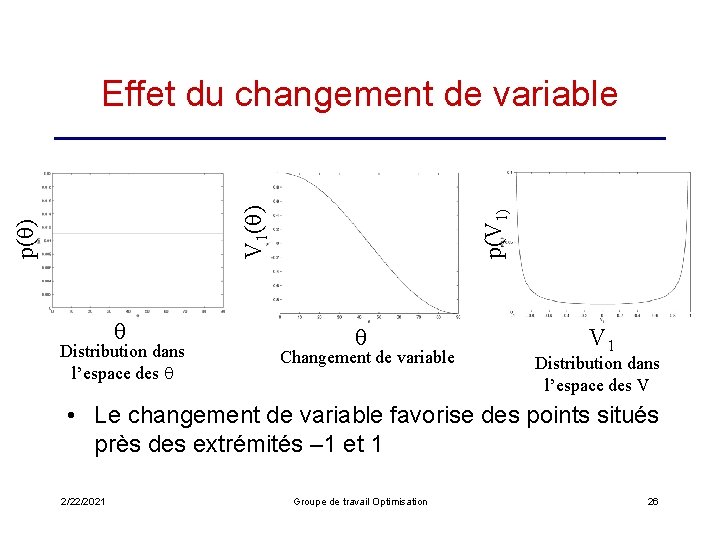

Distribution dans l’espace des p(V 1) p( ) V 1( ) Effet du changement de variable Changement de variable V 1 Distribution dans l’espace des V • Le changement de variable favorise des points situés près des extrémités – 1 et 1 2/22/2021 Groupe de travail Optimisation 26

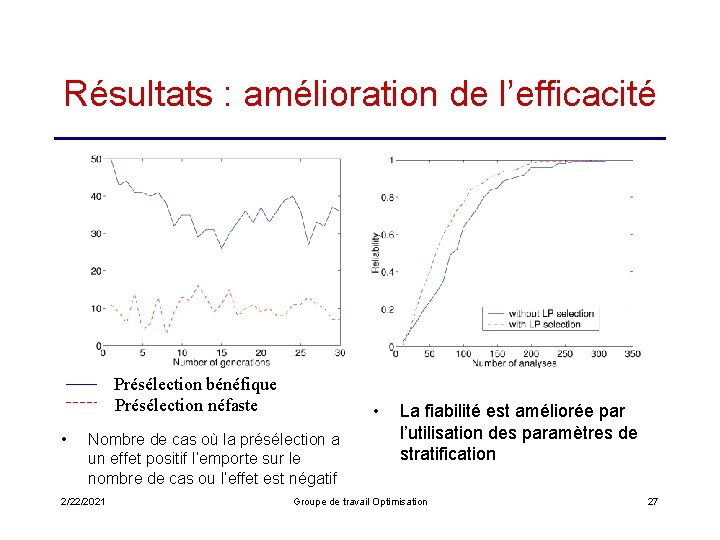

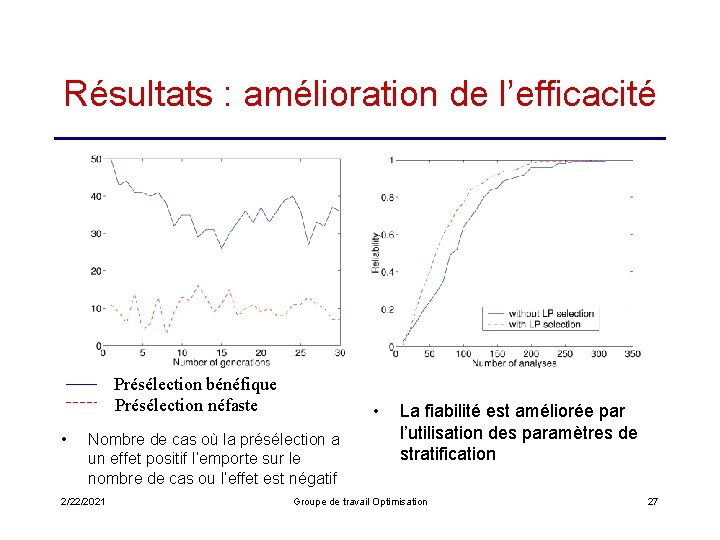

Résultats : amélioration de l’efficacité Présélection bénéfique Présélection néfaste • • Nombre de cas où la présélection a un effet positif l’emporte sur le nombre de cas ou l’effet est négatif 2/22/2021 La fiabilité est améliorée par l’utilisation des paramètres de stratification Groupe de travail Optimisation 27

Problèmes rencontrés, questions • Algorithme trop conservateur : freine le progrès car les points qui s’éloignent trop du point courant sont exclus • Cela a-t-il du sens de fitter une gaussienne compte tenu de la taille des populations (<10)? • L’amélioration observée est-elle spécifique aux paramètres de stratification? Tout changement de variable donnerait-il le même résultat? 2/22/2021 Groupe de travail Optimisation 28

Résumé • Modèles linéaires : – Facile à mettre en œuvre – Peu de paramètres à régler – Ne prennent pas en compte les couplages entre variables • Modèle à variable intermédiaire – Prend en compte des interactions entre variables – Apportent une amélioration 2/22/2021 Groupe de travail Optimisation 29

Directions de recherche • Utiliser un modèle probabiliste plus complexe qui prend en compte le couplage entre les variables : – Modèle Chaîne – Réseau bayesien • Réfléchir à l’importance de la taille des populations, rôle de la mutation… • Au lieu de fournir UN point optimum, l’optimisation fournit une densité de probabilité. Comment les interpréter et les utiliser : – Fiabilité de l’optimum, sensibilité – Relation au problème physique 2/22/2021 Groupe de travail Optimisation 30