EXPERIMENTOS CON UN SOLO FACTOR ANLISIS DE VARIANZA

- Slides: 43

EXPERIMENTOS CON UN SOLO FACTOR: ANÁLISIS DE VARIANZA

Temas • Análisis de varianza (Ejemplo aplicado) • Análisis del modelo con efectos fijos • Descomposición de la suma de cuadrados total • Análisis estadístico • Estimación de los parámetros del modelo. • Datos no balanceados.

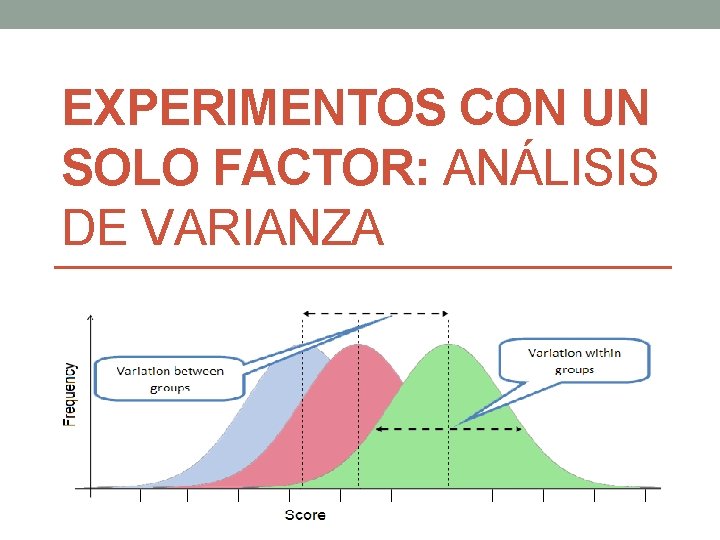

Introducción • El Análisis de la Varianza es, probablemente, la herramienta de inferencia estadística más utilizada en las investigaciones científico-técnicas. • Esta compuesto por unidades llamadas tratamientos, los cuales consisten en un conjunto de acciones que se aplican a las unidades experimentales con la finalidad de observar como responden a éstas. • El procedimiento usual es asignar aleatoriamente tratamientos a las unidades experimentales. los • Se llama variable aleatoria observada o respuesta a la medida u observación que se obtiene de cada una de las unidades experimentales.

Ejemplos • Los tratamientos consisten en sembrar tres variedades de trigo en las parcelas experimentales y observar la respuesta: rendimiento de la parcela. Se dice en este caso que el factor tratamiento (variedad) tiene 3 niveles. • Se llama repetición a cada realización de un tratamiento • Ejemplo: si se asignan 10 parcelas a cada cultivar, se tendrán 10 repeticiones para cada tratamiento.

¿cómo surge una ANOVA? • Las técnicas iniciales de análisis de varianza fueron desarrolladas por el estadístico y genetista R. A Fisher, en los años 1920 y 1930. Debido a que se basa en la distribución F de Fisher como parte de contraste de hipotesis, a menudo se le lama “análisis de varianza de Fisher”

¿Para que hacer una ANOVA? • Su verdadero objetivo (la mayoría de veces) no es la variabilidad, sino otros contrastes como la igualdad de medias ó el ajuste en un problema de regresión. • El objetivo del ANOVA de efectos fijos es contrastar la hipótesis de que los efectos de tratamientos son nulos versus que al menos uno no lo es. En términos estadísticos: • H 0: τ1=. . . =τa= 0 • H 1: Al menos un tratamiento tiene efecto no nulo.

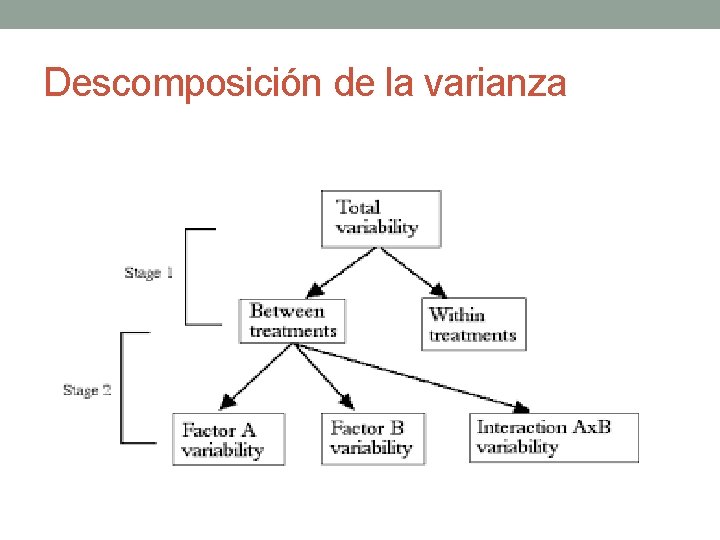

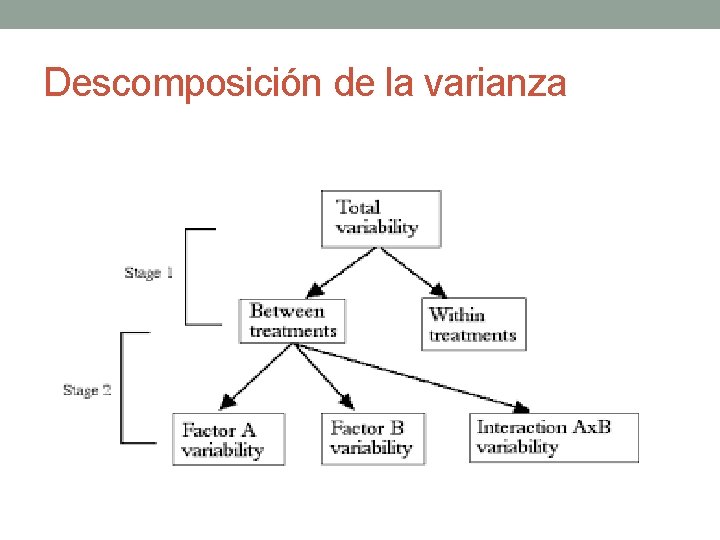

¿En que consiste la ANOVA? • Consiste en descomponer la variabilidad de una población (representada por una varianza) en diversos sumandos según los factores que intervengan en la creación de esa variabildiad. • Normalmente el modelo se indica en terminos de variables dependientes, independientes. • Hay algunos factores que no se incluyen, pero se deben controlar.

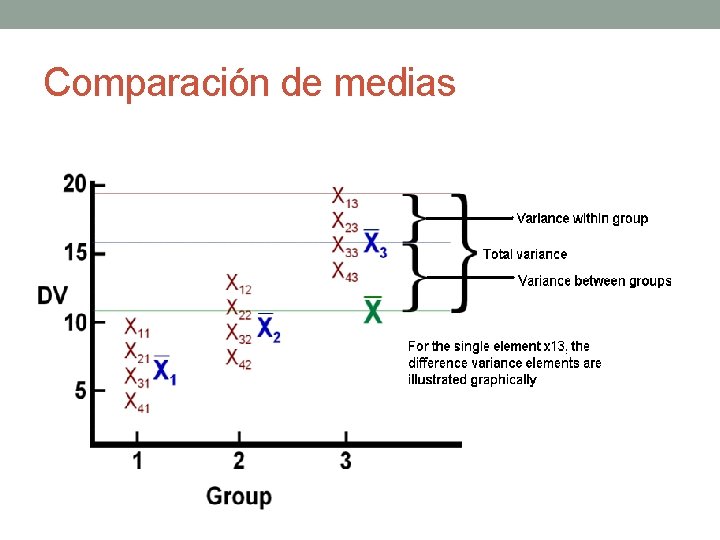

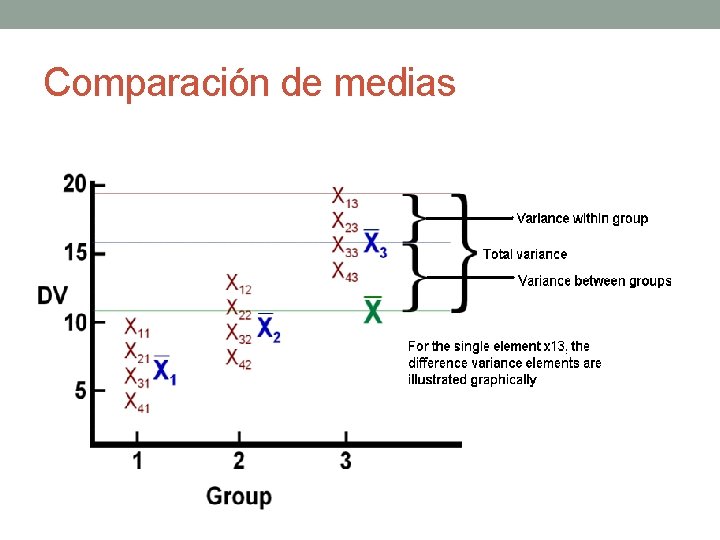

Comparación de medias

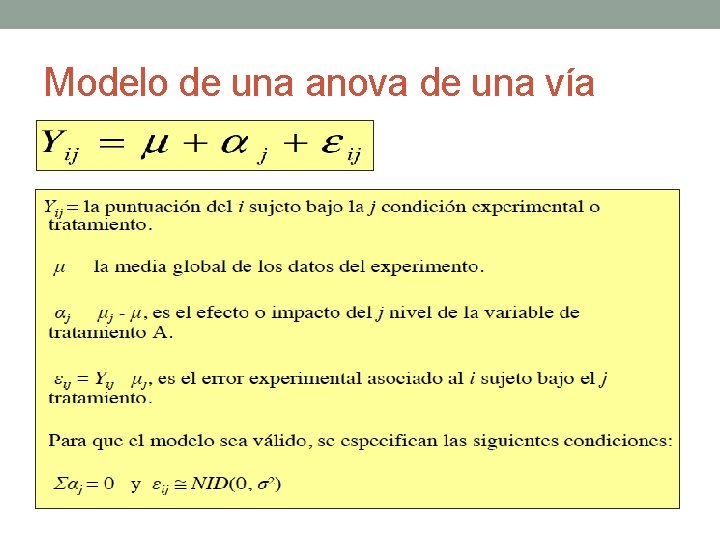

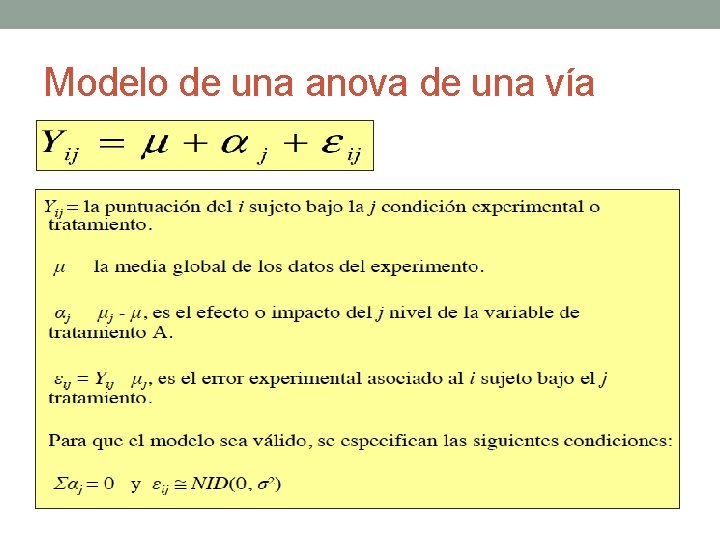

Modelo de una anova de una vía

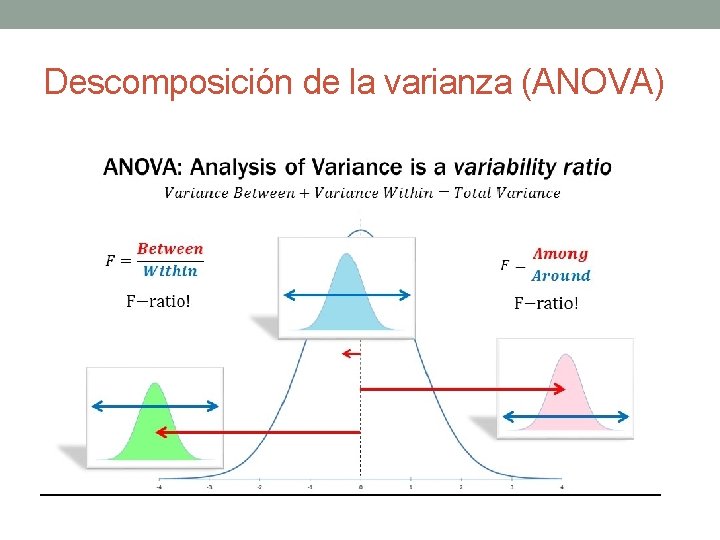

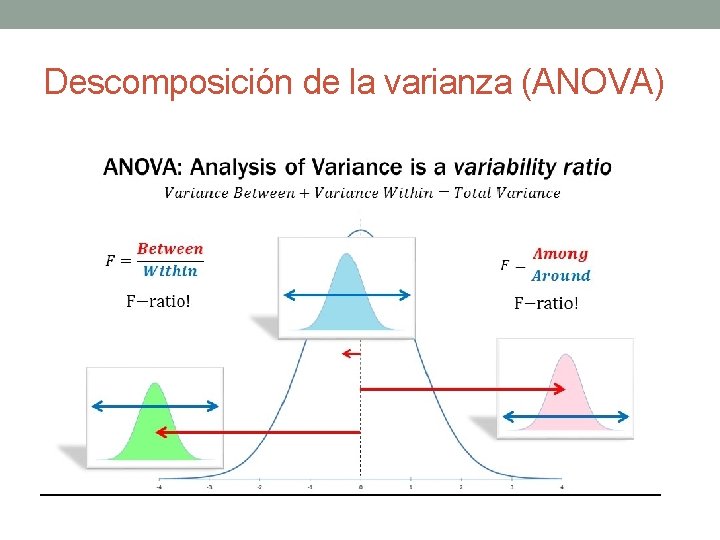

Descomposición de la varianza (ANOVA)

Generalidades de la ANOVA de efectos fijos • Sirve para comparar las medias de mas de 2 grupos • La variable dependiente es cuantitativa. • La variable independiente (Factor de estudio) es cualitativa ó categórica. • No es necesario que todos los grupos sean del mismo tamaño. • Cuanto mayor es el tamaño de los grupos, es menos importante garantizar la normalidad ó la homocedasticidad

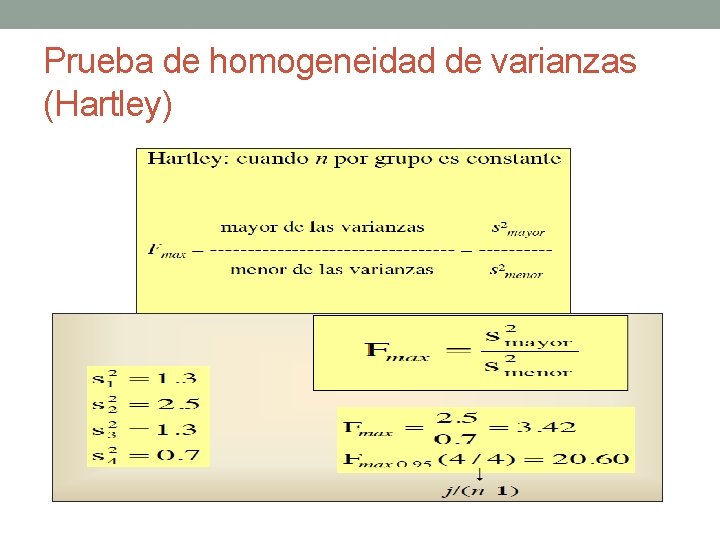

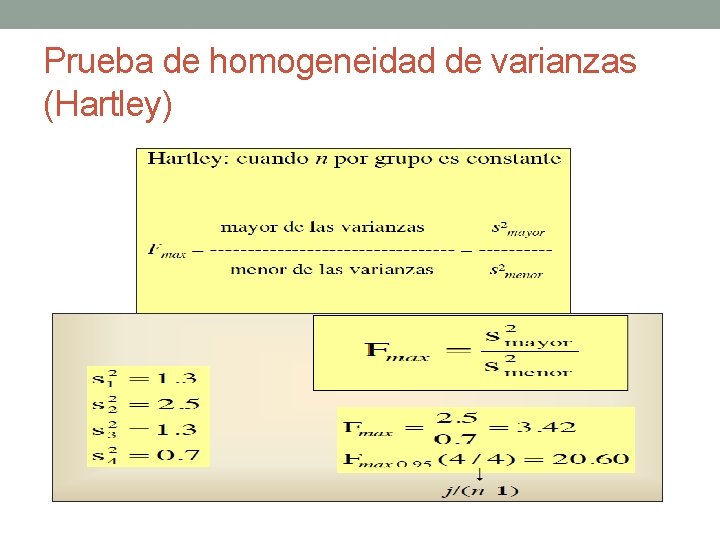

Características y supuestos • Permite comparar 3 o más medias para ver si son iguales, controlando el error. • Existen 3 supuestos: 1. Independencia de las observaciones y de los errores. 2. Normalidad de los datos 3. Homogeneidad de varianzas (Homocedsticidad): Igualdad de las varianzas de los grupos. Ejemplo: Prueba de Hartley (F)

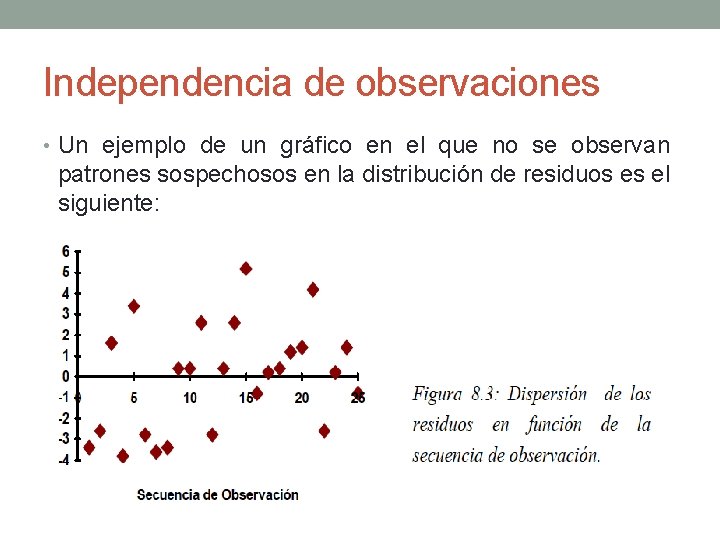

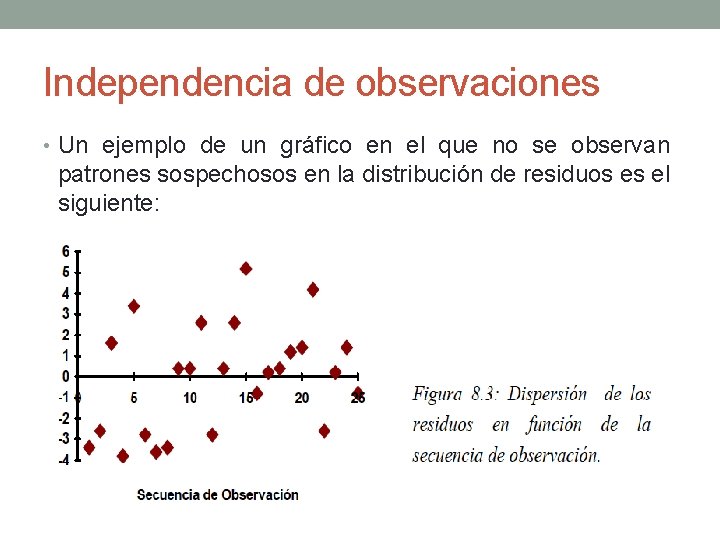

Independencia de observaciones • Un ejemplo de un gráfico en el que no se observan patrones sospechosos en la distribución de residuos es el siguiente:

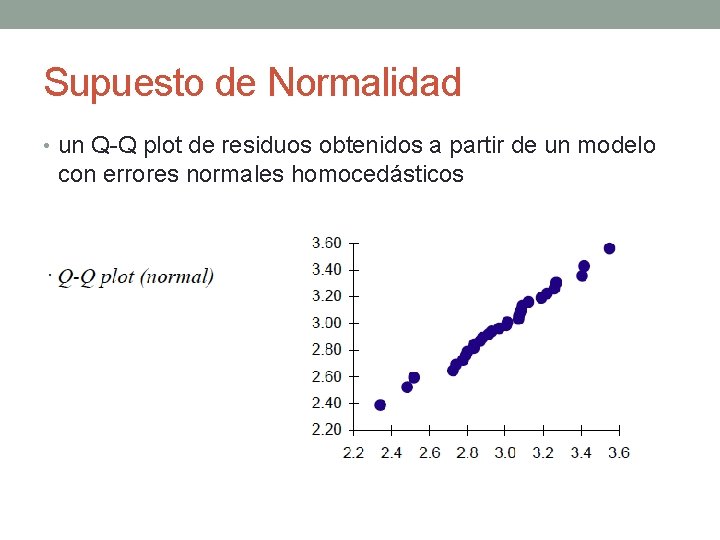

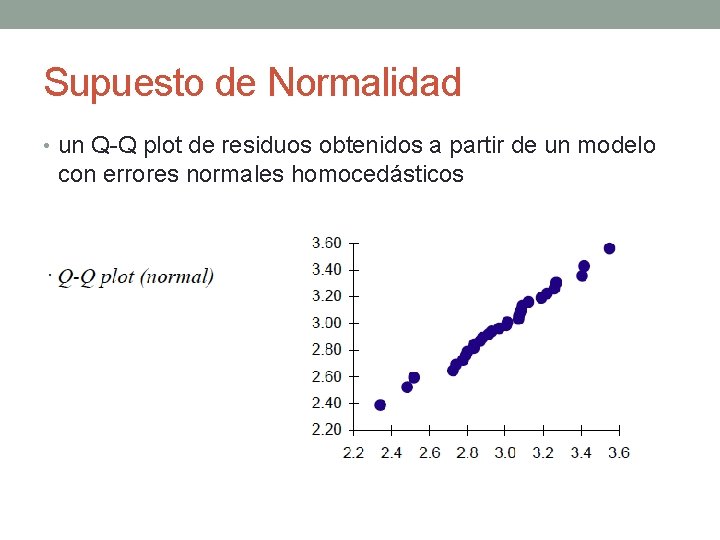

Supuesto de Normalidad • un Q-Q plot de residuos obtenidos a partir de un modelo con errores normales homocedásticos

Prueba de homogeneidad de varianzas (Hartley)

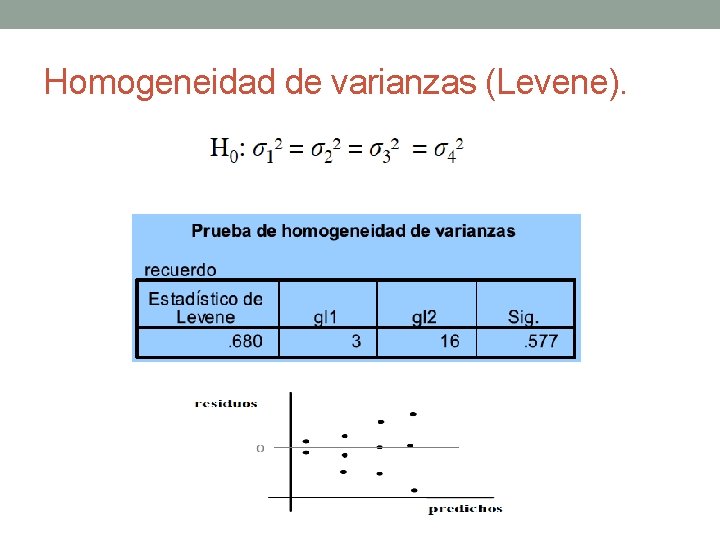

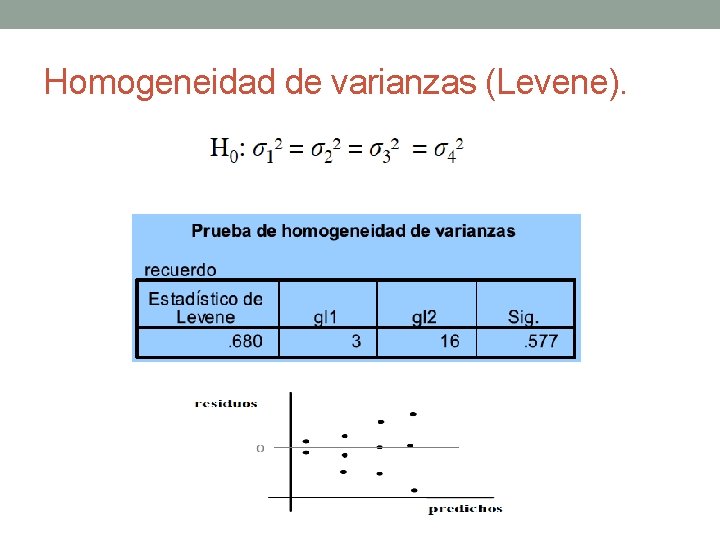

Homogeneidad de varianzas (Levene).

Descomposición de la varianza

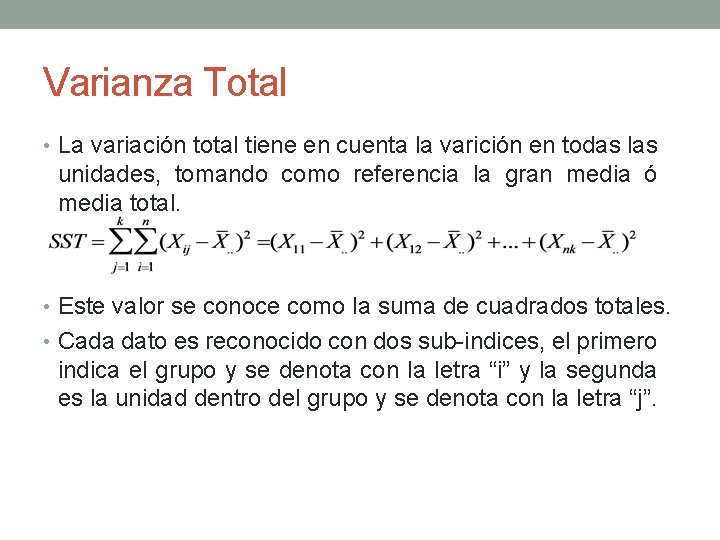

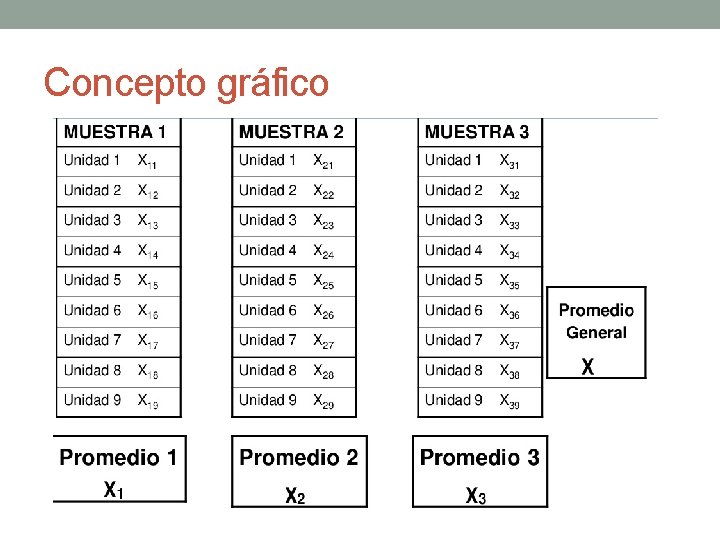

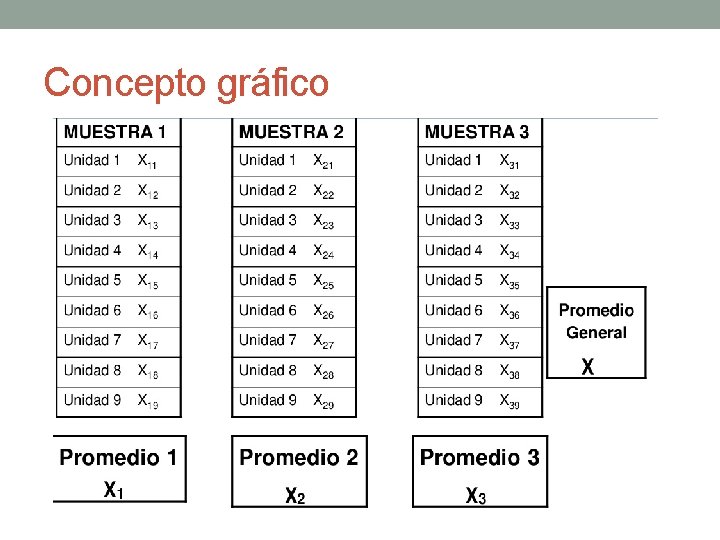

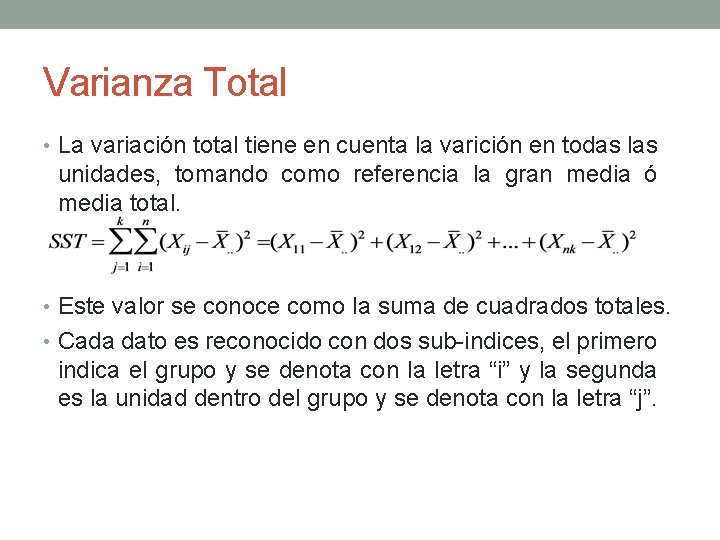

Varianza Total • La variación total tiene en cuenta la varición en todas las unidades, tomando como referencia la gran media ó media total. • Este valor se conoce como la suma de cuadrados totales. • Cada dato es reconocido con dos sub-indices, el primero indica el grupo y se denota con la letra “i” y la segunda es la unidad dentro del grupo y se denota con la letra “j”.

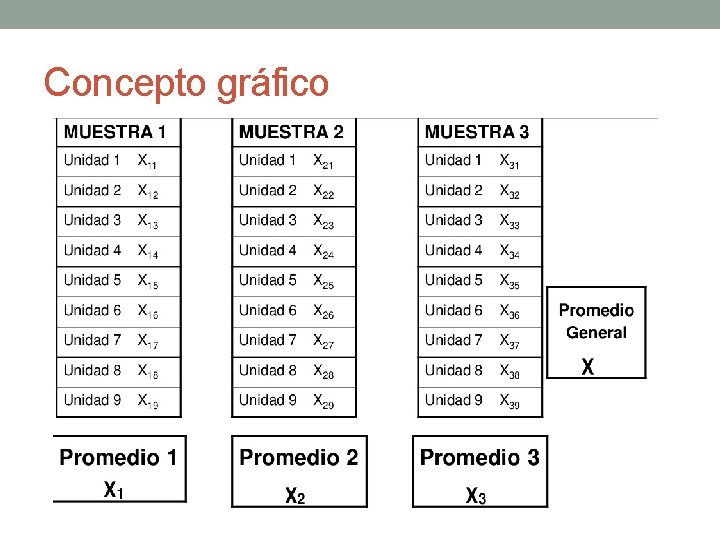

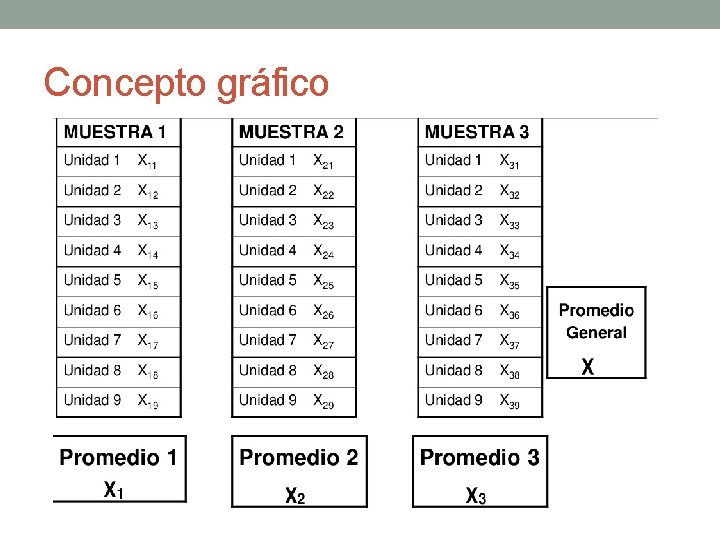

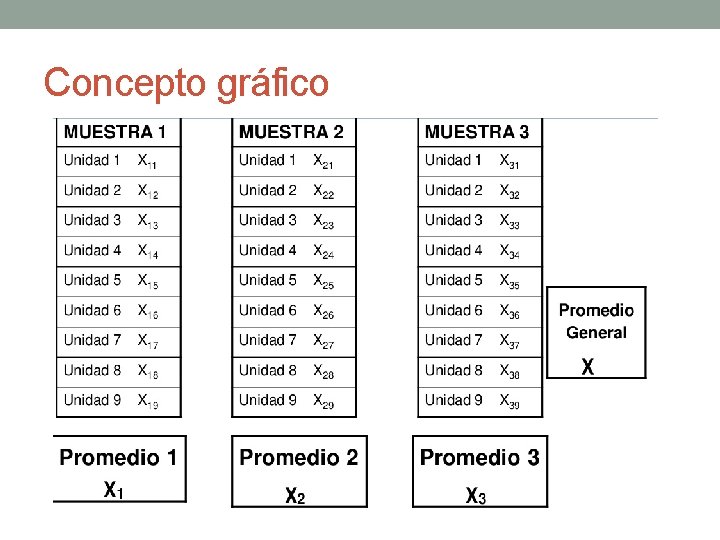

Concepto gráfico

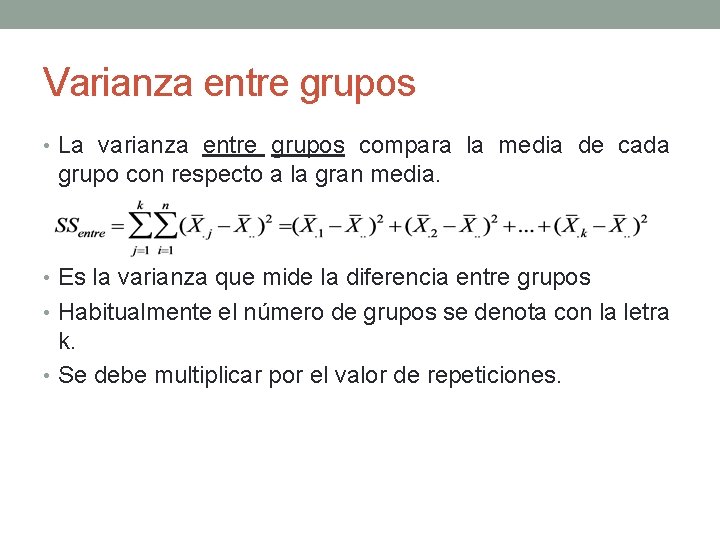

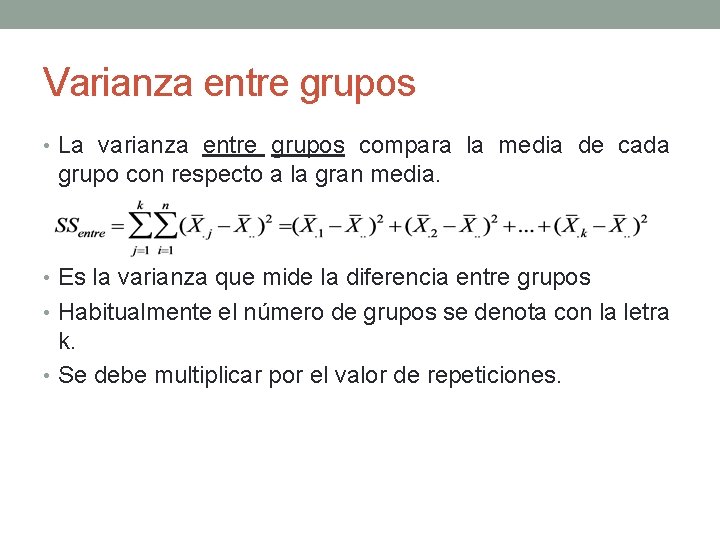

Varianza entre grupos • La varianza entre grupos compara la media de cada grupo con respecto a la gran media. • Es la varianza que mide la diferencia entre grupos • Habitualmente el número de grupos se denota con la letra k. • Se debe multiplicar por el valor de repeticiones.

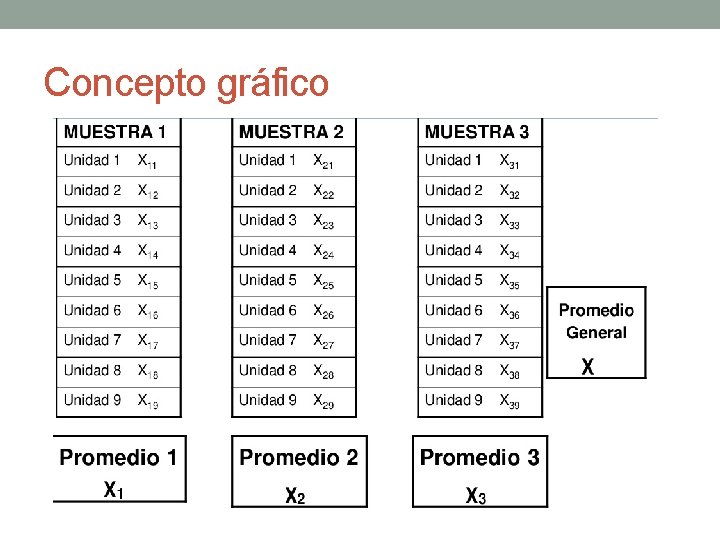

Concepto gráfico

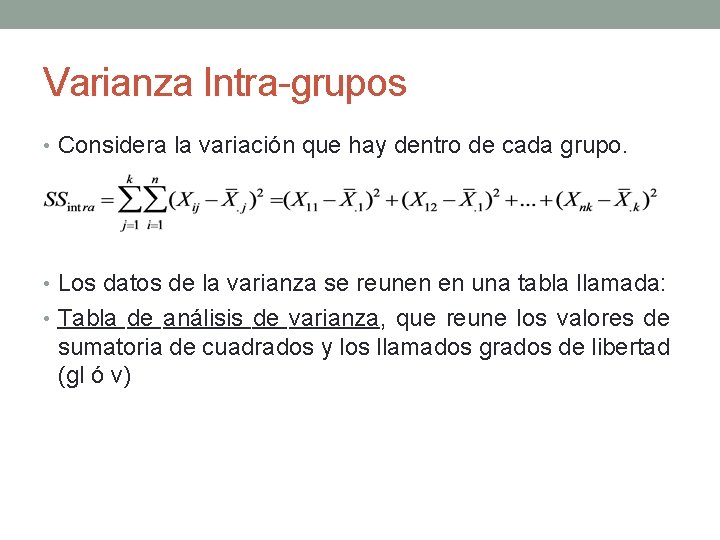

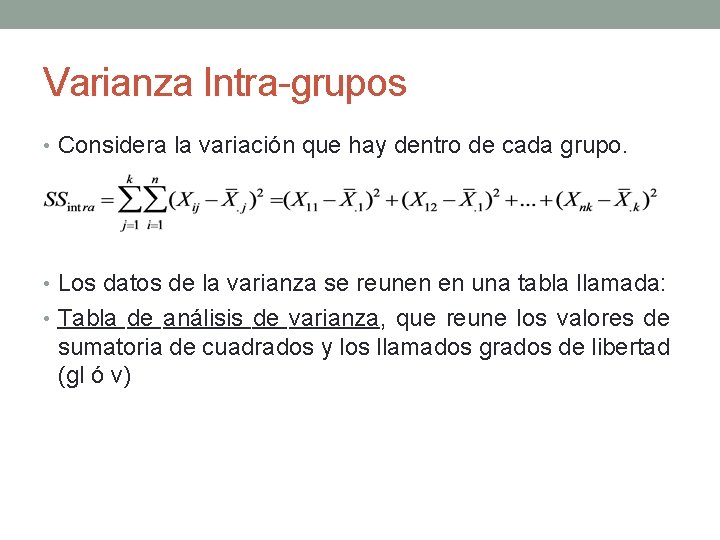

Varianza Intra-grupos • Considera la variación que hay dentro de cada grupo. • Los datos de la varianza se reunen en una tabla llamada: • Tabla de análisis de varianza, que reune los valores de sumatoria de cuadrados y los llamados grados de libertad (gl ó ν)

Concepto gráfico

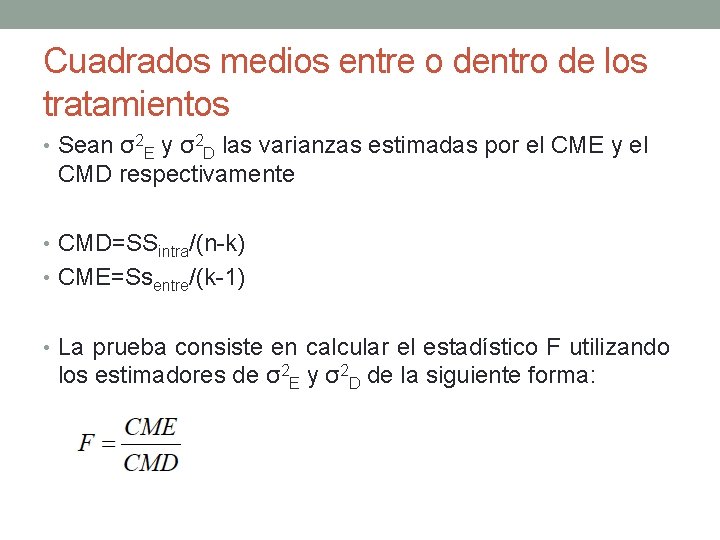

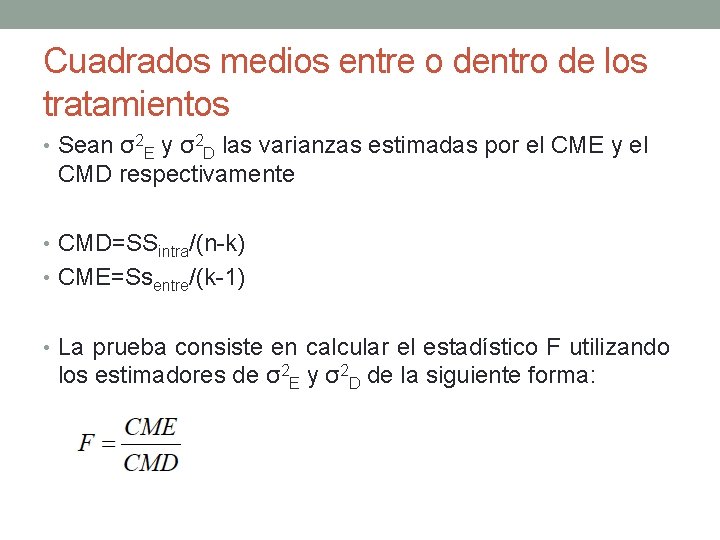

Cuadrados medios entre o dentro de los tratamientos • Sean σ2 E y σ2 D las varianzas estimadas por el CME y el CMD respectivamente • CMD=SSintra/(n-k) • CME=Ssentre/(k-1) • La prueba consiste en calcular el estadístico F utilizando los estimadores de σ2 E y σ2 D de la siguiente forma:

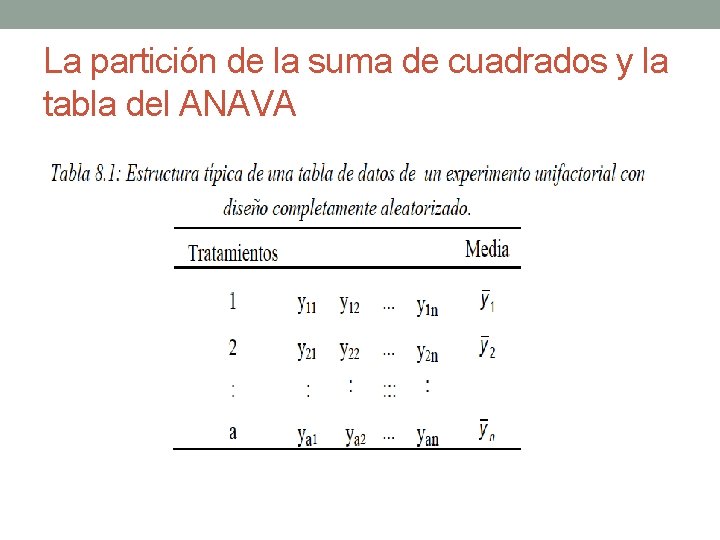

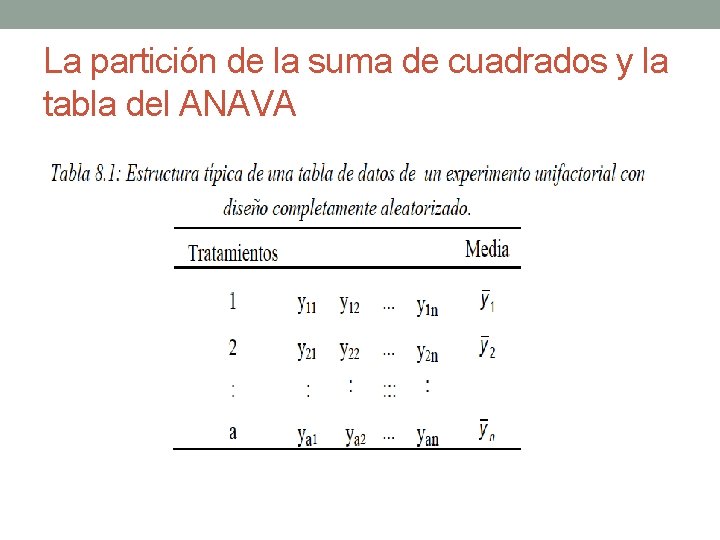

La partición de la suma de cuadrados y la tabla del ANAVA

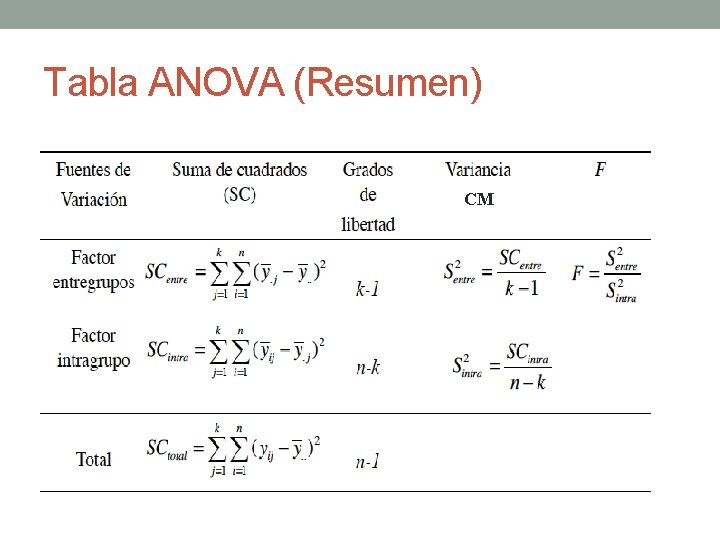

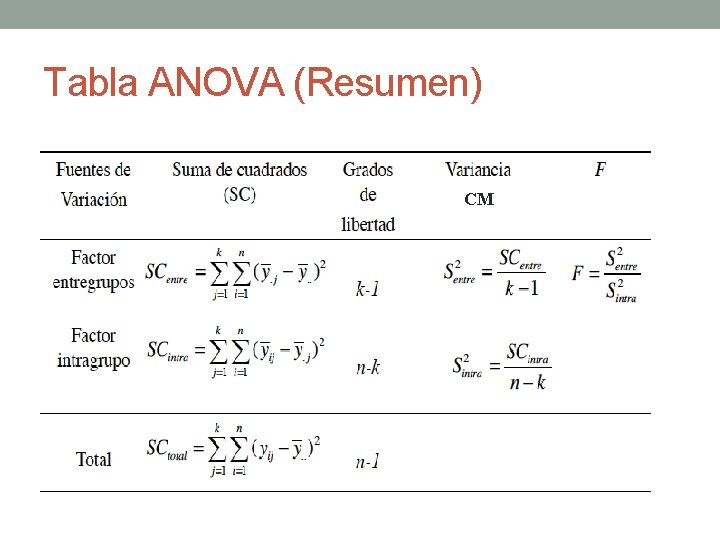

Tabla ANOVA (Resumen) CM

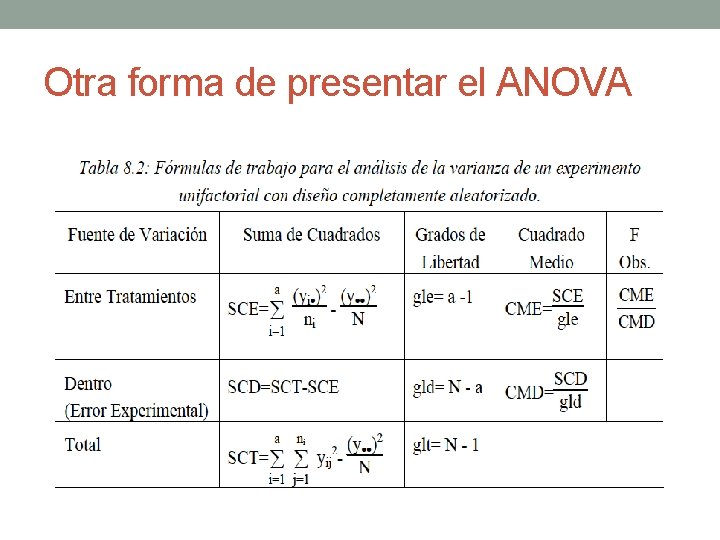

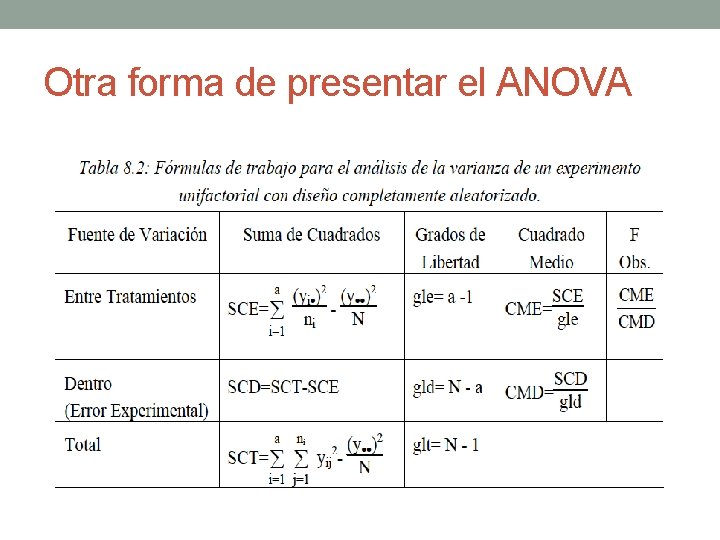

Otra forma de presentar el ANOVA

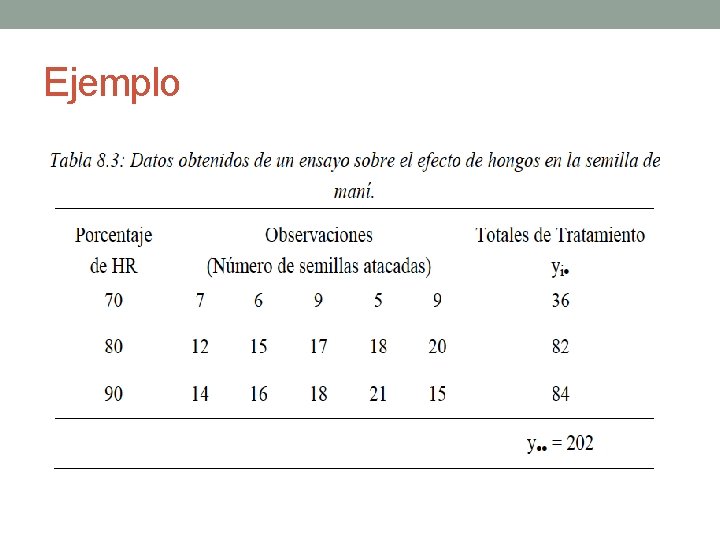

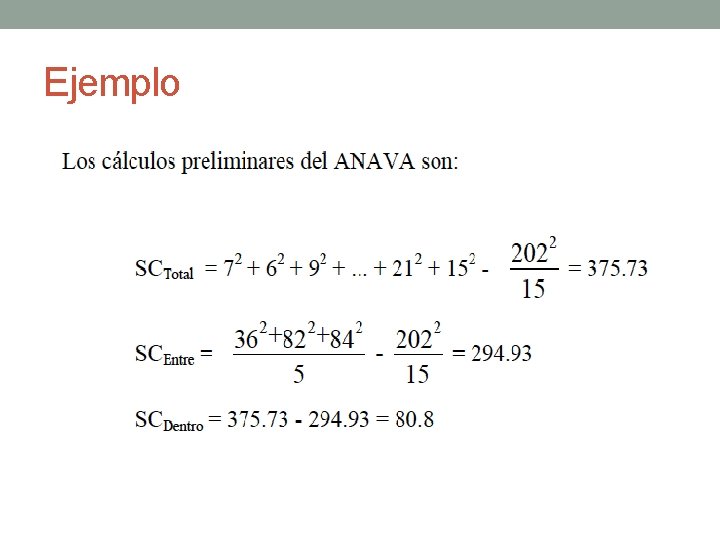

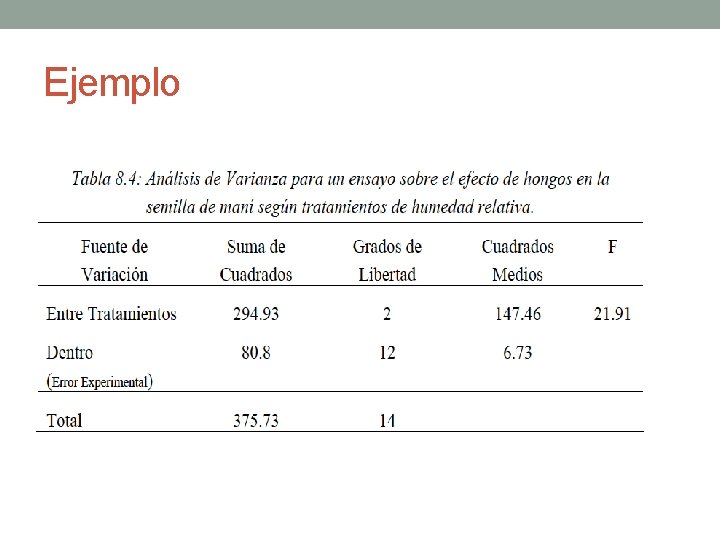

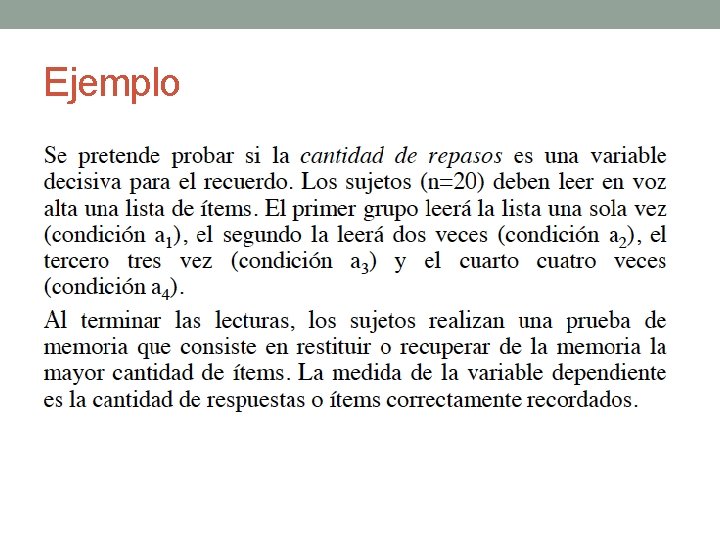

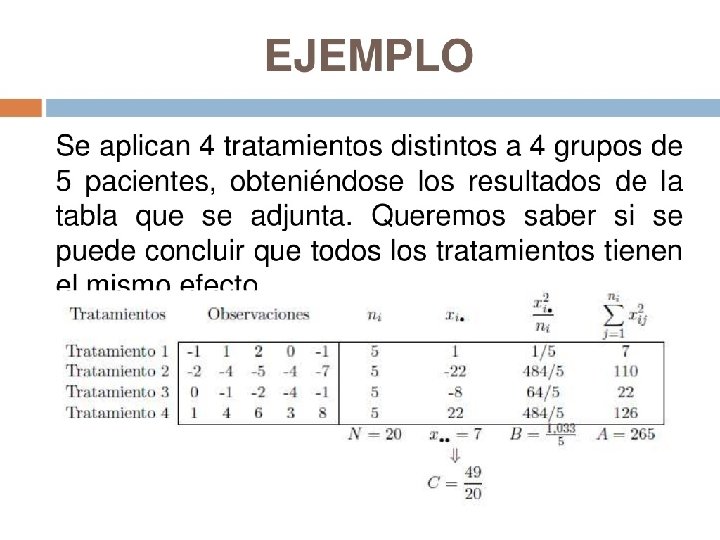

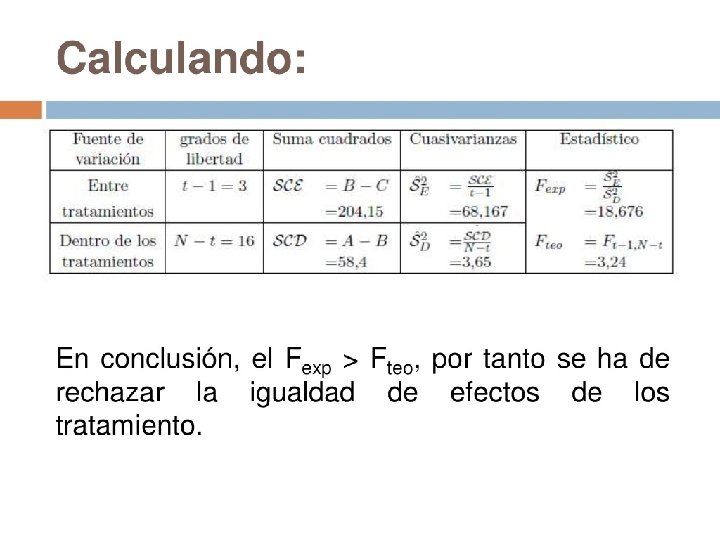

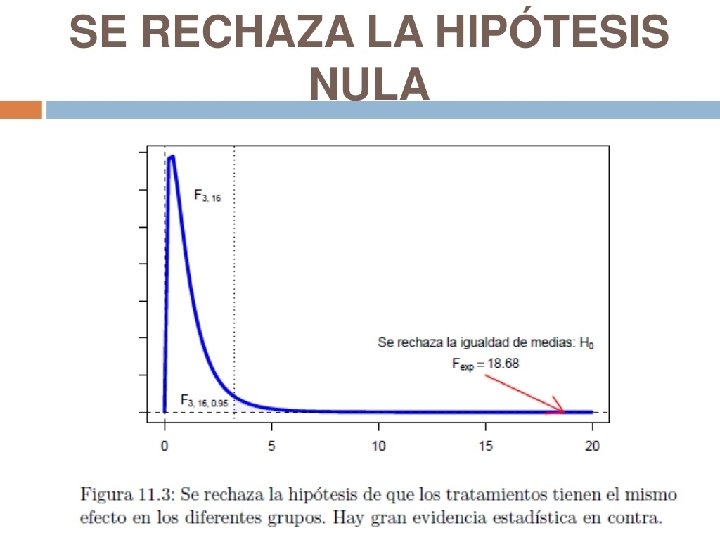

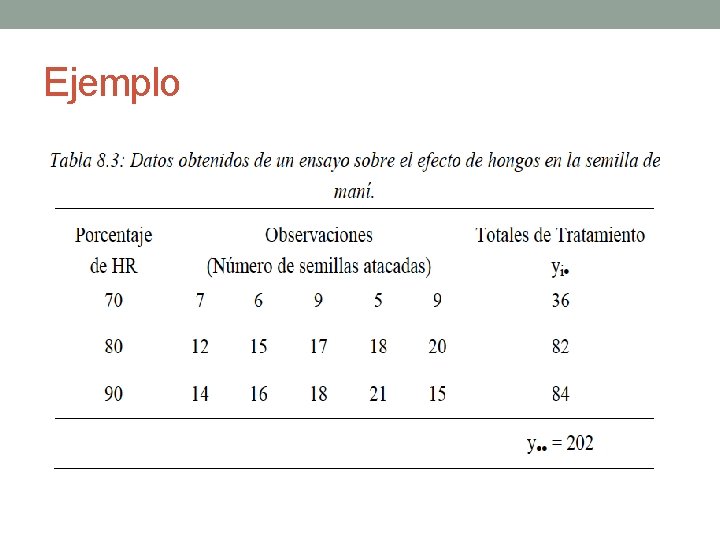

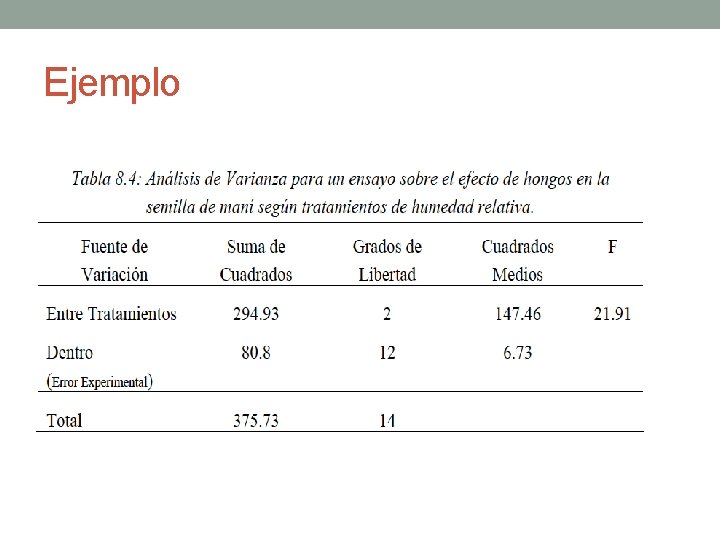

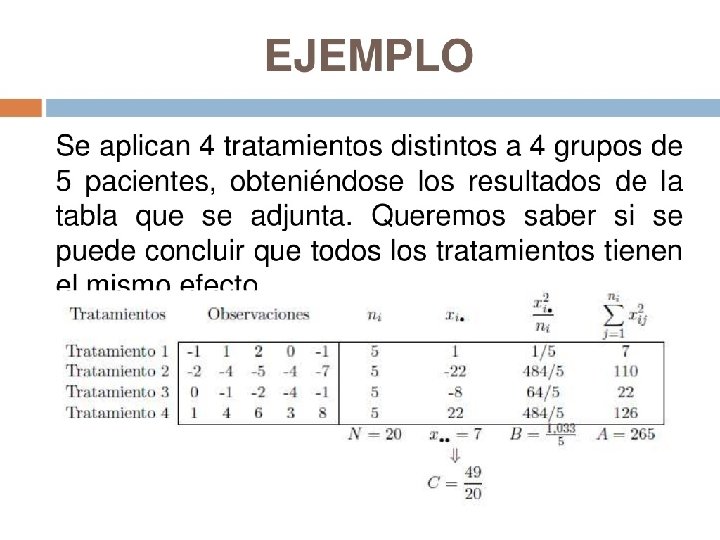

Ejemplo

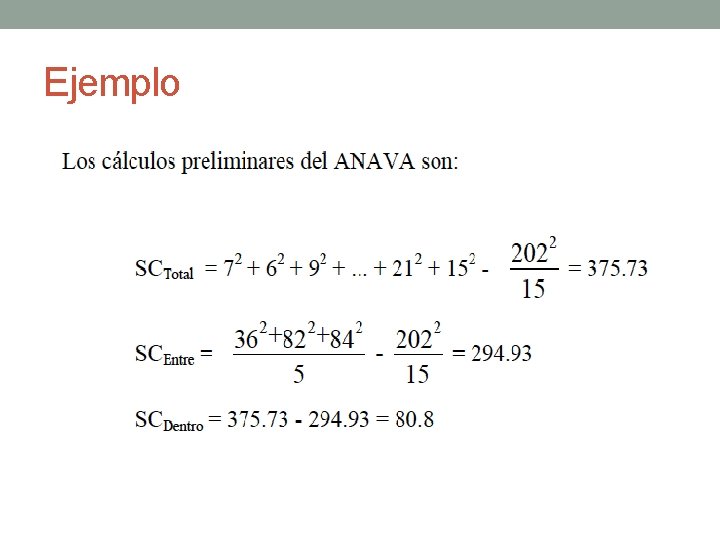

Ejemplo

Ejemplo

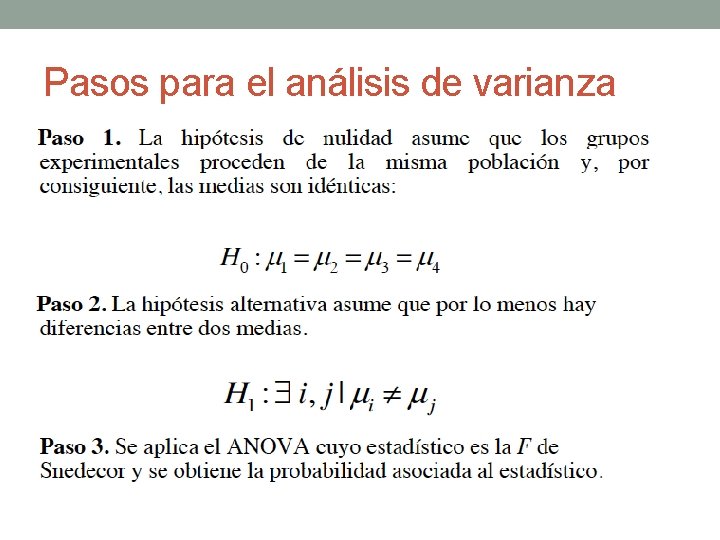

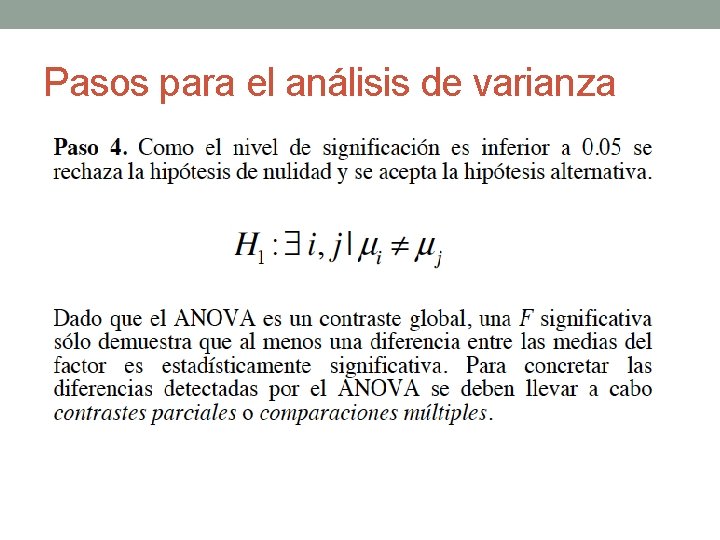

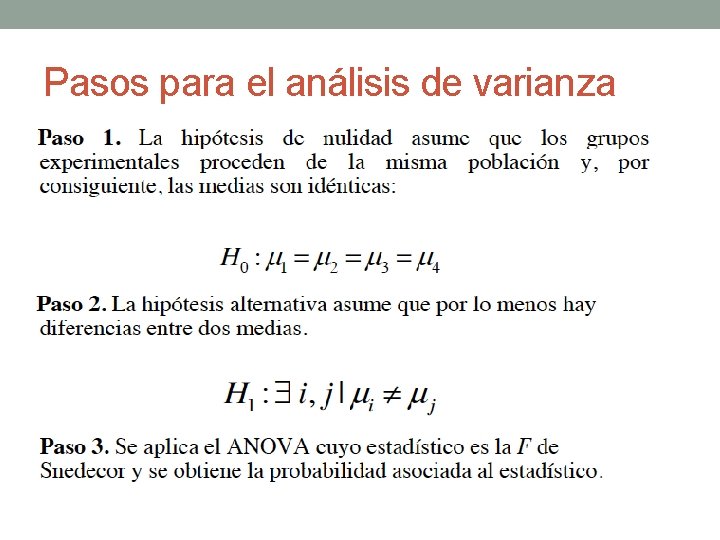

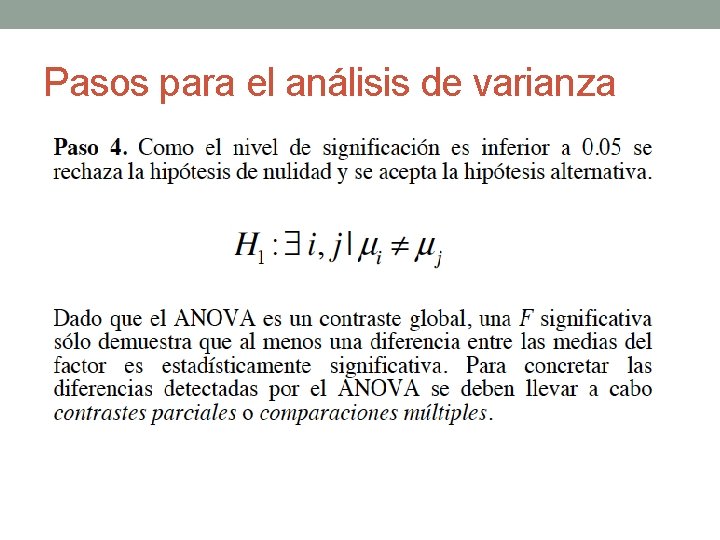

Pasos para el análisis de varianza

Pasos para el análisis de varianza

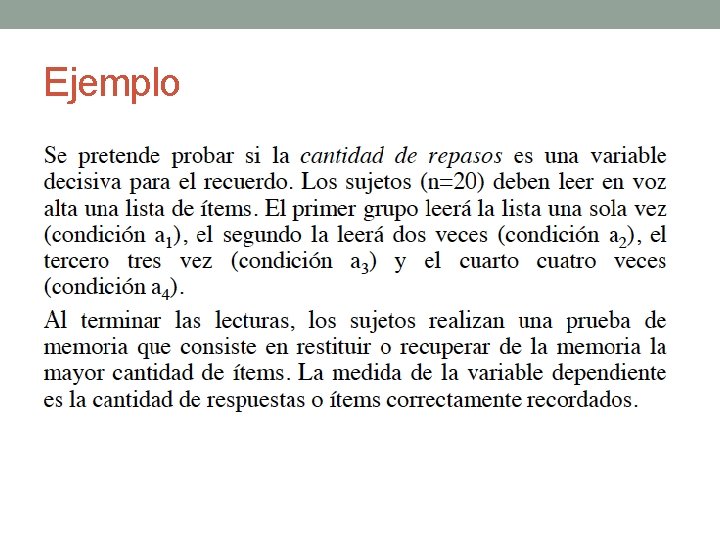

Ejemplo

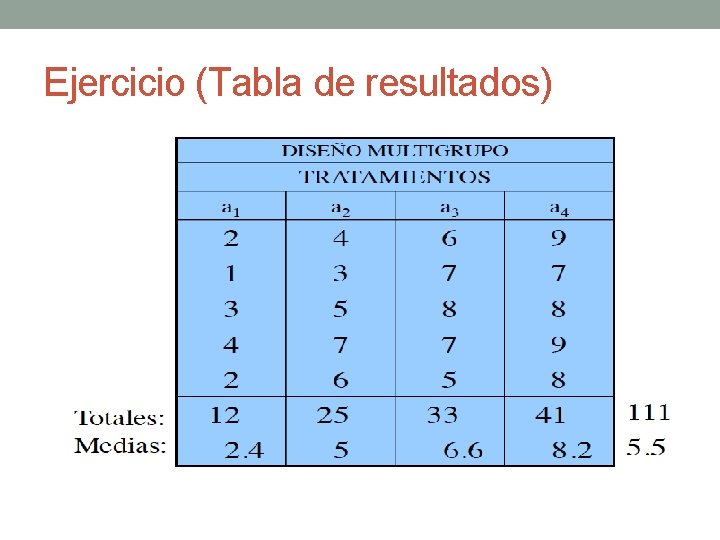

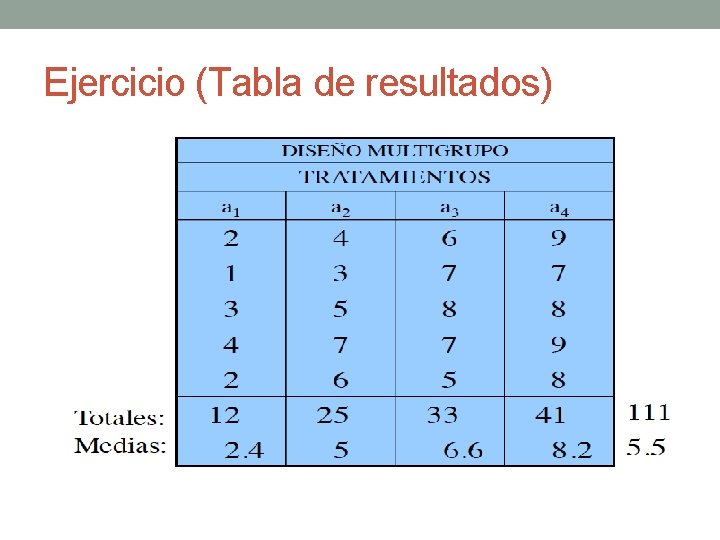

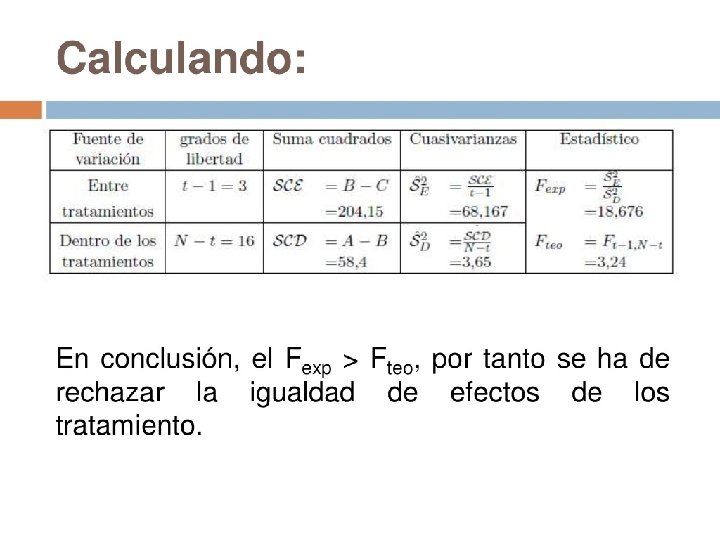

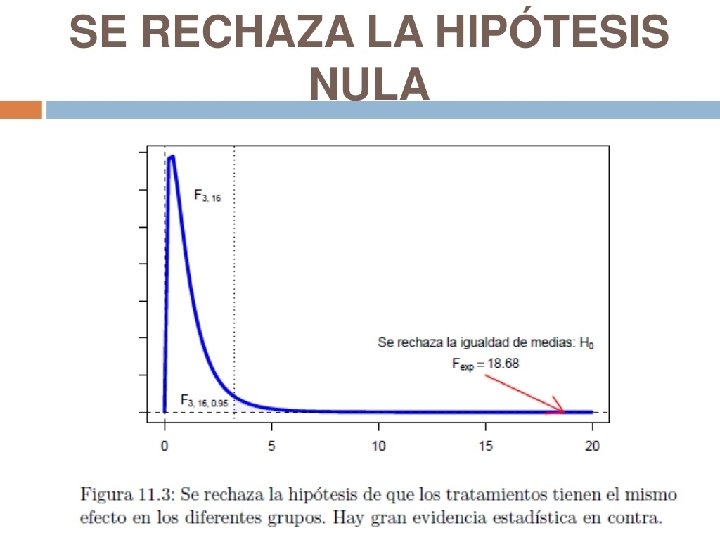

Ejercicio (Tabla de resultados)

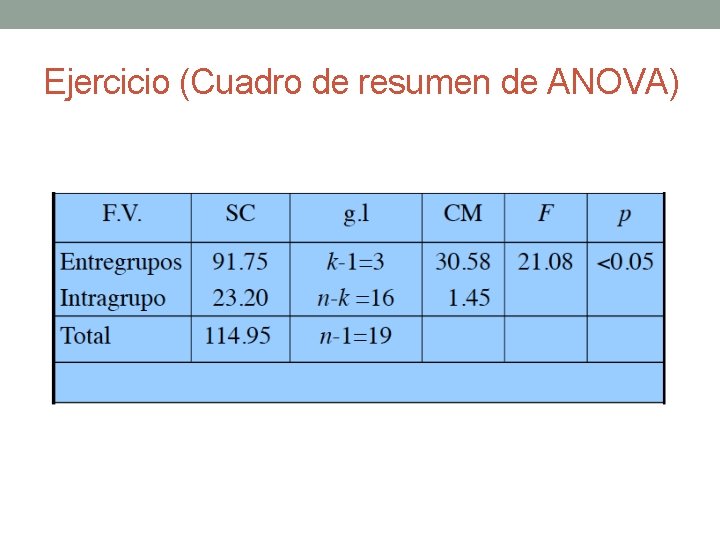

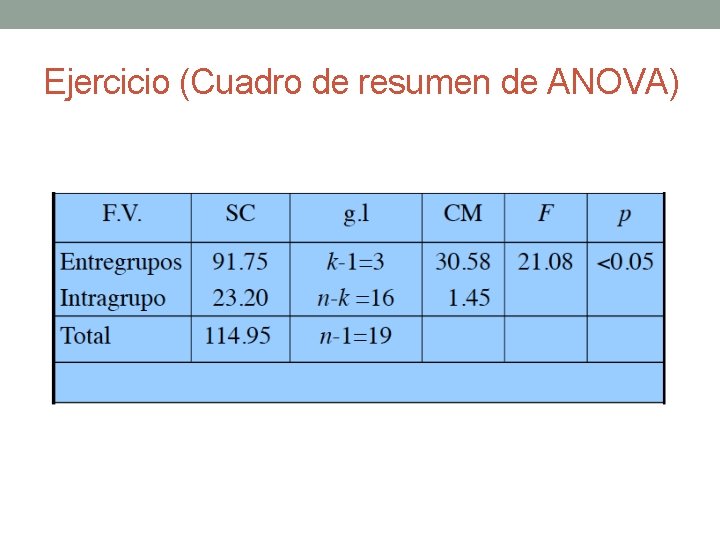

Ejercicio (Cuadro de resumen de ANOVA)

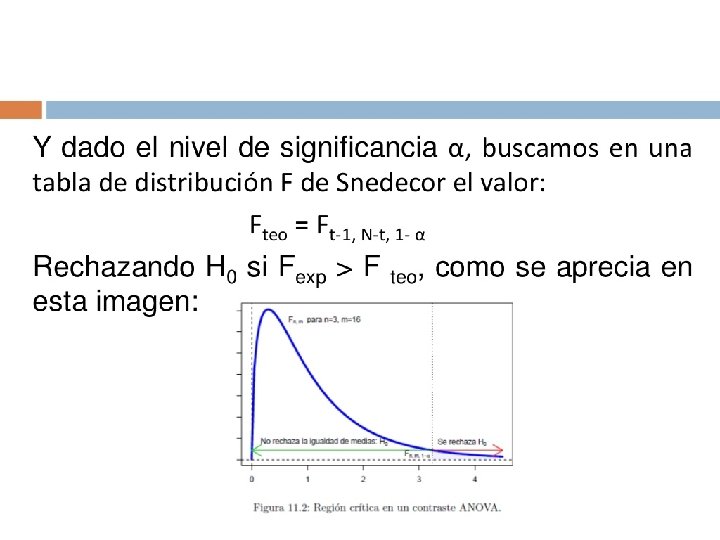

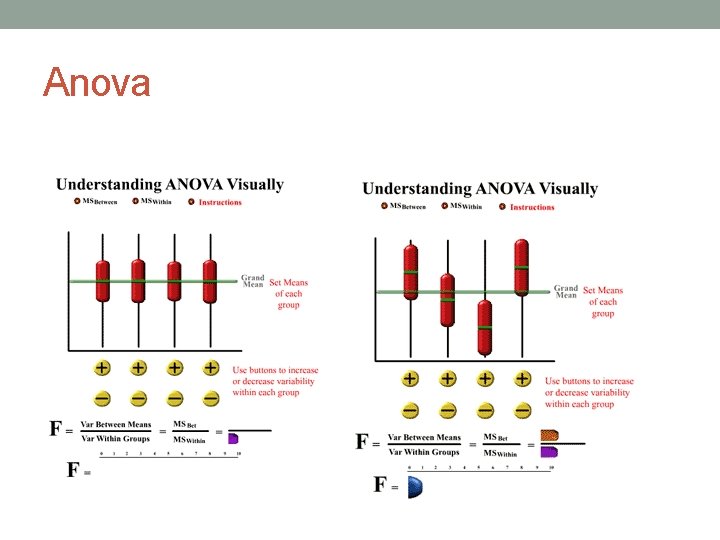

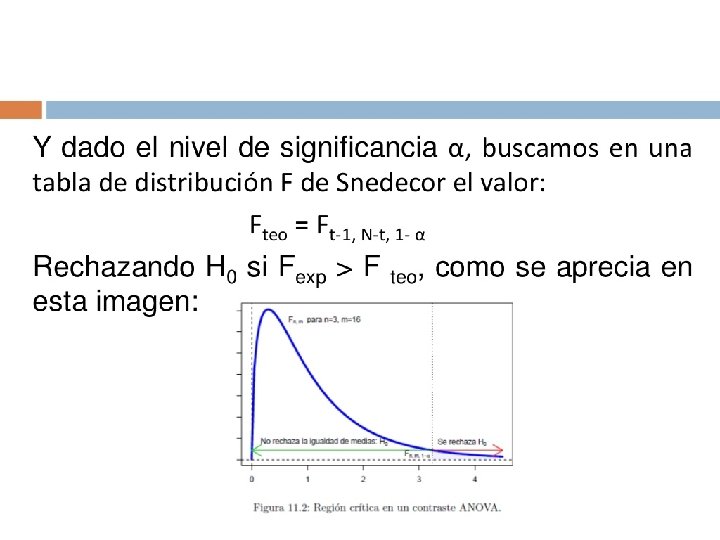

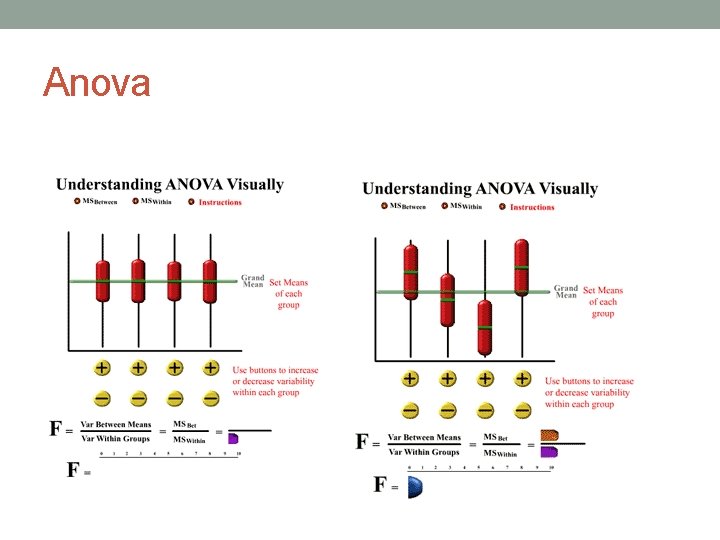

Anova

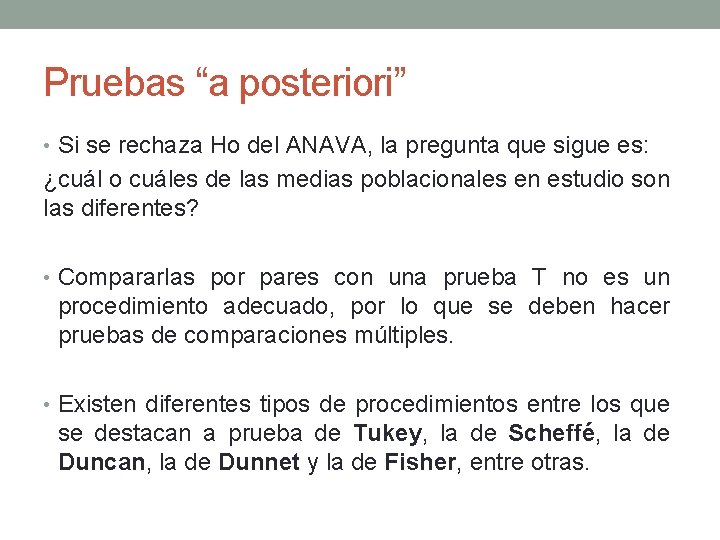

Pruebas “a posteriori” • Si se rechaza Ho del ANAVA, la pregunta que sigue es: ¿cuál o cuáles de las medias poblacionales en estudio son las diferentes? • Compararlas por pares con una prueba T no es un procedimiento adecuado, por lo que se deben hacer pruebas de comparaciones múltiples. • Existen diferentes tipos de procedimientos entre los que se destacan a prueba de Tukey, la de Scheffé, la de Duncan, la de Dunnet y la de Fisher, entre otras.

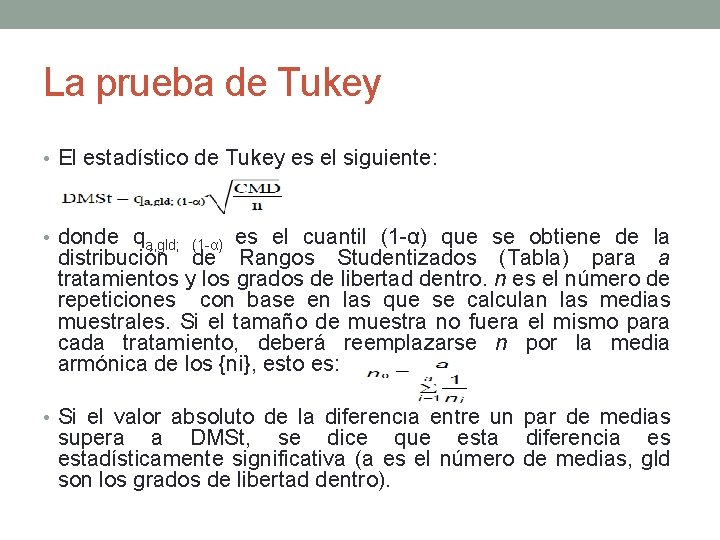

La prueba de Tukey • El estadístico de Tukey es el siguiente: • donde qa, gld; es el cuantil (1 -α) que se obtiene de la distribución de Rangos Studentizados (Tabla) para a tratamientos y los grados de libertad dentro. n es el número de repeticiones con base en las que se calculan las medias muestrales. Si el tamaño de muestra no fuera el mismo para cada tratamiento, deberá reemplazarse n por la media armónica de los {ni}, esto es: (1 -α) • Si el valor absoluto de la diferencia entre un par de medias supera a DMSt, se dice que esta diferencia es estadísticamente significativa (a es el número de medias, gld son los grados de libertad dentro).

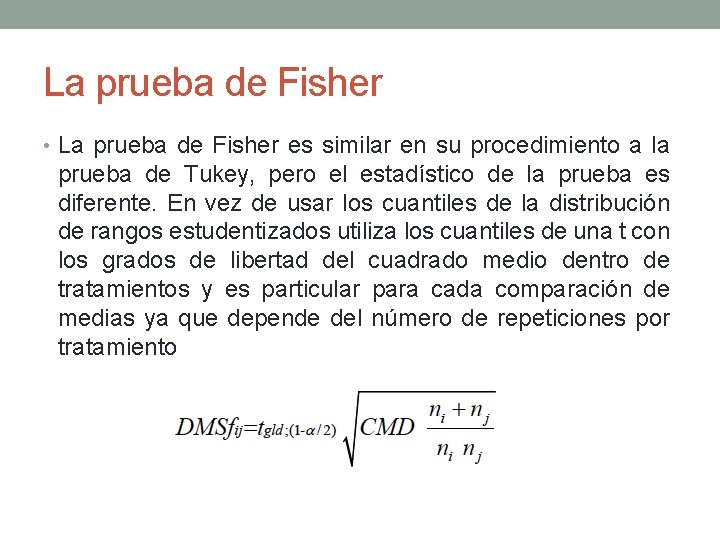

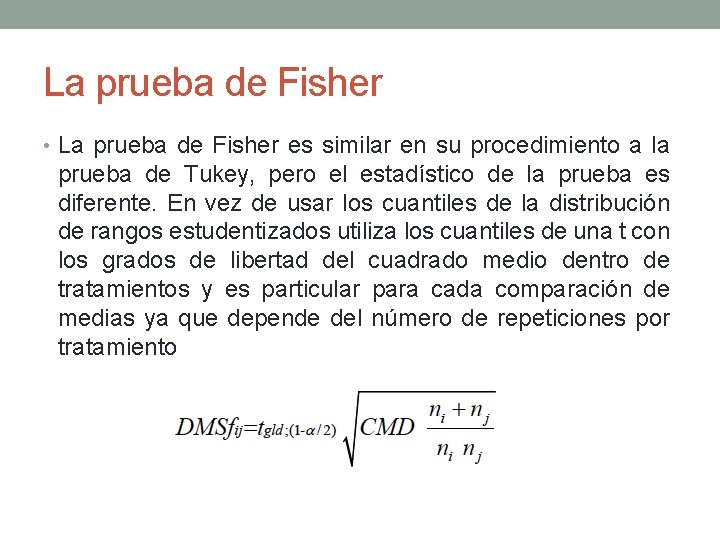

La prueba de Fisher • La prueba de Fisher es similar en su procedimiento a la prueba de Tukey, pero el estadístico de la prueba es diferente. En vez de usar los cuantiles de la distribución de rangos estudentizados utiliza los cuantiles de una t con los grados de libertad del cuadrado medio dentro de tratamientos y es particular para cada comparación de medias ya que depende del número de repeticiones por tratamiento