Jaringan Syaraf Tiruan Artificial Neural Networks ANN 3

![Algoritma Backpropagation - Inisialisasi • Set parameter learning rate (α) dalam rentang [0, 1]. Algoritma Backpropagation - Inisialisasi • Set parameter learning rate (α) dalam rentang [0, 1].](https://slidetodoc.com/presentation_image_h/1ffb3b2bd44885f210f903a8ba8f6bdb/image-20.jpg)

- Slides: 29

Jaringan Syaraf Tiruan Artificial Neural Networks (ANN) 3 SKS Dosen: Muhammad Fachrie, M. Cs. JST - Pertemuan 2 1

Outline • Pengantar Multi Layer Perceptron (MLP) • Arsitektur MLP • Algoritma Belajar Perceptron JST - Pertemuan 2 2

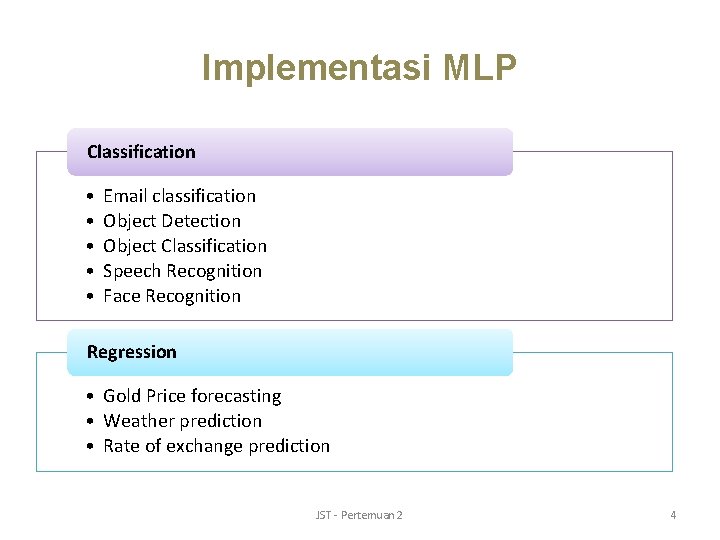

Pengantar MLP • Multi Layer Perceptron (MLP) merupakan perkembangan dari perceptron – Kemampuan klasifikasi yang jauh lebih baik (klasifikasi data yang nonlinearly separable). – Mampu digunakan untuk keperluan classification dan regression. • MLP merupakan salah satu model JST yang paling sering digunakan, karena: – Arsitekturnya simpel – Algoritma pembelajarannya tergolong mudah diimplementasikan – Cenderung memiliki akurasi yang baik JST - Pertemuan 2 3

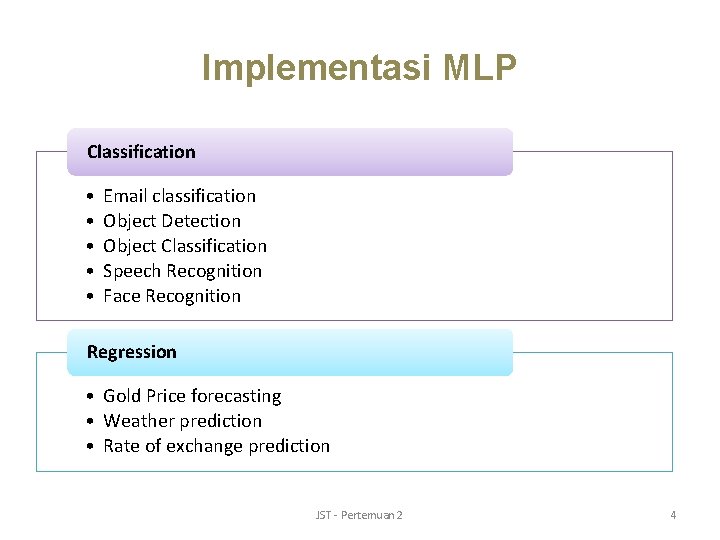

Implementasi MLP Classification • • • Email classification Object Detection Object Classification Speech Recognition Face Recognition Regression • Gold Price forecasting • Weather prediction • Rate of exchange prediction JST - Pertemuan 2 4

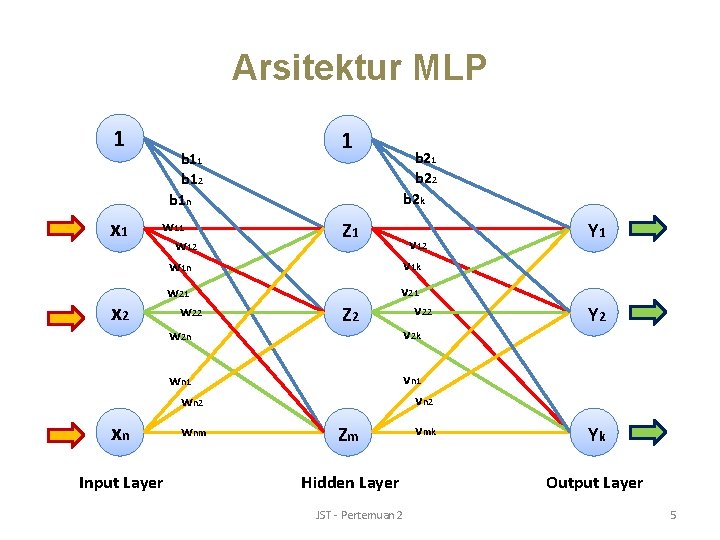

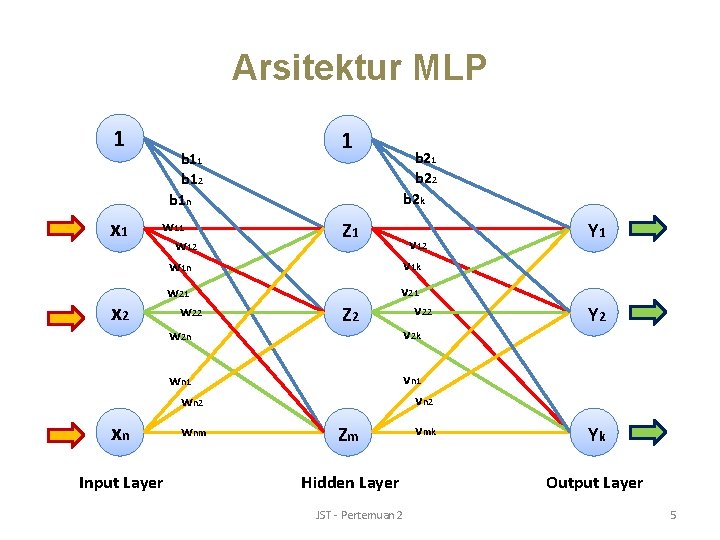

Arsitektur MLP 1 x 1 b 12 b 1 n w 11 w 12 w 1 n x 2 w 21 w 22 w 2 n 1 Z 2 Input Layer wnm v 12 v 1 k v 21 v 22 v 2 k Y 1 Y 2 vn 1 vn 2 wn 1 wn 2 xn b 21 b 22 b 2 k Zm Hidden Layer JST - Pertemuan 2 vmk Yk Output Layer 5

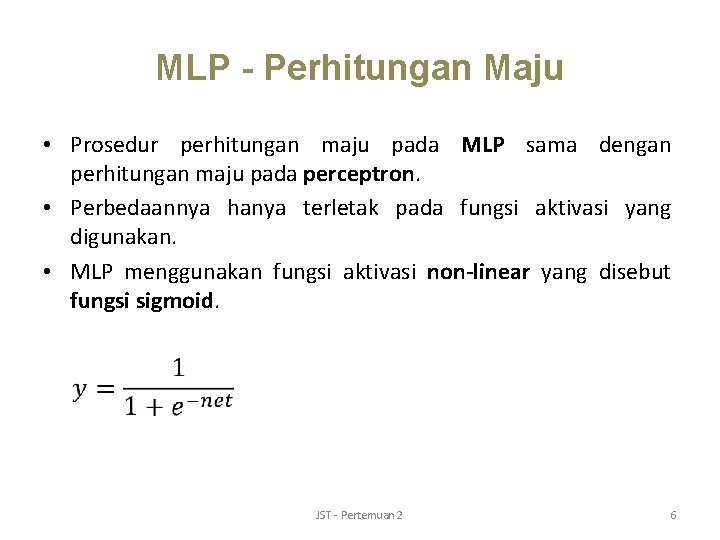

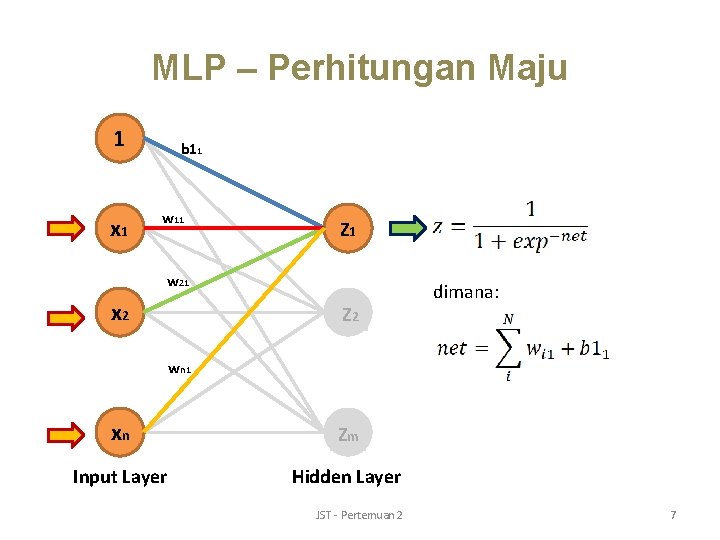

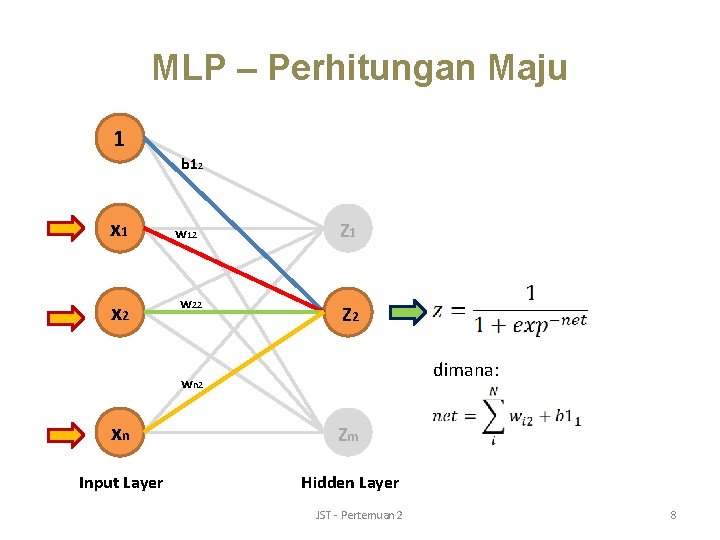

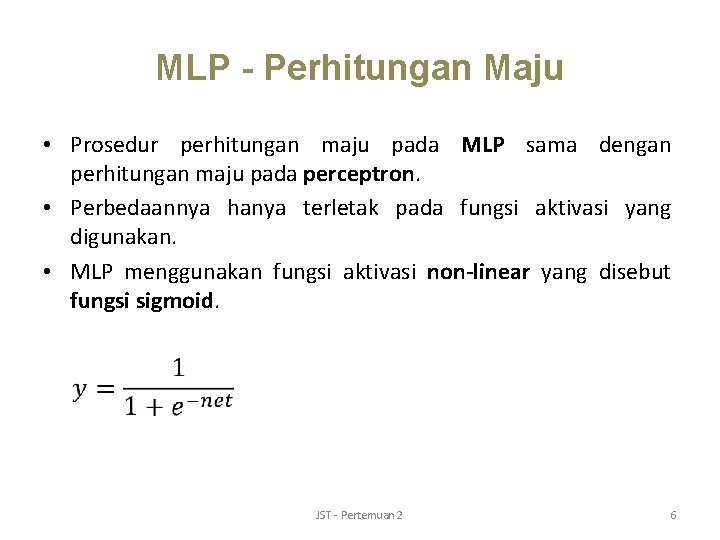

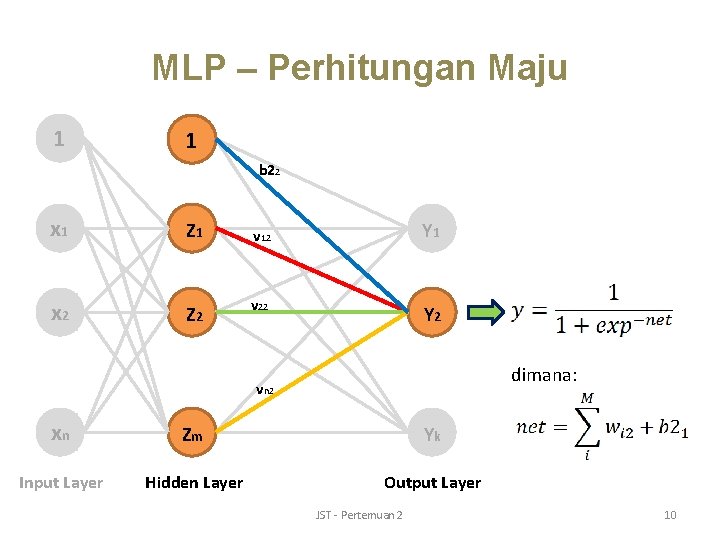

MLP - Perhitungan Maju • Prosedur perhitungan maju pada MLP sama dengan perhitungan maju pada perceptron. • Perbedaannya hanya terletak pada fungsi aktivasi yang digunakan. • MLP menggunakan fungsi aktivasi non-linear yang disebut fungsi sigmoid. JST - Pertemuan 2 6

MLP – Perhitungan Maju 1 x 1 b 11 w 11 Z 1 w 21 x 2 Z 2 dimana: wn 1 xn Zm Input Layer Hidden Layer JST - Pertemuan 2 7

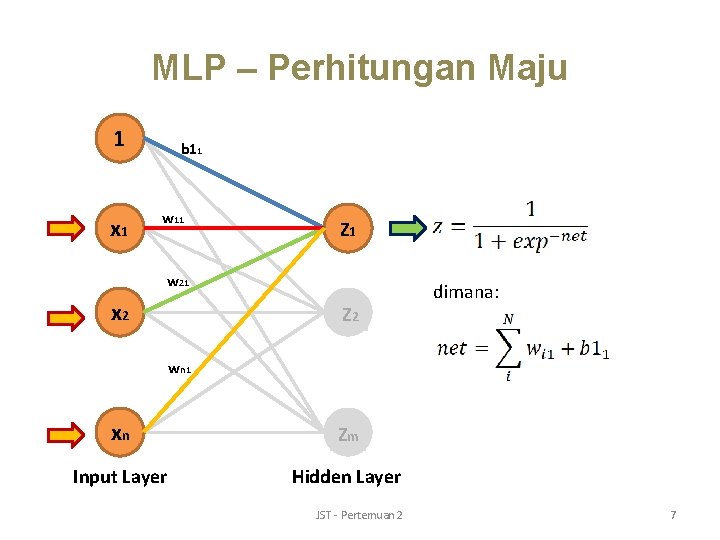

MLP – Perhitungan Maju 1 b 12 x 1 x 2 w 12 w 22 Z 1 Z 2 dimana: wn 2 xn Zm Input Layer Hidden Layer JST - Pertemuan 2 8

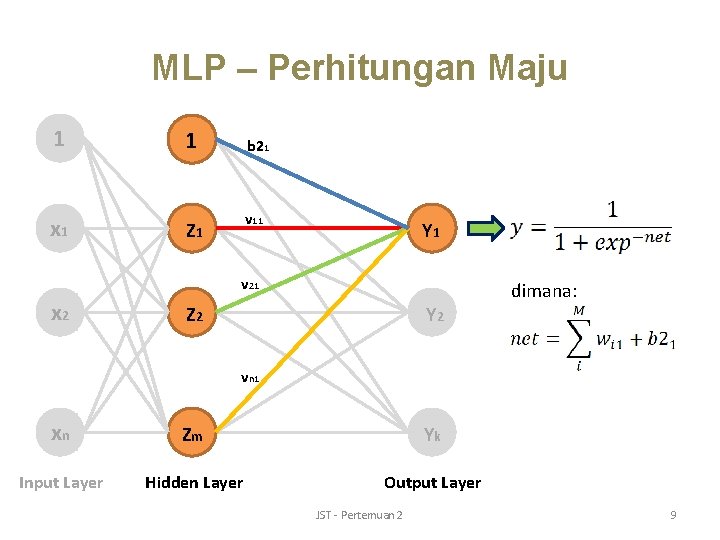

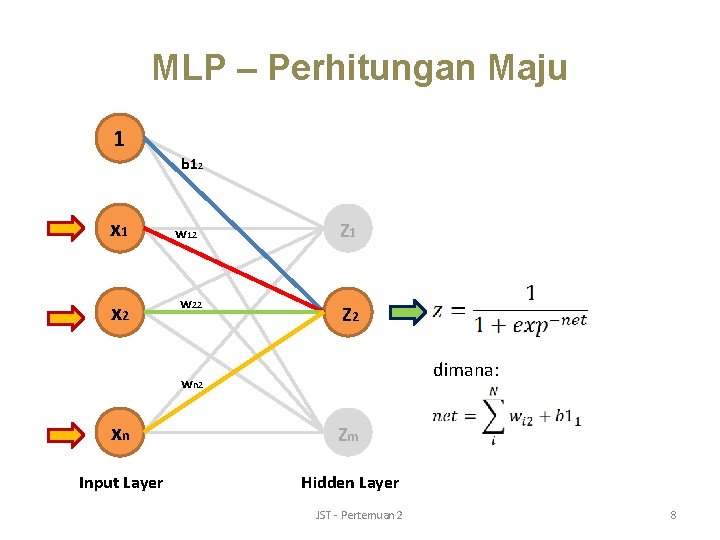

MLP – Perhitungan Maju 1 x 1 1 b 21 v 11 Z 1 Y 1 v 21 x 2 Z 2 Y 2 dimana: vn 1 xn Zm Yk Input Layer Hidden Layer Output Layer JST - Pertemuan 2 9

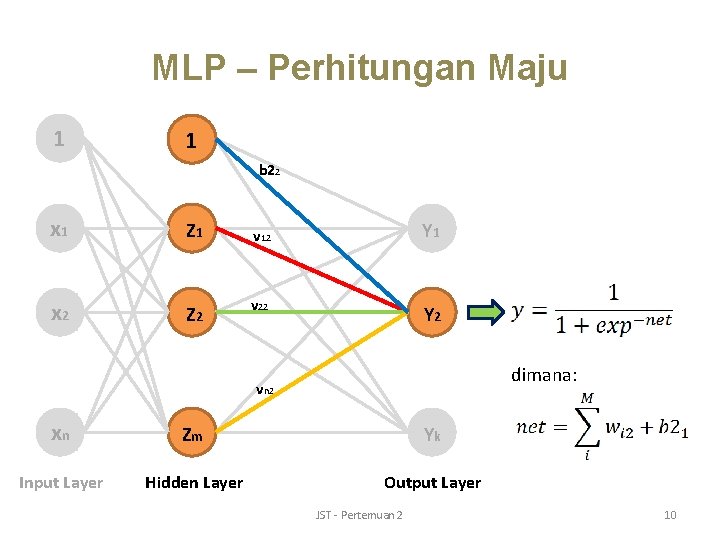

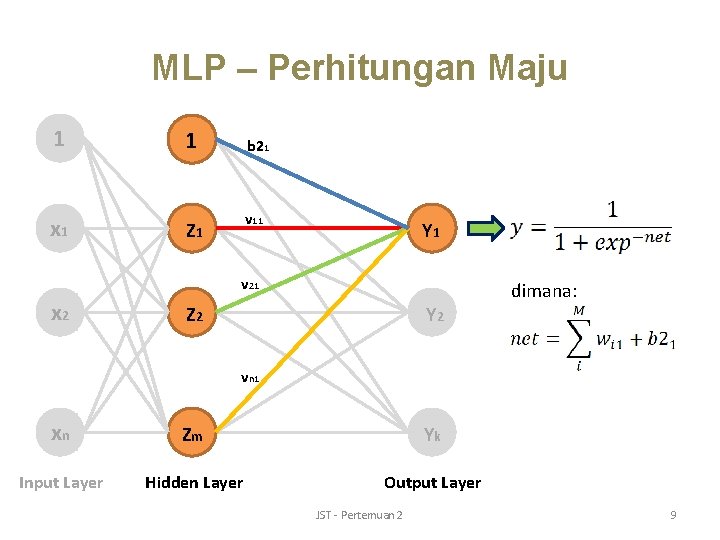

MLP – Perhitungan Maju 1 1 b 22 x 1 Z 1 v 12 Y 1 x 2 Z 2 v 22 Y 2 dimana: vn 2 xn Zm Yk Input Layer Hidden Layer Output Layer JST - Pertemuan 2 10

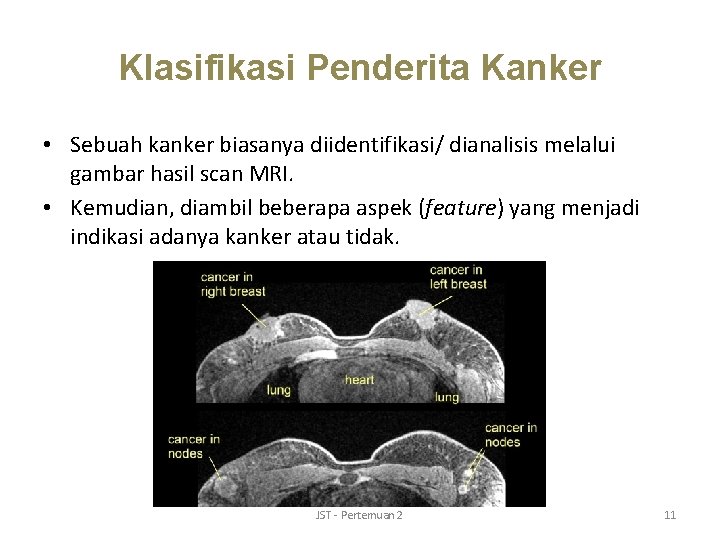

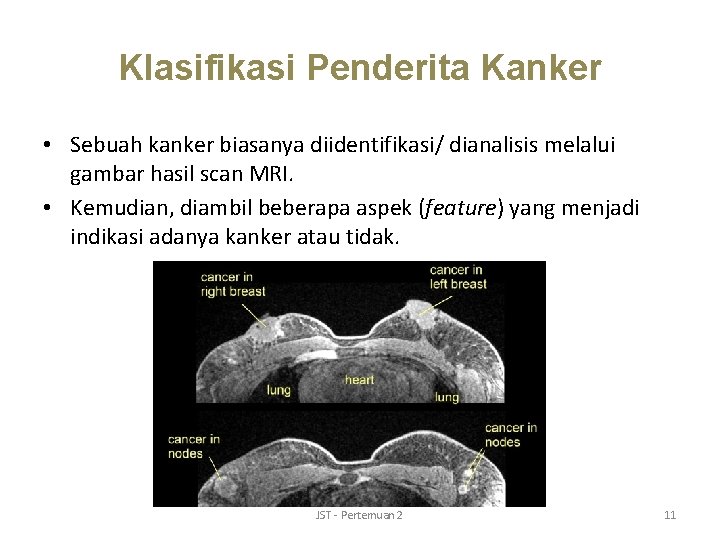

Klasifikasi Penderita Kanker • Sebuah kanker biasanya diidentifikasi/ dianalisis melalui gambar hasil scan MRI. • Kemudian, diambil beberapa aspek (feature) yang menjadi indikasi adanya kanker atau tidak. JST - Pertemuan 2 11

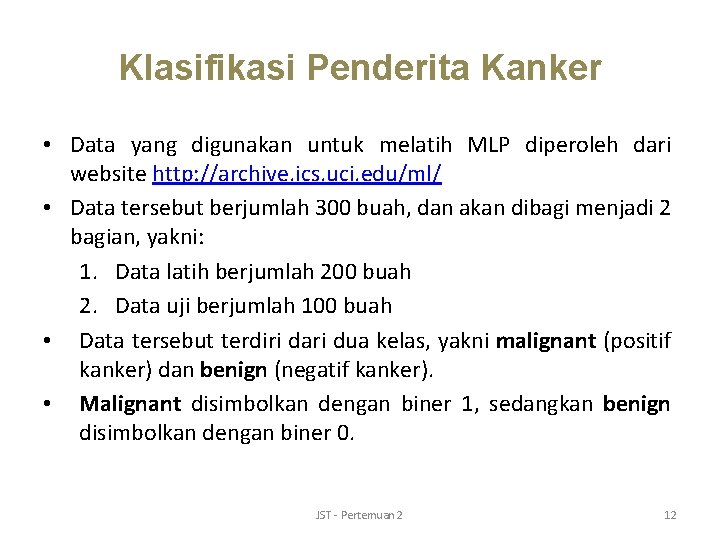

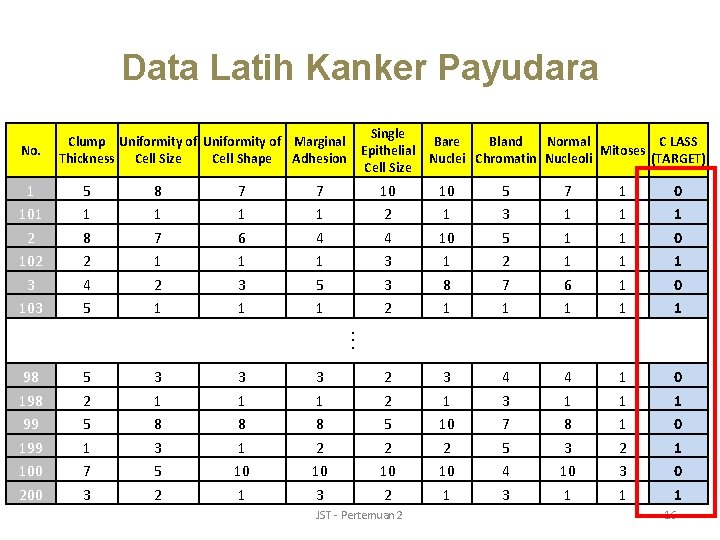

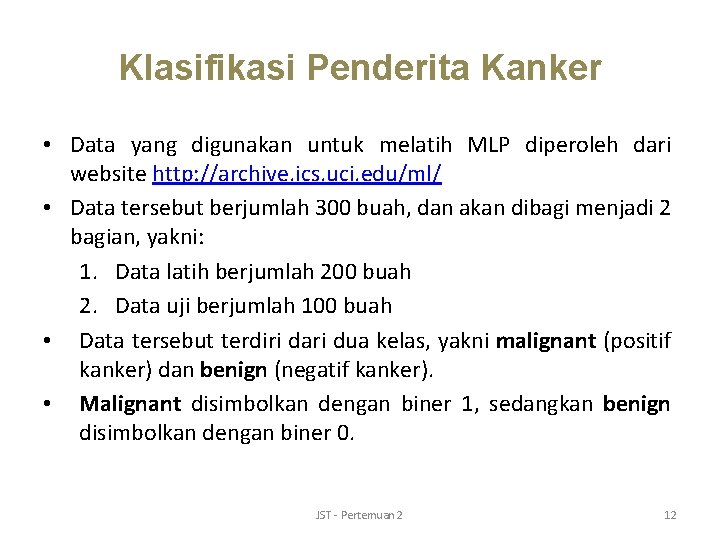

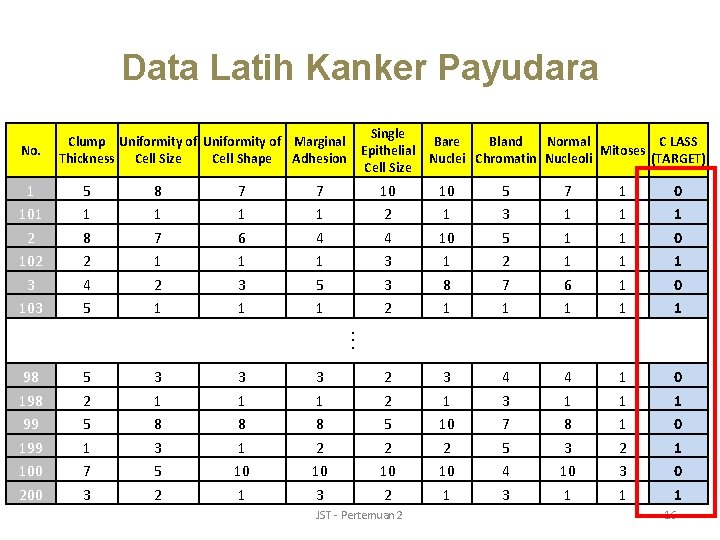

Klasifikasi Penderita Kanker • Data yang digunakan untuk melatih MLP diperoleh dari website http: //archive. ics. uci. edu/ml/ • Data tersebut berjumlah 300 buah, dan akan dibagi menjadi 2 bagian, yakni: 1. Data latih berjumlah 200 buah 2. Data uji berjumlah 100 buah • Data tersebut terdiri dari dua kelas, yakni malignant (positif kanker) dan benign (negatif kanker). • Malignant disimbolkan dengan biner 1, sedangkan benign disimbolkan dengan biner 0. JST - Pertemuan 2 12

Klasifikasi Penderita Kanker No. Single Clump Uniformity of Marginal Bare Bland Normal C LASS Mitoses Epithelial Thickness Cell Size Cell Shape Adhesion Nuclei Chromatin Nucleoli (TARGET) Cell Size 5 8 4 5 5 1 8 7 2 10 10 5 7 6 3 10 10 8 7 4 5 3 5 6 195 196 197 198 199 200 1 5 3 2 1 3 1 1 3 2 1 1 1 1 1 2 2 10 4 3 7 4 5 10 10 8 3 5 8 5 5 7 8 4 7 7 1 6 10 4 10 1 1 1 2 1 1 0 0 0 1 1 3 1 1 1 2 1 1 1 1 . . . 1 2 3 4 5 6 1 2 2 2 JST - Pertemuan 2 1 1 2 1 2 3 5 3 13

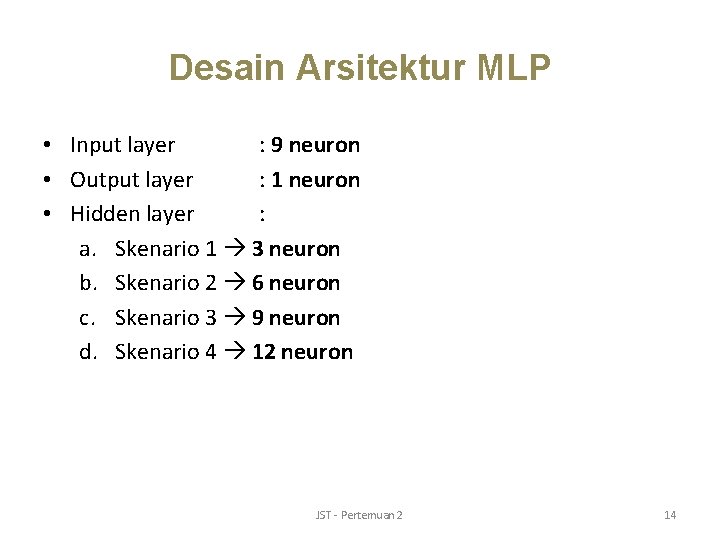

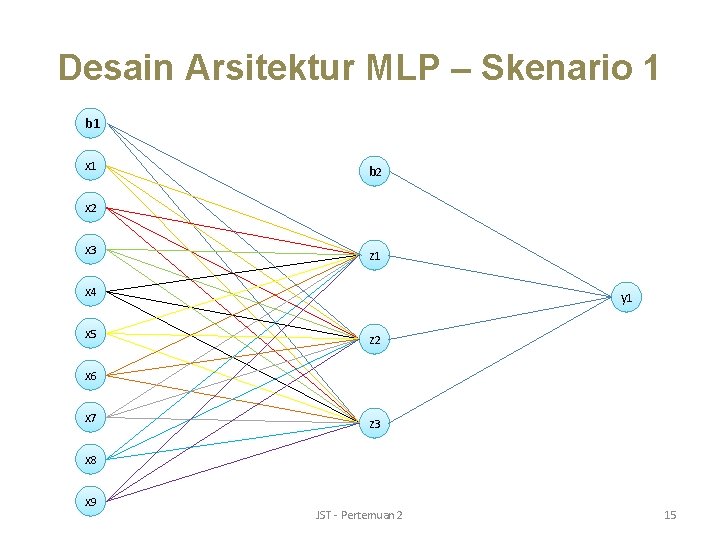

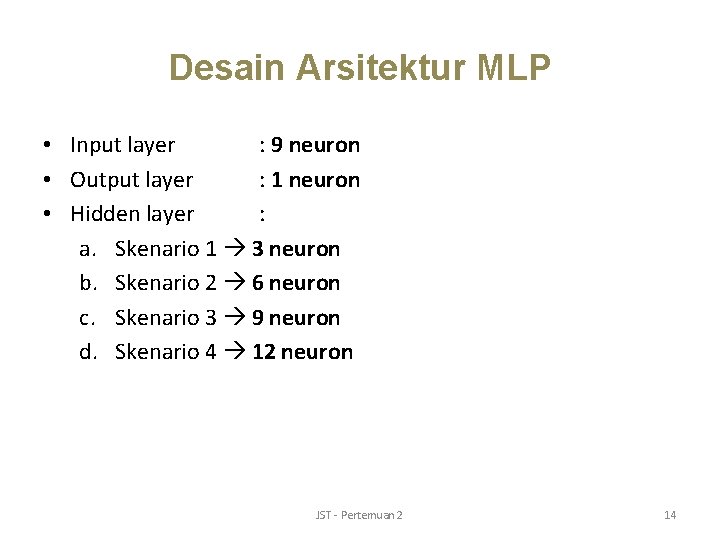

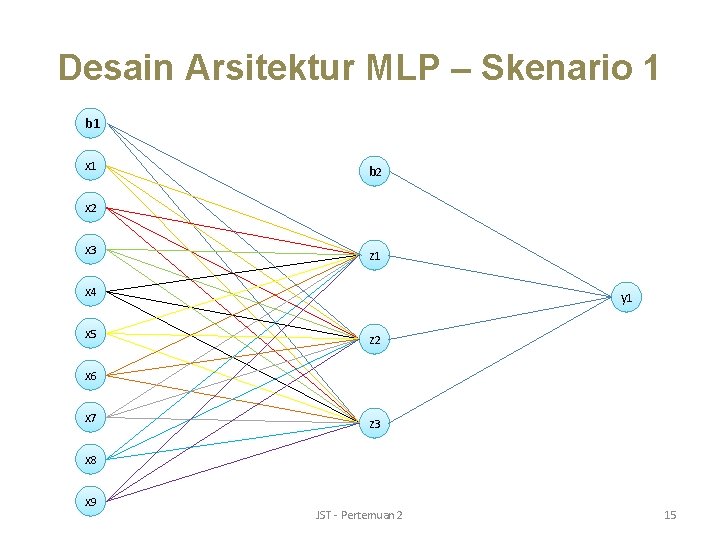

Desain Arsitektur MLP • Input layer : 9 neuron • Output layer : 1 neuron • Hidden layer : a. Skenario 1 3 neuron b. Skenario 2 6 neuron c. Skenario 3 9 neuron d. Skenario 4 12 neuron JST - Pertemuan 2 14

Desain Arsitektur MLP – Skenario 1 b 1 x 1 b 2 x 3 z 1 x 4 x 5 y 1 z 2 x 6 x 7 z 3 x 8 x 9 JST - Pertemuan 2 15

Data Latih Kanker Payudara No. Single Clump Uniformity of Marginal Bare Bland Normal C LASS Mitoses Epithelial Thickness Cell Size Cell Shape Adhesion Nuclei Chromatin Nucleoli (TARGET) Cell Size 5 1 8 2 4 5 8 1 7 1 2 1 7 1 6 1 3 1 7 1 4 1 5 1 98 198 99 100 200 5 2 5 1 7 3 3 1 8 3 5 2 3 1 8 1 10 1 3 1 8 2 10 3 10 2 4 3 3 2 10 1 8 1 5 3 5 2 7 1 1 1 6 1 1 1 1 0 1 0 1 2 2 5 2 10 2 3 1 10 2 10 1 4 3 7 5 4 3 4 1 8 3 10 1 1 2 3 1 0 1 0 1 . . . 1 101 2 102 3 103 JST - Pertemuan 2 16

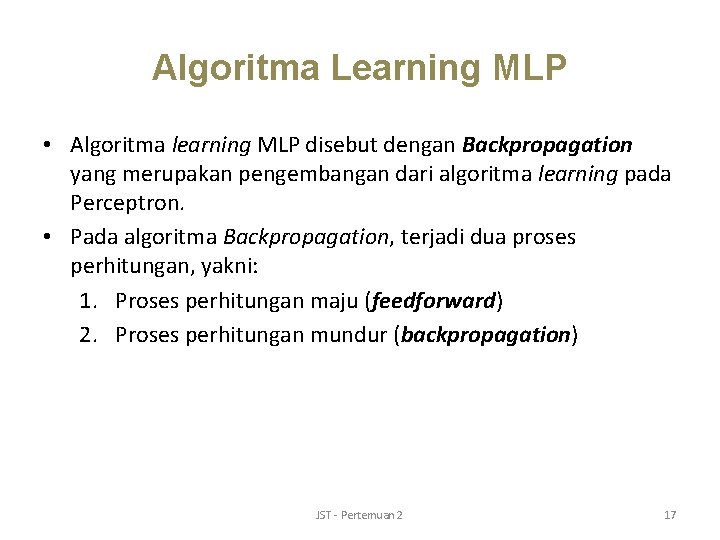

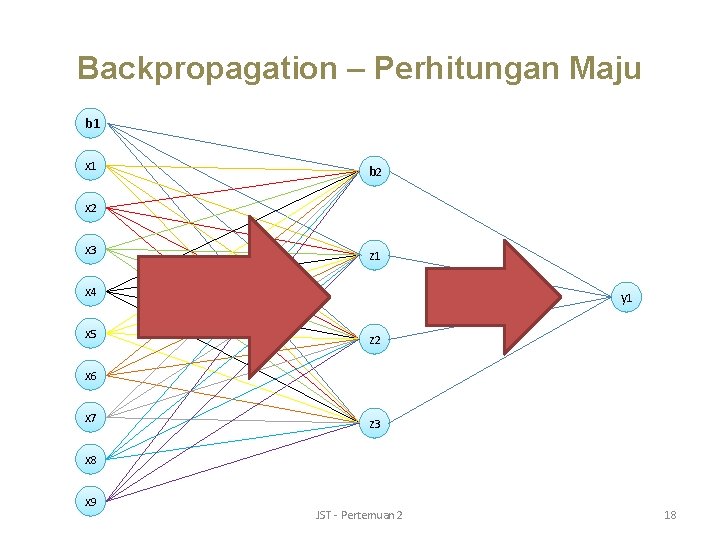

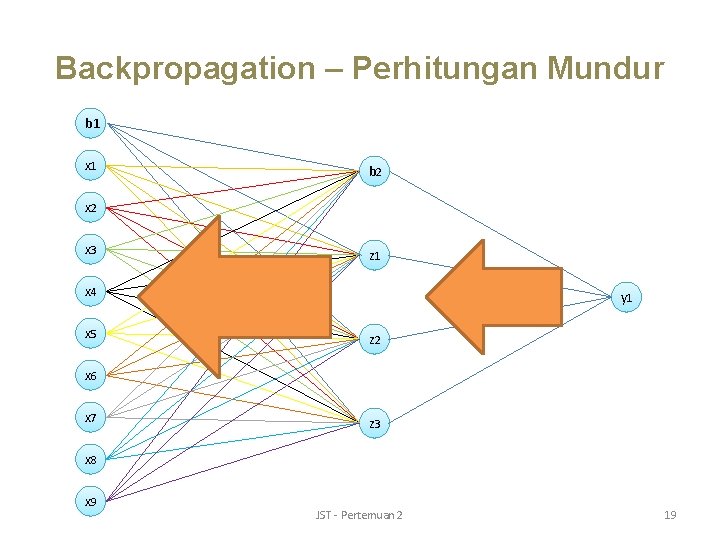

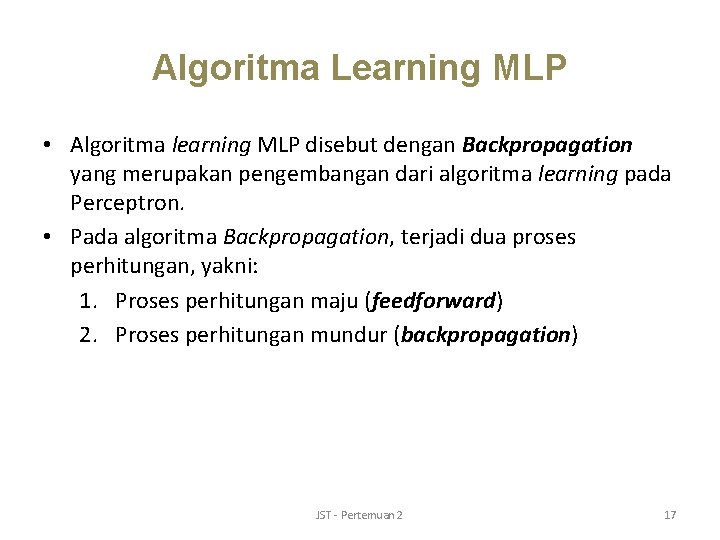

Algoritma Learning MLP • Algoritma learning MLP disebut dengan Backpropagation yang merupakan pengembangan dari algoritma learning pada Perceptron. • Pada algoritma Backpropagation, terjadi dua proses perhitungan, yakni: 1. Proses perhitungan maju (feedforward) 2. Proses perhitungan mundur (backpropagation) JST - Pertemuan 2 17

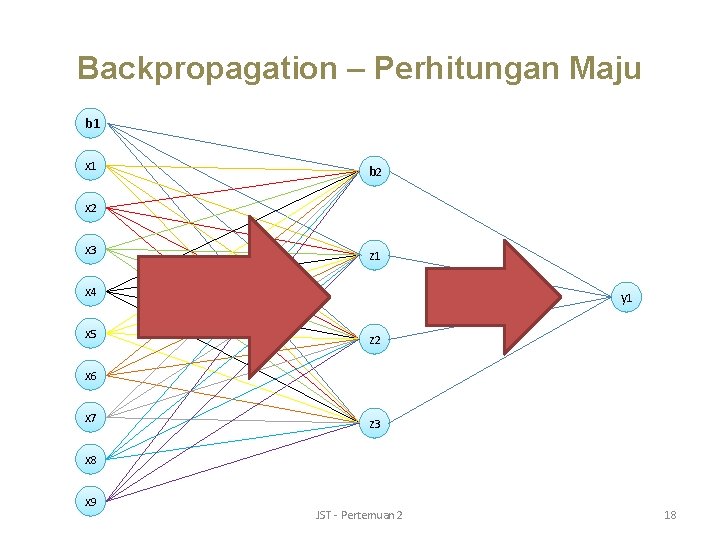

Backpropagation – Perhitungan Maju b 1 x 1 b 2 x 3 z 1 x 4 x 5 y 1 z 2 x 6 x 7 z 3 x 8 x 9 JST - Pertemuan 2 18

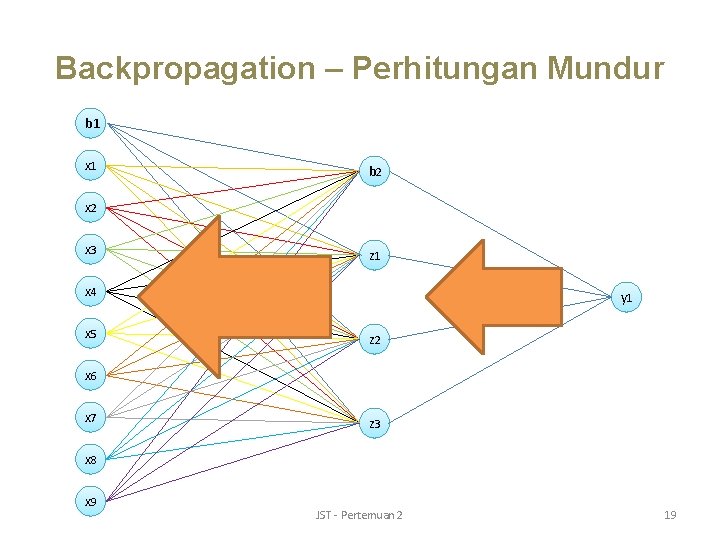

Backpropagation – Perhitungan Mundur b 1 x 1 b 2 x 3 z 1 x 4 x 5 y 1 z 2 x 6 x 7 z 3 x 8 x 9 JST - Pertemuan 2 19

![Algoritma Backpropagation Inisialisasi Set parameter learning rate α dalam rentang 0 1 Algoritma Backpropagation - Inisialisasi • Set parameter learning rate (α) dalam rentang [0, 1].](https://slidetodoc.com/presentation_image_h/1ffb3b2bd44885f210f903a8ba8f6bdb/image-20.jpg)

Algoritma Backpropagation - Inisialisasi • Set parameter learning rate (α) dalam rentang [0, 1]. • Set jumlah maksimal iterasi (epoch). • Set nilai awal bobot jaringan. Nilai awal bobot diset secara random dalam rentang [-1, 1]*. -------------------------- • Satu epoch/ iterasi diperoleh ketika semua data latih sudah diinputkan/ diproses ke dalam jaringan. JST - Pertemuan 2 20

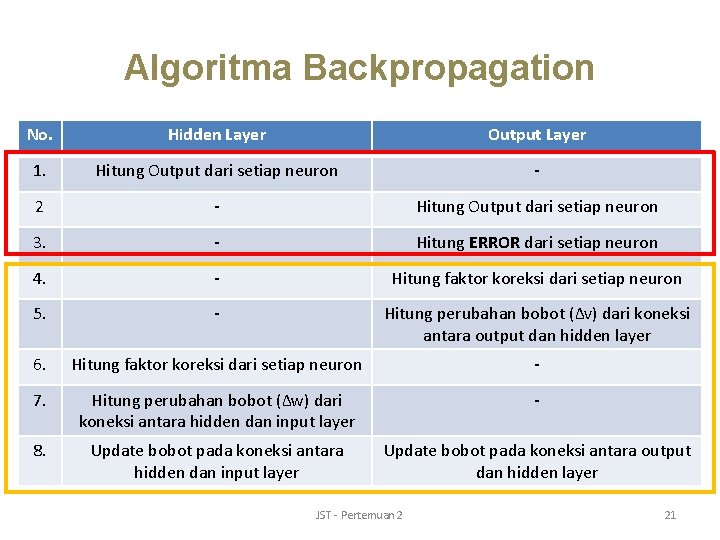

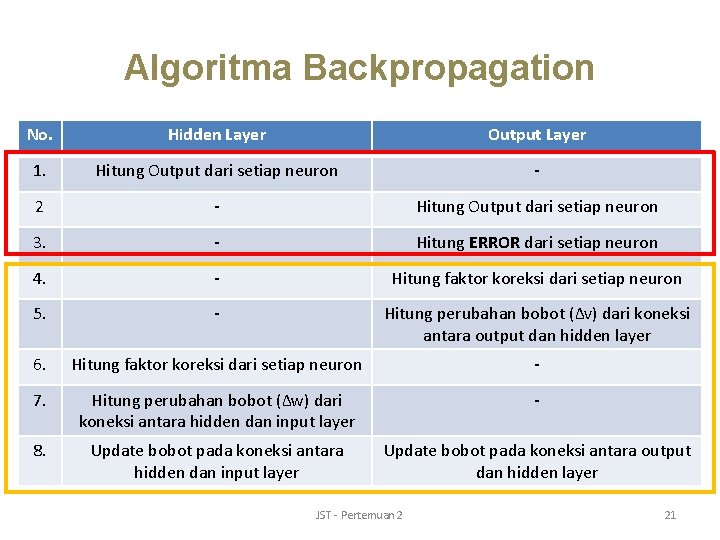

Algoritma Backpropagation No. Hidden Layer Output Layer 1. Hitung Output dari setiap neuron - 2 - Hitung Output dari setiap neuron 3. - Hitung ERROR dari setiap neuron 4. - Hitung faktor koreksi dari setiap neuron 5. - Hitung perubahan bobot (∆v) dari koneksi antara output dan hidden layer 6. Hitung faktor koreksi dari setiap neuron - 7. Hitung perubahan bobot (∆w) dari koneksi antara hidden dan input layer - 8. Update bobot pada koneksi antara hidden dan input layer Update bobot pada koneksi antara output dan hidden layer JST - Pertemuan 2 21

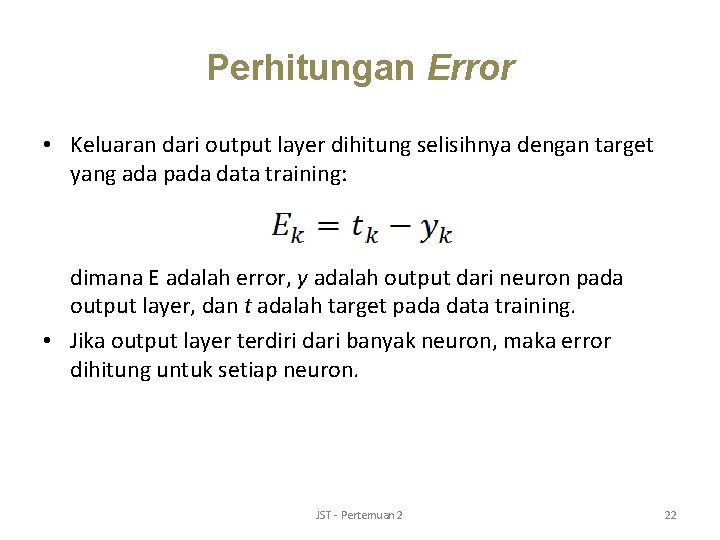

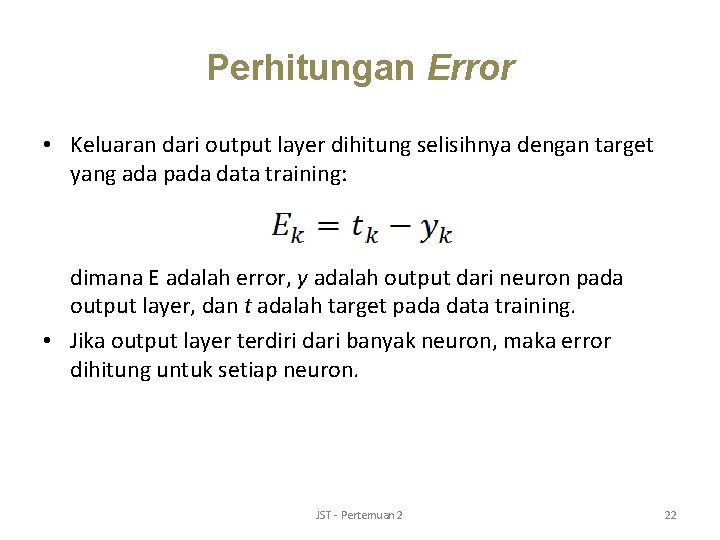

Perhitungan Error • Keluaran dari output layer dihitung selisihnya dengan target yang ada pada data training: dimana E adalah error, y adalah output dari neuron pada output layer, dan t adalah target pada data training. • Jika output layer terdiri dari banyak neuron, maka error dihitung untuk setiap neuron. JST - Pertemuan 2 22

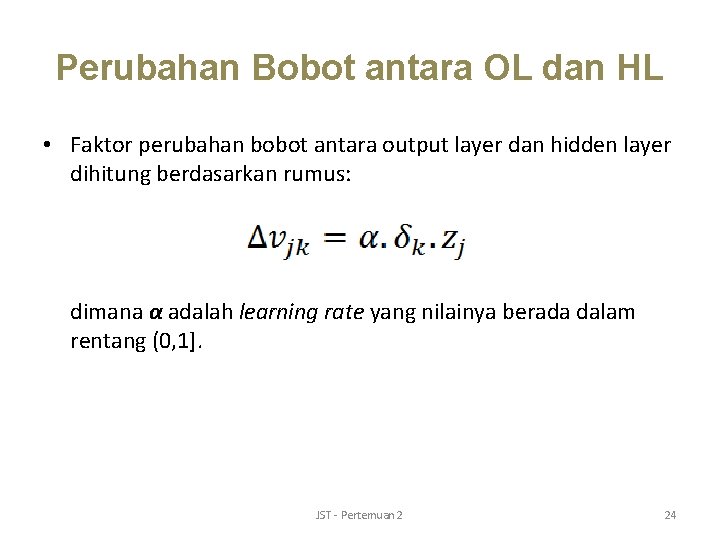

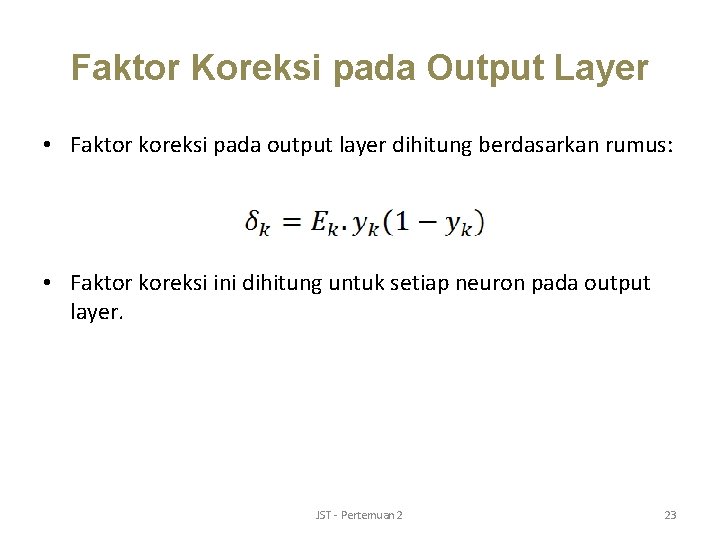

Faktor Koreksi pada Output Layer • Faktor koreksi pada output layer dihitung berdasarkan rumus: • Faktor koreksi ini dihitung untuk setiap neuron pada output layer. JST - Pertemuan 2 23

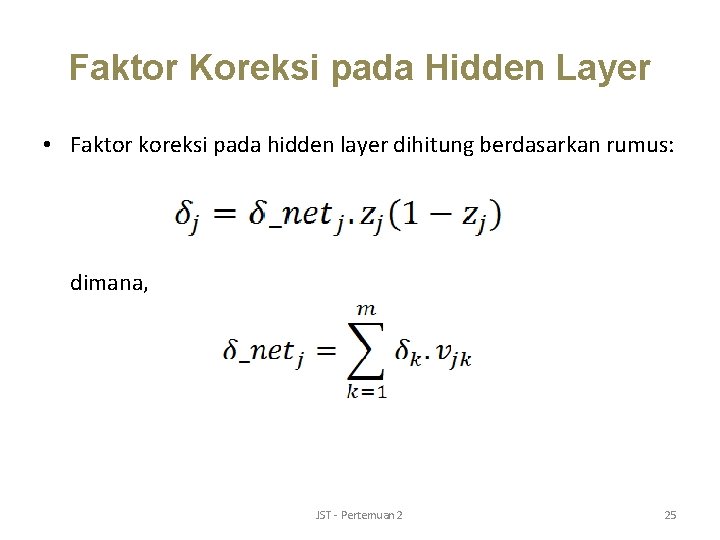

Perubahan Bobot antara OL dan HL • Faktor perubahan bobot antara output layer dan hidden layer dihitung berdasarkan rumus: dimana α adalah learning rate yang nilainya berada dalam rentang (0, 1]. JST - Pertemuan 2 24

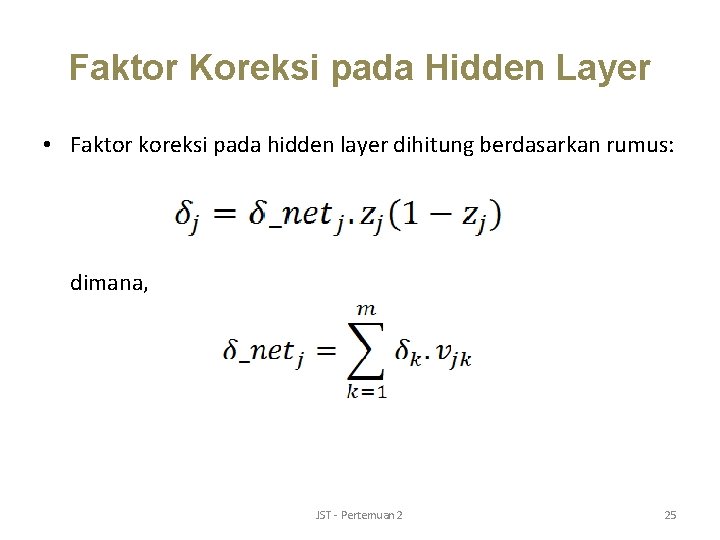

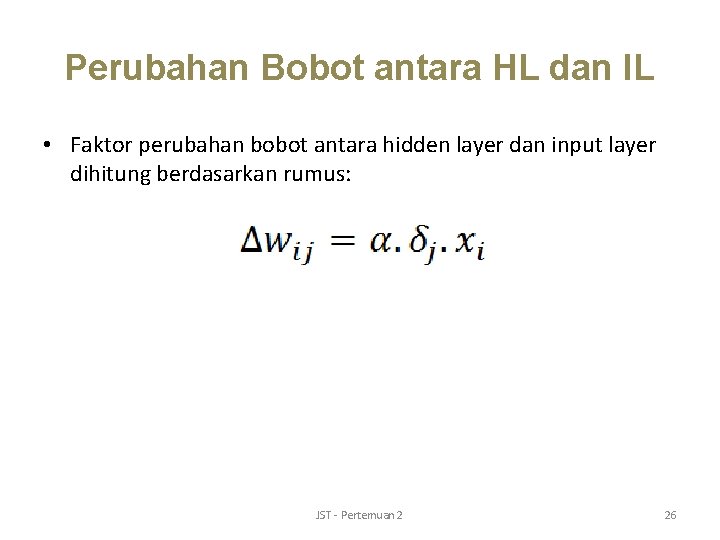

Faktor Koreksi pada Hidden Layer • Faktor koreksi pada hidden layer dihitung berdasarkan rumus: dimana, JST - Pertemuan 2 25

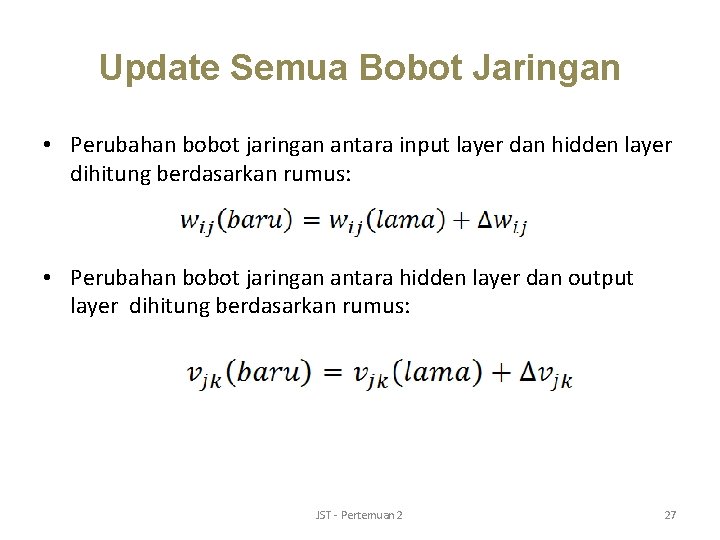

Perubahan Bobot antara HL dan IL • Faktor perubahan bobot antara hidden layer dan input layer dihitung berdasarkan rumus: JST - Pertemuan 2 26

Update Semua Bobot Jaringan • Perubahan bobot jaringan antara input layer dan hidden layer dihitung berdasarkan rumus: • Perubahan bobot jaringan antara hidden layer dan output layer dihitung berdasarkan rumus: JST - Pertemuan 2 27

Proses Learning • Alur proses learning tadi dilakukan untuk setiap satu record/ satu baris data training. • Setiap selesai semua record digunakan untuk learning, berarti selesai proses learning untuk 1 iterasi/ epoch. AI - Pertemuan 8 28

Proses Pengujian JST • Setelah JST melalui proses learning, maka dilakukan pengujian terhadap performa JST untuk mengklasifikasikan data testing. • Proses testing hanya melibatkan proses perhitungan maju (feed forward), dan pada output layer dilakukan pembulatan nilai keluaran menjadi 0 atau 1. AI - Pertemuan 8 29