VETAKE NEURONSKE MREE 1 predavanje dr Zoran evarac

- Slides: 25

VEŠTAČKE NEURONSKE MREŽE 1. predavanje dr Zoran Ševarac sevarac@gmail. com FON, 2020.

KRATAK PREGLED • Naučite neuronske mreže kroz programiranje u Java-i • Upoznavanje sa osnovnim pojmovima, komponentama, arhitekturama i algoritmima za učenje neuronskih mreža • Napredne tehnike programiranja u Javi i projektovanja softvera • Primena NM • Upoznavanje i ovladavanje edukativnim Java softverom Neuroph • Mogućnost učestvovanja u razvoju Neuroph-a kroz završni rad

PLAN PREDAVANJA I VEŽBI Predavanja 1. Osnovni pojmovi, vrste i elementi neuronskih mreža Višeslojni perceptron i Backpropagation algoritam 2. Neuroph softver i procedura rešavanja problema pomoću neuronskih mreža Detaljnije o Backpropagation algoritmu Vežbe 1. Rad sa softverom za neuronske mreže Neuroph 2. Upoznavanje sa implementacijom Neuroph softvera i mogućnostima za proširenje.

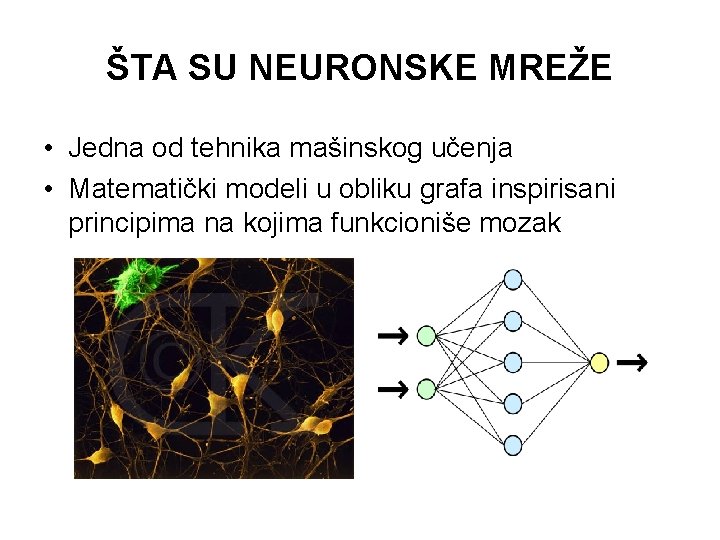

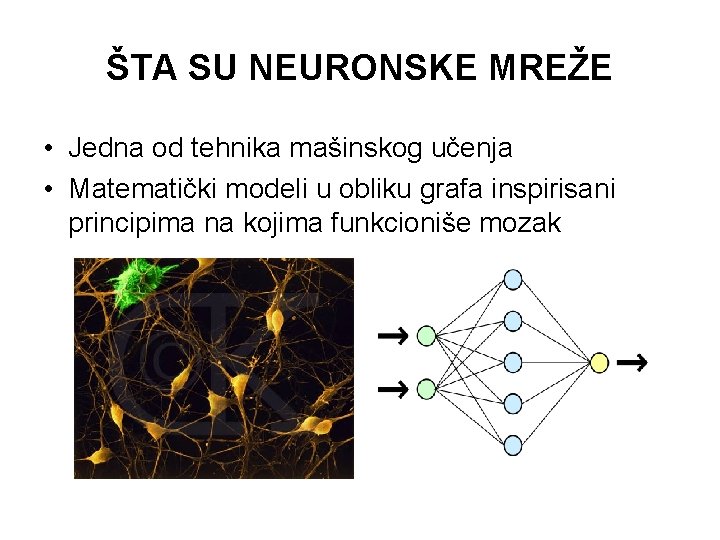

ŠTA SU NEURONSKE MREŽE • Jedna od tehnika mašinskog učenja • Matematički modeli u obliku grafa inspirisani principima na kojima funkcioniše mozak

ŠTA JE VEŠTAČKA NEURONSKA MREŽA - DEFINICIJE • DARPA: Neuronska mreža je sistem koji se sastoji od velikog broja međusobno povezanih, jednostavnih elemenata procesiranja koji rade paralelno. Funkcija VNM je određena strukturom mreže, težinom veza, i obradom u elementima procesiranja. • Haykin: Neuronska mreža je paralelni distribuirani procesor koji ima prirodnu sposobnost čuvanja i korišćenja iskustvenog znanja. Sličnost sa mozgom se ogleda kroz dve osobine: – mreža stiče znanje kroz proces učenja – znanje se čuva u vezama između neurona (sinaptičkim težinama)

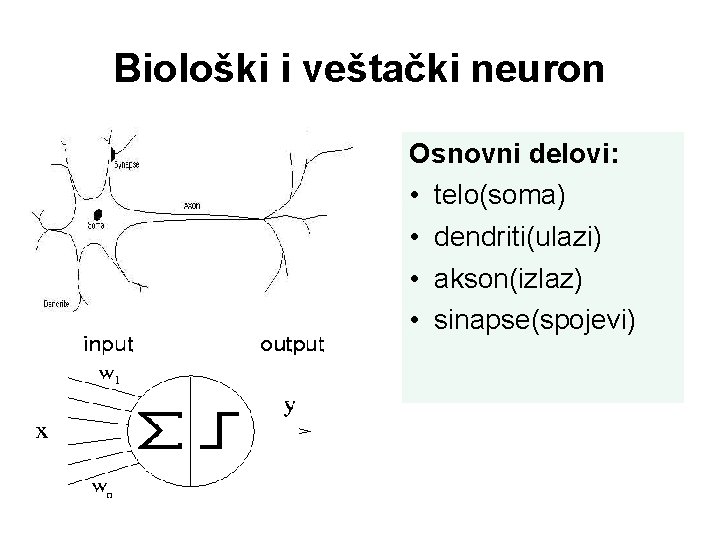

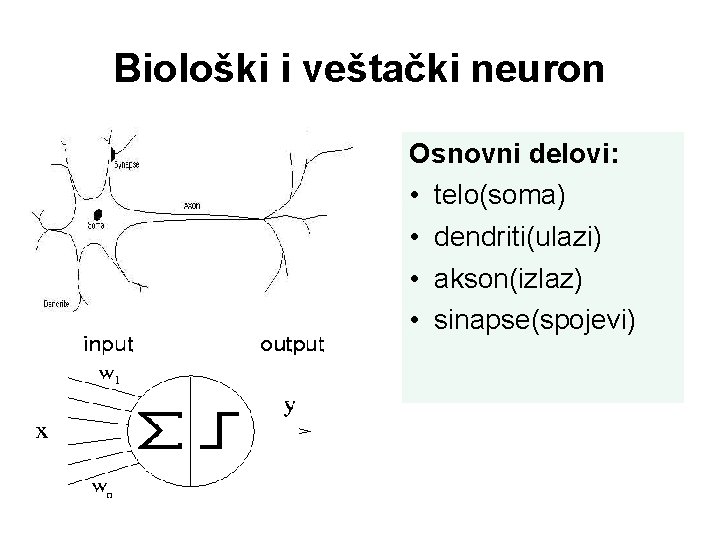

Biološki i veštački neuron Osnovni delovi: • telo(soma) • dendriti(ulazi) • akson(izlaz) • sinapse(spojevi)

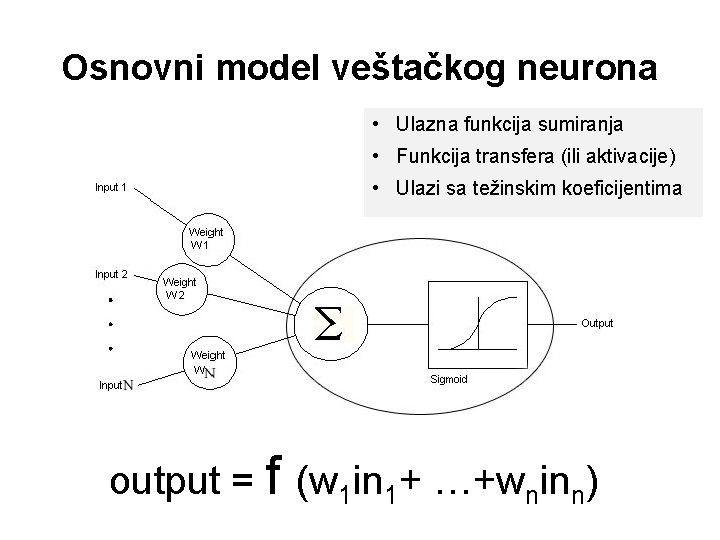

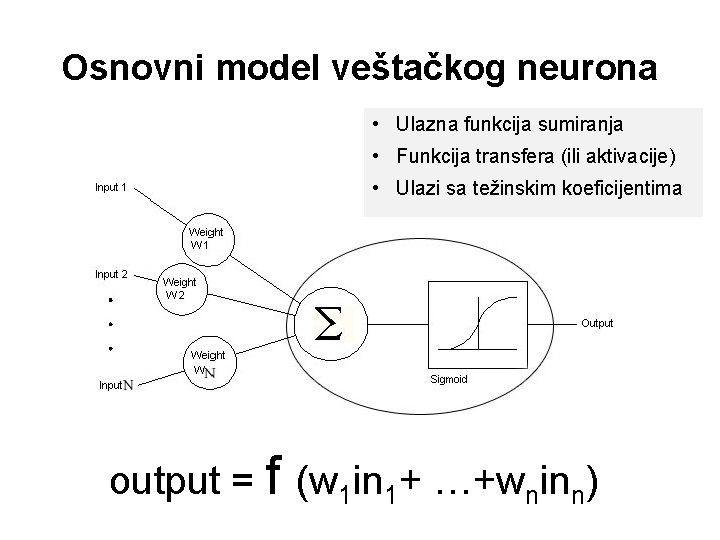

Osnovni model veštačkog neurona • Ulazna funkcija sumiranja • Funkcija transfera (ili aktivacije) • Ulazi sa težinskim koeficijentima output = f (w 1 in 1+ …+wninn)

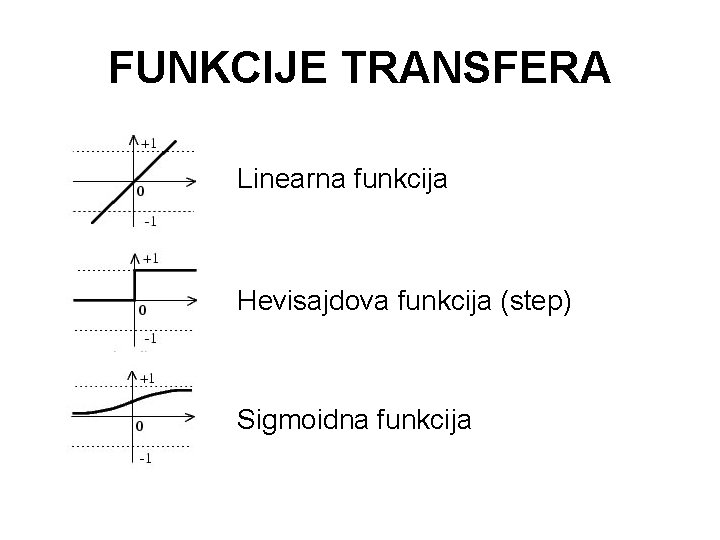

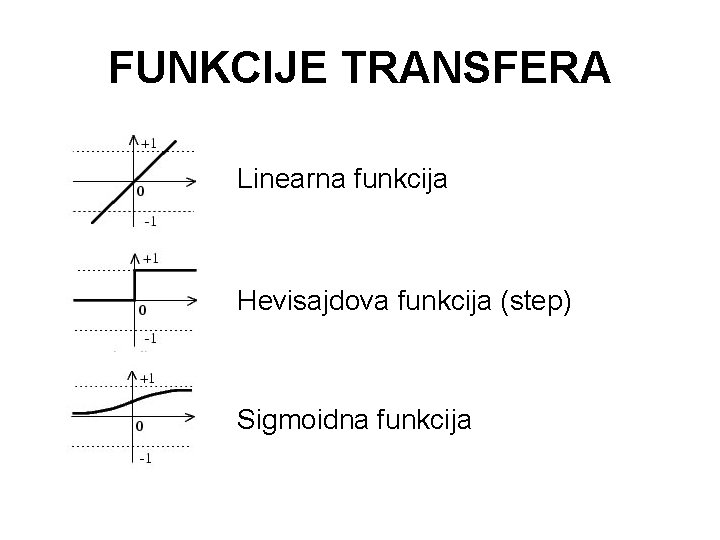

FUNKCIJE TRANSFERA Linearna funkcija Hevisajdova funkcija (step) Sigmoidna funkcija

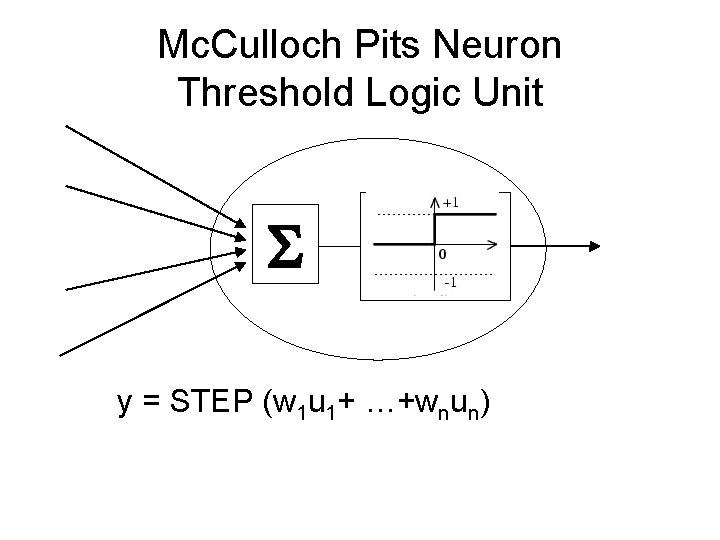

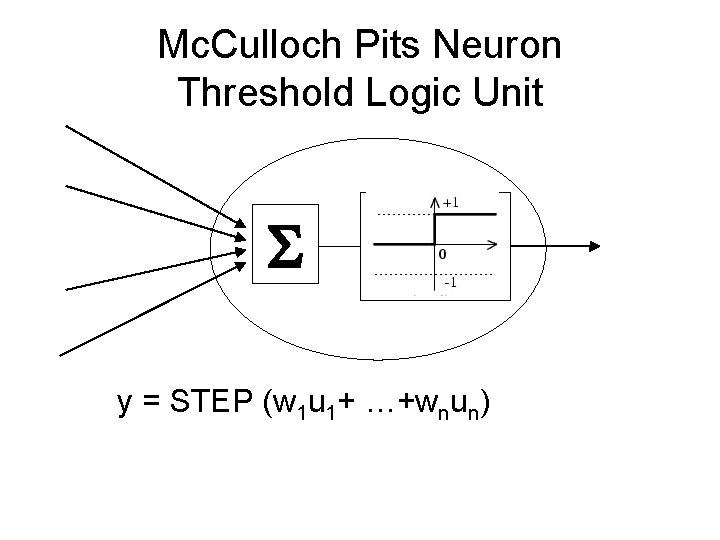

Mc. Culloch Pits Neuron Threshold Logic Unit y = STEP (w 1 u 1+ …+wnun)

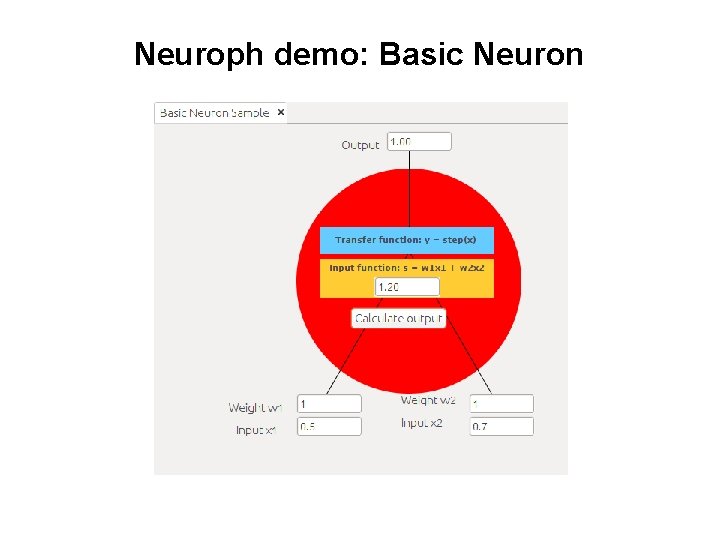

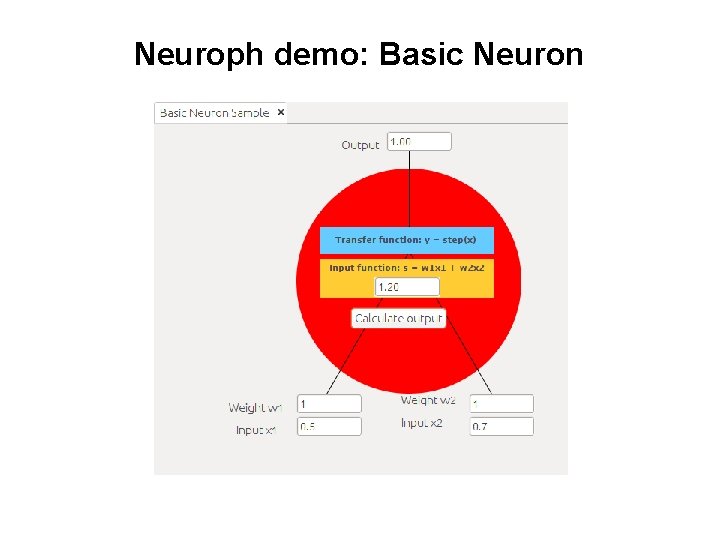

Neuroph demo: Basic Neuron

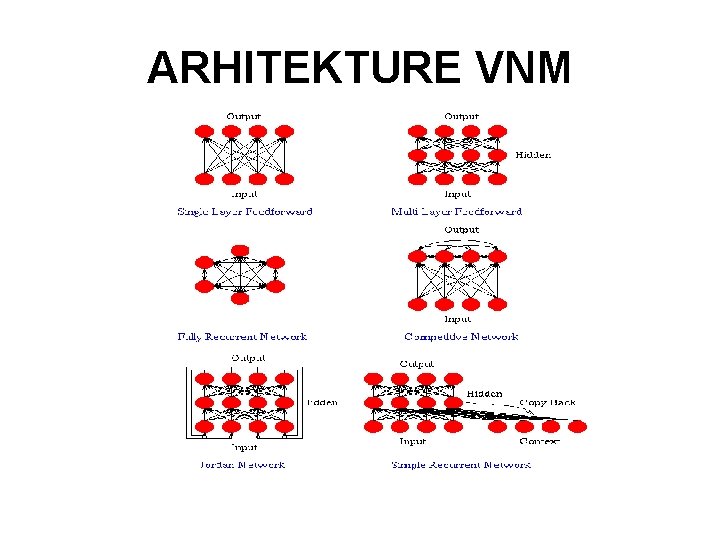

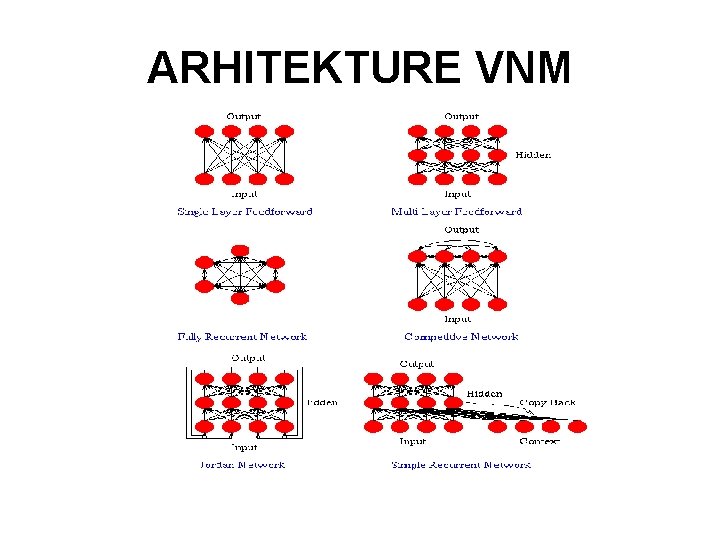

ARHITEKTURE VNM

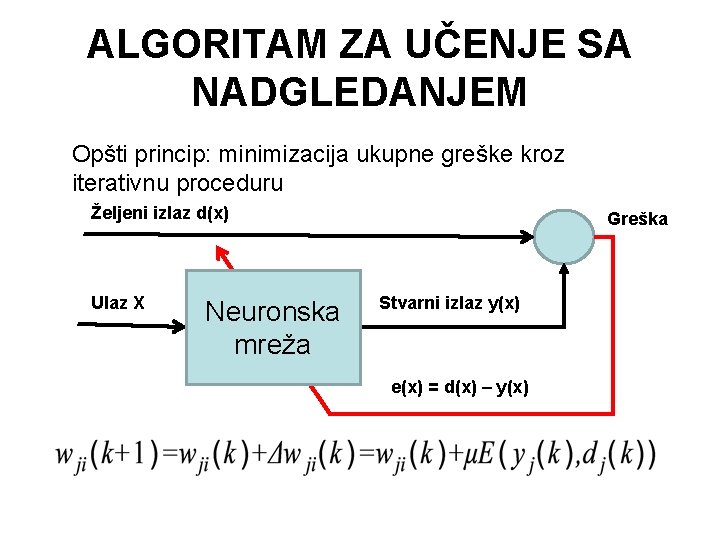

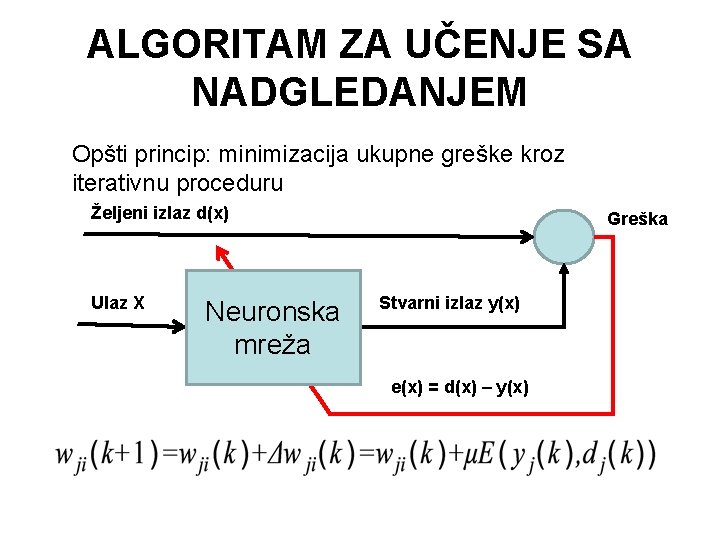

ALGORITAM ZA UČENJE SA NADGLEDANJEM Opšti princip: minimizacija ukupne greške kroz iterativnu proceduru Željeni izlaz d(x) Ulaz X Neuronska mreža Greška Stvarni izlaz y(x) e(x) = d(x) – y(x)

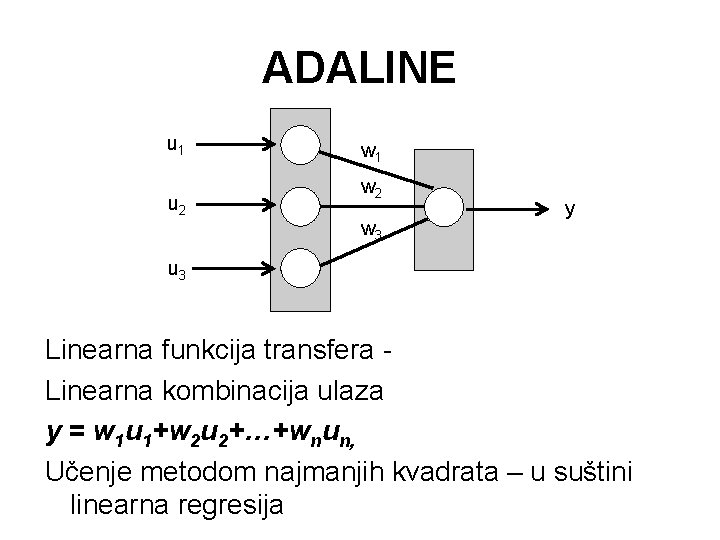

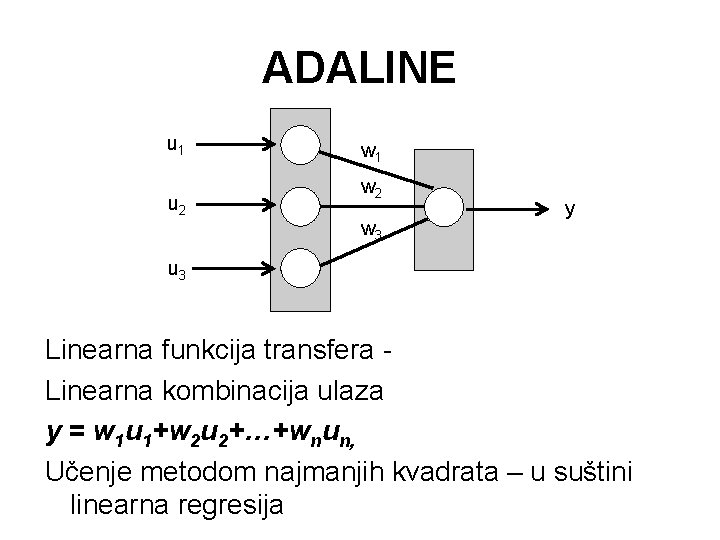

ADALINE u 1 u 2 w 1 w 2 w 3 y u 3 Linearna funkcija transfera Linearna kombinacija ulaza y = w 1 u 1+w 2 u 2+…+wnun, Učenje metodom najmanjih kvadrata – u suštini linearna regresija

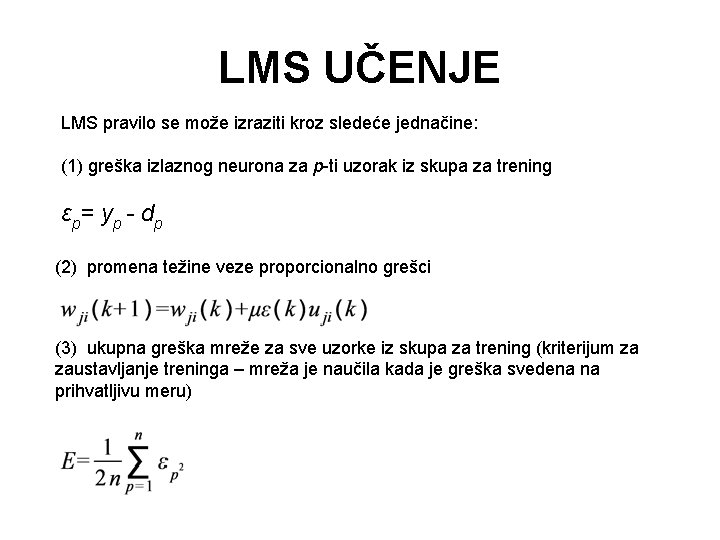

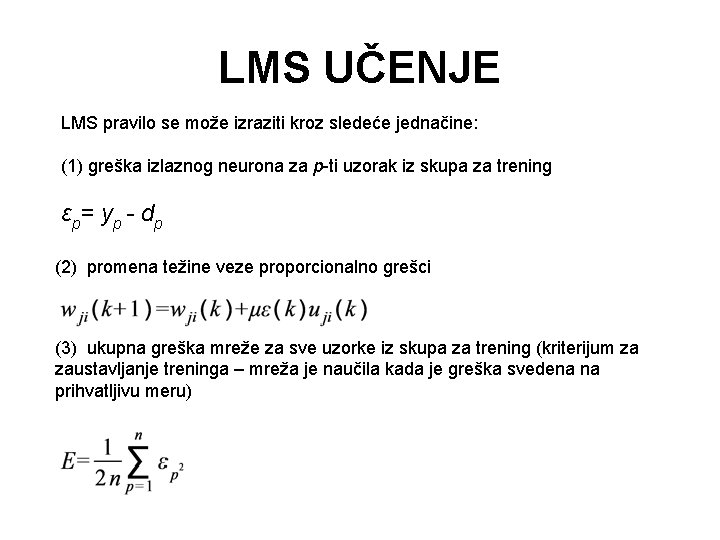

LMS UČENJE LMS pravilo se može izraziti kroz sledeće jednačine: (1) greška izlaznog neurona za p-ti uzorak iz skupa za trening ε p= y p - d p (2) promena težine veze proporcionalno grešci (3) ukupna greška mreže za sve uzorke iz skupa za trening (kriterijum za zaustavljanje treninga – mreža je naučila kada je greška svedena na prihvatljivu meru)

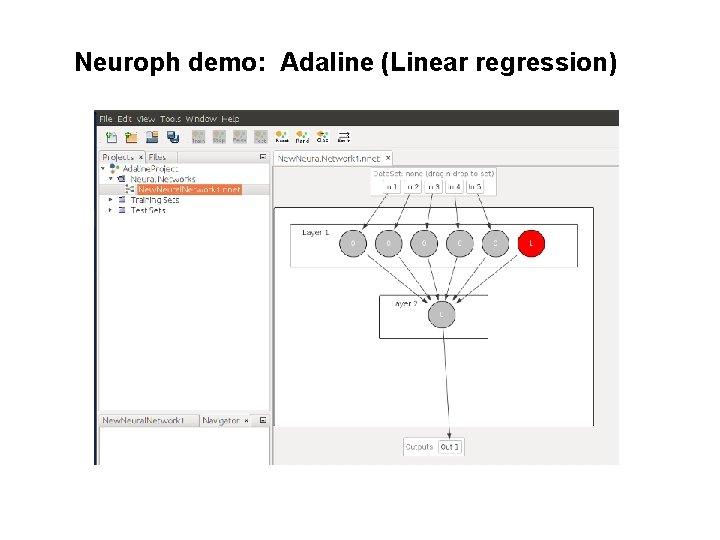

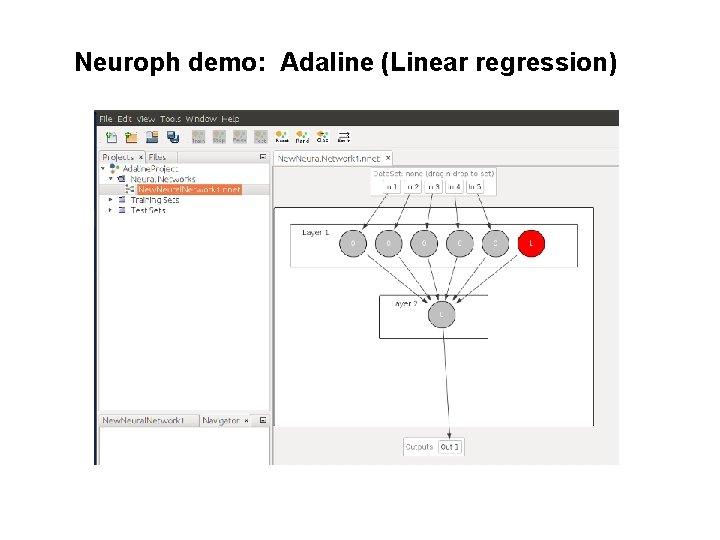

Neuroph demo: Adaline (Linear regression)

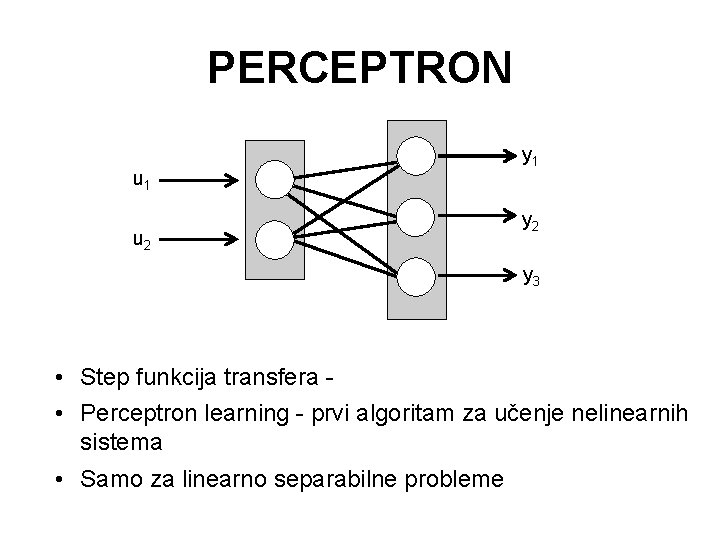

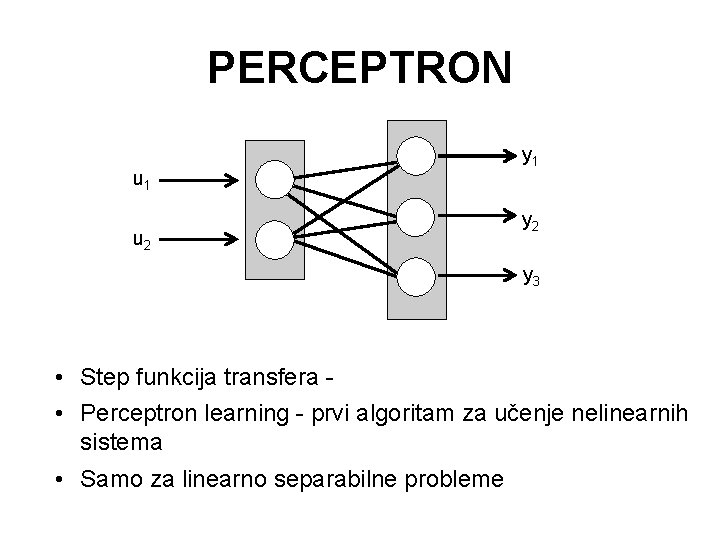

PERCEPTRON u 1 u 2 y 1 y 2 y 3 • Step funkcija transfera • Perceptron learning - prvi algoritam za učenje nelinearnih sistema • Samo za linearno separabilne probleme

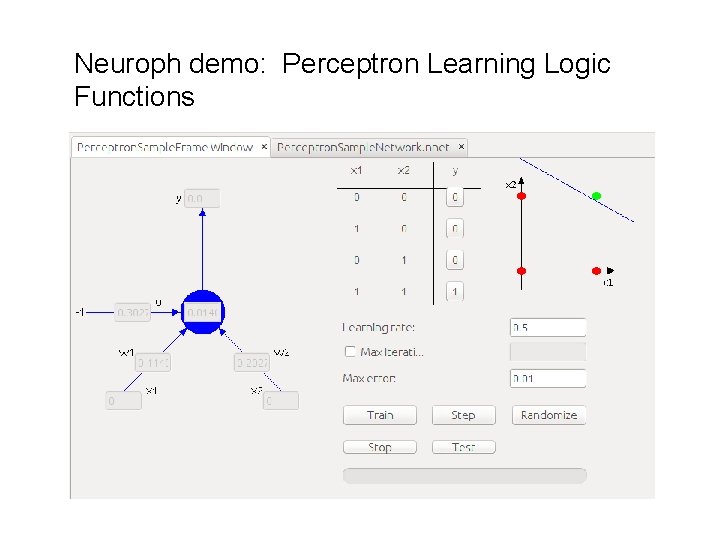

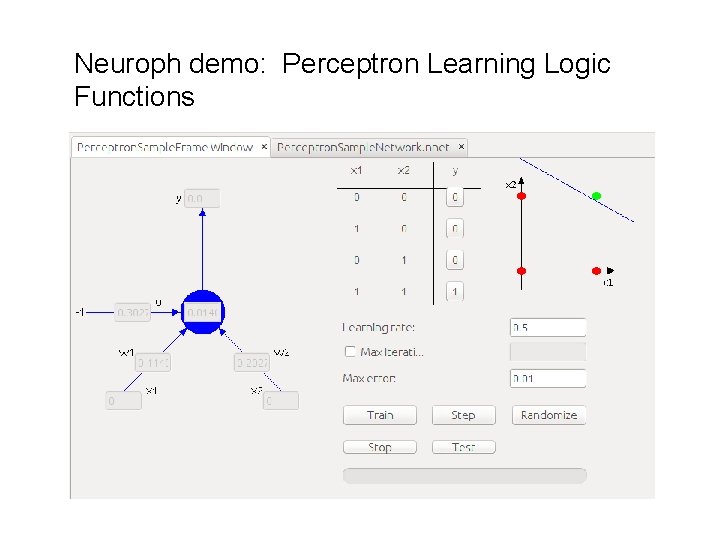

Neuroph demo: Perceptron Learning Logic Functions

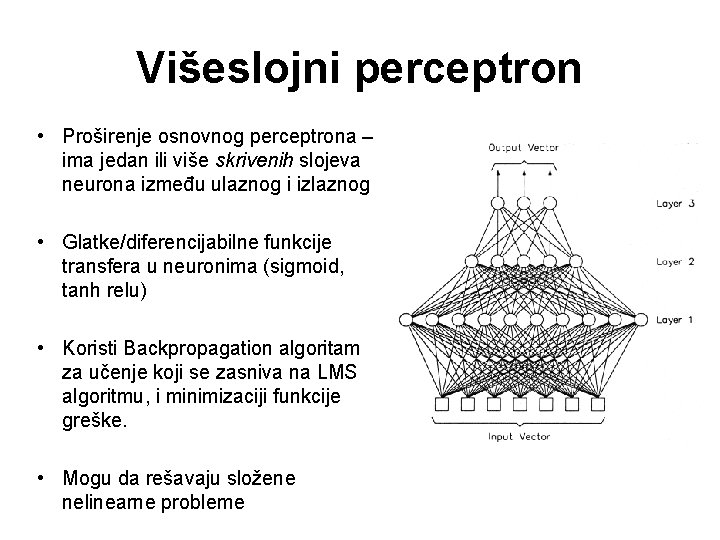

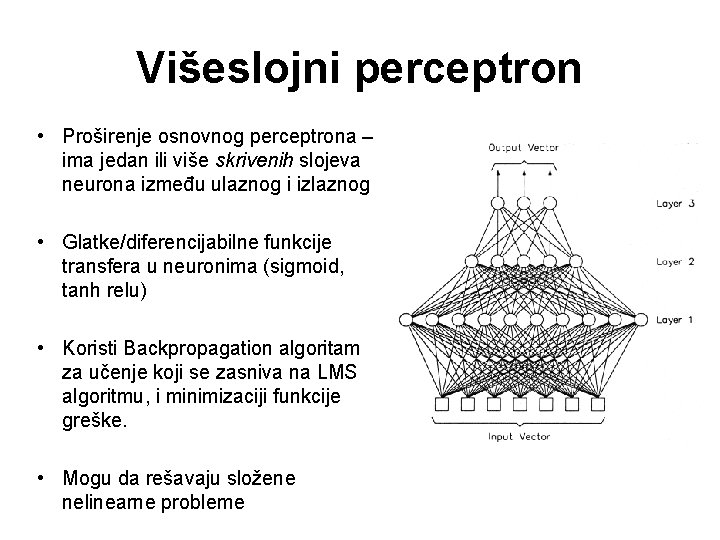

Višeslojni perceptron • Proširenje osnovnog perceptrona – ima jedan ili više skrivenih slojeva neurona između ulaznog i izlaznog • Glatke/diferencijabilne funkcije transfera u neuronima (sigmoid, tanh relu) • Koristi Backpropagation algoritam za učenje koji se zasniva na LMS algoritmu, i minimizaciji funkcije greške. • Mogu da rešavaju složene nelinearne probleme

Backpropagation algoritam • Služi za trening višeslojnog perceptrona – može da podešava težine u skrivenim slojevima • Predstavlja supervizorni algoritam koji se zasniva na LMS algoritmu • Višeslojni perceptron sa BP algoritmom predstavlja univerzalni aproksimator

Backpropagation algoritam Iterativna minimizacija funkcije greške gradijentnom metodom Korišćenje diferencijabilnih funkcija transfera (sigmoid), i primena pravila za izvod složenih funkcija omogućavaju prenošenje greške sa izlaza unazad, sa sloja na sloj. w(k+1) = w(k) + u * d. E/dw = d. E/dy * dy/ds * ds / dw

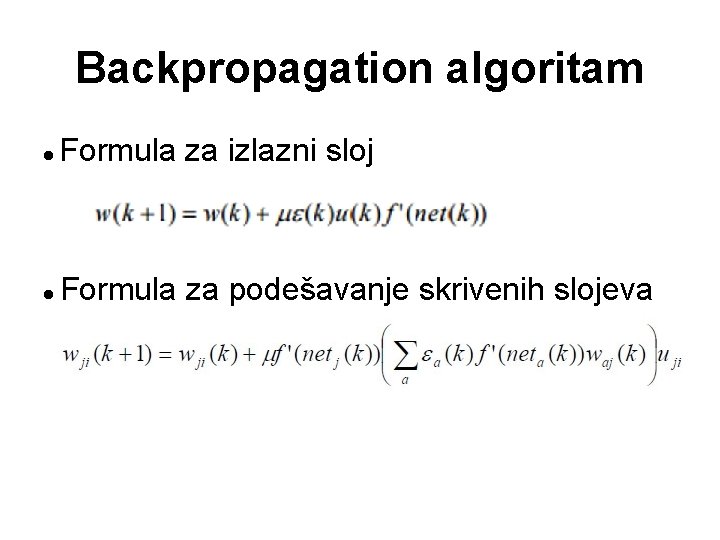

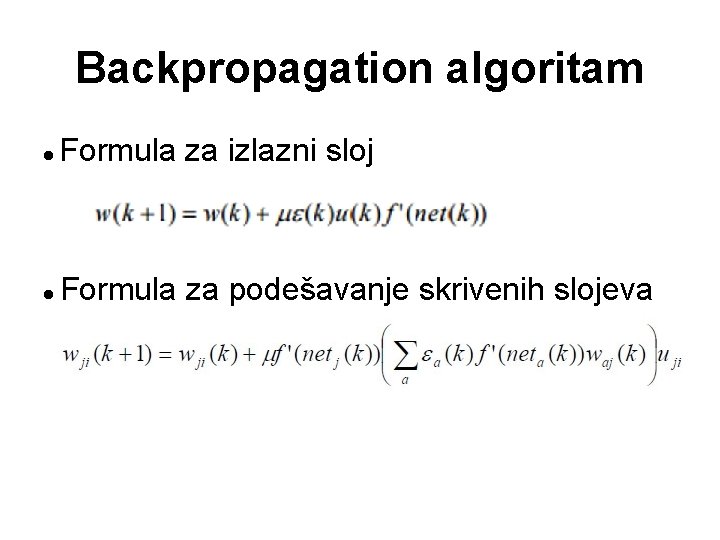

Backpropagation algoritam Formula za izlazni sloj Formula za podešavanje skrivenih slojeva

Osnovni kontrolni parametri backpropagation algoritma • Max error – trening se zaustavlja kada ukupna greška padne ispod ove vrednosti • Max iterations – trening se zaustavlja posle zadatog broja iteracija • Learning rate – određuje u kojoj meri greška utiče na promenu težine • Batch mode – da li se promene težine vrše za svaki par (ulaz, izlaz) ili za skup parova

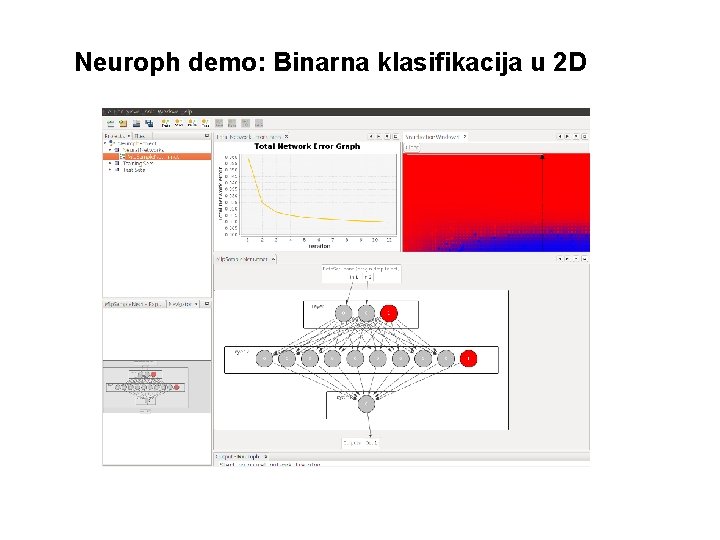

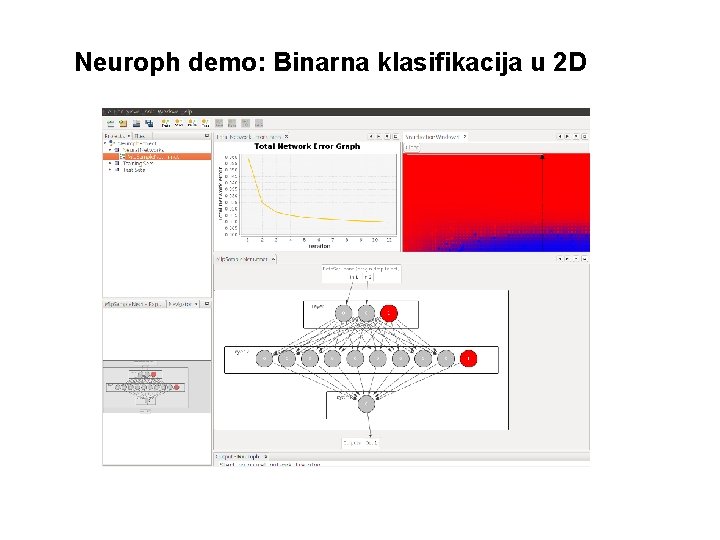

Neuroph demo: Binarna klasifikacija u 2 D

Problemi Backpropagation algoritma Problem lokalnog minimuma Problem saturacije/nestajućih gradijenta Zaustavljanje algoritma: – spora konvergencija – rast greške – rano zaustavljanje - greška za određeni data set, izbegavanje overfittinga

LINKOVI I LITERATURA • Sajt Neuroph projekta • http: //neuroph. sourceforge. net • http: //github. com/neuroph • Sajt predmeta Inteligentni sistemi http: //ai. fon. bg. ac. rs/osnovne/inteligentni-sistemi/neuronskemreze/ Knjige • Neural Networks - A Systematic Introduction , besplatna online knjiga • Neural Networks For Pattern Recognition, C. Bishop • Fundamentals of Neural Networks, Lauren Fauset