Stochastische kontextfreie Grammatiken SKFGn Gliederung Einfhrung Definition Anwendungen

- Slides: 26

Stochastische kontextfreie Grammatiken (SKFGn)

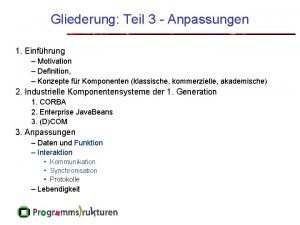

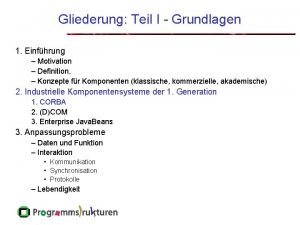

Gliederung • Einführung – Definition – Anwendungen – Eigenschaften • Innen- / Außenwahrscheinlichkeiten • Trainingsalgorithmus • Schlusswort

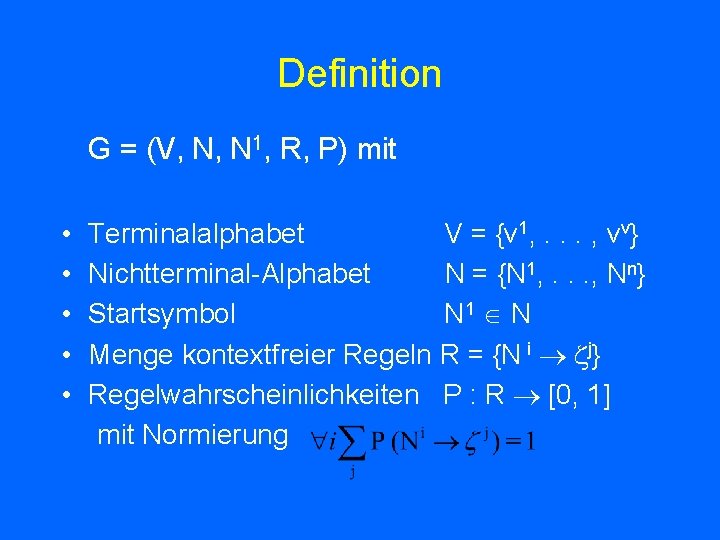

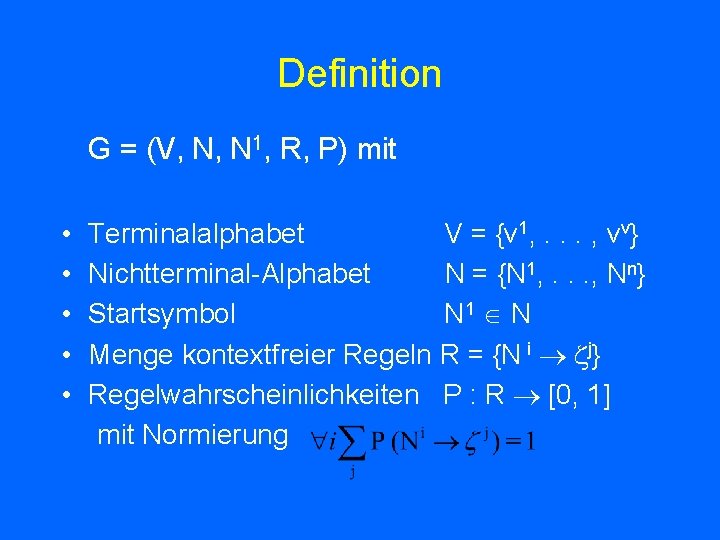

Definition G = (V, N, N 1, R, P) mit • • • Terminalalphabet V = {v 1, . . . , vv} Nichtterminal-Alphabet N = {N 1, . . . , Nn} Startsymbol N 1 N Menge kontextfreier Regeln R = {N i j} Regelwahrscheinlichkeiten P : R [0, 1] mit Normierung

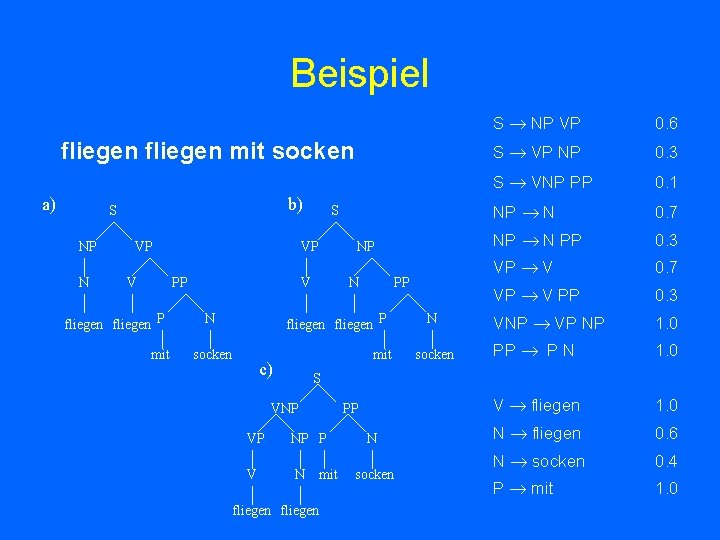

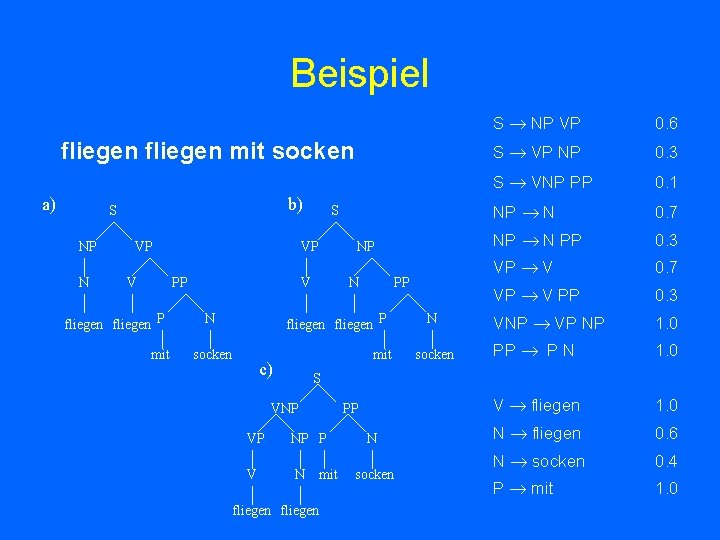

Beispiel fliegen mit socken a) b) S NP N VP V VP PP fliegen P mit S V N NP N PP fliegen P socken mit c) N socken S NP VP 0. 6 S VP NP 0. 3 S VNP PP 0. 1 NP N 0. 7 NP N PP 0. 3 VP V 0. 7 VP V PP 0. 3 VNP VP NP 1. 0 PP P N 1. 0 V fliegen 1. 0 N fliegen 0. 6 N socken 0. 4 P mit 1. 0 S VNP VP NP P V N mit fliegen PP N socken

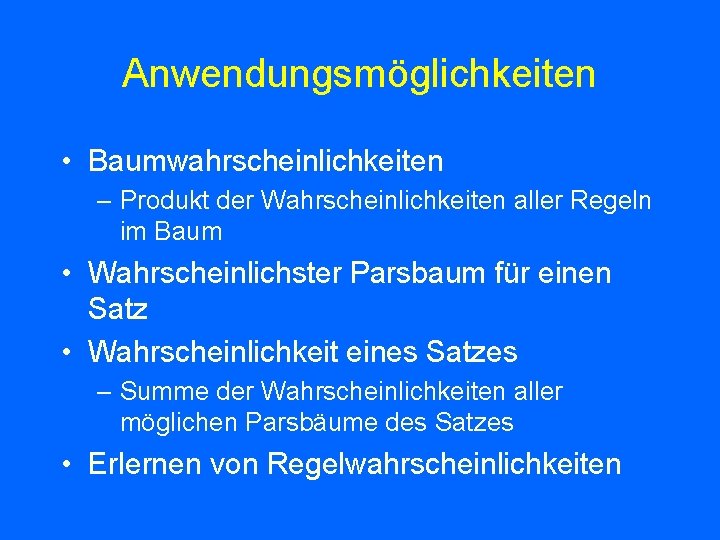

Anwendungsmöglichkeiten • Baumwahrscheinlichkeiten – Produkt der Wahrscheinlichkeiten aller Regeln im Baum • Wahrscheinlichster Parsbaum für einen Satz • Wahrscheinlichkeit eines Satzes – Summe der Wahrscheinlichkeiten aller möglichen Parsbäume des Satzes • Erlernen von Regelwahrscheinlichkeiten

Beispielberechnungen a) 0. 6 b) S 0. 3 NP 0. 7 0. 6 VP VP 0. 3 N PP V 1. 0 fliegen P 1. 0 mit N 0. 4 socken 1. 0 N 0. 6 0. 1 S 1. 0 VNP NP 0. 3 0. 7 V 1. 0 c) S VP PP 0. 7 1. 0 fliegen P 1. 0 mit N 0. 4 socken V 1. 0 PP NP P 0. 7 1. 0 N mit 0. 6 fliegen N 0. 4 socken

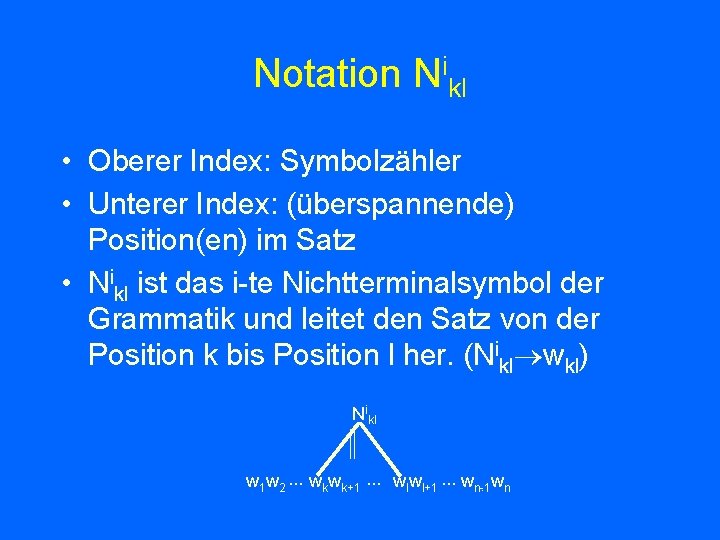

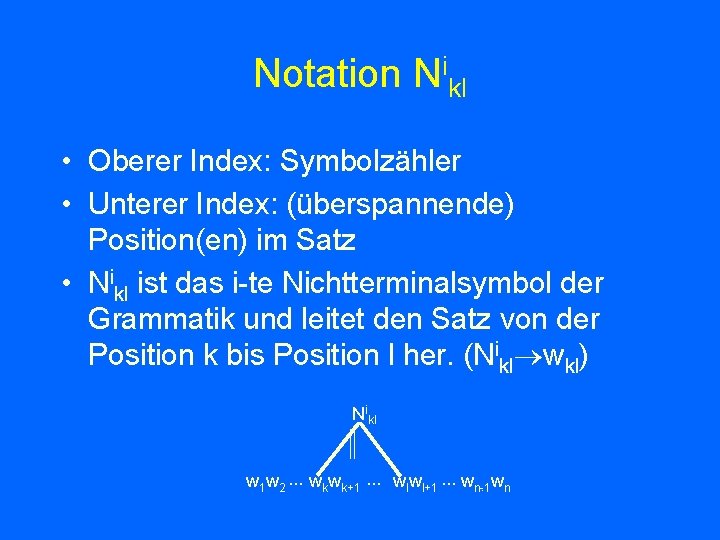

Notation Nikl • Oberer Index: Symbolzähler • Unterer Index: (überspannende) Position(en) im Satz • Nikl ist das i-te Nichtterminalsymbol der Grammatik und leitet den Satz von der Position k bis Position l her. (Nikl wkl) Nikl w 1 w 2. . . wkwk+1. . . wlwl+1. . . wn-1 wn -

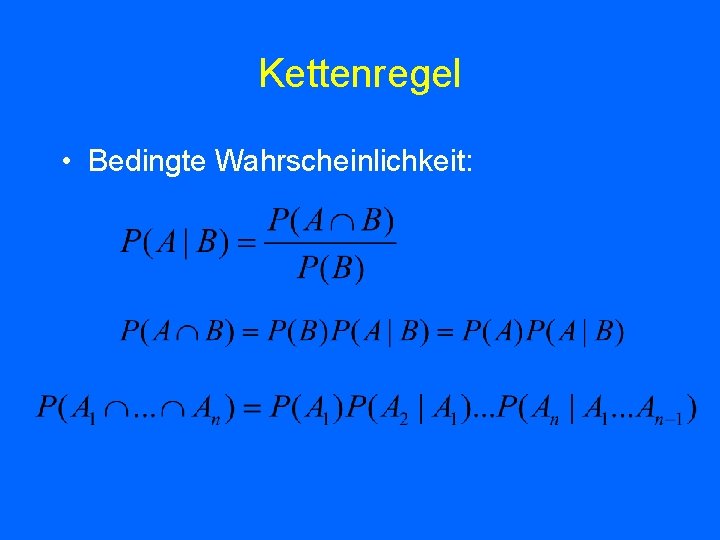

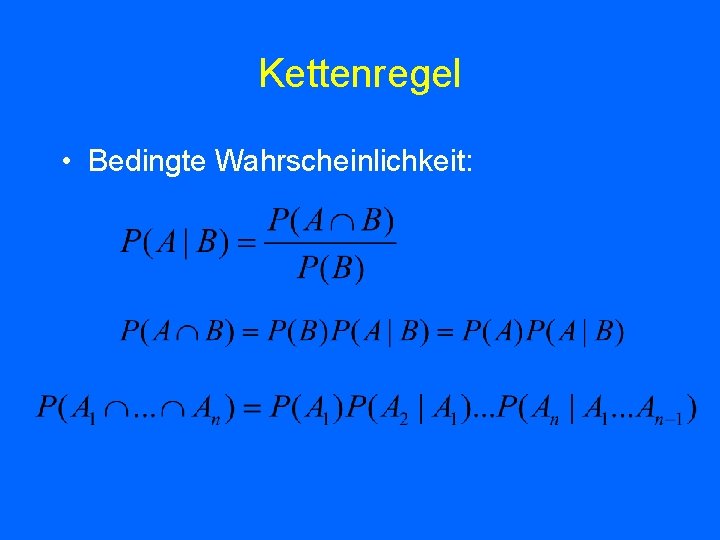

Kettenregel • Bedingte Wahrscheinlichkeit:

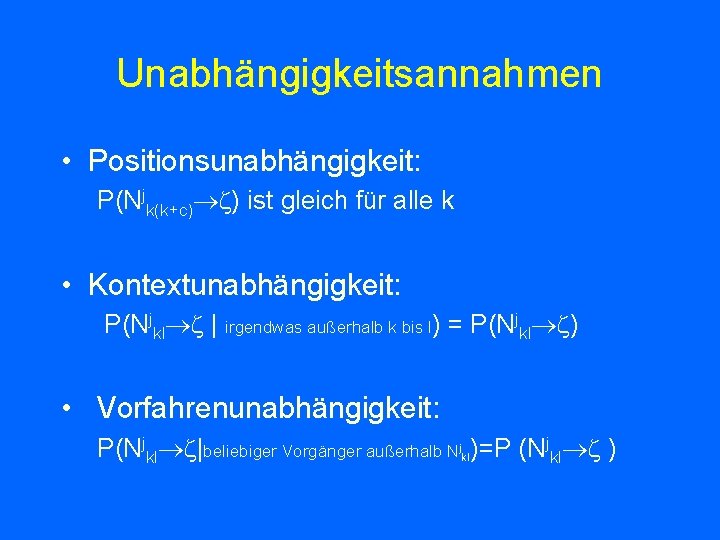

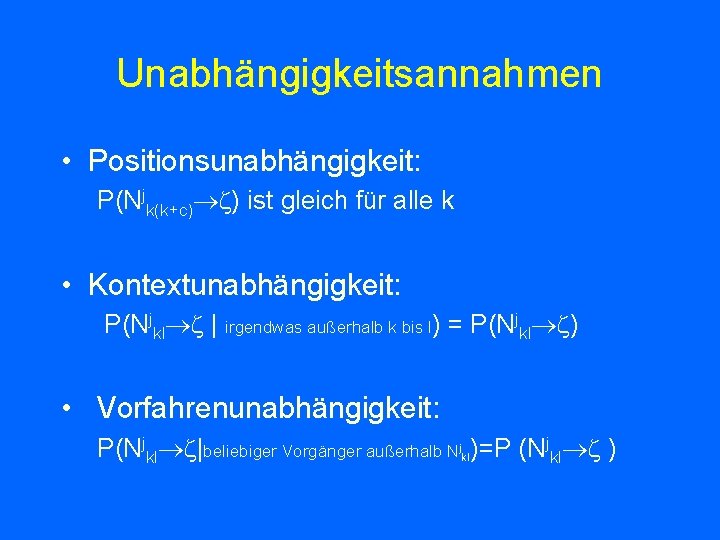

Unabhängigkeitsannahmen • Positionsunabhängigkeit: P(Njk(k+c) ) ist gleich für alle k • Kontextunabhängigkeit: P(Njkl | irgendwas außerhalb k bis l) = P(Njkl ) • Vorfahrenunabhängigkeit: P(Njkl |beliebiger Vorgänger außerhalb Njkl)=P (Njkl )

Orientierungsfolie • Einführung • Innen- und Außenwahrscheinlichkeiten (Inside/Outside-Probabilities) – Äquivalent zu Vorwärts-/Rückwärts. Wahrscheinlichkeiten für HMM‘s • Trainingsalgorithmus • Schlusswort

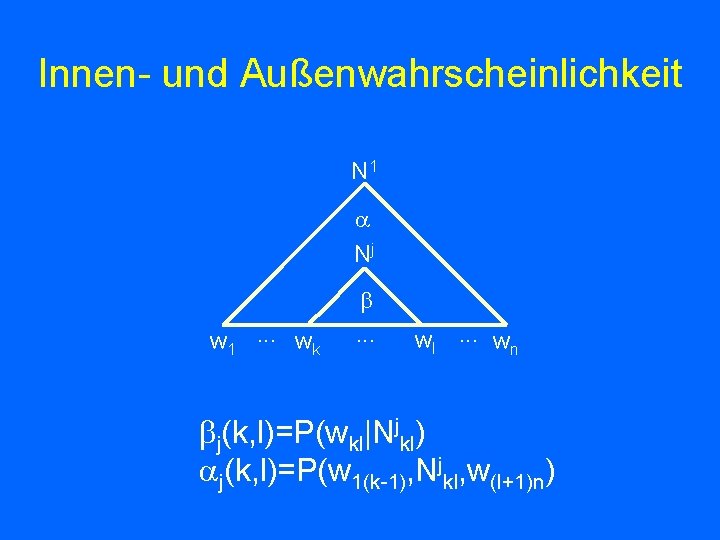

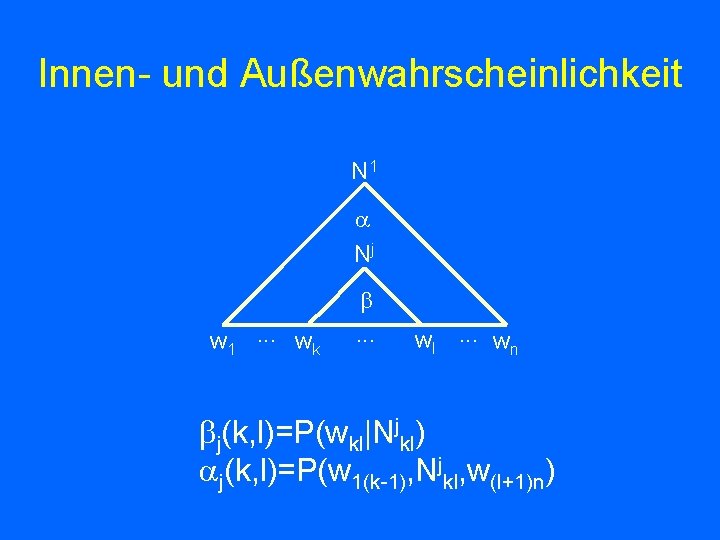

Innen- und Außenwahrscheinlichkeit • Analog zu Vorwärts- und Rückwärtswahrscheinlichkeit für H reguläre Grammatiken 21 H=Si • Rückwärts / Innen: 3 t =Si H – HMM: i(t)= P(wtn|St=si) 3 t C – SKFG: j(k, l)=P(wkl|Njkl) 2 n T • Vorwärts / Außen: – HMM: i(t)=P(w 1(t-1), St=si) – SKFG: j(k, l)=P(w 1(k-1), Njkl, w(l+1)n)

Innen- und Außenwahrscheinlichkeit N 1 Nj w 1. . . wk . . . wl. . . wn j(k, l)=P(wkl|Njkl) j(k, l)=P(w 1(k-1), Njkl, w(l+1)n)

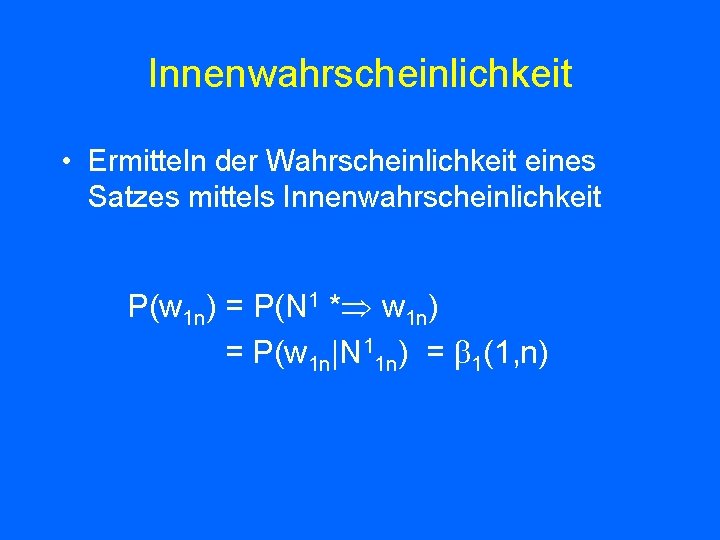

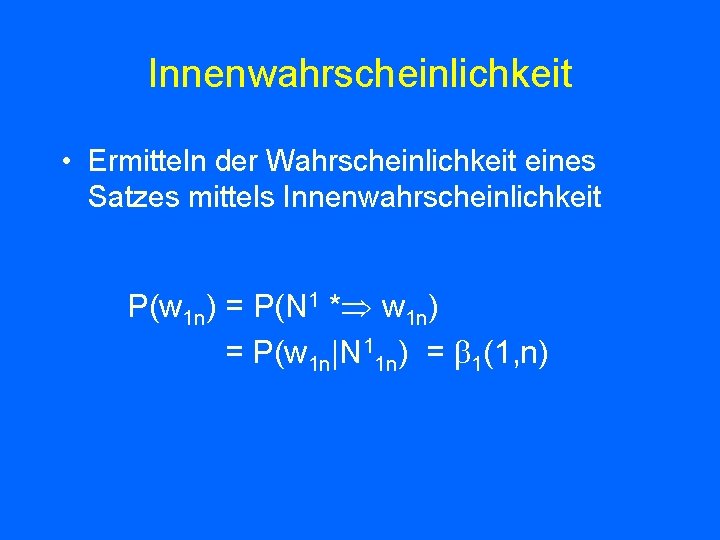

Innenwahrscheinlichkeit • Ermitteln der Wahrscheinlichkeit eines Satzes mittels Innenwahrscheinlichkeit P(w 1 n) = P(N 1 * w 1 n) = P(w 1 n|N 11 n) = 1(1, n)

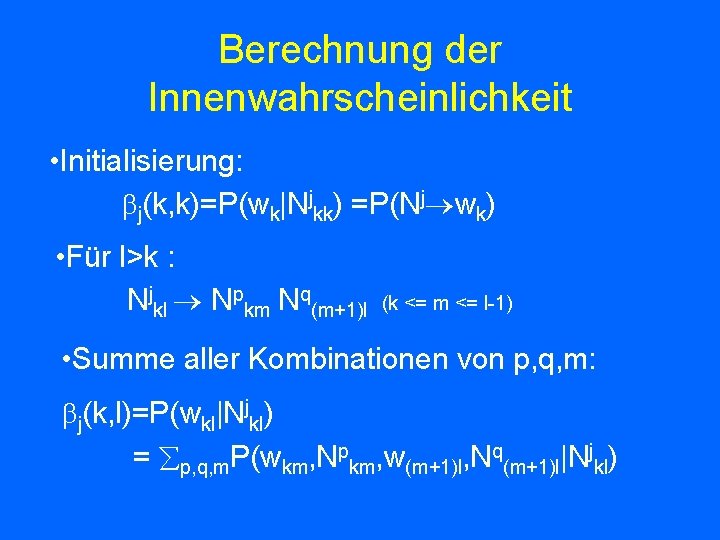

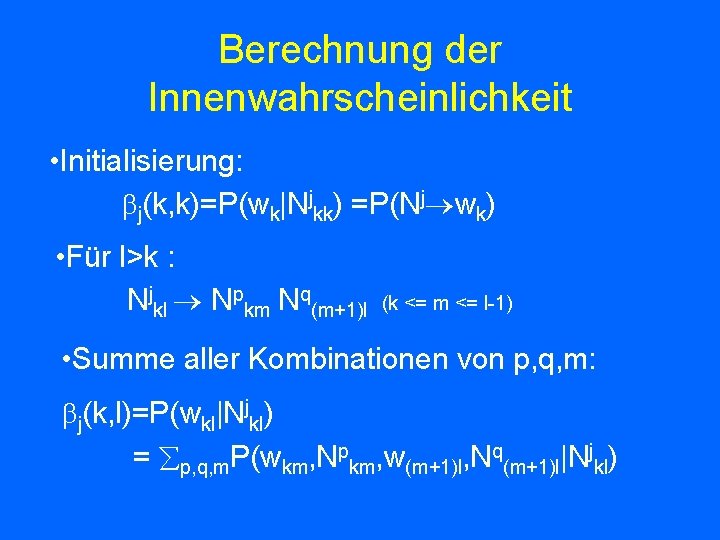

Berechnung der Innenwahrscheinlichkeit • Initialisierung: j(k, k)=P(wk|Njkk) =P(Nj wk) • Für l>k : Njkl Npkm Nq(m+1)l (k <= m <= l-1) • Summe aller Kombinationen von p, q, m: j(k, l)=P(wkl|Njkl) = p, q, m. P(wkm, Npkm, w(m+1)l, Nq(m+1)l|Njkl)

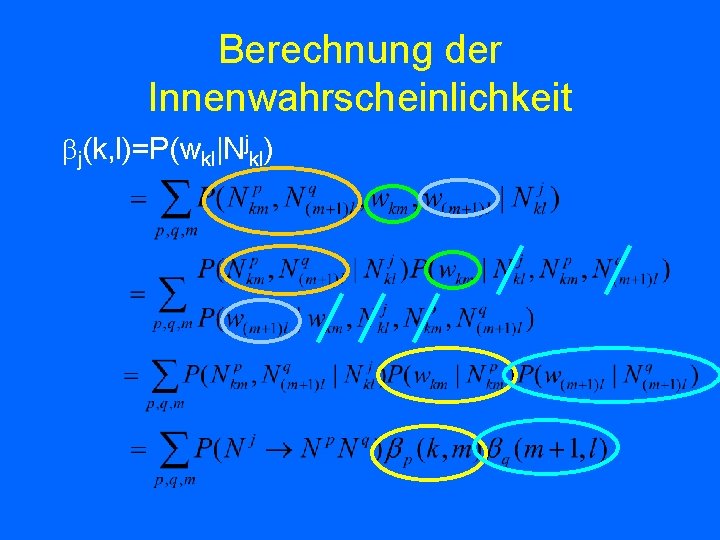

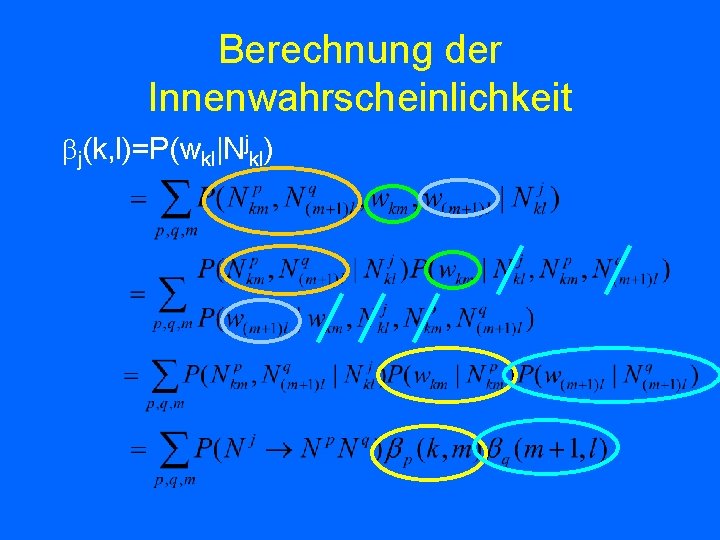

Berechnung der Innenwahrscheinlichkeit j(k, l)=P(wkl|Njkl)

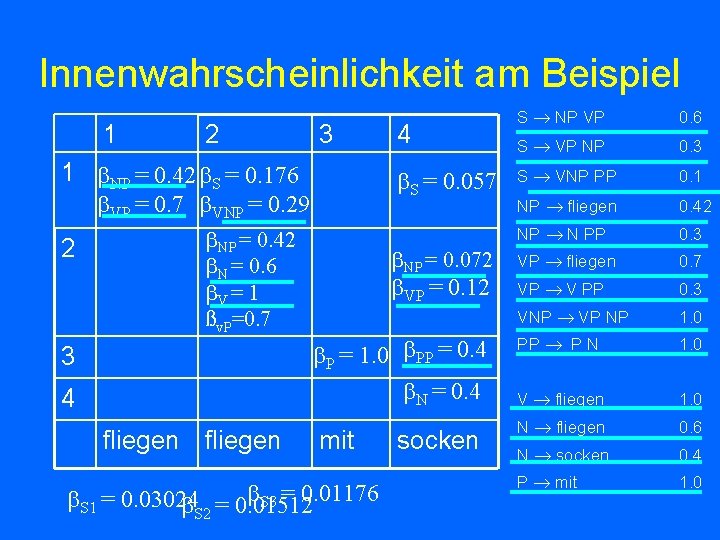

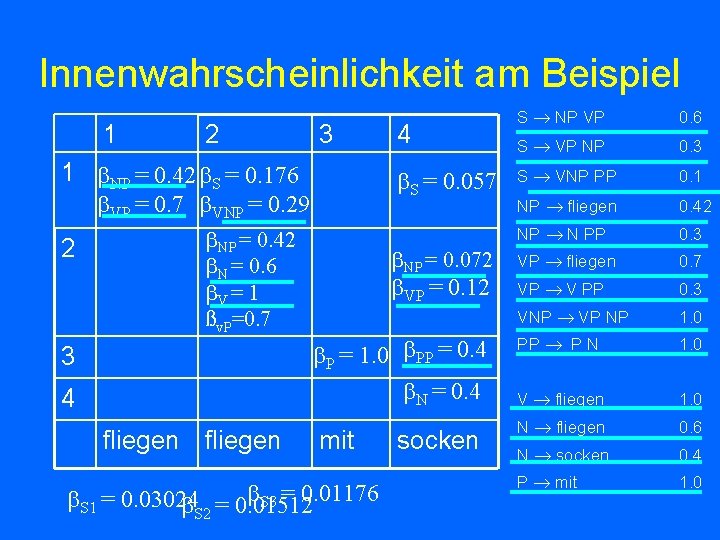

Innenwahrscheinlichkeit am Beispiel 1 2 3 1 NP = 0. 42 S = 0. 176 S = 0. 057 VP = 0. 7 VNP = 0. 29 2 NP = 0. 42 N = 0. 6 V = 1 ßv. P=0. 7 3 4 fliegen 4 NP = 0. 072 VP = 0. 12 P = 1. 0 PP = 0. 4 N = 0. 4 mit S 3 = 0. 01176 S 1 = 0. 03024 S 2 = 0. 01512 socken S NP VP 0. 6 S VP NP 0. 3 S VNP PP 0. 1 NP fliegen 0. 42 NP N PP 0. 3 VP fliegen 0. 7 VP V PP 0. 3 VNP VP NP 1. 0 PP P N 1. 0 V fliegen 1. 0 N fliegen 0. 6 N socken 0. 4 P mit 1. 0

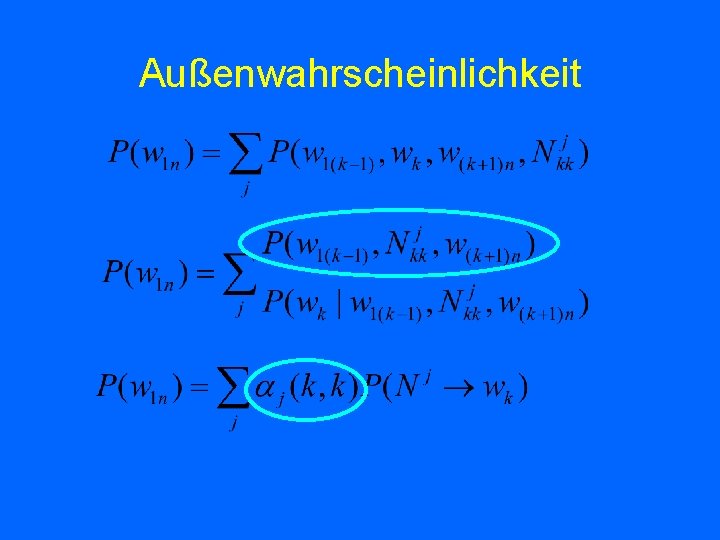

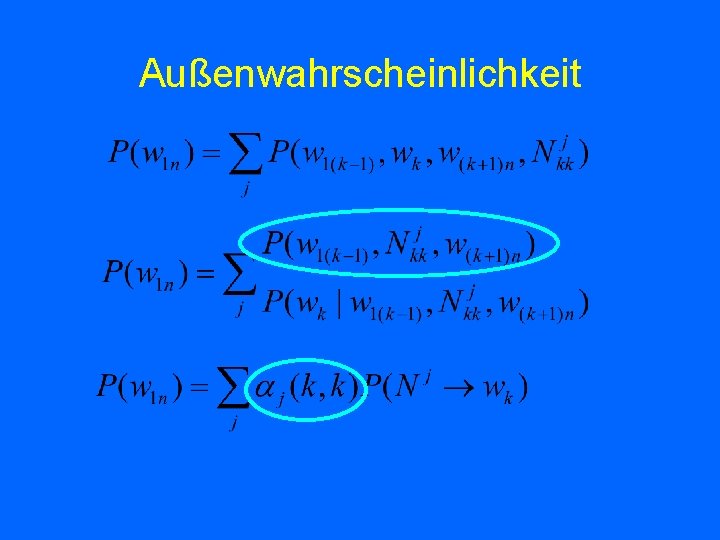

Außenwahrscheinlichkeit

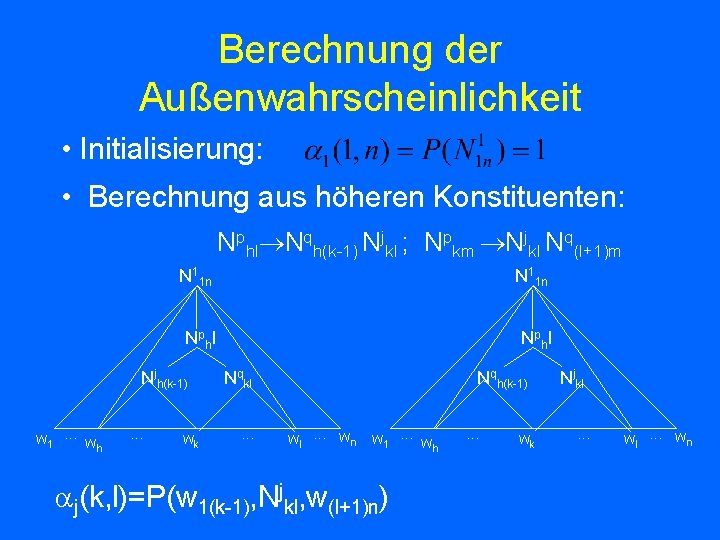

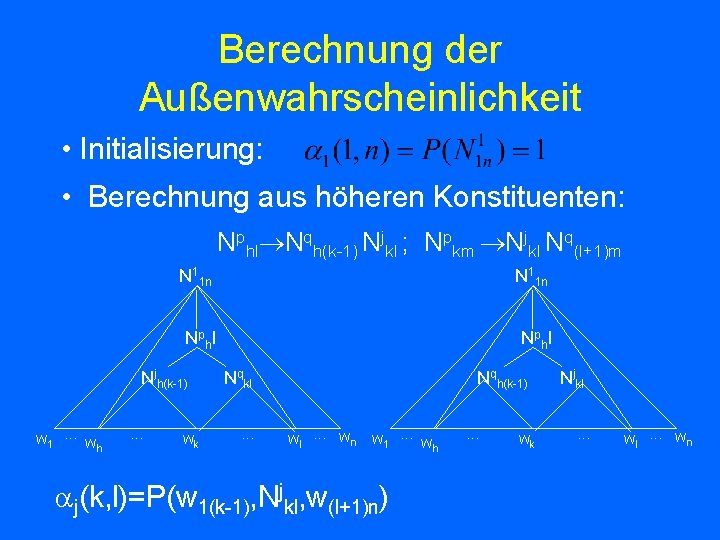

Berechnung der Außenwahrscheinlichkeit • Initialisierung: • Berechnung aus höheren Konstituenten: Nphl Nqh(k-1) Njkl ; Npkm Njkl Nq(l+1)m N 11 n Np h l Njh(k-1) w 1. . . wh . . . wk Nqkl. . . Nqh(k-1) wl. . . wn w 1. . . wh j(k, l)=P(w 1(k-1), Njkl, w(l+1)n) . . . wk Njkl. . . wl. . . wn

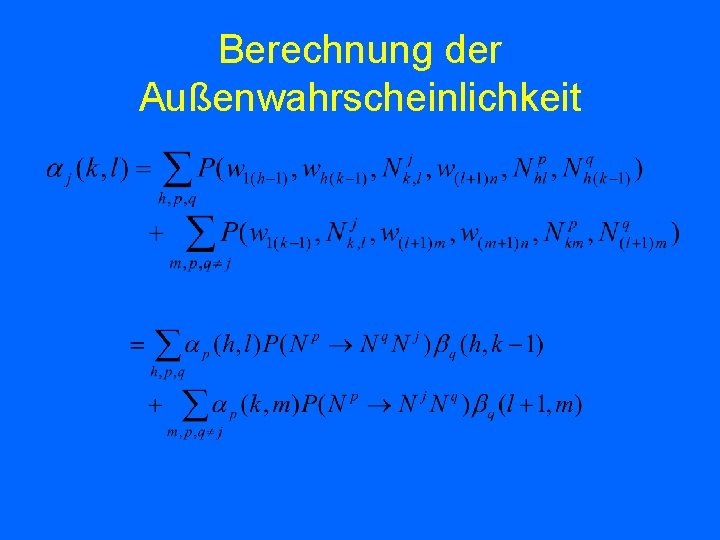

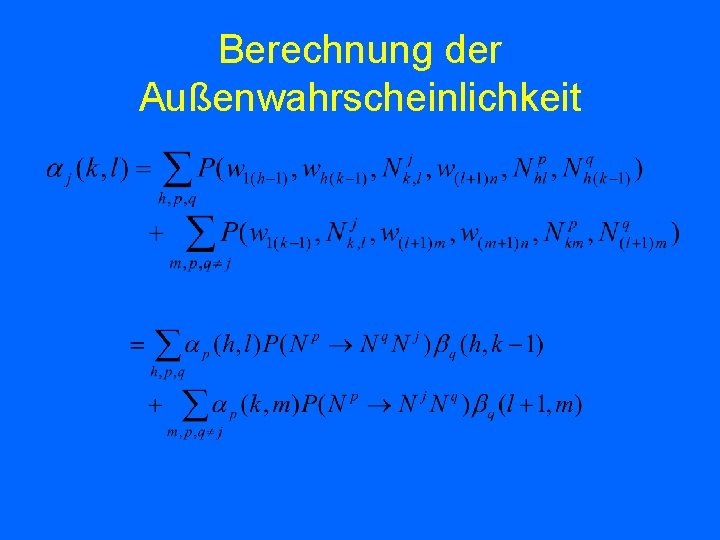

Berechnung der Außenwahrscheinlichkeit

Orientierungsfolie • Einführung • Innen- und Außenwahrscheinlichkeiten • Trainingsalgorithmus – ähnelt HMM – verwendet Innen- Außenwahrscheinlichkeiten zur Schätzung der Regelwahrscheinlichkeit • Schlusswort

Trainingsalgorithmus (wie HMM) • Wähle Grammatik G 0 als Ausgangshypothese • Iteration bis Wahrscheinlichkeiten der Trainingssätze sich nicht mehr ändern: – Schätze mit Hilfe der Inside-/Outside. Wahrscheinlichkeiten die Wahrscheinlichkeiten für die Regeln – Ersetze Gi durch neu gewonnene Gi+1

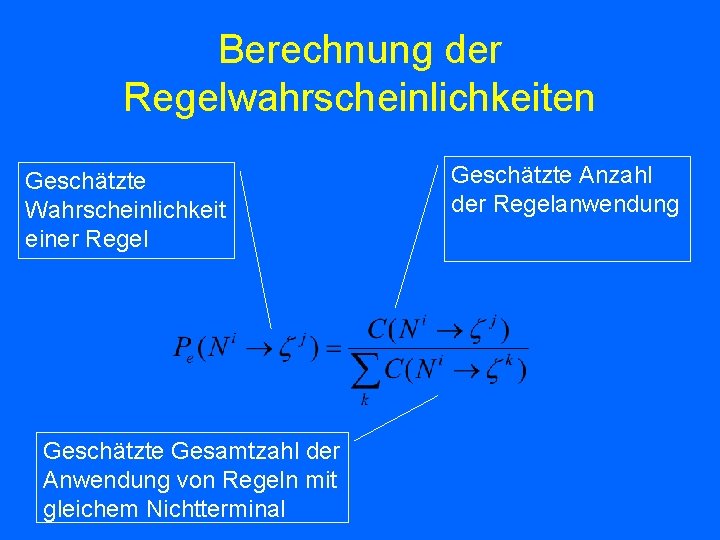

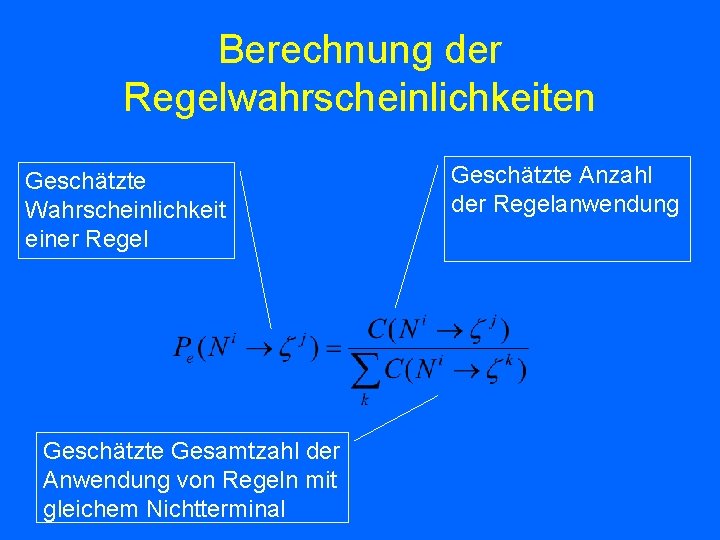

Berechnung der Regelwahrscheinlichkeiten Geschätzte Wahrscheinlichkeit einer Regel Geschätzte Gesamtzahl der Anwendung von Regeln mit gleichem Nichtterminal Geschätzte Anzahl der Regelanwendung

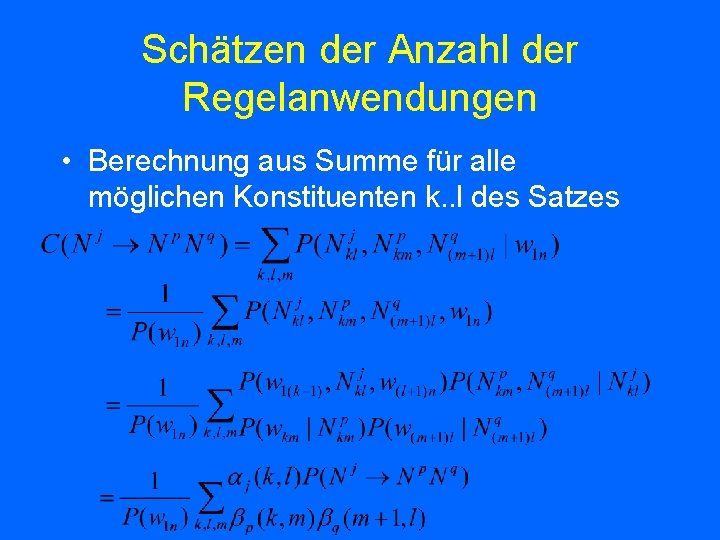

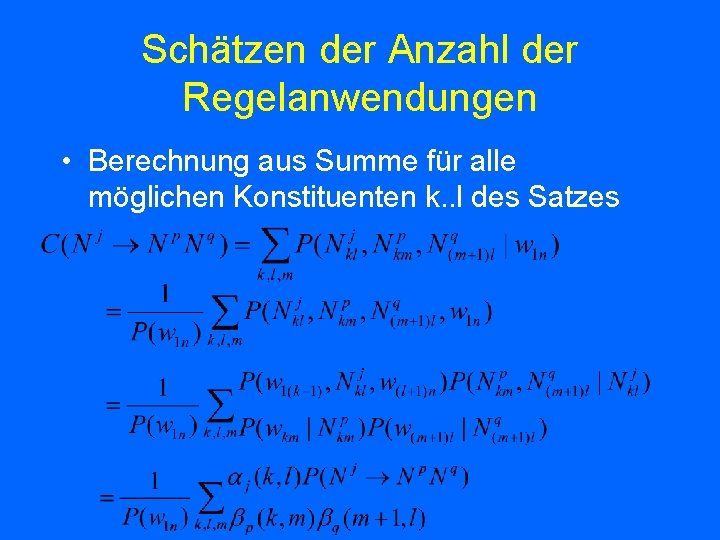

Schätzen der Anzahl der Regelanwendungen • Berechnung aus Summe für alle möglichen Konstituenten k. . l des Satzes

Orientierungsfolie • • Einführung Innen- und Außenwahrscheinlichkeiten Trainingsalgorithmus Schlusswort – Eigenschaften und Bedeutung von SKFGn und Inside/Outside-Algorithmus

Bedeutung von SKFGn • Wahrscheinlichkeitsgrade für Ambiguitäten – probabilistisches Sprachmodell • Robustheit • Bewertung ausschließlich über Struktur, keine lexikalischen Abhängigkeiten (kontextfrei) • Kombinationsmöglichkeit mit n-Gramm. Modellen • Lernmöglichkeiten bei entsprechendem Korpus

Eigenschaften des I/O-Algorithmus • Komplexität O(m 3 n 3) (n: Satzlänge, m: #NT) • Lokale Maxima; Initialisierung einflussreich • Mehr Nichtterminale zum Lernen benötigt als zur manuellen Beschreibung (experimentell: 3 n) • Gelernte Grammatik widerspiegelt nicht unbedingt die natürliche Struktur der Sprache • Präterminale erhöhen Chance auf Erhalt der Struktur und vereinfachen das Schätzverfahren

Stochastische unabhängigkeit

Stochastische unabhängigkeit Ergodischer prozess

Ergodischer prozess Laplace multiplikationssatz

Laplace multiplikationssatz Formel von bernoulli erklärung

Formel von bernoulli erklärung Satz totale wahrscheinlichkeit

Satz totale wahrscheinlichkeit Gliederung definition

Gliederung definition Fallstudie gliederung beispiel

Fallstudie gliederung beispiel W-seminar bayern gliederung

W-seminar bayern gliederung Gliederung in niveaus

Gliederung in niveaus Weg der erkenntnisgewinnung

Weg der erkenntnisgewinnung Wilhelm conrad röntgen lebenslauf

Wilhelm conrad röntgen lebenslauf Gliederung facharbeit

Gliederung facharbeit Gliederung gif

Gliederung gif Argumentation gliederung

Argumentation gliederung Biografie gliederung

Biografie gliederung Volxbibel matthäus 5

Volxbibel matthäus 5 Mitarbeiterbindung gliederung

Mitarbeiterbindung gliederung Projektstrukturplan gliederung

Projektstrukturplan gliederung Gliederung qualitative forschung

Gliederung qualitative forschung Funktionsorientierte gliederung

Funktionsorientierte gliederung Motivationsschreiben gliederung

Motivationsschreiben gliederung Gliederung bilanz ugb

Gliederung bilanz ugb Deutungshypothese leise begleitung

Deutungshypothese leise begleitung Gliederung des wortschatzes

Gliederung des wortschatzes Gliederung mathematik

Gliederung mathematik Varianzzerlegung

Varianzzerlegung Gliederung biographie

Gliederung biographie