Introduction aux rseaux de neurones CHAPITRE 2 Intelligence

- Slides: 35

Introduction aux réseaux de neurones CHAPITRE 2

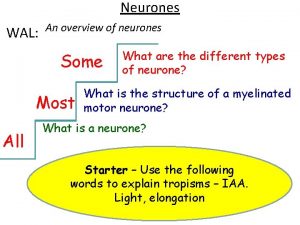

Intelligence et Neurone Cardiocentrisme : Depuis l’antiquité l’humanité a presque toujours associé la pensée, l’intelligence, les émotions au cœur Aristote : « le cerveau est un organe de refroidissement »

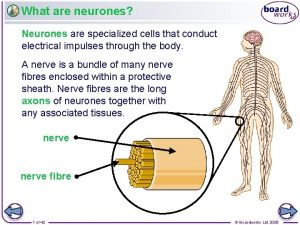

Intelligence et Neurone Cérébrocentrisme : avec la révolution scientifique les ancienes connaissances sont remises en question Découverte de l’influx nerveux

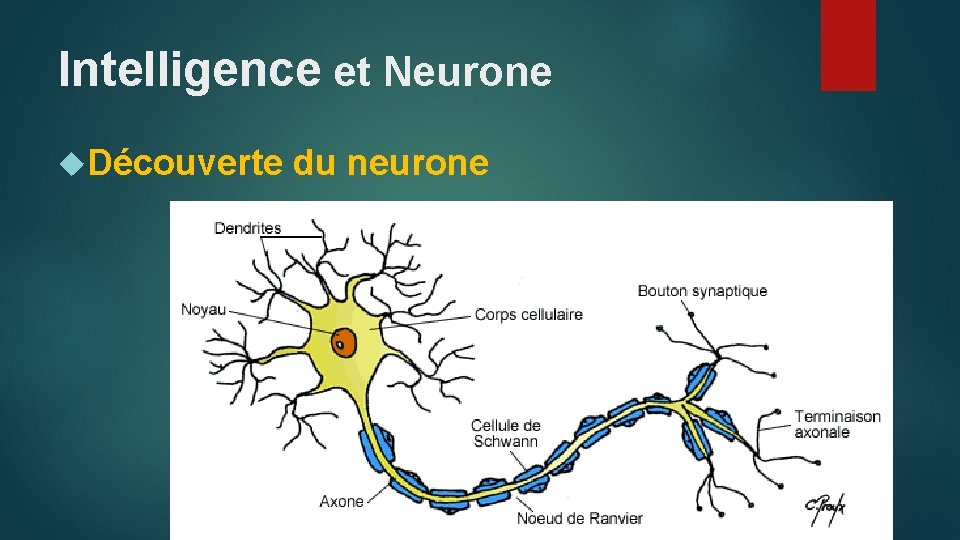

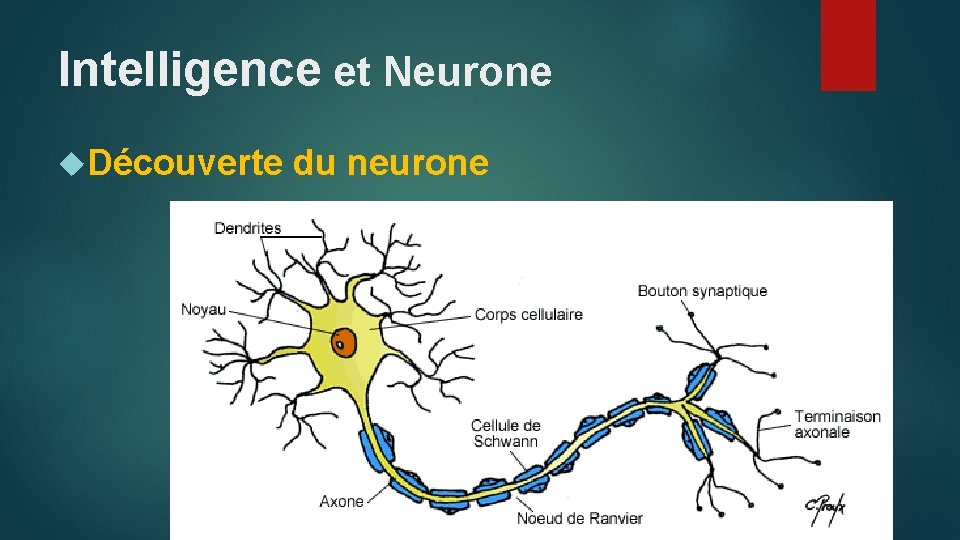

Intelligence et Neurone Découverte du neurone

Intelligence et Neurone Le cerveau est fait 100 milliards de neurones L’activité cérébrale laisse émerger de la conscience

Dans ce chapitre S’inspirer Ce du cerveau chapitre présente les réseaux de neurones, largement utilisés comme modèle pour l’apprentissage automatique.

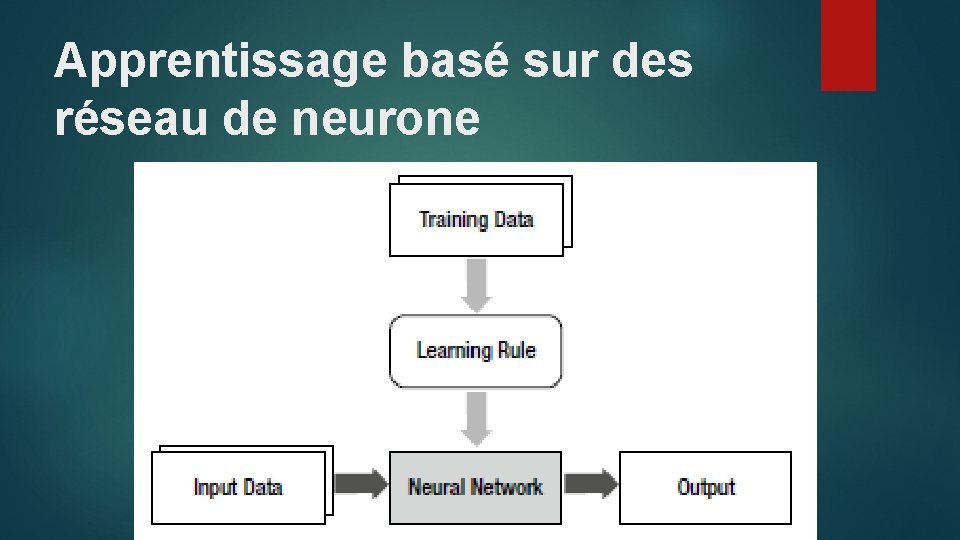

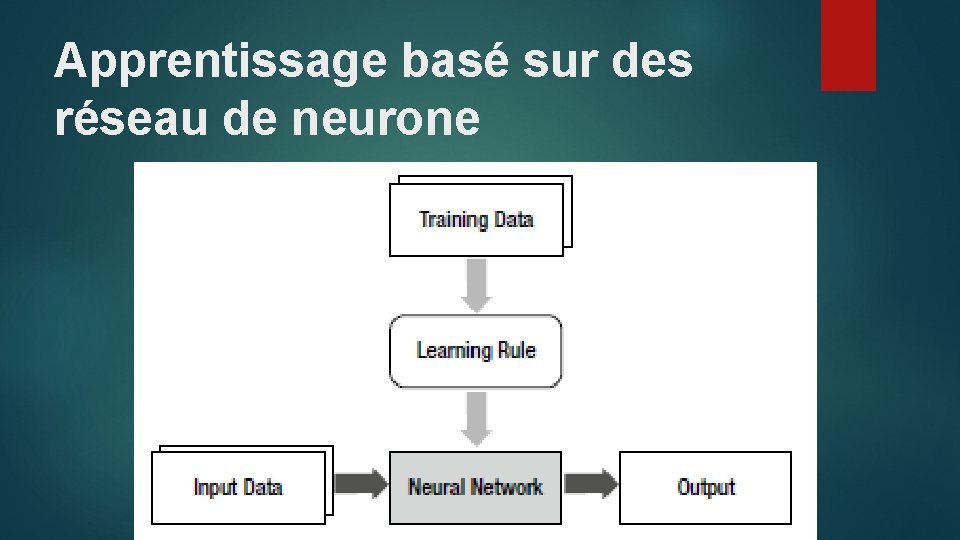

Apprentissage basé sur des réseau de neurone

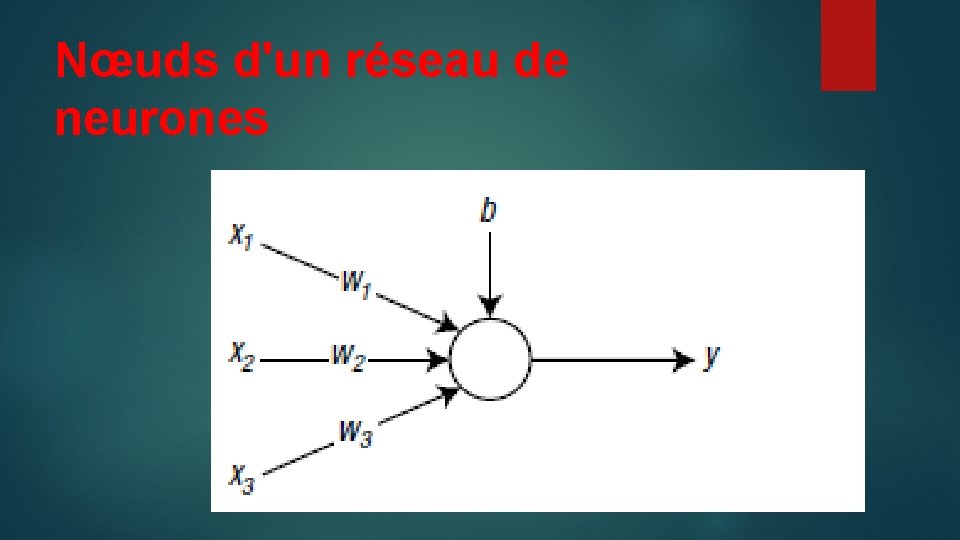

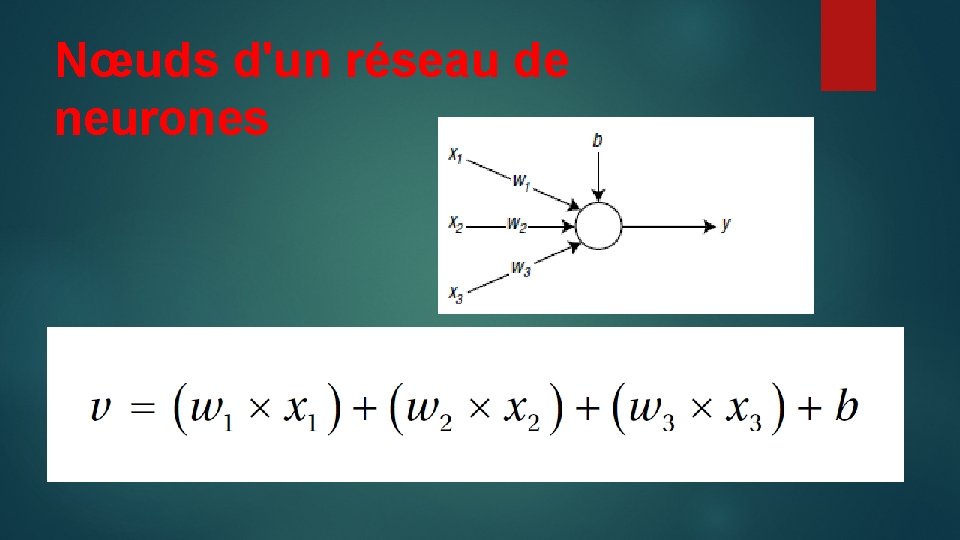

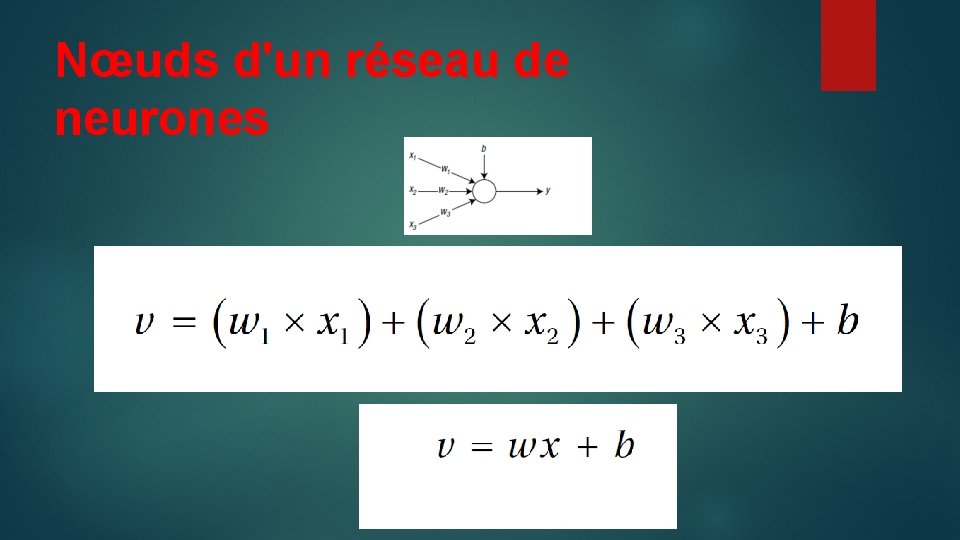

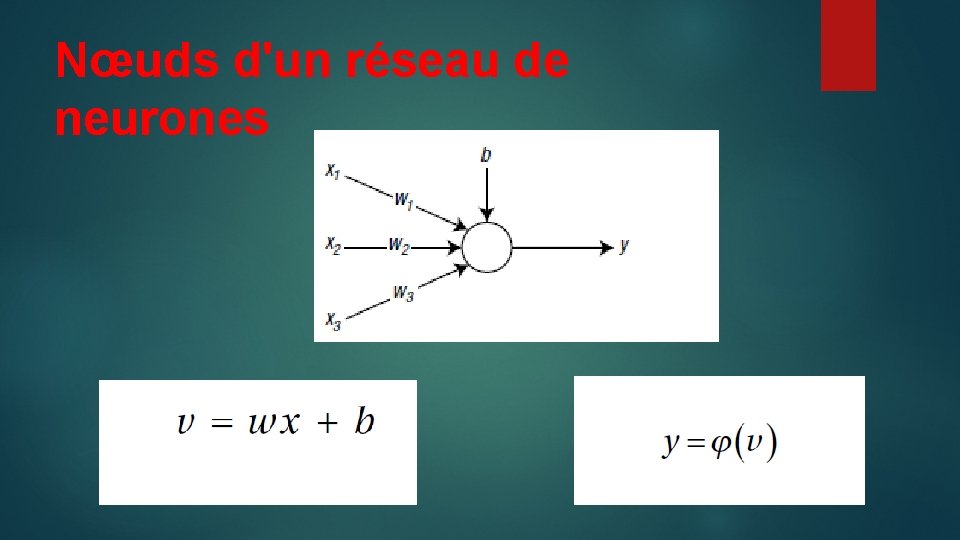

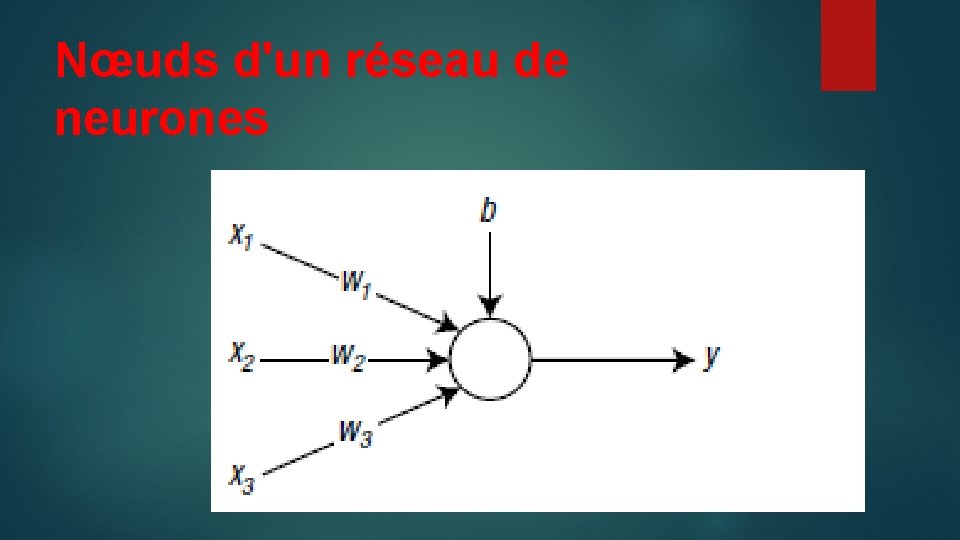

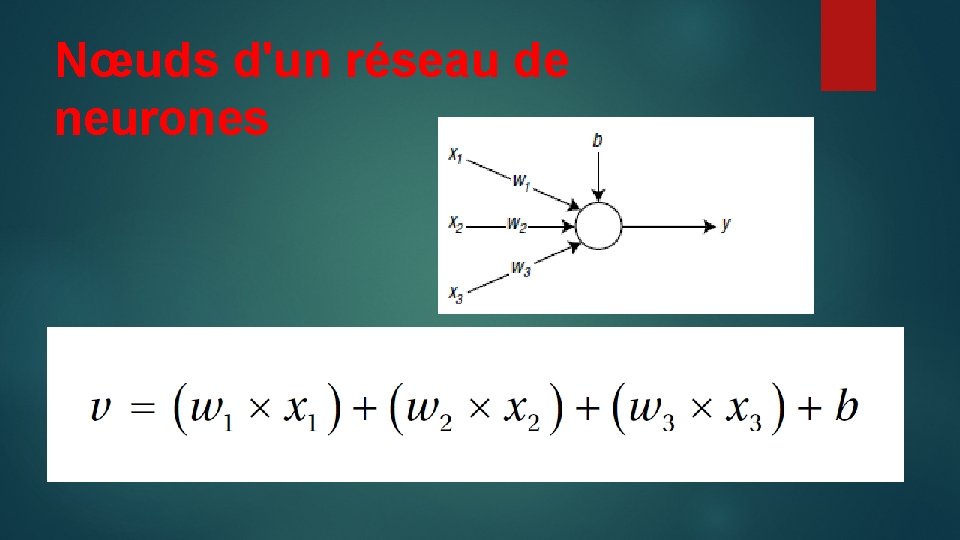

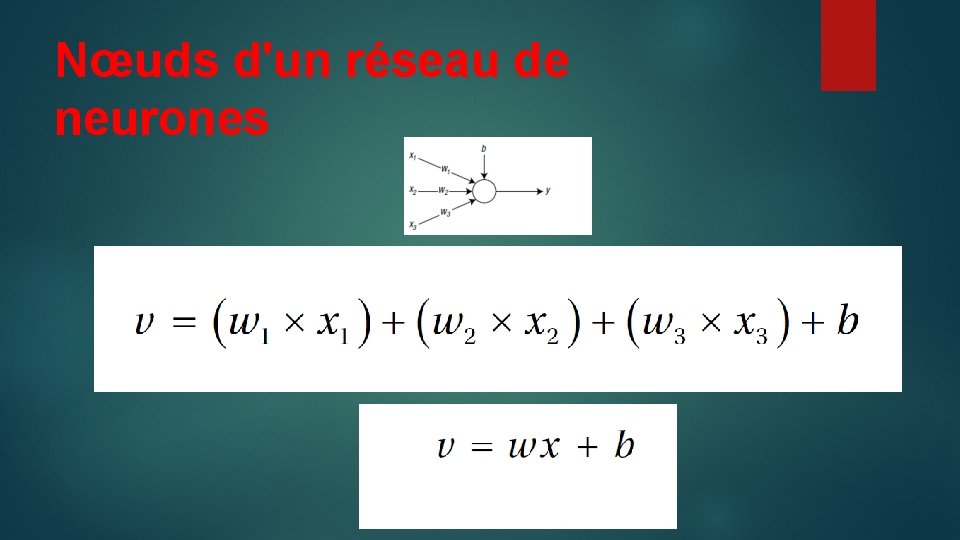

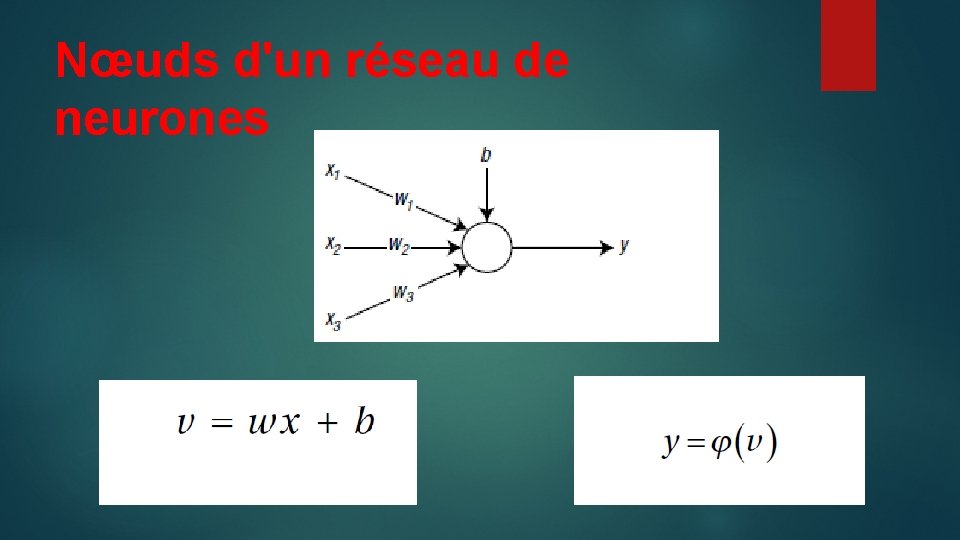

Nœuds d'un réseau de neurones

Nœuds d'un réseau de neurones

Nœuds d'un réseau de neurones

Nœuds d'un réseau de neurones

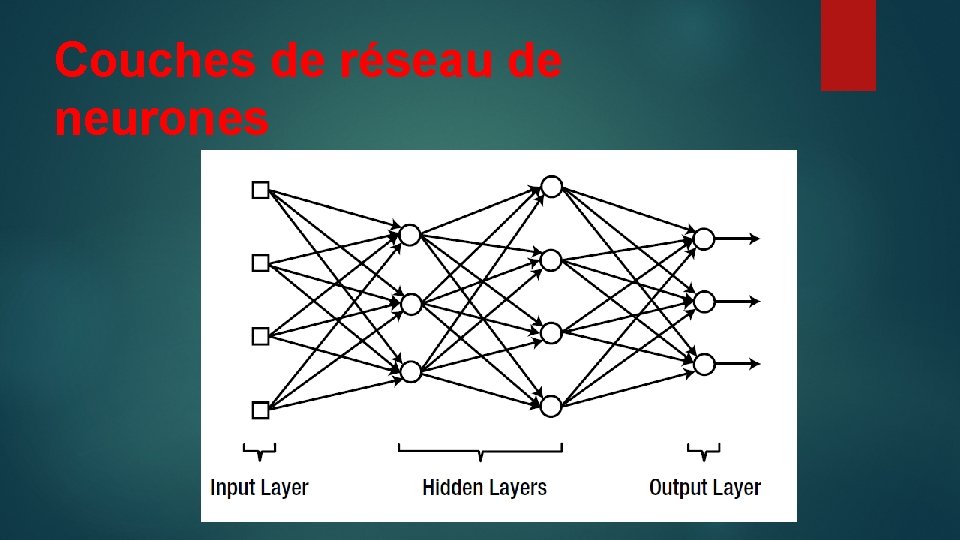

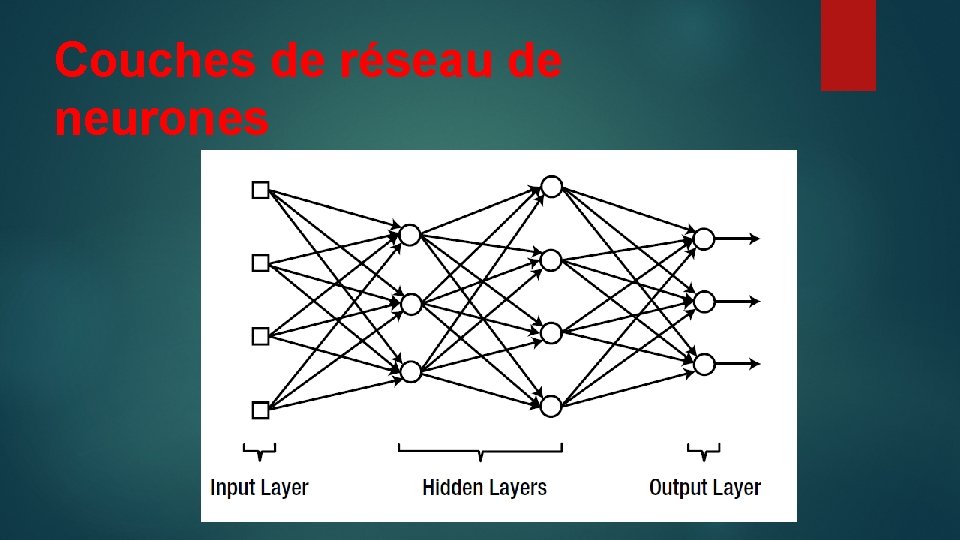

Couches de réseau de neurones

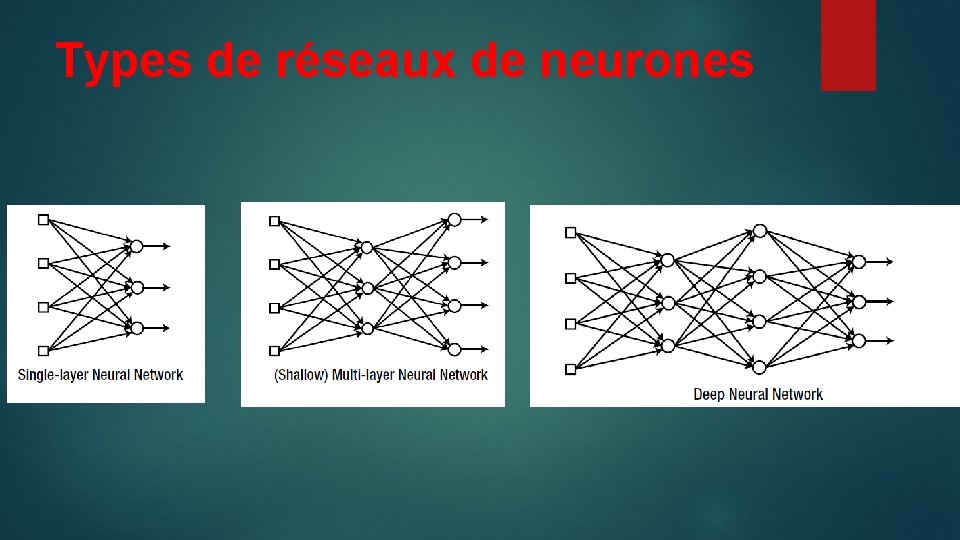

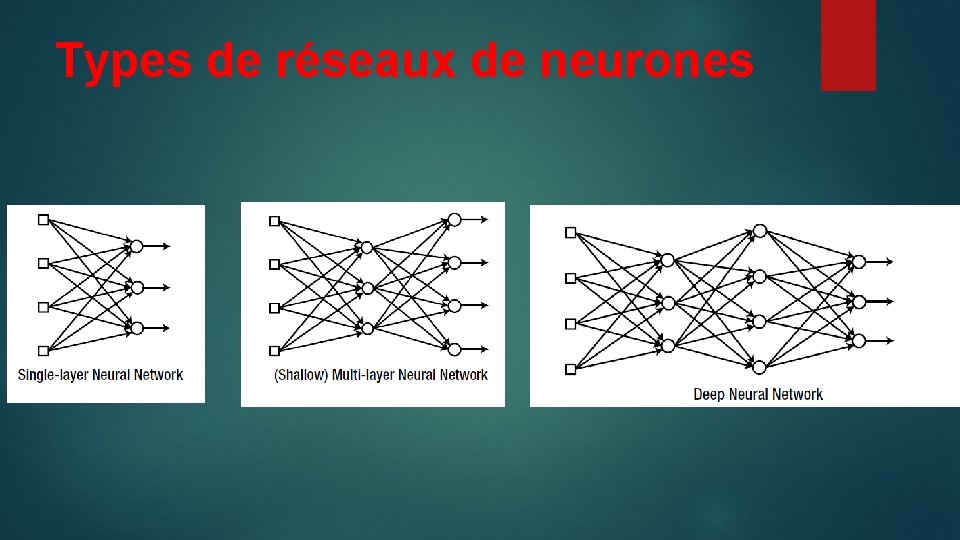

Types de réseaux de neurones

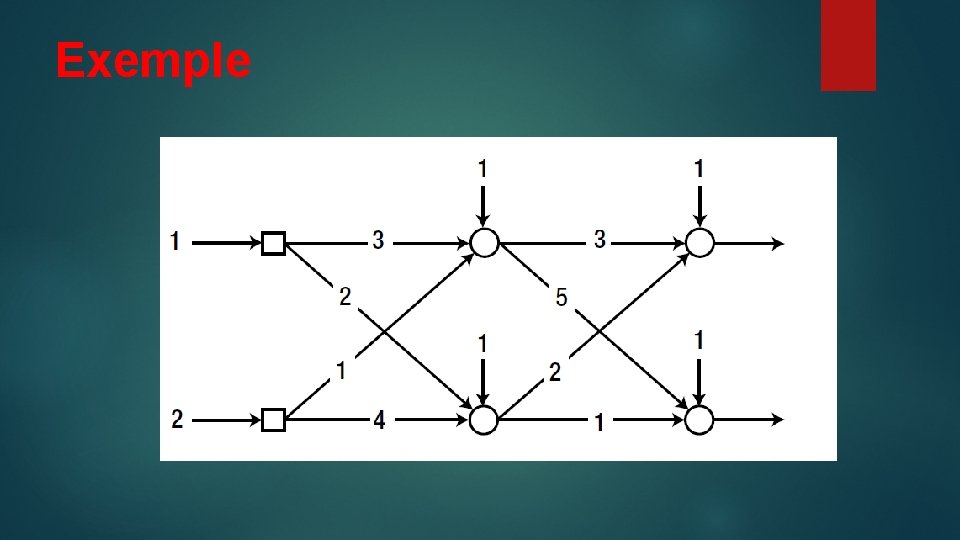

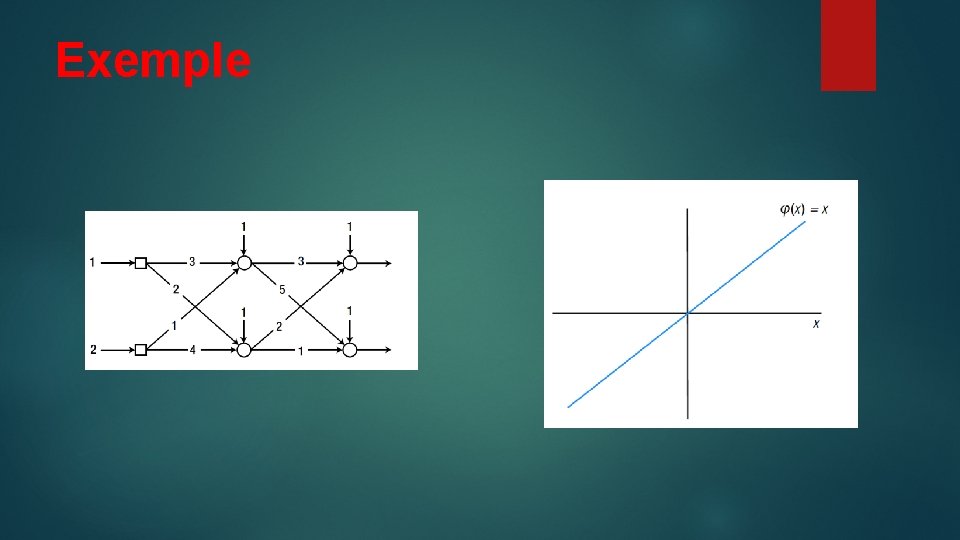

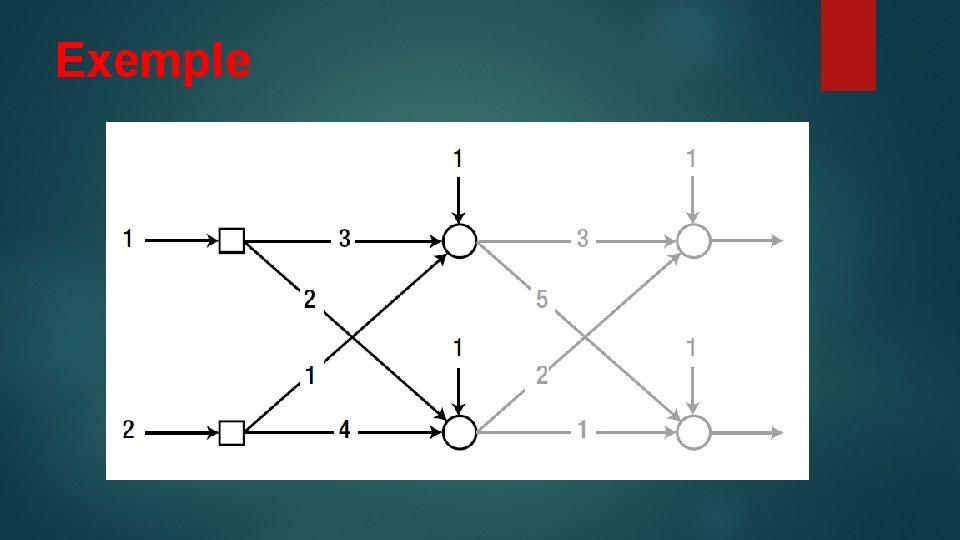

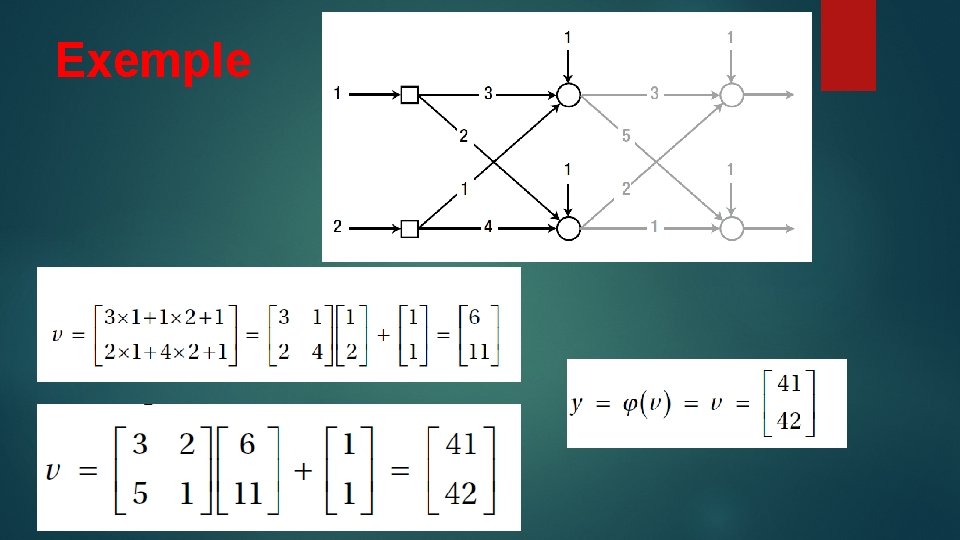

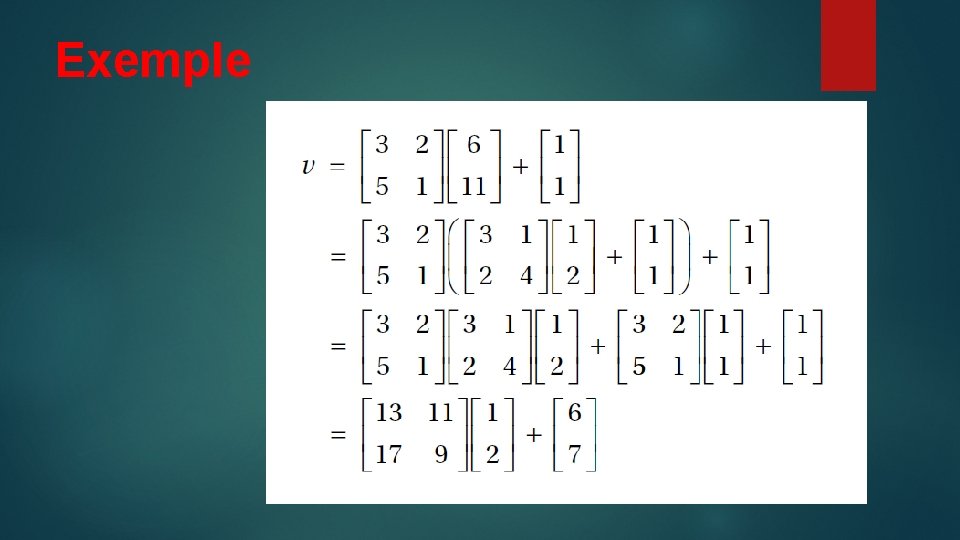

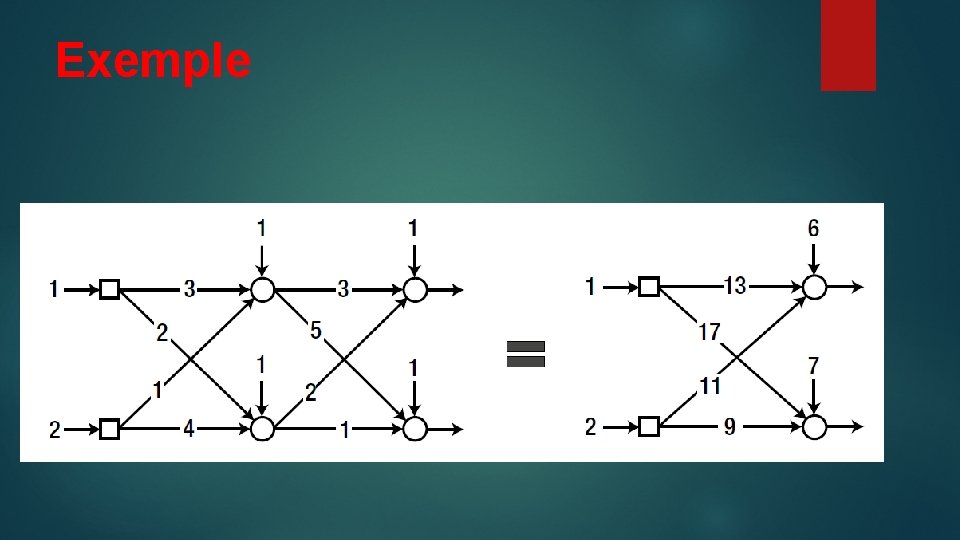

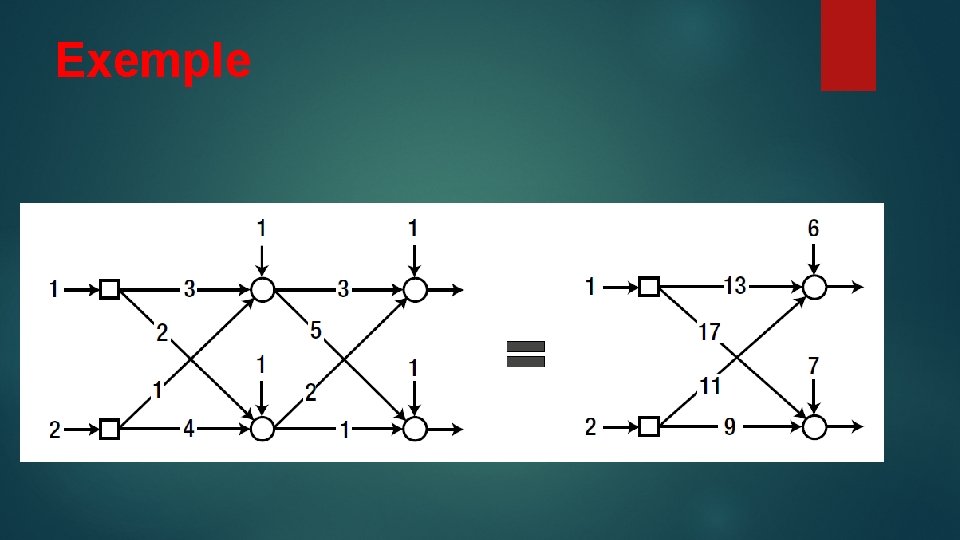

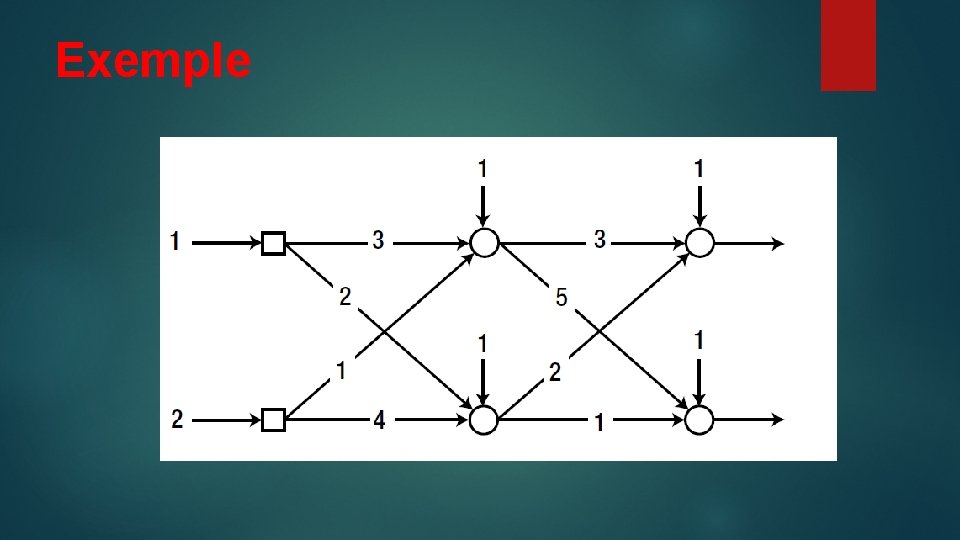

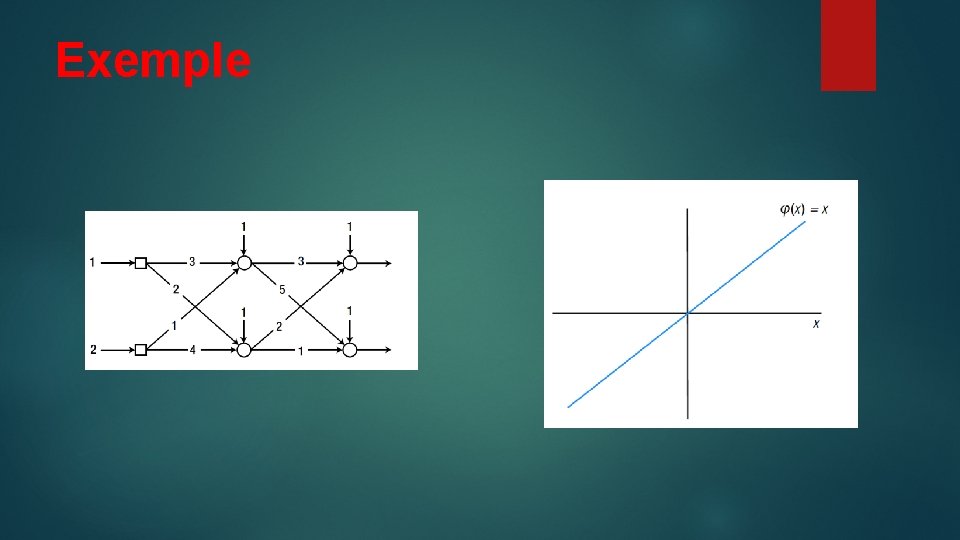

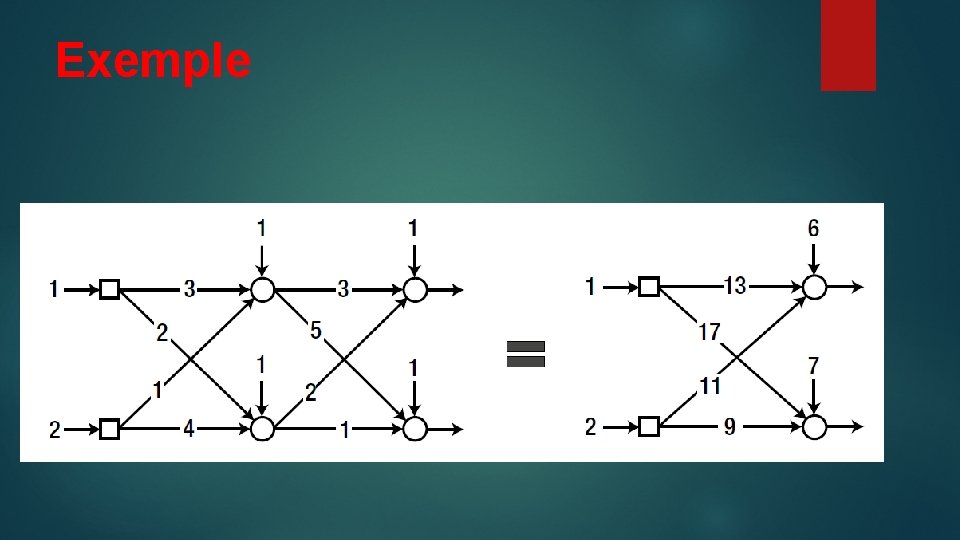

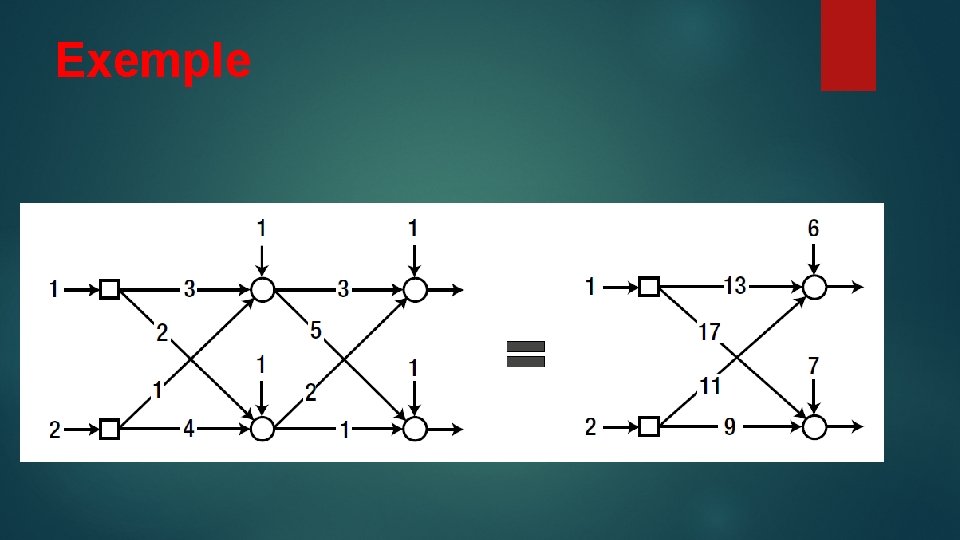

Exemple

Exemple

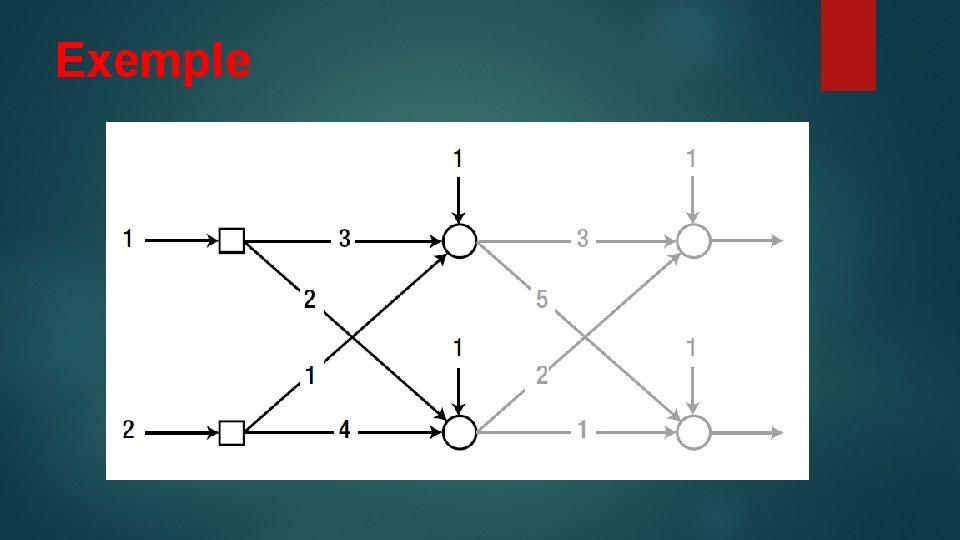

Exemple

Exemple

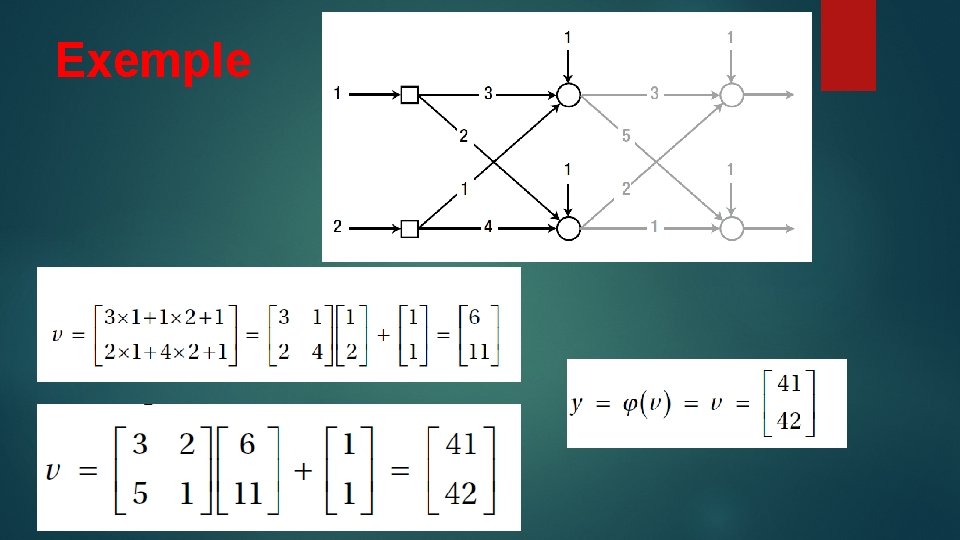

Exemple

Exemple

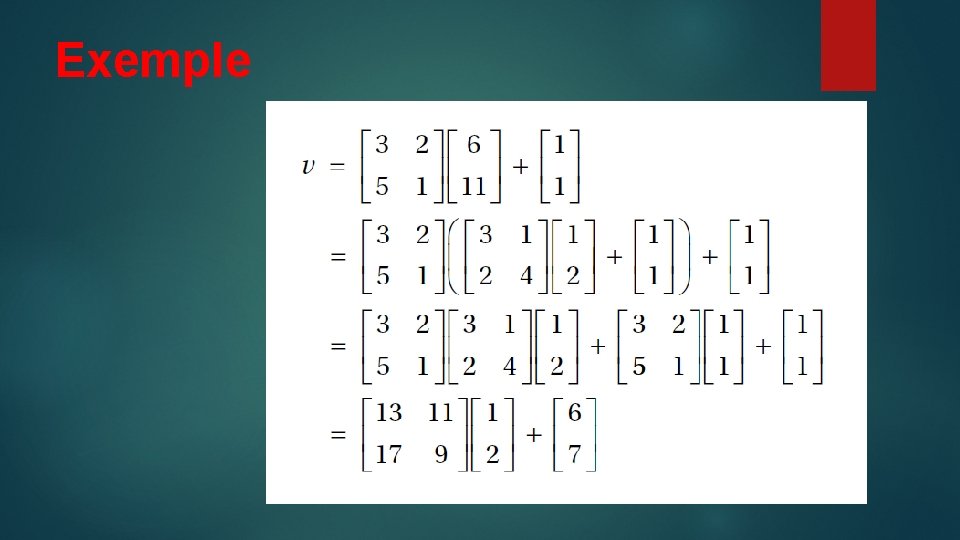

Exemple

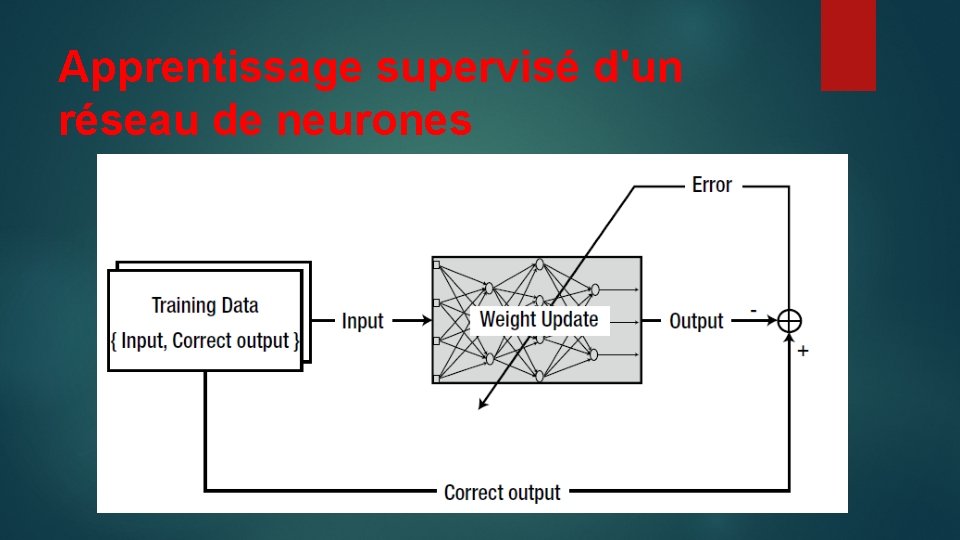

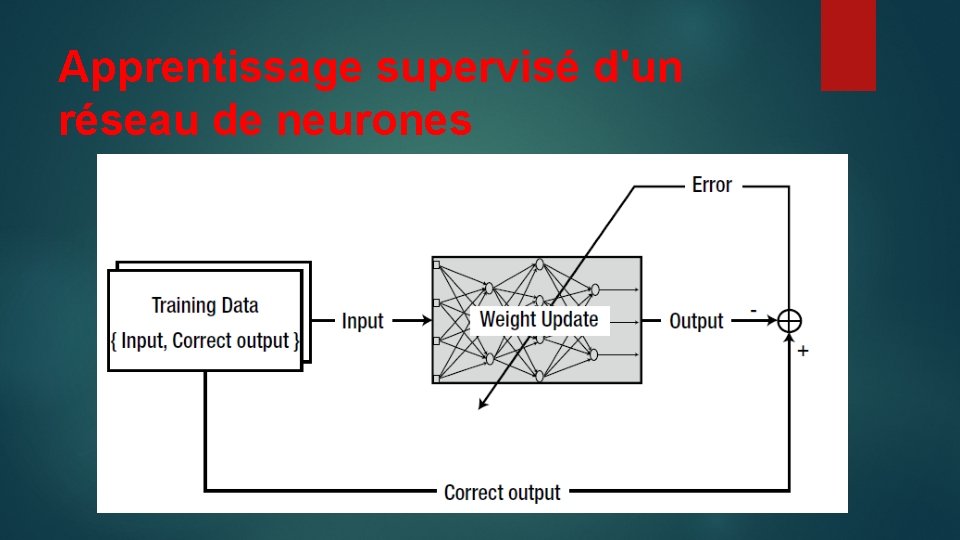

Apprentissage supervisé d'un réseau de neurones

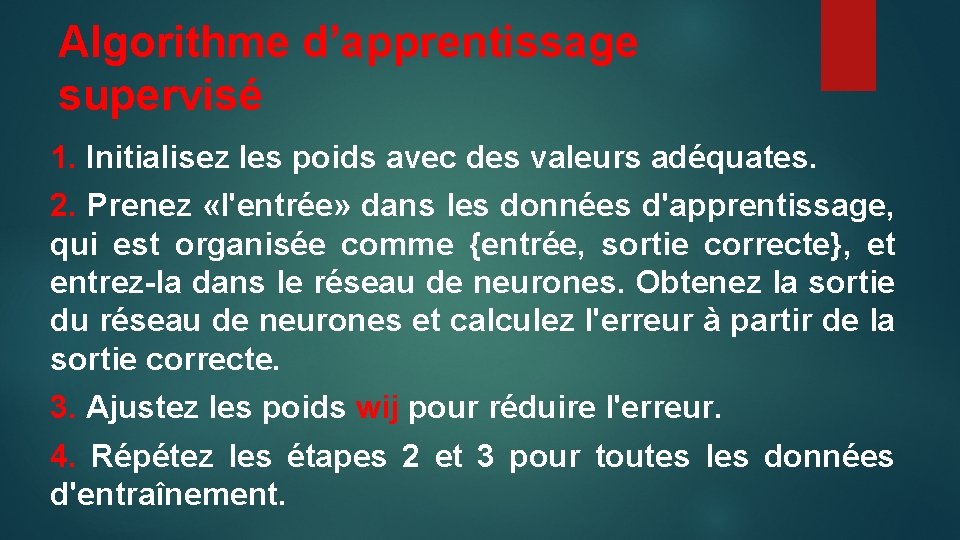

Algorithme d’apprentissage supervisé 1. Initialisez les poids avec des valeurs adéquates. 2. Prenez «l'entrée» dans les données d'apprentissage, qui est organisée comme {entrée, sortie correcte}, et entrez-la dans le réseau de neurones. Obtenez la sortie du réseau de neurones et calculez l'erreur à partir de la sortie correcte. 3. Ajustez les poids wij pour réduire l'erreur. 4. Répétez les étapes 2 et 3 pour toutes les données d'entraînement.

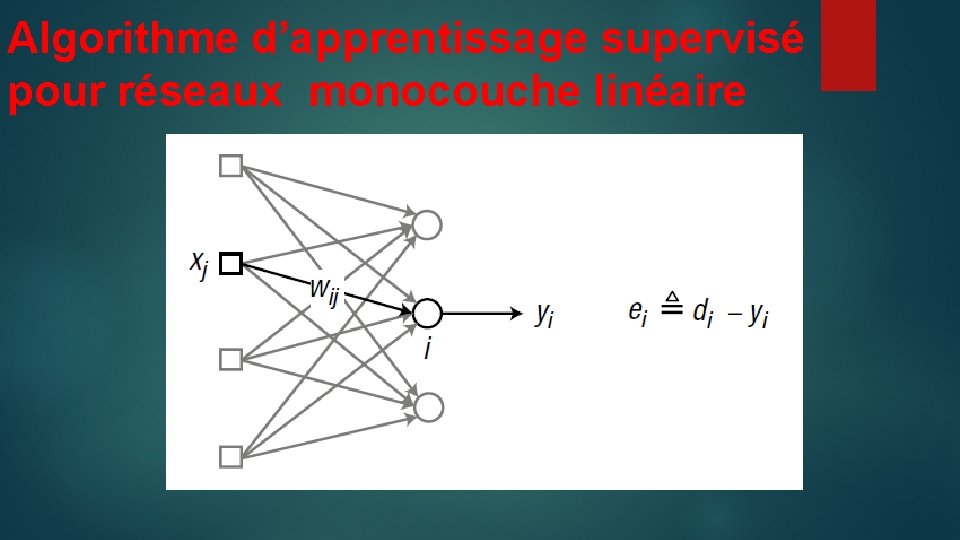

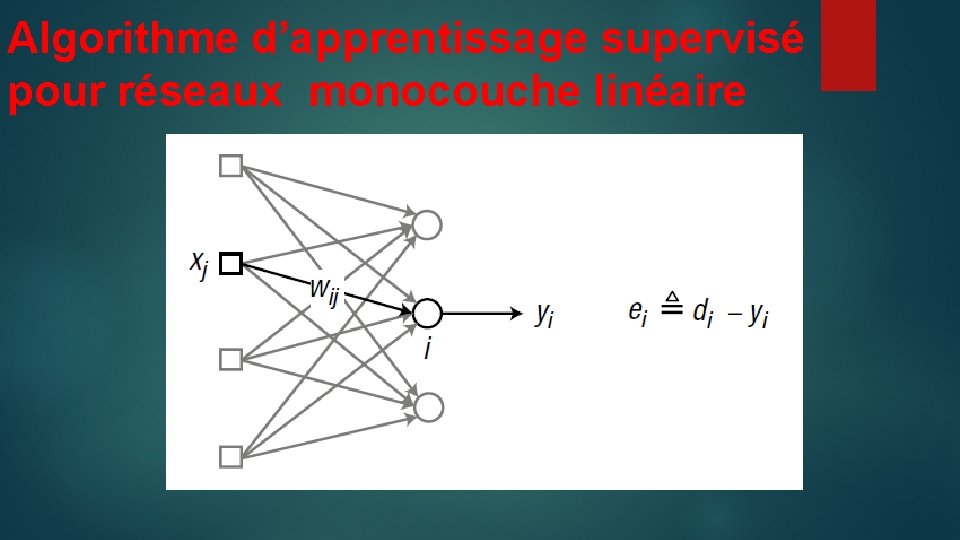

Algorithme d’apprentissage supervisé pour réseaux monocouche linéaire

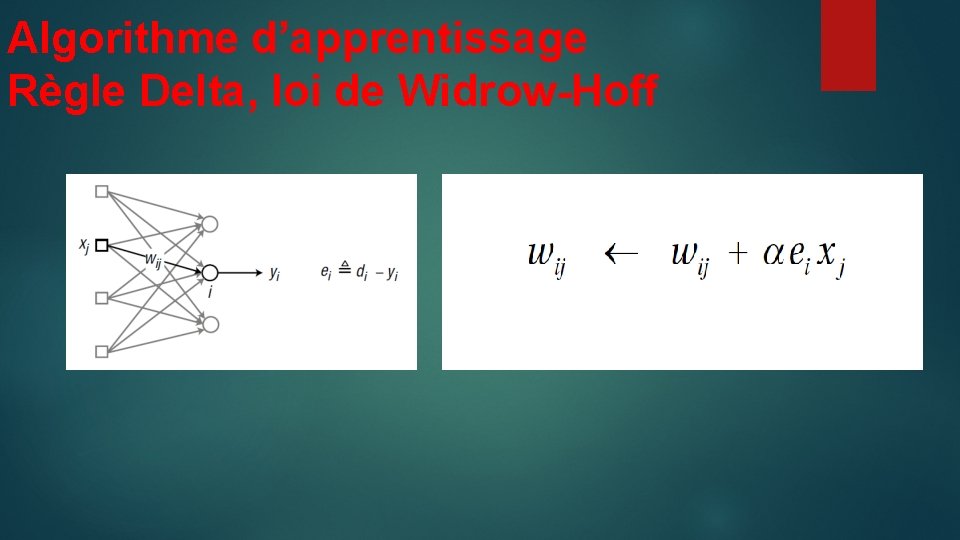

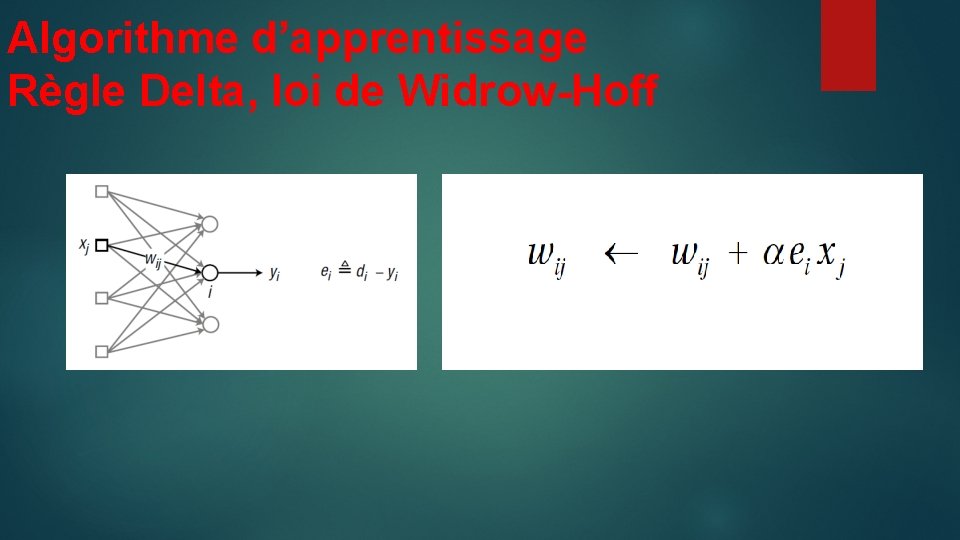

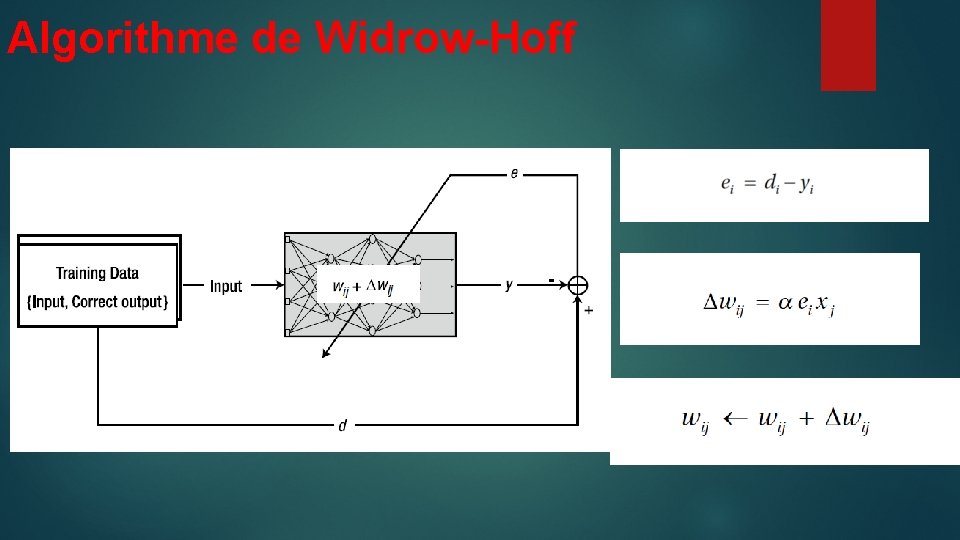

Algorithme d’apprentissage Règle Delta, loi de Widrow-Hoff

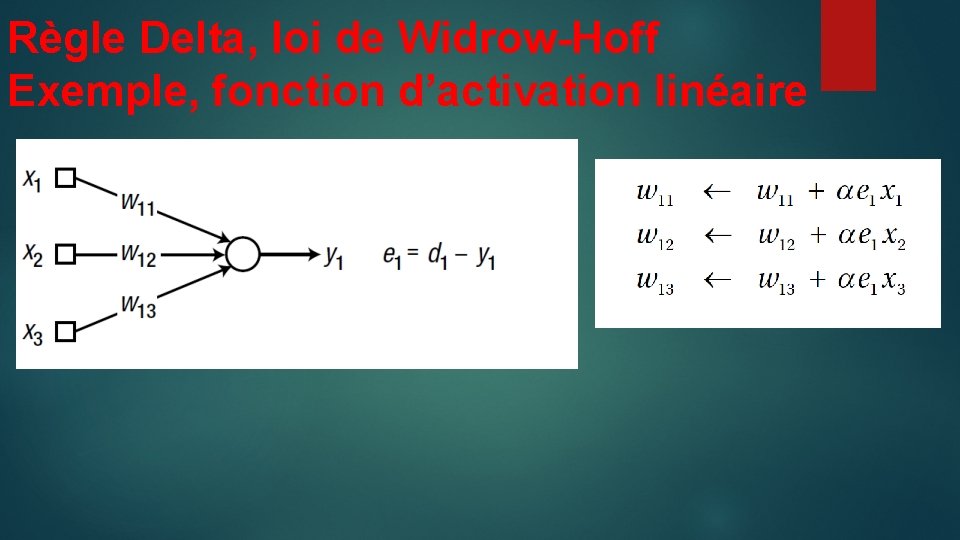

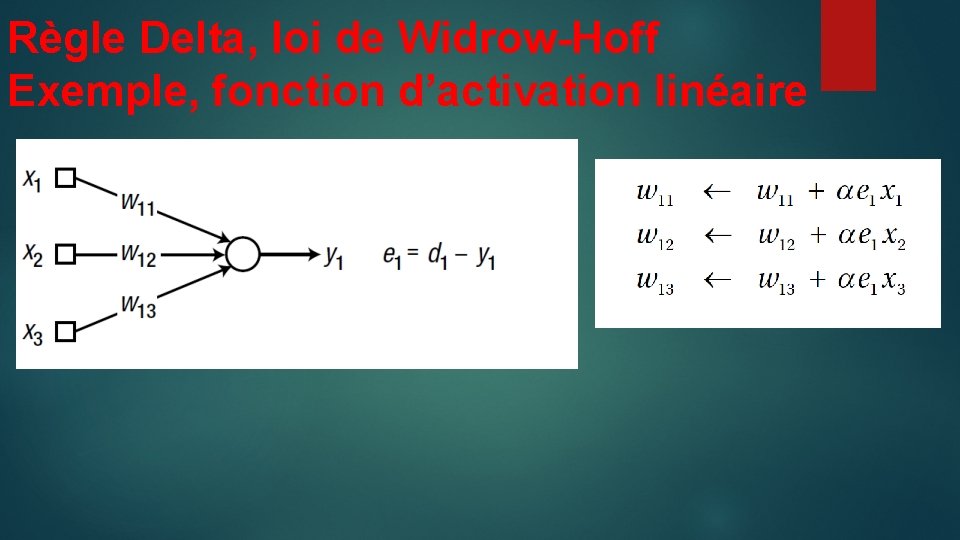

Règle Delta, loi de Widrow-Hoff Exemple, fonction d’activation linéaire

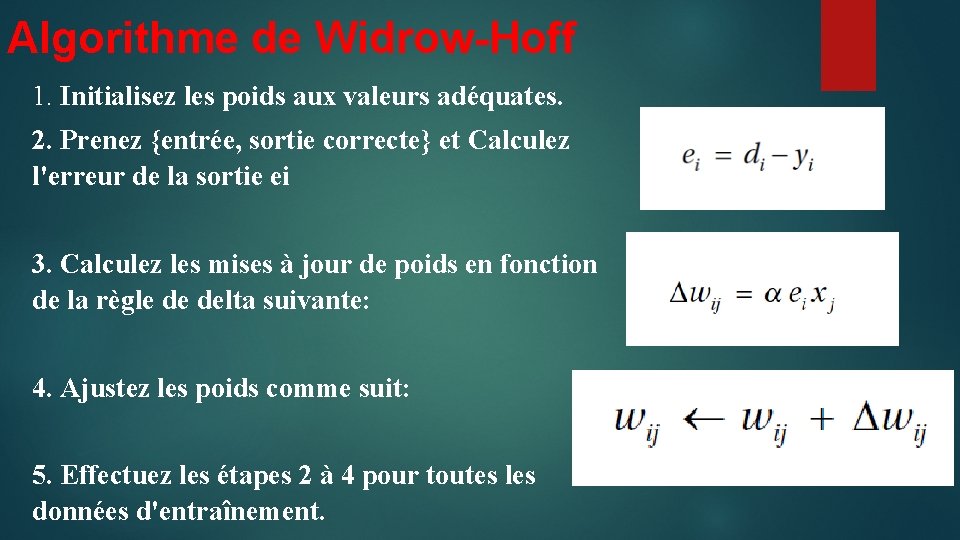

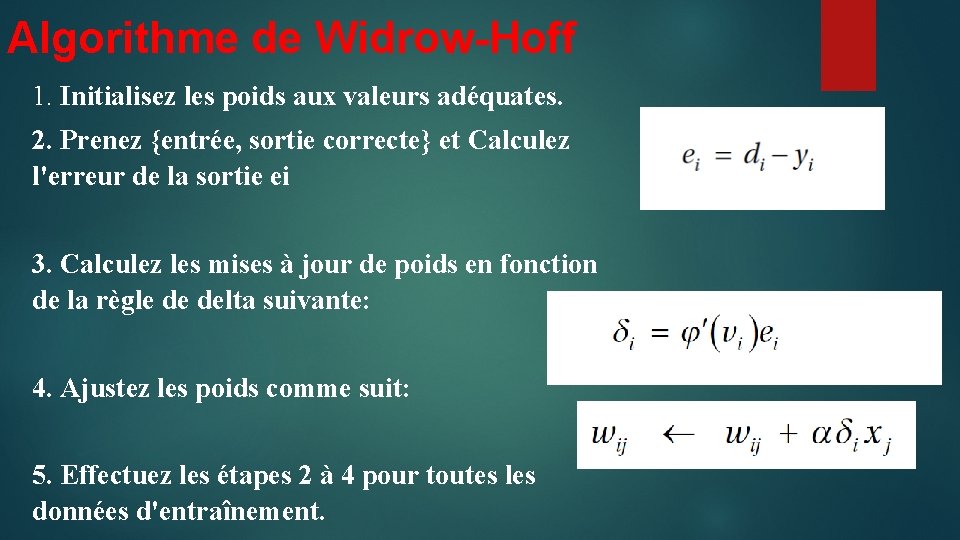

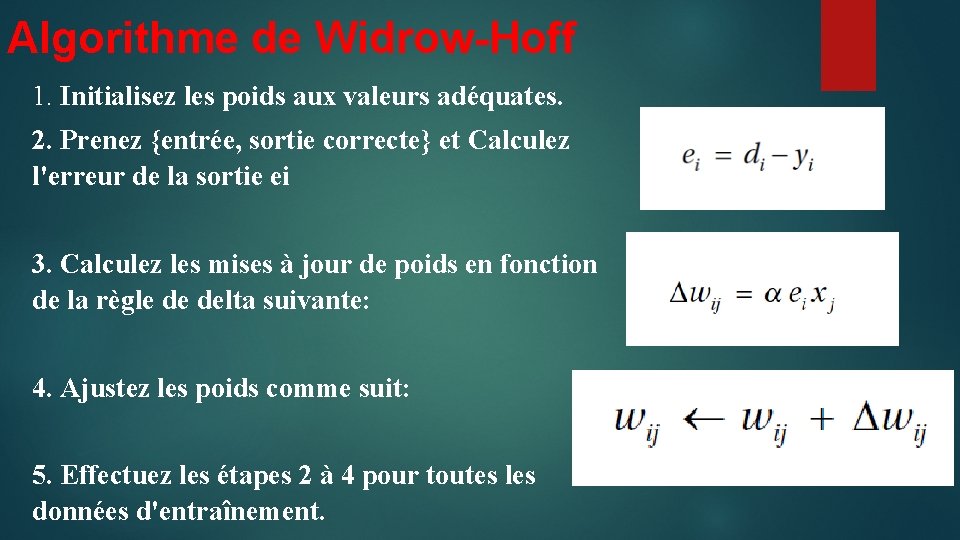

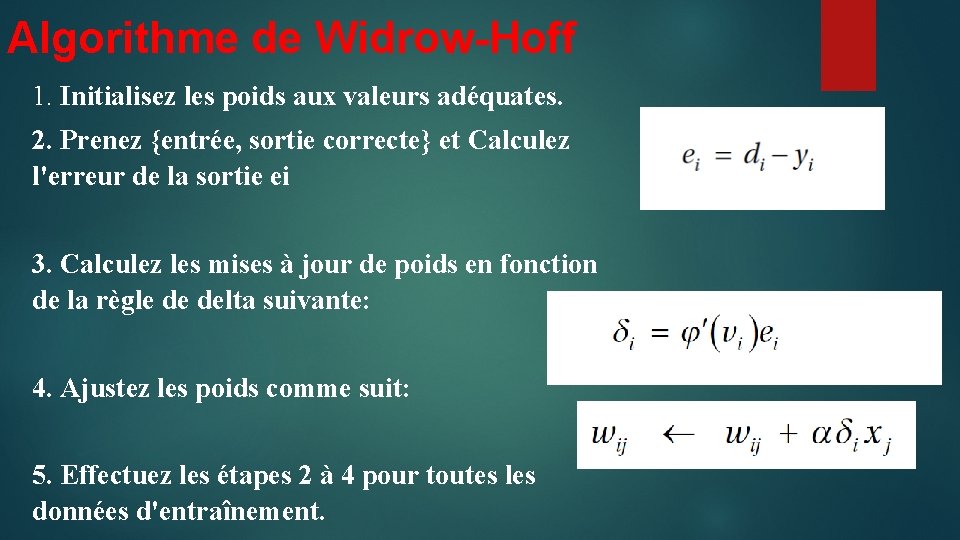

Algorithme de Widrow-Hoff 1. Initialisez les poids aux valeurs adéquates. 2. Prenez {entrée, sortie correcte} et Calculez l'erreur de la sortie ei 3. Calculez les mises à jour de poids en fonction de la règle de delta suivante: 4. Ajustez les poids comme suit: 5. Effectuez les étapes 2 à 4 pour toutes les données d'entraînement.

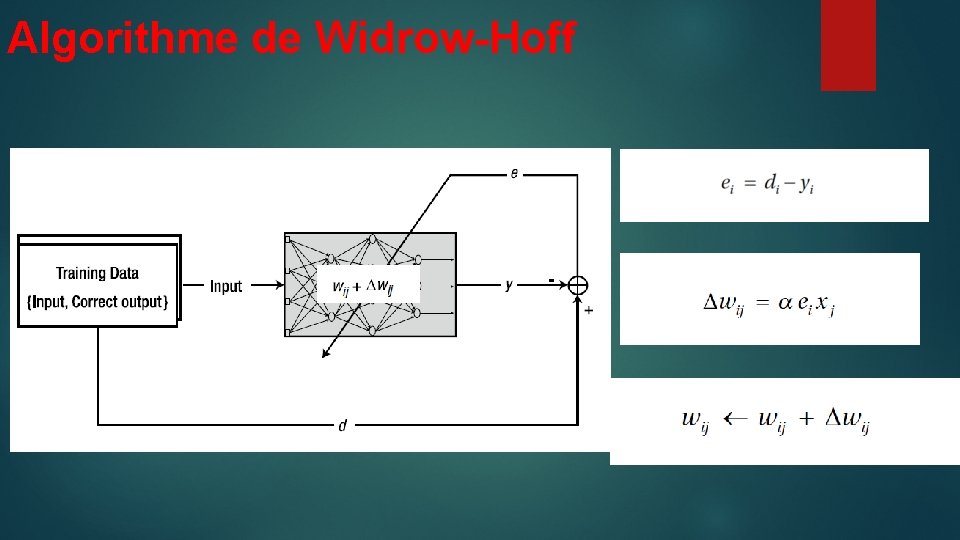

Algorithme de Widrow-Hoff

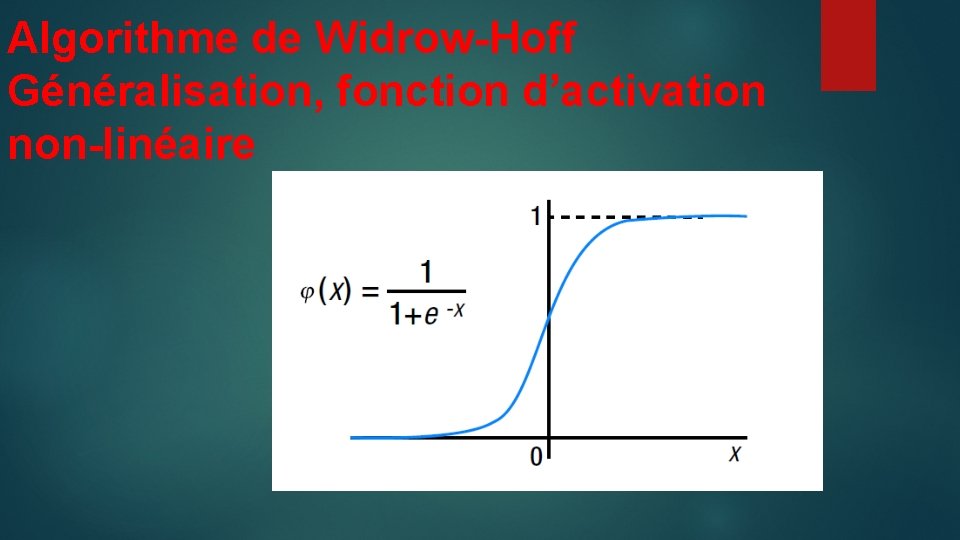

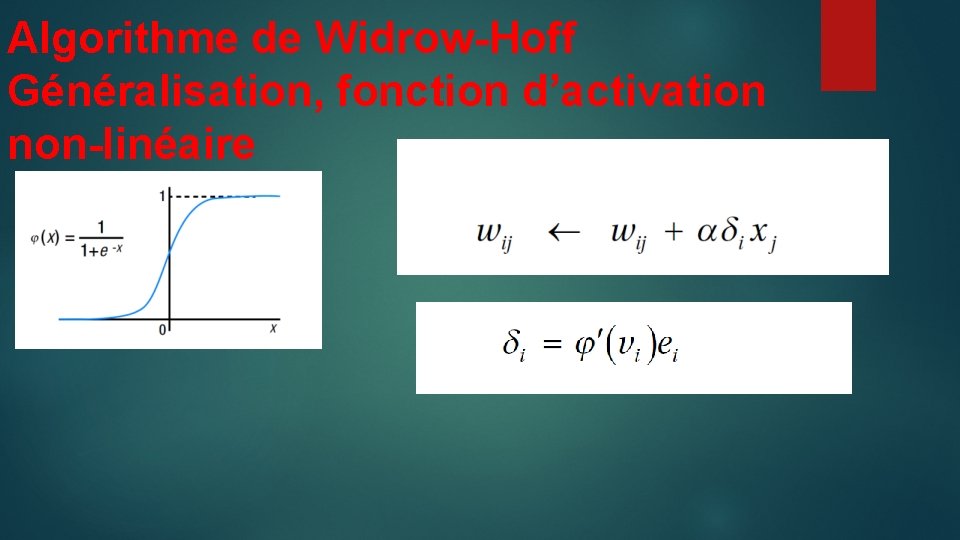

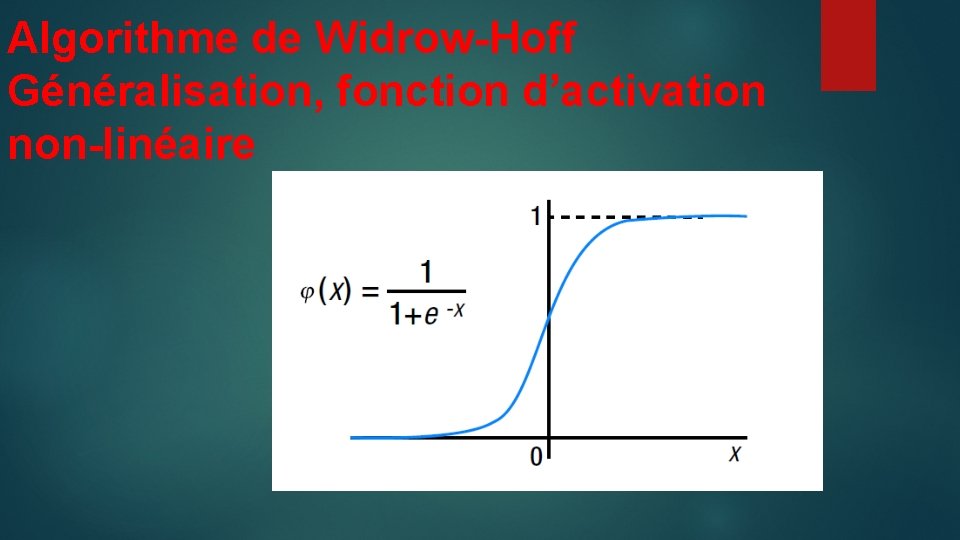

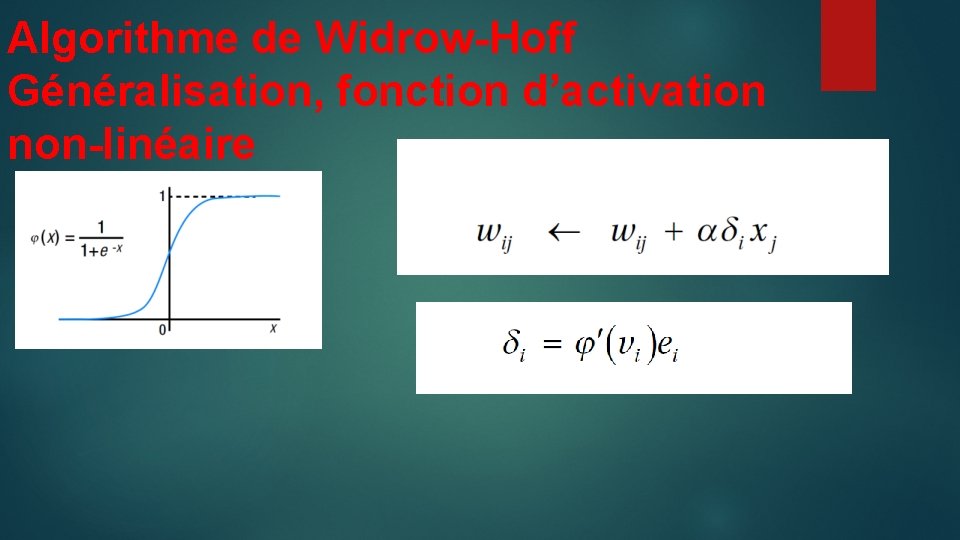

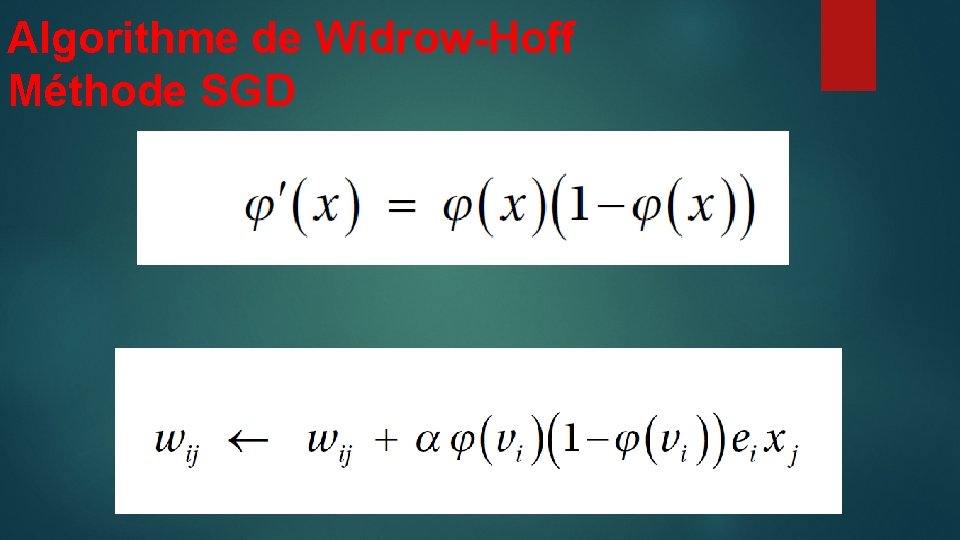

Algorithme de Widrow-Hoff Généralisation, fonction d’activation non-linéaire

Algorithme de Widrow-Hoff Généralisation, fonction d’activation non-linéaire

Algorithme de Widrow-Hoff 1. Initialisez les poids aux valeurs adéquates. 2. Prenez {entrée, sortie correcte} et Calculez l'erreur de la sortie ei 3. Calculez les mises à jour de poids en fonction de la règle de delta suivante: 4. Ajustez les poids comme suit: 5. Effectuez les étapes 2 à 4 pour toutes les données d'entraînement.

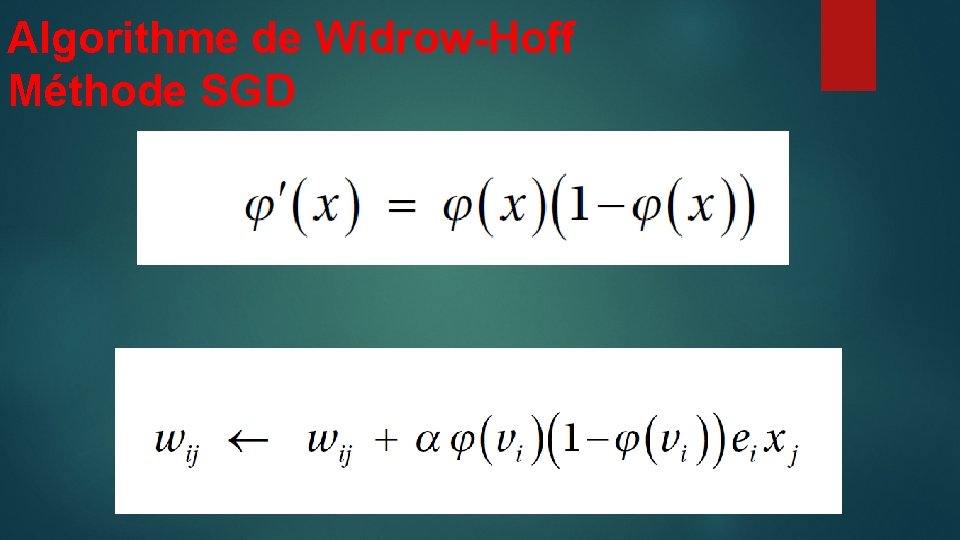

Algorithme de Widrow-Hoff Méthode SGD

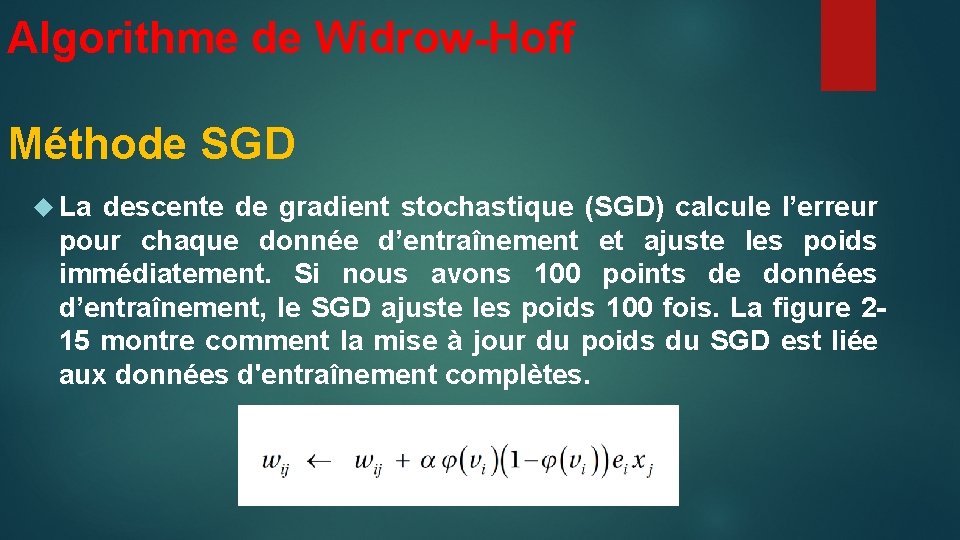

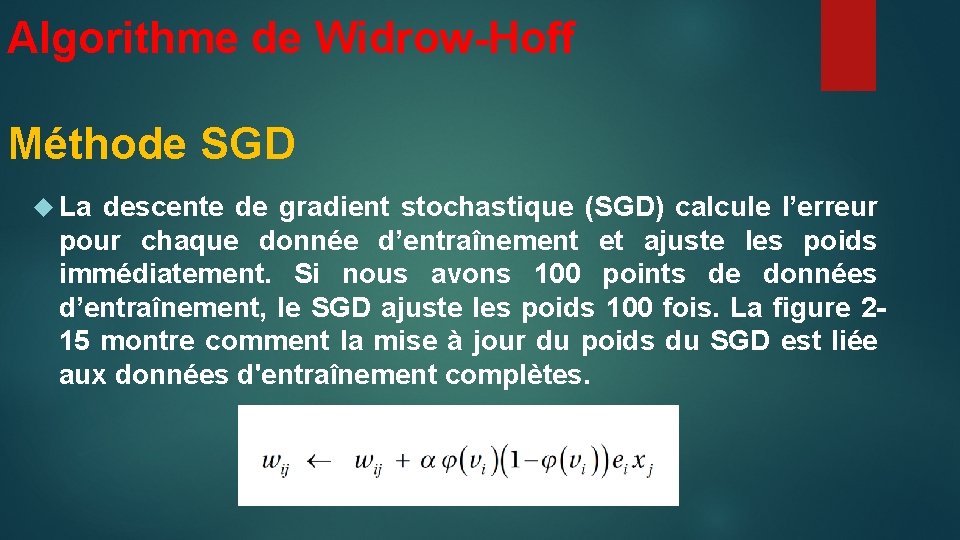

Algorithme de Widrow-Hoff Méthode SGD La descente de gradient stochastique (SGD) calcule l’erreur pour chaque donnée d’entraînement et ajuste les poids immédiatement. Si nous avons 100 points de données d’entraînement, le SGD ajuste les poids 100 fois. La figure 215 montre comment la mise à jour du poids du SGD est liée aux données d'entraînement complètes.

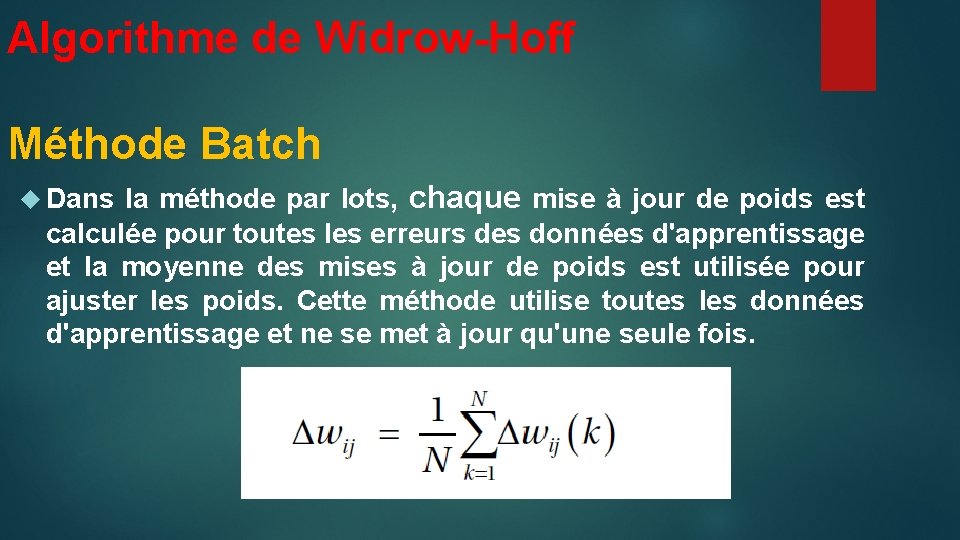

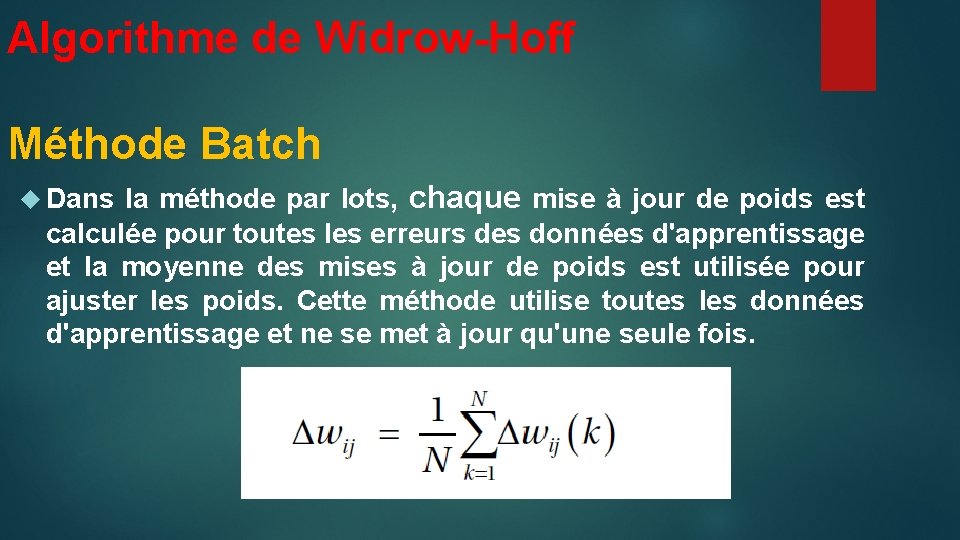

Algorithme de Widrow-Hoff Méthode Batch la méthode par lots, chaque mise à jour de poids est calculée pour toutes les erreurs des données d'apprentissage et la moyenne des mises à jour de poids est utilisée pour ajuster les poids. Cette méthode utilise toutes les données d'apprentissage et ne se met à jour qu'une seule fois. Dans

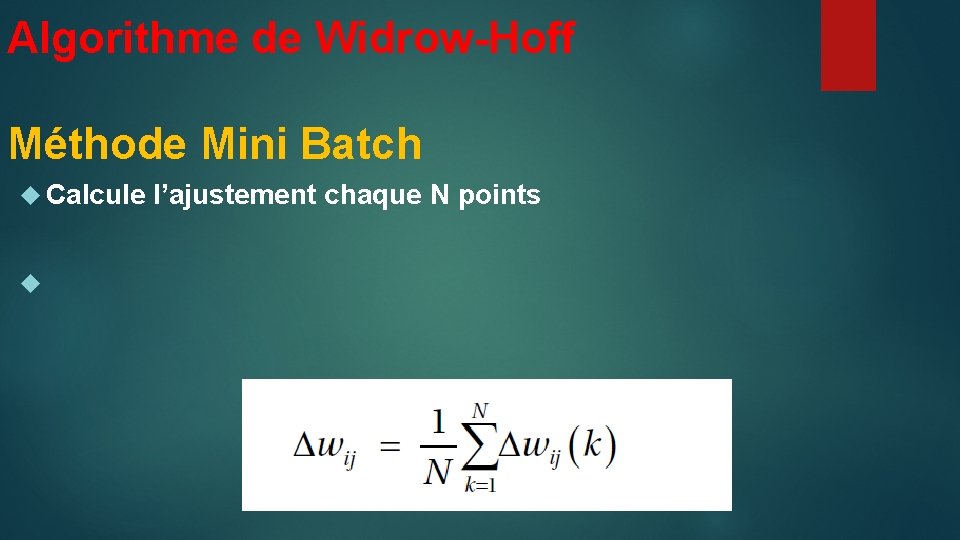

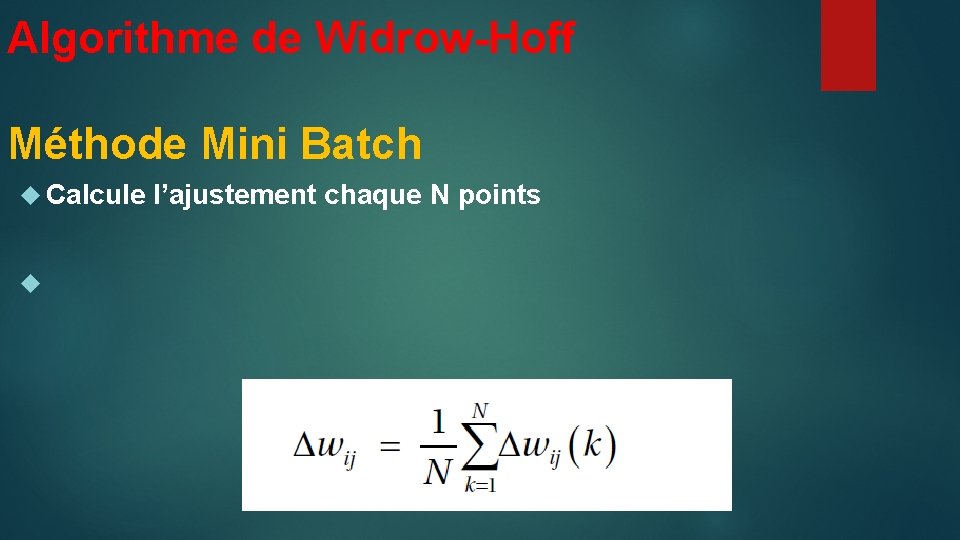

Algorithme de Widrow-Hoff Méthode Mini Batch Calcule l’ajustement chaque N points

Vos Questions !

Cytones des neurones

Cytones des neurones Scurit

Scurit Rseaux sociaux

Rseaux sociaux Rseaux

Rseaux Rseaux

Rseaux Le petit prince résumé

Le petit prince résumé Petit pays chapitre par chapitre

Petit pays chapitre par chapitre Résumé tirez pas sur le scarabée

Résumé tirez pas sur le scarabée Le petit prince chapitre 5

Le petit prince chapitre 5 Introduction aux relations internationales cours

Introduction aux relations internationales cours Cher parent

Cher parent Auxlms

Auxlms Comme un enfant aux yeux

Comme un enfant aux yeux Alleluia christ est vivant il est ressuscité

Alleluia christ est vivant il est ressuscité Vincent van gogh champ de blé aux corbeaux

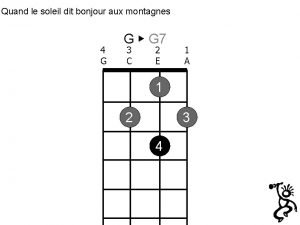

Vincent van gogh champ de blé aux corbeaux Quand le soleil dit bonjour aux montagnes

Quand le soleil dit bonjour aux montagnes Lisez le texte et répondez aux questions

Lisez le texte et répondez aux questions Lisez le texte et répondez aux questions suivantes

Lisez le texte et répondez aux questions suivantes Soyez soumis aux autorités

Soyez soumis aux autorités Exemple fausse analogie

Exemple fausse analogie Bulgarie aux jeux olympiques d

Bulgarie aux jeux olympiques d Ne fait pas aux autres ce que tu n'aimerais

Ne fait pas aux autres ce que tu n'aimerais Subject-dqrnghtp

Subject-dqrnghtp Dans ces murs voués aux merveilles

Dans ces murs voués aux merveilles Ne fait pas aux autres ce que tu n'aimerais

Ne fait pas aux autres ce que tu n'aimerais La dame aux camelias a streetcar named desire

La dame aux camelias a streetcar named desire Ouvre mes yeux seigneur fais que je voie partition pdf

Ouvre mes yeux seigneur fais que je voie partition pdf Fais correspondre

Fais correspondre Rembrandt aux yeux hagards

Rembrandt aux yeux hagards Il sauva daniel de la fosse aux lions

Il sauva daniel de la fosse aux lions Aux armes citoyens

Aux armes citoyens Aspirez aux dons les meilleurs

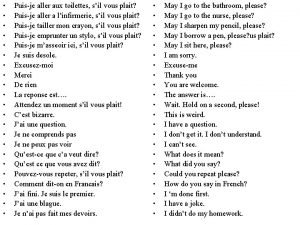

Aspirez aux dons les meilleurs Puis je aller aux toilettes

Puis je aller aux toilettes Crrpi

Crrpi Chambre nationale des commissaires aux comptes

Chambre nationale des commissaires aux comptes Gloire au père

Gloire au père