Wykad 14 Neuropsychologia komputerowa Jzyk Wodzisaw Duch UMK

- Slides: 31

Wykład 14 Neuropsychologia komputerowa Język Włodzisław Duch UMK Toruń Google: W Duch

Modelowanie reprezentacji symbolicznych Te same mechanizmy w mózgu, tylko inne wejścia. Poziomy przetwarzania: fonemy/sylaby, litery, słowa, pojęcia, frazy, zdania, sytuacje, historie. Rozproszone reprezentacje, wiele możliwości kombinacji licznych rep. W tych modelach uwzględniamy: rozproszony leksykon, ortografię, fonologie, semantykę. Uczenie czytania, dysleksje: rozpoznawanie znaków, mapowanie ortografii na fonologię (nietrywialne dla angielskiego); regularności i wyjątki, tworzenie zbyt regularnych czasów przeszłych. Reprezentacje semantyczne z kookurencji słów. Reprezentacje semantyczne na poziomie kształtu zdań.

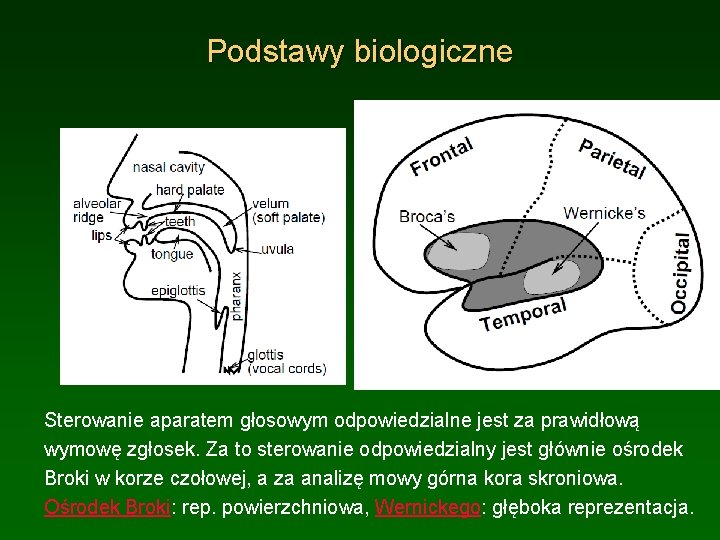

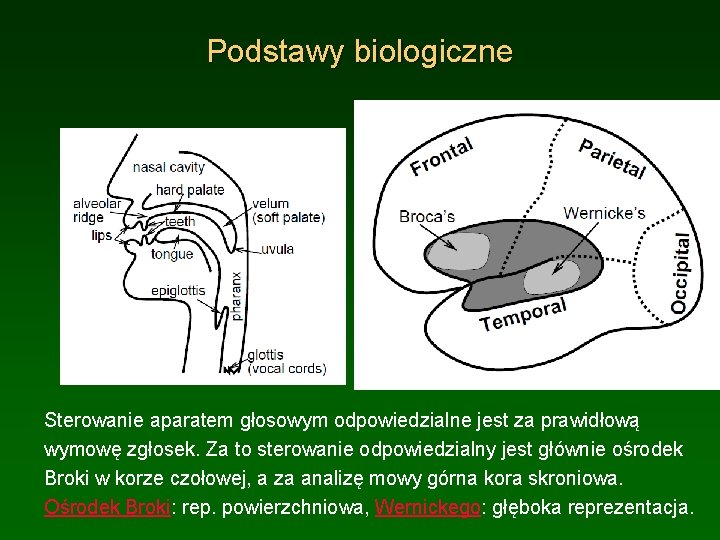

Podstawy biologiczne Sterowanie aparatem głosowym odpowiedzialne jest za prawidłową wymowę zgłosek. Za to sterowanie odpowiedzialny jest głównie ośrodek Broki w korze czołowej, a za analizę mowy górna kora skroniowa. Ośrodek Broki: rep. powierzchniowa, Wernickego: głęboka reprezentacja.

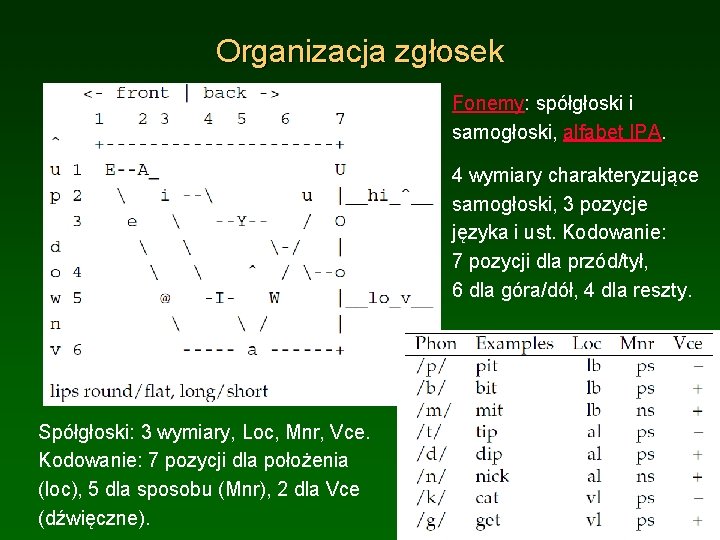

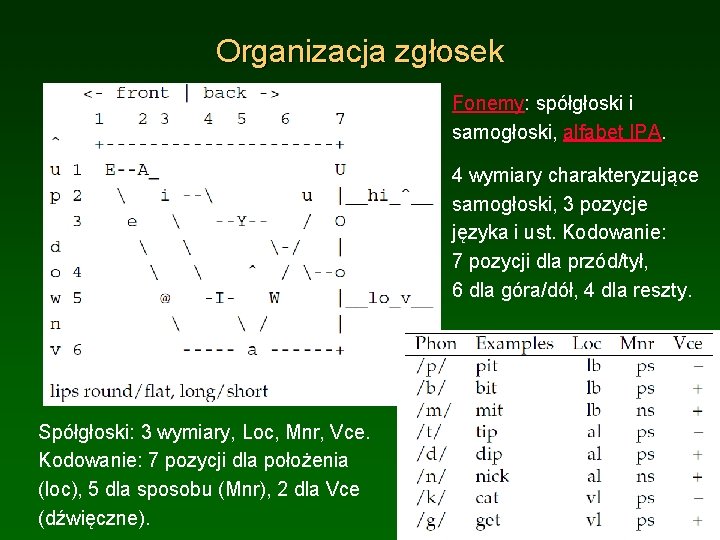

Organizacja zgłosek Neuron uczy się prawdopodob. warunkowego, korelacji pomiędzy pożądaną aktywnością a sygnałami wejściowymi; optymalna wartość 0. 7 osiągana jest szybko tylko przy małej stałej uczenia 0. 005 Spółgłoski: 3 wymiary, Loc, Mnr, Vce. Kodowanie: 7 pozycji dla położenia (loc), 5 dla sposobu (Mnr), 2 dla Vce (dźwięczne). Fonemy: spółgłoski i samogłoski, alfabet IPA. 4 wymiary charakteryzujące samogłoski, 3 pozycje języka i ust. Kodowanie: 7 pozycji dla przód/tył, 6 dla góra/dół, 4 dla reszty.

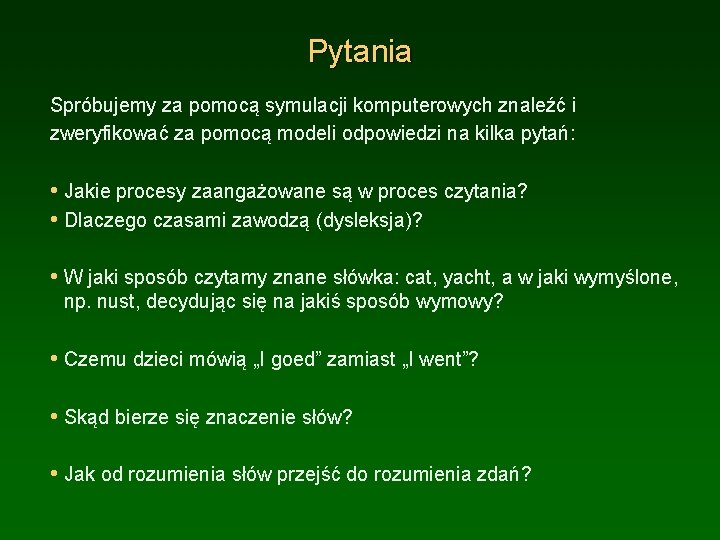

Pytania Spróbujemy za pomocą symulacji komputerowych znaleźć i zweryfikować za pomocą modeli odpowiedzi na kilka pytań: • Jakie procesy zaangażowane są w proces czytania? • Dlaczego czasami zawodzą (dysleksja)? • W jaki sposób czytamy znane słówka: cat, yacht, a w jaki wymyślone, np. nust, decydując się na jakiś sposób wymowy? • Czemu dzieci mówią „I goed” zamiast „I went”? • Skąd bierze się znaczenie słów? • Jak od rozumienia słów przejść do rozumienia zdań?

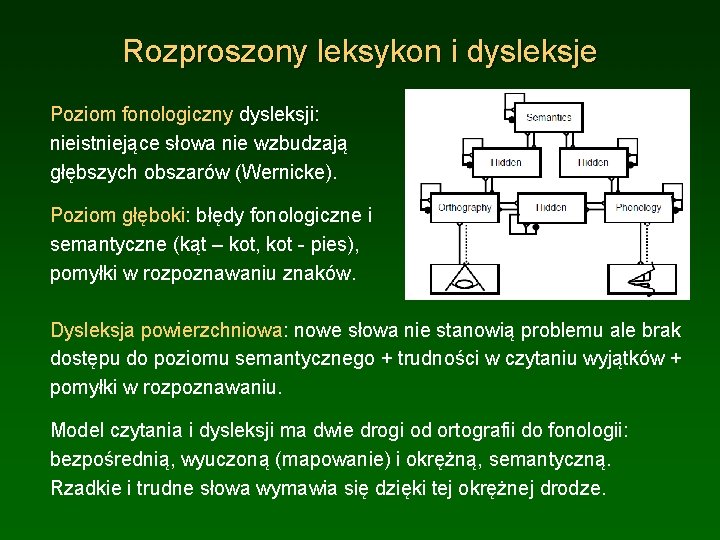

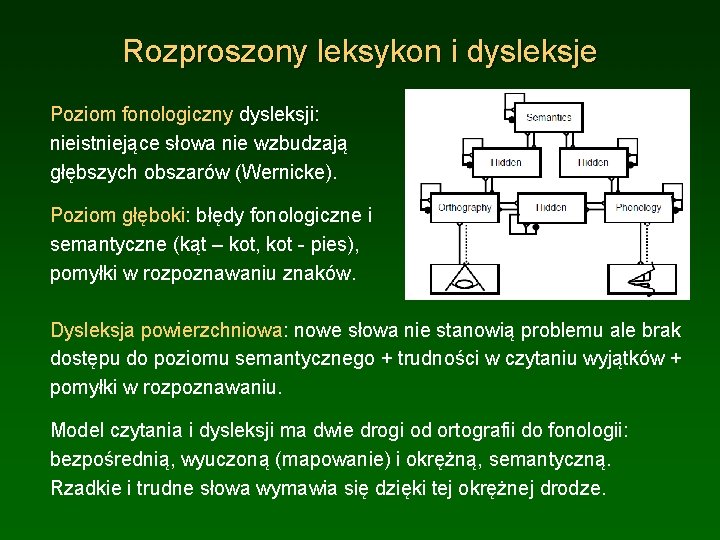

Rozproszony leksykon i dysleksje Poziom fonologiczny dysleksji: nieistniejące słowa nie wzbudzają głębszych obszarów (Wernicke). Poziom głęboki: błędy fonologiczne i semantyczne (kąt – kot, kot - pies), pomyłki w rozpoznawaniu znaków. Dysleksja powierzchniowa: nowe słowa nie stanowią problemu ale brak dostępu do poziomu semantycznego + trudności w czytaniu wyjątków + pomyłki w rozpoznawaniu. Model czytania i dysleksji ma dwie drogi od ortografii do fonologii: bezpośrednią, wyuczoną (mapowanie) i okrężną, semantyczną. Rzadkie i trudne słowa wymawia się dzięki tej okrężnej drodze.

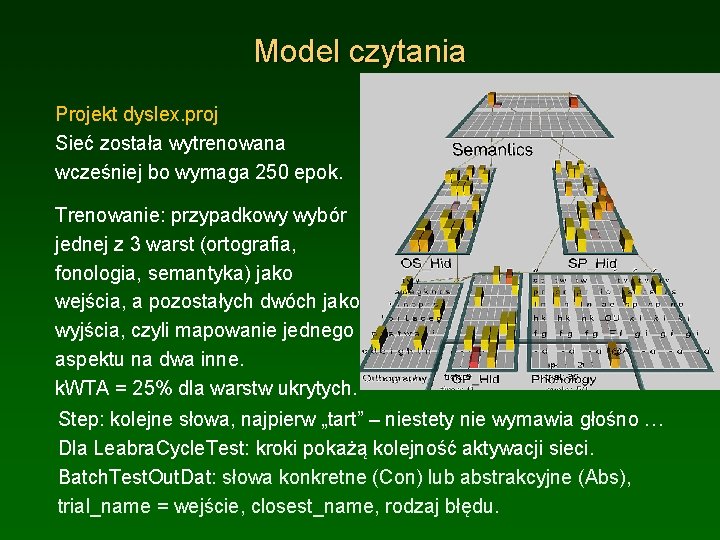

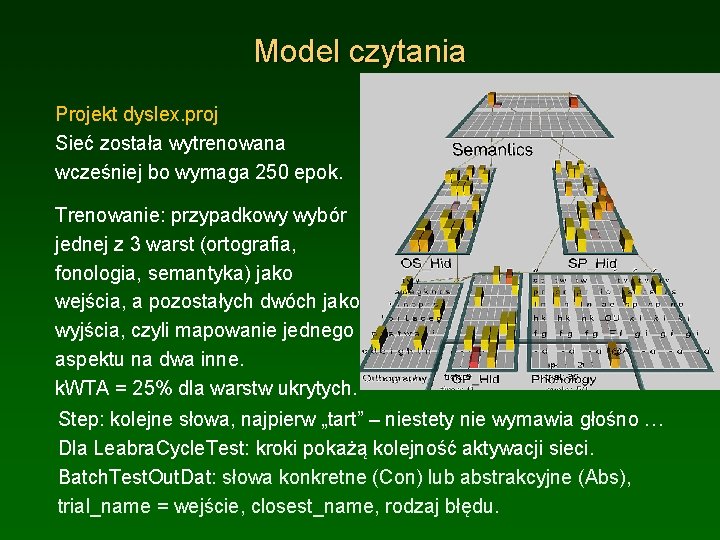

Model czytania Projekt dyslex. proj Sieć została wytrenowana wcześniej bo wymaga 250 epok. Trenowanie: przypadkowy wybór jednej z 3 warst (ortografia, fonologia, semantyka) jako wejścia, a pozostałych dwóch jako wyjścia, czyli mapowanie jednego aspektu na dwa inne. k. WTA = 25% dla warstw ukrytych. Step: kolejne słowa, najpierw „tart” – niestety nie wymawia głośno … Dla Leabra. Cycle. Test: kroki pokażą kolejność aktywacji sieci. Batch. Test. Out. Dat: słowa konkretne (Con) lub abstrakcyjne (Abs), trial_name = wejście, closest_name, rodzaj błędu.

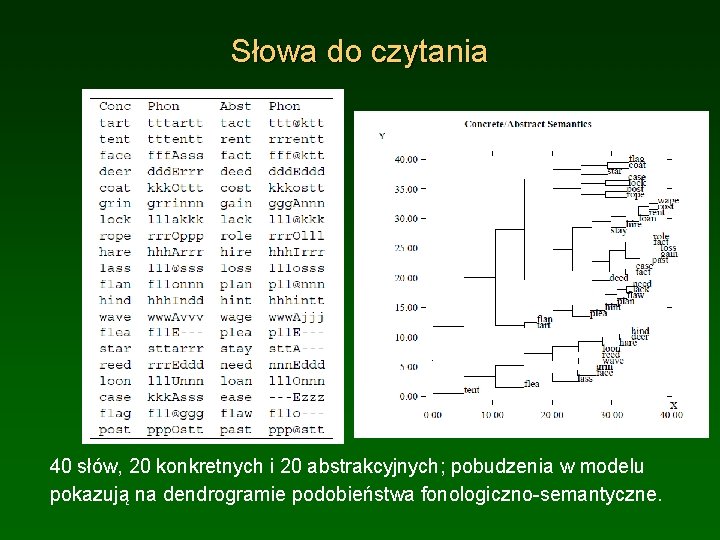

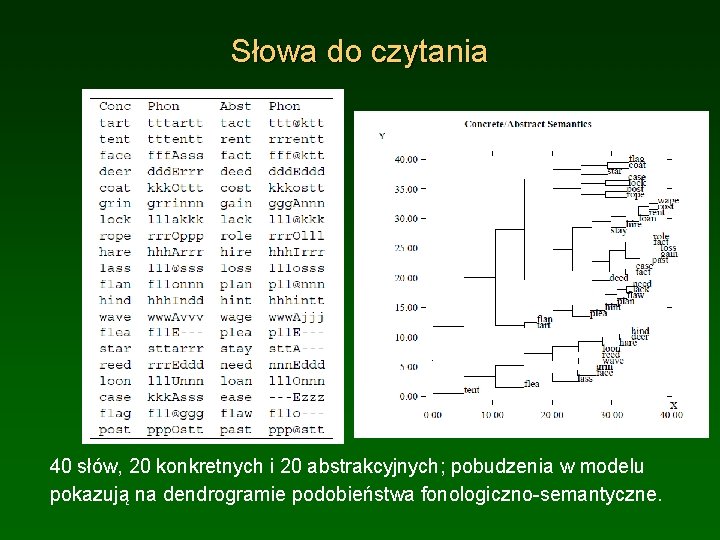

Słowa do czytania 40 słów, 20 konkretnych i 20 abstrakcyjnych; pobudzenia w modelu pokazują na dendrogramie podobieństwa fonologiczno-semantyczne.

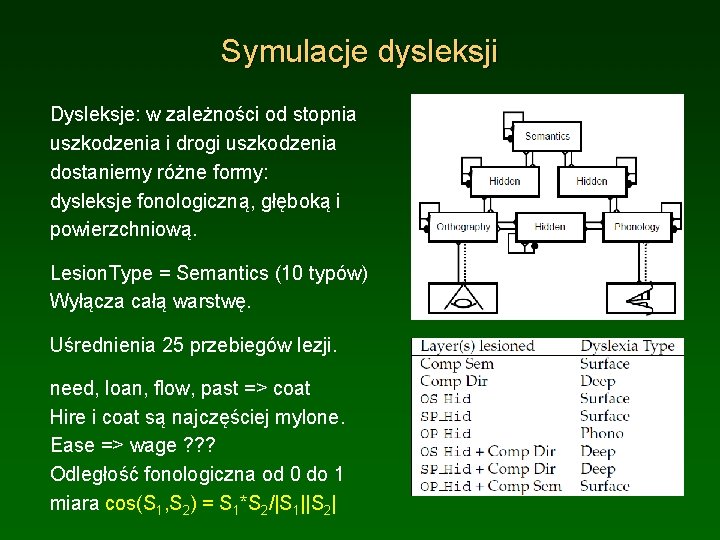

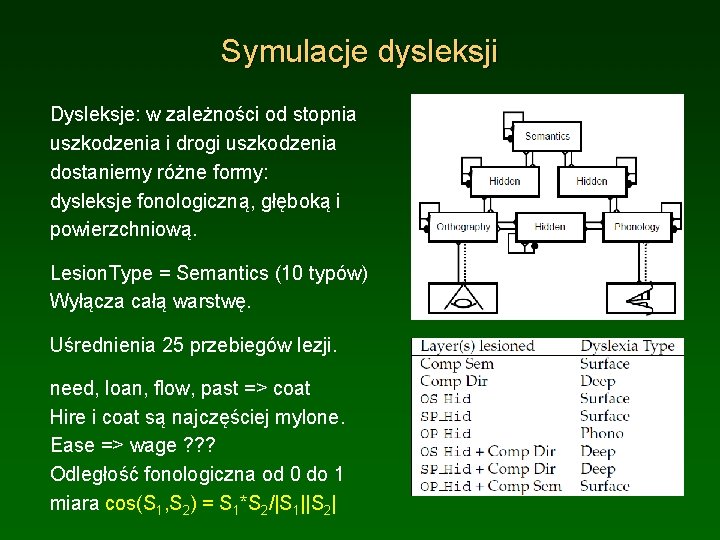

Symulacje dysleksji Dysleksje: w zależności od stopnia uszkodzenia i drogi uszkodzenia dostaniemy różne formy: dysleksje fonologiczną, głęboką i powierzchniową. Lesion. Type = Semantics (10 typów) Wyłącza całą warstwę. Uśrednienia 25 przebiegów lezji. need, loan, flow, past => coat Hire i coat są najczęściej mylone. Ease => wage ? ? ? Odległość fonologiczna od 0 do 1 miara cos(S 1, S 2) = S 1*S 2/|S 1||S 2|

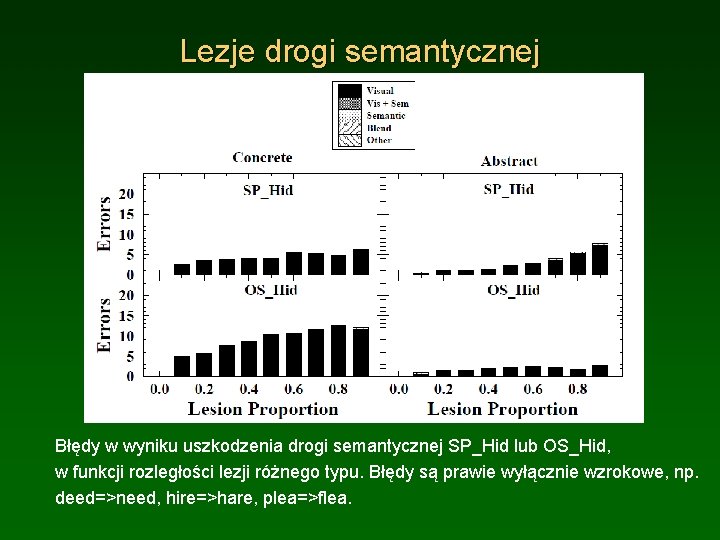

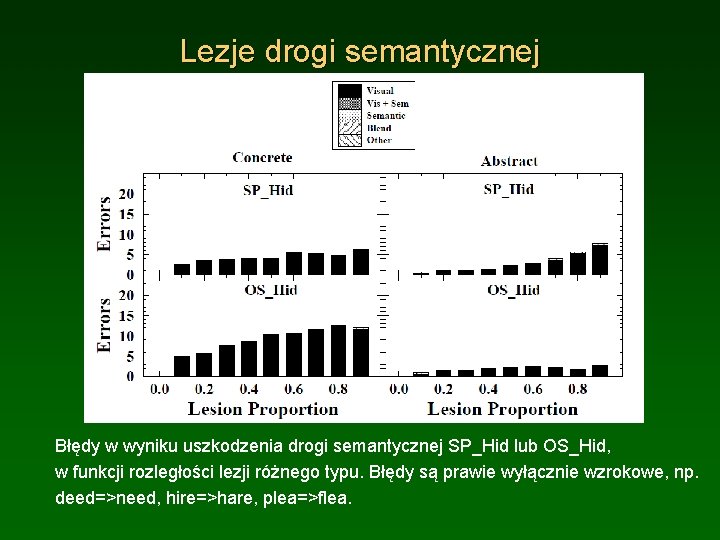

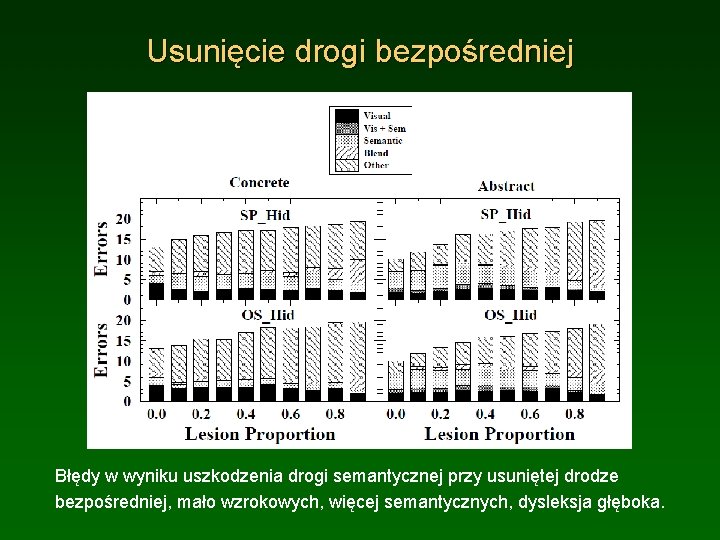

Lezje drogi semantycznej Błędy w wyniku uszkodzenia drogi semantycznej SP_Hid lub OS_Hid, w funkcji rozległości lezji różnego typu. Błędy są prawie wyłącznie wzrokowe, np. deed=>need, hire=>hare, plea=>flea.

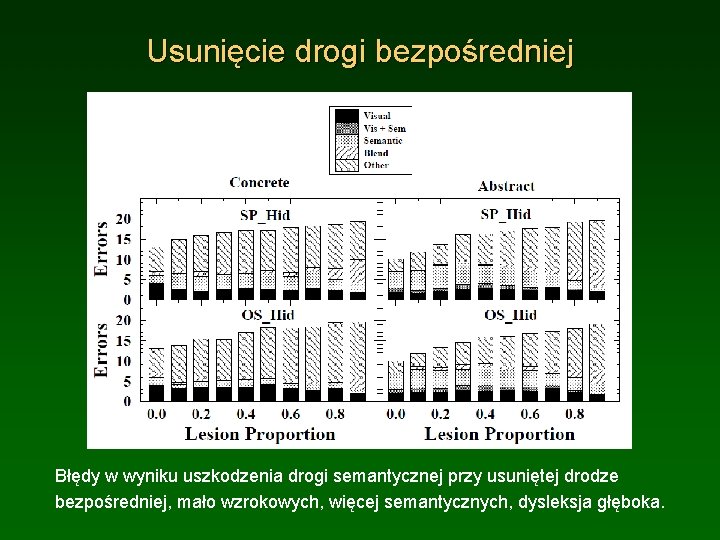

Usunięcie drogi bezpośredniej Błędy w wyniku uszkodzenia drogi semantycznej przy usuniętej drodze bezpośredniej, mało wzrokowych, więcej semantycznych, dysleksja głęboka.

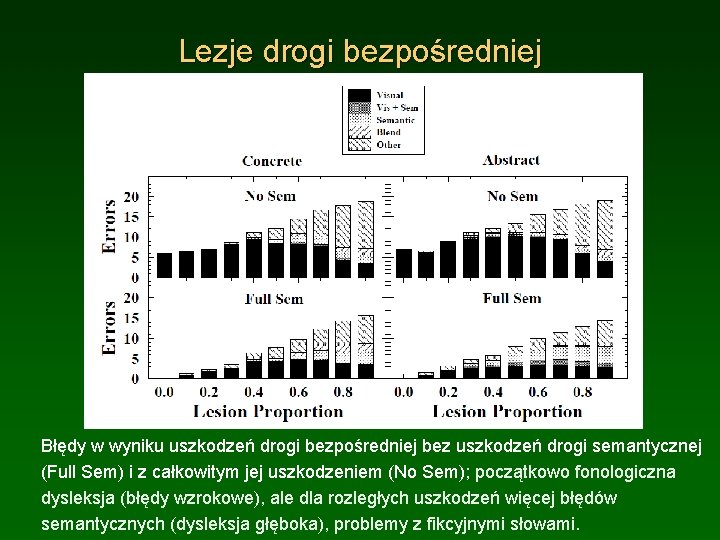

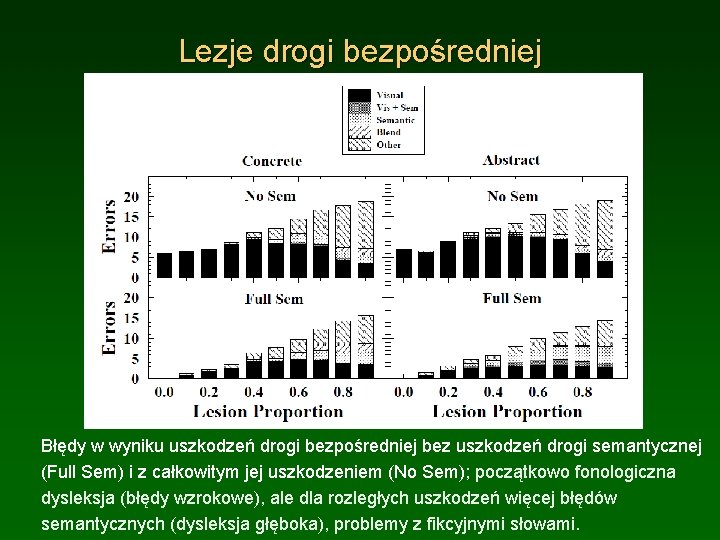

Lezje drogi bezpośredniej Błędy w wyniku uszkodzeń drogi bezpośredniej bez uszkodzeń drogi semantycznej (Full Sem) i z całkowitym jej uszkodzeniem (No Sem); początkowo fonologiczna dysleksja (błędy wzrokowe), ale dla rozległych uszkodzeń więcej błędów semantycznych (dysleksja głęboka), problemy z fikcyjnymi słowami.

Czytanie Reprezentacje nie są zlokalizowane w jednym regionie. Oddziaływania prowadzą do ciekawego podziału pracy. Modele czytania: mapowanie ortografii na fonologie. Dwa zagadnienia: • czy jeden system może się nauczyć wymowy regularnych słów i jednocześnie radzić sobie z wyjątkami? • symulacja wymowy nieistniejących słów wymaga odkrycia subtelnych regularności wymowy. Mint, hint, flint => i wymawiane tak samo, ale w pint całkiem inaczej. . . Regularności są często modyfikowane, zależne od kontekstu, mają skupienia (sąsiedztwa), a wyjątki są na krańcach takich modyfikacji. Regularności i wyjątki tworzą kontinuum.

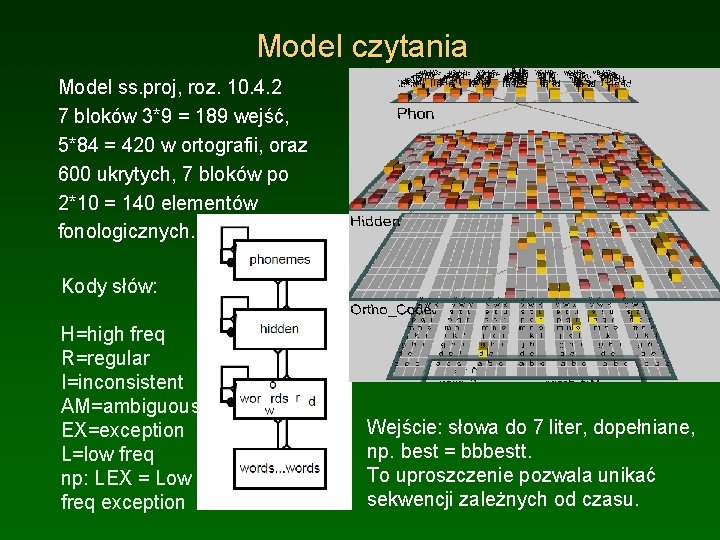

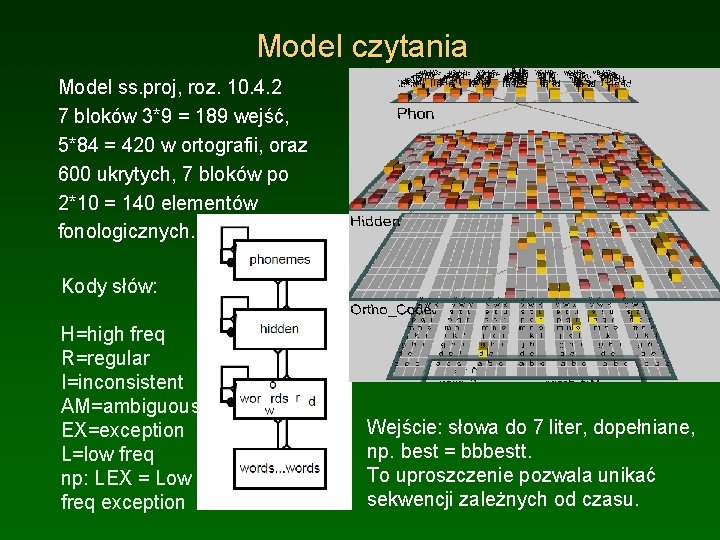

Model czytania Model ss. proj, roz. 10. 4. 2 7 bloków 3*9 = 189 wejść, 5*84 = 420 w ortografii, oraz 600 ukrytych, 7 bloków po 2*10 = 140 elementów fonologicznych. Kody słów: H=high freq R=regular I=inconsistent AM=ambiguous EX=exception L=low freq np: LEX = Low freq exception Wejście: słowa do 7 liter, dopełniane, np. best = bbbestt. To uproszczenie pozwala unikać sekwencji zależnych od czasu.

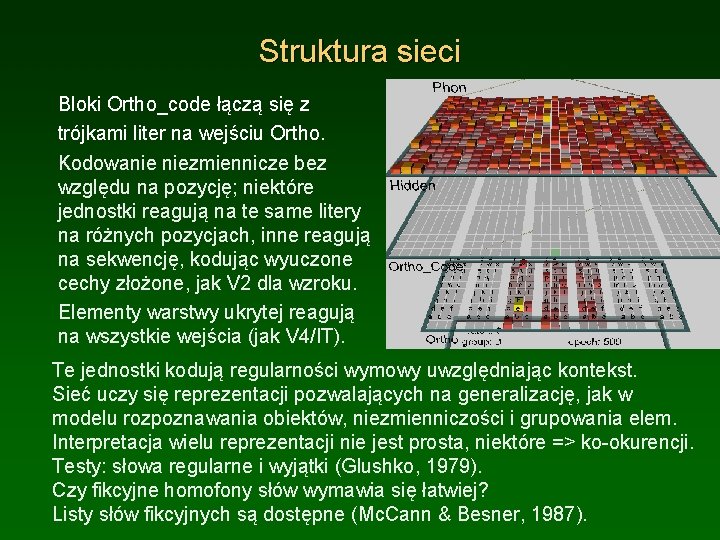

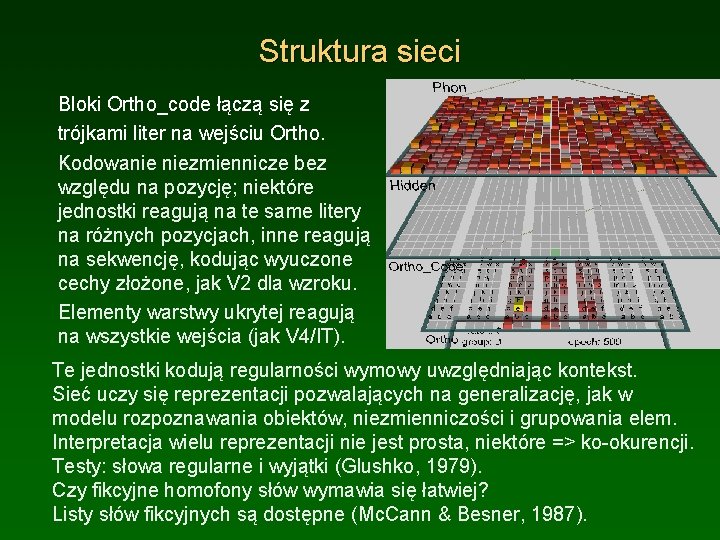

Struktura sieci Bloki Ortho_code łączą się z trójkami liter na wejściu Ortho. Kodowanie niezmiennicze bez względu na pozycję; niektóre jednostki reagują na te same litery na różnych pozycjach, inne reagują na sekwencję, kodując wyuczone cechy złożone, jak V 2 dla wzroku. Elementy warstwy ukrytej reagują na wszystkie wejścia (jak V 4/IT). Te jednostki kodują regularności wymowy uwzględniając kontekst. Sieć uczy się reprezentacji pozwalających na generalizację, jak w modelu rozpoznawania obiektów, niezmienniczości i grupowania elem. Interpretacja wielu reprezentacji nie jest prosta, niektóre => ko-okurencji. Testy: słowa regularne i wyjątki (Glushko, 1979). Czy fikcyjne homofony słów wymawia się łatwiej? Listy słów fikcyjnych są dostępne (Mc. Cann & Besner, 1987).

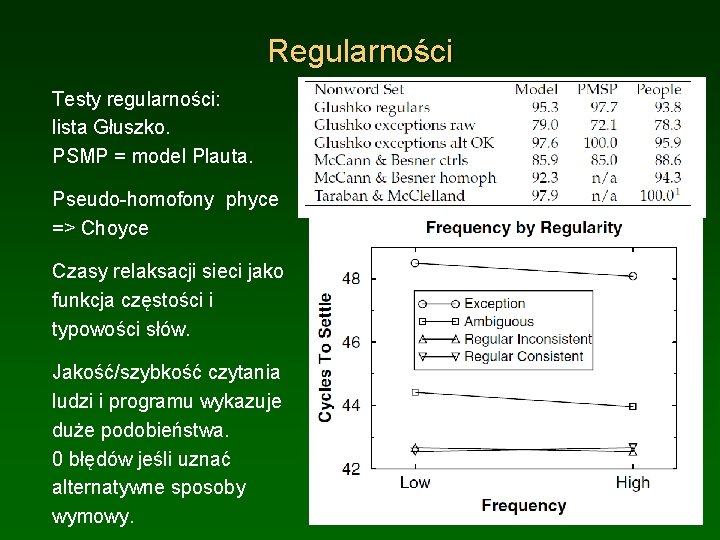

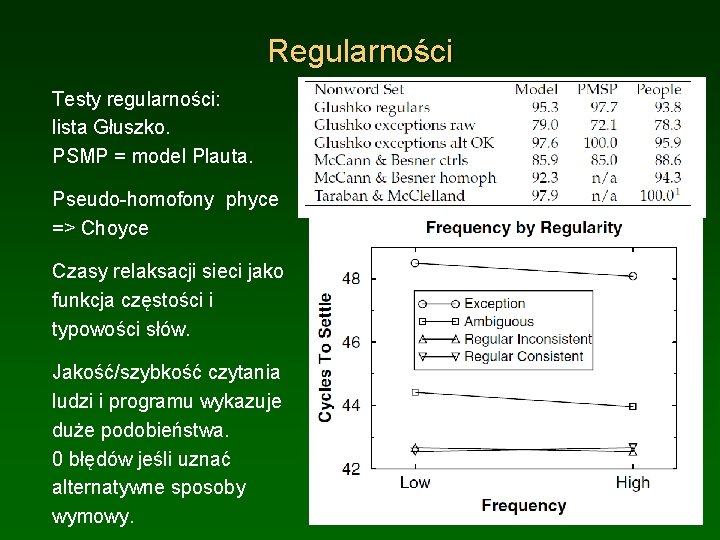

Regularności Testy regularności: lista Głuszko. PSMP = model Plauta. Pseudo-homofony phyce => Choyce Czasy relaksacji sieci jako funkcja częstości i typowości słów. Jakość/szybkość czytania ludzi i programu wykazuje duże podobieństwa. 0 błędów jeśli uznać alternatywne sposoby wymowy.

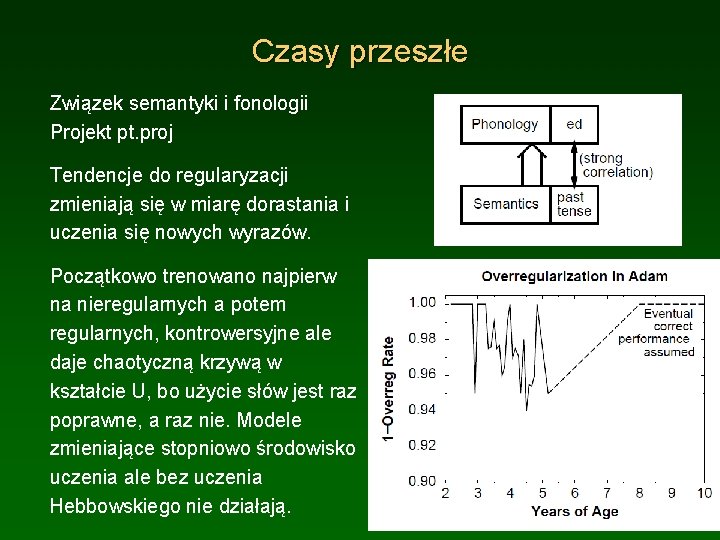

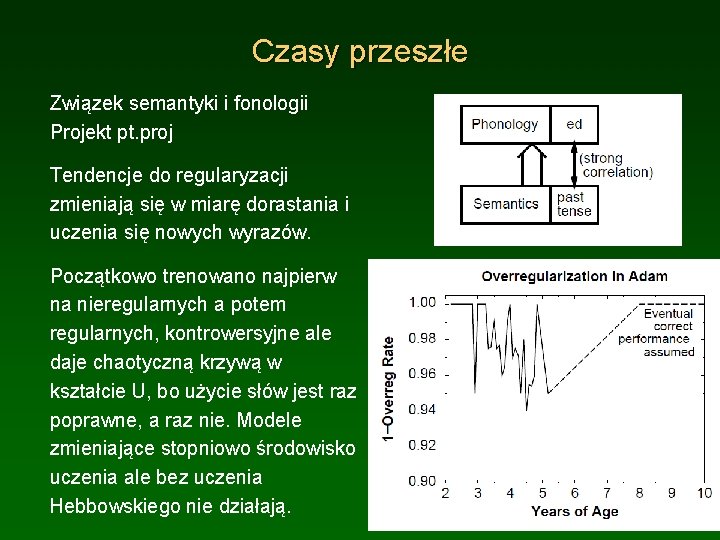

Czasy przeszłe Związek semantyki i fonologii Projekt pt. proj Tendencje do regularyzacji zmieniają się w miarę dorastania i uczenia się nowych wyrazów. Początkowo trenowano najpierw na nieregularnych a potem regularnych, kontrowersyjne ale daje chaotyczną krzywą w kształcie U, bo użycie słów jest raz poprawne, a raz nie. Modele zmieniające stopniowo środowisko uczenia ale bez uczenia Hebbowskiego nie działają.

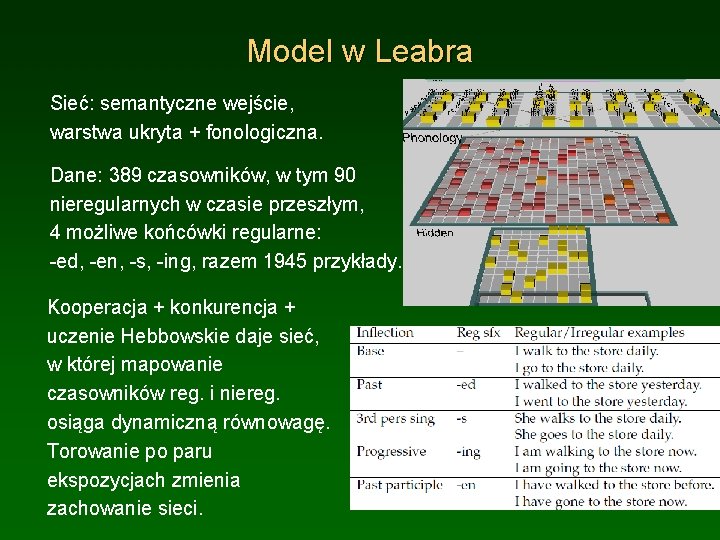

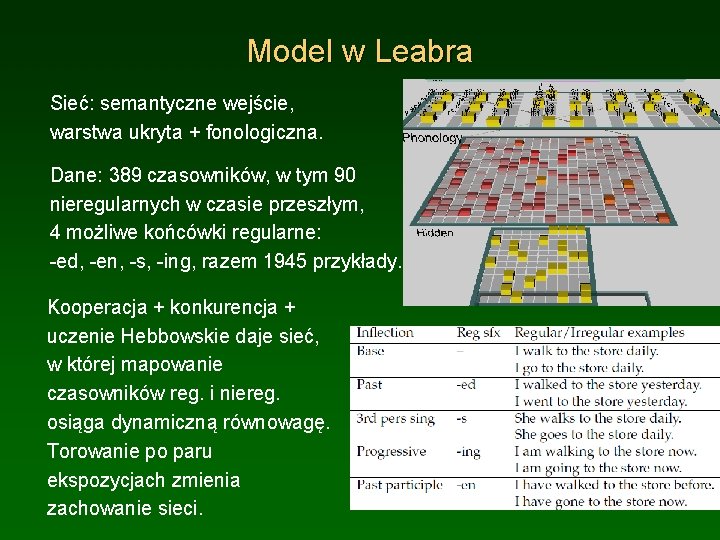

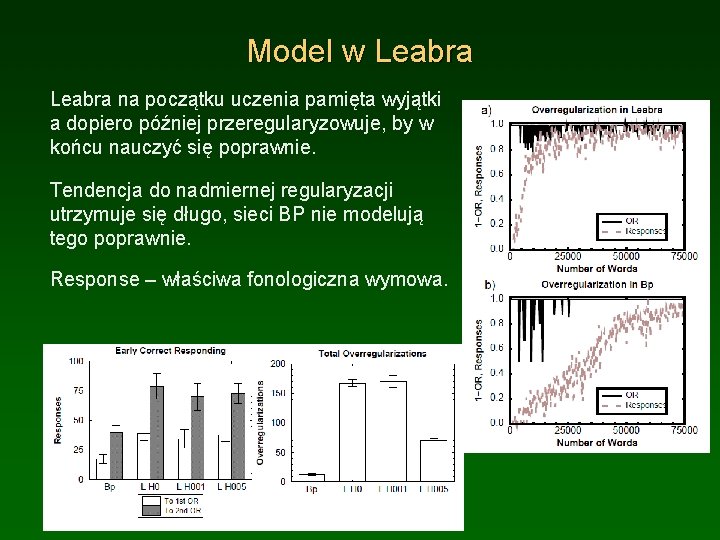

Model w Leabra Sieć: semantyczne wejście, warstwa ukryta + fonologiczna. Dane: 389 czasowników, w tym 90 nieregularnych w czasie przeszłym, 4 możliwe końcówki regularne: -ed, -en, -s, -ing, razem 1945 przykłady. Kooperacja + konkurencja + uczenie Hebbowskie daje sieć, w której mapowanie czasowników reg. i niereg. osiąga dynamiczną równowagę. Torowanie po paru ekspozycjach zmienia zachowanie sieci.

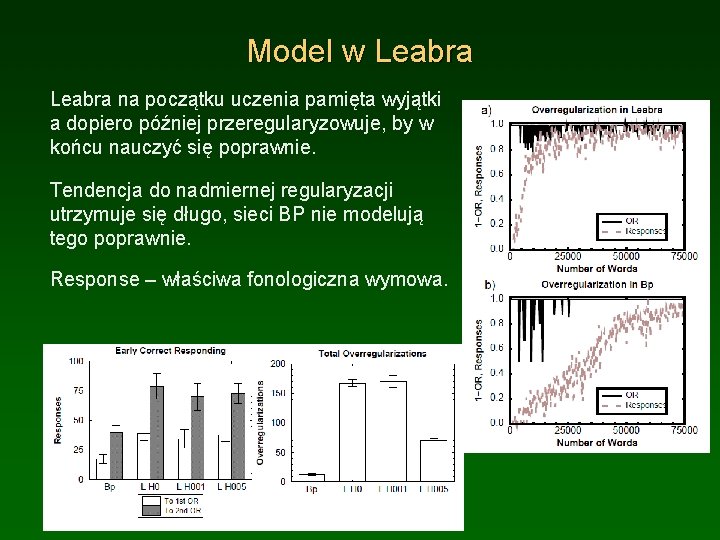

Model w Leabra na początku uczenia pamięta wyjątki a dopiero później przeregularyzowuje, by w końcu nauczyć się poprawnie. Tendencja do nadmiernej regularyzacji utrzymuje się długo, sieci BP nie modelują tego poprawnie. Response – właściwa fonologiczna wymowa.

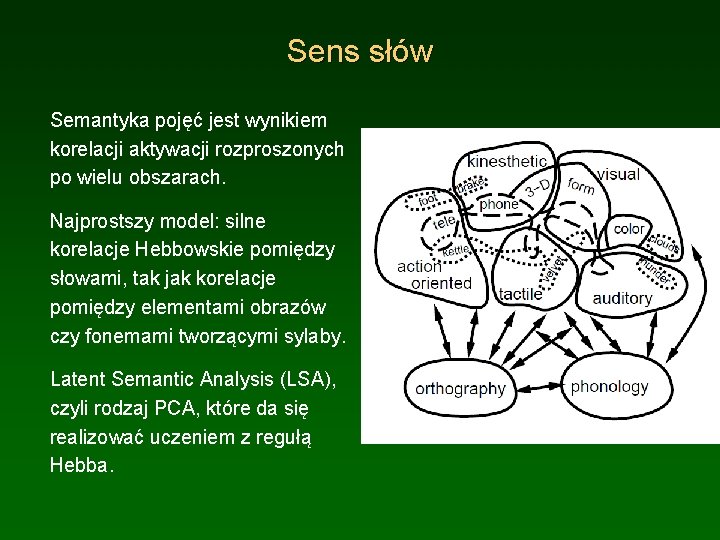

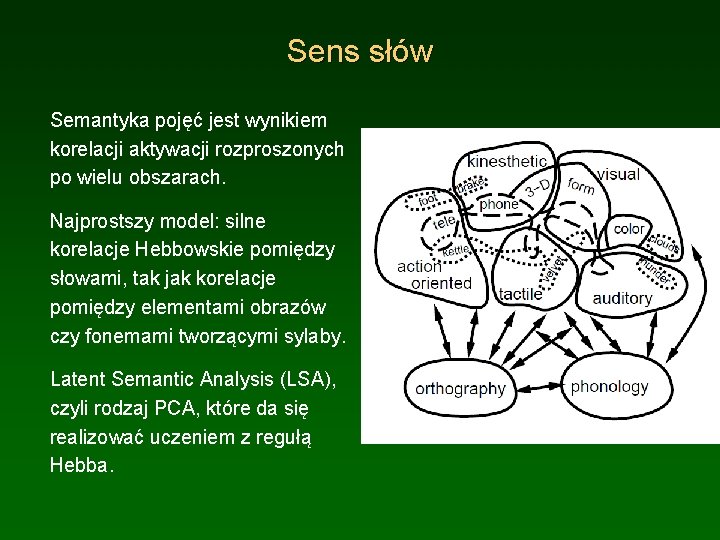

Sens słów Semantyka pojęć jest wynikiem korelacji aktywacji rozproszonych po wielu obszarach. Najprostszy model: silne korelacje Hebbowskie pomiędzy słowami, tak jak korelacje pomiędzy elementami obrazów czy fonemami tworzącymi sylaby. Latent Semantic Analysis (LSA), czyli rodzaj PCA, które da się realizować uczeniem z regułą Hebba.

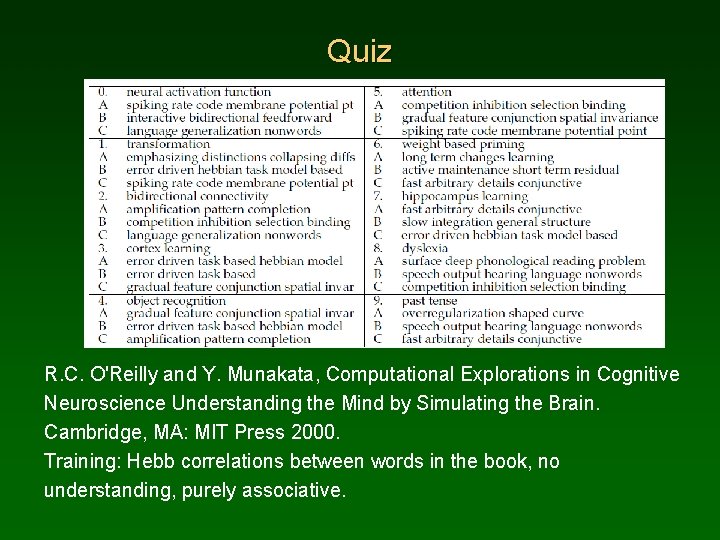

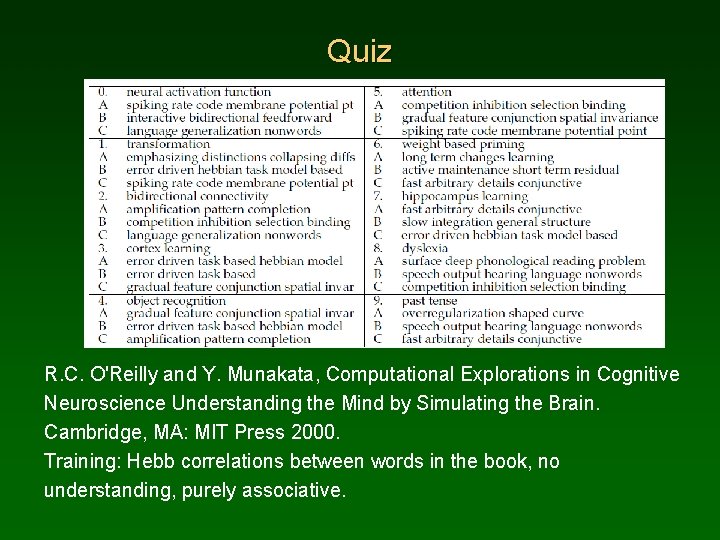

Quiz R. C. O'Reilly and Y. Munakata, Computational Explorations in Cognitive Neuroscience Understanding the Mind by Simulating the Brain. Cambridge, MA: MIT Press 2000. Training: Hebb correlations between words in the book, no understanding, purely associative.

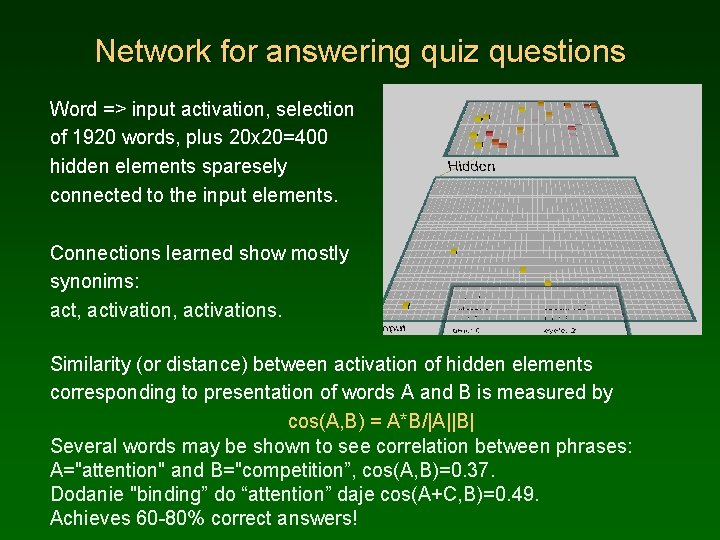

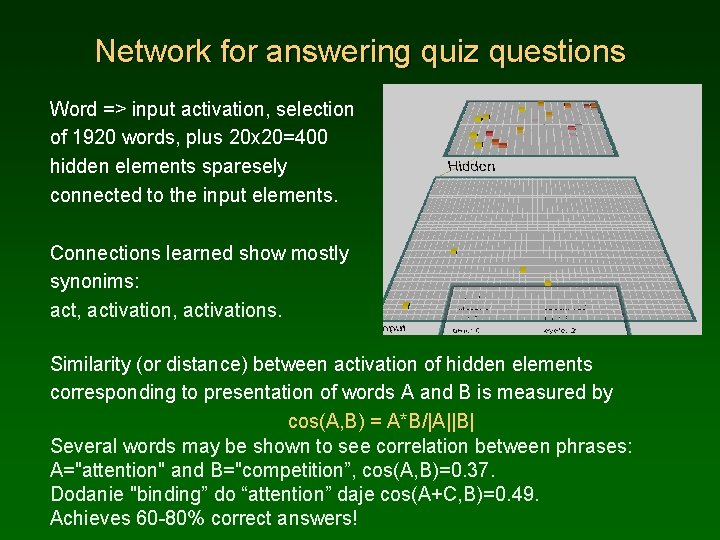

Network for answering quiz questions Word => input activation, selection of 1920 words, plus 20 x 20=400 hidden elements sparesely connected to the input elements. Connections learned show mostly synonims: act, activations. Similarity (or distance) between activation of hidden elements corresponding to presentation of words A and B is measured by cos(A, B) = A*B/|A||B| Several words may be shown to see correlation between phrases: A="attention" and B="competition”, cos(A, B)=0. 37. Dodanie "binding” do “attention” daje cos(A+C, B)=0. 49. Achieves 60 -80% correct answers!

Model nieco dokładniej Słowa składają się z prostszych elementów, nie uwzględniliśmy morfologii, wtedy wejściowa warstwa mogłaby być prostsza. Sieć trenowana jest na uproszczonym tekście z książki, zostało 1920 wyrazów, usunięto bardzo rzadkie (<5 x) i bardzo częste (the, and, it, his, can etc, cała lista usuniętych słów jest w sem_filter. lg. list. eccn_lg_f 5. cln zawiera tekst po filtracji. Sieć nie pamięta szyku słów. Ukryte jednostki traktują słowa wejściowe jako cechy, które je definiują; aktywacja tych jednostek jest proporcjonalna do prawdopodobieństwa jednoczesnego pojawienia się słów w tym samym paragrafie; brakuje struktury pojęć, jest tylko statystyczna korelacja. Prezentacja jednocześnie kilku słów – efekty nie są addytywne, zwiększanie liczby słów daje niewielkie zwiększanie podobieństwa, brakuje hamowania by mogło się zmniejszyć. Czy da się zrobić sieć z literami, rzędu 100 jednostek wejściowych?

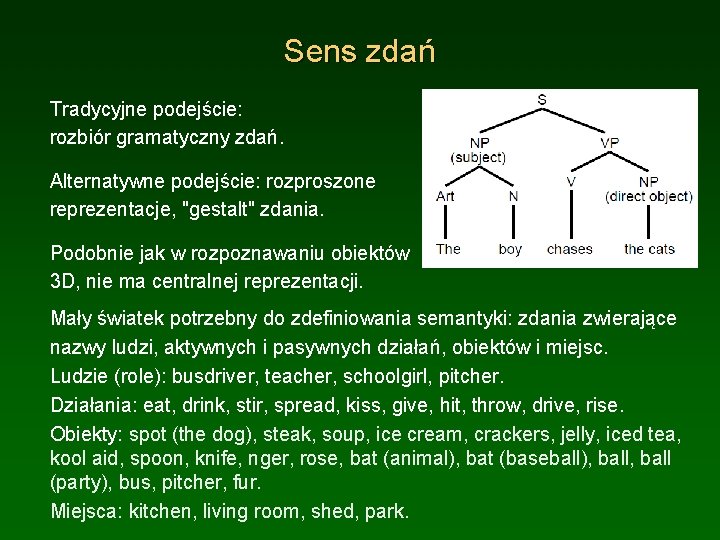

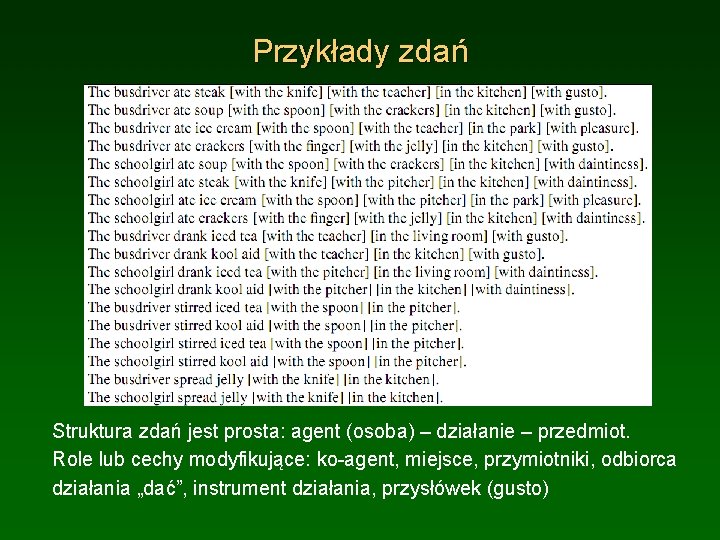

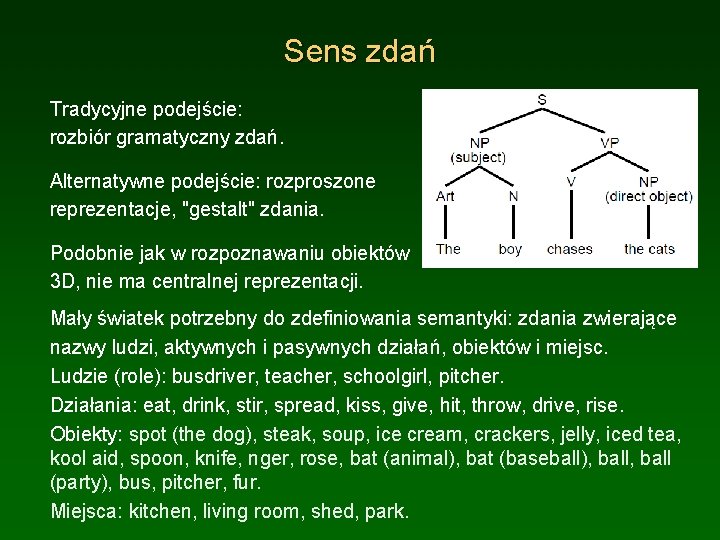

Sens zdań Tradycyjne podejście: rozbiór gramatyczny zdań. Alternatywne podejście: rozproszone reprezentacje, "gestalt" zdania. Podobnie jak w rozpoznawaniu obiektów 3 D, nie ma centralnej reprezentacji. Mały światek potrzebny do zdefiniowania semantyki: zdania zwierające nazwy ludzi, aktywnych i pasywnych działań, obiektów i miejsc. Ludzie (role): busdriver, teacher, schoolgirl, pitcher. Działania: eat, drink, stir, spread, kiss, give, hit, throw, drive, rise. Obiekty: spot (the dog), steak, soup, ice cream, crackers, jelly, iced tea, kool aid, spoon, knife, nger, rose, bat (animal), bat (baseball), ball (party), bus, pitcher, fur. Miejsca: kitchen, living room, shed, park.

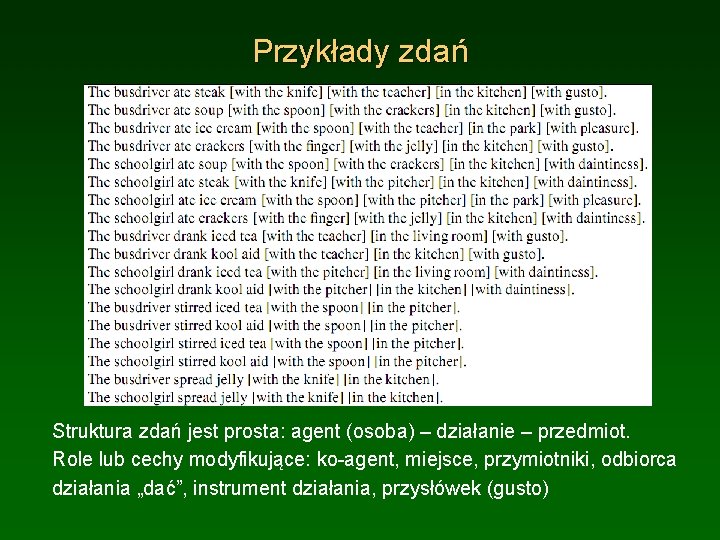

Przykłady zdań Struktura zdań jest prosta: agent (osoba) – działanie – przedmiot. Role lub cechy modyfikujące: ko-agent, miejsce, przymiotniki, odbiorca działania „dać”, instrument działania, przysłówek (gusto)

Sieć i projekt Projekt sg. proj, opis 10. 7. 2 Wejście prezentuje słowa, zlokalizowane reprezentacje, w warstwie Encode tworzone są reprezentacje rozproszone, integrowane w czasie w warstwie Gestalt i Gestalt_Context, pytania wiążą się z rolami (agent, pacjent, instrument. . . ), sieć dekoduje reprezentacje dopełniając je (Filler). Np. bat (zwierze) i bat (pałka bejsbolowa) wymaga odróżnienia.

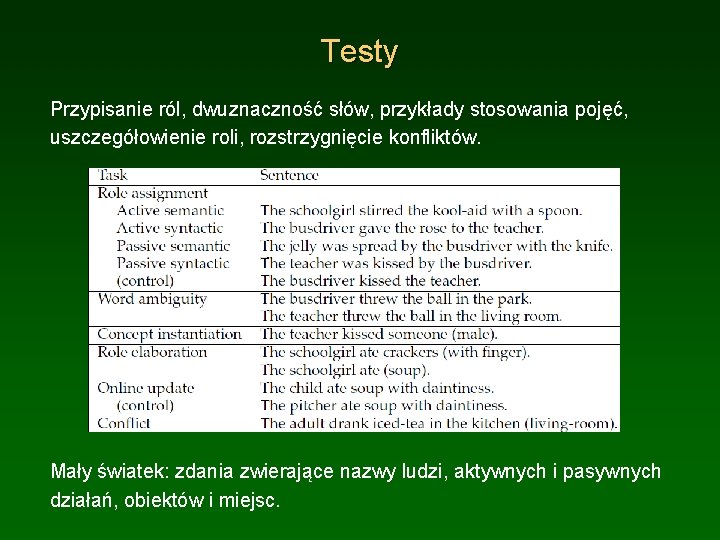

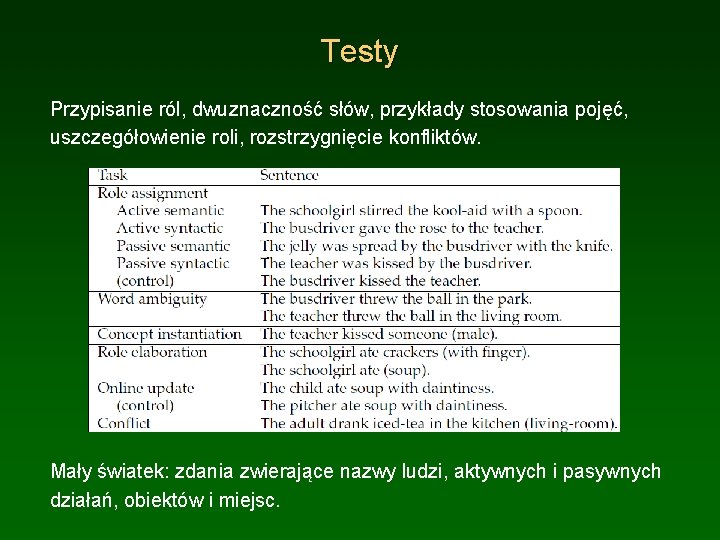

Testy Przypisanie ról, dwuznaczność słów, przykłady stosowania pojęć, uszczegółowienie roli, rozstrzygnięcie konfliktów. Mały światek: zdania zwierające nazwy ludzi, aktywnych i pasywnych działań, obiektów i miejsc.

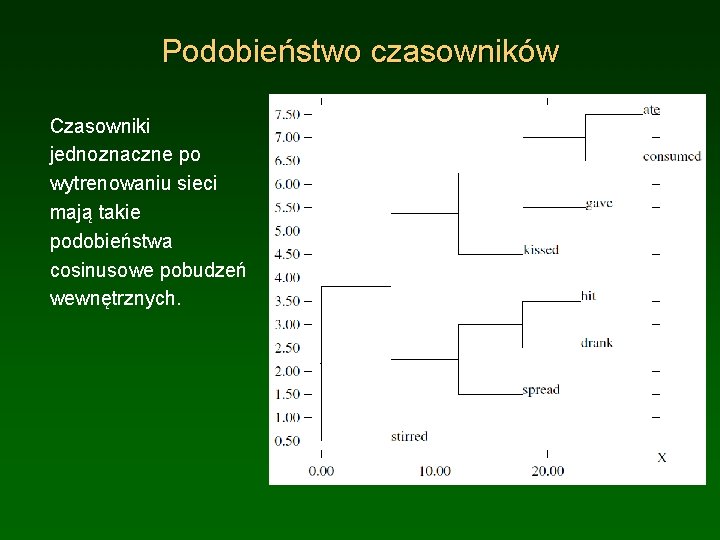

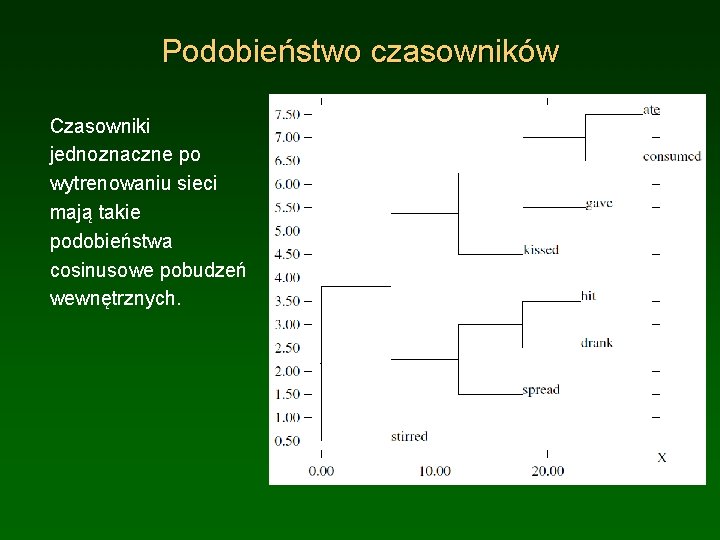

Podobieństwo czasowników Czasowniki jednoznaczne po wytrenowaniu sieci mają takie podobieństwa cosinusowe pobudzeń wewnętrznych.

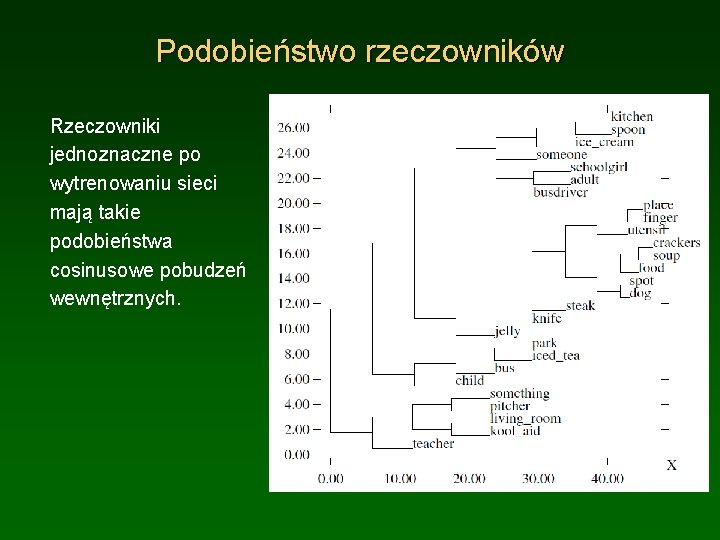

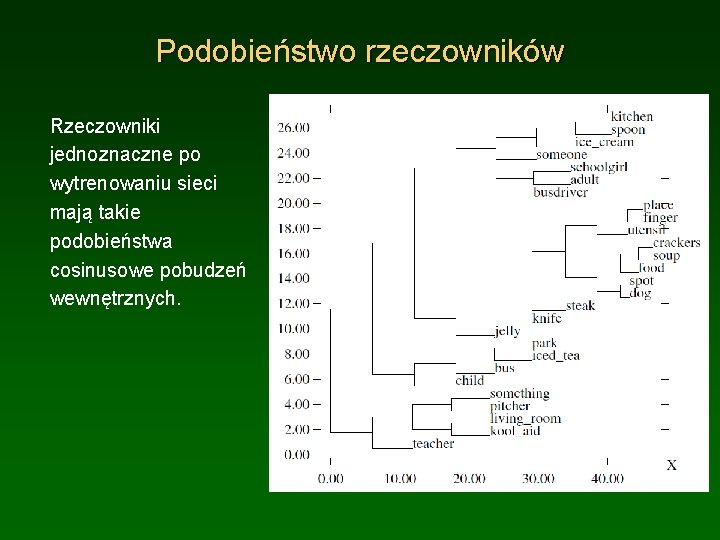

Podobieństwo rzeczowników Rzeczowniki jednoznaczne po wytrenowaniu sieci mają takie podobieństwa cosinusowe pobudzeń wewnętrznych.

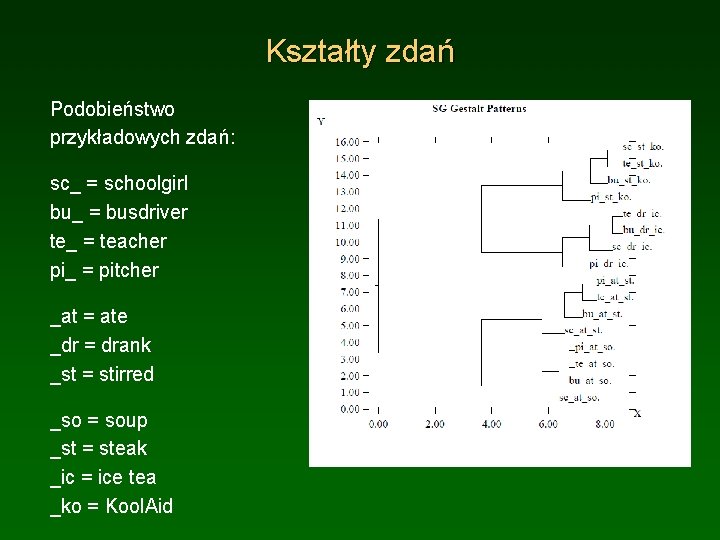

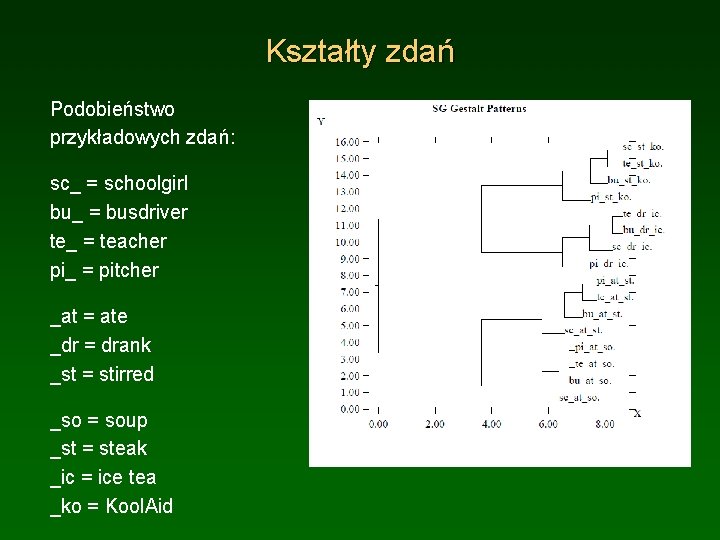

Kształty zdań Podobieństwo przykładowych zdań: sc_ = schoolgirl bu_ = busdriver te_ = teacher pi_ = pitcher _at = ate _dr = drank _st = stirred _so = soup _st = steak _ic = ice tea _ko = Kool. Aid

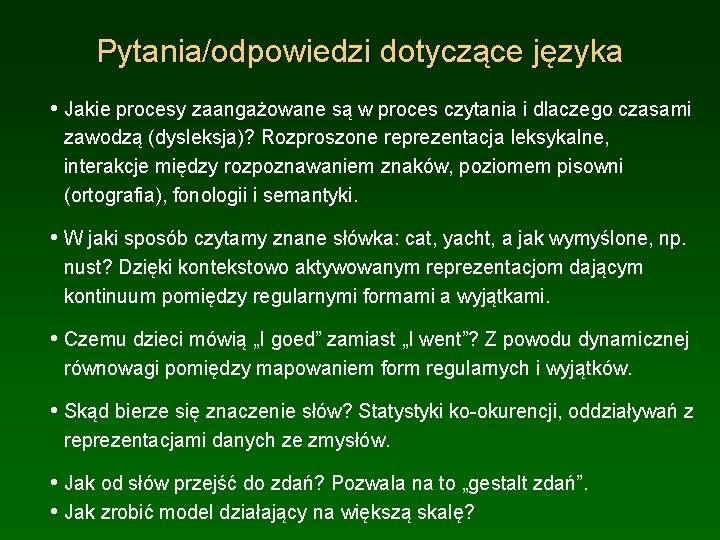

Pytania/odpowiedzi dotyczące języka • Jakie procesy zaangażowane są w proces czytania i dlaczego czasami zawodzą (dysleksja)? Rozproszone reprezentacja leksykalne, interakcje między rozpoznawaniem znaków, poziomem pisowni (ortografia), fonologii i semantyki. • W jaki sposób czytamy znane słówka: cat, yacht, a jak wymyślone, np. nust? Dzięki kontekstowo aktywowanym reprezentacjom dającym kontinuum pomiędzy regularnymi formami a wyjątkami. • Czemu dzieci mówią „I goed” zamiast „I went”? Z powodu dynamicznej równowagi pomiędzy mapowaniem form regularnych i wyjątków. • Skąd bierze się znaczenie słów? Statystyki ko-okurencji, oddziaływań z reprezentacjami danych ze zmysłów. • Jak od słów przejść do zdań? Pozwala na to „gestalt zdań”. • Jak zrobić model działający na większą skalę?