UNIVERSIDAD DE MLAGA ESCUELA TCNICA SUPERIOR DE INGENIERA

- Slides: 39

UNIVERSIDAD DE MÁLAGA ESCUELA TÉCNICA SUPERIOR DE INGENIERÍA INFORMÁTICA Programación Declarativa Avanzada REDES NEURONALES EN HASKELL Antonio Claros, Juan Fco. Gutiérrez, Juan Miguel Muñoz

Contenidos 2 Antecedentes Históricos Neurocomputación Redes Neuronales en Haskell Redes Neuronales en MATLAB Redes Neuronales en LISP Redes Neuronales en la Universidad Conclusiones Referencias

Antecedentes Históricos(I) 3 Las raíces de la computación datan del siglo XIX Problema de Decisión: “Dada una representación formal de una afirmación matemática, diseñar un algoritmo que determine si la afirmación es verdadera o falsa”. David Hilbert (1862 -1943)

Antecedentes Históricos(II) 4 Teorema de Incompletitud: “Ningún sistema de razonamiento matemático es lo suficientemente potente para ser capaz de probar toda afirmación cierta acerca de las propiedades de los números naturales”. Kart Gödel (1906 -1978)

Antecedentes Históricos(III) 5 Tesis Church-Turing: “La clase de problemas que se pueden resolver utilizando el sistema de programación de Turing es exactamente el mismo que los que se pueden resolver utilizando cualquier sistema de programación razonable”. Alan Turing (19121954)

Antecedentes Históricos(IV) 6 Warren Mc. Culloch y Walter Pitts padres de la neurocomputación con la publicación en 1943 “A logical calculus of the ideas immanent in nervous activity”. En 1957, Frank Rosenblatt desarrolló un conjunto de redes neuronales artificiales que se denominaron perceptrones. Teuvo Kohonen, en 1972, trabajó en el desarrollo de las redes neuronales de memoria asociativa. Ágil Carpenter junto con Stephen Grossberg , desarrollaron las redes autoorganizadas John Hopfield en 1980, trabajó con varias redes neuronales recurrentes con pesos fijos y activaciones

Neurocomputación (I). Red Neuronal. 7 ¿Qué es una red neuronal? ¿Por qué se elige el cerebro como modelo a seguir?

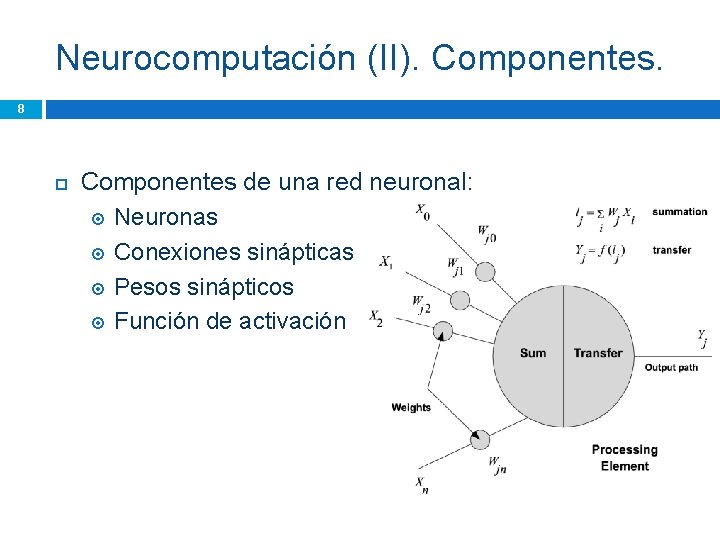

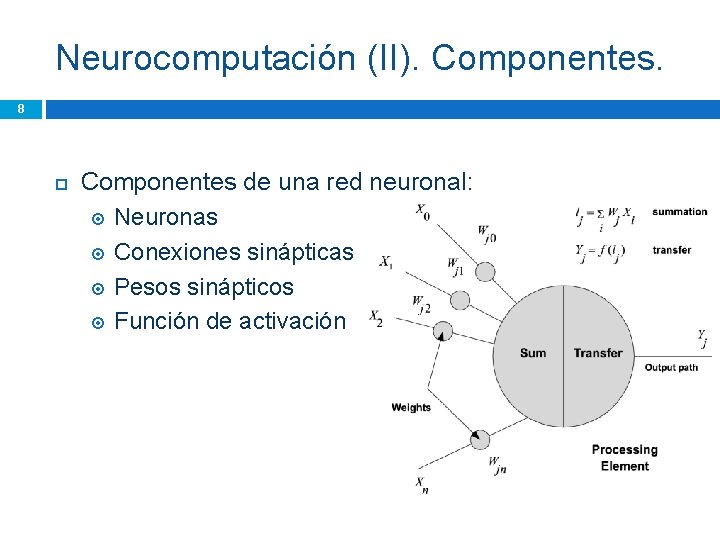

Neurocomputación (II). Componentes. 8 Componentes de una red neuronal: Neuronas Conexiones sinápticas Pesos sinápticos Función de activación

Neurocomputación (III). Características. 9 No linealidad. Representación de correspondencias entrada-salida. Tolerancia a fallos y robustez frente a ruido. Masivamente paralelas. Información contextual.

Neurocomputación (IV). Aplicaciones. 10 No haya algoritmo. Entradas con ruido. Con alto costo computacional Ejemplos: Clasificación de patrones (voz, imágenes, etc. ) Problema del viajante y homólogos. Robótica (controladores). Y muchos más…

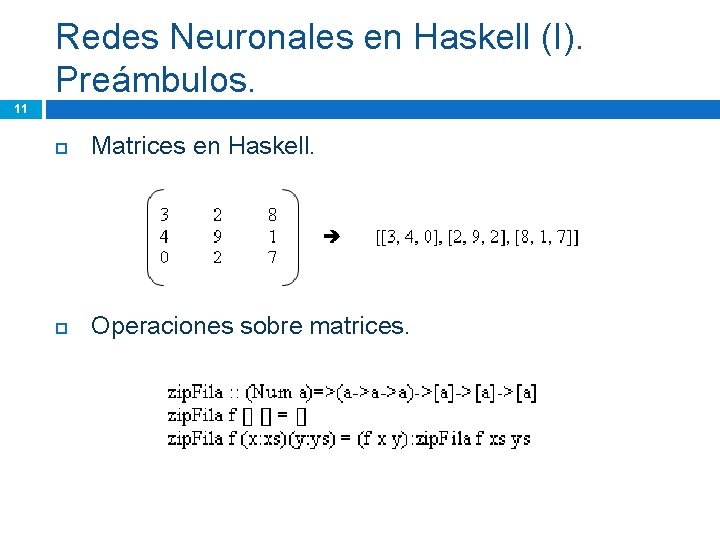

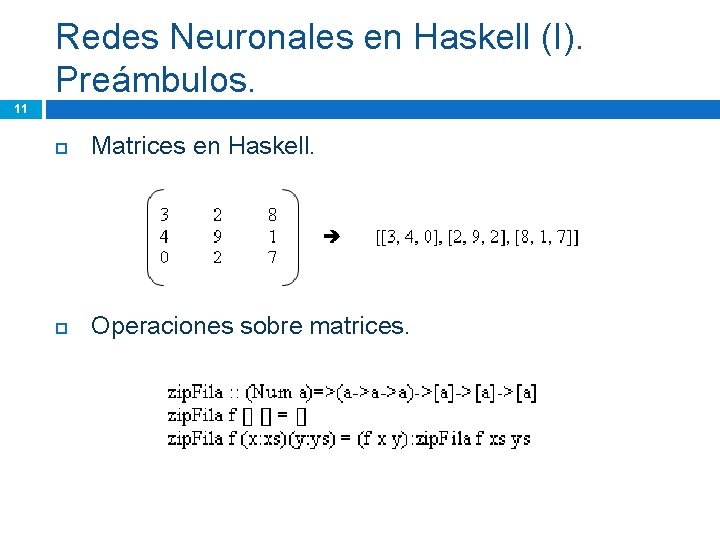

Redes Neuronales en Haskell (I). Preámbulos. 11 Matrices en Haskell. Operaciones sobre matrices.

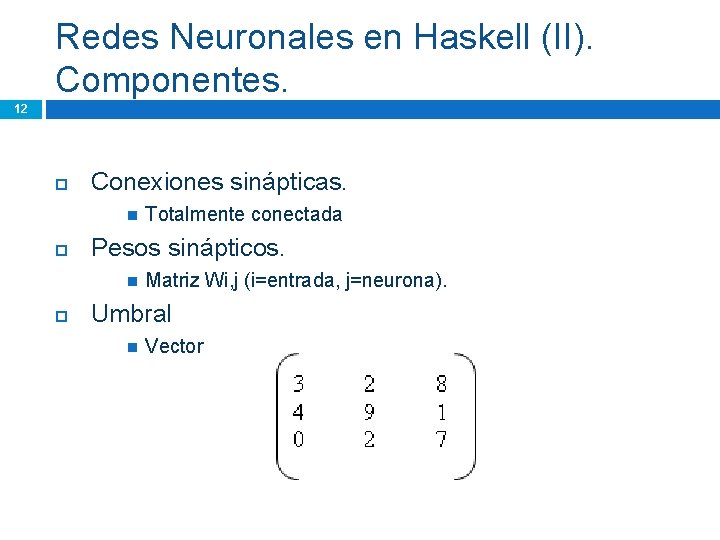

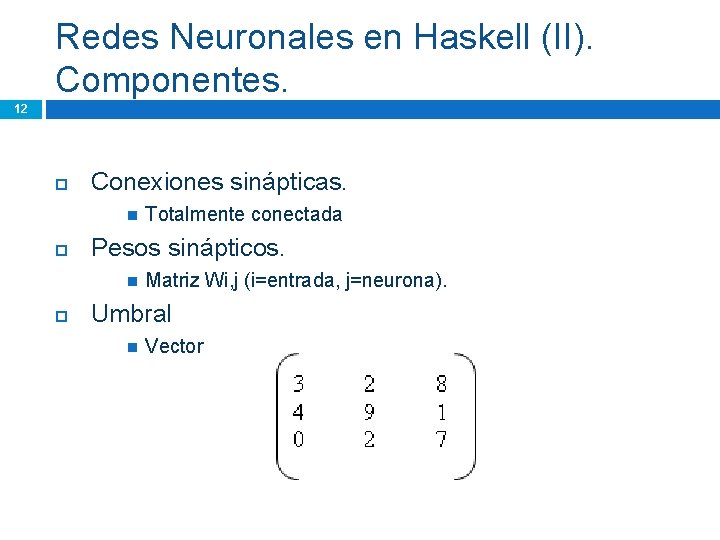

Redes Neuronales en Haskell (II). Componentes. 12 Conexiones sinápticas. Pesos sinápticos. Totalmente conectada Matriz Wi, j (i=entrada, j=neurona). Umbral Vector

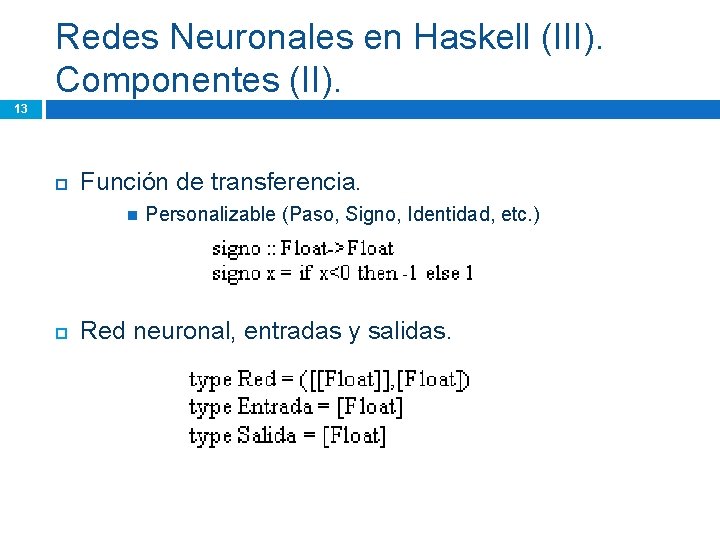

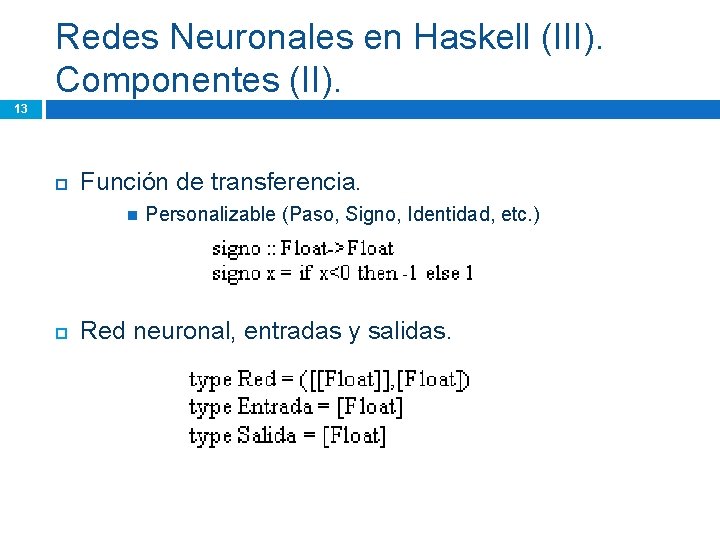

Redes Neuronales en Haskell (III). Componentes (II). 13 Función de transferencia. Personalizable (Paso, Signo, Identidad, etc. ) Red neuronal, entradas y salidas.

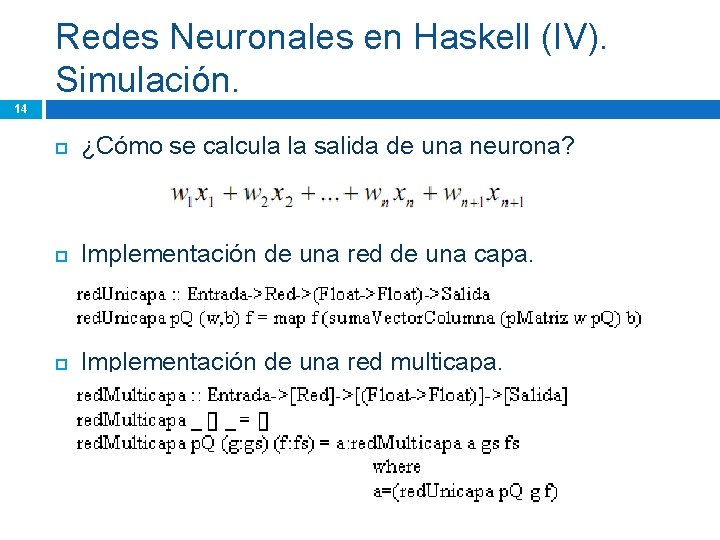

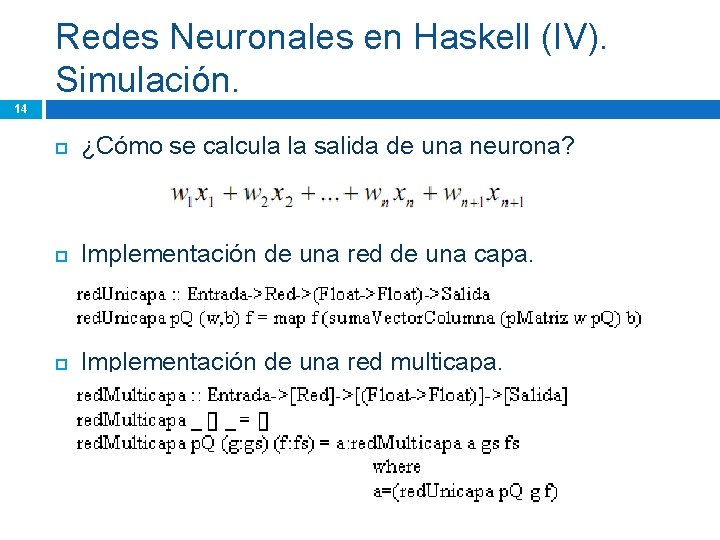

Redes Neuronales en Haskell (IV). Simulación. 14 ¿Cómo se calcula la salida de una neurona? Implementación de una red de una capa. Implementación de una red multicapa.

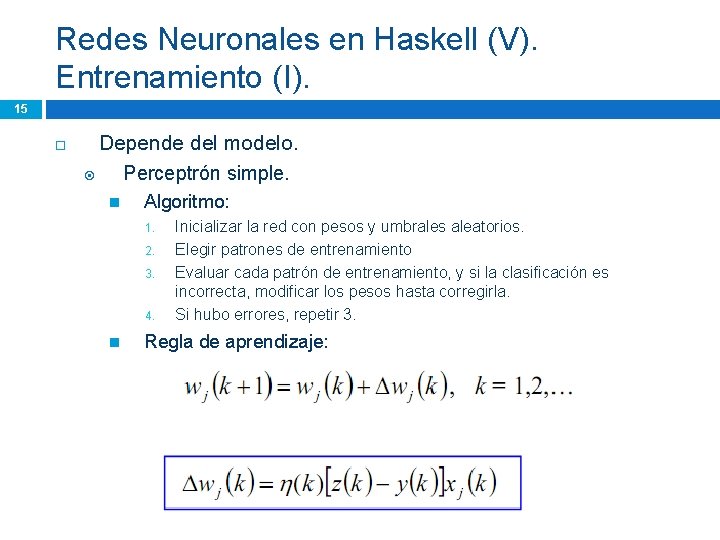

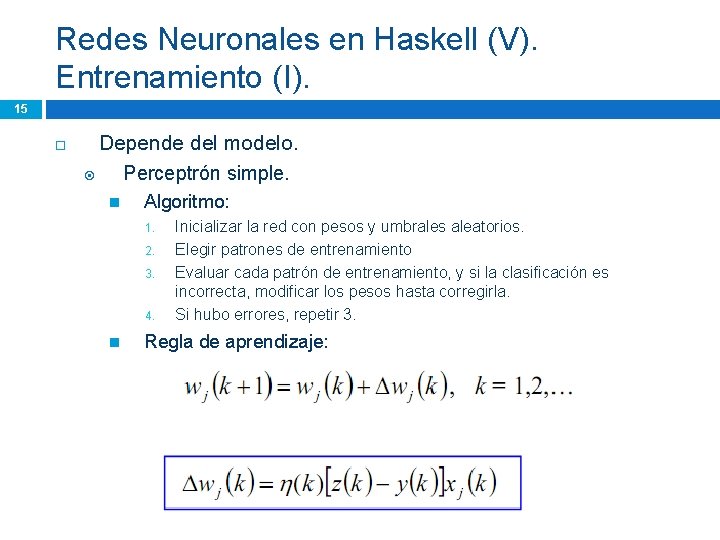

Redes Neuronales en Haskell (V). Entrenamiento (I). 15 Depende del modelo. Perceptrón simple. Algoritmo: 1. 2. 3. 4. Inicializar la red con pesos y umbrales aleatorios. Elegir patrones de entrenamiento Evaluar cada patrón de entrenamiento, y si la clasificación es incorrecta, modificar los pesos hasta corregirla. Si hubo errores, repetir 3. Regla de aprendizaje:

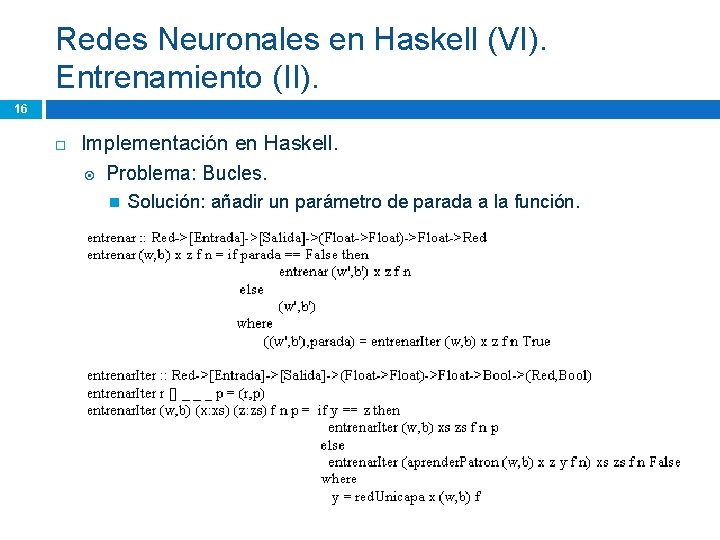

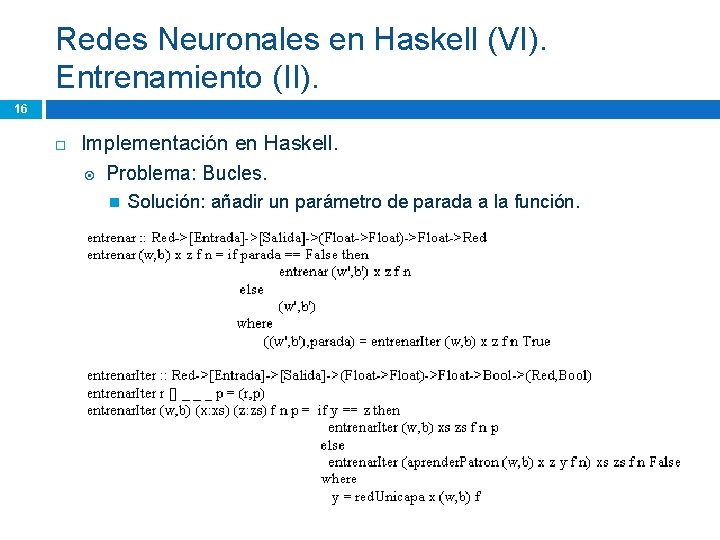

Redes Neuronales en Haskell (VI). Entrenamiento (II). 16 Implementación en Haskell. Problema: Bucles. Solución: añadir un parámetro de parada a la función.

Redes Neuronales en MATLAB(I) 17 MATLAB es un software de computación numérica MATLAB es un software muy usado, tanto en universidades como para propósitos de desarrollo e investigación. Fue creado en la década de los setenta por Cleve Moler Reconociendo el potencial comercial del software se unieron junto a Steve Bangert para fundar en 1984 The Math. Works

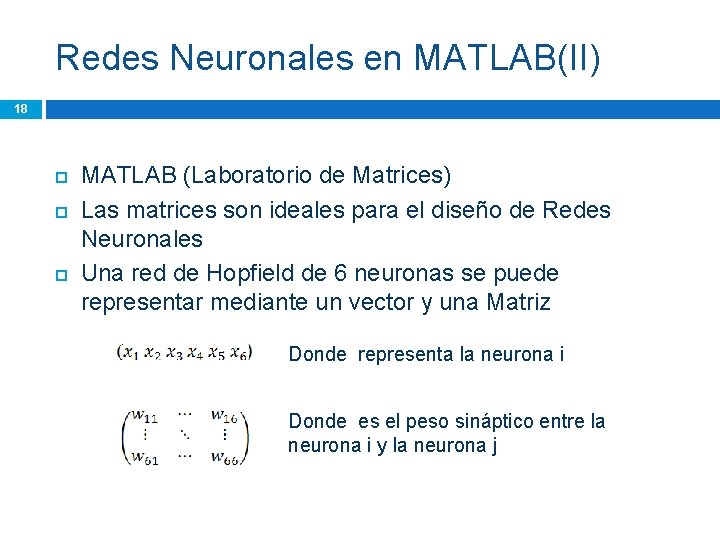

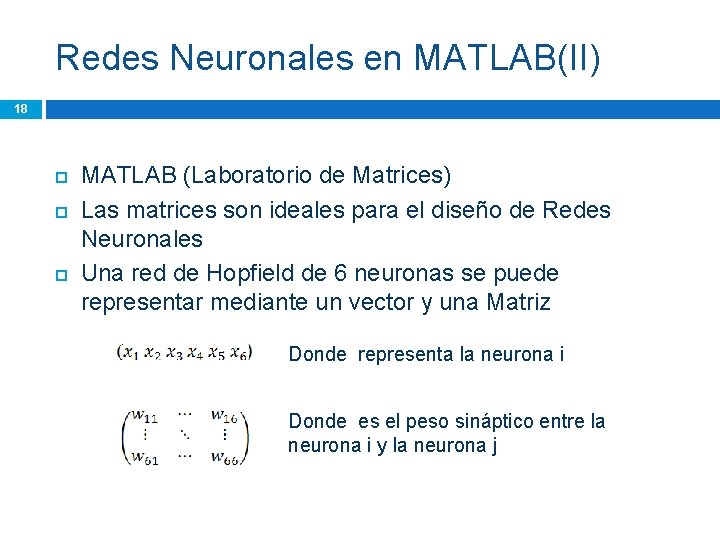

Redes Neuronales en MATLAB(II) 18 MATLAB (Laboratorio de Matrices) Las matrices son ideales para el diseño de Redes Neuronales Una red de Hopfield de 6 neuronas se puede representar mediante un vector y una Matriz Donde representa la neurona i Donde es el peso sináptico entre la neurona i y la neurona j

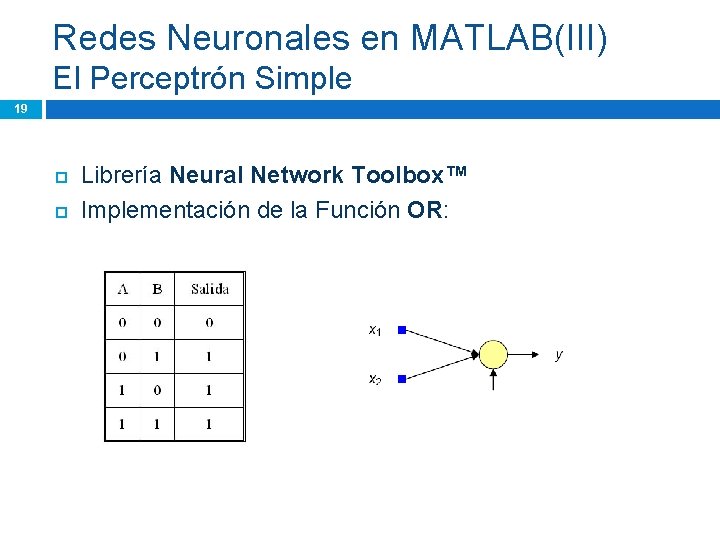

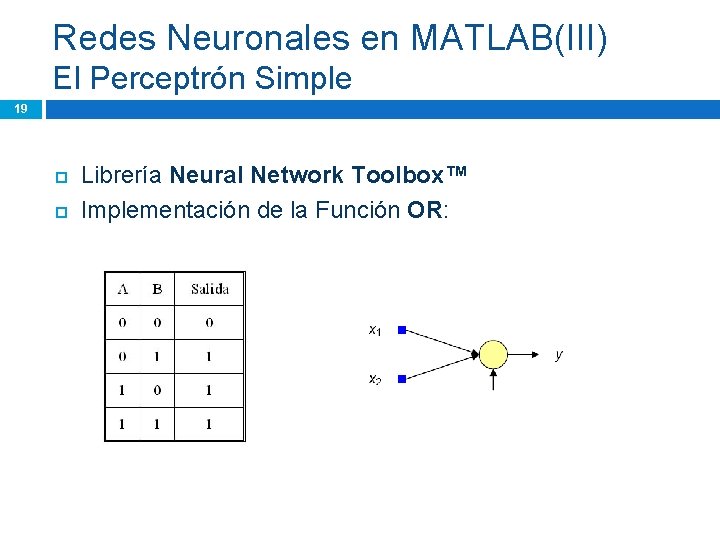

Redes Neuronales en MATLAB(III) El Perceptrón Simple 19 Librería Neural Network Toolbox™ Implementación de la Función OR:

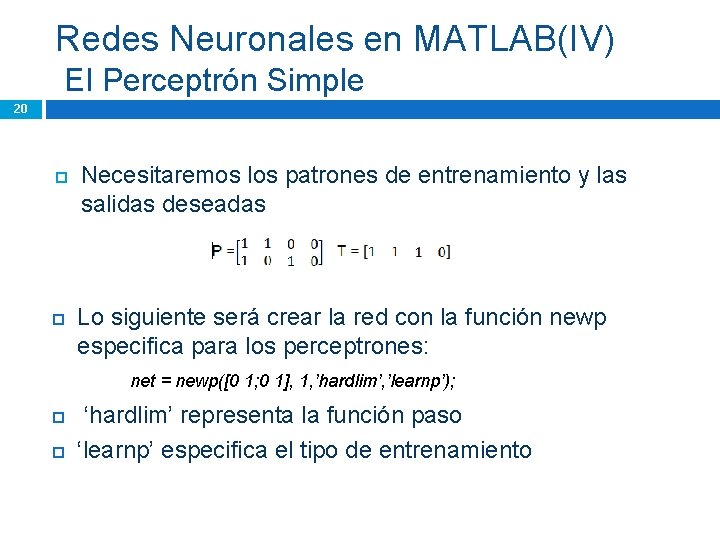

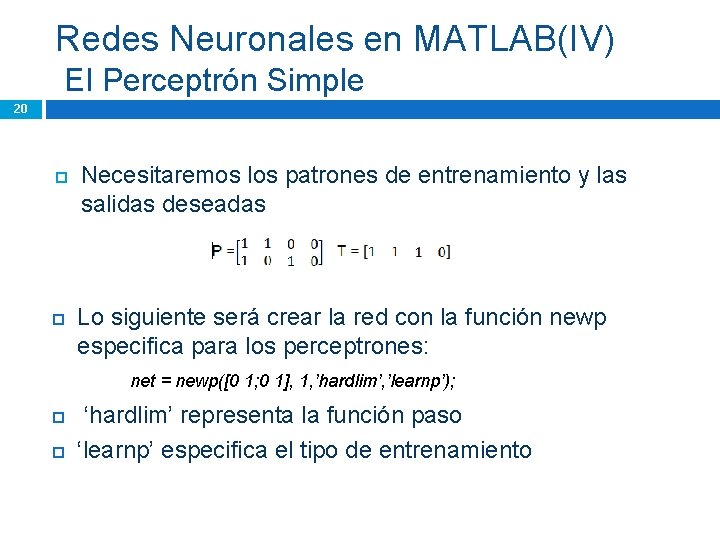

Redes Neuronales en MATLAB(IV) El Perceptrón Simple 20 Necesitaremos los patrones de entrenamiento y las salidas deseadas Lo siguiente será crear la red con la función newp especifica para los perceptrones: net = newp([0 1; 0 1], 1, ’hardlim’, ’learnp’); ‘hardlim’ representa la función paso ‘learnp’ especifica el tipo de entrenamiento

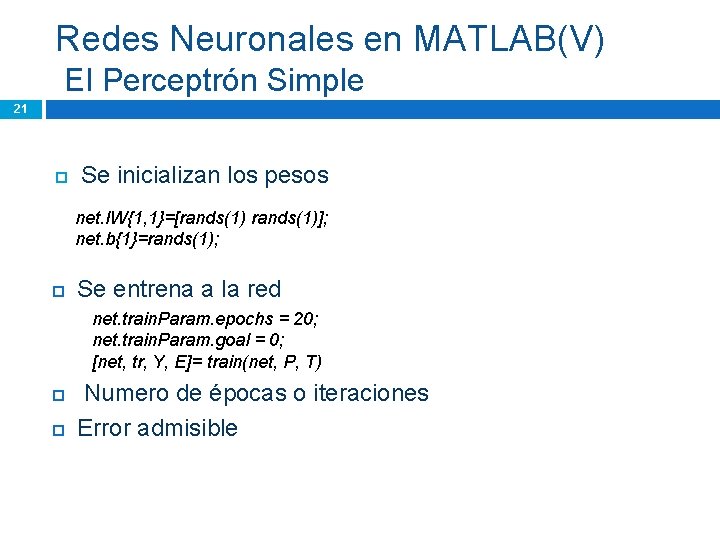

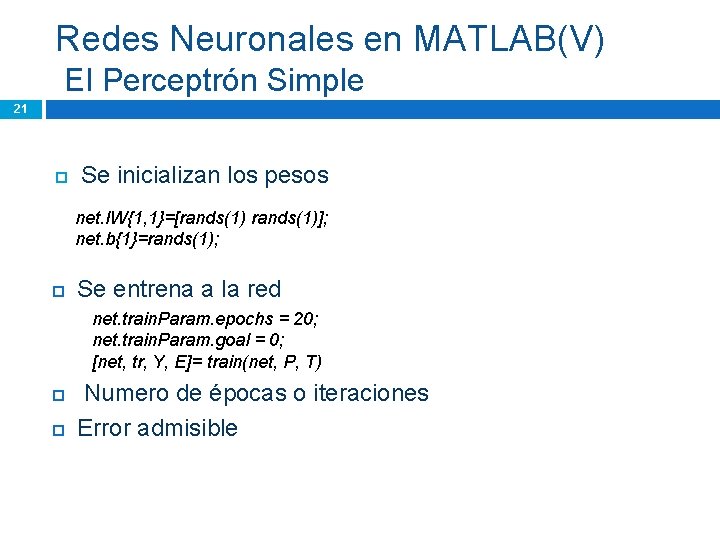

Redes Neuronales en MATLAB(V) El Perceptrón Simple 21 Se inicializan los pesos net. IW{1, 1}=[rands(1)]; net. b{1}=rands(1); Se entrena a la red net. train. Param. epochs = 20; net. train. Param. goal = 0; [net, tr, Y, E]= train(net, P, T) Numero de épocas o iteraciones Error admisible

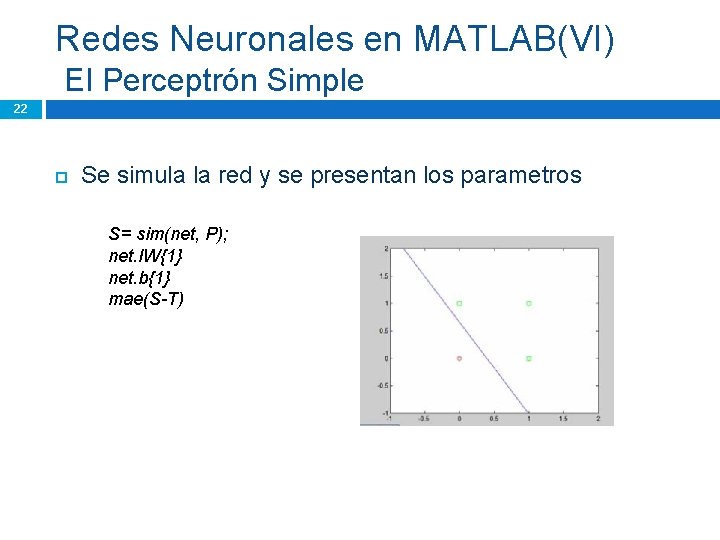

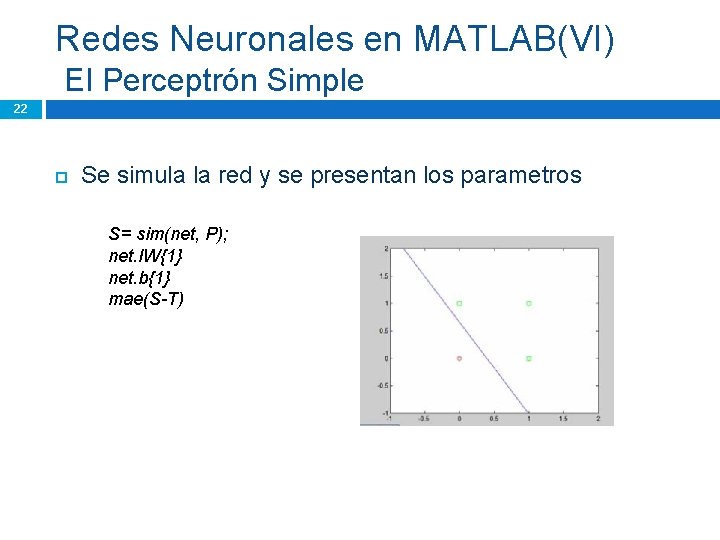

Redes Neuronales en MATLAB(VI) El Perceptrón Simple 22 Se simula la red y se presentan los parametros S= sim(net, P); net. IW{1} net. b{1} mae(S-T)

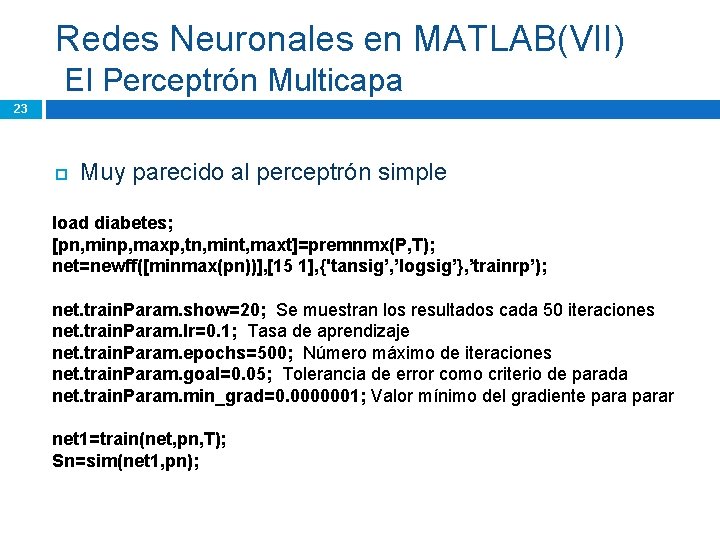

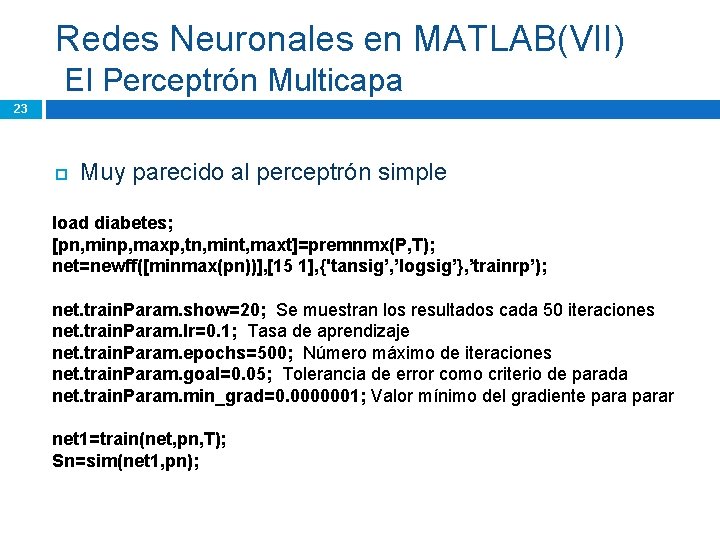

Redes Neuronales en MATLAB(VII) El Perceptrón Multicapa 23 Muy parecido al perceptrón simple load diabetes; [pn, minp, maxp, tn, mint, maxt]=premnmx(P, T); net=newff([minmax(pn))], [15 1], {'tansig’, ’logsig’}, ’trainrp’); net. train. Param. show=20; Se muestran los resultados cada 50 iteraciones net. train. Param. lr=0. 1; Tasa de aprendizaje net. train. Param. epochs=500; Número máximo de iteraciones net. train. Param. goal=0. 05; Tolerancia de error como criterio de parada net. train. Param. min_grad=0. 0000001; Valor mínimo del gradiente parar net 1=train(net, pn, T); Sn=sim(net 1, pn);

Redes Neuronales en LISP(I) Introducción a LISP(I) 24 LISP (LISt Processing). Propuesto por John Mc. Carthy a finales de los 50 como una alternativa al modelo de computación tradicional. Las listas son la base tanto de los programas como de los datos en LISP, proporcionando un conjunto potente de funciones que las manipulan. Implementado internamente como punteros.

Redes Neuronales en LISP(II) Introducción a LISP(II) 25 Originalmente un lenguaje simple y pequeño. Se le han ido incorporando funciones especializadas como estructuras de datos, aritmética de reales… provocando la aparición de diferentes dialectos del LISP. en 1983, la Agencia de Proyectos Avanzados de Investigación propuso un dialecto standard del lenguaje, conocido bajo el nombre de Common Lisp.

Redes Neuronales en LISP(III) Introducción a LISP(III) 26 En un principio, muchos de los programas desarrollados dentro del ámbito de la Inteligencia Artificial se implementaron en LISP. Posteriormente, aparecieron formalismos de más alto nivel utilizando LISP como lenguaje para su implementación. Se podría considerar el LISP como el lenguaje referencia de la Inteligencia Artificial.

Redes Neuronales en LISP(IV) Implementación. 27 Existe un repositorio de código Lisp accesible y público (http: //aima. cs. berckeley. edu/). En él están implementados los principales tipos de redes neuronales, así como una amplia gama de funciones necesarias para su manipulación.

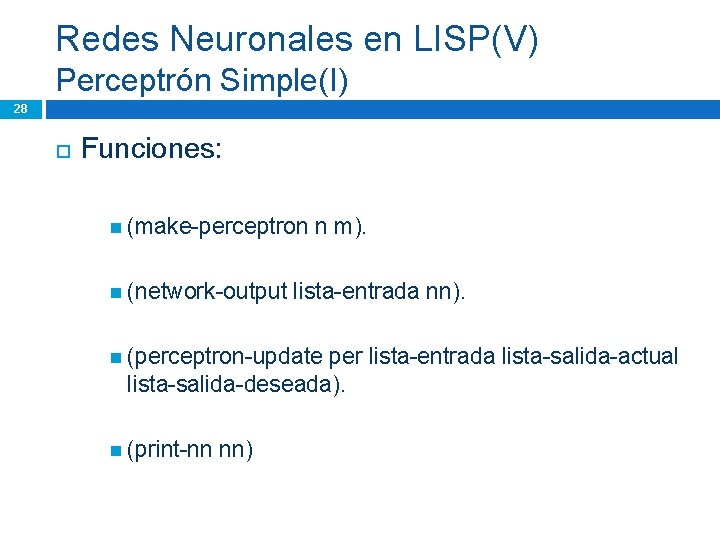

Redes Neuronales en LISP(V) Perceptrón Simple(I) 28 Funciones: (make-perceptron (network-output n m). lista-entrada nn). (perceptron-update per lista-entrada lista-salida-actual lista-salida-deseada). (print-nn nn)

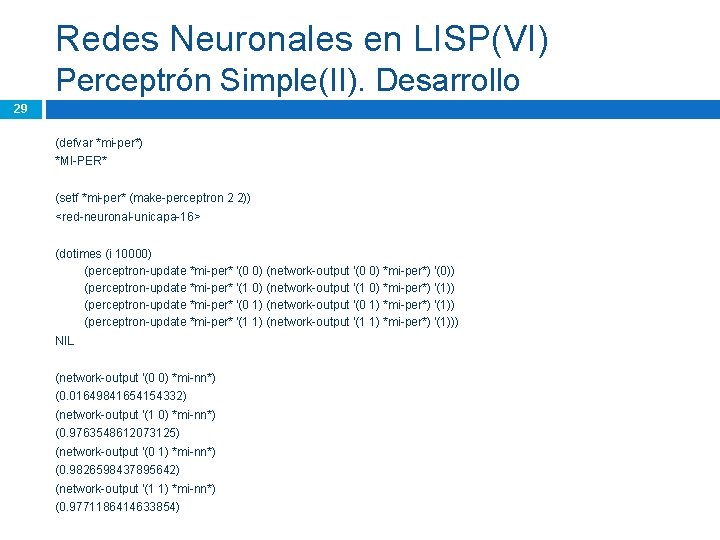

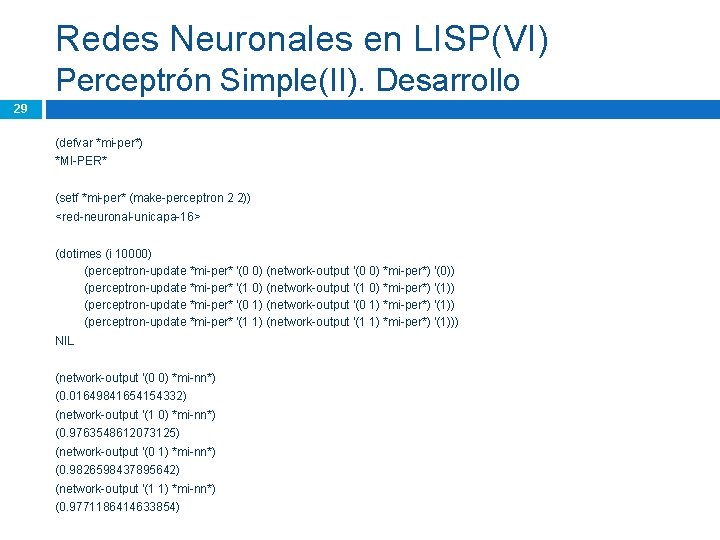

Redes Neuronales en LISP(VI) Perceptrón Simple(II). Desarrollo 29 (defvar *mi-per*) *MI-PER* (setf *mi-per* (make-perceptron 2 2)) <red-neuronal-unicapa-16> (dotimes (i 10000) (perceptron-update *mi-per* '(0 0) (network-output '(0 0) *mi-per*) '(0)) (perceptron-update *mi-per* '(1 0) (network-output '(1 0) *mi-per*) '(1)) (perceptron-update *mi-per* '(0 1) (network-output '(0 1) *mi-per*) '(1)) (perceptron-update *mi-per* '(1 1) (network-output '(1 1) *mi-per*) '(1))) NIL (network-output '(0 0) *mi-nn*) (0. 01649841654154332) (network-output '(1 0) *mi-nn*) (0. 9763548612073125) (network-output '(0 1) *mi-nn*) (0. 9826598437895642) (network-output '(1 1) *mi-nn*) (0. 9771186414633854)

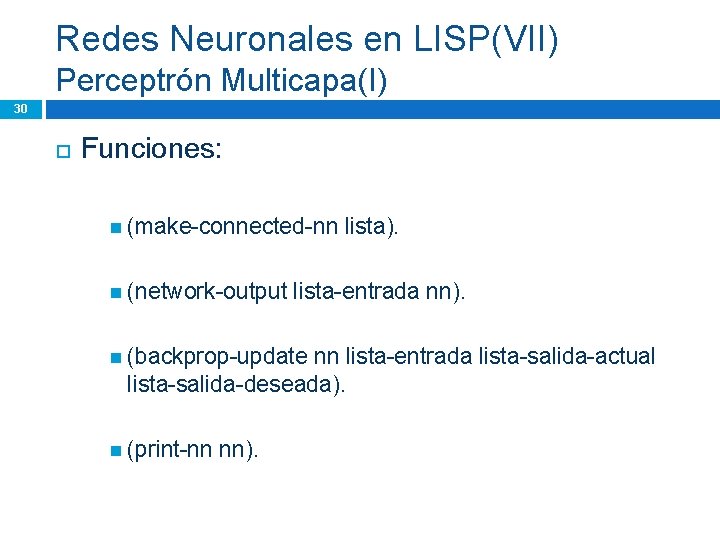

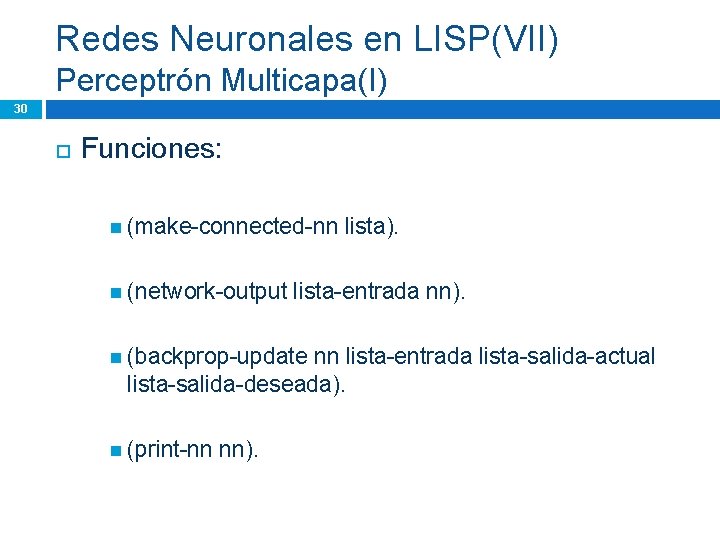

Redes Neuronales en LISP(VII) Perceptrón Multicapa(I) 30 Funciones: (make-connected-nn (network-output lista). lista-entrada nn). (backprop-update nn lista-entrada lista-salida-actual lista-salida-deseada). (print-nn nn).

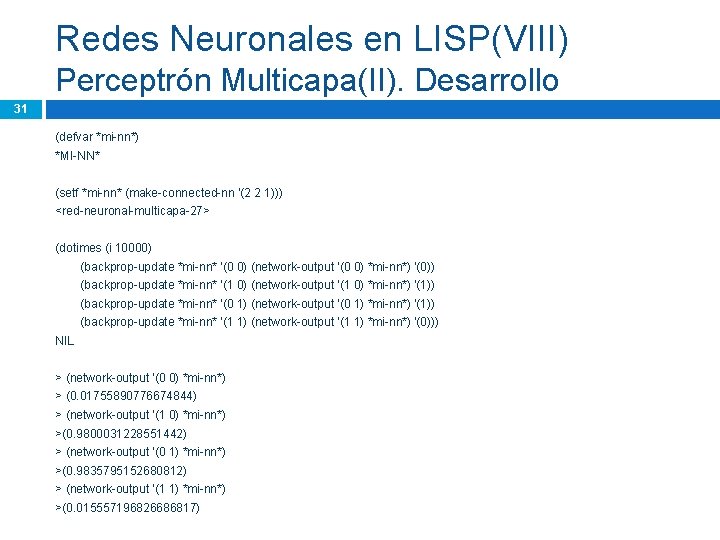

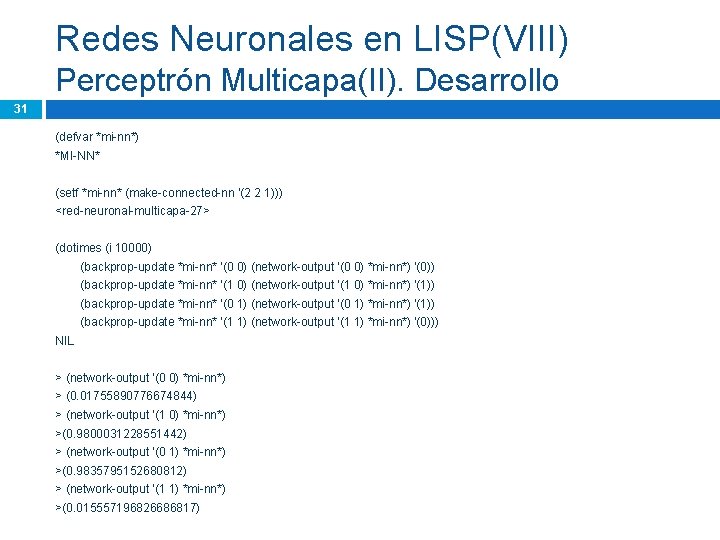

Redes Neuronales en LISP(VIII) Perceptrón Multicapa(II). Desarrollo 31 (defvar *mi-nn*) *MI-NN* (setf *mi-nn* (make-connected-nn '(2 2 1))) <red-neuronal-multicapa-27> (dotimes (i 10000) (backprop-update *mi-nn* '(0 0) (network-output '(0 0) *mi-nn*) '(0)) (backprop-update *mi-nn* '(1 0) (network-output '(1 0) *mi-nn*) '(1)) (backprop-update *mi-nn* '(0 1) (network-output '(0 1) *mi-nn*) '(1)) (backprop-update *mi-nn* '(1 1) (network-output '(1 1) *mi-nn*) '(0))) NIL > (network-output '(0 0) *mi-nn*) > (0. 01755890776674844) > (network-output '(1 0) *mi-nn*) >(0. 9800031228551442) > (network-output '(0 1) *mi-nn*) >(0. 9835795152680812) > (network-output '(1 1) *mi-nn*) >(0. 015557196826686817)

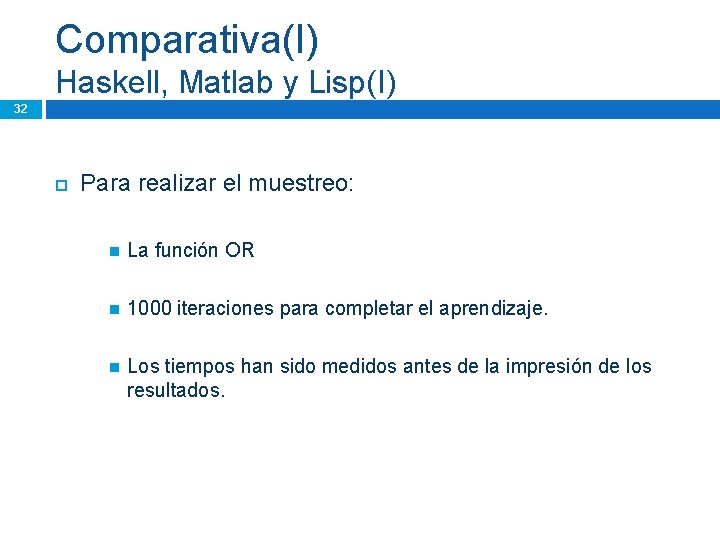

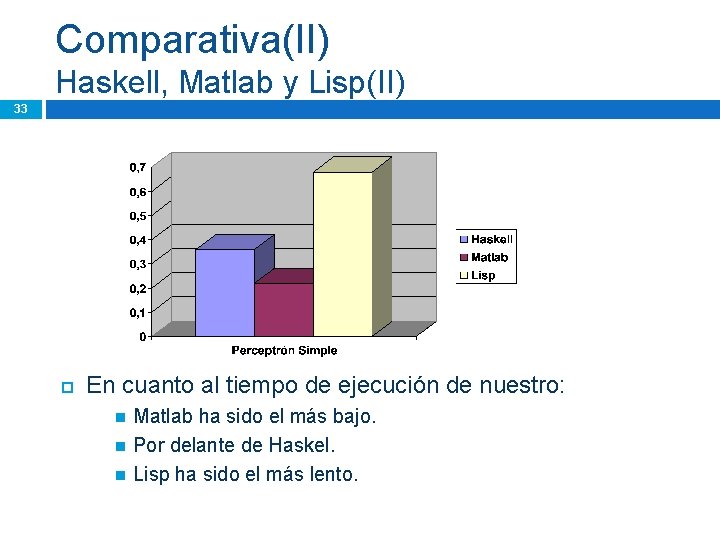

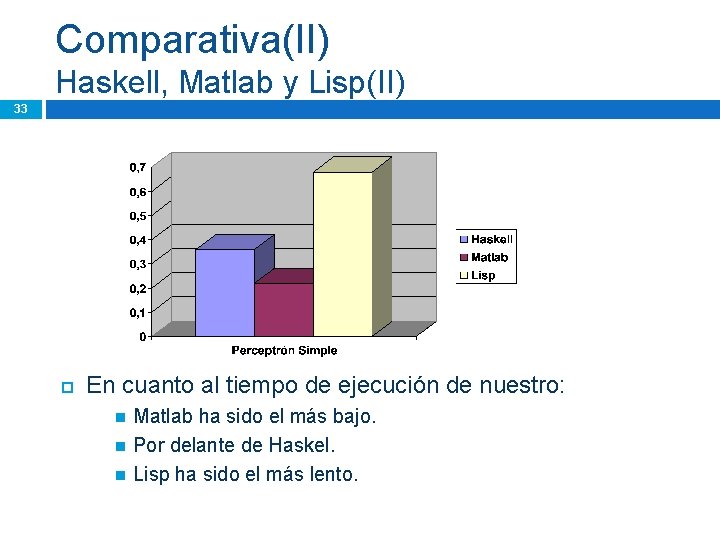

Comparativa(I) Haskell, Matlab y Lisp(I) 32 Para realizar el muestreo: La función OR 1000 iteraciones para completar el aprendizaje. Los tiempos han sido medidos antes de la impresión de los resultados.

Comparativa(II) Haskell, Matlab y Lisp(II) 33 En cuanto al tiempo de ejecución de nuestro: Matlab ha sido el más bajo. Por delante de Haskel. Lisp ha sido el más lento.

Redes Neuronales en la Universidad(I) 34 Universidad Granada 2 asignaturas (una troncal y otra optativa) MATLAB Universidad Sevilla 1 Tema introductorio de una asignatura Troncal sobre Teoría del Conocimiento e Inteligencia Artificial Carácter completamente teórico

Redes Neuronales en la Universidad(II) 35 Universidad Politécnica de Madrid 1 asignatura (optativa) Carácter teórico Universidad Politécnica de Barcelona 1 tema de una asignatura (optativa) Carácter introductorio y teórico

Conclusiones 36 ¿Cuál elegir? Depende de nuestras necesidades: Máxima eficiencia: MATLAB Gran volumen de datos: MATLAB RN relativamente pequeñas: Haskell Claridad del programa: Haskell ¿Haskell o Lisp? Haskell más eficiente y menos engorroso Al final se reduce a una cuestión de preferencia

Referencias 37 Apuntes Jose Muñoz Perez, asignatura “Modelos Computacionales” Universidad de Málaga (2009) “Redes Neuronales y Sistemas Borrosos” Bonifacio Martín del Brio (2001) “Estructura Dinámica y Aplicaciones de las Redes de Neuronas Artificiales” Juan Rios (1991) Wikipedia http: //es. wikipedia. org Imágenes google http: //images. google. es/imghp? hl=es&tab=wi Razonando con Haskell. Una Introducción a la Programación Funcional , Blas C. Ruiz, Francisco Gutiérrez, Pablo Guerrero y José E. Gallardo.

Referencias 38 Trabajo Redes Neuronales en Haskell (2006), Francisco Jesús Fernández Burgos, José Manuel Cortés López Paginas web de las diferentes asignaturas: Universidad Granada: http: //decsai. ugr. es/~castro/MCII/ http: //decsai. ugr. es/index. php? p=temarios&cod_asigtura=24 Universidad Sevilla: Universidad Madrid: http: //www. us. es/estudios/titulaciones/plan_26_23/asignatura_260108 http: //www. dia. fi. upm. es/index. php? page=inteligencia-artificial-coenexionista-rna&hl=es_ES Universidad Barcelona: http: //www. fib. upc. edu/es/info. Aca/estudis/assignatures/A. html

GRACIAS POR LA ATENCIÓN. Antonio Claros, Juan Fco. Gutiérrez, Juan Miguel Muñoz