Odkrywanie wzorcw sekwencji Prefix Span Odkrywanie wzorcw sekwencji

![Dwupoziomowy schemat projekcji n n Element M[a, b] = (x_1, x_2, x_3) reprezentuje wartości Dwupoziomowy schemat projekcji n n Element M[a, b] = (x_1, x_2, x_3) reprezentuje wartości](https://slidetodoc.com/presentation_image_h/731e312dd1384cfad903a91f989b62cc/image-18.jpg)

- Slides: 32

Odkrywanie wzorców sekwencji Prefix Span Odkrywanie wzorców sekwencji z ograniczeniami Uogólnione wzorce sekwencji

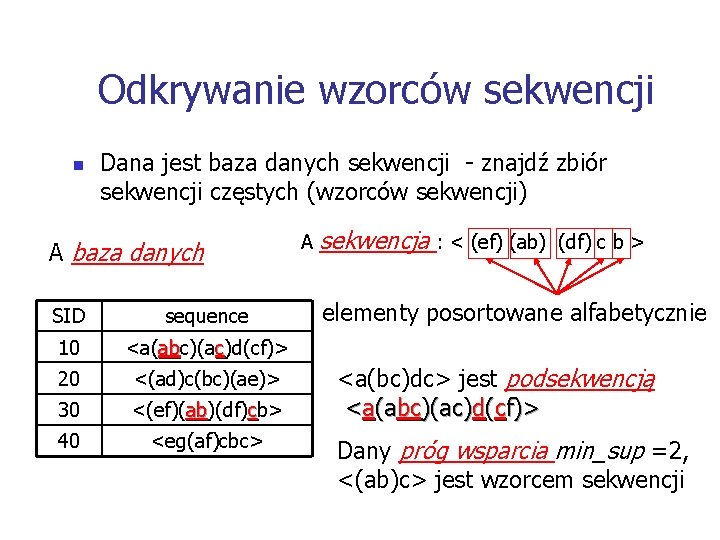

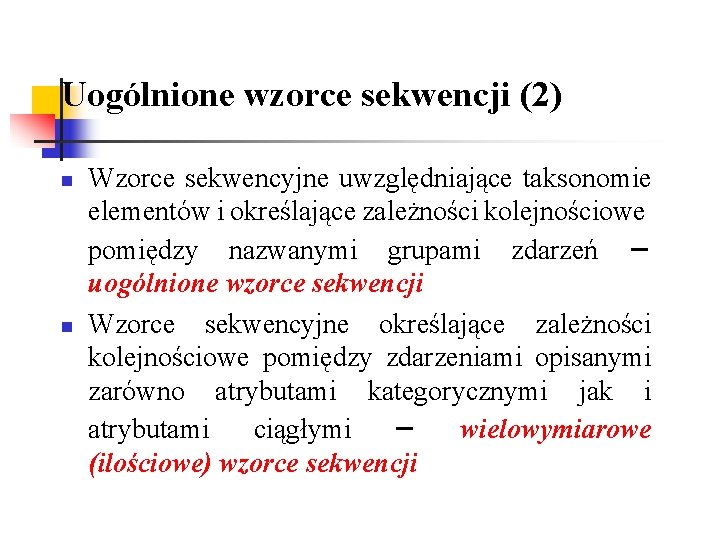

Odkrywanie wzorców sekwencji n Dana jest baza danych sekwencji - znajdź zbiór sekwencji częstych (wzorców sekwencji) A baza danych SID sequence 10 <a(abc)(a c)d(cf)> ab 20 <(ad)c(bc)(ae)> 30 <(ef)(ab)(df) cb> ab 40 <eg(af)cbc> A sekwencja : < (ef) (ab) (df) c b > elementy posortowane alfabetycznie <a(bc)dc> jest podsekwencją <a(abc)(ac)d(cf)> Dany próg wsparcia min_sup =2, <(ab)c> jest wzorcem sekwencji

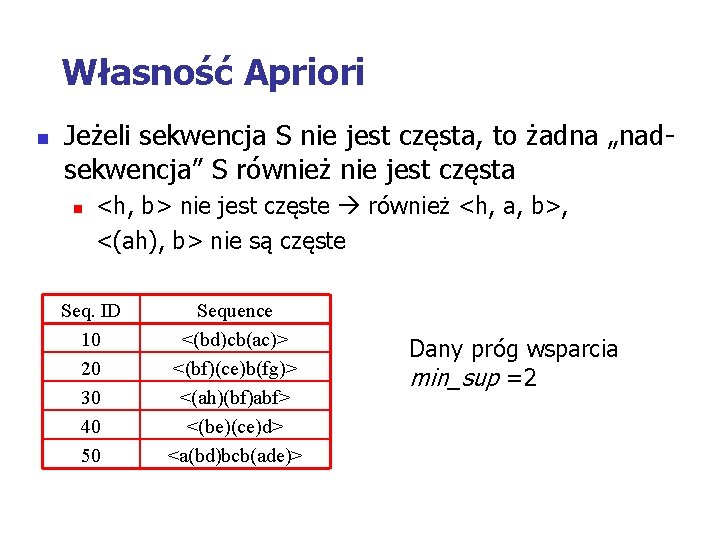

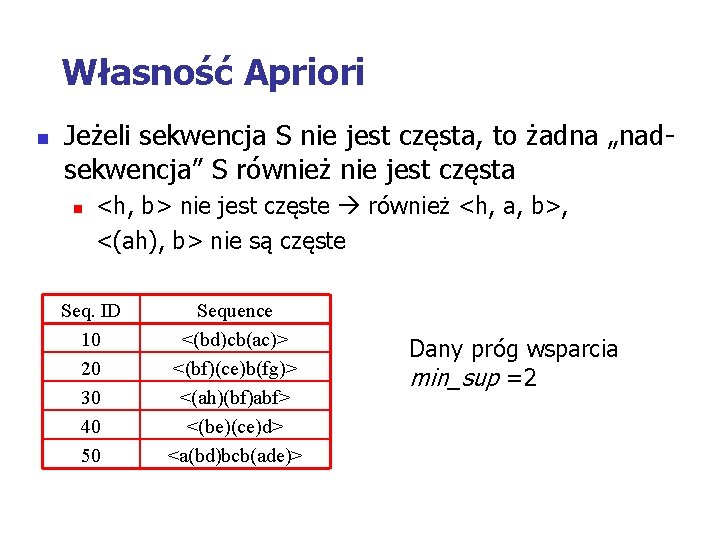

Własność Apriori n Jeżeli sekwencja S nie jest częsta, to żadna „nadsekwencja” S również nie jest częsta n <h, b> nie jest częste również <h, a, b>, <(ah), b> nie są częste Seq. ID 10 20 30 40 50 Sequence <(bd)cb(ac)> <(bf)(ce)b(fg)> <(ah)(bf)abf> <(be)(ce)d> <a(bd)bcb(ade)> Dany próg wsparcia min_sup =2

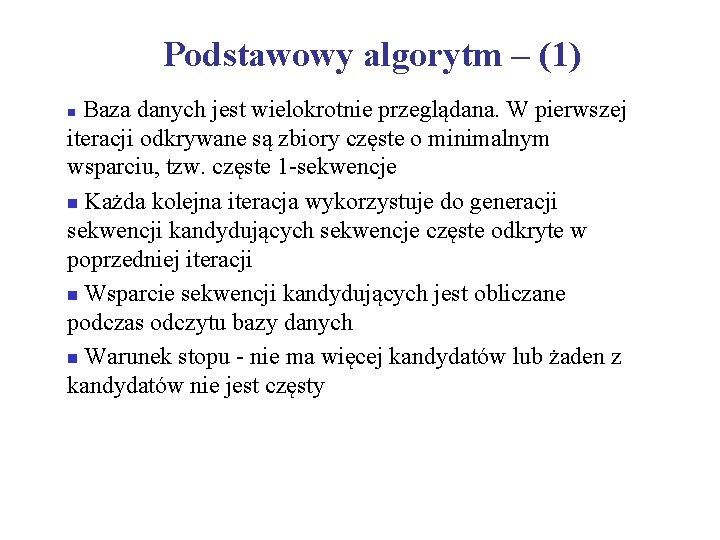

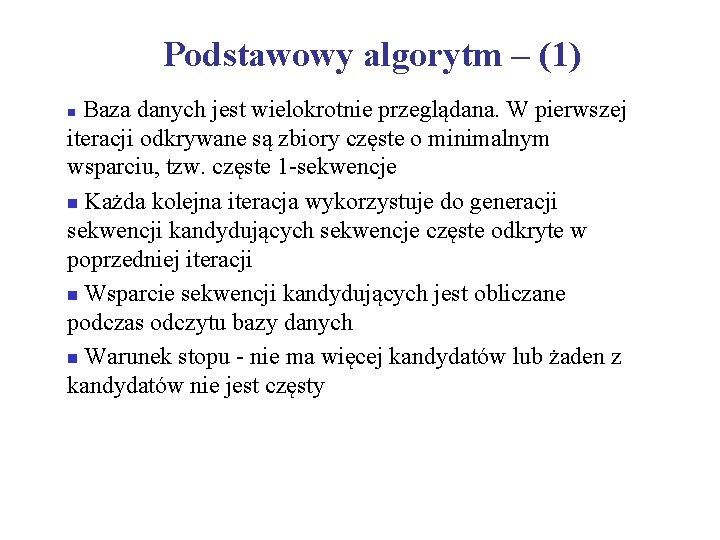

Podstawowy algorytm – (1) Baza danych jest wielokrotnie przeglądana. W pierwszej iteracji odkrywane są zbiory częste o minimalnym wsparciu, tzw. częste 1 -sekwencje n Każda kolejna iteracja wykorzystuje do generacji sekwencji kandydujących sekwencje częste odkryte w poprzedniej iteracji n Wsparcie sekwencji kandydujących jest obliczane podczas odczytu bazy danych n Warunek stopu - nie ma więcej kandydatów lub żaden z kandydatów nie jest częsty n

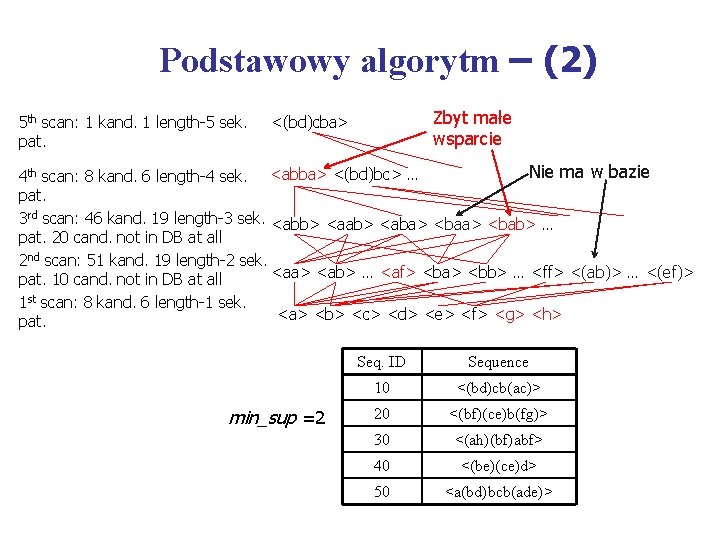

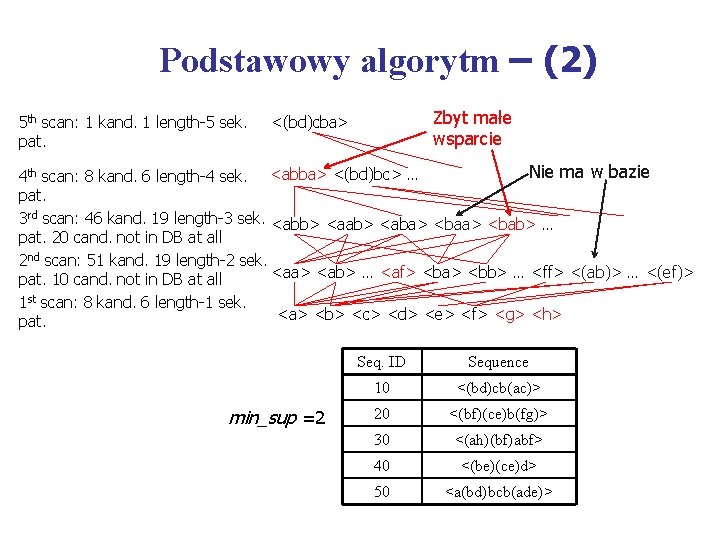

Podstawowy algorytm – (2) 5 th scan: 1 kand. 1 length-5 sek. pat. Zbyt małe wsparcie <(bd)cba> Nie ma w bazie 4 th scan: 8 kand. 6 length-4 sek. <abba> <(bd)bc> … pat. 3 rd scan: 46 kand. 19 length-3 sek. <abb> <aab> <aba> <bab> … pat. 20 cand. not in DB at all 2 nd scan: 51 kand. 19 length-2 sek. <aa> <ab> … <af> <ba> <bb> … <ff> <(ab)> … <(ef)> pat. 10 cand. not in DB at all 1 st scan: 8 kand. 6 length-1 sek. <a> <b> <c> <d> <e> <f> <g> <h> pat. min_sup =2 Seq. ID Sequence 10 <(bd)cb(ac)> 20 <(bf)(ce)b(fg)> 30 <(ah)(bf)abf> 40 <(be)(ce)d> 50 <a(bd)bcb(ade)>

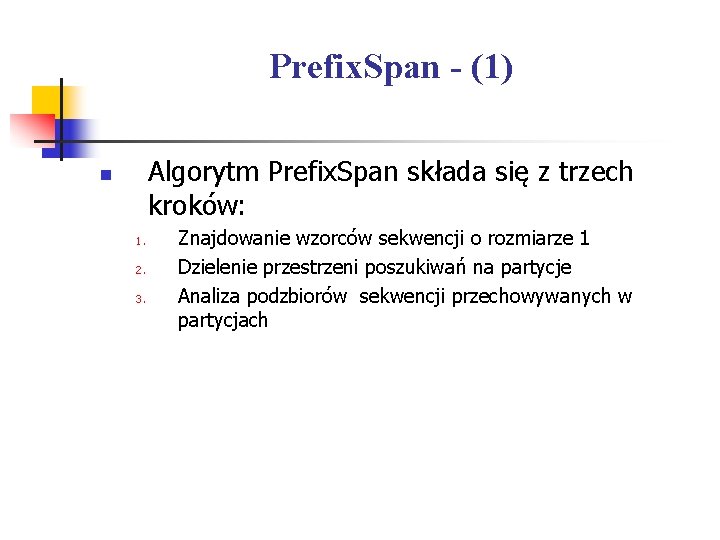

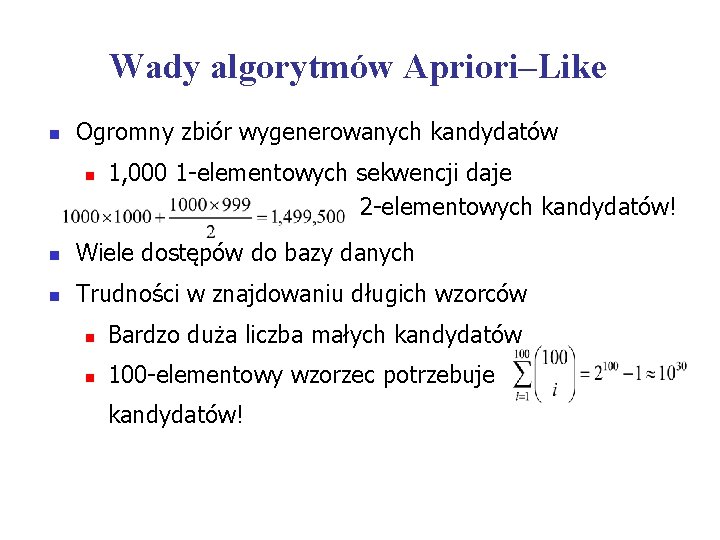

Wady algorytmów Apriori–Like n Ogromny zbiór wygenerowanych kandydatów n 1, 000 1 -elementowych sekwencji daje 2 -elementowych kandydatów! n Wiele dostępów do bazy danych n Trudności w znajdowaniu długich wzorców n Bardzo duża liczba małych kandydatów n 100 -elementowy wzorzec potrzebuje kandydatów!

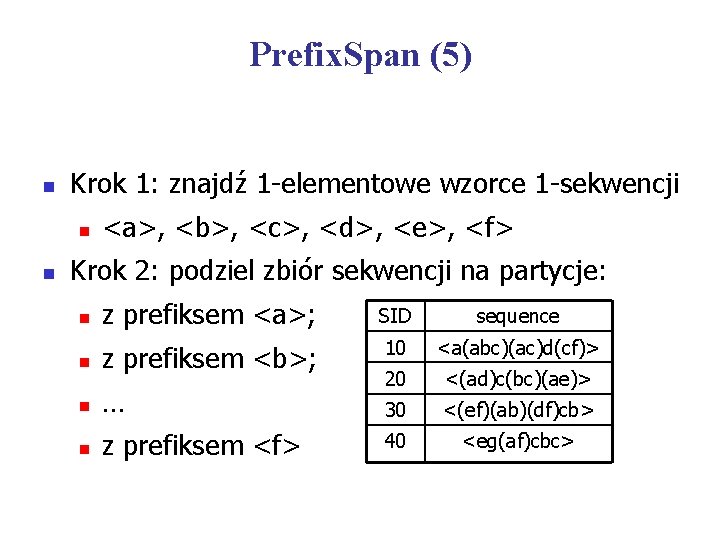

Prefix. Span - (1) Algorytm Prefix. Span składa się z trzech kroków: n 1. 2. 3. Znajdowanie wzorców sekwencji o rozmiarze 1 Dzielenie przestrzeni poszukiwań na partycje Analiza podzbiorów sekwencji przechowywanych w partycjach

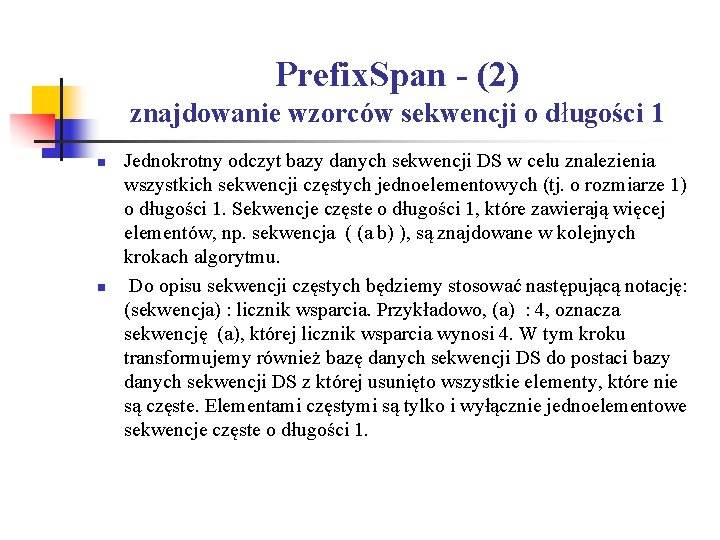

Prefix. Span - (2) znajdowanie wzorców sekwencji o długości 1 n n Jednokrotny odczyt bazy danych sekwencji DS w celu znalezienia wszystkich sekwencji częstych jednoelementowych (tj. o rozmiarze 1) o długości 1. Sekwencje częste o długości 1, które zawierają więcej elementów, np. sekwencja ( (a b) ), są znajdowane w kolejnych krokach algorytmu. Do opisu sekwencji częstych będziemy stosować następującą notację: (sekwencja) : licznik wsparcia. Przykładowo, (a) : 4, oznacza sekwencję (a), której licznik wsparcia wynosi 4. W tym kroku transformujemy również bazę danych sekwencji DS do postaci bazy danych sekwencji DS z której usunięto wszystkie elementy, które nie są częste. Elementami częstymi są tylko i wyłącznie jednoelementowe sekwencje częste o długości 1.

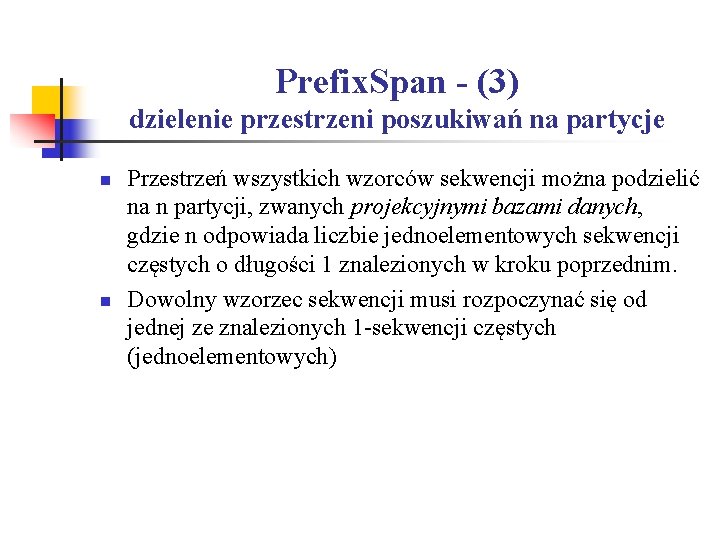

Prefix. Span - (3) dzielenie przestrzeni poszukiwań na partycje n n Przestrzeń wszystkich wzorców sekwencji można podzielić na n partycji, zwanych projekcyjnymi bazami danych, gdzie n odpowiada liczbie jednoelementowych sekwencji częstych o długości 1 znalezionych w kroku poprzednim. Dowolny wzorzec sekwencji musi rozpoczynać się od jednej ze znalezionych 1 -sekwencji częstych (jednoelementowych)

Prefix. Span (4) analiza podzbiorów sekwencji przechowywanych w partycjach n n n Dla każdej jednoelementowej sekwencji częstej o długości 1 tworzymy projekcyjną bazę danych jej postfiksów Każda projekcyjna baza danych jest następnie rekurencyjnie eksplorowana w celu wygenerowania wzorców sekwencji. Eksploracja polega na znajdowaniu wieloelementowych sekwencji częstych o długości 1 lub sekwencji częstych o długości 2, utworzeniu kolejnych projekcyjnych baz danych dla znalezionych sekwencji częstych, eksploracji tych baz danych, itd.

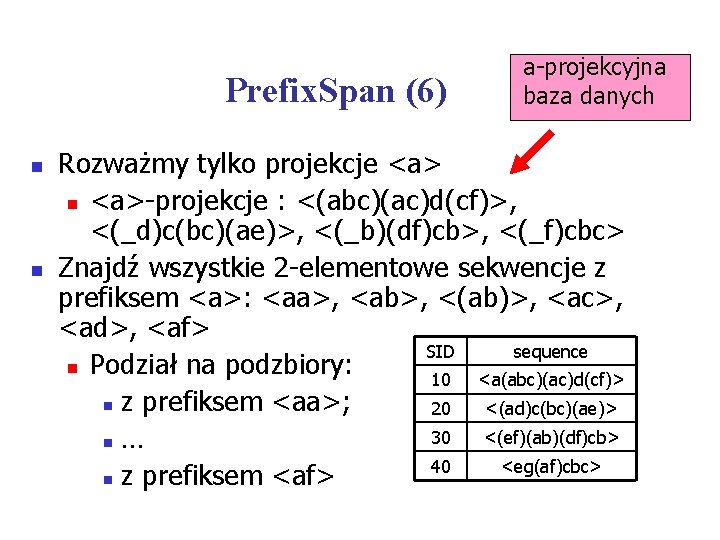

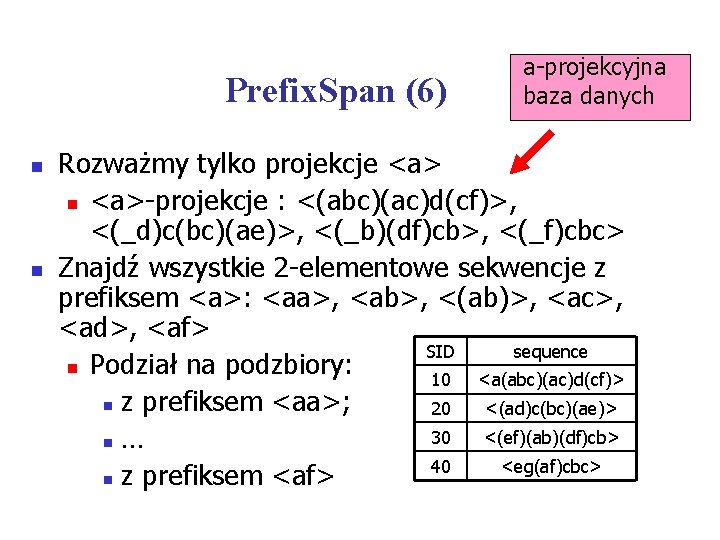

Prefix. Span (5) n Krok 1: znajdź 1 -elementowe wzorce 1 -sekwencji n n <a>, <b>, <c>, <d>, <e>, <f> Krok 2: podziel zbiór sekwencji na partycje: n z prefiksem <a>; SID sequence n z prefiksem <b>; 10 <a(abc)(ac)d(cf)> <(ad)c(bc)(ae)> n … 20 30 <(ef)(ab)(df)cb> n z prefiksem <f> 40 <eg(af)cbc>

Prefix. Span (6) n n a-projekcyjna baza danych Rozważmy tylko projekcje <a> n <a>-projekcje : <(abc)(ac)d(cf)>, <(_d)c(bc)(ae)>, <(_b)(df)cb>, <(_f)cbc> Znajdź wszystkie 2 -elementowe sekwencje z prefiksem <a>: <aa>, <ab>, <(ab)>, <ac>, <ad>, <af> SID sequence n Podział na podzbiory: 10 <a(abc)(ac)d(cf)> n z prefiksem <aa>; 20 <(ad)c(bc)(ae)> 30 <(ef)(ab)(df)cb> n … 40 <eg(af)cbc> n z prefiksem <af>

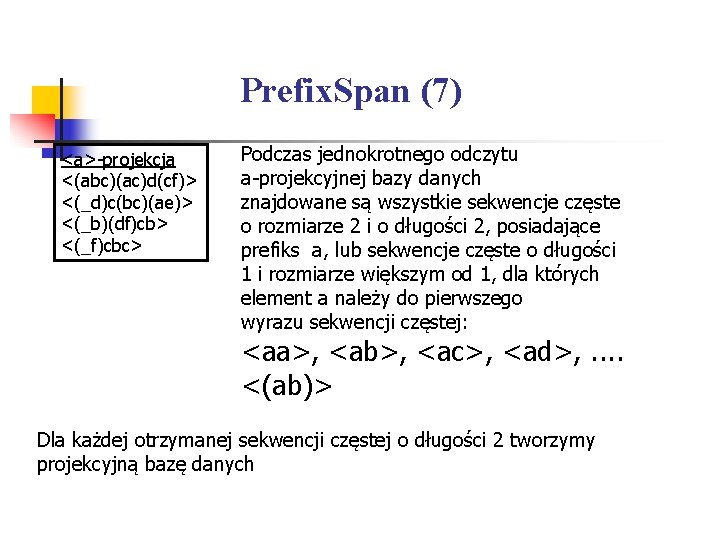

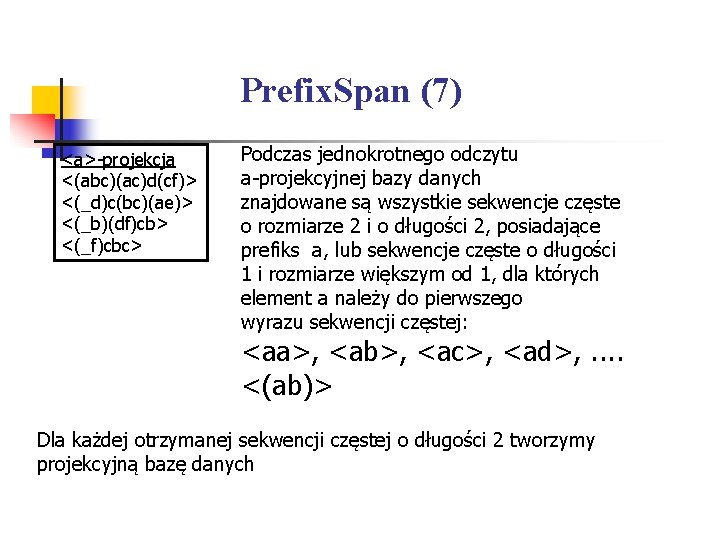

Prefix. Span (7) <a>-projekcja <(abc)(ac)d(cf)> <(_d)c(bc)(ae)> <(_b)(df)cb> <(_f)cbc> Podczas jednokrotnego odczytu a-projekcyjnej bazy danych znajdowane są wszystkie sekwencje częste o rozmiarze 2 i o długości 2, posiadające prefiks a, lub sekwencje częste o długości 1 i rozmiarze większym od 1, dla których element a należy do pierwszego wyrazu sekwencji częstej: <aa>, <ab>, <ac>, <ad>, . . <(ab)> Dla każdej otrzymanej sekwencji częstej o długości 2 tworzymy projekcyjną bazę danych

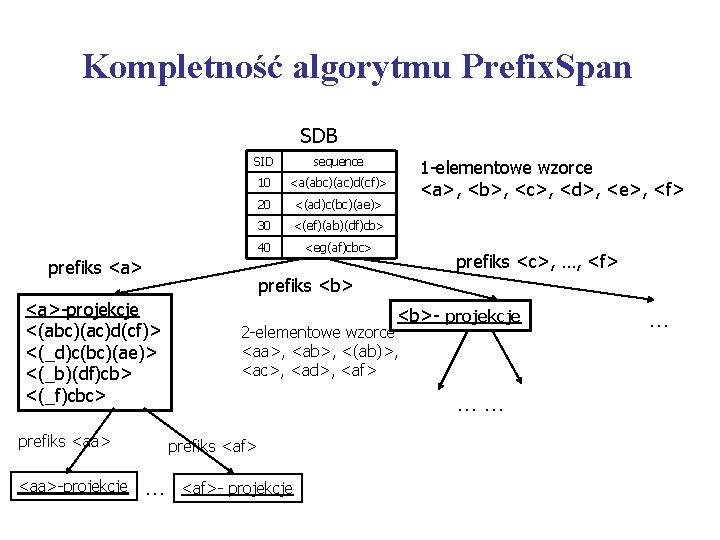

Kompletność algorytmu Prefix. Span SDB SID sequence 10 <a(abc)(ac)d(cf)> 20 <(ad)c(bc)(ae)> 30 <(ef)(ab)(df)cb> 40 <eg(af)cbc> prefiks <a> prefiks <c>, …, <f> prefiks <b> <a>-projekcje <(abc)(ac)d(cf)> <(_d)c(bc)(ae)> <(_b)(df)cb> <(_f)cbc> prefiks <aa>-projekcje 1 -elementowe wzorce <a>, <b>, <c>, <d>, <e>, <f> <b>- projekcje 2 -elementowe wzorce <aa>, <ab>, <(ab)>, <ac>, <ad>, <af> …… prefiks <af> … <af>- projekcje …

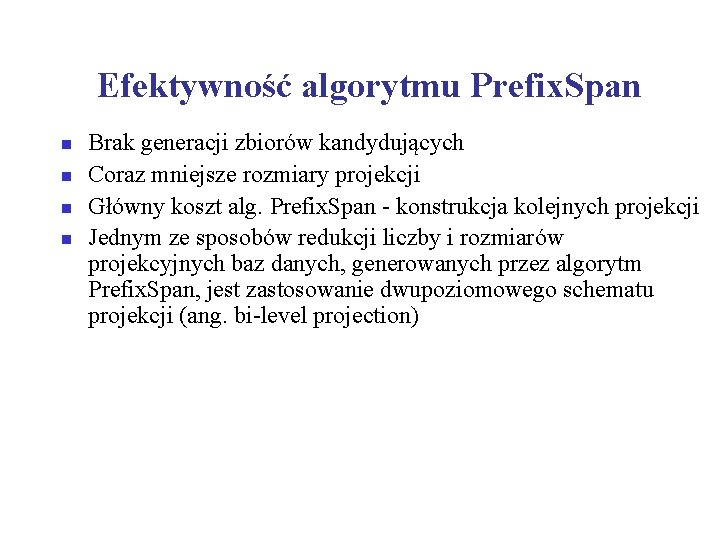

Efektywność algorytmu Prefix. Span n n Brak generacji zbiorów kandydujących Coraz mniejsze rozmiary projekcji Główny koszt alg. Prefix. Span - konstrukcja kolejnych projekcji Jednym ze sposobów redukcji liczby i rozmiarów projekcyjnych baz danych, generowanych przez algorytm Prefix. Span, jest zastosowanie dwupoziomowego schematu projekcji (ang. bi-level projection)

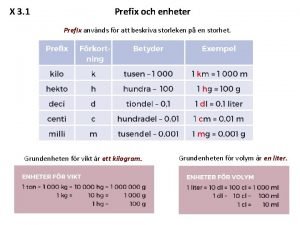

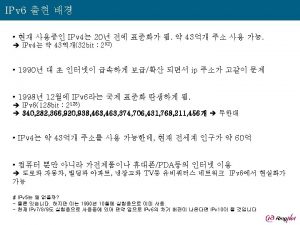

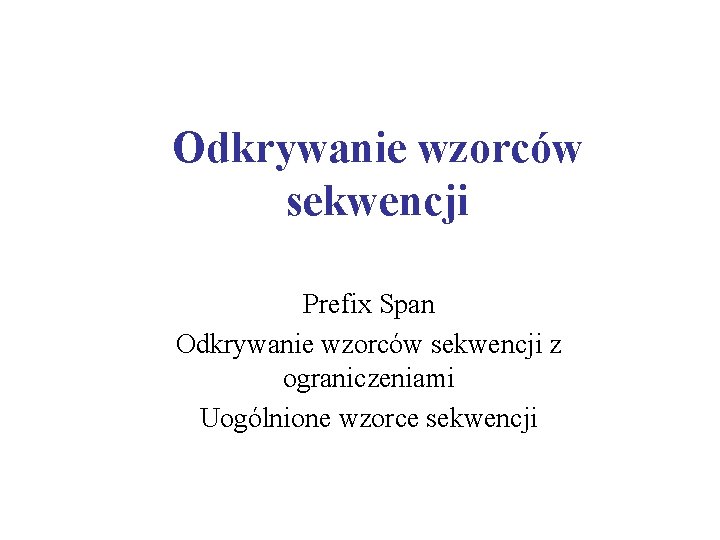

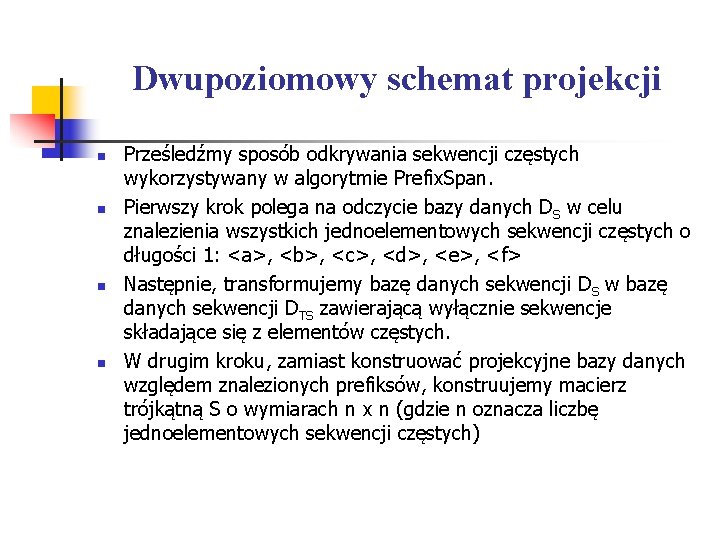

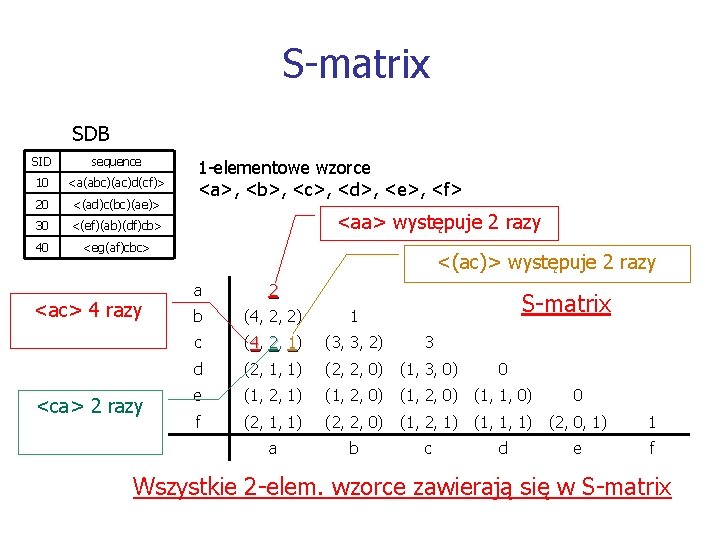

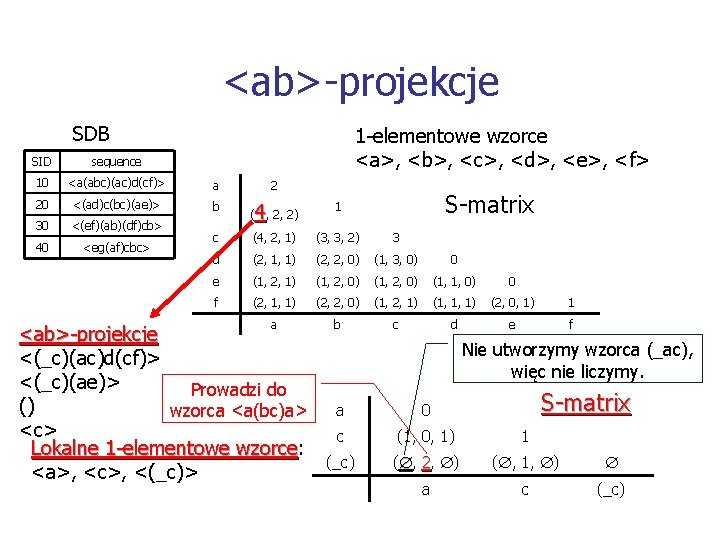

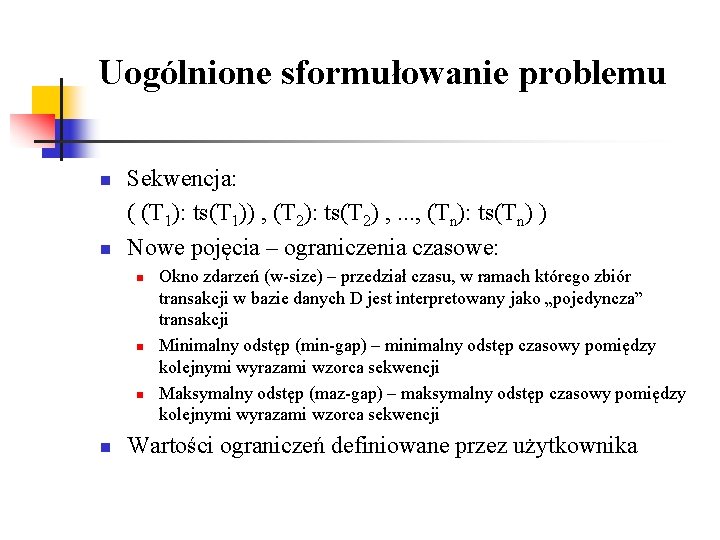

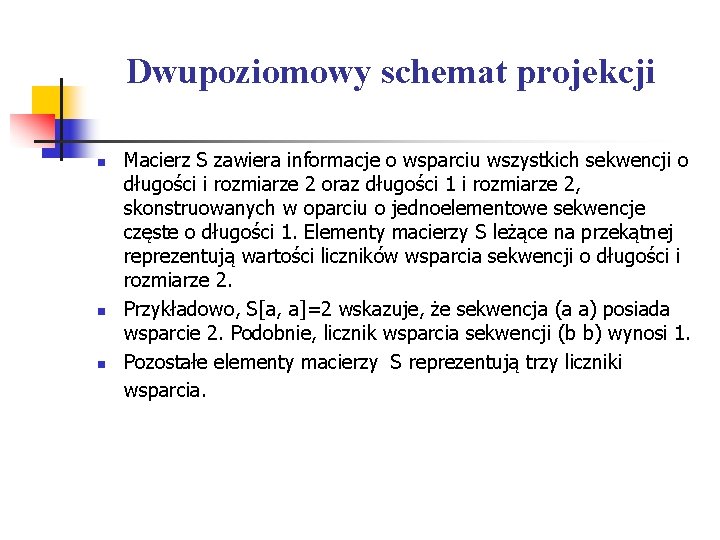

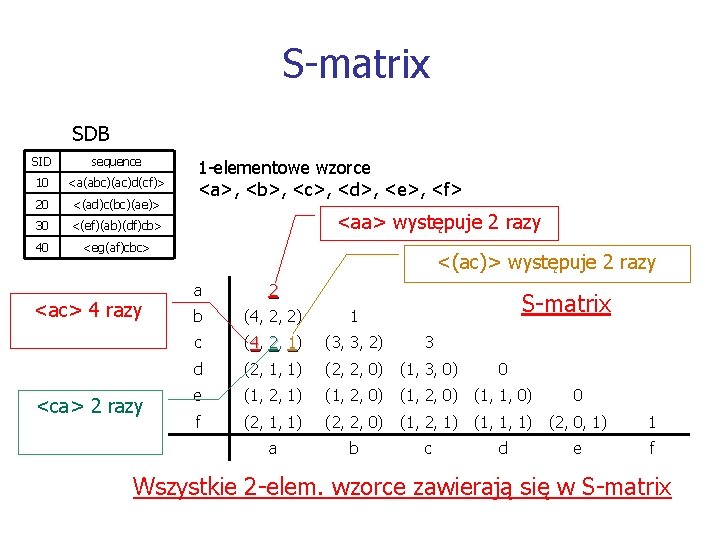

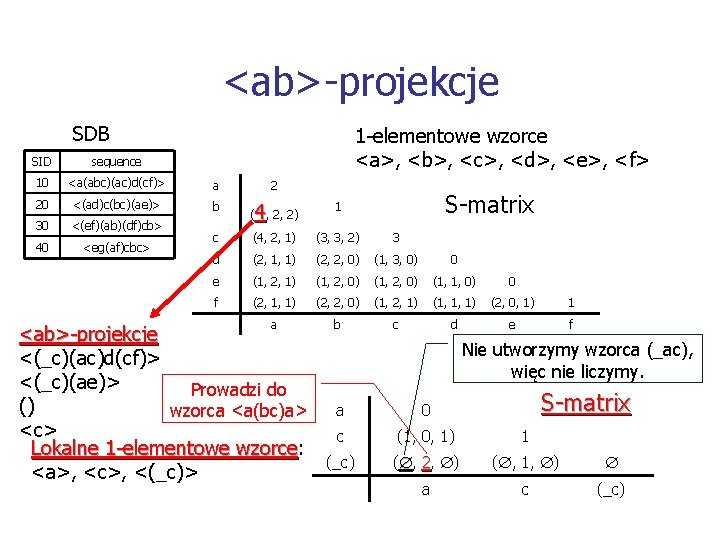

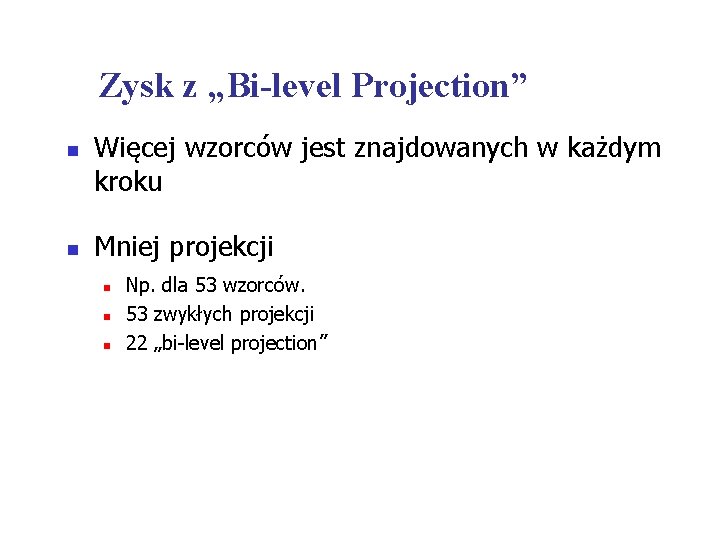

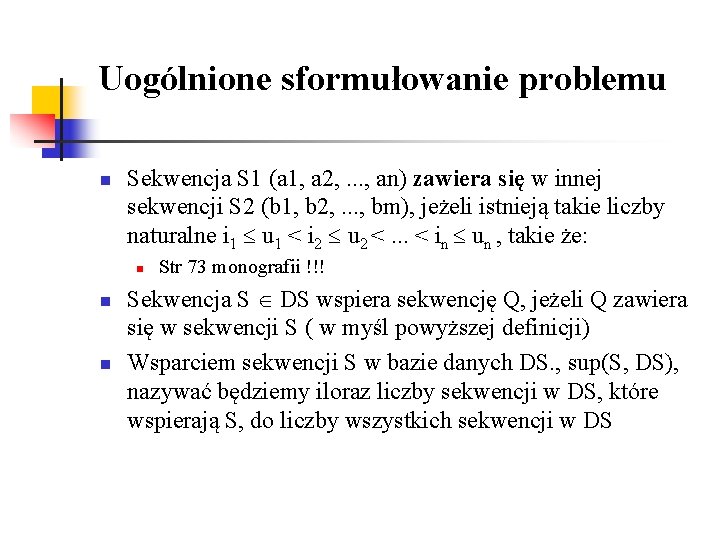

Dwupoziomowy schemat projekcji n n Prześledźmy sposób odkrywania sekwencji częstych wykorzystywany w algorytmie Prefix. Span. Pierwszy krok polega na odczycie bazy danych DS w celu znalezienia wszystkich jednoelementowych sekwencji częstych o długości 1: <a>, <b>, <c>, <d>, <e>, <f> Następnie, transformujemy bazę danych sekwencji DS w bazę danych sekwencji DTS zawierającą wyłącznie sekwencje składające się z elementów częstych. W drugim kroku, zamiast konstruować projekcyjne bazy danych względem znalezionych prefiksów, konstruujemy macierz trójkątną S o wymiarach n x n (gdzie n oznacza liczbę jednoelementowych sekwencji częstych)

Dwupoziomowy schemat projekcji n n n Macierz S zawiera informacje o wsparciu wszystkich sekwencji o długości i rozmiarze 2 oraz długości 1 i rozmiarze 2, skonstruowanych w oparciu o jednoelementowe sekwencje częste o długości 1. Elementy macierzy S leżące na przekątnej reprezentują wartości liczników wsparcia sekwencji o długości i rozmiarze 2. Przykładowo, S[a, a]=2 wskazuje, że sekwencja (a a) posiada wsparcie 2. Podobnie, licznik wsparcia sekwencji (b b) wynosi 1. Pozostałe elementy macierzy S reprezentują trzy liczniki wsparcia.

![Dwupoziomowy schemat projekcji n n Element Ma b x1 x2 x3 reprezentuje wartości Dwupoziomowy schemat projekcji n n Element M[a, b] = (x_1, x_2, x_3) reprezentuje wartości](https://slidetodoc.com/presentation_image_h/731e312dd1384cfad903a91f989b62cc/image-18.jpg)

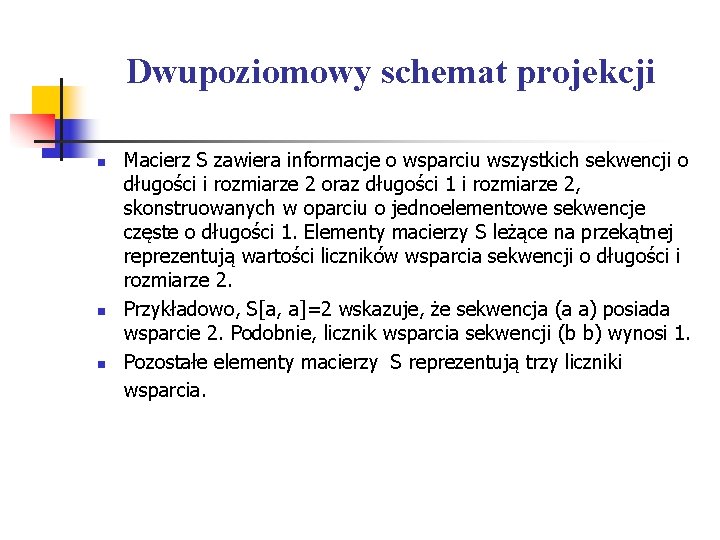

Dwupoziomowy schemat projekcji n n Element M[a, b] = (x_1, x_2, x_3) reprezentuje wartości licznika wsparcia, odpowiednio, 2 -sekwencji ( a b ), 2 -sekwencji ( b a) oraz 1 -sekwencji ( (a b) ). Przykładowo, element S[a b] = (4, 2, 2) wskazuje, że licznik wsparcia sekwencji (a b) wynosi 4, licznik wsparcia sekwencji (b a) wynosi 2, i licznik wsparcia sekwencji ( (a b) ) wynosi 2. Zauważmy, że elementy macierzy leżące po obu stronach przekątnej zawierają identyczną informację: S[a, b] = S[b, a]. Stąd, do opisu wsparcia sekwencji wystarczy macierz trójkątna.

S-matrix SDB SID sequence 10 <a(abc)(ac)d(cf)> 20 <(ad)c(bc)(ae)> 30 <(ef)(ab)(df)cb> 40 <eg(af)cbc> <ac> 4 razy <ca> 2 razy 1 -elementowe wzorce <a>, <b>, <c>, <d>, <e>, <f> <aa> występuje 2 razy <(ac)> występuje 2 razy a 2 b (4, 2, 2) 1 c (4, 2, 1) (3, 3, 2) 3 d (2, 1, 1) (2, 2, 0) (1, 3, 0) 0 e (1, 2, 1) (1, 2, 0) (1, 1, 0) 0 f (2, 1, 1) (2, 2, 0) (1, 2, 1) (1, 1, 1) (2, 0, 1) 1 a b c d e f S-matrix Wszystkie 2 -elem. wzorce zawierają się w S-matrix

<ab>-projekcje SDB 1 -elementowe wzorce <a>, <b>, <c>, <d>, <e>, <f> SID sequence 10 <a(abc)(ac)d(cf)> a 20 <(ad)c(bc)(ae)> b 30 <(ef)(ab)(df)cb> 40 <eg(af)cbc> 2 4 ( , 2, 2) S-matrix 1 c (4, 2, 1) (3, 3, 2) 3 d (2, 1, 1) (2, 2, 0) (1, 3, 0) 0 e (1, 2, 1) (1, 2, 0) (1, 1, 0) 0 f (2, 1, 1) (2, 2, 0) (1, 2, 1) (1, 1, 1) (2, 0, 1) 1 a b c d e f <ab>-projekcje <(_c)(ac)d(cf)> <(_c)(ae)> Prowadzi do () wzorca <a(bc)a> <c> Lokalne 1 -elementowe wzorce: wzorce <a>, <c>, <(_c)> Nie utworzymy wzorca (_ac), więc nie liczymy. S-matrix a 0 c (1, 0, 1) 1 (_c) ( , 2, ) ( , 1, ) a c (_c)

Zysk z „Bi-level Projection” n n Więcej wzorców jest znajdowanych w każdym kroku Mniej projekcji n n n Np. dla 53 wzorców. 53 zwykłych projekcji 22 „bi-level projection”

Główne cechy alg. Prefix. Span należy do algorytmów „pattern-growth” n n Wyszukiwanie jest bardziej skupione i tym samym bardziej efektywne Użycie elementów z algorytmu Apriori - „bi-level projection”

Uogólnione sformułowanie problemu Wzorzec sekwencji a przyczynowość n Dotychczasowe sformułowanie problemu nie uwzględnia ograniczeń czasowych na wzorce sekwencji • Sekwencją S nazywać będziemy uporządkowaną listę wyrazów (T 1, T 2, . . . , Tn), gdzie Ti jest zbiorem elementów. • Z każdym wyrazem sekwencji Ti sekwencji S jest związany znacznik czasowy ts(Ti), określający czas wystąpienia zdarzenia Ti • Wyrazy Ti w sekwencji S są uporządkowane według rosnących wartości ich znaczników czasowych n

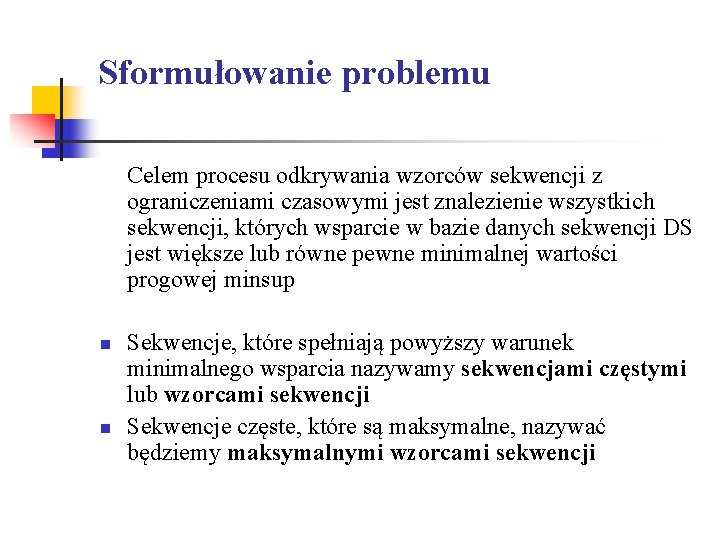

Uogólnione sformułowanie problemu n n Sekwencja: ( (T 1): ts(T 1)) , (T 2): ts(T 2) , . . . , (Tn): ts(Tn) ) Nowe pojęcia – ograniczenia czasowe: n n Okno zdarzeń (w-size) – przedział czasu, w ramach którego zbiór transakcji w bazie danych D jest interpretowany jako „pojedyncza” transakcji Minimalny odstęp (min-gap) – minimalny odstęp czasowy pomiędzy kolejnymi wyrazami wzorca sekwencji Maksymalny odstęp (maz-gap) – maksymalny odstęp czasowy pomiędzy kolejnymi wyrazami wzorca sekwencji Wartości ograniczeń definiowane przez użytkownika

Uogólnione sformułowanie problemu n Sekwencja S 1 (a 1, a 2, . . . , an) zawiera się w innej sekwencji S 2 (b 1, b 2, . . . , bm), jeżeli istnieją takie liczby naturalne i 1 u 1 < i 2 u 2 <. . . < in un , takie że: n n n Str 73 monografii !!! Sekwencja S DS wspiera sekwencję Q, jeżeli Q zawiera się w sekwencji S ( w myśl powyższej definicji) Wsparciem sekwencji S w bazie danych DS. , sup(S, DS), nazywać będziemy iloraz liczby sekwencji w DS, które wspierają S, do liczby wszystkich sekwencji w DS

Sformułowanie problemu Celem procesu odkrywania wzorców sekwencji z ograniczeniami czasowymi jest znalezienie wszystkich sekwencji, których wsparcie w bazie danych sekwencji DS jest większe lub równe pewne minimalnej wartości progowej minsup n n Sekwencje, które spełniają powyższy warunek minimalnego wsparcia nazywamy sekwencjami częstymi lub wzorcami sekwencji Sekwencje częste, które są maksymalne, nazywać będziemy maksymalnymi wzorcami sekwencji

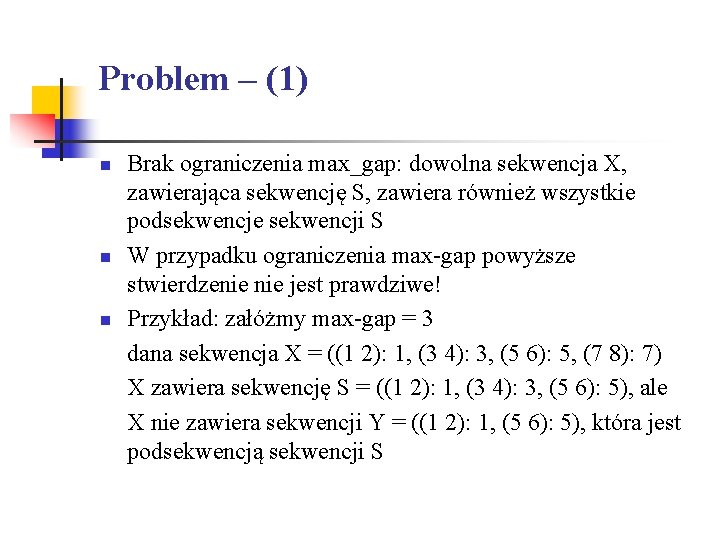

Problem – (1) n n n Brak ograniczenia max_gap: dowolna sekwencja X, zawierająca sekwencję S, zawiera również wszystkie podsekwencje sekwencji S W przypadku ograniczenia max-gap powyższe stwierdzenie jest prawdziwe! Przykład: załóżmy max-gap = 3 dana sekwencja X = ((1 2): 1, (3 4): 3, (5 6): 5, (7 8): 7) X zawiera sekwencję S = ((1 2): 1, (3 4): 3, (5 6): 5), ale X nie zawiera sekwencji Y = ((1 2): 1, (5 6): 5), która jest podsekwencją sekwencji S

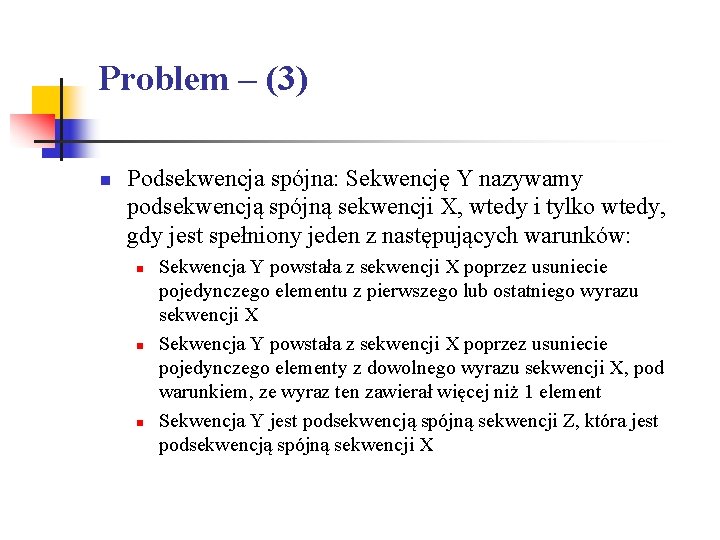

Problem – (2) n n n Konsekwencje: brak własności monotoniczności miary wsparcia w przypadku ograniczenia max-gap Brak monotoniczności uniemożliwia generowanie sekwencji kandydujących w oparciu o ideę algorytmu Apriori – ograniczenie przestrzeni możliwych rozwiązań (inaczej mówiąc, ograniczenie przestrzeni generacji potencjalnie częstych sekwencji kandydujących) Rozwiązanie: podsekwencje spójne

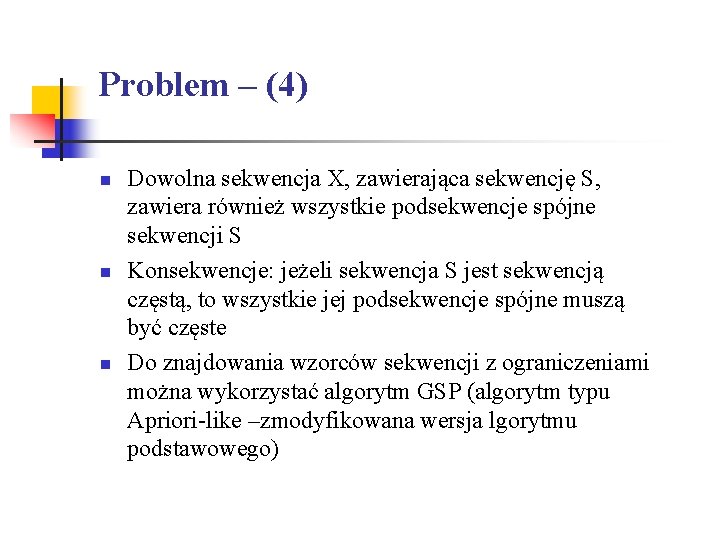

Problem – (3) n Podsekwencja spójna: Sekwencję Y nazywamy podsekwencją spójną sekwencji X, wtedy i tylko wtedy, gdy jest spełniony jeden z następujących warunków: n n n Sekwencja Y powstała z sekwencji X poprzez usuniecie pojedynczego elementu z pierwszego lub ostatniego wyrazu sekwencji X Sekwencja Y powstała z sekwencji X poprzez usuniecie pojedynczego elementy z dowolnego wyrazu sekwencji X, pod warunkiem, ze wyraz ten zawierał więcej niż 1 element Sekwencja Y jest podsekwencją spójną sekwencji Z, która jest podsekwencją spójną sekwencji X

Problem – (4) n n n Dowolna sekwencja X, zawierająca sekwencję S, zawiera również wszystkie podsekwencje spójne sekwencji S Konsekwencje: jeżeli sekwencja S jest sekwencją częstą, to wszystkie jej podsekwencje spójne muszą być częste Do znajdowania wzorców sekwencji z ograniczeniami można wykorzystać algorytm GSP (algorytm typu Apriori-like –zmodyfikowana wersja lgorytmu podstawowego)

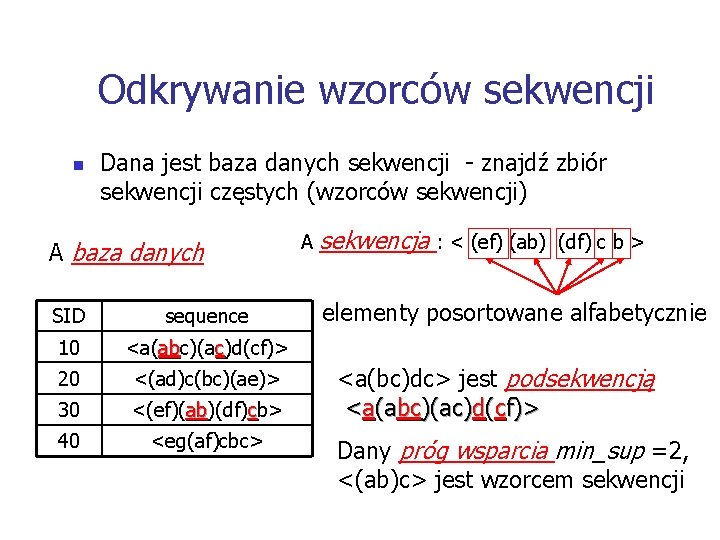

Uogólnione wzorce sekwencji (1) n Użytkownicy są często zainteresowani znajdowaniem wzorców sekwencji z pewnymi dodatkowymi ograniczeniami: · Ograniczenia elementów · „Znajdź wszystkie produkty, które klienci kupują najczęściej zanim kupią DVD” · Ograniczenia czasowe · „ Znajdź wszystkie produkty, które klienci kupują w ciągu miesiąca od dnia zakupu telewizora”

Uogólnione wzorce sekwencji (2) n n Wzorce sekwencyjne uwzględniające taksonomie elementów i określające zależności kolejnościowe pomiędzy nazwanymi grupami zdarzeń – uogólnione wzorce sekwencji Wzorce sekwencyjne określające zależności kolejnościowe pomiędzy zdarzeniami opisanymi zarówno atrybutami kategorycznymi jak i atrybutami ciągłymi – wielowymiarowe (ilościowe) wzorce sekwencji

Prefix span

Prefix span Prefixspan

Prefixspan Diagram sekwencji biblioteka

Diagram sekwencji biblioteka Diagram sekwencji

Diagram sekwencji Diagram sekwencji alt

Diagram sekwencji alt Lean-to roof diagram

Lean-to roof diagram Life span theories

Life span theories Uneven span greenhouse advantages

Uneven span greenhouse advantages Fan roof truss

Fan roof truss Span ptkin login siswa

Span ptkin login siswa C span cram for the exam

C span cram for the exam Is the vitruvian man theory true

Is the vitruvian man theory true Ics symbol

Ics symbol Factors affecting span of control

Factors affecting span of control Unbillicus

Unbillicus Painted lady butterfly chrysalis stage

Painted lady butterfly chrysalis stage Swing span

Swing span Wisc v substitutions

Wisc v substitutions Span etiketi

Span etiketi What is span of control

What is span of control Uneven span greenhouse

Uneven span greenhouse Petit four display

Petit four display The developing person through the life span 9th edition

The developing person through the life span 9th edition Work and span

Work and span Classification of managerial function

Classification of managerial function Stabilizing community lifelines is the primary

Stabilizing community lifelines is the primary Paula span new york times

Paula span new york times Geometric description of span

Geometric description of span The developing person through the life span 9th edition

The developing person through the life span 9th edition Mother any distance language analysis

Mother any distance language analysis Percussion abdomen normal findings

Percussion abdomen normal findings How to do linear combination

How to do linear combination Bristol bulge inspector

Bristol bulge inspector