Mestersges neuronhlzatok Neurlis hlzat l l l Gpi

- Slides: 11

Mesterséges neuronhálózatok

Neurális hálózat l l l Gépi tanulás egyik módja Mesterséges neuronokból áll Mc. Culloch-Pitts neuron ¡ ¡ ¡ több súlyozott bemenet küszöbfüggvény 1 kimenet, amely l l lehet végső kimenet elágazhat lehet újabb neuron(ok) bemenete Használat: ¡ minták megtanulása után olyan mintákat is tud kategorizálni, amit még nem „látott”

Hálózat használata l Neuronháló megtervezése ¡ rétegek száma ¡ neuronok száma ¡ tanulási algoritmus l Hálózat elkészítése l Hálózat tanítása l Hálózat használata kategorizálási feladatokra

Mesterséges neuron Tanulás: súlyok módosításával Súlyok: a bemenet/kapcsolat erősségét jelzik Kimeneti jel: aktivációs szint Aktivációs szint: a súlyokból, a bemeneti jelekből és a küszöb segítségével számítja ki l Bemenetek: a külvilágtól vagy más neuronoktól érkező jelek l Kimenet: végső eredmény vagy bemenet más neuronoknak l Aktivációs függvény: eldönti, hogy a neuron tüzel -e l l

Aktivációs függvények l szignum (előjel) függvény (1/-1) l egységugrás/lépés függvény (0/1) l lineáris függvény (y=x) l szigmoid függvény

Perceptron l legegyszerűbb neuronháló = 1 neuron l 1958. Frank Rosenblatt l cél: bemeneteket osztályokba sorolni (jó/nem jó) l n db bemenet l n dimenziós teret oszt fel hipersíkok segítségével 2 területre ¡ 2 bemenet: 1 vonal mentén 2 terület ¡ 3 bemenet: 3 D test

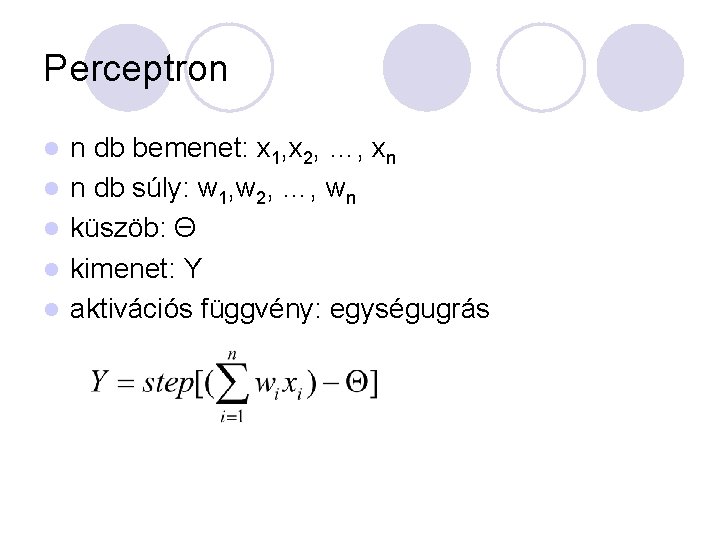

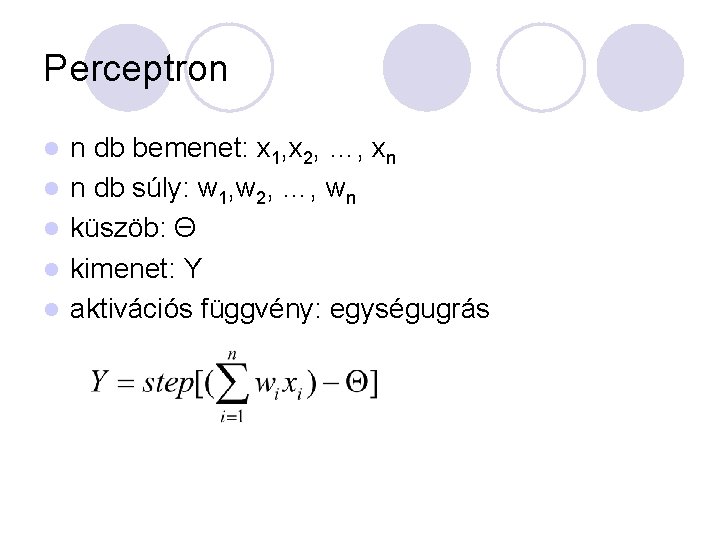

Perceptron l l l n db bemenet: x 1, x 2, …, xn n db súly: w 1, w 2, …, wn küszöb: Θ kimenet: Y aktivációs függvény: egységugrás

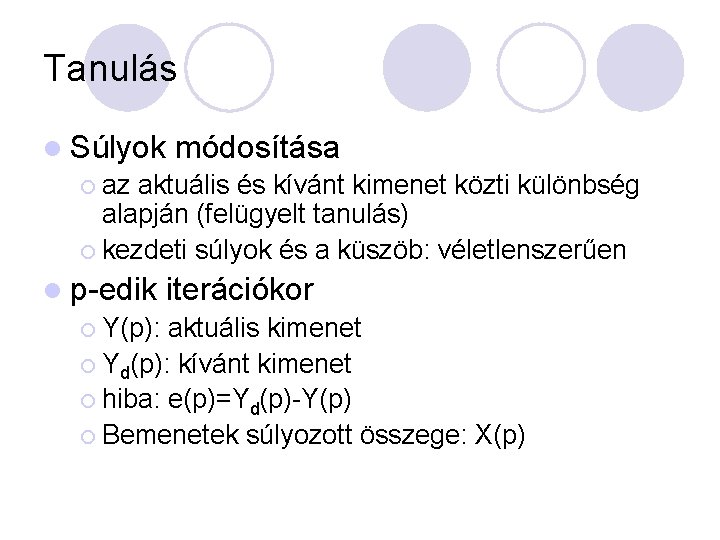

Tanulás l Súlyok módosítása ¡ az aktuális és kívánt kimenet közti különbség alapján (felügyelt tanulás) ¡ kezdeti súlyok és a küszöb: véletlenszerűen l p-edik iterációkor ¡ Y(p): aktuális kimenet ¡ Yd(p): kívánt kimenet ¡ hiba: e(p)=Yd(p)-Y(p) ¡ Bemenetek súlyozott összege: X(p)

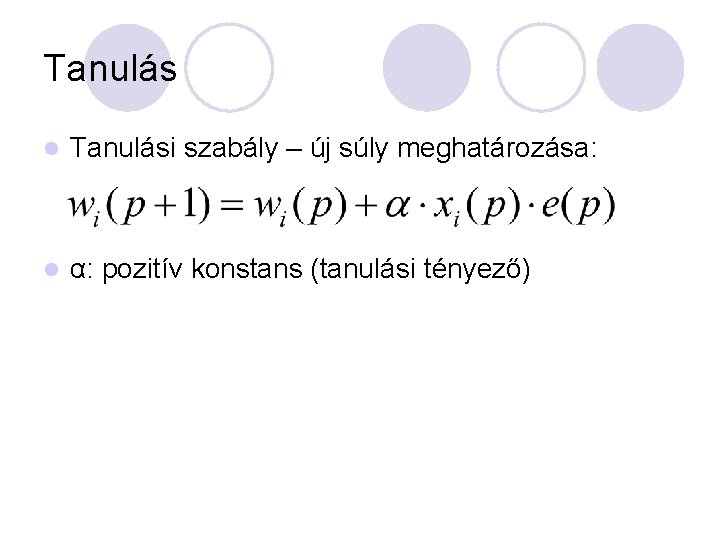

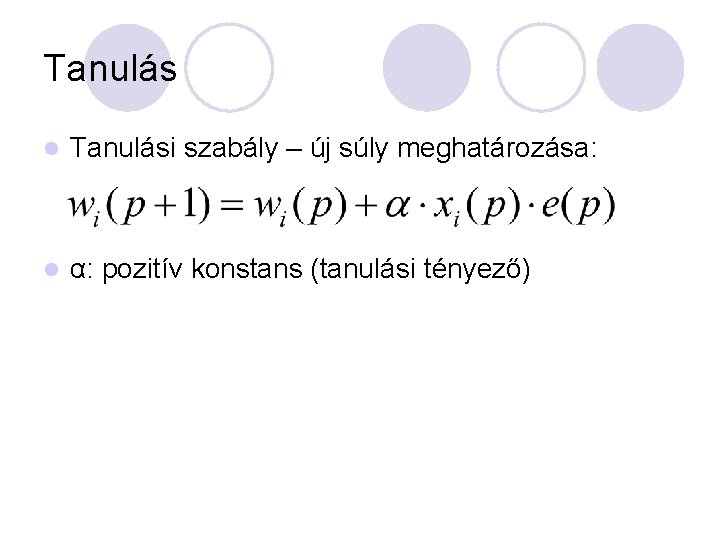

Tanulás l Tanulási szabály – új súly meghatározása: l α: pozitív konstans (tanulási tényező)

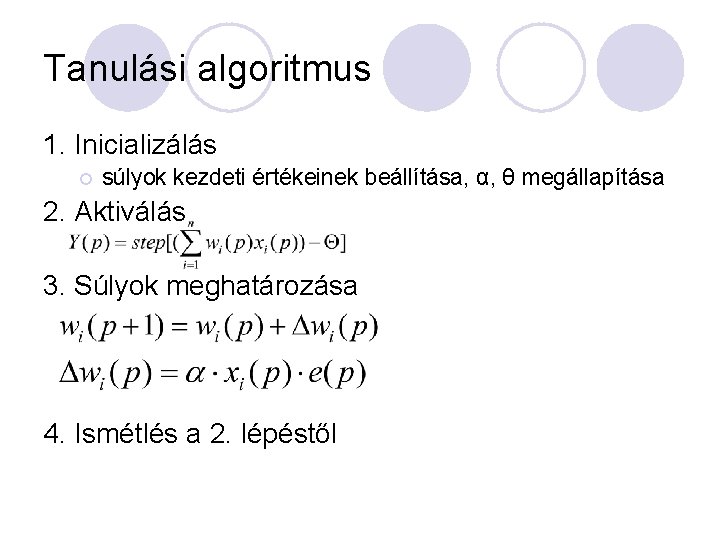

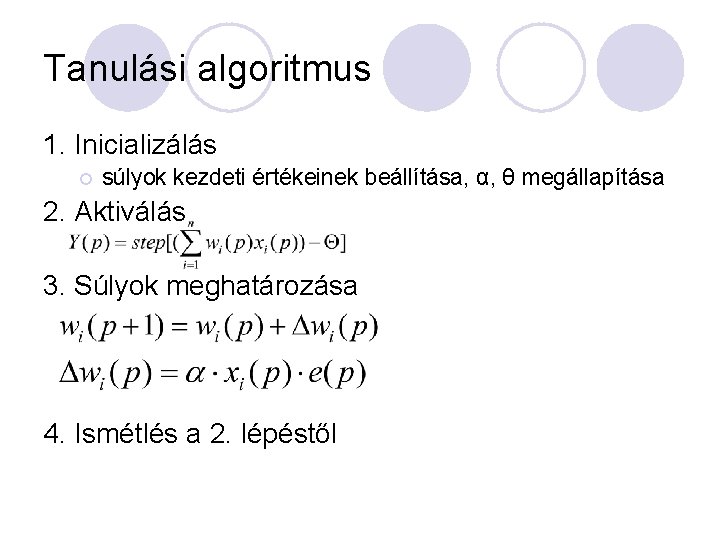

Tanulási algoritmus 1. Inicializálás ¡ súlyok kezdeti értékeinek beállítása, α, θ megállapítása 2. Aktiválás 3. Súlyok meghatározása 4. Ismétlés a 2. lépéstől

Neurális szakértői rendszerek l Neurális háló és szabályok kombinációja l Szabályok automatikus létrehozása l Tudás: a hálóban l 3 rétegű háló l Minden tulajdonság egy neuron