APPROSSIMAZIONE DI FUNZIONI AF 1 La regressione e

- Slides: 13

APPROSSIMAZIONE DI FUNZIONI

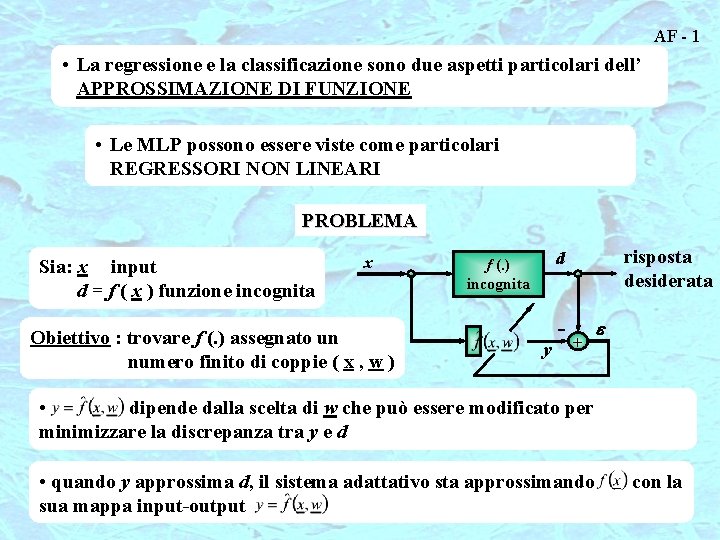

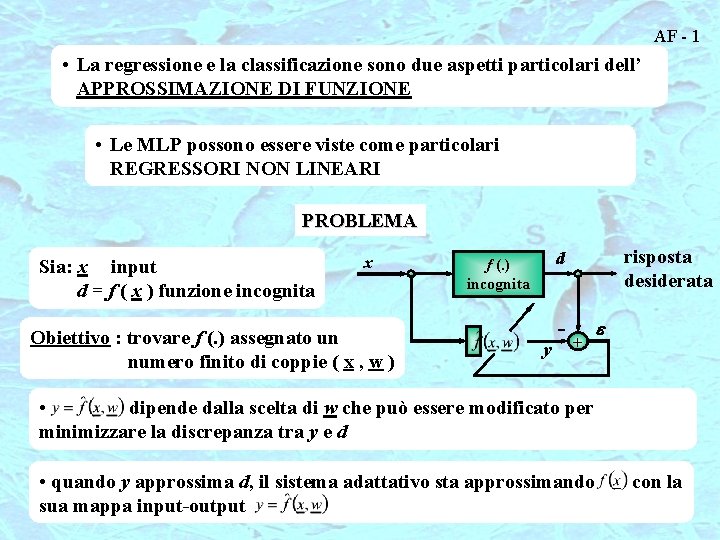

AF - 1 • La regressione e la classificazione sono due aspetti particolari dell’ APPROSSIMAZIONE DI FUNZIONE • Le MLP possono essere viste come particolari REGRESSORI NON LINEARI PROBLEMA Sia: x input d = f ( x ) funzione incognita x Obiettivo : trovare f (. ) assegnato un numero finito di coppie ( x , w ) risposta desiderata d f (. ) incognita y - + e • dipende dalla scelta di w che può essere modificato per minimizzare la discrepanza tra y e d • quando y approssima d, il sistema adattativo sta approssimando sua mappa input-output con la

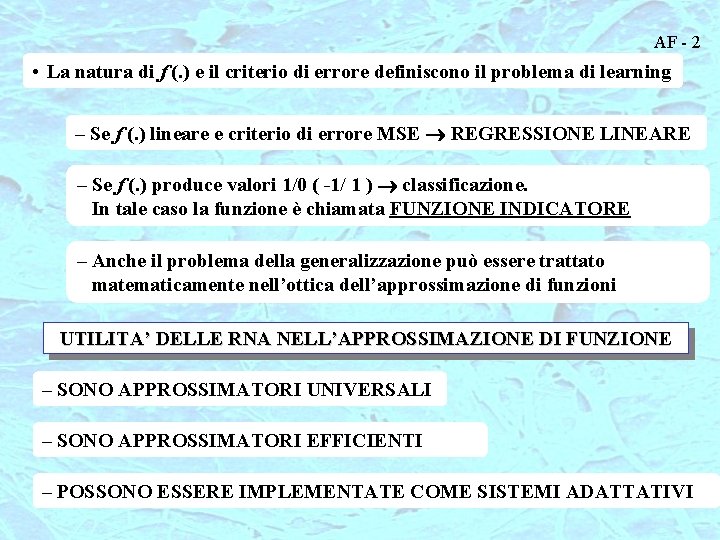

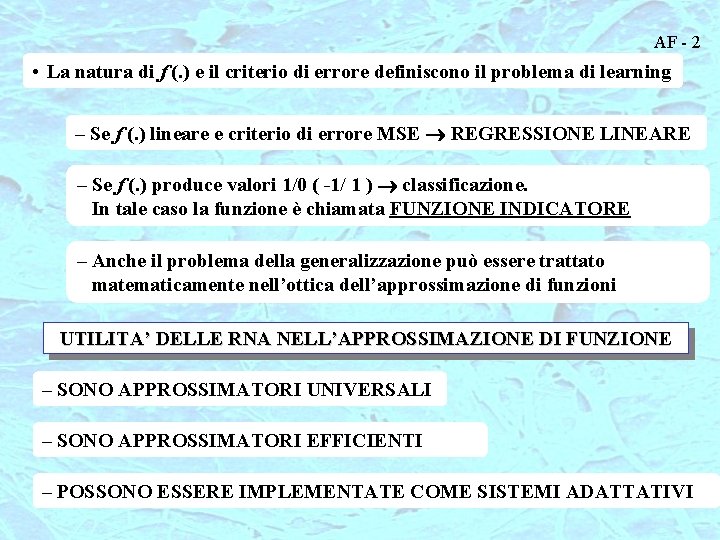

AF - 2 • La natura di f (. ) e il criterio di errore definiscono il problema di learning – Se f (. ) lineare e criterio di errore MSE REGRESSIONE LINEARE – Se f (. ) produce valori 1/0 ( -1/ 1 ) classificazione. In tale caso la funzione è chiamata FUNZIONE INDICATORE – Anche il problema della generalizzazione può essere trattato matematicamente nell’ottica dell’approssimazione di funzioni UTILITA’ DELLE RNA NELL’APPROSSIMAZIONE DI FUNZIONE – SONO APPROSSIMATORI UNIVERSALI – SONO APPROSSIMATORI EFFICIENTI – POSSONO ESSERE IMPLEMENTATE COME SISTEMI ADATTATIVI

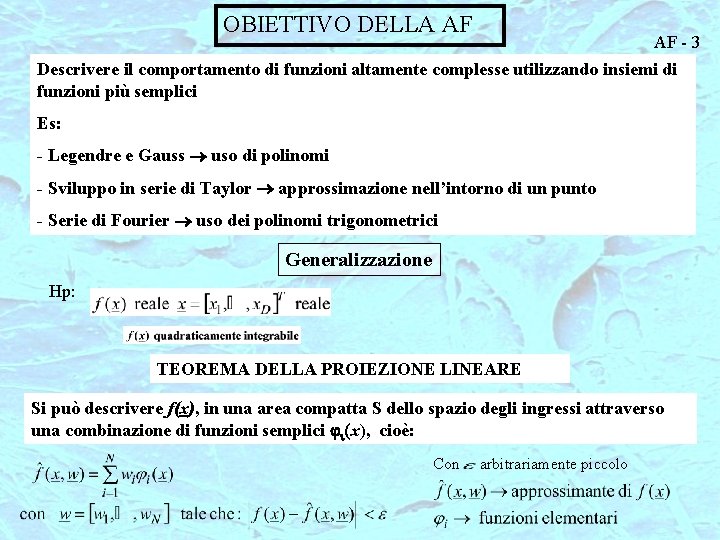

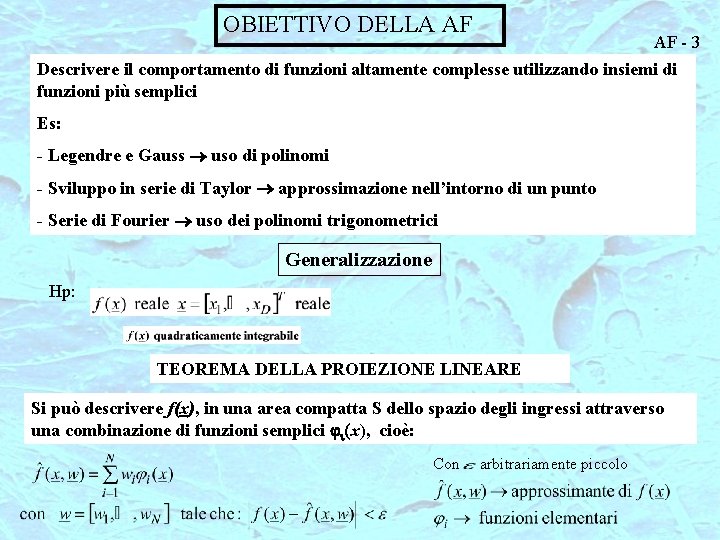

OBIETTIVO DELLA AF AF - 3 Descrivere il comportamento di funzioni altamente complesse utilizzando insiemi di funzioni più semplici Es: - Legendre e Gauss uso di polinomi - Sviluppo in serie di Taylor approssimazione nell’intorno di un punto - Serie di Fourier uso dei polinomi trigonometrici Generalizzazione Hp: TEOREMA DELLA PROIEZIONE LINEARE Si può descrivere f(x), in una area compatta S dello spazio degli ingressi attraverso una combinazione di funzioni semplici ji(x), cioè: Con arbitrariamente piccolo

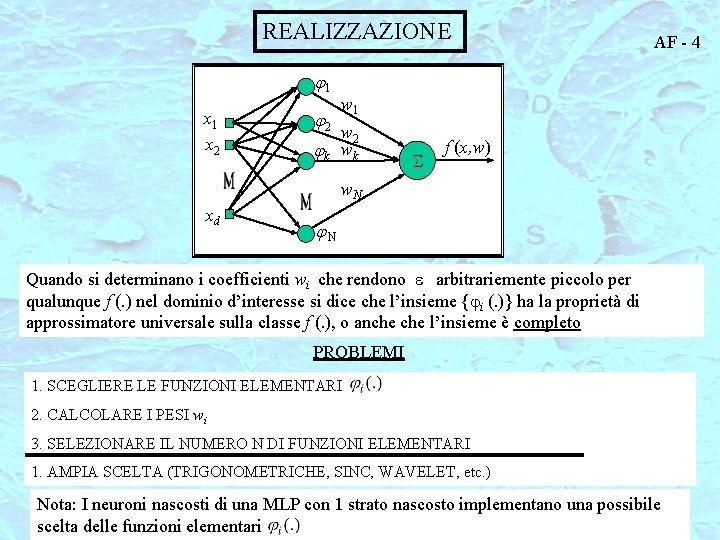

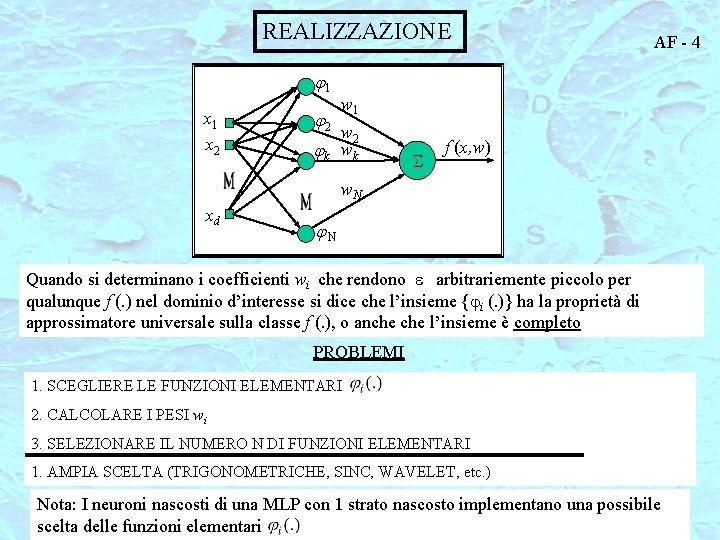

REALIZZAZIONE j 1 x 2 j 2 AF - 4 w 1 w 2 jk w k S f (x, w) w. N xd j. N Quando si determinano i coefficienti wi che rendono e arbitrariemente piccolo per qualunque f (. ) nel dominio d’interesse si dice che l’insieme {ji (. )} ha la proprietà di approssimatore universale sulla classe f (. ), o anche l’insieme è completo PROBLEMI 1. SCEGLIERE LE FUNZIONI ELEMENTARI 2. CALCOLARE I PESI wi 3. SELEZIONARE IL NUMERO N DI FUNZIONI ELEMENTARI 1. AMPIA SCELTA (TRIGONOMETRICHE, SINC, WAVELET, etc. ) Nota: I neuroni nascosti di una MLP con 1 strato nascosto implementano una possibile scelta delle funzioni elementari

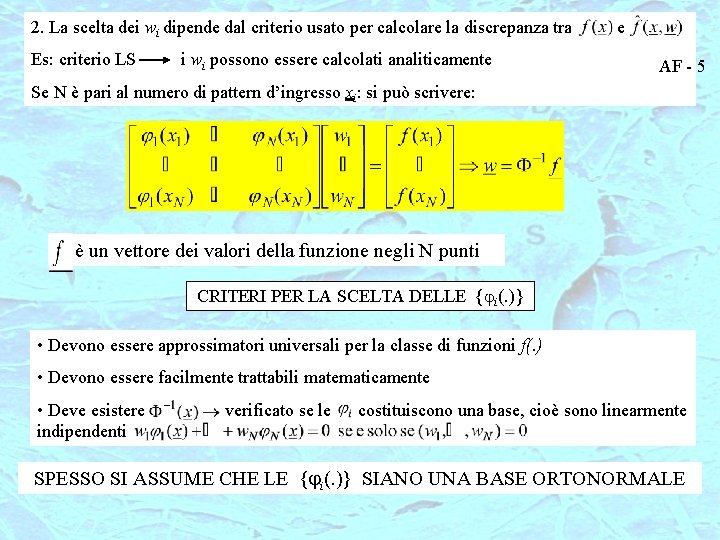

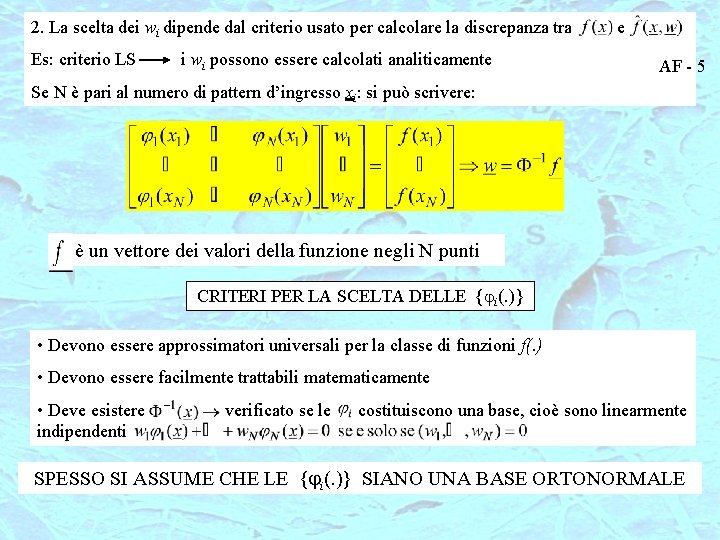

2. La scelta dei wi dipende dal criterio usato per calcolare la discrepanza tra Es: criterio LS i wi possono essere calcolati analiticamente e AF - 5 Se N è pari al numero di pattern d’ingresso xi: si può scrivere: è un vettore dei valori della funzione negli N punti CRITERI PER LA SCELTA DELLE {ji(. )} • Devono essere approssimatori universali per la classe di funzioni f(. ) • Devono essere facilmente trattabili matematicamente • Deve esistere indipendenti verificato se le costituiscono una base, cioè sono linearmente SPESSO SI ASSUME CHE LE {ji(. )} SIANO UNA BASE ORTONORMALE

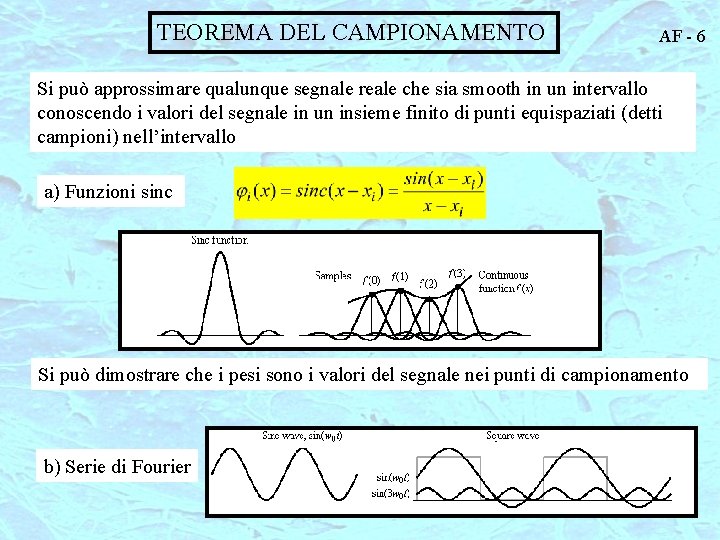

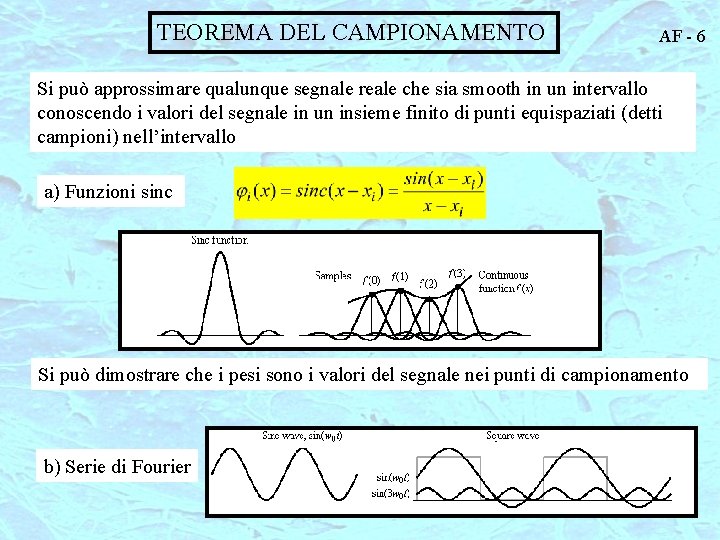

TEOREMA DEL CAMPIONAMENTO AF - 6 Si può approssimare qualunque segnale reale che sia smooth in un intervallo conoscendo i valori del segnale in un insieme finito di punti equispaziati (detti campioni) nell’intervallo a) Funzioni sinc Si può dimostrare che i pesi sono i valori del segnale nei punti di campionamento b) Serie di Fourier

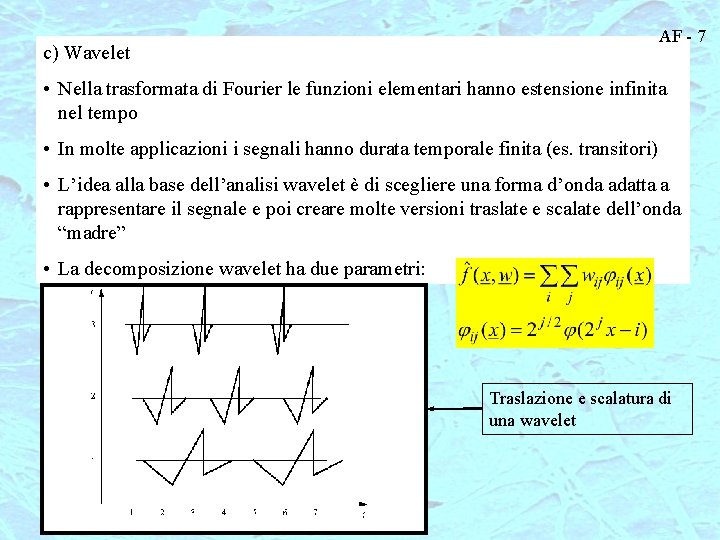

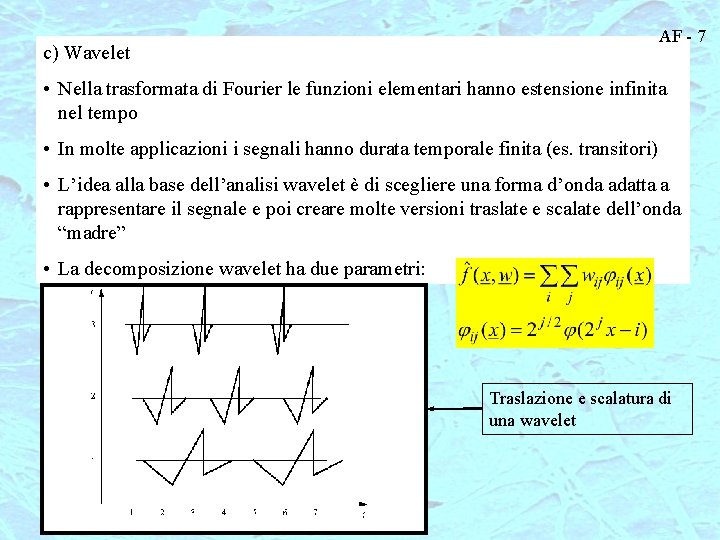

AF - 7 c) Wavelet • Nella trasformata di Fourier le funzioni elementari hanno estensione infinita nel tempo • In molte applicazioni i segnali hanno durata temporale finita (es. transitori) • L’idea alla base dell’analisi wavelet è di scegliere una forma d’onda adatta a rappresentare il segnale e poi creare molte versioni traslate e scalate dell’onda “madre” • La decomposizione wavelet ha due parametri: Traslazione e scalatura di una wavelet

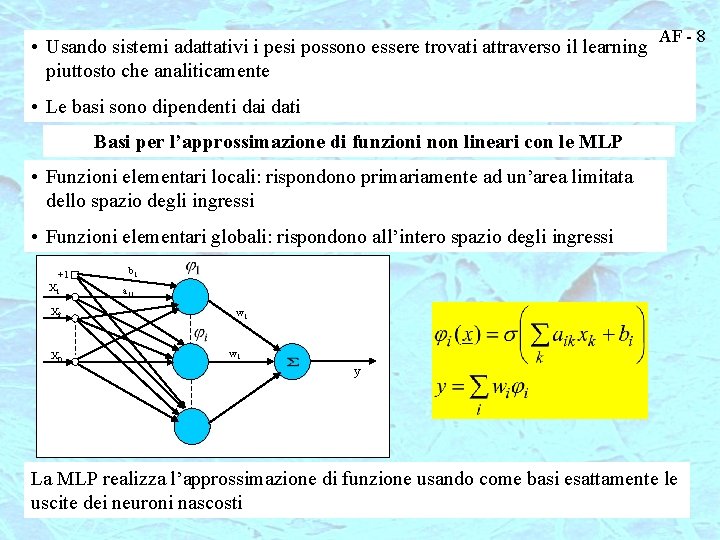

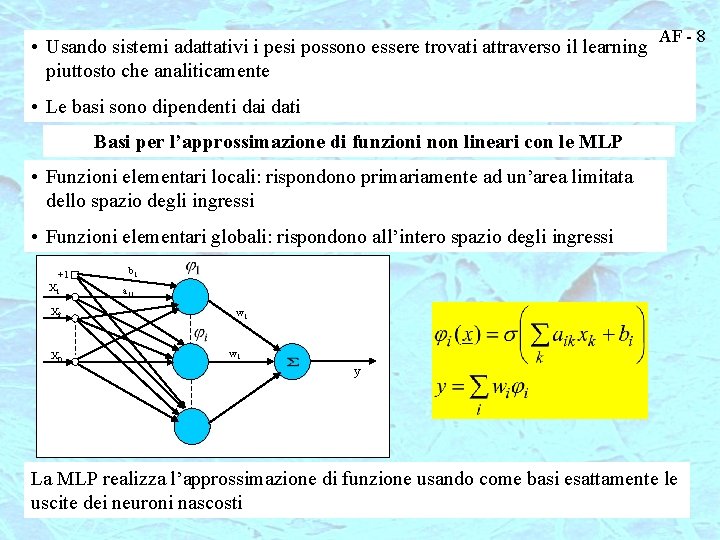

• Usando sistemi adattativi i pesi possono essere trovati attraverso il learning piuttosto che analiticamente AF - 8 • Le basi sono dipendenti dati Basi per l’approssimazione di funzioni non lineari con le MLP • Funzioni elementari locali: rispondono primariamente ad un’area limitata dello spazio degli ingressi • Funzioni elementari globali: rispondono all’intero spazio degli ingressi +1 X 2 XD b 1 a 11 w 1 y La MLP realizza l’approssimazione di funzione usando come basi esattamente le uscite dei neuroni nascosti

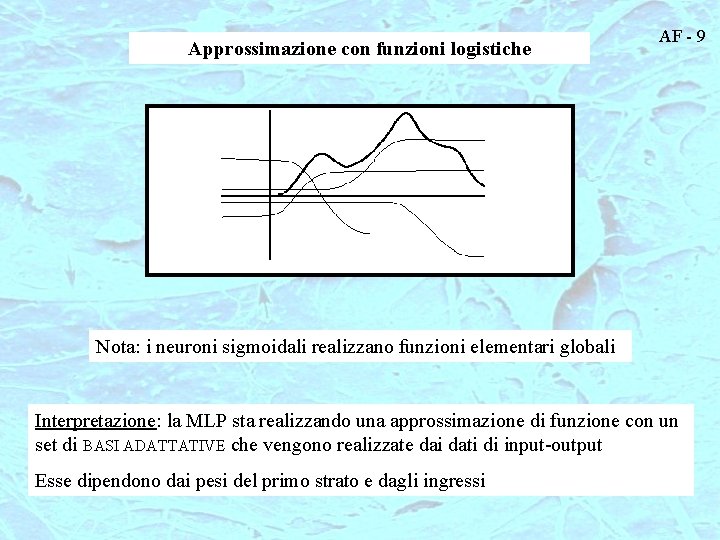

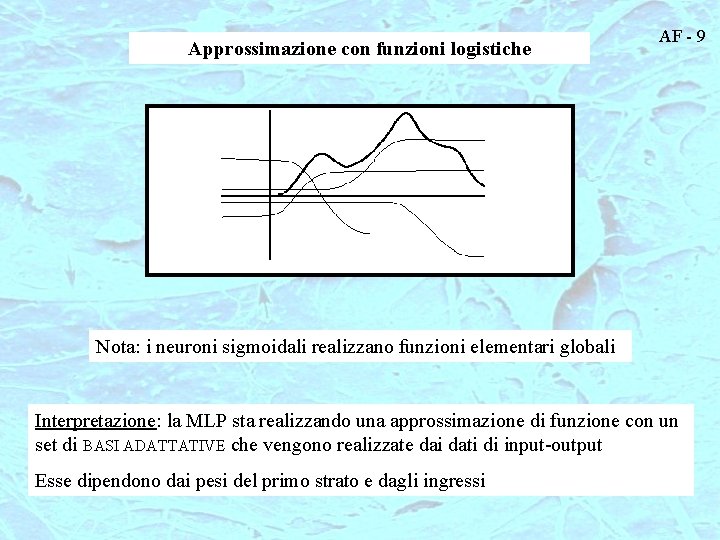

Approssimazione con funzioni logistiche AF - 9 Nota: i neuroni sigmoidali realizzano funzioni elementari globali Interpretazione: la MLP sta realizzando una approssimazione di funzione con un set di BASI ADATTATIVE che vengono realizzate dai dati di input-output Esse dipendono dai pesi del primo strato e dagli ingressi

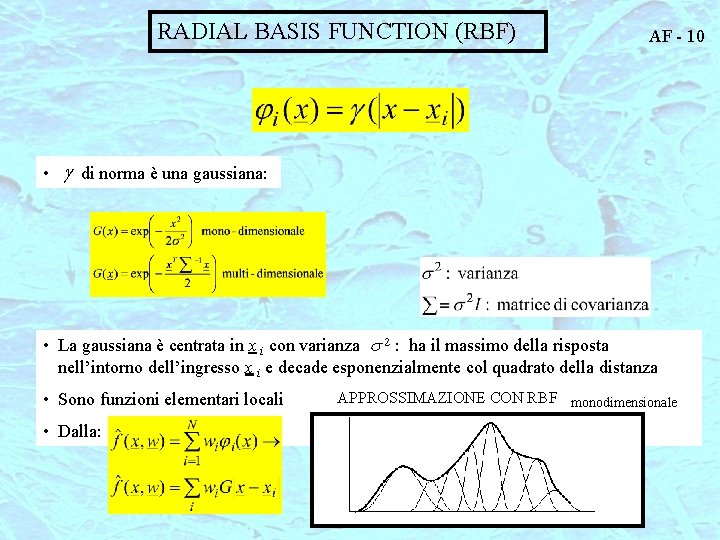

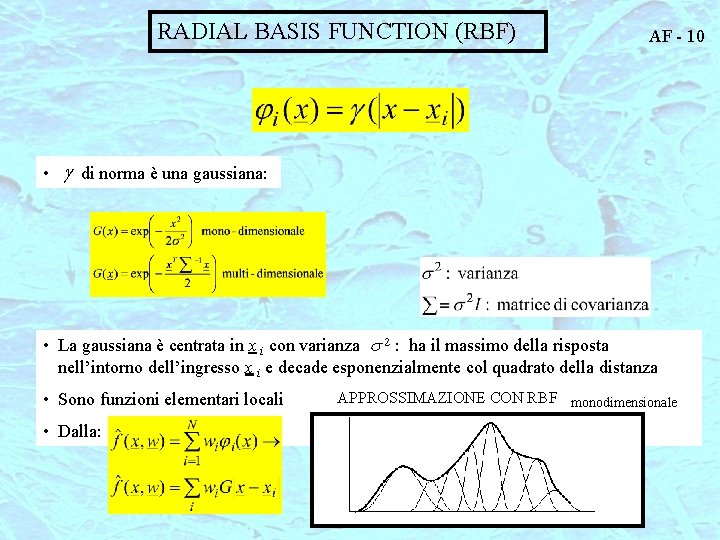

RADIAL BASIS FUNCTION (RBF) AF - 10 • g di norma è una gaussiana: • La gaussiana è centrata in x i con varianza s 2 : ha il massimo della risposta nell’intorno dell’ingresso x i e decade esponenzialmente col quadrato della distanza • Sono funzioni elementari locali • Dalla: APPROSSIMAZIONE CON RBF monodimensionale

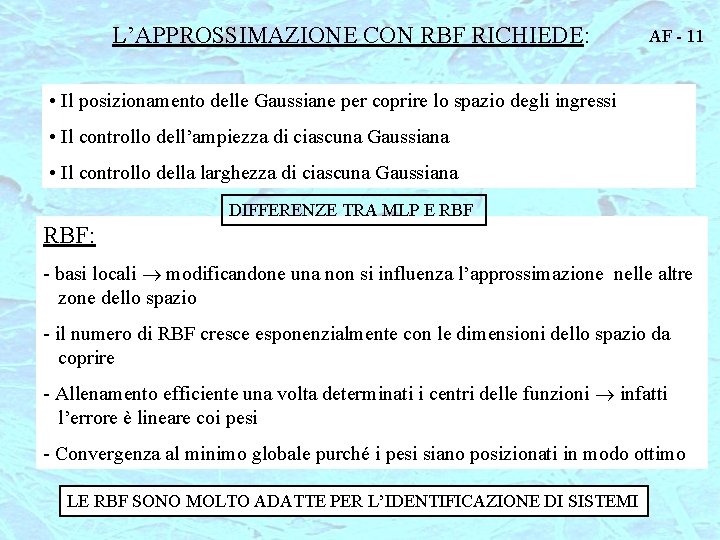

L’APPROSSIMAZIONE CON RBF RICHIEDE: AF - 11 • Il posizionamento delle Gaussiane per coprire lo spazio degli ingressi • Il controllo dell’ampiezza di ciascuna Gaussiana • Il controllo della larghezza di ciascuna Gaussiana DIFFERENZE TRA MLP E RBF: - basi locali modificandone una non si influenza l’approssimazione nelle altre zone dello spazio - il numero di RBF cresce esponenzialmente con le dimensioni dello spazio da coprire - Allenamento efficiente una volta determinati i centri delle funzioni infatti l’errore è lineare coi pesi - Convergenza al minimo globale purché i pesi siano posizionati in modo ottimo LE RBF SONO MOLTO ADATTE PER L’IDENTIFICAZIONE DI SISTEMI

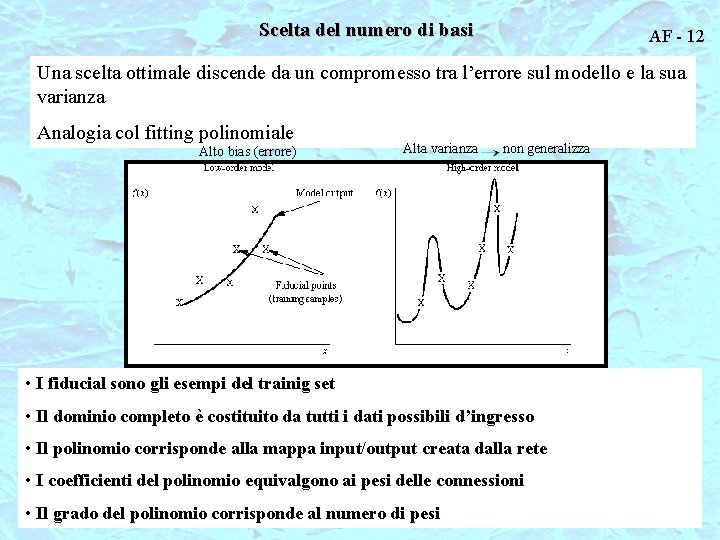

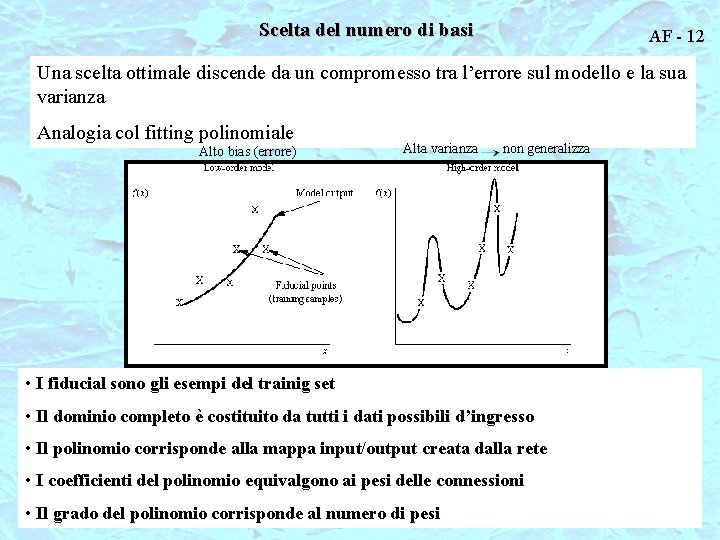

Scelta del numero di basi AF - 12 Una scelta ottimale discende da un compromesso tra l’errore sul modello e la sua varianza Analogia col fitting polinomiale Alto bias (errore) Alta varianza non generalizza • I fiducial sono gli esempi del trainig set • Il dominio completo è costituito da tutti i dati possibili d’ingresso • Il polinomio corrisponde alla mappa input/output creata dalla rete • I coefficienti del polinomio equivalgono ai pesi delle connessioni • Il grado del polinomio corrisponde al numero di pesi