Y X PRP VBD DT NN X I

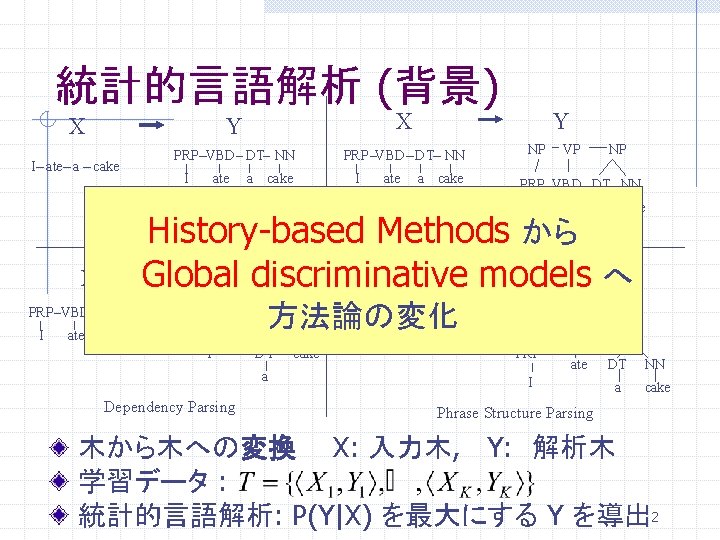

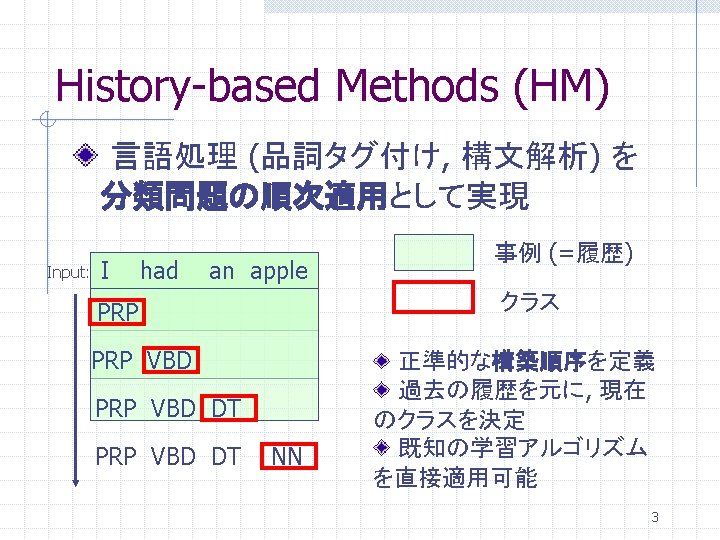

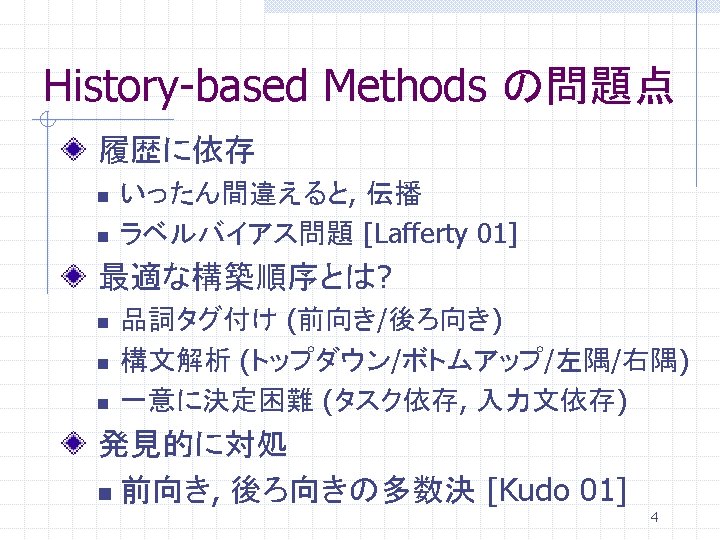

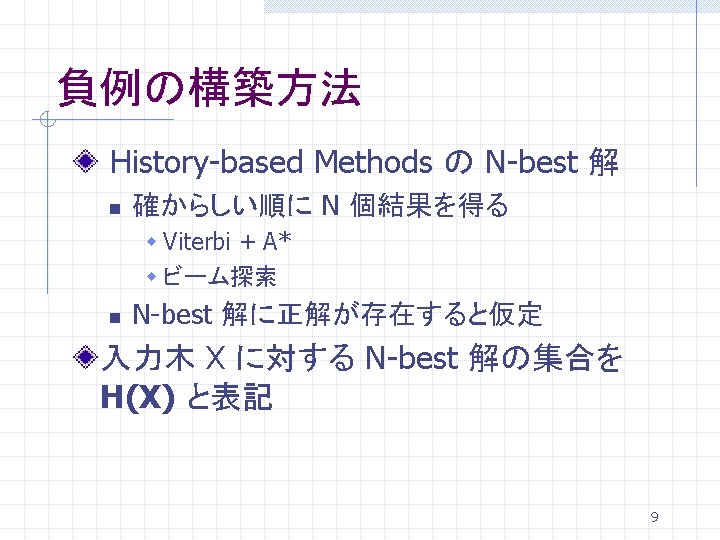

統計的言語解析 (背景) Y X PRP VBD DT NN X I ate a cake Y NP VP NP PRP VBD DT NN I ate a cake Text Chunking (Shallow Parsing) History-based Methods から X Y へ Global. Ydiscriminative models Part of Speech Tagging X PRP VBD DT NN I ate a cake VBD PRP ate I 方法論の変化 NN I ate a cake PRP VBD DT NN DT a Dependency Parsing cake S NP PRP VP VBD ate I NP DT NN a cake Phrase Structure Parsing 木から木への変換 X: 入力木, Y: 解析木 学習データ : 統計的言語解析: P(Y|X) を最大にする Y を導出 2

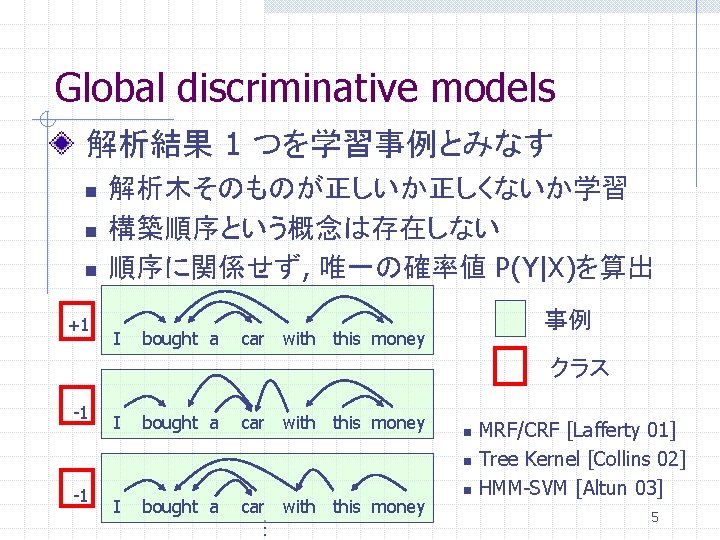

Global discriminative models 解析結果 1 つを学習事例とみなす n n n +1 解析木そのものが正しいか正しくないか学習 構築順序という概念は存在しない 順序に関係せず, 唯一の確率値 P(Y|X)を算出 I bought a 事例 car with this money クラス -1 I bought a car with this money n n -1 I bought a car with this money n MRF/CRF [Lafferty 01] Tree Kernel [Collins 02] HMM-SVM [Altun 03] … 5

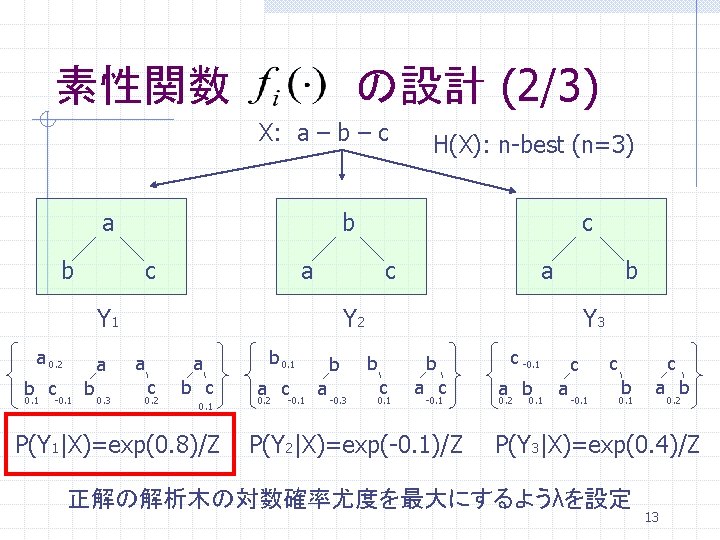

の設計 (2/3) 素性関数 X: a – b – c a b b c a b c-0. 1 b 0. 3 0. 1 c a c Y 1 a 0. 2 H(X): n-best (n=3) a b Y 2 a a c 0. 2 b c 0. 1 P(Y 1|X)=exp(0. 8)/Z b 0. 1 b a c-0. 1 a -0. 3 0. 2 Y 3 b b c 0. 1 a c -0. 1 P(Y 2|X)=exp(-0. 1)/Z c -0. 1 c a b 0. 1 a -0. 1 0. 2 c c b 0. 1 a b 0. 2 P(Y 3|X)=exp(0. 4)/Z 正解の解析木の対数確率尤度を最大にするようλを設定 13

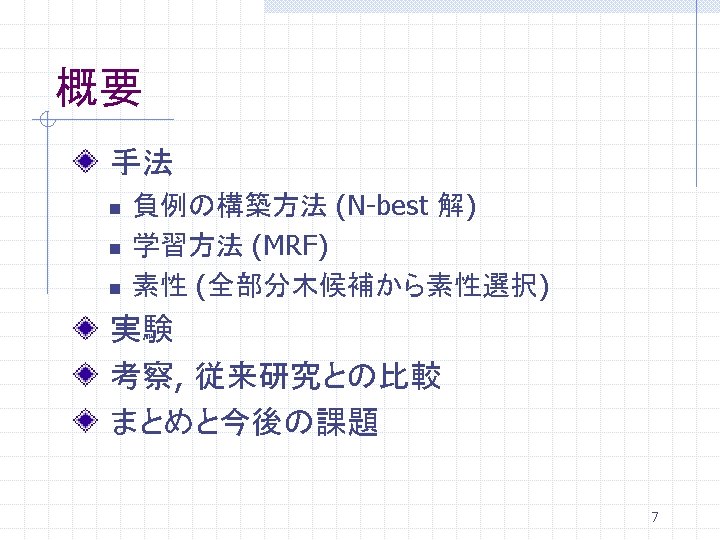

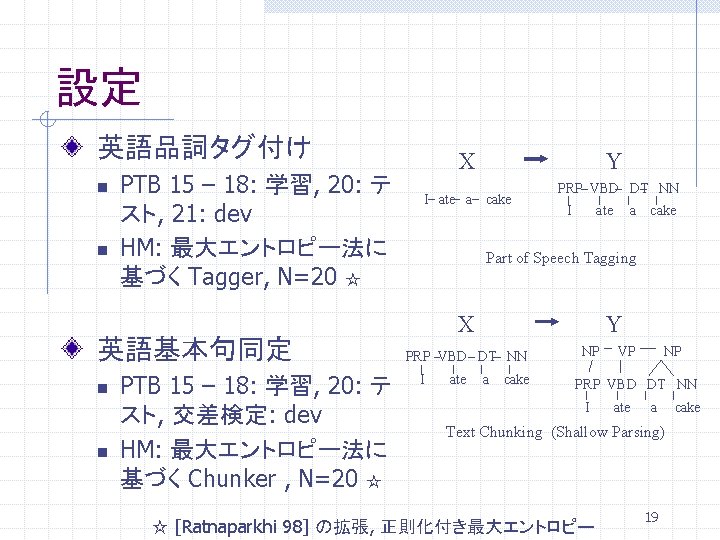

設定 英語品詞タグ付け n n PTB 15 – 18: 学習, 20: テ スト, 21: dev HM: 最大エントロピー法に 基づく Tagger, N=20 ☆ 英語基本句同定 n n PTB 15 – 18: 学習, 20: テ スト, 交差検定: dev HM: 最大エントロピー法に 基づく Chunker , N=20 ☆ X I ate a Y cake PRP VBD DT NN I ate a cake Part of Speech Tagging X Y PRP VBD DT NN I ate a cake NP VP NP PRP VBD DT NN I ate a Text Chunking (Shallow Parsing) ☆ [Ratnaparkhi 98] の拡張, 正則化付き最大エントロピー 19 cake

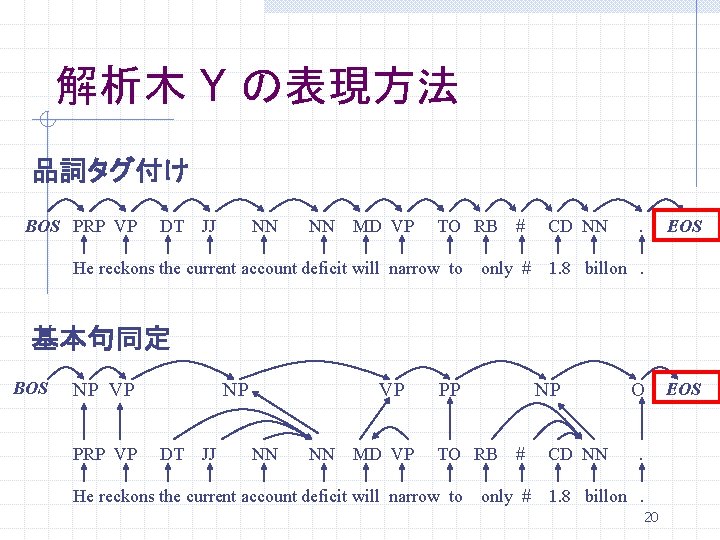

解析木 Y の表現方法 品詞タグ付け BOS PRP VP DT JJ NN NN MD VP TO RB He reckons the current account deficit will narrow to # only # CD NN . EOS 1. 8 billon. 基本句同定 BOS NP VP PRP VP NP DT JJ VP NN NN MD VP PP NP TO RB He reckons the current account deficit will narrow to # only # CD NN O. 1. 8 billon. 20 EOS

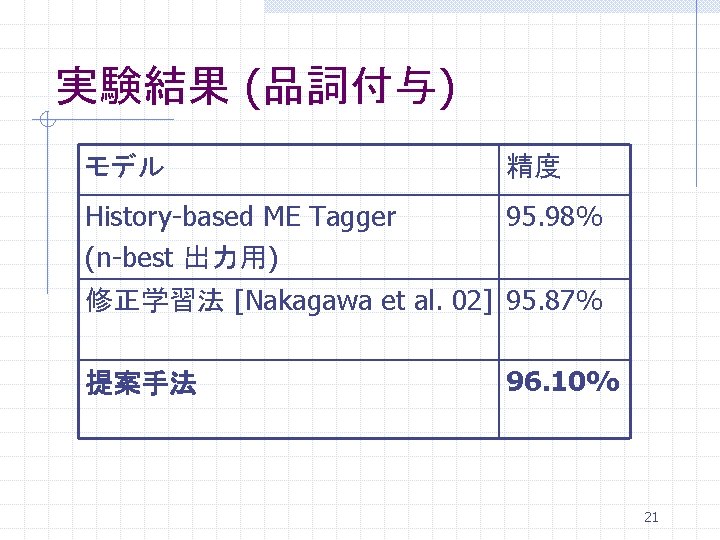

実験結果 (品詞付与) モデル 精度 History-based ME Tagger (n-best 出力用) 95. 98% 修正学習法 [Nakagawa et al. 02] 95. 87% 提案手法 96. 10% 21

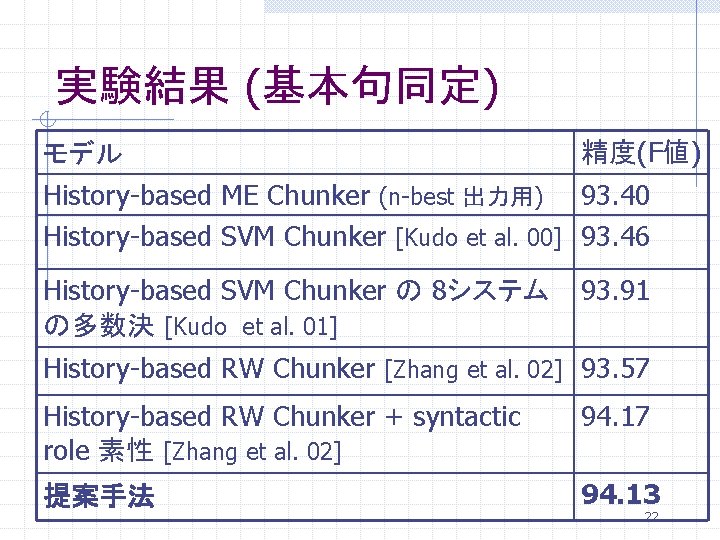

実験結果 (基本句同定) モデル 精度(F値) History-based ME Chunker (n-best 出力用) 93. 40 History-based SVM Chunker [Kudo et al. 00] 93. 46 History-based SVM Chunker の 8システム の多数決 [Kudo et al. 01] 93. 91 History-based RW Chunker [Zhang et al. 02] 93. 57 History-based RW Chunker + syntactic role 素性 [Zhang et al. 02] 94. 17 提案手法 94. 13 22

![関連研究との比較 負例 学習 素性 欠点 [Collins 01] N-best MRF/Boosting Heuristics 素性の恣意性 [Collins 02] N-Best 関連研究との比較 負例 学習 素性 欠点 [Collins 01] N-best MRF/Boosting Heuristics 素性の恣意性 [Collins 02] N-Best](http://slidetodoc.com/presentation_image_h2/cc88ff060c21f995138d9fadaf3bad2c/image-24.jpg)

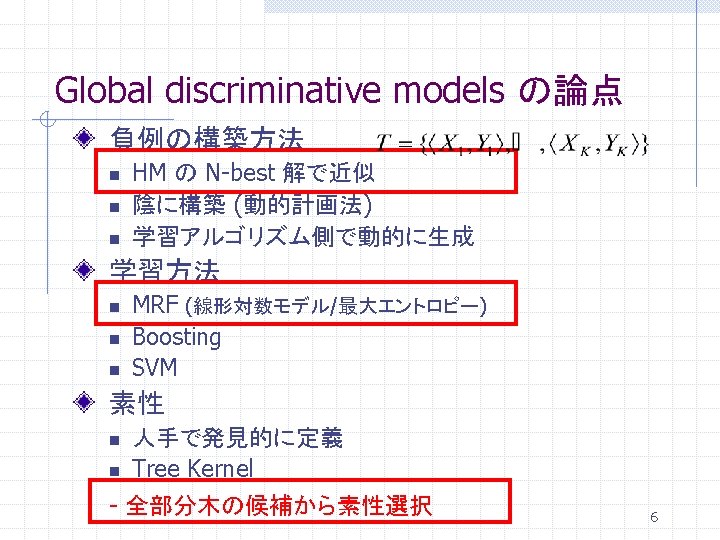

関連研究との比較 負例 学習 素性 欠点 [Collins 01] N-best MRF/Boosting Heuristics 素性の恣意性 [Collins 02] N-Best Perceptron Kernel 解析コスト大 CRF/FF DP MRF Heuristics [Lafferty 01] [Miyao 03] 陰に列挙 素性の恣意性 学習コスト大 HMM-SVM 〃 SVM N-best MRF [Altun 03] 本手法 (マルコフ性を満 たす必要) 〃 〃 部分木 + 素性選択 24

- Slides: 26