Uczenie konkurencyjne Wykad 6 Wodzisaw Duch Uniwersytet Mikoaja

- Slides: 26

Uczenie konkurencyjne Wykład 6 Włodzisław Duch Uniwersytet Mikołaja Kopernika Google: W. Duch

Co było • Mapy topograficzne w mózgu • Samoorganizacja • Sieci SOM Kohonena

Co będzie • • Mapy ekwiprobabilistyczne Zwycięzca bierze wszystko Gaz neuronowy Demonstracje w Jawie

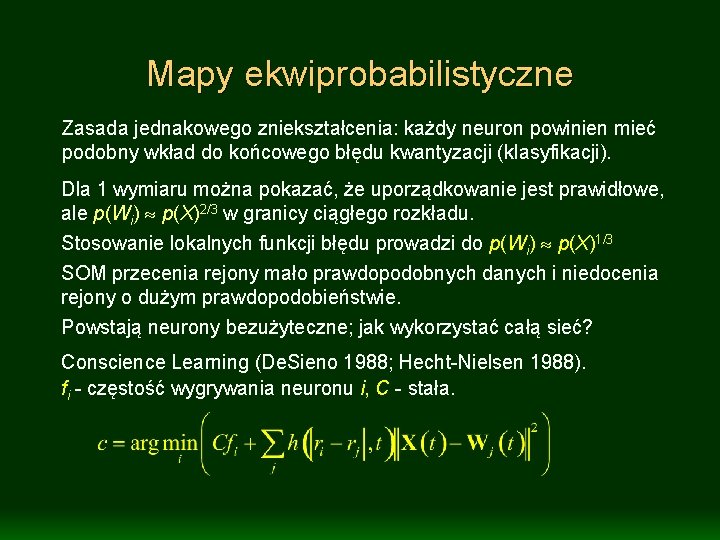

Mapy ekwiprobabilistyczne Zasada jednakowego zniekształcenia: każdy neuron powinien mieć podobny wkład do końcowego błędu kwantyzacji (klasyfikacji). Dla 1 wymiaru można pokazać, że uporządkowanie jest prawidłowe, ale p(Wi) p(X)2/3 w granicy ciągłego rozkładu. Stosowanie lokalnych funkcji błędu prowadzi do p(Wi) p(X)1/3 SOM przecenia rejony mało prawdopodobnych danych i niedocenia rejony o dużym prawdopodobieństwie. Powstają neurony bezużyteczne; jak wykorzystać całą sieć? Conscience Learning (De. Sieno 1988; Hecht-Nielsen 1988). fi - częstość wygrywania neuronu i, C - stała.

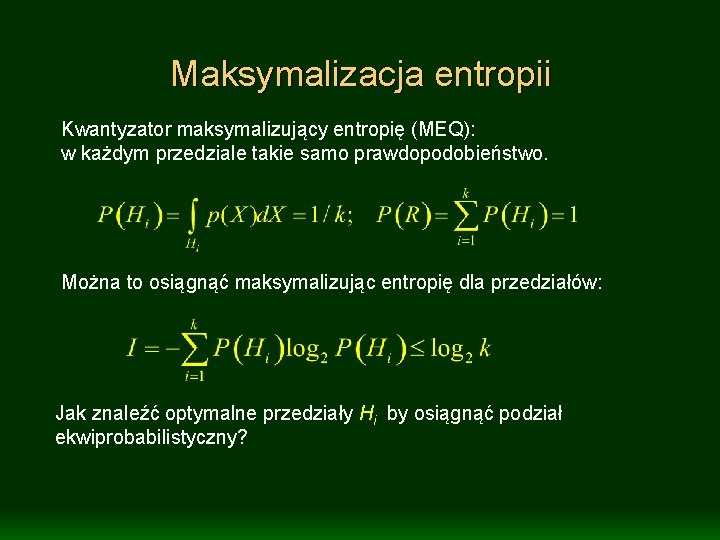

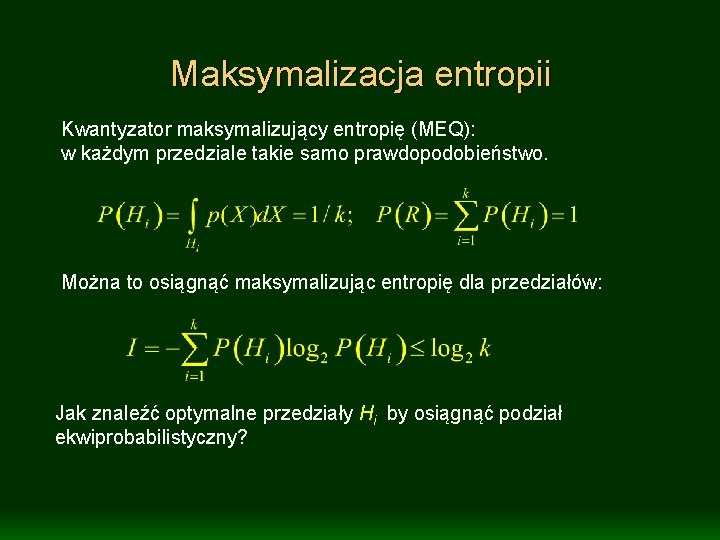

Maksymalizacja entropii Kwantyzator maksymalizujący entropię (MEQ): w każdym przedziale takie samo prawdopodobieństwo. Można to osiągnąć maksymalizując entropię dla przedziałów: Jak znaleźć optymalne przedziały Hi by osiągnąć podział ekwiprobabilistyczny?

BAR Reguła Adaptacji Granic, Boundry Adaptation Rule. Jeśli P(Hi) jest za duże (zbyt często pojawiają się wektory z tego przedziału) to wielkość przedziału należy zmniejszyć. Przedział w 1 D określony jest przez wagi. Jeśli dane są z przedziału Hi to Wi przesuwamy w lewo (zmniejszamy przedział Hi), jeśli z Hi+1 to w prawo (zmniejszamy przedział Hi+1). Zmiany ustają gdy mamy ekwiprobabilistyczny podział:

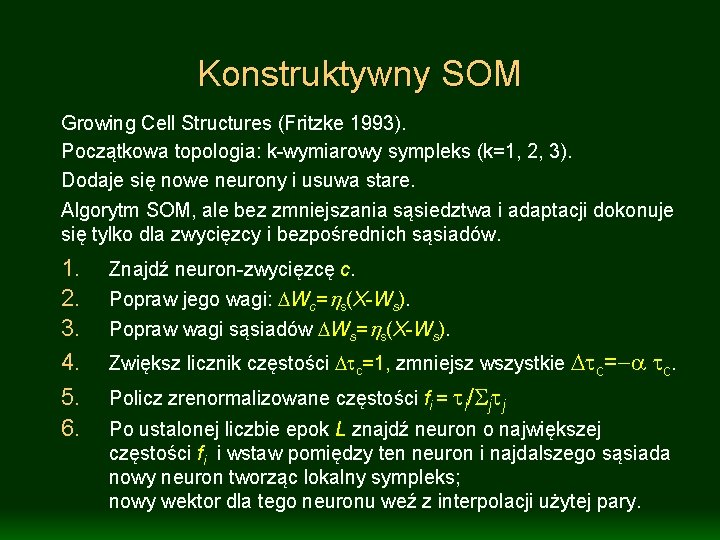

Konstruktywny SOM Growing Cell Structures (Fritzke 1993). Początkowa topologia: k-wymiarowy sympleks (k=1, 2, 3). Dodaje się nowe neurony i usuwa stare. Algorytm SOM, ale bez zmniejszania sąsiedztwa i adaptacji dokonuje się tylko dla zwycięzcy i bezpośrednich sąsiadów. 1. 2. 3. 4. 5. 6. Znajdź neuron-zwycięzcę c. Popraw jego wagi: DWc=hs(X-Ws). Popraw wagi sąsiadów DWs=hs(X-Ws). Zwiększ licznik częstości Dtc=1, zmniejsz wszystkie Dtc=-a tc. Policz zrenormalizowane częstości fi = ti/Sjtj Po ustalonej liczbie epok L znajdź neuron o największej częstości fi i wstaw pomiędzy ten neuron i najdalszego sąsiada nowy neuron tworząc lokalny sympleks; nowy wektor dla tego neuronu weź z interpolacji użytej pary.

Rozwój GCS

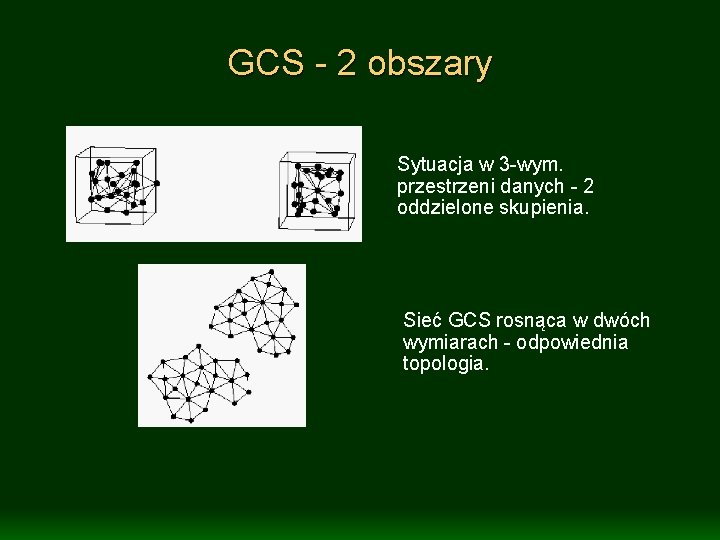

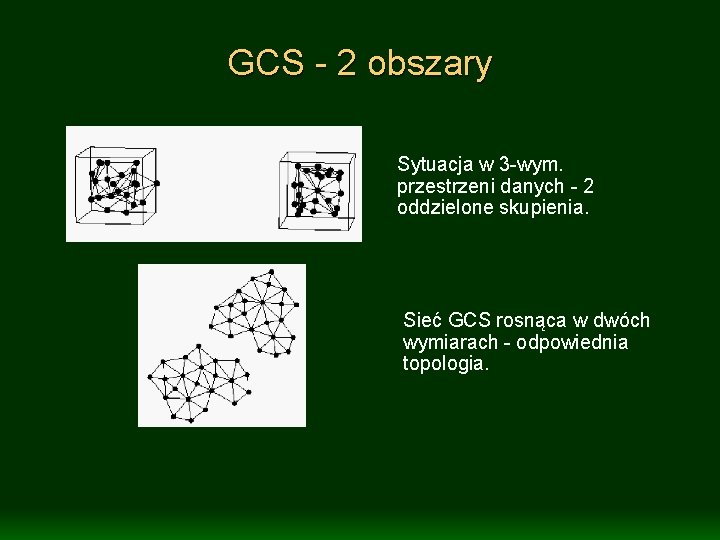

GCS - 2 obszary Sytuacja w 3 -wym. przestrzeni danych - 2 oddzielone skupienia. Sieć GCS rosnąca w dwóch wymiarach - odpowiednia topologia.

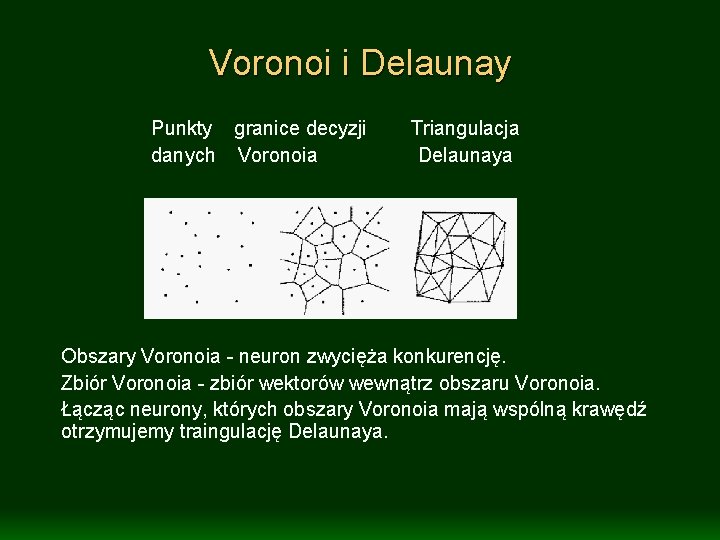

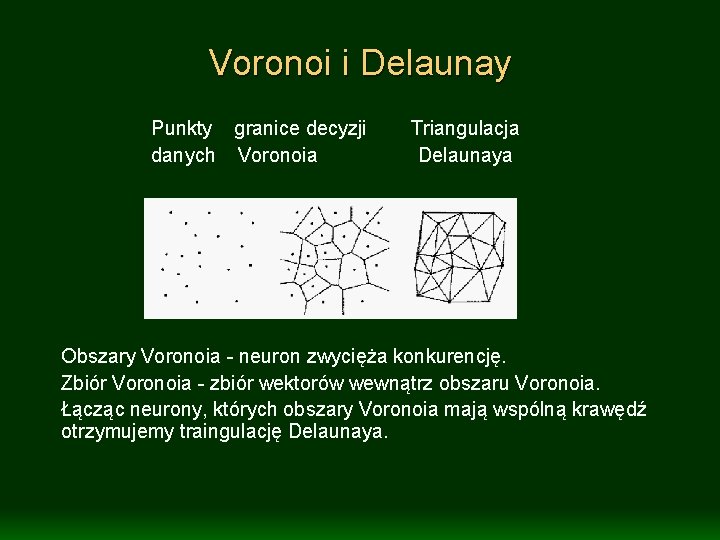

Voronoi i Delaunay Punkty granice decyzji danych Voronoia Triangulacja Delaunaya Obszary Voronoia - neuron zwycięża konkurencję. Zbiór Voronoia - zbiór wektorów wewnątrz obszaru Voronoia. Łącząc neurony, których obszary Voronoia mają wspólną krawędź otrzymujemy traingulację Delaunaya.

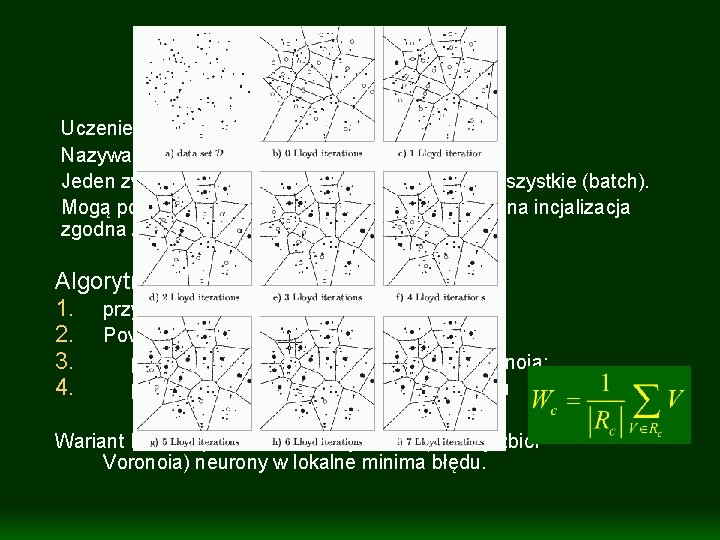

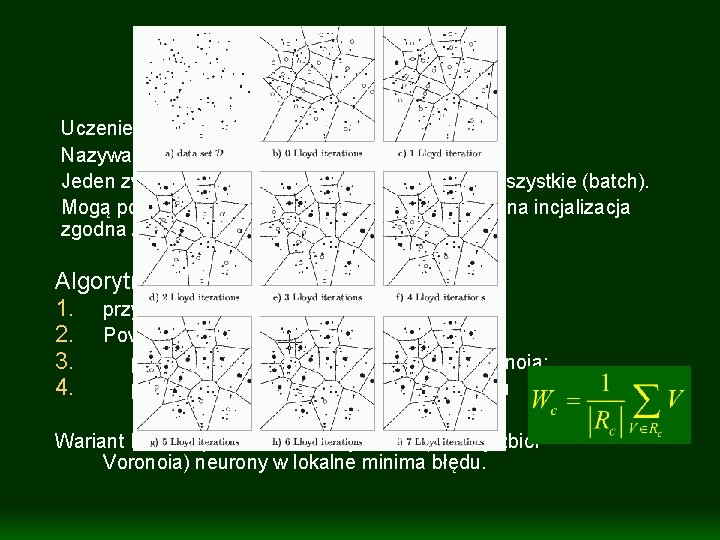

WTA Uczenie konkurencyjne - WTA, Winner Takes All. Nazywane też Hard Competitive Learning. Jeden zwycięzca, dane pojedynczo (on-line) lub wszystkie (batch). Mogą powstawać bezużyteczne neurony - konieczna incjalizacja zgodna z rozkładem danych. Algorytm LBG typu WTA: 1. przypadkowa inicjalizacja; 2. Powtarzaj aż ustaną zmiany: 3. pokaż wszystkie dane i znajdź zbiory Voronoia; 4. przesuń wagi neuronu do centrum obszaru Wariant LBG-U: przesuń mało użyteczne (zerowy zbiór Voronoia) neurony w lokalne minima błędu.

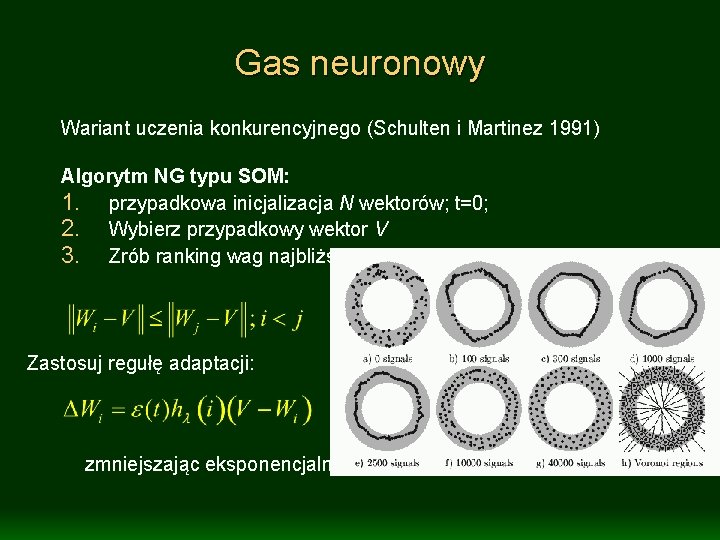

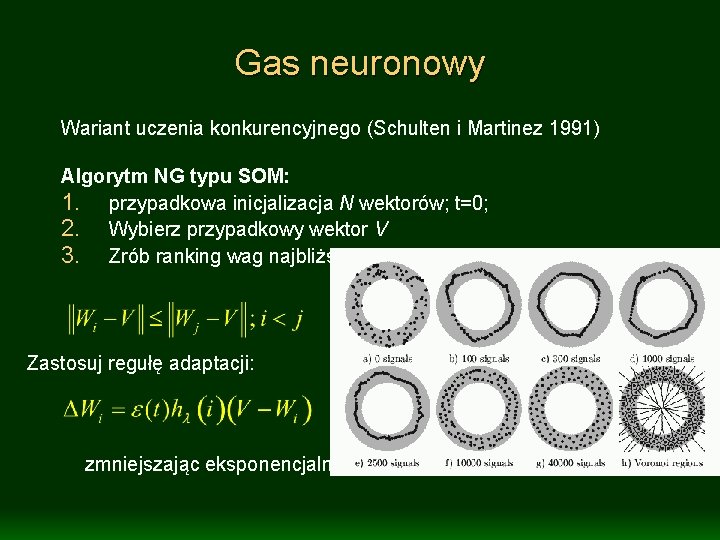

Gas neuronowy Wariant uczenia konkurencyjnego (Schulten i Martinez 1991) Algorytm NG typu SOM: 1. przypadkowa inicjalizacja N wektorów; t=0; 2. Wybierz przypadkowy wektor V 3. Zrób ranking wag najbliższych V; k=1. . N Zastosuj regułę adaptacji: zmniejszając eksponencjalnie obszar l i stałą uczenia e(t).

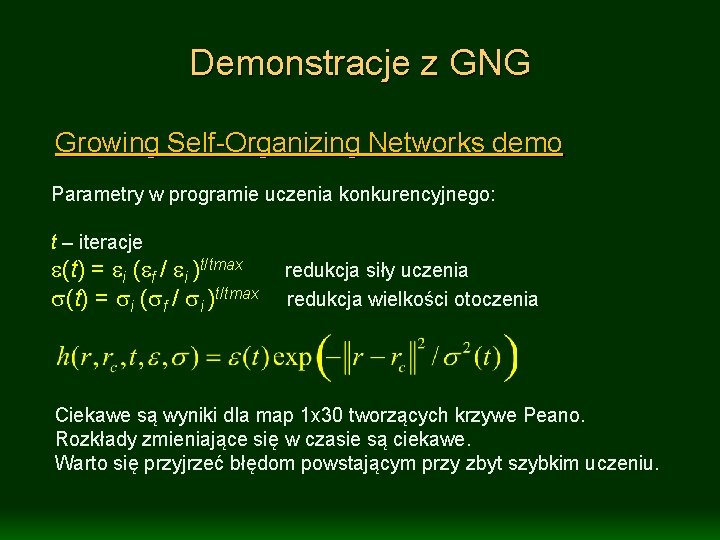

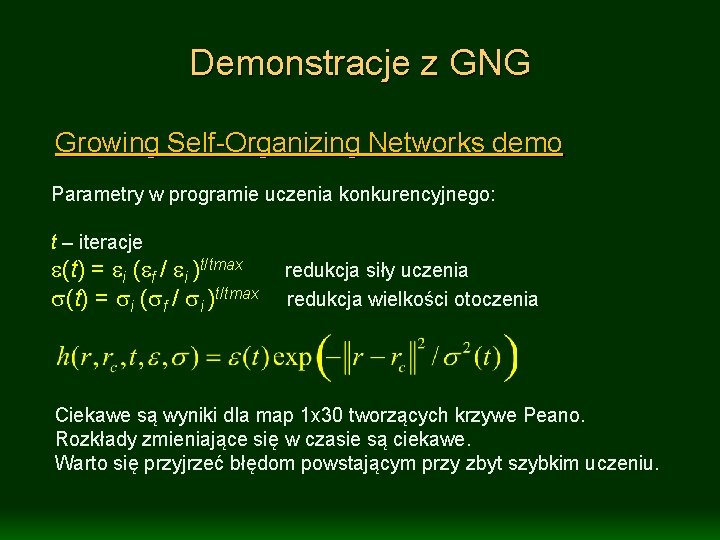

Demonstracje z GNG Growing Self-Organizing Networks demo Parametry w programie uczenia konkurencyjnego: t – iteracje e(t) = ei (ef / ei )t/tmax s(t) = si (sf / si )t/tmax redukcja siły uczenia redukcja wielkości otoczenia Ciekawe są wyniki dla map 1 x 30 tworzących krzywe Peano. Rozkłady zmieniające się w czasie są ciekawe. Warto się przyjrzeć błędom powstającym przy zbyt szybkim uczeniu.

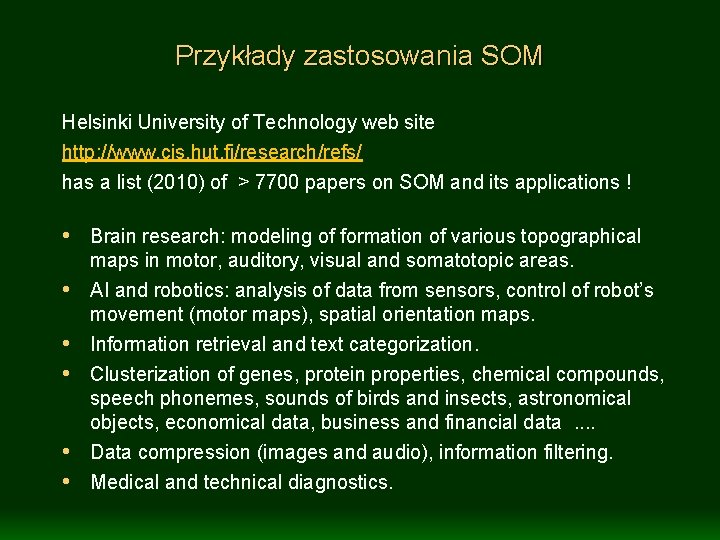

Przykłady zastosowania SOM Helsinki University of Technology web site http: //www. cis. hut. fi/research/refs/ has a list (2010) of > 7700 papers on SOM and its applications ! • Brain research: modeling of formation of various topographical • • • maps in motor, auditory, visual and somatotopic areas. AI and robotics: analysis of data from sensors, control of robot’s movement (motor maps), spatial orientation maps. Information retrieval and text categorization. Clusterization of genes, protein properties, chemical compounds, speech phonemes, sounds of birds and insects, astronomical objects, economical data, business and financial data. . Data compression (images and audio), information filtering. Medical and technical diagnostics.

Więcej przykładów • Natural language processing: linguistic analysis, parsing, learning languages, hyphenation patterns • Optimization: configuration of telephone connections, VLSI design, time series prediction, scheduling algorithms. • Signal processing: adaptive filters, real-time signal analysis, radar, sonar seismic, USG, EKG, EEG and other medical signals. . . • Image recognition and processing: segmentation, object recognition, texture recognition. . . • Content-based retrieval: examples of Web. SOM, Pic. Som – similarity based image retrieval, RGB and textures. • Viscovery SOMine, komercyjny program do wizualizacji, eksploracji, klasyfikacji, prognozowania oparty na SOM.

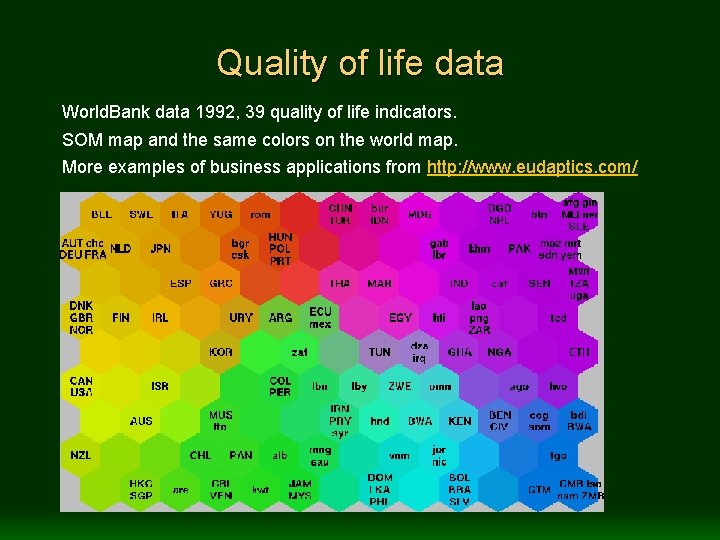

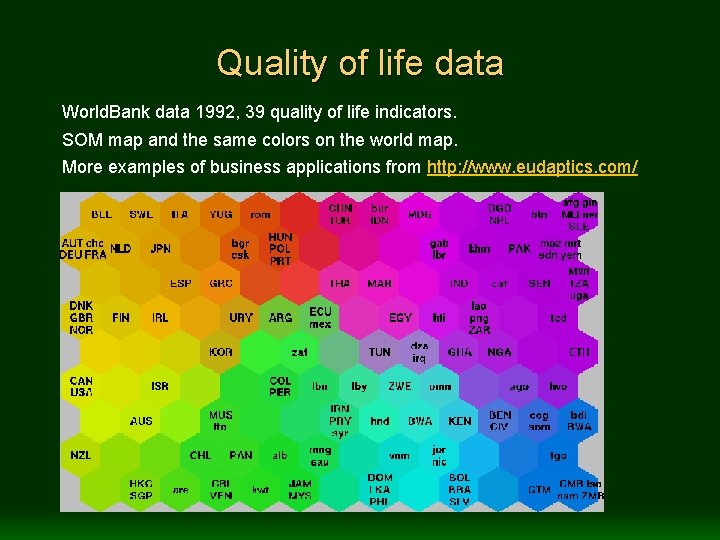

Quality of life data World. Bank data 1992, 39 quality of life indicators. SOM map and the same colors on the world map. More examples of business applications from http: //www. eudaptics. com/

SOM software • Jest kilka darmowych implementacji SOM. • Najlepsze wizualizacje ma Viscovery free viewer http: //www. eudaptics. com Można go było używać z darmowym SOM_pack z http: //www. cis. hut. fi/research/som_lvq_pak. shtml • Growing Self-Organizing Networks demo (demo. GNG) i praca przeglądowa na temat uczenia konkurencyjnego. Książka: T. Kohonen, Self-organizing Maps (3 rd ed, Springer 2001)

Spisek zagnieżdża się w mózgu Dlaczego ludzie wierzą w teorie spiskowe? • Emocje, niepewne sytuacje zmuszają mózg do większej neuroplastyczności by zapamiętać to co nas poruszyło. • Większa dostępność neurotransmiterów zwiększa szybkość uczenia i prawdopodobieństwo błędnej interpretacji. • Gwałtowna zmiana, traumatyczne przeżycia, zmniejszają plastyczność „zamrażając” błędne wyobrażenia. • Zapominanie szczegółów pozostawia najsilniejsze skojarzenia. • Teorie i przekonania tworzą się przez skojarzenia zbioru stanów reprezentowanych przez „migawki aktywacji mózgu”, prototypy pewnych przeżyć. • Teorie spiskowe powstają gdy z kilkoma błędnymi stanami mózgu zaczyna się kojarzyć wiele innych – to daje proste pozornie prawdziwe wyjaśnienia, oszczędza energię mózgu. I tak powstaje oczywista oczywistość …

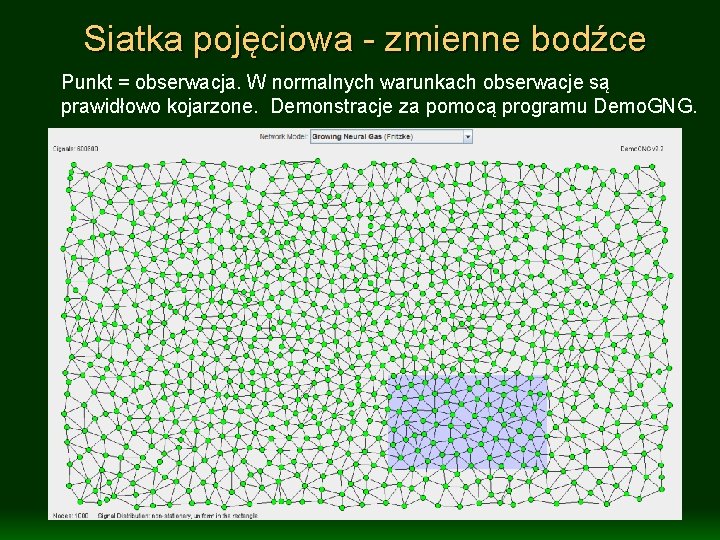

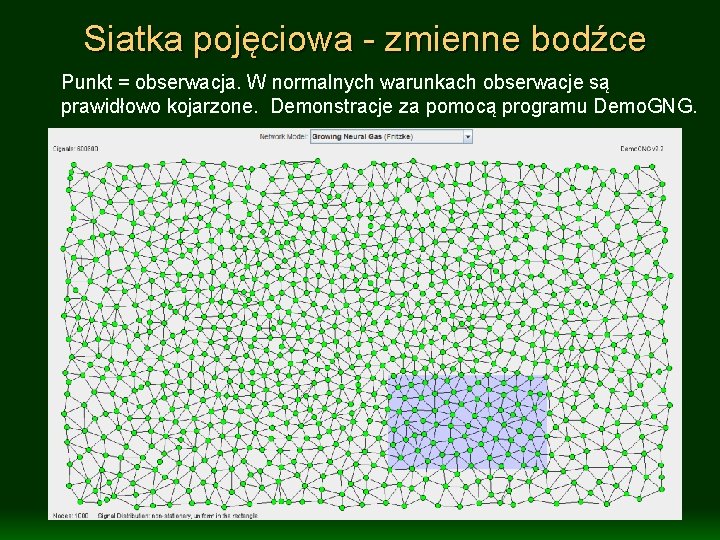

Siatka pojęciowa - zmienne bodźce Punkt = obserwacja. W normalnych warunkach obserwacje są prawidłowo kojarzone. Demonstracje za pomocą programu Demo. GNG.

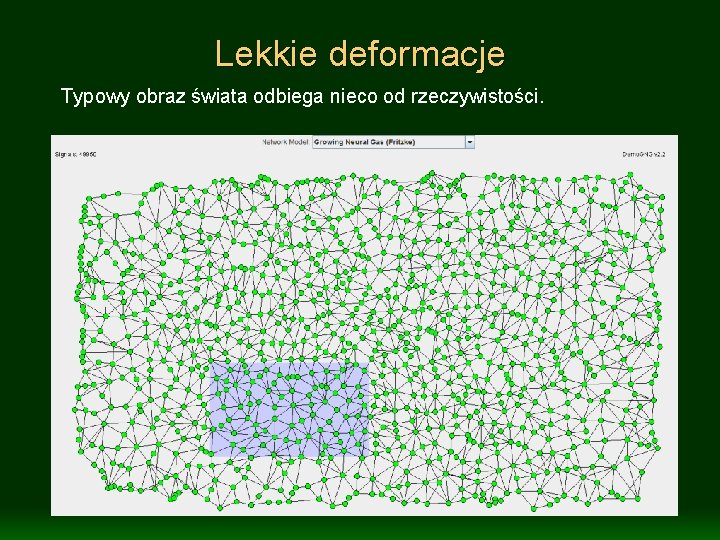

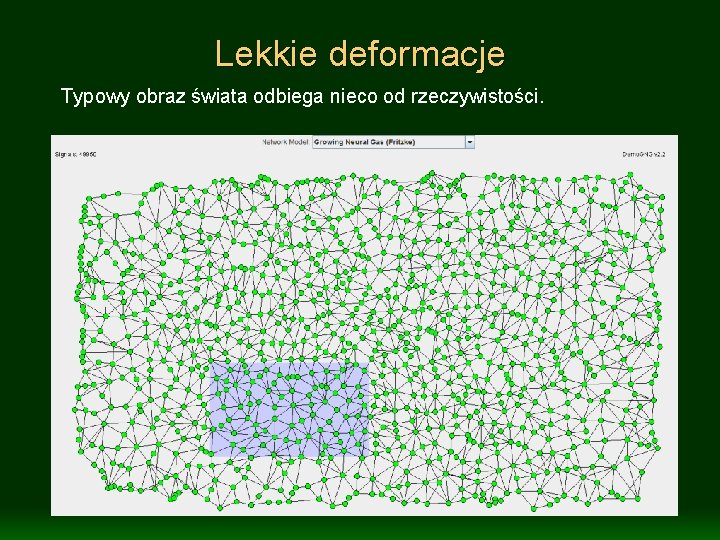

Lekkie deformacje Typowy obraz świata odbiega nieco od rzeczywistości.

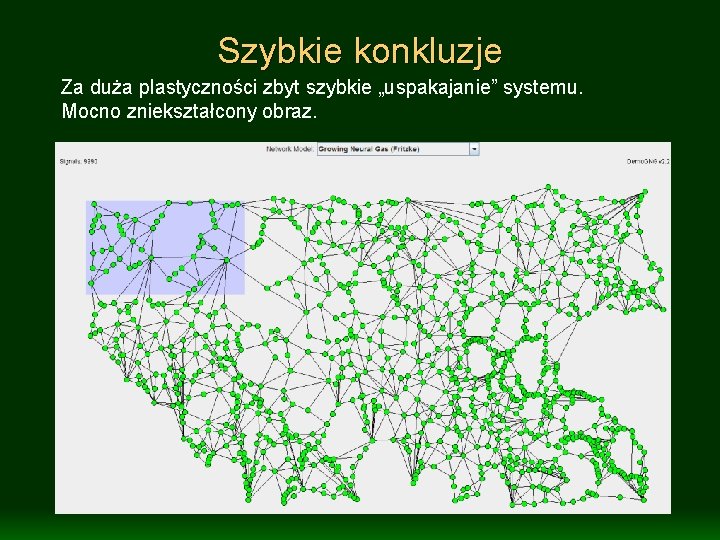

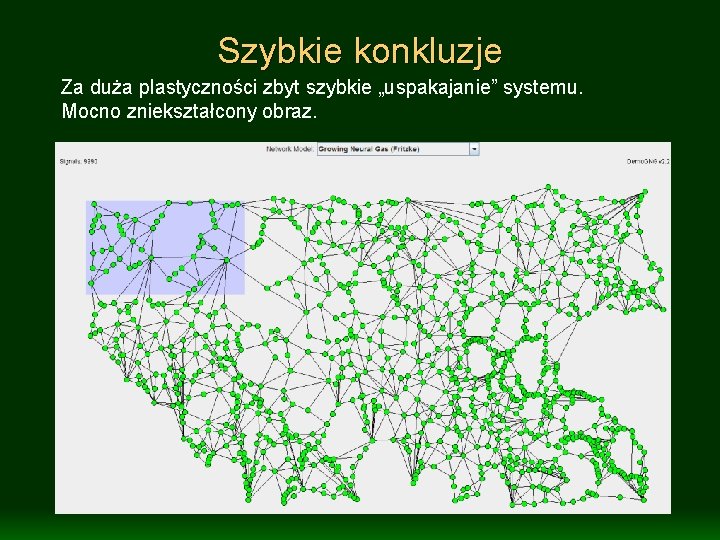

Szybkie konkluzje Za duża plastyczności zbyt szybkie „uspakajanie” systemu. Mocno zniekształcony obraz.

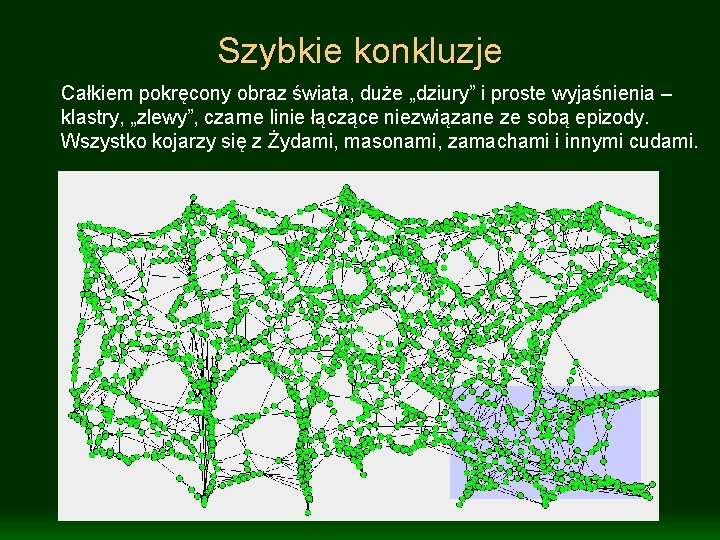

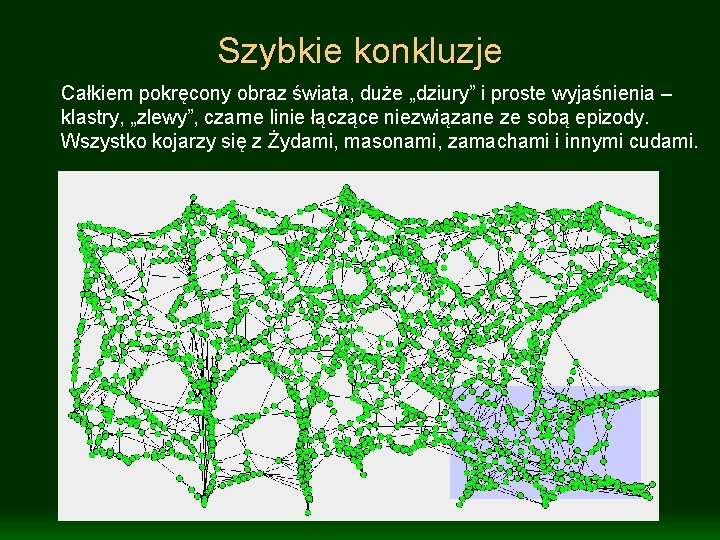

Szybkie konkluzje Całkiem pokręcony obraz świata, duże „dziury” i proste wyjaśnienia – klastry, „zlewy”, czarne linie łączące niezwiązane ze sobą epizody. Wszystko kojarzy się z Żydami, masonami, zamachami i innymi cudami.

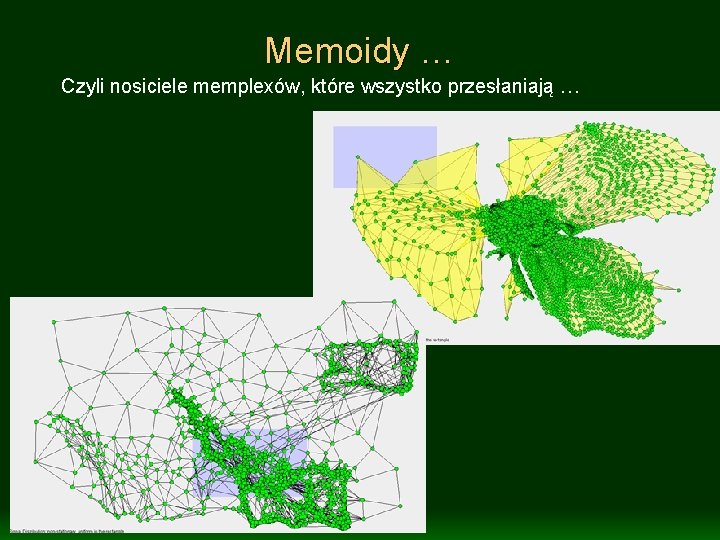

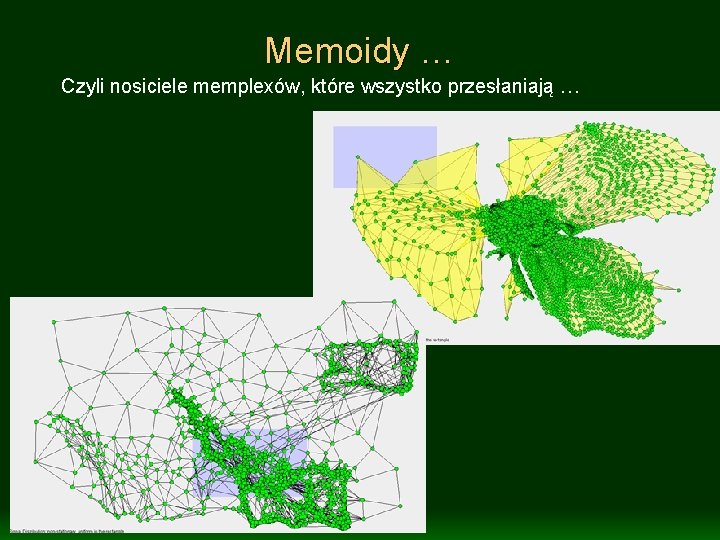

Memoidy … Czyli nosiciele memplexów, które wszystko przesłaniają …

Co dalej? • Wizualizacja SOM. Skalowanie Wielowymiarowe. • Learnmatrix, Adaline, Madaline i modele liniowe. • Perceptrony.

Koniec wykładu 6 Dobranoc !

Dobra prywatne i publiczne

Dobra prywatne i publiczne G??bokie uczenie

G??bokie uczenie Uczenie maszynowe

Uczenie maszynowe Plainai

Plainai Utw rzeszów ogłoszenia

Utw rzeszów ogłoszenia Uniwersytet opolski erasmus

Uniwersytet opolski erasmus Logistyka studia opole

Logistyka studia opole Najstarszy uniwersytet w polsce

Najstarszy uniwersytet w polsce Uksw irk

Uksw irk Katolicki uniwersytet lubelski

Katolicki uniwersytet lubelski Tutw zgorzelec

Tutw zgorzelec Uniwersytet rzeszowski wydział wychowania fizycznego

Uniwersytet rzeszowski wydział wychowania fizycznego Googleduch

Googleduch Formułka pragniemy, aby duch święty

Formułka pragniemy, aby duch święty Mickiewicz prezentacja

Mickiewicz prezentacja Hebrajskie duch to

Hebrajskie duch to Lau duch

Lau duch Protestantská etika a duch kapitalismu

Protestantská etika a duch kapitalismu Jezis moj pred tvojou stojim obetou akordy

Jezis moj pred tvojou stojim obetou akordy W zdrowym ciele zdrowy duch wikipedia

W zdrowym ciele zdrowy duch wikipedia Patryk duch

Patryk duch Jak ożywczy deszcz duchu święty przyjdź

Jak ożywczy deszcz duchu święty przyjdź Duch prorocki a wróżby

Duch prorocki a wróżby Príď svätý duch vojdi do nás

Príď svätý duch vojdi do nás Duch

Duch Holubica symbol ducha svätého

Holubica symbol ducha svätého