Testes PostHoc Filipi Calbaizer Marchi Matos Juliana Rodrigues

Testes Post-Hoc Filipi Calbaizer Marchi Matos Juliana Rodrigues Pereira Silva Leandro Libório da Silva

Tópicos Abordados ● ● ● ● ● Introdução - Testes post-hoc (Juliana) Revisão - Testes de hipóteses (Juliana) Tipos de testes post-hoc mais comuns (Juliana) Teste de Tukey (Filipi) Teste SNK (Filipi) Teste de Bonferroni (Filipi) Aplicação do Teste de Tukey no R (Leandro) Aplicação do Teste SNK no R (Leandro) Aplicação do Teste de Bonferroni no R (Leandro) Referências

Introdução Quando os resultados da ANOVA levam à rejeição de H 0, que representa a afirmação de que todas as médias são iguais, temos evidências de que as médias diferem significativamente. Os testes Post hoc são um conjunto de testes para descobrir onde estas diferenças residem. A ANOVA não informa quais grupos diferem, somente informa que existe uma diferença. Os testes consistem em comparações pareadas, projetadas para comparar todas as diferentes combinações dos grupos de tratamento.

Introdução A escolha do procedimento de comparação dependerá da situação exata que você possui e se é mais importante manter controle rígido sobre a taxa de erro familiar ou ter maior poder estatístico (Toothaker, 1993). Comparações aos pares controlam o erro familiar, corrigindo o nível de significância para cada teste, de modo que a taxa de erro geral do tipo I (α) em todas as comparações permaneça em 0, 05.

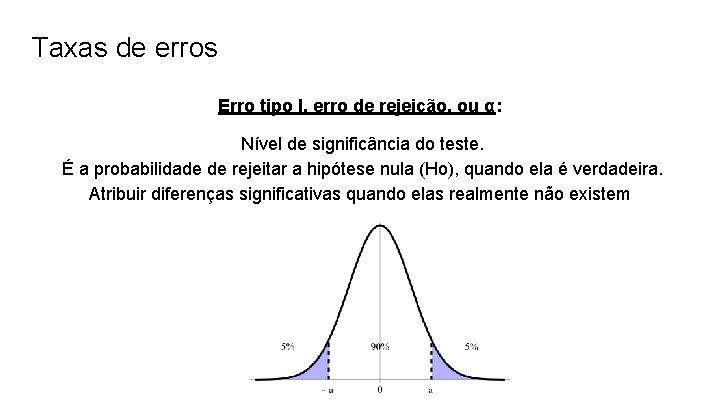

Taxas de erros Erro tipo I, erro de rejeição, ou α: Nível de significância do teste. É a probabilidade de rejeitar a hipótese nula (Ho), quando ela é verdadeira. Atribuir diferenças significativas quando elas realmente não existem

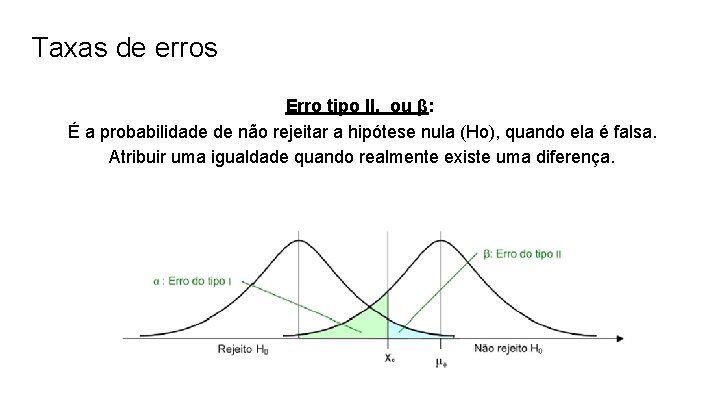

Taxas de erros Erro tipo II, ou β: É a probabilidade de não rejeitar a hipótese nula (Ho), quando ela é falsa. Atribuir uma igualdade quando realmente existe uma diferença.

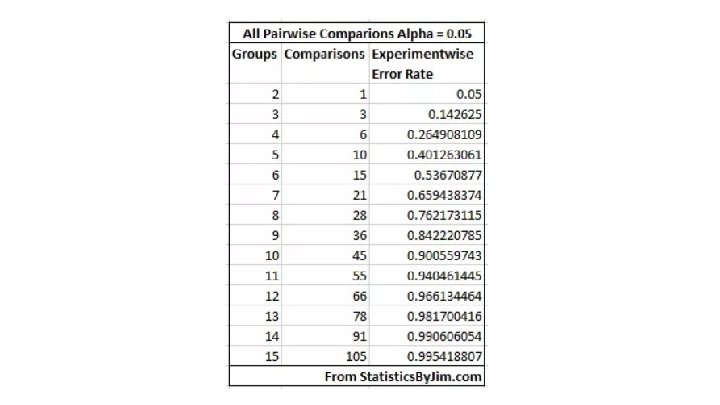

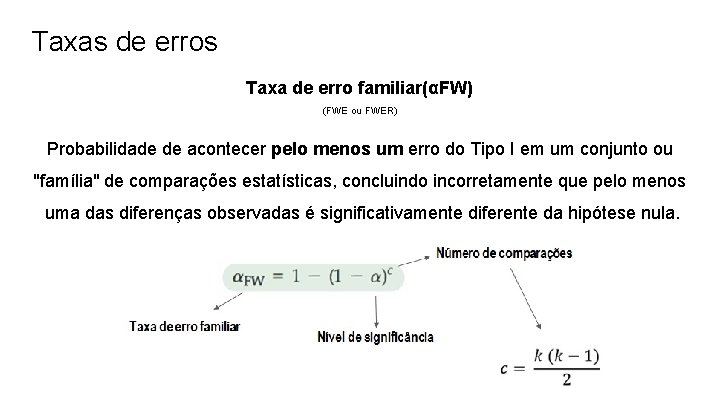

Taxas de erros Taxa de erro familiar(αFW) (FWE ou FWER) Probabilidade de acontecer pelo menos um erro do Tipo I em um conjunto ou "família" de comparações estatísticas, concluindo incorretamente que pelo menos uma das diferenças observadas é significativamente diferente da hipótese nula.

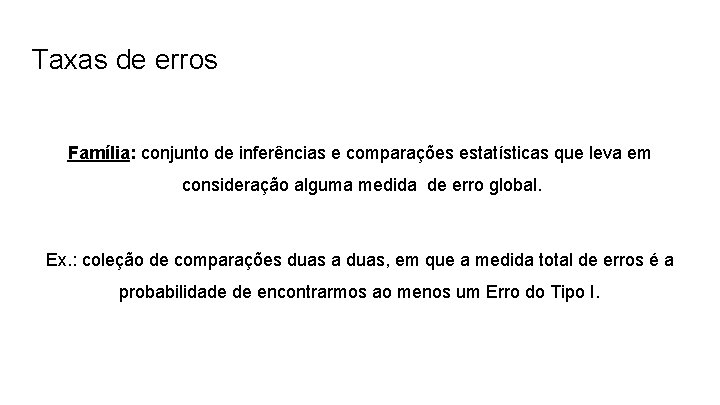

Taxas de erros Família: conjunto de inferências e comparações estatísticas que leva em consideração alguma medida de erro global. Ex. : coleção de comparações duas a duas, em que a medida total de erros é a probabilidade de encontrarmos ao menos um Erro do Tipo I.

Taxas de erros Taxa de erro por comparação (αPC) Probabilidade de rejeitarmos incorretamente cada uma das hipóteses nulas que compõem a família, onde cada comparação da família é definida com um valor de α.

Taxas de erros Taxas de erro por comparação x taxa de erro familiar: O uso da taxa de erro por comparação resultará em maior poder estatístico, mas com o potencial de mais erros do Tipo I. O uso da taxa de erro de família produzirá menos erros do Tipo I, mas resultará em menos diferenças significativas.

Taxas de erros Existe uma compensação pelo controle da taxa de erro familiar e isso é uma perda de poder estatístico. Isso significa que a probabilidade de rejeitar um efeito que realmente existe é aumentada (isso é chamado de erro do tipo II). Por ser mais conservador na taxa de erro Tipo I para cada comparação, aumentamos a chance de perdermos uma diferença genuína nos dados.

Testes Post hoc mais comuns Testes de comparações múltiplas: ● Teste de Tukey ● Teste de Scheffé ● Teste de Newman-Keuls ● Teste de Duncan ● Teste de Bonferroni ● Teste de Fisher

Teste de Tukey Pretende identificar quais as médias que, tomadas duas a duas, diferem significativamente entre si. Este método protege os testes de um aumento do nível de significância devido ao grande número de comparações efetuadas. Diferença Honestamente Significativa (HSD): Define uma taxa de erro familiar → proteção contra o erro tipo I.

Teste de Student-Newman-Keuls(SNK) Realizado da mesma forma que o de Tukey, com exceção de que o valor crítico depende não do número de tratamentos envolvidos no experimento(k), mas do número de médias incluídas (k') na amplitude de médias que está sendo testada.

Correção de Bonferroni Consiste em corrigir o valor de α, calculando-se: A correção de Bonferroni não requer que as várias comparações sejam independentes.

Correção de Bonferroni Existem várias maneiras pelas quais a taxa de erro familiar pode ser controlada. A maneira mais popular (e mais fácil) é dividir α pelo número de comparações, garantindo assim que o erro cumulativo de Tipo I esteja abaixo de 0, 05. Portanto, se realizarmos 10 testes, usaremos 0, 005 como nosso critério de significância.

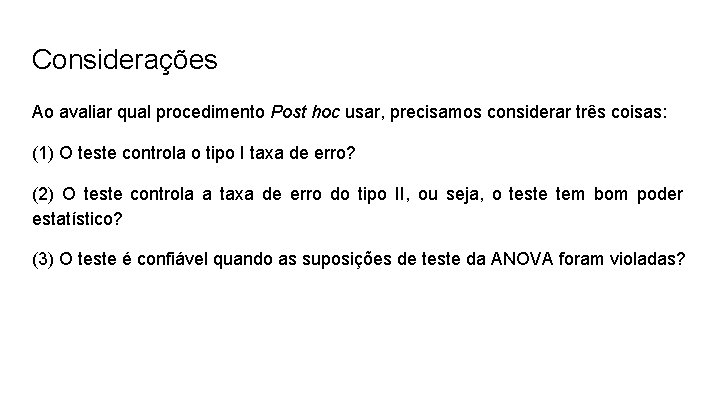

Considerações Ao avaliar qual procedimento Post hoc usar, precisamos considerar três coisas: (1) O teste controla o tipo I taxa de erro? (2) O teste controla a taxa de erro do tipo II, ou seja, o teste tem bom poder estatístico? (3) O teste é confiável quando as suposições de teste da ANOVA foram violadas?

❖ Tukey TESTE DE COMPARAÇÕES MÚLTIPLAS ❖ Newman-Keuls ❖ Scheffé ❖ Fisher ❖ Bonferroni ❖ Duncan

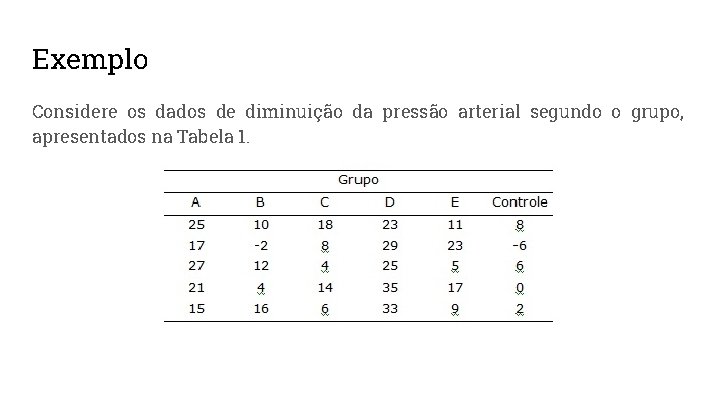

Exemplo Considere os dados de diminuição da pressão arterial segundo o grupo, apresentados na Tabela 1.

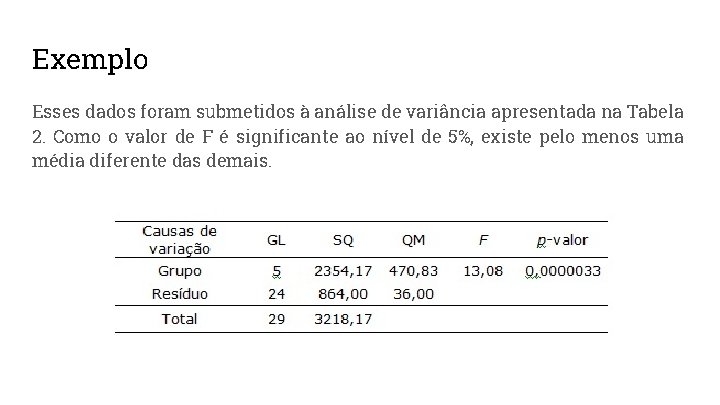

Exemplo Esses dados foram submetidos à análise de variância apresentada na Tabela 2. Como o valor de F é significante ao nível de 5%, existe pelo menos uma média diferente das demais.

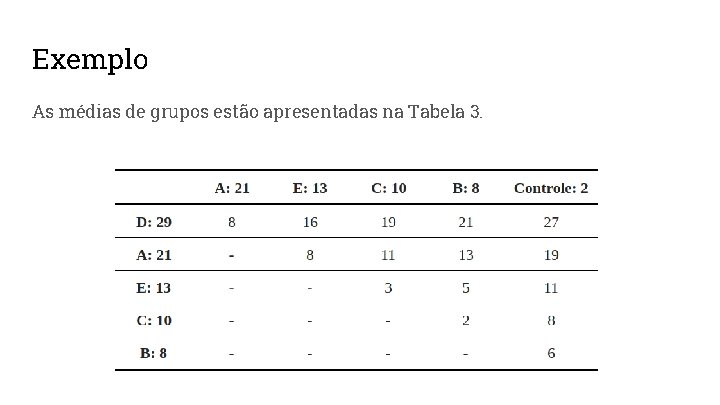

Exemplo As médias de grupos estão apresentadas na Tabela 3.

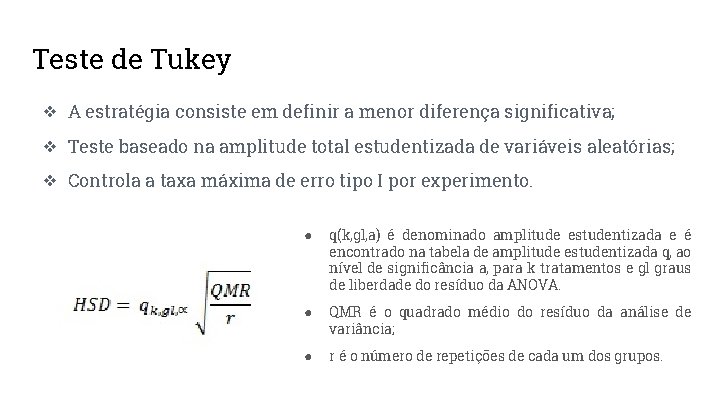

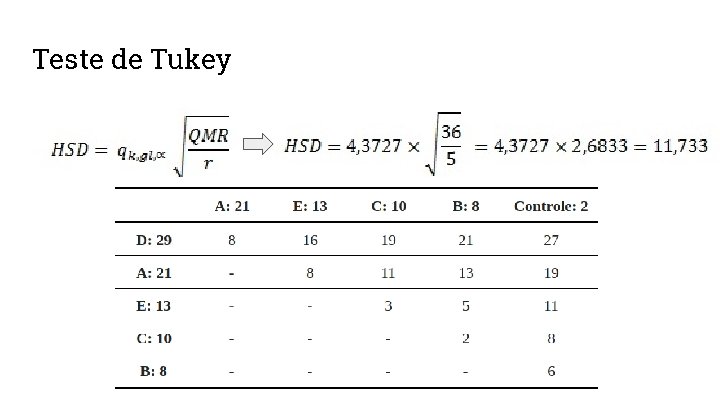

Teste de Tukey ❖ A estratégia consiste em definir a menor diferença significativa; ❖ Teste baseado na amplitude total estudentizada de variáveis aleatórias; ❖ Controla a taxa máxima de erro tipo I por experimento. ● q(k, gl, a) é denominado amplitude estudentizada e é encontrado na tabela de amplitude estudentizada q, ao nível de significância a, para k tratamentos e gl graus de liberdade do resíduo da ANOVA. ● QMR é o quadrado médio do resíduo da análise de variância; ● r é o número de repetições de cada um dos grupos.

Teste de Tukey

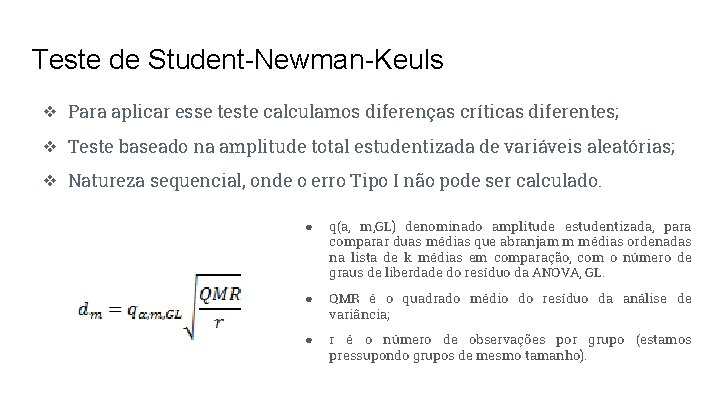

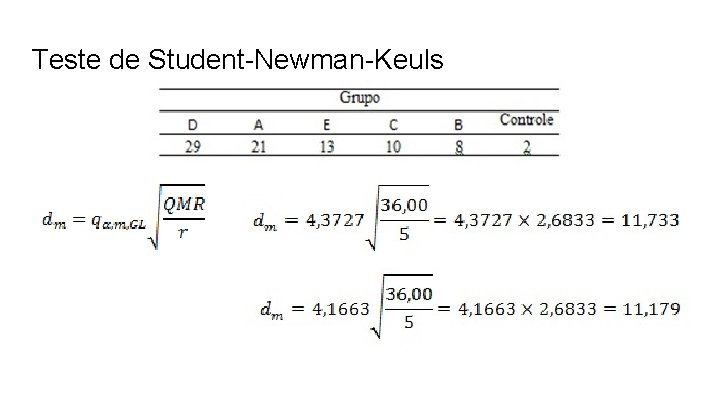

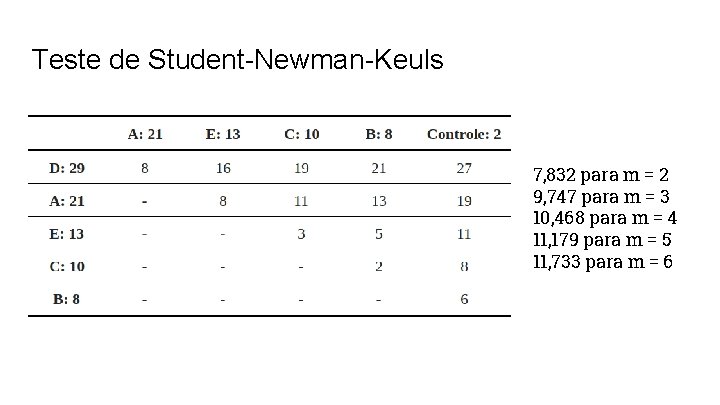

Teste de Student-Newman-Keuls ❖ Para aplicar esse teste calculamos diferenças críticas diferentes; ❖ Teste baseado na amplitude total estudentizada de variáveis aleatórias; ❖ Natureza sequencial, onde o erro Tipo I não pode ser calculado. ● q(a, m, GL) denominado amplitude estudentizada, para comparar duas médias que abranjam m médias ordenadas na lista de k médias em comparação, com o número de graus de liberdade do resíduo da ANOVA, GL. ● QMR é o quadrado médio do resíduo da análise de variância; ● r é o número de observações por grupo (estamos pressupondo grupos de mesmo tamanho).

Teste de Student-Newman-Keuls

Teste de Student-Newman-Keuls 7, 832 para m = 2 9, 747 para m = 3 10, 468 para m = 4 11, 179 para m = 5 11, 733 para m = 6

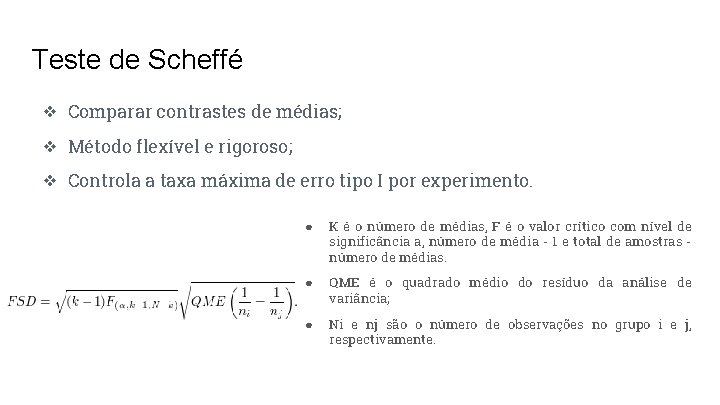

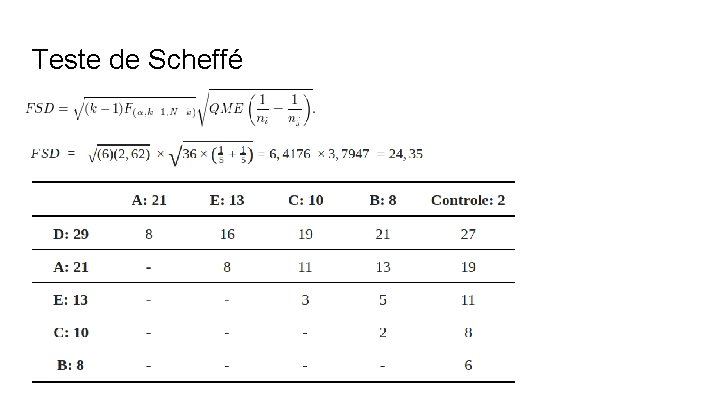

Teste de Scheffé ❖ Comparar contrastes de médias; ❖ Método flexível e rigoroso; ❖ Controla a taxa máxima de erro tipo I por experimento. ● K é o número de médias, F é o valor crítico com nível de significância a, número de média - 1 e total de amostras número de médias. ● QME é o quadrado médio do resíduo da análise de variância; ● Ni e nj são o número de observações no grupo i e j, respectivamente.

Teste de Scheffé

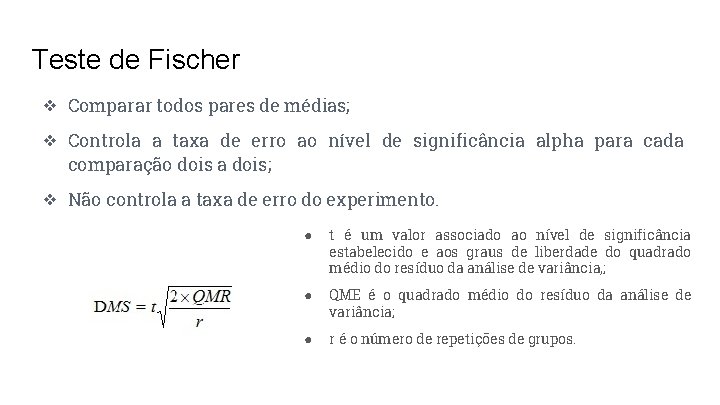

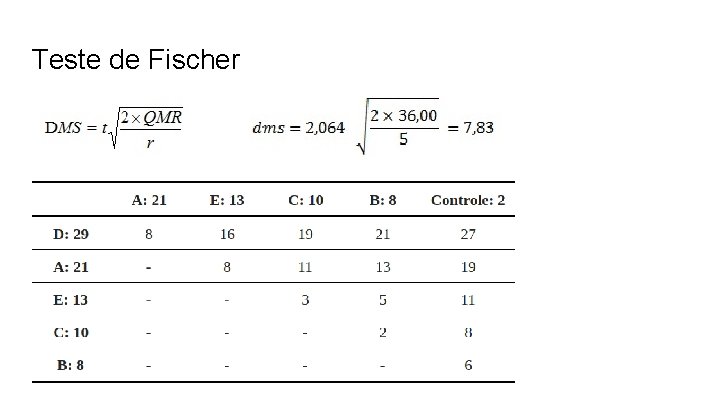

Teste de Fischer ❖ Comparar todos pares de médias; ❖ Controla a taxa de erro ao nível de significância alpha para cada comparação dois a dois; ❖ Não controla a taxa de erro do experimento. ● t é um valor associado ao nível de significância estabelecido e aos graus de liberdade do quadrado médio do resíduo da análise de variância, ; ● QME é o quadrado médio do resíduo da análise de variância; ● r é o número de repetições de grupos.

Teste de Fischer

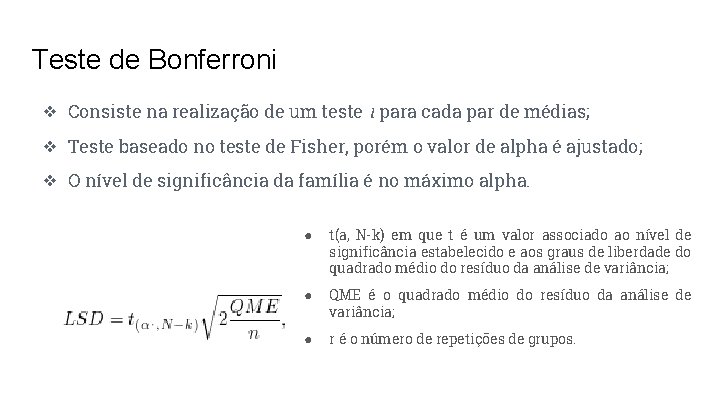

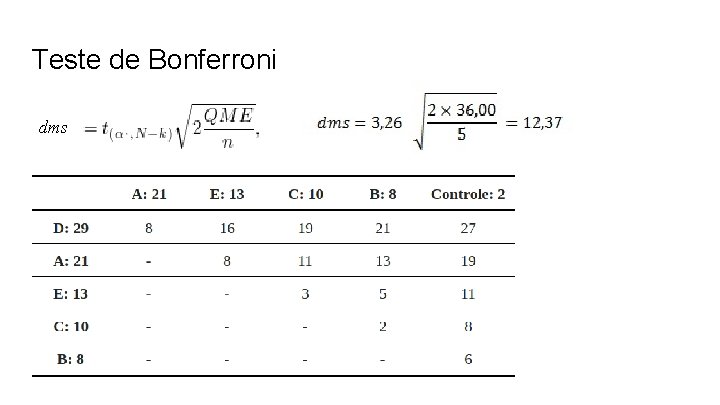

Teste de Bonferroni ❖ Consiste na realização de um teste t para cada par de médias; ❖ Teste baseado no teste de Fisher, porém o valor de alpha é ajustado; ❖ O nível de significância da família é no máximo alpha. ● t(a, N-k) em que t é um valor associado ao nível de significância estabelecido e aos graus de liberdade do quadrado médio do resíduo da análise de variância; ● QME é o quadrado médio do resíduo da análise de variância; ● r é o número de repetições de grupos.

Teste de Bonferroni dms

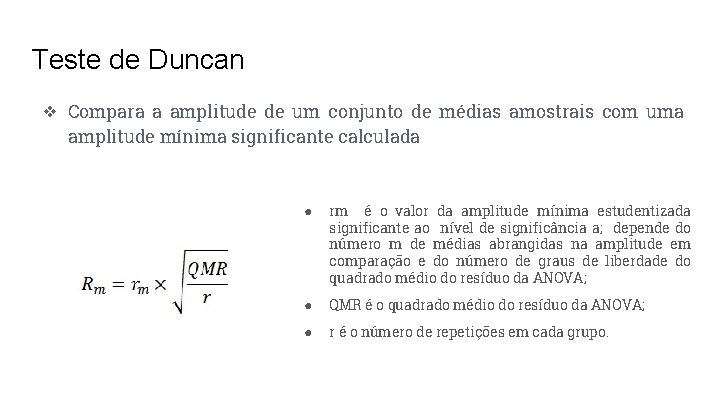

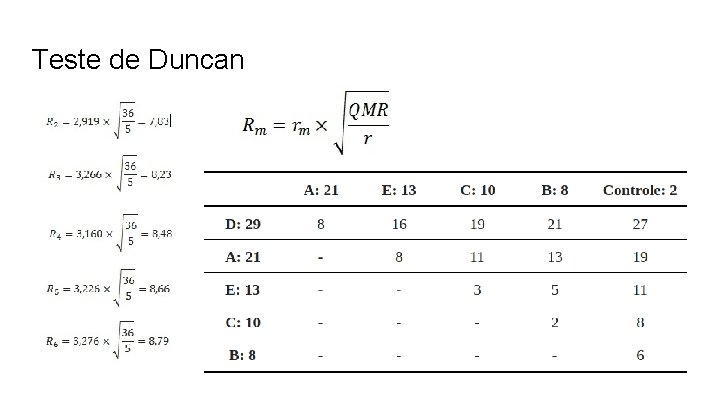

Teste de Duncan ❖ Compara a amplitude de um conjunto de médias amostrais com uma amplitude mínima significante calculada ● rm é o valor da amplitude mínima estudentizada significante ao nível de significância a; depende do número m de médias abrangidas na amplitude em comparação e do número de graus de liberdade do quadrado médio do resíduo da ANOVA; ● QMR é o quadrado médio do resíduo da ANOVA; ● r é o número de repetições em cada grupo.

Teste de Duncan

Aplicando no R

Aplicação do Teste de Tukey no R Para exemplificar o procedimento vamos analisar uma situação experimental onde uma empresa está aplicando um teste sensorial para um conjunto de 15 provadores em três marcas diferentes de chocolate. Três marcas são comparadas, sendo uma delas a referência, e o objetivo é verificar se existe diferença das marcas com o controle. Nesse experimento temos dois fatores, a marca e os provadores, e esperamos que os provadores não tenham um efeito significativo. Em cada avaliação o provador tem que determinar essa diferença em uma escala que vai de 0 a 7.

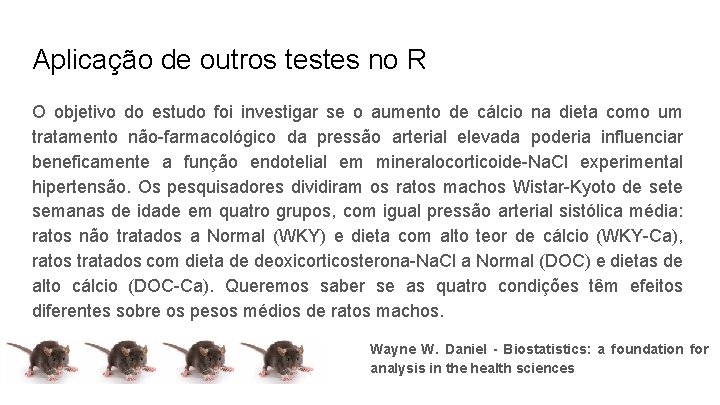

Aplicação de outros testes no R O objetivo do estudo foi investigar se o aumento de cálcio na dieta como um tratamento não-farmacológico da pressão arterial elevada poderia influenciar beneficamente a função endotelial em mineralocorticoide-Na. Cl experimental hipertensão. Os pesquisadores dividiram os ratos machos Wistar-Kyoto de sete semanas de idade em quatro grupos, com igual pressão arterial sistólica média: ratos não tratados a Normal (WKY) e dieta com alto teor de cálcio (WKY-Ca), ratos tratados com dieta de deoxicorticosterona-Na. Cl a Normal (DOC) e dietas de alto cálcio (DOC-Ca). Queremos saber se as quatro condições têm efeitos diferentes sobre os pesos médios de ratos machos. Wayne W. Daniel - Biostatistics: a foundation for analysis in the health sciences

Referências PORTNEY, L, WATKINS; M. Foundations of Clinical Research Applications To Practice. 2 a. ed. Pearson, 2000. SIDIA, M; CALEGUARI, J. Bioestatística - Princípios e Aplicações, 1 a. Ed. Artmed, 2003. Discovering Statistics Using SPSS - Third Edition. Disponível em: <https: //faculty. psau. edu. sa/filedownload/doc-6 -pdfa 46 e 10627 f 49 a 5333 cdcd 0 b 700790 f 8 b-original. pdf>. Acesso em: 11 nov. 2019. One-Way ANOVA Post Hoc Tests. Disponível em: <https: //www. ibm. com/support/knowledgecenter/SSLVMB_24. 0. 0/spss/base/idh_onew_post. html>. Acesso em: 11 nov. 2019. POSTHOC Subcommand (ONEWAY command). Disponível em: <https: //www. ibm. com/support/knowledgecenter/SSLVMB_24. 0. 0/spss/base/syn_oneway_n 102 a 3. html>. Acesso em: 11 nov. 2019. Post-Hoc Definition and Types of Post Hoc Tests. Disponível em: <https: //www. statisticshowto. datasciencecentral. com/post-hoc>. Acesso em: 11 nov. 2019. Teste de Tukey Para Comparações Múltiplas. Disponível em: <https: //operdata. com. br/blog/comparacoes-multiplas-teste-de-tukey/>. Acesso em: 11 nov. 2019.

Referências Teste de Tukey Para Comparações de Médias. Disponível em: <http: //soniavieira. blogspot. com/2016/06/paraproceder-ao-teste-detukey-e. htm>. Acesso em: 11 nov. 2019. Teste de Comparações Múltiplas. Disponível em: <http: //www. portalaction. com. br/anova/teste-de-comparacoes-multiplas>. Acesso em: 11 nov. 2019. Using Post Hoc Tests with ANOVA. Disponível em: <https: //statisticsbyjim. com/anova/post-hoc-tests-anova/>. Acesso em: 11 nov. 2019 Anova e Teste de Tukey no R. Disponível em: <https: //www. rmining. com. br/2013/06/10/anova-e-teste-de-tukey-no-r/index. html>. Acesso em: 11 nov. 2019. Outros exemplos de Testes Post Hoc no R. Disponível em: <http: //www. uel. br/pessoal/silvano/Experimental/R/Inteiramente%20 Casualizado/Exe_9%20 -%20 Peso_Ratos. R>. Acesso em: 11 nov. 2019.

Obrigado(a)!

- Slides: 41