Synthse dimages 2006 2007 Antoine Bouthors Antoine Bouthorsimag

Synthèse d’images 2006 -2007 Antoine Bouthors Antoine. Bouthors@imag. fr http: //www-evasion. imag. fr/Membres/Antoine. Bouthors/teaching/ensimag/ Credits : Joëlle Thollot, Hector Briceño, Edmond Boyer

Qu’est-ce que la synthèse d’images ? 2

Pourquoi la synthèse d’images ? • • Effets spéciaux pour le cinéma Dessins animés Jeux vidéo CAO Simulateurs Réalité virtuelle Visualisation, imagerie médicale 3

Ce que vous apprendrez • • Fondements de la synthèse d’images Grands thèmes de la synthèse d’images Vocabulaire complet Capacité de créer des images de synthèse avec • Capacité de reproduire n’importe quelle image de synthèse (moyennant pas mal de temps) 4

Ce que vous n’apprendrez pas • Les détails • L’utilisation de logiciel de synthèse d’images (Catia, 3 DS, Maya, Photoshop) • La conception artistique 5

Plan du cours • Cours 1, 2 : le pipeline graphique • Cours 3 : GPU • Cours 4, 5, 6 : rendu temps-réel – – Calcul des ombres Niveaux de détails Image-based rendering Visibilité • Cours 7 : illumination globale 6

Plan • • Historique Pipeline graphique Transformations Image, couleur Rasterisation Visibilité Illumination 7

Plan • • Historique Pipeline graphique Transformations Image, couleur Rasterisation Visibilité Illumination 8

Lignes 2 D 9

Image 2 D 10

Lignes 3 D 11

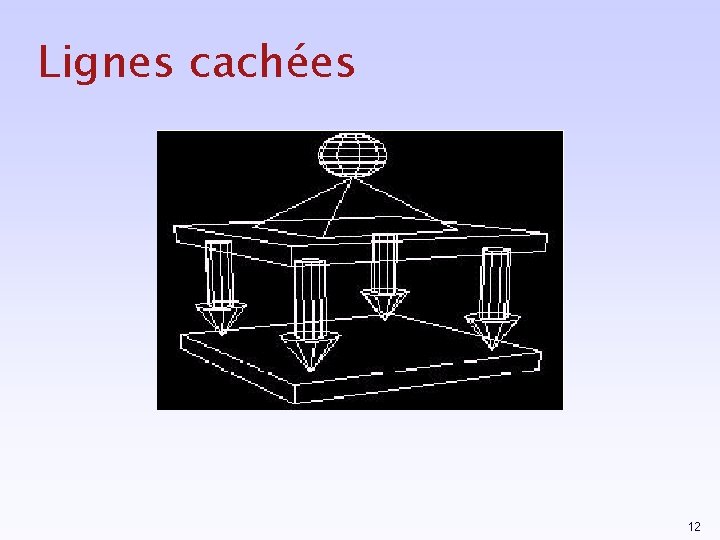

Lignes cachées 12

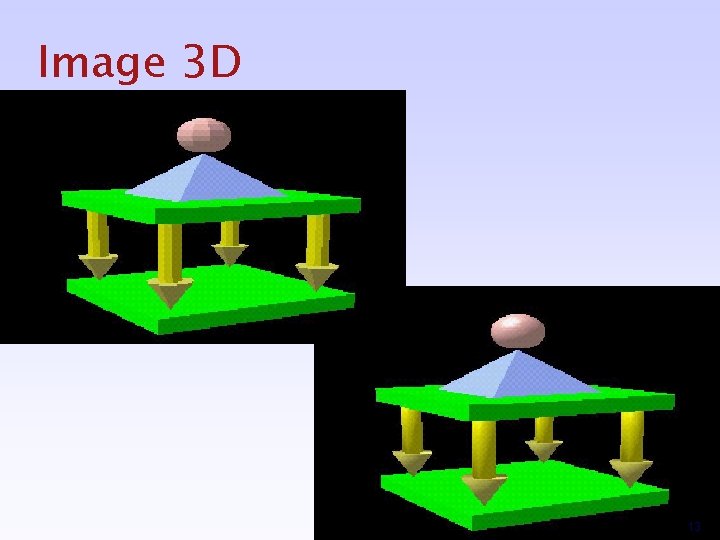

Image 3 D 13

Photo-réalisme 14

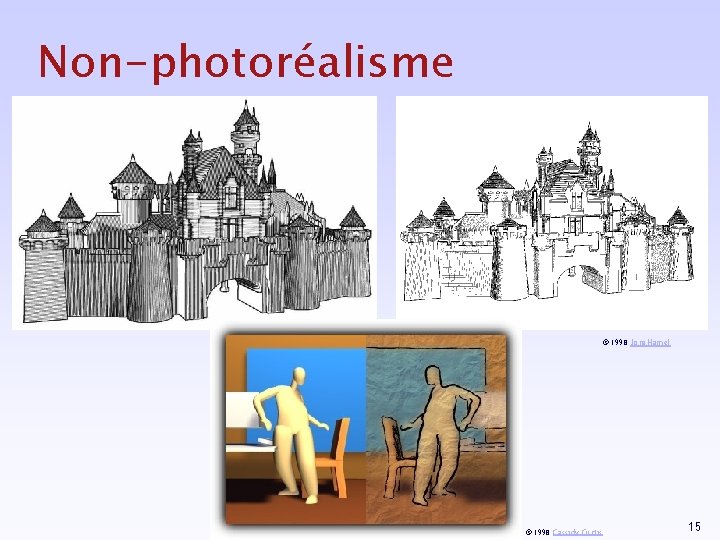

Non-photoréalisme © 1998 Jörg Hamel © 1998 Cassidy Curtis 15

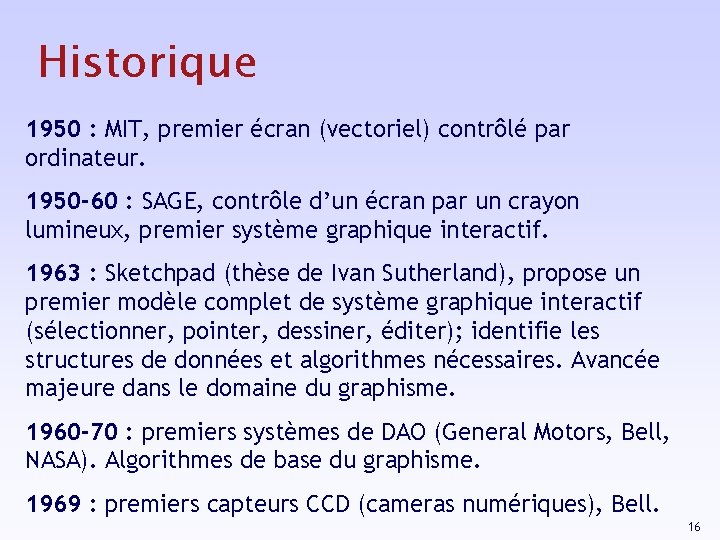

Historique 1950 : MIT, premier écran (vectoriel) contrôlé par ordinateur. 1950 -60 : SAGE, contrôle d’un écran par un crayon lumineux, premier système graphique interactif. 1963 : Sketchpad (thèse de Ivan Sutherland), propose un premier modèle complet de système graphique interactif (sélectionner, pointer, dessiner, éditer); identifie les structures de données et algorithmes nécessaires. Avancée majeure dans le domaine du graphisme. 1960 -70 : premiers systèmes de DAO (General Motors, Bell, NASA). Algorithmes de base du graphisme. 1969 : premiers capteurs CCD (cameras numériques), Bell. 16

1970 : premier terminal graphique a bas prix (Tektronix). ADIS graphics package : possibilité de lire/écrire un pixel, dessiner une ligne, déplacer des portions de l’image, la sortie étant dirigée sur des zones rectangulaires appelées fenêtres. 1970 -80 : barrière économique dépassée, mémoires et écrans peu chers sont disponibles, écrans matriciels, apparition de la couleur, cartes d’extensions graphiques (Apple II). Algorithmes de traitements d’images, premiers algorithmes de vision artificielle. 1980 -90 : premières interfaces graphiques (macintosh). Photo-réalisme (lancer de rayons, radiosité). Animations. 1984 : le langage Post. Script. 1990 -… : systèmes 3 D interactifs, algorithmes câblés, librairie graphique Open. GL, cameras CCD peu chères, développement de la vision artificielle. Réalité virtuelle. 17

Plan • • Historique Pipeline graphique Transformations Image, couleur Rasterisation Visibilité Illumination 18

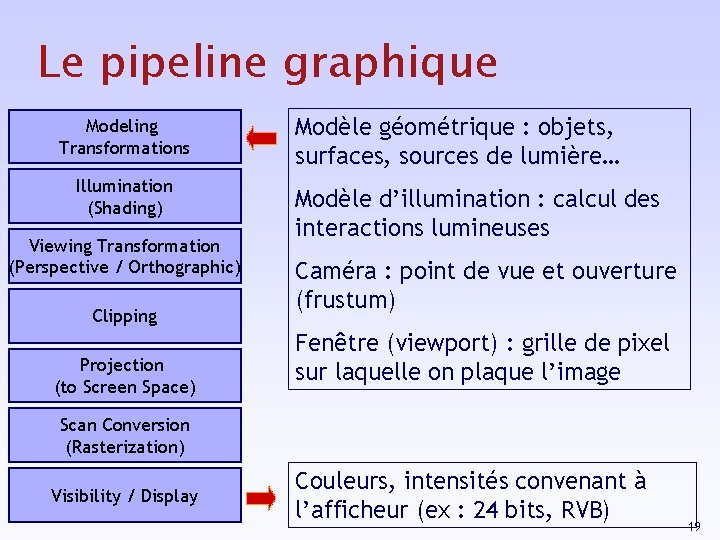

Le pipeline graphique Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Clipping Projection (to Screen Space) Modèle géométrique : objets, surfaces, sources de lumière… Modèle d’illumination : calcul des interactions lumineuses Caméra : point de vue et ouverture (frustum) Fenêtre (viewport) : grille de pixel sur laquelle on plaque l’image Scan Conversion (Rasterization) Visibility / Display Couleurs, intensités convenant à l’afficheur (ex : 24 bits, RVB) 19

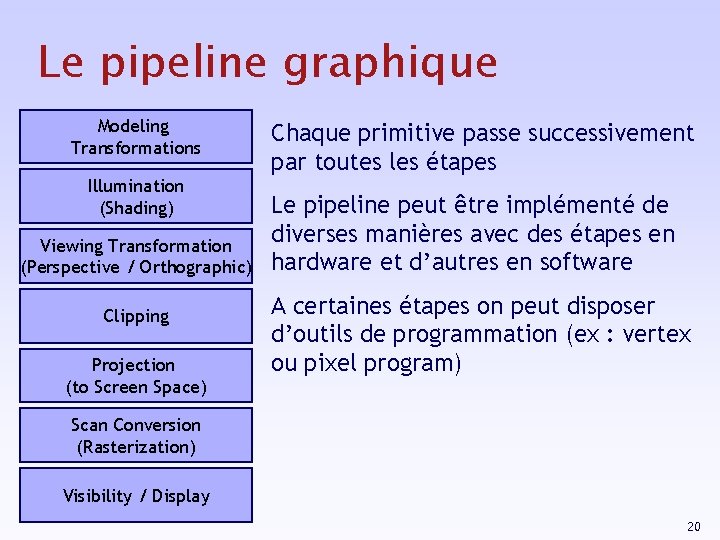

Le pipeline graphique Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Clipping Projection (to Screen Space) Chaque primitive passe successivement par toutes les étapes Le pipeline peut être implémenté de diverses manières avec des étapes en hardware et d’autres en software A certaines étapes on peut disposer d’outils de programmation (ex : vertex ou pixel program) Scan Conversion (Rasterization) Visibility / Display 20

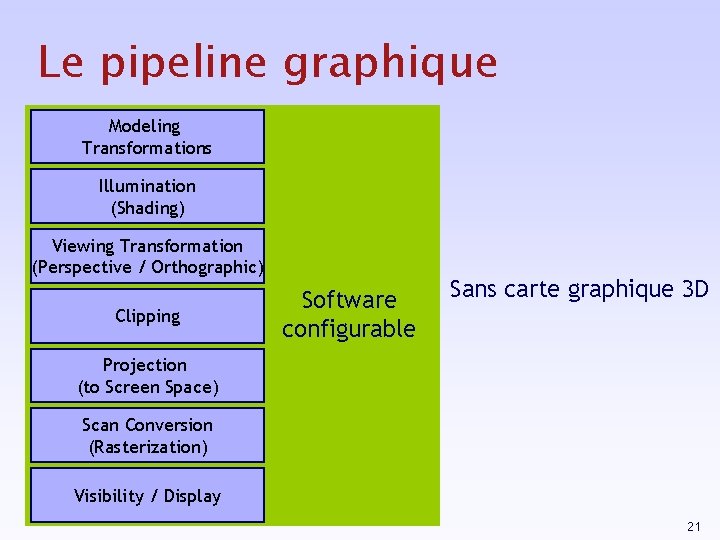

Le pipeline graphique Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Clipping Software configurable Sans carte graphique 3 D Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 21

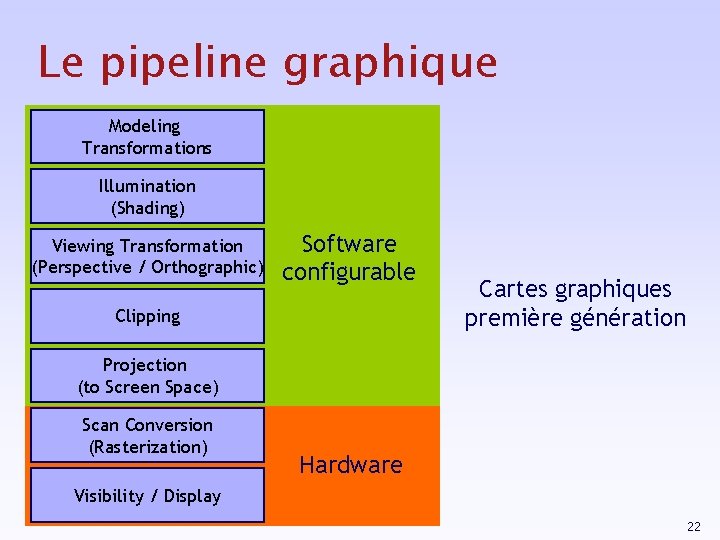

Le pipeline graphique Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Software configurable Clipping Cartes graphiques première génération Projection (to Screen Space) Scan Conversion (Rasterization) Hardware Visibility / Display 22

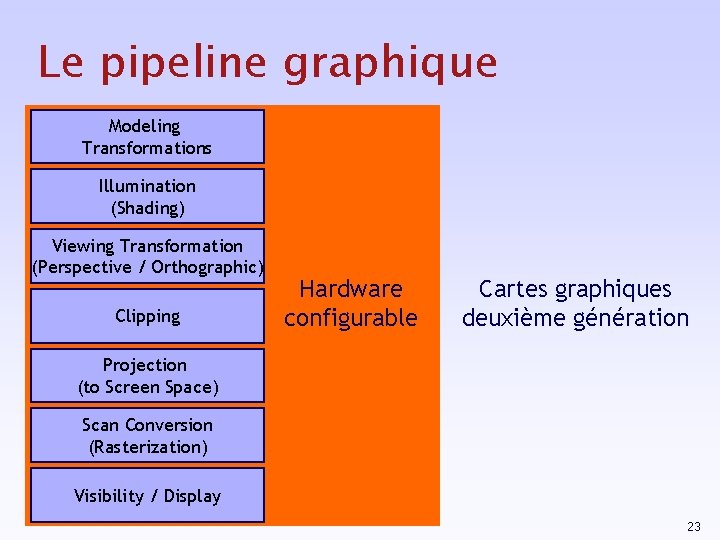

Le pipeline graphique Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Clipping Hardware configurable Cartes graphiques deuxième génération Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 23

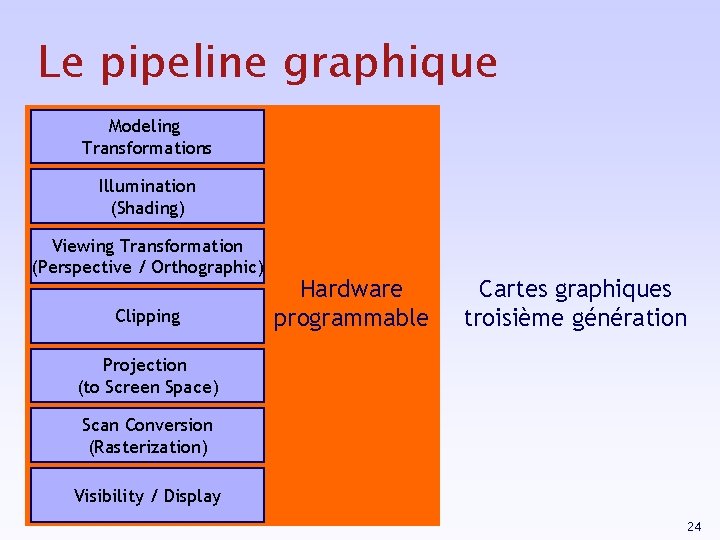

Le pipeline graphique Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Clipping Hardware programmable Cartes graphiques troisième génération Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 24

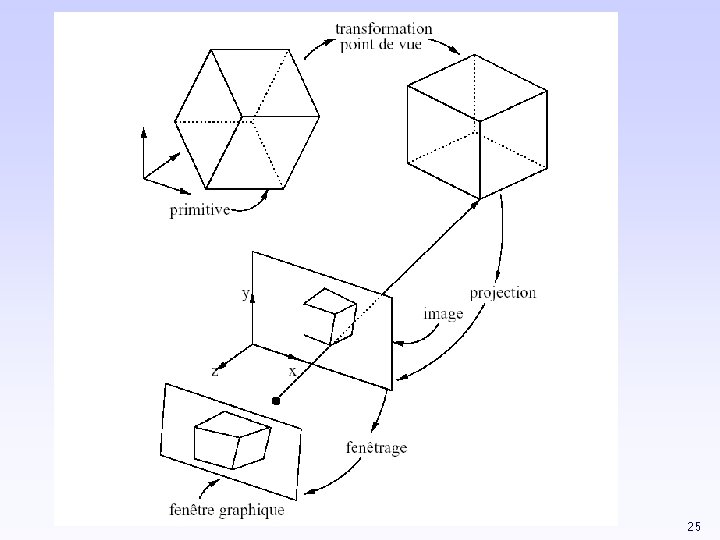

25

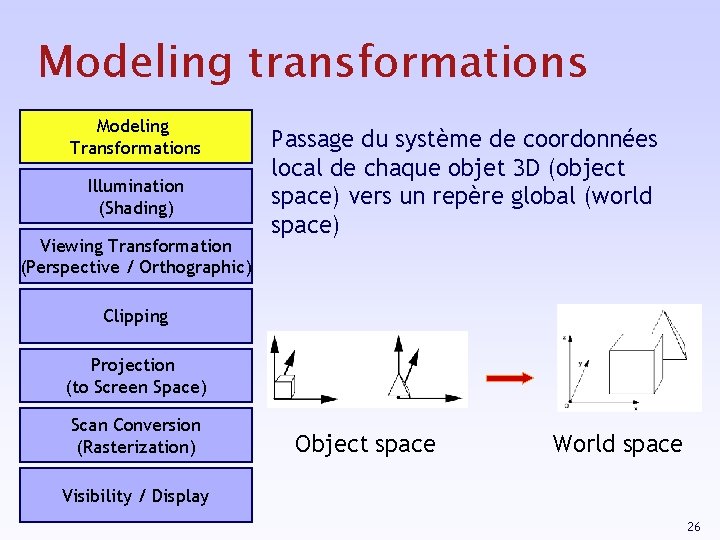

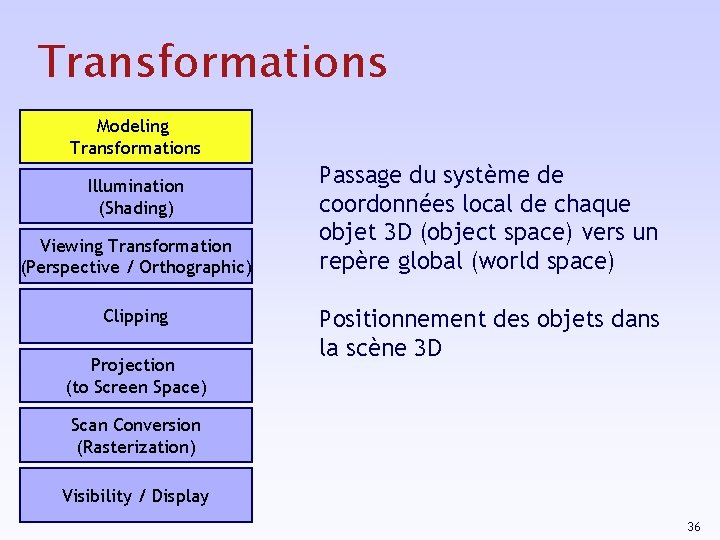

Modeling transformations Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Passage du système de coordonnées local de chaque objet 3 D (object space) vers un repère global (world space) Clipping Projection (to Screen Space) Scan Conversion (Rasterization) Object space World space Visibility / Display 26

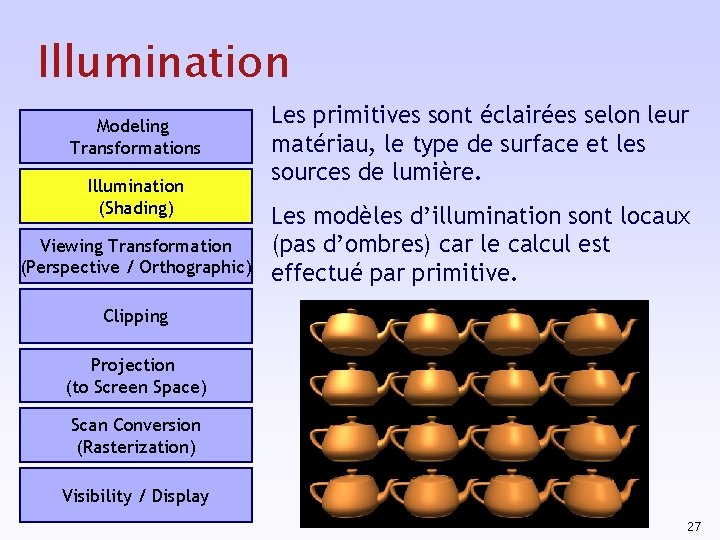

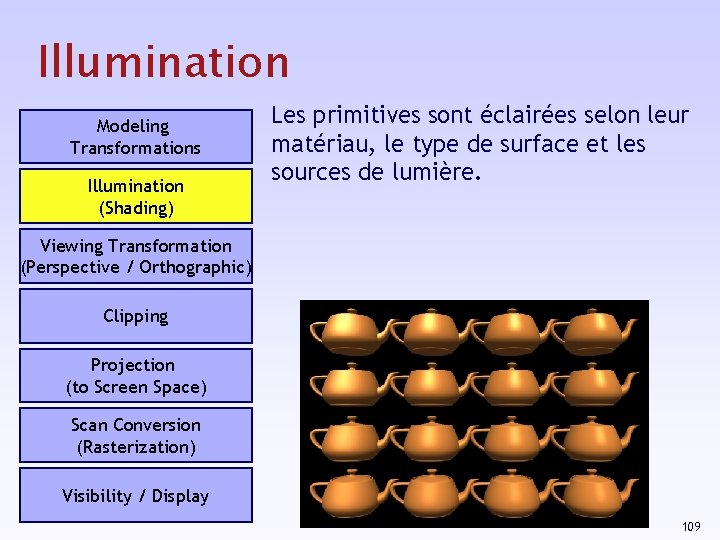

Illumination Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Les primitives sont éclairées selon leur matériau, le type de surface et les sources de lumière. Les modèles d’illumination sont locaux (pas d’ombres) car le calcul est effectué par primitive. Clipping Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 27

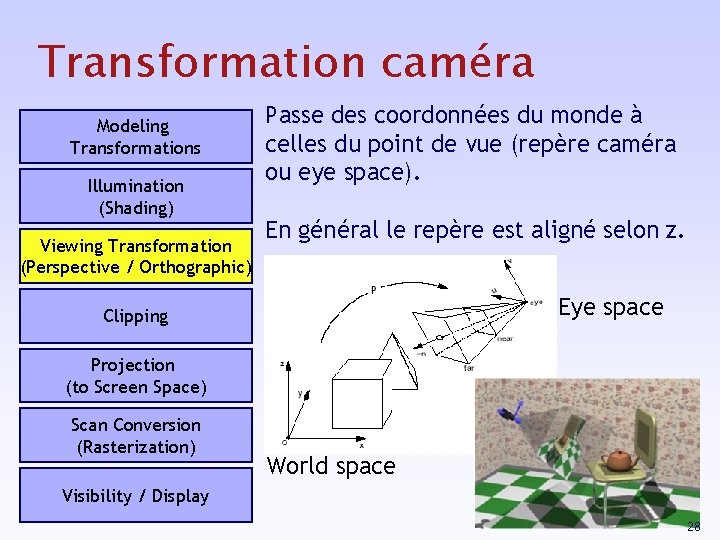

Transformation caméra Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Passe des coordonnées du monde à celles du point de vue (repère caméra ou eye space). En général le repère est aligné selon z. Eye space Clipping Projection (to Screen Space) Scan Conversion (Rasterization) World space Visibility / Display 28

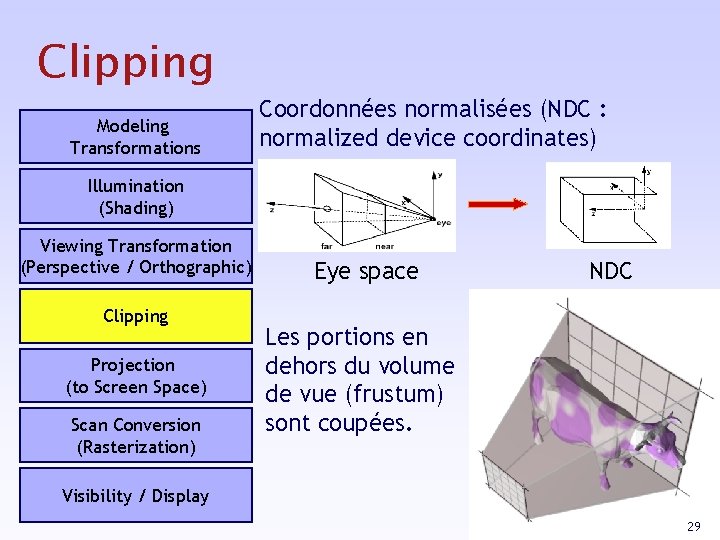

Clipping Modeling Transformations Coordonnées normalisées (NDC : normalized device coordinates) Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Clipping Projection (to Screen Space) Scan Conversion (Rasterization) Eye space NDC Les portions en dehors du volume de vue (frustum) sont coupées. Visibility / Display 29

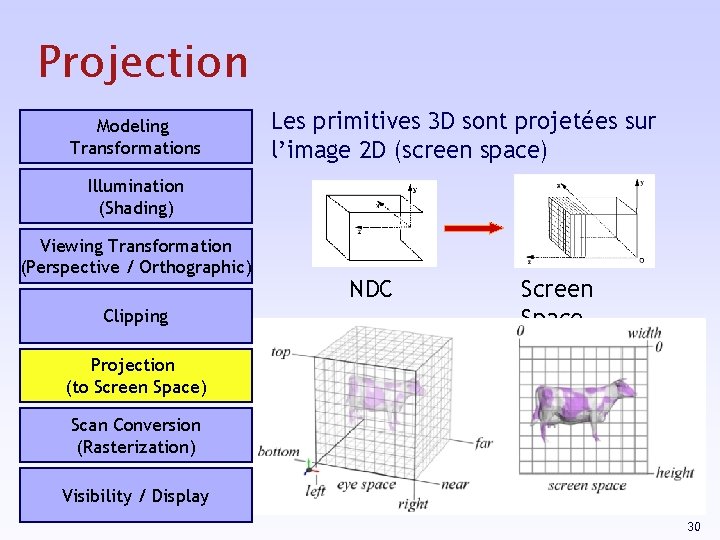

Projection Modeling Transformations Les primitives 3 D sont projetées sur l’image 2 D (screen space) Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Clipping NDC Screen Space Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 30

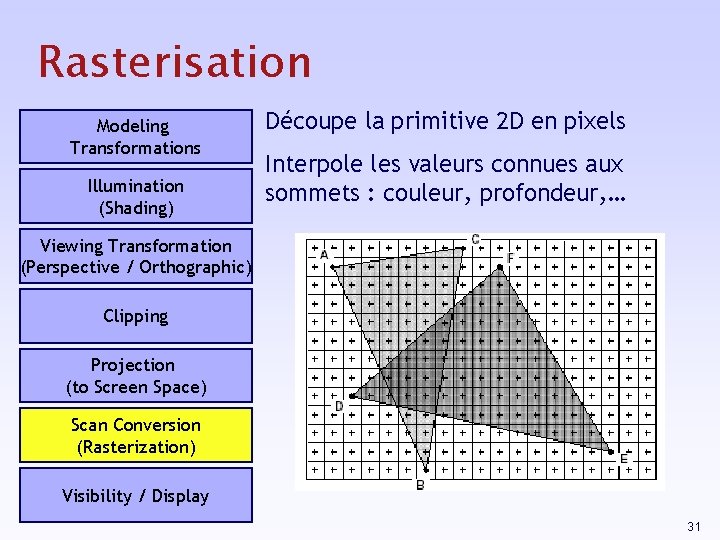

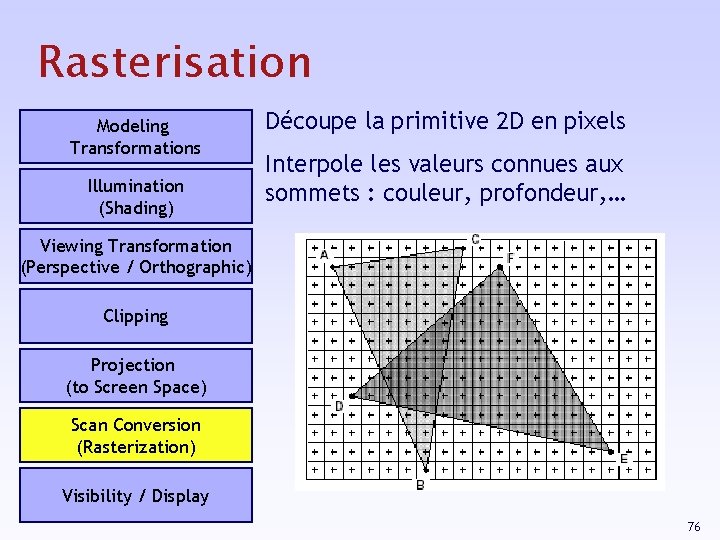

Rasterisation Modeling Transformations Illumination (Shading) Découpe la primitive 2 D en pixels Interpole les valeurs connues aux sommets : couleur, profondeur, … Viewing Transformation (Perspective / Orthographic) Clipping Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 31

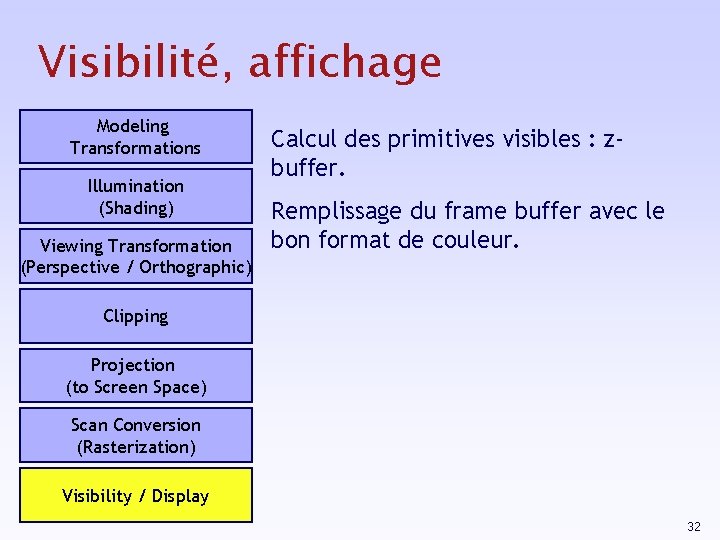

Visibilité, affichage Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Calcul des primitives visibles : zbuffer. Remplissage du frame buffer avec le bon format de couleur. Clipping Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 32

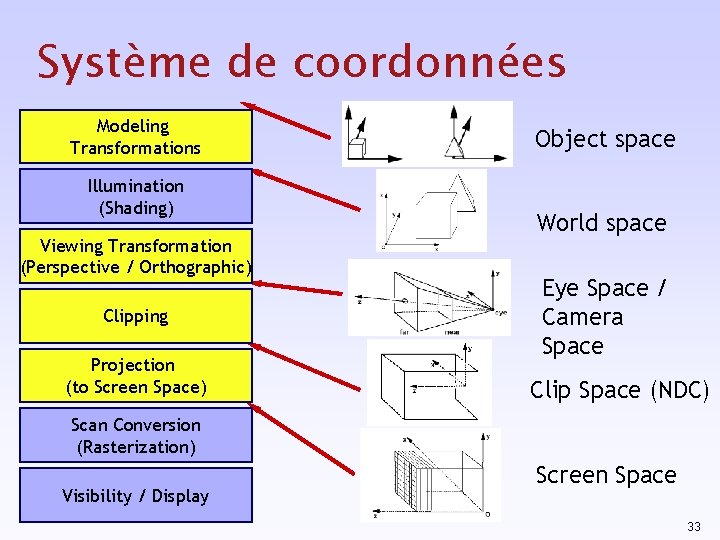

Système de coordonnées Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Clipping Projection (to Screen Space) Object space World space Eye Space / Camera Space Clip Space (NDC) Scan Conversion (Rasterization) Visibility / Display Screen Space 33

Plan • • Historique Pipeline graphique Transformations Image, couleur Rasterisation Visibilité Illumination 34

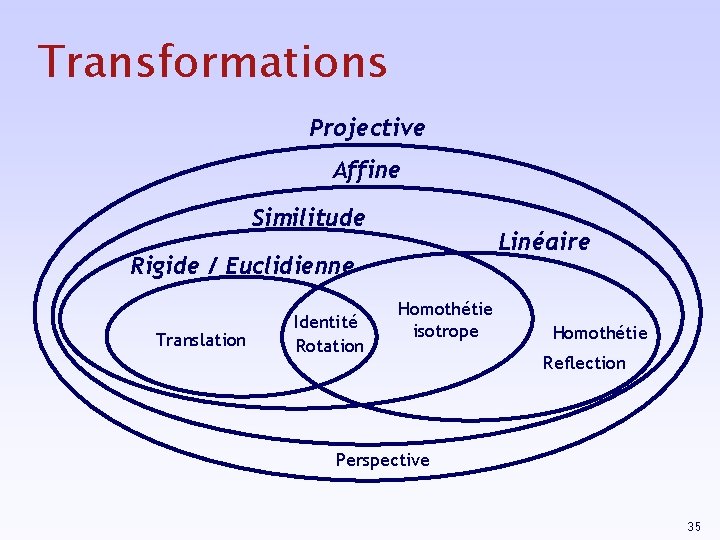

Transformations Projective Affine Similitude Linéaire Rigide / Euclidienne Translation Identité Rotation Homothétie isotrope Homothétie Reflection Perspective 35

Transformations Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Clipping Projection (to Screen Space) Passage du système de coordonnées local de chaque objet 3 D (object space) vers un repère global (world space) Positionnement des objets dans la scène 3 D Scan Conversion (Rasterization) Visibility / Display 36

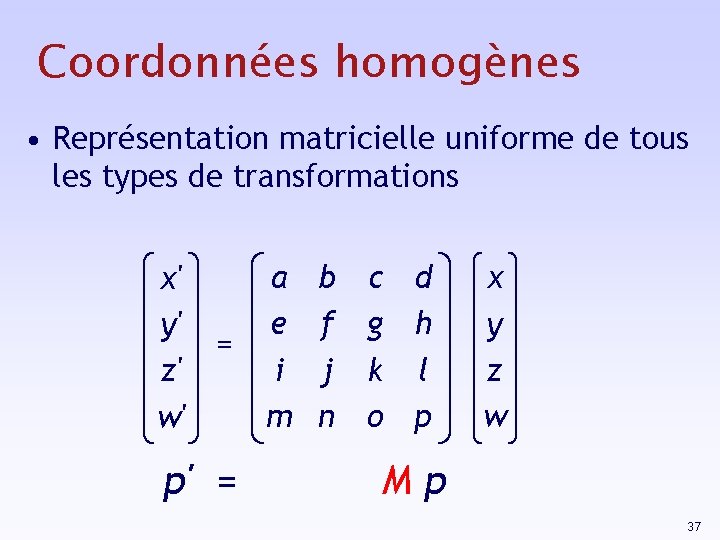

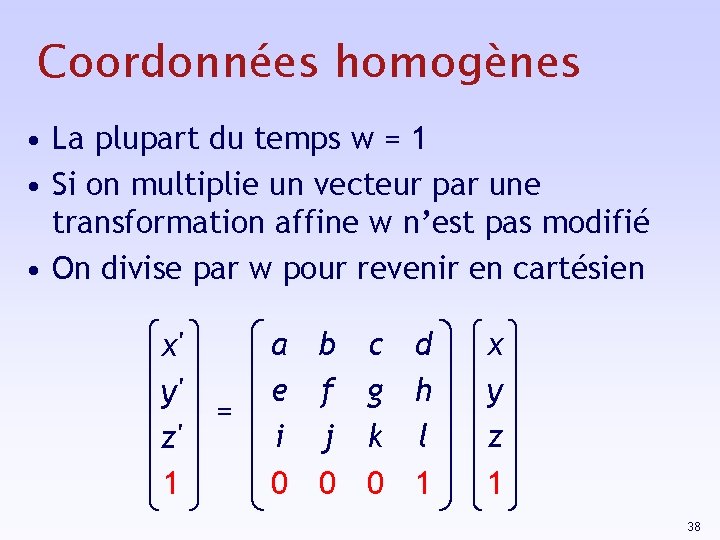

Coordonnées homogènes • Représentation matricielle uniforme de tous les types de transformations x' y' = z' w' p' = a e i m b f j n c d g h k l o p x y z w Mp 37

Coordonnées homogènes • La plupart du temps w = 1 • Si on multiplie un vecteur par une transformation affine w n’est pas modifié • On divise par w pour revenir en cartésien x' y' z' 1 = a b c d e f g h i j k l 0 0 0 1 x y z 1 38

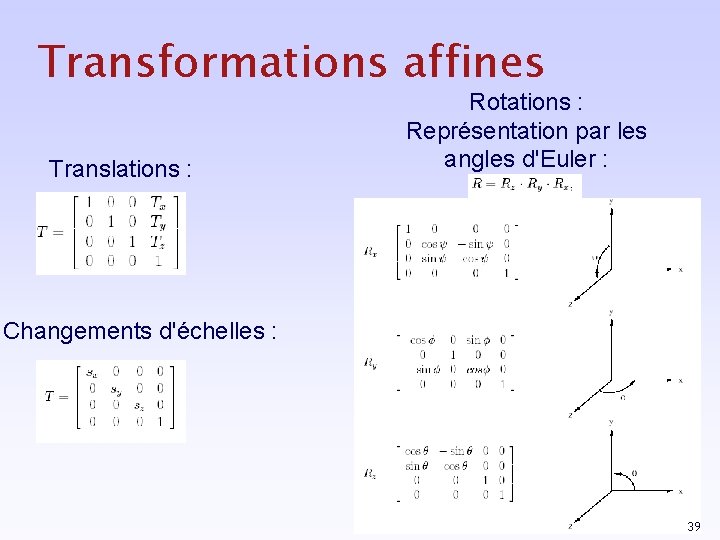

Transformations affines Translations : Rotations : Représentation par les angles d'Euler : Changements d'échelles : 39

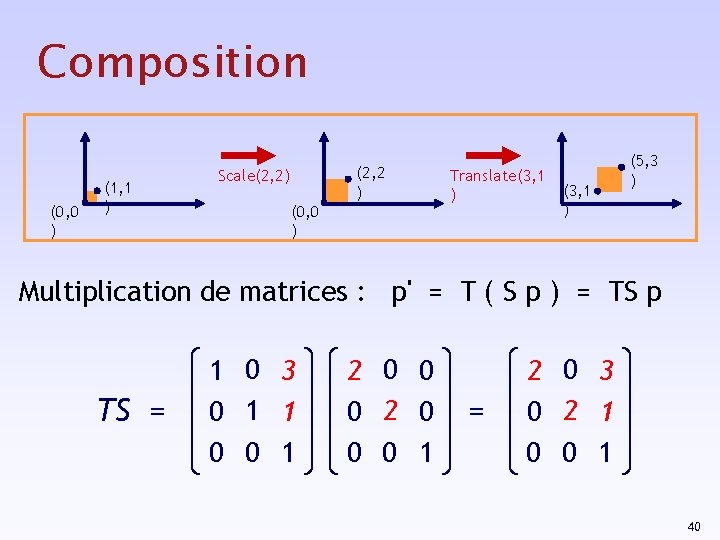

Composition (0, 0 ) (1, 1 ) (2, 2 ) Scale(2, 2) (0, 0 ) Translate(3, 1 ) (5, 3 ) Multiplication de matrices : p' = T ( S p ) = TS p TS = 1 0 3 0 1 1 0 0 1 2 0 0 0 1 = 2 0 3 0 2 1 0 0 1 40

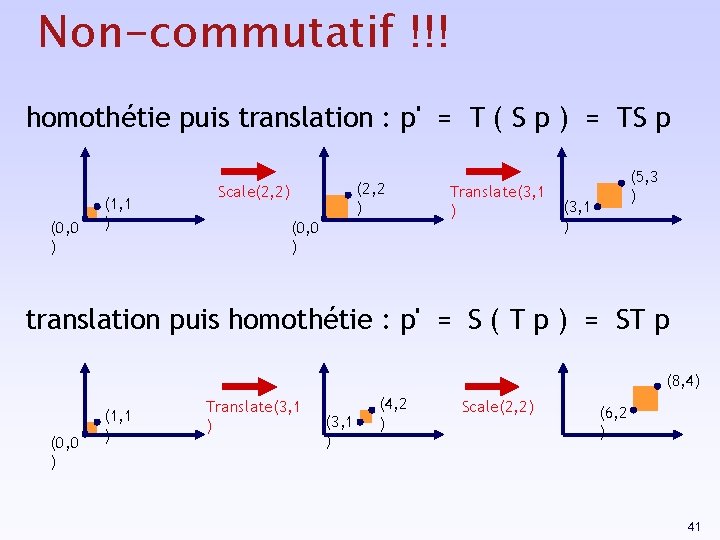

Non-commutatif !!! homothétie puis translation : p' = T ( S p ) = TS p (0, 0 ) (1, 1 ) (2, 2 ) Scale(2, 2) (0, 0 ) Translate(3, 1 ) (5, 3 ) (3, 1 ) translation puis homothétie : p' = S ( T p ) = ST p (8, 4) (0, 0 ) (1, 1 ) Translate(3, 1 ) (4, 2 ) Scale(2, 2) (6, 2 ) 41

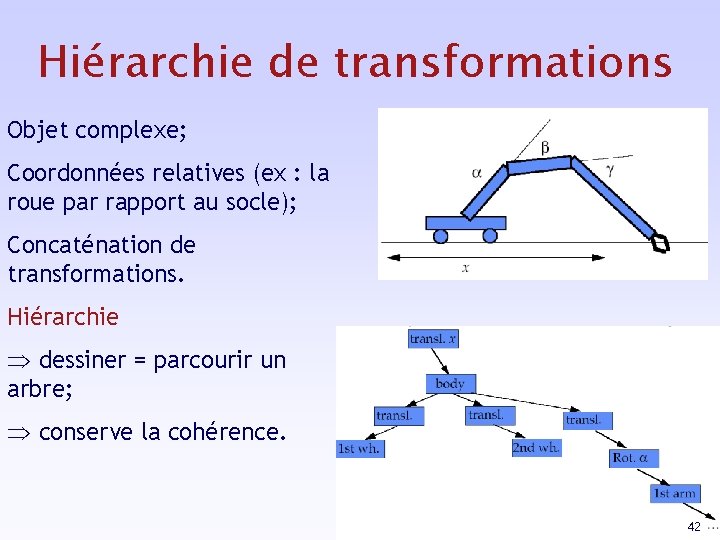

Hiérarchie de transformations Objet complexe; Coordonnées relatives (ex : la roue par rapport au socle); Concaténation de transformations. Hiérarchie Þ dessiner = parcourir un arbre; Þ conserve la cohérence. 42

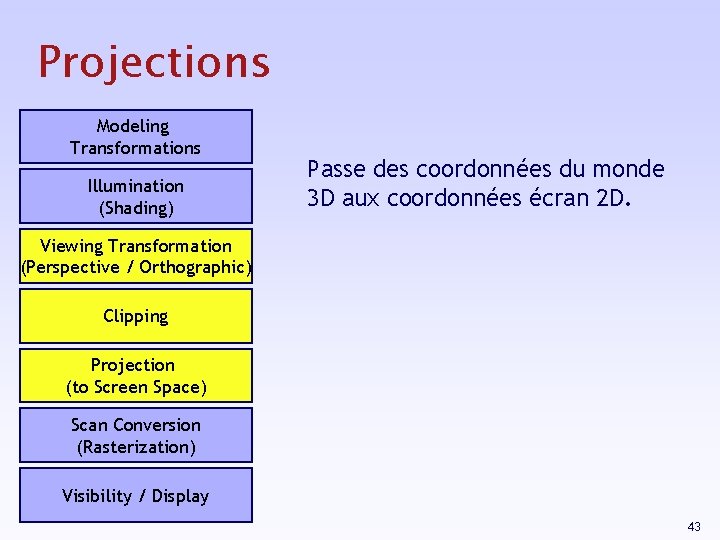

Projections Modeling Transformations Illumination (Shading) Passe des coordonnées du monde 3 D aux coordonnées écran 2 D. Viewing Transformation (Perspective / Orthographic) Clipping Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 43

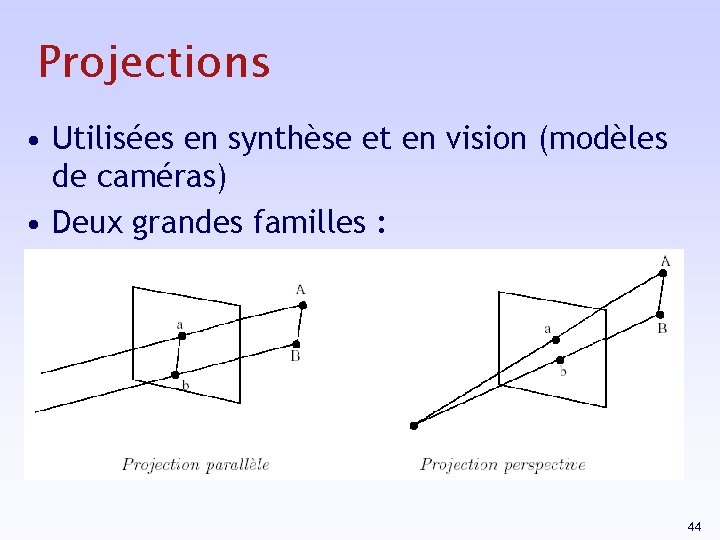

Projections • Utilisées en synthèse et en vision (modèles de caméras) • Deux grandes familles : 44

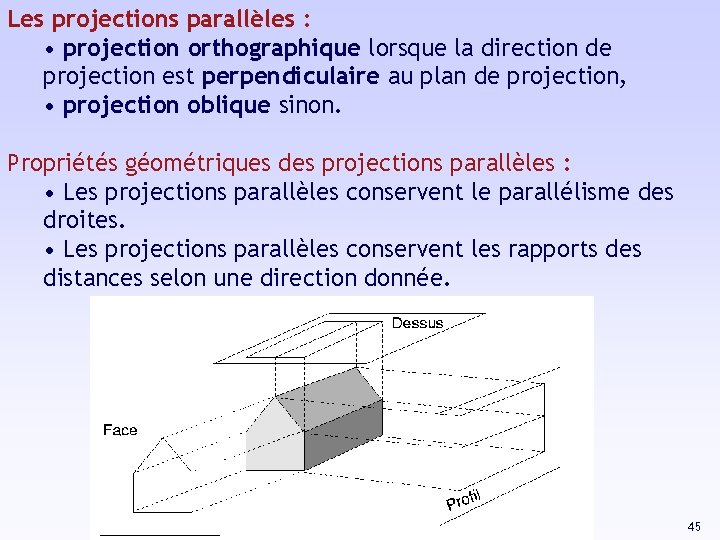

Les projections parallèles : • projection orthographique lorsque la direction de projection est perpendiculaire au plan de projection, • projection oblique sinon. Propriétés géométriques des projections parallèles : • Les projections parallèles conservent le parallélisme des droites. • Les projections parallèles conservent les rapports des distances selon une direction donnée. 45

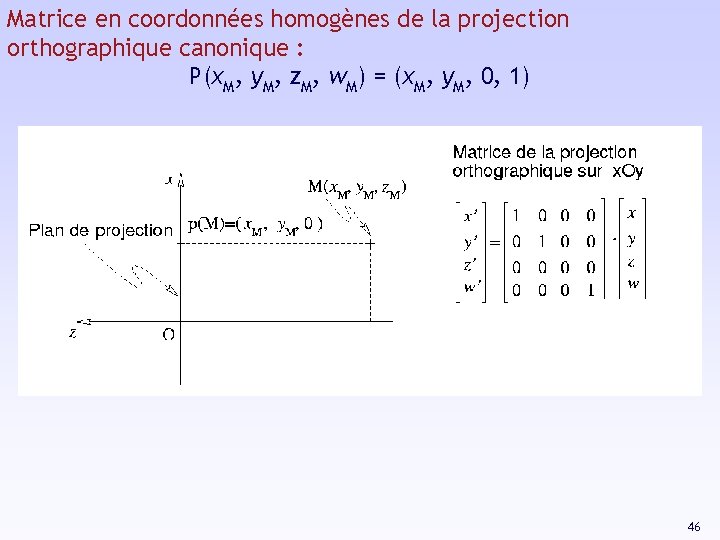

Matrice en coordonnées homogènes de la projection orthographique canonique : P(x. M, y. M, z. M, w. M) = (x. M, y. M, 0, 1) 46

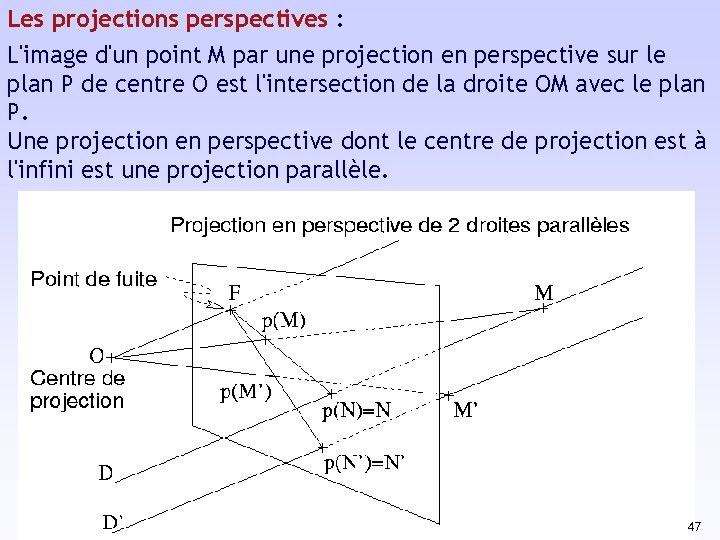

Les projections perspectives : L'image d'un point M par une projection en perspective sur le plan P de centre O est l'intersection de la droite OM avec le plan P. Une projection en perspective dont le centre de projection est à l'infini est une projection parallèle. 47

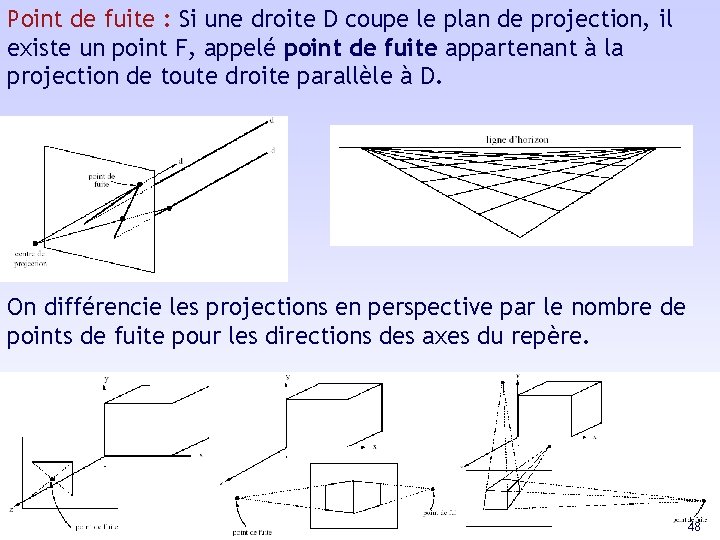

Point de fuite : Si une droite D coupe le plan de projection, il existe un point F, appelé point de fuite appartenant à la projection de toute droite parallèle à D. On différencie les projections en perspective par le nombre de points de fuite pour les directions des axes du repère. 48

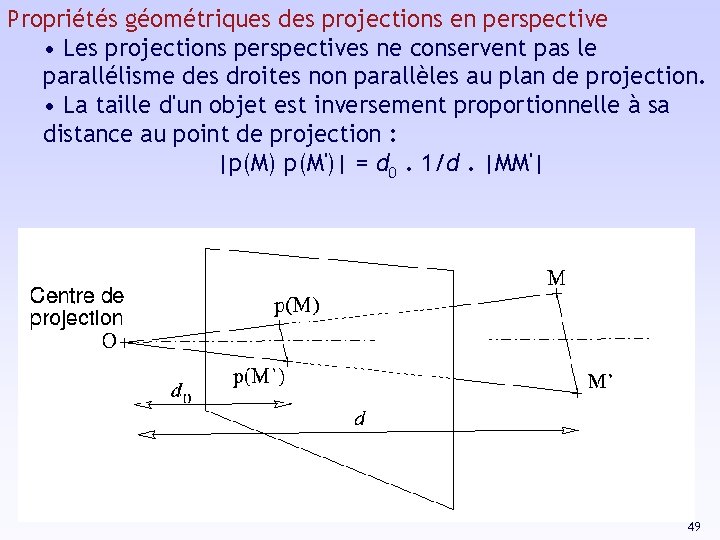

Propriétés géométriques des projections en perspective • Les projections perspectives ne conservent pas le parallélisme des droites non parallèles au plan de projection. • La taille d'un objet est inversement proportionnelle à sa distance au point de projection : |p(M) p(M')| = d 0. 1/d. |MM'| 49

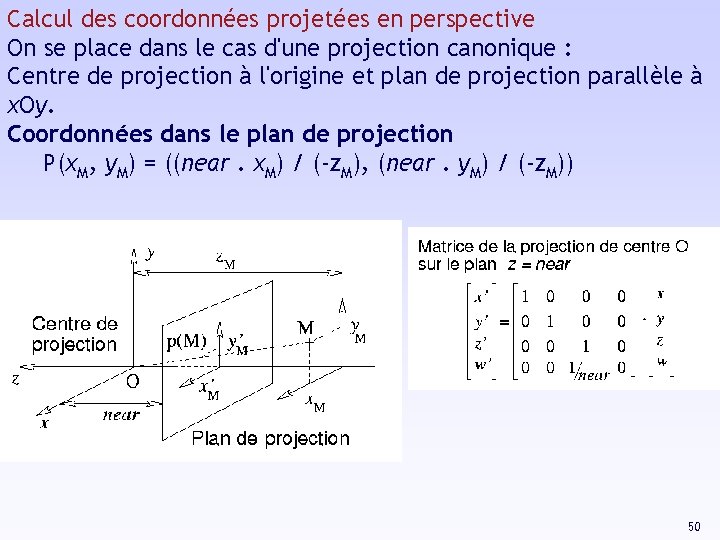

Calcul des coordonnées projetées en perspective On se place dans le cas d'une projection canonique : Centre de projection à l'origine et plan de projection parallèle à x. Oy. Coordonnées dans le plan de projection P(x. M, y. M) = ((near. x. M) / (-z. M), (near. y. M) / (-z. M)) 50

Plan • • Historique Pipeline graphique Transformations Image, couleur Rasterisation Visibilité Illumination 51

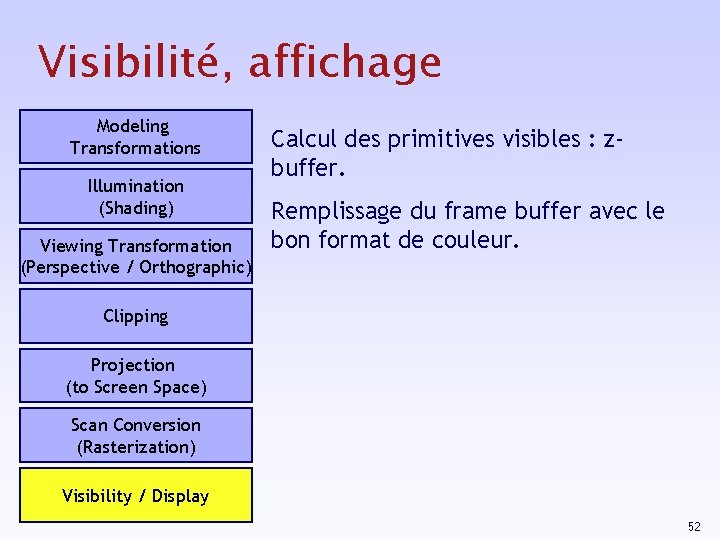

Visibilité, affichage Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Calcul des primitives visibles : zbuffer. Remplissage du frame buffer avec le bon format de couleur. Clipping Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 52

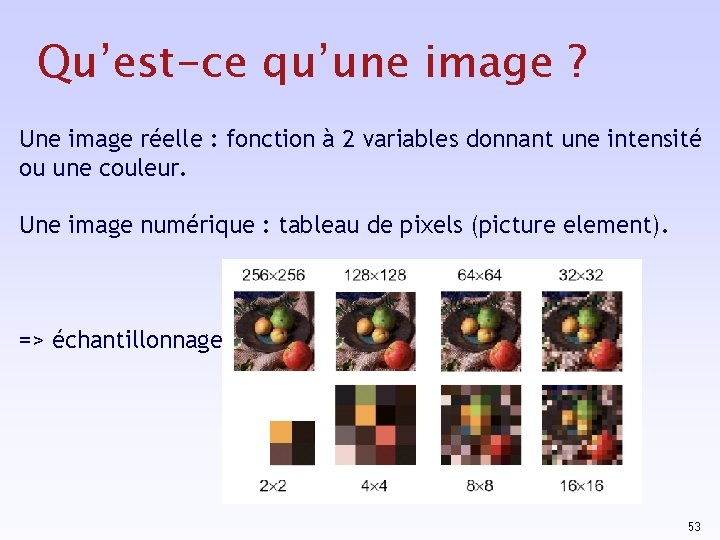

Qu’est-ce qu’une image ? Une image réelle : fonction à 2 variables donnant une intensité ou une couleur. Une image numérique : tableau de pixels (picture element). => échantillonnage 53

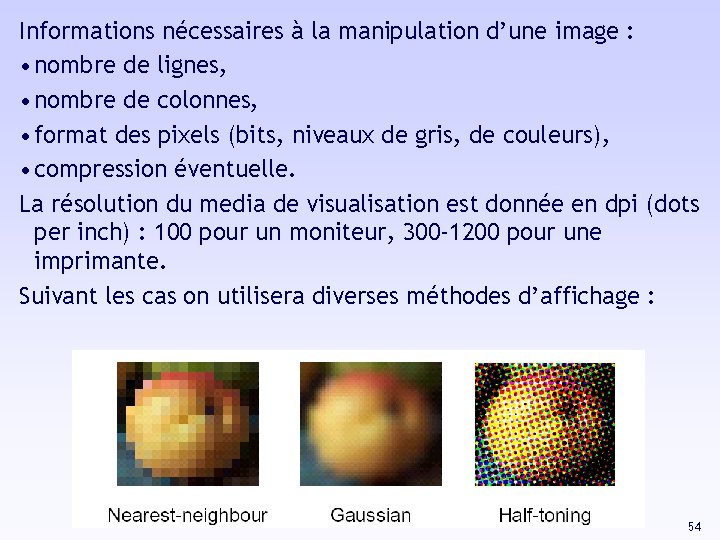

Informations nécessaires à la manipulation d’une image : • nombre de lignes, • nombre de colonnes, • format des pixels (bits, niveaux de gris, de couleurs), • compression éventuelle. La résolution du media de visualisation est donnée en dpi (dots per inch) : 100 pour un moniteur, 300 -1200 pour une imprimante. Suivant les cas on utilisera diverses méthodes d’affichage : 54

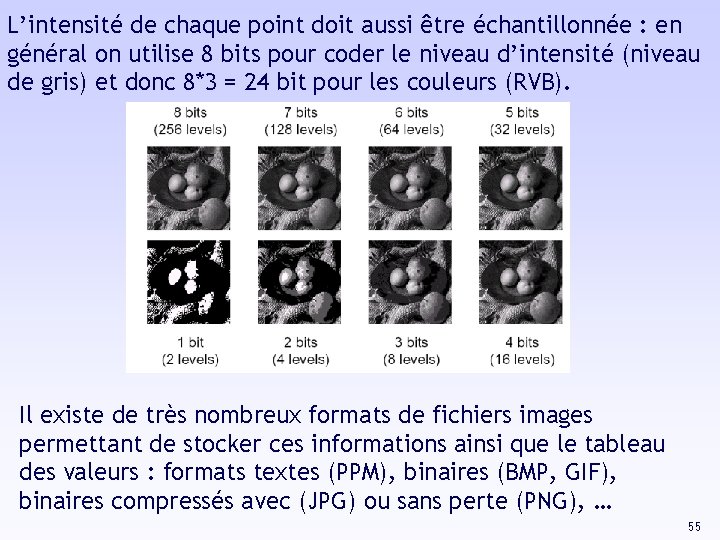

L’intensité de chaque point doit aussi être échantillonnée : en général on utilise 8 bits pour coder le niveau d’intensité (niveau de gris) et donc 8*3 = 24 bit pour les couleurs (RVB). Il existe de très nombreux formats de fichiers images permettant de stocker ces informations ainsi que le tableau des valeurs : formats textes (PPM), binaires (BMP, GIF), binaires compressés avec (JPG) ou sans perte (PNG), … 55

Le « frame buffer » Partie de la mémoire réservée à l’affichage (Vidéo RAM). Double buffer pour permettre un affichage plus fluide : on affiche un des buffer pendant que l’on met l’autre à jour. Quadruple buffer pour faire de la stéréo en double buffer : deux buffer par œil. 56

Qu’est-ce-que la couleur ? • Qu’est-ce qu’une couleur ? Définitions – Artistiques • Teinte, saturation, luminance – Physiques/biologiques • Spectre, stimulus • Fonctions de base universelles • Espaces perceptuellement uniformes – Informatiques • RGB, CMYK, HSV… 57

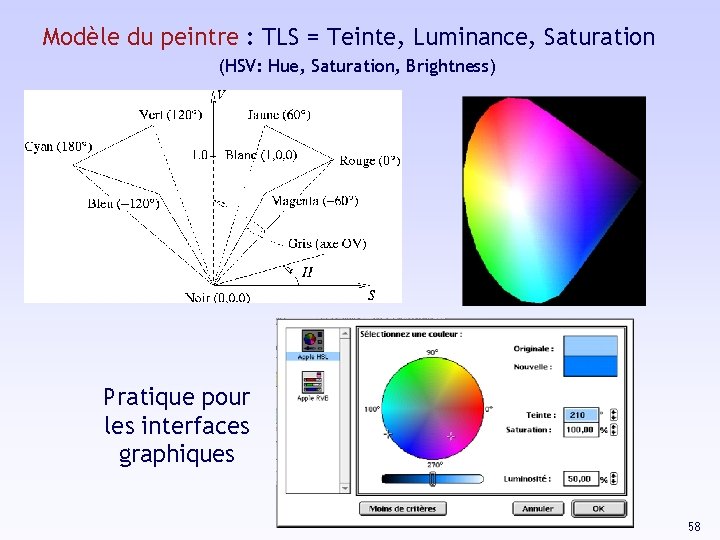

Modèle du peintre : TLS = Teinte, Luminance, Saturation (HSV: Hue, Saturation, Brightness) Pratique pour les interfaces graphiques 58

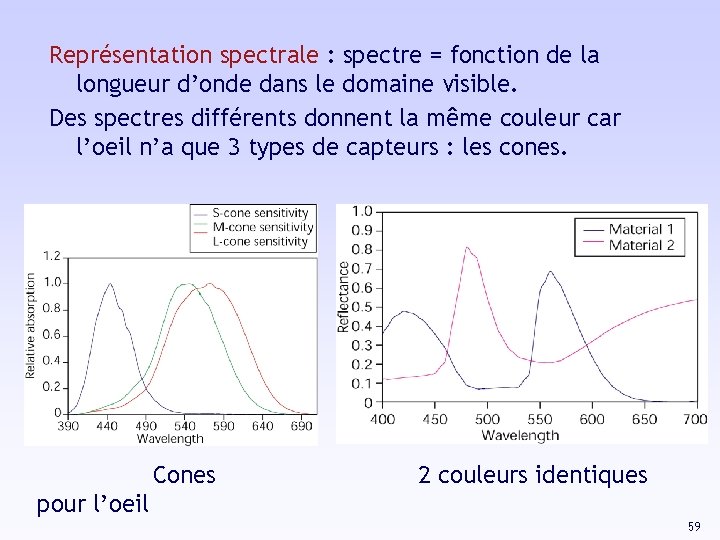

Représentation spectrale : spectre = fonction de la longueur d’onde dans le domaine visible. Des spectres différents donnent la même couleur car l’oeil n’a que 3 types de capteurs : les cones. Cones 2 couleurs identiques pour l’oeil 59

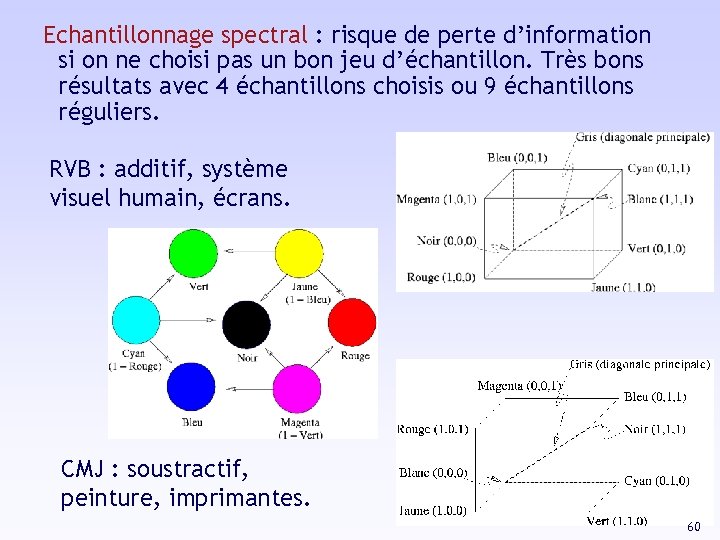

Echantillonnage spectral : risque de perte d’information si on ne choisi pas un bon jeu d’échantillon. Très bons résultats avec 4 échantillons choisis ou 9 échantillons réguliers. RVB : additif, système visuel humain, écrans. CMJ : soustractif, peinture, imprimantes. 60

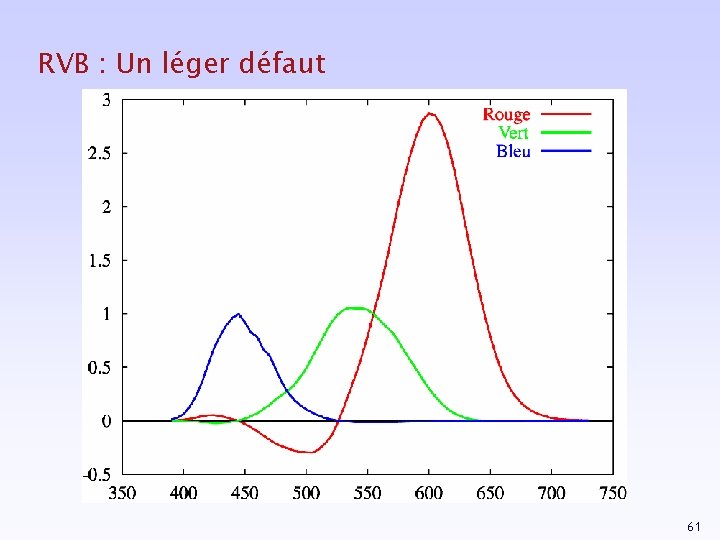

RVB : Un léger défaut 61

Une nouvelle fonction de base • Les couleurs primaires ont un défaut : – L’ensemble des couleurs visibles ne peut pas être représenté avec des coordonnées positives • Besoin de nouvelles fonctions de base – Couvrant tout le visible – Avec des coordonnées positives – Linéaires par rapport à RVB • Commission Internationale de l’Éclairage – www. cie. co. at – 1931 62

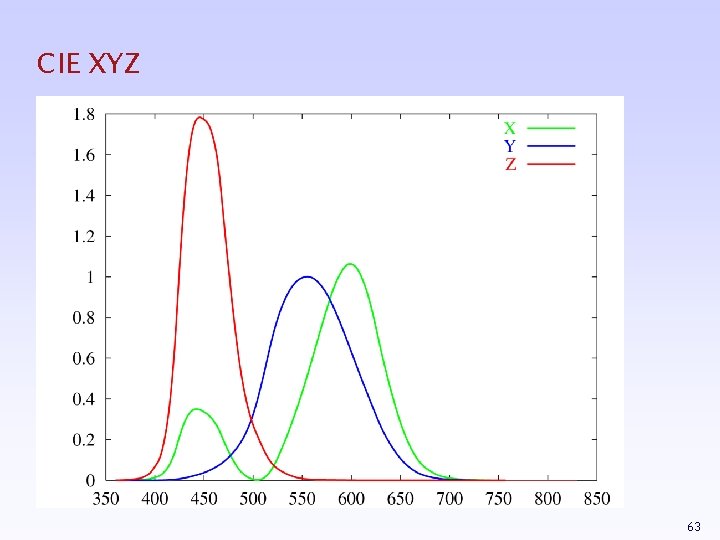

CIE XYZ 63

Modèle de la Commission Internationale de l'Éclairage (CIE) : 3 primaires standard X, Y, Z sans coeff négatifs. La couleur est donnée par x, y, z : 64

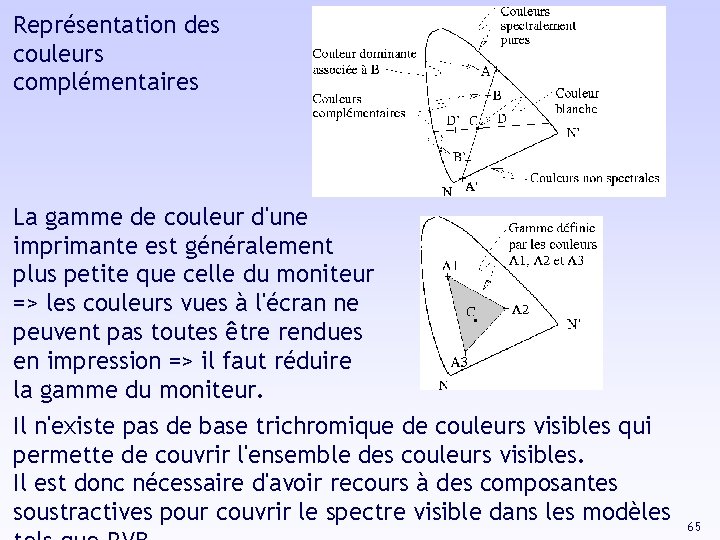

Représentation des couleurs complémentaires La gamme de couleur d'une imprimante est généralement plus petite que celle du moniteur => les couleurs vues à l'écran ne peuvent pas toutes être rendues en impression => il faut réduire la gamme du moniteur. Il n'existe pas de base trichromique de couleurs visibles qui permette de couvrir l'ensemble des couleurs visibles. Il est donc nécessaire d'avoir recours à des composantes soustractives pour couvrir le spectre visible dans les modèles 65

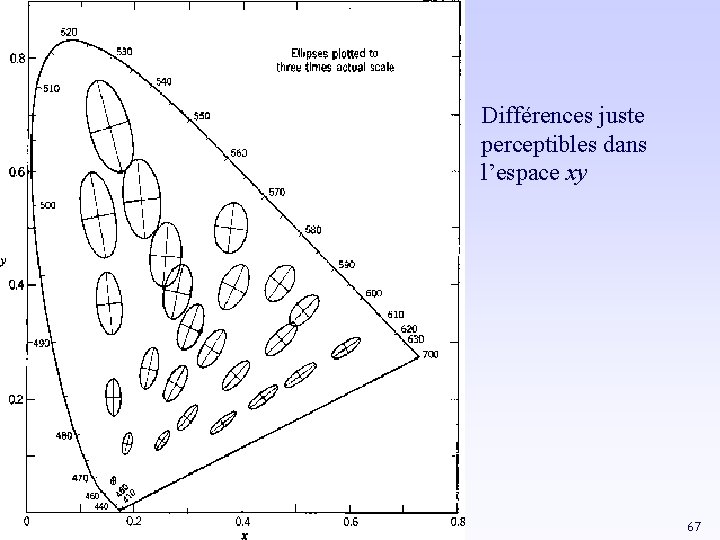

Perception des couleurs • Distance entre deux couleurs : – Dans l’espace de base : facile – Pour la vision humaine : utile • Idéalement, il y a un lien entre les deux • Espace des couleurs perceptuellement uniforme – Lien constant, indépendant de la couleur • Différences juste perceptibles : – Plus petite distance entre deux couleurs perçues comme différentes 66

Différences juste perceptibles dans l’espace xy 67

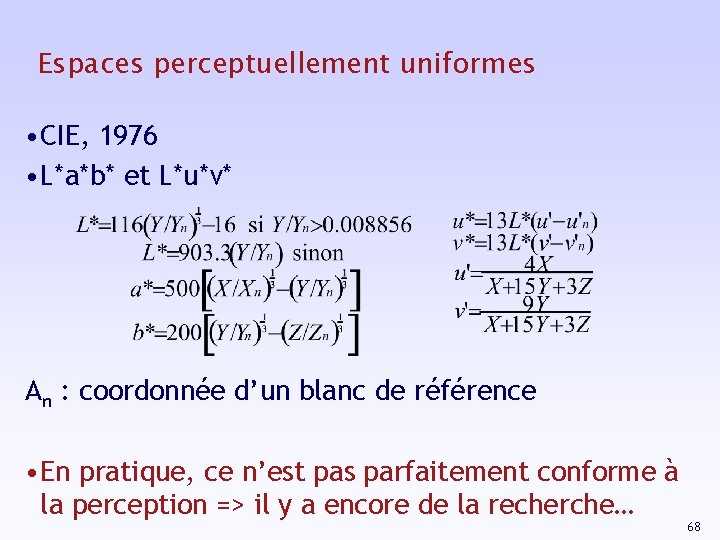

Espaces perceptuellement uniformes • CIE, 1976 • L*a*b* et L*u*v* An : coordonnée d’un blanc de référence • En pratique, ce n’est pas parfaitement conforme à la perception => il y a encore de la recherche… 68

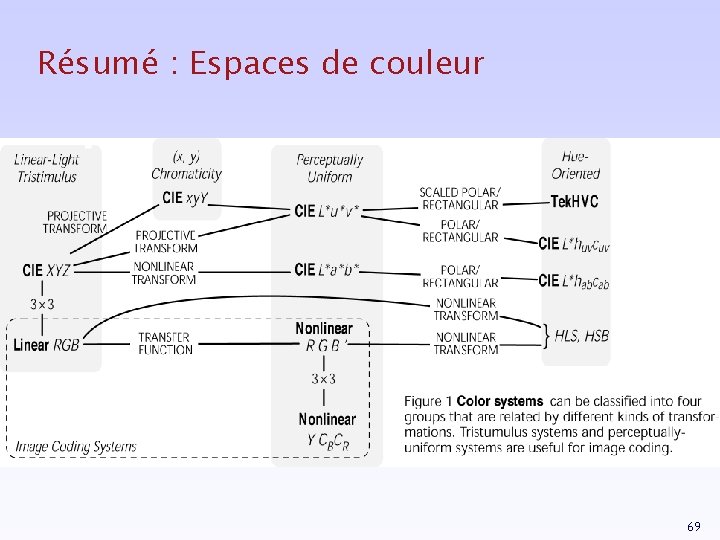

Résumé : Espaces de couleur 69

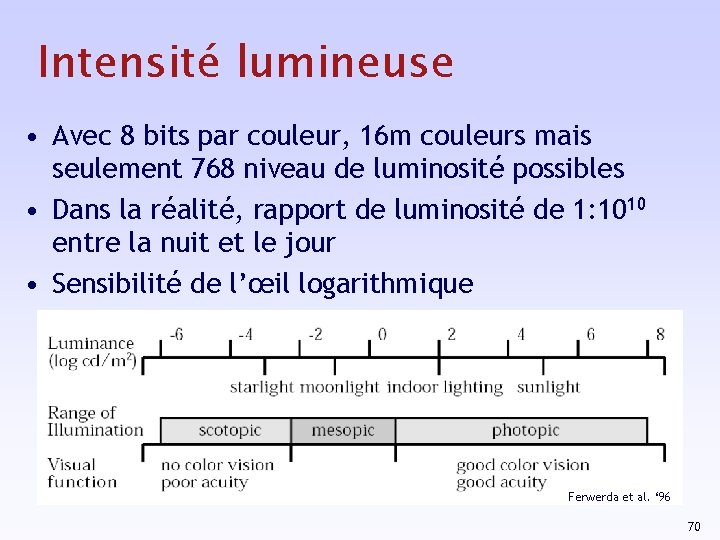

Intensité lumineuse • Avec 8 bits par couleur, 16 m couleurs mais seulement 768 niveau de luminosité possibles • Dans la réalité, rapport de luminosité de 1: 1010 entre la nuit et le jour • Sensibilité de l’œil logarithmique Ferwerda et al. ‘ 96 70

Intensité lumineuse • Formats d’image classiques : 24 bits => Besoin d’un codage HDR (High Dynamic Range) • Sensibilité des appareils photos limitée => Besoin d’outils d’acquisition HDR • Résolution des écrans limitée à 24 bits => Besoin d’outils d’affichage HDR 71

Intensité lumineuse • Formats d’image HDR – SGI Log. Luv 32 bits TIFF – Open. EXR – … 72

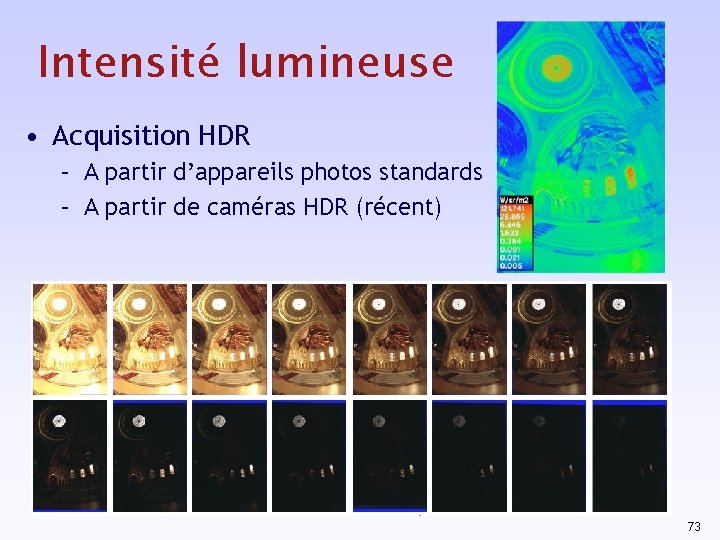

Intensité lumineuse • Acquisition HDR – A partir d’appareils photos standards – A partir de caméras HDR (récent) 73

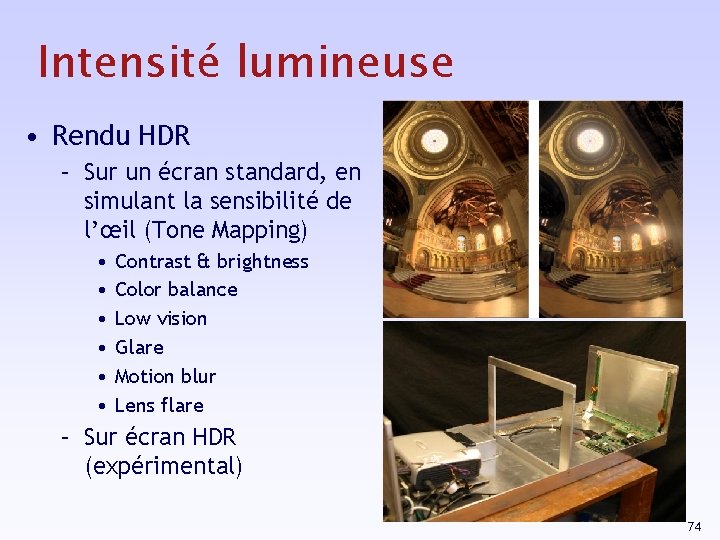

Intensité lumineuse • Rendu HDR – Sur un écran standard, en simulant la sensibilité de l’œil (Tone Mapping) • • • Contrast & brightness Color balance Low vision Glare Motion blur Lens flare – Sur écran HDR (expérimental) 74

Plan • • Historique Pipeline graphique Transformations Image, couleur Rasterisation Visibilité Illumination 75

Rasterisation Modeling Transformations Illumination (Shading) Découpe la primitive 2 D en pixels Interpole les valeurs connues aux sommets : couleur, profondeur, … Viewing Transformation (Perspective / Orthographic) Clipping Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 76

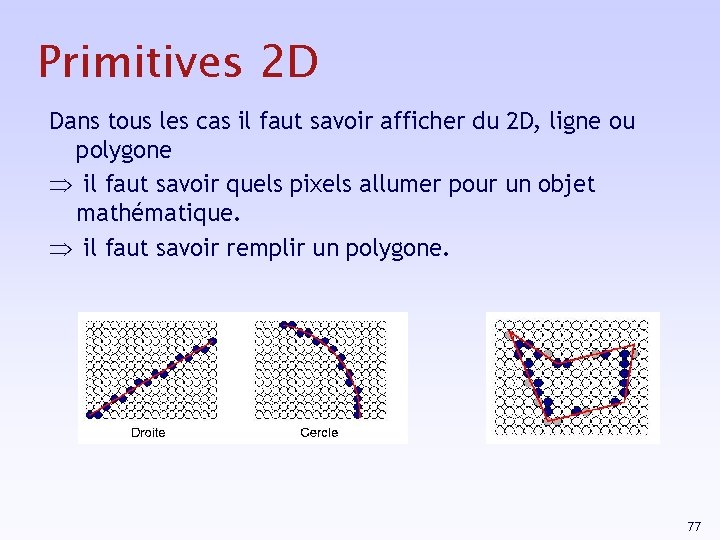

Primitives 2 D Dans tous les cas il faut savoir afficher du 2 D, ligne ou polygone Þ il faut savoir quels pixels allumer pour un objet mathématique. Þ il faut savoir remplir un polygone. 77

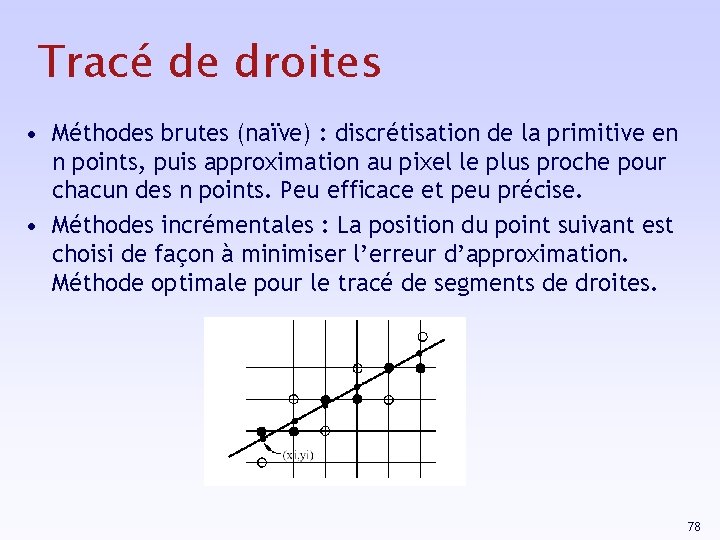

Tracé de droites • Méthodes brutes (naïve) : discrétisation de la primitive en n points, puis approximation au pixel le plus proche pour chacun des n points. Peu efficace et peu précise. • Méthodes incrémentales : La position du point suivant est choisi de façon à minimiser l’erreur d’approximation. Méthode optimale pour le tracé de segments de droites. 78

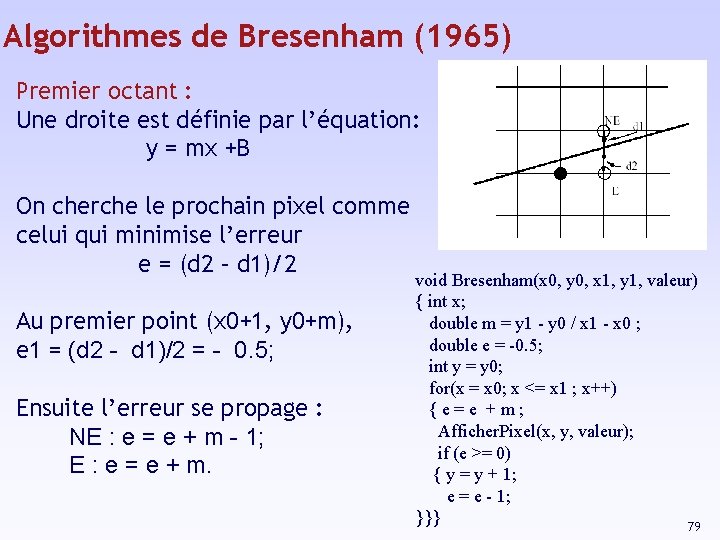

Algorithmes de Bresenham (1965) Premier octant : Une droite est définie par l’équation: y = mx +B On cherche le prochain pixel comme celui qui minimise l’erreur e = (d 2 – d 1)/2 Au premier point (x 0+1, y 0+m), e 1 = (d 2 - d 1)/2 = - 0. 5; Ensuite l’erreur se propage : NE : e = e + m - 1; E : e = e + m. void Bresenham(x 0, y 0, x 1, y 1, valeur) { int x; double m = y 1 - y 0 / x 1 - x 0 ; double e = -0. 5; int y = y 0; for(x = x 0; x <= x 1 ; x++) {e=e +m; Afficher. Pixel(x, y, valeur); if (e >= 0) { y = y + 1; e = e - 1; }}} 79

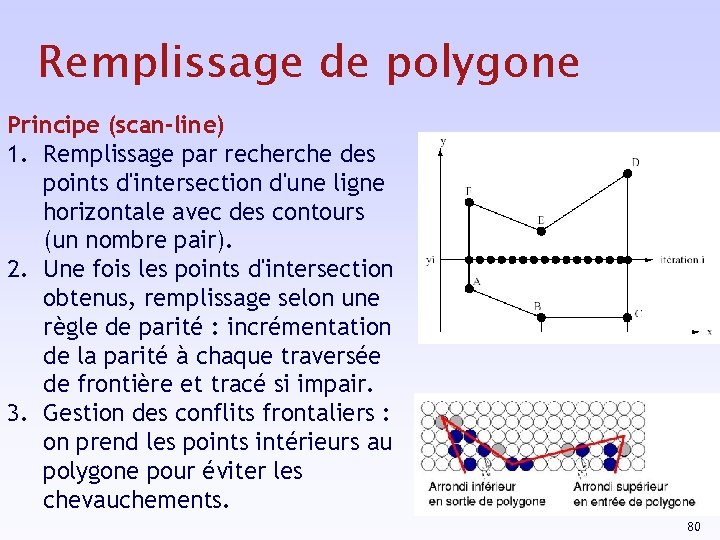

Remplissage de polygone Principe (scan-line) 1. Remplissage par recherche des points d'intersection d'une ligne horizontale avec des contours (un nombre pair). 2. Une fois les points d'intersection obtenus, remplissage selon une règle de parité : incrémentation de la parité à chaque traversée de frontière et tracé si impair. 3. Gestion des conflits frontaliers : on prend les points intérieurs au polygone pour éviter les chevauchements. 80

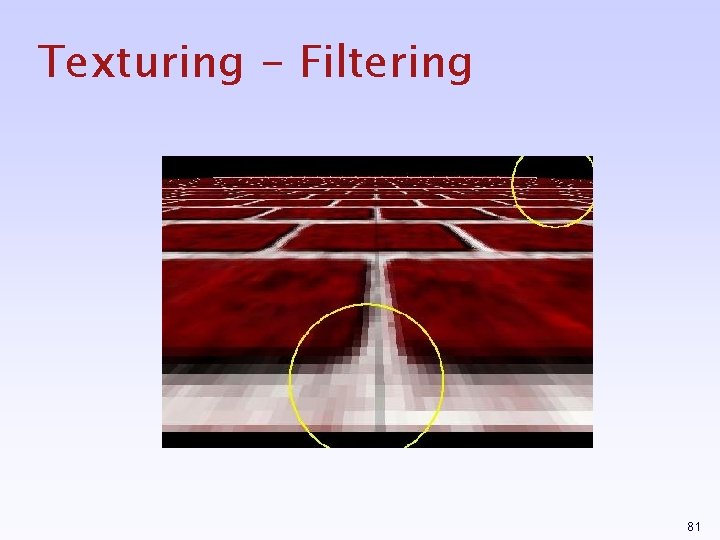

Texturing - Filtering 81

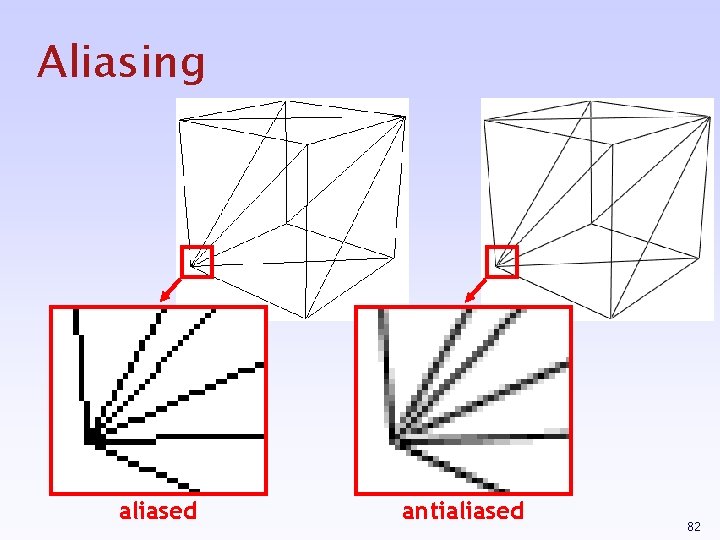

Aliasing aliased antialiased 82

Plan • • Historique Pipeline graphique Transformations Image, couleur Rasterisation Visibilité Illumination 83

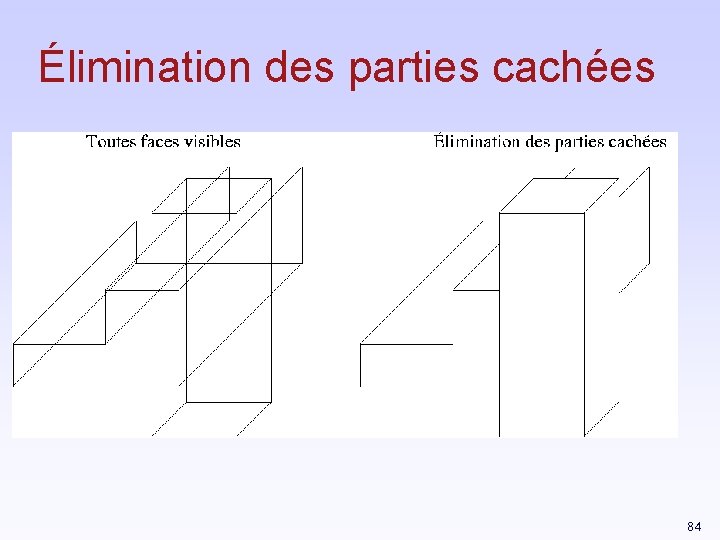

Élimination des parties cachées 84

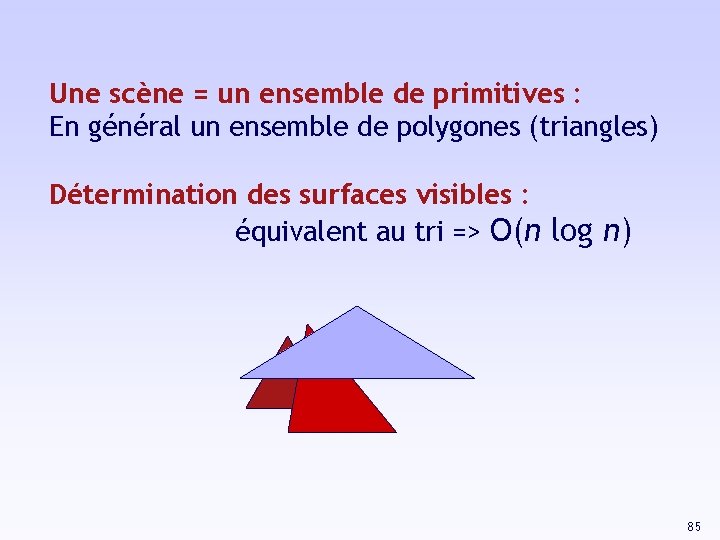

Une scène = un ensemble de primitives : En général un ensemble de polygones (triangles) Détermination des surfaces visibles : équivalent au tri => O(n log n) 85

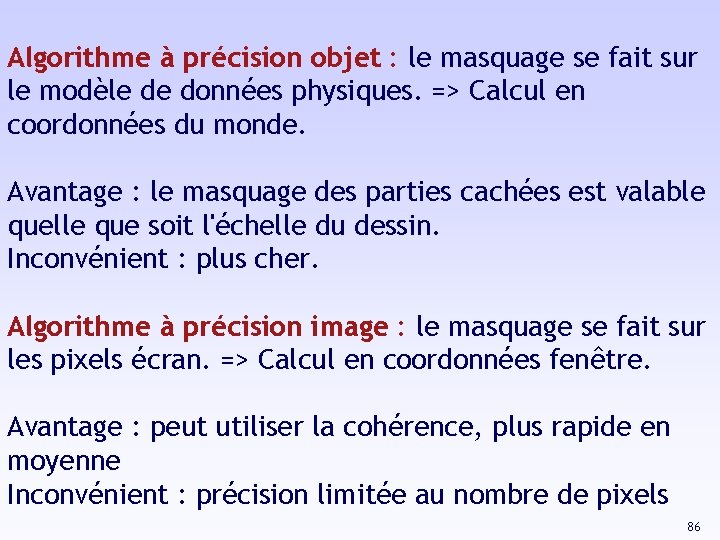

Algorithme à précision objet : le masquage se fait sur le modèle de données physiques. => Calcul en coordonnées du monde. Avantage : le masquage des parties cachées est valable quelle que soit l'échelle du dessin. Inconvénient : plus cher. Algorithme à précision image : le masquage se fait sur les pixels écran. => Calcul en coordonnées fenêtre. Avantage : peut utiliser la cohérence, plus rapide en moyenne Inconvénient : précision limitée au nombre de pixels 86

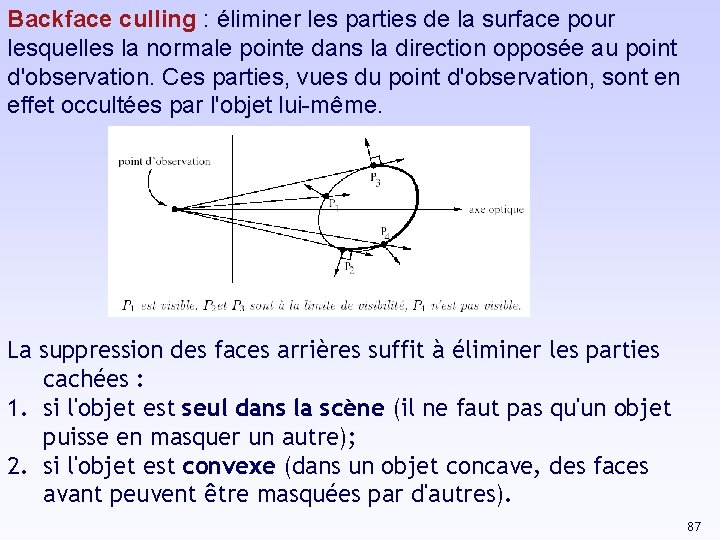

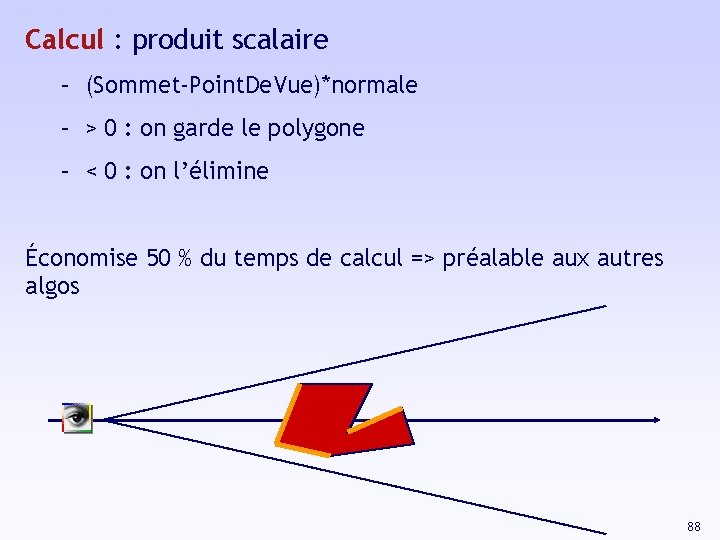

Backface culling : éliminer les parties de la surface pour lesquelles la normale pointe dans la direction opposée au point d'observation. Ces parties, vues du point d'observation, sont en effet occultées par l'objet lui-même. La suppression des faces arrières suffit à éliminer les parties cachées : 1. si l'objet est seul dans la scène (il ne faut pas qu'un objet puisse en masquer un autre); 2. si l'objet est convexe (dans un objet concave, des faces avant peuvent être masquées par d'autres). 87

Calcul : produit scalaire – (Sommet-Point. De. Vue)*normale – > 0 : on garde le polygone – < 0 : on l’élimine Économise 50 % du temps de calcul => préalable aux autres algos 88

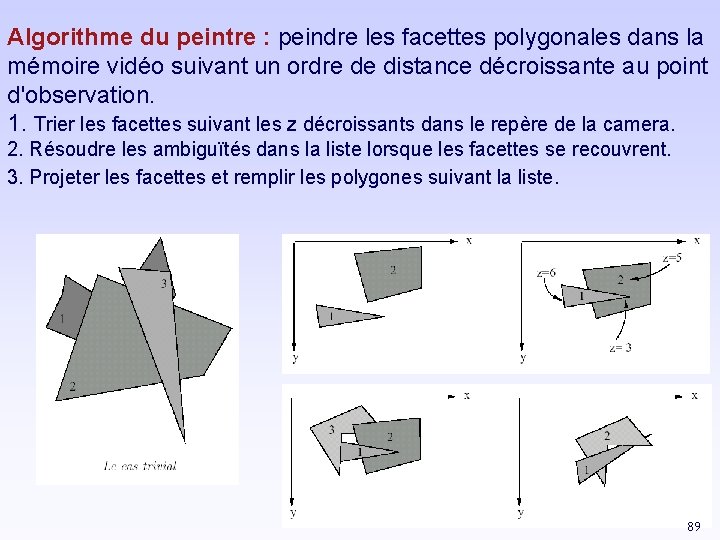

Algorithme du peintre : peindre les facettes polygonales dans la mémoire vidéo suivant un ordre de distance décroissante au point d'observation. 1. Trier les facettes suivant les z décroissants dans le repère de la camera. 2. Résoudre les ambiguïtés dans la liste lorsque les facettes se recouvrent. 3. Projeter les facettes et remplir les polygones suivant la liste. 89

Pour ou contre ? • Le plus intuitif des algorithmes • Coût en mémoire : – Affichage direct à l’écran : O(p) – Il faut trier les polygones : O(nlogn) • Temps de calcul : – On affiche toute la scène – Efficace surtout sur des petites scènes 90

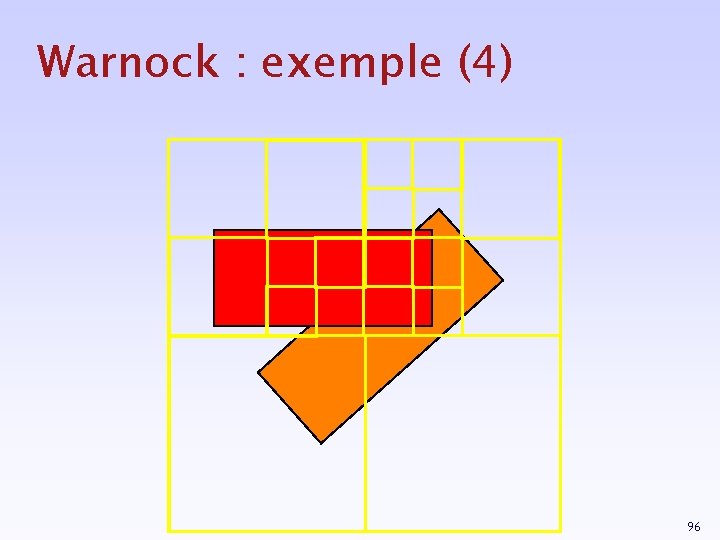

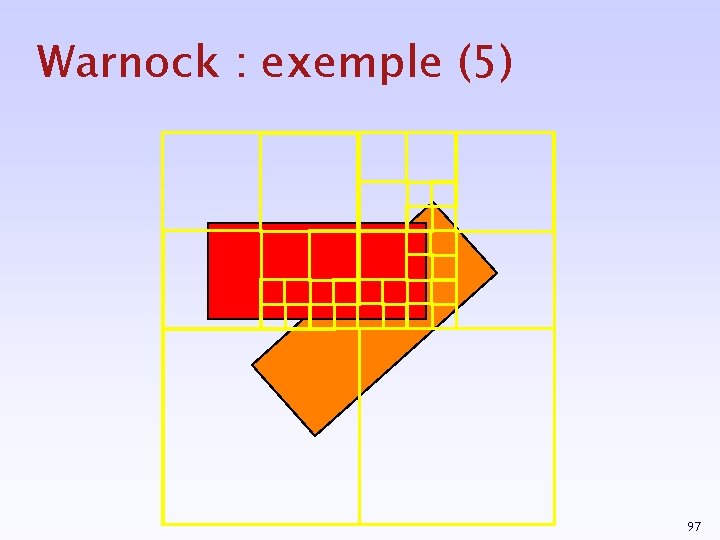

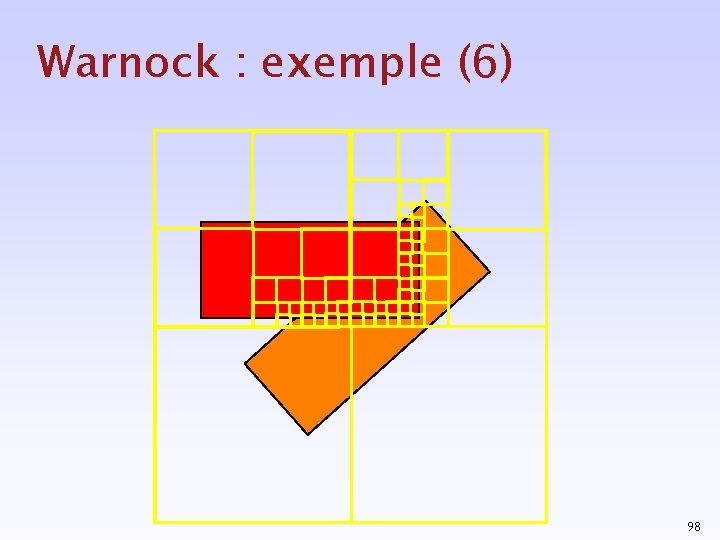

Area Subdivision (Warnock) • On utilise la cohérence spatiale • On divise l’écran en zones de travail • Pour chaque zone, on ne considère que les polygones qui l’intersectent • Si la visibilité est connue, on s’arrête • Si la visibilité est inconnue, on subdivise • On interrompt la subdivision quand on atteint une taille limite 91

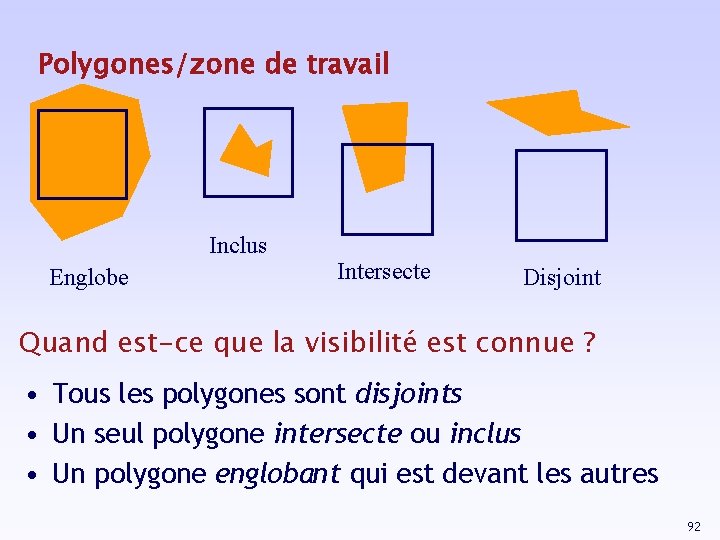

Polygones/zone de travail Inclus Englobe Intersecte Disjoint Quand est-ce que la visibilité est connue ? • Tous les polygones sont disjoints • Un seul polygone intersecte ou inclus • Un polygone englobant qui est devant les autres 92

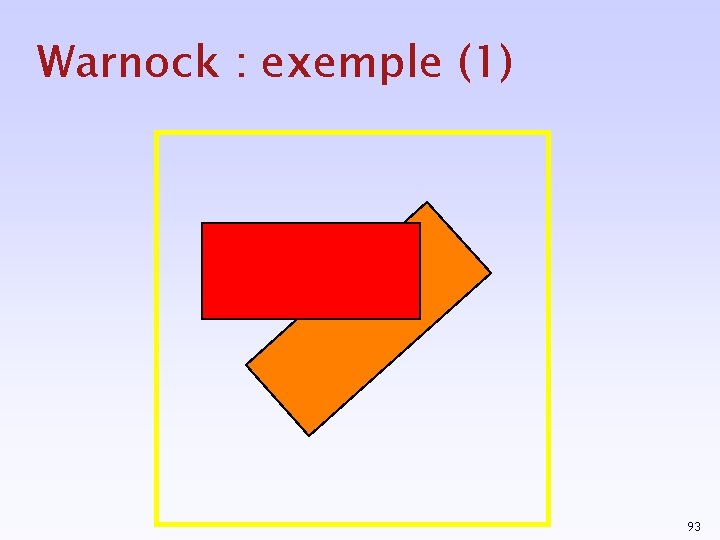

Warnock : exemple (1) 93

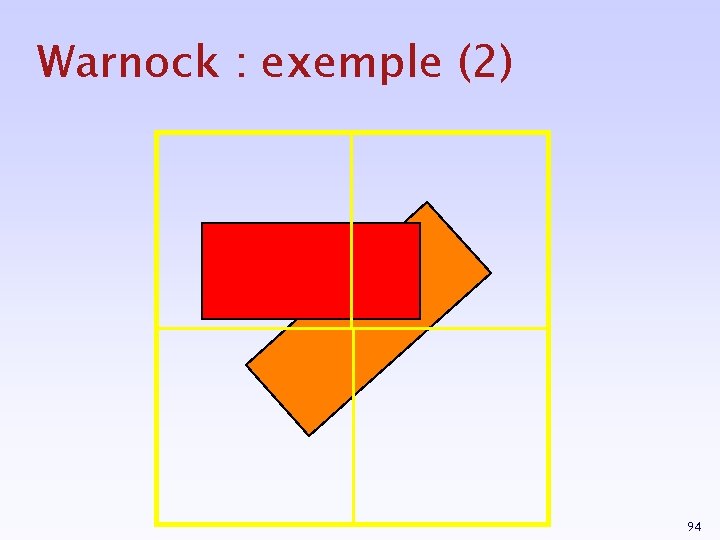

Warnock : exemple (2) 94

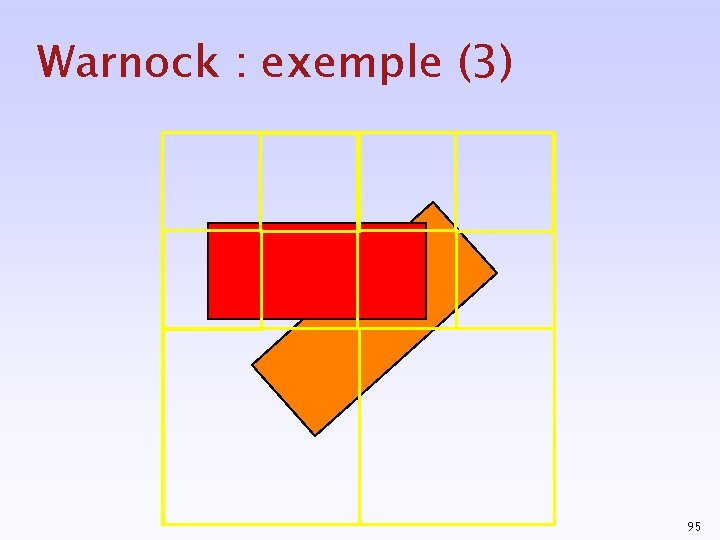

Warnock : exemple (3) 95

Warnock : exemple (4) 96

Warnock : exemple (5) 97

Warnock : exemple (6) 98

Warnock : pour ou contre • • Utilise la cohérence spatiale Plus efficace avec des grands polygones Coût mémoire parfois élevé Implémentation facile : appels récursifs à la même fonction 99

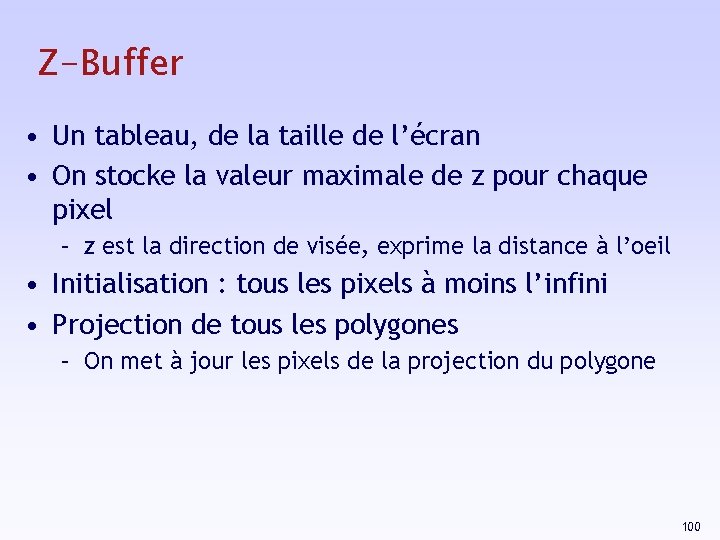

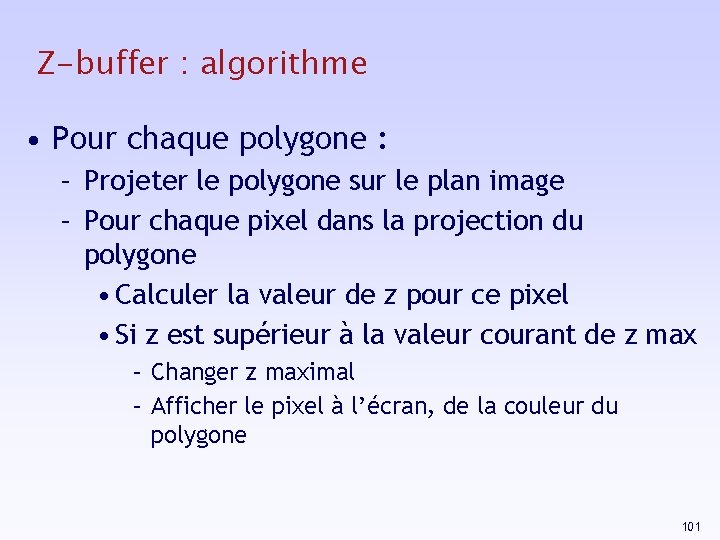

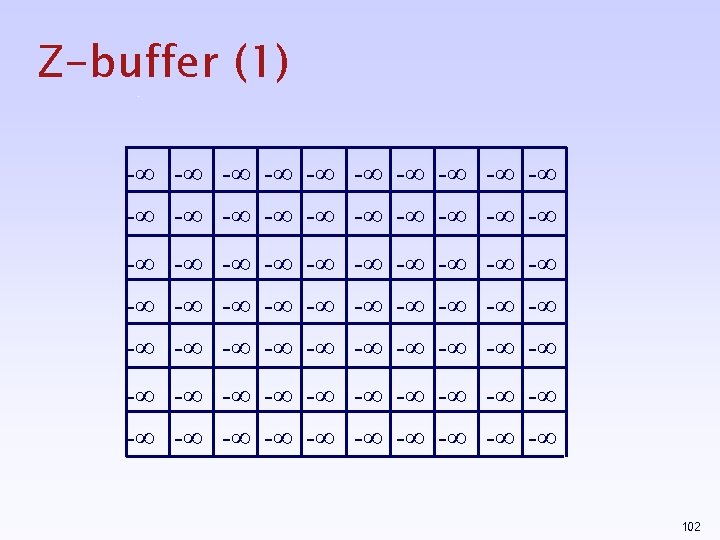

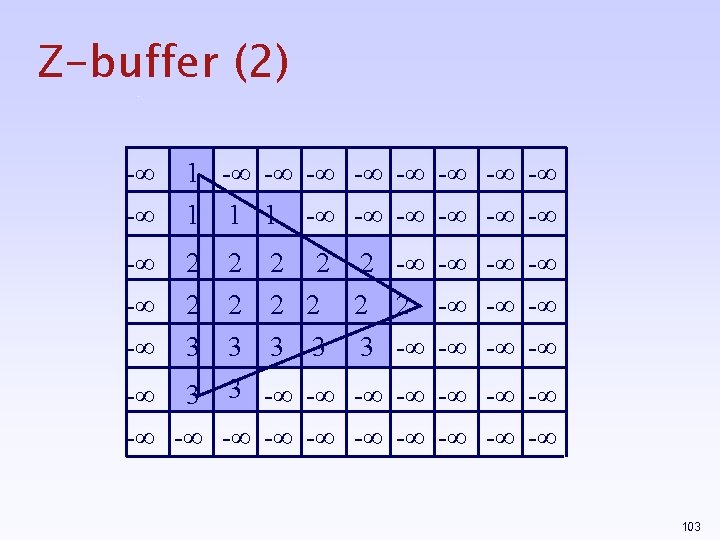

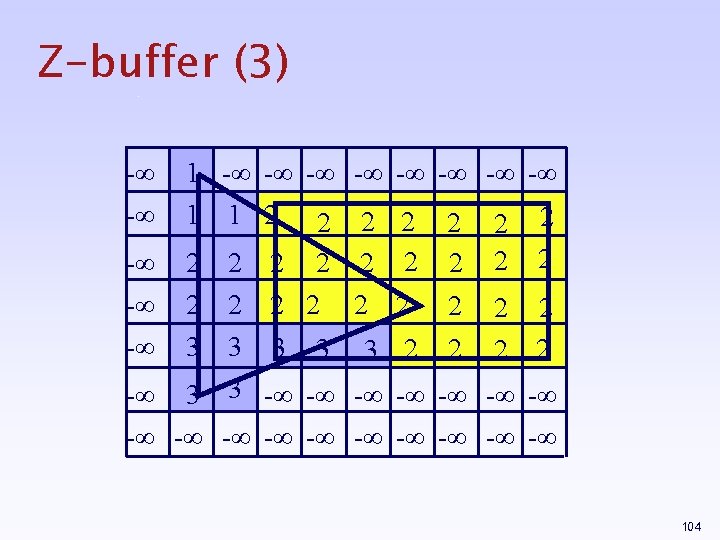

Z-Buffer • Un tableau, de la taille de l’écran • On stocke la valeur maximale de z pour chaque pixel – z est la direction de visée, exprime la distance à l’oeil • Initialisation : tous les pixels à moins l’infini • Projection de tous les polygones – On met à jour les pixels de la projection du polygone 100

Z-buffer : algorithme • Pour chaque polygone : – Projeter le polygone sur le plan image – Pour chaque pixel dans la projection du polygone • Calculer la valeur de z pour ce pixel • Si z est supérieur à la valeur courant de z max – Changer z maximal – Afficher le pixel à l’écran, de la couleur du polygone 101

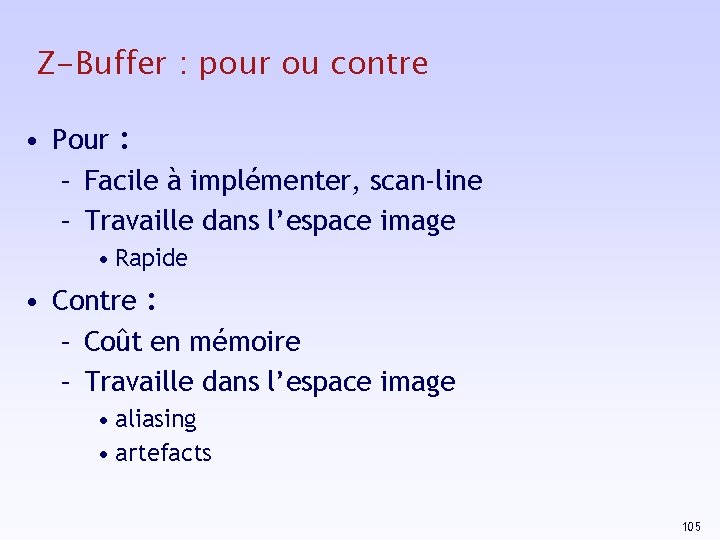

Z-Buffer : pour ou contre • Pour : – Facile à implémenter, scan-line – Travaille dans l’espace image • Rapide • Contre : – Coût en mémoire – Travaille dans l’espace image • aliasing • artefacts 105

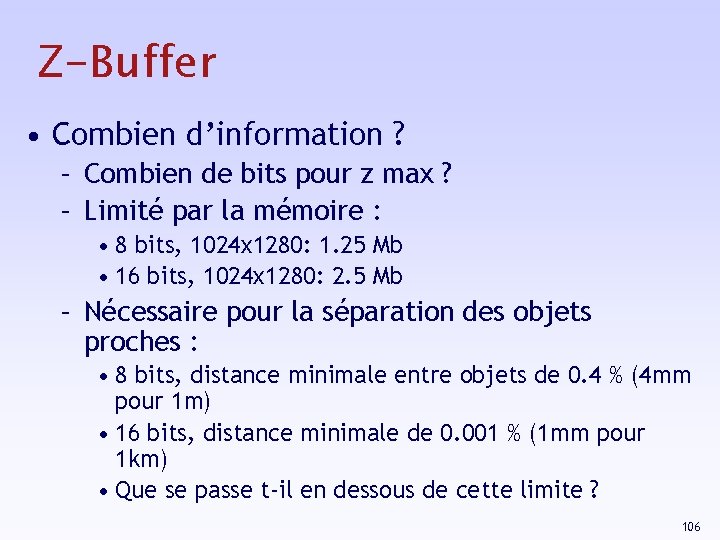

Z-Buffer • Combien d’information ? – Combien de bits pour z max ? – Limité par la mémoire : • 8 bits, 1024 x 1280: 1. 25 Mb • 16 bits, 1024 x 1280: 2. 5 Mb – Nécessaire pour la séparation des objets proches : • 8 bits, distance minimale entre objets de 0. 4 % (4 mm pour 1 m) • 16 bits, distance minimale de 0. 001 % (1 mm pour 1 km) • Que se passe t-il en dessous de cette limite ? 106

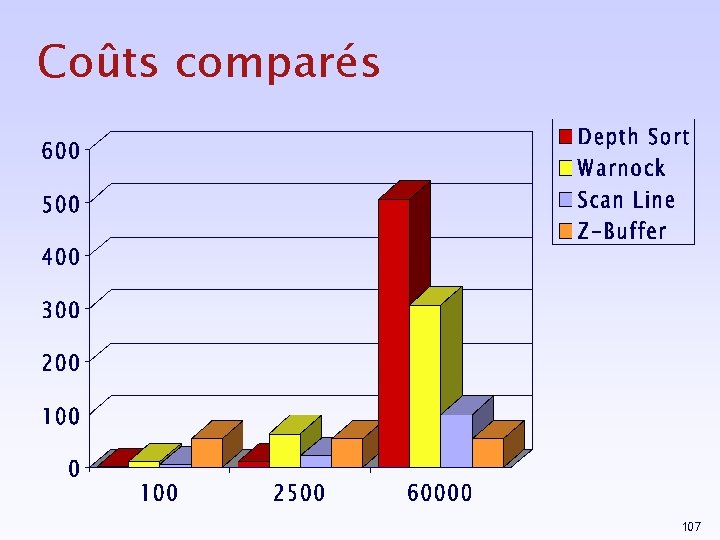

Coûts comparés 107

Plan • • Historique Pipeline graphique Transformations Image, couleur Rasterisation Visibilité Illumination 108

Illumination Modeling Transformations Illumination (Shading) Les primitives sont éclairées selon leur matériau, le type de surface et les sources de lumière. Viewing Transformation (Perspective / Orthographic) Clipping Projection (to Screen Space) Scan Conversion (Rasterization) Visibility / Display 109

Illumination Quelle couleur doit-on afficher pour ce pixel ? => Résultat de l’interaction de la lumière avec la scène et l’oeil. Dépend donc de : • position du point dans l’espace, • orientation du point (élément de surface), • caractéristiques de la surface (diffusion, réflexion, transparence…), • sources de lumière (surfaciques, ponctuelles…). • Position et orientation de la “caméra” 110

La lumière : onde et corpuscule => propagation et transport. Un photon transporte une certaine énergie à une longueur d’onde donnée. A chaque interaction (réflexion, transmission, réfraction, absorption, diffraction et interference) il peut changer sa direction et sa couleur (spatial et spectral). Si un photon passe par la position de l’oeil tout en intersectant la fenêtre graphique, alors sa couleur contribue au pixel qu’il traverse. ÞL’image parfaite demande de suivre une infinité de photons, il faut donc simplifier le problème : Illumination locale, ombrage, illumination globale. 111

Modèles d'illumination locale On suppose que les objets interagissent avec une seule source de lumière ponctuelle. On ne calcule pas les interactions entre objets => pas d’ombres, pas d’effet miroir… On calcule la couleur en chaque point. 112

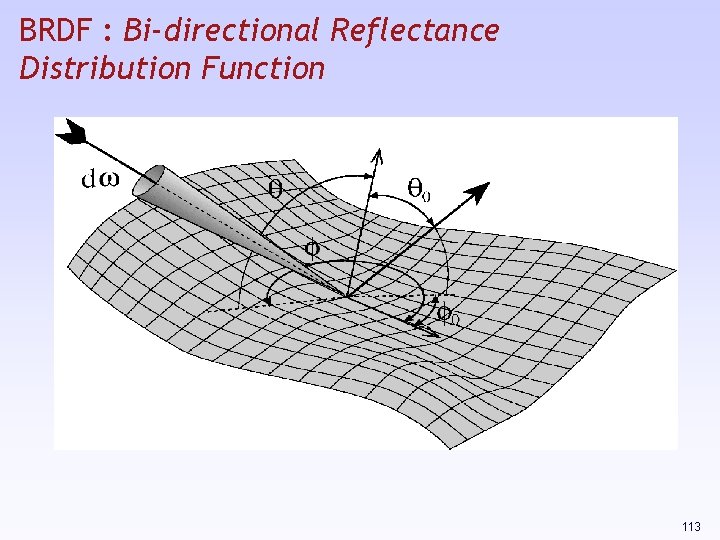

BRDF : Bi-directional Reflectance Distribution Function 113

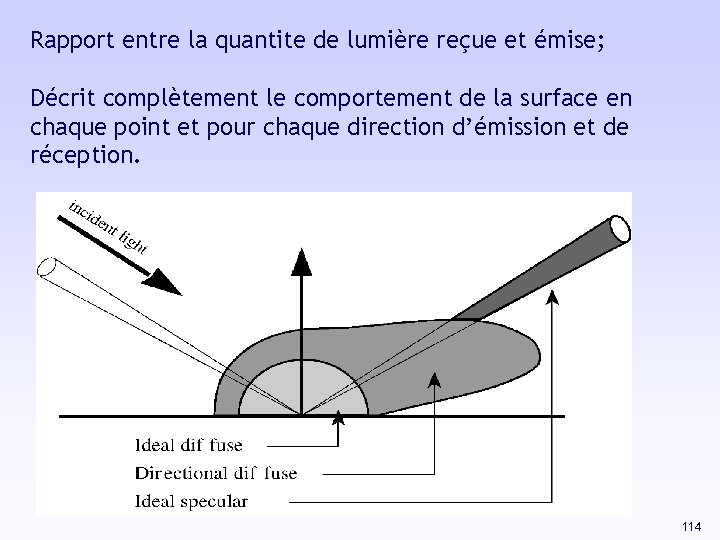

Rapport entre la quantite de lumière reçue et émise; Décrit complètement le comportement de la surface en chaque point et pour chaque direction d’émission et de réception. 114

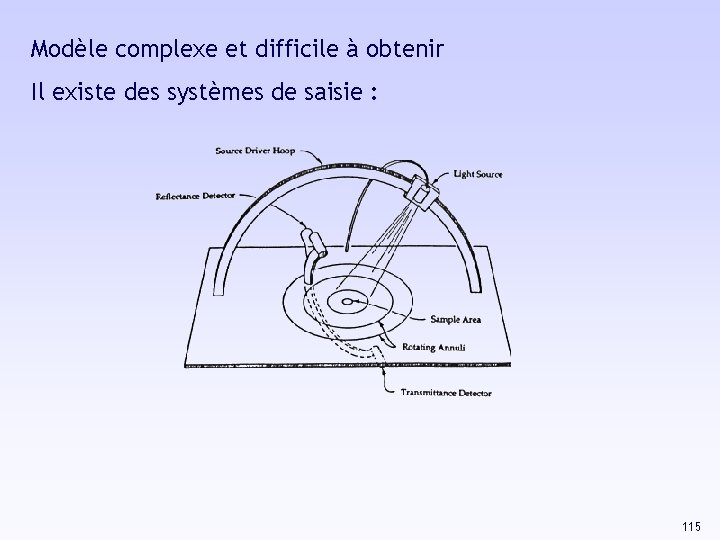

Modèle complexe et difficile à obtenir Il existe des systèmes de saisie : 115

Modèles simplifiés Lumière ambiante : une source lumineuse non ponctuelle qui émet de manière constante dans toutes les directions et sur toutes les surfaces une lumière d'intensité Ia. Alors pour un point P de la surface, l'intensité lumineuse sera I(P) = ρa Ia; qui est constante en tous points de la surface, et où ρa est un facteur qui détermine la quantité de lumière ambiante réfléchie par la surface et est fonction des propriétés matérielles de la surface (0 <= ρa <= 1). 116

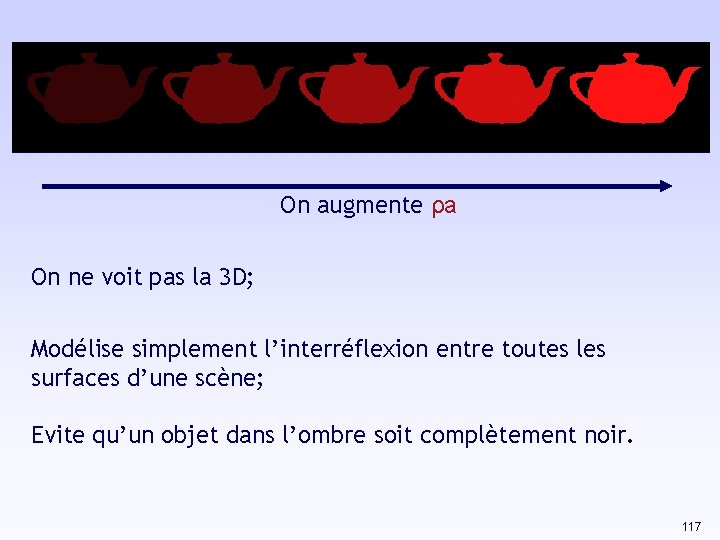

On augmente ρa On ne voit pas la 3 D; Modélise simplement l’interréflexion entre toutes les surfaces d’une scène; Evite qu’un objet dans l’ombre soit complètement noir. 117

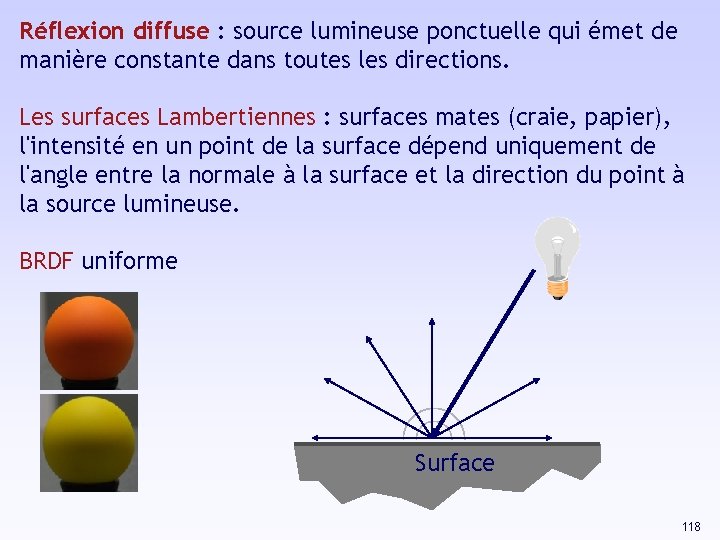

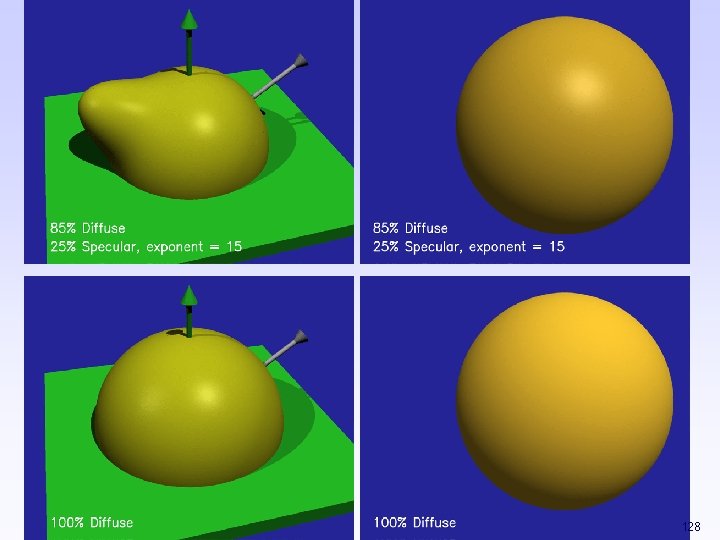

Réflexion diffuse : source lumineuse ponctuelle qui émet de manière constante dans toutes les directions. Les surfaces Lambertiennes : surfaces mates (craie, papier), l'intensité en un point de la surface dépend uniquement de l'angle entre la normale à la surface et la direction du point à la source lumineuse. BRDF uniforme Surface 118

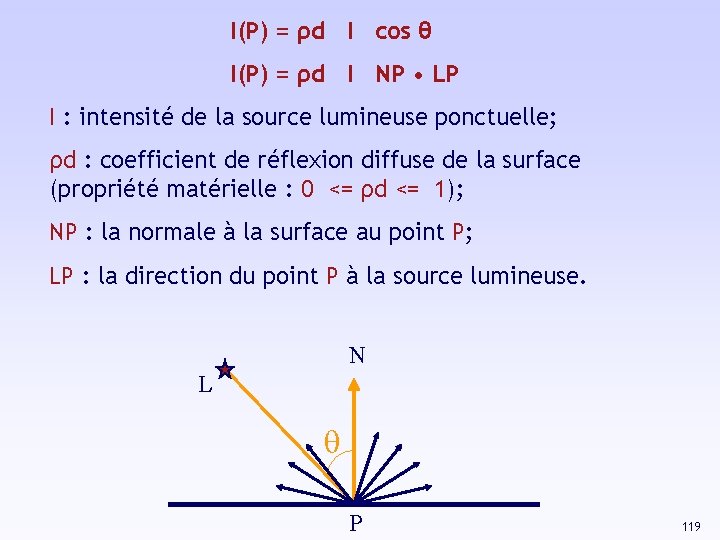

I(P) = ρd I cos θ I(P) = ρd I NP • LP I : intensité de la source lumineuse ponctuelle; ρd : coefficient de réflexion diffuse de la surface (propriété matérielle : 0 <= ρd <= 1); NP : la normale à la surface au point P; LP : la direction du point P à la source lumineuse. N L P 119

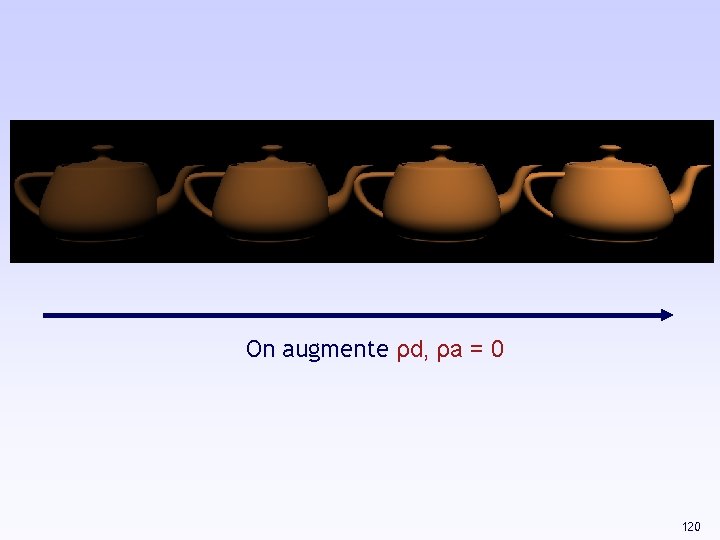

On augmente ρd, ρa = 0 120

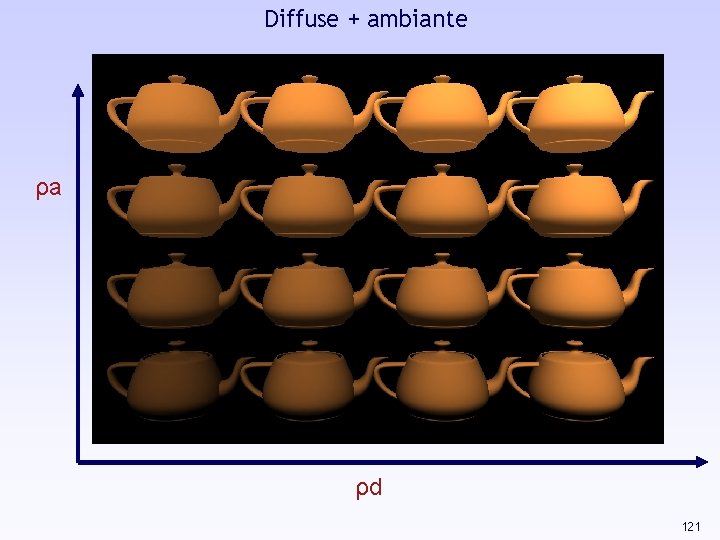

Diffuse + ambiante ρa ρd 121

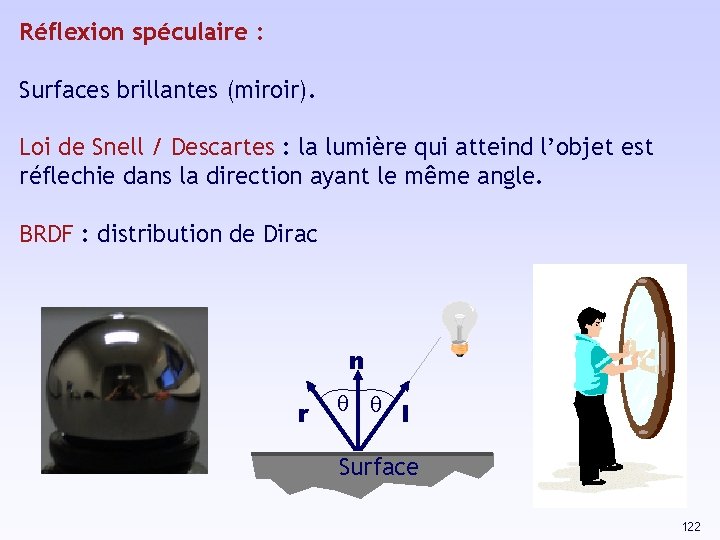

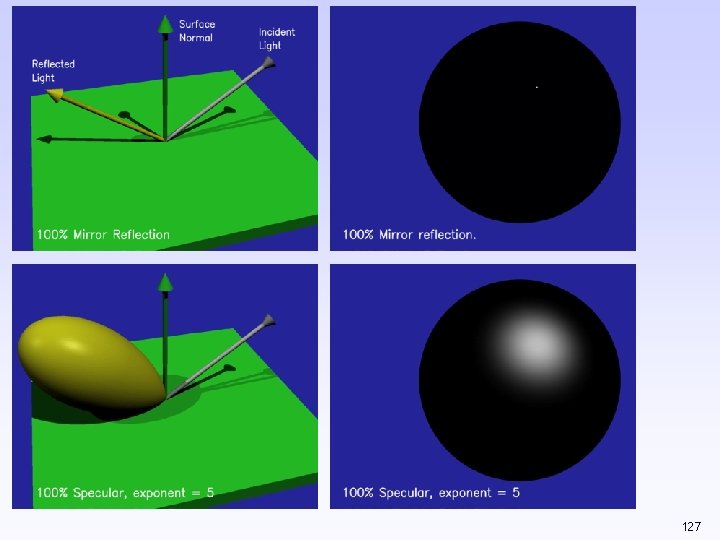

Réflexion spéculaire : Surfaces brillantes (miroir). Loi de Snell / Descartes : la lumière qui atteind l’objet est réflechie dans la direction ayant le même angle. BRDF : distribution de Dirac n r l Surface 122

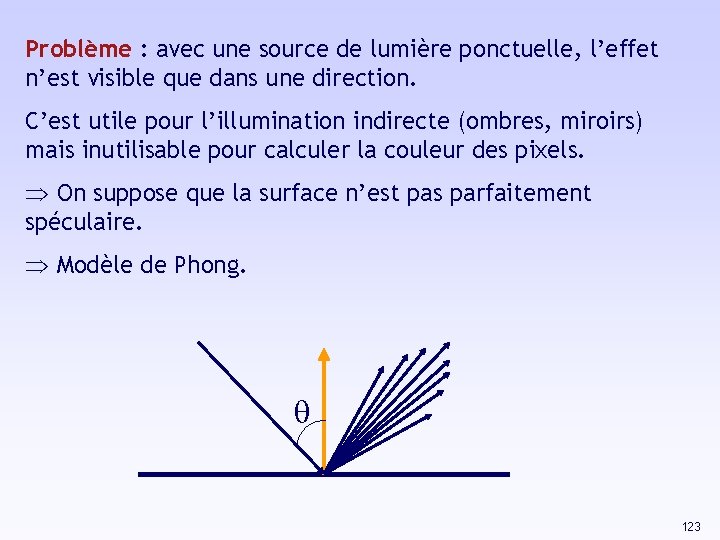

Problème : avec une source de lumière ponctuelle, l’effet n’est visible que dans une direction. C’est utile pour l’illumination indirecte (ombres, miroirs) mais inutilisable pour calculer la couleur des pixels. Þ On suppose que la surface n’est pas parfaitement spéculaire. Þ Modèle de Phong. 123

![Modèle de Phong [1975] : la réflexion est importante lorsque l'angle α entre la Modèle de Phong [1975] : la réflexion est importante lorsque l'angle α entre la](http://slidetodoc.com/presentation_image_h/1ca85702ce6d6c94bf094582102ab74d/image-124.jpg)

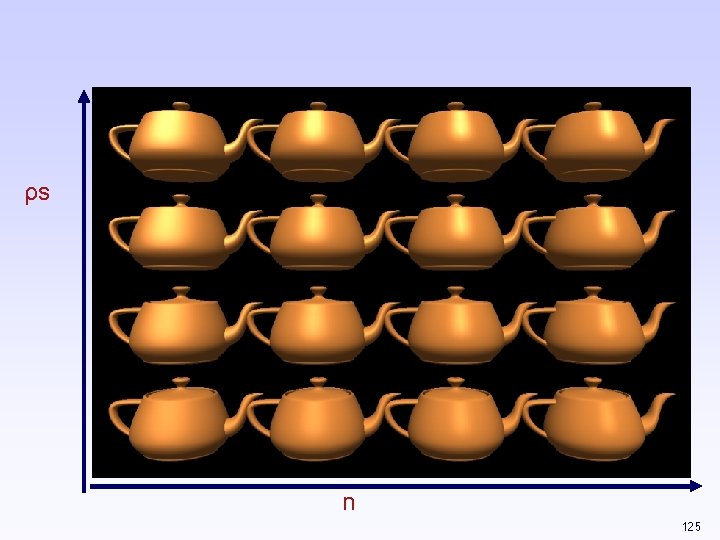

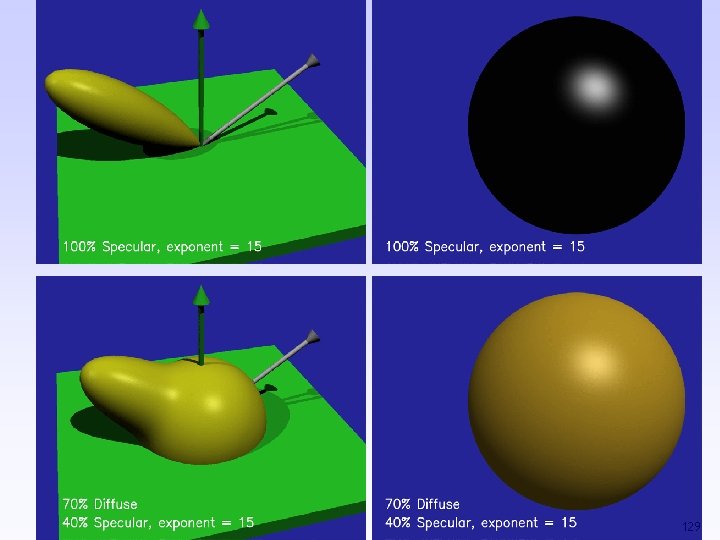

Modèle de Phong [1975] : la réflexion est importante lorsque l'angle α entre la direction d'observation du point de la surface V et la direction de réflexion R (symétrique de la direction LP par rapport à NP ) est faible. Cette réflexion diminue de façon importante lorsque l'angle augmente. I(P) = ρs I cosn α n = rugosité : (1024) pour un miroir, 1 pour une surface très rugueuse. L R a P V 124

ρs n 125

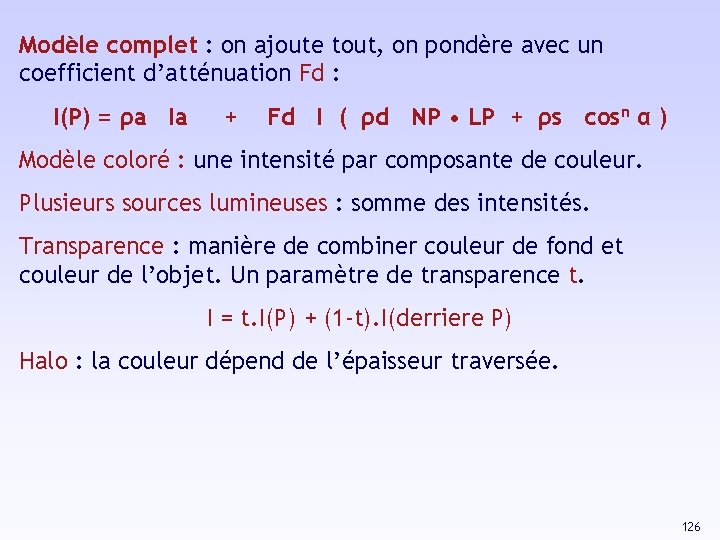

Modèle complet : on ajoute tout, on pondère avec un coefficient d’atténuation Fd : I(P) = ρa Ia + Fd I ( ρd NP • LP + ρs cosn α ) Modèle coloré : une intensité par composante de couleur. Plusieurs sources lumineuses : somme des intensités. Transparence : manière de combiner couleur de fond et couleur de l’objet. Un paramètre de transparence t. I = t. I(P) + (1 -t). I(derriere P) Halo : la couleur dépend de l’épaisseur traversée. 126

127

128

129

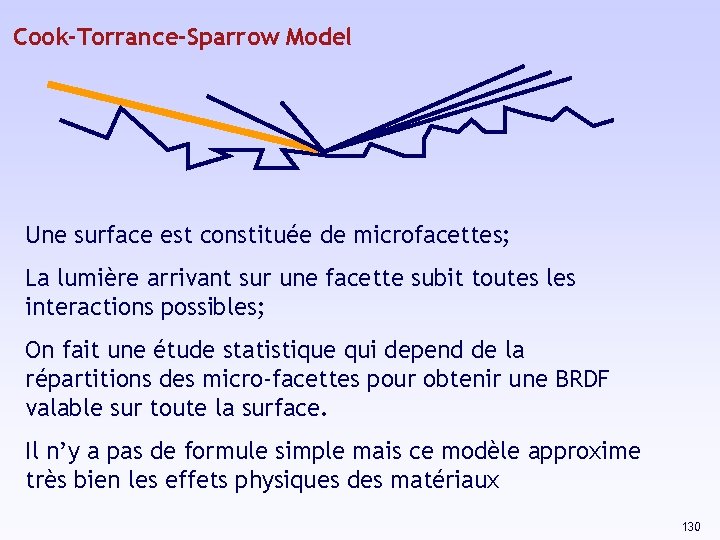

Cook-Torrance-Sparrow Model Une surface est constituée de microfacettes; La lumière arrivant sur une facette subit toutes les interactions possibles; On fait une étude statistique qui depend de la répartitions des micro-facettes pour obtenir une BRDF valable sur toute la surface. Il n’y a pas de formule simple mais ce modèle approxime très bien les effets physiques des matériaux 130

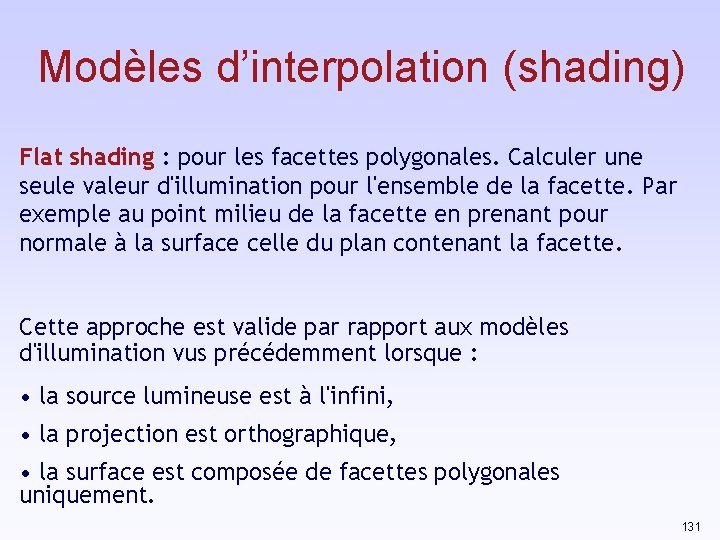

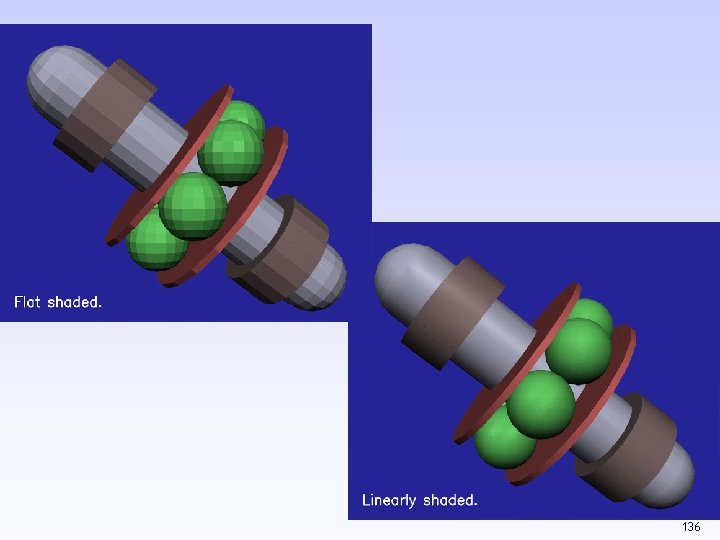

Modèles d’interpolation (shading) Flat shading : pour les facettes polygonales. Calculer une seule valeur d'illumination pour l'ensemble de la facette. Par exemple au point milieu de la facette en prenant pour normale à la surface celle du plan contenant la facette. Cette approche est valide par rapport aux modèles d'illumination vus précédemment lorsque : • la source lumineuse est à l'infini, • la projection est orthographique, • la surface est composée de facettes polygonales uniquement. 131

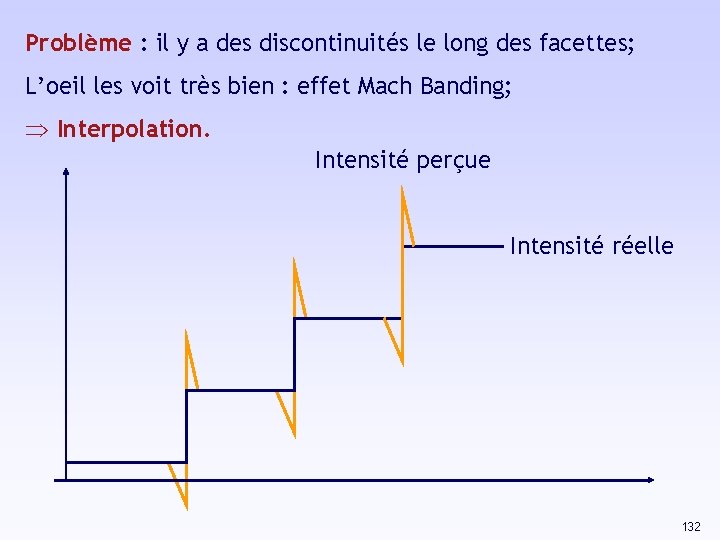

Problème : il y a des discontinuités le long des facettes; L’oeil les voit très bien : effet Mach Banding; Þ Interpolation. Intensité perçue Intensité réelle 132

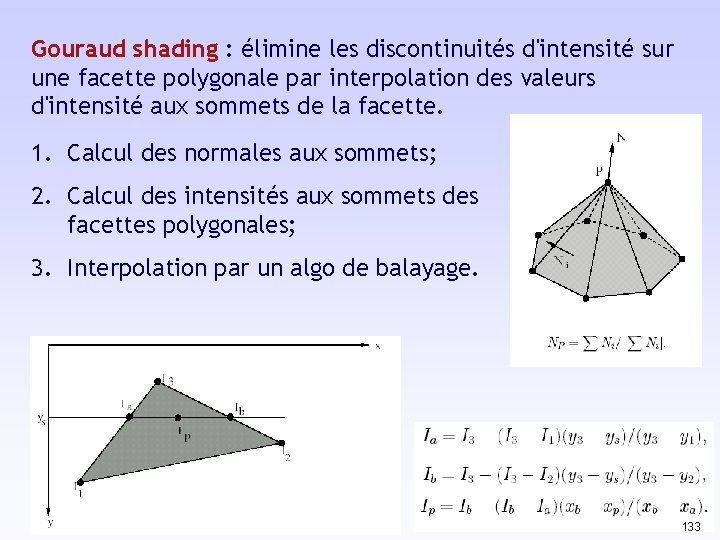

Gouraud shading : élimine les discontinuités d'intensité sur une facette polygonale par interpolation des valeurs d'intensité aux sommets de la facette. 1. Calcul des normales aux sommets; 2. Calcul des intensités aux sommets des facettes polygonales; 3. Interpolation par un algo de balayage. 133

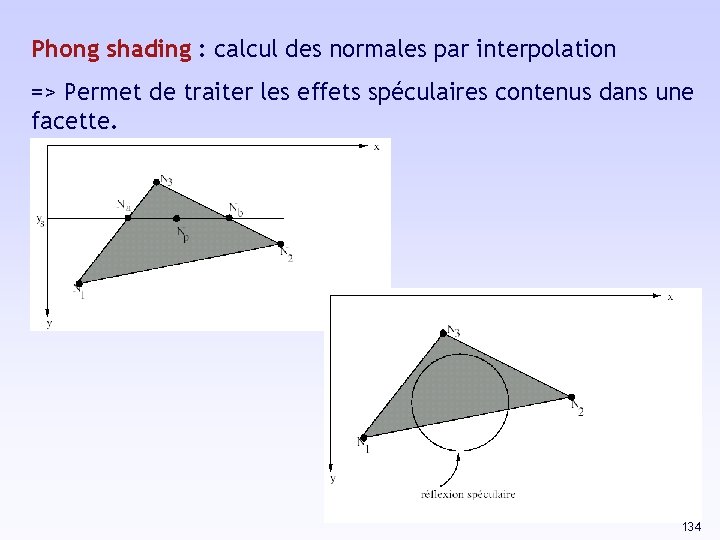

Phong shading : calcul des normales par interpolation => Permet de traiter les effets spéculaires contenus dans une facette. 134

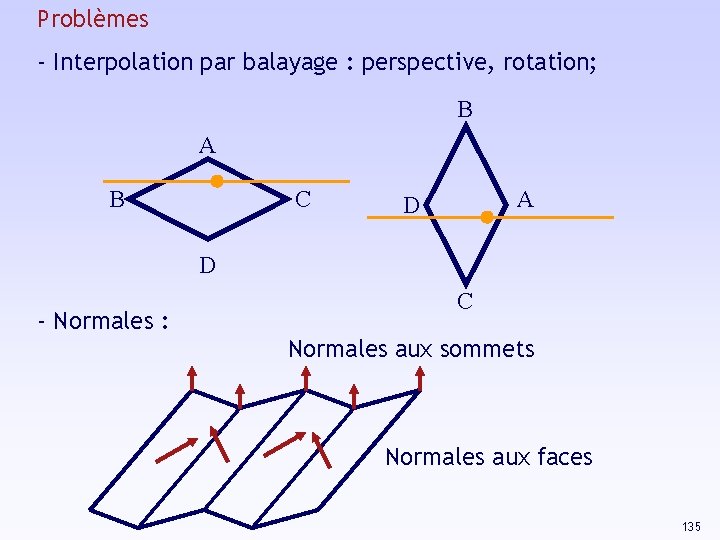

Problèmes - Interpolation par balayage : perspective, rotation; B A B C A D D - Normales : C Normales aux sommets Normales aux faces 135

136

Sources de lumiere • Ponctuelle : – Controle de la position – Rayons emis dans toutes les directions – Intensite décroit comme le carré de la distance • Directionnelle : – Controle de l’intensité – Lumiere située à l’infini (direction) – Rayons de lumière parallèles 137

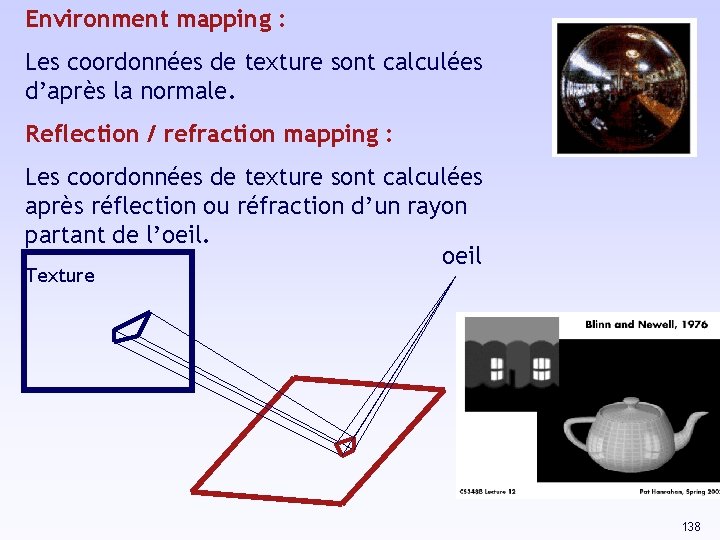

Environment mapping : Les coordonnées de texture sont calculées d’après la normale. Reflection / refraction mapping : Les coordonnées de texture sont calculées après réflection ou réfraction d’un rayon partant de l’oeil Texture 138

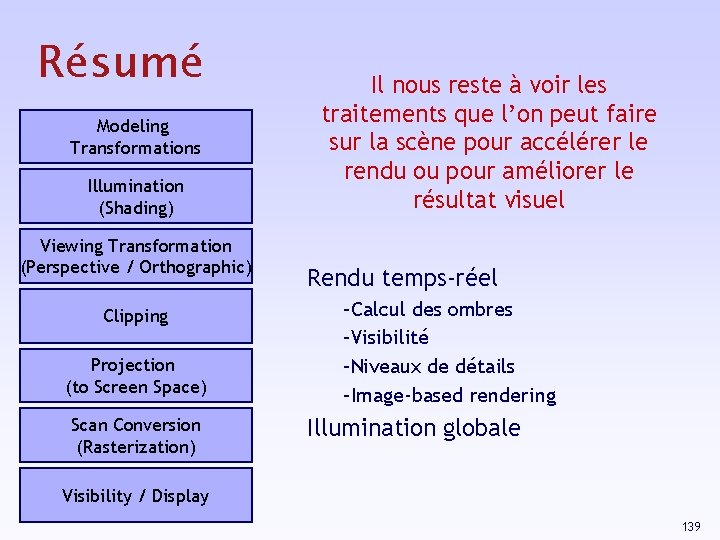

Résumé Modeling Transformations Illumination (Shading) Viewing Transformation (Perspective / Orthographic) Clipping Projection (to Screen Space) Scan Conversion (Rasterization) Il nous reste à voir les traitements que l’on peut faire sur la scène pour accélérer le rendu ou pour améliorer le résultat visuel Rendu temps-réel –Calcul des ombres –Visibilité –Niveaux de détails –Image-based rendering Illumination globale Visibility / Display 139

- Slides: 139