Statistische Verfahren zur Bestimmung von Kollokationen LV Sprachverarbeitung

Statistische Verfahren zur Bestimmung von Kollokationen LV Sprachverarbeitung WS 02/03 H. Schweppe Literatur: C. Manning, H. Schütze, Foundations of Statistical NL Processing, ch. 5 ff, MIT Press, 2002

"The notion of collocation may be confusing to readers without a background in linguistics" (C. M. ) hs / fub – alp 3 -19 -Bbaum-1 2

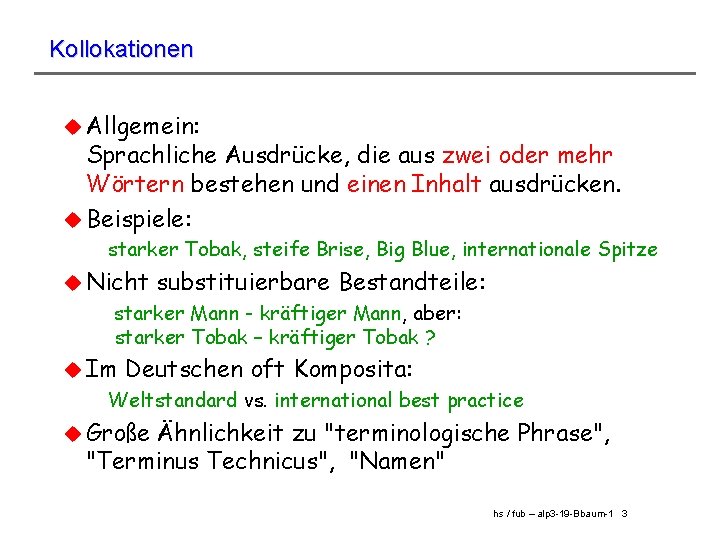

Kollokationen u Allgemein: Sprachliche Ausdrücke, die aus zwei oder mehr Wörtern bestehen und einen Inhalt ausdrücken. u Beispiele: starker Tobak, steife Brise, Big Blue, internationale Spitze u Nicht substituierbare Bestandteile: starker Mann - kräftiger Mann, aber: starker Tobak – kräftiger Tobak ? u Im Deutschen oft Komposita: Weltstandard vs. international best practice u Große Ähnlichkeit zu "terminologische Phrase", "Terminus Technicus", "Namen" hs / fub – alp 3 -19 -Bbaum-1 3

Kollokationen u Typische Eigenschaften w Nicht kompositionell "Neue Schuhe" versus "Neuer Markt" w. Nicht substituierbar "white wine" , "yellow wine" w. Nicht modifizierbar "Neuer dynamischer Markt" aber "dynamischer Neuer Markt" ( Adj, Nomen) u Erweiterte Definition schließt ein: w. Eigennamen w. Terminologische Ausdrücke ("test set", "program specification") w. Assoziative Kollokationen ("Krankenhaus – Schwester") w. Verb / Substantiv – Kollokationen ("Entscheidung treffen") hs / fub – alp 3 -19 -Bbaum-1 4

Kontext und Anwendungen u Keine Bedeutung in strukturalistischer Linguistik à la Chomsky u Anwendungen: w. Spracherzeugung w… also auch maschinelle Übersetzung - stiff breeze = starke Brise? ? steifer Wind? ? w. Korpus-Linguistik (besonders Wörterbücher) w. Parsen w. Terminologie Extraktion (in technischer Literatur) "Projektbeginn" : " Projektbeginn ist am. . . ", "Projekt beginnt am. . . " hs / fub – alp 3 -19 -Bbaum-1 5

Frequenzanalyse u Einfachstes Verfahren: w. Worthistogramm erstellen wdie Wörter, die häufig gemeinsam (z. B. in einem Satz, "in der Nachbarschaft" vorkommen), bilden Kollokation u Unbrauchbar: C(w 1, w 2) 80871 … 15494 …. 11428 w 1 of to w 2 the Nach Manning, New York Times Korpus, 115 MB Text be C(w 1, w 2): Häufigkeit des gemeinsamen Vorkommens. New York hs / fub – alp 3 -19 -Bbaum-1 6

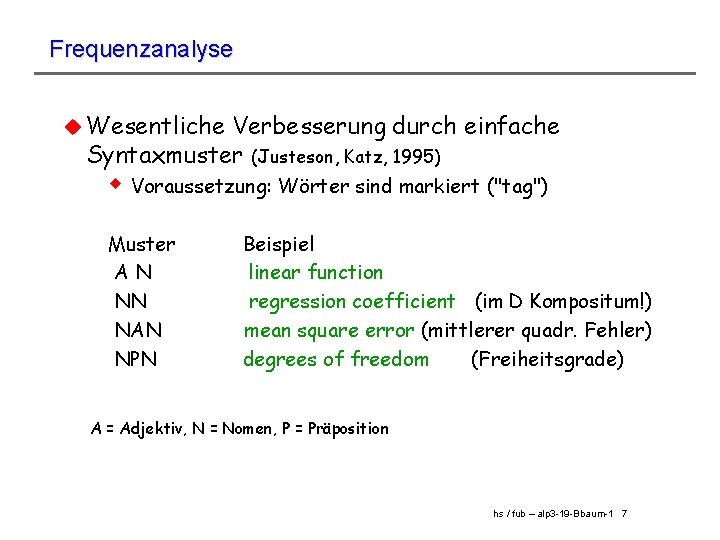

Frequenzanalyse u Wesentliche Verbesserung durch einfache Syntaxmuster (Justeson, Katz, 1995) w Voraussetzung: Wörter sind markiert ("tag") Muster AN NN NAN NPN Beispiel linear function regression coefficient (im D Kompositum!) mean square error (mittlerer quadr. Fehler) degrees of freedom (Freiheitsgrade) A = Adjektiv, N = Nomen, P = Präposition hs / fub – alp 3 -19 -Bbaum-1 7

Frequenzanalyse mit Syntaxfilter u NYT-Korpus (wie oben) mit Justeson / Katz Filter hs / fub – alp 3 -19 -Bbaum-1 8

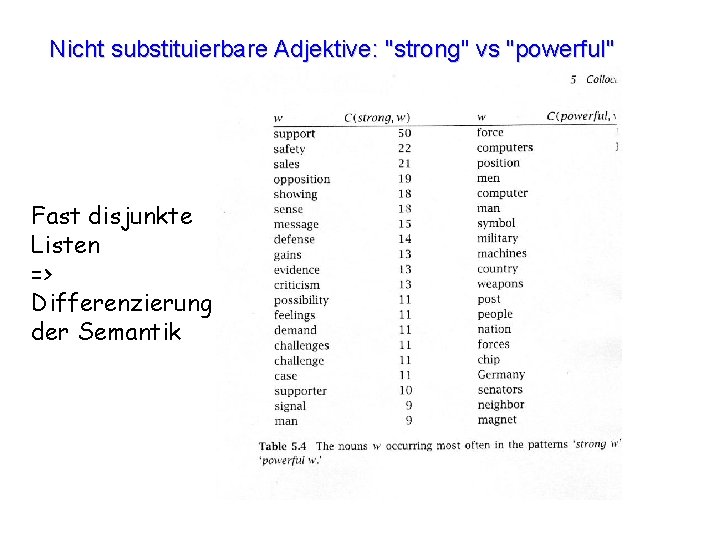

Nicht substituierbare Adjektive: "strong" vs "powerful" Fast disjunkte Listen => Differenzierung der Semantik

Fazit u Einfache quantitative Technik (hier Frequenzfilter) kombiniert mit einfachem linguistischen Wissen liefert erstaunlich gute Ergebnisse u Verbesserungen leicht möglich durch w. Stoppwort-Filter w. Lemmatisierung (Reduktion auf Stammformen) u Aber: w. Große Trainingsmenge w. Bisher nur auf n-Gramme, n klein hs / fub – alp 3 -19 -Bbaum-1 10

Mittelwert und Standardabweichung u Bisher: n-Gramme u Syntaxmuster sonst kaum sinnvoll anwendbar(? ) (oder auch reguläre Ausdrücke sinnvoll? ? ) u Alternative: Fenster der Breite b zulassen wb im allgemeinen klein (5 … 10), da Kollokationen lokales Phänomen sind. w. Beispiel : "Projektbeginn" - "Das Projekt beginnt am 1. 1. 2003" - "Nach Verzögerungen beginnt das Projekt…" - "Das Projekt, an das keiner mehr geglaubt hat, beginnt am…" - "Das Projekt mit der knappsten Personalausstattung beginnt. . " hs / fub – alp 3 -19 -Bbaum-1 11

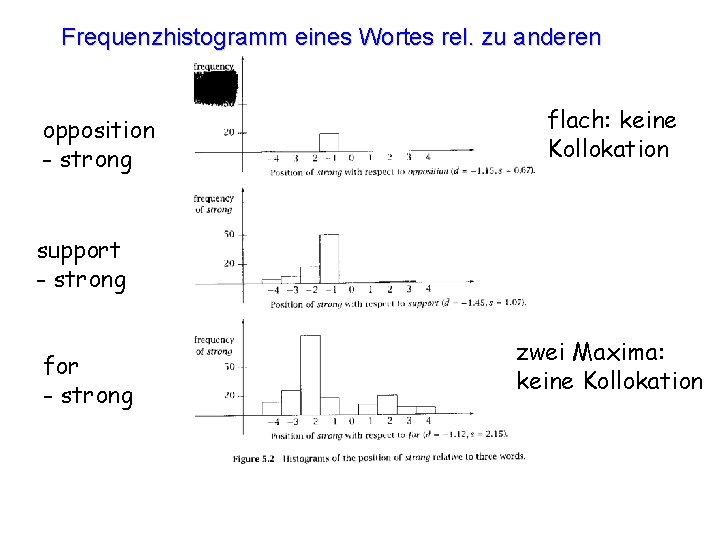

Mittelwert und Standardabweichung u Berechne Mittelwert und Standardabweichung der Wortabstände w. Im Beispiel: d = ¼ *(1+2+7+6) = 4, 0 s = Ö S (di-d)2 /(n-1) = 5, 1… Frequenz/Abstands-Histogramme von zu untersuchendem Wort w und anderen x, y, z sind Indiz für Kollokationen w x, w y, w z (Abb. ) u Hypothese - nur in homogenem Textmaterial anwendbar u "Die Klasse beginnt mit einem import-…" (ok) "Die Aufführung beginnt …" (disjunkte Korpora? ) hs / fub – alp 3 -19 -Bbaum-1 12

Frequenzhistogramm eines Wortes rel. zu anderen opposition - strong flach: keine Kollokation support - strong for - strong zwei Maxima: keine Kollokation

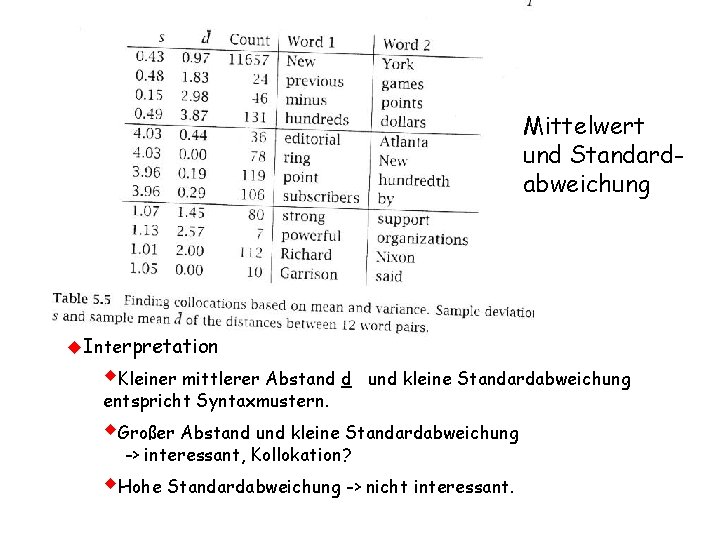

Varian und Mittelwert von Wortändenabst Mittelwert und Standardabweichung u. Interpretation w. Kleiner mittlerer Abstand d entspricht Syntaxmustern. und kleine Standardabweichung w. Großer Abstand und kleine Standardabweichung -> interessant, Kollokation? w. Hohe Standardabweichung -> nicht interessant.

Hypothesentests u Wie lassen sich zufällige Ergebnisse vermeiden? Beispiel: zufällig häufiges Auftreten von "neue" und "Firmen" , etwa in Wirtschaftsartikeln. u Typisches statistisches Problem: Hypothesentests w Nullhypothese: z. B. zwei zufällige Ereignisse sind unabhängig. w Bestimme Wahrscheinlichkeit p, dass sie beide eintreffen, wenn Nullhypothese zutrifft. w Nullhypothese zurückweisen, wenn p zu klein z. B. p <= 0, 05. hs / fub – alp 3 -19 -Bbaum-1 15

Hypothesentests u Beispiel Hypothese: Die Wörter "new" und "companies" kommen unabhängig in Texten vor (keine Kollokation): P(w 1 w 2) = P(w 1) P(w 2) u Statistische Testverfahren z. B. t-Test : w Gegeben N Messungen, errechneter Mittelwert x und Varianz s 2. w Zu testen die Nullhypothese: Daten sind aus einer Menge mit gegebene Verteilung und Mittelwert m. w. Technisch: berechnen des t-Wertes: t = (x – m) /( Ö s 2/N ) wt-Verteilung liefert Konfidenzniveau, auf dem Nullhypothese verworfen oder akzeptiert wird. hs / fub – alp 3 -19 -Bbaum-1 16

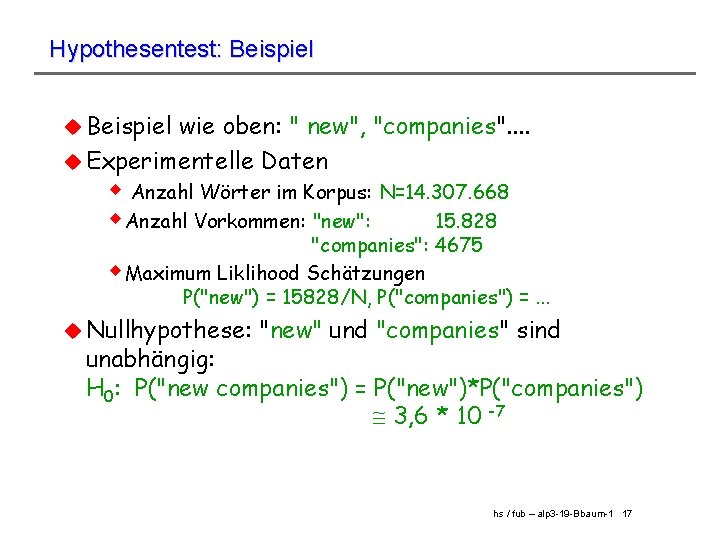

Hypothesentest: Beispiel u Beispiel wie oben: " new", "companies". . u Experimentelle Daten w Anzahl Wörter im Korpus: N=14. 307. 668 w. Anzahl Vorkommen: "new": 15. 828 "companies": 4675 w. Maximum Liklihood Schätzungen P("new") = 15828/N, P("companies") =. . . u Nullhypothese: "new" und "companies" sind unabhängig: H 0: P("new companies") = P("new")*P("companies") 3, 6 * 10 -7 hs / fub – alp 3 -19 -Bbaum-1 17

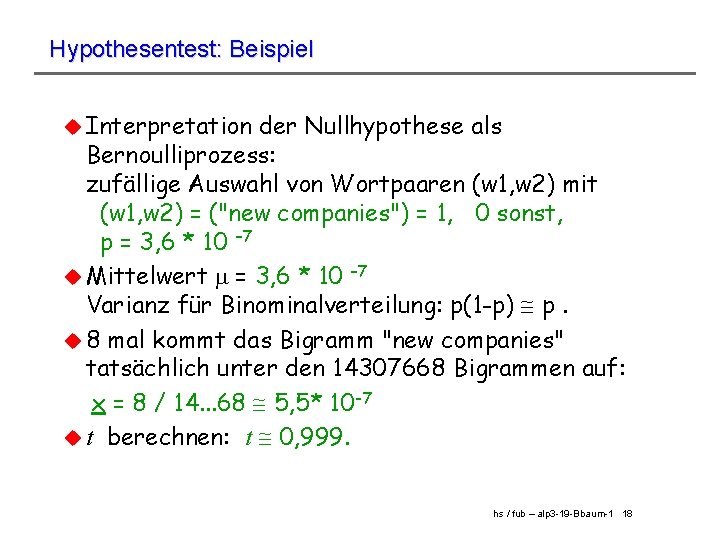

Hypothesentest: Beispiel u Interpretation der Nullhypothese als Bernoulliprozess: zufällige Auswahl von Wortpaaren (w 1, w 2) mit (w 1, w 2) = ("new companies") = 1, 0 sonst, p = 3, 6 * 10 – 7 u Mittelwert m = 3, 6 * 10 – 7 Varianz für Binominalverteilung: p(1 -p) p. u 8 mal kommt das Bigramm "new companies" tatsächlich unter den 14307668 Bigrammen auf: x = 8 / 14. . . 68 5, 5* 10 -7 u t berechnen: t 0, 999. hs / fub – alp 3 -19 -Bbaum-1 18

Beispiel: Hypothesentest u Kritischer Wert für Konfidenz p = 0, 995 , dass Nullhypothese zutrifft ist t 0 = 2, 576. u Nullhypothese ist für t > t 0 zurückzuweisen. Trifft hier NICHT zu => "new companies" keine Kollokation (Bestätigung der Null-Hypothese) hs / fub – alp 3 -19 -Bbaum-1 19

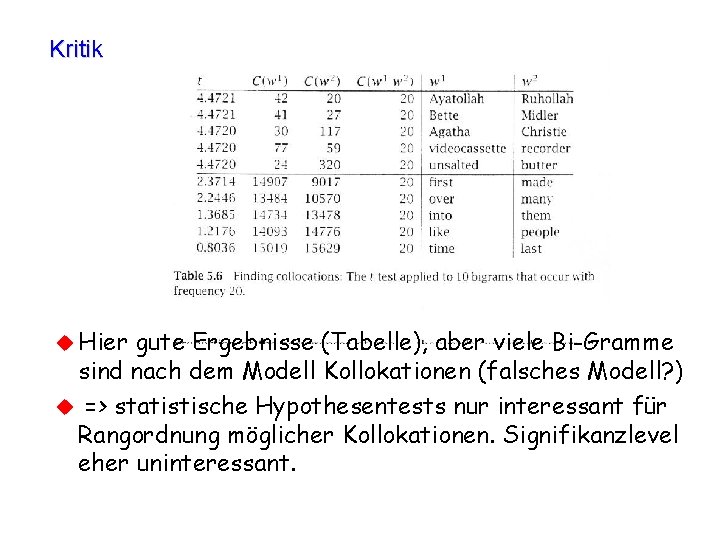

Kritik u Hier gute Ergebnisse (Tabelle), aber viele Bi-Gramme sind nach dem Modell Kollokationen (falsches Modell? ) u => statistische Hypothesentests nur interessant für Rangordnung möglicher Kollokationen. Signifikanzlevel eher uninteressant.

Andere Verfahren u Relative Frequenzen: w. Mehre Korpora w. Erwartet: Verhältnis der Frequenzen nahe 1 w. Aber: Sprachentwicklung. "Prager Fühling", "east Berliners", . . . w. Interessant, um Fachterminologie von anderen Kollokationen zu trennen. D u Informationstheoretisches Maß I(w, v) = log ( P(w v) / (P(w)P(v)) ) = log (P( w|v) / P(w)) =. . . "Welche Information liefert w über v bzw. v über w" w. Brauchbares Maß für Unabhängigkeit von w, v, aber insgesamt für Kollokations-Analyse wenig geeignet. hs / fub – alp 3 -19 -Bbaum-1 21

Allgemeines zu probabilistischen Sprachmodellen u Jeder Wortfolge t = w 1 w 2…wn wird Wahrscheinlichkeit p(t) zugeordnet u Verkettung und bedingte Wahrscheinlichkeiten für Text t: p(t) = p(w 1…wn) = p(w 1) … p(wn|w 1, …wn-1) mit p(wk | w 1…wk-1) = p(w 1…wk) / P(w 1…wk-1) C(w 1…wk) / C(w 1…wk-1) (C: Empirische Frequenzen der Folgen) Diese "Verkettungsregel" führt zu einem Historienbasierten Modell´. u Historien clustern, um riesige Parametermenge zu reduzieren. u hs / fub – alp 3 -19 -Bbaum-1 22

n-gram Modelle u Klassische statistische Sprachmodelle u Jedes Wort wird in einem begrenzten Kontext entsprechen einer bedingten Wahrscheinlichkeit vorhergesagt. u Tabellen… w. P(of|both) w. P(to|both) w. P(in|both) w 1 w 2 = = = 0, 066 0, 041 0, 038 w 3 wn n klein, lokaler Kontext. hs / fub – alp 3 -19 -Bbaum-1 23

n-gram -Modelle u Fragwürdig, weil Distanz von aufeinander Einfluß habenden Wörtern SEHR groß ist. "Der Politiker, wohl wissend, dass seine anstehende Entscheidung zur Reform des Arbeitsmarktes erhebliche Auswirkung auf das Leben des Einzelnen, besonders des gering Verdienenden, haben würde, liess sich in seinem Vorhaben nicht beirren. " u Nützlich… w… weil solche Sätze selten sind w Empirische Untersuchungen: 74% Abhängigkeit zwischen benachbarten Wörtern (einfache Nominalphrasen als Wörter gezählt), 95% innerhalb 1… 5 Wörtern. hs / fub – alp 3 -19 -Bbaum-1 24

- Slides: 24