Stark korrelation mellan frklaringsvariabler Exempel Vad pverkar kostnaden

Stark korrelation mellan förklaringsvariabler. Exempel: Vad påverkar kostnaden för produktion av korrugerat papper, dvs sådant som ingår i wellpapp och kartonger? Amerikansk studie: Kostnaden kan förmodligen förklaras av en eller flera av följande variabler: • produktionsmängden (PAPER) • maskintid (MACHINE) • overhead-kostnader (OVERHEAD) • antal direkta personarbetstimmar (LABOR)

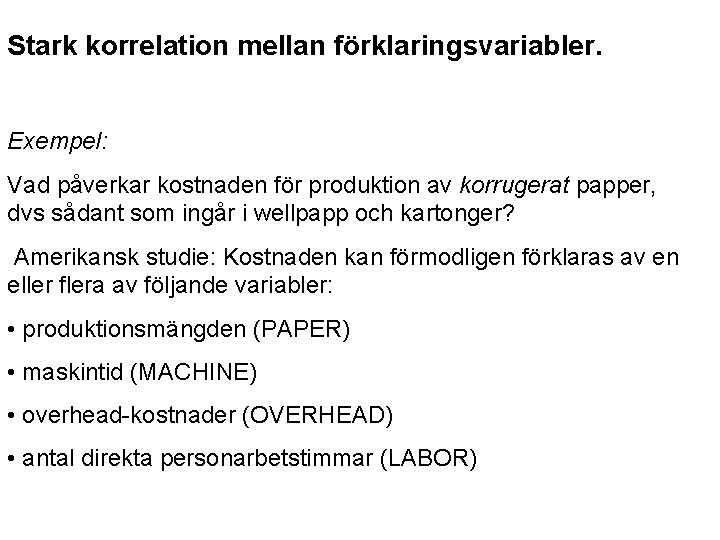

Insamlade månadsvisa data: MONTH COST PAPER MACHINE OVERHEAD LABOR 1 1102 550 218 112 325 2 1008 502 199 99 301 3 1227 616 249 126 376 4 1395 701 277 143 419 … … … 27 1388 704 281 142 429

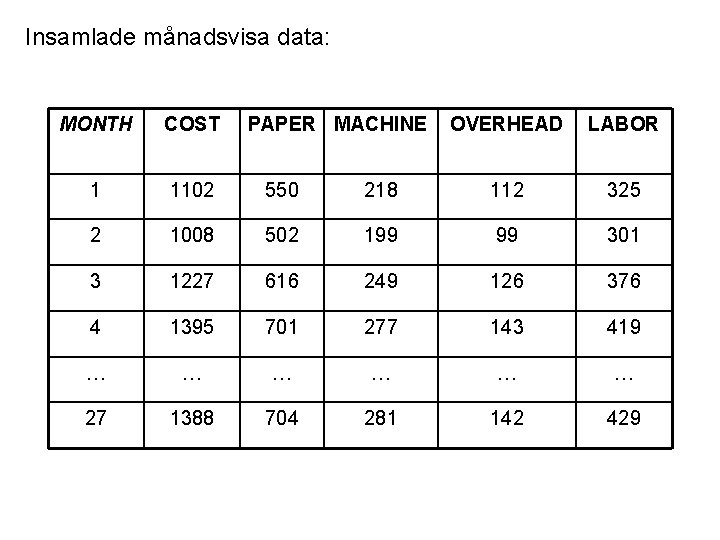

Grafisk illustration av ev. samband:

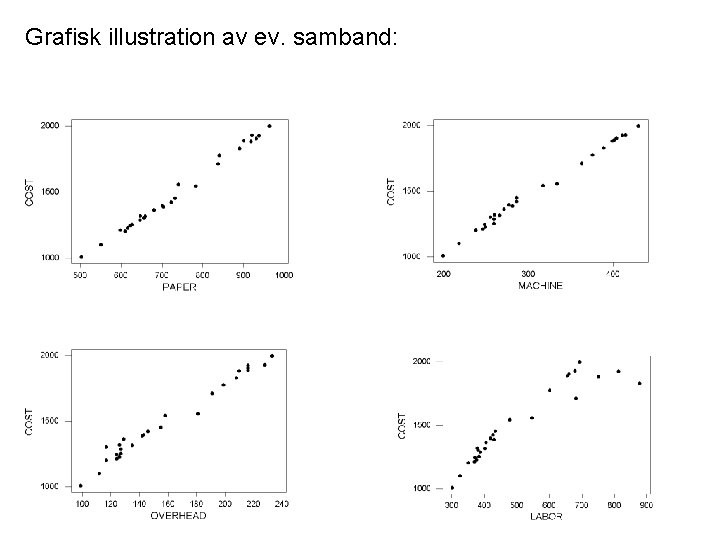

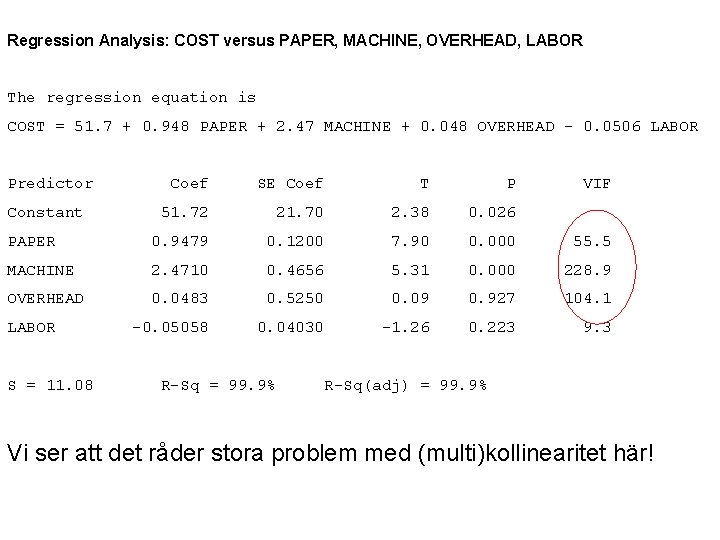

Pröva först en modell där kostnaden förklaras av samtliga förklaringsvariabler: Regression Analysis: COST versus PAPER, MACHINE, OVERHEAD, LABOR The regression equation is COST = 51. 7 + 0. 948 PAPER + 2. 47 MACHINE + 0. 048 OVERHEAD - 0. 0506 LABOR Predictor Coef SE Coef T P 51. 72 21. 70 2. 38 0. 026 PAPER 0. 9479 0. 1200 7. 90 0. 000 MACHINE 2. 4710 0. 4656 5. 31 0. 000 OVERHEAD 0. 0483 0. 5250 0. 09 0. 927 -0. 05058 0. 04030 -1. 26 0. 223 Constant LABOR S = 11. 08 R-Sq = 99. 9% R-Sq(adj) = 99. 9% Hög förklaringsgrad, men alla x-variabler är ej signifikanta

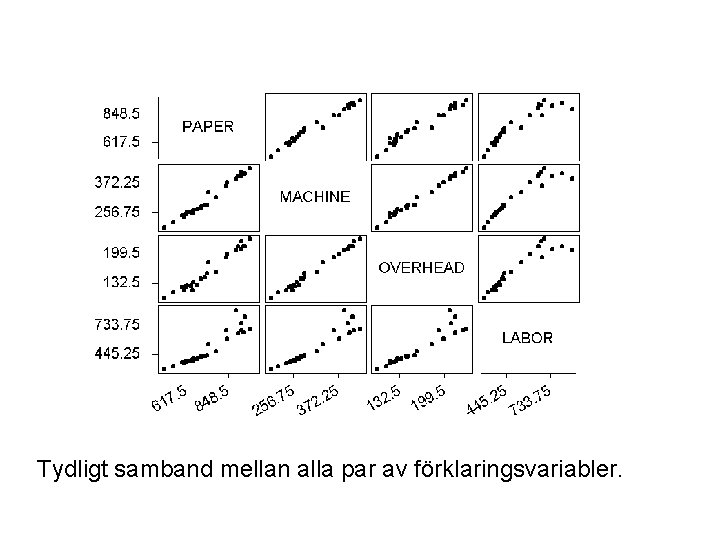

Varför kan vi inte hitta samma samband i regressionsmodellen som vi såg genom visuell inspektion? Kan det vara så att förklaringsvariablerna ”överlappar” varandra när det gäller att förklara kostnaden? Vi kan undersöka detta genom att plotta de förklarande variablerna mot varandra.

Tydligt samband mellan alla par av förklaringsvariabler.

Vi kan också beräkna parvisa korrelationskoefficienter mellan förklaringsvariabler: Correlations: PAPER, MACHINE, OVERHEAD PAPER MACHINE 0. 989 OVERHEAD 0. 978 MACHINE 0. 994 Cell Contents: Pearson correlation och vi ser att samtliga korrelationer ligger mycket nära 1.

Om korrelationen är hög (över 0. 9) mellan två förklaringsvariabler kan modellen bli svår att analysera. Vi kan t. ex. få: • konstiga värden på parameterskattningar (t. ex. negativa lutningsparametrar där sambandet ska vara positivt) • förklaringsvariabler är inte signifikanta, fastän man kan se ett tydligt linjärt samband mellan variabeln och responsen Eftersom flera förklarande variabler representerar samma påverkan är det svårt att separera vad i varje förklaringsvariabel som främst förklarar variationen i y.

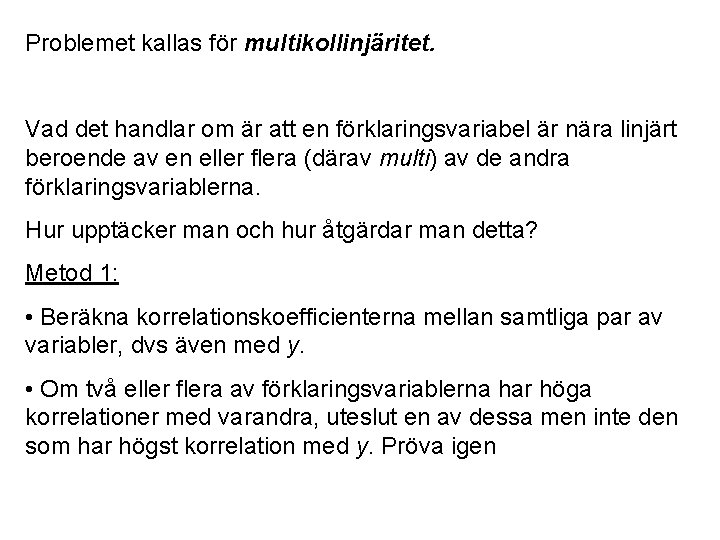

Problemet kallas för multikollinjäritet. Vad det handlar om är att en förklaringsvariabel är nära linjärt beroende av en eller flera (därav multi) av de andra förklaringsvariablerna. Hur upptäcker man och hur åtgärdar man detta? Metod 1: • Beräkna korrelationskoefficienterna mellan samtliga par av variabler, dvs även med y. • Om två eller flera av förklaringsvariablerna har höga korrelationer med varandra, uteslut en av dessa men inte den som har högst korrelation med y. Pröva igen

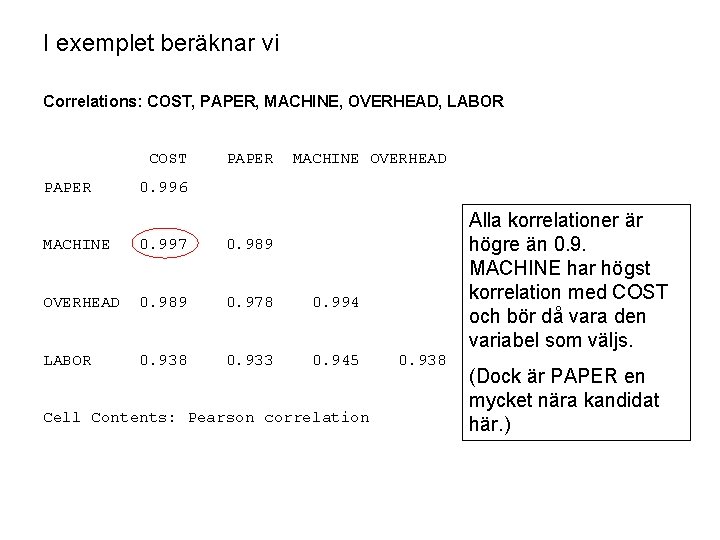

I exemplet beräknar vi Correlations: COST, PAPER, MACHINE, OVERHEAD, LABOR COST PAPER MACHINE OVERHEAD 0. 996 MACHINE 0. 997 0. 989 OVERHEAD 0. 989 0. 978 0. 994 LABOR 0. 938 0. 933 0. 945 Cell Contents: Pearson correlation 0. 938 Alla korrelationer är högre än 0. 9. MACHINE har högst korrelation med COST och bör då vara den variabel som väljs. (Dock är PAPER en mycket nära kandidat här. )

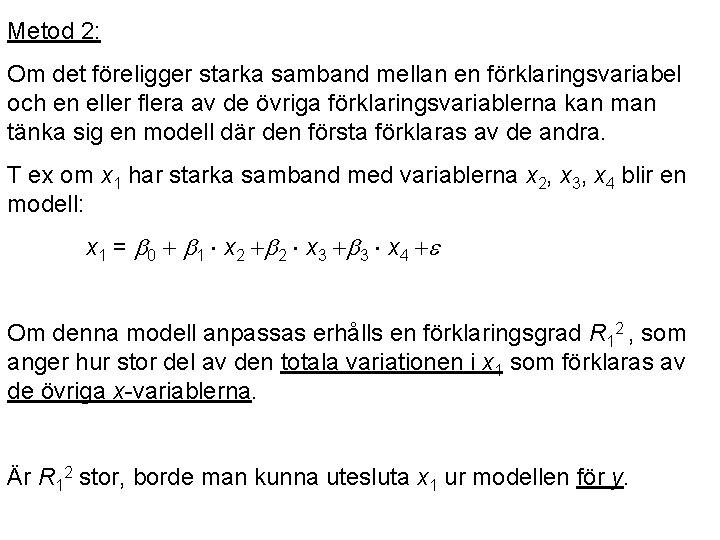

Metod 2: Om det föreligger starka samband mellan en förklaringsvariabel och en eller flera av de övriga förklaringsvariablerna kan man tänka sig en modell där den första förklaras av de andra. T ex om x 1 har starka samband med variablerna x 2, x 3, x 4 blir en modell: x 1 = 0 1 x 2 2 x 3 3 x 4 Om denna modell anpassas erhålls en förklaringsgrad R 12 , som anger hur stor del av den totala variationen i x 1 som förklaras av de övriga x-variablerna. Är R 12 stor, borde man kunna utesluta x 1 ur modellen för y.

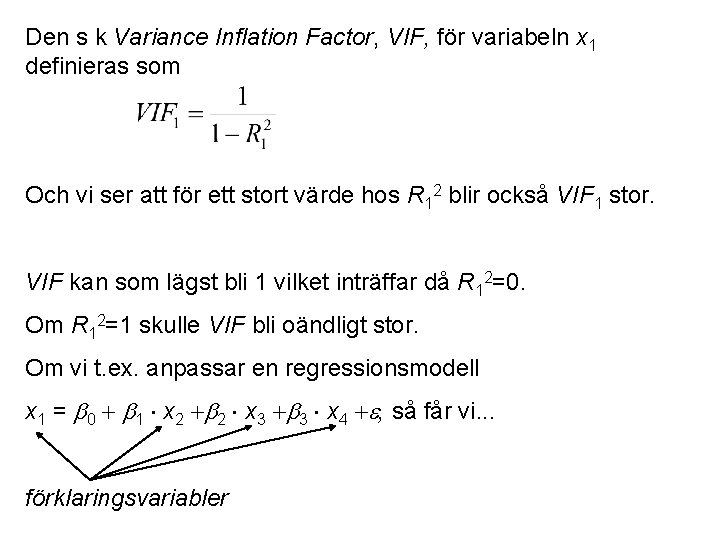

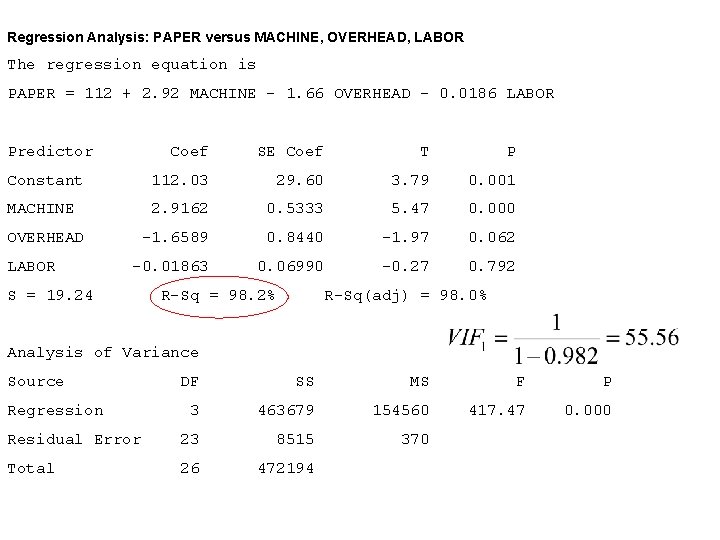

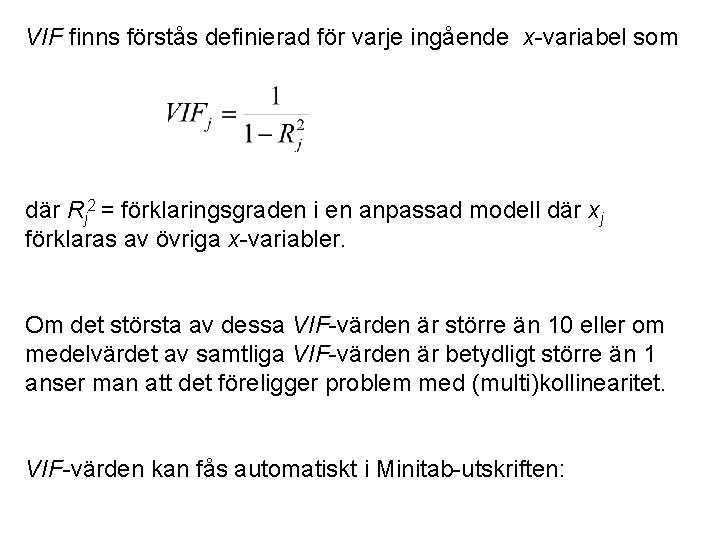

Den s k Variance Inflation Factor, VIF, för variabeln x 1 definieras som Och vi ser att för ett stort värde hos R 12 blir också VIF 1 stor. VIF kan som lägst bli 1 vilket inträffar då R 12=0. Om R 12=1 skulle VIF bli oändligt stor. Om vi t. ex. anpassar en regressionsmodell x 1 = 0 1 x 2 2 x 3 3 x 4 , så får vi. . . förklaringsvariabler

Regression Analysis: PAPER versus MACHINE, OVERHEAD, LABOR The regression equation is PAPER = 112 + 2. 92 MACHINE - 1. 66 OVERHEAD - 0. 0186 LABOR Predictor Coef SE Coef T P Constant 112. 03 29. 60 3. 79 0. 001 MACHINE 2. 9162 0. 5333 5. 47 0. 000 -1. 6589 0. 8440 -1. 97 0. 062 -0. 01863 0. 06990 -0. 27 0. 792 OVERHEAD LABOR S = 19. 24 R-Sq = 98. 2% R-Sq(adj) = 98. 0% Analysis of Variance Source DF SS MS F P 3 463679 154560 417. 47 0. 000 Residual Error 23 8515 370 Total 26 472194 Regression

VIF finns förstås definierad för varje ingående x-variabel som där Rj 2 = förklaringsgraden i en anpassad modell där xj förklaras av övriga x-variabler. Om det största av dessa VIF-värden är större än 10 eller om medelvärdet av samtliga VIF-värden är betydligt större än 1 anser man att det föreligger problem med (multi)kollinearitet. VIF-värden kan fås automatiskt i Minitab-utskriften:

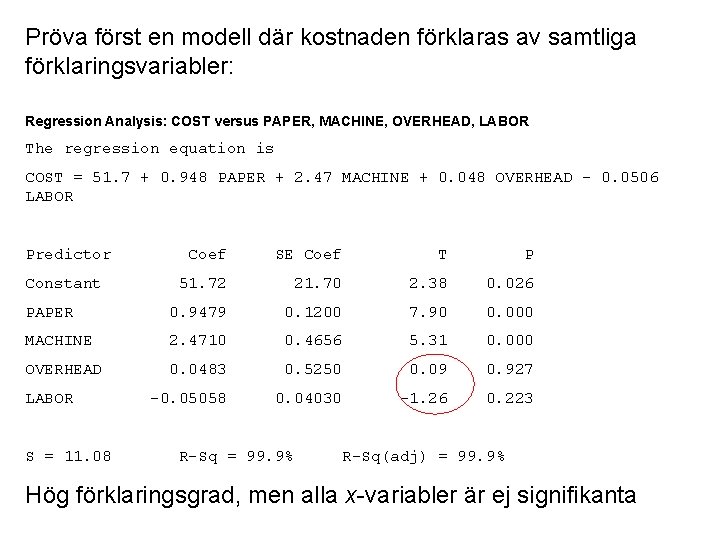

Regression Analysis: COST versus PAPER, MACHINE, OVERHEAD, LABOR The regression equation is COST = 51. 7 + 0. 948 PAPER + 2. 47 MACHINE + 0. 048 OVERHEAD - 0. 0506 LABOR Predictor Coef SE Coef T P 51. 72 21. 70 2. 38 0. 026 PAPER 0. 9479 0. 1200 7. 90 0. 000 55. 5 MACHINE 2. 4710 0. 4656 5. 31 0. 000 228. 9 OVERHEAD 0. 0483 0. 5250 0. 09 0. 927 104. 1 -0. 05058 0. 04030 -1. 26 0. 223 9. 3 Constant LABOR S = 11. 08 R-Sq = 99. 9% VIF R-Sq(adj) = 99. 9% Vi ser att det råder stora problem med (multi)kollinearitet här!

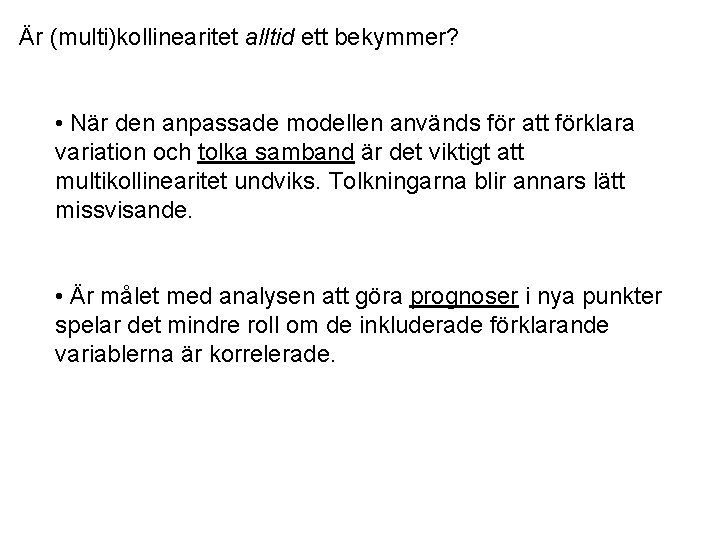

Är (multi)kollinearitet alltid ett bekymmer? • När den anpassade modellen används för att förklara variation och tolka samband är det viktigt att multikollinearitet undviks. Tolkningarna blir annars lätt missvisande. • Är målet med analysen att göra prognoser i nya punkter spelar det mindre roll om de inkluderade förklarande variablerna är korrelerade.

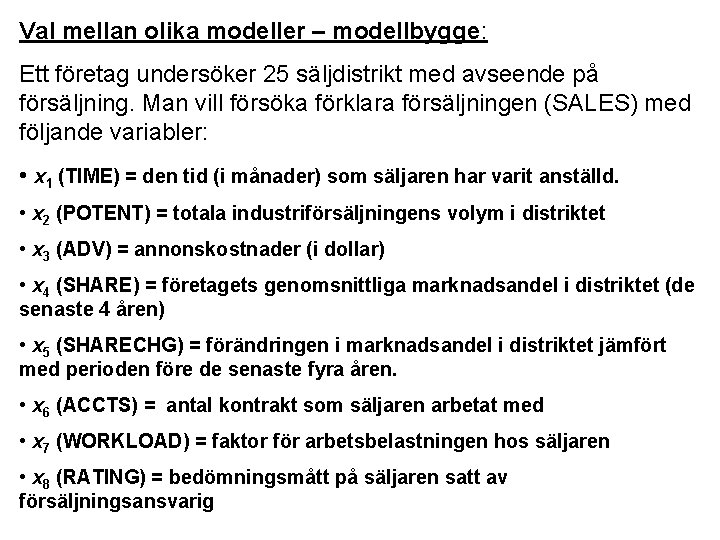

Val mellan olika modeller – modellbygge: Ett företag undersöker 25 säljdistrikt med avseende på försäljning. Man vill försöka förklara försäljningen (SALES) med följande variabler: • x 1 (TIME) = den tid (i månader) som säljaren har varit anställd. • x 2 (POTENT) = totala industriförsäljningens volym i distriktet • x 3 (ADV) = annonskostnader (i dollar) • x 4 (SHARE) = företagets genomsnittliga marknadsandel i distriktet (de senaste 4 åren) • x 5 (SHARECHG) = förändringen i marknadsandel i distriktet jämfört med perioden före de senaste fyra åren. • x 6 (ACCTS) = antal kontrakt som säljaren arbetat med • x 7 (WORKLOAD) = faktor för arbetsbelastningen hos säljaren • x 8 (RATING) = bedömningsmått på säljaren satt av försäljningsansvarig

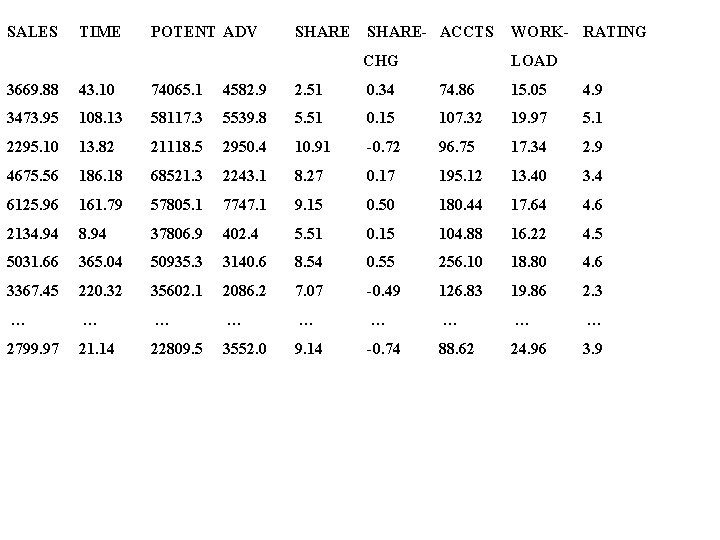

SALES TIME POTENT ADV SHARE- ACCTS WORK- RATING CHG LOAD 3669. 88 43. 10 74065. 1 4582. 9 2. 51 0. 34 74. 86 15. 05 4. 9 3473. 95 108. 13 58117. 3 5539. 8 5. 51 0. 15 107. 32 19. 97 5. 1 2295. 10 13. 82 21118. 5 2950. 4 10. 91 -0. 72 96. 75 17. 34 2. 9 4675. 56 186. 18 68521. 3 2243. 1 8. 27 0. 17 195. 12 13. 40 3. 4 6125. 96 161. 79 57805. 1 7747. 1 9. 15 0. 50 180. 44 17. 64 4. 6 2134. 94 8. 94 37806. 9 402. 4 5. 51 0. 15 104. 88 16. 22 4. 5 5031. 66 365. 04 50935. 3 3140. 6 8. 54 0. 55 256. 10 18. 80 4. 6 3367. 45 220. 32 35602. 1 2086. 2 7. 07 -0. 49 126. 83 19. 86 2. 3 … … … … … 2799. 97 21. 14 22809. 5 3552. 0 9. 14 -0. 74 88. 62 24. 96 3. 9

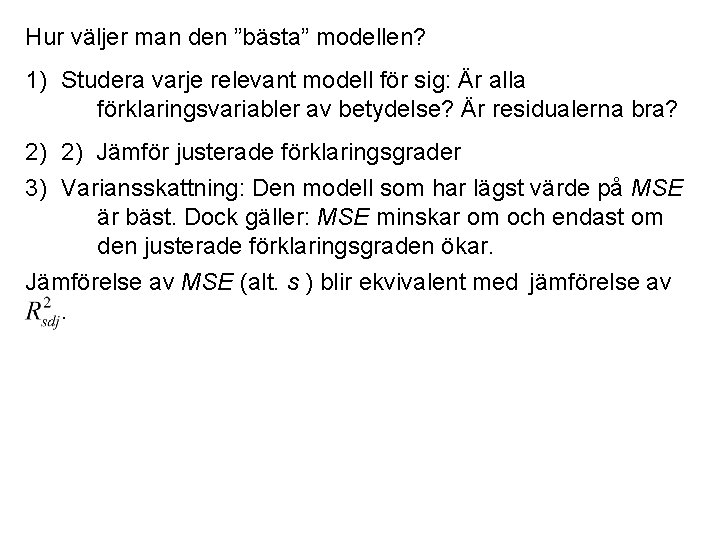

Hur väljer man den ”bästa” modellen? 1) Studera varje relevant modell för sig: Är alla förklaringsvariabler av betydelse? Är residualerna bra? 2) 2) Jämför justerade förklaringsgrader 3) Variansskattning: Den modell som har lägst värde på MSE är bäst. Dock gäller: MSE minskar om och endast om den justerade förklaringsgraden ökar. Jämförelse av MSE (alt. s ) blir ekvivalent med jämförelse av.

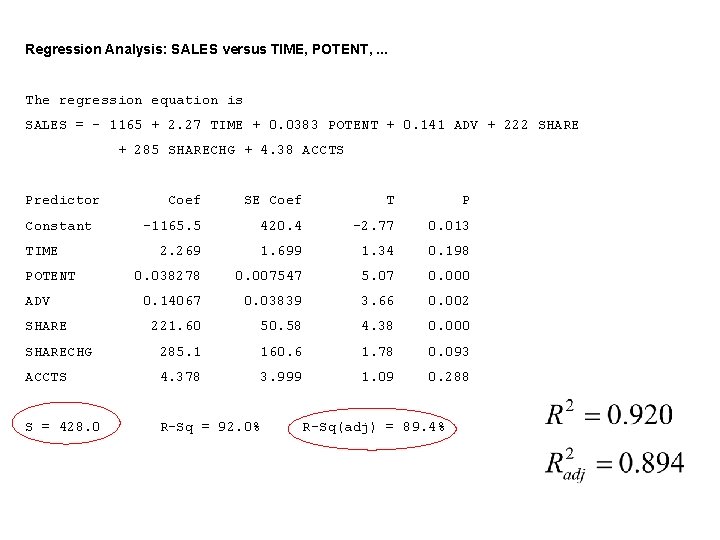

Regression Analysis: SALES versus TIME, POTENT, . . . The regression equation is SALES = - 1165 + 2. 27 TIME + 0. 0383 POTENT + 0. 141 ADV + 222 SHARE + 285 SHARECHG + 4. 38 ACCTS Predictor Coef SE Coef T P -1165. 5 420. 4 -2. 77 0. 013 2. 269 1. 699 1. 34 0. 198 0. 038278 0. 007547 5. 07 0. 000 0. 14067 0. 03839 3. 66 0. 002 221. 60 50. 58 4. 38 0. 000 SHARECHG 285. 1 160. 6 1. 78 0. 093 ACCTS 4. 378 3. 999 1. 09 0. 288 S = 428. 0 R-Sq = 92. 0% Constant TIME POTENT ADV SHARE R-Sq(adj) = 89. 4%

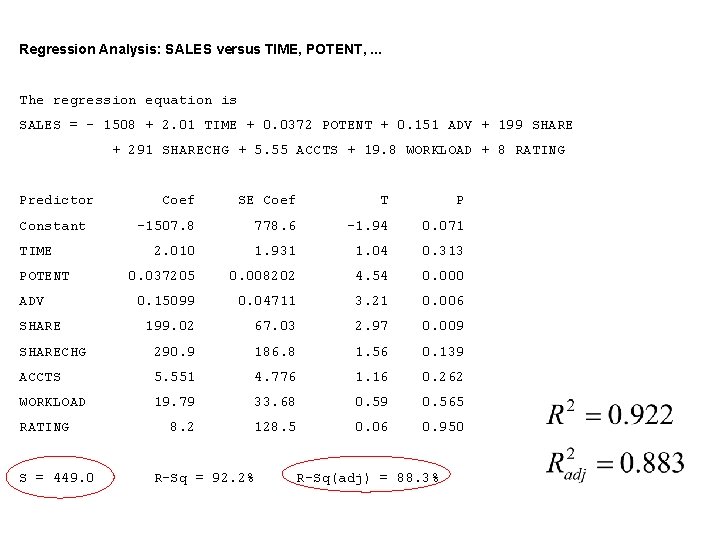

Regression Analysis: SALES versus TIME, POTENT, . . . The regression equation is SALES = - 1508 + 2. 01 TIME + 0. 0372 POTENT + 0. 151 ADV + 199 SHARE + 291 SHARECHG + 5. 55 ACCTS + 19. 8 WORKLOAD + 8 RATING Predictor Coef SE Coef T P -1507. 8 778. 6 -1. 94 0. 071 2. 010 1. 931 1. 04 0. 313 0. 037205 0. 008202 4. 54 0. 000 0. 15099 0. 04711 3. 21 0. 006 199. 02 67. 03 2. 97 0. 009 SHARECHG 290. 9 186. 8 1. 56 0. 139 ACCTS 5. 551 4. 776 1. 16 0. 262 WORKLOAD 19. 79 33. 68 0. 59 0. 565 8. 2 128. 5 0. 06 0. 950 Constant TIME POTENT ADV SHARE RATING S = 449. 0 R-Sq = 92. 2% R-Sq(adj) = 88. 3%

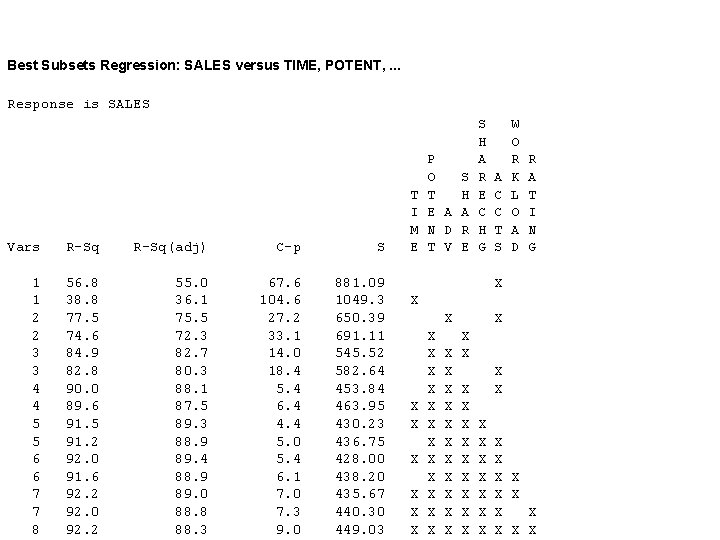

Minitab: Vi använder funktionen ’best subset regression’ för att ta fram de två bästa modellerna i varje modellstorlek (de två som har de högsta R 2 -värdena). Modellstorlek: antal förklarande variabler i modellen Förutom R 2 -värdena får vi med ’best subsets’ metoden även justerade förklaringsgrader, s.

Best Subsets Regression: SALES versus TIME, POTENT, . . . Response is SALES Vars R-Sq(adj) C-p S 1 1 2 2 3 3 4 4 5 5 6 6 7 7 8 56. 8 38. 8 77. 5 74. 6 84. 9 82. 8 90. 0 89. 6 91. 5 91. 2 92. 0 91. 6 92. 2 92. 0 92. 2 55. 0 36. 1 75. 5 72. 3 82. 7 80. 3 88. 1 87. 5 89. 3 88. 9 89. 4 88. 9 89. 0 88. 8 88. 3 67. 6 104. 6 27. 2 33. 1 14. 0 18. 4 5. 4 6. 4 4. 4 5. 0 5. 4 6. 1 7. 0 7. 3 9. 0 881. 09 1049. 3 650. 39 691. 11 545. 52 582. 64 453. 84 463. 95 430. 23 436. 75 428. 00 438. 20 435. 67 440. 30 449. 03 T I M E P O S T H E A A N D R T V E S H A R E C H G A C C T S W O R K L O A D R A T I N G X X X X X X X X X X X X X X X X

Automatiserat modellval: – Framåtval: Forward Selection – Bakåtval: Backward Selection – Stegvis Regression: Stepwise regression Gemensamt för de här metoderna är att man testar en variabel i taget. Med hjälp av några kriterier som man bestämmer i förväg kan man sen avgöra om denna variabel ska läggas till i modellen (tas bort från modellen) eller inte.

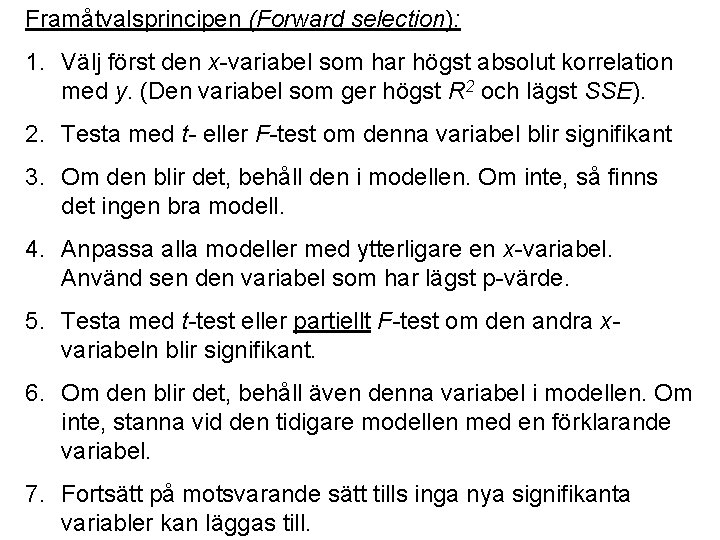

Framåtvalsprincipen (Forward selection): 1. Välj först den x-variabel som har högst absolut korrelation med y. (Den variabel som ger högst R 2 och lägst SSE). 2. Testa med t- eller F-test om denna variabel blir signifikant 3. Om den blir det, behåll den i modellen. Om inte, så finns det ingen bra modell. 4. Anpassa alla modeller med ytterligare en x-variabel. Använd sen den variabel som har lägst p-värde. 5. Testa med t-test eller partiellt F-test om den andra xvariabeln blir signifikant. 6. Om den blir det, behåll även denna variabel i modellen. Om inte, stanna vid den tidigare modellen med en förklarande variabel. 7. Fortsätt på motsvarande sätt tills inga nya signifikanta variabler kan läggas till.

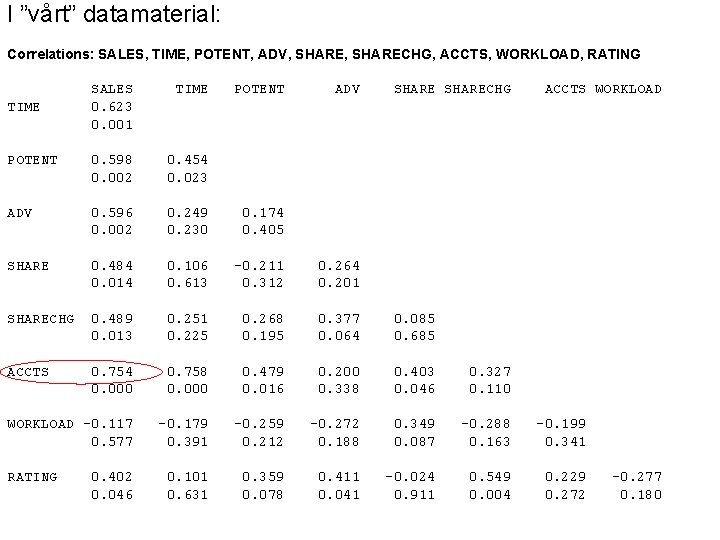

I ”vårt” datamaterial: Correlations: SALES, TIME, POTENT, ADV, SHARECHG, ACCTS, WORKLOAD, RATING SALES 0. 623 0. 001 TIME POTENT 0. 598 0. 002 0. 454 0. 023 ADV 0. 596 0. 002 0. 249 0. 230 0. 174 0. 405 SHARE 0. 484 0. 014 0. 106 0. 613 -0. 211 0. 312 0. 264 0. 201 SHARECHG 0. 489 0. 013 0. 251 0. 225 0. 268 0. 195 0. 377 0. 064 0. 085 0. 685 ACCTS 0. 754 0. 000 0. 758 0. 000 0. 479 0. 016 0. 200 0. 338 0. 403 0. 046 0. 327 0. 110 WORKLOAD -0. 117 0. 577 -0. 179 0. 391 -0. 259 0. 212 -0. 272 0. 188 0. 349 0. 087 -0. 288 0. 163 -0. 199 0. 341 0. 101 0. 631 0. 359 0. 078 0. 411 0. 041 -0. 024 0. 911 0. 549 0. 004 0. 229 0. 272 TIME RATING 0. 402 0. 046 POTENT ADV SHARECHG ACCTS WORKLOAD -0. 277 0. 180

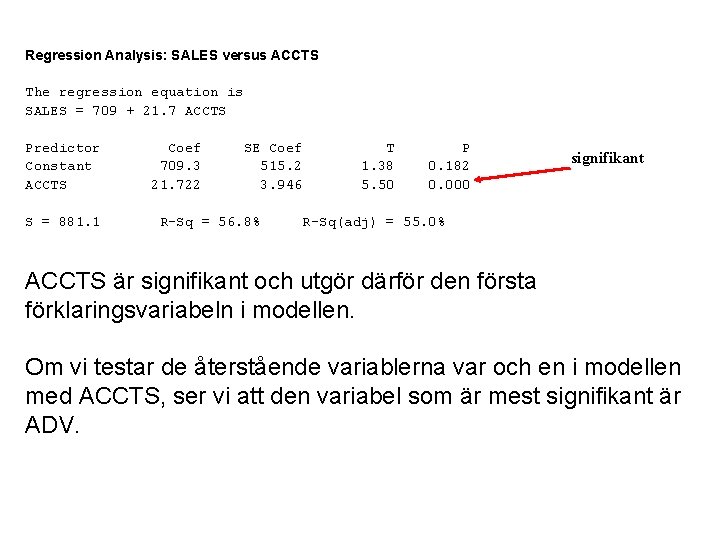

Regression Analysis: SALES versus ACCTS The regression equation is SALES = 709 + 21. 7 ACCTS Predictor Constant ACCTS S = 881. 1 Coef 709. 3 21. 722 SE Coef 515. 2 3. 946 R-Sq = 56. 8% T 1. 38 5. 50 P 0. 182 0. 000 signifikant R-Sq(adj) = 55. 0% ACCTS är signifikant och utgör därför den första förklaringsvariabeln i modellen. Om vi testar de återstående variablerna var och en i modellen med ACCTS, ser vi att den variabel som är mest signifikant är ADV.

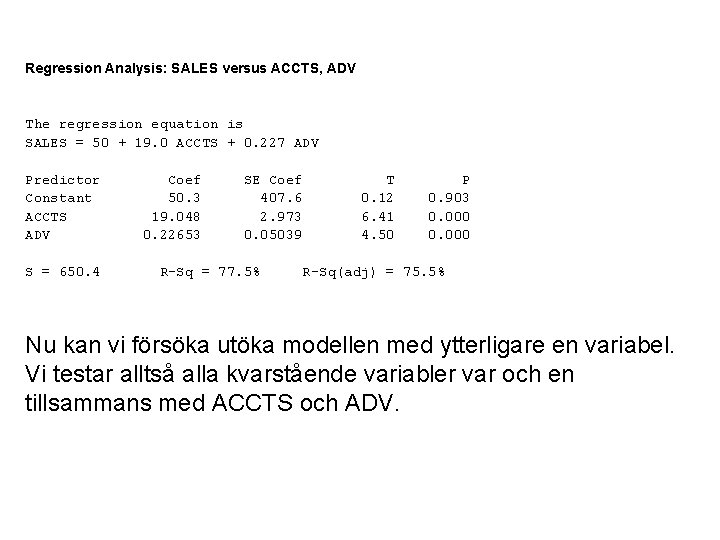

Regression Analysis: SALES versus ACCTS, ADV The regression equation is SALES = 50 + 19. 0 ACCTS + 0. 227 ADV Predictor Constant ACCTS ADV S = 650. 4 Coef 50. 3 19. 048 0. 22653 SE Coef 407. 6 2. 973 0. 05039 R-Sq = 77. 5% T 0. 12 6. 41 4. 50 P 0. 903 0. 000 R-Sq(adj) = 75. 5% Nu kan vi försöka utöka modellen med ytterligare en variabel. Vi testar alltså alla kvarstående variabler var och en tillsammans med ACCTS och ADV.

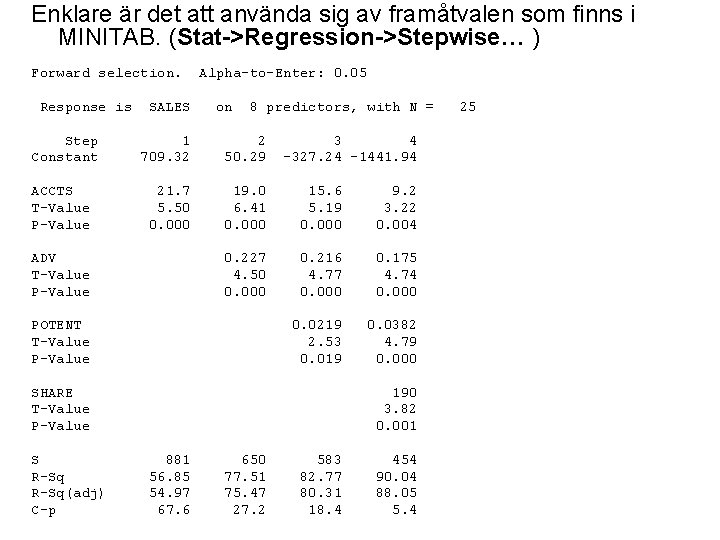

Enklare är det att använda sig av framåtvalen som finns i MINITAB. (Stat->Regression->Stepwise… ) Forward selection. Response is Step Constant ACCTS T-Value P-Value SALES Alpha-to-Enter: 0. 05 on 8 predictors, with N = 1 709. 32 2 50. 29 21. 7 5. 50 0. 000 19. 0 6. 41 0. 000 15. 6 5. 19 0. 000 9. 2 3. 22 0. 004 0. 227 4. 50 0. 000 0. 216 4. 77 0. 000 0. 175 4. 74 0. 000 0. 0219 2. 53 0. 019 0. 0382 4. 79 0. 000 ADV T-Value POTENT T-Value P-Value 3 4 -327. 24 -1441. 94 SHARE T-Value P-Value S R-Sq(adj) C-p 190 3. 82 0. 001 881 56. 85 54. 97 67. 6 650 77. 51 75. 47 27. 2 583 82. 77 80. 31 18. 4 454 90. 04 88. 05 5. 4 25

Bakåtelimineringsprincipen (Backward elimination ): 1. Anpassa modellen med samtliga tillgängliga förklrande variabler. 2. Om alla förklaringsvariabler är signifikanta blir detta den slutliga modellen. 3. Om en eller flera variabler ej är signifikanta ta bort den variabel som har lägst absolut t-kvot (högst p-värde). 4. Anpassa en ny modell med de variabler som är kvar. Om alla förklaringsvariabler i denna modell är signifikanta är det den slutliga modellen. 5. Om en eller flera variabler ej är signifikanta, ta bort den med högst p-värde. 6. Upprepa förfarandet till dess att samtliga ingående förklaringsvariabler är signifikanta.

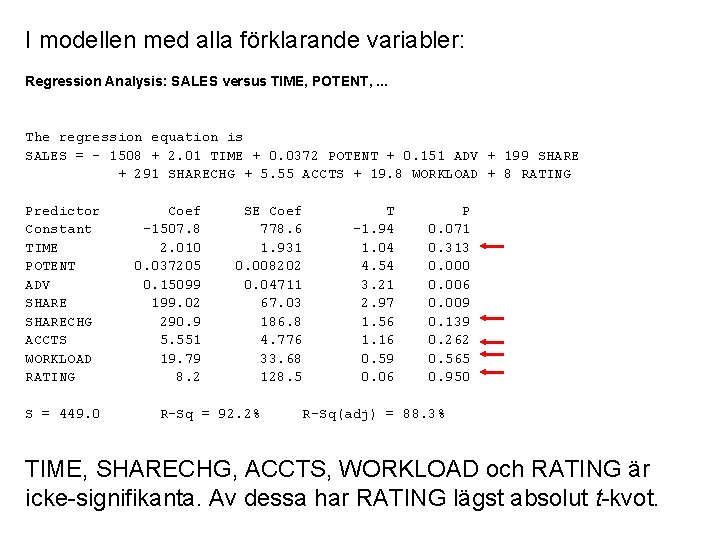

I modellen med alla förklarande variabler: Regression Analysis: SALES versus TIME, POTENT, . . . The regression equation is SALES = - 1508 + 2. 01 TIME + 0. 0372 POTENT + 0. 151 ADV + 199 SHARE + 291 SHARECHG + 5. 55 ACCTS + 19. 8 WORKLOAD + 8 RATING Predictor Constant TIME POTENT ADV SHARECHG ACCTS WORKLOAD RATING S = 449. 0 Coef -1507. 8 2. 010 0. 037205 0. 15099 199. 02 290. 9 5. 551 19. 79 8. 2 SE Coef 778. 6 1. 931 0. 008202 0. 04711 67. 03 186. 8 4. 776 33. 68 128. 5 R-Sq = 92. 2% T -1. 94 1. 04 4. 54 3. 21 2. 97 1. 56 1. 16 0. 59 0. 06 P 0. 071 0. 313 0. 000 0. 006 0. 009 0. 139 0. 262 0. 565 0. 950 R-Sq(adj) = 88. 3% TIME, SHARECHG, ACCTS, WORKLOAD och RATING är icke-signifikanta. Av dessa har RATING lägst absolut t-kvot.

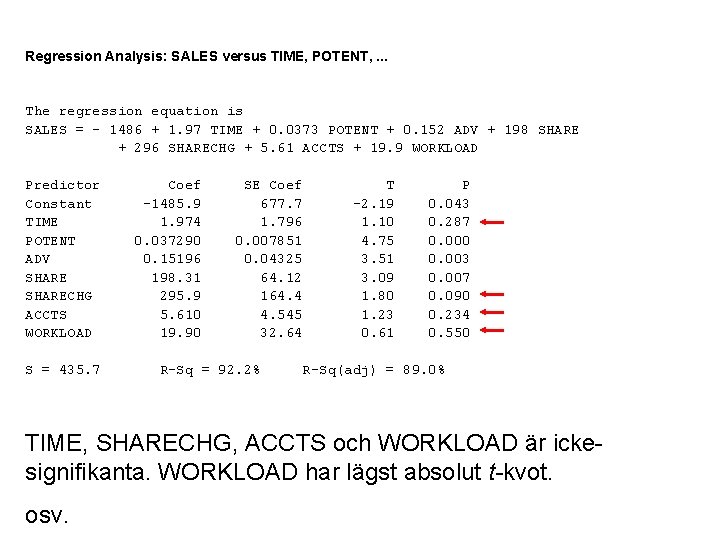

Regression Analysis: SALES versus TIME, POTENT, . . . The regression equation is SALES = - 1486 + 1. 97 TIME + 0. 0373 POTENT + 0. 152 ADV + 198 SHARE + 296 SHARECHG + 5. 61 ACCTS + 19. 9 WORKLOAD Predictor Constant TIME POTENT ADV SHARECHG ACCTS WORKLOAD S = 435. 7 Coef -1485. 9 1. 974 0. 037290 0. 15196 198. 31 295. 9 5. 610 19. 90 SE Coef 677. 7 1. 796 0. 007851 0. 04325 64. 12 164. 4 4. 545 32. 64 R-Sq = 92. 2% T -2. 19 1. 10 4. 75 3. 51 3. 09 1. 80 1. 23 0. 61 P 0. 043 0. 287 0. 000 0. 003 0. 007 0. 090 0. 234 0. 550 R-Sq(adj) = 89. 0% TIME, SHARECHG, ACCTS och WORKLOAD är ickesignifikanta. WORKLOAD har lägst absolut t-kvot. osv.

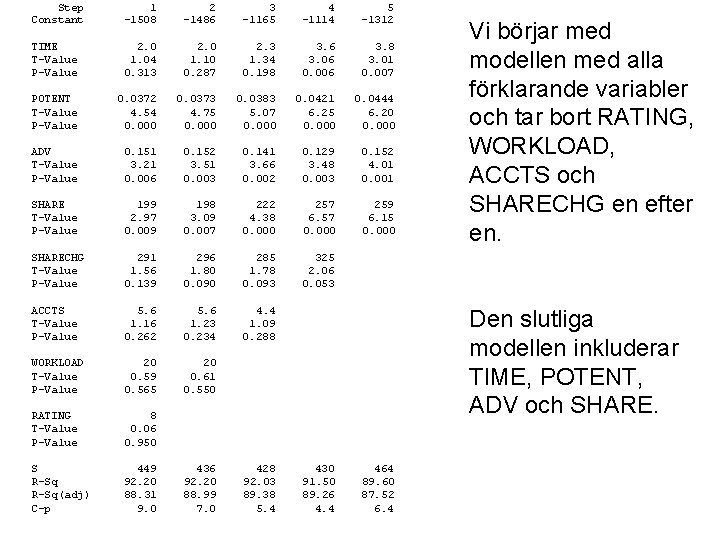

Step Constant 1 -1508 2 -1486 3 -1165 4 -1114 5 -1312 TIME T-Value P-Value 2. 0 1. 04 0. 313 2. 0 1. 10 0. 287 2. 3 1. 34 0. 198 3. 6 3. 06 0. 006 3. 8 3. 01 0. 007 POTENT T-Value P-Value 0. 0372 4. 54 0. 000 0. 0373 4. 75 0. 000 0. 0383 5. 07 0. 000 0. 0421 6. 25 0. 000 0. 0444 6. 20 0. 000 ADV T-Value P-Value 0. 151 3. 21 0. 006 0. 152 3. 51 0. 003 0. 141 3. 66 0. 002 0. 129 3. 48 0. 003 0. 152 4. 01 0. 001 SHARE T-Value P-Value 199 2. 97 0. 009 198 3. 09 0. 007 222 4. 38 0. 000 257 6. 57 0. 000 259 6. 15 0. 000 SHARECHG T-Value P-Value 291 1. 56 0. 139 296 1. 80 0. 090 285 1. 78 0. 093 325 2. 06 0. 053 ACCTS T-Value P-Value 5. 6 1. 16 0. 262 5. 6 1. 23 0. 234 4. 4 1. 09 0. 288 WORKLOAD T-Value P-Value 20 0. 59 0. 565 20 0. 61 0. 550 RATING T-Value P-Value 8 0. 06 0. 950 S R-Sq(adj) C-p 449 92. 20 88. 31 9. 0 436 92. 20 88. 99 7. 0 428 92. 03 89. 38 5. 4 Vi börjar med modellen med alla förklarande variabler och tar bort RATING, WORKLOAD, ACCTS och SHARECHG en efter en. Den slutliga modellen inkluderar TIME, POTENT, ADV och SHARE. 430 91. 50 89. 26 4. 4 464 89. 60 87. 52 6. 4

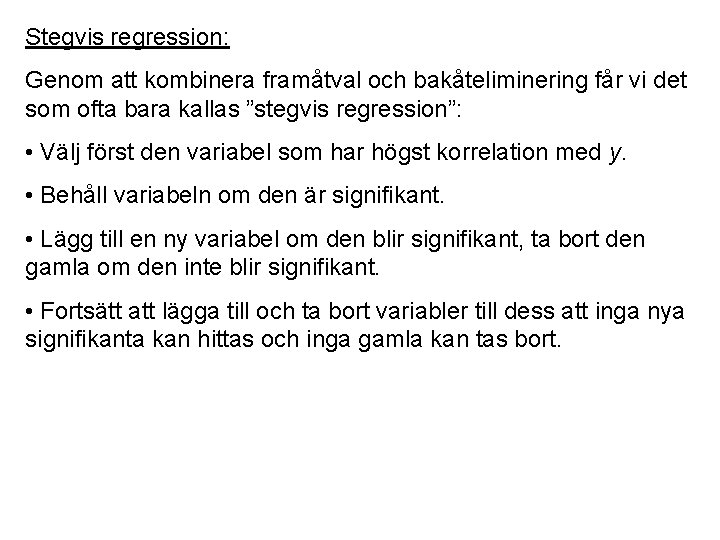

Stegvis regression: Genom att kombinera framåtval och bakåteliminering får vi det som ofta bara kallas ”stegvis regression”: • Välj först den variabel som har högst korrelation med y. • Behåll variabeln om den är signifikant. • Lägg till en ny variabel om den blir signifikant, ta bort den gamla om den inte blir signifikant. • Fortsätt att lägga till och ta bort variabler till dess att inga nya signifikanta kan hittas och inga gamla kan tas bort.

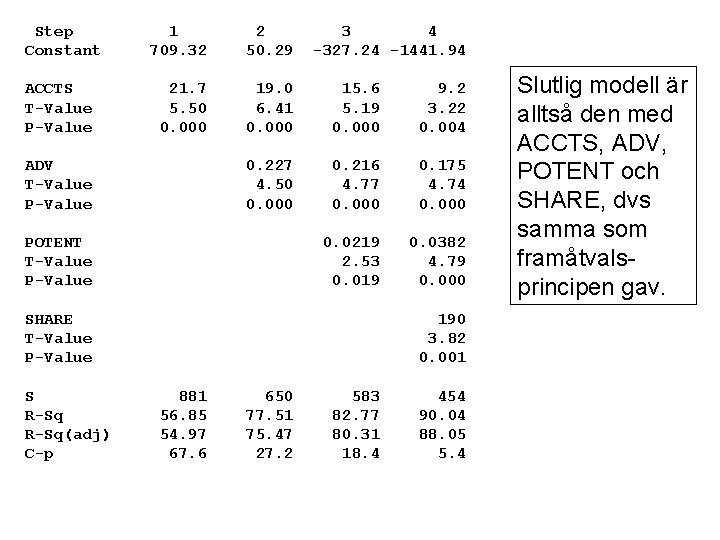

Step Constant 1 709. 32 2 50. 29 ACCTS T-Value P-Value 21. 7 5. 50 0. 000 19. 0 6. 41 0. 000 15. 6 5. 19 0. 000 9. 2 3. 22 0. 004 0. 227 4. 50 0. 000 0. 216 4. 77 0. 000 0. 175 4. 74 0. 000 0. 0219 2. 53 0. 019 0. 0382 4. 79 0. 000 ADV T-Value POTENT T-Value P-Value 3 4 -327. 24 -1441. 94 SHARE T-Value P-Value S R-Sq(adj) C-p 190 3. 82 0. 001 881 56. 85 54. 97 67. 6 650 77. 51 75. 47 27. 2 583 82. 77 80. 31 18. 4 454 90. 04 88. 05 5. 4 Slutlig modell är alltså den med ACCTS, ADV, POTENT och SHARE, dvs samma som framåtvalsprincipen gav.

Ingen av de tre algoritmerna är optimal i något avseende och olika modeller kan fås. Det är inte heller så att någon med nödvändighet ger den bästa modellen. Algoritmerna skall kombineras med förnuft och residualanalys. Speciellt viktigt är det att inte utan att fundera stoppa in alla variabler man har i modellen, utan att börja med en vettig uppsättning relevanta variabler.

- Slides: 36