Sogang University Natural Language Processing Lab LefttoRight Dependency

Sogang University : Natural Language Processing Lab Left-to-Right Dependency Parsing with Pointer Network Daniel Fernandez-Gonzalez, Carlos Gomez-Rodriguez Universidade da Coruna NAACL 2019 자연어처리 연구실 한장훈

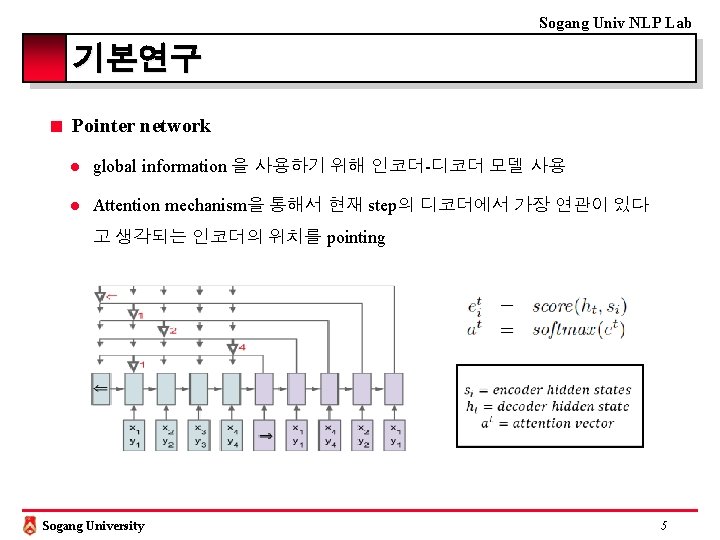

Sogang Univ NLP Lab 기본연구 ■ Pointer network l global information 을 사용하기 위해 인코더-디코더 모델 사용 l Attention mechanism을 통해서 현재 step의 디코더에서 가장 연관이 있다 고 생각되는 인코더의 위치를 pointing l ㄴ Sogang University 5

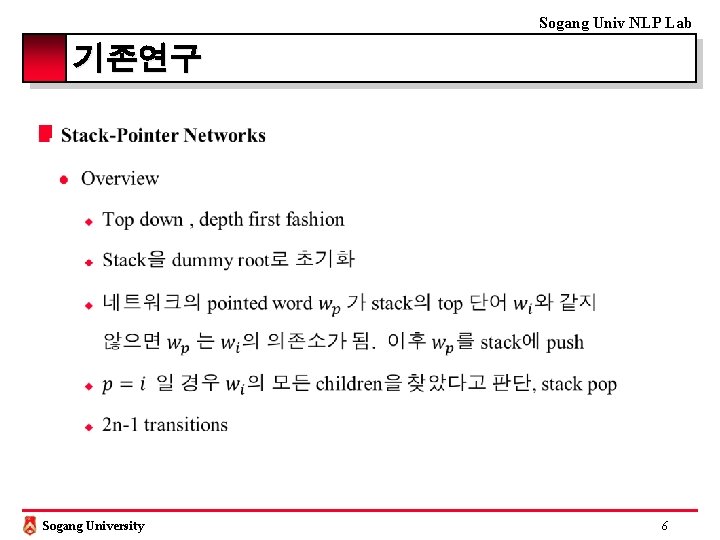

Sogang Univ NLP Lab 기존연구 ■ Sogang University 6

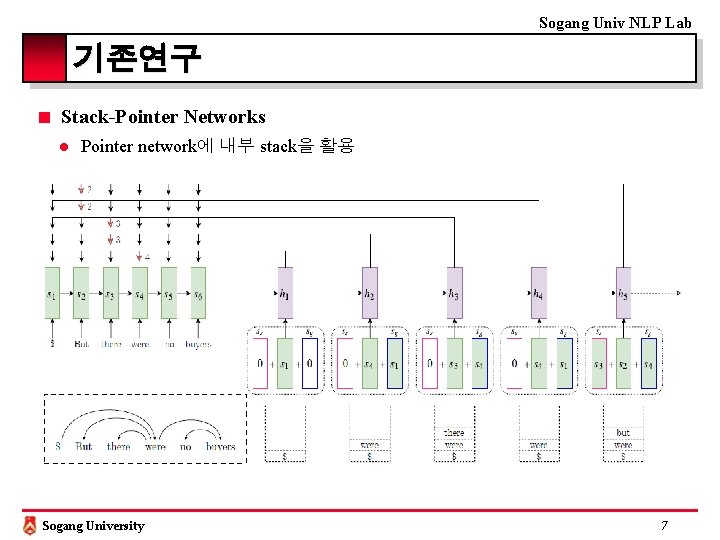

Sogang Univ NLP Lab 기존연구 ■ Stack-Pointer Networks l Pointer network에 내부 stack을 활용 Sogang University 7

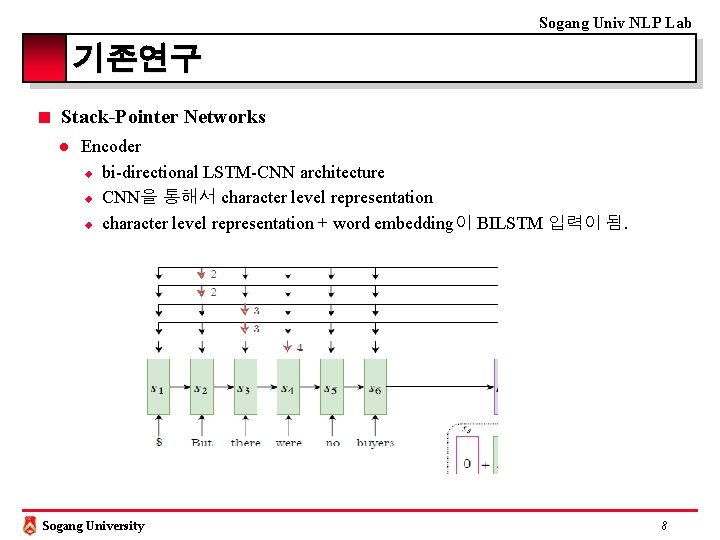

Sogang Univ NLP Lab 기존연구 ■ Stack-Pointer Networks l Encoder u bi-directional LSTM-CNN architecture u CNN을 통해서 character level representation u character level representation + word embedding이 BILSTM 입력이 됨. Sogang University 8

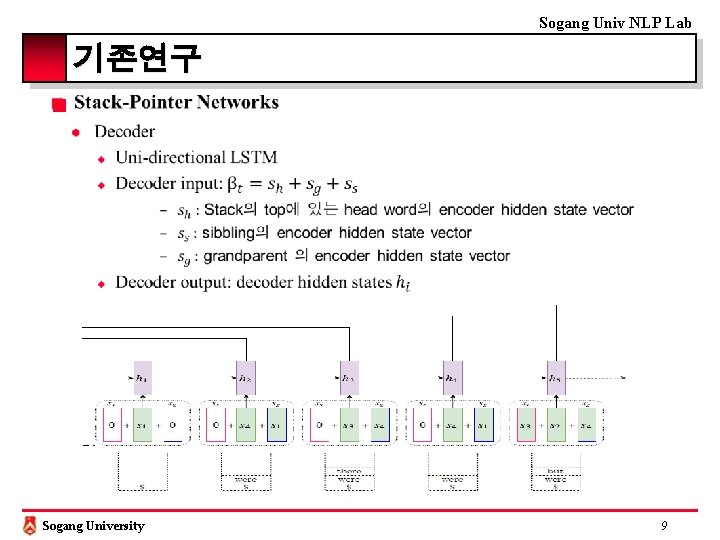

Sogang Univ NLP Lab 기존연구 ■ Sogang University 9

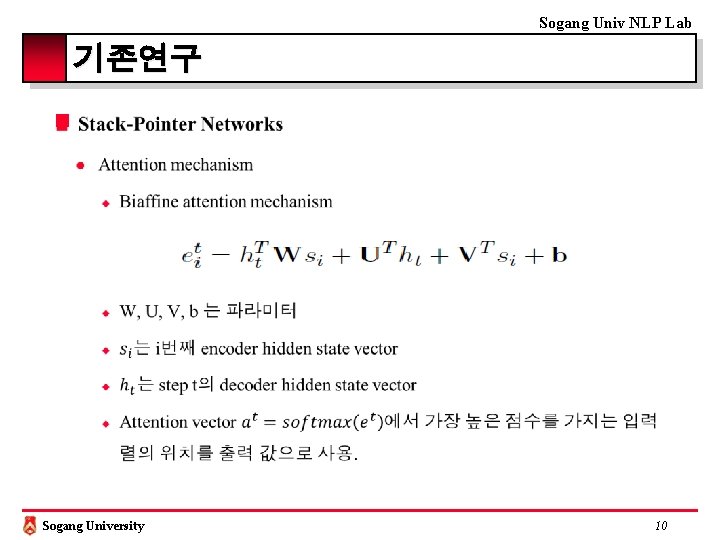

Sogang Univ NLP Lab 기존연구 ■ Sogang University 10

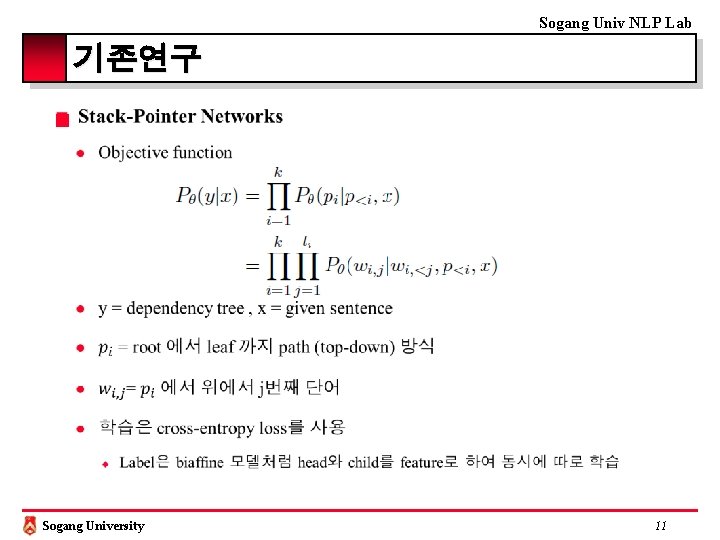

Sogang Univ NLP Lab 기존연구 ■ Sogang University 11

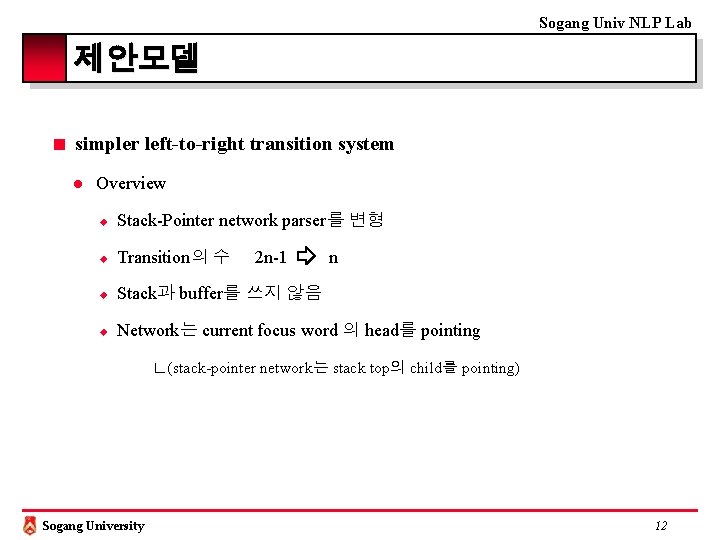

Sogang Univ NLP Lab 제안모델 ■ simpler left-to-right transition system l Overview u Stack-Pointer network parser를 변형 u Transition의 수 u Stack과 buffer를 쓰지 않음 u Network는 current focus word 의 head를 pointing 2 n-1 n ∟(stack-pointer network는 stack top의 child를 pointing) Sogang University 12

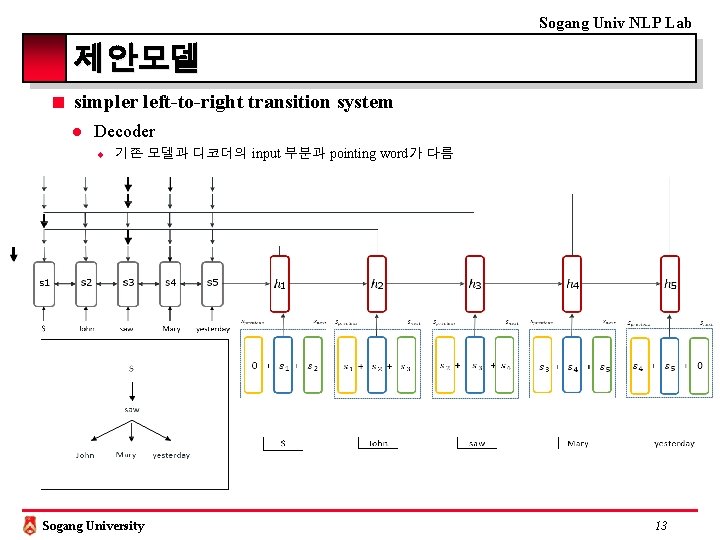

Sogang Univ NLP Lab 제안모델 ■ simpler left-to-right transition system l Decoder u 기존 모델과 디코더의 input 부분과 pointing word가 다름 Sogang University 13

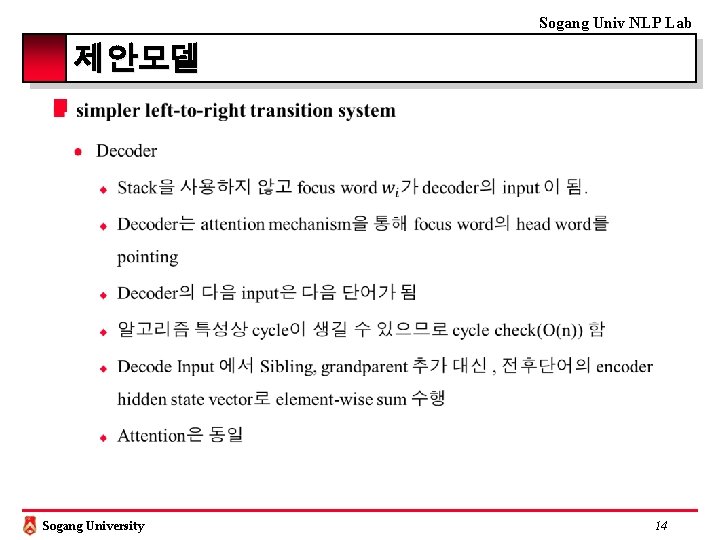

Sogang Univ NLP Lab 제안모델 ■ Sogang University 14

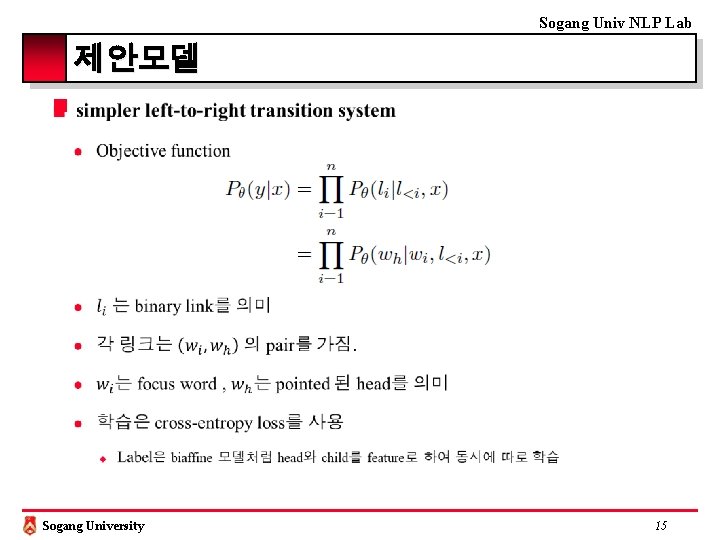

Sogang Univ NLP Lab 제안모델 ■ Sogang University 15

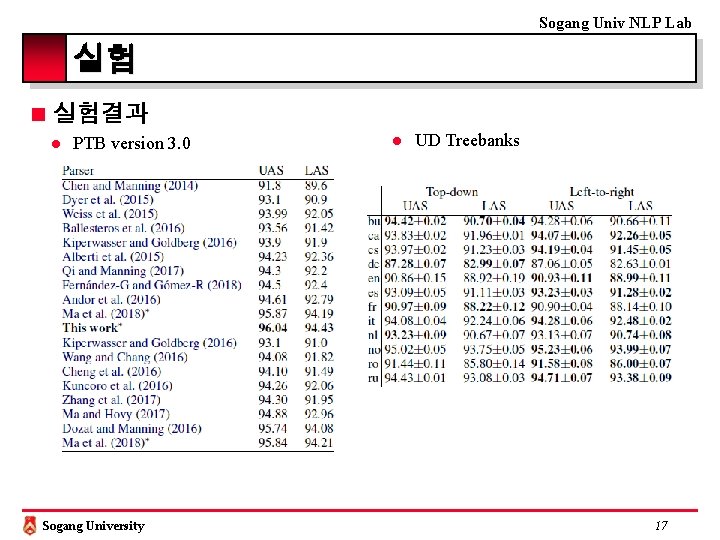

Sogang Univ NLP Lab 실험 ■ 실험 데이터 l English Penn Tree. Bank (PTB version 3. 0) l UD Treebanks Sogang University 16

Sogang Univ NLP Lab 실험 ■ 실험결과 l PTB version 3. 0 Sogang University l UD Treebanks 17

Sogang Univ NLP Lab 결론 ■ 결론 l Stack-pointer network를 base로 하였으나 stack, buffer 대신 focus word를 사 용, 의존소 대신 지배소를 pointing. l Cycle check를 하더라도 거의 2배 빠른 속도 l 지금 까지 나온 SOTA 모델인 biaffine 모델과 stack-pointer network 모델을 뛰어넘는 성능 l 한국어 적용시 성능 향상 기대 Sogang University

Sogang Univ NLP Lab 결론 감사합니다 Sogang University

- Slides: 19