Samoorganizacja uczenie bez nadzoru Wykad 5 Wodzisaw Duch

Samoorganizacja: uczenie bez nadzoru Wykład 5 Włodzisław Duch Uniwersytet Mikołaja Kopernika Google: W. Duch

Co będzie • Mapy w mózgu • Samoorganizacja • Sieci SOM (sieci Kohonena)

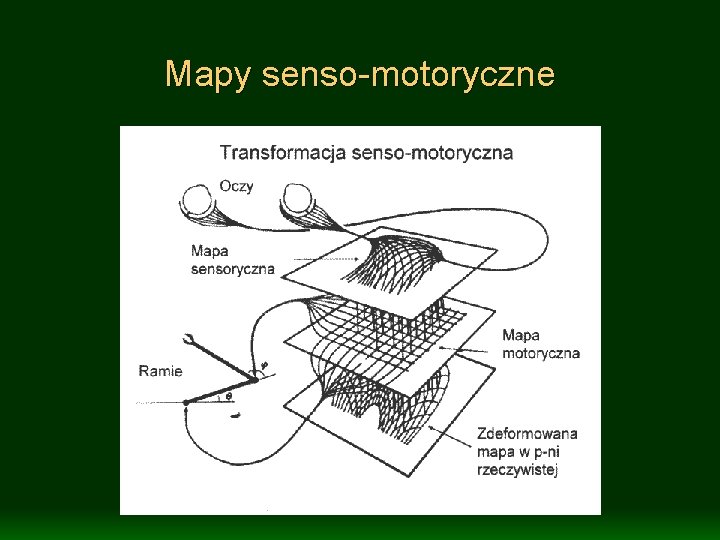

Mapy senso-motoryczne

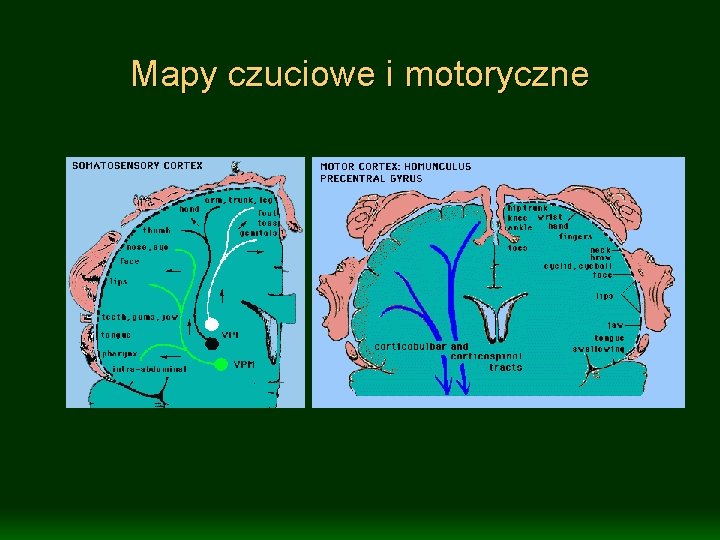

Samoorganizacja Uczenie bez nadzoru: wykrywanie cech w sygnale, modelowanie danych, analiza skupień, modele rozkładu prawd. stanów środowiska. . . Powstawanie wewnętrznych reprezentacji w mózgu: skomplikowane. Proste bodźce wyzwalające u zwierząt, uboga reprezentacja. Analiza danych zmysłowych i instrukcje motoryczne - neurony o podobnych funkcjach są obok siebie => mapy topograficzne. • • • Mapy somatosensoryczne układu czuciowego, mapy motoryczne kory i móżdżku, mapy tonotopiczne układu słuchowego, mapy orientacji dwuocznej układu wzrokowego, mapy wielomodalne układu orientacji (wzgórki czworacze górne)

Mapy czuciowe i motoryczne

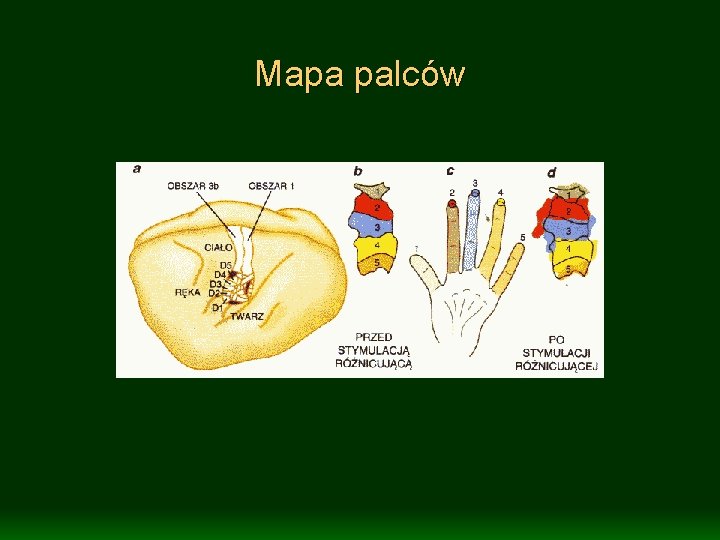

Mapa palców

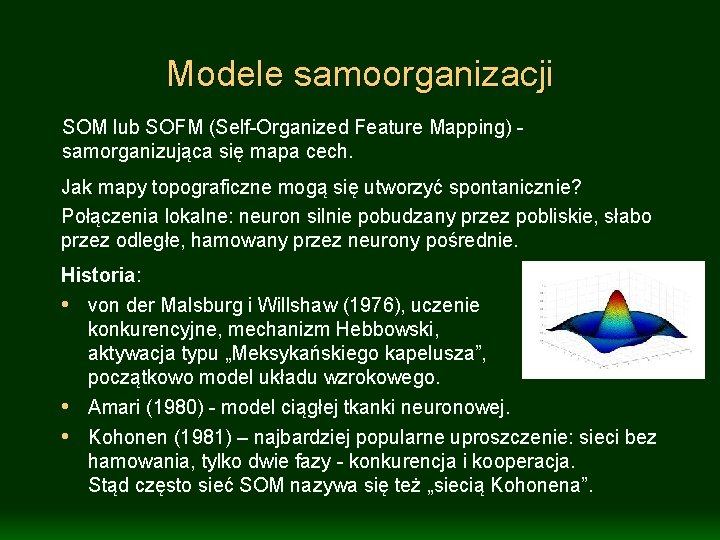

Modele samoorganizacji SOM lub SOFM (Self-Organized Feature Mapping) samorganizująca się mapa cech. Jak mapy topograficzne mogą się utworzyć spontanicznie? Połączenia lokalne: neuron silnie pobudzany przez pobliskie, słabo przez odległe, hamowany przez neurony pośrednie. Historia: • von der Malsburg i Willshaw (1976), uczenie konkurencyjne, mechanizm Hebbowski, aktywacja typu „Meksykańskiego kapelusza”, początkowo model układu wzrokowego. • Amari (1980) - model ciągłej tkanki neuronowej. • Kohonen (1981) – najbardziej popularne uproszczenie: sieci bez hamowania, tylko dwie fazy - konkurencja i kooperacja. Stąd często sieć SOM nazywa się też „siecią Kohonena”.

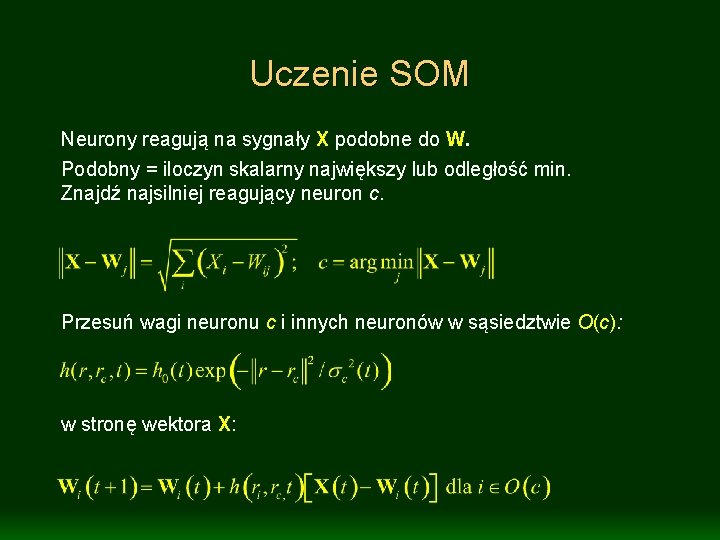

Uczenie SOM Neurony reagują na sygnały X podobne do W. Podobny = iloczyn skalarny największy lub odległość min. Znajdź najsilniej reagujący neuron c. Przesuń wagi neuronu c i innych neuronów w sąsiedztwie O(c): w stronę wektora X:

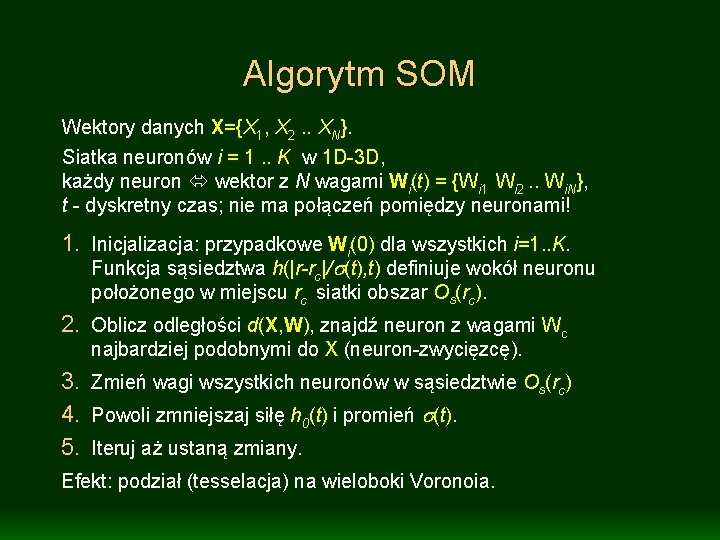

Algorytm SOM Wektory danych X={X 1, X 2. . XN}. Siatka neuronów i = 1. . K w 1 D-3 D, każdy neuron wektor z N wagami Wi(t) = {Wi 1 Wi 2. . Wi. N}, t - dyskretny czas; nie ma połączeń pomiędzy neuronami! 1. Inicjalizacja: przypadkowe Wi(0) dla wszystkich i=1. . K. Funkcja sąsiedztwa h(|r-rc|/s(t), t) definiuje wokół neuronu położonego w miejscu rc siatki obszar Os(rc). 2. Oblicz odległości d(X, W), znajdź neuron z wagami Wc najbardziej podobnymi do X (neuron-zwycięzcę). 3. Zmień wagi wszystkich neuronów w sąsiedztwie Os(rc) 4. Powoli zmniejszaj siłę h 0(t) i promień s(t). 5. Iteruj aż ustaną zmiany. Efekt: podział (tesselacja) na wieloboki Voronoia.

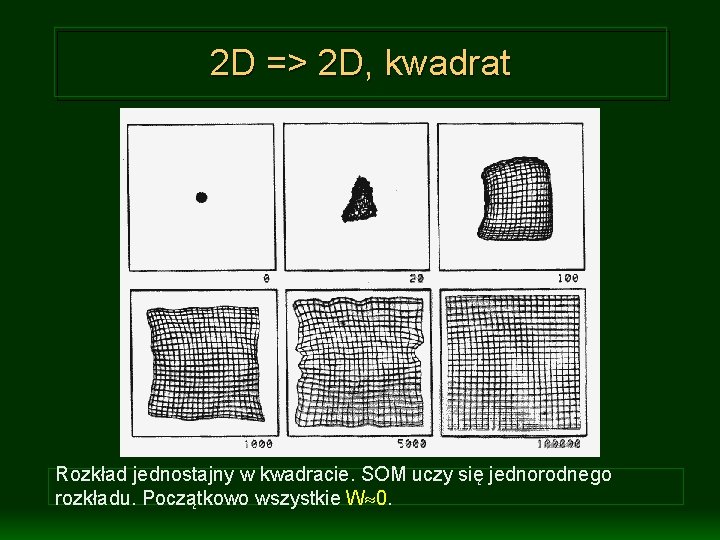

2 D => 2 D, kwadrat Rozkład jednostajny w kwadracie. SOM uczy się jednorodnego rozkładu. Początkowo wszystkie W 0.

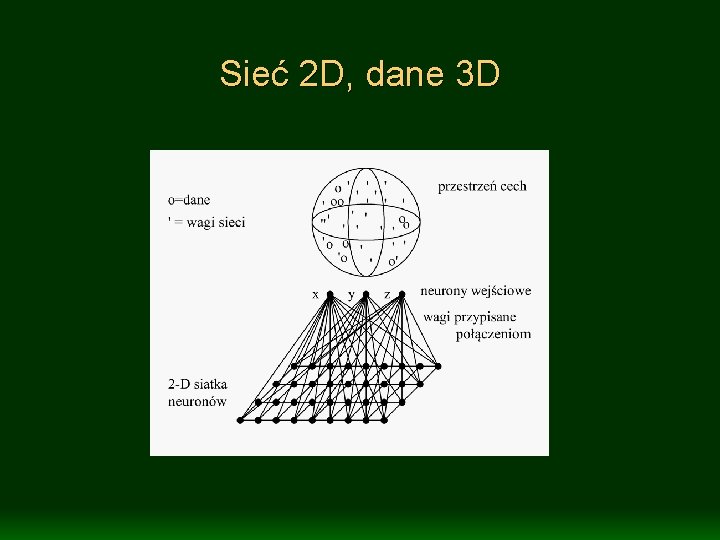

Sieć 2 D, dane 3 D

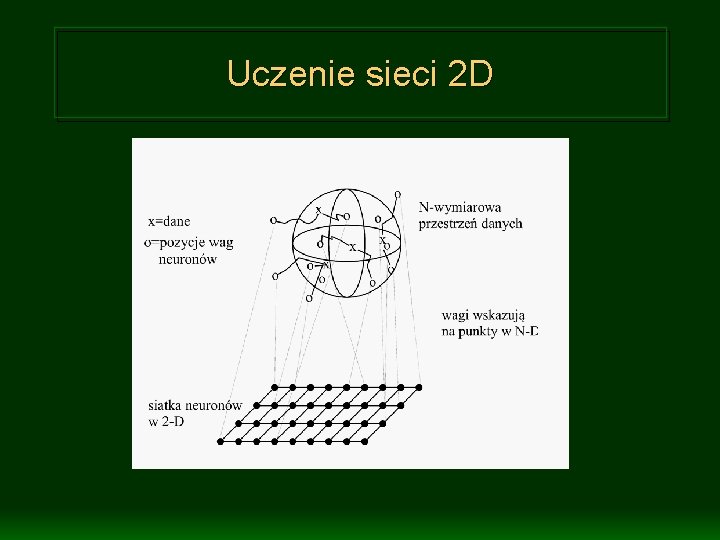

Uczenie sieci 2 D

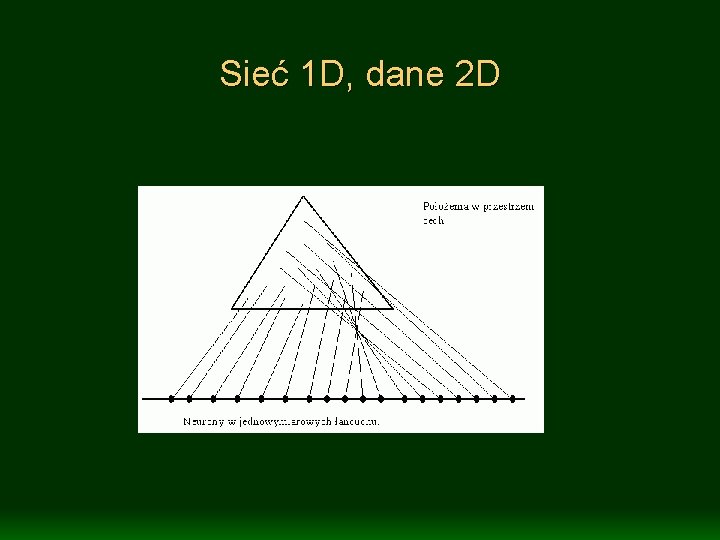

Sieć 1 D, dane 2 D

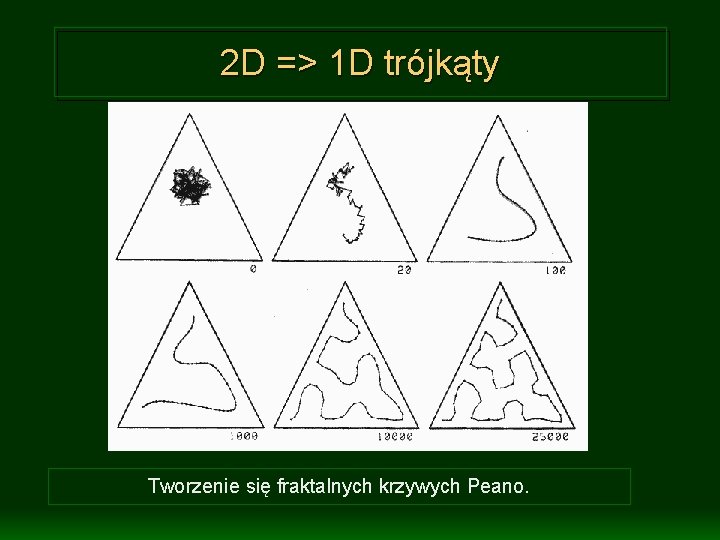

2 D => 1 D trójkąty Tworzenie się fraktalnych krzywych Peano.

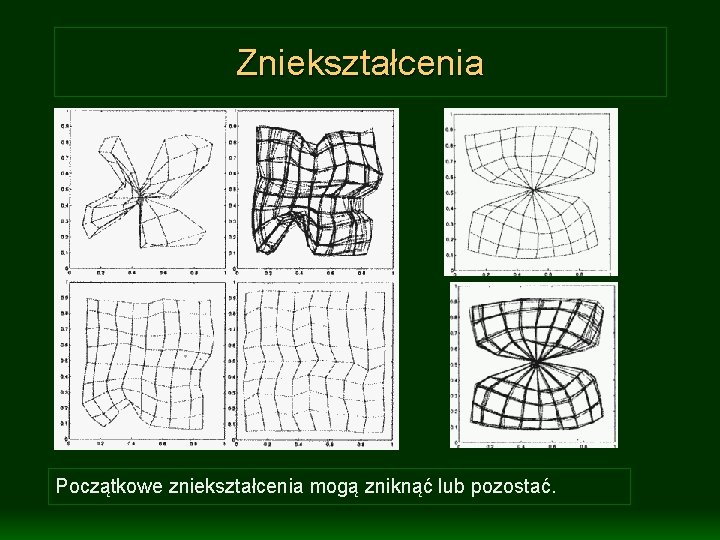

Zniekształcenia Początkowe zniekształcenia mogą zniknąć lub pozostać.

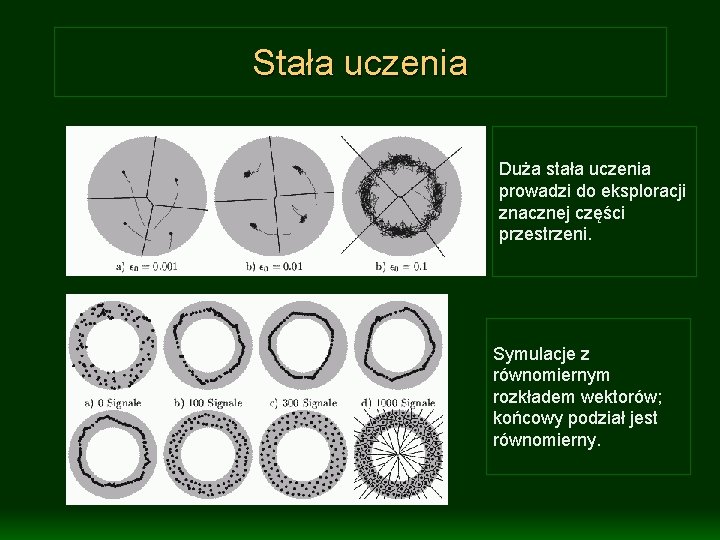

Stała uczenia Duża stała uczenia prowadzi do eksploracji znacznej części przestrzeni. Symulacje z równomiernym rozkładem wektorów; końcowy podział jest równomierny.

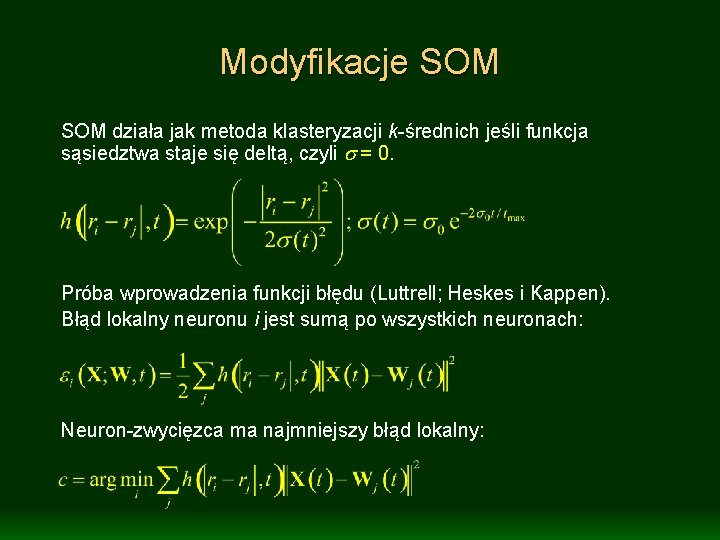

Modyfikacje SOM działa jak metoda klasteryzacji k-średnich jeśli funkcja sąsiedztwa staje się deltą, czyli s = 0. Próba wprowadzenia funkcji błędu (Luttrell; Heskes i Kappen). Błąd lokalny neuronu i jest sumą po wszystkich neuronach: Neuron-zwycięzca ma najmniejszy błąd lokalny:

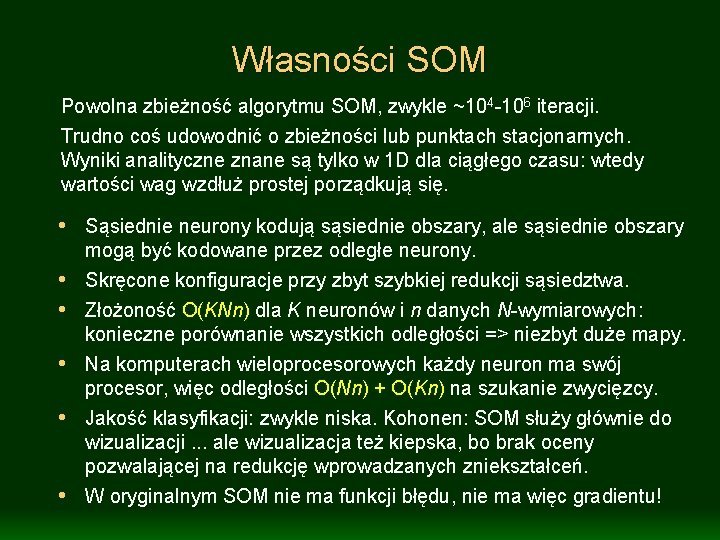

Własności SOM Powolna zbieżność algorytmu SOM, zwykle ~104 -106 iteracji. Trudno coś udowodnić o zbieżności lub punktach stacjonarnych. Wyniki analityczne znane są tylko w 1 D dla ciągłego czasu: wtedy wartości wag wzdłuż prostej porządkują się. • Sąsiednie neurony kodują sąsiednie obszary, ale sąsiednie obszary mogą być kodowane przez odległe neurony. • Skręcone konfiguracje przy zbyt szybkiej redukcji sąsiedztwa. • Złożoność O(KNn) dla K neuronów i n danych N-wymiarowych: konieczne porównanie wszystkich odległości => niezbyt duże mapy. • Na komputerach wieloprocesorowych każdy neuron ma swój procesor, więc odległości O(Nn) + O(Kn) na szukanie zwycięzcy. • Jakość klasyfikacji: zwykle niska. Kohonen: SOM służy głównie do wizualizacji. . . ale wizualizacja też kiepska, bo brak oceny pozwalającej na redukcję wprowadzanych zniekształceń. • W oryginalnym SOM nie ma funkcji błędu, nie ma więc gradientu!

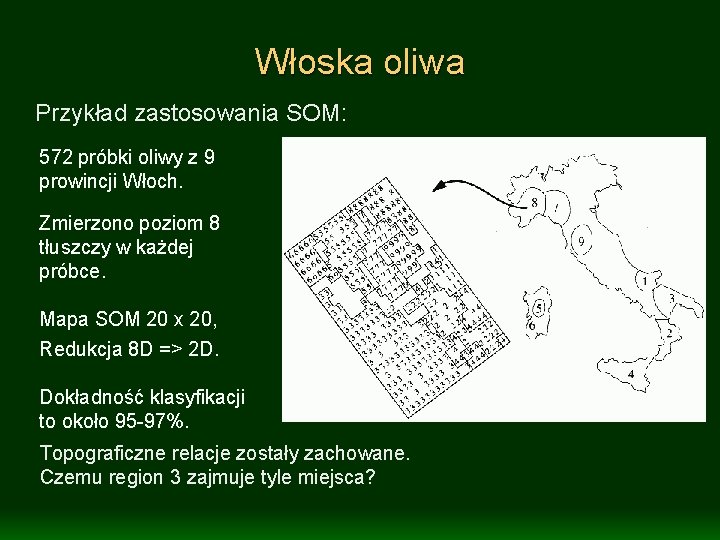

Włoska oliwa Przykład zastosowania SOM: 572 próbki oliwy z 9 prowincji Włoch. Zmierzono poziom 8 tłuszczy w każdej próbce. Mapa SOM 20 x 20, Redukcja 8 D => 2 D. Dokładność klasyfikacji to około 95 -97%. Topograficzne relacje zostały zachowane. Czemu region 3 zajmuje tyle miejsca?

Demos SOM Pang kilka demo, uporządkowanie kolorów, fonetyczna klawiatura i inne. Git. Hub SOM: SOM_Color i SOM_Image Self-organizing Maps: Py. MVPA kolory na mapie 2 D Xsom, wsom, somd – wizualizacja terningu SOM, C. Borgelt Self-Organizing Maps Applet World Poverty Map NN models: Kohonen SOM Interactive Self-Organizing Map demo - Hynninen SOM-Rapid Miner docs AI Junkie

Co dalej? • • Uczenie konkurencyjne. Wizualizacja SOM i MDS. Probabilistyczne podstawy uczenia. Perceptrony Sieci MLP Sieci RBF Systemy dynamiczne.

Koniec wykładu 5 Dobranoc !

Co było • Sieci ze sprzężeniami zwrotnymi • Model Hopfielda • Modele pamięci asocjacyjnej • Maszyna Boltzmana

- Slides: 23