Rsolution de problmes non markoviens par apprentissage Olivier

Résolution de problèmes non markoviens par apprentissage Olivier Sigaud, Pierre Gérard* DASSAULT AVIATION, DGT/DPR/ESA olivier. sigaud@dassault-aviation. fr http: //www. ensta. fr/~osigaud *Animat. Lab (Lip 6), Pierre. Gerard@lip 6. fr http: //www. rio. lip 6. fr/~pgerard/index. html Direction Générale Technique IA et PDM, 19 mars 2001 1

PLAN • POMDPs : un labyrinthe illustratif • Détecter les états cachés avec YACS • Solutions : – chaîner les actions – états internes – représentations hiérarchiques • Applications multi-agents Direction Générale Technique IA et PDM, 19 mars 2001 2

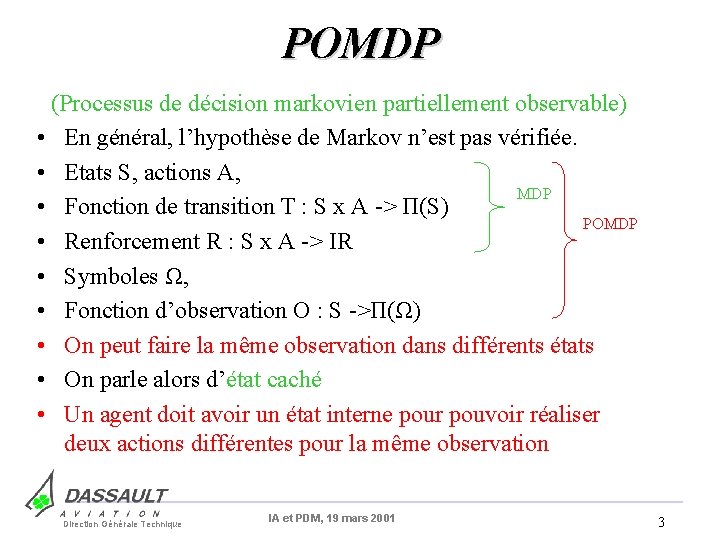

POMDP (Processus de décision markovien partiellement observable) • En général, l’hypothèse de Markov n’est pas vérifiée. • Etats S, actions A, MDP • Fonction de transition T : S x A -> Π(S) POMDP • Renforcement R : S x A -> IR • Symboles Ω, • Fonction d’observation O : S ->Π(Ω) • On peut faire la même observation dans différents états • On parle alors d’état caché • Un agent doit avoir un état interne pour pouvoir réaliser deux actions différentes pour la même observation Direction Générale Technique IA et PDM, 19 mars 2001 3

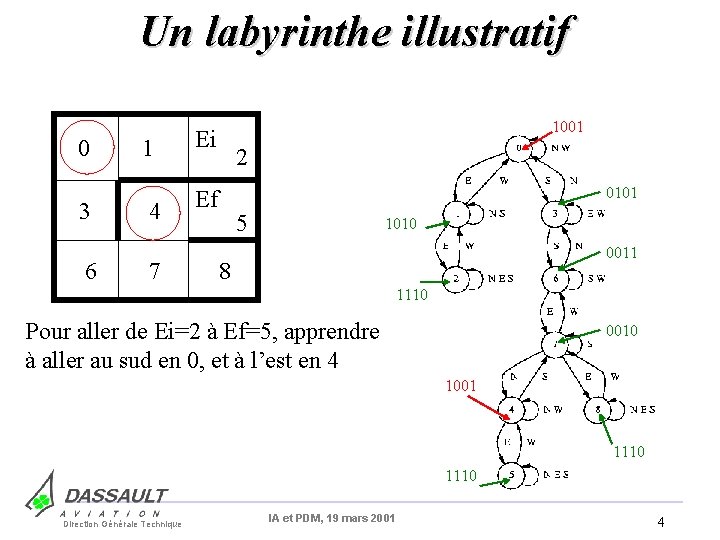

Un labyrinthe illustratif 0 3 6 1 Ei 4 Ef 7 1001 2 0101 5 1010 0011 8 1110 Pour aller de Ei=2 à Ef=5, apprendre à aller au sud en 0, et à l’est en 4 0010 1001 1110 Direction Générale Technique IA et PDM, 19 mars 2001 4

Résolution classique d’un POMDP (Kaelbing, Littman, Cassandra 98) • On suppose connu le MDP sous-jacent • Introduire l’état dans lequel on croit être (belief state) permet de ramener le pb à la résolution d’un MDP dont la fonction valeur est continue et linéaire par morceaux • Pour trouver la commande optimale, explosion combinatoire • Limité à des problèmes jouet • C’est de la planification, pas de l’apprentissage • NMDP, SMDP Construire par apprentissage une représentation du POMDP qui converge vers un MDP Direction Générale Technique IA et PDM, 19 mars 2001 5

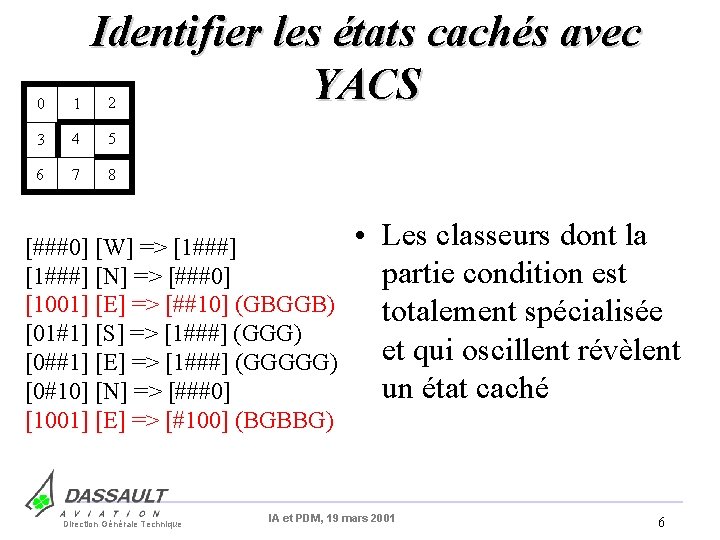

Identifier les états cachés avec YACS 2 0 1 3 4 5 6 7 8 [###0] [W] => [1###] [N] => [###0] [1001] [E] => [##10] (GBGGB) [01#1] [S] => [1###] (GGG) [0##1] [E] => [1###] (GGGGG) [0#10] [N] => [###0] [1001] [E] => [#100] (BGBBG) Direction Générale Technique • Les classeurs dont la partie condition est totalement spécialisée et qui oscillent révèlent un état caché IA et PDM, 19 mars 2001 6

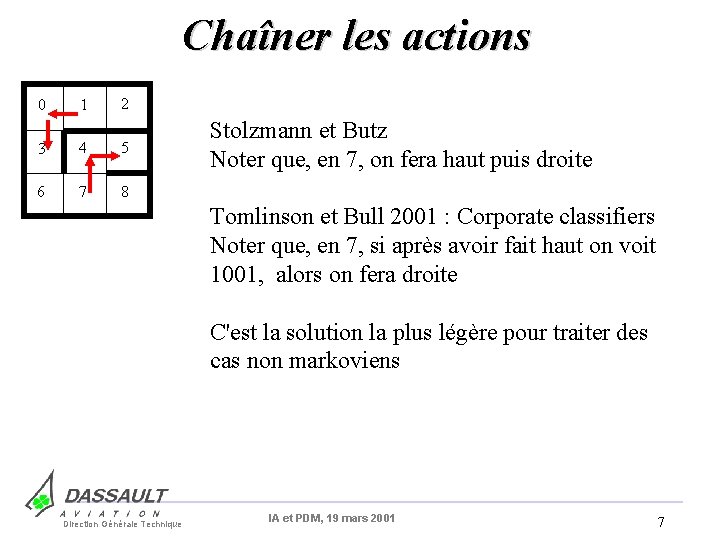

Chaîner les actions 0 1 2 3 4 5 6 7 8 Stolzmann et Butz Noter que, en 7, on fera haut puis droite Tomlinson et Bull 2001 : Corporate classifiers Noter que, en 7, si après avoir fait haut on voit 1001, alors on fera droite C'est la solution la plus légère pour traiter des cas non markoviens Direction Générale Technique IA et PDM, 19 mars 2001 7

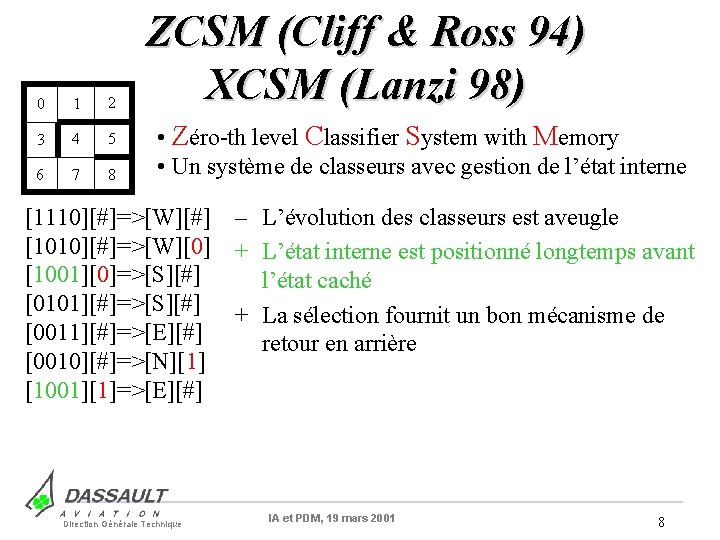

0 1 2 3 4 5 6 7 8 ZCSM (Cliff & Ross 94) XCSM (Lanzi 98) • Zéro-th level Classifier System with Memory • Un système de classeurs avec gestion de l’état interne [1110][#]=>[W][#] [1010][#]=>[W][0] [1001][0]=>[S][#] [0101][#]=>[S][#] [0011][#]=>[E][#] [0010][#]=>[N][1] [1001][1]=>[E][#] Direction Générale Technique – L’évolution des classeurs est aveugle + L’état interne est positionné longtemps avant l’état caché + La sélection fournit un bon mécanisme de retour en arrière IA et PDM, 19 mars 2001 8

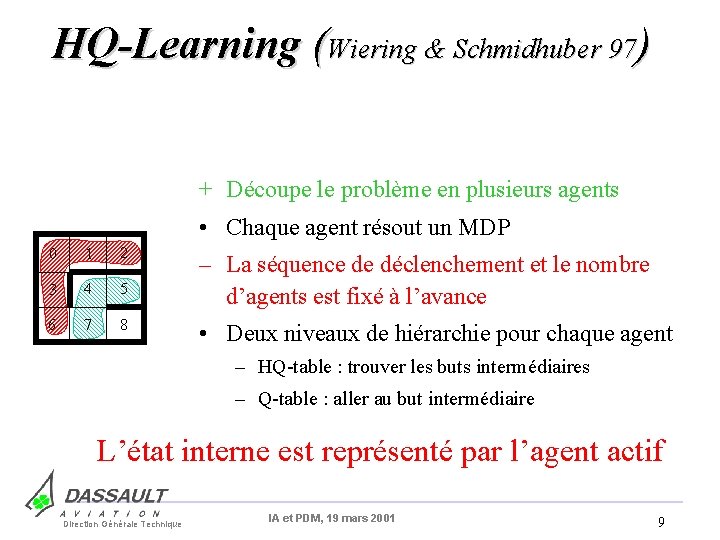

HQ-Learning (Wiering & Schmidhuber 97) + Découpe le problème en plusieurs agents • Chaque agent résout un MDP 0 1 2 3 4 5 6 7 8 – La séquence de déclenchement et le nombre d’agents est fixé à l’avance • Deux niveaux de hiérarchie pour chaque agent – HQ-table : trouver les buts intermédiaires – Q-table : aller au but intermédiaire L’état interne est représenté par l’agent actif Direction Générale Technique IA et PDM, 19 mars 2001 9

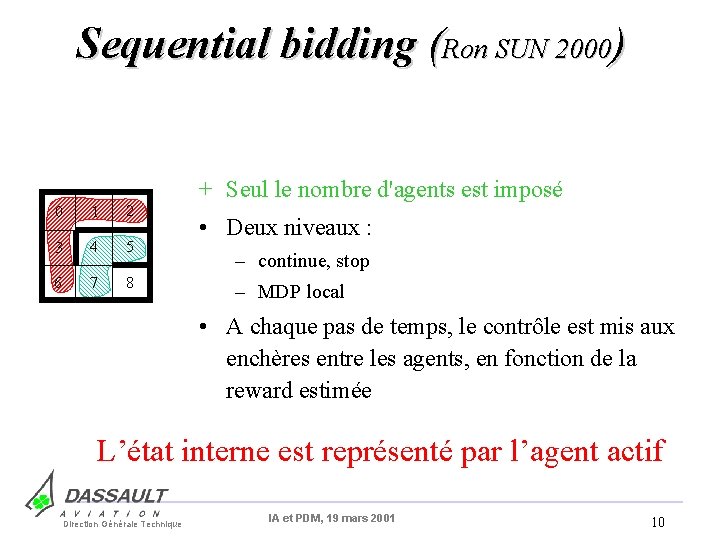

Sequential bidding (Ron SUN 2000) 0 1 2 3 4 5 6 7 8 + Seul le nombre d'agents est imposé • Deux niveaux : – continue, stop – MDP local • A chaque pas de temps, le contrôle est mis aux enchères entre les agents, en fonction de la reward estimée L’état interne est représenté par l’agent actif Direction Générale Technique IA et PDM, 19 mars 2001 10

Approches hiérarchiques + A. Barry : hiérarchies de XCS + Ron Parr : Hierarchies of Abstract Machines + D. Precup : Options (MDP + SMDP) + C. Boutilier : Macro-actions + T. Dietterich : Max. Q-Hierarchical RL + S. Mahadevan : Max. Q, Mc. Callum. . . +. . . L’état interne est représenté par le module actif Direction Générale Technique IA et PDM, 19 mars 2001 11

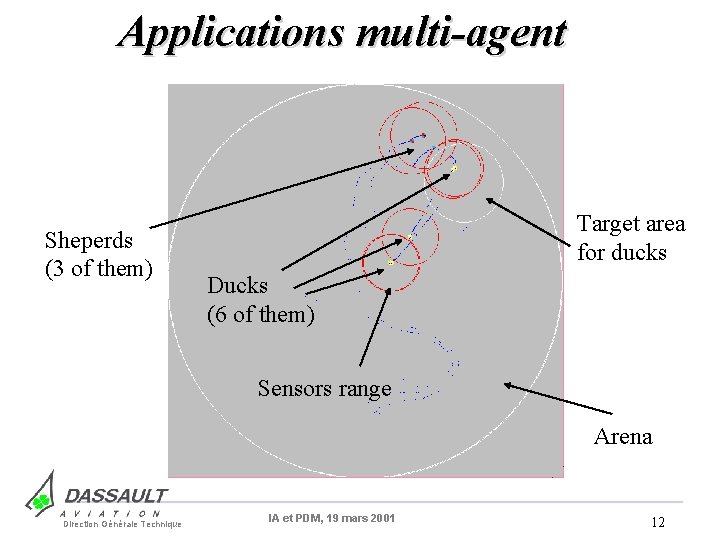

Applications multi-agent Sheperds (3 of them) Target area for ducks Ducks (6 of them) Sensors range Arena Direction Générale Technique IA et PDM, 19 mars 2001 12

Conclusion + Avec YACS, on sait identifier les états cachés + La plupart des approches hiérarchiques imposent une structure a priori (nb. Modules, séquencement) + On souhaite découper en modules au fur et à mesure de la découverte de ces états + On souhaite transposer les techniques existantes au cas de YACS, tirant parti de l'anticipation C'est difficile ! Direction Générale Technique IA et PDM, 19 mars 2001 13

- Slides: 13