Regresin Lineal Simple yi b 0 b 1

Regresión Lineal Simple yi = b 0 + b 1 xi + ui Javier Aparicio División de Estudios Políticos, CIDE javier. aparicio@cide. edu Primavera 2011 http: //www. cide. edu/investigadores/aparicio/metodos. html 1

Contenido n n n n Estimación mediante el método de momentos Estimación por mínimos cuadrados ordinarios Bondad de ajuste: R 2 Propiedades de los estimadores MCO Supuestos Gauss-Markov Insesgamiento Eficiencia 2

y = b 0 + b 1 x + u n donde y es: q q n n Variable dependiente Variable explicada Variable de lado izquierdo (duh!) Regresando q q q u es: q q Residual Término de error mientras que x es: q n Variable independiente Variable explicativa Covariable Variable de control Regresor Variable de lado derecho b 0 y b 1: parámetros o coeficientes a estimar 3

Algunos supuestos n n El valor promedio de u, el término de error, en la población es = 0. Es decir, E(u) = 0 Este supuesto no es muy restrictivo puesto que siempre podemos ajustar el intercepto b 0 para normalizar E(u) = 0 4

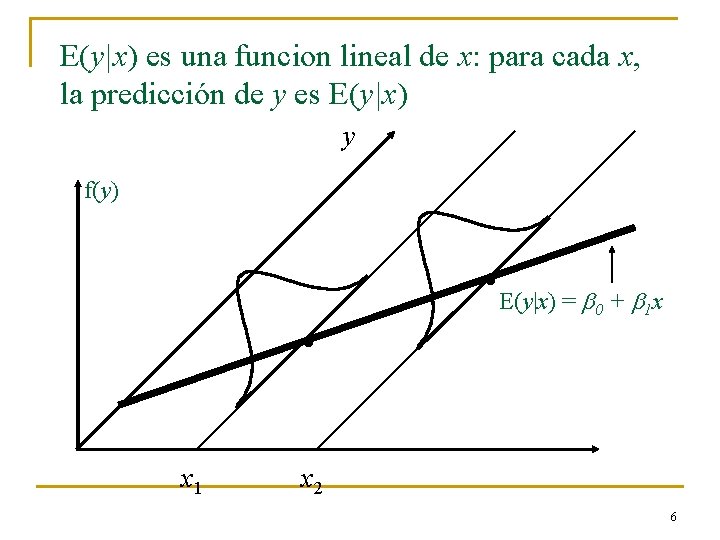

Media condicional = 0 n n Hay un supuesto crucial sobre la relación entre el error y la variable explicativa: cov(x, u) Queremos que la información contenida en x sea independiente de la información contenida en u (ie, que no estén relacionados), de modo que: E(u|x) = E(u) = 0, lo cual implica: E(y|x) = b 0 + b 1 x 5

E(y|x) es una funcion lineal de x: para cada x, la predicción de y es E(y|x) y f(y) . x 1 . E(y|x) = b + b x 0 1 x 2 6

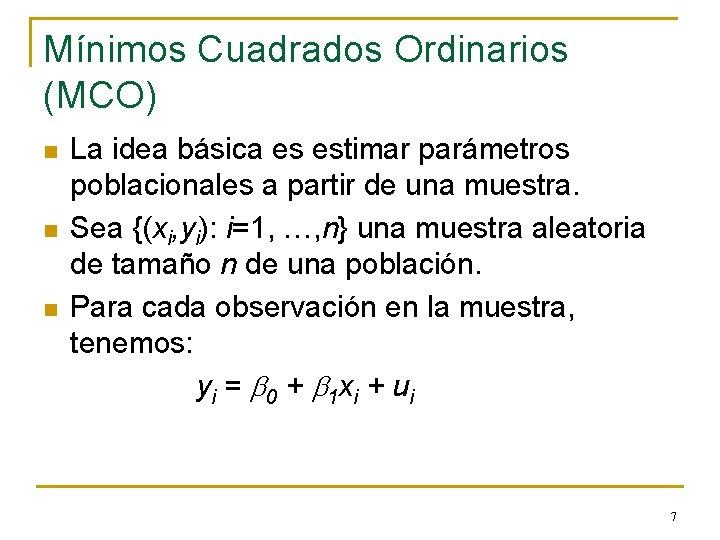

Mínimos Cuadrados Ordinarios (MCO) n n n La idea básica es estimar parámetros poblacionales a partir de una muestra. Sea {(xi, yi): i=1, …, n} una muestra aleatoria de tamaño n de una población. Para cada observación en la muestra, tenemos: yi = b 0 + b 1 xi + ui 7

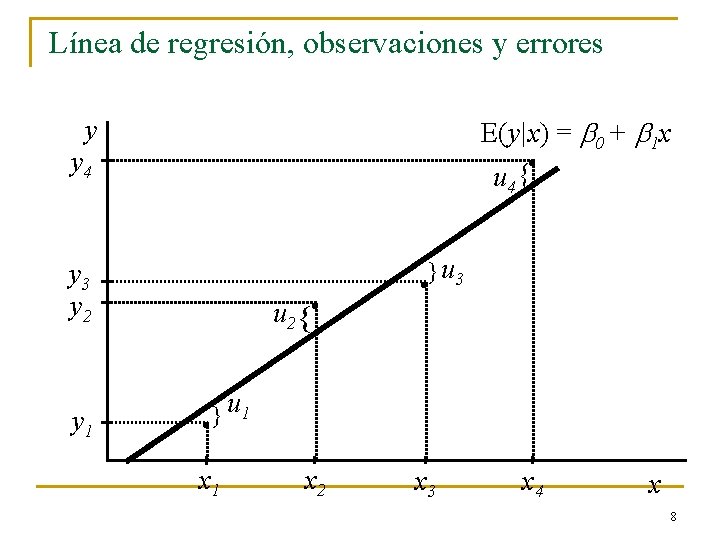

Línea de regresión, observaciones y errores E(y|x) = b 0 + b 1 x. { u 4 y y 4 y 3 y 2 y 1 u 2 {. . } u 3 } u 1 . x 1 x 2 x 3 x 4 x 8

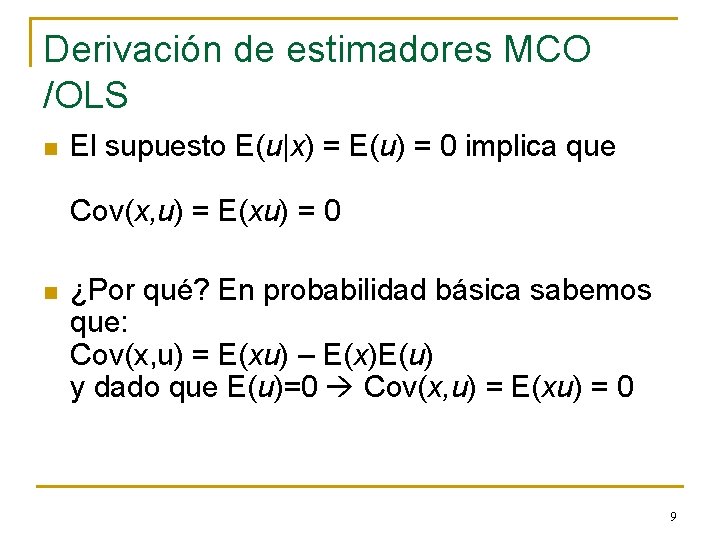

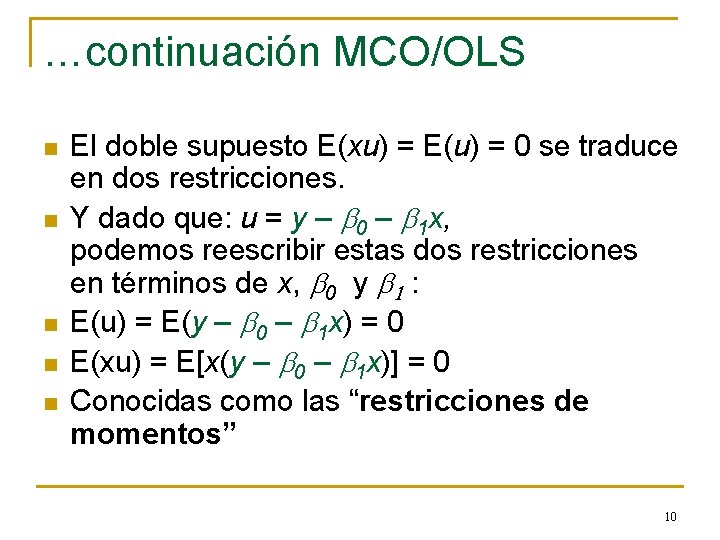

Derivación de estimadores MCO /OLS n El supuesto E(u|x) = E(u) = 0 implica que Cov(x, u) = E(xu) = 0 n ¿Por qué? En probabilidad básica sabemos que: Cov(x, u) = E(xu) – E(x)E(u) y dado que E(u)=0 Cov(x, u) = E(xu) = 0 9

…continuación MCO/OLS n n n El doble supuesto E(xu) = E(u) = 0 se traduce en dos restricciones. Y dado que: u = y – b 0 – b 1 x, podemos reescribir estas dos restricciones en términos de x, b 0 y b 1 : E(u) = E(y – b 0 – b 1 x) = 0 E(xu) = E[x(y – b 0 – b 1 x)] = 0 Conocidas como las “restricciones de momentos” 10

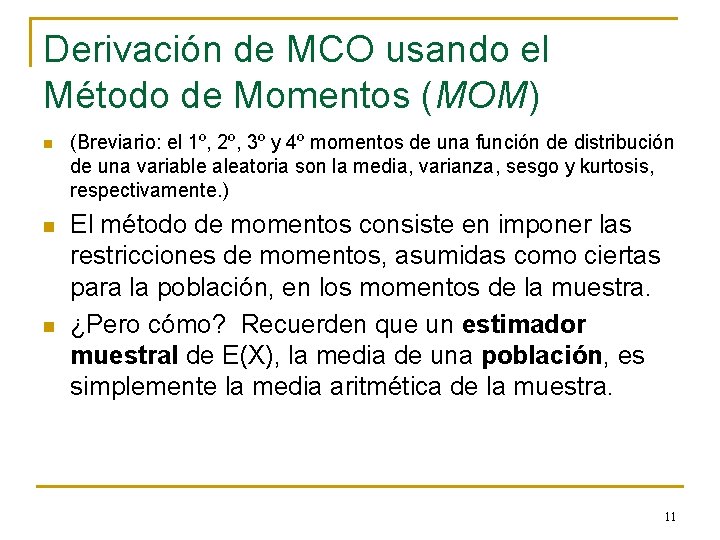

Derivación de MCO usando el Método de Momentos (MOM) n n n (Breviario: el 1º, 2º, 3º y 4º momentos de una función de distribución de una variable aleatoria son la media, varianza, sesgo y kurtosis, respectivamente. ) El método de momentos consiste en imponer las restricciones de momentos, asumidas como ciertas para la población, en los momentos de la muestra. ¿Pero cómo? Recuerden que un estimador muestral de E(X), la media de una población, es simplemente la media aritmética de la muestra. 11

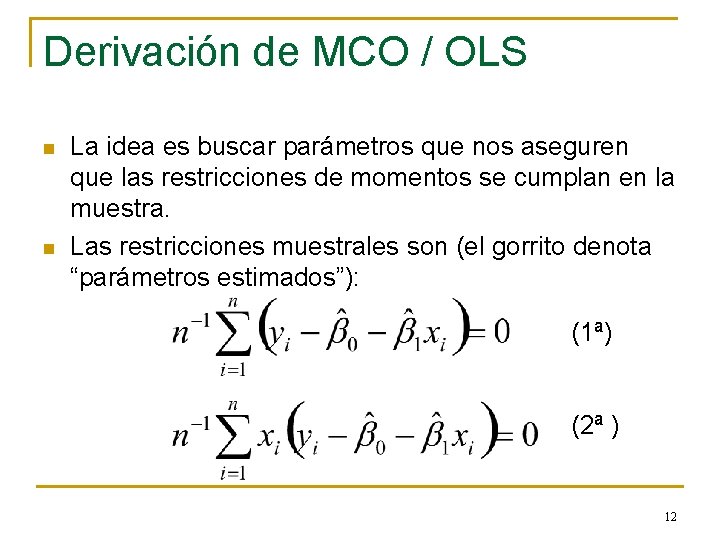

Derivación de MCO / OLS n n La idea es buscar parámetros que nos aseguren que las restricciones de momentos se cumplan en la muestra. Las restricciones muestrales son (el gorrito denota “parámetros estimados”): (1ª) (2ª ) 12

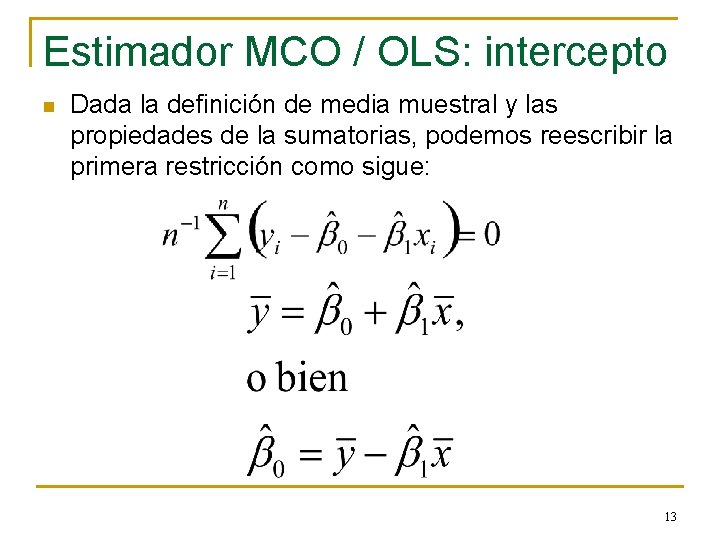

Estimador MCO / OLS: intercepto n Dada la definición de media muestral y las propiedades de la sumatorias, podemos reescribir la primera restricción como sigue: 13

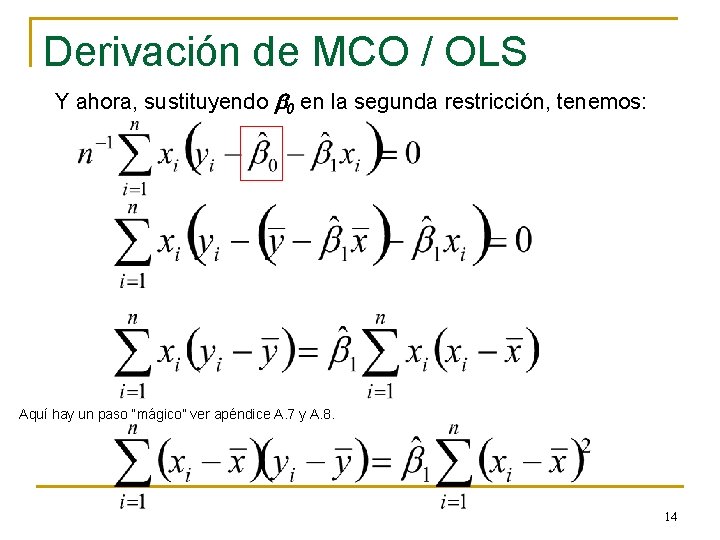

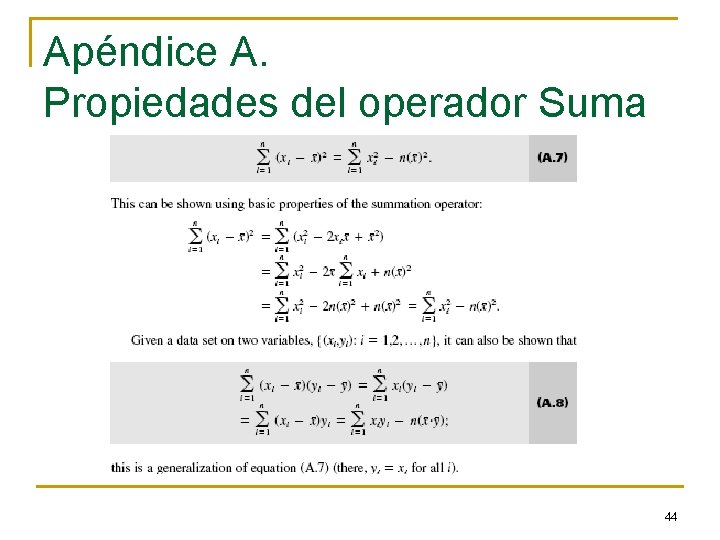

Derivación de MCO / OLS Y ahora, sustituyendo b 0 en la segunda restricción, tenemos: Aquí hay un paso “mágico” ver apéndice A. 7 y A. 8. 14

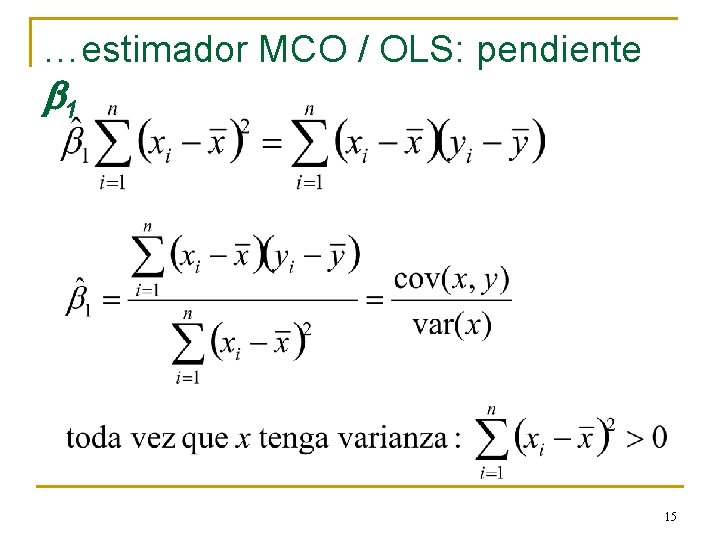

…estimador MCO / OLS: pendiente b 1 15

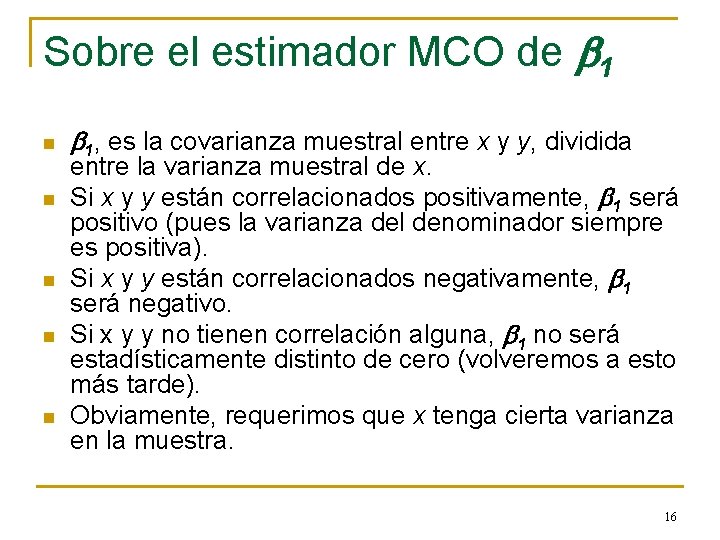

Sobre el estimador MCO de b 1 n n n b 1, es la covarianza muestral entre x y y, dividida entre la varianza muestral de x. Si x y y están correlacionados positivamente, b 1 será positivo (pues la varianza del denominador siempre es positiva). Si x y y están correlacionados negativamente, b 1 será negativo. Si x y y no tienen correlación alguna, b 1 no será estadísticamente distinto de cero (volveremos a esto más tarde). Obviamente, requerimos que x tenga cierta varianza en la muestra. 16

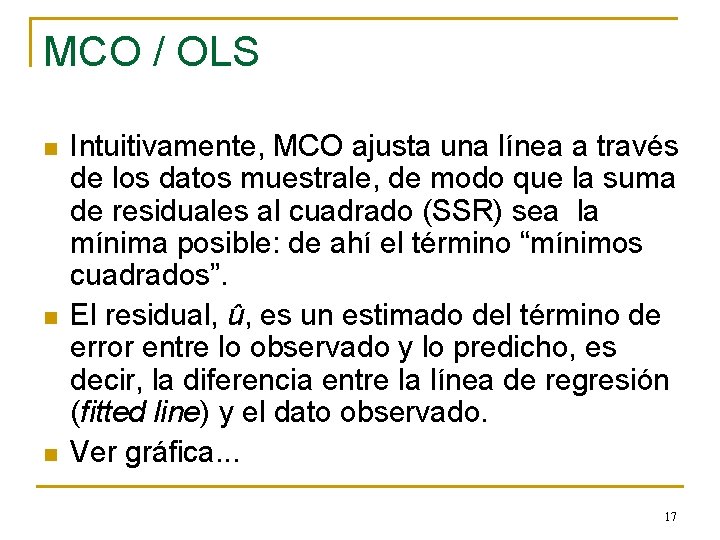

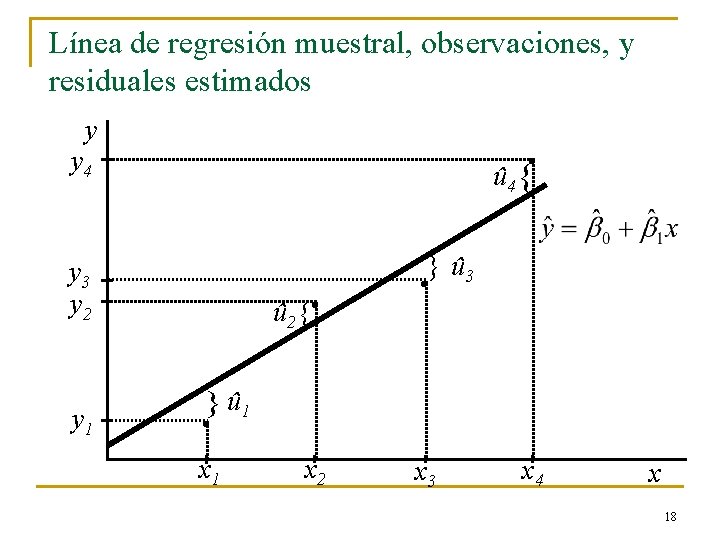

MCO / OLS n n n Intuitivamente, MCO ajusta una línea a través de los datos muestrale, de modo que la suma de residuales al cuadrado (SSR) sea la mínima posible: de ahí el término “mínimos cuadrados”. El residual, û, es un estimado del término de error entre lo observado y lo predicho, es decir, la diferencia entre la línea de regresión (fitted line) y el dato observado. Ver gráfica. . . 17

Línea de regresión muestral, observaciones, y residuales estimados y . y 4 û 4 { y 3 y 2 y 1 . û{ . } û 3 2 û 1 }. x 1 x 2 x 3 x 4 x 18

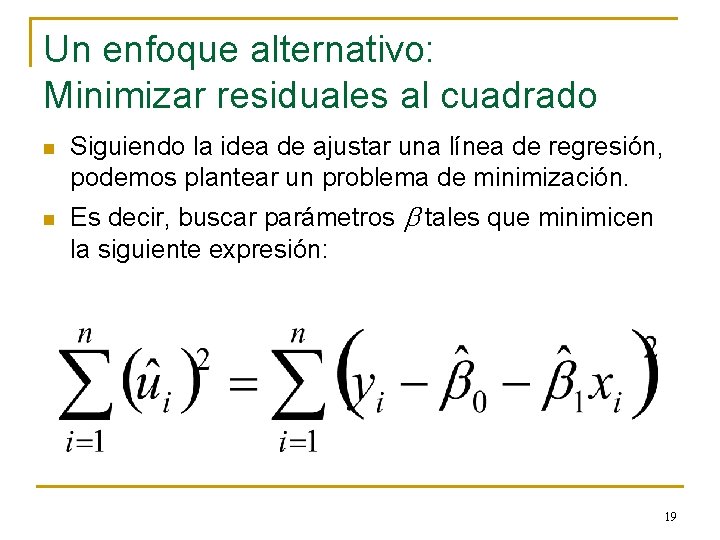

Un enfoque alternativo: Minimizar residuales al cuadrado n n Siguiendo la idea de ajustar una línea de regresión, podemos plantear un problema de minimización. Es decir, buscar parámetros b tales que minimicen la siguiente expresión: 19

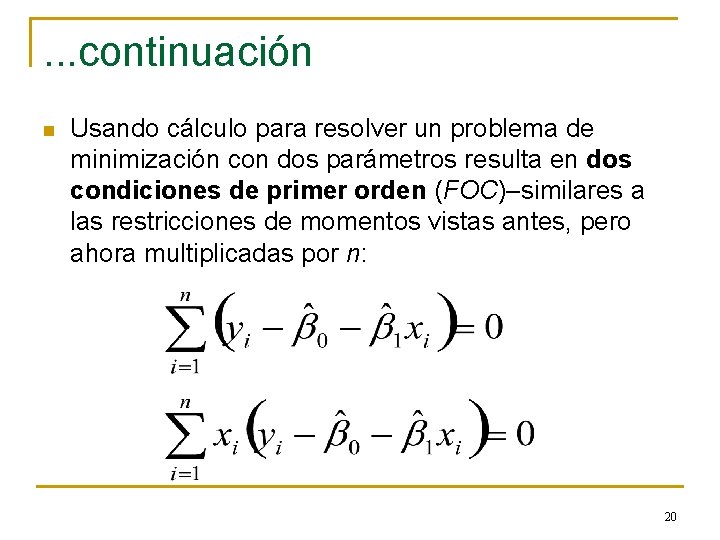

. . . continuación n Usando cálculo para resolver un problema de minimización con dos parámetros resulta en dos condiciones de primer orden (FOC)–similares a las restricciones de momentos vistas antes, pero ahora multiplicadas por n: 20

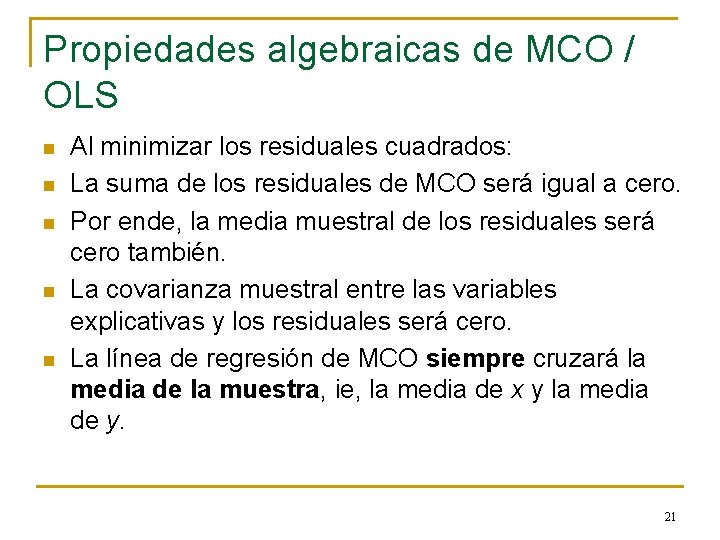

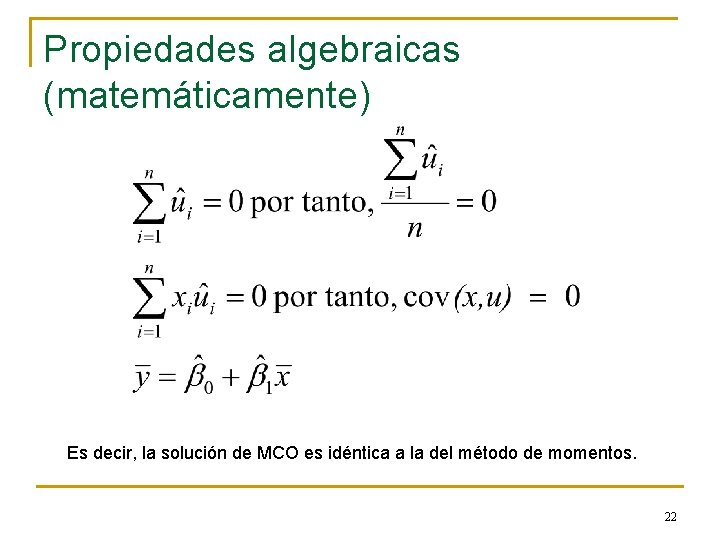

Propiedades algebraicas de MCO / OLS n n n Al minimizar los residuales cuadrados: La suma de los residuales de MCO será igual a cero. Por ende, la media muestral de los residuales será cero también. La covarianza muestral entre las variables explicativas y los residuales será cero. La línea de regresión de MCO siempre cruzará la media de la muestra, ie, la media de x y la media de y. 21

Propiedades algebraicas (matemáticamente) Es decir, la solución de MCO es idéntica a la del método de momentos. 22

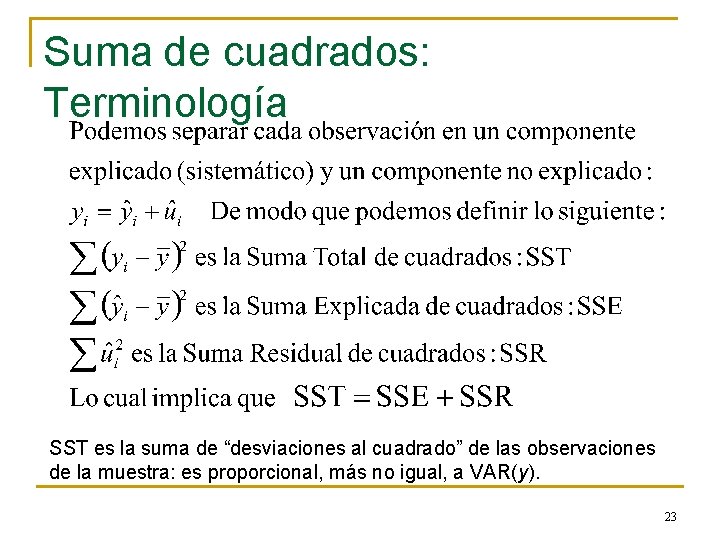

Suma de cuadrados: Terminología SST es la suma de “desviaciones al cuadrado” de las observaciones de la muestra: es proporcional, más no igual, a VAR(y). 23

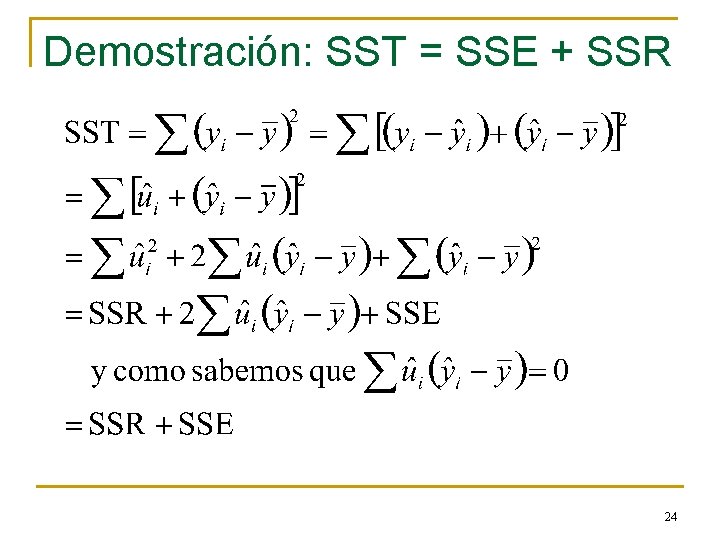

Demostración: SST = SSE + SSR 24

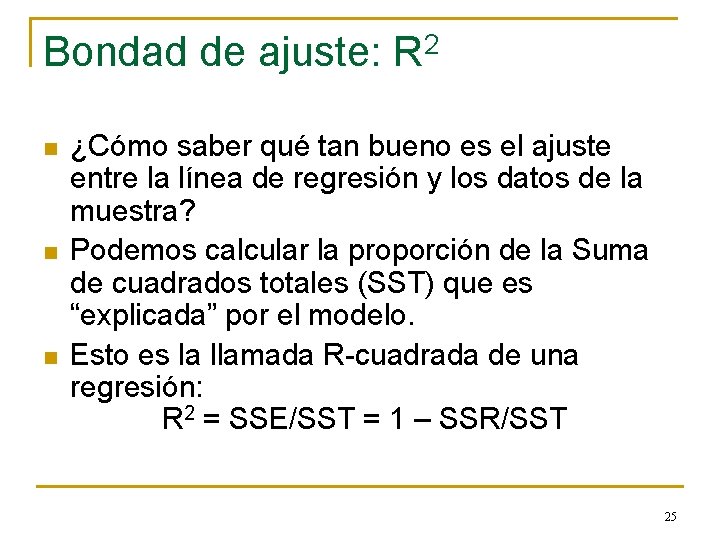

Bondad de ajuste: R 2 n n n ¿Cómo saber qué tan bueno es el ajuste entre la línea de regresión y los datos de la muestra? Podemos calcular la proporción de la Suma de cuadrados totales (SST) que es “explicada” por el modelo. Esto es la llamada R-cuadrada de una regresión: R 2 = SSE/SST = 1 – SSR/SST 25

Haciendo regresiones con stata n n n Hemos visto como derivar las fórmulas para calcular estimadores MCO de nuestros parámetros de interés b. Podemos calcularlos “a mano” (muy tedioso), o aplicar estas fórmulas en una hoja de cálculo como excel (algo tedioso), o bien usar un paquete estadístico estándar como stata (muy fácil) Para correr una regresión de y en x en stata: regress y x 1 x 2 x 3 (ver ejemplo) 26

Sesgo y eficiencia de MCO n n n Dos características deseables de cualquier estimador estadístico son: Insesgamiento (unbiasedness): que el parámetro estimado sea, en promedio, igual al “verdadero” parámetro poblacional. Eficiencia (efficiency): que la varianza del estimador sea mínima (ie, máxima precisión). Así, buscamos estimadores con sesgo mínimo y máxima eficiencia (ie, mínima varianza). MCO cuenta con ambas propiedades bajo ciertas condiciones: los supuestos Gauss-Markov. 27

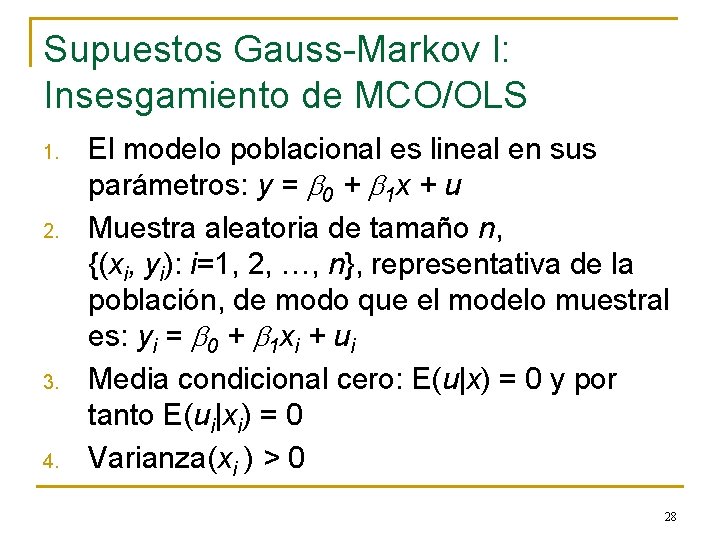

Supuestos Gauss-Markov I: Insesgamiento de MCO/OLS 1. 2. 3. 4. El modelo poblacional es lineal en sus parámetros: y = b 0 + b 1 x + u Muestra aleatoria de tamaño n, {(xi, yi): i=1, 2, …, n}, representativa de la población, de modo que el modelo muestral es: yi = b 0 + b 1 xi + ui Media condicional cero: E(u|x) = 0 y por tanto E(ui|xi) = 0 Varianza(xi ) > 0 28

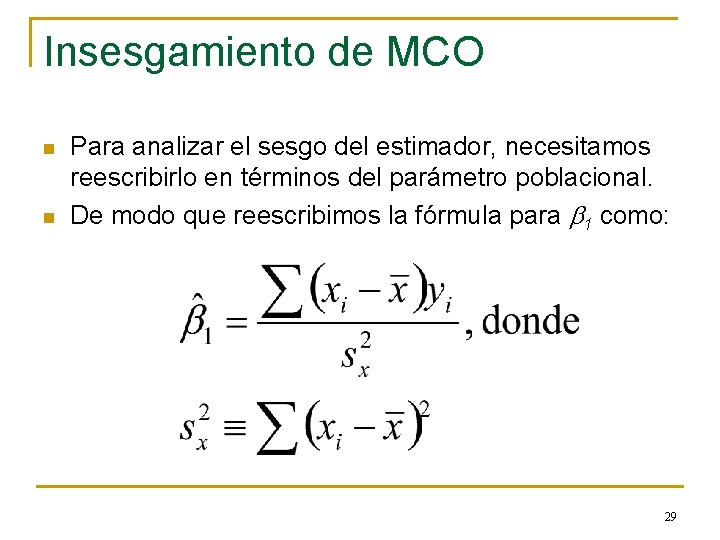

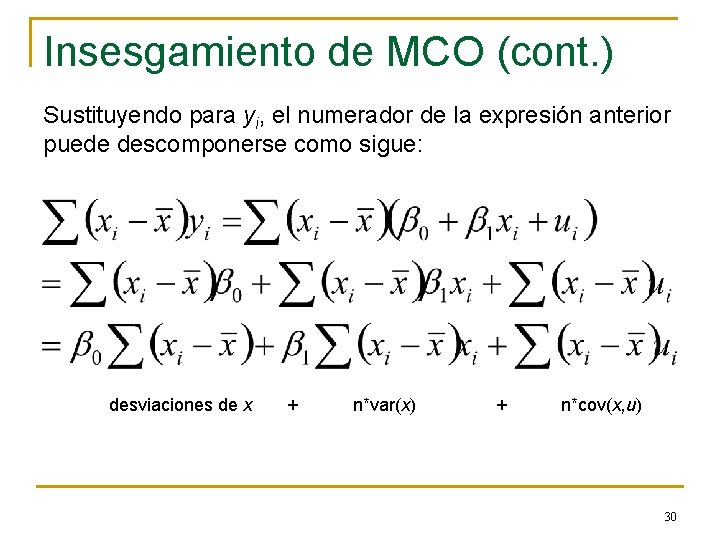

Insesgamiento de MCO n n Para analizar el sesgo del estimador, necesitamos reescribirlo en términos del parámetro poblacional. De modo que reescribimos la fórmula para b 1 como: 29

Insesgamiento de MCO (cont. ) Sustituyendo para yi, el numerador de la expresión anterior puede descomponerse como sigue: desviaciones de x + n*var(x) + n*cov(x, u) 30

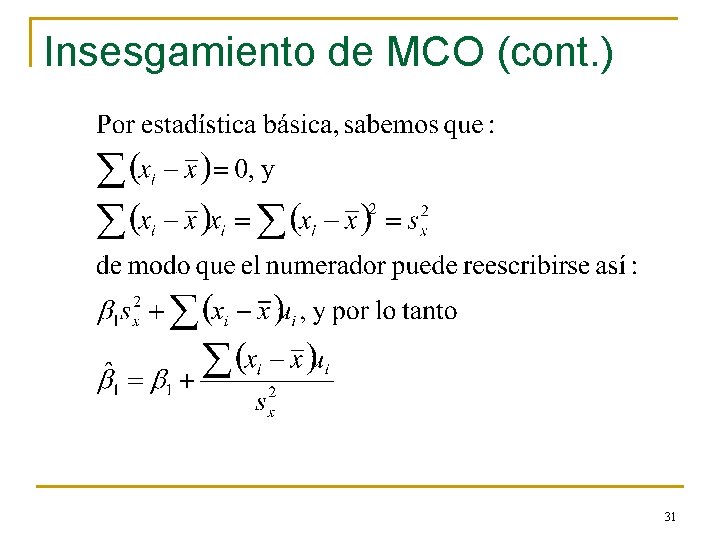

Insesgamiento de MCO (cont. ) 31

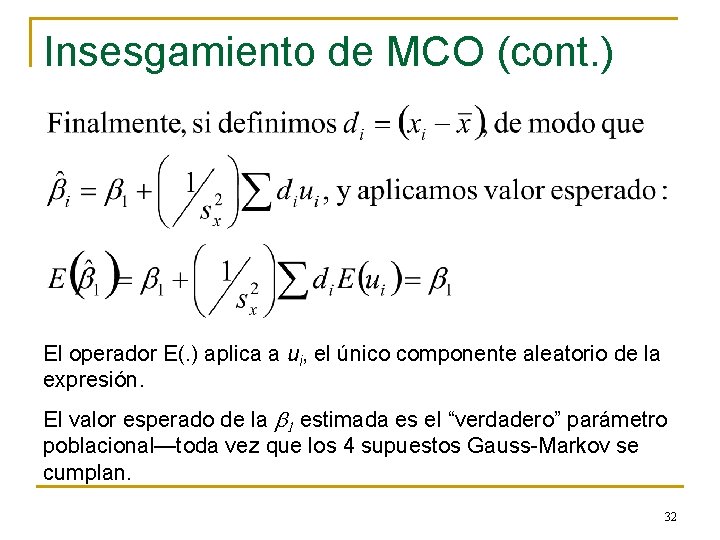

Insesgamiento de MCO (cont. ) El operador E(. ) aplica a ui, el único componente aleatorio de la expresión. El valor esperado de la b 1 estimada es el “verdadero” parámetro poblacional—toda vez que los 4 supuestos Gauss-Markov se cumplan. 32

Insesgamiento: resumen n Los estimadores MCO de b 1 y b 0 son insesgados. La demostración de esto depende de los 4 supuestos Gauss-Markov: si alguno de ellos no se cumple, MCO no necesariamente será insesgado. El insesgamiento es una propiedad del estimador muestral: dada cierta muestra, éste puede estar cerca o lejos del verdadero parámetro poblacional. 33

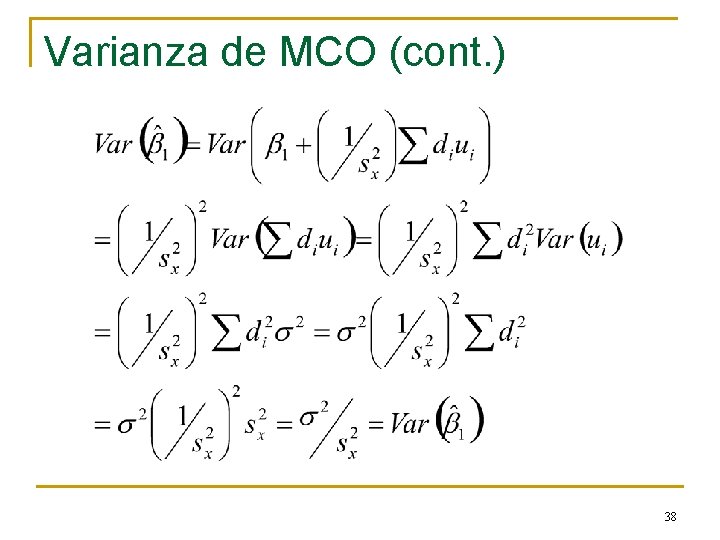

Varianza de los estimadores MCO n n n Ya vimos que la “distribución muestral” de nuestro estimador está centrada en torno al “verdadero” parámetro. ¿Qué tan dispersa será la distribución del estimador? Para analizar esto, requerimos un supuesto Gauss-Markov adicional (el 5º): var(u|x) = s 2 conocido como homoscedasticidad (homoskedasticity): varianza constante. 34

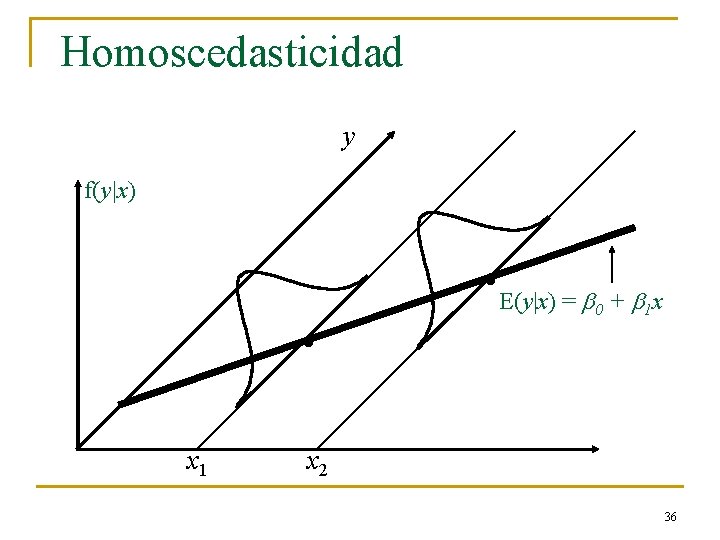

Varianza de MCO (cont. ) n n n n Por estadística sabemos que: s 2 = Var(u|x) = E(u 2|x)-[E(u|x)]2 Y como E(u|x) = 0, entonces: s 2 = E(u 2|x) = E(u 2) = Var(u) De modo que s 2 es la varianza no condicional de los residuales, también llamada varianza del error. s, la raíz cuadrada de la varianza del error, se conoce como la desviación estándar del error. Con lo cual podemos decir que: E(y|x)=b 0 + b 1 x Var(y|x) = s 2 35

Homoscedasticidad y f(y|x) . x 1 . E(y|x) = b + b x 0 1 x 2 36

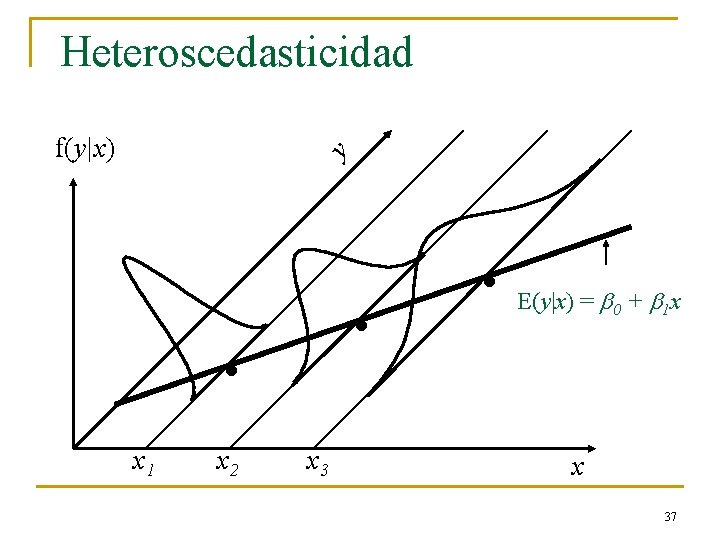

Heteroscedasticidad y f(y|x) . . x 1 x 2 x 3 . E(y|x) = b 0 + b 1 x x 37

Varianza de MCO (cont. ) 38

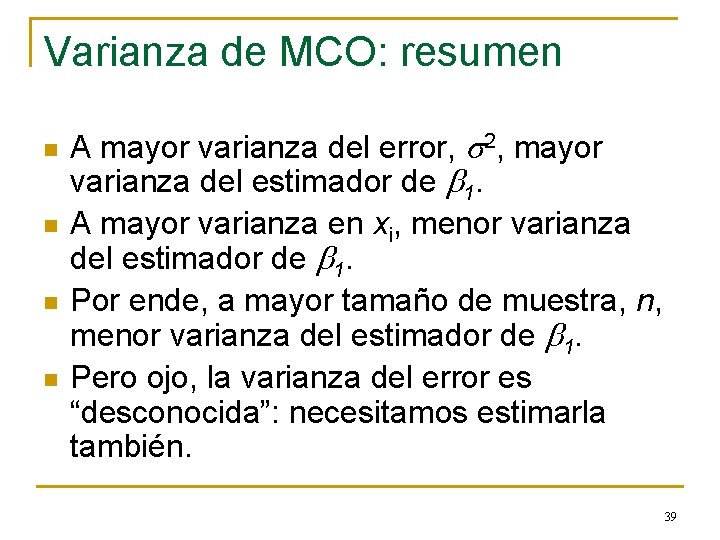

Varianza de MCO: resumen n n A mayor varianza del error, s 2, mayor varianza del estimador de b 1. A mayor varianza en xi, menor varianza del estimador de b 1. Por ende, a mayor tamaño de muestra, n, menor varianza del estimador de b 1. Pero ojo, la varianza del error es “desconocida”: necesitamos estimarla también. 39

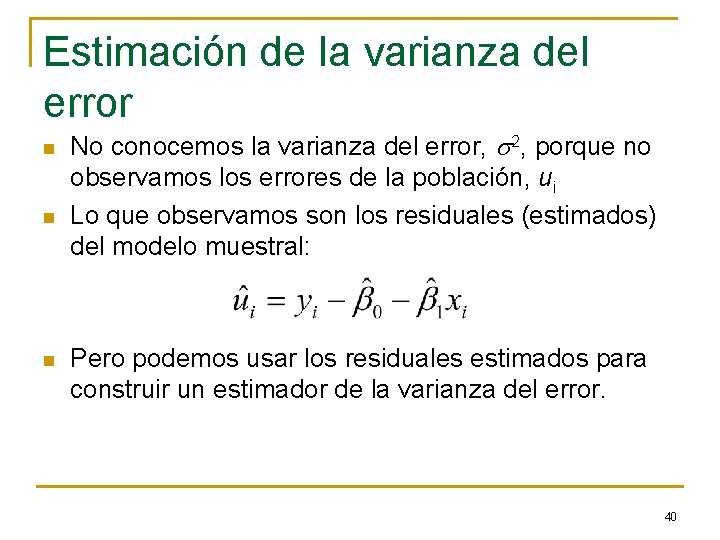

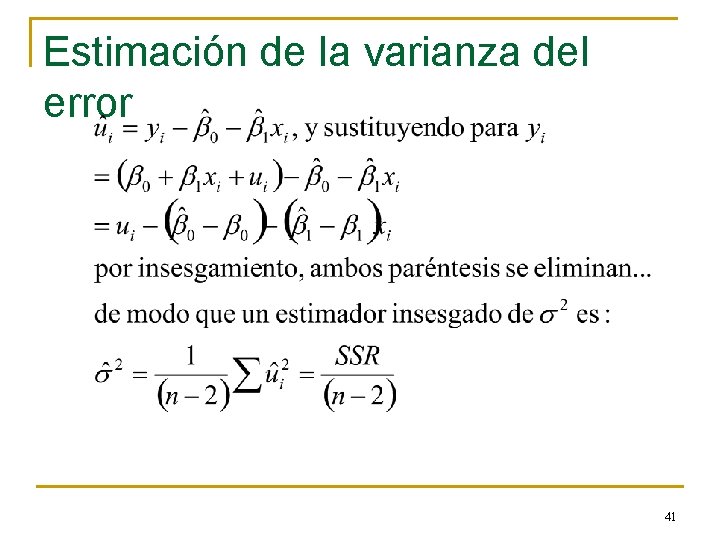

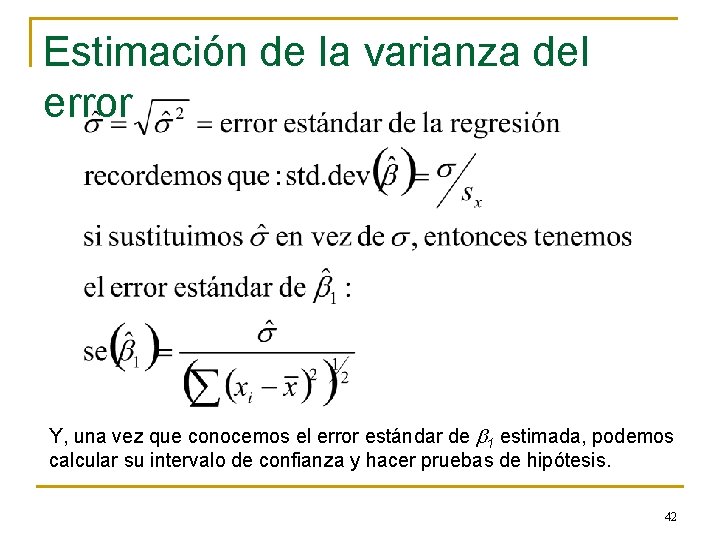

Estimación de la varianza del error n n n No conocemos la varianza del error, s 2, porque no observamos los errores de la población, ui Lo que observamos son los residuales (estimados) del modelo muestral: Pero podemos usar los residuales estimados para construir un estimador de la varianza del error. 40

Estimación de la varianza del error 41

Estimación de la varianza del error Y, una vez que conocemos el error estándar de b 1 estimada, podemos calcular su intervalo de confianza y hacer pruebas de hipótesis. 42

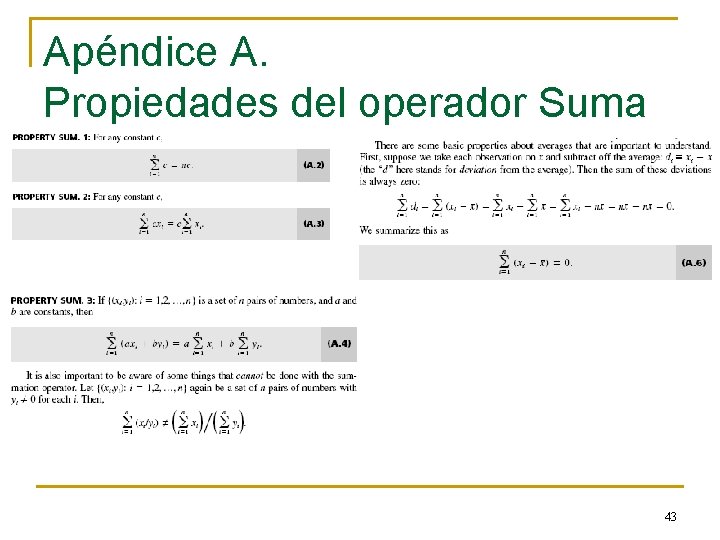

Apéndice A. Propiedades del operador Suma 43

Apéndice A. Propiedades del operador Suma 44

- Slides: 44