Probleme in der Psychologie Replikationskrise Replikationskrise 90 Yes

Probleme in der Psychologie

Replikationskrise

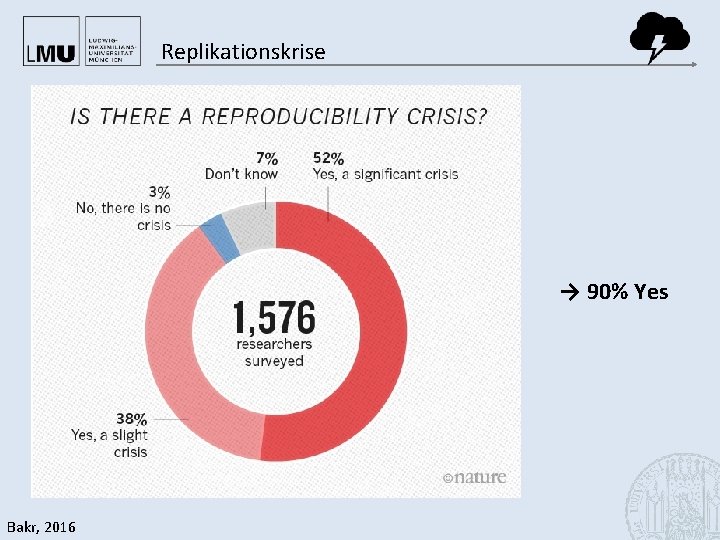

Replikationskrise → 90% Yes Bakr, 2016

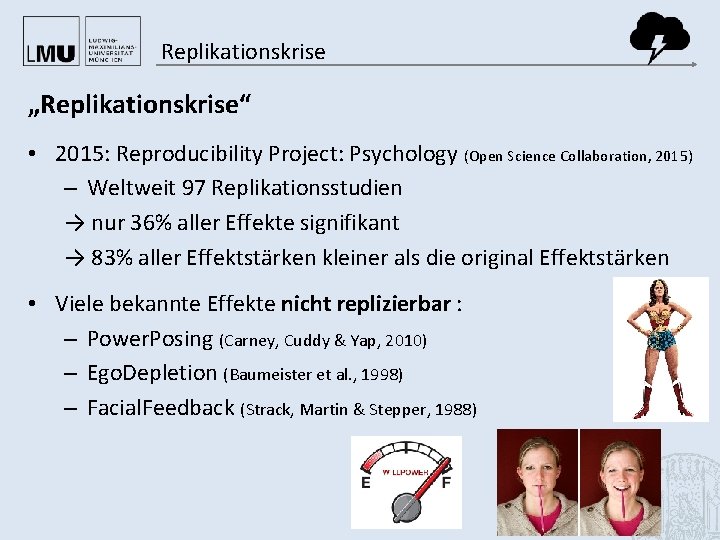

Replikationskrise „Replikationskrise“ • 2015: Reproducibility Project: Psychology (Open Science Collaboration, 2015) – Weltweit 97 Replikationsstudien → nur 36% aller Effekte signifikant → 83% aller Effektstärken kleiner als die original Effektstärken • Viele bekannte Effekte nicht replizierbar : – Power. Posing (Carney, Cuddy & Yap, 2010) – Ego. Depletion (Baumeister et al. , 1998) – Facial. Feedback (Strack, Martin & Stepper, 1988)

Replikationskrise Wir sind nicht alleine… Welcher Teil der publizierten Forschungsergebnisse kann repliziert werden? * Ökonomie: reine Reproduktion , d. h. Versuch anhand der selben Daten zum selben Ergebnis zu kommen

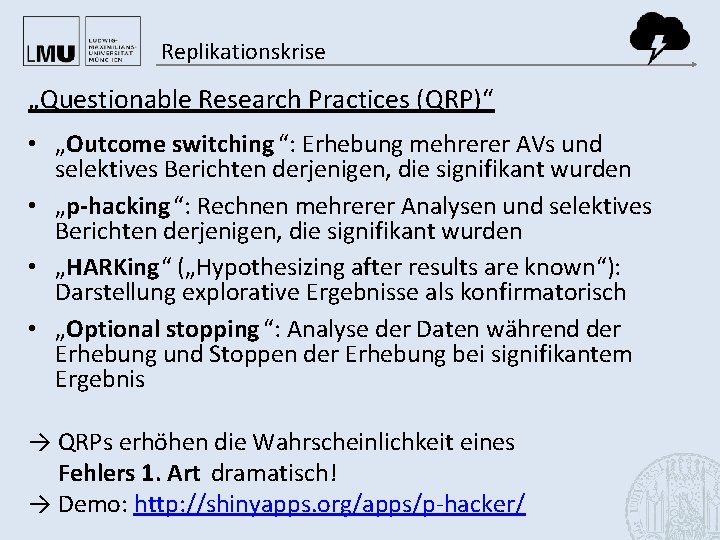

Replikationskrise „Questionable Research Practices (QRP)“ • „Outcome switching “: Erhebung mehrerer AVs und selektives Berichten derjenigen, die signifikant wurden • „p-hacking“: Rechnen mehrerer Analysen und selektives Berichten derjenigen, die signifikant wurden • „HARKing“ („Hypothesizing after results are known“): Darstellung explorative Ergebnisse als konfirmatorisch • „Optional stopping “: Analyse der Daten während der Erhebung und Stoppen der Erhebung bei signifikantem Ergebnis → QRPs erhöhen die Wahrscheinlichkeit eines Fehlers 1. Art dramatisch! → Demo: http: //shinyapps. org/apps/p-hacker/

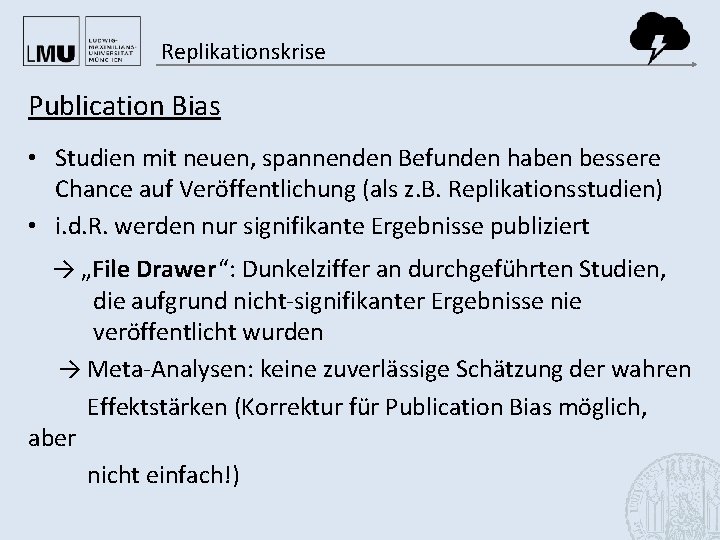

Replikationskrise Publication Bias • Studien mit neuen, spannenden Befunden haben bessere Chance auf Veröffentlichung (als z. B. Replikationsstudien) • i. d. R. werden nur signifikante Ergebnisse publiziert → „File Drawer“: Dunkelziffer an durchgeführten Studien, die aufgrund nicht-signifikanter Ergebnisse nie veröffentlicht wurden → Meta-Analysen: keine zuverlässige Schätzung der wahren Effektstärken (Korrektur für Publication Bias möglich, aber nicht einfach!)

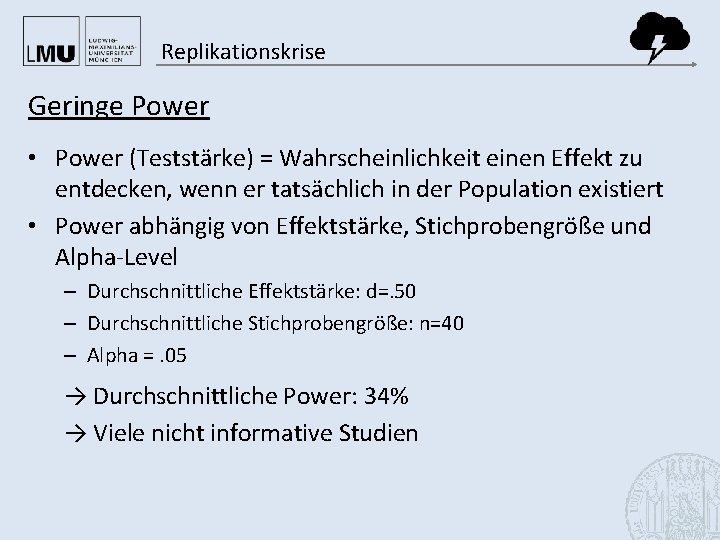

Replikationskrise Geringe Power • Power (Teststärke) = Wahrscheinlichkeit einen Effekt zu entdecken, wenn er tatsächlich in der Population existiert • Power abhängig von Effektstärke, Stichprobengröße und Alpha-Level – Durchschnittliche Effektstärke: d=. 50 – Durchschnittliche Stichprobengröße: n=40 – Alpha =. 05 → Durchschnittliche Power: 34% → Viele nicht informative Studien

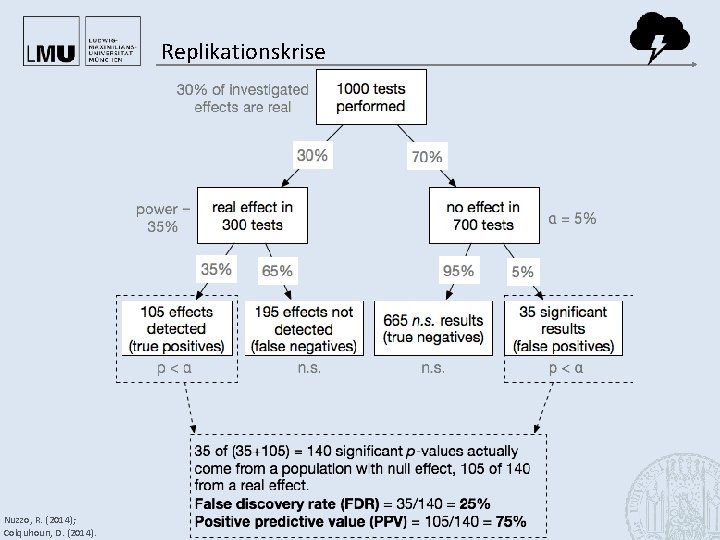

Replikationskrise Nuzzo, R. (2014); Colquhoun, D. (2014).

Replikationskrise Falsche Anreizstrukturen • Power (Teststärke) = Wahrscheinlichkeit einen Effekt zu entdecken, wenn er tatsächlich in der Population existiert • Power abhängig von Effektstärke, Stichprobengröße und Alpha-Level – Durchschnittliche Effektstärke: d=. 50 – Durchschnittliche Stichprobengröße: n=40 – Alpha =. 05 → Durchschnittliche Power: 34% → Viele nicht informative Studien

Replikationskrise Falsche Anreizstrukturen • Wissenschaftliche Karriere: Anzahl der Publikationen ausschlaggebend Richard Horton, Editor von The Lancet

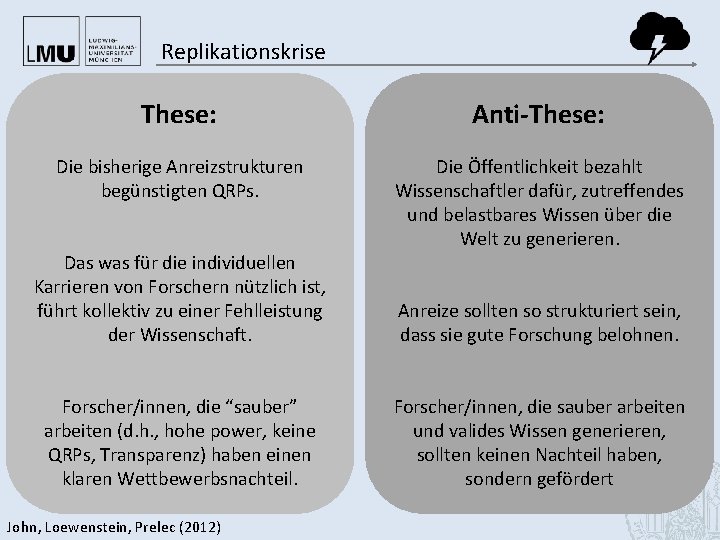

Replikationskrise These: Anti-These: Die bisherige Anreizstrukturen begünstigten QRPs. Die Öffentlichkeit bezahlt Wissenschaftler dafür, zutreffendes und belastbares Wissen über die Welt zu generieren. Das was für die individuellen Karrieren von Forschern nützlich ist, führt kollektiv zu einer Fehlleistung der Wissenschaft. Forscher/innen, die “sauber” arbeiten (d. h. , hohe power, keine QRPs, Transparenz) haben einen klaren Wettbewerbsnachteil. John, Loewenstein, Prelec (2012) Anreize sollten so strukturiert sein, dass sie gute Forschung belohnen. Forscher/innen, die sauber arbeiten und valides Wissen generieren, sollten keinen Nachteil haben, sondern gefördert

Lösungen

Lösungen: • Präregistrierungen – Vor der Datenerhebung Bedingungen (u. a. Hypothesen, Messinstrument, statistische Analyse) der Studie festlegen – Öffentliche Plattformen: Open Science Framework (http: //osf. io/ ) oder as. Predicted. org → p-Hacking weitgehend verhindert • Hohe Power ( Stichprobenplanung!) • Unabhängige Replikationen mit hoher Power

Lösungen Open Science = Offene Daten, offene Materialien, offene Analyseskripte & Präregistrierungen • “Die Bereitschaft Forschungsdaten zu teilen steht in Zusammenhang mit der Stärke der Beweise und der Qualität des Berichts der statistischen Ergebnisse” (Wicherts, Bakker, & Molenaar, 2011) • Quarterly Journal of Political Science: 54% der eingereichten Paper enthielten Resultate, die von den Resultaten abwichen, die mit dem beigefügten Code der Autoren generiert wurden (Eubank, 2014) → Gute Aufbereitung von Daten-Set und Analyse-Code als Indikator der Validität der Studie

Lösungen Open Science A 21 Word Solution “We report how we determined our sample size, all data exclusions (if any), all manipulations, and all measures in the study. ” Dieses Statement in einem Paper macht transparent, dass “nicht geschummelt wurde” Simmons, Nelson & Simonsohn (2011)

Zusammenfassung Probleme in der Psychologie https: //www. youtube. com/watch? v=42 Qu. XLuc. H 3 Q • Hoher Anteil falscher Ergebnisse in der veröffentlichten Wissenschaft • Beleg durch Reproducibility Projekte • Probleme: Publication Bias, Power, p-Hacking, falsche Anreize • Lösungen: Open Science, Replikationsstudien, …

Quellen I • Replikationskrise: Baker, M. (2016). 1, 500 scientists lift the lid on reproducibility. Nature, 533(7604), 452 -454. • Power Posing: • Carney, D. R. , Cuddy, A. J. , & Yap, A. J. (2010). Power posing: Brief nonverbal displays affect neuroendocrine levels and risk tolerance. Psychological science, 21(10), 1363 -1368. • Ranehill, E. , Dreber, A. , Johannesson, M. , Leiberg, S. , Sul, S. , & Weber, R. A. (2015). Assessing the robustness of power posing: No effect on hormones and risk tolerance in a large sample of men and women. Psychological Science, 26(5), 653 -656. • Ego Depletion: • Baumeister, R. F. , Bratslavsky, E. , Muraven, M. , & Tice, D. M. (1998). Ego depletion: Is the active self a limited resource? . Journal of personality and social psychology, 74(5), 1252 -1265. • Hagger, M. S. , Chatzisarantis, N. L. , Alberts, H. , Anggono, C. O. , Batailler, C. , Birt, A. R. , . . . & Calvillo, D. P. (2016). A multilab preregistered replication of the ego-depletion effect. Perspectives on Psychological Science , 11(4), 546 -573. • Facial Feedback: • Strack, F. , Martin, L. L. , & Stepper, S. (1988). Inhibiting and facilitating conditions of the human smile: a nonobtrusive test of the facial feedback hypothesis. Journal of personality and social psychology, 54(5), 768 -777. • Wagenmakers, E. J. , Beek, T. , Dijkhoff, L. , Gronau, Q. F. , Acosta, A. , Adams Jr, R. B. , . . . & Bulnes, L. C. (2016). Registered Replication Report: Strack, Martin, & Stepper (1988). Perspectives on Psychological Science, 11(6), 917 -928.

Quellen II • Replizierbarkeit • Psychologie: Open Science Collaboration (2015). Estimating the reproducibility of psychological science. Science, 349(6251), aac 4716 -1 – acc 4716 -8. • Ökonomie: Chang, A. C. , & Li, P. (2015). Is economics research replicable? Sixty published papers from thirteen journals say'usually not'. Finance and Economics Discussion Series 2015 -083. Washington: Board of Governors of the Federal Reserve System. • Krebsforschung 1: Begley, C. G. , & Ellis, L. M. (2012). Drug development: Raise standards for preclinical cancer research. Nature, 483(7391), 531 -533. • Krebsforschung 2: Prinz, F. , Schlange, T. , & Asadullah, K. (2011). Believe it or not: how much can we rely on published data on potential drug targets? . Nature reviews Drug discovery , 10(9), 712 -712. • Power-Problematik: • Nuzzo, R. (2014). Statistical errors. Nature, 506(7487), 150 -152. • Colquhoun, D. (2014). An investigation of the false discovery rate and the misinterpretation of p-values. Royal Society Open Science, 1 (3), 140216– 140216. • Anreizstrukturen: John, L. K. , Loewenstein, G. , & Prelec, D. (2012). Measuring the prevalence of questionable research practices with incentives for truth telling. Psychological science, 23(5), 524 -532. • Open Science: • Wicherts, J. M. , Bakker, M. , & Molenaar, D. (2011). Willingness to share research data is related to the strength of the evidence and the quality of reporting of statistical results. Plo. S one, 6(11), e 26828. • Eubank, N. (2014). A Decade of Replications: Lessons from the Quarterly Journal of Political Science. The Political Methodologist. Abgerufen unter: https: //thepoliticalmethodologist. com/2014/12/09/a-decade-ofreplications-lessons-from-the-quarterly-journal-of-political-science/ • Simmons, J. P. , Nelson, L. D. , & Simonsohn, U. (2012). A 21 word solution.

Danksagung Dieser Foliensatz ist im Rahmen eines von Lehre@LMU geförderten Multiplikatoren-Projekts zur Vereinheitlichung der Parallel-Kurse der Lehrveranstaltung „Empirisches Praktikum“ entstanden. Projekt-Team: Dr. Stephanie Lichtenfeld, Dr. Vanessa Büchner & M. Sc. Caroline Zygar mit großer Unterstützung von B. Sc. Larissa Sust Als Grundlage für diesen Foliensatz dienten u. a. Folien von Dr. Stephanie Lichtenfeld & PD Dr. Felix Schönbrodt. Wir danken für die Bereitstellung der Materialien!

- Slides: 20