Pravdpodobnost nhodnch jev Pravdpodobnost nhodnho jevu je slo

Pravděpodobnost náhodných jevů Pravděpodobnost náhodného jevu je číslo, které je mírou očekávatelnosti výskytu jevu. Náhodným jevem rozumíme opakovatelnou činnost prováděnou za stejných (nebo přibližně stejných) podmínek, jejíž výsledek je nejistý a závisí na náhodě. Příklady mohou být například házení kostkou, střelba do terče nebo losování loterie. Blaise Pascal 1623 - 1262 Pierre de Fermat 1601 - 1665 Rozvoj teorie pravděpodobnosti probíhal od 17. století, zpočátku inspirován hlavně hazardními hrami. Za její počátek se považuje slavná výměna dopisů mezi matematiky Blaisem Pascalem a Pierrem Fermatem zahájená roku 1654. Šlo jim tehdy o otázku, jak spravedlivě rozdělit bank mezi hráče, jestliže série hazardních her musela být předčasně přerušena. Dalším stimulem pak byl rozvoj pojišťovnictví. Evropský sociální fond Praha & EU: Investujeme do vaší budoucnosti Pro projekt „Cesta k vědě“ (veda. gymjs. net) vytvořil V. Pospíšil (gdermog@seznam. cz). Modifikace a šíření dokumentu podléhá licenci CC-BY-SA.

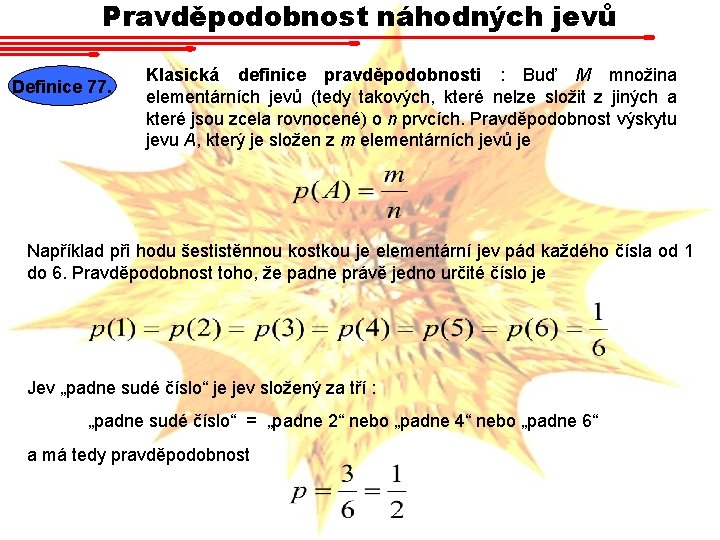

Pravděpodobnost náhodných jevů Definice 77. Klasická definice pravděpodobnosti : Buď M množina elementárních jevů (tedy takových, které nelze složit z jiných a které jsou zcela rovnocené) o n prvcích. Pravděpodobnost výskytu jevu A, který je složen z m elementárních jevů je Například při hodu šestistěnnou kostkou je elementární jev pád každého čísla od 1 do 6. Pravděpodobnost toho, že padne právě jedno určité číslo je Jev „padne sudé číslo“ je jev složený za tří : „padne sudé číslo“ = „padne 2“ nebo „padne 4“ nebo „padne 6“ a má tedy pravděpodobnost

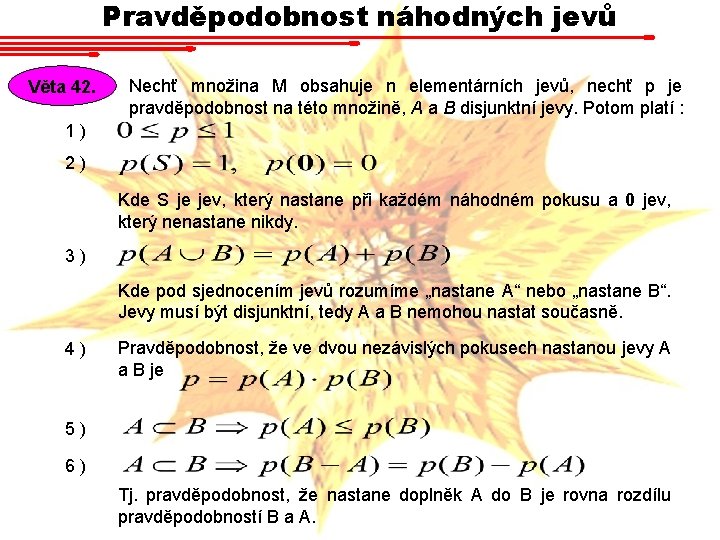

Pravděpodobnost náhodných jevů Věta 42. Nechť množina M obsahuje n elementárních jevů, nechť p je pravděpodobnost na této množině, A a B disjunktní jevy. Potom platí : 1) 2) Kde S je jev, který nastane při každém náhodném pokusu a 0 jev, který nenastane nikdy. 3) Kde pod sjednocením jevů rozumíme „nastane A“ nebo „nastane B“. Jevy musí být disjunktní, tedy A a B nemohou nastat současně. 4) Pravděpodobnost, že ve dvou nezávislých pokusech nastanou jevy A a B je 5) 6) Tj. pravděpodobnost, že nastane doplněk A do B je rovna rozdílu pravděpodobností B a A.

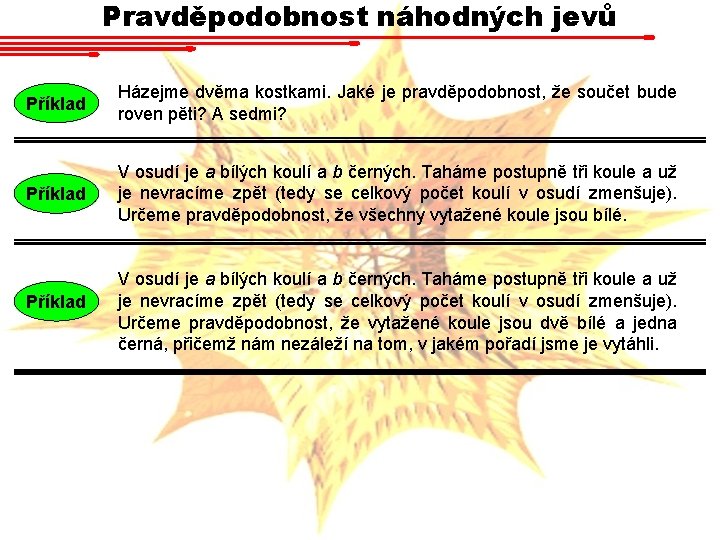

Pravděpodobnost náhodných jevů Příklad Házejme dvěma kostkami. Jaké je pravděpodobnost, že součet bude roven pěti? A sedmi? Příklad V osudí je a bílých koulí a b černých. Taháme postupně tři koule a už je nevracíme zpět (tedy se celkový počet koulí v osudí zmenšuje). Určeme pravděpodobnost, že všechny vytažené koule jsou bílé. Příklad V osudí je a bílých koulí a b černých. Taháme postupně tři koule a už je nevracíme zpět (tedy se celkový počet koulí v osudí zmenšuje). Určeme pravděpodobnost, že vytažené koule jsou dvě bílé a jedna černá, přičemž nám nezáleží na tom, v jakém pořadí jsme je vytáhli.

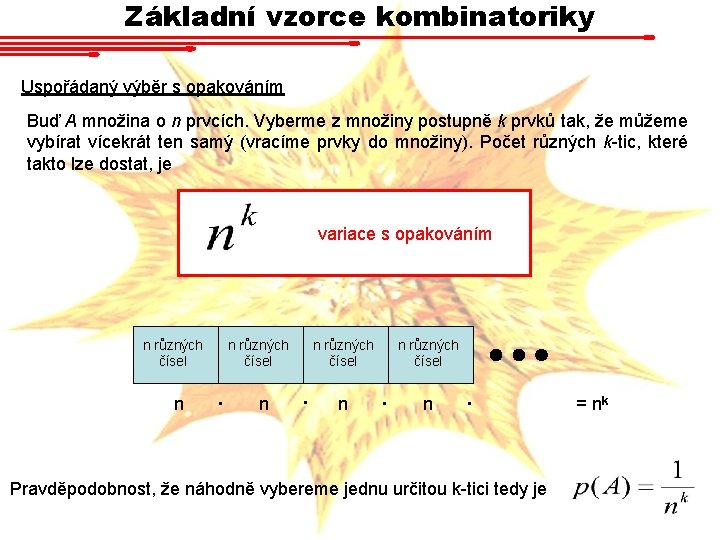

Základní vzorce kombinatoriky Uspořádaný výběr s opakováním Buď A množina o n prvcích. Vyberme z množiny postupně k prvků tak, že můžeme vybírat vícekrát ten samý (vracíme prvky do množiny). Počet různých k-tic, které takto lze dostat, je variace s opakováním n různých čísel n n různých čísel . n . Pravděpodobnost, že náhodně vybereme jednu určitou k-tici tedy je = nk

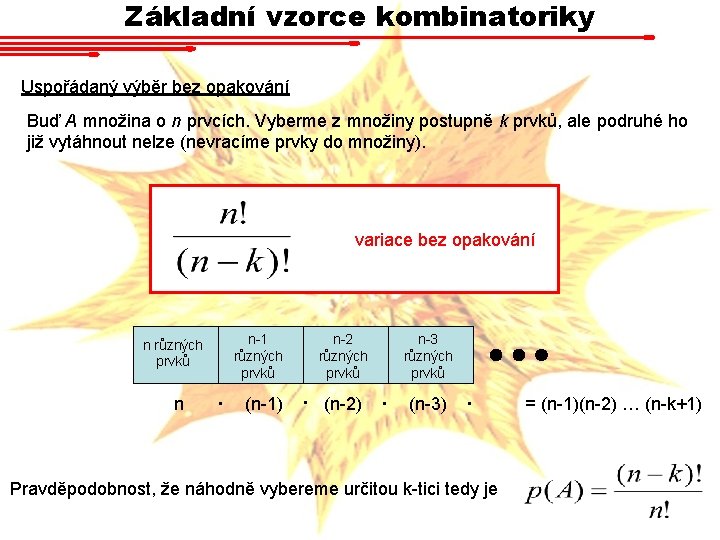

Základní vzorce kombinatoriky Uspořádaný výběr bez opakování Buď A množina o n prvcích. Vyberme z množiny postupně k prvků, ale podruhé ho již vytáhnout nelze (nevracíme prvky do množiny). variace bez opakování n-1 různých prvků n . (n-1) n-2 různých prvků . (n-2) n-3 různých prvků . (n-3) . Pravděpodobnost, že náhodně vybereme určitou k-tici tedy je = (n-1)(n-2) … (n-k+1)

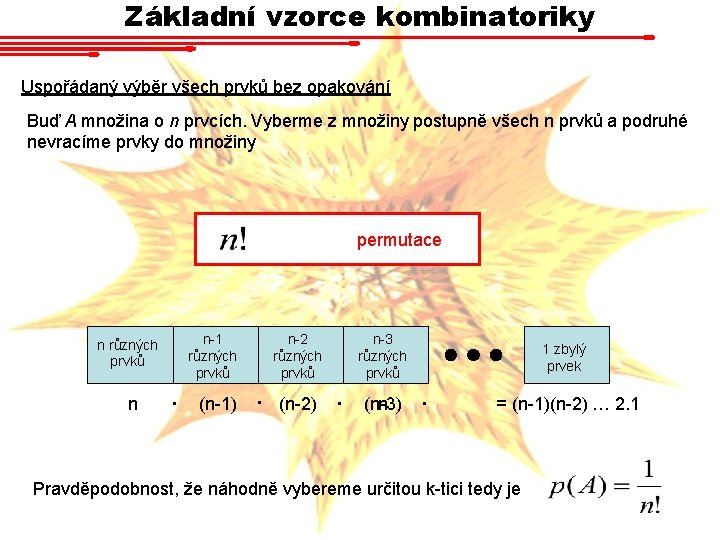

Základní vzorce kombinatoriky Uspořádaný výběr všech prvků bez opakování Buď A množina o n prvcích. Vyberme z množiny postupně všech n prvků a podruhé nevracíme prvky do množiny permutace n-1 různých prvků n . (n-1) n-2 různých prvků . (n-2) n-3 různých prvků . (n-3) n 1 zbylý prvek . = (n-1)(n-2) … 2. 1 Pravděpodobnost, že náhodně vybereme určitou k-tici tedy je

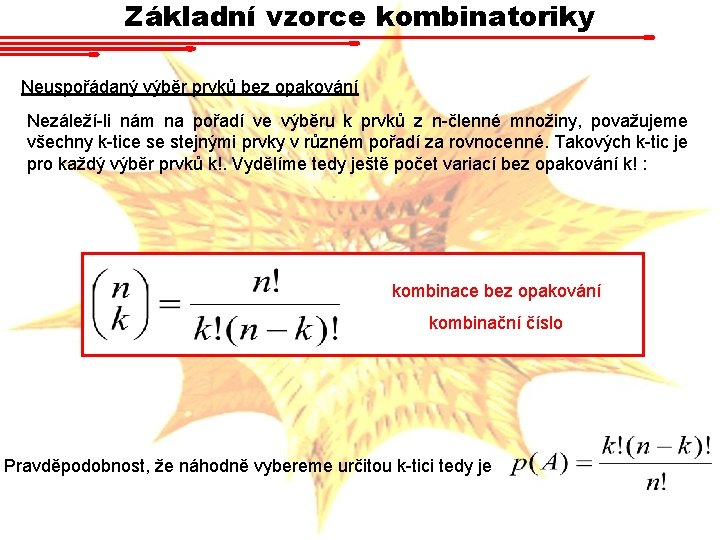

Základní vzorce kombinatoriky Neuspořádaný výběr prvků bez opakování Nezáleží-li nám na pořadí ve výběru k prvků z n-členné množiny, považujeme všechny k-tice se stejnými prvky v různém pořadí za rovnocenné. Takových k-tic je pro každý výběr prvků k!. Vydělíme tedy ještě počet variací bez opakování k! : kombinace bez opakování kombinační číslo Pravděpodobnost, že náhodně vybereme určitou k-tici tedy je

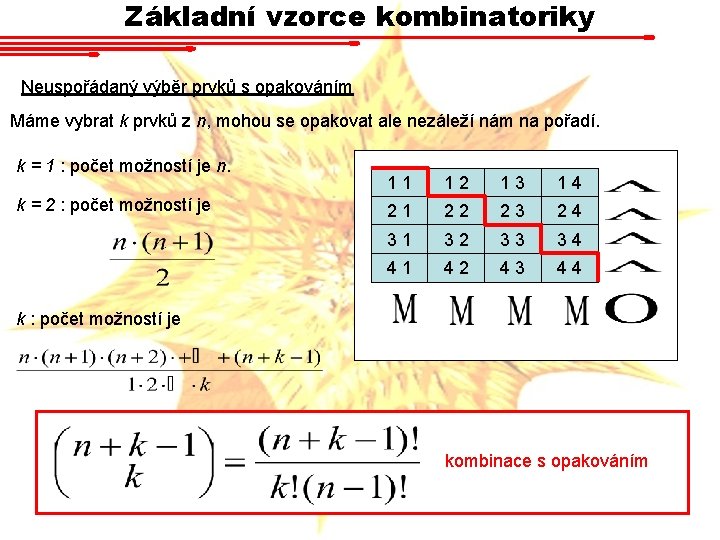

Základní vzorce kombinatoriky Neuspořádaný výběr prvků s opakováním Máme vybrat k prvků z n, mohou se opakovat ale nezáleží nám na pořadí. k = 1 : počet možností je n. k = 2 : počet možností je 11 12 13 14 21 22 23 24 31 32 33 34 41 42 43 44 k : počet možností je kombinace s opakováním

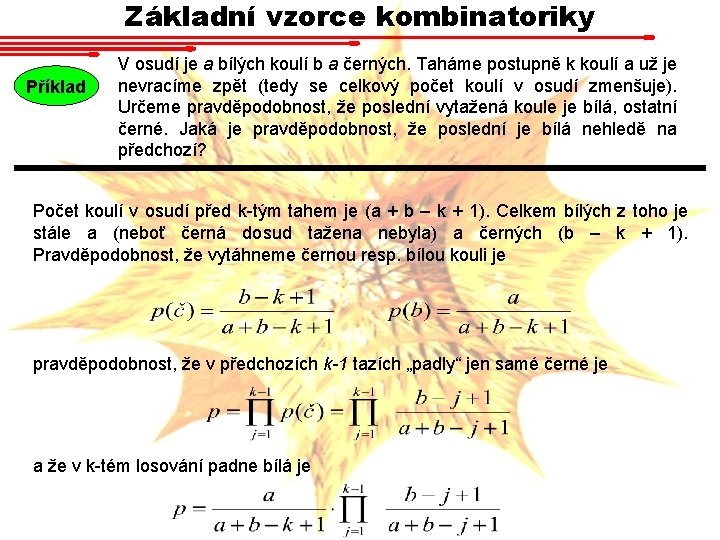

Základní vzorce kombinatoriky Příklad V osudí je a bílých koulí b a černých. Taháme postupně k koulí a už je nevracíme zpět (tedy se celkový počet koulí v osudí zmenšuje). Určeme pravděpodobnost, že poslední vytažená koule je bílá, ostatní černé. Jaká je pravděpodobnost, že poslední je bílá nehledě na předchozí? Počet koulí v osudí před k-tým tahem je (a + b – k + 1). Celkem bílých z toho je stále a (neboť černá dosud tažena nebyla) a černých (b – k + 1). Pravděpodobnost, že vytáhneme černou resp. bílou kouli je pravděpodobnost, že v předchozích k-1 tazích „padly“ jen samé černé je a že v k-tém losování padne bílá je

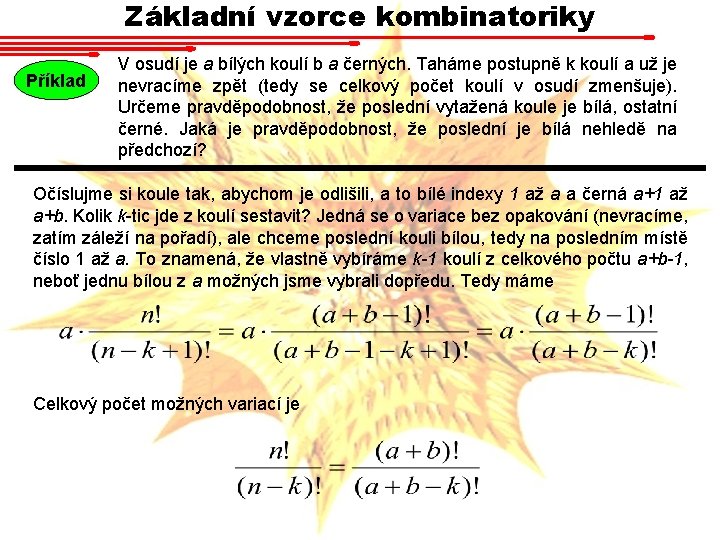

Základní vzorce kombinatoriky Příklad V osudí je a bílých koulí b a černých. Taháme postupně k koulí a už je nevracíme zpět (tedy se celkový počet koulí v osudí zmenšuje). Určeme pravděpodobnost, že poslední vytažená koule je bílá, ostatní černé. Jaká je pravděpodobnost, že poslední je bílá nehledě na předchozí? Očíslujme si koule tak, abychom je odlišili, a to bílé indexy 1 až a a černá a+1 až a+b. Kolik k-tic jde z koulí sestavit? Jedná se o variace bez opakování (nevracíme, zatím záleží na pořadí), ale chceme poslední kouli bílou, tedy na posledním místě číslo 1 až a. To znamená, že vlastně vybíráme k-1 koulí z celkového počtu a+b-1, neboť jednu bílou z a možných jsme vybrali dopředu. Tedy máme Celkový počet možných variací je

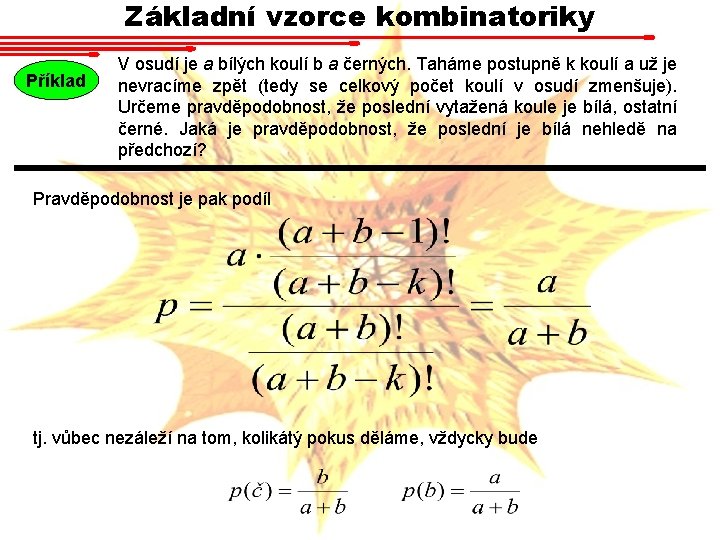

Základní vzorce kombinatoriky Příklad V osudí je a bílých koulí b a černých. Taháme postupně k koulí a už je nevracíme zpět (tedy se celkový počet koulí v osudí zmenšuje). Určeme pravděpodobnost, že poslední vytažená koule je bílá, ostatní černé. Jaká je pravděpodobnost, že poslední je bílá nehledě na předchozí? Pravděpodobnost je pak podíl tj. vůbec nezáleží na tom, kolikátý pokus děláme, vždycky bude

Pravděpodobnost náhodných jevů Předchozí definice nám ale nestačí. Kde je problém? No jasně – co když je možných jevů nekonečně mnoho?

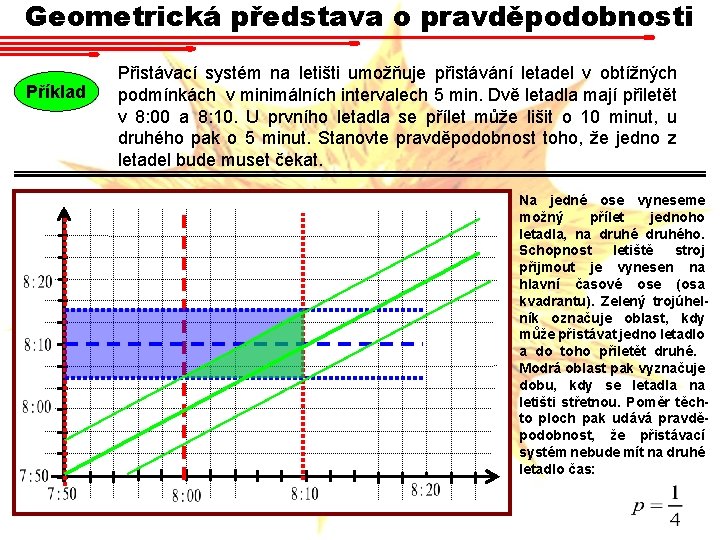

Geometrická představa o pravděpodobnosti Příklad Přistávací systém na letišti umožňuje přistávání letadel v obtížných podmínkách v minimálních intervalech 5 min. Dvě letadla mají přiletět v 8: 00 a 8: 10. U prvního letadla se přílet může lišit o 10 minut, u druhého pak o 5 minut. Stanovte pravděpodobnost toho, že jedno z letadel bude muset čekat. Na jedné ose vyneseme možný přílet jednoho letadla, na druhého. Schopnost letiště stroj přijmout je vynesen na hlavní časové ose (osa kvadrantu). Zelený trojúhelník označuje oblast, kdy může přistávat jedno letadlo a do toho přiletět druhé. Modrá oblast pak vyznačuje dobu, kdy se letadla na letišti střetnou. Poměr těchto ploch pak udává pravděpodobnost, že přistávací systém nebude mít na druhé letadlo čas:

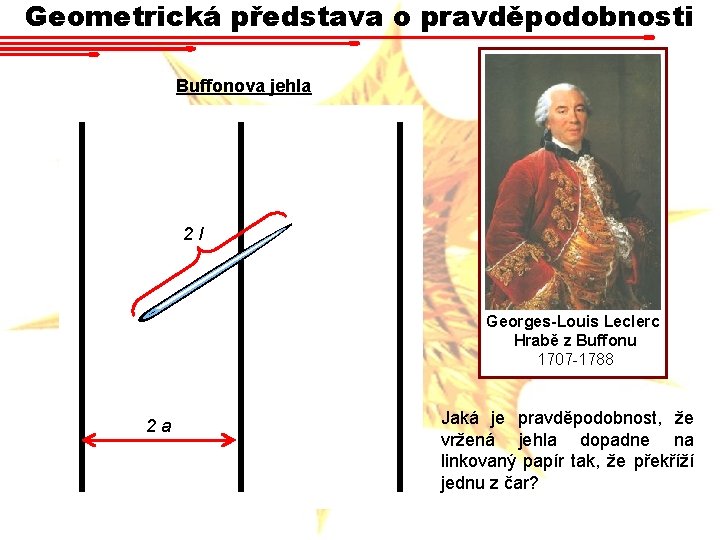

Geometrická představa o pravděpodobnosti Buffonova jehla 2 l Georges-Louis Leclerc Hrabě z Buffonu 1707 -1788 2 a Jaká je pravděpodobnost, že vržená jehla dopadne na linkovaný papír tak, že překříží jednu z čar?

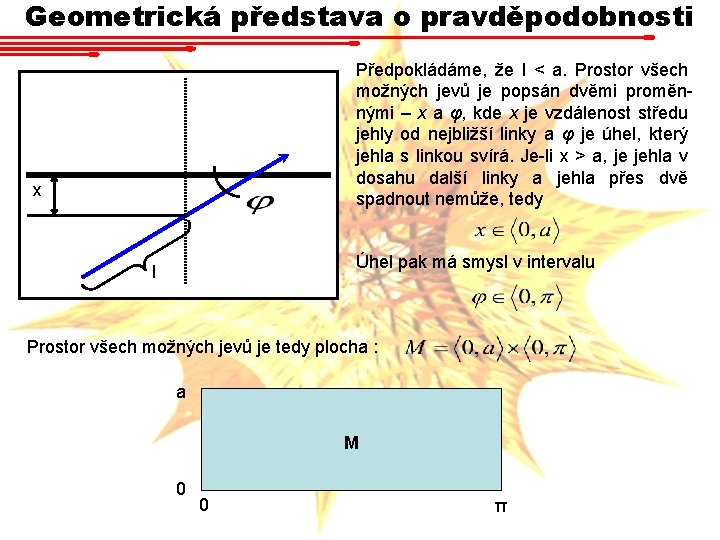

Geometrická představa o pravděpodobnosti Předpokládáme, že l < a. Prostor všech možných jevů je popsán dvěmi proměnnými – x a φ, kde x je vzdálenost středu jehly od nejbližší linky a φ je úhel, který jehla s linkou svírá. Je-li x > a, je jehla v dosahu další linky a jehla přes dvě spadnout nemůže, tedy x Úhel pak má smysl v intervalu l Prostor všech možných jevů je tedy plocha : a M 0 0 π

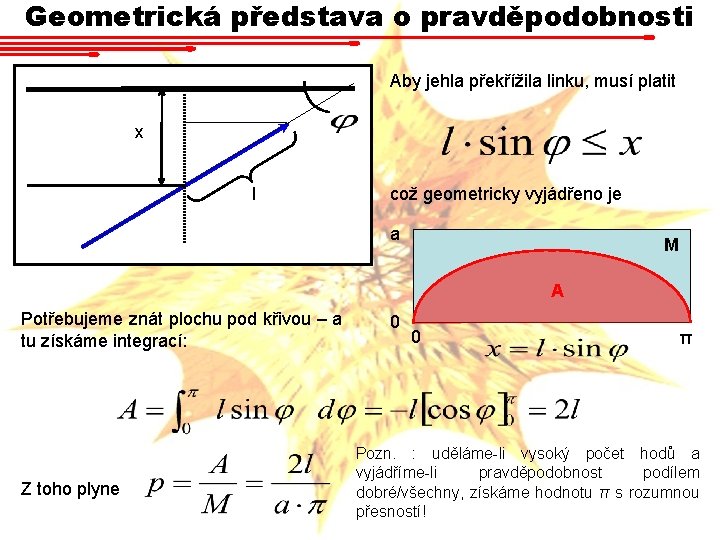

Geometrická představa o pravděpodobnosti Aby jehla překřížila linku, musí platit x l což geometricky vyjádřeno je a M A Potřebujeme znát plochu pod křivou – a tu získáme integrací: Z toho plyne 0 0 π Pozn. : uděláme-li vysoký počet hodů a vyjádříme-li pravděpodobnost podílem dobré/všechny, získáme hodnotu π s rozumnou přesností!

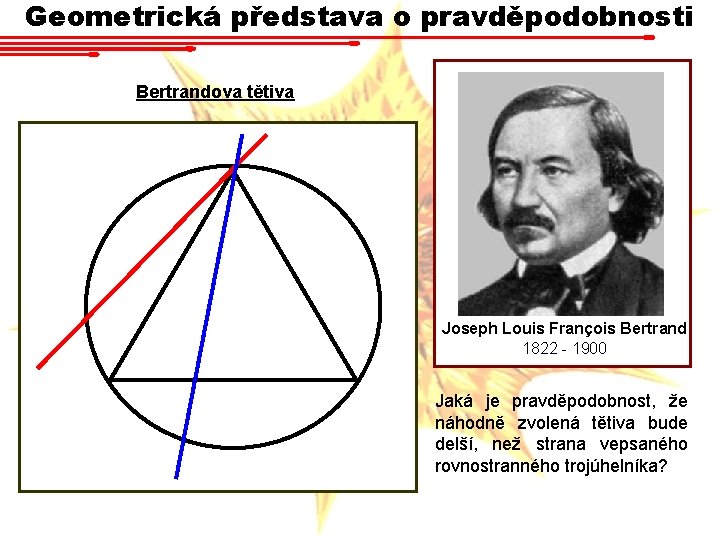

Geometrická představa o pravděpodobnosti Bertrandova tětiva Joseph Louis François Bertrand 1822 - 1900 Jaká je pravděpodobnost, že náhodně zvolená tětiva bude delší, než strana vepsaného rovnostranného trojúhelníka?

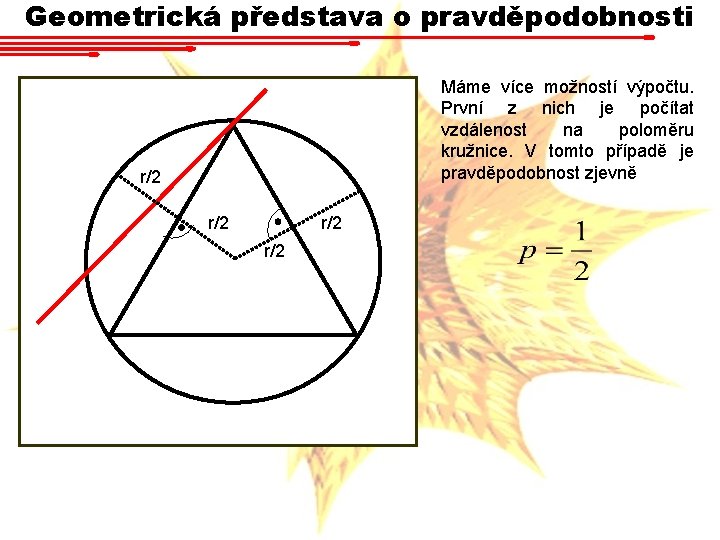

Geometrická představa o pravděpodobnosti Máme více možností výpočtu. První z nich je počítat vzdálenost na poloměru kružnice. V tomto případě je pravděpodobnost zjevně r/2 r/2

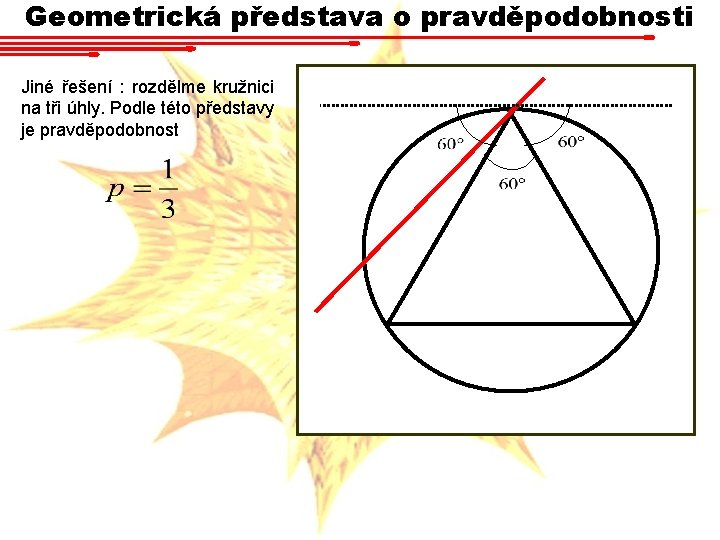

Geometrická představa o pravděpodobnosti Jiné řešení : rozdělme kružnici na tři úhly. Podle této představy je pravděpodobnost

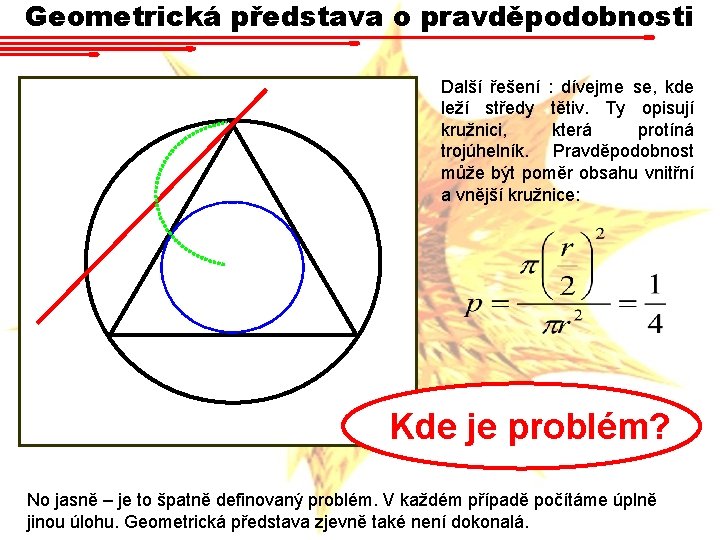

Geometrická představa o pravděpodobnosti Další řešení : dívejme se, kde leží středy tětiv. Ty opisují kružnici, která protíná trojúhelník. Pravděpodobnost může být poměr obsahu vnitřní a vnější kružnice: Kde je problém? No jasně – je to špatně definovaný problém. V každém případě počítáme úplně jinou úlohu. Geometrická představa zjevně také není dokonalá.

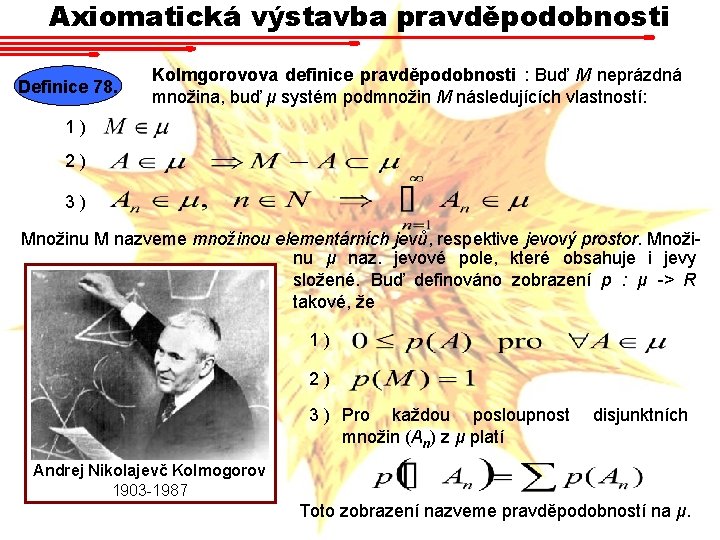

Axiomatická výstavba pravděpodobnosti Definice 78. Kolmgorovova definice pravděpodobnosti : Buď M neprázdná množina, buď μ systém podmnožin M následujících vlastností: 1) 2) 3) Množinu M nazveme množinou elementárních jevů, respektive jevový prostor. Množinu μ naz. jevové pole, které obsahuje i jevy složené. Buď definováno zobrazení p : μ -> R takové, že 1) 2) 3 ) Pro každou posloupnost množin (An) z μ platí disjunktních Andrej Nikolajevč Kolmogorov 1903 -1987 Toto zobrazení nazveme pravděpodobností na μ.

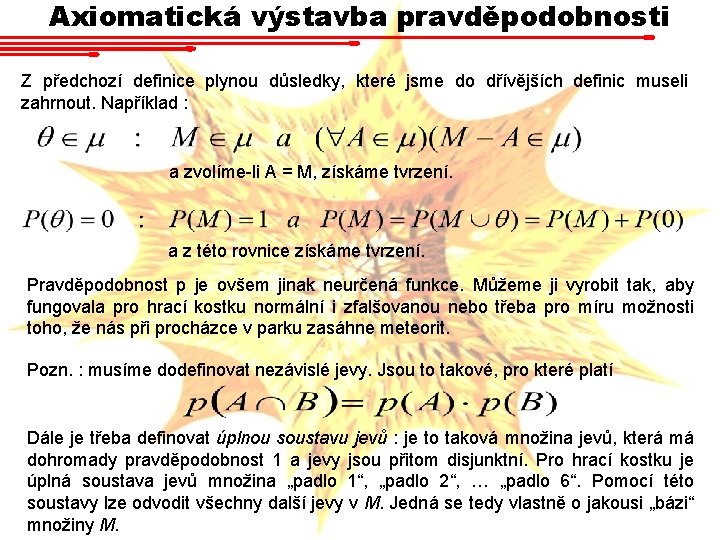

Axiomatická výstavba pravděpodobnosti Z předchozí definice plynou důsledky, které jsme do dřívějších definic museli zahrnout. Například : a zvolíme-li A = M, získáme tvrzení. a z této rovnice získáme tvrzení. Pravděpodobnost p je ovšem jinak neurčená funkce. Můžeme ji vyrobit tak, aby fungovala pro hrací kostku normální i zfalšovanou nebo třeba pro míru možnosti toho, že nás při procházce v parku zasáhne meteorit. Pozn. : musíme dodefinovat nezávislé jevy. Jsou to takové, pro které platí Dále je třeba definovat úplnou soustavu jevů : je to taková množina jevů, která má dohromady pravděpodobnost 1 a jevy jsou přitom disjunktní. Pro hrací kostku je úplná soustava jevů množina „padlo 1“, „padlo 2“, … „padlo 6“. Pomocí této soustavy lze odvodit všechny další jevy v M. Jedná se tedy vlastně o jakousi „bázi“ množiny M.

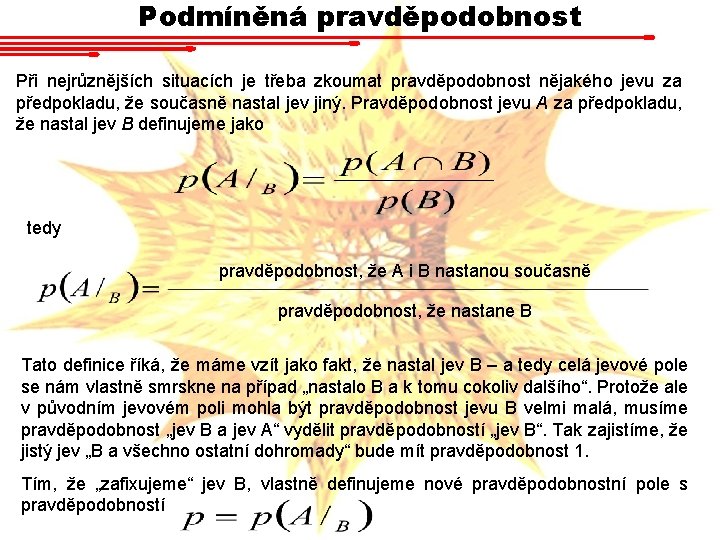

Podmíněná pravděpodobnost Při nejrůznějších situacích je třeba zkoumat pravděpodobnost nějakého jevu za předpokladu, že současně nastal jev jiný. Pravděpodobnost jevu A za předpokladu, že nastal jev B definujeme jako tedy pravděpodobnost, že A i B nastanou současně pravděpodobnost, že nastane B Tato definice říká, že máme vzít jako fakt, že nastal jev B – a tedy celá jevové pole se nám vlastně smrskne na případ „nastalo B a k tomu cokoliv dalšího“. Protože ale v původním jevovém poli mohla být pravděpodobnost jevu B velmi malá, musíme pravděpodobnost „jev B a jev A“ vydělit pravděpodobností „jev B“. Tak zajistíme, že jistý jev „B a všechno ostatní dohromady“ bude mít pravděpodobnost 1. Tím, že „zafixujeme“ jev B, vlastně definujeme nové pravděpodobnostní pole s pravděpodobností

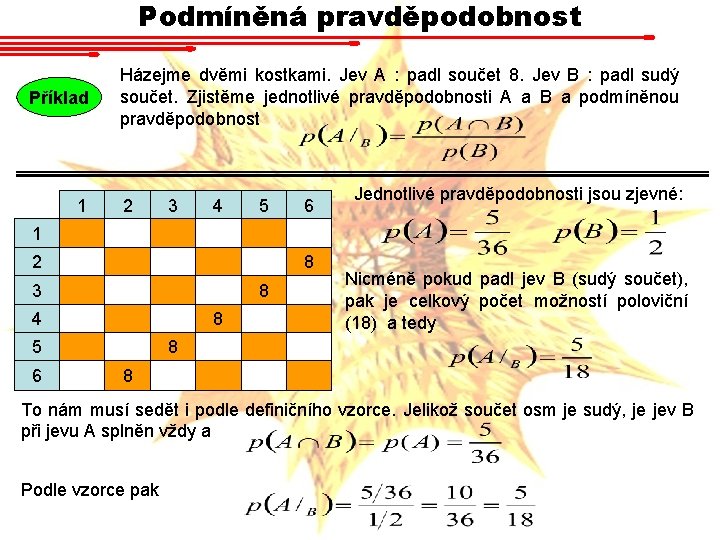

Podmíněná pravděpodobnost Příklad 1 Házejme dvěmi kostkami. Jev A : padl součet 8. Jev B : padl sudý součet. Zjistěme jednotlivé pravděpodobnosti A a B a podmíněnou pravděpodobnost 2 3 4 5 6 Jednotlivé pravděpodobnosti jsou zjevné: 1 2 8 3 8 4 8 5 6 Nicméně pokud padl jev B (sudý součet), pak je celkový počet možností poloviční (18) a tedy 8 8 To nám musí sedět i podle definičního vzorce. Jelikož součet osm je sudý, je jev B při jevu A splněn vždy a Podle vzorce pak

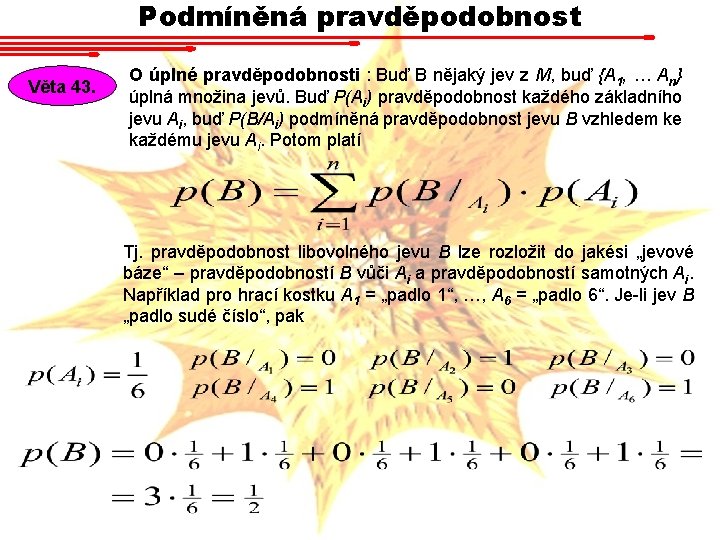

Podmíněná pravděpodobnost Věta 43. O úplné pravděpodobnosti : Buď B nějaký jev z M, buď {A 1, … An} úplná množina jevů. Buď P(Ai) pravděpodobnost každého základního jevu Ai, buď P(B/Ai) podmíněná pravděpodobnost jevu B vzhledem ke každému jevu Ai. Potom platí Tj. pravděpodobnost libovolného jevu B lze rozložit do jakési „jevové báze“ – pravděpodobností B vůči Ai a pravděpodobností samotných Ai. Například pro hrací kostku A 1 = „padlo 1“, …, A 6 = „padlo 6“. Je-li jev B „padlo sudé číslo“, pak

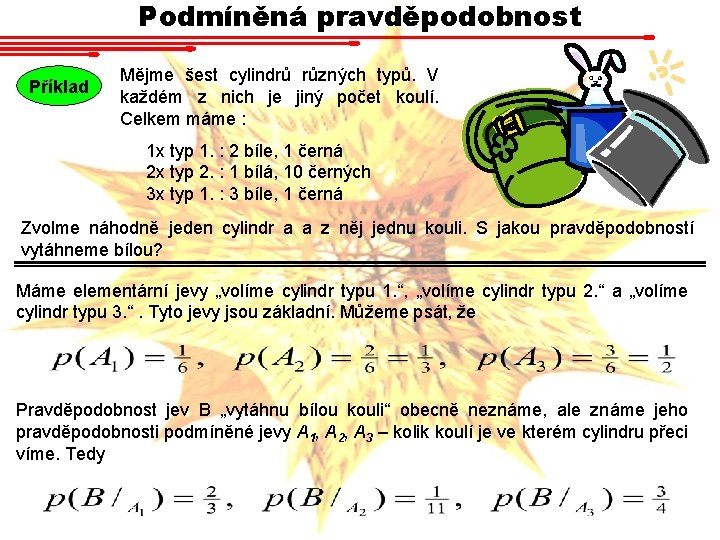

Podmíněná pravděpodobnost Příklad Mějme šest cylindrů různých typů. V každém z nich je jiný počet koulí. Celkem máme : 1 x typ 1. : 2 bíle, 1 černá 2 x typ 2. : 1 bílá, 10 černých 3 x typ 1. : 3 bíle, 1 černá Zvolme náhodně jeden cylindr a a z něj jednu kouli. S jakou pravděpodobností vytáhneme bílou? Máme elementární jevy „volíme cylindr typu 1. “, „volíme cylindr typu 2. “ a „volíme cylindr typu 3. “. Tyto jevy jsou základní. Můžeme psát, že Pravděpodobnost jev B „vytáhnu bílou kouli“ obecně neznáme, ale známe jeho pravděpodobnosti podmíněné jevy A 1, A 2, A 3 – kolik koulí je ve kterém cylindru přeci víme. Tedy

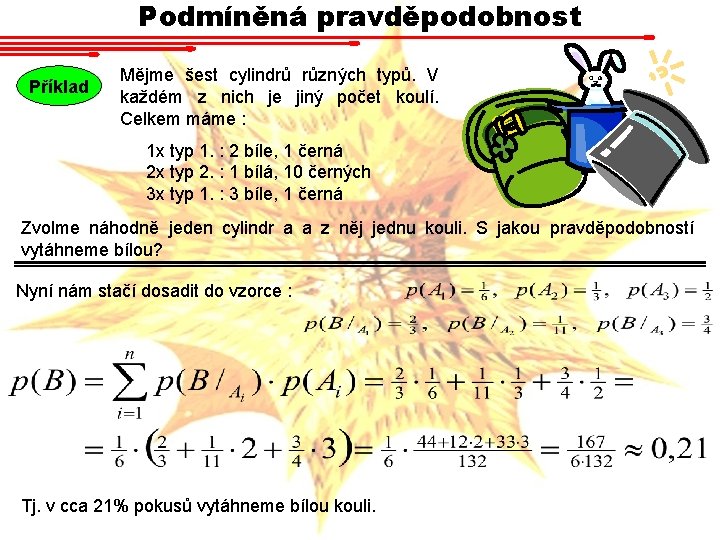

Podmíněná pravděpodobnost Příklad Mějme šest cylindrů různých typů. V každém z nich je jiný počet koulí. Celkem máme : 1 x typ 1. : 2 bíle, 1 černá 2 x typ 2. : 1 bílá, 10 černých 3 x typ 1. : 3 bíle, 1 černá Zvolme náhodně jeden cylindr a a z něj jednu kouli. S jakou pravděpodobností vytáhneme bílou? Nyní nám stačí dosadit do vzorce : Tj. v cca 21% pokusů vytáhneme bílou kouli.

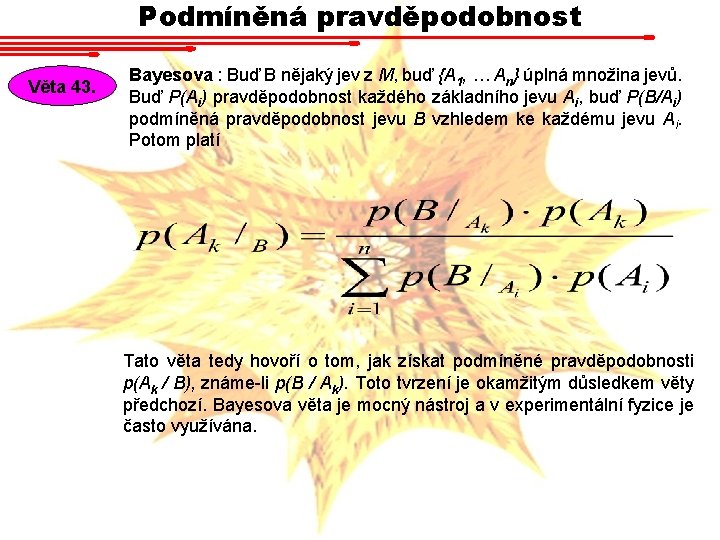

Podmíněná pravděpodobnost Věta 43. Bayesova : Buď B nějaký jev z M, buď {A 1, … An} úplná množina jevů. Buď P(Ai) pravděpodobnost každého základního jevu Ai, buď P(B/Ai) podmíněná pravděpodobnost jevu B vzhledem ke každému jevu Ai. Potom platí Tato věta tedy hovoří o tom, jak získat podmíněné pravděpodobnosti p(Ak / B), známe-li p(B / Ak). Toto tvrzení je okamžitým důsledkem věty předchozí. Bayesova věta je mocný nástroj a v experimentální fyzice je často využívána.

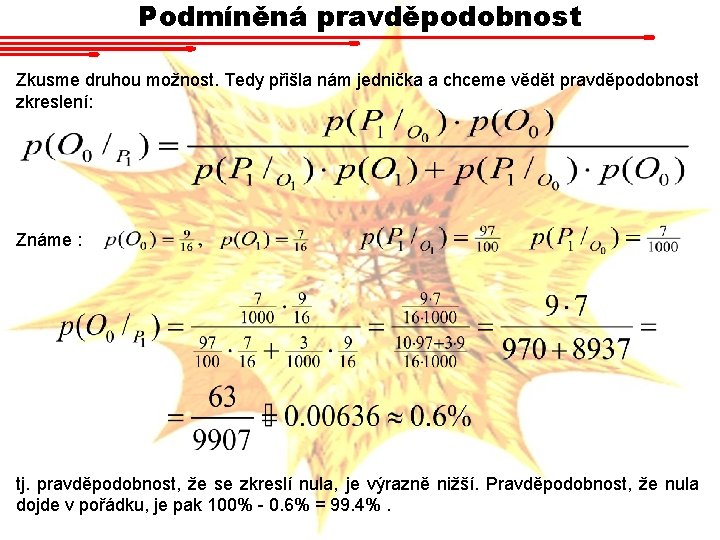

Podmíněná pravděpodobnost Digitální informace se přenáší ve formě signálů Příklad představující nuly a jedničky. Cestou ovšem může docházet ke zkreslení. Předpokládejme, že je naměřeno zkreslení v průměru 3 jedniček ze 100 (přijmou se jako nuly) a 7 nul z 1000 (přijmou se jako jedničky). Dále předpokládejme, že je znám poměr mezi nulami a jedničkami 9: 7. Spočítejte pravděpodobnost, že nedošlo ke zkreslení, pokud byla přijata jednička, respektive pokud byla přijata nula. Shrňme si, co máme naměřeno (pozn. : čísla jsou ve skutečnosti samozřejmě jiná) : Pravděpodobnost zkreslení 1, resp. 0 : Poměr mezi počtem 1 a 0 : Mějme nyní událost „přišla 0“ a otestujme pravděpodobnost jevů „byla odeslána 0“ a „byla odeslána 1“.

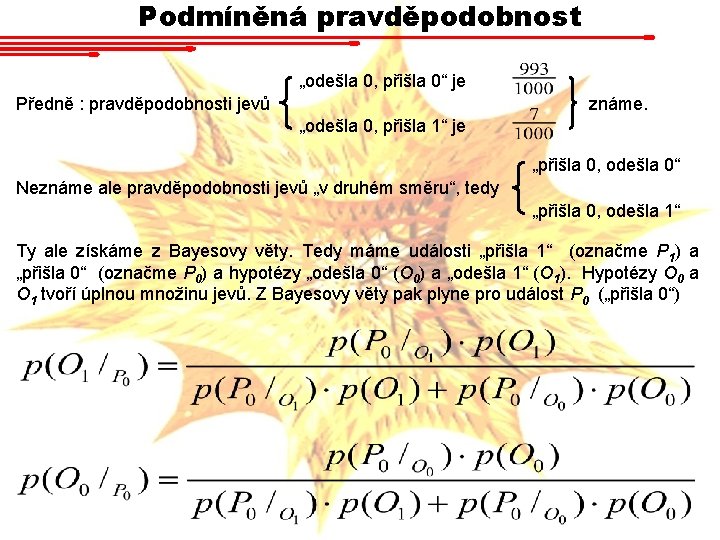

Podmíněná pravděpodobnost „odešla 0, přišla 0“ je Předně : pravděpodobnosti jevů známe. „odešla 0, přišla 1“ je „přišla 0, odešla 0“ Neznáme ale pravděpodobnosti jevů „v druhém směru“, tedy „přišla 0, odešla 1“ Ty ale získáme z Bayesovy věty. Tedy máme události „přišla 1“ (označme P 1) a „přišla 0“ (označme P 0) a hypotézy „odešla 0“ (O 0) a „odešla 1“ (O 1). Hypotézy O 0 a O 1 tvoří úplnou množinu jevů. Z Bayesovy věty pak plyne pro událost P 0 („přišla 0“)

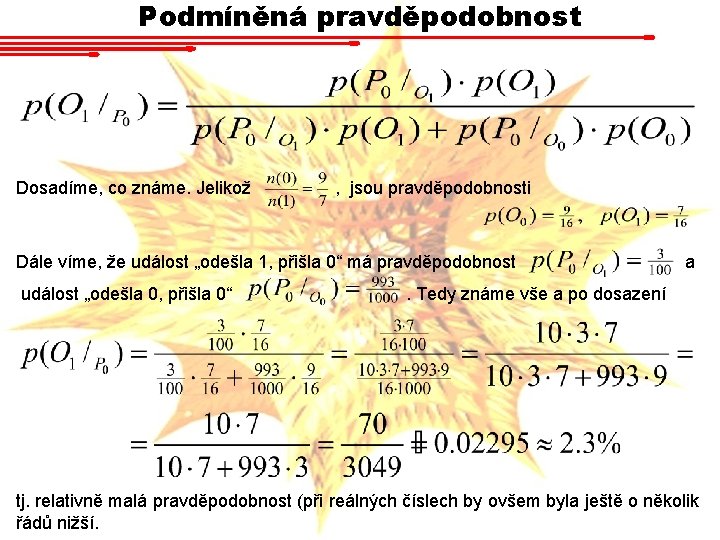

Podmíněná pravděpodobnost Dosadíme, co známe. Jelikož , jsou pravděpodobnosti Dále víme, že událost „odešla 1, přišla 0“ má pravděpodobnost událost „odešla 0, přišla 0“ a . Tedy známe vše a po dosazení tj. relativně malá pravděpodobnost (při reálných číslech by ovšem byla ještě o několik řádů nižší.

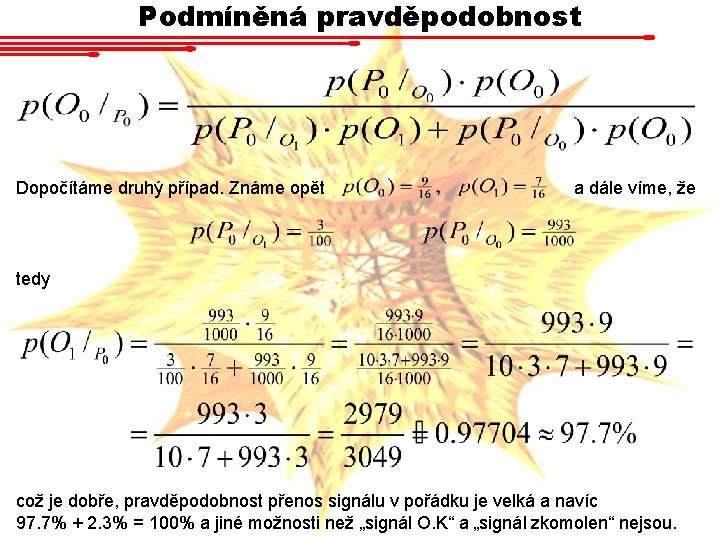

Podmíněná pravděpodobnost Dopočítáme druhý případ. Známe opět a dále víme, že tedy což je dobře, pravděpodobnost přenos signálu v pořádku je velká a navíc 97. 7% + 2. 3% = 100% a jiné možnosti než „signál O. K“ a „signál zkomolen“ nejsou.

Podmíněná pravděpodobnost Zkusme druhou možnost. Tedy přišla nám jednička a chceme vědět pravděpodobnost zkreslení: Známe : tj. pravděpodobnost, že se zkreslí nula, je výrazně nižší. Pravděpodobnost, že nula dojde v pořádku, je pak 100% - 0. 6% = 99. 4%.

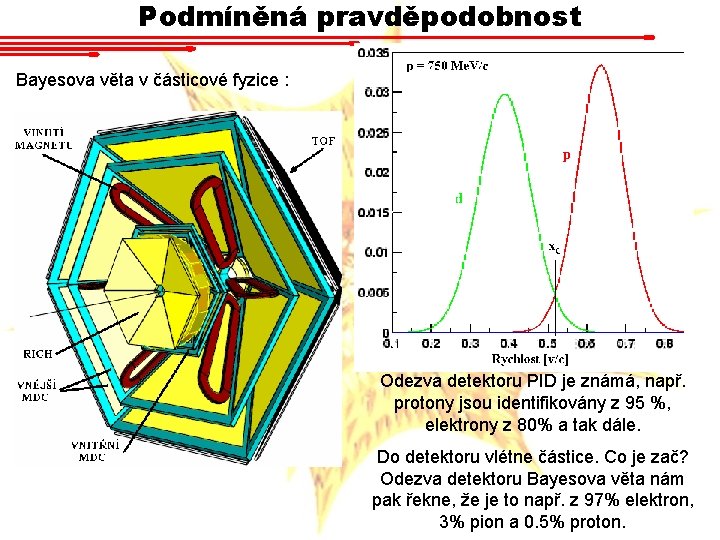

Podmíněná pravděpodobnost Bayesova věta v částicové fyzice : Odezva detektoru PID je známá, např. protony jsou identifikovány z 95 %, elektrony z 80% a tak dále. Do detektoru vlétne částice. Co je zač? Odezva detektoru Bayesova věta nám pak řekne, že je to např. z 97% elektron, 3% pion a 0. 5% proton.

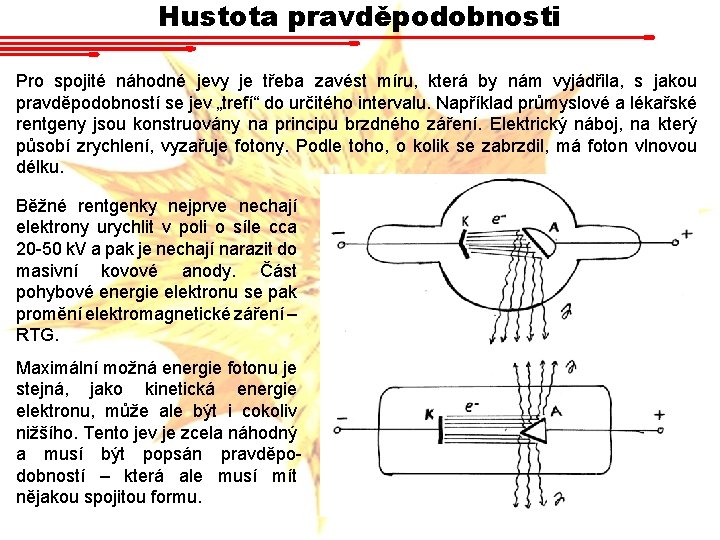

Hustota pravděpodobnosti Pro spojité náhodné jevy je třeba zavést míru, která by nám vyjádřila, s jakou pravděpodobností se jev „trefí“ do určitého intervalu. Například průmyslové a lékařské rentgeny jsou konstruovány na principu brzdného záření. Elektrický náboj, na který působí zrychlení, vyzařuje fotony. Podle toho, o kolik se zabrzdil, má foton vlnovou délku. Běžné rentgenky nejprve nechají elektrony urychlit v poli o síle cca 20 -50 k. V a pak je nechají narazit do masivní kovové anody. Část pohybové energie elektronu se pak promění elektromagnetické záření – RTG. Maximální možná energie fotonu je stejná, jako kinetická energie elektronu, může ale být i cokoliv nižšího. Tento jev je zcela náhodný a musí být popsán pravděpodobností – která ale musí mít nějakou spojitou formu.

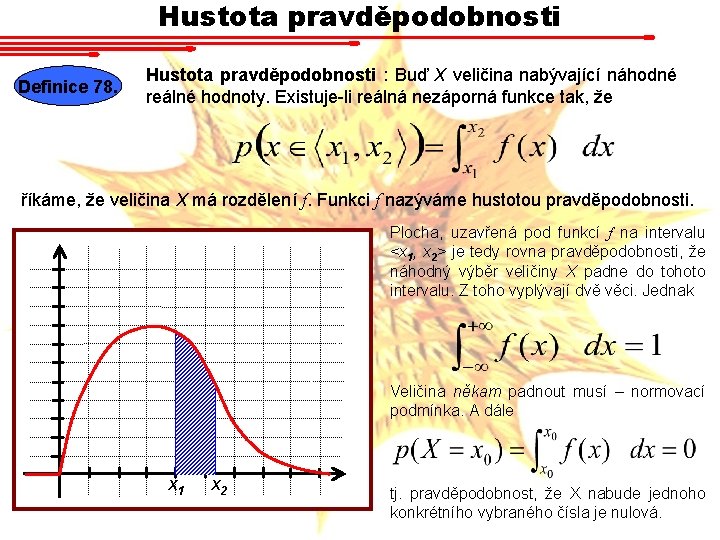

Hustota pravděpodobnosti Definice 78. Hustota pravděpodobnosti : Buď X veličina nabývající náhodné reálné hodnoty. Existuje-li reálná nezáporná funkce tak, že říkáme, že veličina X má rozdělení f. Funkci f nazýváme hustotou pravděpodobnosti. Plocha, uzavřená pod funkcí f na intervalu <x 1, x 2> je tedy rovna pravděpodobnosti, že náhodný výběr veličiny X padne do tohoto intervalu. Z toho vyplývají dvě věci. Jednak Veličina někam padnout musí – normovací podmínka. A dále x 1 x 2 tj. pravděpodobnost, že X nabude jednoho konkrétního vybraného čísla je nulová.

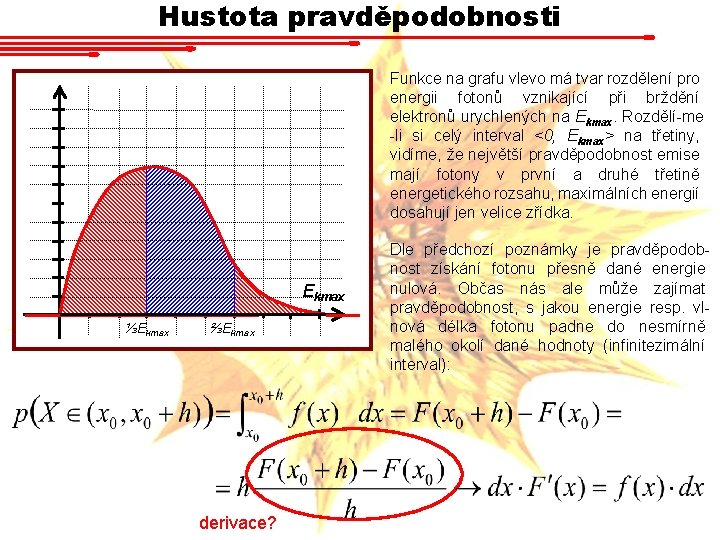

Hustota pravděpodobnosti Funkce na grafu vlevo má tvar rozdělení pro energii fotonů vznikající při brždění elektronů urychlených na Ekmax. Rozdělí-me -li si celý interval <0, Ekmax> na třetiny, vidíme, že největší pravděpodobnost emise mají fotony v první a druhé třetině energetického rozsahu, maximálních energií dosahují jen velice zřídka. Ekmax ⅓Ekmax ⅔Ekmax derivace? Dle předchozí poznámky je pravděpodobnost získání fotonu přesně dané energie nulová. Občas nás ale může zajímat pravděpodobnost, s jakou energie resp. vlnová délka fotonu padne do nesmírně malého okolí dané hodnoty (infinitezimální interval):

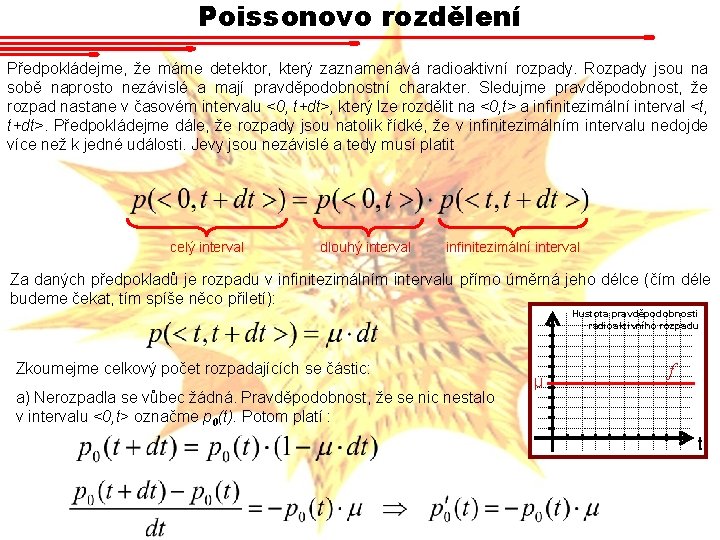

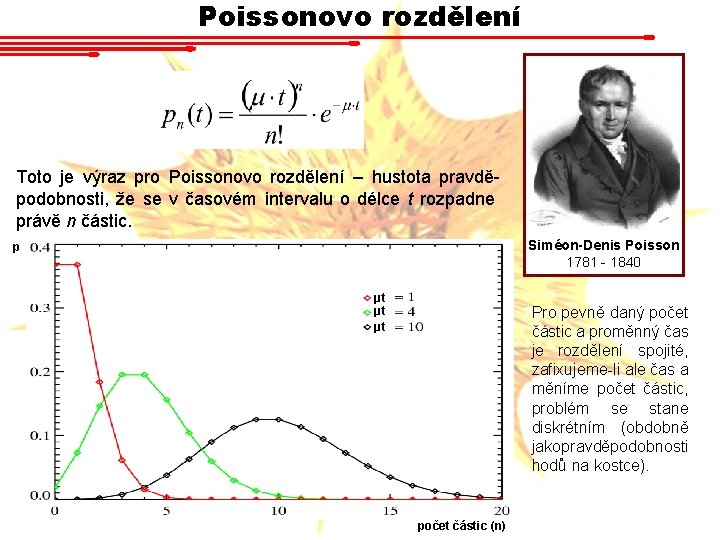

Poissonovo rozdělení Předpokládejme, že máme detektor, který zaznamenává radioaktivní rozpady. Rozpady jsou na sobě naprosto nezávislé a mají pravděpodobnostní charakter. Sledujme pravděpodobnost, že rozpad nastane v časovém intervalu <0, t+dt>, který lze rozdělit na <0, t> a infinitezimální interval <t, t+dt>. Předpokládejme dále, že rozpady jsou natolik řídké, že v infinitezimálním intervalu nedojde více než k jedné události. Jevy jsou nezávislé a tedy musí platit celý interval dlouhý interval infinitezimální interval Za daných předpokladů je rozpadu v infinitezimálním intervalu přímo úměrná jeho délce (čím déle budeme čekat, tím spíše něco přiletí): Hustota pravděpodobnosti radioaktivního rozpadu Zkoumejme celkový počet rozpadajících se částic: a) Nerozpadla se vůbec žádná. Pravděpodobnost, že se nic nestalo v intervalu <0, t> označme p 0(t). Potom platí : μ f t

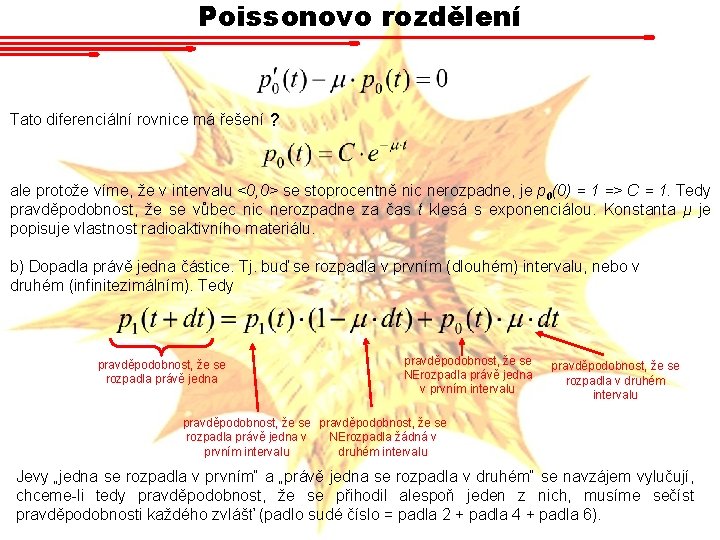

Poissonovo rozdělení Tato diferenciální rovnice má řešení ? ale protože víme, že v intervalu <0, 0> se stoprocentně nic nerozpadne, je p 0(0) = 1 => C = 1. Tedy pravděpodobnost, že se vůbec nic nerozpadne za čas t klesá s exponenciálou. Konstanta μ je popisuje vlastnost radioaktivního materiálu. b) Dopadla právě jedna částice. Tj. buď se rozpadla v prvním (dlouhém) intervalu, nebo v druhém (infinitezimálním). Tedy pravděpodobnost, že se rozpadla právě jedna pravděpodobnost, že se NErozpadla právě jedna v prvním intervalu pravděpodobnost, že se rozpadla v druhém intervalu pravděpodobnost, že se rozpadla právě jedna v NErozpadla žádná v prvním intervalu druhém intervalu Jevy „jedna se rozpadla v prvním“ a „právě jedna se rozpadla v druhém“ se navzájem vylučují, chceme-li tedy pravděpodobnost, že se přihodil alespoň jeden z nich, musíme sečíst pravděpodobnosti každého zvlášť (padlo sudé číslo = padla 2 + padla 4 + padla 6).

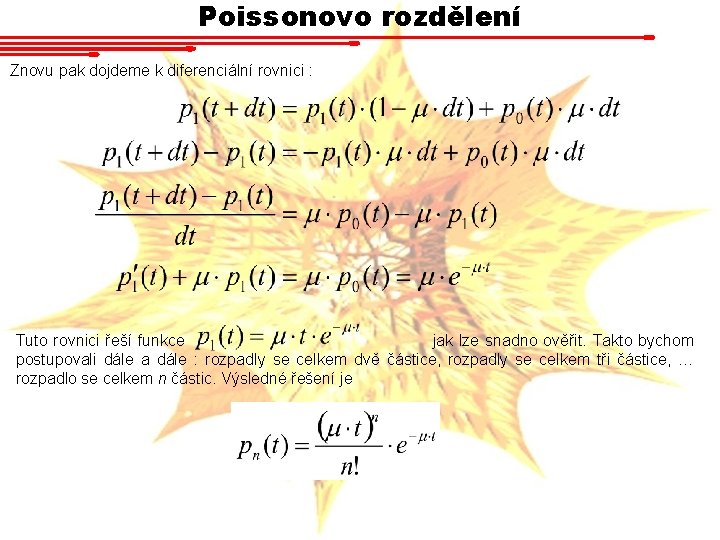

Poissonovo rozdělení Znovu pak dojdeme k diferenciální rovnici : Tuto rovnici řeší funkce jak lze snadno ověřit. Takto bychom postupovali dále a dále : rozpadly se celkem dvě částice, rozpadly se celkem tři částice, … rozpadlo se celkem n částic. Výsledné řešení je

Poissonovo rozdělení Toto je výraz pro Poissonovo rozdělení – hustota pravděpodobnosti, že se v časovém intervalu o délce t rozpadne právě n částic. Siméon-Denis Poisson 1781 - 1840 p μt μt μt Pro pevně daný počet částic a proměnný čas je rozdělení spojité, zafixujeme-li ale čas a měníme počet částic, problém se stane diskrétním (obdobně jakopravděpodobnosti hodů na kostce). počet částic (n)

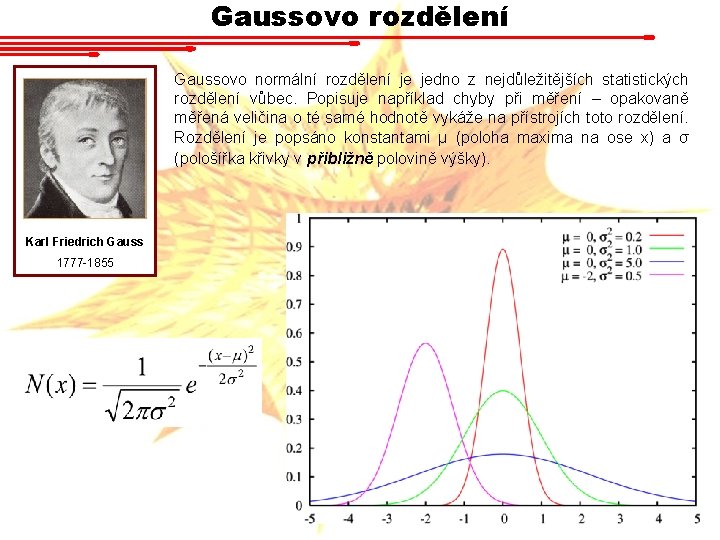

Gaussovo rozdělení Gaussovo normální rozdělení je jedno z nejdůležitějších statistických rozdělení vůbec. Popisuje například chyby při měření – opakovaně měřená veličina o té samé hodnotě vykáže na přístrojích toto rozdělení. Rozdělení je popsáno konstantami μ (poloha maxima na ose x) a σ (pološířka křivky v přibližně polovině výšky). Karl Friedrich Gauss 1777 -1855

Podmíněná pravděpodobnost Příklad Ukažte, že parametr σ má význam vzdálenosti inflexních bodů na křivce od polohy střední hodnoty (μ). Spočítejte, jak vysoko jsou tyto body vůči ose x. Dále ukažte, že integrál gaussova rozdělení přes celý definiční obor je skutečně 1.

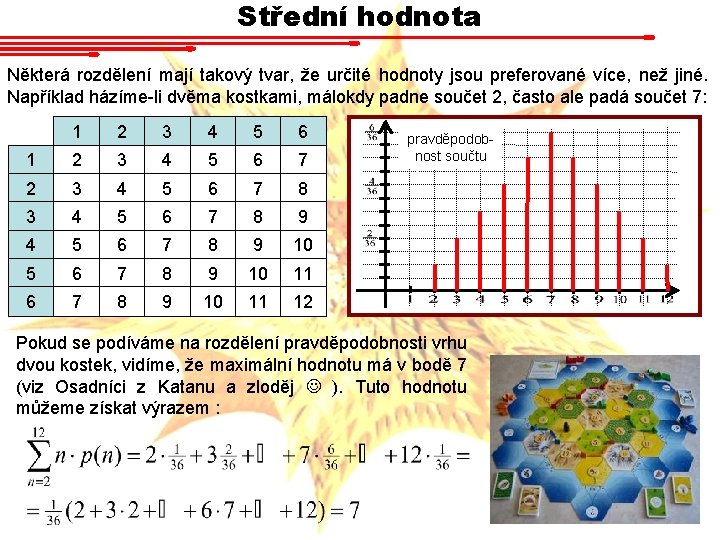

Střední hodnota Některá rozdělení mají takový tvar, že určité hodnoty jsou preferované více, než jiné. Například házíme-li dvěma kostkami, málokdy padne součet 2, často ale padá součet 7: 1 2 3 4 5 6 7 8 9 4 5 6 7 8 9 10 11 12 pravděpodobnost součtu Pokud se podíváme na rozdělení pravděpodobnosti vrhu dvou kostek, vidíme, že maximální hodnotu má v bodě 7 (viz Osadníci z Katanu a zloděj ). Tuto hodnotu můžeme získat výrazem :

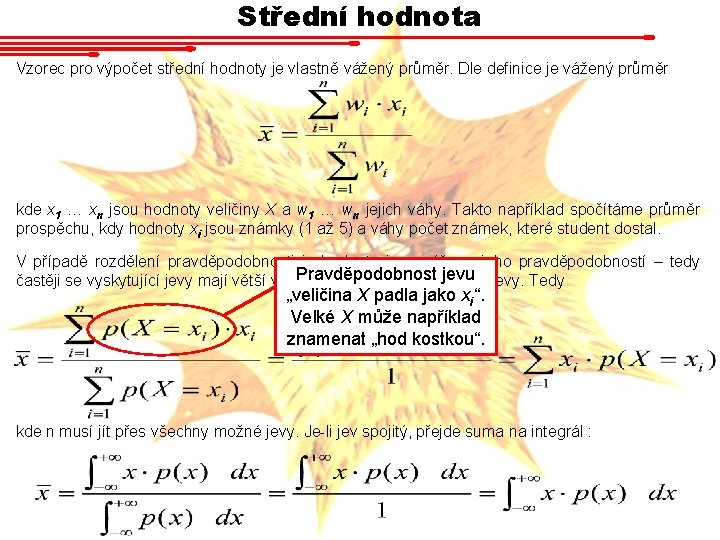

Střední hodnota Vzorec pro výpočet střední hodnoty je vlastně vážený průměr. Dle definice je vážený průměr kde x 1 … xn jsou hodnoty veličiny X a w 1 … wn jejich váhy. Takto například spočítáme průměr prospěchu, kdy hodnoty xi jsou známky (1 až 5) a váhy počet známek, které student dostal. V případě rozdělení pravděpodobnosti je hodnota jevu vážena jeho pravděpodobností – tedy Pravděpodobnost jevu jevy. Tedy častěji se vyskytující jevy mají větší váhu, než zřídka se vyskytující „veličina X padla jako xi“. Velké X může například znamenat „hod kostkou“. kde n musí jít přes všechny možné jevy. Je-li jev spojitý, přejde suma na integrál :

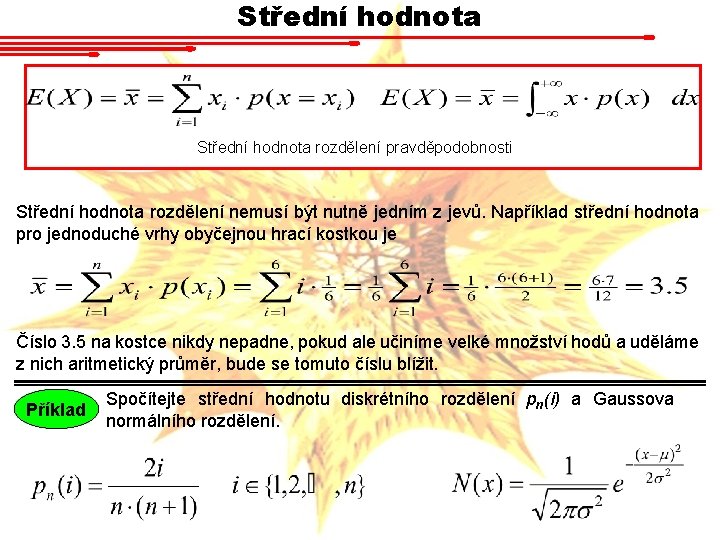

Střední hodnota rozdělení pravděpodobnosti Střední hodnota rozdělení nemusí být nutně jedním z jevů. Například střední hodnota pro jednoduché vrhy obyčejnou hrací kostkou je Číslo 3. 5 na kostce nikdy nepadne, pokud ale učiníme velké množství hodů a uděláme z nich aritmetický průměr, bude se tomuto číslu blížit. Příklad Spočítejte střední hodnotu diskrétního rozdělení pn(i) a Gaussova normálního rozdělení.

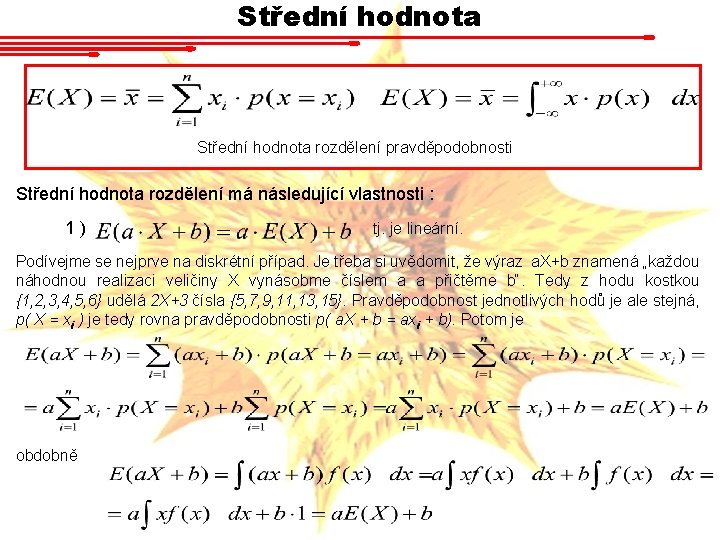

Střední hodnota rozdělení pravděpodobnosti Střední hodnota rozdělení má následující vlastnosti : 1) tj. je lineární. Podívejme se nejprve na diskrétní případ. Je třeba si uvědomit, že výraz a. X+b znamená „každou náhodnou realizaci veličiny X vynásobme číslem a a přičtěme b“. Tedy z hodu kostkou {1, 2, 3, 4, 5, 6} udělá 2 X+3 čísla {5, 7, 9, 11, 13, 15}. Pravděpodobnost jednotlivých hodů je ale stejná, p( X = xi ) je tedy rovna pravděpodobnosti p( a. X + b = axi + b). Potom je obdobně

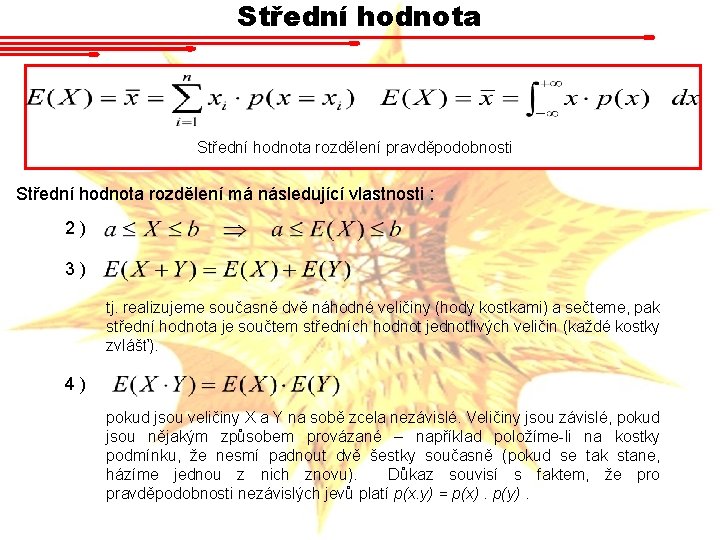

Střední hodnota rozdělení pravděpodobnosti Střední hodnota rozdělení má následující vlastnosti : 2) 3) tj. realizujeme současně dvě náhodné veličiny (hody kostkami) a sečteme, pak střední hodnota je součtem středních hodnot jednotlivých veličin (každé kostky zvlášť). 4) pokud jsou veličiny X a Y na sobě zcela nezávislé. Veličiny jsou závislé, pokud jsou nějakým způsobem provázané – například položíme-li na kostky podmínku, že nesmí padnout dvě šestky současně (pokud se tak stane, házíme jednou z nich znovu). Důkaz souvisí s faktem, že pro pravděpodobnosti nezávislých jevů platí p(x. y) = p(x). p(y).

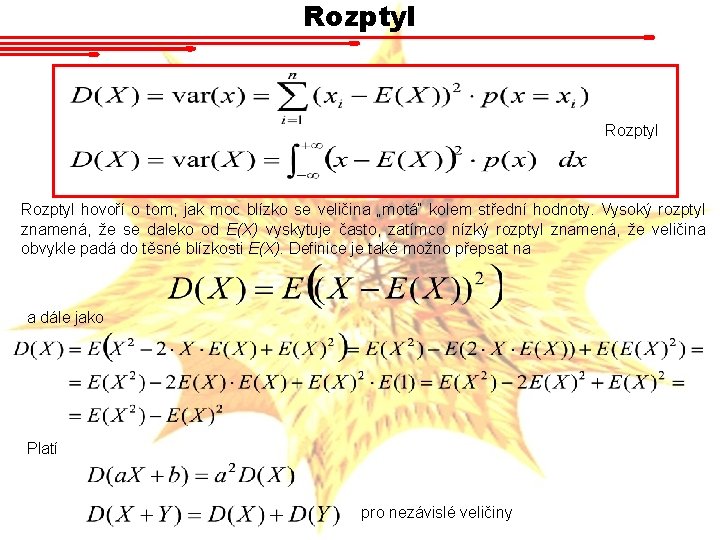

Rozptyl hovoří o tom, jak moc blízko se veličina „motá“ kolem střední hodnoty. Vysoký rozptyl znamená, že se daleko od E(X) vyskytuje často, zatímco nízký rozptyl znamená, že veličina obvykle padá do těsné blízkosti E(X). Definice je také možno přepsat na a dále jako Platí pro nezávislé veličiny

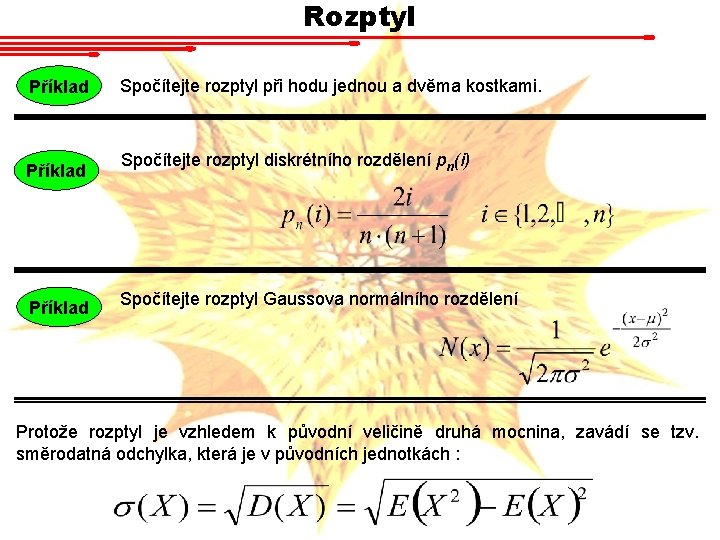

Rozptyl Příklad Spočítejte rozptyl při hodu jednou a dvěma kostkami. Příklad Spočítejte rozptyl diskrétního rozdělení pn(i) Příklad Spočítejte rozptyl Gaussova normálního rozdělení Protože rozptyl je vzhledem k původní veličině druhá mocnina, zavádí se tzv. směrodatná odchylka, která je v původních jednotkách :

Shrnutí • Klasická definice pravděpodobnosti • Základní vzorce kombinatoriky • Geometrická představa pravděpodobnosti • Kolmogorovova definice pravděpodobnosti • Podmíněná pravděpodobnost • Bayesova věta • Hustota pravděpodobnosti • Poissonovo rozdělení • Gaussovo normální rozdělení • Střední hodnota, rozptyl

- Slides: 52