Pertemuan 4 Analisis Regresi Berganda Pengertian Regresi Linier

Pertemuan 4 Analisis Regresi Berganda

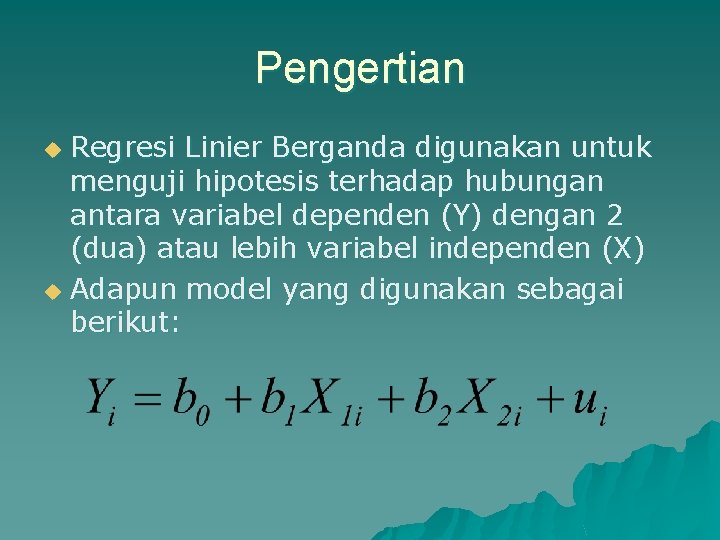

Pengertian Regresi Linier Berganda digunakan untuk menguji hipotesis terhadap hubungan antara variabel dependen (Y) dengan 2 (dua) atau lebih variabel independen (X) u Adapun model yang digunakan sebagai berikut: u

Proses Pendugaan (Estimasi) u Proses Estimasi dapat dipecah menjadi 2 Kelas Utama 1. Least Square – Cara ini mencari jumlah kuadrat error yang terkecil, dengan kata lain, Proses optimalisasi dilakukan dalam bentuk meminimalkan error 2. Maximum Likelihood – Cara ini memaksimalkan coverage fungsi densitas F(. ) dan mencari bentuk fungsi densitas yang optimal dalam pengertian mampu melingkupi sebanyak mungkin observasi

Proses Pendugaan (Estimasi) u Least square – Rumpun ini terbagi menjadi beberapa pendekatan: u u u Pendekatan yang paling dasar adalah OLS ( Ordinary Least Square) GLS (Generalized Least Square) ILS (Indirect Least Square) 2 -SLS (Two Stage Least Square) 3 -SLS (Three Stage Least Square)

Proses Pendugaan (Estimasi) u Maximum Likelihood – Metode ini berupaya memaksimumkan peluang munculnya observasi. – Secara teknis prosesi ini melibatkan fungsi densitas (fungsi kepadatan) f (ε 1)

Asumsi Penting dari model Regresi Linier Berganda: 1. 2. 3. Modelnya adalah peubah terikat y yang merupakan fungsi linier sejumlah peubah bebas X 1, X 2, … , Xn. E (u) = 0, asumsi ini menginginkan model yang dipakai dapat secara tepat menggambarkan rata-rata variabel endogen dalam tiap observasi Cov (ui , uj ) = 0, i ≠ j tidak ada masalah dengan autokorelasi, artinya error atau gangguan disatu observasi tidak berkorelasi dengan error atau gangguan di observasi lainnya

Asumsi Penting dari model Regresi Linier Berganda: 4. 5. 6. Var (Ui|Xi) = ơ 2 sama untuk setiap I (homokedastisitas), Varians error tidak berbeda dari satu observasi ke observasi lainnya. Jadi setiap observasi memiliki reliabilitas yang sama Cov (ui, Xi) = 0, artinya nilai variabel bebas (independen) tidak berkorelasi dengan error atau gangguan Tidak ada kesalahan spesifikasi model pada Model Regresi

Asumsi Penting dari model Regresi Linier Berganda: Asumsi ini pada dasarnya akan menjamin hasil estimasi parameter menjadi: 1. 2. 3. u Efisien Tidak bias Konsisten Dengan terpenuhinya asumsi-asumsi diatas maka model regresi dapat diselesaikan dengan menggunakan metode pendugaan parameter regresi yaitu ordinary least square (OLS)

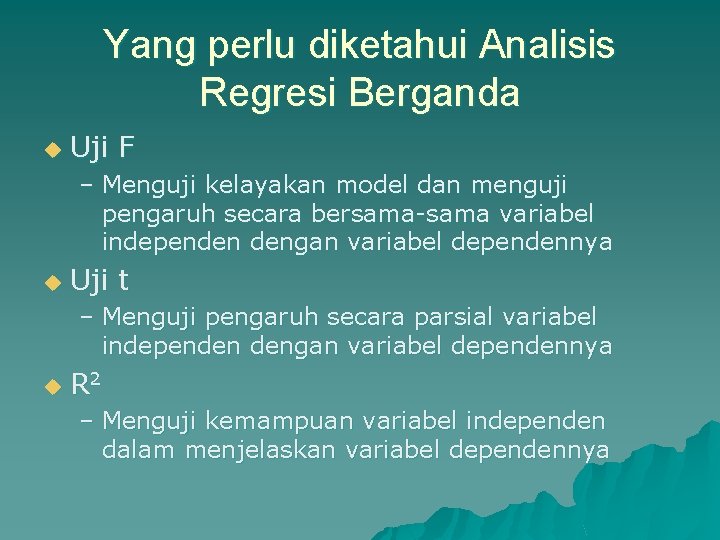

Yang perlu diketahui Analisis Regresi Berganda u Uji F – Menguji kelayakan model dan menguji pengaruh secara bersama-sama variabel independen dengan variabel dependennya u Uji t – Menguji pengaruh secara parsial variabel independen dengan variabel dependennya u R 2 – Menguji kemampuan variabel independen dalam menjelaskan variabel dependennya

Asumsi Klasik Adapun Asumsi Klasik terbagi menjadi: 1. Multikolinearitas 2. Autokorelasi 3. Heterokedastisitas

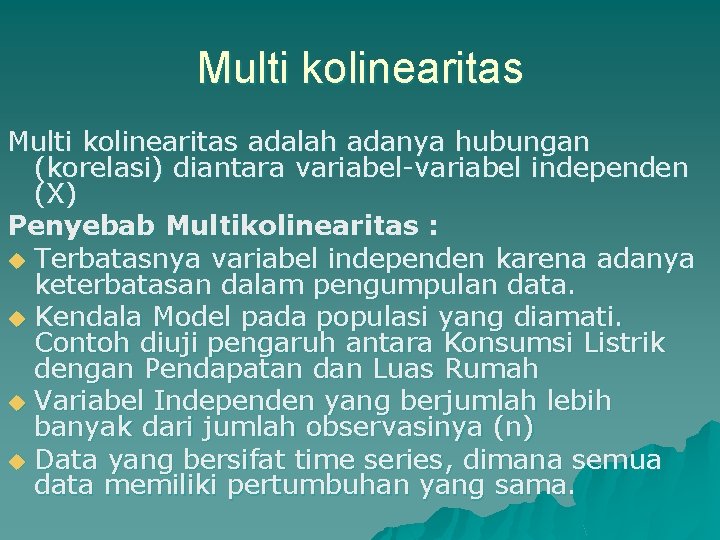

Multi kolinearitas adalah adanya hubungan (korelasi) diantara variabel-variabel independen (X) Penyebab Multikolinearitas : u Terbatasnya variabel independen karena adanya keterbatasan dalam pengumpulan data. u Kendala Model pada populasi yang diamati. Contoh diuji pengaruh antara Konsumsi Listrik dengan Pendapatan dan Luas Rumah u Variabel Independen yang berjumlah lebih banyak dari jumlah observasinya (n) u Data yang bersifat time series, dimana semua data memiliki pertumbuhan yang sama.

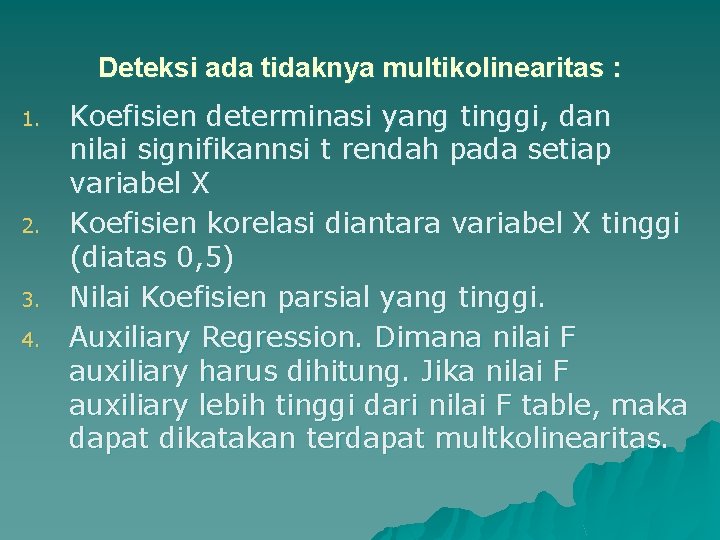

Deteksi ada tidaknya multikolinearitas : 1. 2. 3. 4. Koefisien determinasi yang tinggi, dan nilai signifikannsi t rendah pada setiap variabel X Koefisien korelasi diantara variabel X tinggi (diatas 0, 5) Nilai Koefisien parsial yang tinggi. Auxiliary Regression. Dimana nilai F auxiliary harus dihitung. Jika nilai F auxiliary lebih tinggi dari nilai F table, maka dapat dikatakan terdapat multkolinearitas.

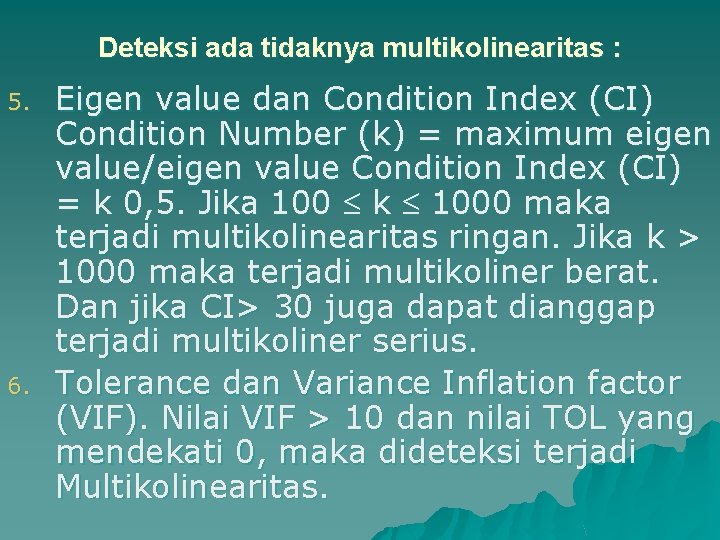

Deteksi ada tidaknya multikolinearitas : 5. 6. Eigen value dan Condition Index (CI) Condition Number (k) = maximum eigen value/eigen value Condition Index (CI) = k 0, 5. Jika 100 k 1000 maka terjadi multikolinearitas ringan. Jika k > 1000 maka terjadi multikoliner berat. Dan jika CI> 30 juga dapat dianggap terjadi multikoliner serius. Tolerance dan Variance Inflation factor (VIF). Nilai VIF > 10 dan nilai TOL yang mendekati 0, maka dideteksi terjadi Multikolinearitas.

Mengatasi Masalah Multikolinearitas : u membuang salah satu variabel yang berkolinearitas. Untuk menentukan variabel mana yang dibuang, dilakukan coba-coba. Dan dipilih persamaan yang memiliki nilai adjusted R 2 yang lebih tinggi. u Menambah jumlah sample, karena mungkin saja multikolinearitas terjadi hanya untuk sample yang saat ini saja.

Autokorelasi Otokorelasi adalah korelasi atau hubungan yang terjadi diantara anggota-anggota dari serangkaian data atau pengamatan yang tersusun dalam rangkaian waktu. Penyebab terjadinya auto korelasi : u Kelembaman data. u Mengeluarkan variabel yang relevan dalam model u Tengang waktu atau lags u Manipulasi data u Non stasioner

Hal yang terjadi akibat dari otokorelasi adalah : u Varians sample tidak dapat menggambarkan varians populasi u Uji t tidak berlaku lagi, apabila uji t tetap diberlakukan maka uji t tersebut tidak berlaku lagi u Model regresi yang digunakan tidak dapat digunakan untuk menduga variabel terikat ataupun variabel terikat tertentu

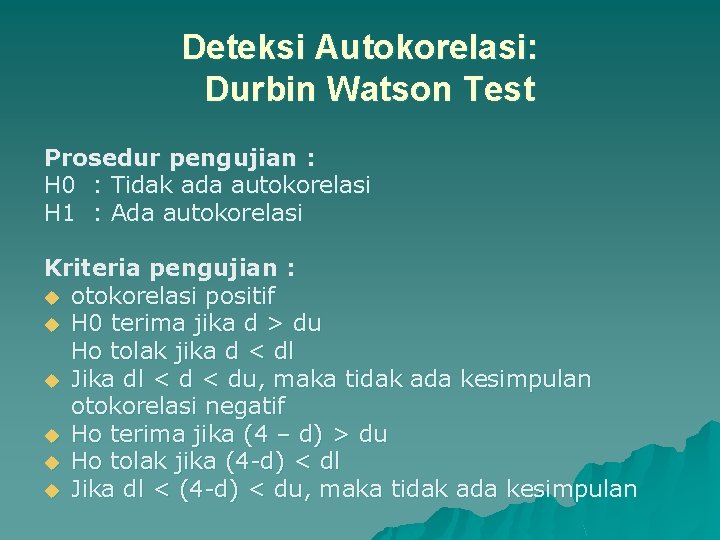

Deteksi Autokorelasi: Durbin Watson Test Prosedur pengujian : H 0 : Tidak ada autokorelasi H 1 : Ada autokorelasi Kriteria pengujian : u otokorelasi positif u H 0 terima jika d > du Ho tolak jika d < dl u Jika dl < du, maka tidak ada kesimpulan otokorelasi negatif u Ho terima jika (4 – d) > du u Ho tolak jika (4 -d) < dl u Jika dl < (4 -d) < du, maka tidak ada kesimpulan

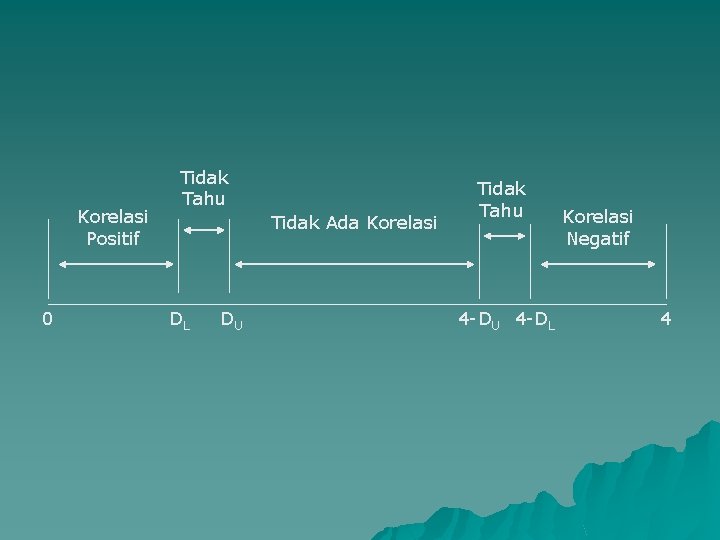

Korelasi Positif 0 Tidak Tahu Tidak Ada Korelasi DL DU Tidak Tahu 4 -DU 4 -DL Korelasi Negatif 4

Menghilangkan masalah autokorelasi : Memilih variabel independen yang relevan ke dalam model. Indikator yang dipakai untuk mengukur variabel yang relevan ke dalam model : u Signifikansi statistik u Koefisien determinasi u Standardized koefisien absolut u Stepwise Regression

Heterosekedastisitas Penyebab : u Data yang mengikuti learning model u Adanya outlier dalam sekelompok data u Kesalahan dalam memilih variabel u Skewness atau kemencengan dalam variabel tertentu

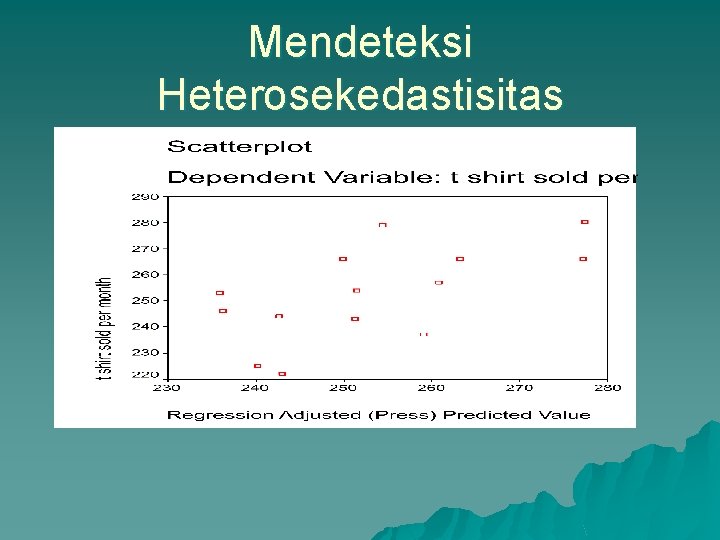

Mendeteksi Heterosekedastisitas

- Slides: 21