PERCEPTRON Perceptron merupakan cikal bakal jaringan saraf tiruan

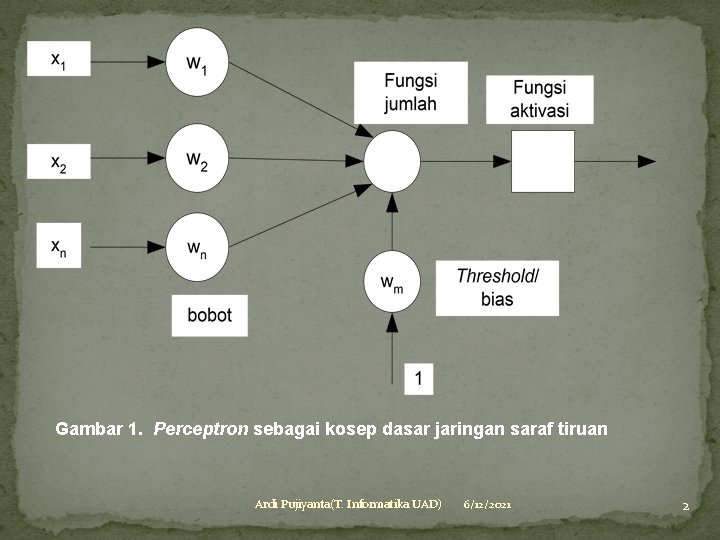

PERCEPTRON Perceptron merupakan cikal bakal jaringan saraf tiruan (F. Rosenblatt 1958) bekerja dengan cara menerima sejumlah (n) masukan berupa vektor( ) dan menghasilkan sebuah keluaran dengan nilai 1 atau 0. contoh arsitektur jaringan perceptron : gambar 1 Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 1

Gambar 1. Perceptron sebagai kosep dasar jaringan saraf tiruan Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 2

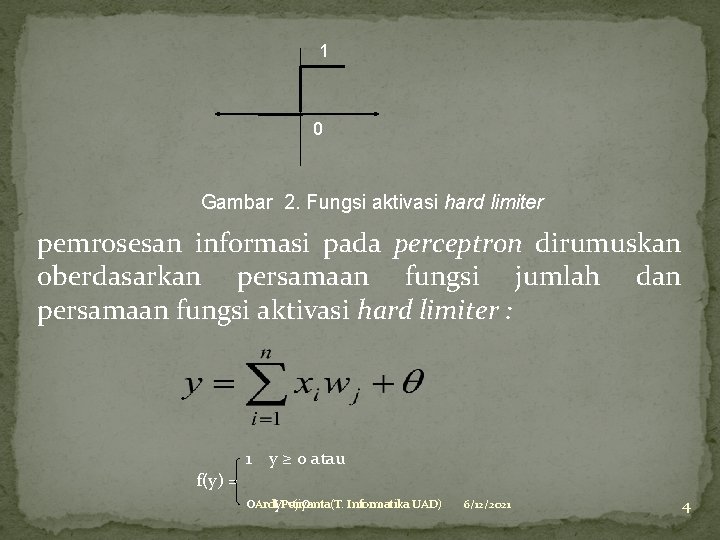

perceptron bekerja dengan menjumlahkan hasil kali masukan dan bobot (w , w , …. . w ). Hasil penjumlahan dimasukkan pada suatu fungsi aktivasi untuk menghasilkan keluaran. Fungsi aktivasi model Rosenblatt menggunakan fungsi aktivasi hard limiter yang berfungsi untuk membatasi keluaran pada nilai 1 atau 0, sesuai dengan gambar 2 : Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 3

1 0 Gambar 2. Fungsi aktivasi hard limiter pemrosesan informasi pada perceptron dirumuskan oberdasarkan persamaan fungsi jumlah dan persamaan fungsi aktivasi hard limiter : f(y) = 1 y ≥ 0 atau Informatika UAD) 0 Ardiy. Pujiyanta(T. <0 6/12/2021 4

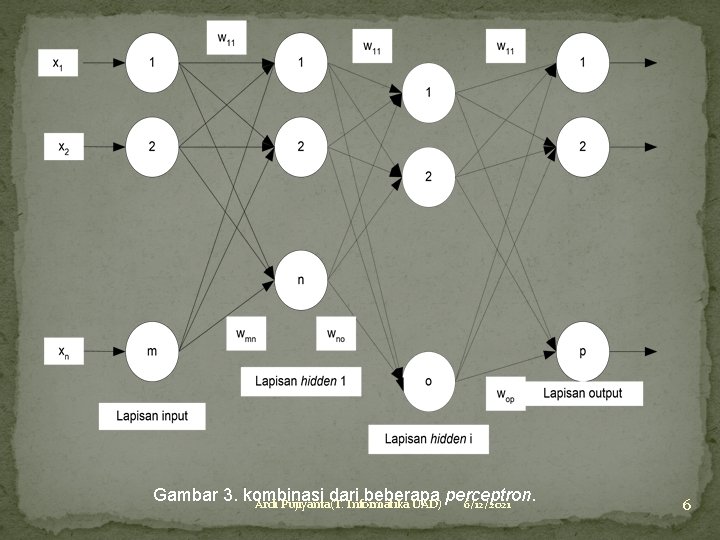

�Multilayer Perceptron : Kombinasi beberapa layer perceptron. Gambar 3 di bawah ini adalah jaringan saraf tiruan yang merupakan kombinasi dari beberapa perceptron : Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 5

Gambar 3. kombinasi dari beberapa perceptron. Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 6

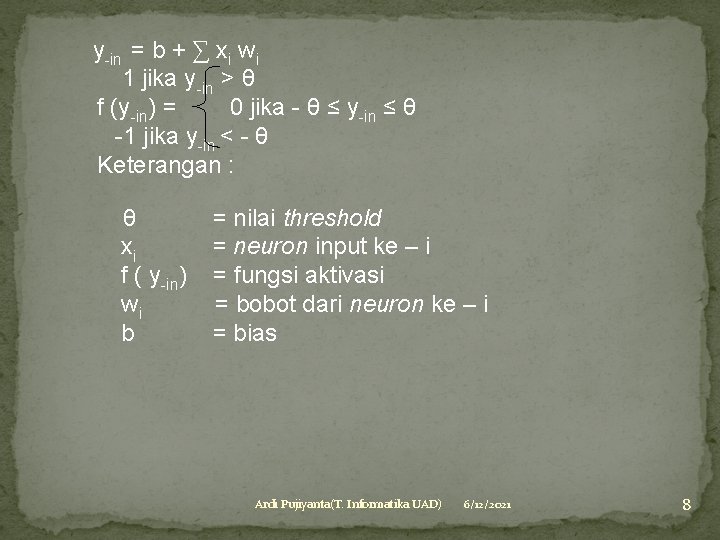

� Awalnya perceptron memiliki tiga lapisan neuron : sensor unit 2. associator unit 3. response unit. Jaringan semacam ini mendekati model suatu retina (bagian mata). Perceptron yang paling sederhana diusulkan oleh “Block” dan menggunakan aktivasi biner untuk input sensory dan assosiator, sedang untuk unit response menggunakan aktivasi biner atau bipolar. Bagian unit sensori atau assosiator dihubungkan dengan sambungan yang bobotnya tetap dengan nilai -1, 0, atau 1 yang nilainya acak. � Fungsi aktivasi untuk setiap unit assosiator adalah binary step function, yang ditentukan secara random/acak tetapi nilainya tetap. Nilai ini disebut threshold. Sinyal yang dikirim oleh unit assosiator ke unit output berupa sinyal biner yaitu 0 atau 1. Output perceptron adalah y = f (y-in) dengan fungsi aktivasi sebagai berikut : 1. Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 7

y-in = b + ∑ xi wi 1 jika y-in > θ f (y-in) = 0 jika - θ ≤ y-in ≤ θ -1 jika y-in < - θ Keterangan : θ xi f ( y-in) wi b = nilai threshold = neuron input ke – i = fungsi aktivasi = bobot dari neuron ke – i = bias Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 8

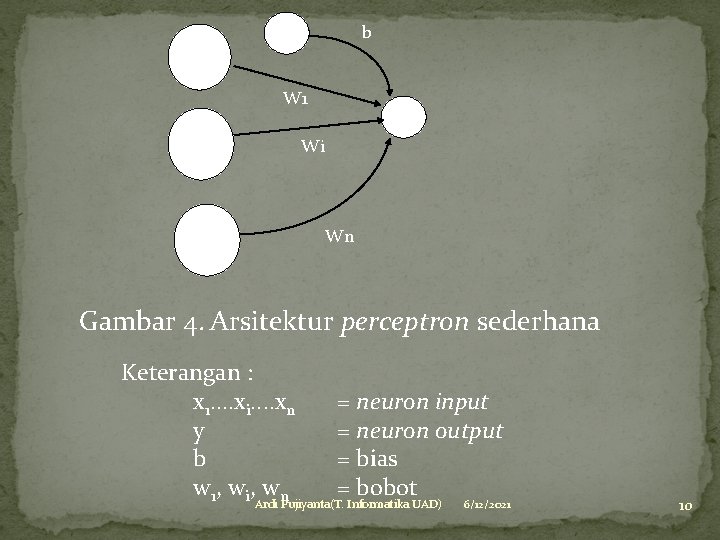

. Arsitektur perceptron �Output unit assosiator adalah biner vektor. Vektor tersebut dikatakan sebagai sinyal input terhadap sinyal output atau unit response. bobot dari assosiator ke unit output dapat diubah-ubah. �Jaringan ini mengklasifikasikan setiap pola input ke dalam kelas tertentu. Apabila outputnya +1, maka input yang diberikan termasuk kelas tertentu, sebaliknya jika outputnya -1, maka input yang diberikan tidak masuk dalam kelas tertentu. Arsitektur perceptron tampak pada gambar 4 : Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 9

x 1 b 1 W 1 xi y Wi xn Wn Gambar 4. Arsitektur perceptron sederhana Keterangan : x 1. . xi. . xn y b w 1 , w i, w n = neuron input = neuron output = bias = bobot Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 10

Pelatihan perceptron �Bobot koneksi dari unit assosiator ke unit response (atau output) ditentukan melalui pelatihan (learning rate) perceptron. Untuk setiap input training jaringan akan menghitung response dari unit output, kemudian jaringan akan menentukan apakah suatu error terjadi pada pola tersebut dengan cara membandingkan output hasil perhitungan dengan nilai targetnya. Jika error tidak terjadi maka bobot-bobot tersebut tidak akan diubah tetapi sebaliknya jika suatu error terjadi untuk pola input pelatihan tertentu, bobot-bobot akan diubah : Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 11

wi (new) = wi (old) + �t xi keterangan : xi = input ke – i t = target yang nilainya +1 atau -1 α = kecepatan belajar (learning rate) yaitu 0 < ≤ 1 w = bobot jika error tidak terjadi, maka bobot-bobot tidak akan berubah. Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 12

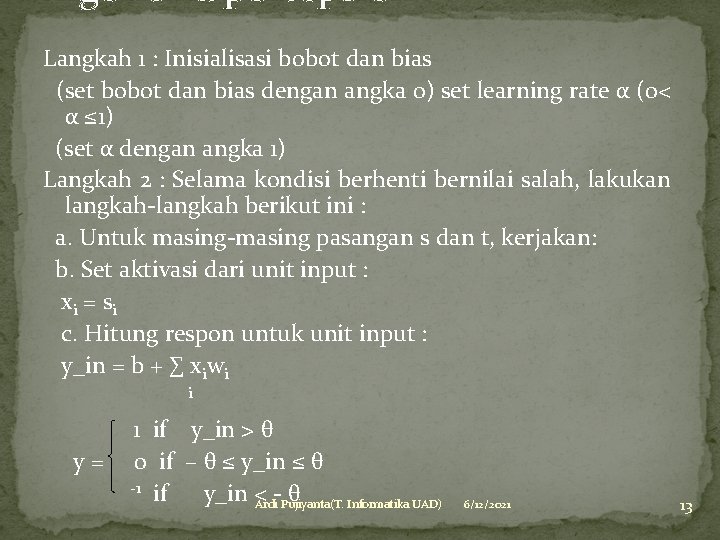

Algoritma perceptron Langkah 1 : Inisialisasi bobot dan bias (set bobot dan bias dengan angka 0) set learning rate α (0< α ≤ 1) (set α dengan angka 1) Langkah 2 : Selama kondisi berhenti bernilai salah, lakukan langkah-langkah berikut ini : a. Untuk masing-masing pasangan s dan t, kerjakan: b. Set aktivasi dari unit input : x i = si c. Hitung respon untuk unit input : y_in = b + ∑ xiwi i y= 1 if y_in > θ 0 if – θ ≤ y_in ≤ θ -1 if y_in < -θ Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 13

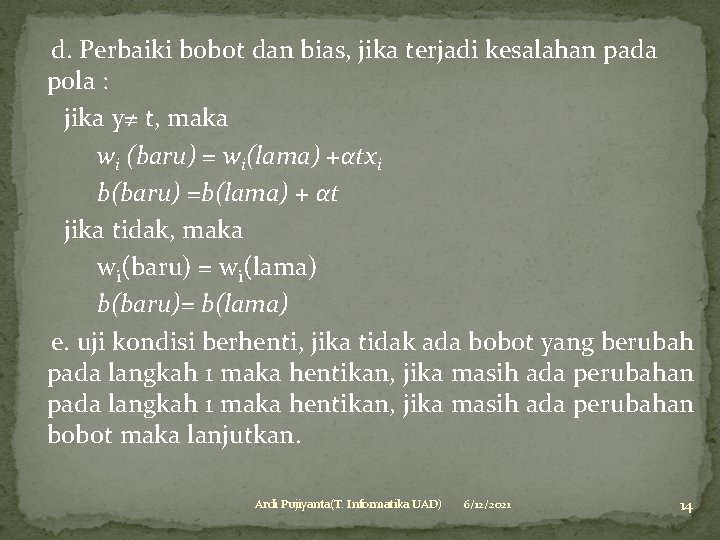

d. Perbaiki bobot dan bias, jika terjadi kesalahan pada pola : jika y≠ t, maka wi (baru) = wi(lama) +αtxi b(baru) =b(lama) + αt jika tidak, maka wi(baru) = wi(lama) b(baru)= b(lama) e. uji kondisi berhenti, jika tidak ada bobot yang berubah pada langkah 1 maka hentikan, jika masih ada perubahan bobot maka lanjutkan. Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 14

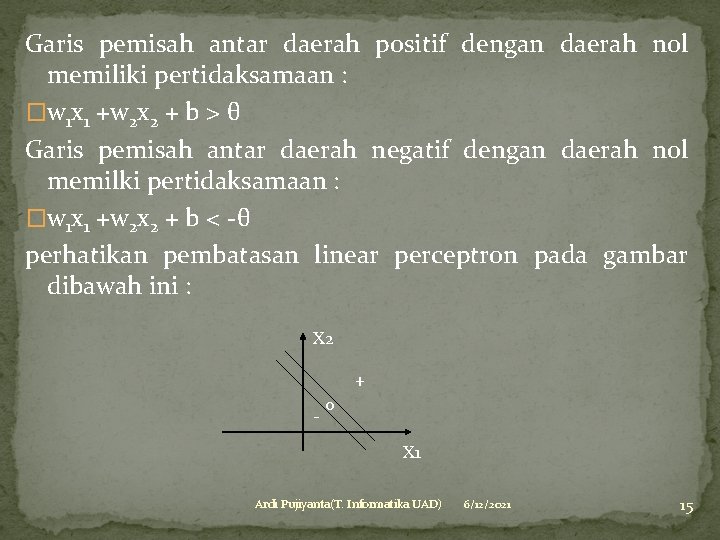

Garis pemisah antar daerah positif dengan daerah nol memiliki pertidaksamaan : �w 1 x 1 +w 2 x 2 + b > θ Garis pemisah antar daerah negatif dengan daerah nol memilki pertidaksamaan : �w 1 x 1 +w 2 x 2 + b < -θ perhatikan pembatasan linear perceptron pada gambar dibawah ini : X 2 + - 0 X 1 Ardi Pujiyanta(T. Informatika UAD) 6/12/2021 15

- Slides: 15