Pekitirmeli renme Hatrlatma Ortamdaki belirsizlie ramen bir amaca

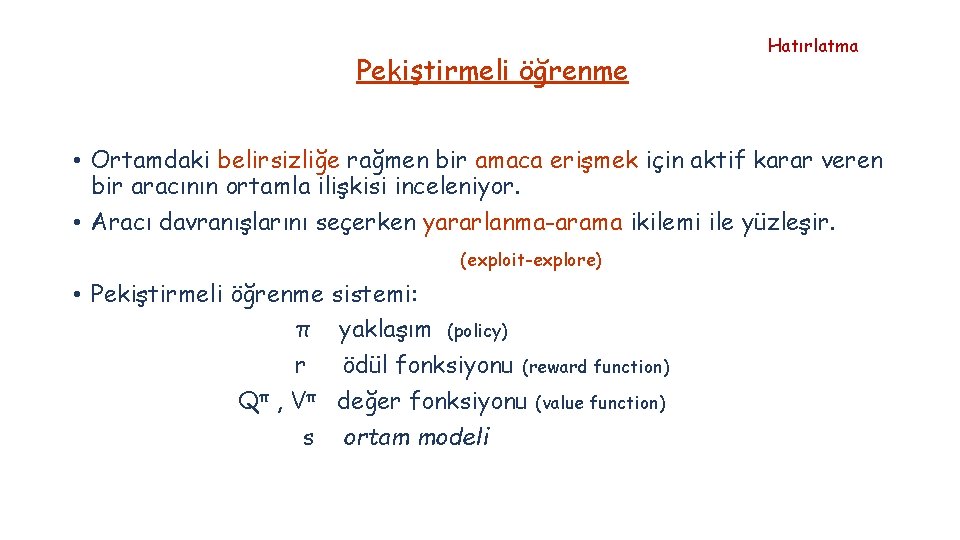

Pekiştirmeli öğrenme Hatırlatma • Ortamdaki belirsizliğe rağmen bir amaca erişmek için aktif karar veren bir aracının ortamla ilişkisi inceleniyor. • Aracı davranışlarını seçerken yararlanma-arama ikilemi ile yüzleşir. (exploit-explore) • Pekiştirmeli öğrenme sistemi: π yaklaşım (policy) r ödül fonksiyonu (reward function) Qπ , Vπ değer fonksiyonu (value function) s ortam modeli

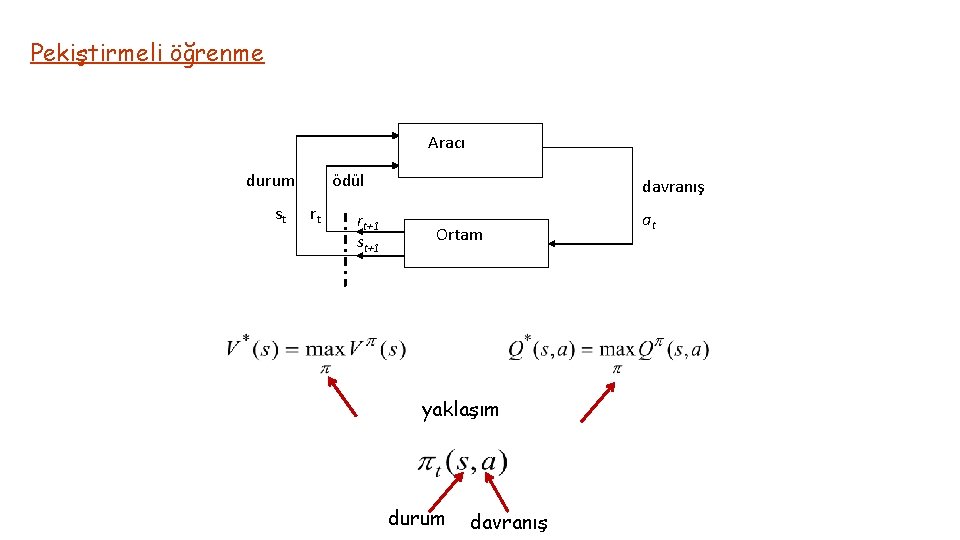

Pekiştirmeli öğrenme Aracı durum st ödül rt rt+1 st+1 davranış Ortam yaklaşım durum davranış at

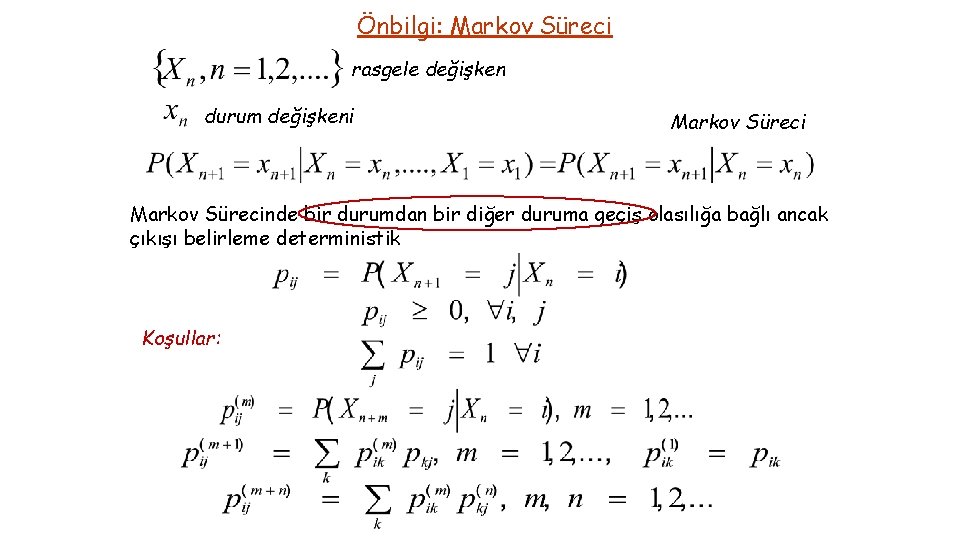

Önbilgi: Markov Süreci rasgele değişken durum değişkeni Markov Sürecinde bir durumdan bir diğer duruma geçiş olasılığa bağlı ancak çıkışı belirleme deterministik Koşullar:

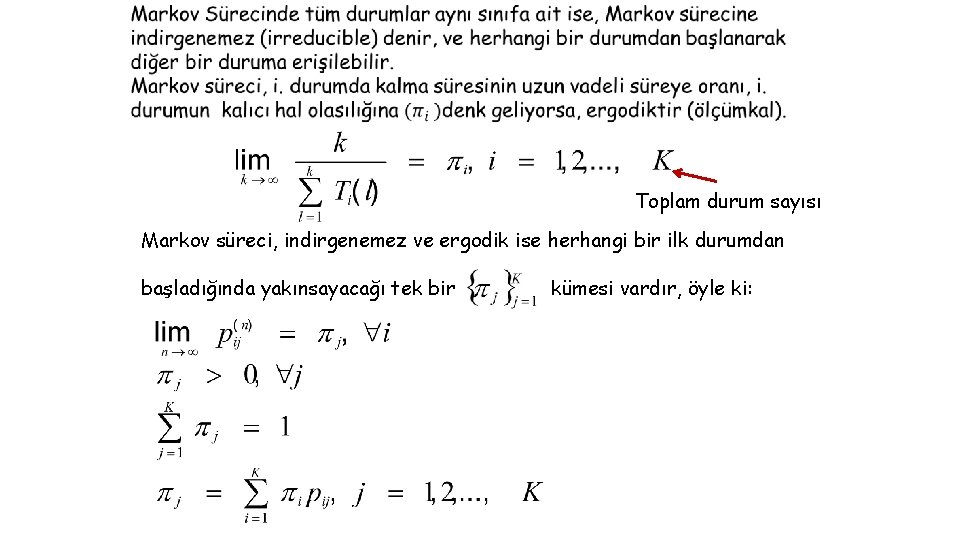

Toplam durum sayısı Markov süreci, indirgenemez ve ergodik ise herhangi bir ilk durumdan başladığında yakınsayacağı tek bir kümesi vardır, öyle ki:

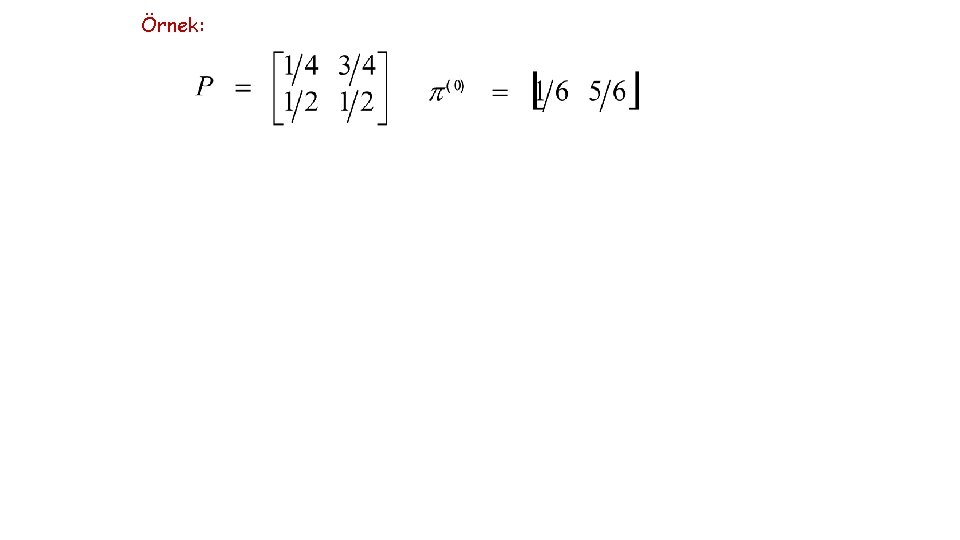

Örnek:

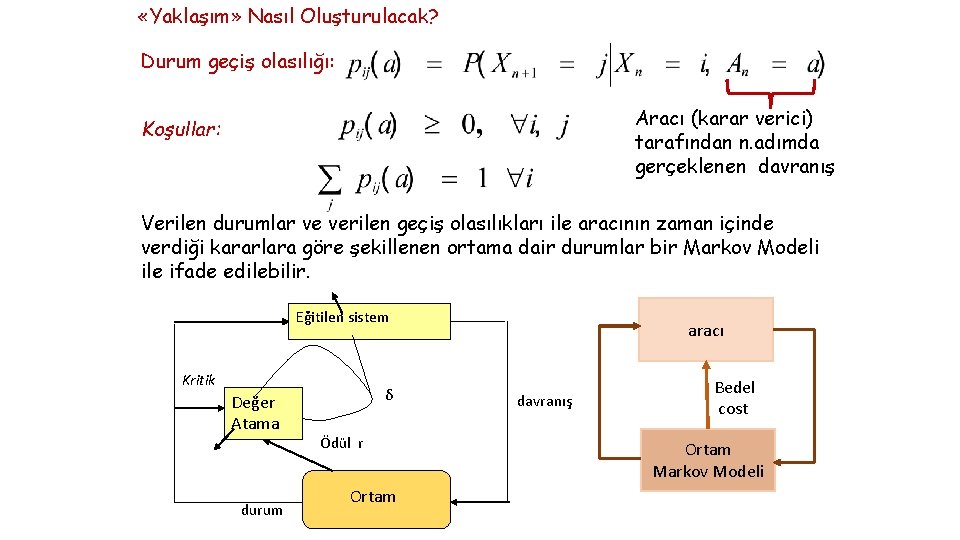

«Yaklaşım» Nasıl Oluşturulacak? Durum geçiş olasılığı: Aracı (karar verici) tarafından n. adımda gerçeklenen davranış Koşullar: Verilen durumlar ve verilen geçiş olasılıkları ile aracının zaman içinde verdiği kararlara göre şekillenen ortama dair durumlar bir Markov Modeli ile ifade edilebilir. Eğitilen sistem Kritik Değer Atama durum δ Ödül r Ortam aracı davranış Bedel cost Ortam Markov Modeli

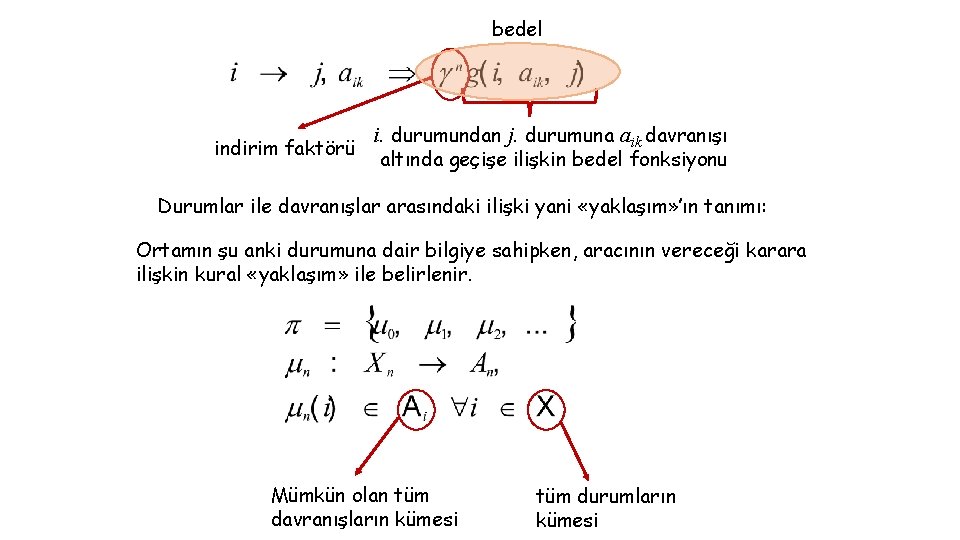

bedel indirim faktörü i. durumundan j. durumuna aik davranışı altında geçişe ilişkin bedel fonksiyonu Durumlar ile davranışlar arasındaki ilişki yani «yaklaşım» ’ın tanımı: Ortamın şu anki durumuna dair bilgiye sahipken, aracının vereceği karara ilişkin kural «yaklaşım» ile belirlenir. Mümkün olan tüm davranışların kümesi tüm durumların kümesi

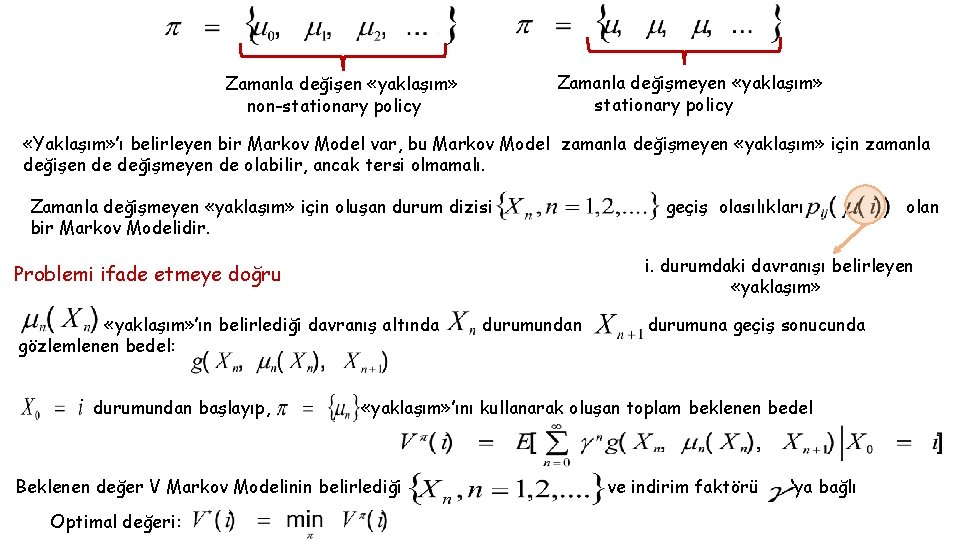

Zamanla değişmeyen «yaklaşım» stationary policy Zamanla değişen «yaklaşım» non-stationary policy «Yaklaşım» ’ı belirleyen bir Markov Model var, bu Markov Model zamanla değişmeyen «yaklaşım» için zamanla değişen de değişmeyen de olabilir, ancak tersi olmamalı. Zamanla değişmeyen «yaklaşım» için oluşan durum dizisi bir Markov Modelidir. «yaklaşım» ’ın belirlediği davranış altında gözlemlenen bedel: durumundan durumuna geçiş sonucunda «yaklaşım» ’ını kullanarak oluşan toplam beklenen bedel Beklenen değer V Markov Modelinin belirlediği Optimal değeri: olan i. durumdaki davranışı belirleyen «yaklaşım» Problemi ifade etmeye doğru durumundan başlayıp, geçiş olasılıkları ve indirim faktörü ‘ya bağlı

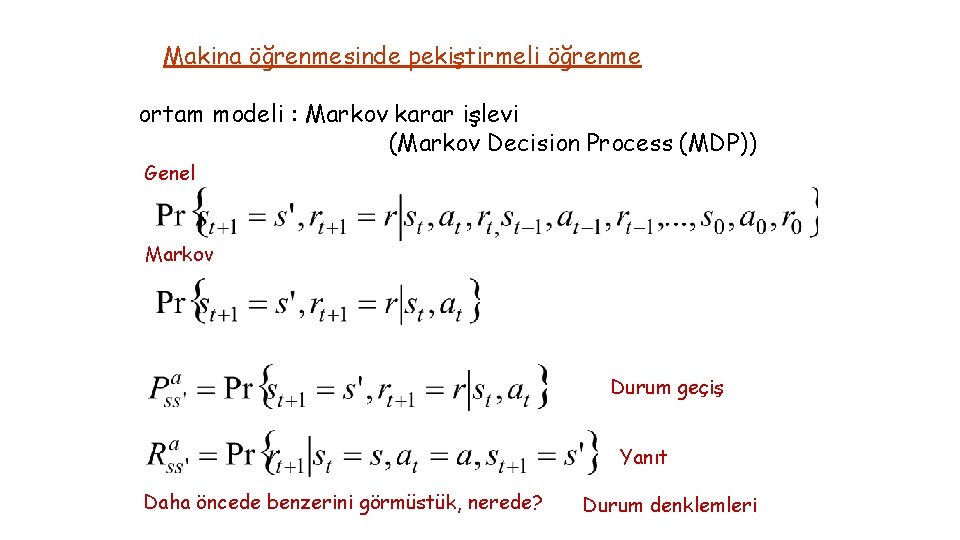

Makina öğrenmesinde pekiştirmeli öğrenme ortam modeli : Markov karar işlevi (Markov Decision Process (MDP)) Genel Markov Durum geçiş Yanıt Daha öncede benzerini görmüstük, nerede? Durum denklemleri

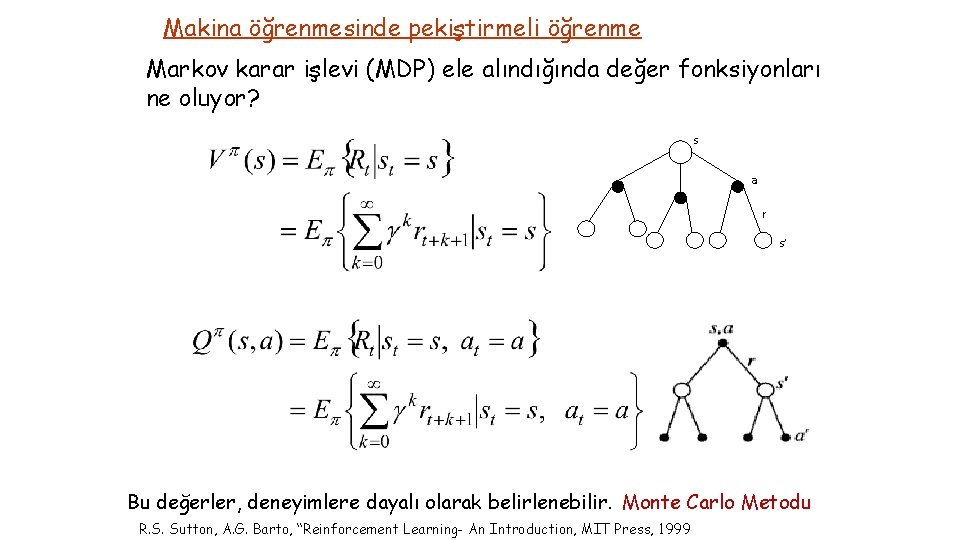

Makina öğrenmesinde pekiştirmeli öğrenme Markov karar işlevi (MDP) ele alındığında değer fonksiyonları ne oluyor? s a r s’ Bu değerler, deneyimlere dayalı olarak belirlenebilir. Monte Carlo Metodu R. S. Sutton, A. G. Barto, “Reinforcement Learning- An Introduction, MIT Press, 1999

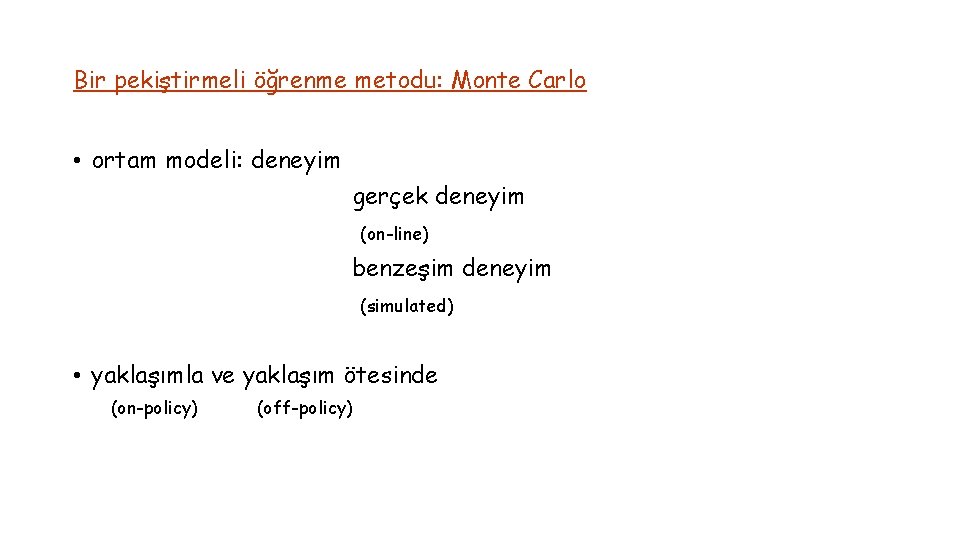

Bir pekiştirmeli öğrenme metodu: Monte Carlo • ortam modeli: deneyim gerçek deneyim (on-line) benzeşim deneyim (simulated) • yaklaşımla ve yaklaşım ötesinde (on-policy) (off-policy)

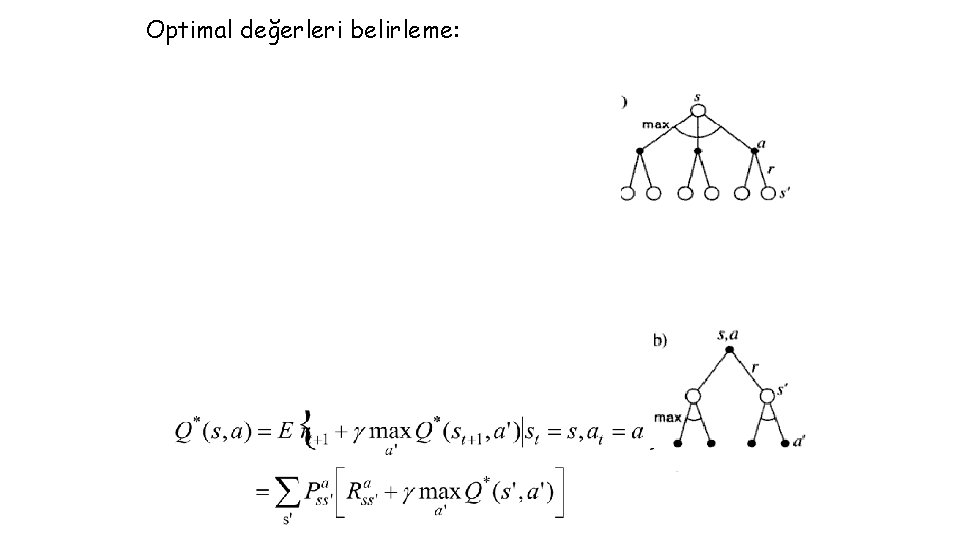

Optimal değerleri belirleme:

Bir pekiştirmeli öğrenme metodu: Zamansal fark • Monte Carlo metoduna benziyor: ortamın tam modeline gereksinimi yok • Dinamik programlamaya benziyor: en son çıktıyı beklemeden güncelleme yapabiliyor ● ● Yaklaşımla: Sarsa Yaklaşım ötesinde: Q-öğrenme Aktör-Kritik (Q-learning)

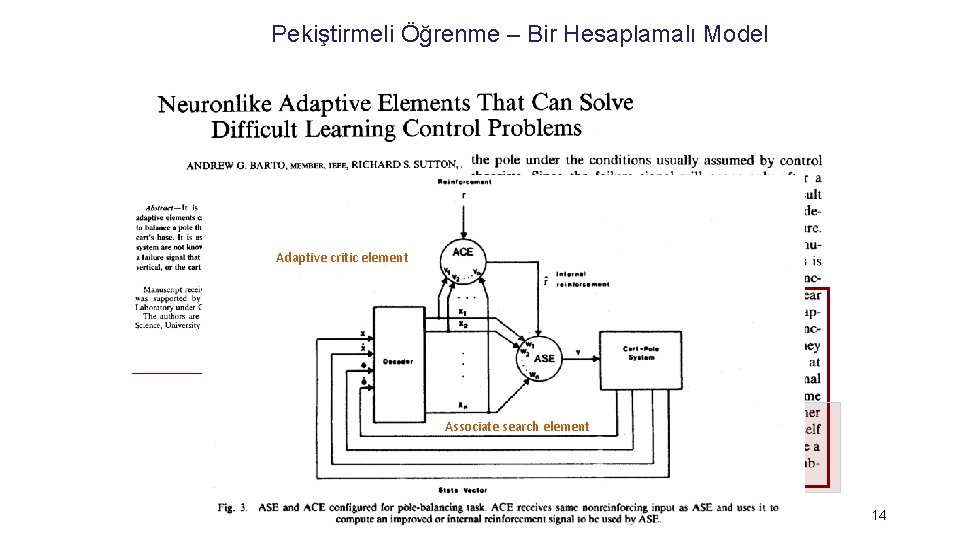

Pekiştirmeli Öğrenme – Bir Hesaplamalı Model Adaptive critic element Associate search element 14

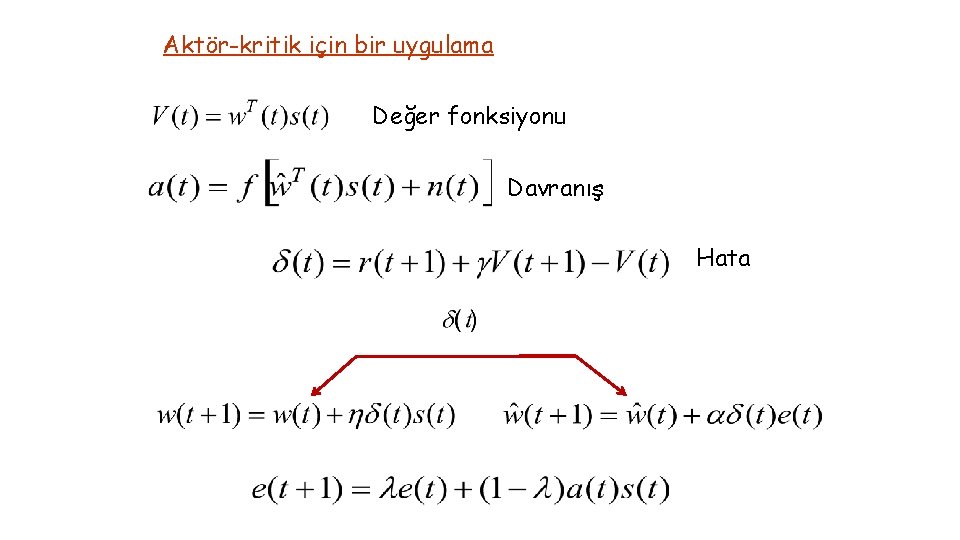

Aktör-kritik için bir uygulama Değer fonksiyonu Davranış Hata

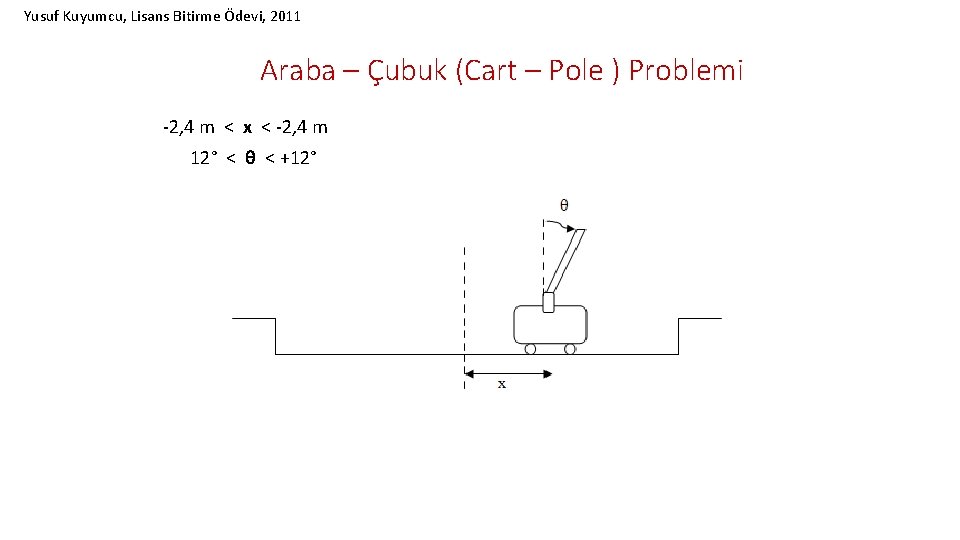

Yusuf Kuyumcu, Lisans Bitirme Ödevi, 2011 Araba – Çubuk (Cart – Pole ) Problemi -2, 4 m < x < -2, 4 m 12° < θ < +12°

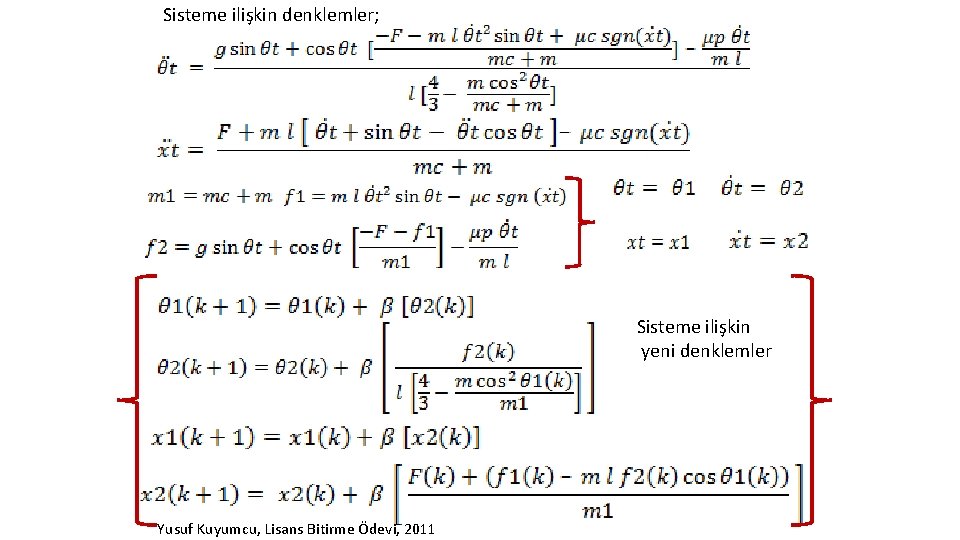

Sisteme ilişkin denklemler; Sisteme ilişkin yeni denklemler Yusuf Kuyumcu, Lisans Bitirme Ödevi, 2011

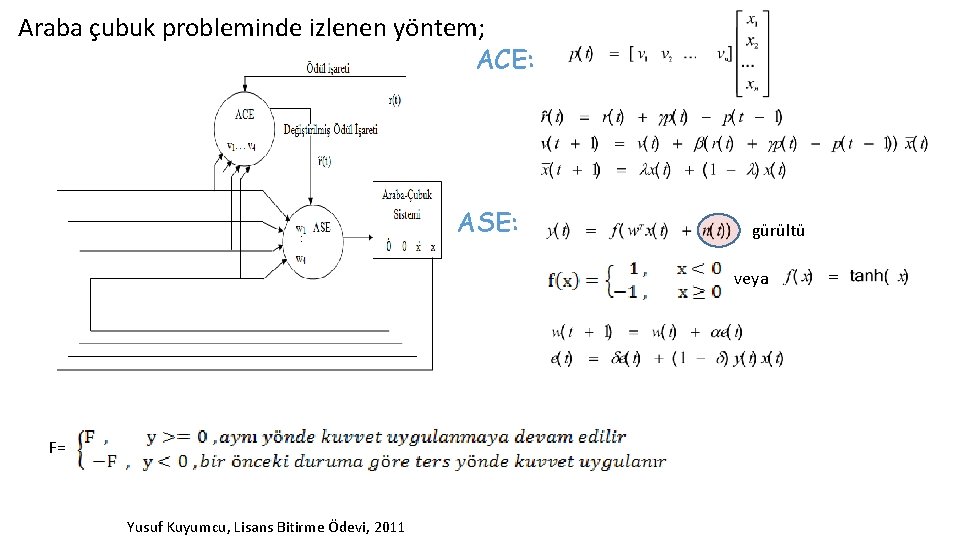

Araba çubuk probleminde izlenen yöntem; ACE: ASE: gürültü veya F= Yusuf Kuyumcu, Lisans Bitirme Ödevi, 2011

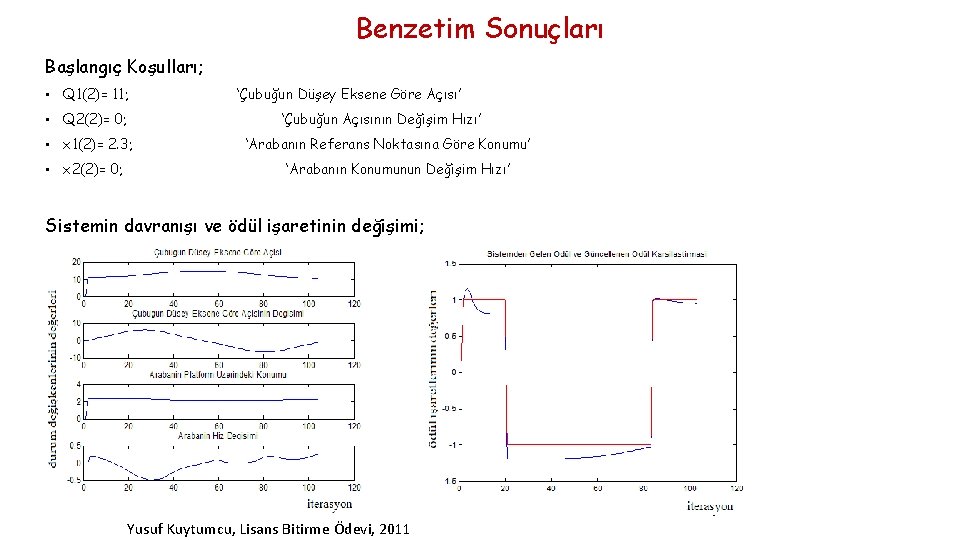

Benzetim Sonuçları Başlangıç Koşulları; • Q 1(2)= 11; • Q 2(2)= 0; ‘Çubuğun Açısının Değişim Hızı’ • x 1(2)= 2. 3; • x 2(2)= 0; ‘Çubuğun Düşey Eksene Göre Açısı’ ‘Arabanın Referans Noktasına Göre Konumu’ ‘Arabanın Konumunun Değişim Hızı’ Sistemin davranışı ve ödül işaretinin değişimi; Yusuf Kuytumcu, Lisans Bitirme Ödevi, 2011

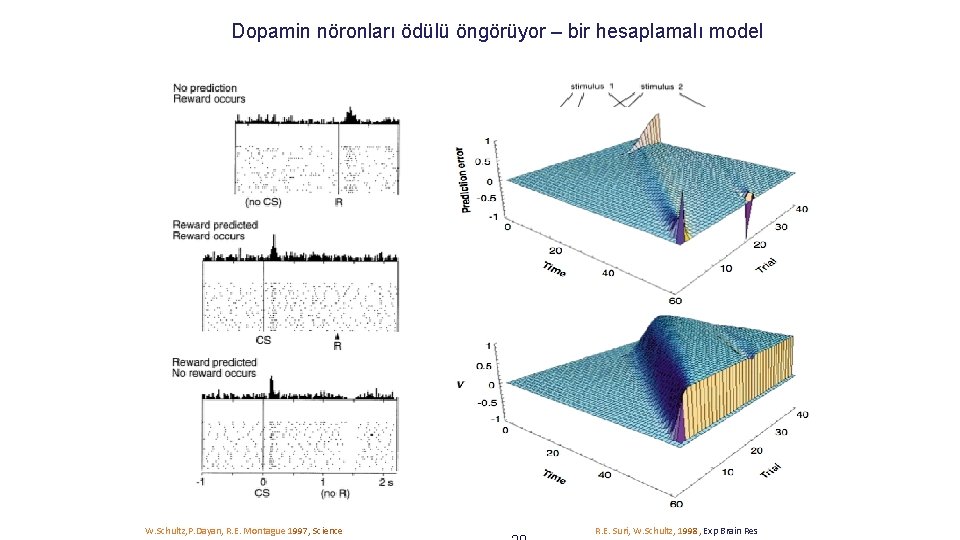

Dopamin nöronları ödülü öngörüyor – bir hesaplamalı model W. Schultz, P. Dayan, R. E. Montague 1997, Science R. E. Suri, W. Schultz, 1998, Exp Brain Res

- Slides: 20