Opinin Pblica y Anlisis de Encuestas Mdulo V

Opinión Pública y Análisis de Encuestas Módulo V: Fuentes de error: ¿por qué muestra y población pueden diferir? Jueves 7 de julio de 2010 David Crow, Associate Director UC Riverside, Survey Research Center david. crow@ucr. edu

Tendencia satisfacción con la democracia

¿Por qué difieren las encuestas entre sí? • Error muestral - Pero algunas de las divergencias son demasiado grandes para explicarse así • Variaciones de fraseo • • ENCUP: satisfecho “hoy en día” El Universal: satisfecho “con el funcionamiento” Latinobarómetro: satisfecho “con la democracia” of contact: 1) face-to-face; 2) SAQ (pencil and paper or on Web); 3) telephone • Escalas distintas • El Univeral, Latinobarómetro cuatro categorías (muy, poco, algo, nada), ENCUP 2003, 2005 incluyeron una quinta categoría punto medio

¿Por qué difieren las encuestas entre sí? (cont. ) • Levantado en momentos distintos - Aún una diferencia tan pequeña como dos meses puede hacer una diferencia - Satisfacción sensible a influencias del entorno • “Efectos de casa” • Peculiaridades • Diferentes casas encuestadoras usan personal diferente, con muestreo, capacitación, método de levantamiento, modo de contacto, etc. distintos

Paradigma de “Error Total” • Hay muchas fuentes de error en las encuestas desde el diseño hasta la ejecución y análisis de ellas • El investigador debe minizar cada fuente de error • Sin embargo, eso es costoso y hay algunos errores que quizás no sean tan graves

Error muestral • Variabilidad o fluctación natural de las medias que resultarían de muestras repetidas • Solución: muestra más grande

Error de cobertura • Existe cuando el marco muestral no incluye a toda la población o, a la inversa, cuando incluye a personas que no son integrantes de la población • Soluciones: – Desarrollar un mejor marco muestral – Usar dos marcos complementarios (“dual frame”)

Error de medición debido a la encuesta • Ocurren cuando las preguntas o el conjunto de respuestas están mal formulados – Preguntas tienen sesgo – Categorías de respuesta no incluyen todas las posibilidades • Solución: revisión cuidadoso del instrumento

Error de medición debido al encuestador • Efectos de entrevistador (“interviewer effects”) • Ocurren cuando el entrevistador se desvía del guión • Error puede ser aleatorio (caso en el que se infla la varianza, pero no introduce sesgo) • Y no aleatorio (caso en el que sí se introduce en sesgo • Debate sobre estilos de entrevistas: uniformidad (“intelligent automatons”) vs. conversacional; los entrevistadores deben aplicar las preguntas de manera uniforme pero, al mismo tiempo, desarrollar una relación con el entrevistado • Solución: capacitación

Error de medición debido al encuestado • Ocurre cuando un entrevistado da una respuesta equivocada • Causas: – Fallas de memoria – Tema sensible

Error de no respuesta nivel “item” • Ocurre cuando un entrevistado accede a ser entrevistado, pero no contesta todas las preguntas – “No sabe” – Tema sensible (deseabilidad social) • Solución: – Revisar cuestionario para estimular que los encuestados respondan a temas sensibles – Capacitación de los entrevistados para conseguir respuestas confiables – Post hoc: imputación de datos faltantes

Error de no respuesta nivel “unidad” • “Unit non-response” ocurre cuando alguien seleccionado para salir en la muestra no se entrevista • Causas: – No se puede contactar (p. e. , es más fácil contactar a gente mayor y mujeres) – Se niega a entrevistarse (p. e. , los más pudientes alegan estar “demasiado ocupados” para entrevistarse”

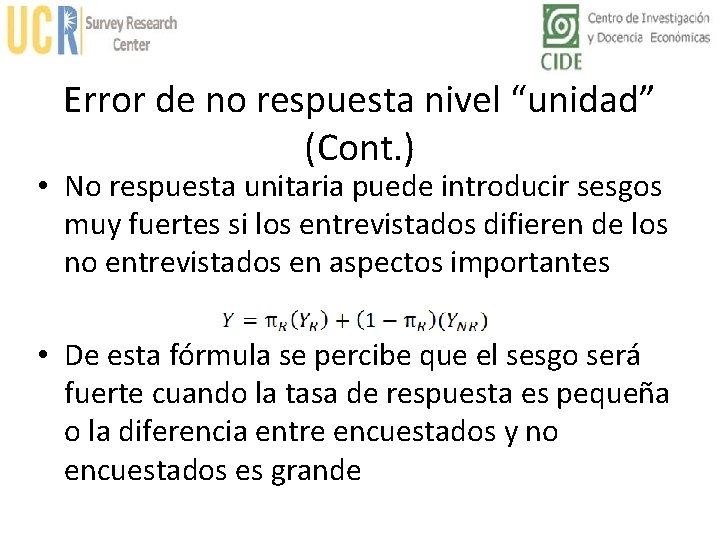

Error de no respuesta nivel “unidad” (Cont. ) • No respuesta unitaria puede introducir sesgos muy fuertes si los entrevistados difieren de los no entrevistados en aspectos importantes • De esta fórmula se percibe que el sesgo será fuerte cuando la tasa de respuesta es pequeña o la diferencia entre encuestados y no encuestados es grande

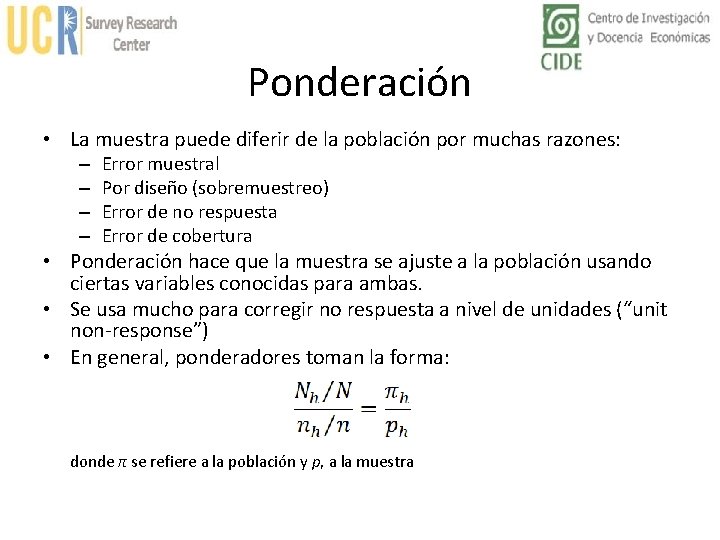

Ponderación • La muestra puede diferir de la población por muchas razones: – – Error muestral Por diseño (sobremuestreo) Error de no respuesta Error de cobertura • Ponderación hace que la muestra se ajuste a la población usando ciertas variables conocidas para ambas. • Se usa mucho para corregir no respuesta a nivel de unidades (“unit non-response”) • En general, ponderadores toman la forma: donde π se refiere a la población y p, a la muestra

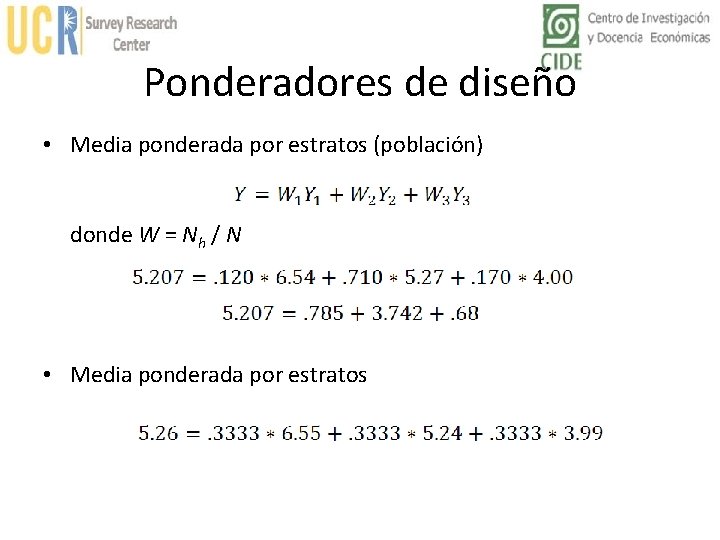

Ponderadores de diseño • Media ponderada por estratos (población) donde W = Nh / N • Media ponderada por estratos

Ponderación • Ponderadores son: –. 12 /. 33 =. 3636 –. 72 /. 33 = 2. 15 –. 17 /. 33 =. 51

Ponderación • Para que la ponderación funcione: 1) debe haber diferencia entre muestra y población y 2) la variable de ponderación (ethnicity) debe estar correlacionada con la variable objetivo (indatt) • OJO: La ponderación no es una panacea, pues sólo corrige aquella parte de la variable objetivo que depende de la variable de ponderación, pero sabemos que hay muchas otras variables (a veces no observadas) que influyen ésa

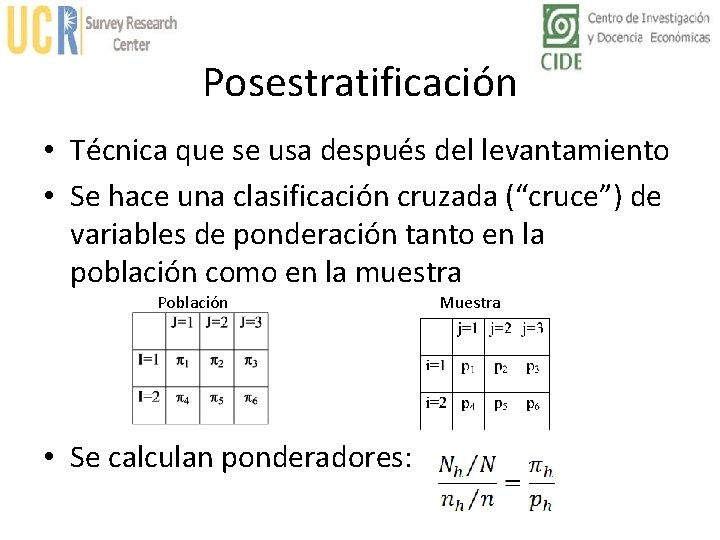

Posestratificación • Técnica que se usa después del levantamiento • Se hace una clasificación cruzada (“cruce”) de variables de ponderación tanto en la población como en la muestra Población • Se calculan ponderadores: Muestra

Raking • Since post-stratification depends on a full cross-classification of population variables, it is often unfeasible—either because these are unknown or because cell counts are sparse (where there are many weighting variables). • “Raking” adjusts sample values to marginal population values. • Deming and Stephen (1940) proposed the “iterative proportional fitting” algorithm for estimating raking weights. The algorithm sets initial weighting factors for each cross-classification term to 1 and adjusts the weight factors for the first cross-classification term so that the weighted sample becomes representative with respect to the population (i. e. , matches the marginal population distribution) for that term. The resulting weight factors are similarly adjusted for the next cross-classification term. Since this disturbs the representativeness of the other cross-classification terms, the process is repeated sequentially until the weighting factors converge (see Bethlehem 2002: 281 for a description of the algorithm).

- Slides: 19