Multiple Regression Gliederung Strukturgleichung Regressionskoeffizienten Der FTest Quadratsummen

- Slides: 53

Multiple Regression Gliederung • Strukturgleichung • Regressionskoeffizienten • Der F-Test – Quadratsummen – Determinationskoeffizient • • Selektion der Prädiktoren Voraussetzungen der Multiplen Regressionsanalyse Die Multiple Regression in SPSS Mediator- und Moderatoranalysen mit der Multiplen Regression 02_multiple_regression 1

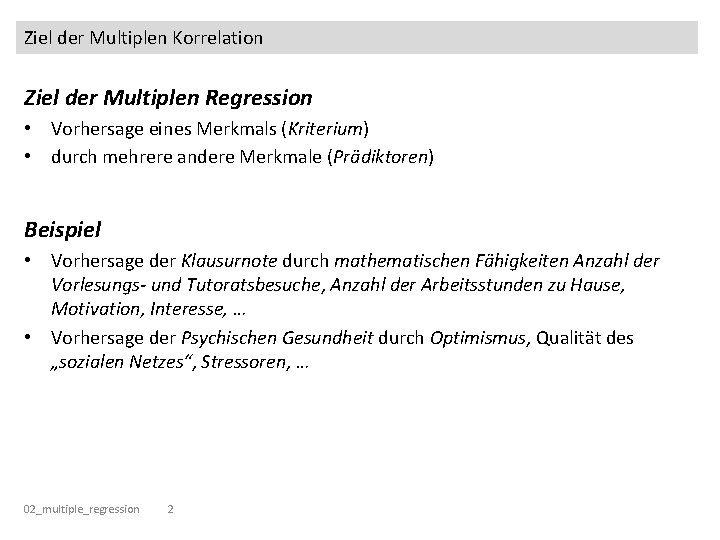

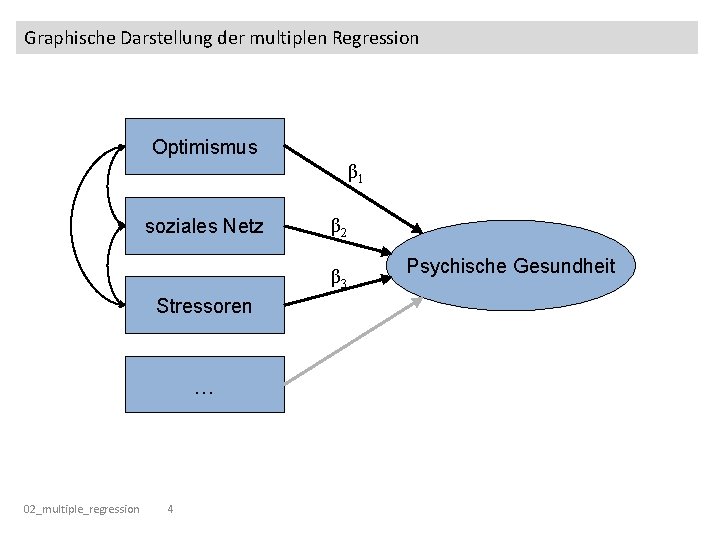

Ziel der Multiplen Korrelation Ziel der Multiplen Regression • Vorhersage eines Merkmals (Kriterium) • durch mehrere andere Merkmale (Prädiktoren) Beispiel • Vorhersage der Klausurnote durch mathematischen Fähigkeiten Anzahl der Vorlesungs- und Tutoratsbesuche, Anzahl der Arbeitsstunden zu Hause, Motivation, Interesse, … • Vorhersage der Psychischen Gesundheit durch Optimismus, Qualität des „sozialen Netzes“, Stressoren, … 02_multiple_regression 2

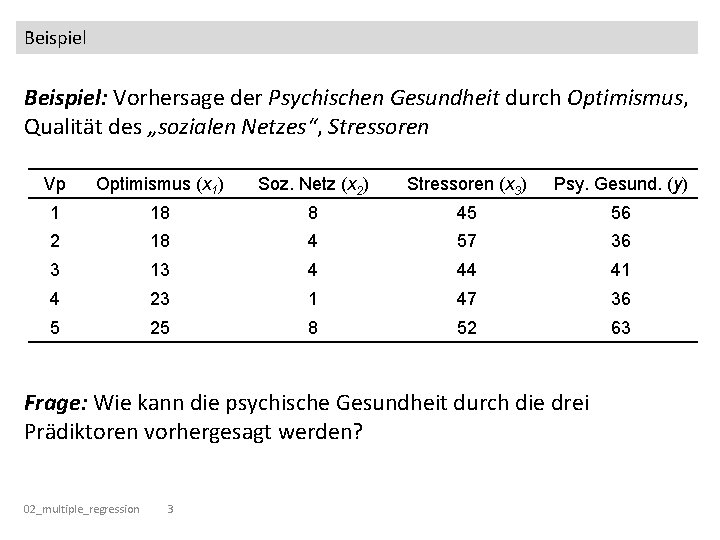

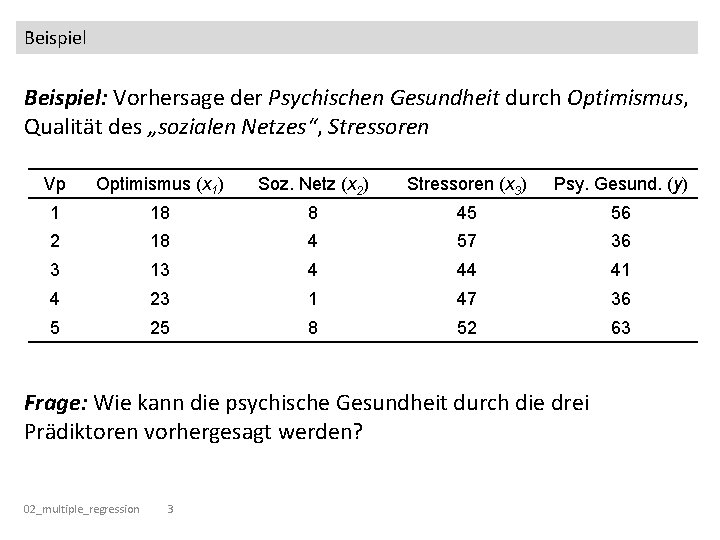

Beispiel: Vorhersage der Psychischen Gesundheit durch Optimismus, Qualität des „sozialen Netzes“, Stressoren Vp Optimismus (x 1) Soz. Netz (x 2) Stressoren (x 3) Psy. Gesund. (y) 1 18 8 45 56 2 18 4 57 36 3 13 4 44 41 4 23 1 47 36 5 25 8 52 63 Frage: Wie kann die psychische Gesundheit durch die drei Prädiktoren vorhergesagt werden? 02_multiple_regression 3

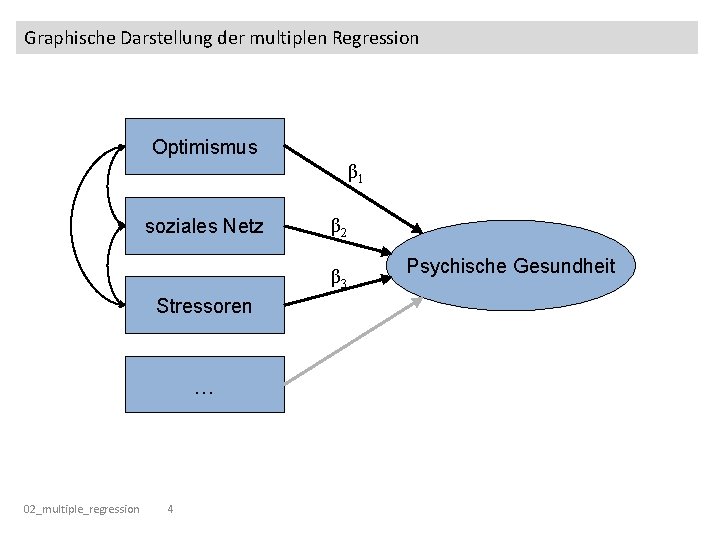

Graphische Darstellung der multiplen Regression Optimismus β 1 soziales Netz β 2 β 3 Stressoren … 02_multiple_regression 4 Psychische Gesundheit

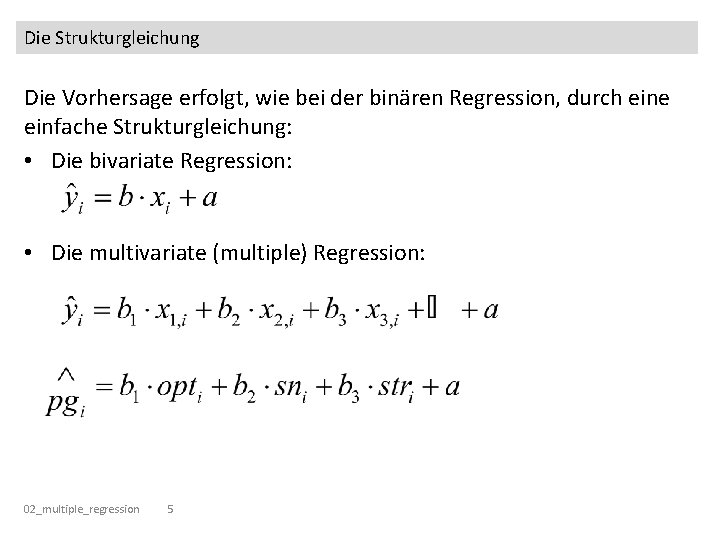

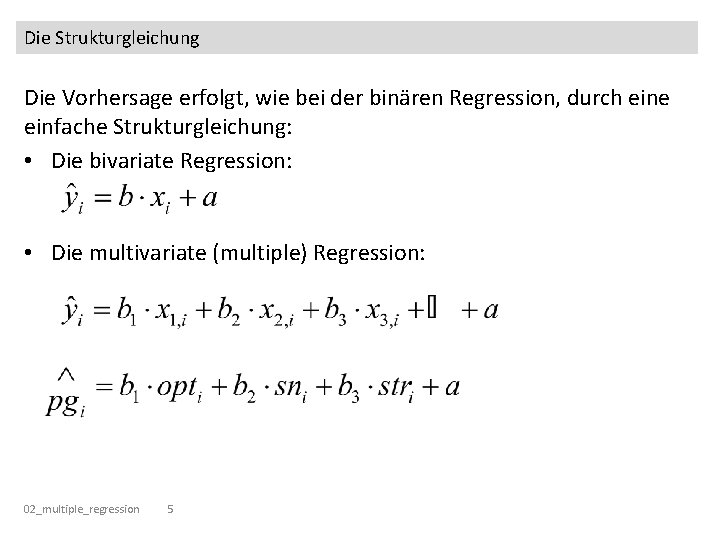

Die Strukturgleichung Die Vorhersage erfolgt, wie bei der binären Regression, durch eine einfache Strukturgleichung: • Die bivariate Regression: • Die multivariate (multiple) Regression: 02_multiple_regression 5

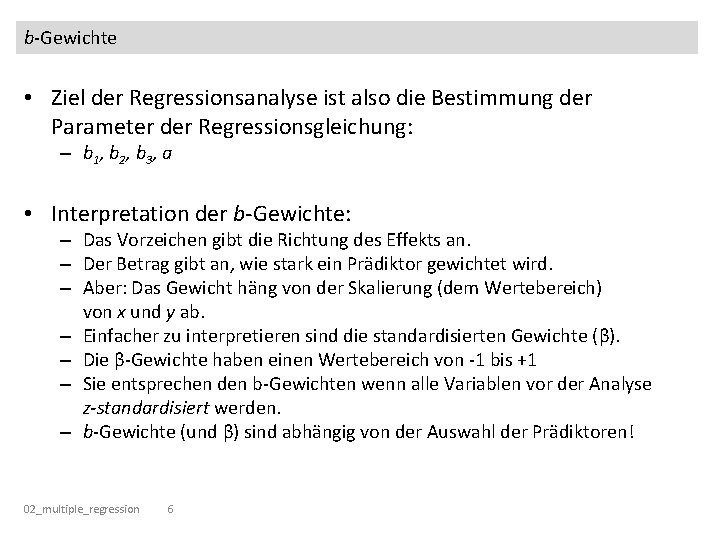

b-Gewichte • Ziel der Regressionsanalyse ist also die Bestimmung der Parameter der Regressionsgleichung: – b 1 , b 2 , b 3 , a • Interpretation der b-Gewichte: – Das Vorzeichen gibt die Richtung des Effekts an. – Der Betrag gibt an, wie stark ein Prädiktor gewichtet wird. – Aber: Das Gewicht häng von der Skalierung (dem Wertebereich) von x und y ab. – Einfacher zu interpretieren sind die standardisierten Gewichte (β). – Die β-Gewichte haben einen Wertebereich von -1 bis +1 – Sie entsprechen den b-Gewichten wenn alle Variablen vor der Analyse z-standardisiert werden. – b-Gewichte (und β) sind abhängig von der Auswahl der Prädiktoren! 02_multiple_regression 6

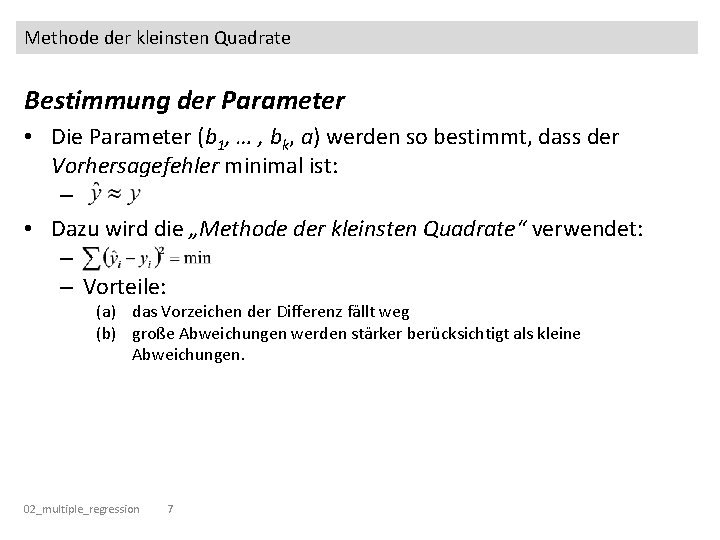

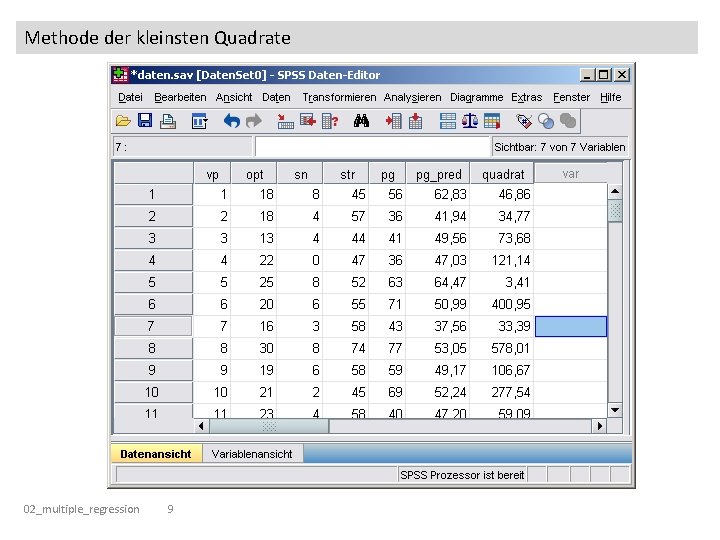

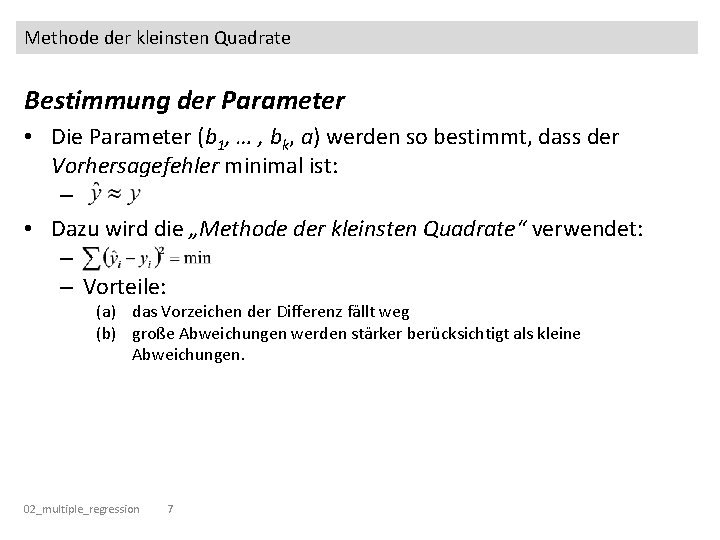

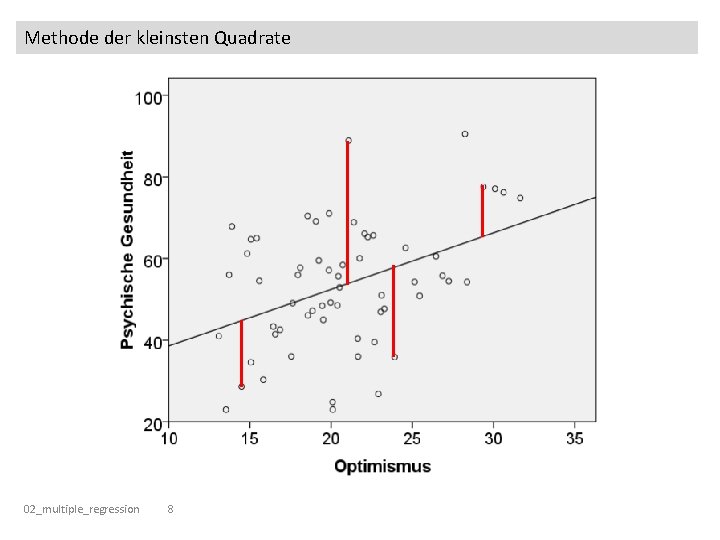

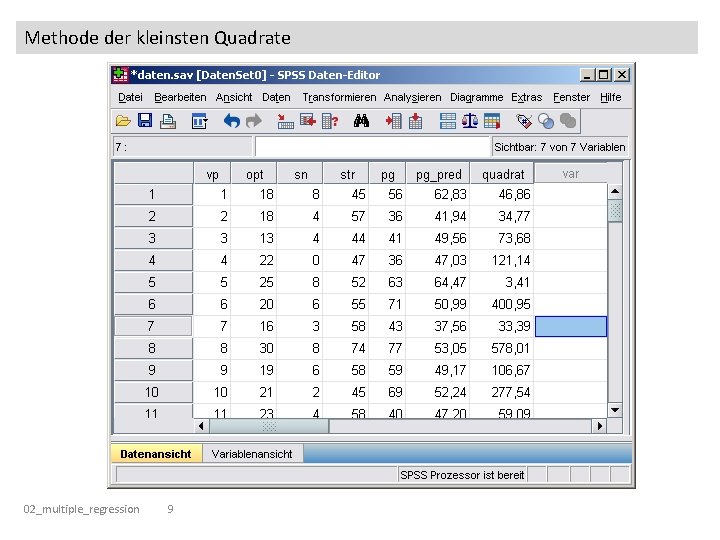

Methode der kleinsten Quadrate Bestimmung der Parameter • Die Parameter (b 1, … , bk, a) werden so bestimmt, dass der Vorhersagefehler minimal ist: – • Dazu wird die „Methode der kleinsten Quadrate“ verwendet: – – Vorteile: (a) das Vorzeichen der Differenz fällt weg (b) große Abweichungen werden stärker berücksichtigt als kleine Abweichungen. 02_multiple_regression 7

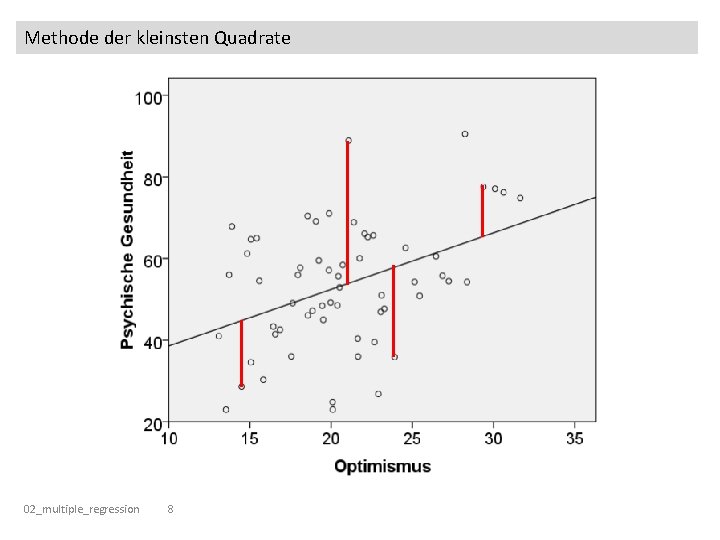

Methode der kleinsten Quadrate 02_multiple_regression 8

Methode der kleinsten Quadrate 02_multiple_regression 9

Signifikanztests der multiplen Regression (1) Wird ein statistisch bedeutsamer Anteil der Varianz des Kriteriums durch alle Prädiktoren gemeinsam aufgeklärt? F-Test (2) Leisten die einzelnen Prädiktoren einen bedeutsamen Beitrag? t-Tests für alle Prädiktoren 02_multiple_regression 10

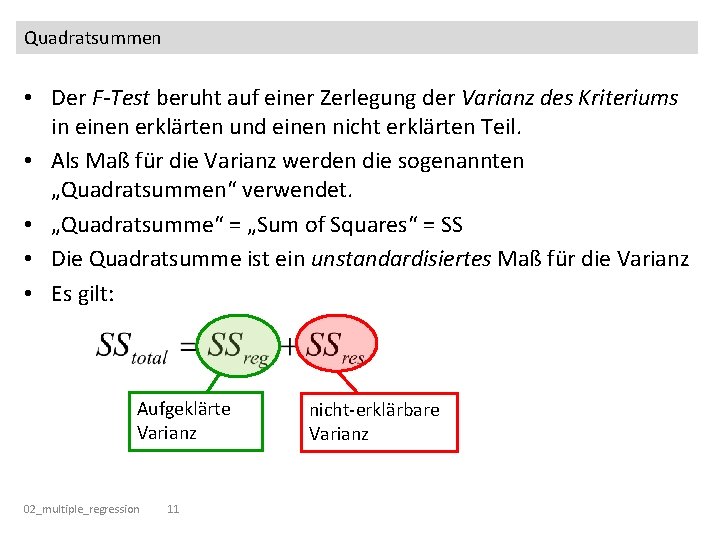

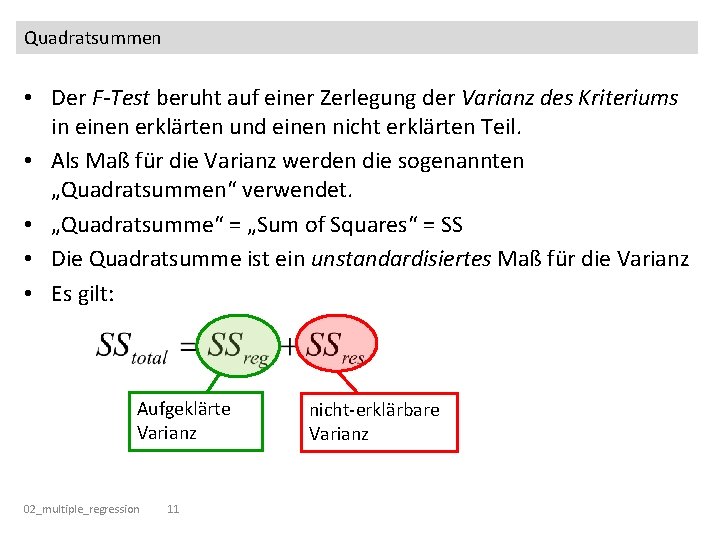

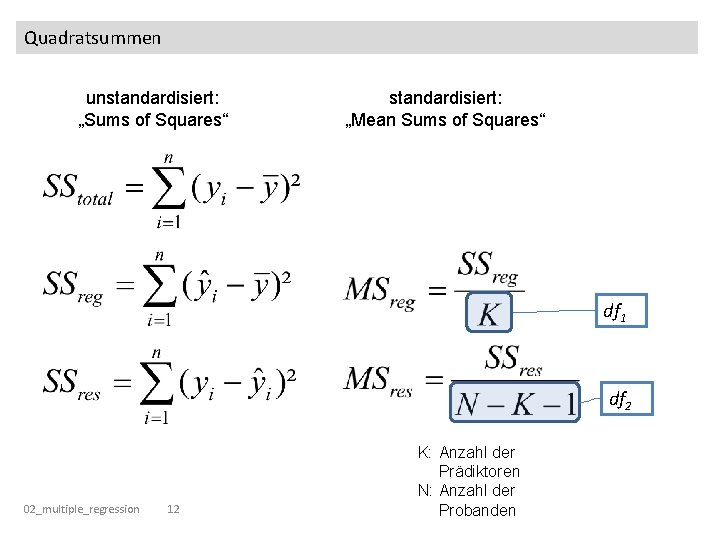

Quadratsummen • Der F-Test beruht auf einer Zerlegung der Varianz des Kriteriums in einen erklärten und einen nicht erklärten Teil. • Als Maß für die Varianz werden die sogenannten „Quadratsummen“ verwendet. • „Quadratsumme“ = „Sum of Squares“ = SS • Die Quadratsumme ist ein unstandardisiertes Maß für die Varianz • Es gilt: Aufgeklärte Varianz 02_multiple_regression 11 nicht-erklärbare Varianz

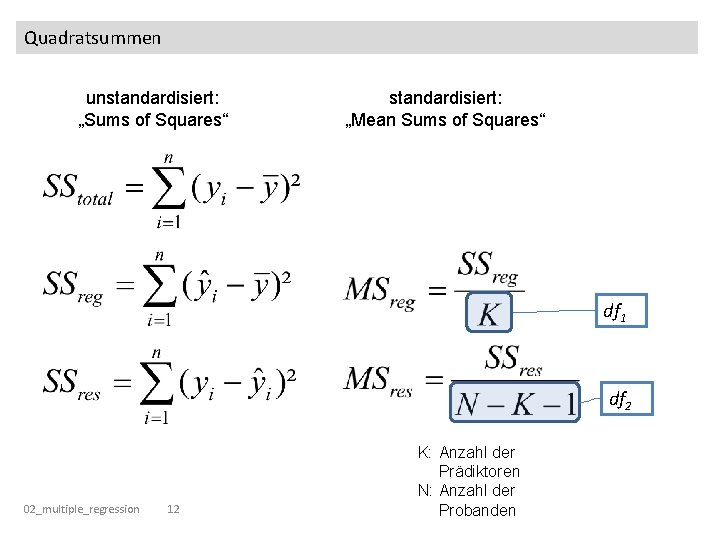

Quadratsummen unstandardisiert: „Sums of Squares“ standardisiert: „Mean Sums of Squares“ df 1 df 2 02_multiple_regression 12 K: Anzahl der Prädiktoren N: Anzahl der Probanden

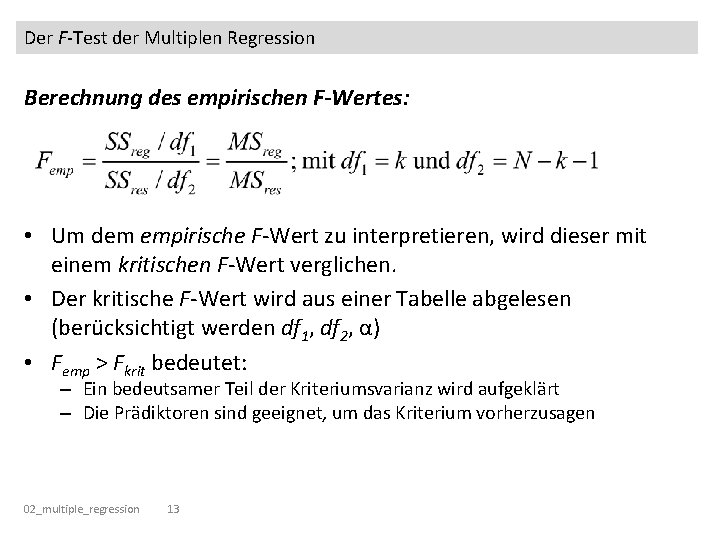

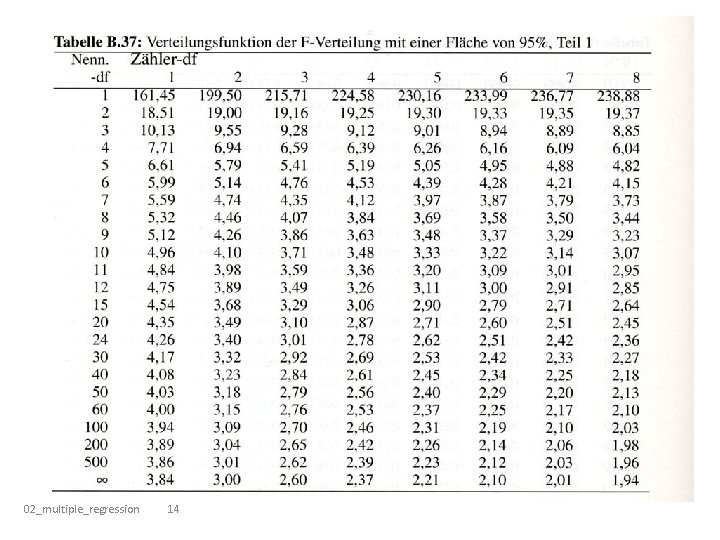

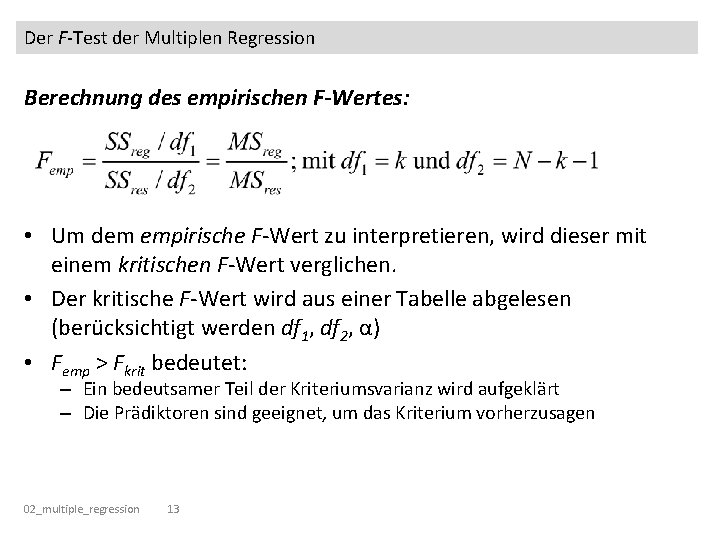

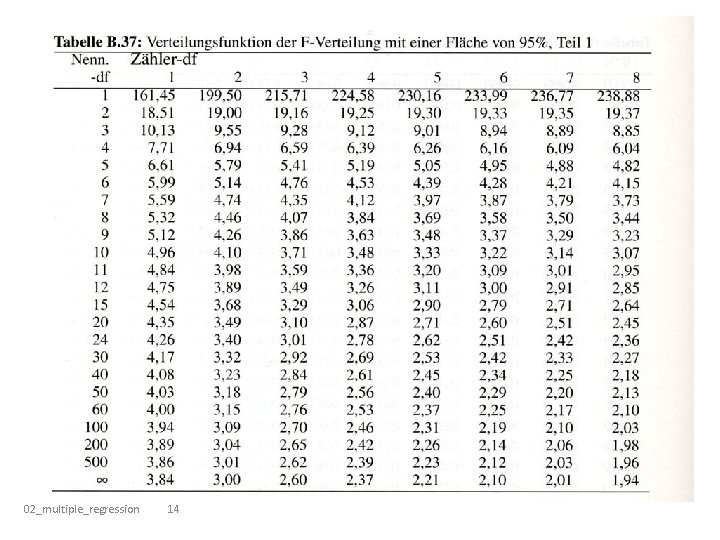

Der F-Test der Multiplen Regression Berechnung des empirischen F-Wertes: • Um dem empirische F-Wert zu interpretieren, wird dieser mit einem kritischen F-Wert verglichen. • Der kritische F-Wert wird aus einer Tabelle abgelesen (berücksichtigt werden df 1, df 2, α) • Femp > Fkrit bedeutet: – Ein bedeutsamer Teil der Kriteriumsvarianz wird aufgeklärt – Die Prädiktoren sind geeignet, um das Kriterium vorherzusagen 02_multiple_regression 13

02_multiple_regression 14

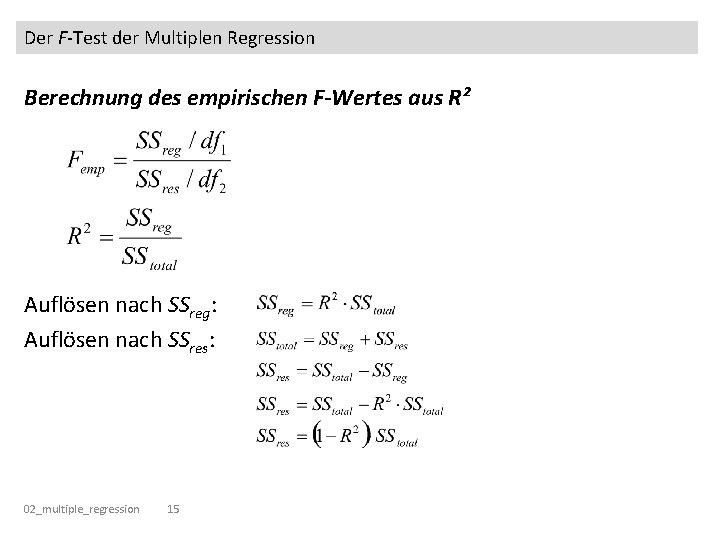

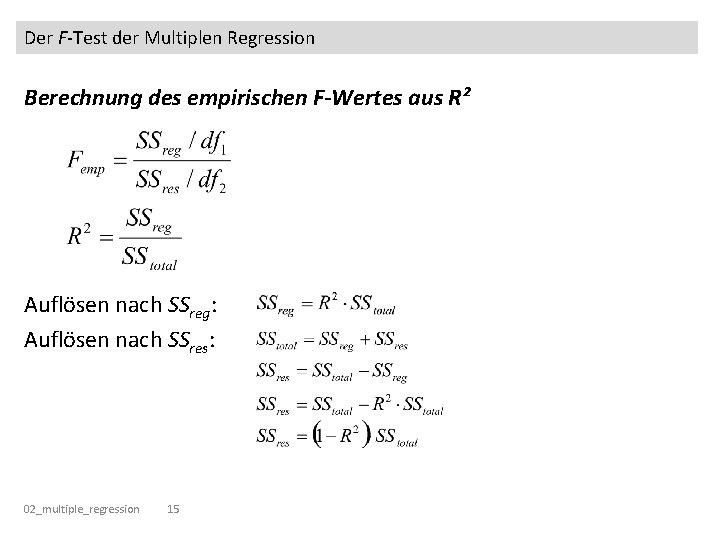

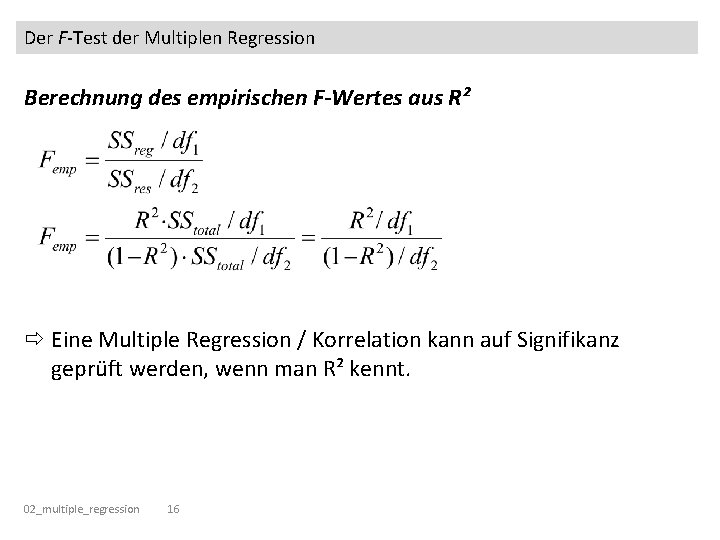

Der F-Test der Multiplen Regression Berechnung des empirischen F-Wertes aus R² Auflösen nach SSreg: Auflösen nach SSres: 02_multiple_regression 15

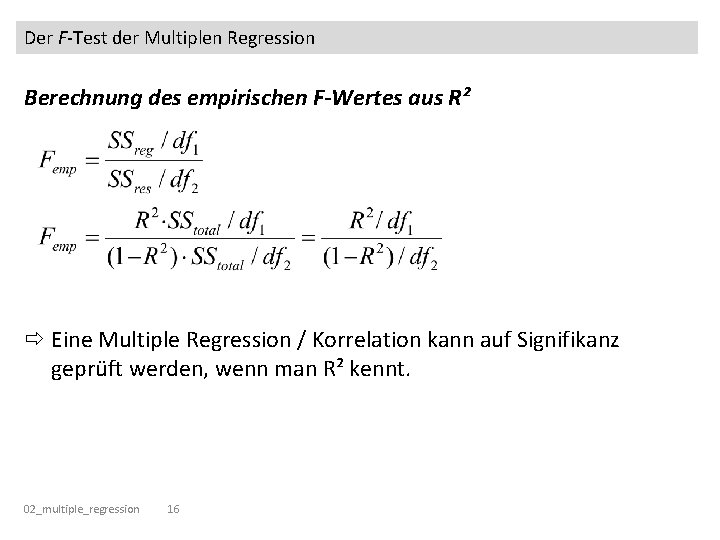

Der F-Test der Multiplen Regression Berechnung des empirischen F-Wertes aus R² Eine Multiple Regression / Korrelation kann auf Signifikanz geprüft werden, wenn man R² kennt. 02_multiple_regression 16

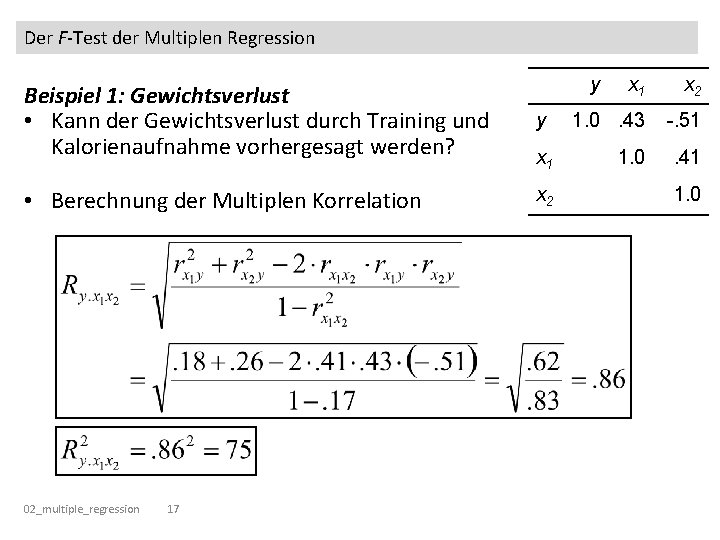

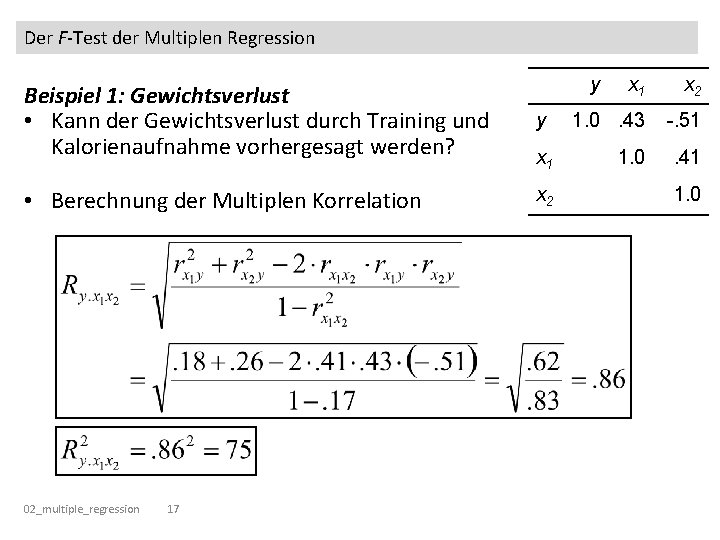

Der F-Test der Multiplen Regression y Beispiel 1: Gewichtsverlust • Kann der Gewichtsverlust durch Training und Kalorienaufnahme vorhergesagt werden? y • Berechnung der Multiplen Korrelation x 2 02_multiple_regression 17 x 1 x 2 1. 0. 43 -. 51 1. 0 . 41 1. 0

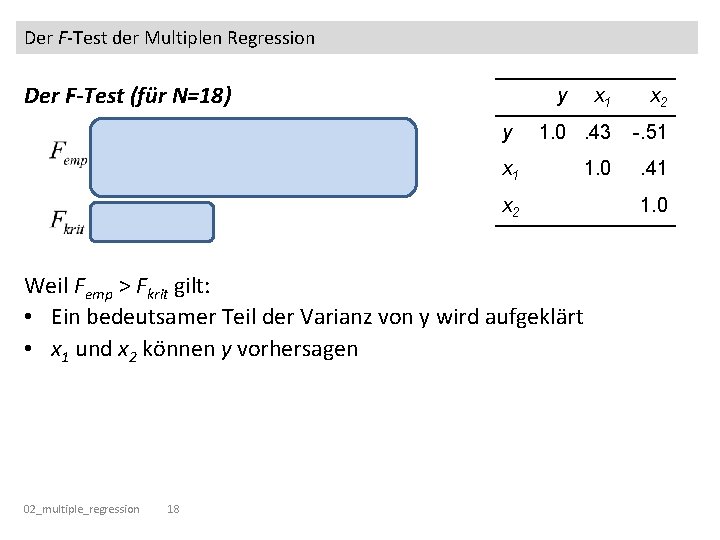

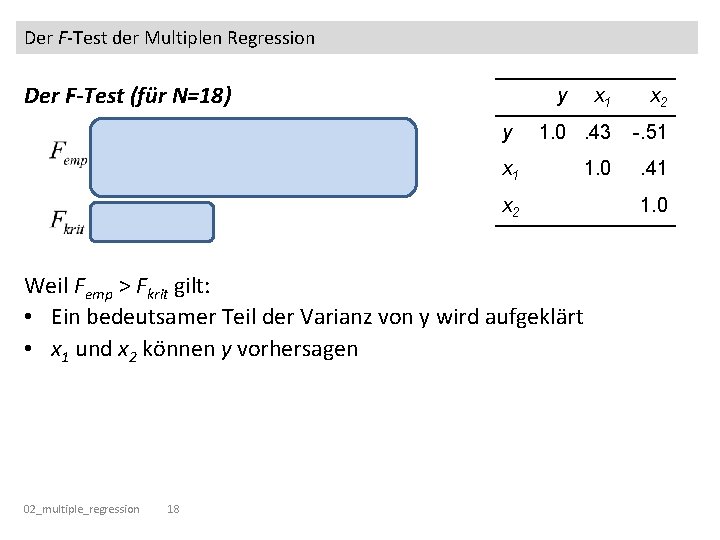

Der F-Test der Multiplen Regression Der F-Test (für N=18) y y x 1 x 2 1. 0. 43 -. 51 1. 0 . 41 x 2 Weil Femp > Fkrit gilt: • Ein bedeutsamer Teil der Varianz von y wird aufgeklärt • x 1 und x 2 können y vorhersagen 02_multiple_regression 18 1. 0

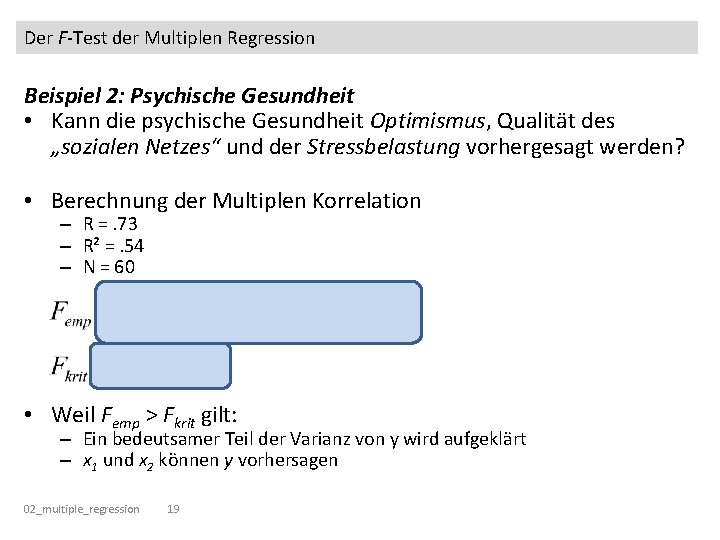

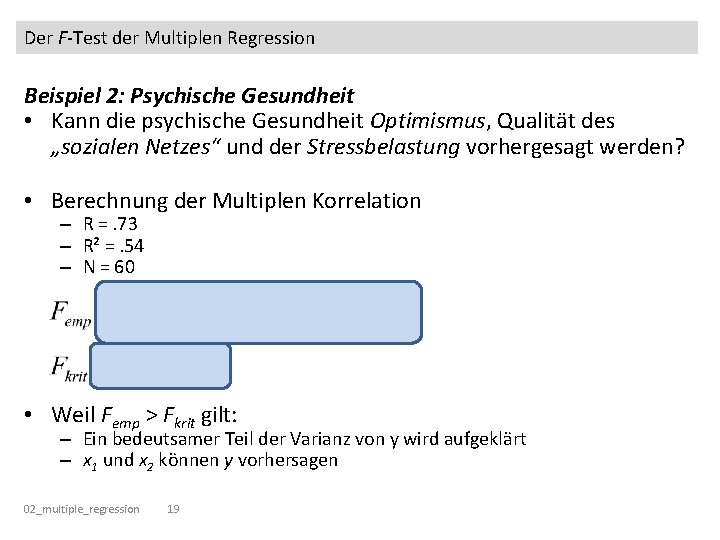

Der F-Test der Multiplen Regression Beispiel 2: Psychische Gesundheit • Kann die psychische Gesundheit Optimismus, Qualität des „sozialen Netzes“ und der Stressbelastung vorhergesagt werden? • Berechnung der Multiplen Korrelation – R =. 73 – R² =. 54 – N = 60 • Weil Femp > Fkrit gilt: – Ein bedeutsamer Teil der Varianz von y wird aufgeklärt – x 1 und x 2 können y vorhersagen 02_multiple_regression 19

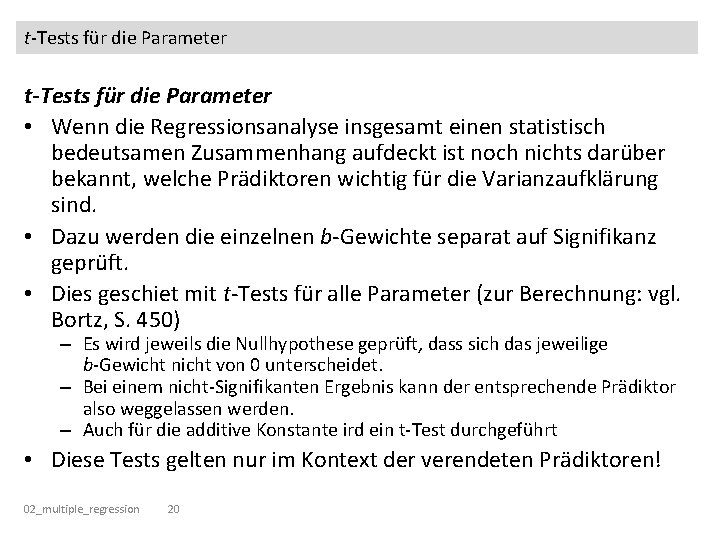

t-Tests für die Parameter • Wenn die Regressionsanalyse insgesamt einen statistisch bedeutsamen Zusammenhang aufdeckt ist noch nichts darüber bekannt, welche Prädiktoren wichtig für die Varianzaufklärung sind. • Dazu werden die einzelnen b-Gewichte separat auf Signifikanz geprüft. • Dies geschiet mit t-Tests für alle Parameter (zur Berechnung: vgl. Bortz, S. 450) – Es wird jeweils die Nullhypothese geprüft, dass sich das jeweilige b-Gewicht nicht von 0 unterscheidet. – Bei einem nicht-Signifikanten Ergebnis kann der entsprechende Prädiktor also weggelassen werden. – Auch für die additive Konstante ird ein t-Test durchgeführt • Diese Tests gelten nur im Kontext der verendeten Prädiktoren! 02_multiple_regression 20

Korrigiertes R² R² überschätzt Populationszusammenhang • Die Vorhersage in einer Stichprobe überschätzt Vorhersage in anderen Stichproben bzw. in der Population • Je kleiner die Stichprobe und je größer die Anzahl der Prädiktoren desto größer die Überschätzung von R² • Bei einem Nullzusammenhang in Population ergibt sich ein Erwartungswert für R² von E(R²) = (k-1)/(N-1) – Beispiel: k=3; N=10: E(R²) = 2/9 =. 22 • Empfehlung: Verhältnis N/K von mind. 20, besser 30 • Beispiel: k=2, N=40: E(R²) = 1/39 =. 03 k=2, N=60: E(R²) = 1/59 =. 02 02_multiple_regression 21

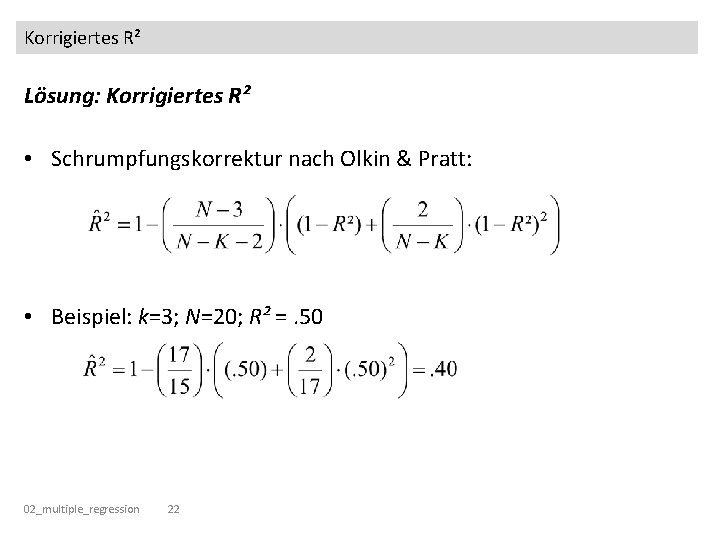

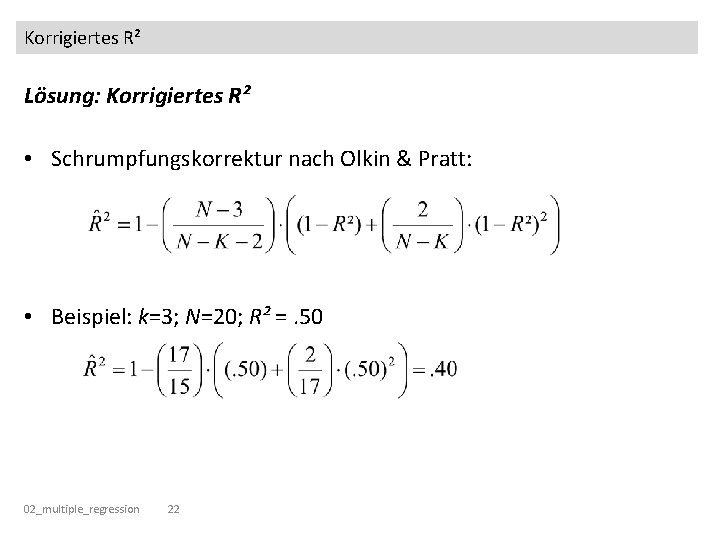

Korrigiertes R² Lösung: Korrigiertes R² • Schrumpfungskorrektur nach Olkin & Pratt: • Beispiel: k=3; N=20; R² =. 50 02_multiple_regression 22

Auswahl der Prädiktoren • In der Praxis stellt sich das Problem, welche und wie viele Prädiktoren für die Vorhersage ausgewählt werden sollten. • Dabei sollte immer ein „sparsames“ Vorgehen gewählt werden, weil eine große Prädiktormenge eine Überschätzung von R² fördert. • Mögliche Strategien – Hypothesengeleitetes Vorgehen: • „Einschluss“ – Hierarchische Regressionsanalysen: • Vorwärts Selektion • Rückwärts Eliminierung • Schrittweises Vorgehen 02_multiple_regression 23

Auswahl der Prädiktoren Einschluss - Strategie • A priori Auswahl der aufzunehmenden Prädiktoren (aufgrund von Vorwissen oder Theorie) • Vorteile: – Hypothesengeleitetes Vorgehen • Nachteile: – Möglicherweise Aufnahme von mehr Prädiktoren als erforderlich (Prädiktoren, die keinen signifikanten Beitrag leisten) – Dies kann zu einer Verringerung des F-Wertes führen (wegen der größeren Anzahl der Zähler-Freiheitsgrade), und damit die Teststärke verringern. – Möglicherweise werden wichtige Prädiktoren „vergessen“ 02_multiple_regression 24

Auswahl der Prädiktoren Hierarchisches Regressionsanalysen • Die am besten passenden Prädiktoren werden post-hoc (empirisch) bestimmt. • Vorteile: – Minimum an Prädiktoren – Exploratives Vorgehen möglich • Nachteile: – „Capitalization of Chance“ wegen der Bevorzugung hoch korrelierender Prädiktoren – Kein hypothesengeleitetes Vorgehen 02_multiple_regression 25

Auswahl der Prädiktoren Vorwärts - Selektion • Aus einer Menge möglicher Prädiktoren wird der Prädiktor mit der höchsten Validität zuerst aufgenommen. • Unter den verbleibenden Prädiktoren wird immer derjenige ausgewählt, der den größten Teil der verbleibenden Varianz aufklärt (=höchste inkrementelle Validität). • Wenn kein Prädiktor die aufgeklärte Varianz signifikant erhöht, ist die endgültige Auswahl gefunden. 02_multiple_regression 26

Auswahl der Prädiktoren Rückwärts - Eliminierung • Zunächst werden alle Prädiktoren eingeschlossen. • Dann wird immer der Prädiktor weglassen, der am wenigsten zur Vorhersage beiträgt. • Wenn der Ausschluss eines Prädiktors zu einer signifikanten Reduktion der aufgeklärten Varianz führen würde, wird der Selektionsprozess abgebrochen. 02_multiple_regression 27

Auswahl der Prädiktoren Schrittweise Selektion: • Es wird abwechseln ein Vorwärts- und ein Rückwärtsschritt durchgeführt. • Dadurch werden Variablen, die im Kontext neu aufgenommener Prädiktoren keine Varianz mehr aufklären, im Nachhinein wieder entfernt. • Diese Schritte werden so lange wiederholt, bis keine weiteren Variablen ein- oder ausgeschlossen werden können. 02_multiple_regression 28

Voraussetzungen der Multiplen Regression • Multivariate Normalverteilung aller Variablen (schwer zu überprüfen) • Aber: bei großen Stichproben (mindestens 20 Probanden pro Prädiktor) ist die Regressionsanalyse robust gegenüber Verletzungen dieser Annahme. • Weitere Einschränkung: Es werden nur lineare Zusammenhänge gefunden. 02_multiple_regression 29

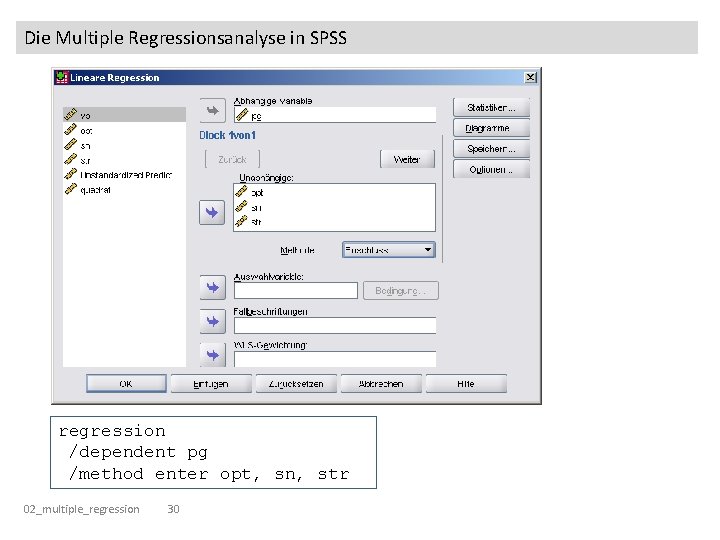

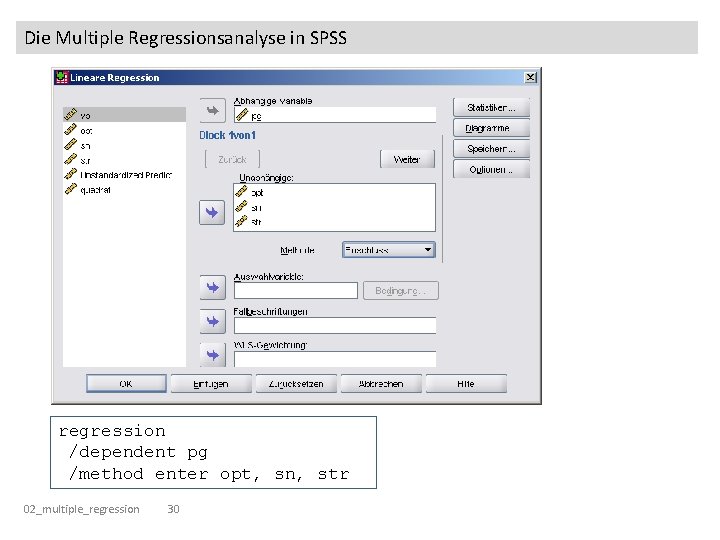

Die Multiple Regressionsanalyse in SPSS regression /dependent pg /method enter opt, sn, str 02_multiple_regression 30

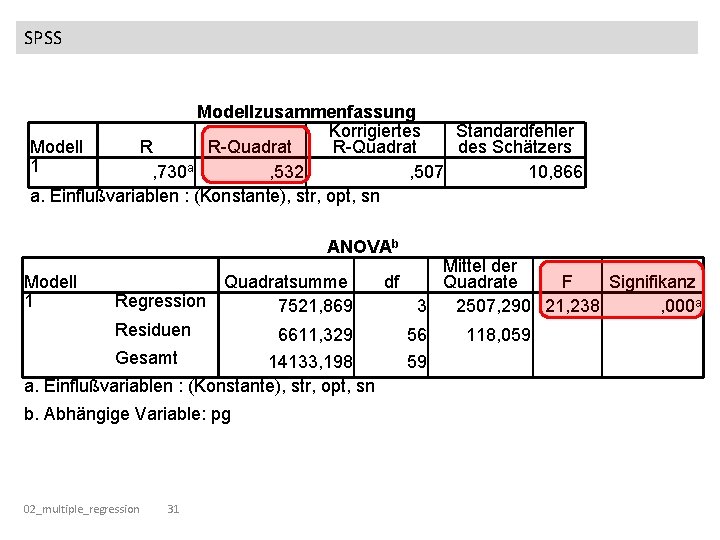

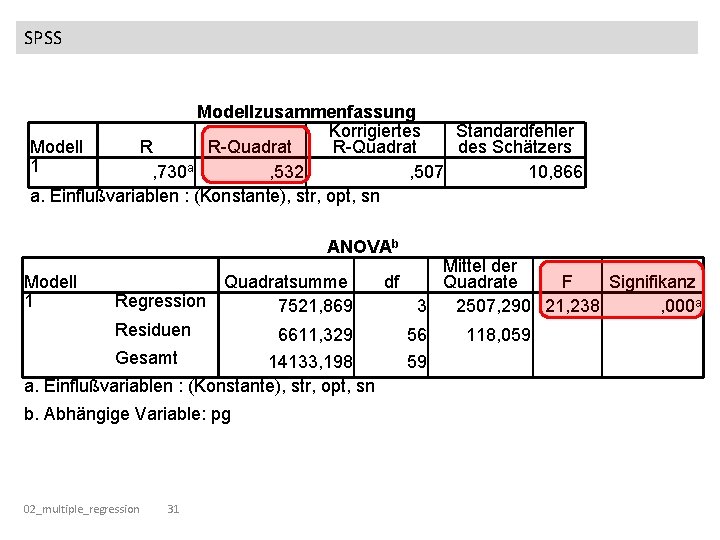

SPSS Modellzusammenfassung Korrigiertes Standardfehler Modell R R-Quadrat des Schätzers 1 , 730 a , 532 , 507 10, 866 a. Einflußvariablen : (Konstante), str, opt, sn ANOVAb Modell 1 Regression Quadratsumme 7521, 869 Residuen Gesamt 6611, 329 14133, 198 a. Einflußvariablen : (Konstante), str, opt, sn b. Abhängige Variable: pg 02_multiple_regression 31 Mittel der df Quadrate F Signifikanz 3 2507, 290 21, 238 , 000 a 56 59 118, 059

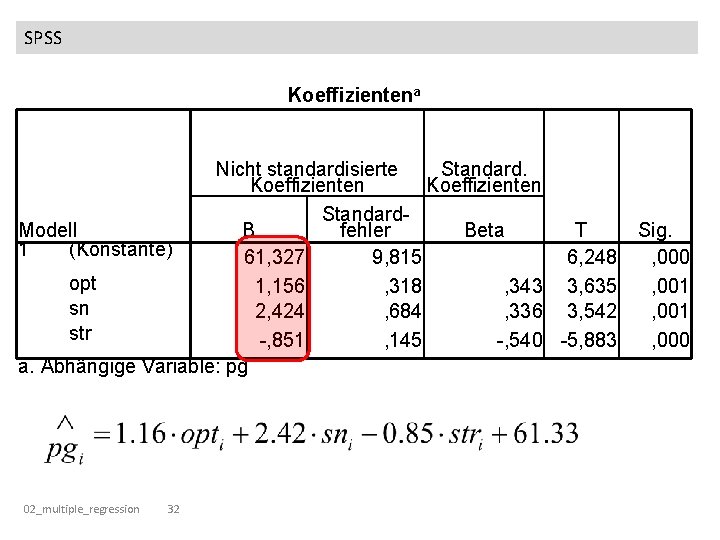

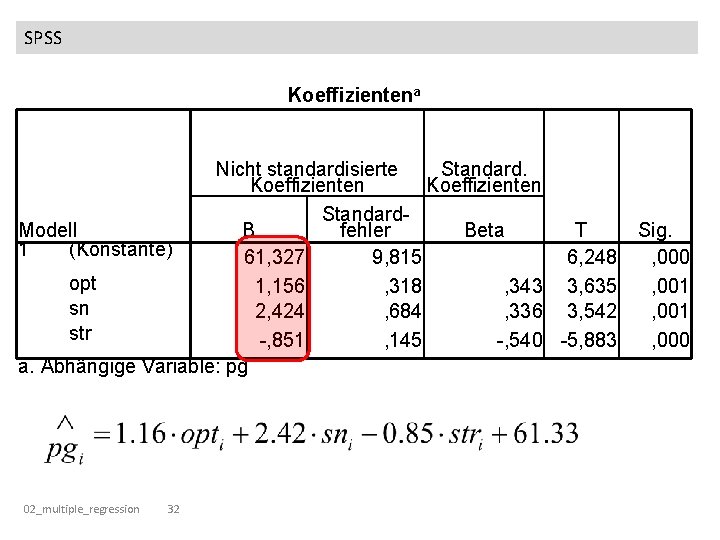

SPSS Koeffizientena Nicht standardisierte Standard. Koeffizienten Standard. B fehler Beta Modell T 1 (Konstante) 61, 327 9, 815 6, 248 opt 1, 156 , 318 , 343 3, 635 sn 2, 424 , 684 , 336 3, 542 str -, 851 , 145 -, 540 -5, 883 a. Abhängige Variable: pg 02_multiple_regression 32 Sig. , 000 , 001 , 000

Weitere Regressionsanalysen • Mediatoranalyse – Wird der Zusammenhang von X und Y durch M vermittelt? • Moderatoranalyse – Wird der Zusammenhang von X und Y durch M beeinflusst? 02_multiple_regression 33

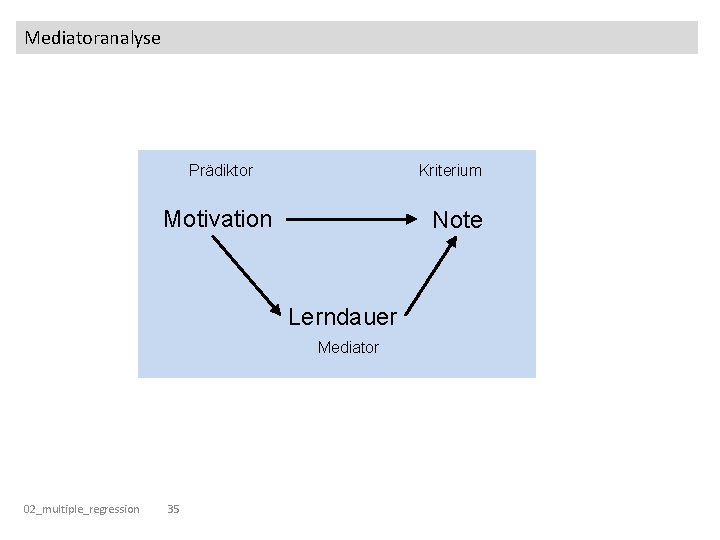

Mediatoranalyse • Fragestellung: „Wird der Zusammenhang von X und Y durch M vermittelt? “ • Beispiel: „Wird der Zusammenhang von Motivation und Note durch Lernaufwand vermittelt? “ • Es wird also eine Annahme zur Kausalität gemacht • Es wird untersucht, wie die Motivation wirkt. • Literatur: – Baron, R. M. , & Kenny, D. A. (1986). The moderator-mediator distinction in social psychological research: Conceptual, strategic, and statistical considerations. Journal of Personality and Social Psychology, 51(6), 11731182. 02_multiple_regression 34

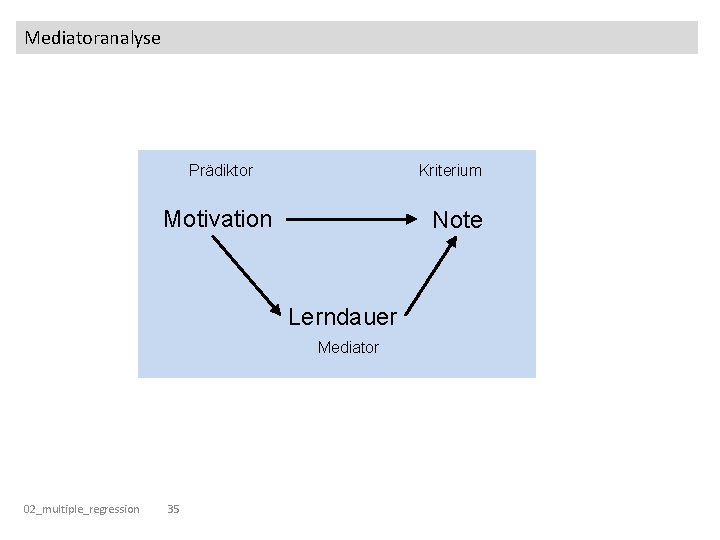

Mediatoranalyse Prädiktor Kriterium Motivation Note Lerndauer Mediator 02_multiple_regression 35

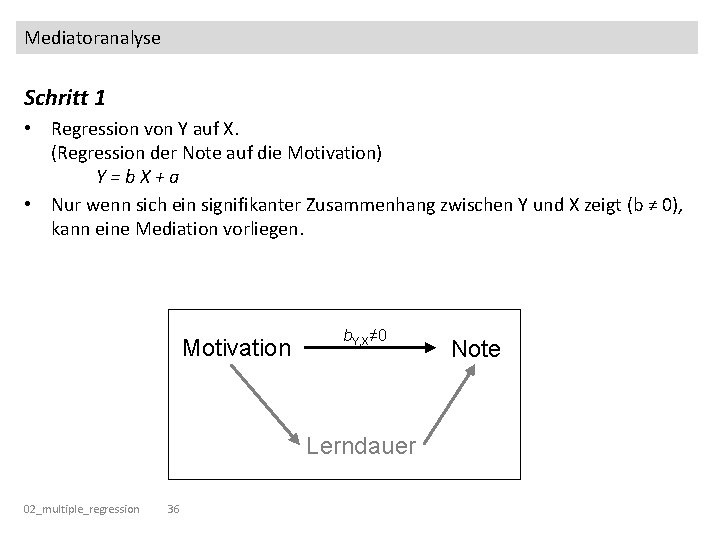

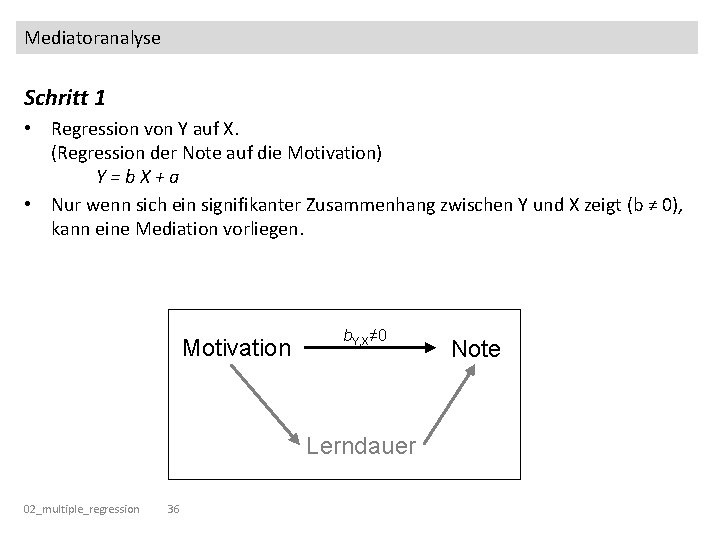

Mediatoranalyse Schritt 1 • Regression von Y auf X. (Regression der Note auf die Motivation) Y=b. X+a • Nur wenn sich ein signifikanter Zusammenhang zwischen Y und X zeigt (b ≠ 0), kann eine Mediation vorliegen. Motivation b. Y, X≠ 0 Lerndauer 02_multiple_regression 36 Note

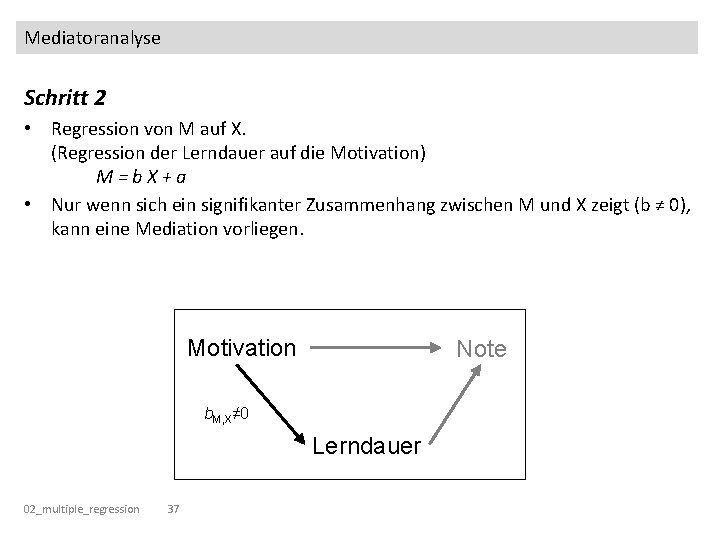

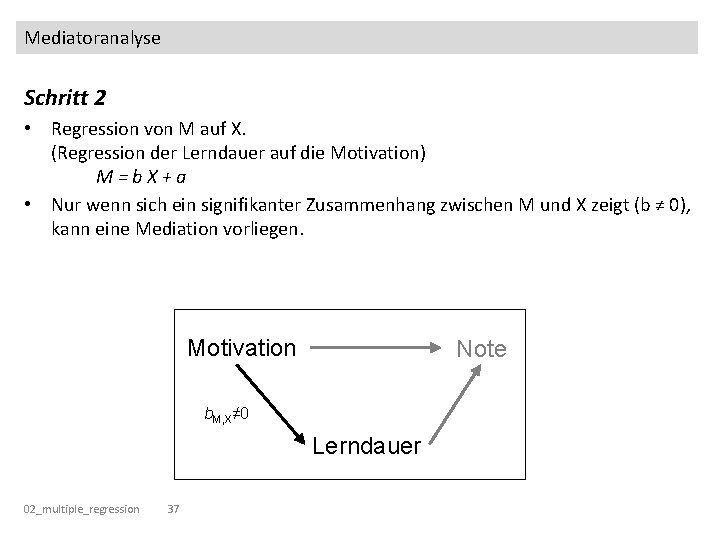

Mediatoranalyse Schritt 2 • Regression von M auf X. (Regression der Lerndauer auf die Motivation) M=b. X+a • Nur wenn sich ein signifikanter Zusammenhang zwischen M und X zeigt (b ≠ 0), kann eine Mediation vorliegen. Motivation Note b. M, X≠ 0 Lerndauer 02_multiple_regression 37

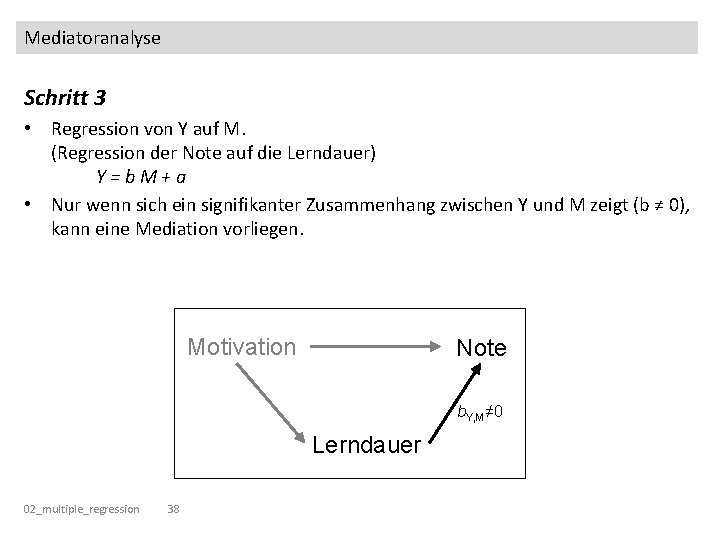

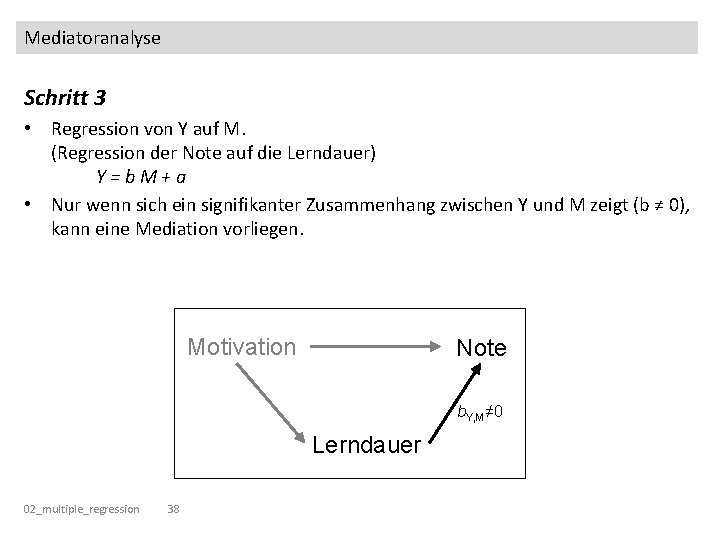

Mediatoranalyse Schritt 3 • Regression von Y auf M. (Regression der Note auf die Lerndauer) Y=b. M+a • Nur wenn sich ein signifikanter Zusammenhang zwischen Y und M zeigt (b ≠ 0), kann eine Mediation vorliegen. Motivation Note b. Y, M≠ 0 Lerndauer 02_multiple_regression 38

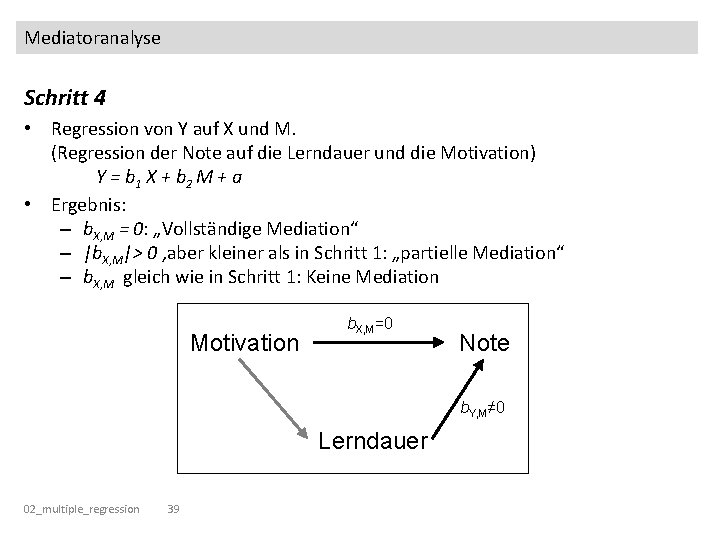

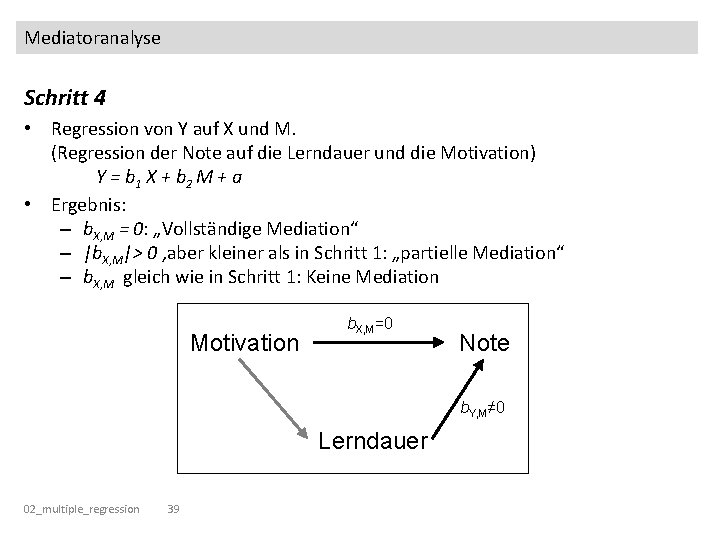

Mediatoranalyse Schritt 4 • Regression von Y auf X und M. (Regression der Note auf die Lerndauer und die Motivation) Y = b 1 X + b 2 M + a • Ergebnis: – b. X, M = 0: „Vollständige Mediation“ – |b. X, M|> 0 , aber kleiner als in Schritt 1: „partielle Mediation“ – b. X, M gleich wie in Schritt 1: Keine Mediation Motivation b. X, M=0 Note b. Y, M≠ 0 Lerndauer 02_multiple_regression 39

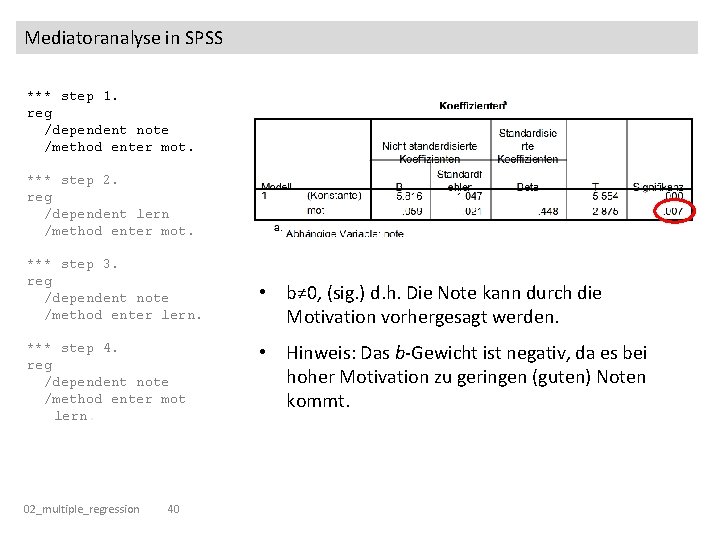

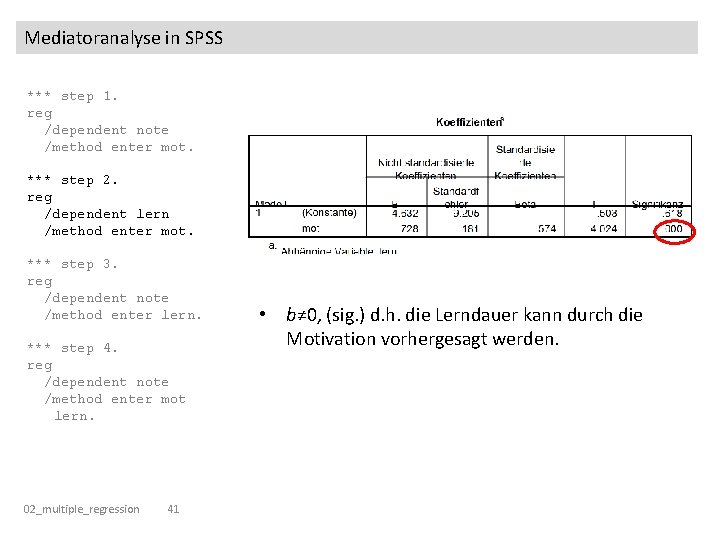

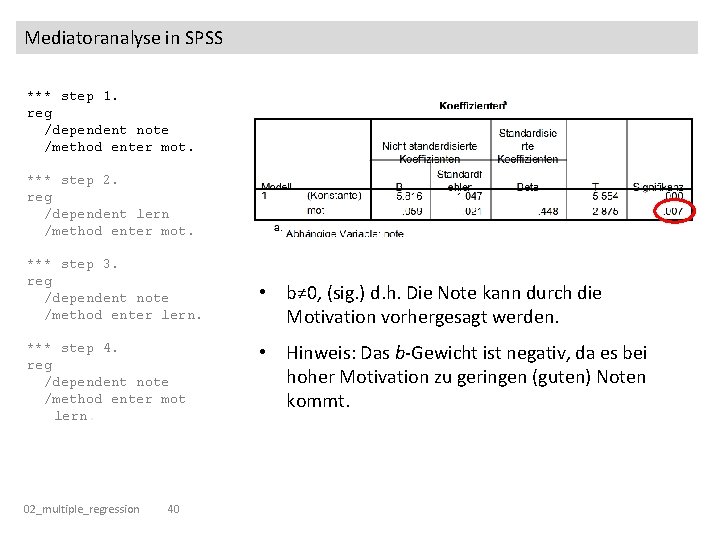

Mediatoranalyse in SPSS *** step 1. reg /dependent note /method enter mot. *** step 2. reg /dependent lern /method enter mot. *** step 3. reg /dependent note /method enter lern. *** step 4. reg /dependent note /method enter mot lern. 02_multiple_regression 40 • b≠ 0, (sig. ) d. h. Die Note kann durch die Motivation vorhergesagt werden. • Hinweis: Das b-Gewicht ist negativ, da es bei hoher Motivation zu geringen (guten) Noten kommt.

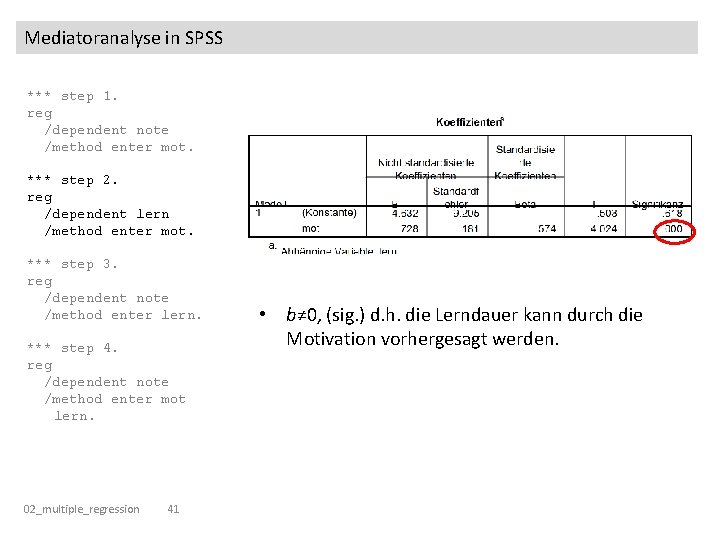

Mediatoranalyse in SPSS *** step 1. reg /dependent note /method enter mot. *** step 2. reg /dependent lern /method enter mot. *** step 3. reg /dependent note /method enter lern. *** step 4. reg /dependent note /method enter mot lern. 02_multiple_regression 41 • b≠ 0, (sig. ) d. h. die Lerndauer kann durch die Motivation vorhergesagt werden.

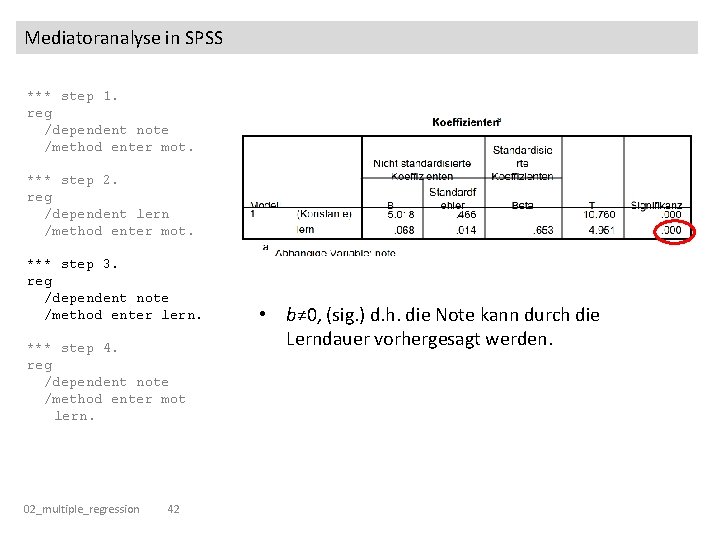

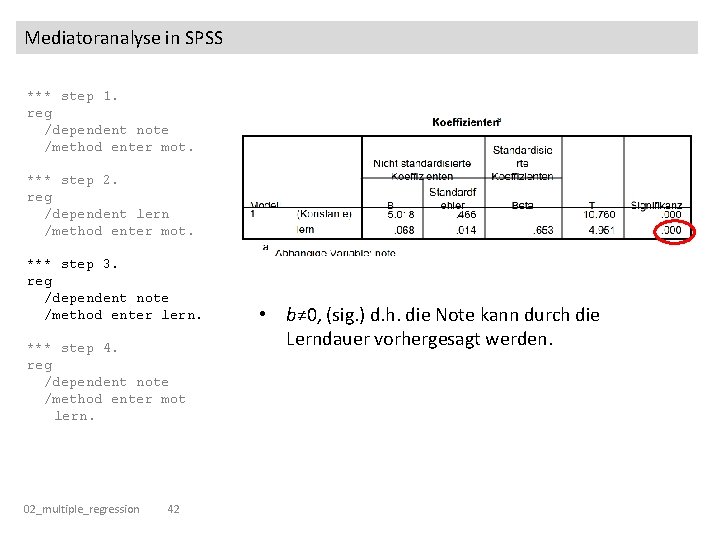

Mediatoranalyse in SPSS *** step 1. reg /dependent note /method enter mot. *** step 2. reg /dependent lern /method enter mot. *** step 3. reg /dependent note /method enter lern. *** step 4. reg /dependent note /method enter mot lern. 02_multiple_regression 42 • b≠ 0, (sig. ) d. h. die Note kann durch die Lerndauer vorhergesagt werden.

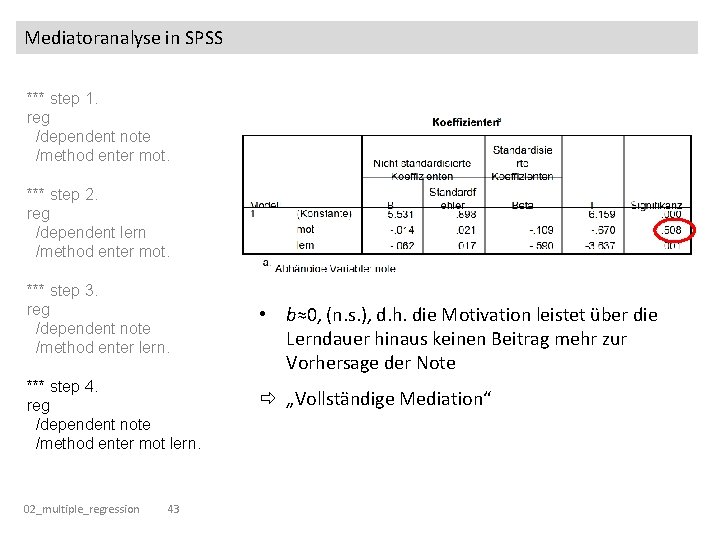

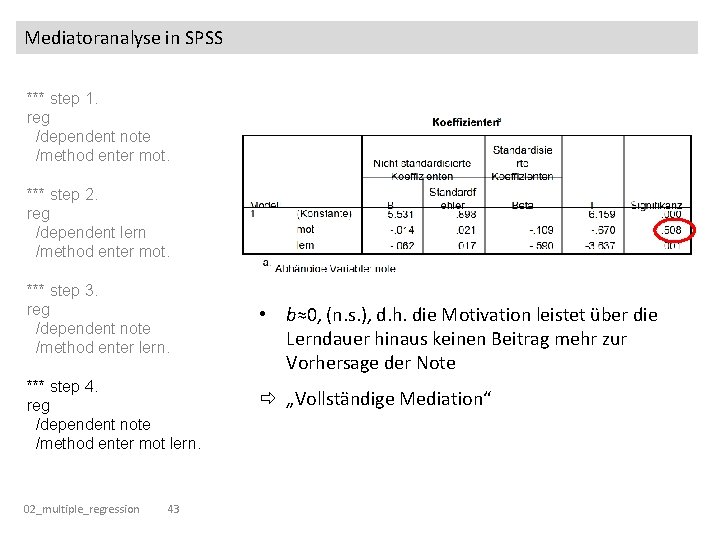

Mediatoranalyse in SPSS *** step 1. reg /dependent note /method enter mot. *** step 2. reg /dependent lern /method enter mot. *** step 3. reg /dependent note /method enter lern. *** step 4. reg /dependent note /method enter mot lern. 02_multiple_regression 43 • b≈0, (n. s. ), d. h. die Motivation leistet über die Lerndauer hinaus keinen Beitrag mehr zur Vorhersage der Note „Vollständige Mediation“

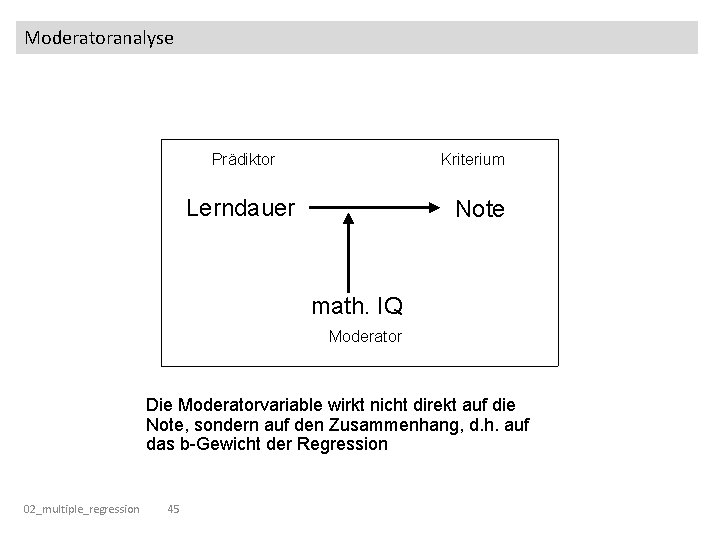

Moderatoranalyse • Fragestellung: „Wird der Zusammenhang von X und Y durch M beeinflusst? “ • Beispiel: „Wird der Zusammenhang von Lerndauer und Note durch mathematische Intelligenz beeinflusst? “ – Hypothese: Die gleiche Lernzeit wirkt sich bei Probanden mit hoher mathematischer Fähigkeit stärker aus als bei Probanden mit geringer mathematischer Fähigkeit. – Im Gegensatz zur Mediatiorvariablen (M) wird nicht angenommen, dass die Moderatorvariable durch die UV (X) beeinflusst wird. 02_multiple_regression 44

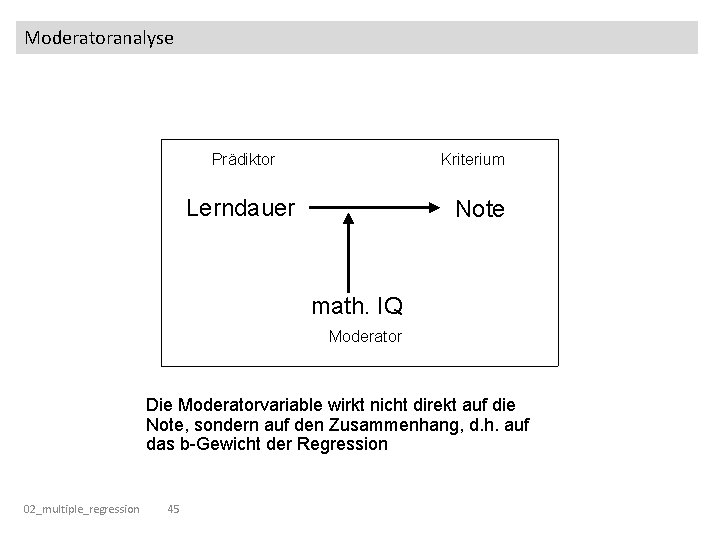

Moderatoranalyse Prädiktor Kriterium Lerndauer Note math. IQ Moderator Die Moderatorvariable wirkt nicht direkt auf die Note, sondern auf den Zusammenhang, d. h. auf das b-Gewicht der Regression 02_multiple_regression 45

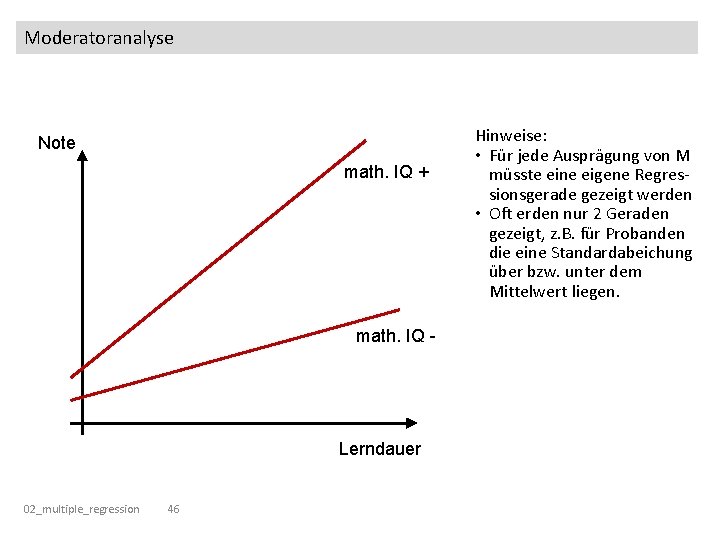

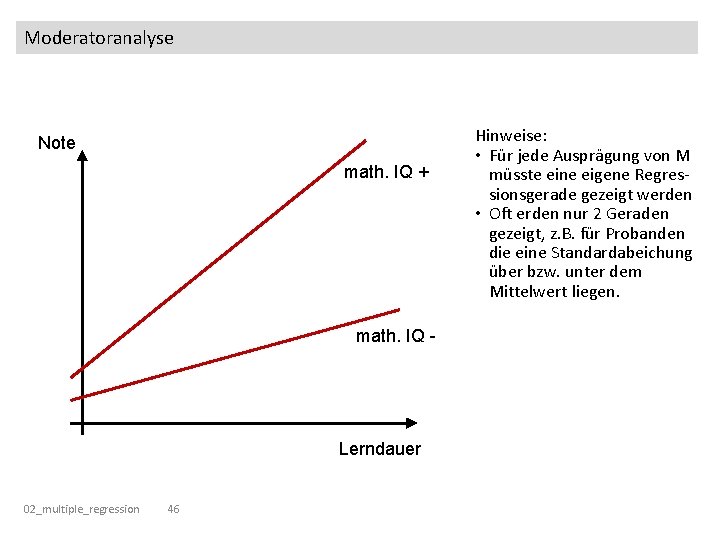

Moderatoranalyse Note math. IQ + math. IQ - Lerndauer 02_multiple_regression 46 Hinweise: • Für jede Ausprägung von M müsste eine eigene Regressionsgerade gezeigt werden • Oft erden nur 2 Geraden gezeigt, z. B. für Probanden die eine Standardabeichung über bzw. unter dem Mittelwert liegen.

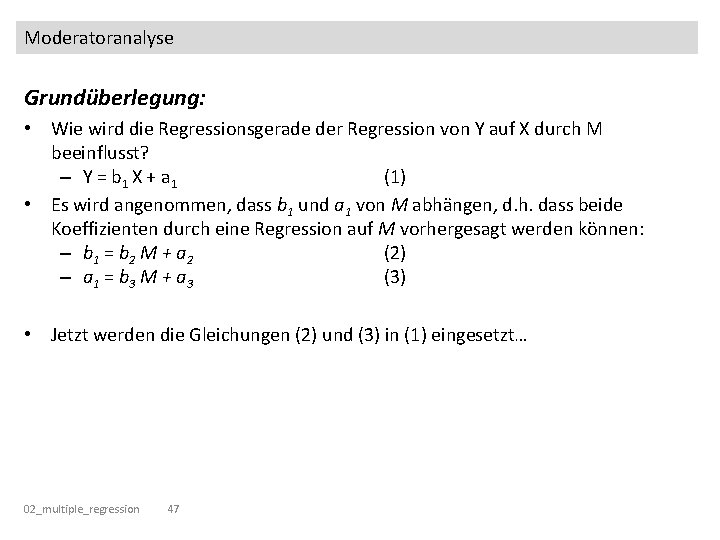

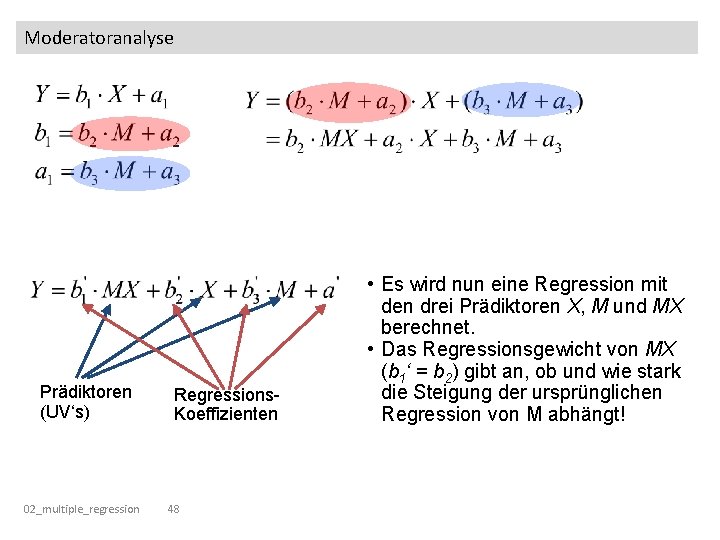

Moderatoranalyse Grundüberlegung: • Wie wird die Regressionsgerade der Regression von Y auf X durch M beeinflusst? – Y = b 1 X + a 1 (1) • Es wird angenommen, dass b 1 und a 1 von M abhängen, d. h. dass beide Koeffizienten durch eine Regression auf M vorhergesagt werden können: – b 1 = b 2 M + a 2 (2) – a 1 = b 3 M + a 3 (3) • Jetzt werden die Gleichungen (2) und (3) in (1) eingesetzt… 02_multiple_regression 47

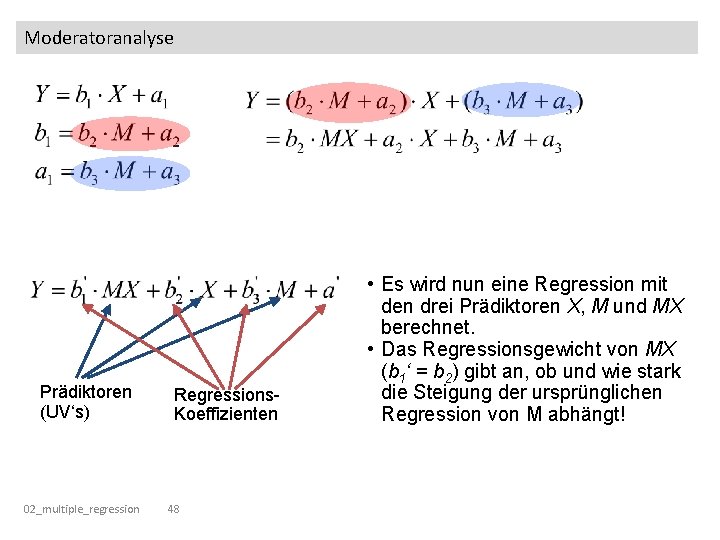

Moderatoranalyse Prädiktoren (UV‘s) 02_multiple_regression Regressions. Koeffizienten 48 • Es wird nun eine Regression mit den drei Prädiktoren X, M und MX berechnet. • Das Regressionsgewicht von MX (b 1‘ = b 2) gibt an, ob und wie stark die Steigung der ursprünglichen Regression von M abhängt!

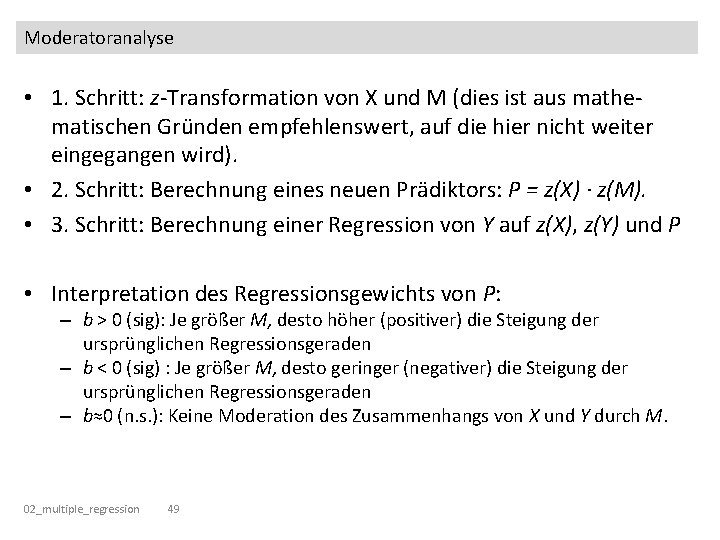

Moderatoranalyse • 1. Schritt: z-Transformation von X und M (dies ist aus mathematischen Gründen empfehlenswert, auf die hier nicht weiter eingegangen wird). • 2. Schritt: Berechnung eines neuen Prädiktors: P = z(X) ∙ z(M). • 3. Schritt: Berechnung einer Regression von Y auf z(X), z(Y) und P • Interpretation des Regressionsgewichts von P: – b > 0 (sig): Je größer M, desto höher (positiver) die Steigung der ursprünglichen Regressionsgeraden – b < 0 (sig) : Je größer M, desto geringer (negativer) die Steigung der ursprünglichen Regressionsgeraden – b≈0 (n. s. ): Keine Moderation des Zusammenhangs von X und Y durch M. 02_multiple_regression 49

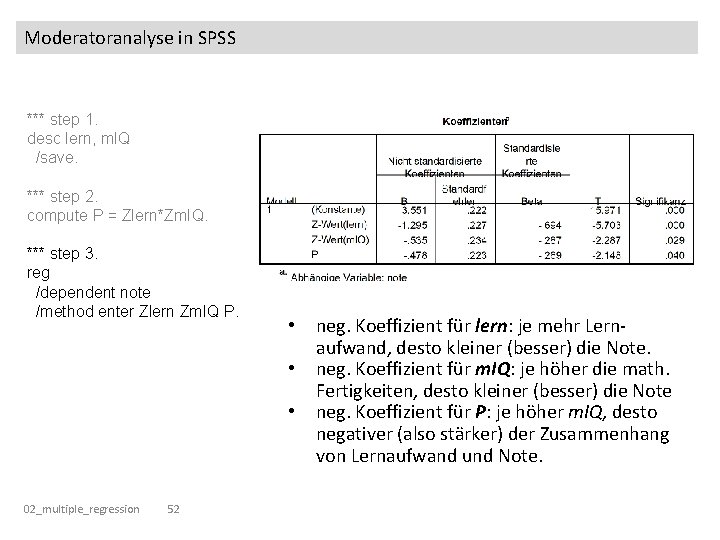

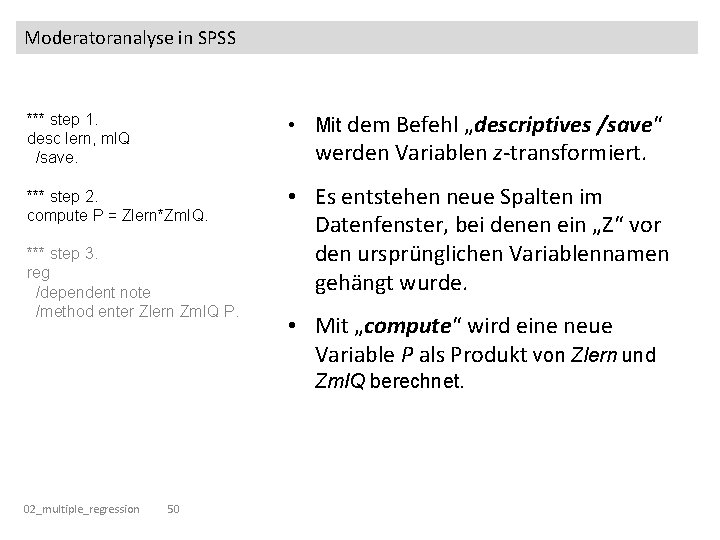

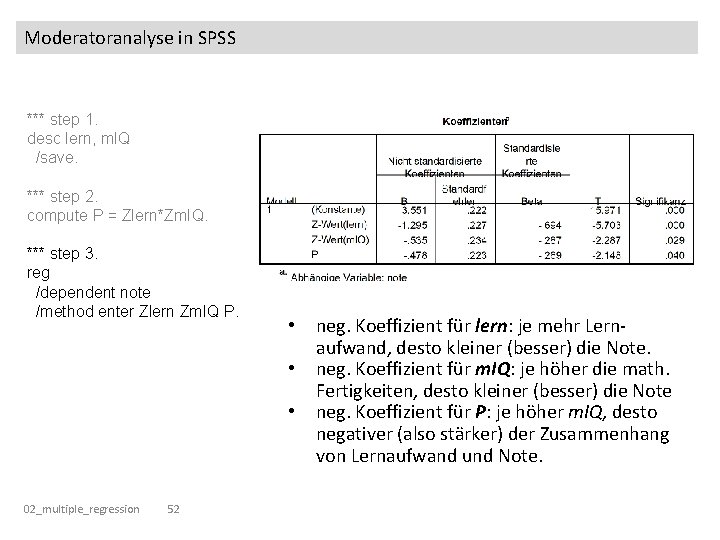

Moderatoranalyse in SPSS *** step 1. desc lern, m. IQ /save. • Mit dem Befehl „descriptives /save“ *** step 2. compute P = Zlern*Zm. IQ. • Es entstehen neue Spalten im Datenfenster, bei denen ein „Z“ vor den ursprünglichen Variablennamen gehängt wurde. werden Variablen z-transformiert. *** step 3. reg /dependent note /method enter Zlern Zm. IQ P. • Mit „compute“ wird eine neue Variable P als Produkt von Zlern und Zm. IQ berechnet. 02_multiple_regression 50

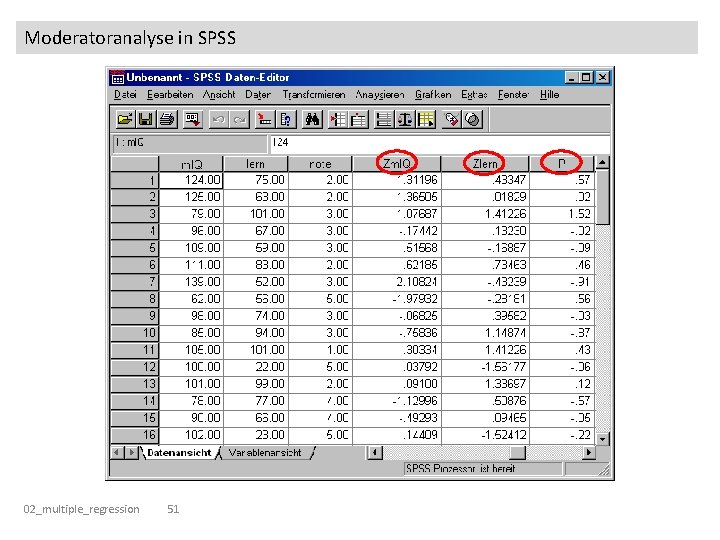

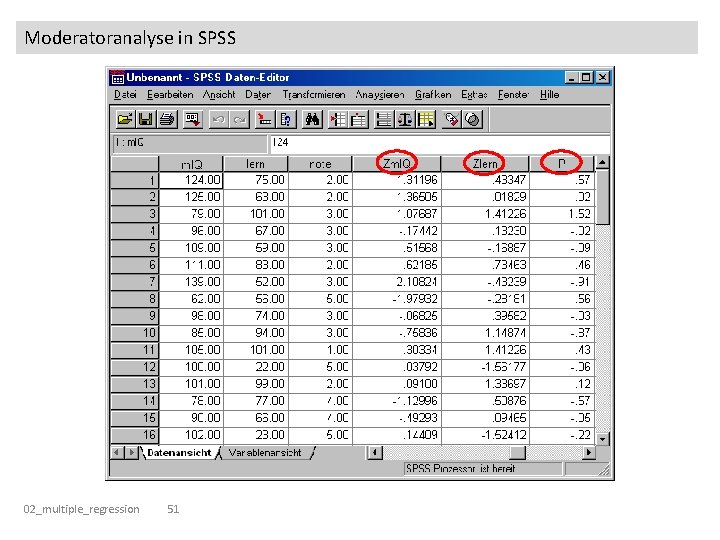

Moderatoranalyse in SPSS 02_multiple_regression 51

Moderatoranalyse in SPSS *** step 1. desc lern, m. IQ /save. *** step 2. compute P = Zlern*Zm. IQ. *** step 3. reg /dependent note /method enter Zlern Zm. IQ P. • • • 02_multiple_regression 52 neg. Koeffizient für lern: je mehr Lernaufwand, desto kleiner (besser) die Note. neg. Koeffizient für m. IQ: je höher die math. Fertigkeiten, desto kleiner (besser) die Note neg. Koeffizient für P: je höher m. IQ, desto negativer (also stärker) der Zusammenhang von Lernaufwand und Note.

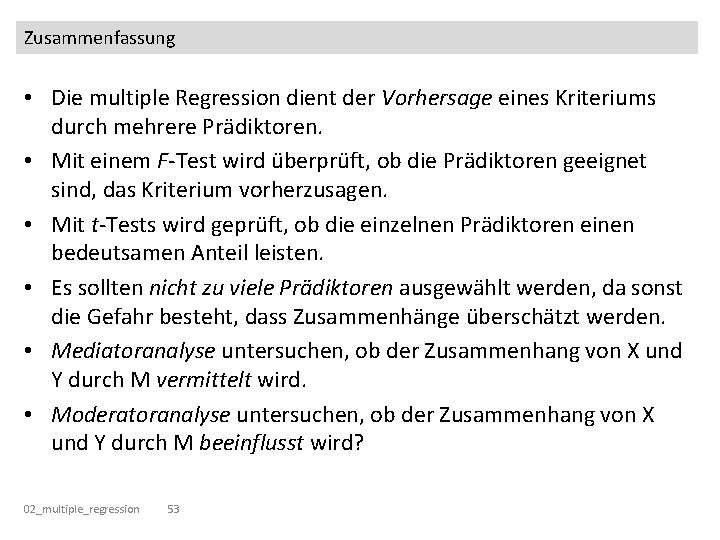

Zusammenfassung • Die multiple Regression dient der Vorhersage eines Kriteriums durch mehrere Prädiktoren. • Mit einem F-Test wird überprüft, ob die Prädiktoren geeignet sind, das Kriterium vorherzusagen. • Mit t-Tests wird geprüft, ob die einzelnen Prädiktoren einen bedeutsamen Anteil leisten. • Es sollten nicht zu viele Prädiktoren ausgewählt werden, da sonst die Gefahr besteht, dass Zusammenhänge überschätzt werden. • Mediatoranalyse untersuchen, ob der Zusammenhang von X und Y durch M vermittelt wird. • Moderatoranalyse untersuchen, ob der Zusammenhang von X und Y durch M beeinflusst wird? 02_multiple_regression 53