Monte Carlo bootstrap jacknife Literatura Bruce Hansen 2012

Monte Carlo, bootstrap, jacknife

Literatura • Bruce Hansen (2012 +) Econometrics, ze strony internetowej: http: //www. ssc. wisc. edu/~bhansen/econometrics/ – Monte Carlo: rozdział 8. 8, 8. 9 – Bootstrap: rozdział 10 • Slajdy 4 -31 wykorzystują materiały z tego podręcznika 2

Literatura • B. Efron (1979) Bootstrap methods: another look at the jackknife, Annals of Statistics 7, 1 -26. • C. F. J. Wu (1986) Jackknife, bootstrap and other resampling methods in regression analysis, Annals of Statistics 14, 1261 -1295. • J. Shao, C. F. J. Wu (1989) A general theory for jackknife variance estimation, Annals of Statistics 17, 1176 -1197. • C. F. J. Wu (1990) On the asymptotic properties of the jacknife histogram, Annals of Statistics 18, 1438 -1452. 3

Monte Carlo • Niech oznaczają obserwacje losowo wybrane z populacji • Niech oznacza parametr, a niech będzie interesującą nas statystyką, np. estymatorem lub statystyką t: 4

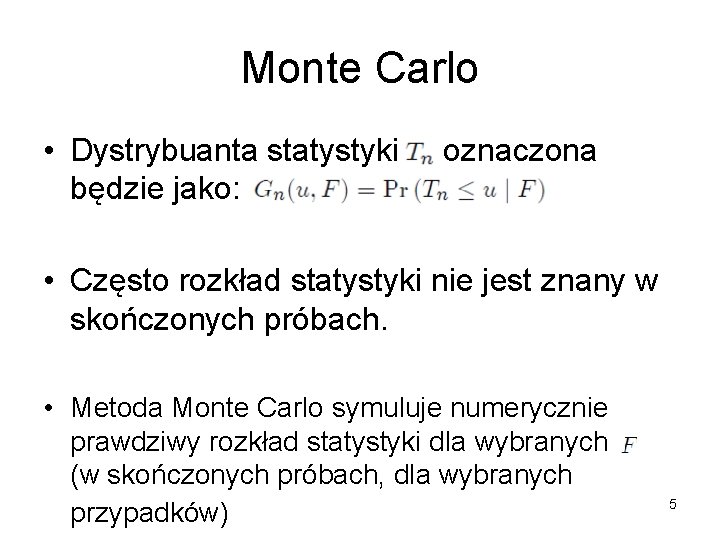

Monte Carlo • Dystrybuanta statystyki będzie jako: oznaczona • Często rozkład statystyki nie jest znany w skończonych próbach. • Metoda Monte Carlo symuluje numerycznie prawdziwy rozkład statystyki dla wybranych (w skończonych próbach, dla wybranych przypadków) 5

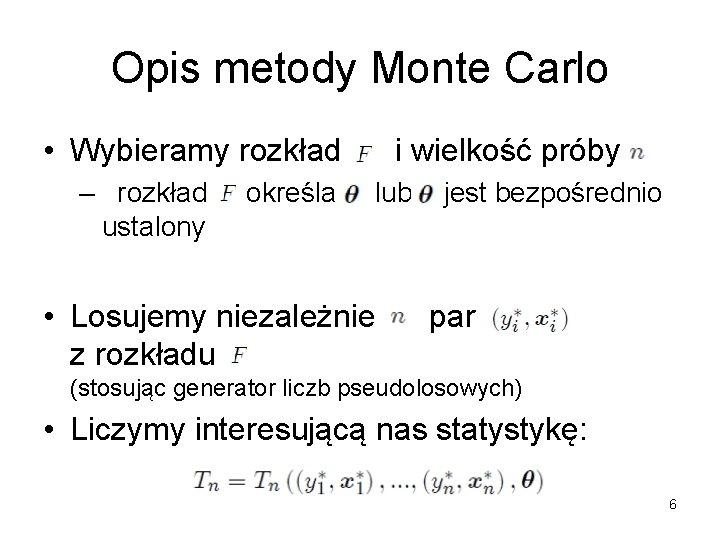

Opis metody Monte Carlo • Wybieramy rozkład – rozkład ustalony określa i wielkość próby lub • Losujemy niezależnie z rozkładu jest bezpośrednio par (stosując generator liczb pseudolosowych) • Liczymy interesującą nas statystykę: 6

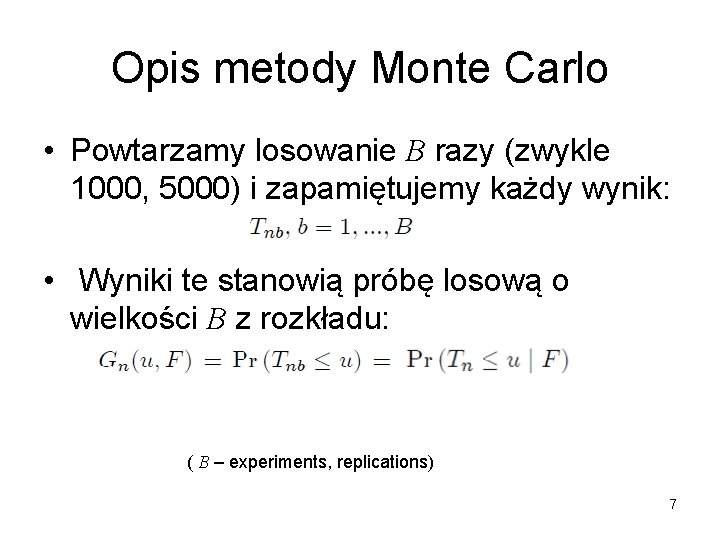

Opis metody Monte Carlo • Powtarzamy losowanie B razy (zwykle 1000, 5000) i zapamiętujemy każdy wynik: • Wyniki te stanowią próbę losową o wielkości B z rozkładu: ( B – experiments, replications) 7

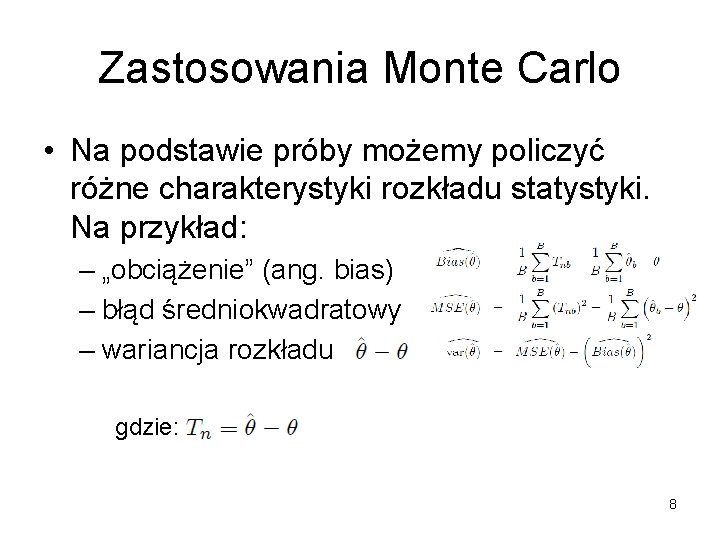

Zastosowania Monte Carlo • Na podstawie próby możemy policzyć różne charakterystyki rozkładu statystyki. Na przykład: – „obciążenie” (ang. bias) – błąd średniokwadratowy – wariancja rozkładu gdzie: 8

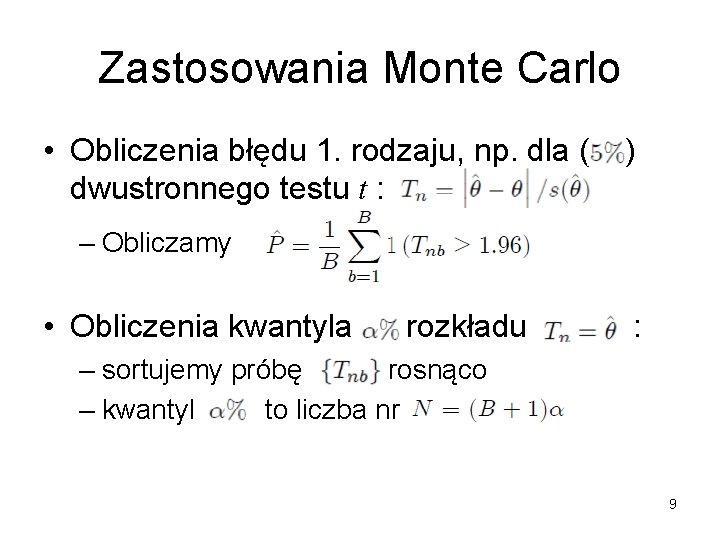

Zastosowania Monte Carlo • Obliczenia błędu 1. rodzaju, np. dla ( dwustronnego testu t : ) – Obliczamy • Obliczenia kwantyla rozkładu : – sortujemy próbę rosnąco – kwantyl to liczba nr 9

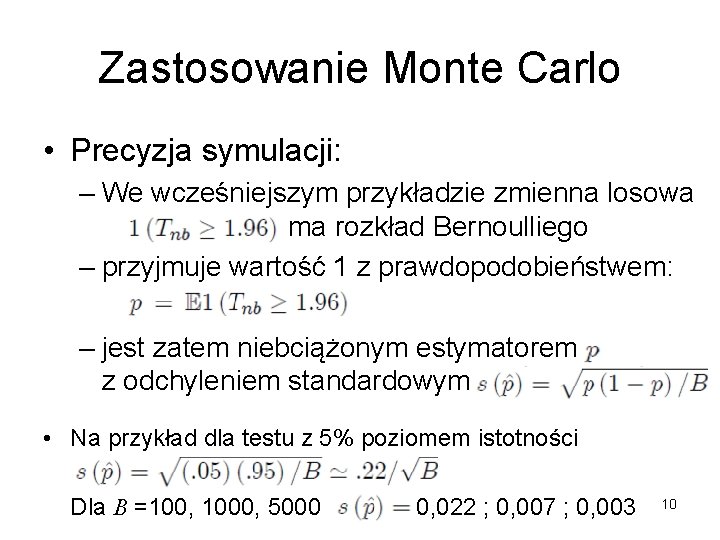

Zastosowanie Monte Carlo • Precyzja symulacji: – We wcześniejszym przykładzie zmienna losowa ma rozkład Bernoulliego – przyjmuje wartość 1 z prawdopodobieństwem: – jest zatem niebciążonym estymatorem z odchyleniem standardowym • Na przykład dla testu z 5% poziomem istotności Dla B =100, 1000, 5000 0, 022 ; 0, 007 ; 0, 003 10

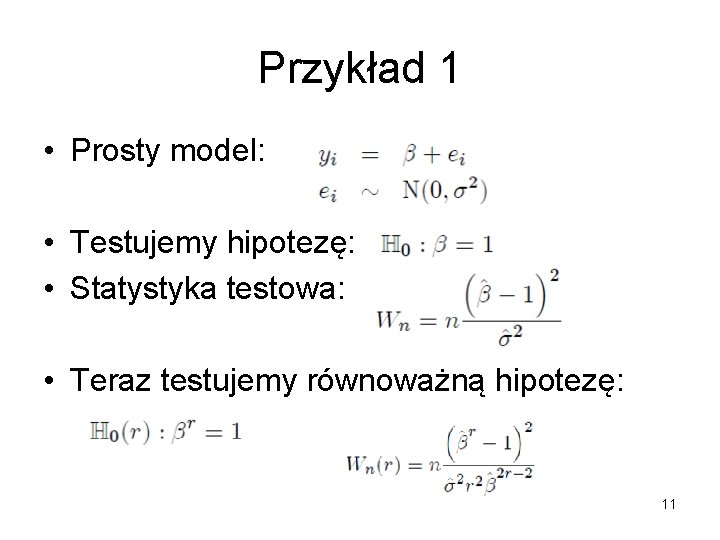

Przykład 1 • Prosty model: • Testujemy hipotezę: • Statystyka testowa: • Teraz testujemy równoważną hipotezę: 11

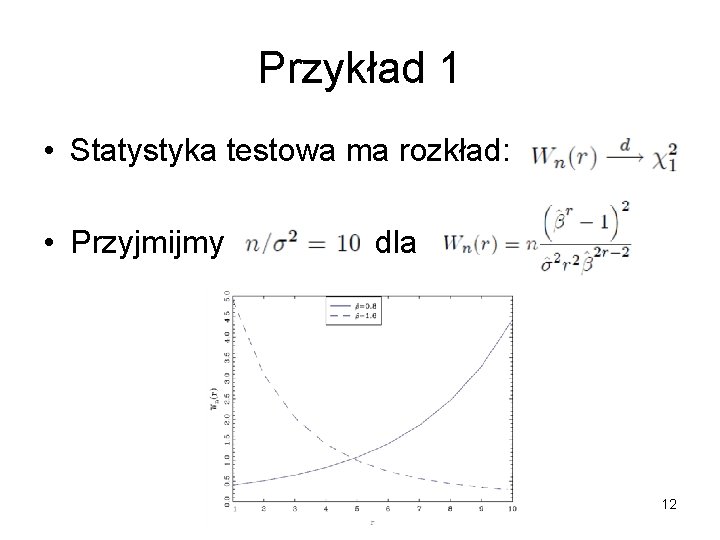

Przykład 1 • Statystyka testowa ma rozkład: • Przyjmijmy dla 12

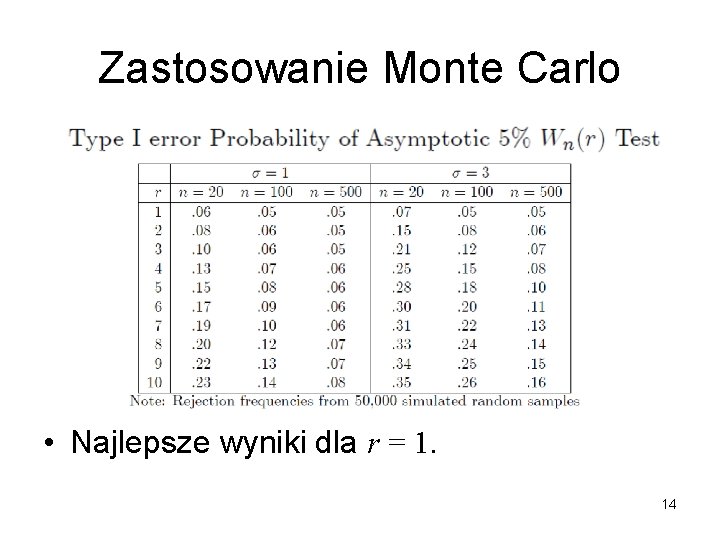

Zastosowanie Monte Carlo • Dla różnych r mamy różne wartości statystyki Walda, a powinny być identyczne, bo hipoteza H 0 jest identyczna, a r wybrane arbitralnie. • Przeanalizujmy symulacyjnie błąd 1. rodzaju: • 50000 wylosowanych prób obserwacji o odpowiedniej długości , odchyleniu stand. parametrze i przy założeniu, że. , 13

Zastosowanie Monte Carlo • Najlepsze wyniki dla r = 1. 14

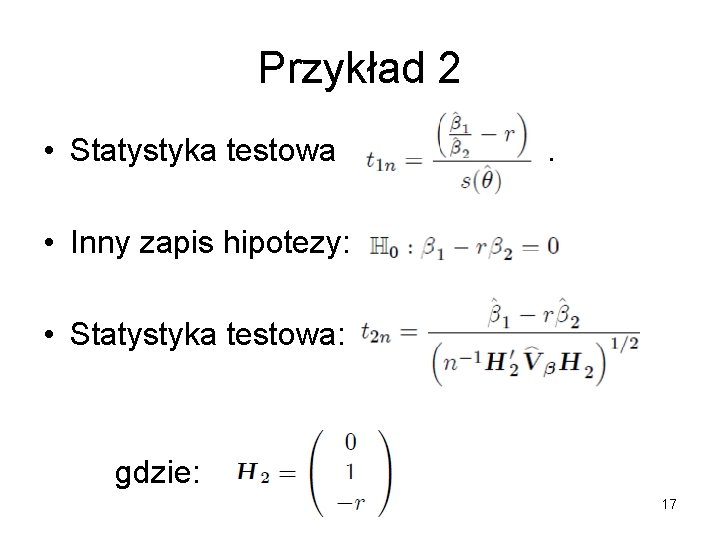

Przykład 2 • Model: • Testujemy hipotezę: • Niech MNK modelu, a będą oszacowaniami wariancją oszacowań. 15

Przykład 2 • Niech. Odchylenie standardowe gdzie: to wektor 16

Przykład 2 • Statystyka testowa . • Inny zapis hipotezy: • Statystyka testowa: gdzie: 17

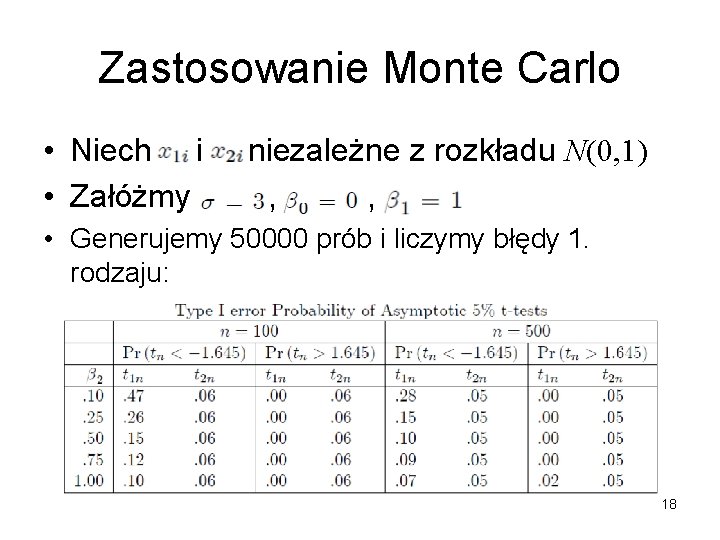

Zastosowanie Monte Carlo • Niech i • Załóżmy niezależne z rozkładu N(0, 1) , , • Generujemy 50000 prób i liczymy błędy 1. rodzaju: 18

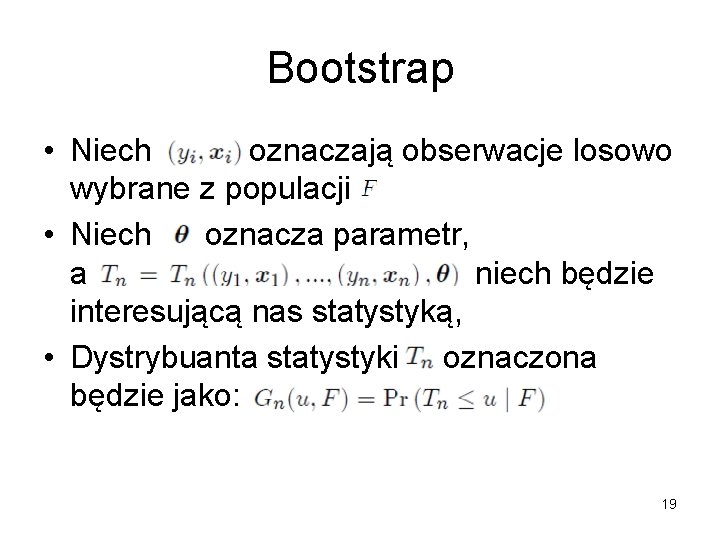

Bootstrap • Niech oznaczają obserwacje losowo wybrane z populacji • Niech oznacza parametr, a niech będzie interesującą nas statystyką, • Dystrybuanta statystyki oznaczona będzie jako: 19

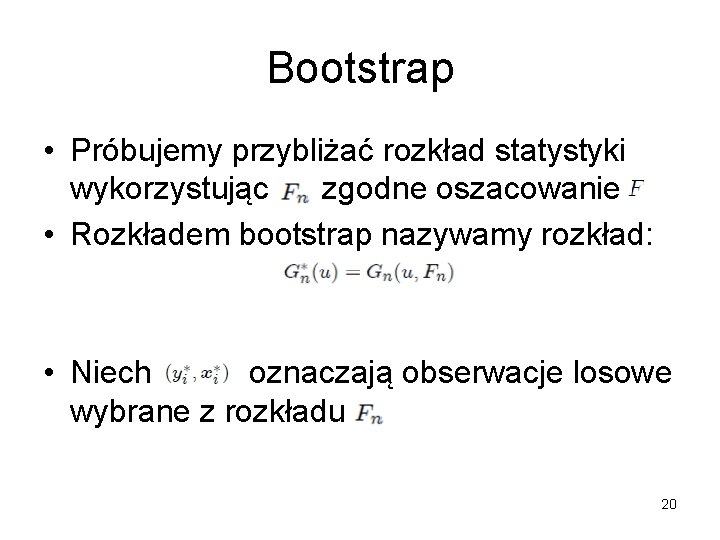

Bootstrap • Próbujemy przybliżać rozkład statystyki wykorzystując zgodne oszacowanie • Rozkładem bootstrap nazywamy rozkład: • Niech oznaczają obserwacje losowe wybrane z rozkładu 20

Bootstrap • Statystyka rozkład , czyli ma (bootstrap statistic) • Rozkład statystyki jest zmienną losową zależną od 21

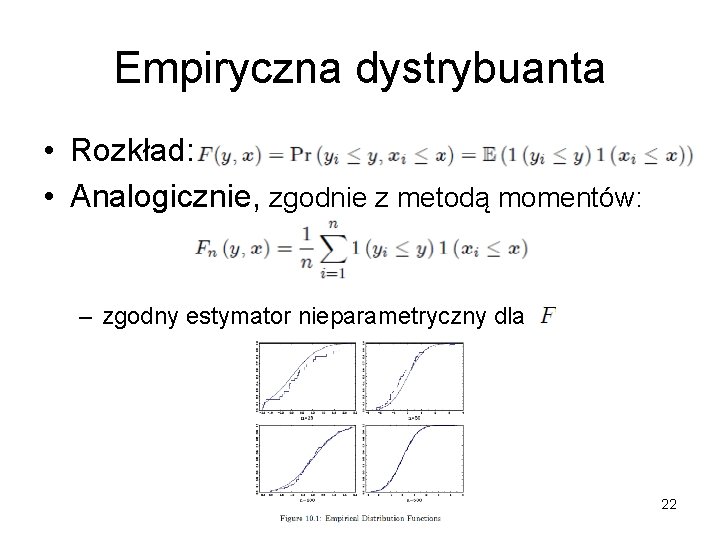

Empiryczna dystrybuanta • Rozkład: • Analogicznie, zgodnie z metodą momentów: – zgodny estymator nieparametryczny dla 22

Bootstrap • Empiryczna dystrybuanta: nieparametryczna metoda bootstrap • Funkcje obserwacji z próby: – średnia z próby empirycznej 23

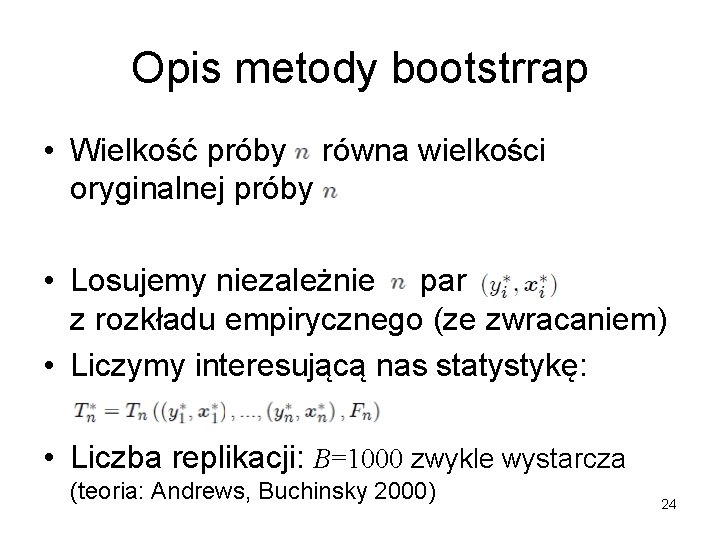

Opis metody bootstrrap • Wielkość próby równa wielkości oryginalnej próby • Losujemy niezależnie par z rozkładu empirycznego (ze zwracaniem) • Liczymy interesującą nas statystykę: • Liczba replikacji: B=1000 zwykle wystarcza (teoria: Andrews, Buchinsky 2000) 24

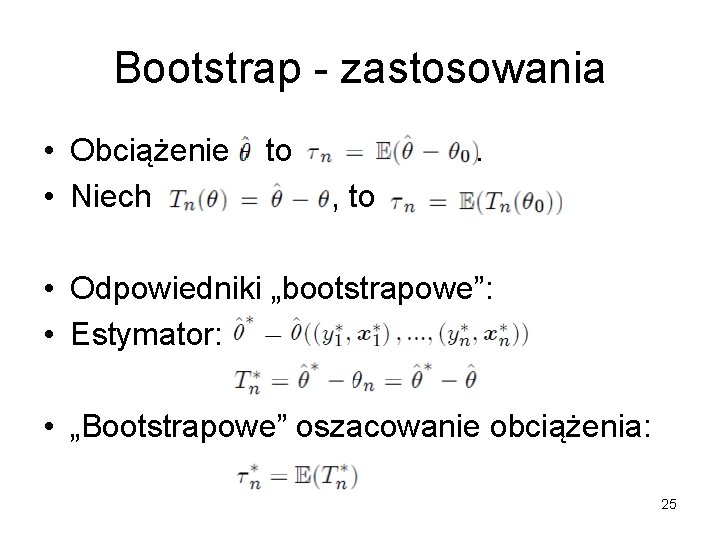

Bootstrap - zastosowania • Obciążenie • Niech to . , to • Odpowiedniki „bootstrapowe”: • Estymator: • „Bootstrapowe” oszacowanie obciążenia: 25

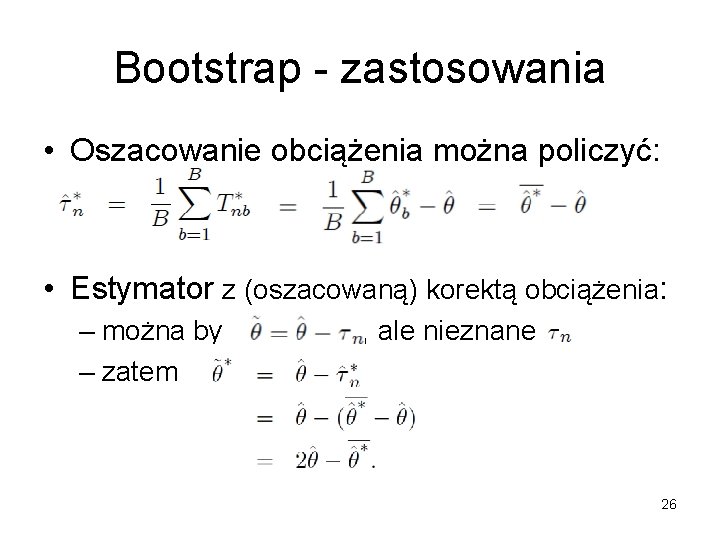

Bootstrap - zastosowania • Oszacowanie obciążenia można policzyć: • Estymator z (oszacowaną) korektą obciążenia: – można by – zatem , ale nieznane 26

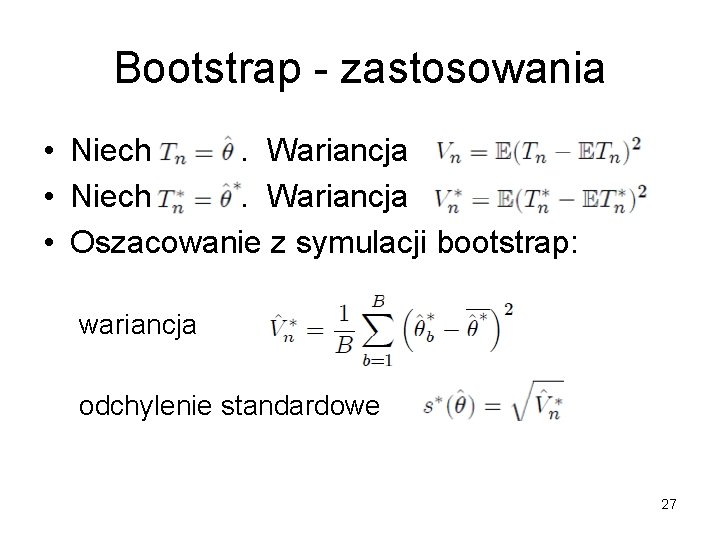

Bootstrap - zastosowania • Niech. Wariancja • Oszacowanie z symulacji bootstrap: wariancja odchylenie standardowe 27

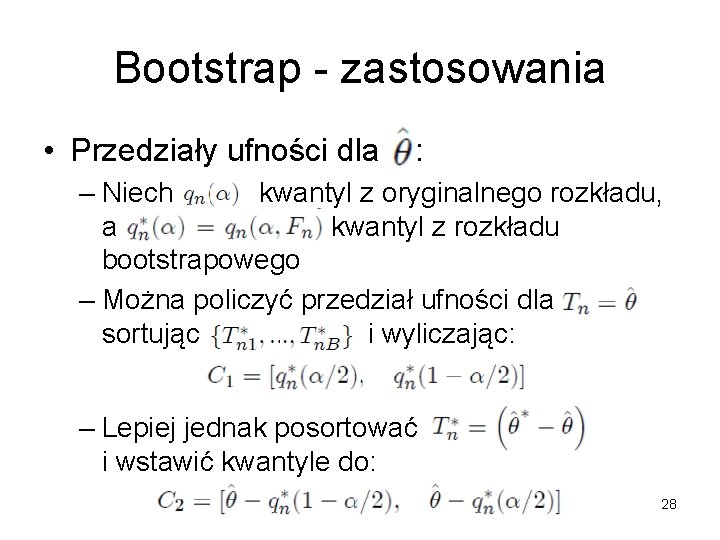

Bootstrap - zastosowania • Przedziały ufności dla : – Niech kwantyl z oryginalnego rozkładu, a kwantyl z rozkładu bootstrapowego – Można policzyć przedział ufności dla sortując i wyliczając: – Lepiej jednak posortować i wstawić kwantyle do: 28

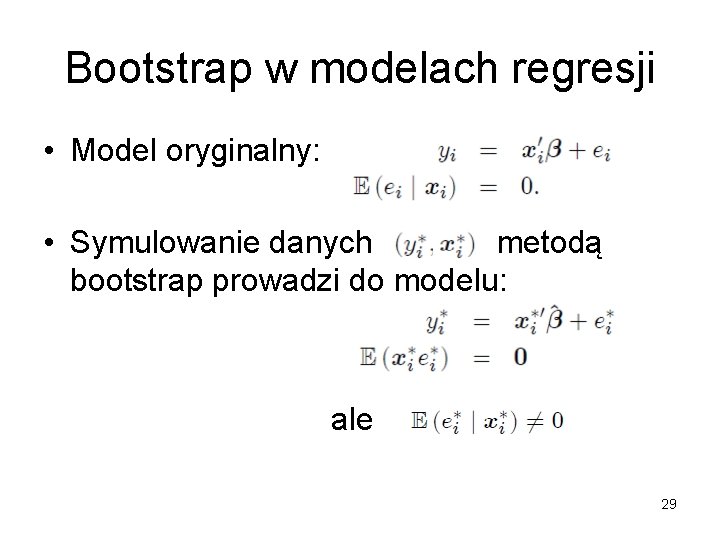

Bootstrap w modelach regresji • Model oryginalny: • Symulowanie danych metodą bootstrap prowadzi do modelu: ale 29

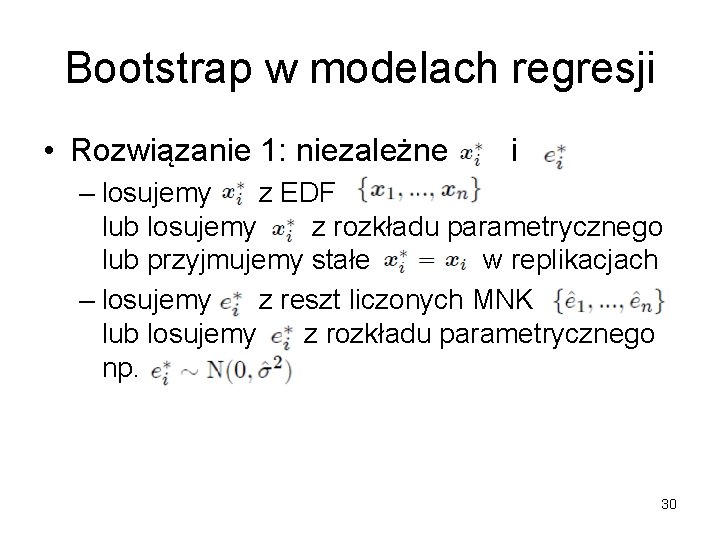

Bootstrap w modelach regresji • Rozwiązanie 1: niezależne i – losujemy z EDF lub losujemy z rozkładu parametrycznego lub przyjmujemy stałe w replikacjach – losujemy z reszt liczonych MNK lub losujemy z rozkładu parametrycznego np. 30

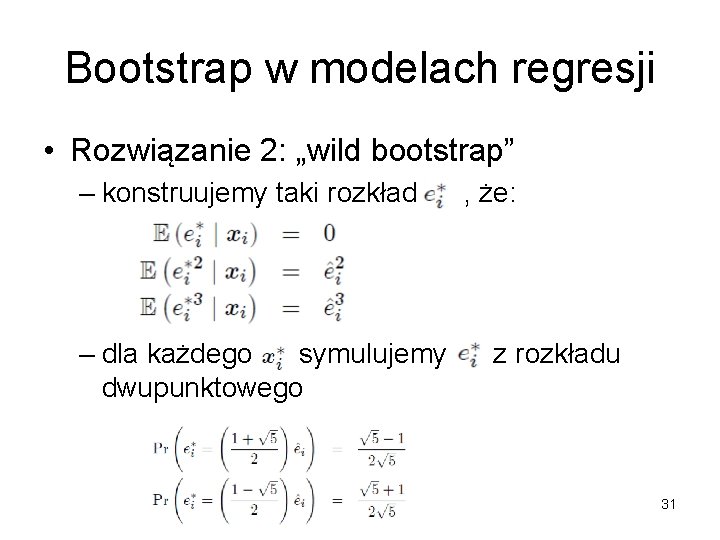

Bootstrap w modelach regresji • Rozwiązanie 2: „wild bootstrap” – konstruujemy taki rozkład – dla każdego symulujemy dwupunktowego , że: z rozkładu 31

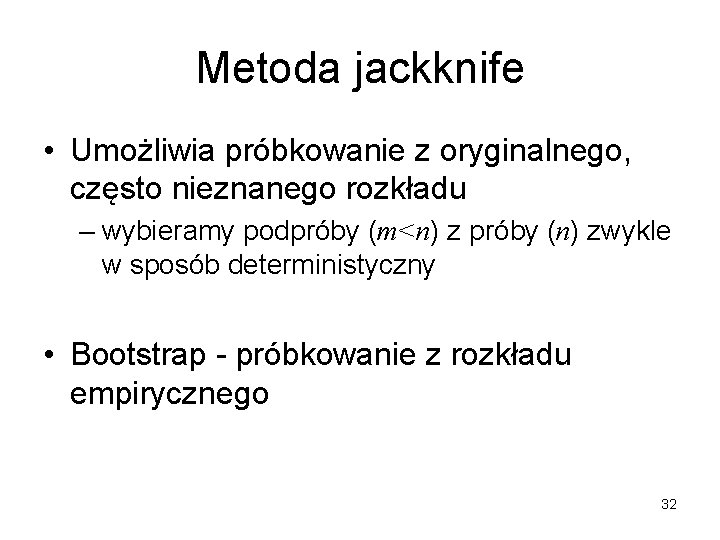

Metoda jackknife • Umożliwia próbkowanie z oryginalnego, często nieznanego rozkładu – wybieramy podpróby (m<n) z próby (n) zwykle w sposób deterministyczny • Bootstrap - próbkowanie z rozkładu empirycznego 32

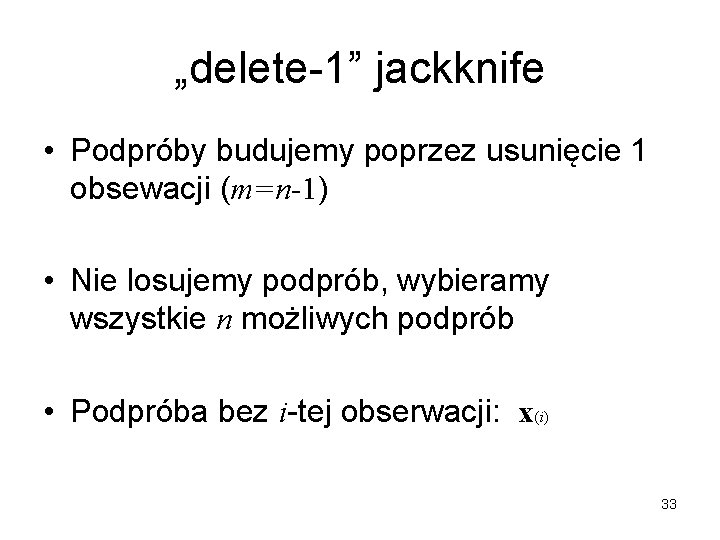

„delete-1” jackknife • Podpróby budujemy poprzez usunięcie 1 obsewacji (m=n-1) • Nie losujemy podprób, wybieramy wszystkie n możliwych podprób • Podpróba bez i-tej obserwacji: x(i) 33

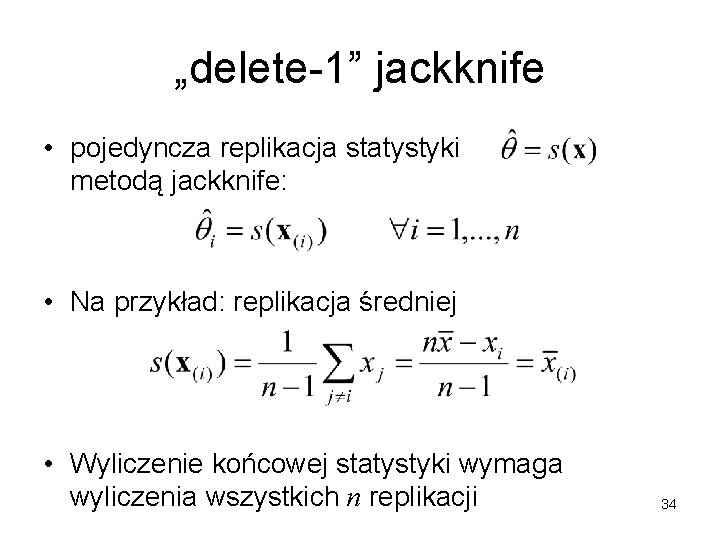

„delete-1” jackknife • pojedyncza replikacja statystyki metodą jackknife: • Na przykład: replikacja średniej • Wyliczenie końcowej statystyki wymaga wyliczenia wszystkich n replikacji 34

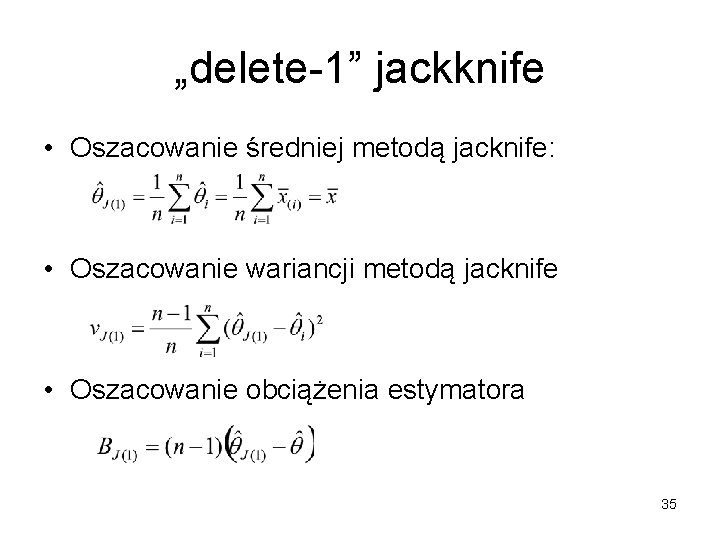

„delete-1” jackknife • Oszacowanie średniej metodą jacknife: • Oszacowanie wariancji metodą jacknife • Oszacowanie obciążenia estymatora 35

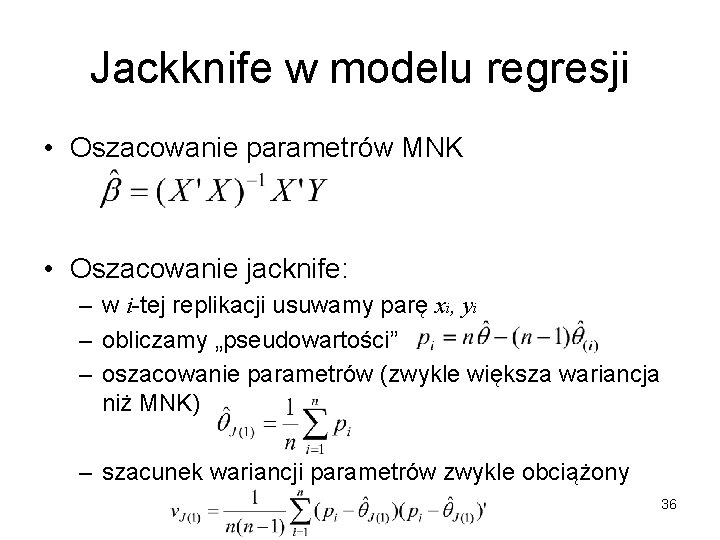

Jackknife w modelu regresji • Oszacowanie parametrów MNK • Oszacowanie jacknife: – w i-tej replikacji usuwamy parę xi, yi – obliczamy „pseudowartości” – oszacowanie parametrów (zwykle większa wariancja niż MNK) – szacunek wariancji parametrów zwykle obciążony 36

Problem • Metoda „delete-1” jackknife nie nadaje się do wyliczania mediany, kwantyli, histogramu – niezgodne i asymptotycznie obciążone oszacowania dla funkcji statystyk niedostatecznie „gładkich” (ang. smooth, gdzie małe zmiany w danych powodują duże zmiany w wartości statystyki) 37

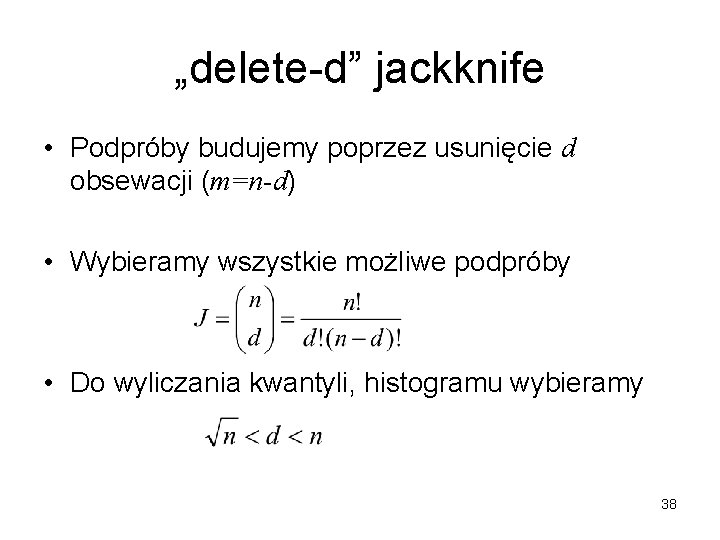

„delete-d” jackknife • Podpróby budujemy poprzez usunięcie d obsewacji (m=n-d) • Wybieramy wszystkie możliwe podpróby • Do wyliczania kwantyli, histogramu wybieramy 38

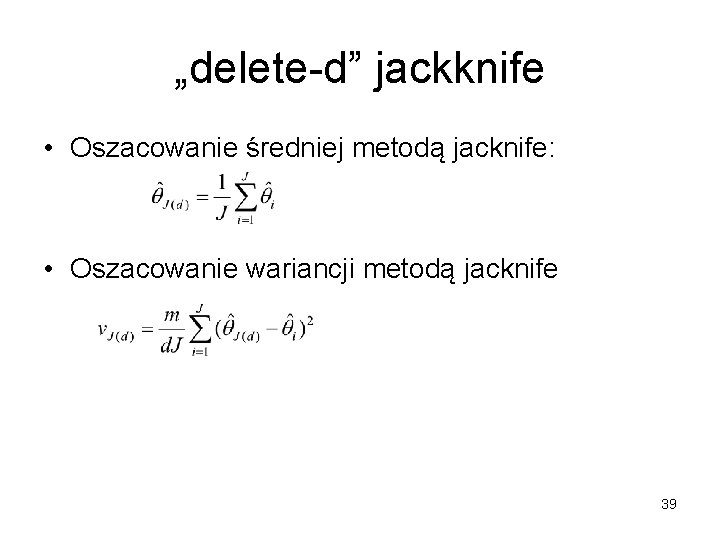

„delete-d” jackknife • Oszacowanie średniej metodą jacknife: • Oszacowanie wariancji metodą jacknife 39

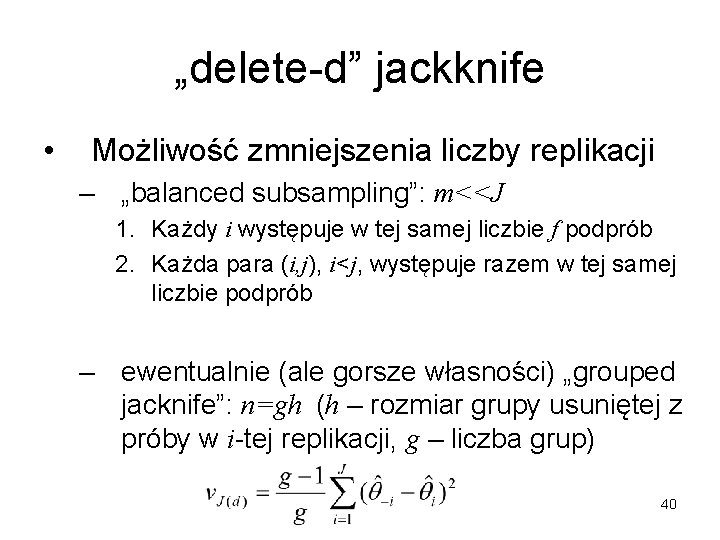

„delete-d” jackknife • Możliwość zmniejszenia liczby replikacji – „balanced subsampling”: m<<J 1. Każdy i występuje w tej samej liczbie f podprób 2. Każda para (i, j), i<j, występuje razem w tej samej liczbie podprób – ewentualnie (ale gorsze własności) „grouped jacknife”: n=gh (h – rozmiar grupy usuniętej z próby w i-tej replikacji, g – liczba grup) 40

- Slides: 40