Mmoires associatives Le modle BSBEidos Mounir Boukadoum Les

Mémoires associatives Le modèle BSB/Eidos Mounir Boukadoum

Les mémoires associatives pourquoi ? § La mémoire est le résultat d’un processus récurrent § Le rappel mnémonique associe un stimulus (clé) et une information emmagasinée § Le processus de mémorisation devrait être non supervisé § Les modèles de mémoires auto et hétéro-associatives sont plus plausibles biologiquement § Le premiers modèles remontent à Kohonen et Anderson (197 x), et Hopfield (1982) ; les titres de noblesse sont dus à Kosko (1986).

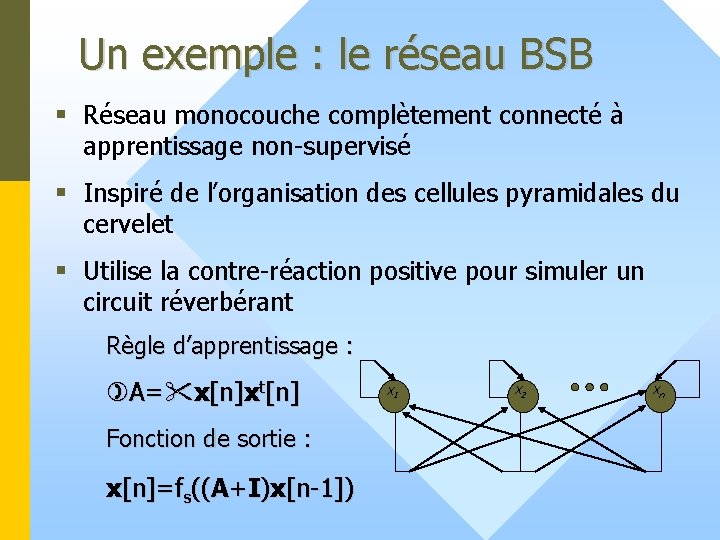

Un exemple : le réseau BSB § Réseau monocouche complètement connecté à apprentissage non-supervisé § Inspiré de l’organisation des cellules pyramidales du cervelet § Utilise la contre-réaction positive pour simuler un circuit réverbérant Règle d’apprentissage : A= x[n]xt[n] Fonction de sortie : x[n]=fs((A+I)x[n-1]) x 1 x 2 xn

![Les vecteurs stimuli x[n] évoluent à l’intérieur d’un hypercube dont les sommets constituent les Les vecteurs stimuli x[n] évoluent à l’intérieur d’un hypercube dont les sommets constituent les](http://slidetodoc.com/presentation_image_h2/2b543c152a991638e5b2dcf05e0a4730/image-4.jpg)

Les vecteurs stimuli x[n] évoluent à l’intérieur d’un hypercube dont les sommets constituent les réponses catégoriques. Fonction de sortie : Xi=fs(ai) ai

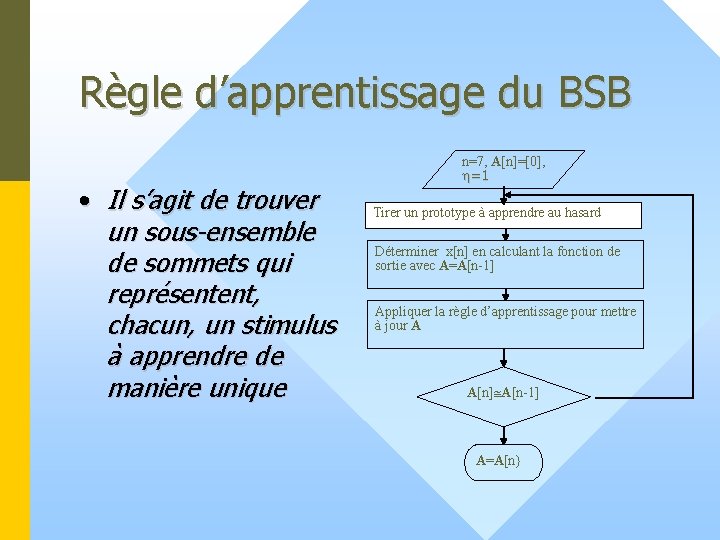

Règle d’apprentissage du BSB • Il s’agit de trouver un sous-ensemble de sommets qui représentent, chacun, un stimulus à apprendre de manière unique n=7, A[n]=[0], =1 Tirer un prototype à apprendre au hasard Déterminer x[n] en calculant la fonction de sortie avec A=A[n-1] Appliquer la règle d’apprentissage pour mettre à jour A A[n] A[n-1] A=A[n}

![Faiblesse du modèle BSB original • Partant de A=0, on a : si xi[0] Faiblesse du modèle BSB original • Partant de A=0, on a : si xi[0]](http://slidetodoc.com/presentation_image_h2/2b543c152a991638e5b2dcf05e0a4730/image-6.jpg)

Faiblesse du modèle BSB original • Partant de A=0, on a : si xi[0] est un vecteur propre de A • Donc, l’apprentissage du réseau consiste à augmenter λi de • Pb : λi croît sans cesse et A ne se stabilisera jamais !

![Le réseau neuronal BSB/Eidos § Règle d’apprentissage : A= x[n]xt[n] - x[p]xt[p] ou x Le réseau neuronal BSB/Eidos § Règle d’apprentissage : A= x[n]xt[n] - x[p]xt[p] ou x](http://slidetodoc.com/presentation_image_h2/2b543c152a991638e5b2dcf05e0a4730/image-7.jpg)

Le réseau neuronal BSB/Eidos § Règle d’apprentissage : A= x[n]xt[n] - x[p]xt[p] ou x 1 x 2 xn f( ) P=2, n=10, = 2, β = 10 -3 § Les i de A se stabilisent à la fin et ses vecteurs propres sont orthogonaux (matrice symétrique) = ( / )2(p-n) -1

Progression de en fonction du nombre d ’essais d ’apprentisage dans le cas d ’ un prototype unique

Échantillonnage dans une grille de 7 x 5 des lettres à reconnaître

Indice de proximité (Corrélation) entre les lettres

Choix des paramètres • Détermination de / qui minimise la période d’apprentissage (n=5, p=10, =0. 001) Nombre d’essais /

Spectre des valeurs propres de A en fonction du nombre d ’essais d ’apprentissage

Temps de rappel pour différents niveaux de bruit

Erreur de rappel pour différents niveaux de bruit

Exemple de rappel (lettre A avec 100% de bruit additif)

Peut-on faire mieux ?

Problèmes avec le modèle BSB • • Sensible aux changements d’échelle Sensible aux translations Sensible aux rotations Limité à la reconnaissance de prototypes binaires La Solution passe par des matrices de grandes dimensions (12 X 12 et plus) => Pas pratique pour la reconnaissance en temps réel.

- Slides: 17