Lo que nos cuentan las palabras cuando las

Lo que nos cuentan las palabras cuando las contamos Sergio Jiménez, Ph. D. sergio. jimenez@caroycuervo. gov. co goo. gl/KR 7 DYr 1

El Instituto Caro y Cuervo “La casa de las palabras” • Lingüística • Español en Colombia • Español como lengua extranjera • Lenguas indígenas, criollas, señas y romaní. • Lexicografía • Fonología • Lingüística de corpus y computacional • Literatura comparada • Memoria, crónica y literatura • Libro en Colombia goo. gl/KR 7 DYr 2 sergio. jimenez@caroycuervo. gov. co

Agenda Pointwise Mutual Information (PMI) Neural Word Embeddings (word 2 vec, Glo. Ve) Similitud de palabras translingual Hillbert-Schmidt Independence Criterion (HSIC) • Word. Net • • goo. gl/KR 7 DYr 3 sergio. jimenez@caroycuervo. gov. co

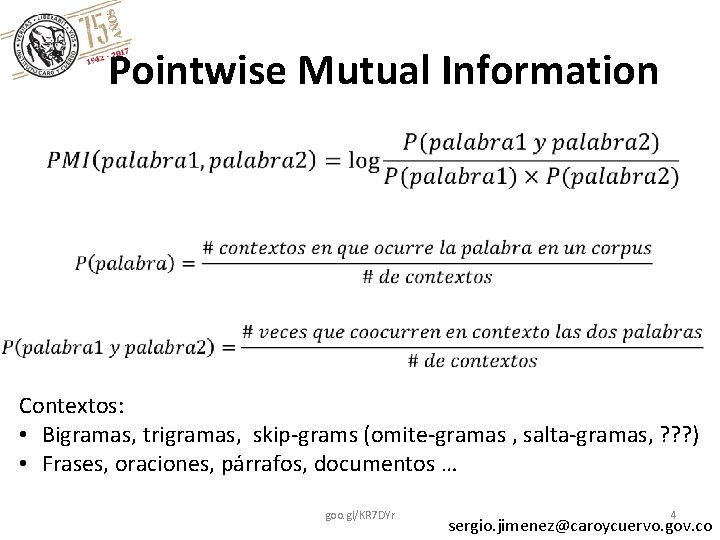

Pointwise Mutual Information Contextos: • Bigramas, trigramas, skip-grams (omite-gramas , salta-gramas, ? ? ? ) • Frases, oraciones, párrafos, documentos … goo. gl/KR 7 DYr 4 sergio. jimenez@caroycuervo. gov. co

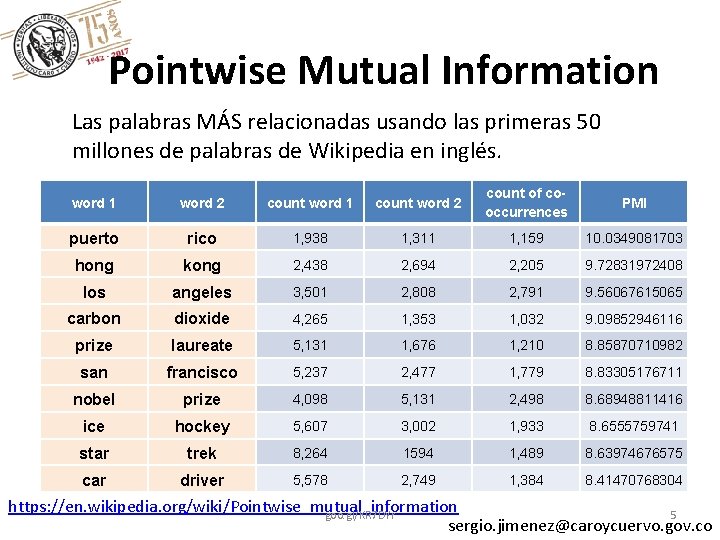

Pointwise Mutual Information Las palabras MÁS relacionadas usando las primeras 50 millones de palabras de Wikipedia en inglés. word 1 word 2 count word 1 count word 2 count of cooccurrences PMI puerto rico 1, 938 1, 311 1, 159 10. 0349081703 hong kong 2, 438 2, 694 2, 205 9. 72831972408 los angeles 3, 501 2, 808 2, 791 9. 56067615065 carbon dioxide 4, 265 1, 353 1, 032 9. 09852946116 prize laureate 5, 131 1, 676 1, 210 8. 85870710982 san francisco 5, 237 2, 477 1, 779 8. 83305176711 nobel prize 4, 098 5, 131 2, 498 8. 68948811416 ice hockey 5, 607 3, 002 1, 933 8. 6555759741 star trek 8, 264 1594 1, 489 8. 63974676575 car driver 5, 578 2, 749 1, 384 8. 41470768304 https: //en. wikipedia. org/wiki/Pointwise_mutual_information 5 goo. gl/KR 7 DYr sergio. jimenez@caroycuervo. gov. co

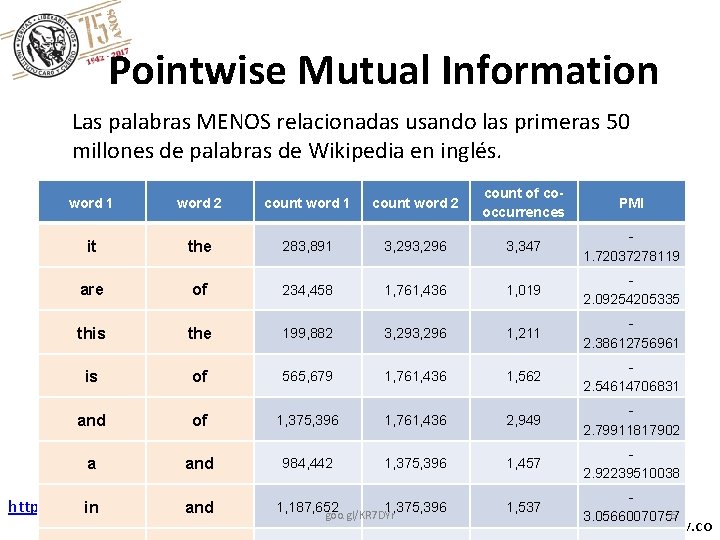

Pointwise Mutual Information Las palabras MENOS relacionadas usando las primeras 50 millones de palabras de Wikipedia en inglés. word 1 word 2 count word 1 count word 2 count of cooccurrences PMI it the 283, 891 3, 296 3, 347 1. 72037278119 are of 234, 458 1, 761, 436 1, 019 2. 09254205335 this the 199, 882 3, 296 1, 211 2. 38612756961 is of 565, 679 1, 761, 436 1, 562 2. 54614706831 and of 1, 375, 396 1, 761, 436 2, 949 2. 79911817902 a and 984, 442 1, 375, 396 1, 457 2. 92239510038 - 1, 187, 652 1, 375, 396 1, 537 https: //en. wikipedia. org/wiki/Pointwise_mutual_information in and 6 goo. gl/KR 7 DYr 3. 05660070757 sergio. jimenez@caroycuervo. gov. co

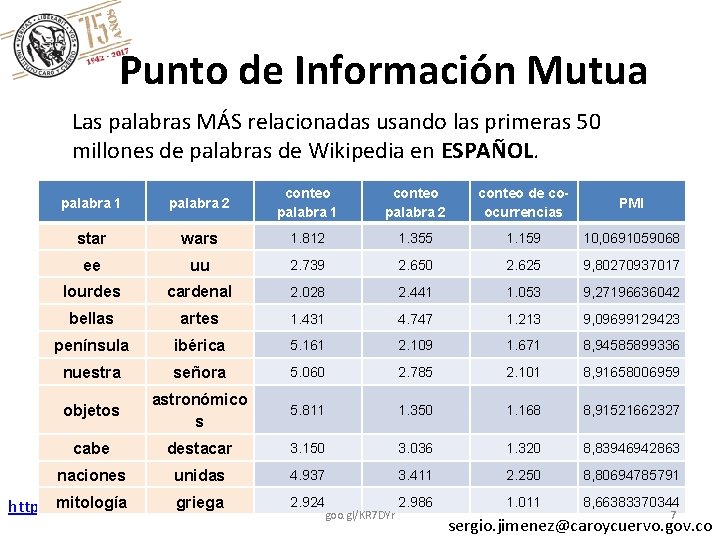

Punto de Información Mutua Las palabras MÁS relacionadas usando las primeras 50 millones de palabras de Wikipedia en ESPAÑOL. palabra 1 palabra 2 conteo palabra 1 conteo palabra 2 conteo de coocurrencias PMI star wars 1. 812 1. 355 1. 159 10, 0691059068 ee uu 2. 739 2. 650 2. 625 9, 80270937017 lourdes cardenal 2. 028 2. 441 1. 053 9, 27196636042 bellas artes 1. 431 4. 747 1. 213 9, 09699129423 península ibérica 5. 161 2. 109 1. 671 8, 94585899336 nuestra señora 5. 060 2. 785 2. 101 8, 91658006959 objetos astronómico s 5. 811 1. 350 1. 168 8, 91521662327 cabe destacar 3. 150 3. 036 1. 320 8, 83946942863 naciones unidas 4. 937 3. 411 2. 250 8, 80694785791 2. 924 2. 986 1. 011 8, 66383370344 mitología griega https: //es. wikipedia. org/wiki/Punto_de_informaci%C 3%B 3 n_mutua 7 goo. gl/KR 7 DYr sergio. jimenez@caroycuervo. gov. co

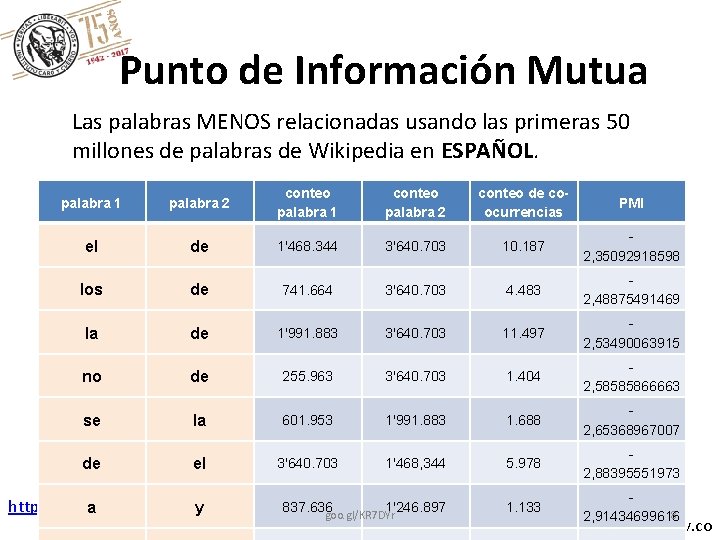

Punto de Información Mutua Las palabras MENOS relacionadas usando las primeras 50 millones de palabras de Wikipedia en ESPAÑOL. palabra 1 palabra 2 conteo palabra 1 conteo palabra 2 conteo de coocurrencias PMI el de 1'468. 344 3'640. 703 10. 187 2, 35092918598 los de 741. 664 3'640. 703 4. 483 2, 48875491469 la de 1'991. 883 3'640. 703 11. 497 2, 53490063915 no de 255. 963 3'640. 703 1. 404 2, 58585866663 se la 601. 953 1'991. 883 1. 688 2, 65368967007 de el 3'640. 703 1'468, 344 5. 978 2, 88395551973 - 837. 636 1'246. 897 1. 133 https: //es. wikipedia. org/wiki/Punto_de_informaci%C 3%B 3 n_mutua a y 8 goo. gl/KR 7 DYr 2, 91434699616 sergio. jimenez@caroycuervo. gov. co

Agenda Pointwise Mutual Information (PMI) Neural word Embeddings (word 2 vec, Glo. Ve) Similitud de palabras translingual Hillbert-Schmidt Independence Criterion (HSIC) • Word. Net • • goo. gl/KR 7 DYr 9 sergio. jimenez@caroycuervo. gov. co

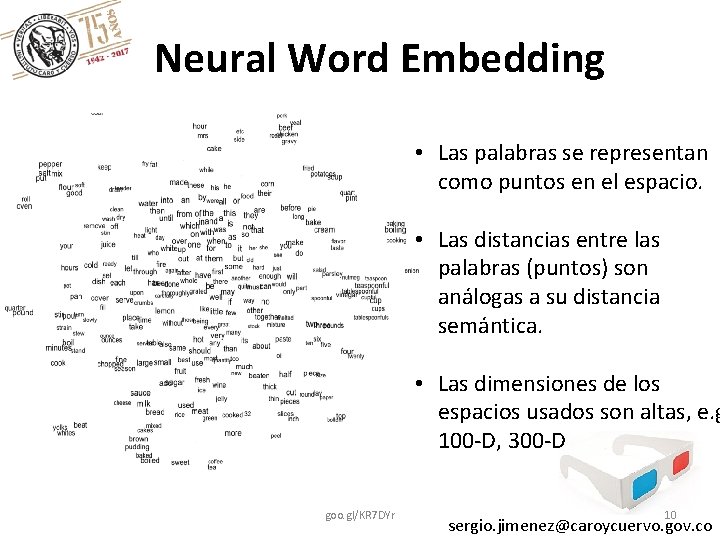

Neural Word Embedding • Las palabras se representan como puntos en el espacio. • Las distancias entre las palabras (puntos) son análogas a su distancia semántica. • Las dimensiones de los espacios usados son altas, e. g 100 -D, 300 -D goo. gl/KR 7 DYr 10 sergio. jimenez@caroycuervo. gov. co

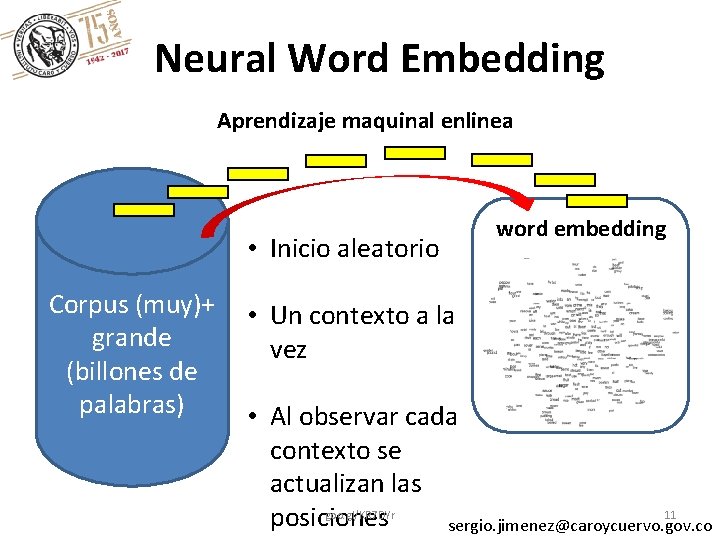

Neural Word Embedding Aprendizaje maquinal enlinea • Inicio aleatorio word embedding Corpus (muy)+ • Un contexto a la grande vez (billones de palabras) • Al observar cada contexto se actualizan las 11 goo. gl/KR 7 DYr posiciones sergio. jimenez@caroycuervo. gov. co

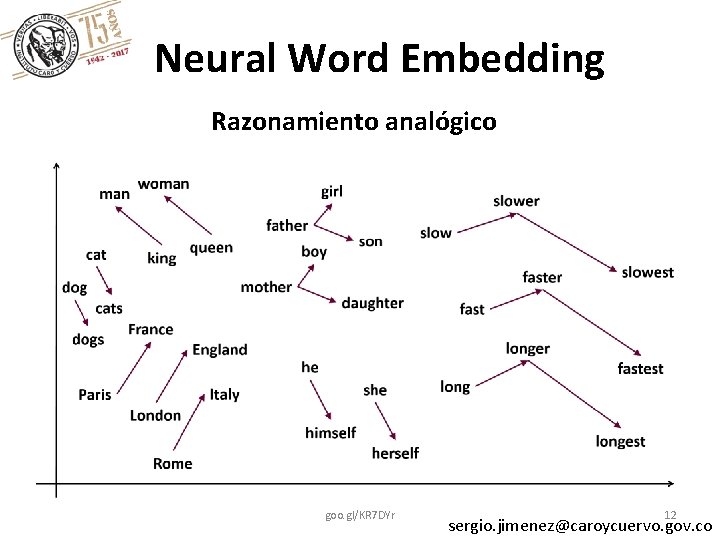

Neural Word Embedding Razonamiento analógico goo. gl/KR 7 DYr 12 sergio. jimenez@caroycuervo. gov. co

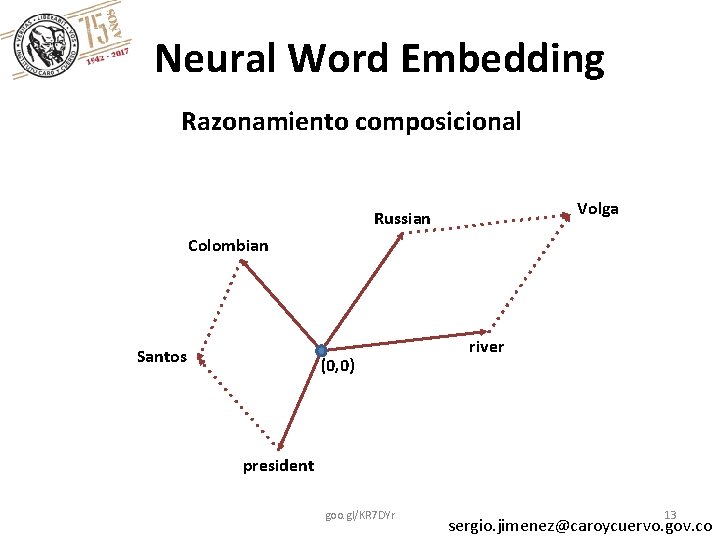

Neural Word Embedding Razonamiento composicional Volga Russian Colombian Santos (0, 0) river president goo. gl/KR 7 DYr 13 sergio. jimenez@caroycuervo. gov. co

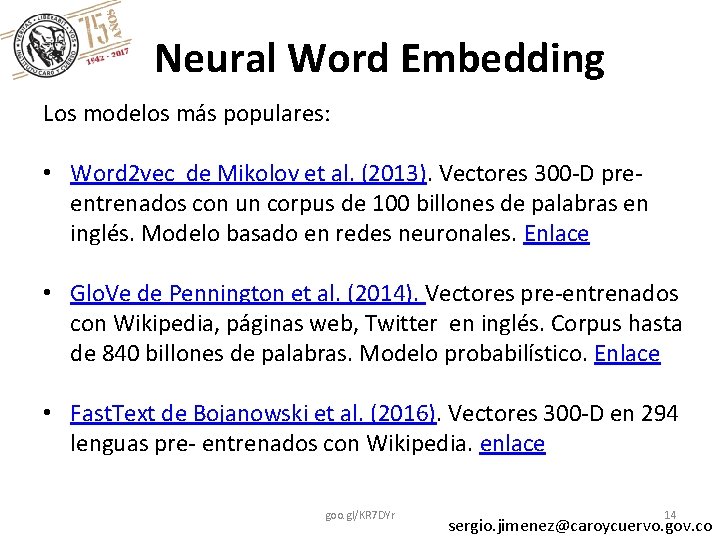

Neural Word Embedding Los modelos más populares: • Word 2 vec de Mikolov et al. (2013). Vectores 300 -D preentrenados con un corpus de 100 billones de palabras en inglés. Modelo basado en redes neuronales. Enlace • Glo. Ve de Pennington et al. (2014). Vectores pre-entrenados con Wikipedia, páginas web, Twitter en inglés. Corpus hasta de 840 billones de palabras. Modelo probabilístico. Enlace • Fast. Text de Bojanowski et al. (2016). Vectores 300 -D en 294 lenguas pre- entrenados con Wikipedia. enlace goo. gl/KR 7 DYr 14 sergio. jimenez@caroycuervo. gov. co

https: //www. datos. gov. co goo. gl/KR 7 DYr 15

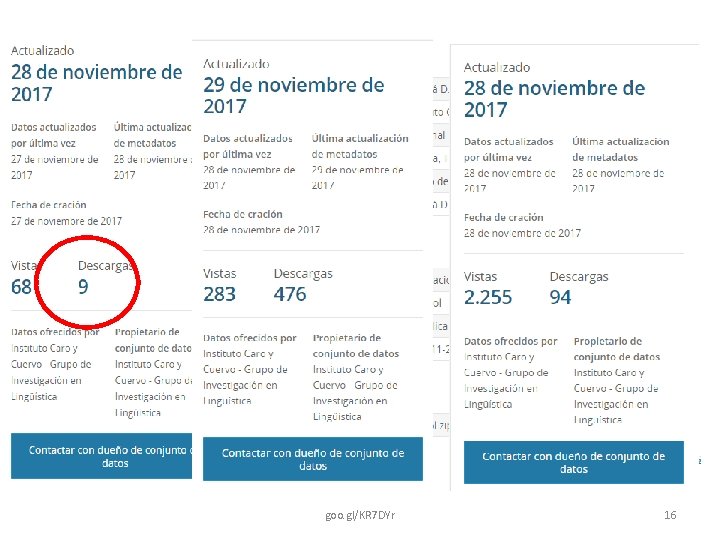

goo. gl/KR 7 DYr 16

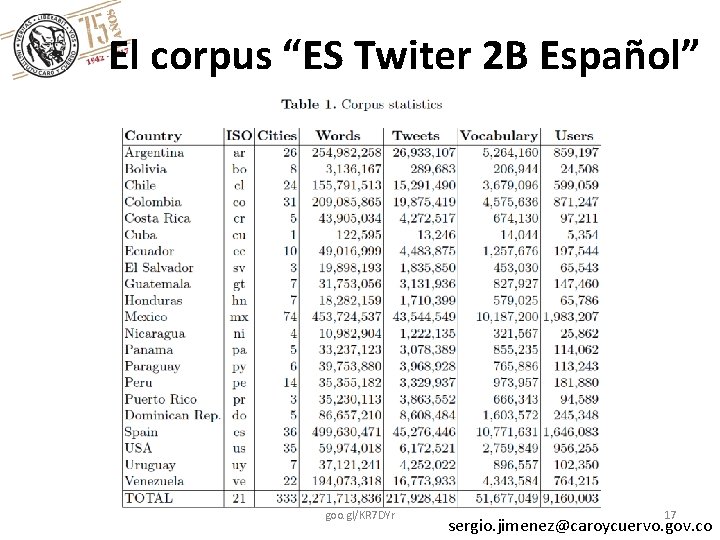

El corpus “ES Twiter 2 B Español” goo. gl/KR 7 DYr 17 sergio. jimenez@caroycuervo. gov. co

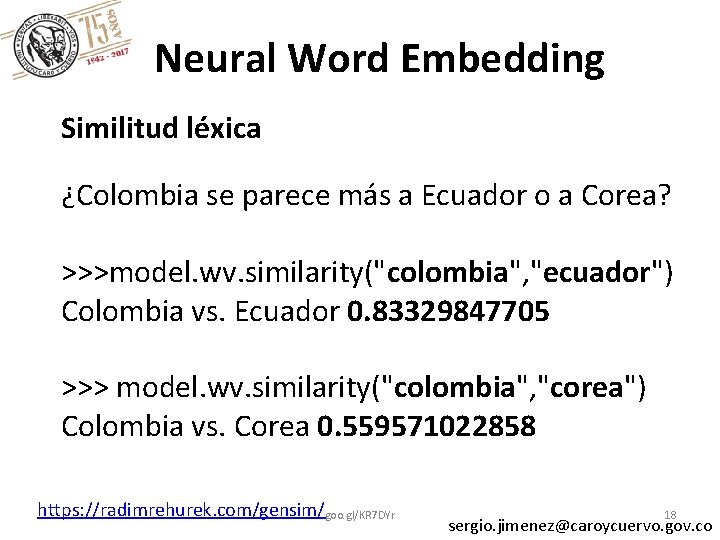

Neural Word Embedding Similitud léxica ¿Colombia se parece más a Ecuador o a Corea? >>>model. wv. similarity("colombia", "ecuador") Colombia vs. Ecuador 0. 83329847705 >>> model. wv. similarity("colombia", "corea") Colombia vs. Corea 0. 559571022858 https: //radimrehurek. com/gensim/goo. gl/KR 7 DYr 18 sergio. jimenez@caroycuervo. gov. co

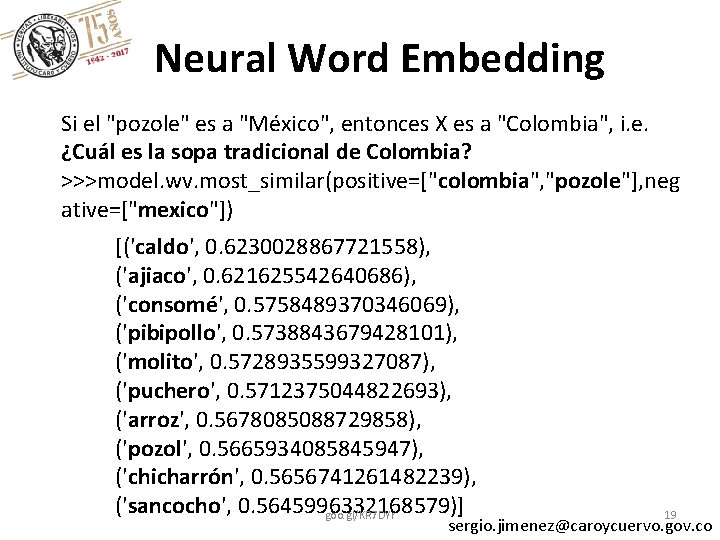

Neural Word Embedding Si el "pozole" es a "México", entonces X es a "Colombia", i. e. ¿Cuál es la sopa tradicional de Colombia? >>>model. wv. most_similar(positive=["colombia", "pozole"], neg ative=["mexico"]) [('caldo', 0. 6230028867721558), ('ajiaco', 0. 621625542640686), ('consomé', 0. 5758489370346069), ('pibipollo', 0. 5738843679428101), ('molito', 0. 5728935599327087), ('puchero', 0. 5712375044822693), ('arroz', 0. 5678085088729858), ('pozol', 0. 5665934085845947), ('chicharrón', 0. 5656741261482239), ('sancocho', 0. 5645996332168579)] goo. gl/KR 7 DYr 19 sergio. jimenez@caroycuervo. gov. co

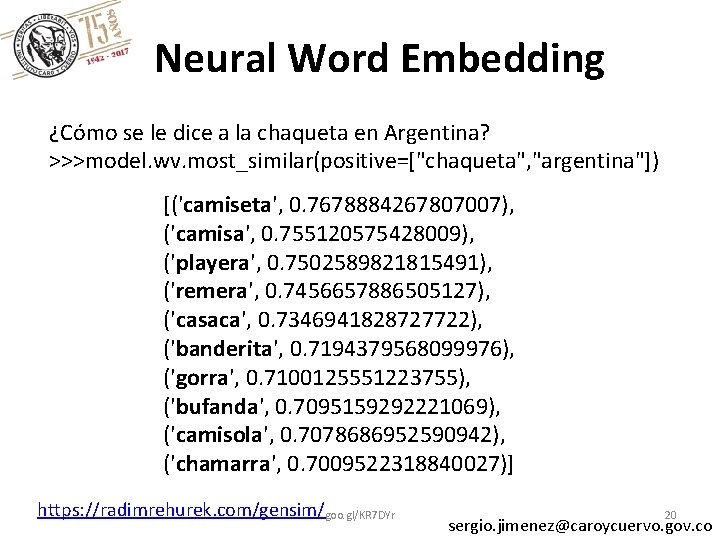

Neural Word Embedding ¿Cómo se le dice a la chaqueta en Argentina? >>>model. wv. most_similar(positive=["chaqueta", "argentina"]) [('camiseta', 0. 7678884267807007), ('camisa', 0. 755120575428009), ('playera', 0. 7502589821815491), ('remera', 0. 7456657886505127), ('casaca', 0. 7346941828727722), ('banderita', 0. 7194379568099976), ('gorra', 0. 7100125551223755), ('bufanda', 0. 7095159292221069), ('camisola', 0. 7078686952590942), ('chamarra', 0. 7009522318840027)] https: //radimrehurek. com/gensim/goo. gl/KR 7 DYr 20 sergio. jimenez@caroycuervo. gov. co

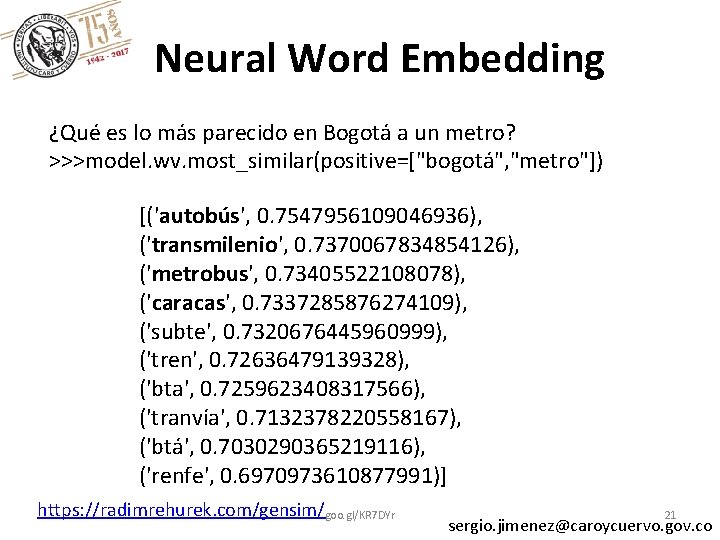

Neural Word Embedding ¿Qué es lo más parecido en Bogotá a un metro? >>>model. wv. most_similar(positive=["bogotá", "metro"]) [('autobús', 0. 7547956109046936), ('transmilenio', 0. 7370067834854126), ('metrobus', 0. 73405522108078), ('caracas', 0. 7337285876274109), ('subte', 0. 7320676445960999), ('tren', 0. 72636479139328), ('bta', 0. 7259623408317566), ('tranvía', 0. 7132378220558167), ('btá', 0. 7030290365219116), ('renfe', 0. 6970973610877991)] https: //radimrehurek. com/gensim/goo. gl/KR 7 DYr 21 sergio. jimenez@caroycuervo. gov. co

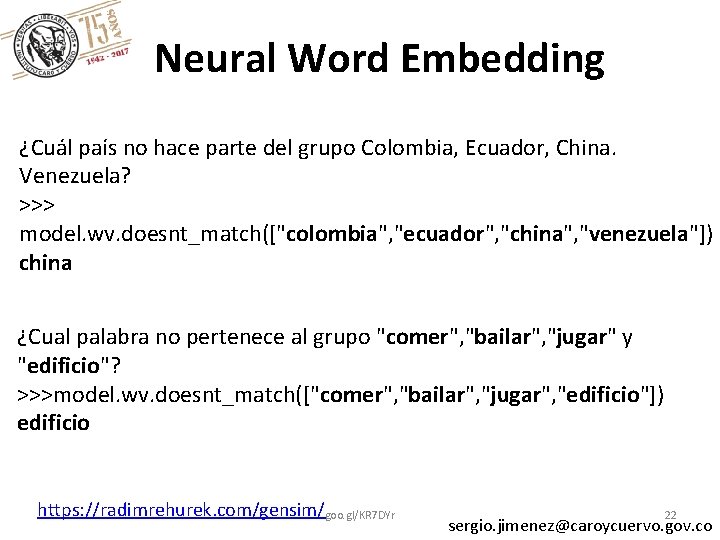

Neural Word Embedding ¿Cuál país no hace parte del grupo Colombia, Ecuador, China. Venezuela? >>> model. wv. doesnt_match(["colombia", "ecuador", "china", "venezuela"]) china ¿Cual palabra no pertenece al grupo "comer", "bailar", "jugar" y "edificio"? >>>model. wv. doesnt_match(["comer", "bailar", "jugar", "edificio"]) edificio https: //radimrehurek. com/gensim/goo. gl/KR 7 DYr 22 sergio. jimenez@caroycuervo. gov. co

Agenda Pointwise Mutual Information (PMI) Neural word Embeddings (word 2 vec, Glo. Ve) Similitud de palabras translingual Hillbert-Schmidt Independence Criterion (HSIC) • Word. Net • • goo. gl/KR 7 DYr 23 sergio. jimenez@caroycuervo. gov. co

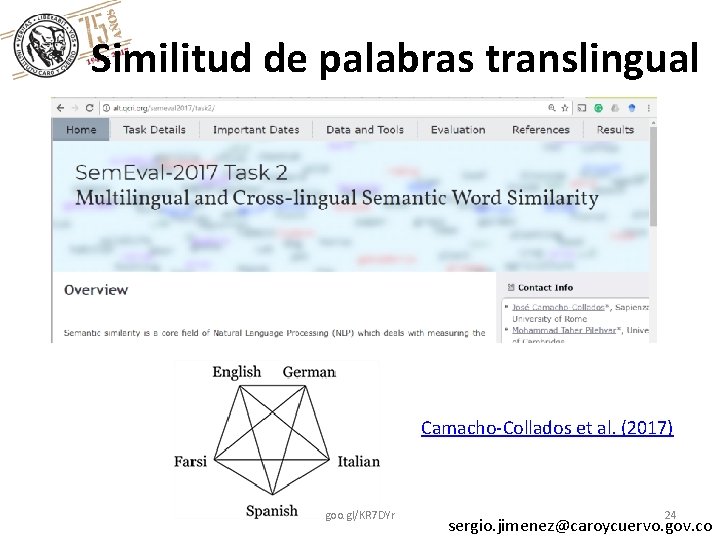

Similitud de palabras translingual Camacho-Collados et al. (2017) goo. gl/KR 7 DYr 24 sergio. jimenez@caroycuervo. gov. co

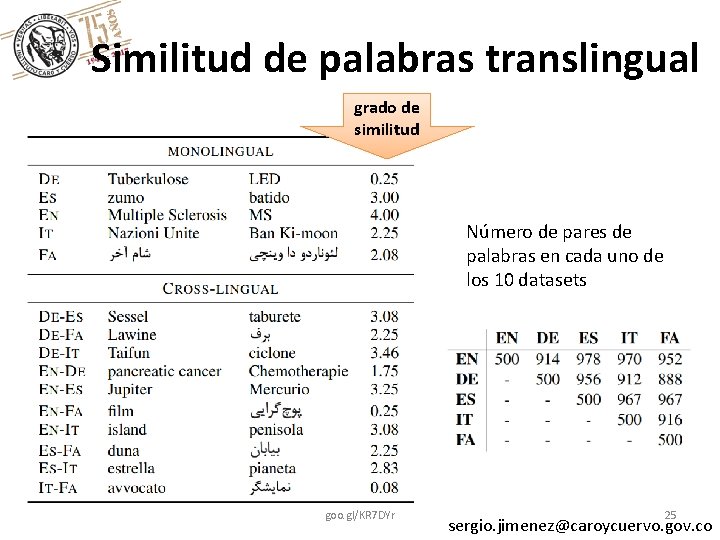

Similitud de palabras translingual grado de similitud Número de pares de palabras en cada uno de los 10 datasets goo. gl/KR 7 DYr 25 sergio. jimenez@caroycuervo. gov. co

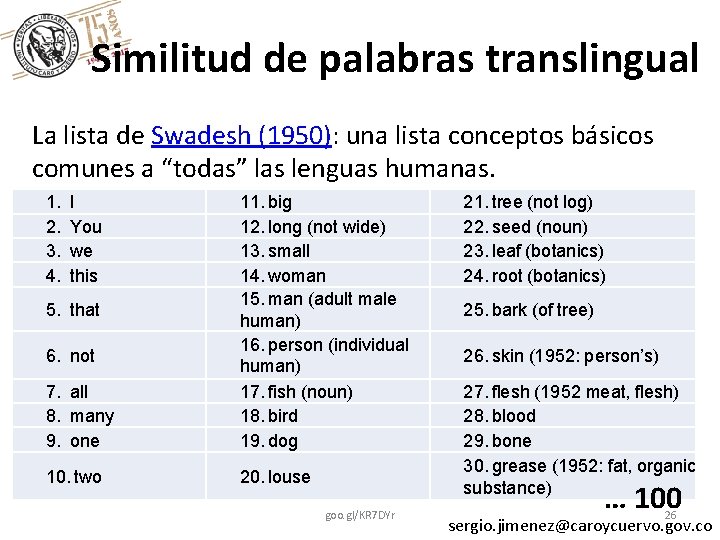

Similitud de palabras translingual La lista de Swadesh (1950): una lista conceptos básicos comunes a “todas” las lenguas humanas. 1. I 2. You 3. we 4. this 7. all 8. many 9. one 11. big 12. long (not wide) 13. small 14. woman 15. man (adult male human) 16. person (individual human) 17. fish (noun) 18. bird 19. dog 10. two 20. louse 5. that 6. not goo. gl/KR 7 DYr 21. tree (not log) 22. seed (noun) 23. leaf (botanics) 24. root (botanics) 25. bark (of tree) 26. skin (1952: person’s) 27. flesh (1952 meat, flesh) 28. blood 29. bone 30. grease (1952: fat, organic substance) … 100 26 sergio. jimenez@caroycuervo. gov. co

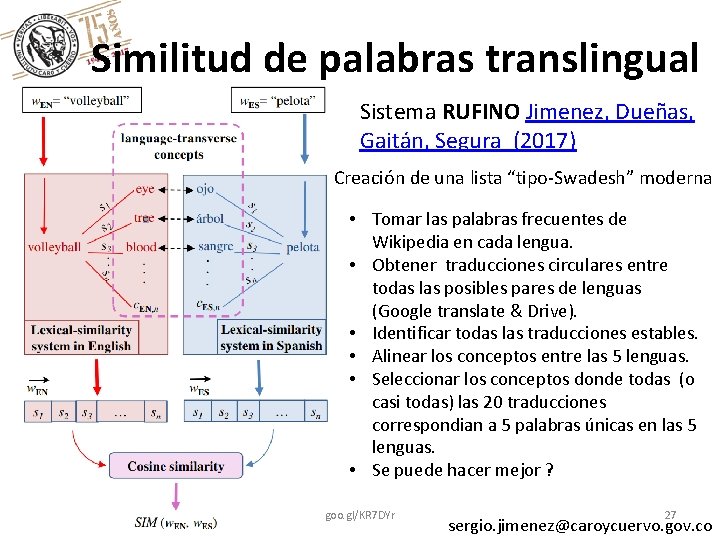

Similitud de palabras translingual Sistema RUFINO Jimenez, Dueñas, Gaitán, Segura (2017) Creación de una lista “tipo-Swadesh” moderna • Tomar las palabras frecuentes de Wikipedia en cada lengua. • Obtener traducciones circulares entre todas las posibles pares de lenguas (Google translate & Drive). • Identificar todas las traducciones estables. • Alinear los conceptos entre las 5 lenguas. • Seleccionar los conceptos donde todas (o casi todas) las 20 traducciones correspondian a 5 palabras únicas en las 5 lenguas. • Se puede hacer mejor ? goo. gl/KR 7 DYr 27 sergio. jimenez@caroycuervo. gov. co

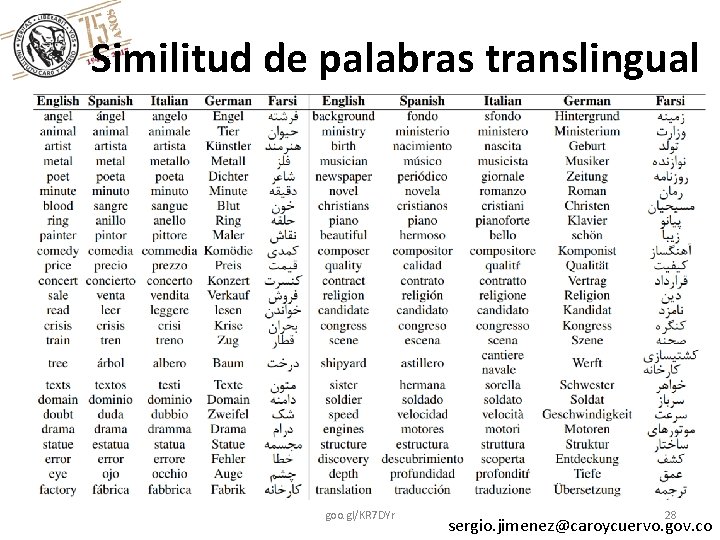

Similitud de palabras translingual goo. gl/KR 7 DYr 28 sergio. jimenez@caroycuervo. gov. co

https: //www. datos. gov. co goo. gl/KR 7 DYr 29

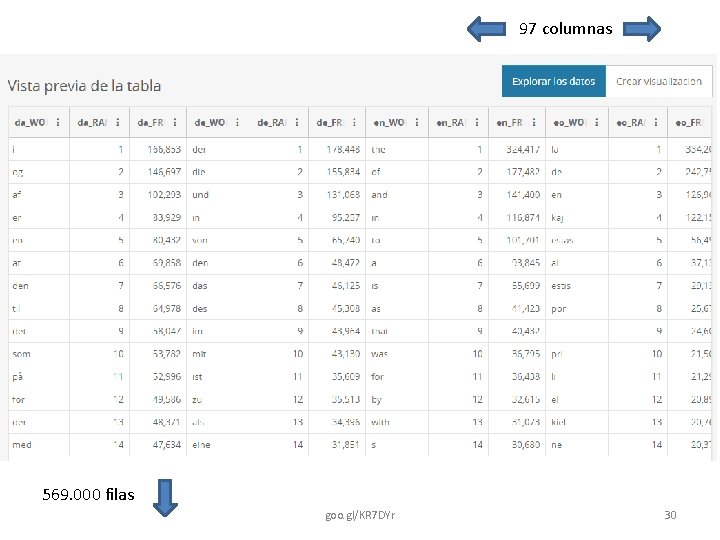

97 columnas 569. 000 filas goo. gl/KR 7 DYr 30

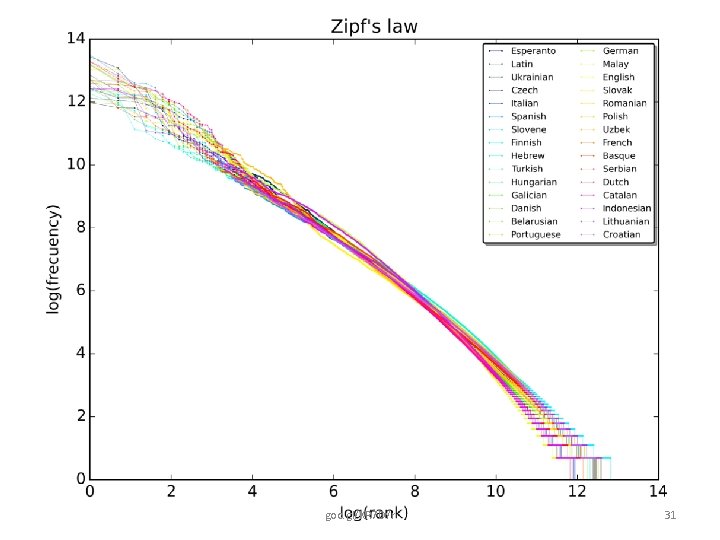

goo. gl/KR 7 DYr 31

DIPLOMADO: Análisis Computacional del Lenguaje 2018, al final segundo semestre. goo. gl/KR 7 DYr 32

Agenda Pointwise Mutual Information (PMI) Neural word Embeddings (word 2 vec, Glo. Ve) Similitud de palabras translingual Hillbert-Schmidt Independence Criterion (HSIC) • Word. Net • • goo. gl/KR 7 DYr 33 sergio. jimenez@caroycuervo. gov. co

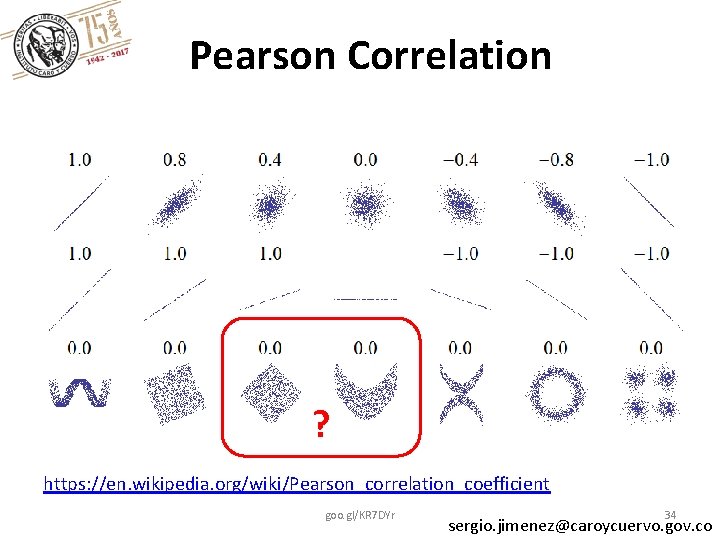

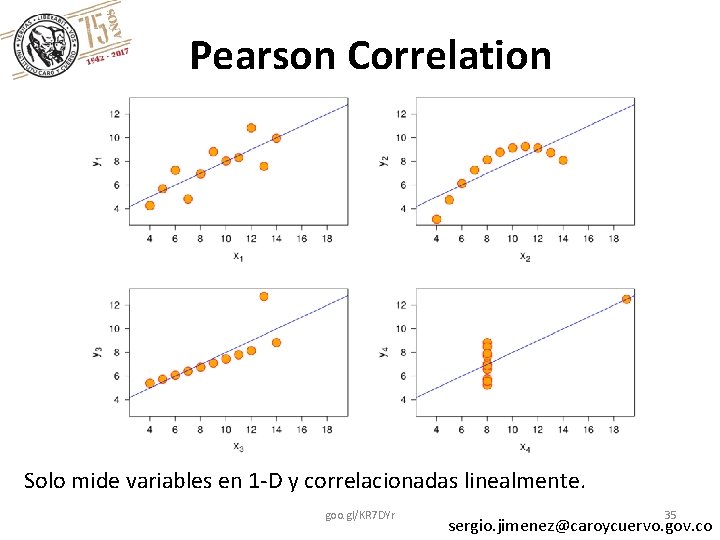

Pearson Correlation ? https: //en. wikipedia. org/wiki/Pearson_correlation_coefficient goo. gl/KR 7 DYr 34 sergio. jimenez@caroycuervo. gov. co

Pearson Correlation Solo mide variables en 1 -D y correlacionadas linealmente. goo. gl/KR 7 DYr 35 sergio. jimenez@caroycuervo. gov. co

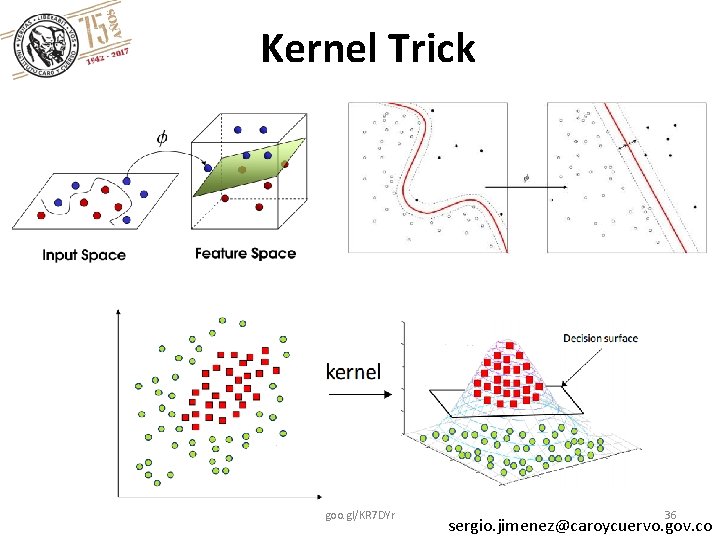

Kernel Trick goo. gl/KR 7 DYr 36 sergio. jimenez@caroycuervo. gov. co

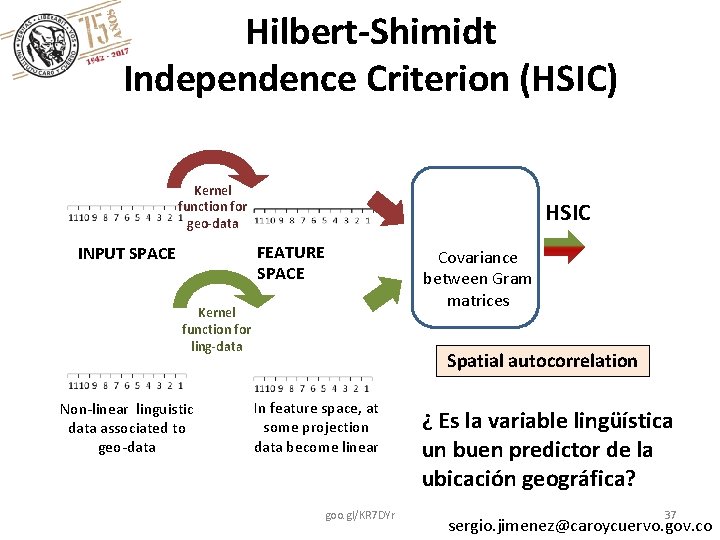

Hilbert-Shimidt Independence Criterion (HSIC) Kernel function for geo-data HSIC FEATURE SPACE INPUT SPACE Covariance between Gram matrices Kernel function for ling-data Non-linear linguistic data associated to geo-data Spatial autocorrelation In feature space, at some projection data become linear goo. gl/KR 7 DYr ¿ Es la variable lingüística un buen predictor de la ubicación geográfica? 37 sergio. jimenez@caroycuervo. gov. co

https: //www. datos. gov. co goo. gl/KR 7 DYr 38

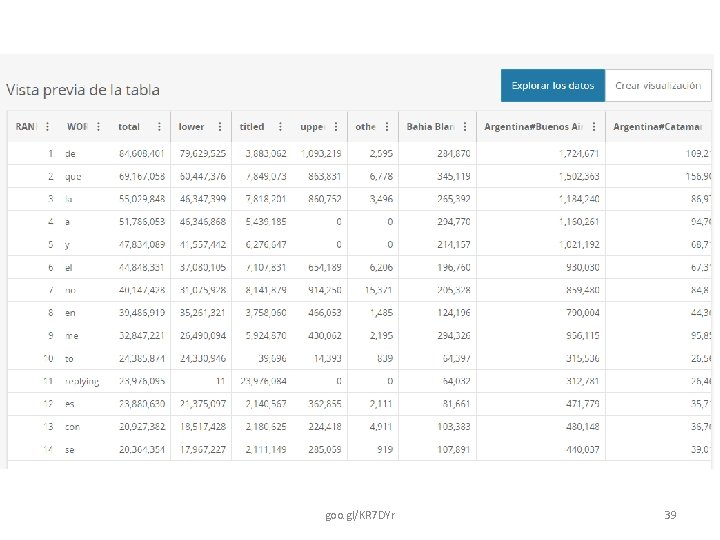

goo. gl/KR 7 DYr 39

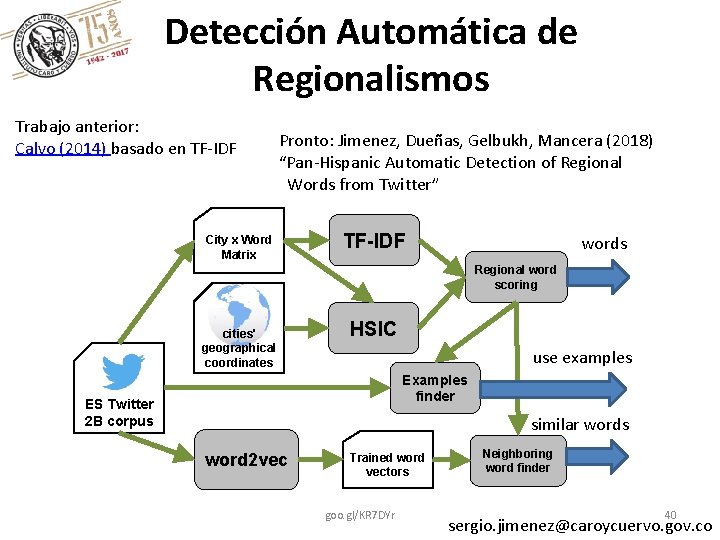

Detección Automática de Regionalismos Trabajo anterior: Calvo (2014) basado en TF-IDF Pronto: Jimenez, Dueñas, Gelbukh, Mancera (2018) “Pan-Hispanic Automatic Detection of Regional Words from Twitter” City x Word Matrix TF-IDF words Regional word scoring cities' geographical coordinates HSIC use examples Examples finder ES Twitter 2 B corpus similar words word 2 vec Trained word vectors goo. gl/KR 7 DYr Neighboring word finder 40 sergio. jimenez@caroycuervo. gov. co

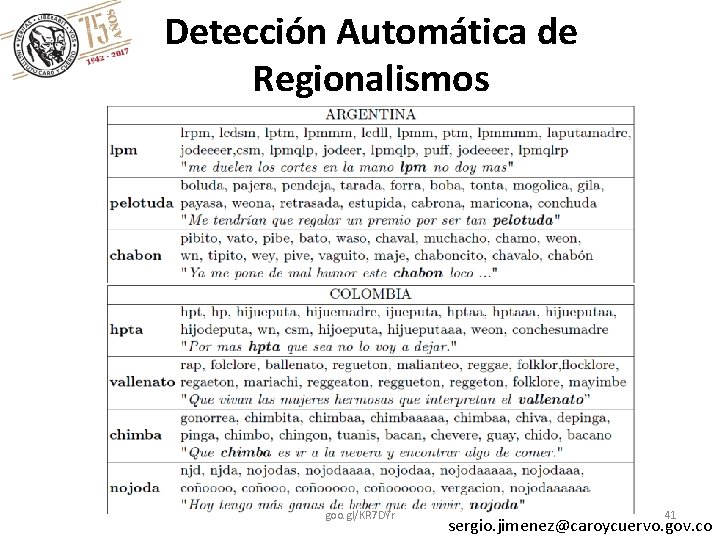

Detección Automática de Regionalismos goo. gl/KR 7 DYr 41 sergio. jimenez@caroycuervo. gov. co

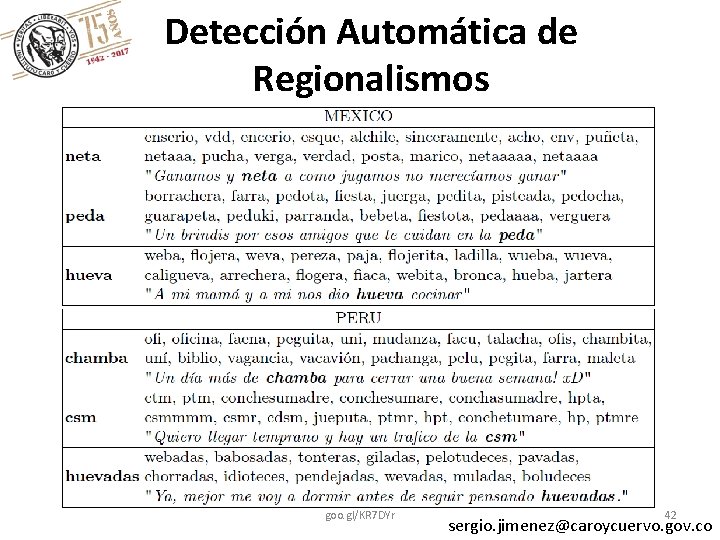

Detección Automática de Regionalismos goo. gl/KR 7 DYr 42 sergio. jimenez@caroycuervo. gov. co

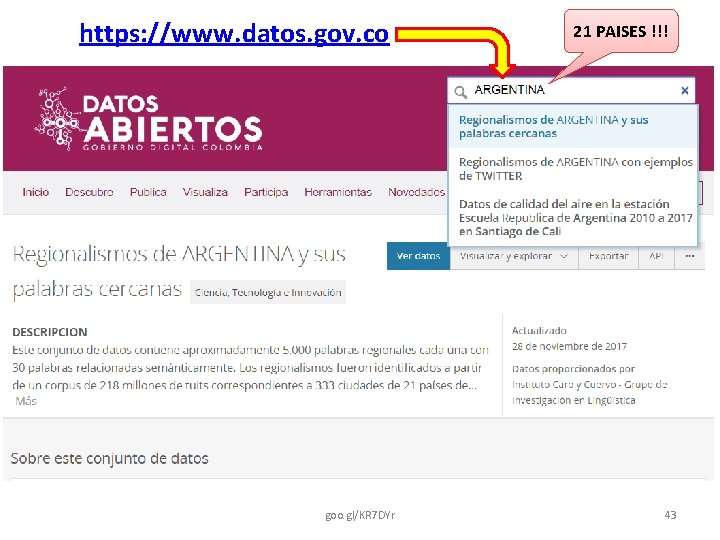

https: //www. datos. gov. co goo. gl/KR 7 DYr 21 PAISES !!! 43

Regionalismos y sus palabras similares goo. gl/KR 7 DYr 44 sergio. jimenez@caroycuervo. gov. co

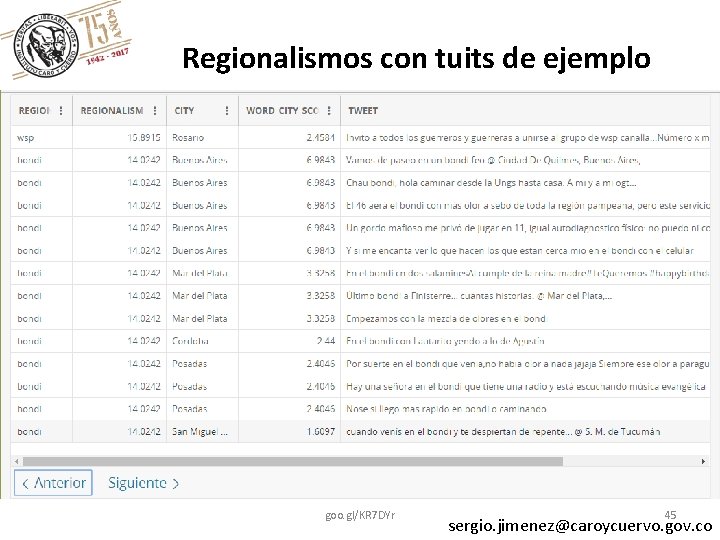

Regionalismos con tuits de ejemplo goo. gl/KR 7 DYr 45 sergio. jimenez@caroycuervo. gov. co

Agenda Pointwise Mutual Information (PMI) Neural word Embeddings (word 2 vec, Glo. Ve) Similitud de palabras translingual Hillbert-Schmidt Independence Criterion (HSIC) • Word. Net • • goo. gl/KR 7 DYr 46 sergio. jimenez@caroycuervo. gov. co

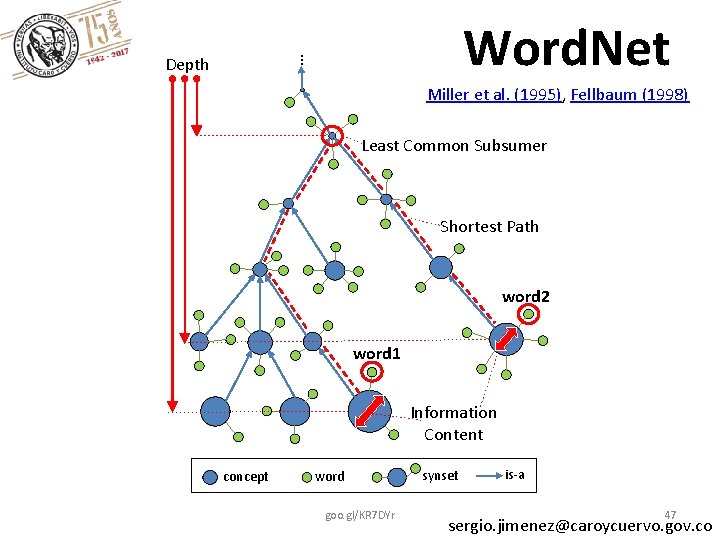

Word. Net … Depth Miller et al. (1995), Fellbaum (1998) Least Common Subsumer Shortest Path word 2 word 1 Information Content concept word goo. gl/KR 7 DYr synset is-a 47 sergio. jimenez@caroycuervo. gov. co

https: //www. datos. gov. co ¡ CON REGIONALISMOS ! goo. gl/KR 7 DYr 48

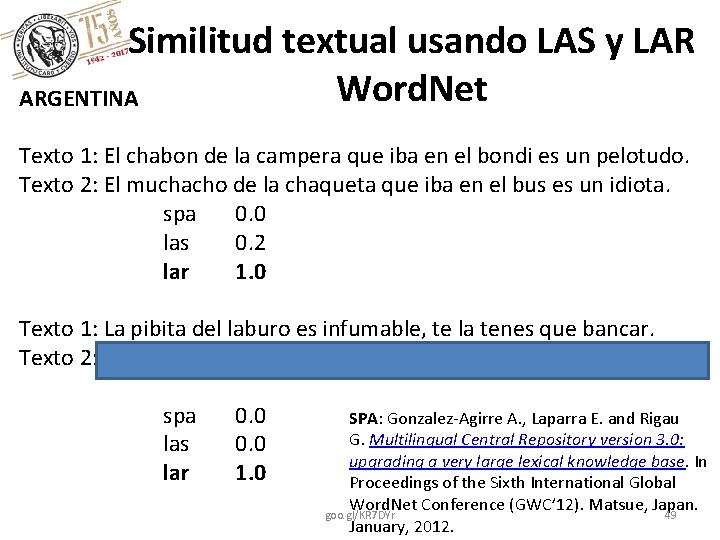

Similitud textual usando LAS y LAR Word. Net ARGENTINA Texto 1: El chabon de la campera que iba en el bondi es un pelotudo. Texto 2: El muchacho de la chaqueta que iba en el bus es un idiota. spa 0. 0 las 0. 2 lar 1. 0 Texto 1: La pibita del laburo es infumable, te la tenes que bancar. Texto 2: La muchacha del trabajo es irritante, te la tienes que soportar. spa las lar 0. 0 1. 0 SPA: Gonzalez-Agirre A. , Laparra E. and Rigau G. Multilingual Central Repository version 3. 0: upgrading a very large lexical knowledge base. In Proceedings of the Sixth International Global Word. Net Conference (GWC’ 12). Matsue, Japan. 49 goo. gl/KR 7 DYr January, 2012.

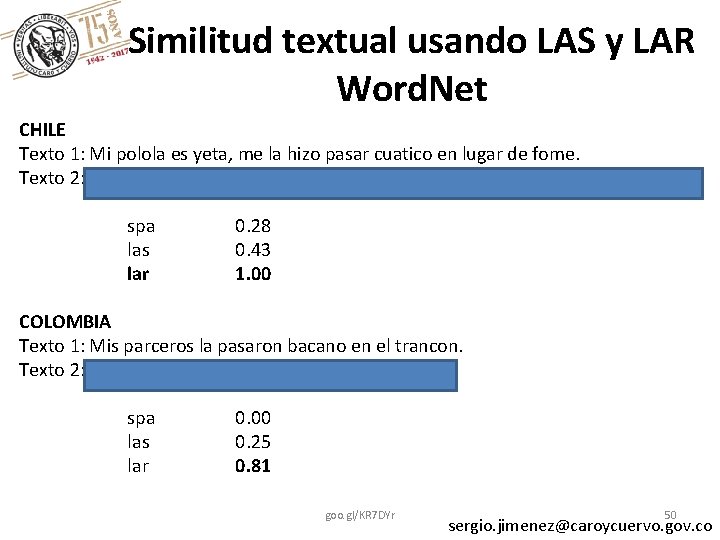

Similitud textual usando LAS y LAR Word. Net CHILE Texto 1: Mi polola es yeta, me la hizo pasar cuatico en lugar de fome. Texto 2: Mi novia es supersticiosa, me la hizo pasar terrible en lugar de entretenido. spa las lar 0. 28 0. 43 1. 00 COLOMBIA Texto 1: Mis parceros la pasaron bacano en el trancon. Texto 2: Mi amigos la pasaron divertido en el tráfico. spa las lar 0. 00 0. 25 0. 81 goo. gl/KR 7 DYr 50 sergio. jimenez@caroycuervo. gov. co

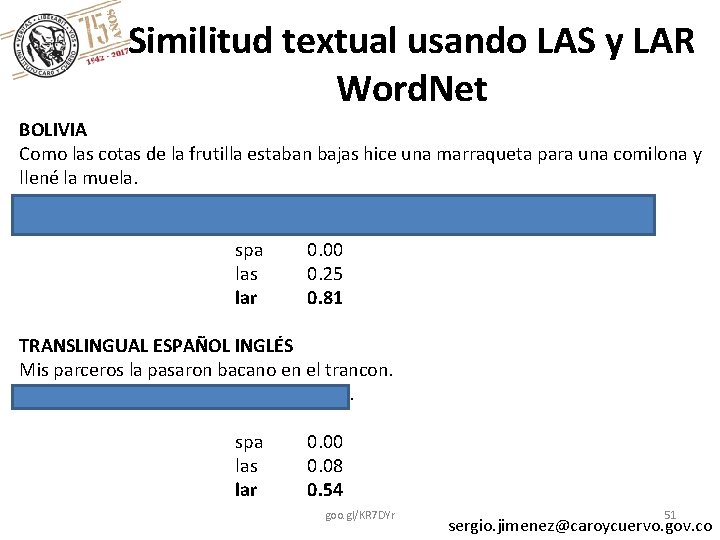

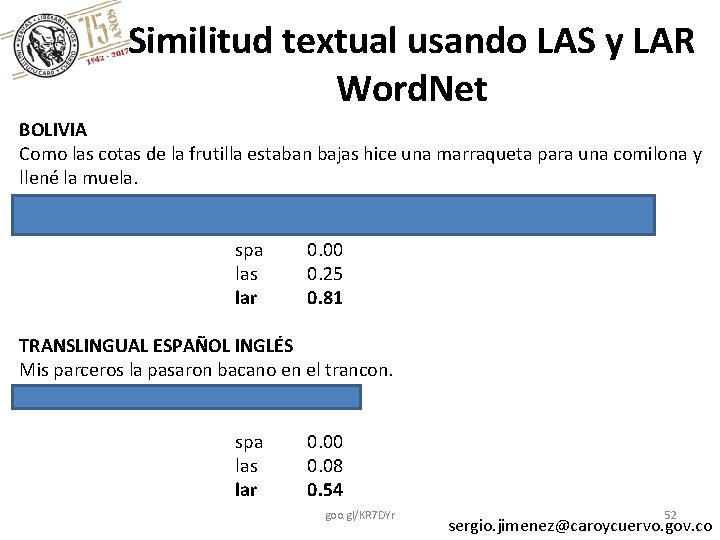

Similitud textual usando LAS y LAR Word. Net BOLIVIA Como las cotas de la frutilla estaban bajas hice una marraqueta para una comilona y llené la muela. Como el precio de la avellana estaba bajo hice una torta para la cena y llené el estómago. spa 0. 00 las 0. 25 lar 0. 81 TRANSLINGUAL ESPAÑOL INGLÉS Mis parceros la pasaron bacano en el trancon. My boys had a fun time in the traffic jam. spa las lar 0. 00 0. 08 0. 54 goo. gl/KR 7 DYr 51 sergio. jimenez@caroycuervo. gov. co

Similitud textual usando LAS y LAR Word. Net BOLIVIA Como las cotas de la frutilla estaban bajas hice una marraqueta para una comilona y llené la muela. Como el precio de la avellana estaba bajo hice una torta para la cena y llené el estómago. spa 0. 00 las 0. 25 lar 0. 81 TRANSLINGUAL ESPAÑOL INGLÉS Mis parceros la pasaron bacano en el trancon. My boys had a fun time in the traffic jam. spa las lar 0. 00 0. 08 0. 54 goo. gl/KR 7 DYr 52 sergio. jimenez@caroycuervo. gov. co

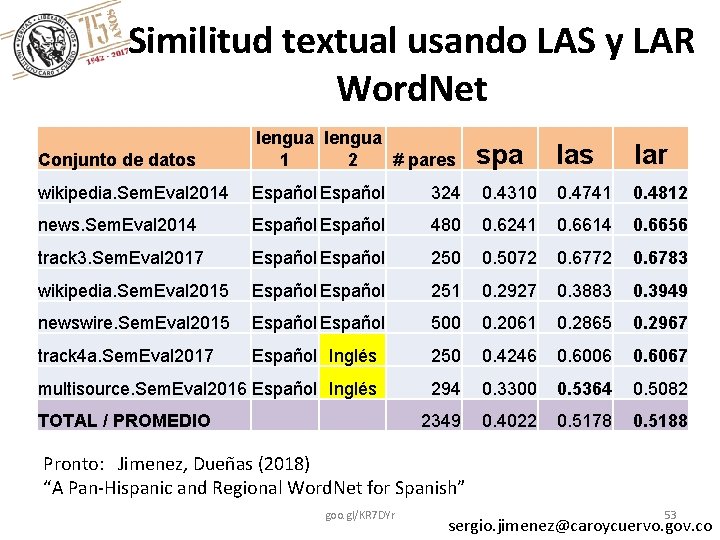

Similitud textual usando LAS y LAR Word. Net Conjunto de datos lengua 1 2 # pares wikipedia. Sem. Eval 2014 Español 324 news. Sem. Eval 2014 Español track 3. Sem. Eval 2017 las lar 0. 4310 0. 4741 0. 4812 480 0. 6241 0. 6614 0. 6656 Español 250 0. 5072 0. 6783 wikipedia. Sem. Eval 2015 Español 251 0. 2927 0. 3883 0. 3949 newswire. Sem. Eval 2015 Español 500 0. 2061 0. 2865 0. 2967 track 4 a. Sem. Eval 2017 Español Inglés 250 0. 4246 0. 6006 0. 6067 multisource. Sem. Eval 2016 Español Inglés 294 0. 3300 0. 5364 0. 5082 2349 0. 4022 0. 5178 0. 5188 TOTAL / PROMEDIO spa Pronto: Jimenez, Dueñas (2018) “A Pan-Hispanic and Regional Word. Net for Spanish” goo. gl/KR 7 DYr 53 sergio. jimenez@caroycuervo. gov. co

! Gracias ! Para … • • dudas, colaboraciones interinstitucionales, problemas con los conjuntos de datos, (los hay) ¿busca un co-director externo para su tesis de maestría? , • ¿quiere acceder al corpus “ES Twitter 2 B”? sergio. jimenez@caroycuervo. gov. co 54 goo. gl/KR 7 DYr

INVITACION PARA MAÑANA A LAS 5 PM EN FILBO goo. gl/KR 7 DYr 55

- Slides: 55