Les Arbres de dcision ou rgression 1 Contexte

Les Arbres de décision ou régression 1

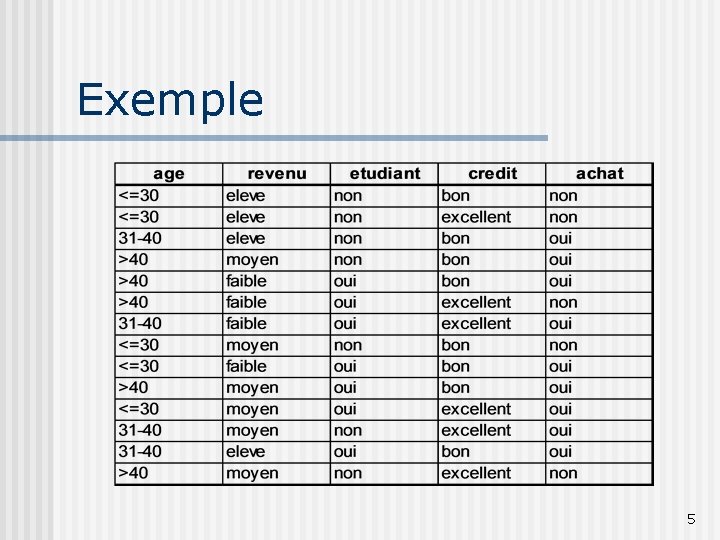

Contexte n Supposons que nous désirons comprendre ou expliquer le profil des gens qui achète un ordinateur. Pour ce faire, nous considérons les variables suivantes: n n ge, revenu, étudiant ou non, cote de crédit Quel raisonnement ou démarche fait-on naturellement pour établir ce profil? 2

Les arbres de décision n n Les arbres de décision sont utilisés pour la prédiction ou l’explication d’une variable cible (Y)(target variable, variable dépendante) à partir d’un ensemble de variable explicatives (X) (input variables, variables indépendantes) Le principe des arbres de décision est de diviser l’ensemble des données d’apprentissage successivement en sous-groupes, selon les valeurs prises par les variables explicatives qui à chaque étape discrimine le mieux la variable cible. 3

n Le résultat est un ensemble de règles simples qui permettent de réaliser des prévisions, de segmenter la population ou d’identifier qu’elles sont les variables qui discriminent le plus la variable cible. 4

Exemple 5

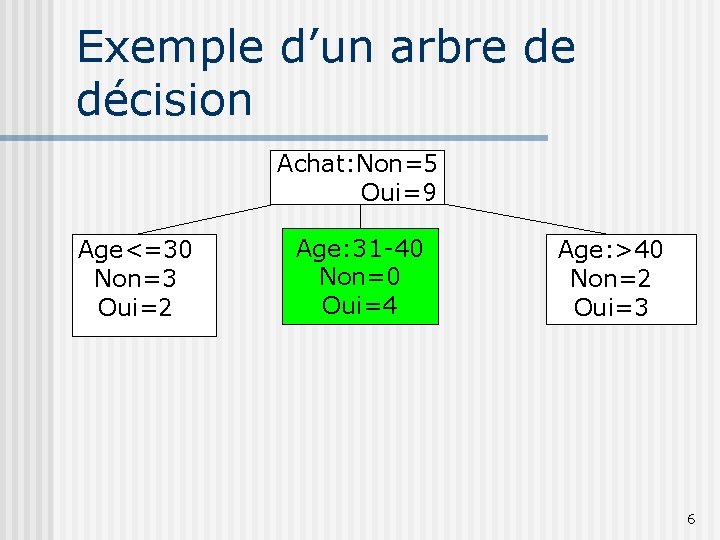

Exemple d’un arbre de décision Achat: Non=5 Oui=9 Age<=30 Non=3 Oui=2 Age: 31 -40 Non=0 Oui=4 Age: >40 Non=2 Oui=3 6

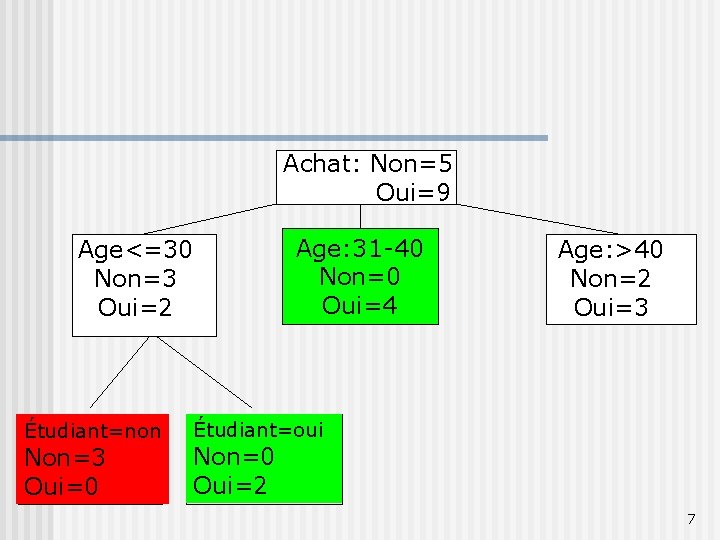

Achat: Non=5 Oui=9 Age<=30 Non=3 Oui=2 Étudiant=non Non=3 Oui=0 Age: 31 -40 Non=0 Oui=4 Age: >40 Non=2 Oui=3 Étudiant=oui Non=0 Oui=2 7

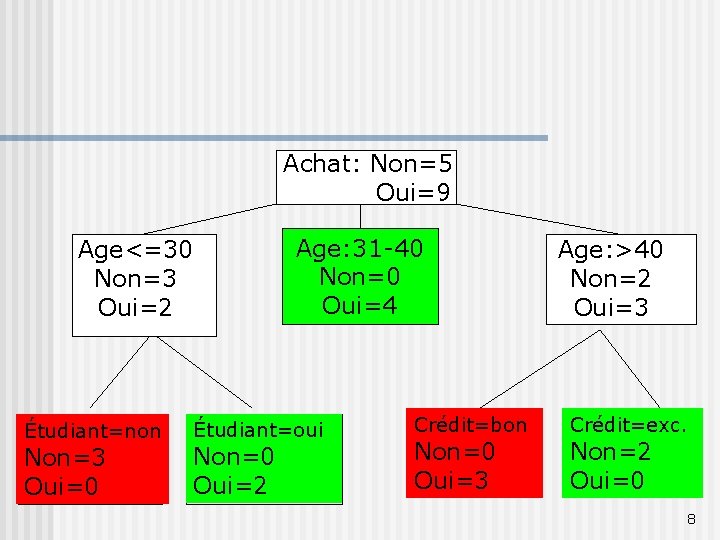

Achat: Non=5 Oui=9 Age<=30 Non=3 Oui=2 Étudiant=non Non=3 Oui=0 Age: 31 -40 Non=0 Oui=4 Étudiant=oui Non=0 Oui=2 Crédit=bon Non=0 Oui=3 Age: >40 Non=2 Oui=3 Crédit=exc. Non=2 Oui=0 8

Algorithmes et logiciels les plus répandus pour construire les arbres de décision: CHAID Chi-Square Automatic Interaction Detection (1975) n CART Classification And Regression Trees (Breiman et al. , 1984) n Knowledge seeker n 9

Algorithme 1) Pour chaque nœud de l’arbre: n Pour chacune des variables explicatives X, jumelage des modalités à partir du test du chi-carré. n Après le jumelage des modalités pour chaque X, Sélection de la variable X la plus fortement lié avec la variable cible Y, c. -à-d. p-value du test du chi-carré le plus petit. 2) Pour chaque nœud fils suivant, reprise des étapes a) et b) 3) Le processus s’arrête lorsque à tous les nœuds de l’arbre, les tests du chi-deux entre les variables X et Y sont tous non significatifs c. -à-d. p-value > 10

Conditions d’arrêt de la croissance de l’arbre n Développement de l’arbre complet: toutes les observations dans le nœud appartiennent à la même classe de la variable cible; n il n’y a plus de variables explicatives X à considérer poursuivre la croissance de l’arbre; n trop peu d’observations dans le nœud poursuivre. n 11

L’élagage (pruning) n n L’arbre complet est le meilleur, en terme de taux d’erreur, pour prédire la variable cible, pour l’ensemble des données d’apprentissage! Qu’en est-il pour un nouvel ensemble de données? n n L’arbre complet n’est probablement pas la meilleure solution! Évaluer les sous-arbres: n n Utiliser un échantillon de validation. Utiliser la validation croisé. 12

Avantages des arbres de décision Règles simples et facilement interprétables. n Traitement des valeurs manquantes. n Aucun modèle et aucun présupposé à satisfaire. n 13

Désavantages Peu performants lorsqu’il y a beaucoup de classes. n Taux d’erreurs élevés lorsqu’il y a des régions non rectangulaires n Peu faire de l‘overfit’ si on ne contrôle pas le nombre minimum d’observation par nœuds. n 14

Construire un arbre à partir d’excel n Nous pouvons générer un arbre manuellement à partir d’excel: On utiliser la fonction ‘pivot tables’ pour obtenir nous comptes n On utilise les utilitaire graphiques d’excel. n Exemple. n 15

- Slides: 15