Konsep Support Vector Machine Hard Margin SVM Lagrange

- Slides: 18

Konsep Support Vector Machine -Hard Margin SVM -Lagrange Multiplier -Dual Problem -Gradient Ascent/Descent Lecture 1 (update 21 Agustus 2009)

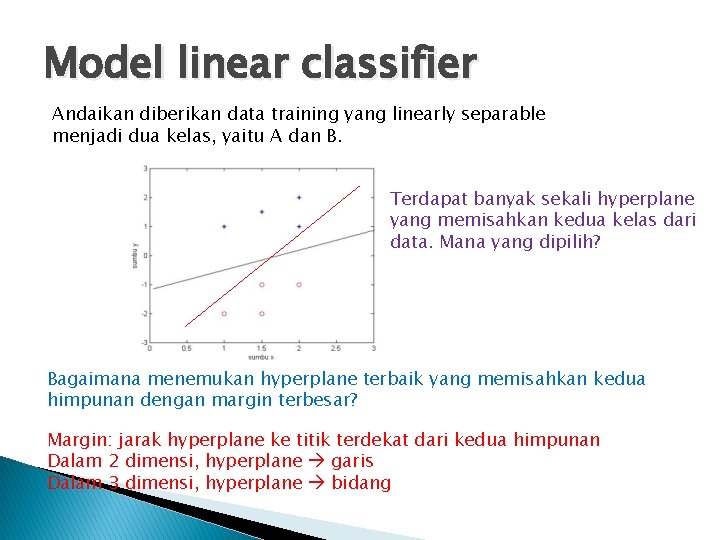

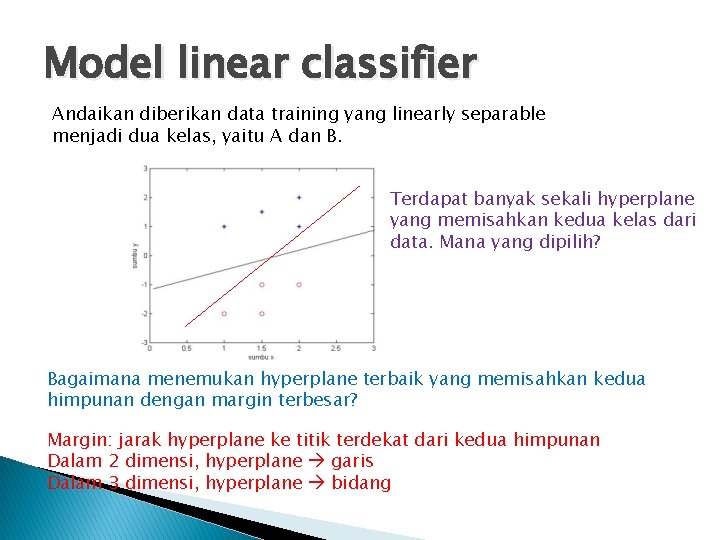

Model linear classifier Andaikan diberikan data training yang linearly separable menjadi dua kelas, yaitu A dan B. Terdapat banyak sekali hyperplane yang memisahkan kedua kelas dari data. Mana yang dipilih? Bagaimana menemukan hyperplane terbaik yang memisahkan kedua himpunan dengan margin terbesar? Margin: jarak hyperplane ke titik terdekat dari kedua himpunan Dalam 2 dimensi, hyperplane garis Dalam 3 dimensi, hyperplane bidang

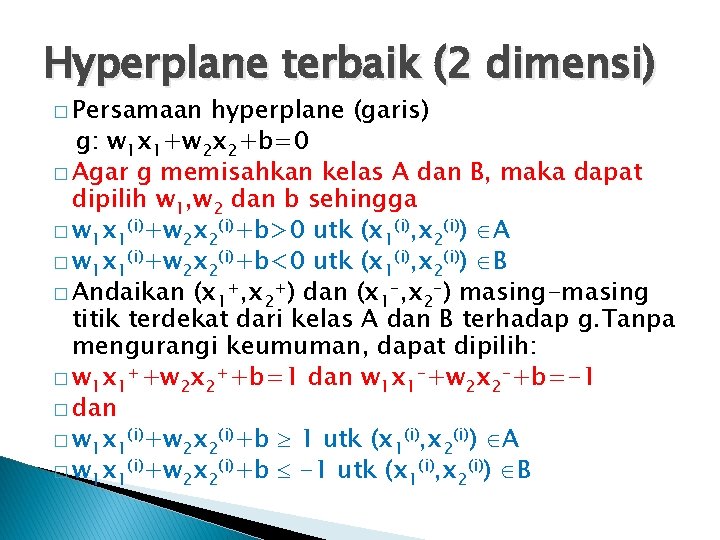

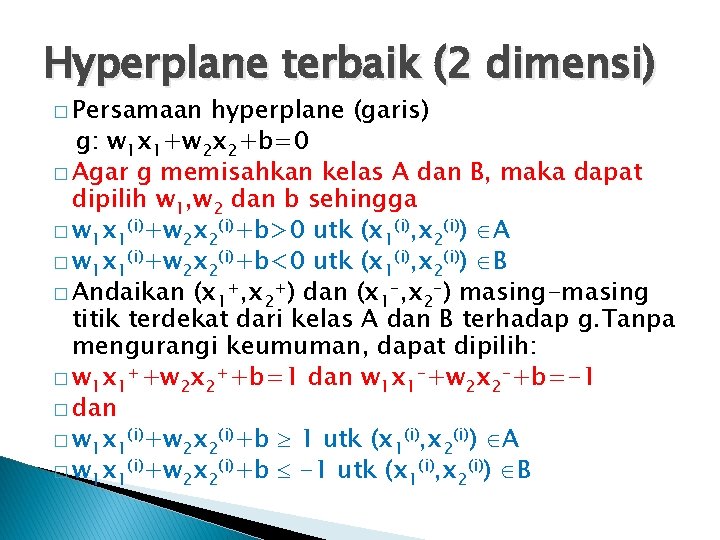

Hyperplane terbaik (2 dimensi) � Persamaan hyperplane (garis) g: w 1 x 1+w 2 x 2+b=0 � Agar g memisahkan kelas A dan B, maka dapat dipilih w 1, w 2 dan b sehingga � w 1 x 1(i)+w 2 x 2(i)+b>0 utk (x 1(i), x 2(i)) A � w 1 x 1(i)+w 2 x 2(i)+b<0 utk (x 1(i), x 2(i)) B � Andaikan (x 1+, x 2+) dan (x 1 -, x 2 -) masing-masing titik terdekat dari kelas A dan B terhadap g. Tanpa mengurangi keumuman, dapat dipilih: � w 1 x 1++w 2 x 2++b=1 dan w 1 x 1 -+w 2 x 2 -+b=-1 � dan � w 1 x 1(i)+w 2 x 2(i)+b 1 utk (x 1(i), x 2(i)) A � w 1 x 1(i)+w 2 x 2(i)+b -1 utk (x 1(i), x 2(i)) B

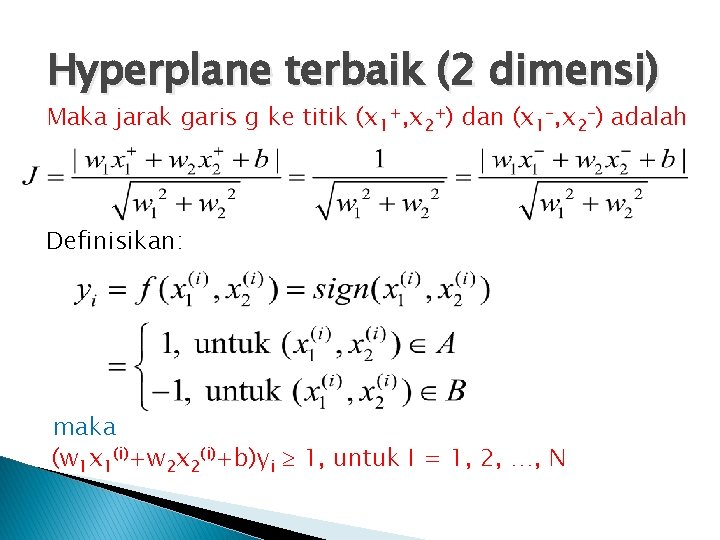

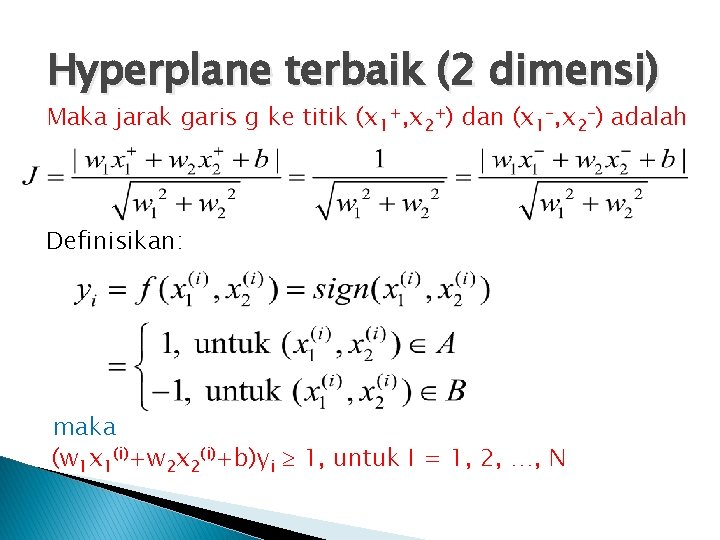

Hyperplane terbaik (2 dimensi) Maka jarak garis g ke titik (x 1+, x 2+) dan (x 1 -, x 2 -) adalah Definisikan: maka (w 1 x 1(i)+w 2 x 2(i)+b)yi 1, untuk I = 1, 2, …, N

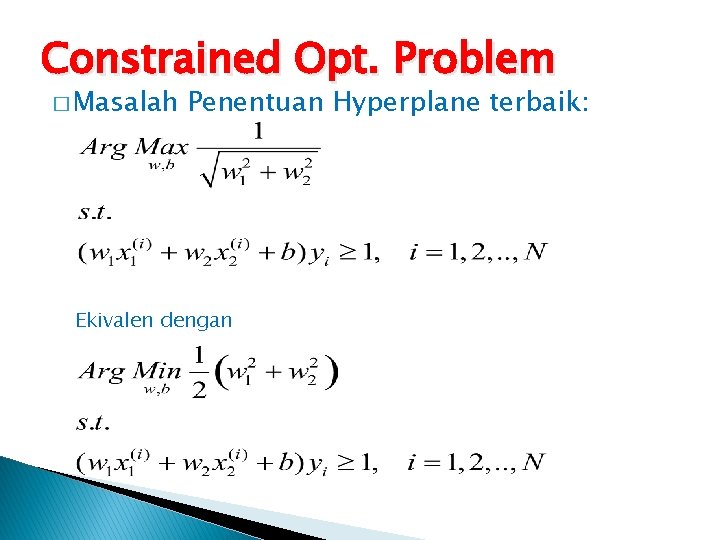

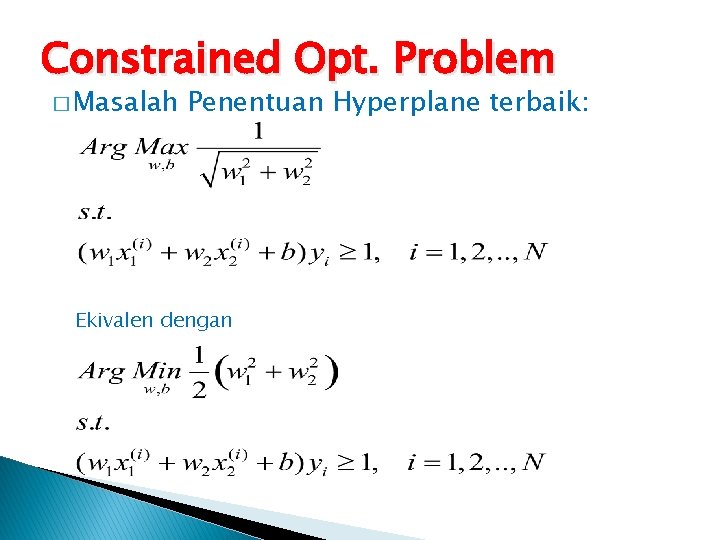

Constrained Opt. Problem � Masalah Penentuan Hyperplane terbaik: Ekivalen dengan

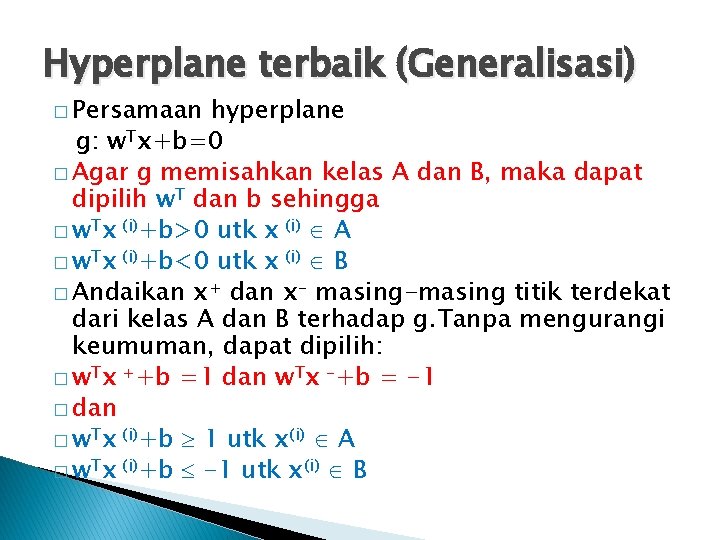

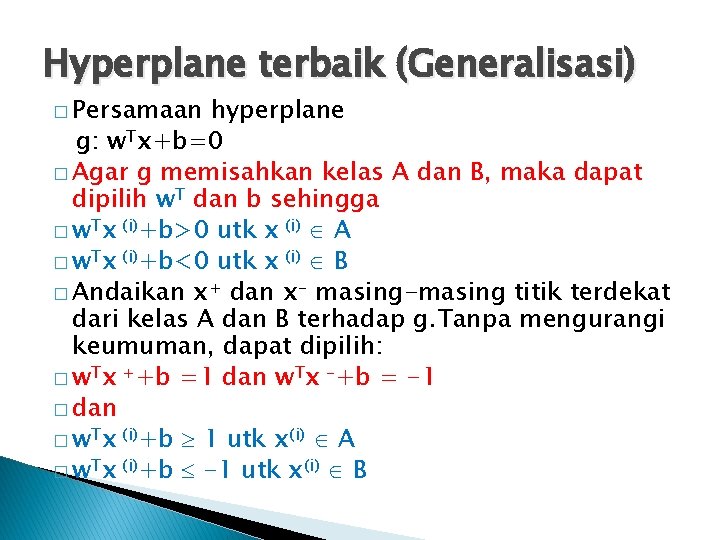

Hyperplane terbaik (Generalisasi) � Persamaan hyperplane g: w. Tx+b=0 � Agar g memisahkan kelas A dan B, maka dapat dipilih w. T dan b sehingga � w. Tx (i)+b>0 utk x (i) A � w. Tx (i)+b<0 utk x (i) B � Andaikan x+ dan x- masing-masing titik terdekat dari kelas A dan B terhadap g. Tanpa mengurangi keumuman, dapat dipilih: � w. Tx ++b =1 dan w. Tx -+b = -1 � dan � w. Tx (i)+b 1 utk x(i) A � w. Tx (i)+b -1 utk x(i) B

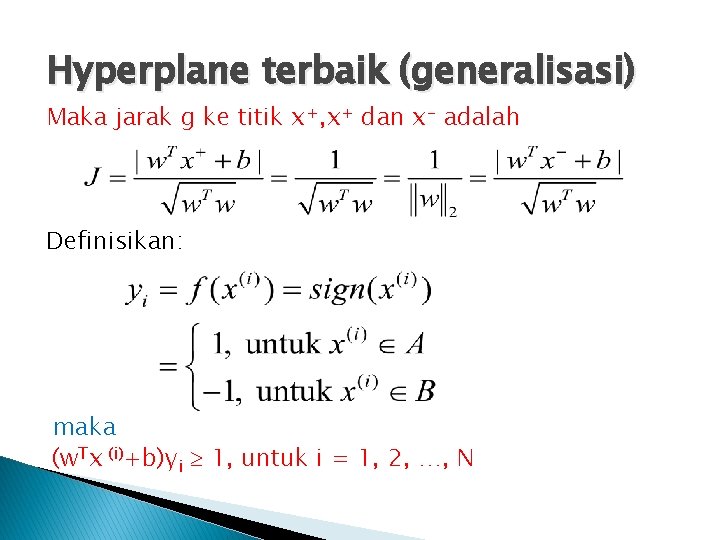

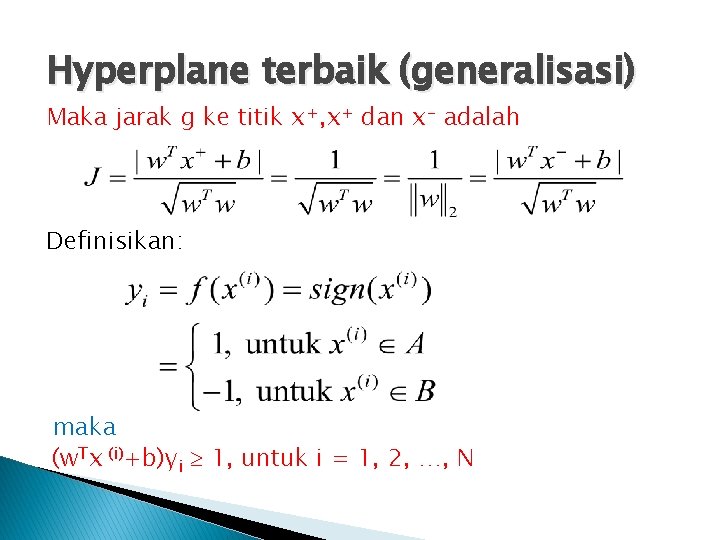

Hyperplane terbaik (generalisasi) Maka jarak g ke titik x+, x+ dan x- adalah Definisikan: maka (w. Tx (i)+b)yi 1, untuk i = 1, 2, …, N

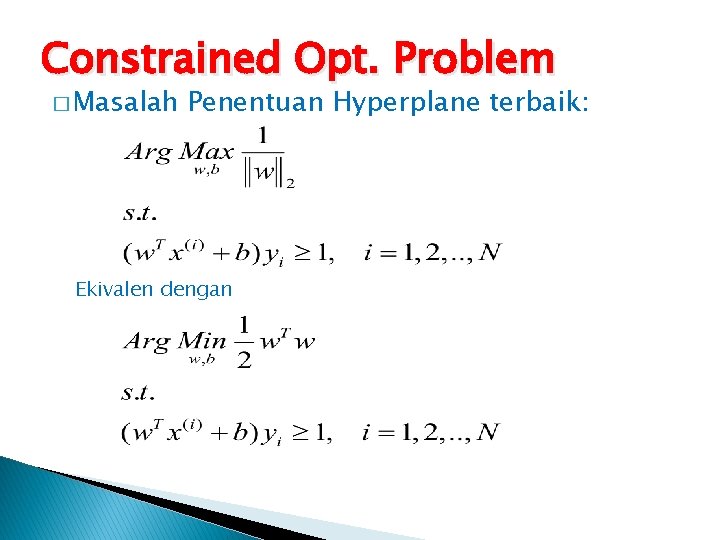

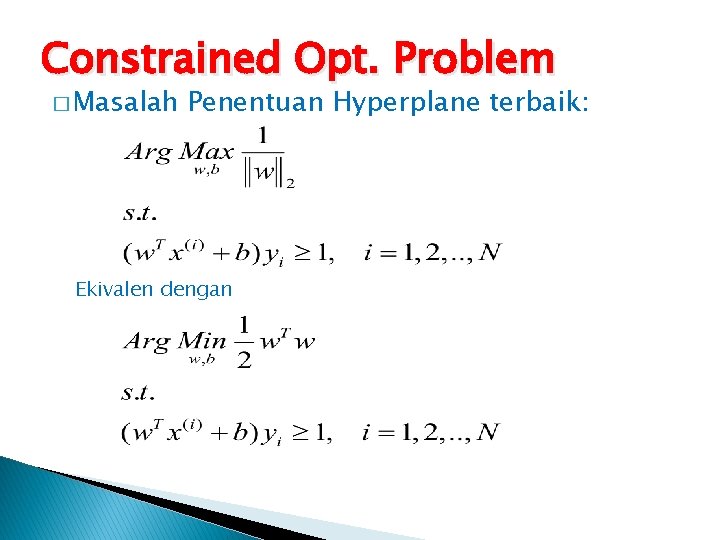

Constrained Opt. Problem � Masalah Penentuan Hyperplane terbaik: Ekivalen dengan

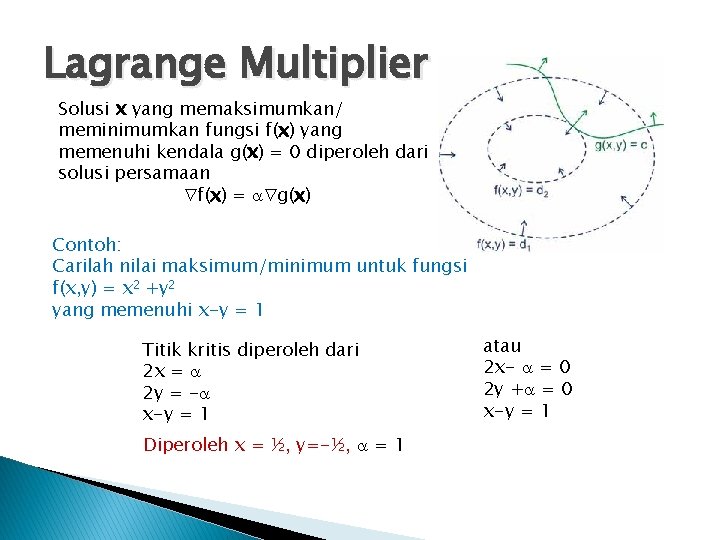

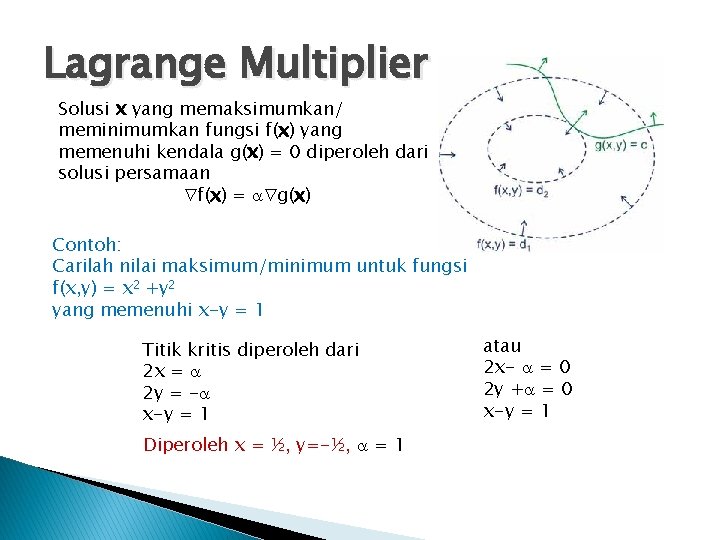

Lagrange Multiplier Solusi x yang memaksimumkan/ meminimumkan fungsi f(x) yang memenuhi kendala g(x) = 0 diperoleh dari solusi persamaan f(x) = g(x) Contoh: Carilah nilai maksimum/minimum untuk fungsi f(x, y) = x 2 +y 2 yang memenuhi x-y = 1 Titik kritis diperoleh dari 2 x = 2 y = - x-y = 1 Diperoleh x = ½, y=-½, = 1 atau 2 x- = 0 2 y + = 0 x-y = 1

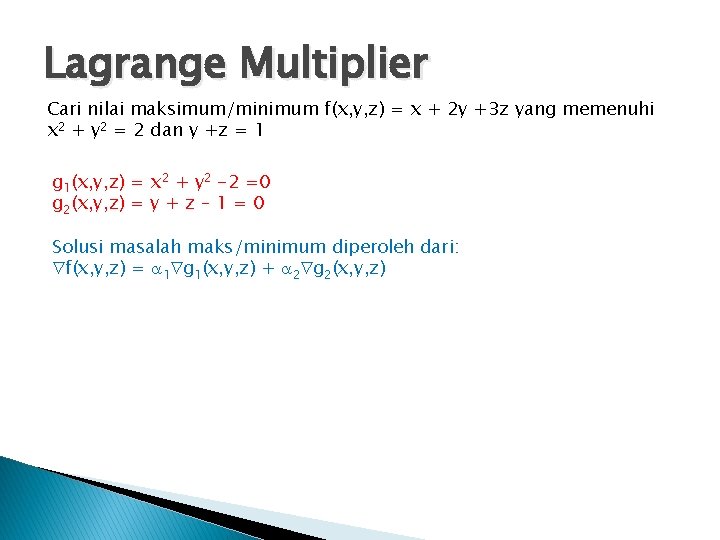

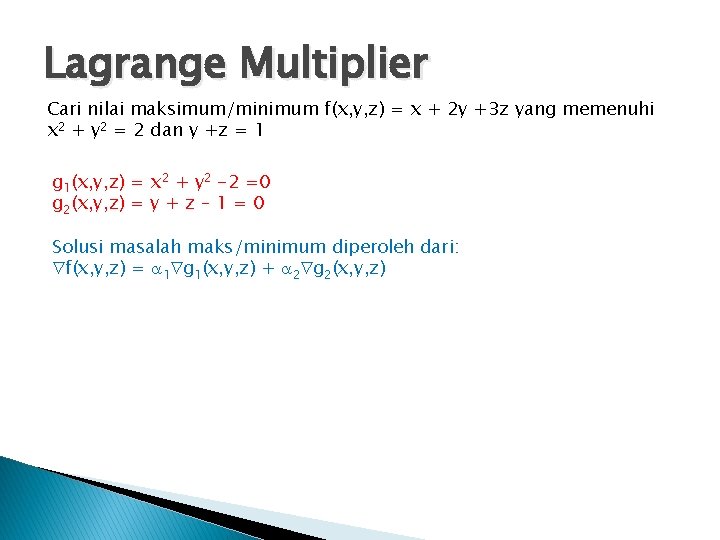

Lagrange Multiplier Cari nilai maksimum/minimum f(x, y, z) = x + 2 y +3 z yang memenuhi x 2 + y 2 = 2 dan y +z = 1 g 1(x, y, z) = x 2 + y 2 -2 =0 g 2(x, y, z) = y + z – 1 = 0 Solusi masalah maks/minimum diperoleh dari: f(x, y, z) = 1 g 1(x, y, z) + 2 g 2(x, y, z)

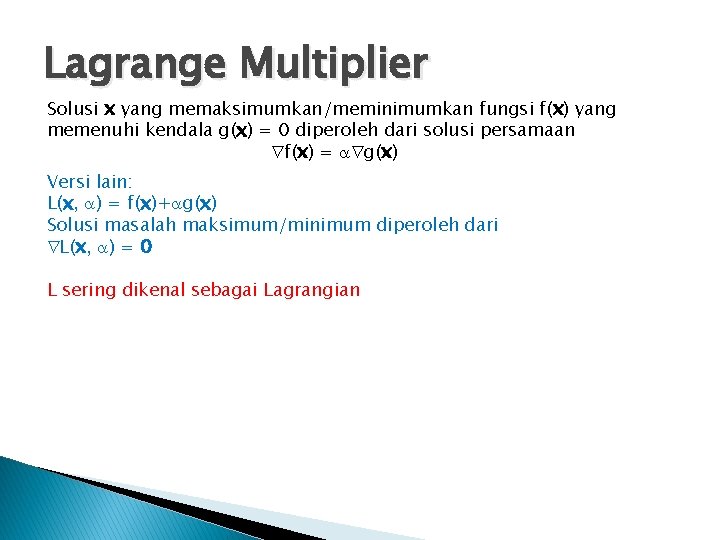

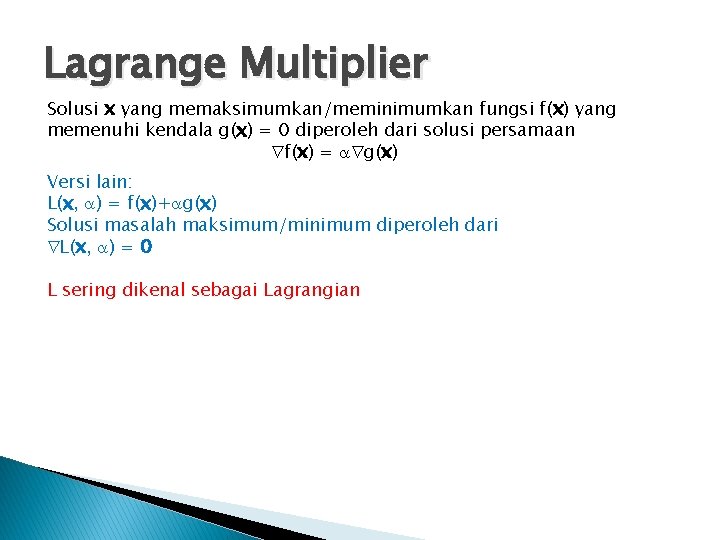

Lagrange Multiplier Solusi x yang memaksimumkan/meminimumkan fungsi f(x) yang memenuhi kendala g(x) = 0 diperoleh dari solusi persamaan f(x) = g(x) Versi lain: L(x, ) = f(x)+ g(x) Solusi masalah maksimum/minimum diperoleh dari L(x, ) = 0 L sering dikenal sebagai Lagrangian

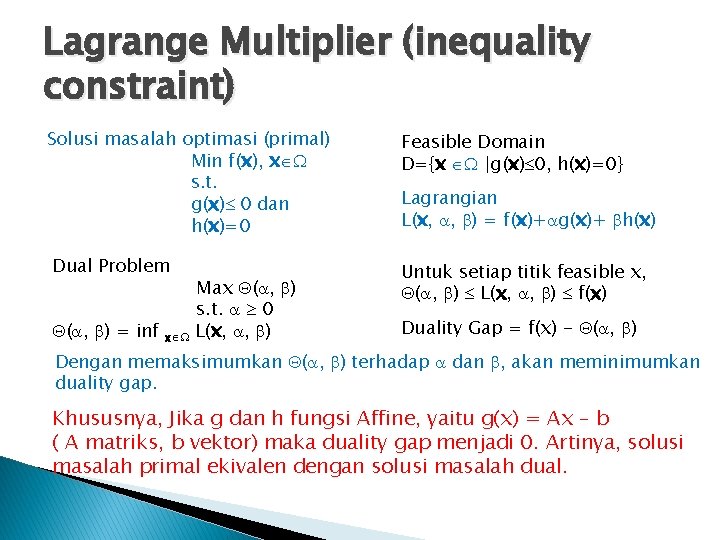

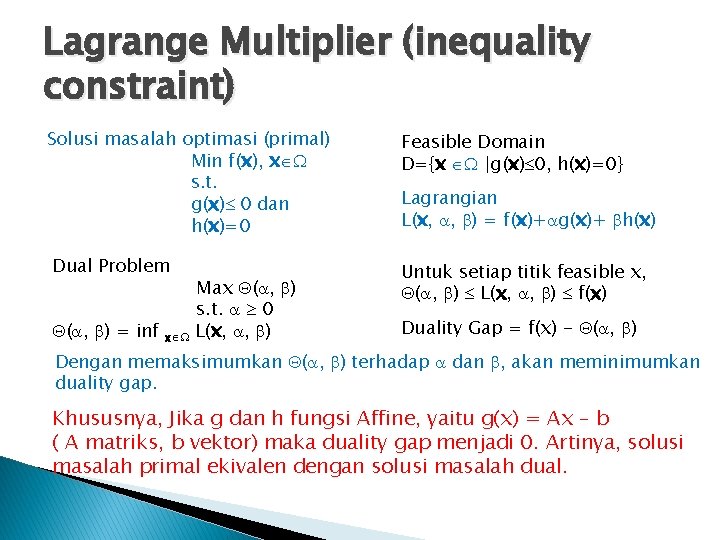

Lagrange Multiplier (inequality constraint) Solusi masalah optimasi (primal) Min f(x), x s. t. g(x) 0 dan h(x)=0 Dual Problem ( , ) = inf x Max ( , ) s. t. 0 L(x, , ) Feasible Domain D={x |g(x) 0, h(x)=0} Lagrangian L(x, , ) = f(x)+ g(x)+ h(x) Untuk setiap titik feasible x, ( , ) L(x, , ) f(x) Duality Gap = f(x) - ( , ) Dengan memaksimumkan ( , ) terhadap dan , akan meminimumkan duality gap. Khususnya, Jika g dan h fungsi Affine, yaitu g(x) = Ax – b ( A matriks, b vektor) maka duality gap menjadi 0. Artinya, solusi masalah primal ekivalen dengan solusi masalah dual.

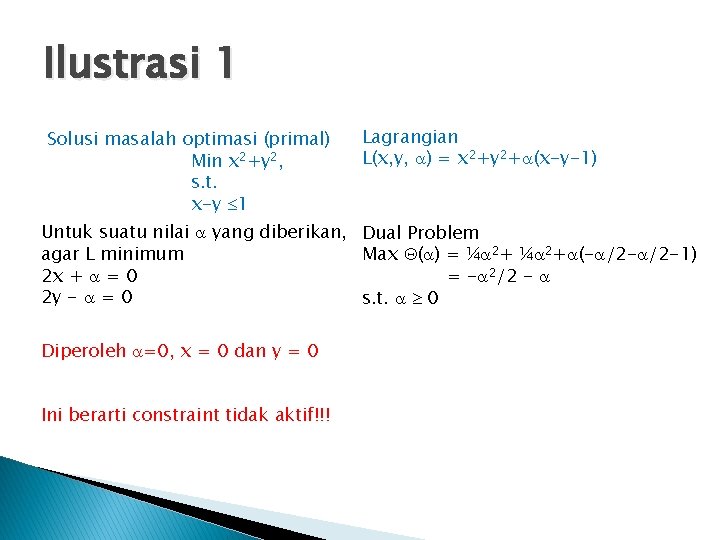

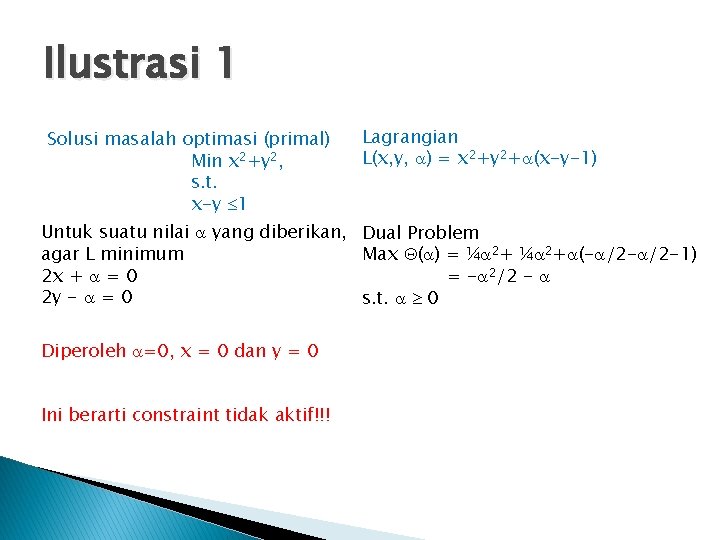

Ilustrasi 1 Solusi masalah optimasi (primal) Min x 2+y 2, s. t. x-y 1 Lagrangian L(x, y, ) = x 2+y 2+ (x-y-1) Untuk suatu nilai yang diberikan, Dual Problem agar L minimum Max ( ) = ¼ 2+ (- /2 -1) 2 x + = 0 = - 2/2 - 2 y - = 0 s. t. 0 Diperoleh =0, x = 0 dan y = 0 Ini berarti constraint tidak aktif!!!

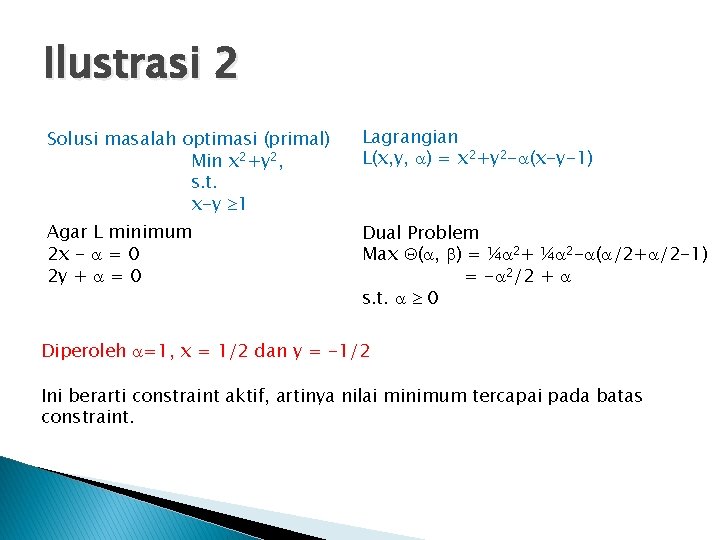

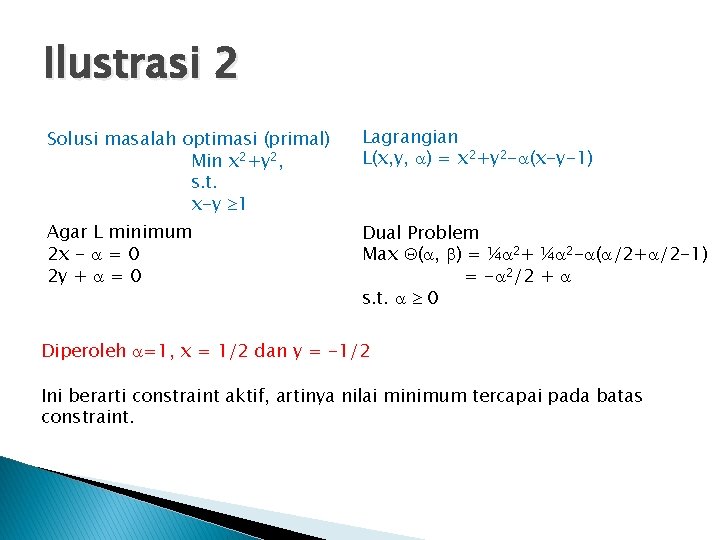

Ilustrasi 2 Solusi masalah optimasi (primal) Min x 2+y 2, s. t. x-y 1 Lagrangian L(x, y, ) = x 2+y 2 - (x-y-1) Agar L minimum 2 x - = 0 2 y + = 0 Dual Problem Max ( , ) = ¼ 2+ ¼ 2 - ( /2+ /2 -1) = - 2/2 + s. t. 0 Diperoleh =1, x = 1/2 dan y = -1/2 Ini berarti constraint aktif, artinya nilai minimum tercapai pada batas constraint.

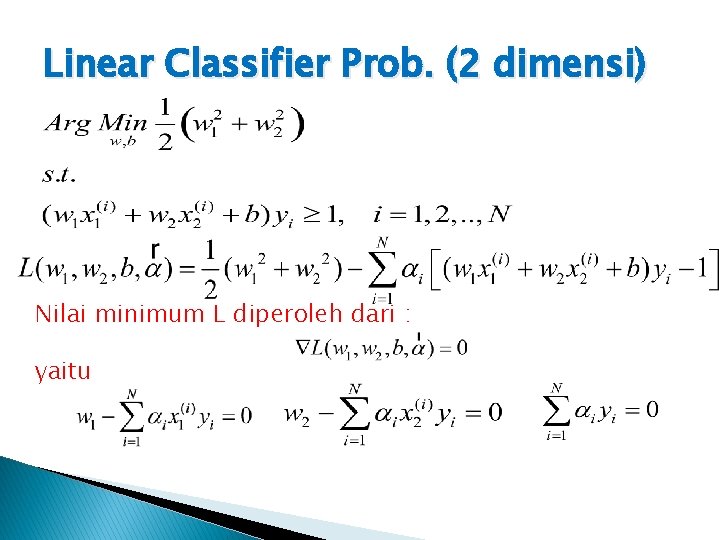

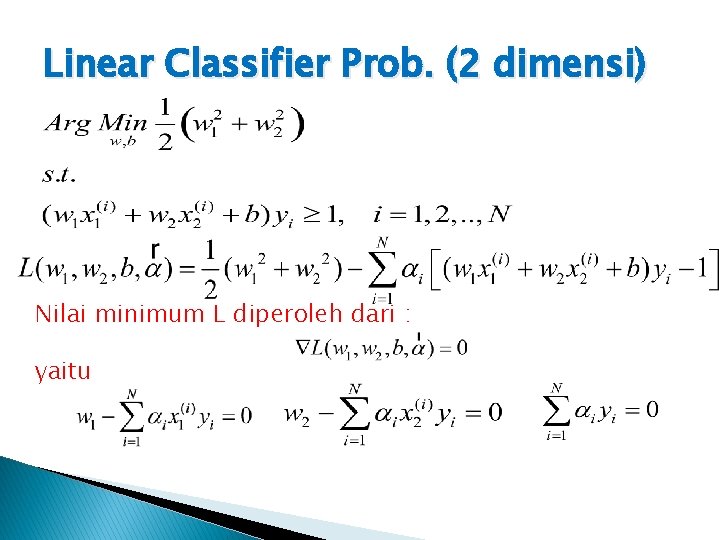

Linear Classifier Prob. (2 dimensi) Nilai minimum L diperoleh dari : yaitu

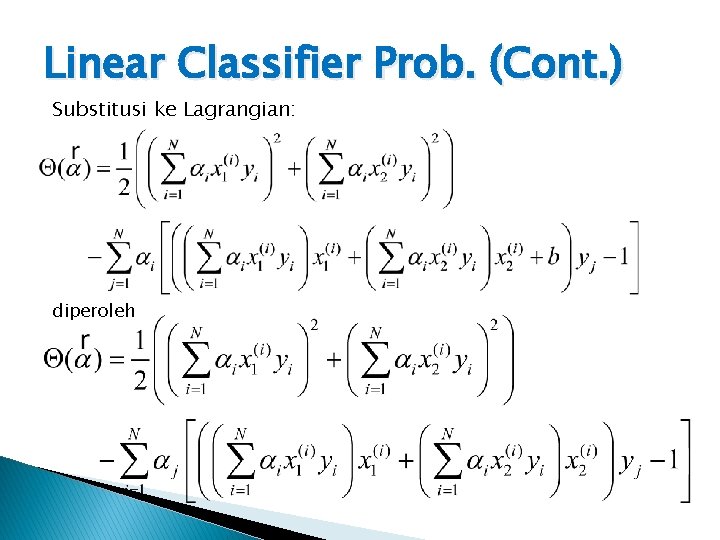

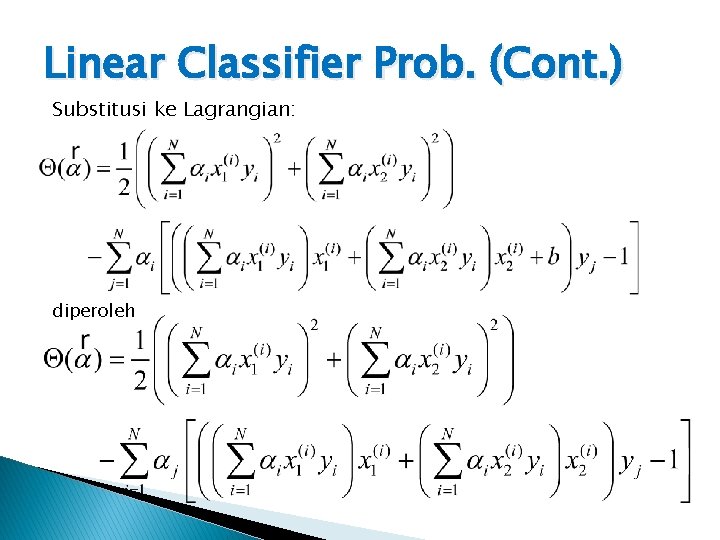

Linear Classifier Prob. (Cont. ) Substitusi ke Lagrangian: diperoleh

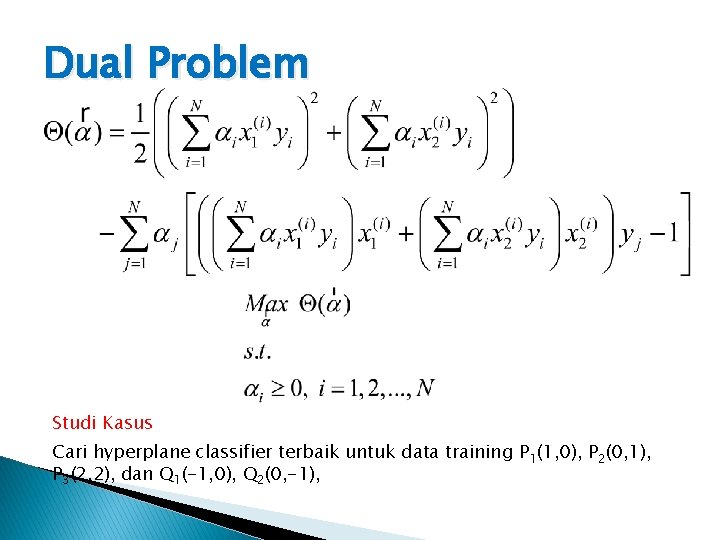

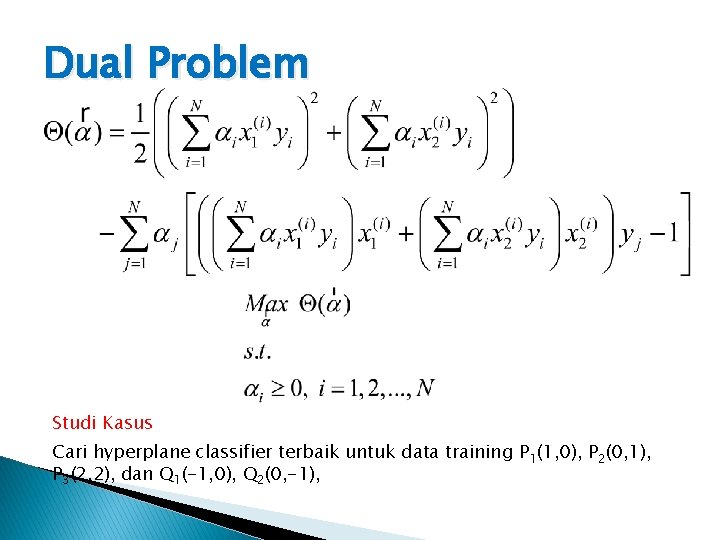

Dual Problem Studi Kasus Cari hyperplane classifier terbaik untuk data training P 1(1, 0), P 2(0, 1), P 3(2, 2), dan Q 1(-1, 0), Q 2(0, -1),

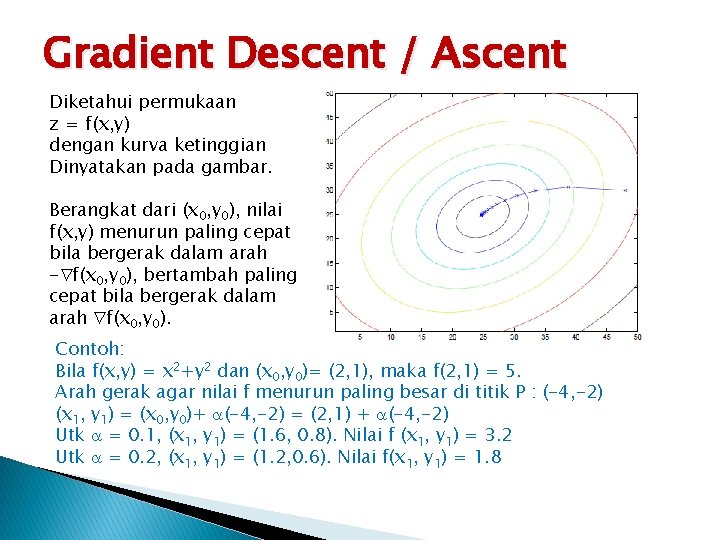

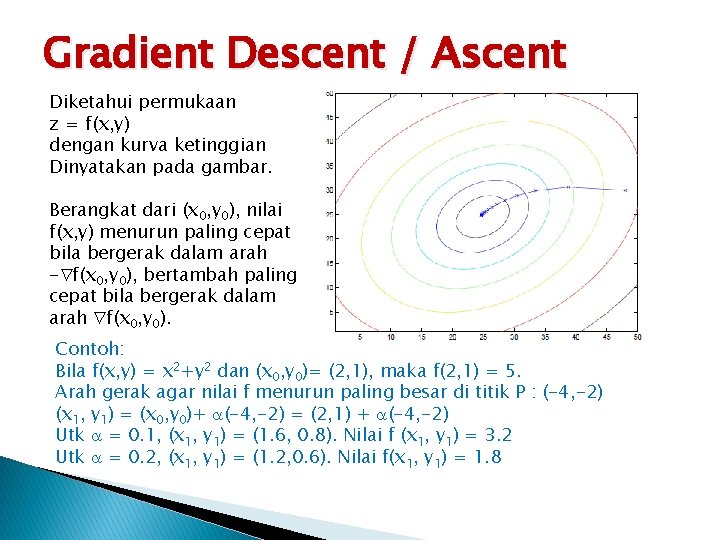

Gradient Descent / Ascent Diketahui permukaan z = f(x, y) dengan kurva ketinggian Dinyatakan pada gambar. Berangkat dari (x 0, y 0), nilai f(x, y) menurun paling cepat bila bergerak dalam arah - f(x 0, y 0), bertambah paling cepat bila bergerak dalam arah f(x 0, y 0). Contoh: Bila f(x, y) = x 2+y 2 dan (x 0, y 0)= (2, 1), maka f(2, 1) = 5. Arah gerak agar nilai f menurun paling besar di titik P : (-4, -2) (x 1, y 1) = (x 0, y 0)+ (-4, -2) = (2, 1) + (-4, -2) Utk = 0. 1, (x 1, y 1) = (1. 6, 0. 8). Nilai f (x 1, y 1) = 3. 2 Utk = 0. 2, (x 1, y 1) = (1. 2, 0. 6). Nilai f(x 1, y 1) = 1. 8