Kommunikationstechnik B Teil 4 Informationstheorie Stephan Rupp Nachrichtentechnik

Kommunikationstechnik B Teil 4 – Informationstheorie Stephan Rupp Nachrichtentechnik www. dhbw-stuttgart. de Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 4. Semester, Nachrichtentechnik, 2014

Inhalt Informationstheorie • Einführung • Information und Wahrscheinlichkeit • Entropie • Entscheidungsgehalt • Redundanz Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 2 4. Semester, Nachrichtentechnik, 2014

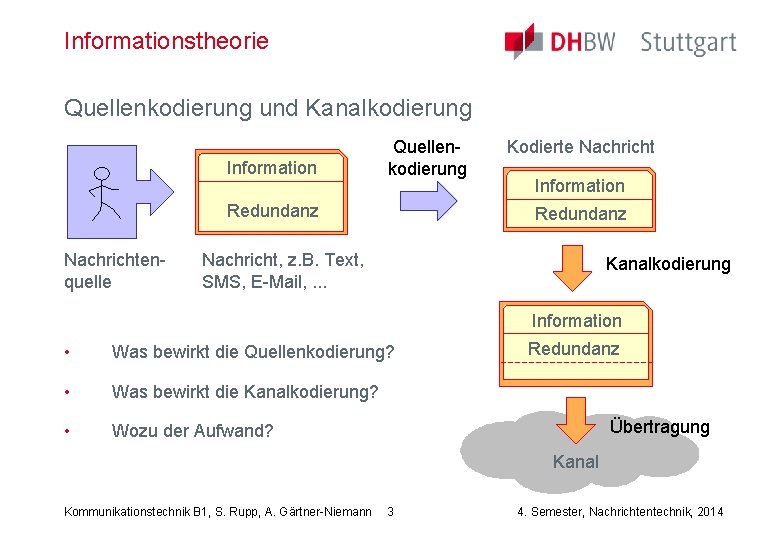

Informationstheorie Quellenkodierung und Kanalkodierung Information Quellenkodierung Redundanz Nachrichtenquelle Kodierte Nachricht Information Redundanz Nachricht, z. B. Text, SMS, E-Mail, . . . Kanalkodierung Information • Was bewirkt die Quellenkodierung? • Was bewirkt die Kanalkodierung? • Wozu der Aufwand? Redundanz Übertragung Kanal Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 3 4. Semester, Nachrichtentechnik, 2014

Inhalt Informationstheorie • Einführung • Information und Wahrscheinlichkeit • Entropie • Entscheidungsgehalt • Redundanz Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 4 4. Semester, Nachrichtentechnik, 2014

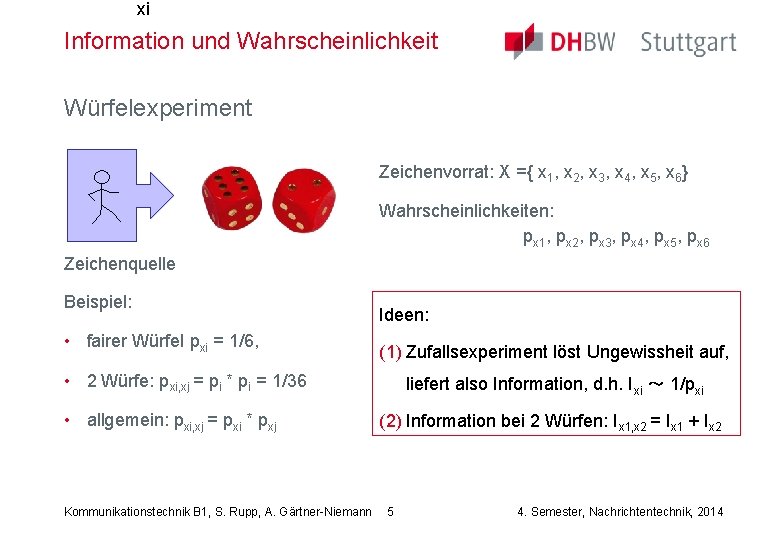

xi Information und Wahrscheinlichkeit Würfelexperiment Zeichenvorrat: X ={ x 1, x 2, x 3, x 4, x 5, x 6} Wahrscheinlichkeiten: px 1, px 2, px 3, px 4, px 5, px 6 Zeichenquelle Beispiel: • fairer Würfel pxi = 1/6, Ideen: (1) Zufallsexperiment löst Ungewissheit auf, • 2 Würfe: pxi, xj = pi * pi = 1/36 • allgemein: pxi, xj = pxi * pxj Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann liefert also Information, d. h. Ixi ~ 1/pxi (2) Information bei 2 Würfen: Ix 1, x 2 = Ix 1 + Ix 2 5 4. Semester, Nachrichtentechnik, 2014

Information und Wahrscheinlichkeit Information eines Zeichens • Definition: Ixi = ld(1/pxi) = - ld(pxi) • Masseinheit: bit • Beispiele: – binäres Zeichen X={0, 1}: pxi = 2 -1 => Information = 1 bit – hexadezimales Zeichen: ? – dezimales Zeichen? – Würfel? – Zeichen im BDC-Format? Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 6 4. Semester, Nachrichtentechnik, 2014

Inhalt Informationstheorie • Einführung • Information und Wahrscheinlichkeit • Entropie • Entscheidungsgehalt • Redundanz Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 7 4. Semester, Nachrichtentechnik, 2014

Entropie Informationsgehalt einer Zeichenquelle Beispiel: Zeichenvorrat: X ={ x 1, x 2, x 3, x 4, x 5, x 6} Wahrscheinlichkeiten: px 1, px 2, px 3, px 4, px 5, px 6 Zeichenquelle Definition: Entropie H(X) = ∑ pi Ii = - ∑ pi ld(pi) • Informationsgehalt der Quelle = • Information aller Zeichen • gewichtet mit deren Wahrscheinlichkeit Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 8 Ü 4. 6 -. 12 4. Semester, Nachrichtentechnik, 2014

Inhalt Informationstheorie • Einführung • Information und Wahrscheinlichkeit • Entropie • Entscheidungsgehalt • Redundanz Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 9 4. Semester, Nachrichtentechnik, 2014

Entscheidungsgehalt Wann ist die Entropie einer Quelle maximal? Beispiel: Zeichenvorrat: X ={ x 1, x 2, x 3, x 4, x 5, x 6} Wahrscheinlichkeiten: px 1, px 2, px 3, px 4, px 5, px 6 Zeichenquelle Definition: Entscheidungsgehalt H 0 = maximale Entropie Beispiele: • fairer Würfel pxi = 1/6: H 0 = ? • Quelle mit 10 Zeichen? Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 10 4. Semester, Nachrichtentechnik, 2014

Inhalt Informationstheorie • Einführung • Information und Wahrscheinlichkeit • Entropie • Entscheidungsgehalt • Redundanz Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 11 4. Semester, Nachrichtentechnik, 2014

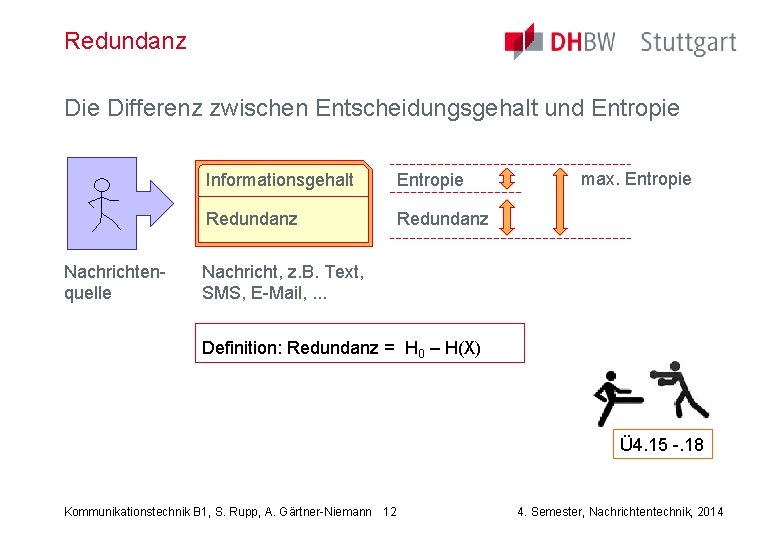

Redundanz Die Differenz zwischen Entscheidungsgehalt und Entropie Nachrichtenquelle Informationsgehalt Entropie Redundanz max. Entropie Nachricht, z. B. Text, SMS, E-Mail, . . . Definition: Redundanz = H 0 – H(X) Ü 4. 15 -. 18 Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 12 4. Semester, Nachrichtentechnik, 2014

Kommunikationstechnik B ENDE Teil 4 Kommunikationstechnik B 1, S. Rupp, A. Gärtner-Niemann 13 4. Semester, Nachrichtentechnik, 2014

- Slides: 13