JST PERCEPTRON Metode pelatihan Perceptron lebih kuat dari

JST PERCEPTRON

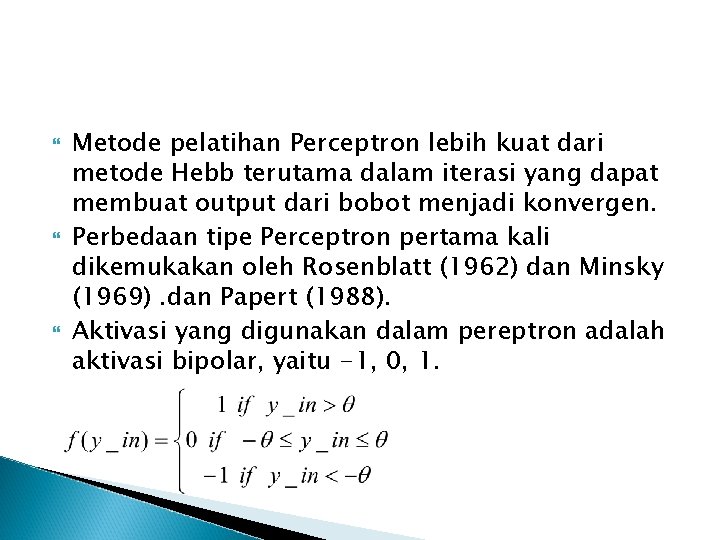

Metode pelatihan Perceptron lebih kuat dari metode Hebb terutama dalam iterasi yang dapat membuat output dari bobot menjadi konvergen. Perbedaan tipe Perceptron pertama kali dikemukakan oleh Rosenblatt (1962) dan Minsky (1969). dan Papert (1988). Aktivasi yang digunakan dalam pereptron adalah aktivasi bipolar, yaitu -1, 0, 1.

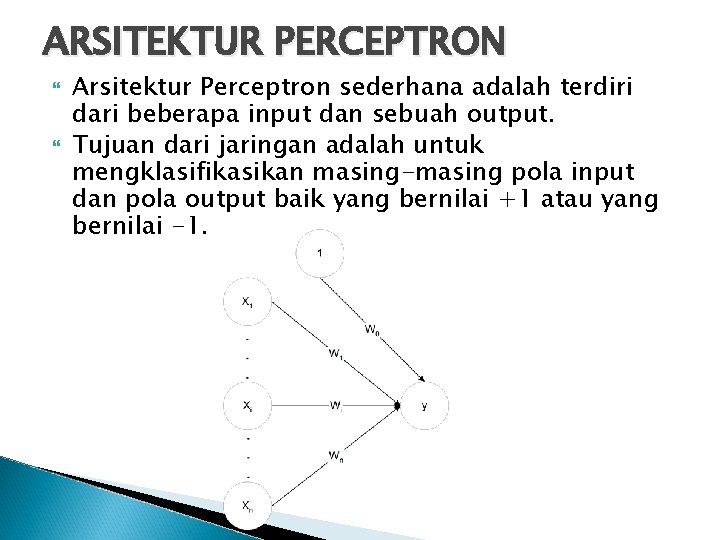

ARSITEKTUR PERCEPTRON Arsitektur Perceptron sederhana adalah terdiri dari beberapa input dan sebuah output. Tujuan dari jaringan adalah untuk mengklasifikasikan masing-masing pola input dan pola output baik yang bernilai +1 atau yang bernilai -1.

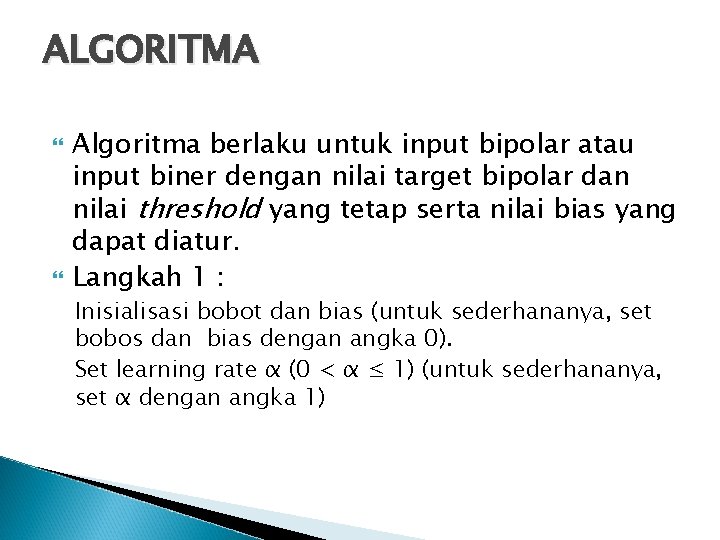

ALGORITMA Algoritma berlaku untuk input bipolar atau input biner dengan nilai target bipolar dan nilai threshold yang tetap serta nilai bias yang dapat diatur. Langkah 1 : Inisialisasi bobot dan bias (untuk sederhananya, set bobos dan bias dengan angka 0). Set learning rate α (0 < α ≤ 1) (untuk sederhananya, set α dengan angka 1)

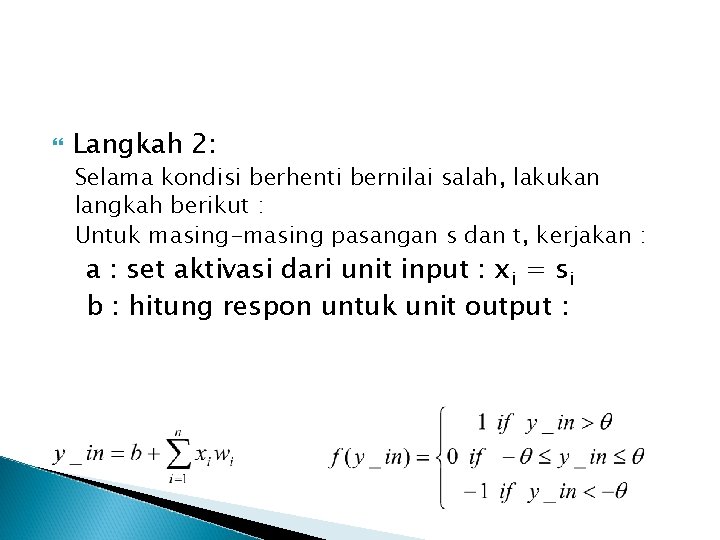

Langkah 2: Selama kondisi berhenti bernilai salah, lakukan langkah berikut : Untuk masing-masing pasangan s dan t, kerjakan : a : set aktivasi dari unit input : xi = si b : hitung respon untuk unit output :

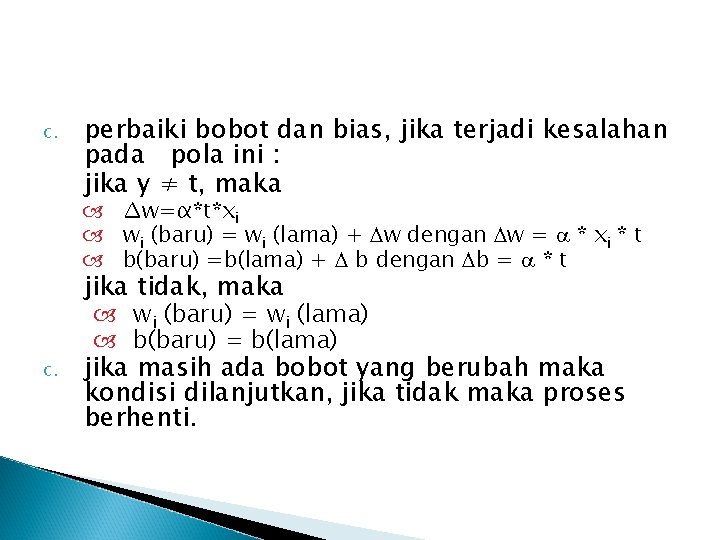

c. perbaiki bobot dan bias, jika terjadi kesalahan pada pola ini : jika y ≠ t, maka ∆w=α*t*xi wi (baru) = wi (lama) + w dengan w = * xi * t b(baru) =b(lama) + b dengan b = * t jika tidak, maka c. wi (baru) = wi (lama) b(baru) = b(lama) jika masih ada bobot yang berubah maka kondisi dilanjutkan, jika tidak maka proses berhenti.

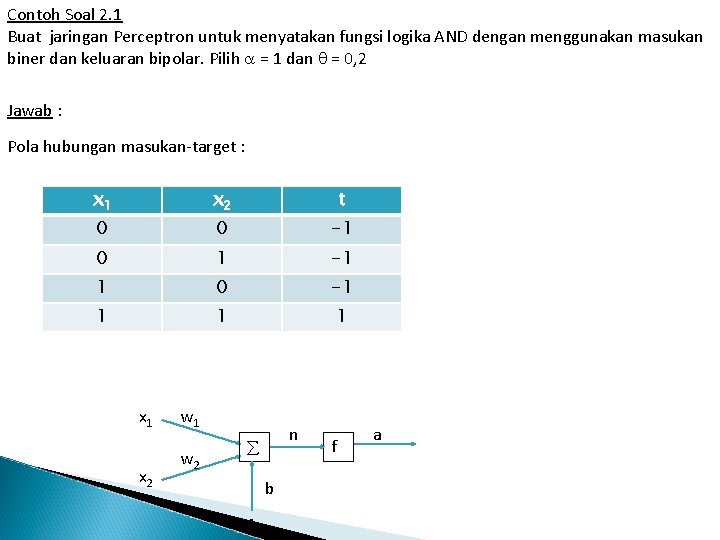

Contoh Soal 2. 1 Buat jaringan Perceptron untuk menyatakan fungsi logika AND dengan menggunakan masukan biner dan keluaran bipolar. Pilih = 1 dan = 0, 2 Jawab : Pola hubungan masukan-target : x 1 x 2 0 -1 0 1 -1 1 0 x 1 x 2 t w 1 w 2 n b 1 f a

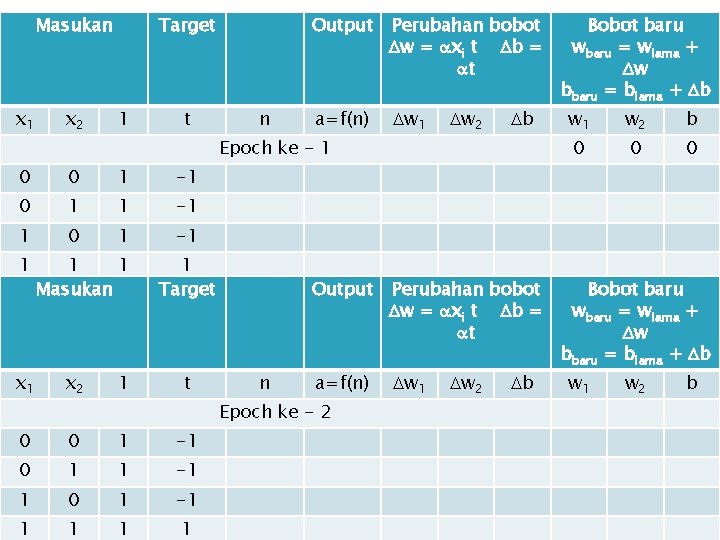

Masukan Target x 1 x 2 1 0 0 1 -1 0 1 1 -1 1 0 1 -1 1 t n Output Perubahan bobot w = xi t b = t a=f(n) w 1 Epoch ke - 1 1 1 Masukan 1 Target x 1 x 2 1 t 0 0 1 -1 0 1 1 -1 1 0 1 -1 1 1 n w 2 b Perubahan bobot w = xi t b = t a=f(n) w 1 Epoch ke - 2 w 1 0 Output w 2 Bobot baru wbaru = wlama + w bbaru = blama + b b w 2 0 b 0 Bobot baru wbaru = wlama + w bbaru = blama + b w 1 w 2 b

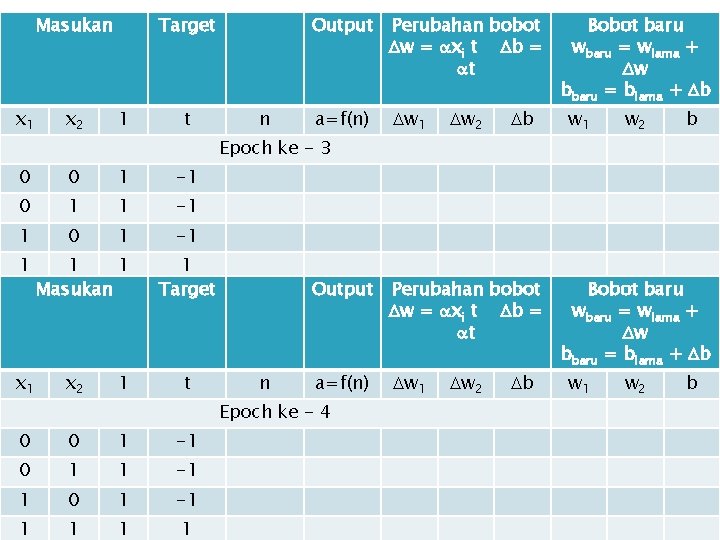

Masukan Target x 1 x 2 1 0 0 1 -1 0 1 1 -1 1 0 1 -1 1 t n Output Perubahan bobot w = xi t b = t a=f(n) w 1 Epoch ke - 3 1 1 Masukan 1 Target x 1 x 2 1 t 0 0 1 -1 0 1 1 -1 1 0 1 -1 1 1 n w 2 b Output Perubahan bobot w = xi t b = t a=f(n) w 1 Epoch ke - 4 w 2 b Bobot baru wbaru = wlama + w bbaru = blama + b w 1 w 2 b

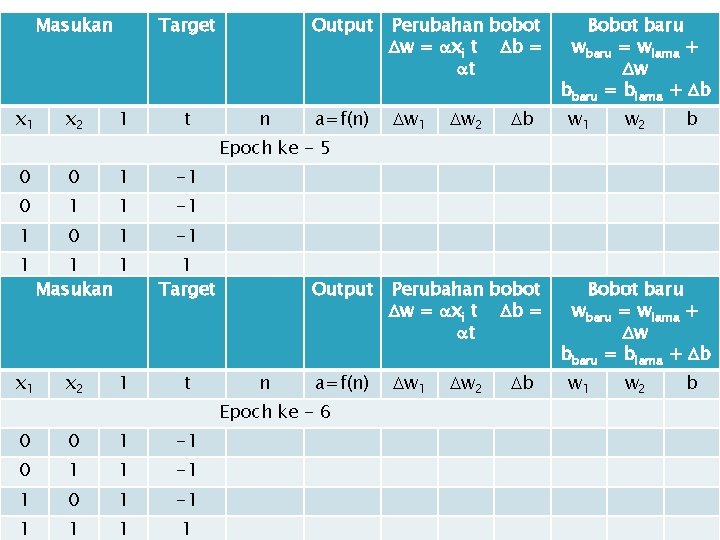

Masukan Target x 1 x 2 1 0 0 1 -1 0 1 1 -1 1 0 1 -1 1 t n Output Perubahan bobot w = xi t b = t a=f(n) w 1 Epoch ke - 5 1 1 Masukan 1 Target x 1 x 2 1 t 0 0 1 -1 0 1 1 -1 1 0 1 -1 1 1 n w 2 b Output Perubahan bobot w = xi t b = t a=f(n) w 1 Epoch ke - 6 w 2 b Bobot baru wbaru = wlama + w bbaru = blama + b w 1 w 2 b

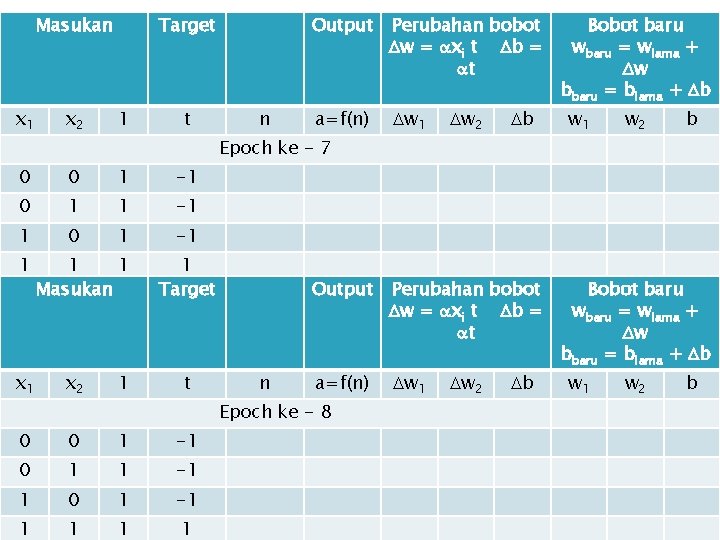

Masukan Target x 1 x 2 1 0 0 1 -1 0 1 1 -1 1 0 1 -1 1 t n Output Perubahan bobot w = xi t b = t a=f(n) w 1 Epoch ke - 7 1 1 Masukan 1 Target x 1 x 2 1 t 0 0 1 -1 0 1 1 -1 1 0 1 -1 1 1 n w 2 b Output Perubahan bobot w = xi t b = t a=f(n) w 1 Epoch ke - 8 w 2 b Bobot baru wbaru = wlama + w bbaru = blama + b w 1 w 2 b

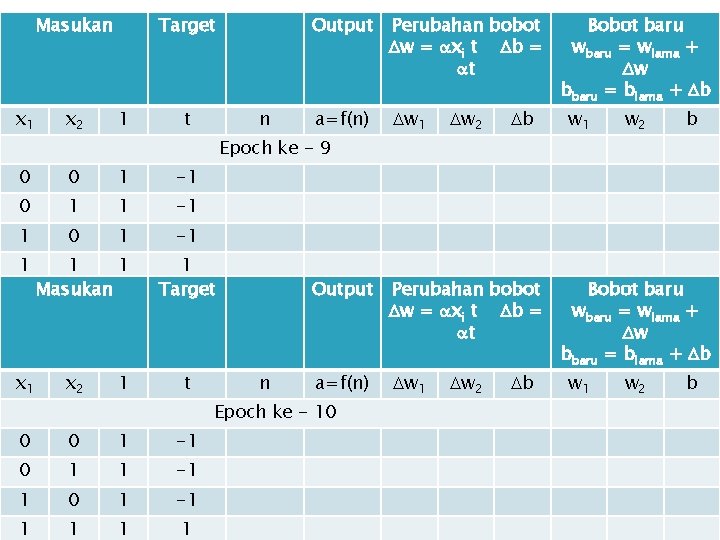

Masukan Target x 1 x 2 1 0 0 1 -1 0 1 1 -1 1 0 1 -1 1 t n Output Perubahan bobot w = xi t b = t a=f(n) w 1 Epoch ke - 9 1 1 Masukan 1 Target x 1 x 2 1 t 0 0 1 -1 0 1 1 -1 1 0 1 -1 1 1 n w 2 b Output Perubahan bobot w = xi t b = t a=f(n) w 1 Epoch ke - 10 w 2 b Bobot baru wbaru = wlama + w bbaru = blama + b w 1 w 2 b

Iterasi akan di hentikan pada epoch ke 10 karena fnet sudah sama dengan target nya

Latihan Soal 2. 2 Buat jaringan Perceptron untuk mengenali pola pada tabel di bawah ini. Gunaka = 1 dan = 0, 1. x 1 x 2 x 3 1 -1 1 0 1 -1 1 1 0 Jawab : 1 Masukan Target Output t a x 1 x 2 x 3 1 0 1 1 1 -1 1 0 1 1 -1 1 1 0 1 -1 1 1 t Perubahan bobot w = xi t b = t Bobot baru wbaru = wlama + w bbaru = blama + b w 1 w 2 w 3 Inisialisasi b 0 w 2 0 w 3 0 b 0

- Slides: 15