Introduccina la Estadstica Inferencia n Prueba t n

Introduccióna la Estadística Inferencia n Prueba t n Prueba de Mann-Whitney n Prueba de Chi-cuadrado n Tablas de Contingencia n

Estadística Inferential Inferencia: el proceso de hacer aseveraciones lógicos sobre lo desconocido en base a alguna evidencia comprobable En estadística: sacar conclusiones sobre una población basado en muestras tomadas de esa población

Población Un grupo de organismos o cosas bajo estudio. Es el grupo que se está estudiando acerca del cual se quiere sacar conclusiones

Muestras Una selección de organismos o cosas del grupo (población) bajo estudio. Si poder examinar todos los individuos de una población, la muestra es lo que se usa para inferir algo sobre el grupo (población).

Muestras Consideraciones sobre las muestras • Al azar • Tamaño • Replicación vs pseudo-replicación • Estructura en la población

Muestras: Al azar • Cada individuo de la población debe tener la misma probabilidad ser escogido en cada momento • Excepciones: • Cuando hay estructura en la población (ej. geográfica, demográfica) y se quiere asegurar que hay una representación balanceada) • Cuando un individuo no puede ser devuelto a la población

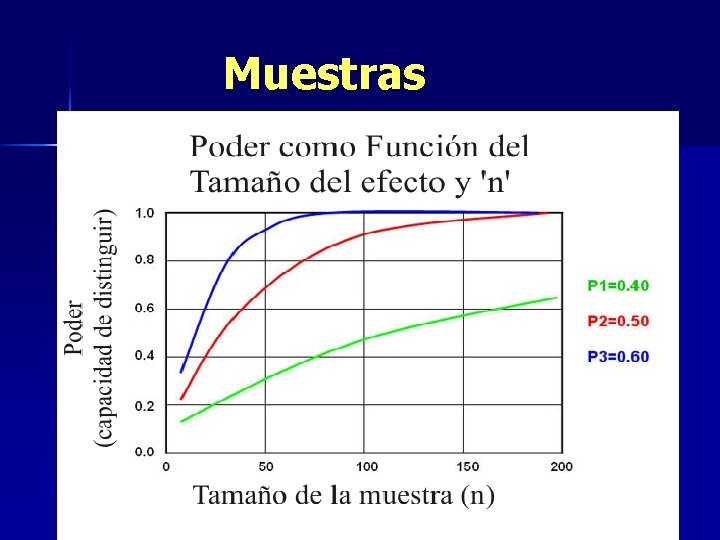

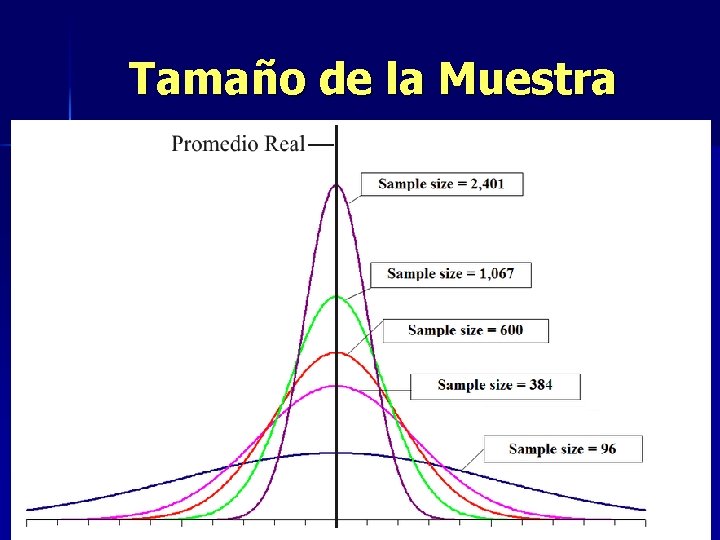

Muestras: Tamaño de la muestra • Cual de ser el tamaño de mi muestra? vs. Cual es el tamaño mínimo de mi muestra? • Capacidad de detectar una diferencia significativa • Factores de para tomar en cuenta: • Variación entre individuos (bulla ‘noise’, error, ‘e’) • Magnitud del señal • Nivel de significancia aplicada o deseada • Costo/beneficio

Muestras: Replicación vs pseudo-replicación • • Cada individuo de la población debe tener la misma probabilidad ser escogido en cada momento Pseudo-replicación ocurre cuando las muestras estén agrupado en una manera no previsto en el diseño experimental • Ej. Partes de un pastel, huevos en una incubadora

Muestras: Estructura de una población • Ej. Genero, distribución geográfica/demográfica, genética, etc. • Consecuencia: puede ocultar efectos, o su importancia puede ser perdida, si el diseño del experimento no la toma en cuenta • El ‘poder’ de un experimento para detectar estructura y su naturaleza en maximizado cuando hay igual representación de los diferentes subpoblaciones.

Hipótesis de una Inferencia Estadística En la estadística queremos sacar conclusiones generalizados sobre una población. Generalmente las inferencias son declaraciones sobre diferencias. En estadística el tipo de inferencia se establece formalmente usando dos tipos de declaraciones mutualmente exclusivas, o hipótesis conocidos como la Hipótesis Nula (Ho) y la Hipótesis Alternative (Ha).

Hipótesis Nula (Ho) Generalmente una declaración de no haber una diferencia y es la versión que se aceptará a menos que se tenga suficiente evidencia para rechazarla y aceptar Ha Hipótesis Alternativa (Ha) Generalmente una declaración de no haber una diferencia y es la versión que se aceptará a menos que se tenga suficiente evidencia para rechazarla y aceptar Ha

Significancia El hecho de haber encontrado suficiente evidencia en una muestra para rechazar la versión de realidad que llamamos Ho en favor de Ha. A menos que se tenga suficiente evidencia de lo contrario se debe aceptar Ho – que no hay una diferencia o un efecto.

‘Probar’ No rechazar Ho NO es lo mismo de PROBAR que Ho es VERDADERA. Aceptar Ha (rechazar Ha) NO es lo mismo que PROBAR que Ha es VERDADERA. Por qué? Porque todo el proceso de inferencia estadística está basado en tratar de hacer declaraciones sobre muchos individuos (la población) en base a apenas unos cuantos.

Modelos Otra manera de pensar sobre la Inferencia Estadística es el concepto de Modelos La Hipótesis Alternativa es equivalente de lo que los científicos llaman un Modelo Un modelo es una descripción de la realidad. Puede ser simple o muy complejo. La interferencia estadística es una herramienta para investigar la certeza de los modelos.

Erroresde una Inferencia Estadística El rechazo de Ho cuando Ho es verdadero (no hay diferencia) se conoce como Error Tipo I El rechazo de Ha cuando Ha es verdadero (hay diferencia) se conoce como Error Tipo II La probabilidad de cometer Error Tipo I es conocido como el nivel de significancia de la prueba y se le da el símbolo a La probabilidad de cometer Error Tipo II se le da el símbolo b y su valor nunca se sabe

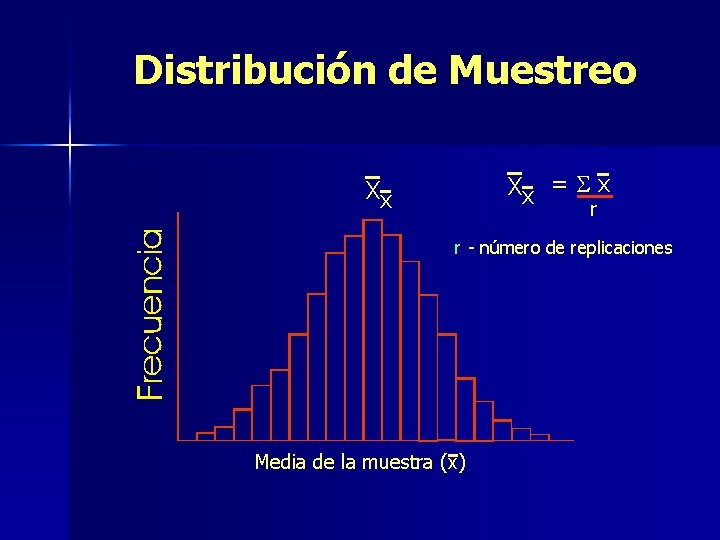

Distribución de Muestreo Xx = S x Xx r r - número de replicaciones Media de la muestra (x)

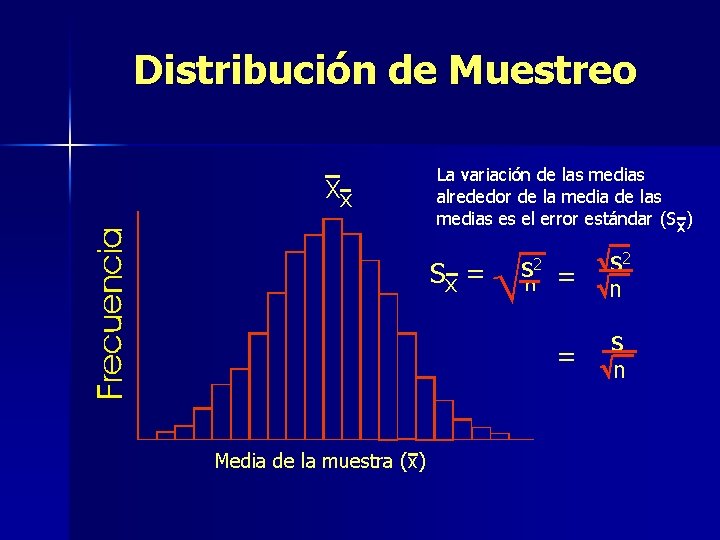

Distribución de Muestreo Xx La variación de las medias alrededor de la media de las medias es el error estándar (Sx) Sx = Ö 2 Ö s sn = Ön 2 s = Ön Media de la muestra (x)

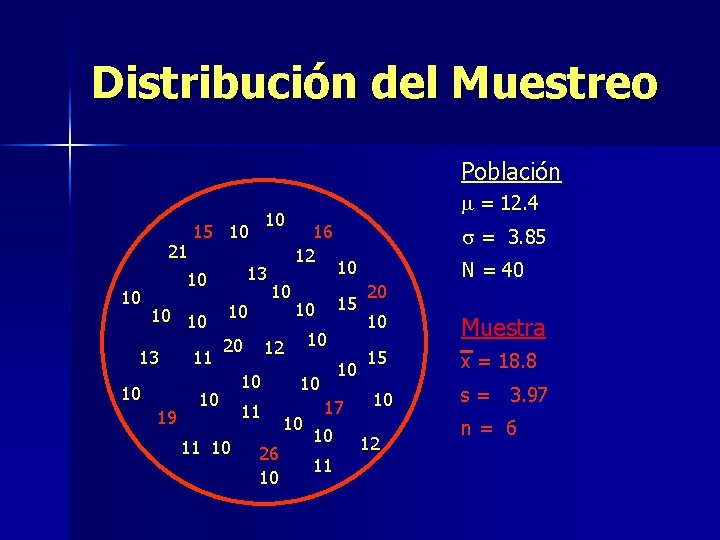

Distribución del Muestreo Población 21 10 13 10 10 10 13 10 19 10 15 10 11 10 20 10 11 10 10 m = 12. 4 16 12 11 26 10 10 15 10 10 12 10 s = 3. 85 10 10 10 17 10 11 20 N = 40 10 Muestra 15 x = 18. 8 10 12 s = 3. 97 n= 6

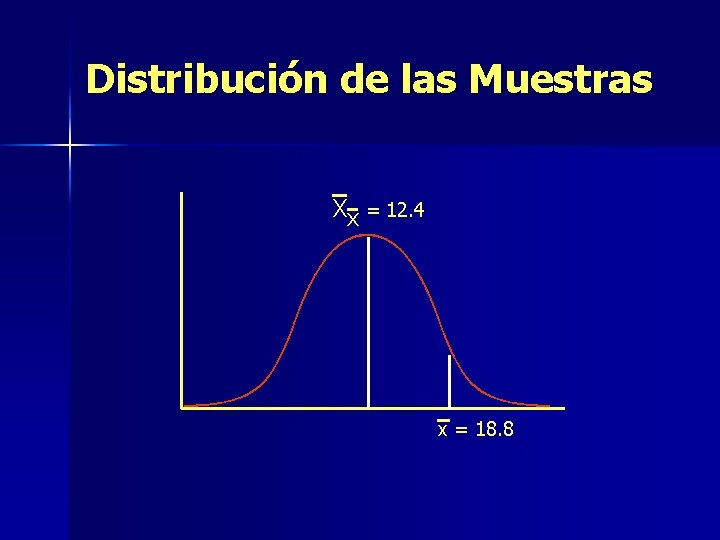

Distribución de las Muestras Xx = 12. 4 x = 18. 8

Tamaño de la Muestra Xx = 12. 4 x = 18. 8

Hipótesis de Una Muestra sobre la Media Cuando se quiere saber si la media de una población es diferente de algún valor hipotético Sin saber m (el caso usual) es necesario hacer inferencias sobre m basado en x. Ho: No hay una diferencia entre el valor propuesto y m (m = 0) Ho: Hay una diferencia entre el valor propuesto y m (m <>0)

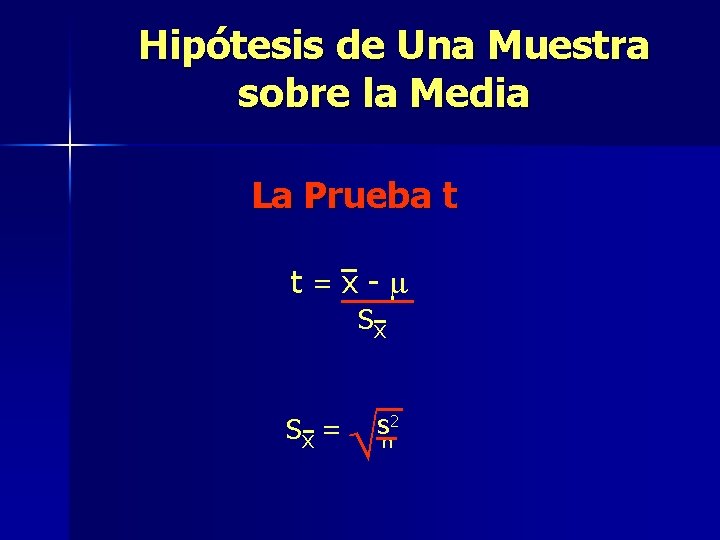

Hipótesis de Una Muestra sobre la Media La Prueba t t=x-m Sx Sx = Ö sn 2

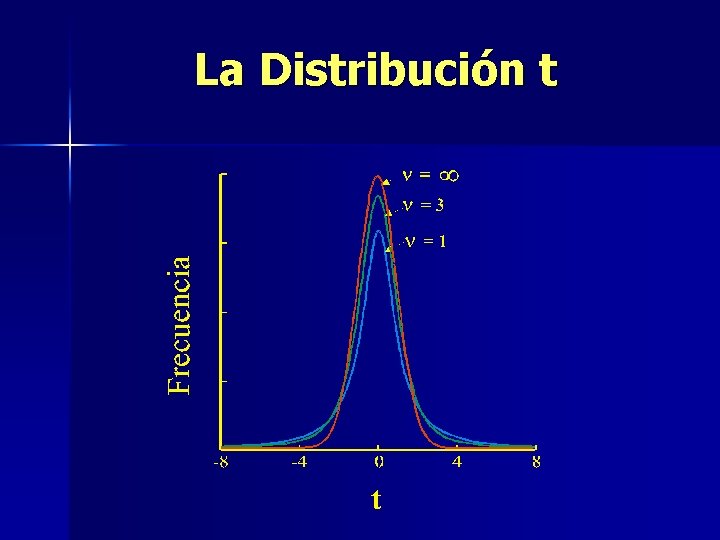

La Distribución t

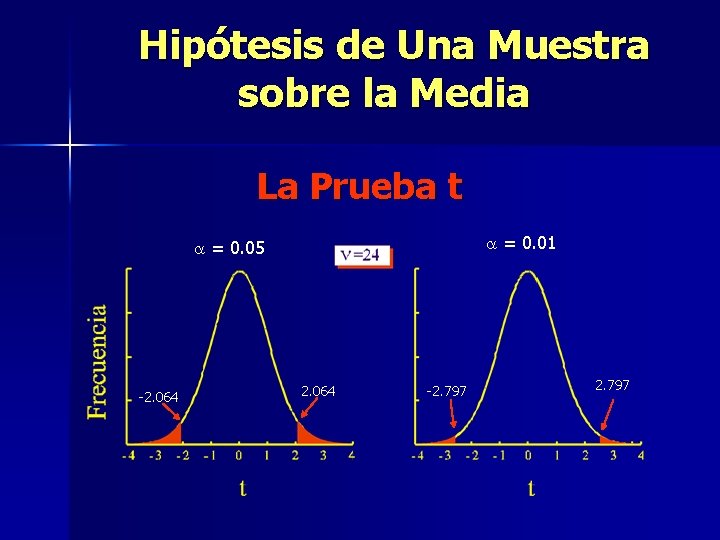

Hipótesis de Una Muestra sobre la Media La Prueba t a = 0. 01 a = 0. 05 -2. 064 -2. 797

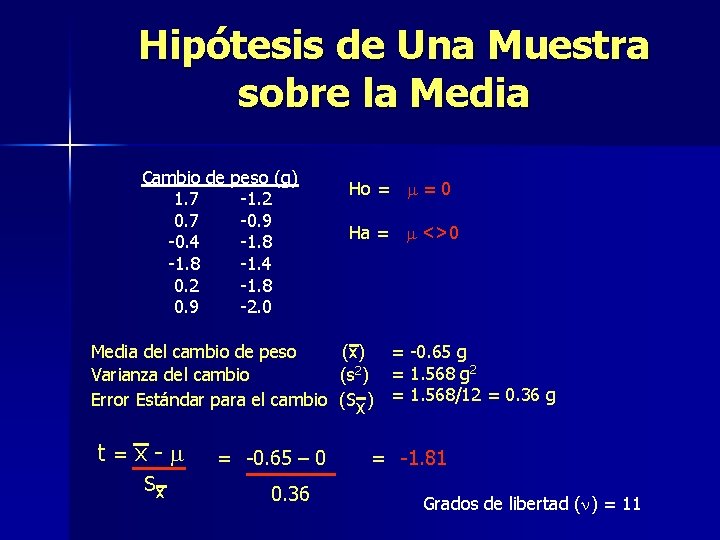

Hipótesis de Una Muestra sobre la Media Cambio de peso (g) 1. 7 -1. 2 0. 7 -0. 9 -0. 4 -1. 8 -1. 4 0. 2 -1. 8 0. 9 -2. 0 Ho = m = 0 Ha = m <>0 Media del cambio de peso (x) = -0. 65 g Varianza del cambio (s 2) = 1. 568 g 2 Error Estándar para el cambio (Sx) = 1. 568/12 = 0. 36 g t=x-m Sx = -0. 65 – 0 0. 36 = -1. 81 Grados de libertad (n) = 11

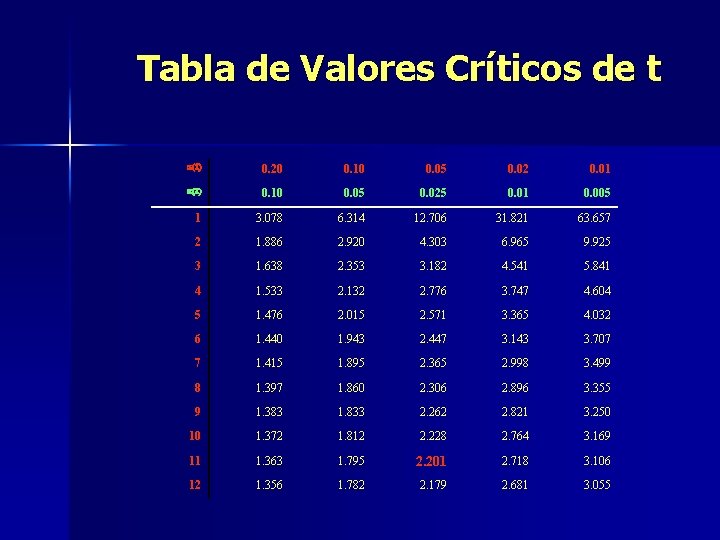

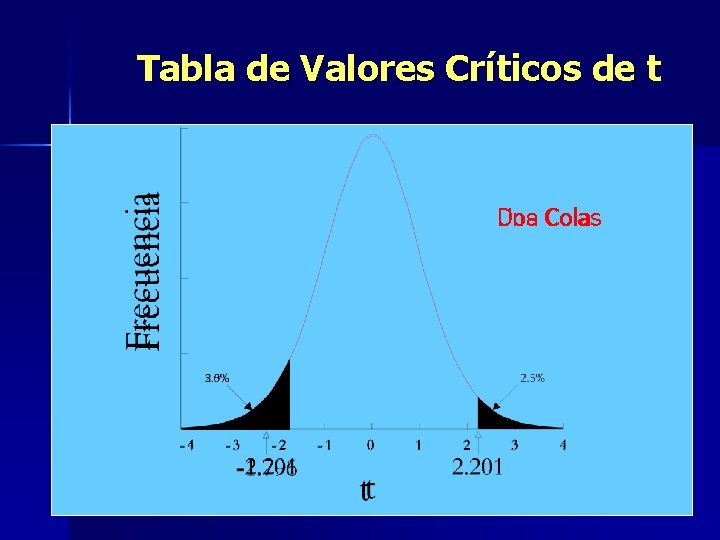

Tabla de Valores Críticos de t a(1) 0. 20 0. 10 0. 05 0. 02 0. 01 a(2) 0. 10 0. 05 0. 025 0. 01 0. 005 1 3. 078 6. 314 12. 706 31. 821 63. 657 2 1. 886 2. 920 4. 303 6. 965 9. 925 3 1. 638 2. 353 3. 182 4. 541 5. 841 4 1. 533 2. 132 2. 776 3. 747 4. 604 5 1. 476 2. 015 2. 571 3. 365 4. 032 6 1. 440 1. 943 2. 447 3. 143 3. 707 7 1. 415 1. 895 2. 365 2. 998 3. 499 8 1. 397 1. 860 2. 306 2. 896 3. 355 9 1. 383 1. 833 2. 262 2. 821 3. 250 10 1. 372 1. 812 2. 228 2. 764 3. 169 11 1. 363 1. 795 2. 201 2. 718 3. 106 12 1. 356 1. 782 2. 179 2. 681 3. 055

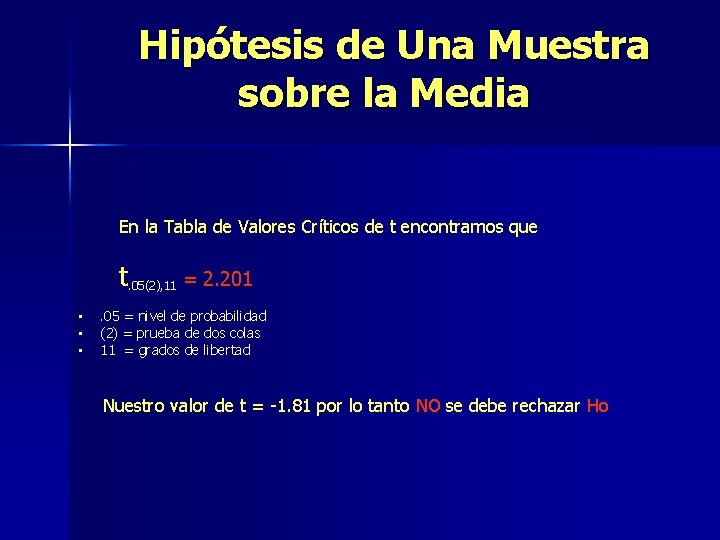

Hipótesis de Una Muestra sobre la Media En la Tabla de Valores Críticos de t encontramos que t. 05(2), 11 = 2. 201 • • • . 05 = nivel de probabilidad (2) = prueba de dos colas 11 = grados de libertad Nuestro valor de t = -1. 81 por lo tanto NO se debe rechazar Ho

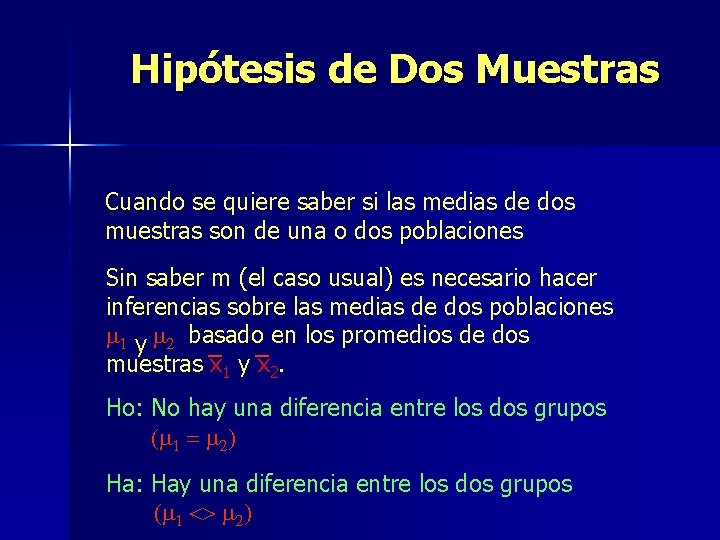

Hipótesis de Dos Muestras Cuando se quiere saber si las medias de dos muestras son de una o dos poblaciones Sin saber m (el caso usual) es necesario hacer inferencias sobre las medias de dos poblaciones m 1 y m 2 basado en los promedios de dos muestras x 1 y x 2. Ho: No hay una diferencia entre los dos grupos (m 1 = m 2) Ha: Hay una diferencia entre los dos grupos (m 1 <> m 2)

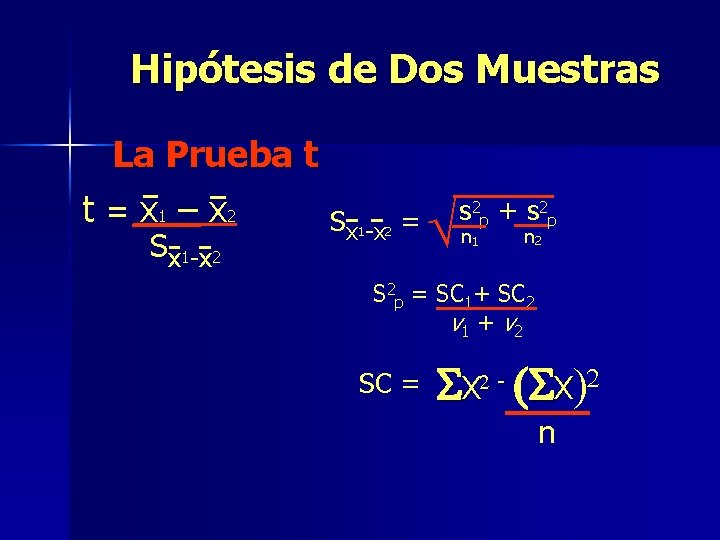

Hipótesis de Dos Muestras La Prueba t t = x 1 – x 2 S Sx 1 -x 2 = Ö s 2 p + s 2 p n 1 n 2 S 2 p = SC 1+ SC 2 v 1 + v 2 SC = S X 2 - (S X )2 n

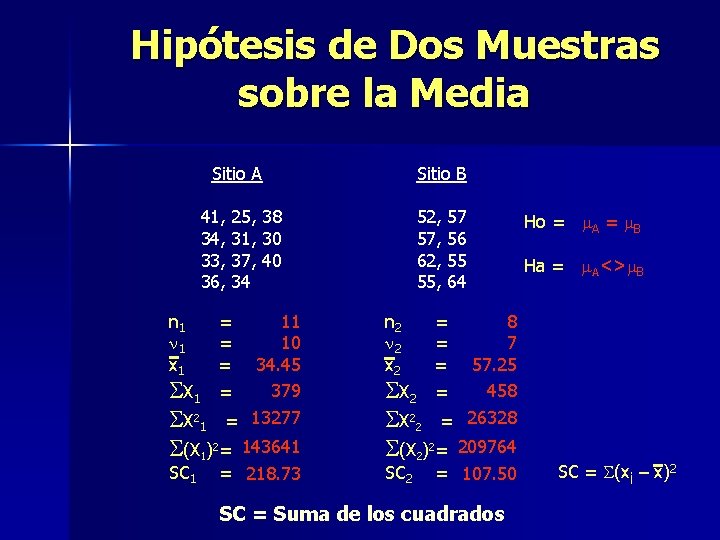

Hipótesis de Dos Muestras sobre la Media Sitio A 41, 34, 33, 36, n 1 x 1 Sitio B 25, 38 31, 30 37, 40 34 = = = 11 10 34. 45 379 S X 1 = SX 21 = 13277 S(X 1)2= 143641 SC 1 = 218. 73 52, 57, 62, 55, n 2 x 2 57 56 55 64 8 7 57. 25 458 S X 2 = SX 22 = 26328 S(X 2)2= 209764 SC 2 = 107. 50 Ho = m. A = m. B Ha = m. A<>m. B = = = SC = Suma de los cuadrados SC = S(xi – x)2

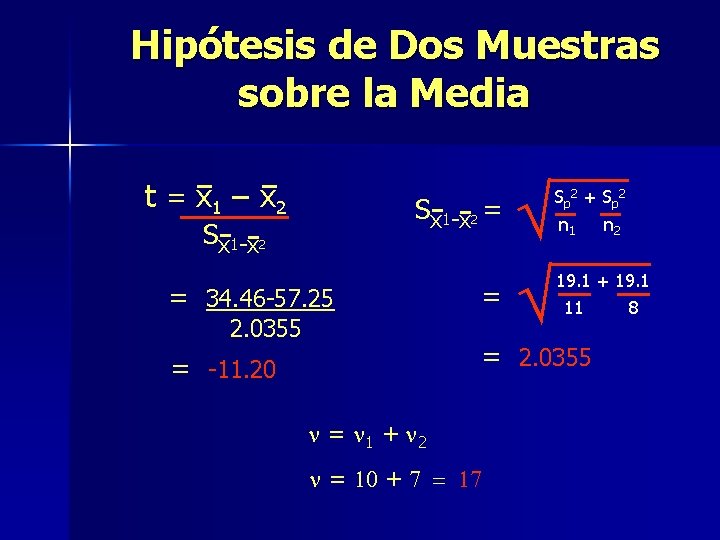

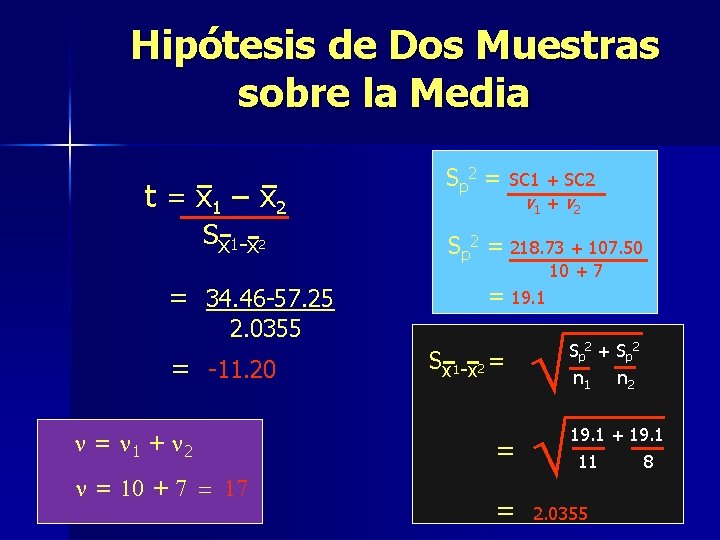

Hipótesis de Dos Muestras sobre la Media t = x 1 – x 2 Ö = Ö Sx 1 -x 2 = 34. 46 -57. 25 2. 0355 Sp 2 + S p 2 n 1 19. 1 + 19. 1 11 8 = 2. 0355 = -11. 20 n = n 1 + n 2 n = 10 + 7 = 17 n 2

Hipótesis de Dos Muestras sobre la Media t = x 1 – x 2 Sx 1 -x 2 = 34. 46 -57. 25 2. 0355 = -11. 20 n = n 1 + n 2 n = 10 + 7 = 17 Sp 2 = SC 1 + SC 2 v 1 + v 2 Sp 2 = 218. 73 + 107. 50 = 19. 1 10 + 7 Ö = Ö Sx 1 -x 2 = = Sp 2 + S p 2 n 1 n 2 19. 1 + 19. 1 11 8 2. 0355

Tabla de Valores Críticos de t a(1) 0. 20 0. 10 0. 05 0. 02 0. 01 0. 005 0. 002 0. 001 a(2) 0. 10 0. 05 0. 025 0. 01 0. 005 0. 0025 0. 001 0. 0005 1 3. 078 6. 314 12. 706 31. 821 63. 657 127. 321 2 1. 886 2. 920 4. 303 6. 965 9. 925 14. 089 22. 327 31. 599 3 1. 638 2. 353 3. 182 4. 541 5. 841 7. 453 10. 215 12. 924 14 1. 345 1. 761 2. 145 2. 624 2. 977 3. 326 3. 787 4. 140 15 1. 341 1. 753 2. 131 2. 602 2. 947 3. 286 3. 733 4. 073 16 1. 337 1. 746 2. 120 2. 583 2. 921 3. 252 3. 686 4. 015 17 1. 333 1. 740 2. 110 2. 567 2. 898 3. 222 3. 646 3. 965 18 1. 330 1. 734 2. 101 2. 552 2. 878 3. 197 3. 610 3. 922 19 1. 328 1. 729 2. 093 2. 539 2. 861 3. 174 3. 579 3. 883 20 1. 325 1. 725 2. 086 2. 528 2. 845 3. 153 3. 552 3. 850 Dos Colas Una Cola 318. 309 636. 619

Pruebas de Una vs Dos Colas Usualmente una prueba de t es de dos colas. Por qué? • Normalmente no se puede anticipar la dirección de un efecto – es decir un fenómeno podría ser mayor o menor del valor especificado por Ho • A veces hay razón pensar que una dirección es físicamente o biológicamente imposible o muy poca probable. En ese caso se puedo aplicar una prueba de una cola

Pruebas de Una vs Dos Colas • Una prueba de una cola es más poderoso debido a que se requiere un valor de t menos grande para llegar a un nivel de significado dado • Es preciso decidir si la prueba va a ser de una cola antes de llevar a cabo el experimento • Algunas pruebas son, por naturaleza, de una cola y no se tiene que tomar consideraciones especiales para ellos.

Suposiciones y Pruebas Inferenciales Todas las pruebas inferenciales están basadas en un número de suposiciones acerca de los datos Todas las pruebas inferenciales requieren muestreo al azar de los datos Muchas pruebas inferenciales asumen que los datos en cuestión están basados en alguna distribución teórico – generalmente normal Normalidad implica una distribución como campana, simétrica, ni muy angosto y muy ancho, sin valores extremos

Suposiciones y Pruebas Inferenciales Muchas pruebas paramétricas asumen que las varianzas entre grupos son iguales – la suposición de homogeneidad de la varianza. También hay muchas de estas pruebas que asumen que no hay ninguna correlación entre las magnitudes de la media y la varianza. Pruebas que suponen una cierta distribución de los datos son pruebas Paramétricas. Las que no, son noparamétricas.

Suposiciones y Pruebas Inferenciales Qué puede pasar si violamos una o más de las suposiciones de una Prueba? Es posible obtener resultados ‘significativos’ que son el producto del suposiciones violadas. Por lo tanto: Es preciso examinar los datos y comprobar las suposiciones antes de realizar más pruebas.

Pruebas Paramétricas vs Pruebas no Paramétricas Las suposiciones de normalidad y homogeneidad son requeridas para la mayoría de pruebas paramétricas. Las pruebas no-paramétricas no se basen en ninguna distribución teórica. Para la mayoría de pruebas paramétricas comúnmente usadas existe una o más pruebas noparamétricas.

Pruebas Paramétricas vs Pruebas no Paramétricas Costos/beneficios Paramétricos • Mas fácil encontrar efectos • Sensibles a las suposiciones sobre la distribución No-paramétricos • Menos capaces de encontrar efectos • Mas robustos en cuanto la forma de los datos

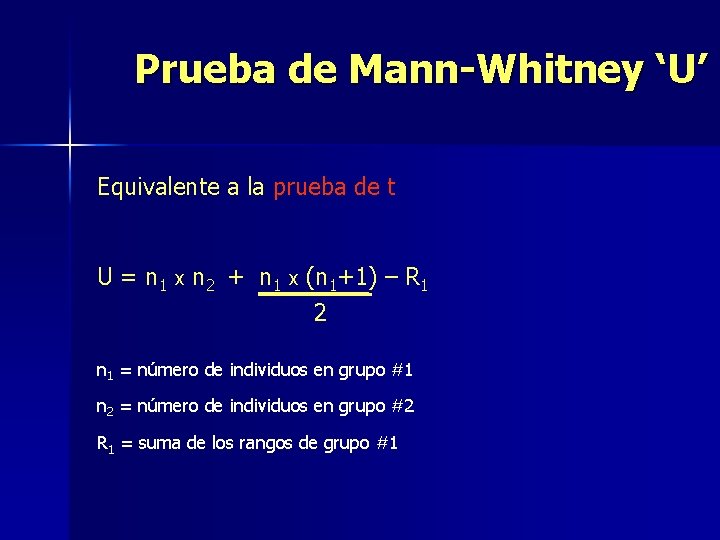

Prueba de Mann-Whitney ‘U’ Equivalente a la prueba de t U = n 1 x n 2 + n 1 x (n 1+1) – R 1 2 n 1 = número de individuos en grupo #1 n 2 = número de individuos en grupo #2 R 1 = suma de los rangos de grupo #1

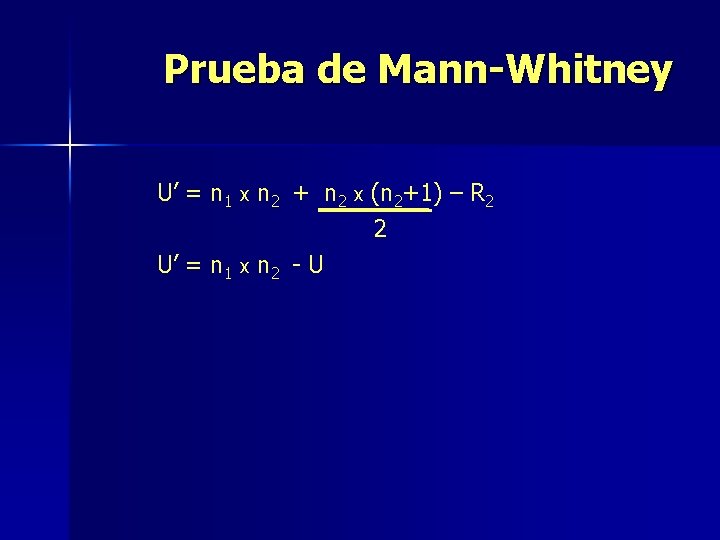

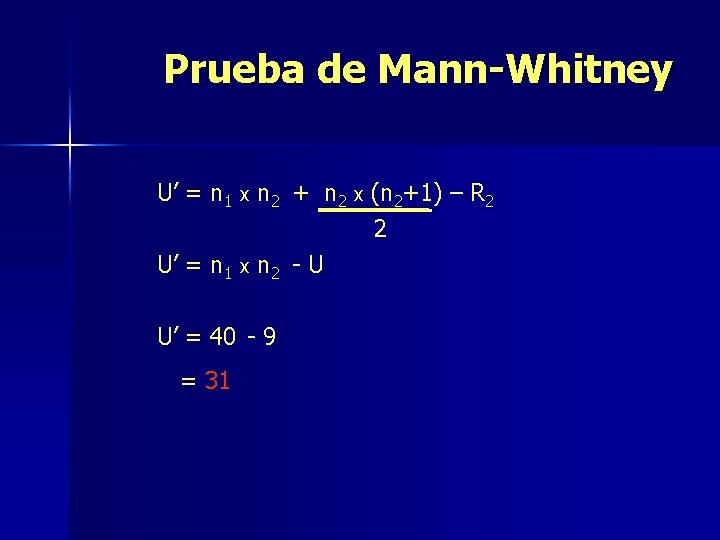

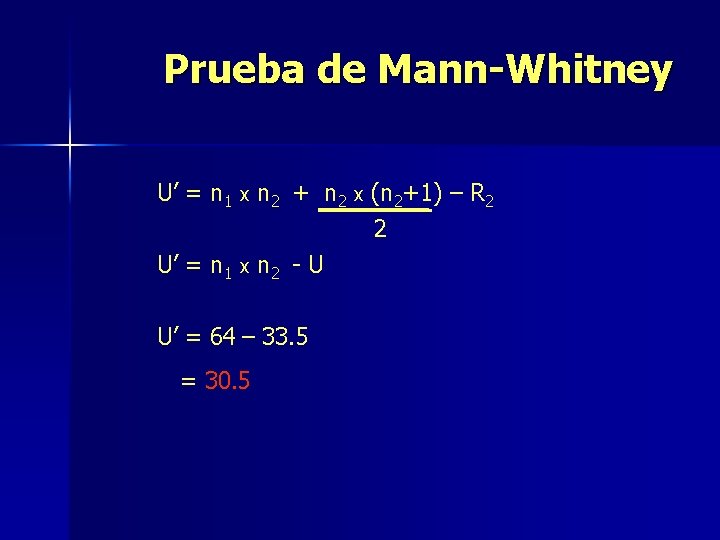

Prueba de Mann-Whitney U’ = n 1 x n 2 + n 2 x (n 2+1) – R 2 2 U’ = n 1 x n 2 - U

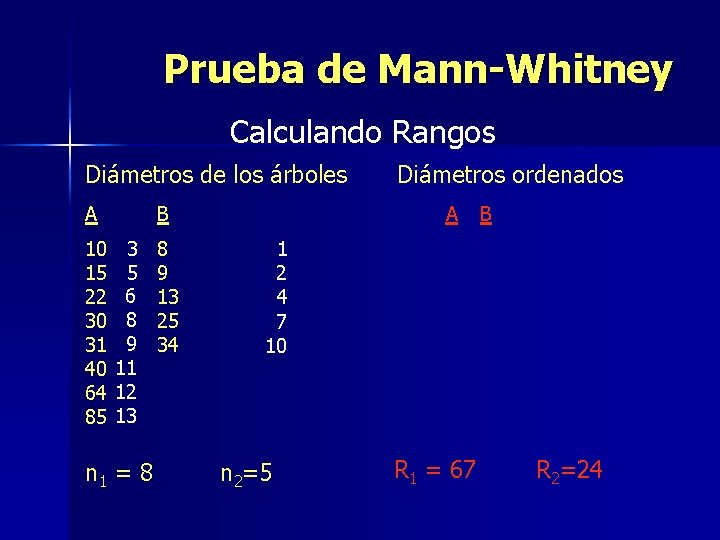

Prueba de Mann-Whitney Calculando Rangos Diámetros de los árboles A 10 15 22 30 31 40 64 85 B 3 5 6 8 9 11 12 13 n 1 = 8 8 9 13 25 34 Diámetros ordenados A B 1 2 4 7 10 n 2=5 R 1 = 67 R 2=24

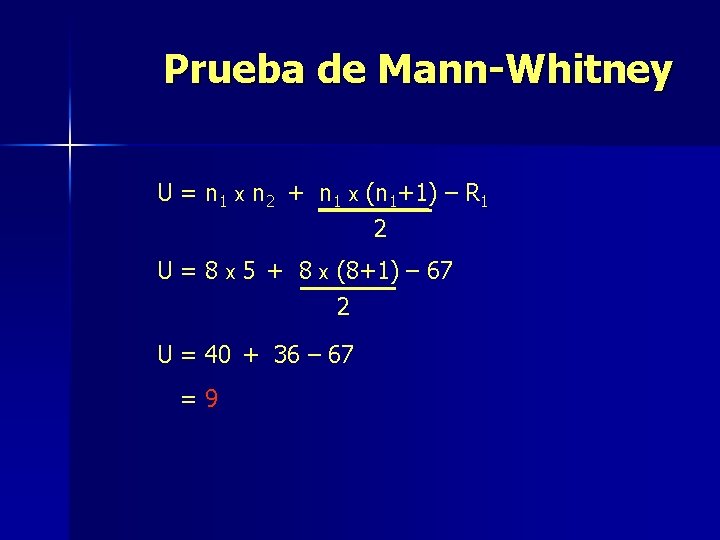

Prueba de Mann-Whitney U = n 1 x n 2 + n 1 x (n 1+1) – R 1 2 U = 8 x 5 + 8 x (8+1) – 67 2 U = 40 + 36 – 67 =9

Prueba de Mann-Whitney U’ = n 1 x n 2 + n 2 x (n 2+1) – R 2 2 U’ = n 1 x n 2 - U U’ = 40 - 9 = 31

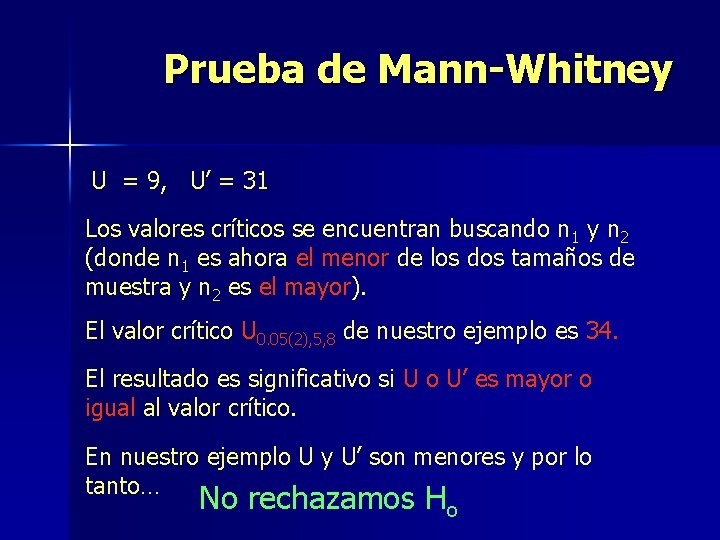

Prueba de Mann-Whitney U = 9, U’ = 31 Los valores críticos se encuentran buscando n 1 y n 2 (donde n 1 es ahora el menor de los dos tamaños de muestra y n 2 es el mayor). El valor crítico U 0. 05(2), 5, 8 de nuestro ejemplo es 34. El resultado es significativo si U o U’ es mayor o igual al valor crítico. En nuestro ejemplo U y U’ son menores y por lo tanto… No rechazamos Ho

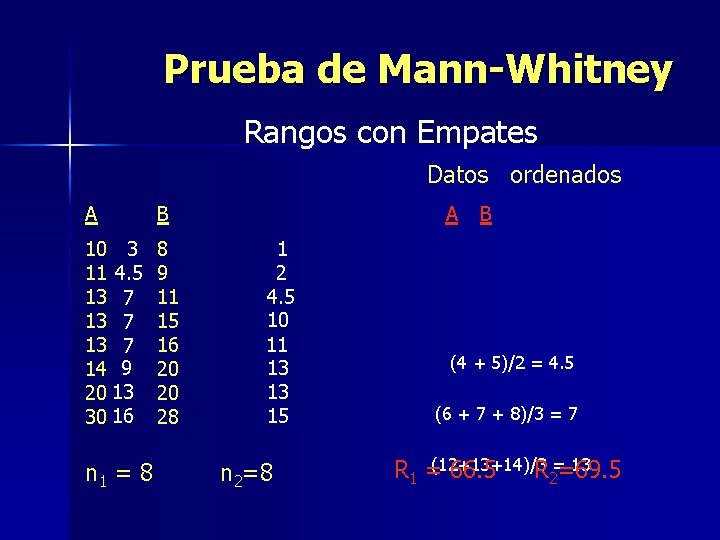

Prueba de Mann-Whitney Rangos con Empates Datos ordenados A B 10 3 11 4. 5 13 7 14 9 20 13 30 16 8 9 11 15 16 20 20 28 n 1 = 8 A 1 2 4. 5 10 11 13 13 15 n 2=8 B (4 + 5)/2 = 4. 5 (6 + 7 + 8)/3 = 7 13 R 1 =(12+13+14)/3 66. 5 R 2==69. 5

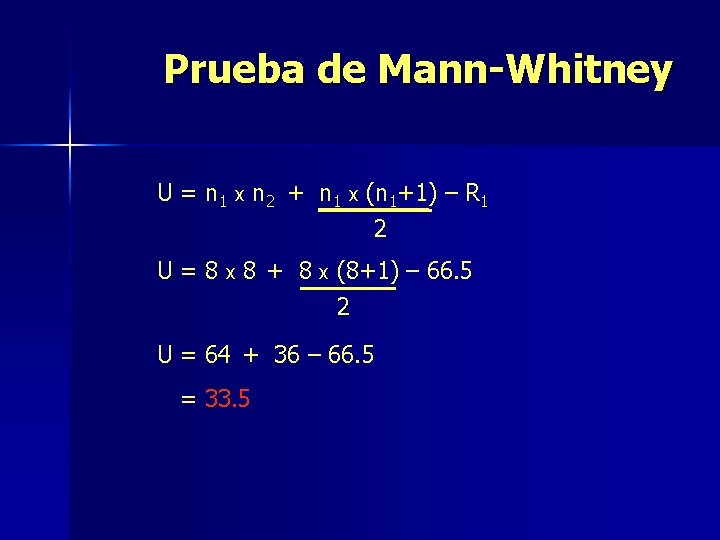

Prueba de Mann-Whitney U = n 1 x n 2 + n 1 x (n 1+1) – R 1 2 U = 8 x 8 + 8 x (8+1) – 66. 5 2 U = 64 + 36 – 66. 5 = 33. 5

Prueba de Mann-Whitney U’ = n 1 x n 2 + n 2 x (n 2+1) – R 2 2 U’ = n 1 x n 2 - U U’ = 64 – 33. 5 = 30. 5

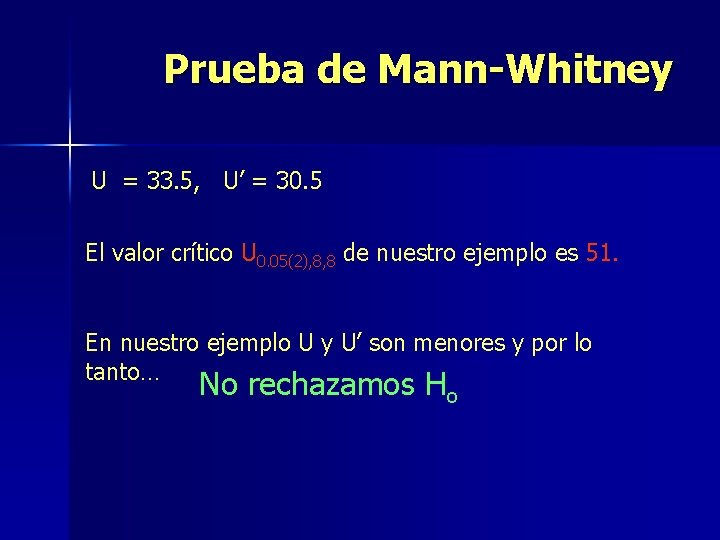

Prueba de Mann-Whitney U = 33. 5, U’ = 30. 5 El valor crítico U 0. 05(2), 8, 8 de nuestro ejemplo es 51. En nuestro ejemplo U y U’ son menores y por lo tanto… No rechazamos Ho

Descanso de 15 minutos

Practica Sepárense en grupos de 3 -4 Elijen uno de los papeles en frente 1. Elijen uno de los archivos 2. Apliquen las pruebas ‘t’ y ‘U’ indicadas 3. Presenten sus resultados

Práctica: A trabajar!

Almuerzohasta 1 pm

Análisis de datos de Frecuencia Es muy común en biología encontrar datos de Frecuencia o Enumeración. Se aplica las técnicas de ‘Goodness of Fit’ o Tablas de Contingencia. Las pruebas más usadas son la Prueba de Chi-cuadrado (c 2) y el Análisis de Tablas de Contingencia. Menos conocidas son las pruebas G, Poison y Binomial.

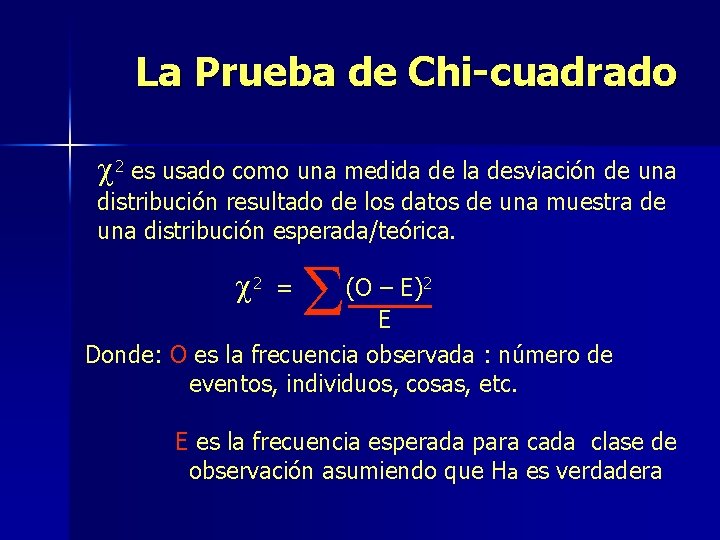

La Prueba de Chi-cuadrado c 2 es usado como una medida de la desviación de una distribución resultado de los datos de una muestra de una distribución esperada/teórica. c 2 = S (O – E)2 E Donde: O es la frecuencia observada : número de eventos, individuos, cosas, etc. E es la frecuencia esperada para cada clase de observación asumiendo que Ha es verdadera

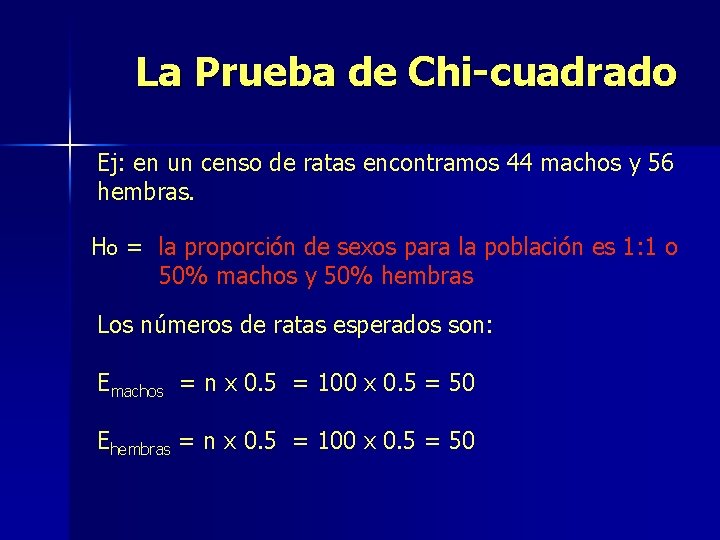

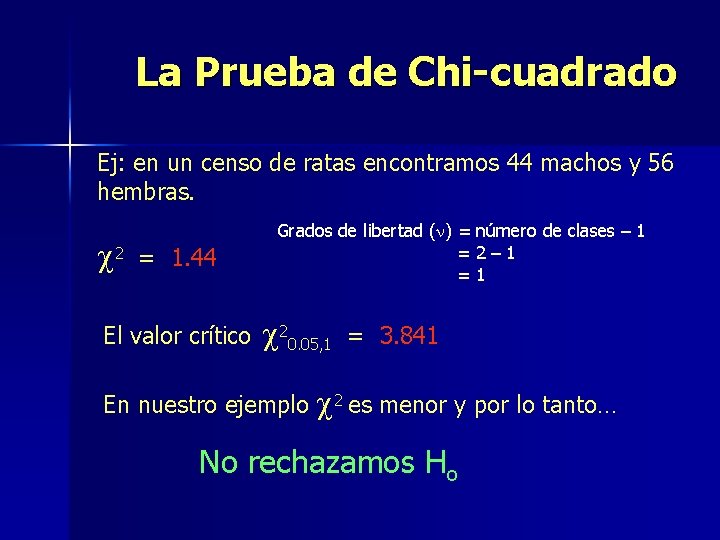

La Prueba de Chi-cuadrado Ej: en un censo de ratas encontramos 44 machos y 56 hembras. Ho = la proporción de sexos para la población es 1: 1 o 50% machos y 50% hembras Los números de ratas esperados son: Emachos = n x 0. 5 = 100 x 0. 5 = 50 Ehembras = n x 0. 5 = 100 x 0. 5 = 50

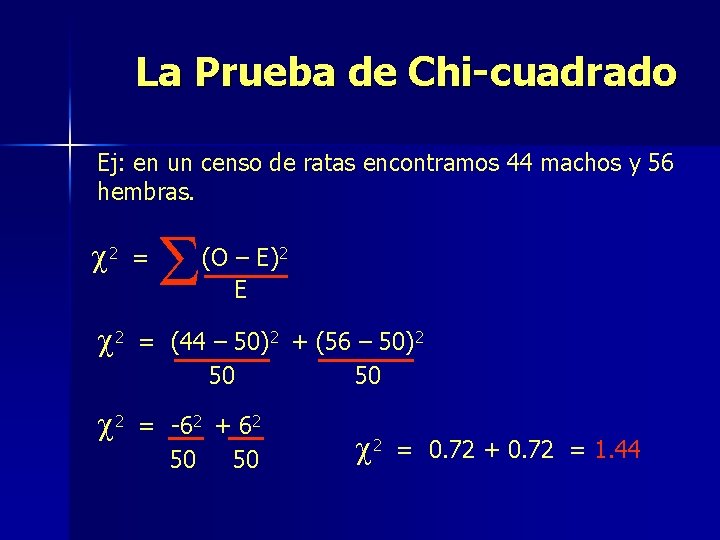

La Prueba de Chi-cuadrado Ej: en un censo de ratas encontramos 44 machos y 56 hembras. S c 2 = (44 – 50)2 + (56 – 50)2 50 50 c 2 = -62 + 62 50 50 (O – E)2 E c 2 = 0. 72 + 0. 72 = 1. 44

La Prueba de Chi-cuadrado Ej: en un censo de ratas encontramos 44 machos y 56 hembras. c 2 = 1. 44 El valor crítico Grados de libertad (n) = número de clases – 1 =2– 1 =1 c 20. 05, 1 En nuestro ejemplo = 3. 841 c 2 es menor y por lo tanto… No rechazamos Ho

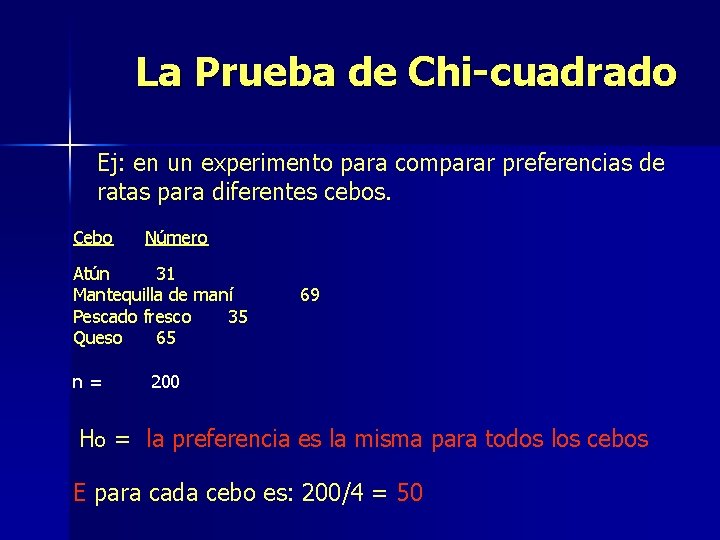

La Prueba de Chi-cuadrado Ej: en un experimento para comparar preferencias de ratas para diferentes cebos. Cebo Número Atún 31 Mantequilla de maní Pescado fresco 35 Queso 65 n= 69 200 Ho = la preferencia es la misma para todos los cebos E para cada cebo es: 200/4 = 50

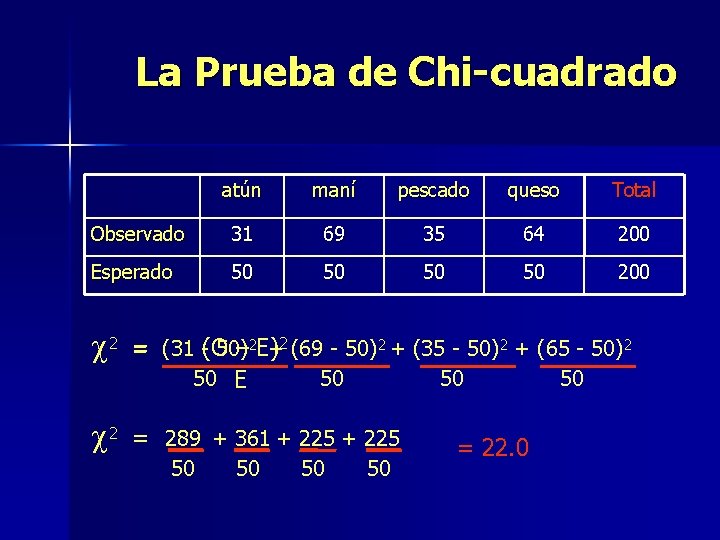

La Prueba de Chi-cuadrado atún maní pescado queso Total Observado 31 69 35 64 200 Esperado 50 50 200 c 2 = (31 -(O 50) – 2 E)+2 (69 - 50)2 + (35 - 50)2 + (65 - 50)2 50 E 50 50 50 c 2 = 289 + 361 + 225 50 50 = 22. 0

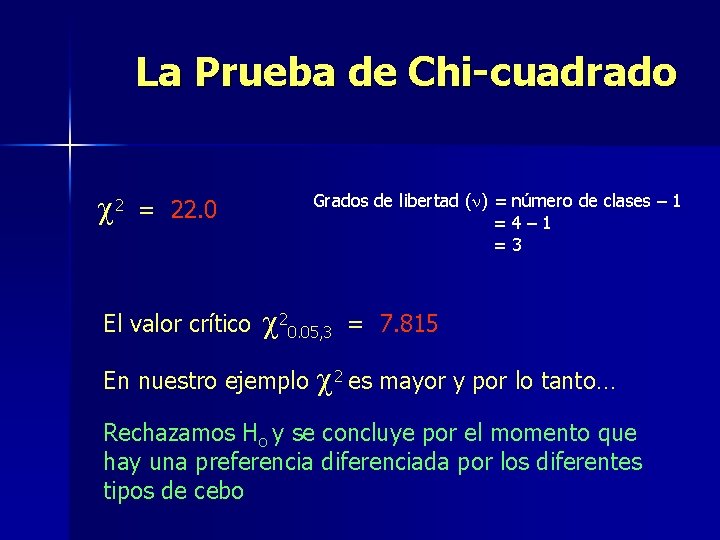

La Prueba de Chi-cuadrado c 2 Grados de libertad (n) = número de clases – 1 =4– 1 =3 = 22. 0 El valor crítico c 20. 05, 3 En nuestro ejemplo = 7. 815 c 2 es mayor y por lo tanto… Rechazamos Ho y se concluye por el momento que hay una preferencia diferenciada por los diferentes tipos de cebo

La Prueba de Chi-cuadrado Cuando y dos variables independientes y queremos saber si las frecuencias observadas en una variable son independientes de las frecuencias de la otra Ej: Se quiere saber si el tiempo de estadía de un pájaro imaginario es independiente de su origen.

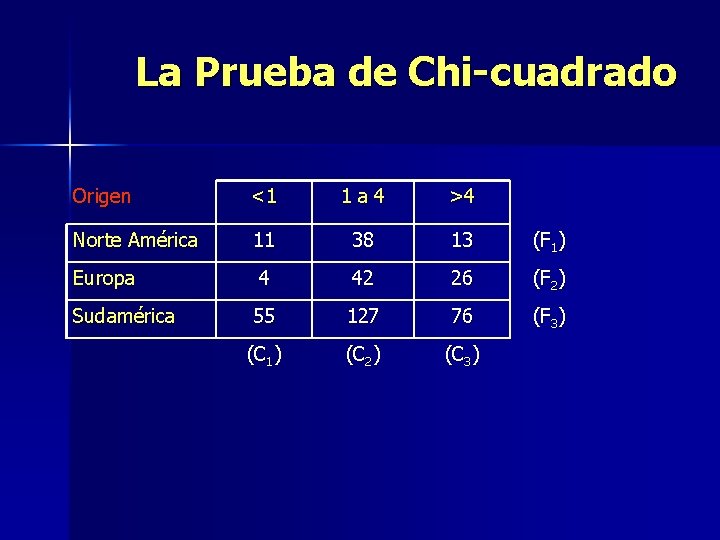

La Prueba de Chi-cuadrado Origen <1 1 a 4 >4 Norte América 11 38 13 (F 1) Europa 4 42 26 (F 2) Sudamérica 55 127 76 (F 3) (C 1) (C 2) (C 3)

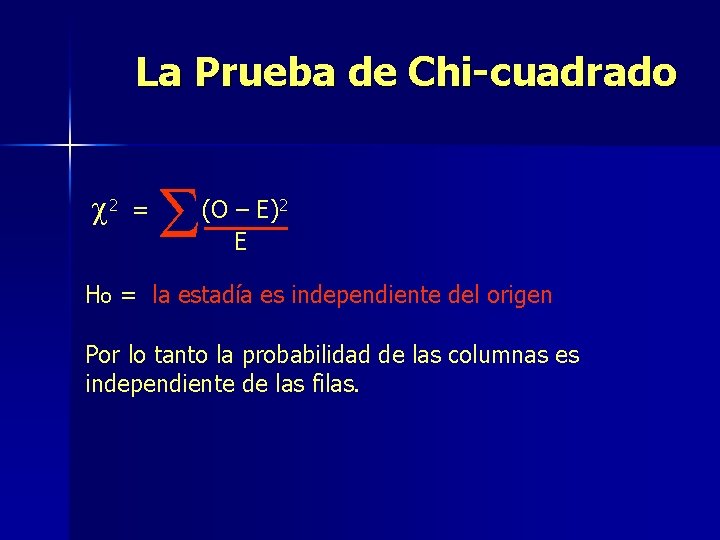

La Prueba de Chi-cuadrado c 2 = S (O – E)2 E Ho = la estadía es independiente del origen Por lo tanto la probabilidad de las columnas es independiente de las filas.

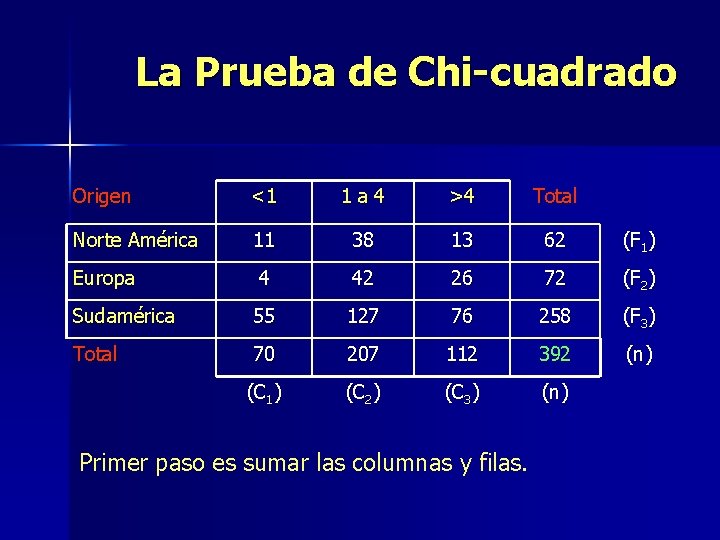

La Prueba de Chi-cuadrado Origen <1 1 a 4 >4 Total Norte América 11 38 13 62 (F 1) Europa 4 42 26 72 (F 2) Sudamérica 55 127 76 258 (F 3) Total 70 207 112 392 (n) (C 1) (C 2) (C 3) (n) Primer paso es sumar las columnas y filas.

La Prueba de Chi-cuadrado Si las frecuencias de las columnas y filas son independientes… La probabilidad de observar una variable no está en ninguna manera relacionada con la otra y por lo tanto… La probabilidad de observar dos variables independientes juntas es igual al producto de las probabilidades de cada variable. Veremos…

La Prueba de Chi-cuadrado La probabilidad que origen es de NA es: # individuos de NA # total de individuos = 62 392 = 0. 1582

La Prueba de Chi-cuadrado La probabilidad que se quede <1 semana es: # individuos se queden <1 semana # total de individuos = 70 392 = 0. 1786

La Prueba de Chi-cuadrado La probabilidad que un individuo de NA se quede <1 semana es: P(origen NA) x P(quede <1 semana) = 0. 1582 x 0. 1786 = 0. 0282

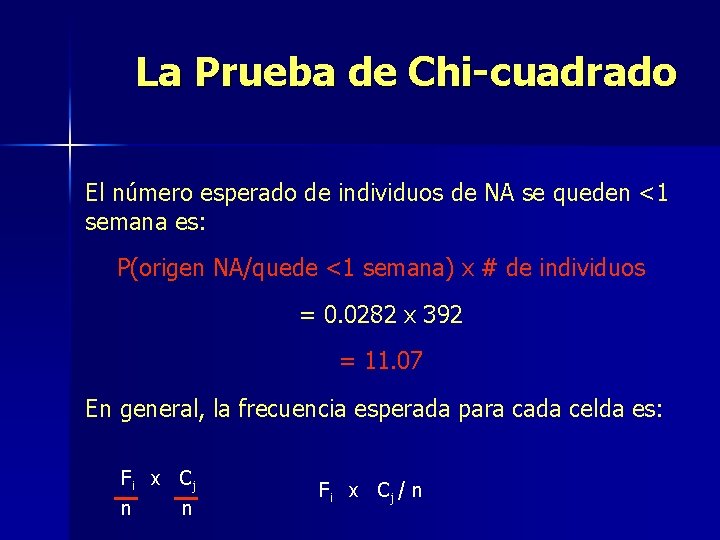

La Prueba de Chi-cuadrado El número esperado de individuos de NA se queden <1 semana es: P(origen NA/quede <1 semana) x # de individuos = 0. 0282 x 392 = 11. 07 En general, la frecuencia esperada para cada celda es: Fi x C j n n Fi x C j / n

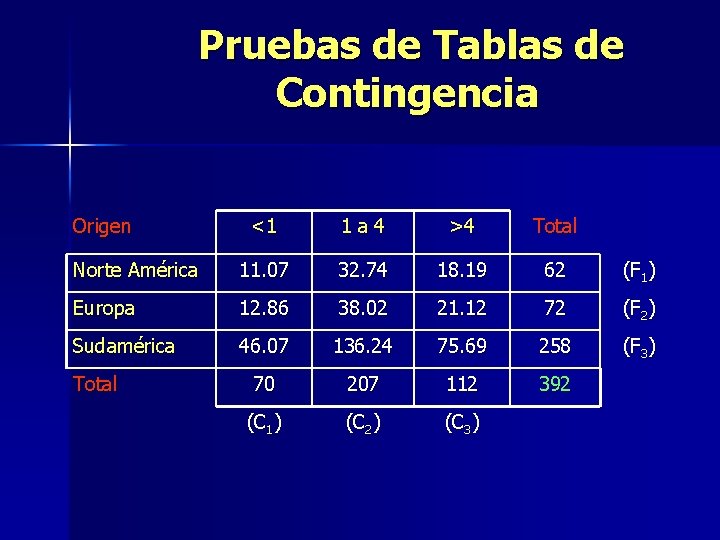

Pruebas de Tablas de Contingencia Origen <1 1 a 4 >4 Total Norte América 11. 07 32. 74 18. 19 62 (F 1) Europa 12. 86 38. 02 21. 12 72 (F 2) Sudamérica 46. 07 136. 24 75. 69 258 (F 3) 70 207 112 392 (C 1) (C 2) (C 3) Total

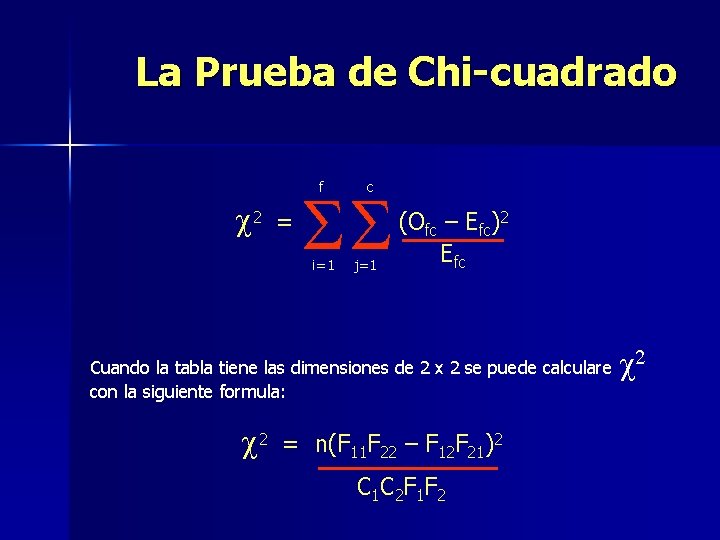

La Prueba de Chi-cuadrado SS f c 2 = i=1 c j=1 (Ofc – Efc)2 Efc Cuando la tabla tiene las dimensiones de 2 x 2 se puede calculare con la siguiente formula: c 2 = n(F 11 F 22 – F 12 F 21)2 C 1 C 2 F 1 F 2 c 2

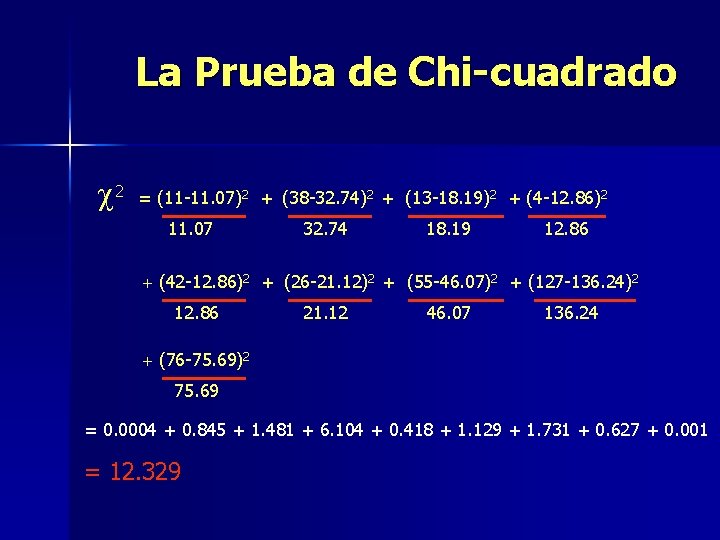

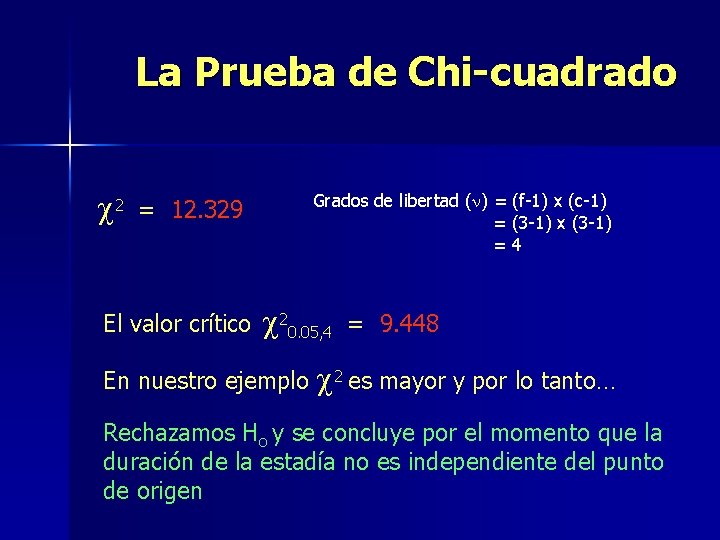

La Prueba de Chi-cuadrado c 2 = (11 -11. 07)2 + (38 -32. 74)2 + (13 -18. 19)2 + (4 -12. 86)2 11. 07 32. 74 18. 19 12. 86 + (42 -12. 86)2 + (26 -21. 12)2 + (55 -46. 07)2 + (127 -136. 24)2 12. 86 21. 12 46. 07 136. 24 + (76 -75. 69)2 75. 69 = 0. 0004 + 0. 845 + 1. 481 + 6. 104 + 0. 418 + 1. 129 + 1. 731 + 0. 627 + 0. 001 = 12. 329

La Prueba de Chi-cuadrado c 2 Grados de libertad (n) = (f-1) x (c-1) = (3 -1) x (3 -1) =4 = 12. 329 El valor crítico c 20. 05, 4 En nuestro ejemplo = 9. 448 c 2 es mayor y por lo tanto… Rechazamos Ho y se concluye por el momento que la duración de la estadía no es independiente del punto de origen

Practica Sepárense en grupos de 3 -4 Elijen uno de los papeles en frente 1. Elijen uno de las practicas 2. Apliquen la prueba c 2 indicada 3. Presenten sus resultados

Práctica: A trabajar!

- Slides: 77