Il calcolo per lesperimento GERDA prospettive per la

![Consuntivo finora per: (1) spazio disco [LNGS] n Dati di GERDA Fase I: circa Consuntivo finora per: (1) spazio disco [LNGS] n Dati di GERDA Fase I: circa](https://slidetodoc.com/presentation_image_h2/5ea595fd840484ad6e9101ed92c4f64f/image-6.jpg)

![Consuntivo finora per: (3) CPU [LNGS] n Analisi dati di GERDA (bck e calibrazioni) Consuntivo finora per: (3) CPU [LNGS] n Analisi dati di GERDA (bck e calibrazioni)](https://slidetodoc.com/presentation_image_h2/5ea595fd840484ad6e9101ed92c4f64f/image-8.jpg)

- Slides: 14

Il calcolo per l’esperimento GERDA: prospettive per la Fase II Luciano Pandola INFN, Laboratori del Gran Sasso e Laboratori del Sud Workshop della CCR, LNGS, 26 Febbraio 2014

Come abbiamo lavorato in Fase I

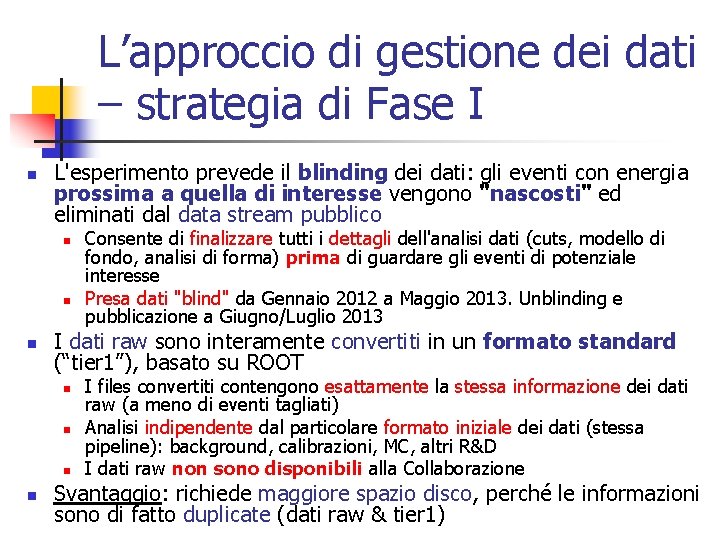

L’approccio di gestione dei dati – strategia di Fase I n L'esperimento prevede il blinding dei dati: gli eventi con energia prossima a quella di interesse vengono "nascosti" ed eliminati dal data stream pubblico n n n I dati raw sono interamente convertiti in un formato standard (“tier 1”), basato su ROOT n n Consente di finalizzare tutti i dettagli dell'analisi dati (cuts, modello di fondo, analisi di forma) prima di guardare gli eventi di potenziale interesse Presa dati "blind" da Gennaio 2012 a Maggio 2013. Unblinding e pubblicazione a Giugno/Luglio 2013 I files convertiti contengono esattamente la stessa informazione dei dati raw (a meno di eventi tagliati) Analisi indipendente dal particolare formato iniziale dei dati (stessa pipeline): background, calibrazioni, MC, altri R&D I dati raw non sono disponibili alla Collaborazione Svantaggio: richiede maggiore spazio disco, perché le informazioni sono di fatto duplicate (dati raw & tier 1)

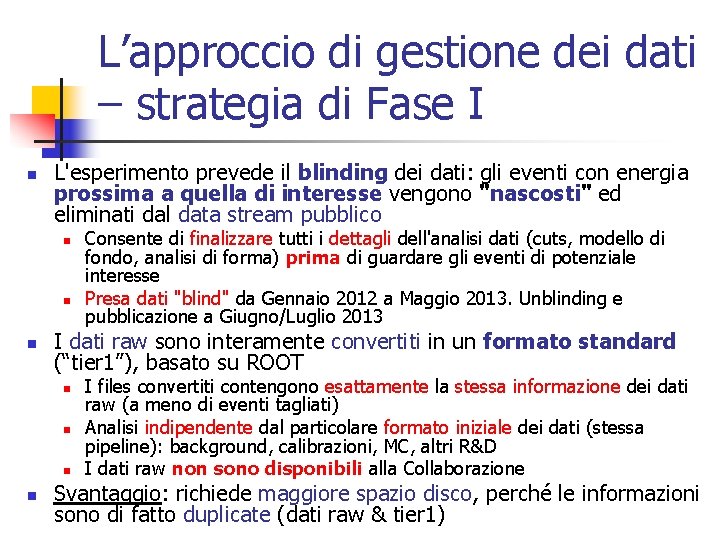

La gestione dei dati Accesso ristretto Dati raw background Dati raw calibrazione Tier 1 (= copia dei dati) Analisi, livello 1 Simulazioni Monte Carlo

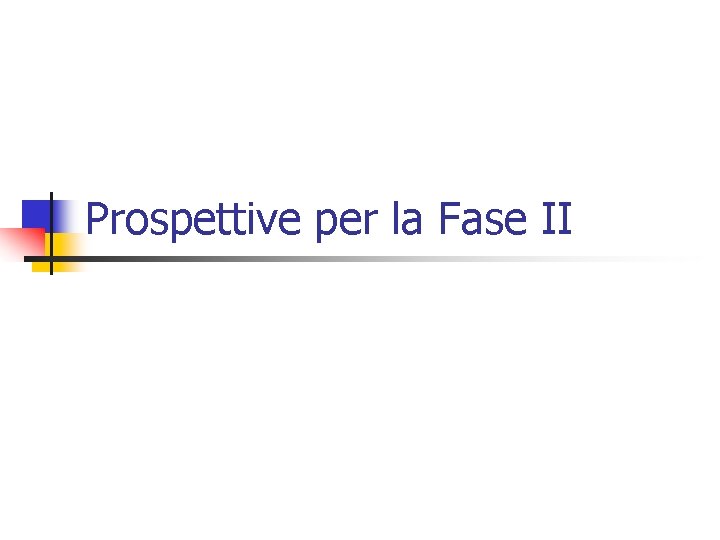

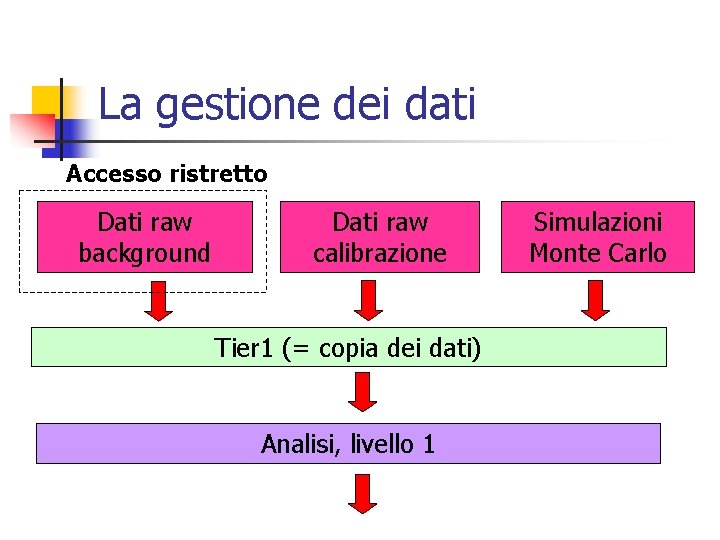

Collaborazione GERDA Il data flow nfs Bastion host, switch DAQ Restricted disk area blinding Restricted disk area Server GERDA Server dati (2 CPU Xeon E 5502) Rete GERDA nei Laboratori sotterranei (2 CPU Xeon E 5620) Laboratori esterni (CED)

![Consuntivo finora per 1 spazio disco LNGS n Dati di GERDA Fase I circa Consuntivo finora per: (1) spazio disco [LNGS] n Dati di GERDA Fase I: circa](https://slidetodoc.com/presentation_image_h2/5ea595fd840484ad6e9101ed92c4f64f/image-6.jpg)

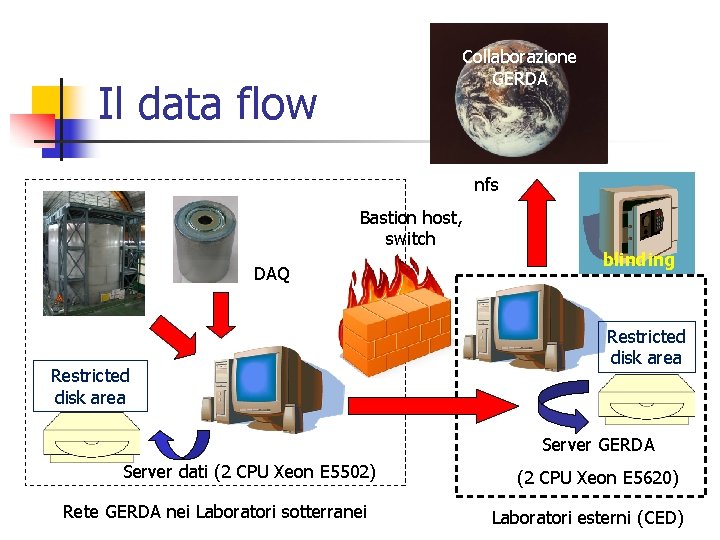

Consuntivo finora per: (1) spazio disco [LNGS] n Dati di GERDA Fase I: circa 6 TB n n n Dati del commissioning (2011 -2012): ~ 4 TB Dati per attività di R&D per la Fase II: ~ 6 TB n n n Raw data: 2. 2 TB run fisica + 1. 7 TB calibrazioni Tier 1: 1. 1 TB (compressione fattore ~4) Altri files di analisi (tier. N): < 200 GB Muon veto: 0. 5 TB Solo misure effettuate ai LNGS. I dati dei test effettuati in altre sedi sono mantenuti localmente Test elettronica, LAr. Ge, caratterizzazione rivelatori Output di Monte Carlo e analisi avanzata: ~ 2 TB

Consuntivo finora per: (2) backup su nastro n Dati raw di GERDA Fase I n Policy della Collaborazione: 3 copie (Italia, Germania, Russia) n n n Non c’è bisogno di backup dei files di tier 1 Due copie su nastro ai LNGS di tutte le aree disco di GERDA n Dati raw, files ausiliari, files di analisi, etc. Gestito dal Servizio di Calcolo n Utilizzati 4. 5 TB circa n n Istituti Russi non ancora pronti Delicato perché i dati raw sono ad accesso ristretto Una copia ad Heidelberg Una copia (disco/nastro) al CNAF per tutti i dati raw di Fase I

![Consuntivo finora per 3 CPU LNGS n Analisi dati di GERDA bck e calibrazioni Consuntivo finora per: (3) CPU [LNGS] n Analisi dati di GERDA (bck e calibrazioni)](https://slidetodoc.com/presentation_image_h2/5ea595fd840484ad6e9101ed92c4f64f/image-8.jpg)

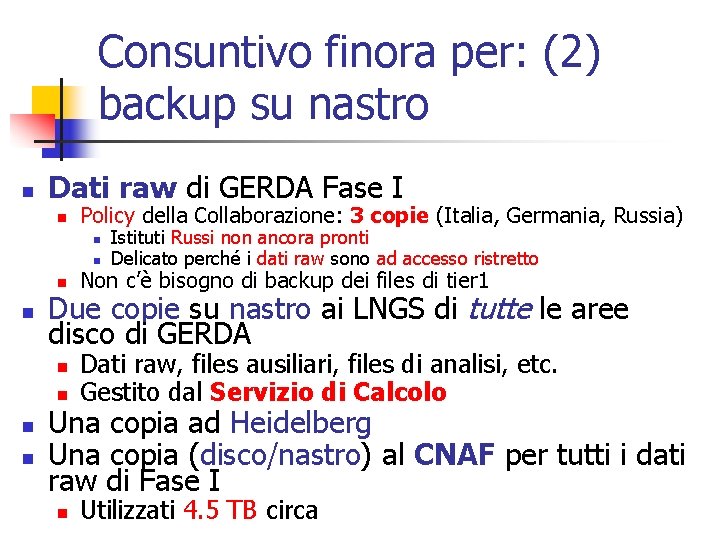

Consuntivo finora per: (3) CPU [LNGS] n Analisi dati di GERDA (bck e calibrazioni) n n n Analisi “base” (ricostruzione in energia, rise time, parametri semplici di PSD) richieste limitate Tutto il ri-processamento dell'unblinding ha richiesto ~1 settimana di CPU sul server di GERDA Simulazioni Monte Carlo, analisi avanzata (PSD) per Fase I, analisi delle misure extra n n Molto più pesante dal punto di vista della CPU Nell'ultimo anno (Feb 2013 -Feb 2014) utilizzati 4. 3 CPU yr sul sistema u. Lite ai LNGS n n n Relativa ai soli dati effettivamente salvati ai LNGS Accesso efficiente ai dati su disco Richieste CPU (piccole) anche sul CNAF, ma non utilizzate n Creata VO (gerda. mpg. de)

Prospettive per la Fase II

Lo scale-up alla Fase II n Si prevede di lavorare con una logica simile alla Fase I n n Blinding dei dati, main storage ai LNGS Dati fattore x 5 -10 rispetto alla Fase I n n Più canali di lettura dei Germani. Acquisizione veto attivo Ar. Tre anni di presa dati, anziché circa un anno Da ottimizzare LNGS ancora pensato come centro di acquisizione, storage, analisi e smistamento primario per i dati dell'esperimento n Altre sedi contribuiranno per backup, storage delle misure ausiliarie e CPU per l'analisi dedicata

Ai LNGS (“home Lab”) n Storage e analisi dati primaria di GERDA-Fase II n n CPU per alcune simulazioni MC e analisi dati avanzata n n n È il posto naturale, perché sede fisica dove vengono raccolti i dati e centro del Coordinamento Analisi di GERDA Acquistati altri 40 TB di disco (totale: 80 TB) Analisi base probabilmente gestibile con i due server di GERDA, possibilmente integrati da u. Lite nei momenti di picco Studi del fondo, analisi dati avanzata, processamento di misure ausiliarie acquisite e salvate ai LNGS… Backup su nastro usando l’infrastruttura messa a disposizione dal Servizio Calcolo Le risorse disponibili dovrebbero essere adeguate (risorse di GERDA + U-Lite)

Conclusioni n Il footprint di GERDA per le risorse di calcolo (disco, CPU) è relativamente modesto rispetto ad altri esperimenti n n I gruppi INFN finora hanno curato lo storage e i data server di esperimento LNGS (risorse GERDA e U-Lite) è il centro di riferimento per le attività direttamente connesse allo storage, backup e analisi dei dati di GERDA n n Basso counting rate, pochi canali Vero "a consuntivo" per la Fase I e prevedibilmente vero anche per la Fase II CPU anche per analisi avanzata e alcune simulazioni MC Istituzioni estere e CNAF per supporto su dati GERDA (backup disco/nastro) e per le attività non direttamente collegate alla presa dati LNGS (R&D, caratterizzazione rivelatori)

Backup

Superficie Galleria Hardware (server e storage) n Server dati n n 2 CPU Xeon E 5502 (1. 846 GHz 4 MB) 8 dischi (2 TB ciascuno) n 14 TB di disco disponibile in RAID 5 n Acquistato e gestito dal gruppo INFN-PD n Server dati (Dell R 410) – ge-data. lngs. infn. it n n n 21 dischi (2 TB ciascuno), fisicamente su ge-data n n 2 CPU Xeon (2. 40 GHz 12 MB), scheda Fibre Channel Certificato digitale rilasciato (Terena) Circa 35 TB disponibili, al netto della ridondanza RAID 3 partizioni, una esportata sul cluster LNGS via nfs Server di backup (Identico, Dell R 410) Acquistato da GERDA, gestito dal Calcolo LNGS