II Rappels sur linfrence statistique Objet du cours

II Rappels sur l'inférence statistique

Objet du cours Au cours de Statistiques de 1 e année, vous avez appris à maîtriser les deux volets du travail interprétatif du statisticien : ➢ Statistique descriptive ➢ Statistique inductive

Induction - Déduction

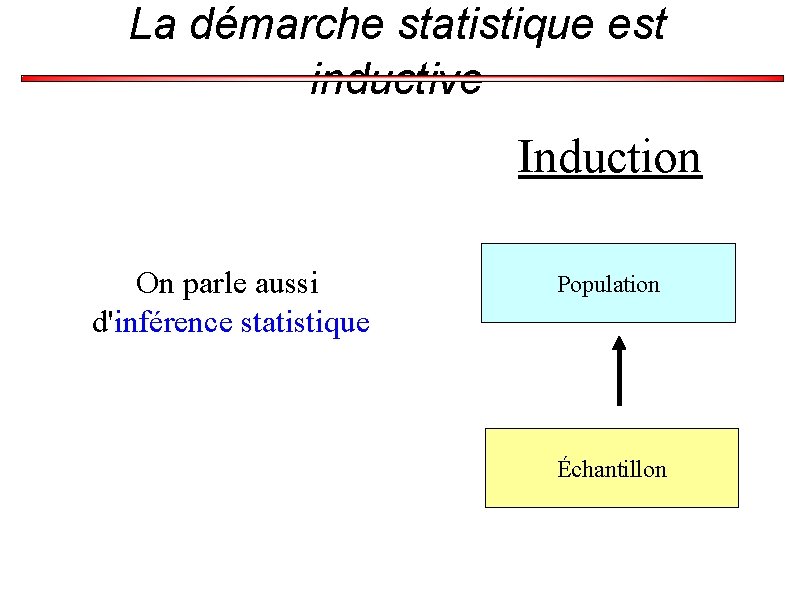

La démarche statistique est inductive Induction On parle aussi d'inférence statistique Population Échantillon

Le problème de l'induction La population présente une grande variabilité. Cela va empêcher de conclure avec certitude sur la population à partir des données acquises sur un échantillon. Mais on a tout de même acquis de l'information!

L'apport des probabilités Variabilité ⇒ Incertitude Données sur l'échantillon ⇒ Information La théorie des probabilités permet de valoriser l'information tout en prenant en compte l'incertitude Comparez : ✗ «Cette voiture peut encore rouler un bon nombre de kilomètres » ✔ « Je vends une bonne centaine de voitures de ce type chaque année, et je peux dire que vous avez 95% de chances de rouler entre 20. 000 et 40. 000 km sans panne majeure. »

L'apport des probabilités Les probabilités vous ont permis : ➢ d'estimer des paramètres d'une population ainsi que leurs intervalles de confiance ➢ de tester des hypothèses (par exemple, si les moyennes de deux échantillons sont égales)

II-a) Rappels sur les intervalles de confiance d'une estimation

Stratégie de l'estimation

Exemple de la moyenne Sur un échantillon, on peut calculer une moyenne Quelle information nous donne-t-elle sur la moyenne de la population ?

Exemple de la moyenne Une population à une moyenne �et une variance � ². Tirer un élément et regarder la valeur de la variable X est une épreuve aléatoire. X 1 est donc une variable aléatoire avec une distribution de probabilité de moyenne �et de variance � ². Mn est donc aussi une variable aléatoire.

Distribution d'échantillonnage distribution d'échantillonnage (d'un paramètre statistique) = distribution de probabilité de ce paramètre statistique

Exemple de la moyenne En toute généralité, on peut pas dire grand chose a priori sur la distribution d'échantillonnage de Mn car la distribution de probabilité des Xi est à peine connue (on ne dispose que de la moyenne et de la variance) Cependant, à grand n, nous sommes sauvés par le théorème central limite !

Théorème central limite Lorsque n est suffisamment grand, (en pratique n>30), la distribution de probabilité de Mn est une distribution normale de moyenne �et de variance � ²/n. C'est valide quelque soit la distribution de probabilité de X! du moment qu'elle a la moyenne �et de variance � ² et qu'elle est la même pour tous les Xi

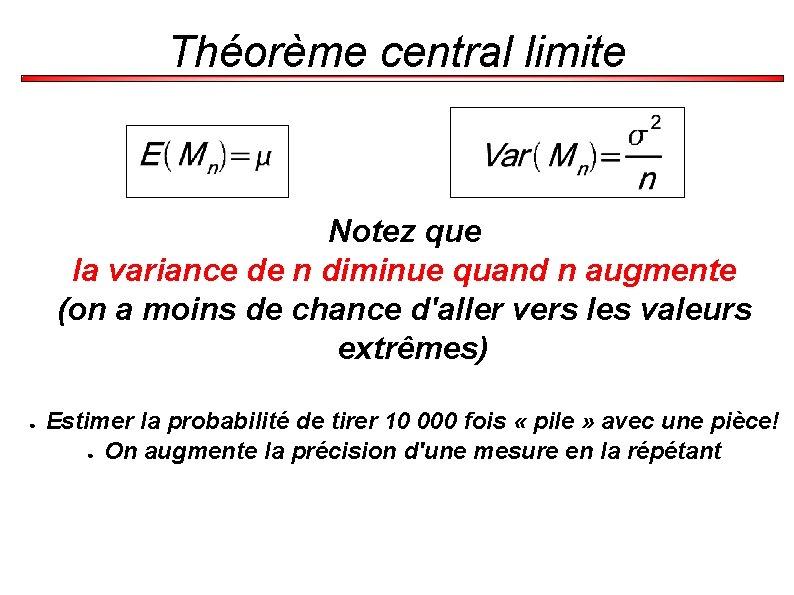

Théorème central limite Notez que la variance de n diminue quand n augmente (on a moins de chance d'aller vers les valeurs extrêmes) ● Estimer la probabilité de tirer 10 000 fois « pile » avec une pièce! ● On augmente la précision d'une mesure en la répétant

Erreur standard Dans le cadre du théorème central limite, l'erreur standard correspond à l'écart-type de la moyenne

Exemple de la moyenne À partir d'un échantillon de grande taille, on peut donc estimer la moyenne de la population En effet, les propriétés de la loi normale sont connues! Estimer ?

Ingrédients nécessaires à une estimation ✔ Fourchette : imprécision d'une estimation ✔ Confiance : probabilité associée à l'intervalle estimé ✔ « Je vends une bonne centaine de voitures de ce type chaque année, et je peux dire que vous avez 95% de chances de rouler entre 20. 000 et 40. 000 km sans panne majeure, de plus de 300 €» Fourchette ⇔ Imprécision Confiance ⇔ Incertitude

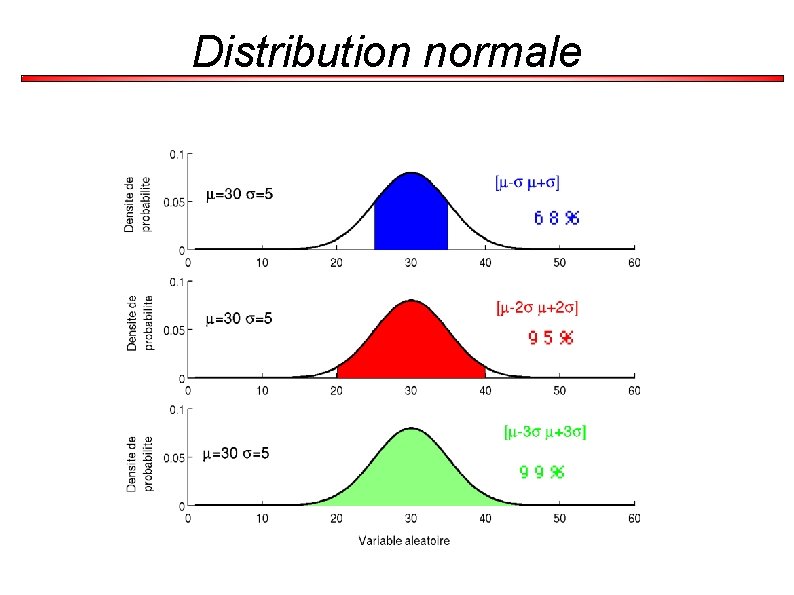

Distribution normale

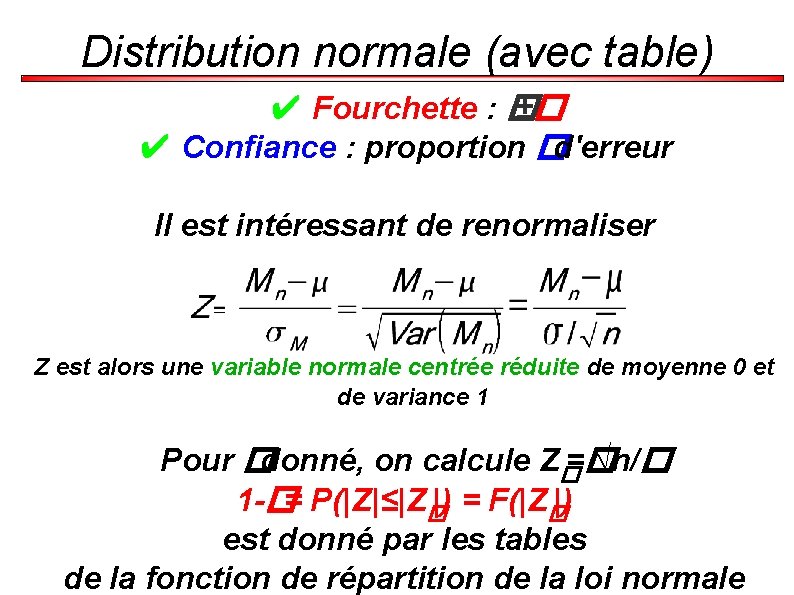

Distribution normale (avec table) ✔ Fourchette : � ±� ✔ Confiance : proportion �d'erreur Il est intéressant de renormaliser Z est alors une variable normale centrée réduite de moyenne 0 et de variance 1 Pour �donné, on calcule Z�=� √n/� 1 -�= P(|Z|≤|Z�|) = F(|Z�|) est donné par les tables de la fonction de répartition de la loi normale

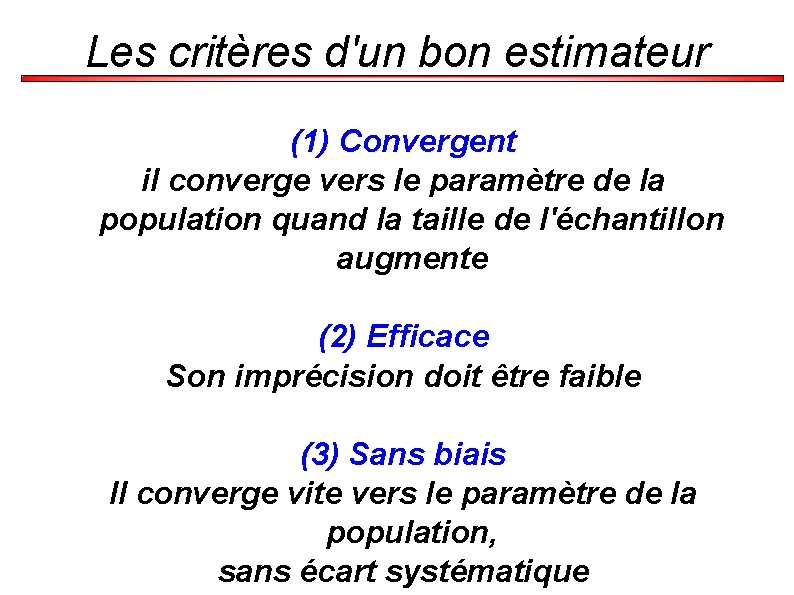

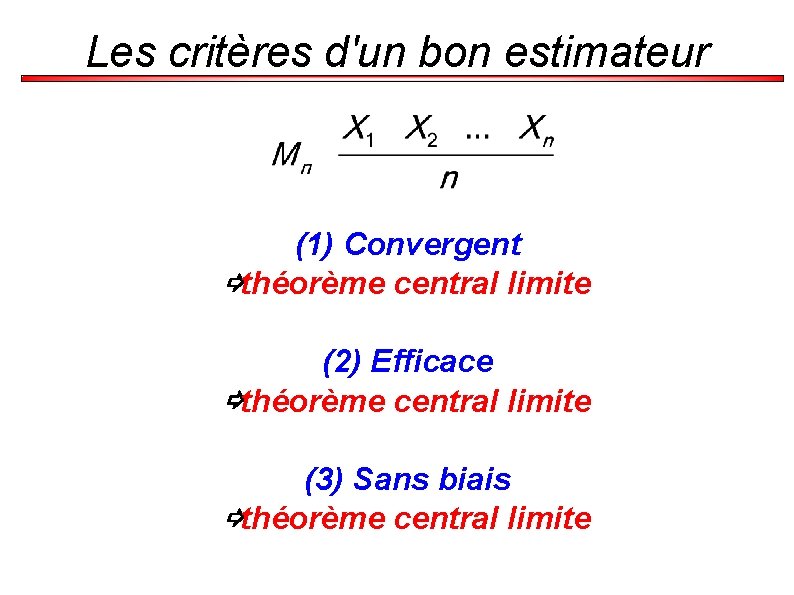

Les critères d'un bon estimateur (1) Convergent il converge vers le paramètre de la population quand la taille de l'échantillon augmente (2) Efficace Son imprécision doit être faible (3) Sans biais Il converge vite vers le paramètre de la population, sans écart systématique

Les critères d'un bon estimateur (1) Convergent ⇨théorème central limite (2) Efficace ⇨théorème central limite (3) Sans biais ⇨théorème central limite

Et si l'échantillon est de petite taille ? On peut encore remonter à la moyenne de l'échantillon si on sait que les variables aléatoires Xi suivent une loi normale Pourquoi ?

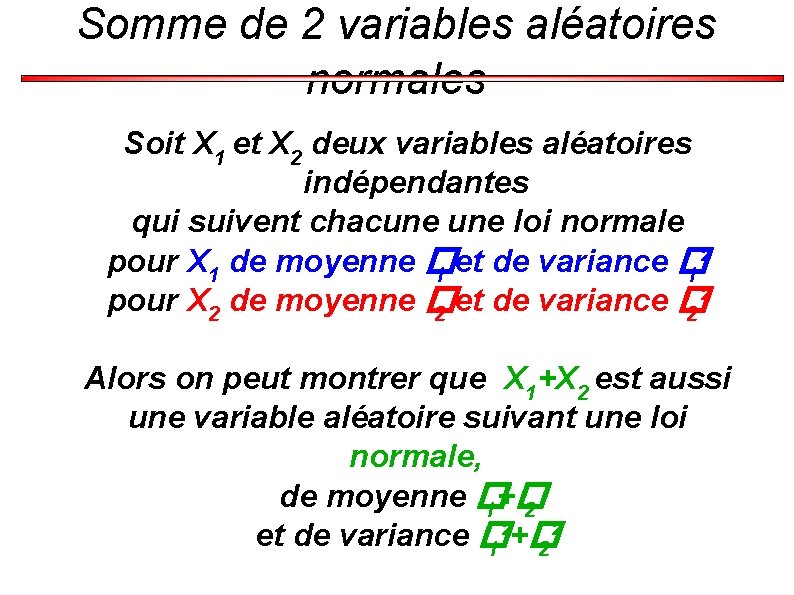

Somme de 2 variables aléatoires normales Soit X 1 et X 2 deux variables aléatoires indépendantes qui suivent chacune loi normale pour X 1 de moyenne � 1 et de variance � 1² pour X 2 de moyenne � 2 et de variance � 2² Alors on peut montrer que X 1+X 2 est aussi une variable aléatoire suivant une loi normale, de moyenne � 1+ � 2 et de variance � 1²+� 2²

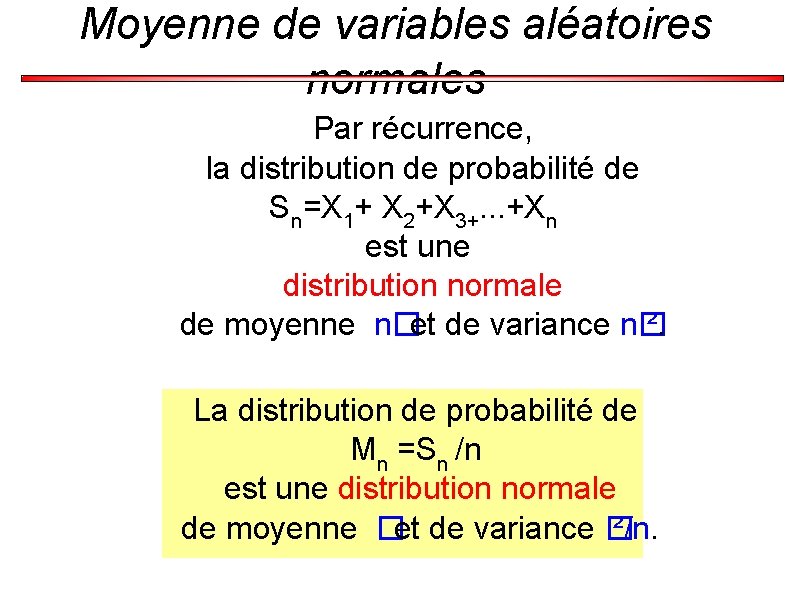

Moyenne de variables aléatoires normales Par récurrence, la distribution de probabilité de Sn=X 1+ X 2+X 3+. . . +Xn est une distribution normale de moyenne n�et de variance n� ². La distribution de probabilité de Mn =Sn /n est une distribution normale de moyenne �et de variance � ²/n.

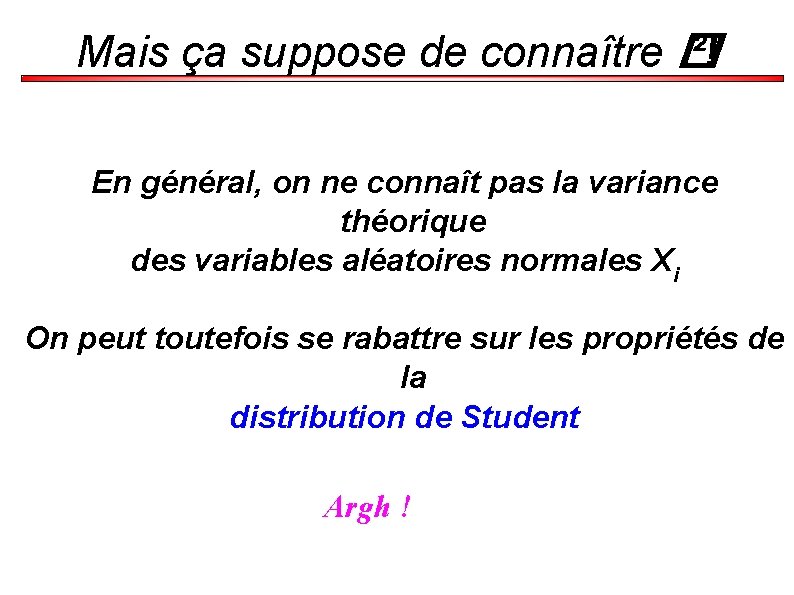

Mais ça suppose de connaître � ²! En général, on ne connaît pas la variance théorique des variables aléatoires normales Xi On peut toutefois se rabattre sur les propriétés de la distribution de Student Argh !

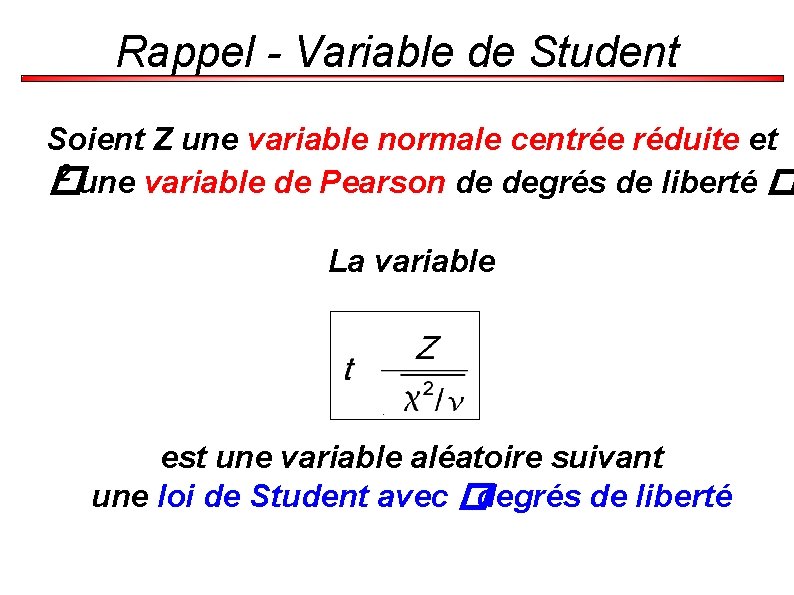

Rappel - Variable de Student Soient Z une variable normale centrée réduite et 2 une variable de Pearson de degrés de liberté � � La variable est une variable aléatoire suivant une loi de Student avec �degrés de liberté

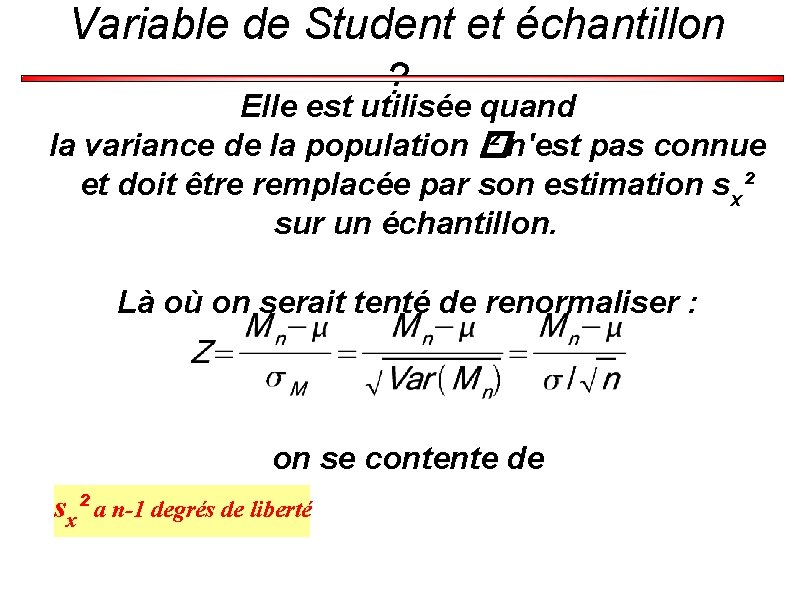

Variable de Student et échantillon ? Elle est utilisée quand la variance de la population � ² n'est pas connue et doit être remplacée par son estimation sx² sur un échantillon. Là où on serait tenté de renormaliser : on se contente de sx² a n-1 degrés de liberté

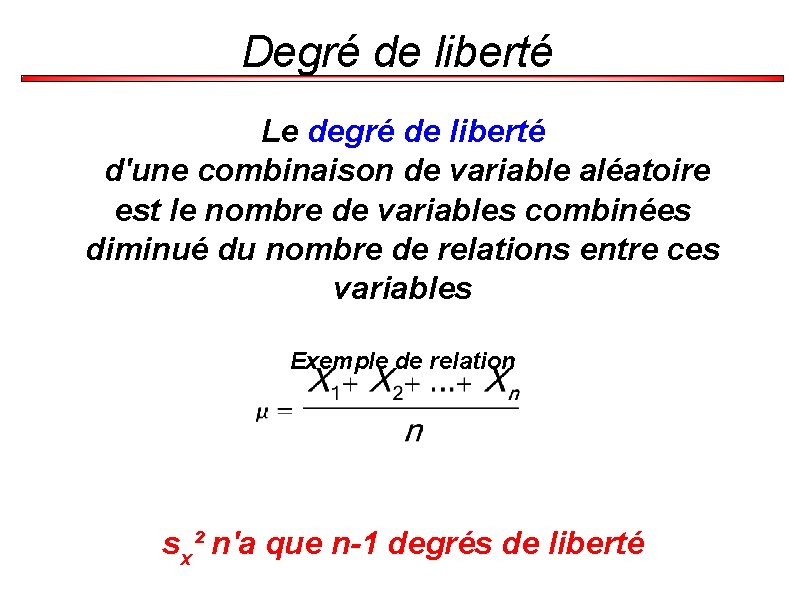

Degré de liberté Le degré de liberté d'une combinaison de variable aléatoire est le nombre de variables combinées diminué du nombre de relations entre ces variables Exemple de relation sx² n'a que n-1 degrés de liberté

Variable de Student et échantillon On peut montrer que est une variable de Student à (n-1) degrés de liberté

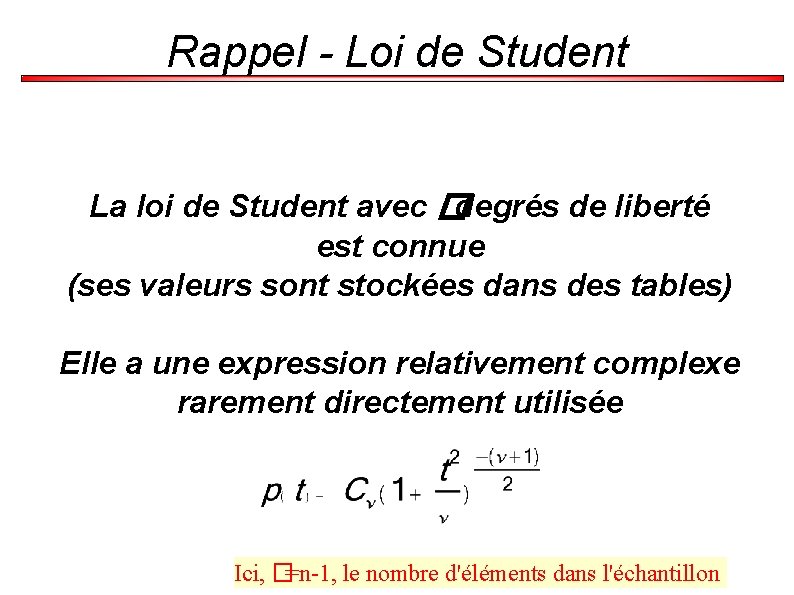

Rappel - Loi de Student La loi de Student avec �degrés de liberté est connue (ses valeurs sont stockées dans des tables) Elle a une expression relativement complexe rarement directement utilisée Ici, �=n-1, le nombre d'éléments dans l'échantillon

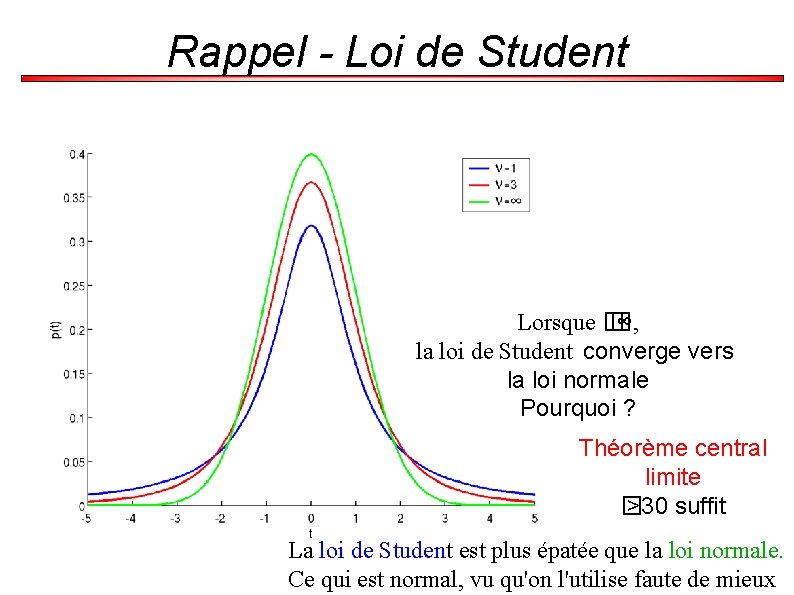

Rappel - Loi de Student Lorsque � � ∞, la loi de Student converge vers la loi normale Pourquoi ? Théorème central limite � >30 suffit La loi de Student est plus épatée que la loi normale. Ce qui est normal, vu qu'on l'utilise faute de mieux

Rappel - Loi de Student La loi de Student est tabulée. Vous pouvez : ➢ Utiliser une table (TD) ➢ Utiliser un logiciel (Excel, Matlab)

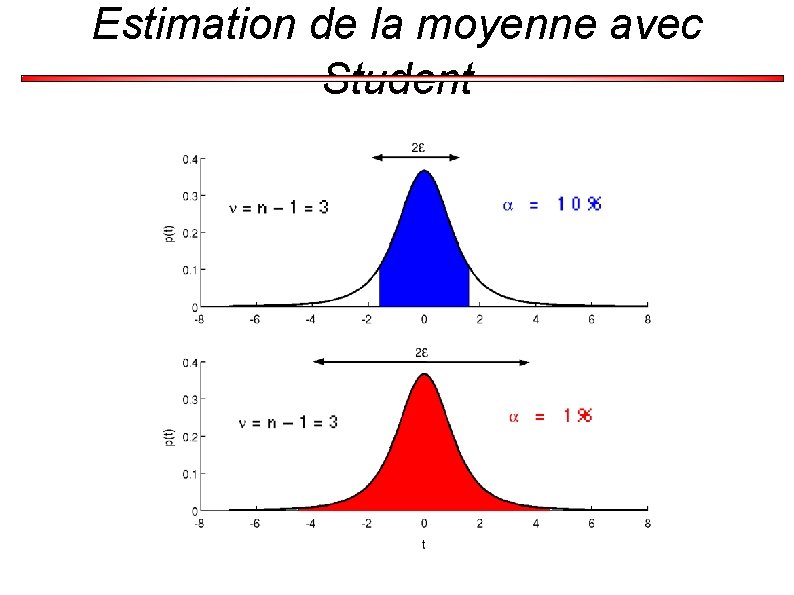

Estimation de la moyenne avec Student

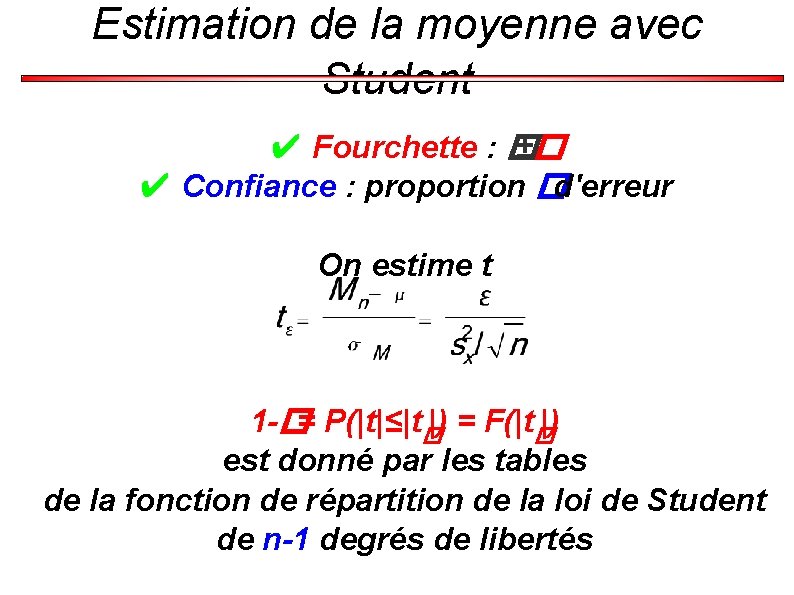

Estimation de la moyenne avec Student ✔ Fourchette : � ±� ✔ Confiance : proportion �d'erreur On estime t 1 -�= P(|t|≤|t�|) = F(|t�|) est donné par les tables de la fonction de répartition de la loi de Student de n-1 degrés de libertés

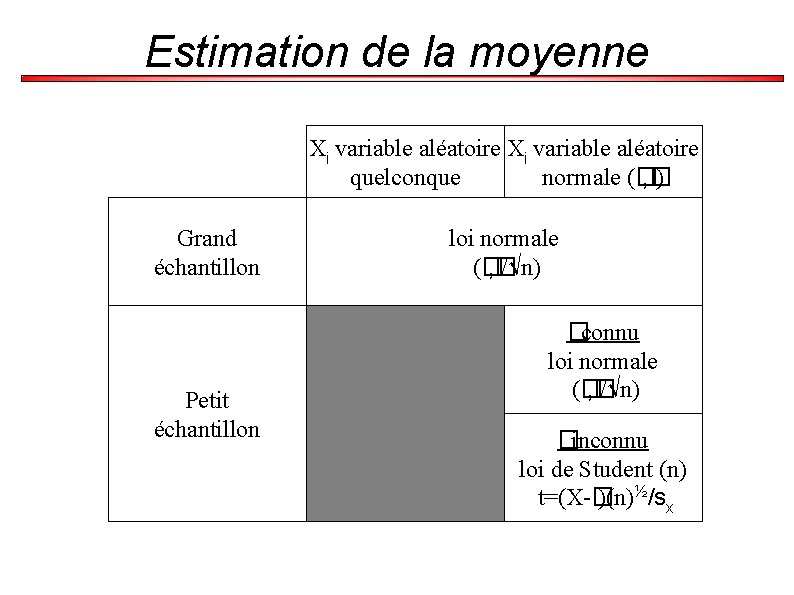

Estimation de la moyenne Xi variable aléatoire quelconque normale (� , � ) Grand échantillon Petit échantillon loi normale (� , � /√n) �connu loi normale (� , � /√n) �inconnu loi de Student (n) t=(X-� )(n)½/sx

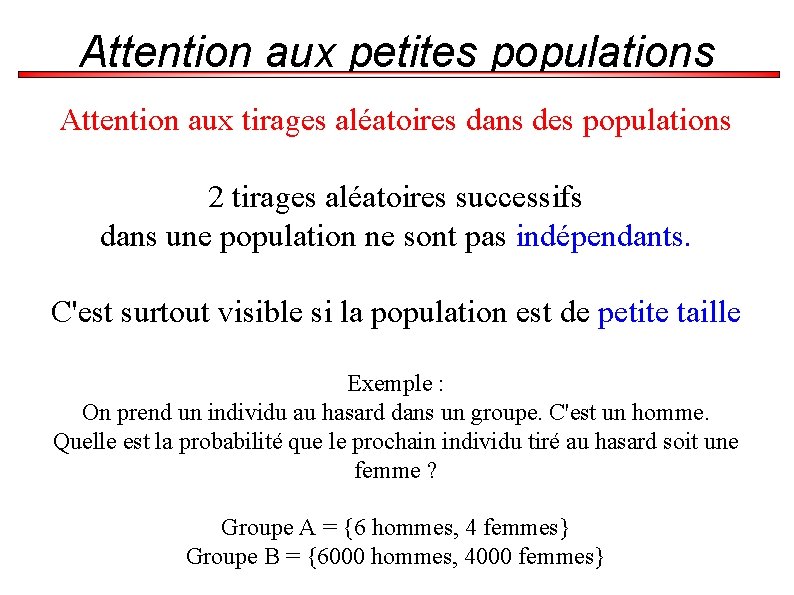

Attention aux petites populations Attention aux tirages aléatoires dans des populations 2 tirages aléatoires successifs dans une population ne sont pas indépendants. C'est surtout visible si la population est de petite taille Exemple : On prend un individu au hasard dans un groupe. C'est un homme. Quelle est la probabilité que le prochain individu tiré au hasard soit une femme ? Groupe A = {6 hommes, 4 femmes} Groupe B = {6000 hommes, 4000 femmes}

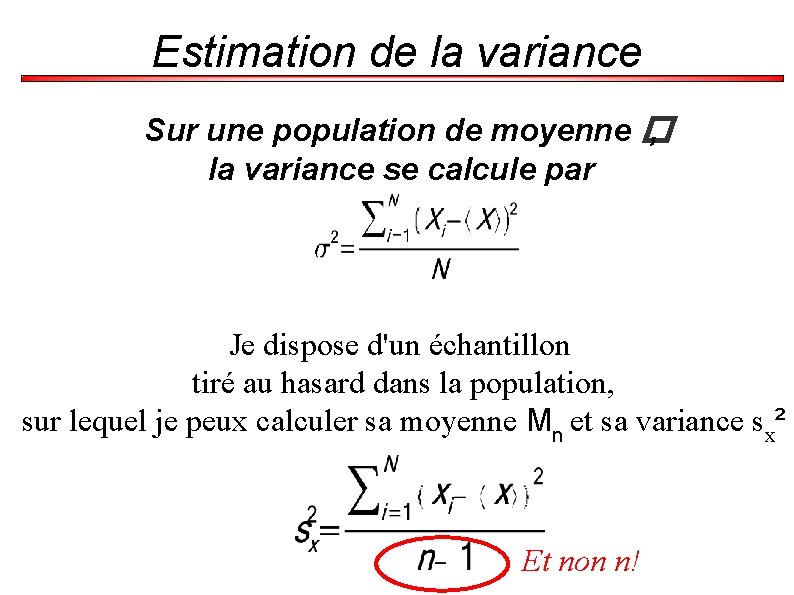

Estimation de la variance Sur une population de moyenne � , la variance se calcule par Je dispose d'un échantillon tiré au hasard dans la population, sur lequel je peux calculer sa moyenne Mn et sa variance sx² Et non n!

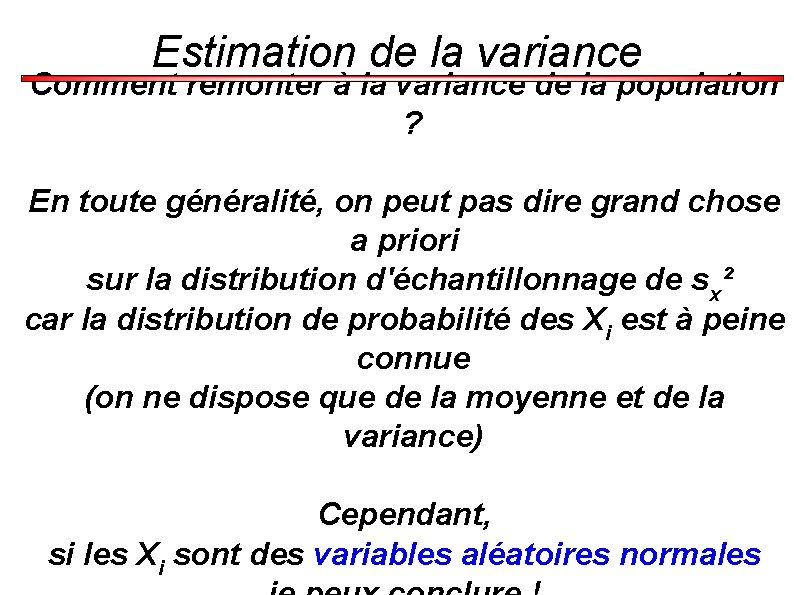

Estimation de la variance Comment remonter à la variance de la population ? En toute généralité, on peut pas dire grand chose a priori sur la distribution d'échantillonnage de sx² car la distribution de probabilité des Xi est à peine connue (on ne dispose que de la moyenne et de la variance) Cependant, si les Xi sont des variables aléatoires normales

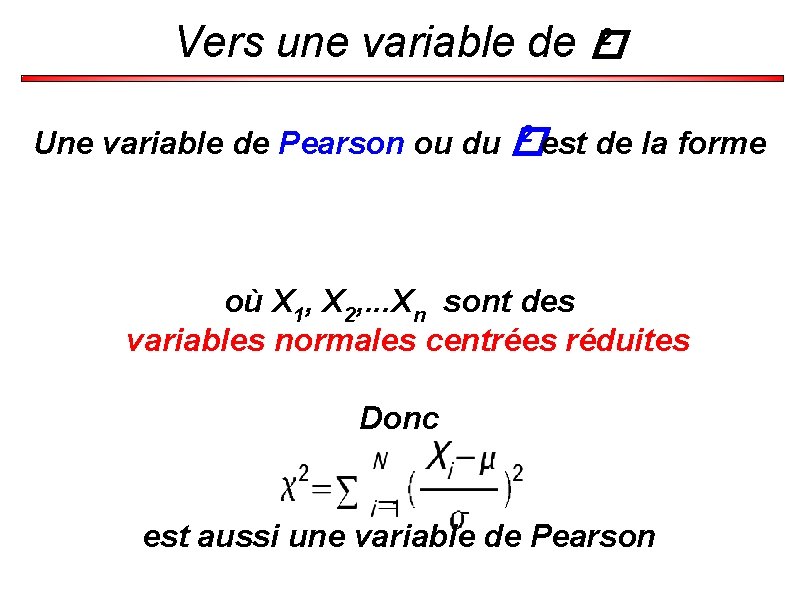

2 Vers une variable de � 2 est de la forme Une variable de Pearson ou du � où X 1, X 2, . . . Xn sont des variables normales centrées réduites Donc est aussi une variable de Pearson

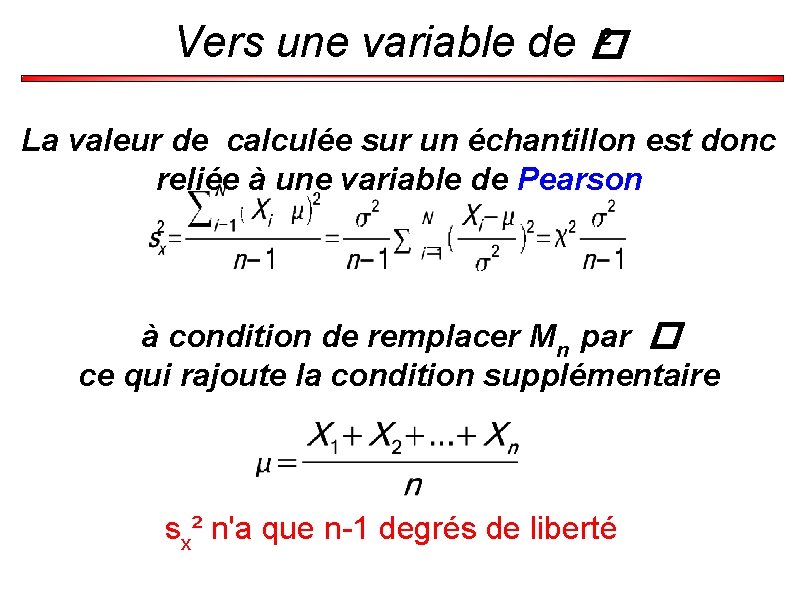

2 Vers une variable de � La valeur de calculée sur un échantillon est donc reliée à une variable de Pearson à condition de remplacer Mn par � ce qui rajoute la condition supplémentaire sx² n'a que n-1 degrés de liberté

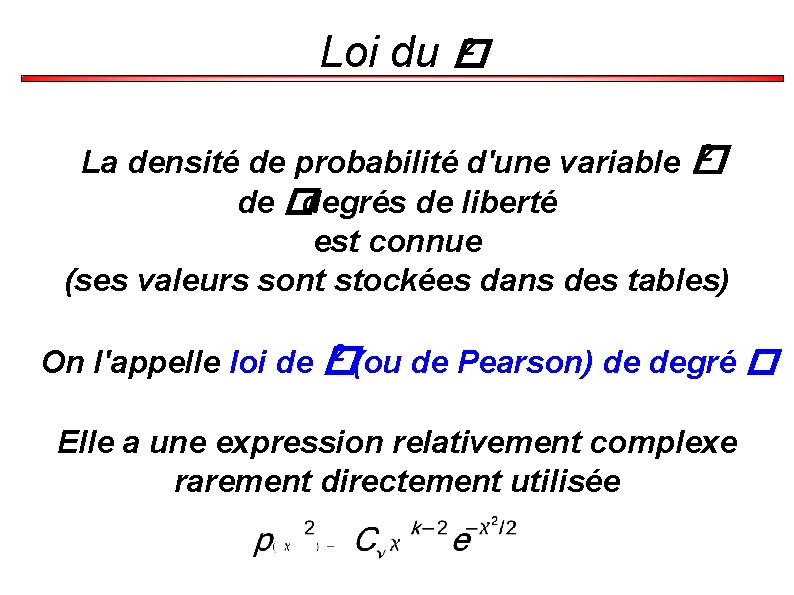

2 Loi du � 2 La densité de probabilité d'une variable � de �degrés de liberté est connue (ses valeurs sont stockées dans des tables) 2 On l'appelle loi de � (ou de Pearson) de degré � Elle a une expression relativement complexe rarement directement utilisée

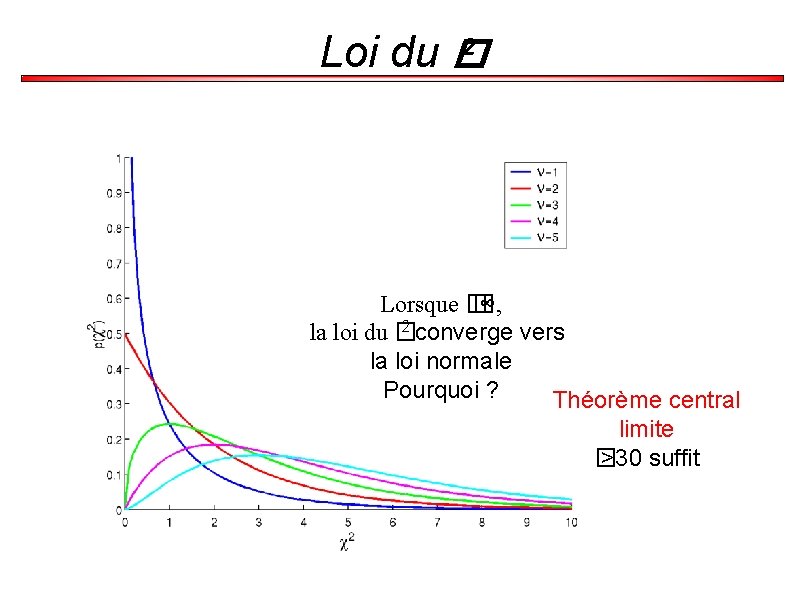

2 Loi du � Lorsque � � ∞, 2 la loi du � converge vers la loi normale Pourquoi ? Théorème central limite � >30 suffit

2 Loi du � 2 est tabulée. La loi du � Vous pouvez : ➢ Utiliser une table (TD) ➢ Utiliser un logiciel (Excel, Matlab)

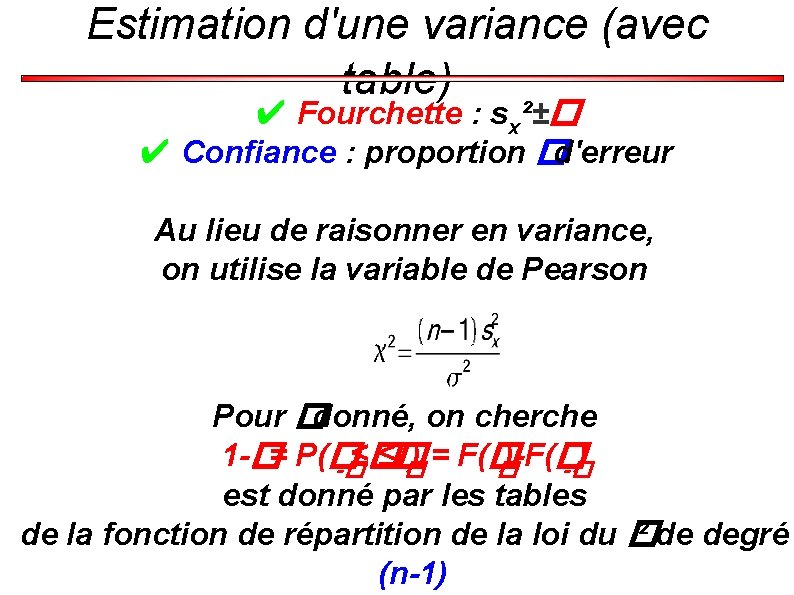

Estimation d'une variance (avec table) ✔ Fourchette : sx²±� ✔ Confiance : proportion �d'erreur Au lieu de raisonner en variance, on utilise la variable de Pearson Pour �donné, on cherche 1 -�= P(� ≤� ≤� ) = F(� )-F(� ) -� � � -� est donné par les tables de la fonction de répartition de la loi du � ² de degré (n-1)

II-b) Rappels sur les tests statistiques

Test Vous disposez d'un dé de 6. Vous voulez vérifier qu'il n'est pas pipé. Pour le savoir, vous tirez 20 fois le dé. Vous obtenez 19 fois la valeur 1. Le dé est sûrement pipé ! Vous venez de faire un test d'hypothèse

Démarche expérimentale (1) Formuler ses hypothèses (2) Récolter des informations Faire des expériences (3) Tirer une conclusion

Test d'hypothèse = Procédure de détermination de la plausibilité d'une hypothèse. Remarquez que nous n'avons parlé de vérité Typiquement, on déterminera la plausibilité qu'un paramètre d'un modèle prenne des valeurs différentes dans des populations distinctes, afin de mettre en évidence, ou non, un effet d'un facteur expérimental sur une population.

Paradoxe des statistiques Dans notre problème du dé : ✔ on peut facilement montrer que le dé est pipé Il suffit de faire le test, et de sortir un cas anormal ✗ mais on ne peut pas montrer facilement que le dé est normal Il faut lancer de nombreuses fois le dé, et déterminer la loi de probabilité de sortir un 1, un 2, . . . Les deux hypothèses « dé pipé » et « dé normal » ne sont pas symétriques

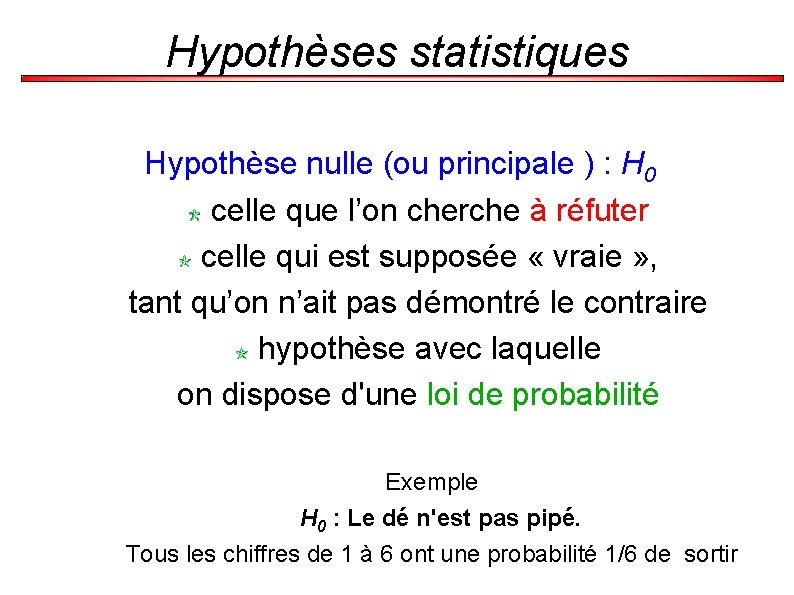

Hypothèses statistiques Le raisonnement tenu implicitement dans le cas du dé a été « Je suppose que le dé est normal et je vérifie si mes résultats confirment cette hypothèse. Sinon, c'est que le dé est pipé» On a en fait introduit deux hypothèses

Hypothèses statistiques On a en fait introduit deux hypothèses H 0 : Le dé est normal On calcule la probabilité d'obtenir 19 fois 1 en 20 lancers. Elle est infime. L'hypothèse est rejetée. H 1 : Le dé est pipé C'est ce qu'on voulait montrer

Hypothèses statistiques Hypothèse nulle (ou principale ) : H 0 celle que l’on cherche à réfuter celle qui est supposée « vraie » , tant qu’on n’ait pas démontré le contraire hypothèse avec laquelle on dispose d'une loi de probabilité Exemple H 0 : Le dé n'est pas pipé. Tous les chiffres de 1 à 6 ont une probabilité 1/6 de sortir

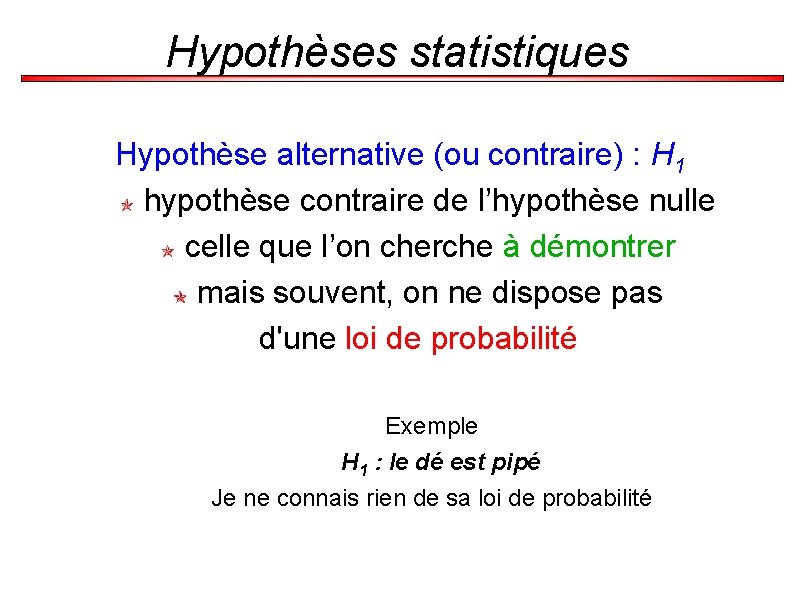

Hypothèses statistiques Hypothèse alternative (ou contraire) : H 1 hypothèse contraire de l’hypothèse nulle celle que l’on cherche à démontrer mais souvent, on ne dispose pas d'une loi de probabilité Exemple H 1 : le dé est pipé Je ne connais rien de sa loi de probabilité

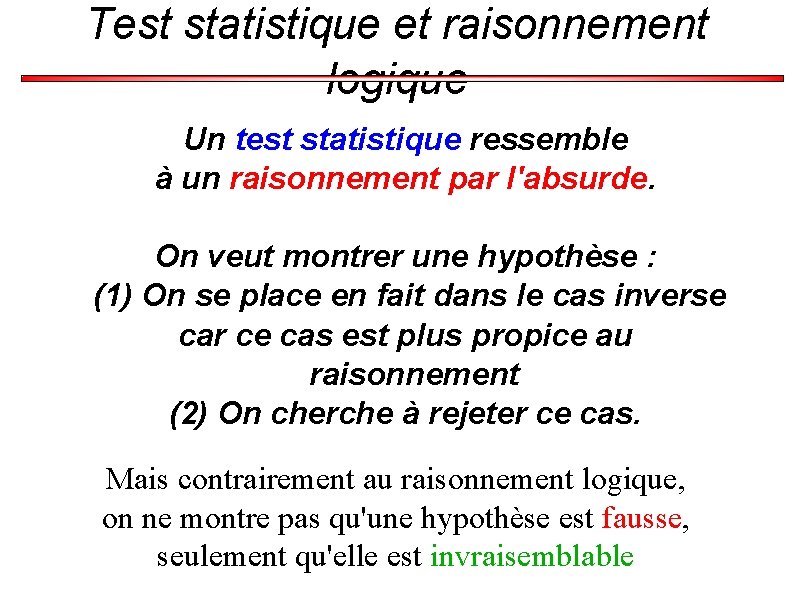

Test statistique et raisonnement logique Un test statistique ressemble à un raisonnement par l'absurde. On veut montrer une hypothèse : (1) On se place en fait dans le cas inverse car ce cas est plus propice au raisonnement (2) On cherche à rejeter ce cas. Mais contrairement au raisonnement logique, on ne montre pas qu'une hypothèse est fausse, seulement qu'elle est invraisemblable

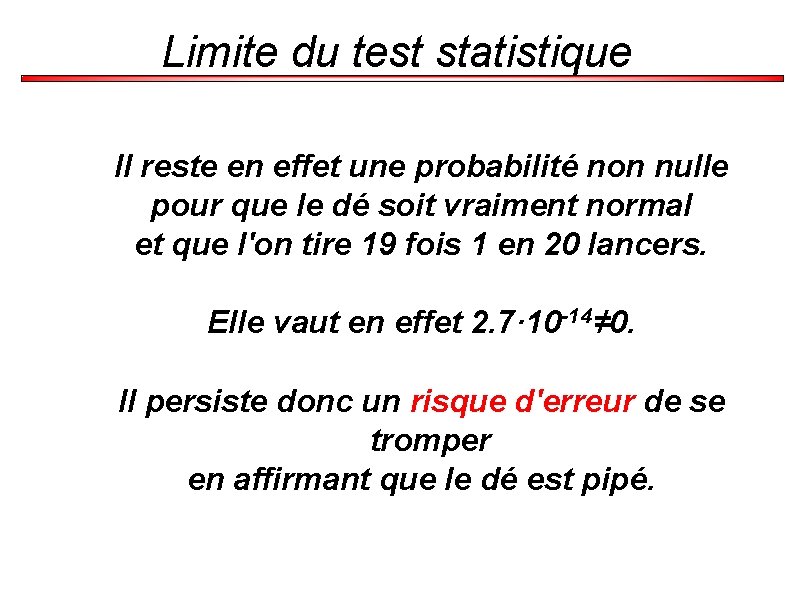

Limite du test statistique Il reste en effet une probabilité non nulle pour que le dé soit vraiment normal et que l'on tire 19 fois 1 en 20 lancers. Elle vaut en effet 2. 7· 10 -14≠ 0. Il persiste donc un risque d'erreur de se tromper en affirmant que le dé est pipé.

Erreur statistique de première espèce Erreur de première espèce = erreur de type I = erreur �= Rejet de l'hypothèse H 0 alors qu'elle était vraie. Exemple • Affirmer que le dé est pipé alors qu'il est normal

Limite du test statistique La décision était jusqu'à présent simple à prendre Mais que pourrions nous dire si j'avais obtenu 6 fois 1 en 20 lancers ? ✔ 6/20>1/6 : le chiffre 1 semble bien fréquent. . . H 1 : « Le dé est pipé » semble vraisemblable ✔ Mais en supposant H 0 : « Le dé est normal » , la possibilité d'avoir 6 fois 1 en 20 coups est de 6. 5% H 0 : « Le dé est normal » semble vraisemblable Une affirmation et son contraire semblent vraisemblables ! Il nous faut être plus précis et établir un critère de plausibilité

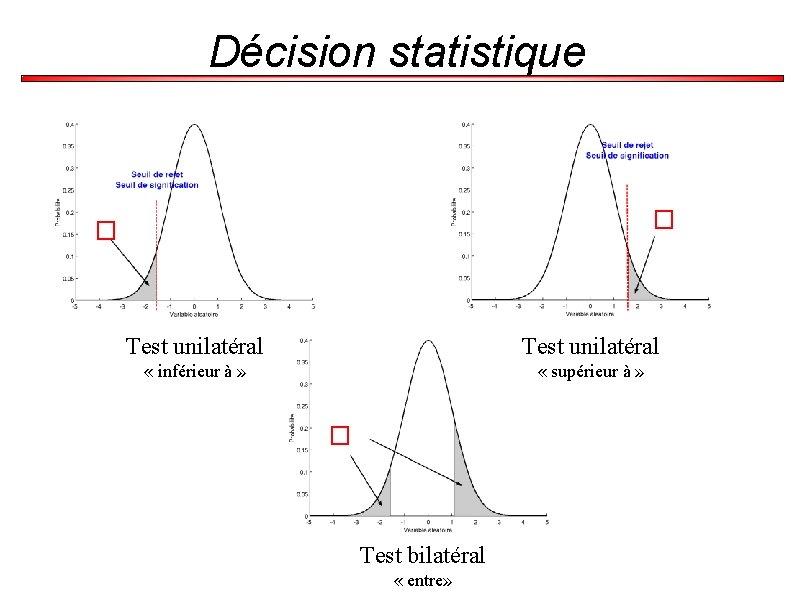

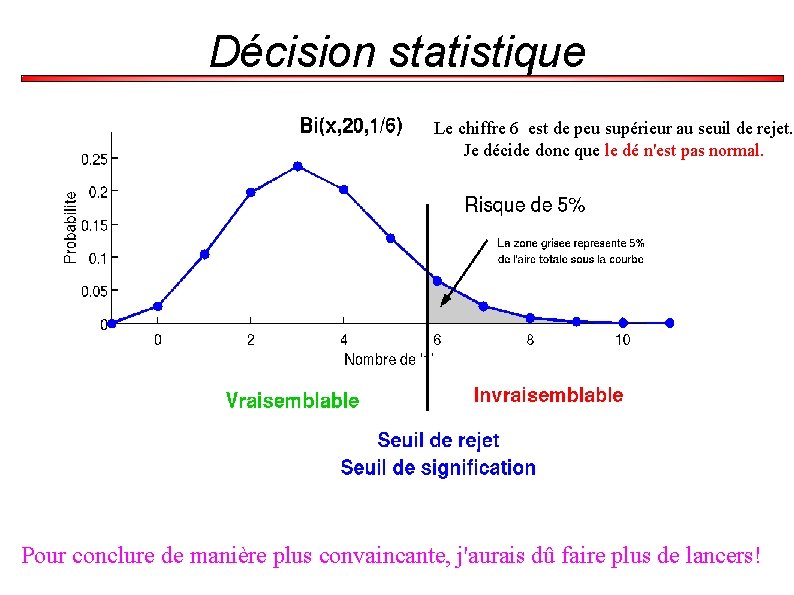

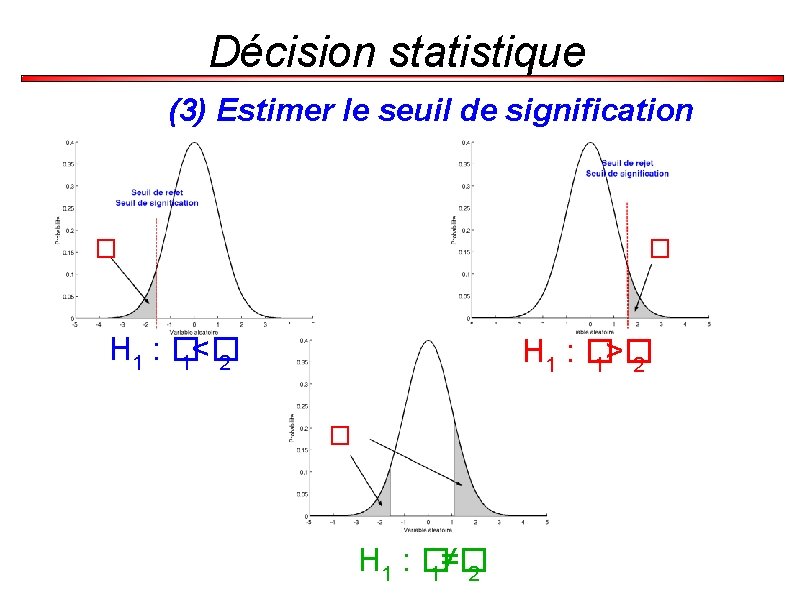

Décision statistique Il nous faut un critère de rejet de l'hypothèse H 0. Plusieurs choix sont possibles : test unilatéraux On écarte toute valeur inférieure ou supérieure à une valeur seuil Cette valeur est appelée seuil de rejet (ou seuil de signification). test bilatéraux On écarte toute valeur se trouvant hors d'un intervalle.

Seuil de rejet et risque On fait souvent dépendre le seuil de signification au risque acceptable d'erreur Le risque de faire une erreur de type I est noté �. Cette erreur correspond au rapport de l'aire sous la courbe correspondant au valeurs rejetées et de l'aire totale (égale à 1 après standardisation). On rejette alors un pourcentage (1 -� ) des cas possibles.

Décision statistique � � Test unilatéral « inférieur à » « supérieur à » � Test bilatéral « entre»

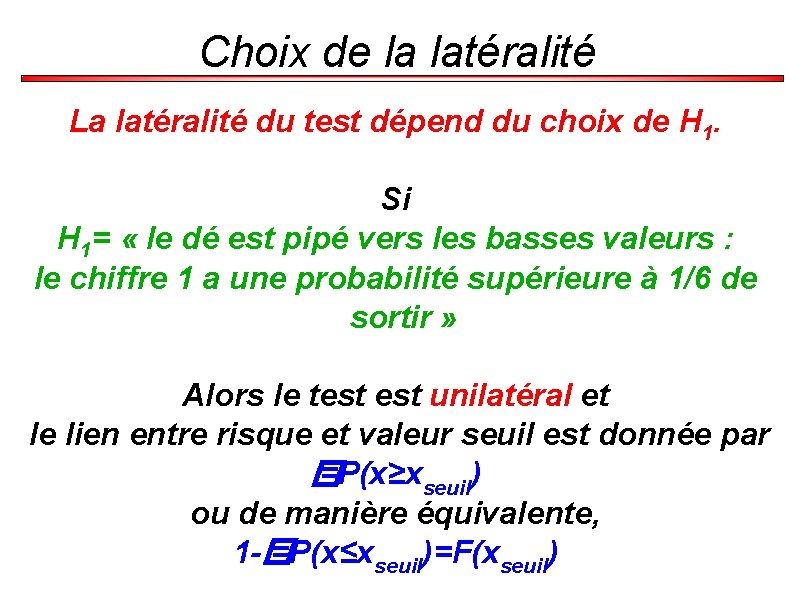

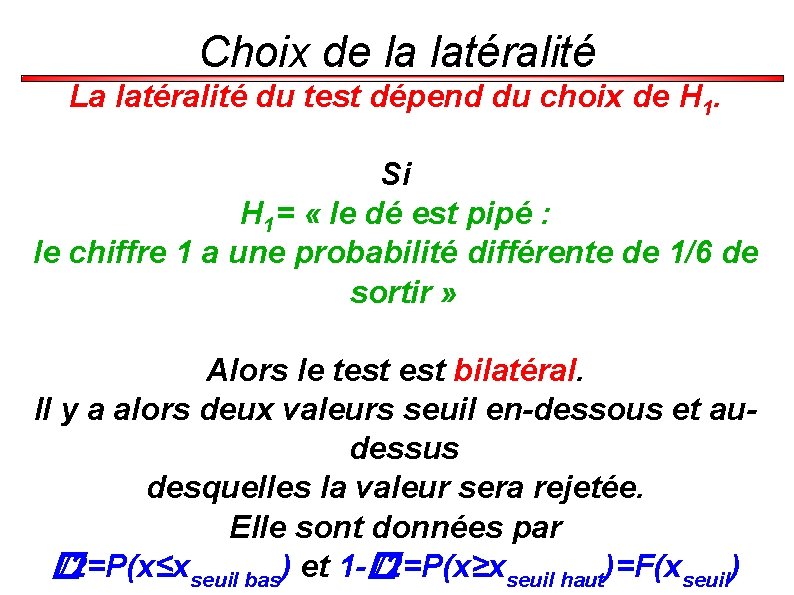

Choix de la latéralité La latéralité du test dépend du choix de H 1. Si H 1= « le dé est pipé vers les basses valeurs : le chiffre 1 a une probabilité supérieure à 1/6 de sortir » Alors le test unilatéral et le lien entre risque et valeur seuil est donnée par � =P(x≥xseuil) ou de manière équivalente, 1 -� =P(x≤xseuil)=F(xseuil)

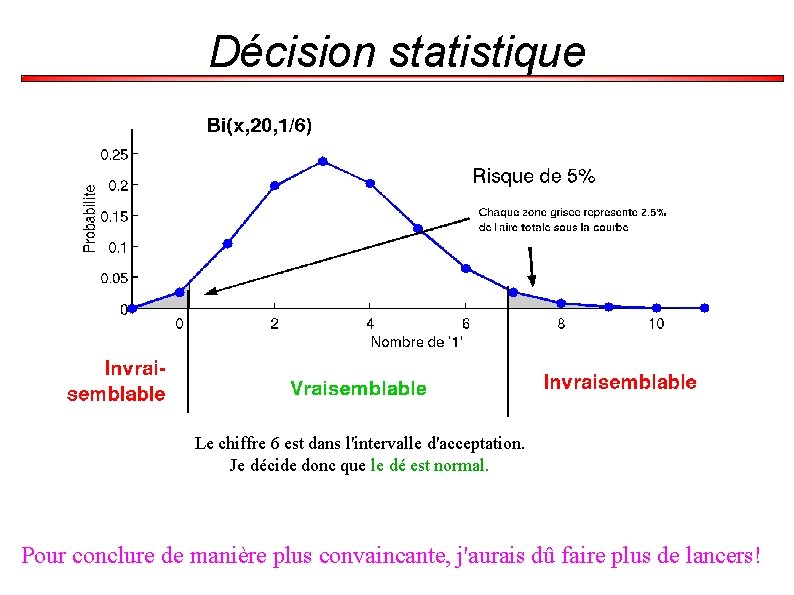

Décision statistique Le chiffre 6 est de peu supérieur au seuil de rejet. Je décide donc que le dé n'est pas normal. Pour conclure de manière plus convaincante, j'aurais dû faire plus de lancers!

Choix de la latéralité La latéralité du test dépend du choix de H 1. Si H 1= « le dé est pipé : le chiffre 1 a une probabilité différente de 1/6 de sortir » Alors le test bilatéral. Il y a alors deux valeurs seuil en-dessous et audessus desquelles la valeur sera rejetée. Elle sont données par � /2=P(x≤xseuil bas) et 1 -� /2=P(x≥xseuil haut)=F(xseuil)

Décision statistique Le chiffre 6 est dans l'intervalle d'acceptation. Je décide donc que le dé est normal. Pour conclure de manière plus convaincante, j'aurais dû faire plus de lancers!

Choix d'hypothèse Le choix des hypothèses est crucial

Risques statistiques Le choix du risque toléré est aussi crucial, mais on se contente souvent de valeurs de risque «standards» : � =5%=0. 05 Risque significatif � =1%=0. 01 Risque hautement significatif � =1‰=0. 001 Risque très hautement significatif

Décision statistique Le risque acceptable dépend du problème considéré. En général, un risque de 5% est suffisant. Dans certains cas (santé publique, . . . ), le risque tolérable est encore plus petit. Appliquer rigoureusement le principe de précaution revient à le prendre nul. Mais réduire le seuil de rejet de H 0 augmente le risque d'accepter H 0 alors qu'elle est fausse !

Erreur statistique de deuxième espèce Erreur de deuxième espèce = erreur de type II = erreur �= Rejet de l'hypothèse H 1 alors qu'elle était vraie. Exemple • Affirmer que le dé est normal alors qu'il est pipé

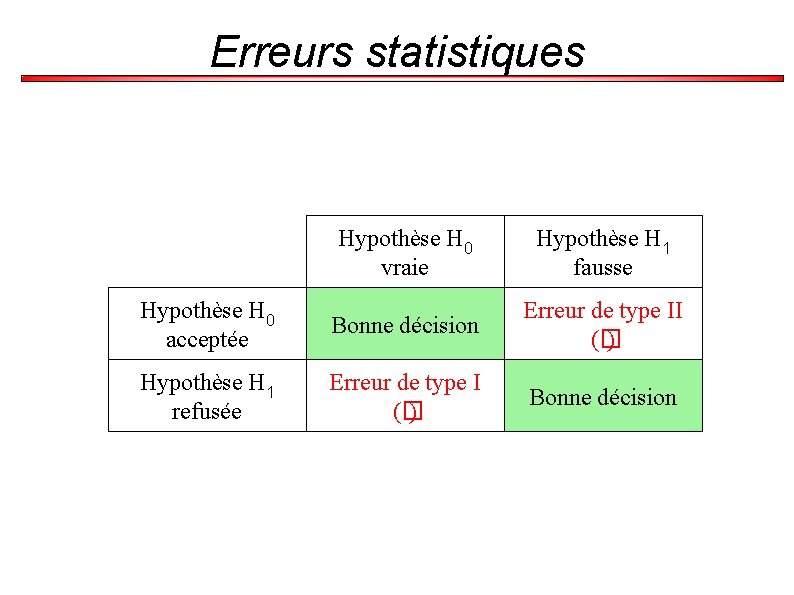

Erreurs statistiques Hypothèse H 0 vraie Hypothèse H 1 fausse Hypothèse H 0 acceptée Bonne décision Erreur de type II (� ) Hypothèse H 1 refusée Erreur de type I (� ) Bonne décision

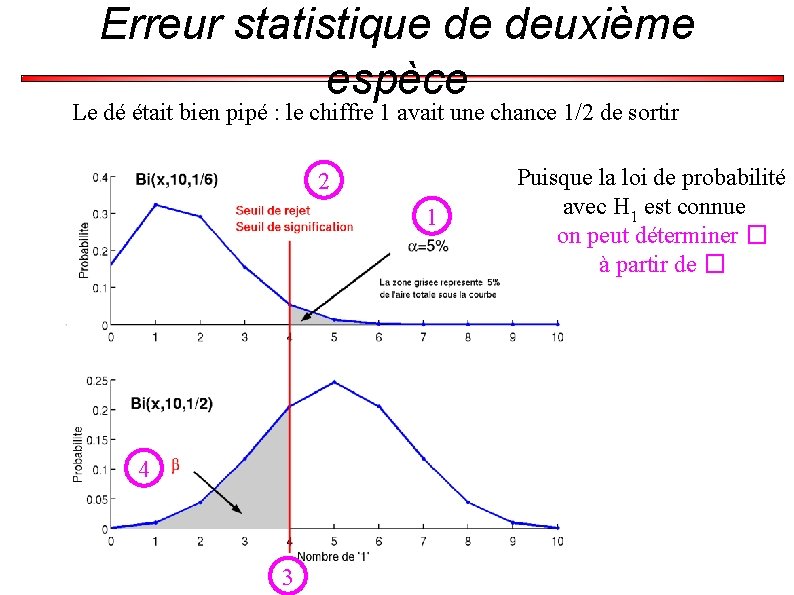

Erreur statistique de deuxième espèce Le dé était bien pipé : le chiffre 1 avait une chance 1/2 de sortir 2 1 4 3 Puisque la loi de probabilité avec H 1 est connue on peut déterminer � à partir de �

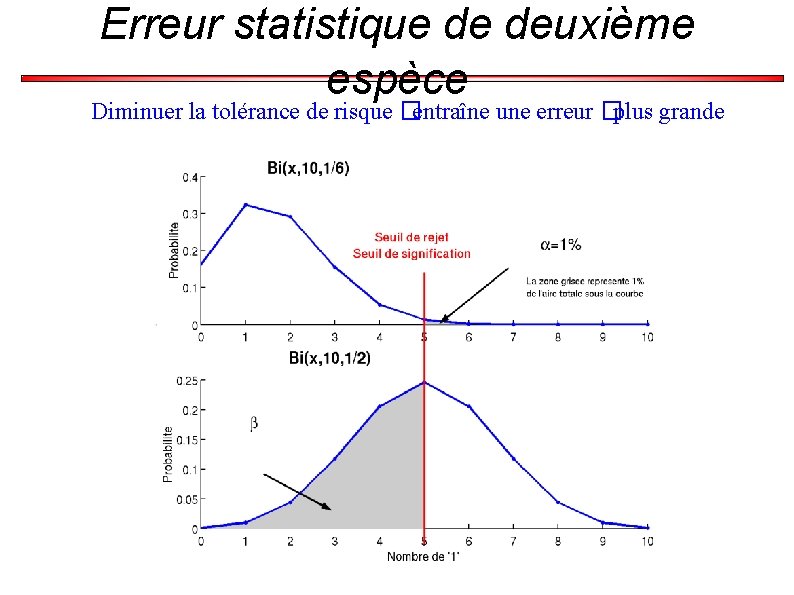

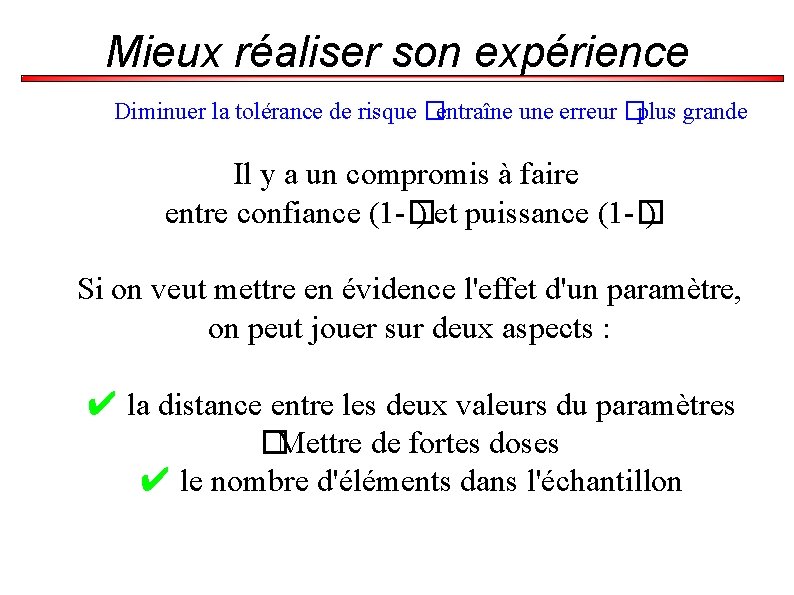

Erreur statistique de deuxième espèce Diminuer la tolérance de risque �entraîne une erreur �plus grande

Erreurs statistiques Diminuer la tolérance de risque �entraîne une erreur �plus grande Il y a donc un compromis à trouver entre les valeurs de �et de �

Erreur statistique de deuxième espèce Bien souvent, l'estimation de l'erreur �est impossible car on ne connaît pas la loi de probabilité d'obtenir les résultats expérimentaux si on suppose l'hypothèse H 1. C'est pourquoi la phase d'estimation de qualité d'un test de diagnostic médical est réalisée sur deux séries d'échantillons : - les personnes saines - les personnes malades

Puissance d'un test statistique Puissance statistique d'un test = 1 -�= Probabilité d'accepter H 1 alors qu'elle est vraie, pour �donné. Pour un risque �donné, le test le plus puissant est celui qui a le plus faible � et donc la plus grande puissance statistique. Le terme «puissance» vient des test médicaux, où H 1= «le patient est malade» . La puissance du test la probabilité de diagnostiquer un patient malade. Elle a intérêt à être bonne !

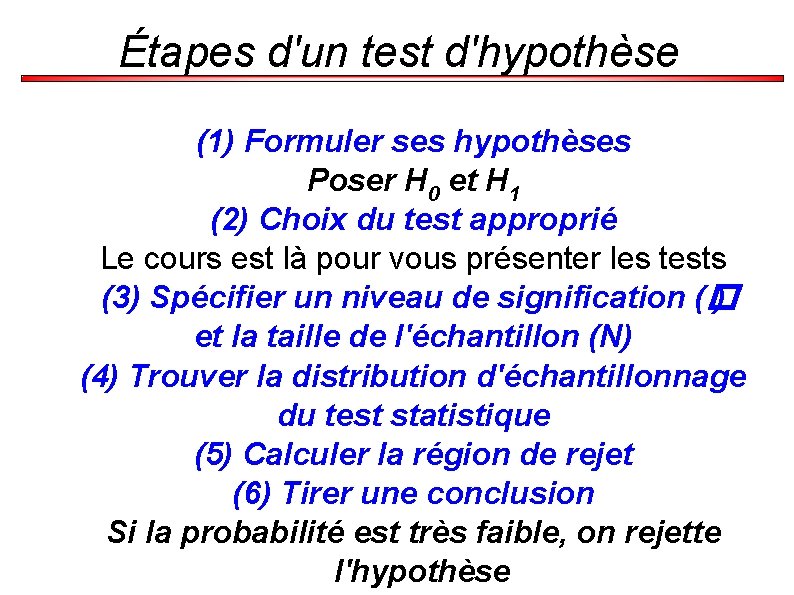

Étapes d'un test d'hypothèse (1) Formuler ses hypothèses Poser H 0 et H 1 (2) Identifier la probabilité d'avoir les résultats expérimentaux La probabilité est calculé en supposant H 0 vraie (3) En déduire le seuil de signification Elle dépend du risque toléré et de la formulation de H 1 (4) Tirer une conclusion Comparer les résultats obtenus à la valeur seuil.

Exemple Les adultes normaux en bonne santé tapent du doigt à un rythme moyen de 100 tapotements en 20 secondes, avec un écart-type de 20. On sait aussi que les vitesses de tapotements sont normalement distribuées dans la population. Cependant, les personnes souffrant de troubles neurologiques tapent du doigt avec un rythme plus lent. Vous présentez un score de 70 tapotements en 20 secondes. Êtes-vous une personne normale mais lente ou d'une personne souffrant d un trouble neurologique ?

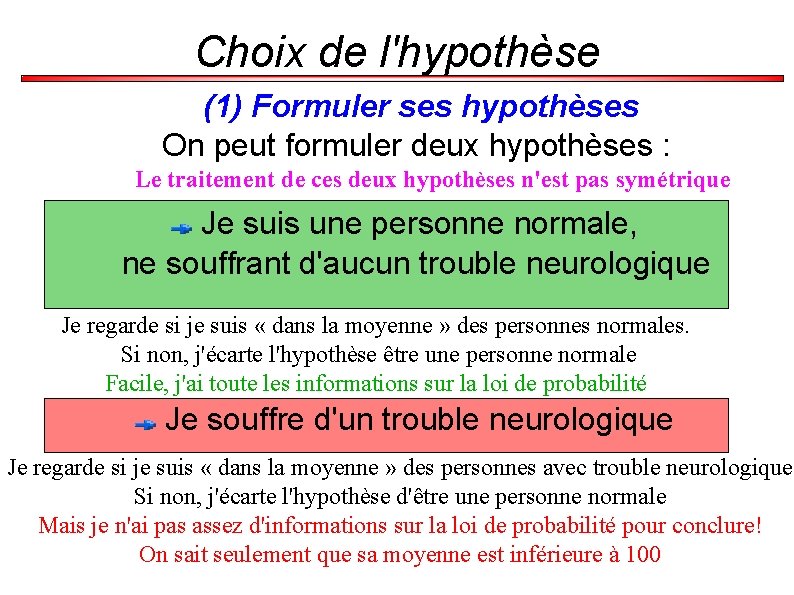

Choix de l'hypothèse (1) Formuler ses hypothèses On peut formuler deux hypothèses : Le traitement de ces deux hypothèses n'est pas symétrique Je suis une personne normale, ne souffrant d'aucun trouble neurologique Je regarde si je suis « dans la moyenne » des personnes normales. Si non, j'écarte l'hypothèse être une personne normale Facile, j'ai toute les informations sur la loi de probabilité Je souffre d'un trouble neurologique Je regarde si je suis « dans la moyenne » des personnes avec trouble neurologique Si non, j'écarte l'hypothèse d'être une personne normale Mais je n'ai pas assez d'informations sur la loi de probabilité pour conclure! On sait seulement que sa moyenne est inférieure à 100

Exemple – Choix de l'hypothèse (1) Formuler ses hypothèses H 0 = Je suis une personne normale H 1 = Je souffre d'un trouble neurologique. Mon score de tapotements est inférieure à celle d'une personne normale

Exemple – Identification de la distribution (2) Identifier la probabilité d'avoir les résultats expérimentaux Si je suis une personne normale (H 0), la loi de probabilité du score de tapotements est donnée par une loi normale de moyenne 100 et d'écart-type 20

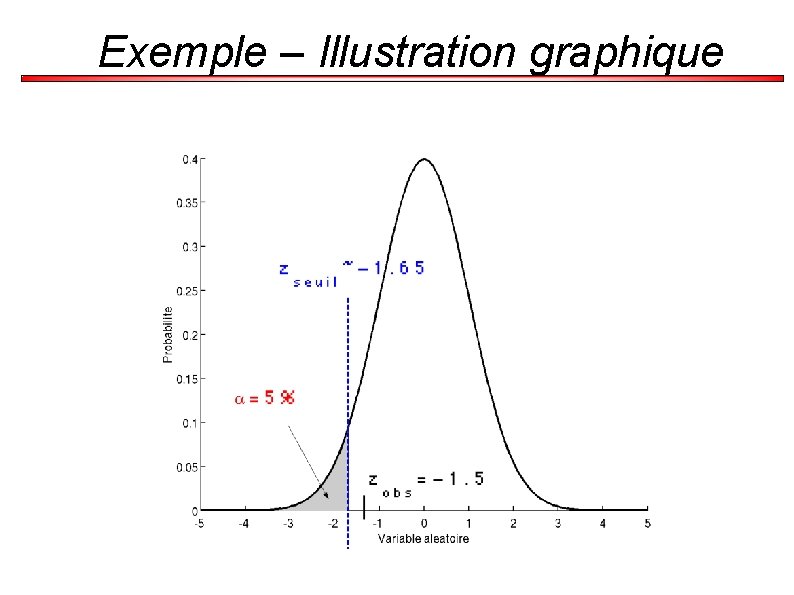

Exemple – Estimation du seuil (3) Estimer le seuil de signification Comme rien ne m'est indiqué, je prends la valeur de risque par défaut : 5% C'est un test unilatéral (à gauche) J'ai à ma disposition la table de la loi normale, je calcule donc la valeur standardisée seuil à l'aide de la fonction de répartition zseuil=Inv(F(0. 05))=-1. 65

Exemple – Décision (4) Décision La valeur normalisée correspondant à mes données est z=(x-� )/� =(70 -100)/20=-1. 5 C'est supérieur à zseuil=-1. 65 Je ne rejette pas l'hypothèse H 0 Je conclus donc que mon faible score de tapotements ne permet pas de dire que je suis anormale Noter que le test n'a pas prouvé que je suis normale!

Exemple – Illustration graphique

II-c) Comparaison de deux populations

Cas d'échantillons de grande taille Nous avons deux échantillons : l'un de moyenne M 1 et de variance sx 1² représentatif d'une population (� 1, � 1²) l'autre de moyenne M 2 et de variance sx 2² représentatif d'une population (� 2, � 2²)

Comparaison de deux moyennes d'échantillons On trouve M 1≠M 2. Doit-on pour autant conclure que � 1≠ � 2 ? Ce n'est pas évident, car la différence peut être due à la variabilité de la population. Comme ✔ il y a incertitude due à la variabilité, ✔ on veut vérifier si il y a égalité des moyennes des population , on applique la théorie des tests statistiques

Comparaison de deux moyennes d'échantillons (1) Formuler ses hypothèses On veut savoir si les deux moyennes � 1 et � 2 sont égales. H 0 : � 1= � 2 Nous verrons qu'on peut alors étudier la probabilité que les deux moyennes d'échantillons M 1 et M 2 soient très différentes. On a plusieurs possibilités dans le chois de H 1 : � 1< � 2 1≠ � 2 1> � 2 Le choix de H 1 va conditionner la latéralité du test.

Comparaison de deux moyennes d'échantillons (2) Identifier la probabilité d'avoir les résultats expérimentaux Lors du calcul de l'intervalle de confiance de la moyenne, nous avons vu que la distribution d'échantillonnage de la moyenne était différentes dans deux cas : L'échantillon est de grande taille L'échantillon est de petite taille

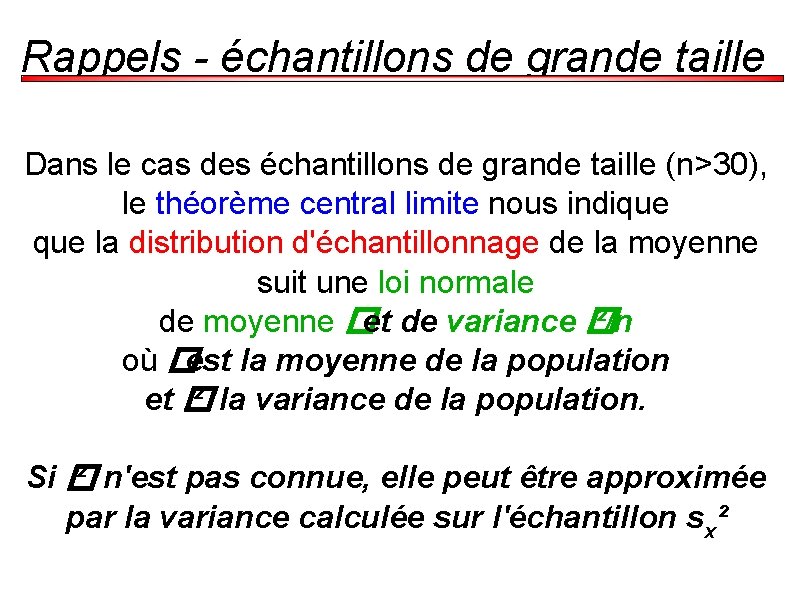

Rappels - échantillons de grande taille Dans le cas des échantillons de grande taille (n>30), le théorème central limite nous indique la distribution d'échantillonnage de la moyenne suit une loi normale de moyenne �et de variance � ²/n où �est la moyenne de la population et � ² la variance de la population. Si � ² n'est pas connue, elle peut être approximée par la variance calculée sur l'échantillon sx²

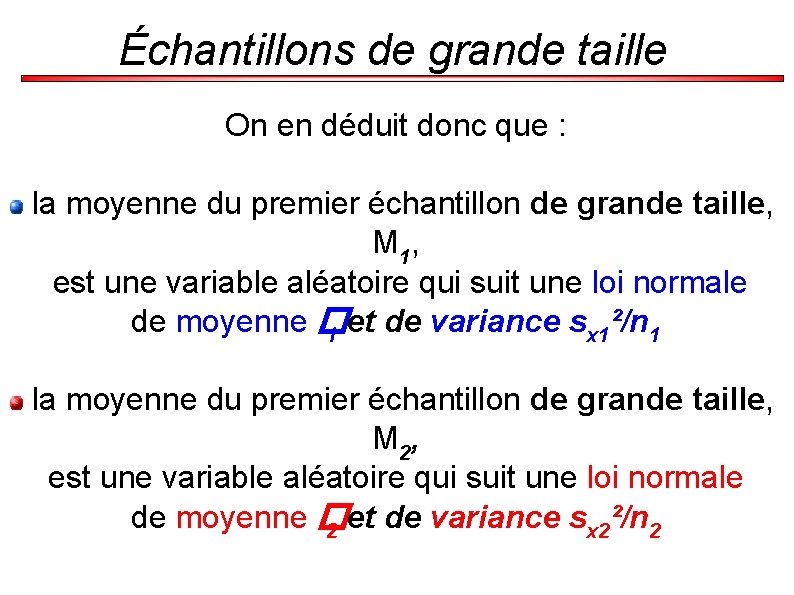

Échantillons de grande taille On en déduit donc que : la moyenne du premier échantillon de grande taille, M 1 , est une variable aléatoire qui suit une loi normale de moyenne � 1 et de variance sx 1²/n 1 la moyenne du premier échantillon de grande taille, M 2 , est une variable aléatoire qui suit une loi normale de moyenne � 2 et de variance sx 2²/n 2

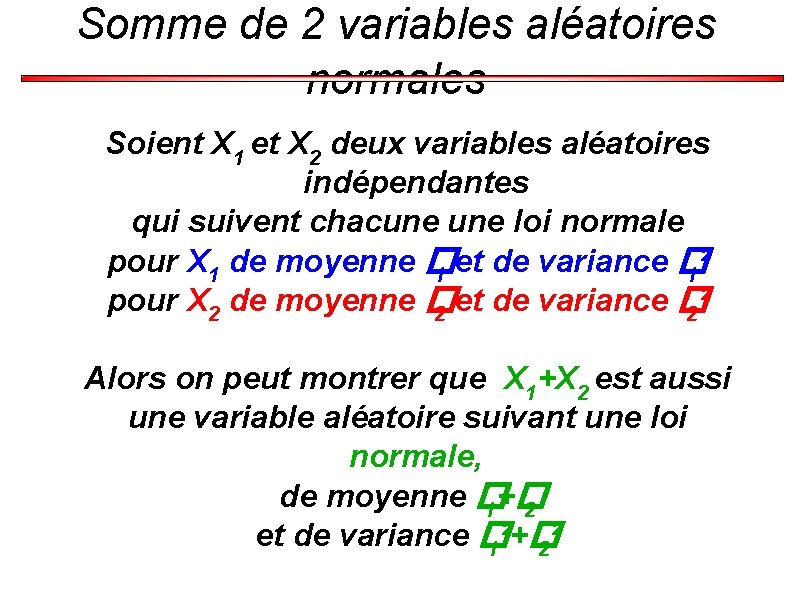

Somme de 2 variables aléatoires normales Soient X 1 et X 2 deux variables aléatoires indépendantes qui suivent chacune loi normale pour X 1 de moyenne � 1 et de variance � 1² pour X 2 de moyenne � 2 et de variance � 2² Alors on peut montrer que X 1+X 2 est aussi une variable aléatoire suivant une loi normale, de moyenne � 1+ � 2 et de variance � 1²+� 2²

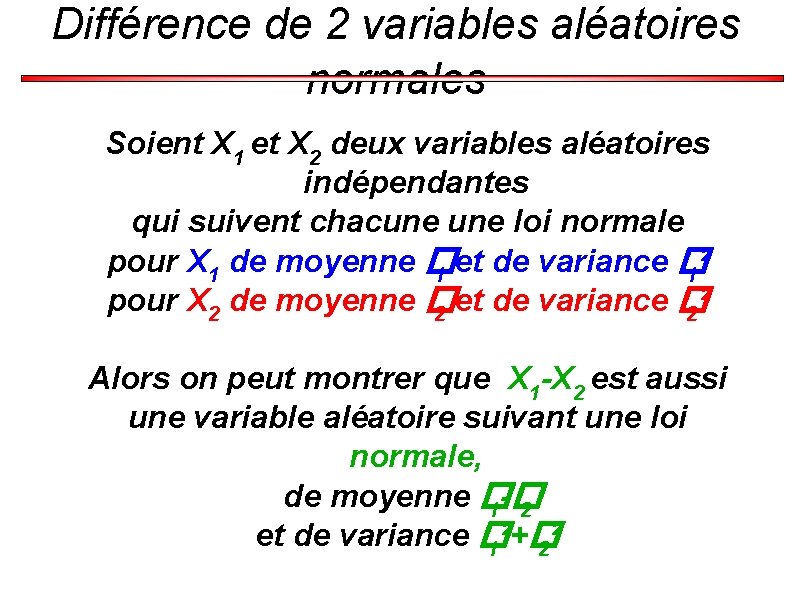

Différence de 2 variables aléatoires normales Soient X 1 et X 2 deux variables aléatoires indépendantes qui suivent chacune loi normale pour X 1 de moyenne � 1 et de variance � 1² pour X 2 de moyenne � 2 et de variance � 2² Alors on peut montrer que X 1 -X 2 est aussi une variable aléatoire suivant une loi normale, de moyenne � 1 -� 2 et de variance � 1²+� 2²

Différence de 2 variables aléatoires normales Illustration graphique

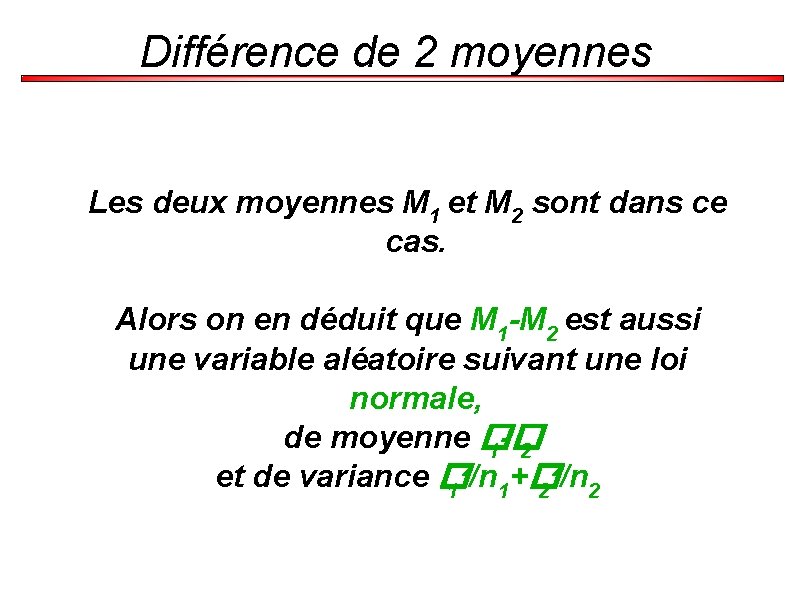

Différence de 2 moyennes Les deux moyennes M 1 et M 2 sont dans ce cas. Alors on en déduit que M 1 -M 2 est aussi une variable aléatoire suivant une loi normale, de moyenne � 1 -� 2 et de variance sx 1²/n 1+sx 2²/n 2

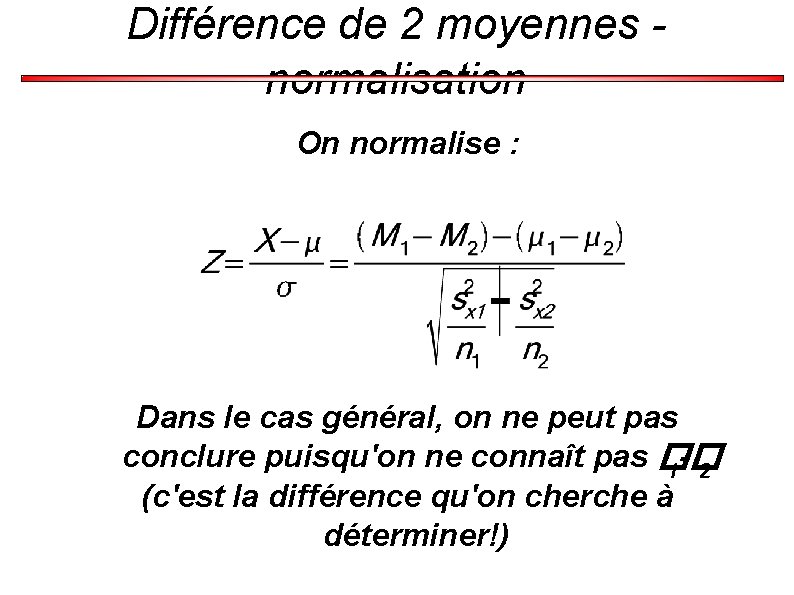

Différence de 2 moyennes normalisation On normalise : Dans le cas général, on ne peut pas conclure puisqu'on ne connaît pas � 1 -� 2 (c'est la différence qu'on cherche à déterminer!)

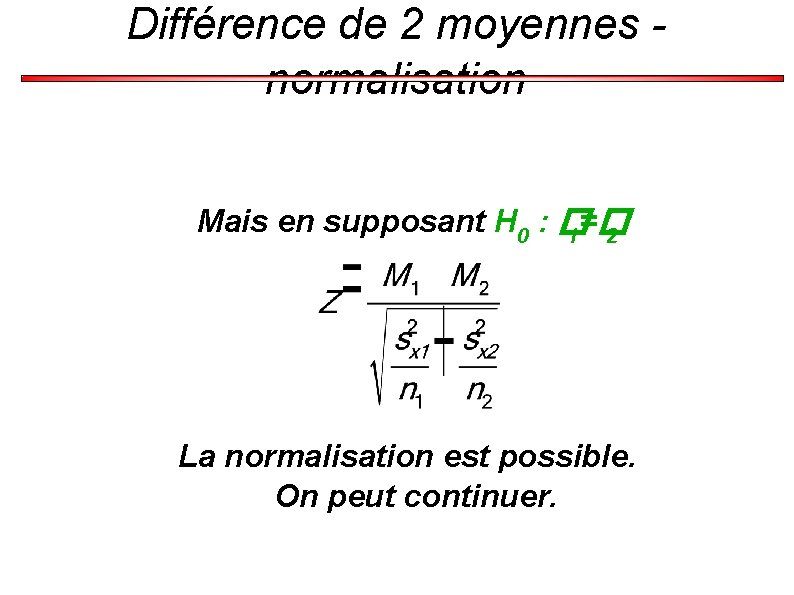

Différence de 2 moyennes normalisation Mais en supposant H 0 : � 1= � 2 La normalisation est possible. On peut continuer.

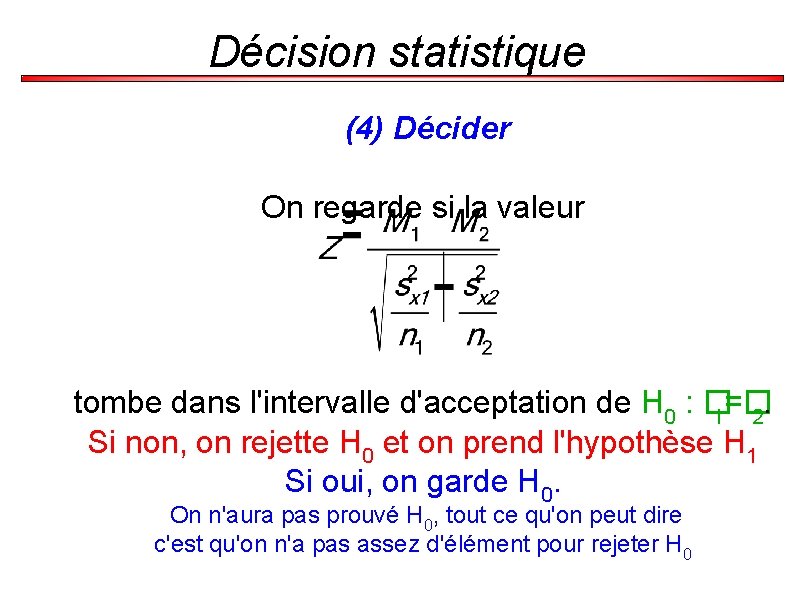

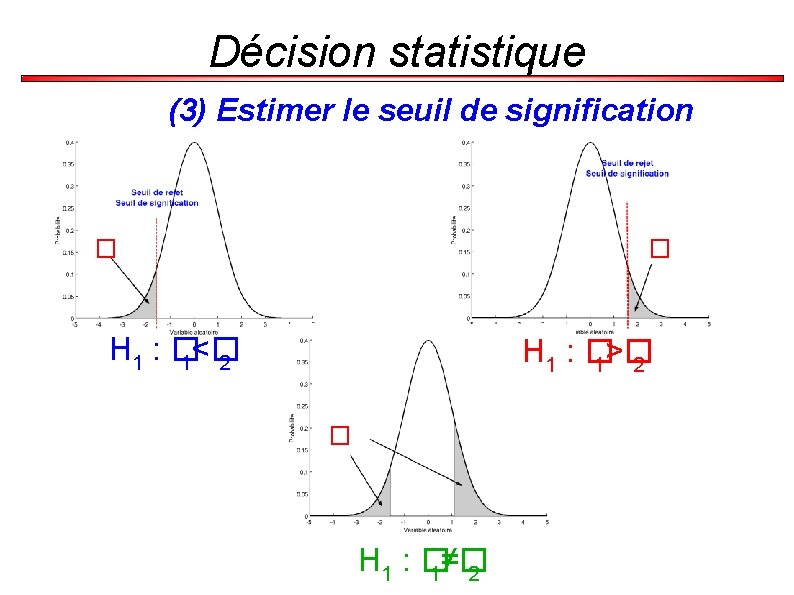

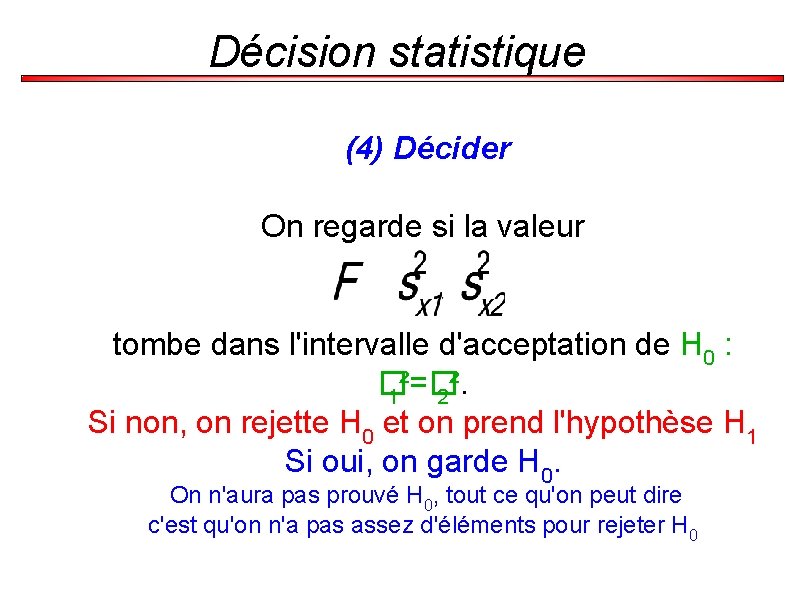

Décision statistique (3) Estimer le seuil de signification � � H 1 : � <� 1 2 H 1 : � >� 1 2 � H 1 : � ≠� 1 2

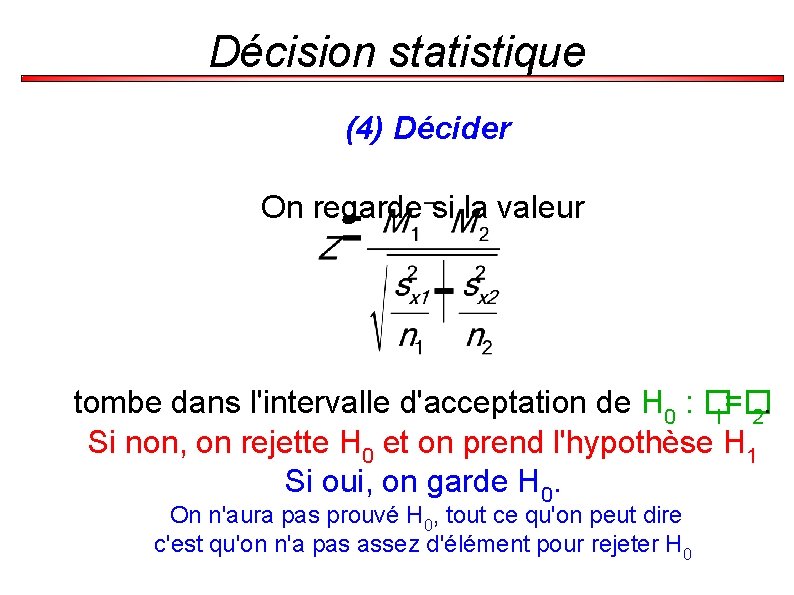

Décision statistique (4) Décider On regarde si la valeur tombe dans l'intervalle d'acceptation de H 0 : � 1=� 2. Si non, on rejette H 0 et on prend l'hypothèse H 1 Si oui, on garde H 0. On n'aura pas prouvé H 0, tout ce qu'on peut dire c'est qu'on n'a pas assez d'élément pour rejeter H 0

Mieux réaliser son expérience Diminuer la tolérance de risque �entraîne une erreur �plus grande Il y a un compromis à faire entre confiance (1 -� ) et puissance (1 -� ) Si on veut mettre en évidence l'effet d'un paramètre, on peut jouer sur deux aspects : ✔ la distance entre les deux valeurs du paramètres �Mettre de fortes doses ✔ le nombre d'éléments dans l'échantillon

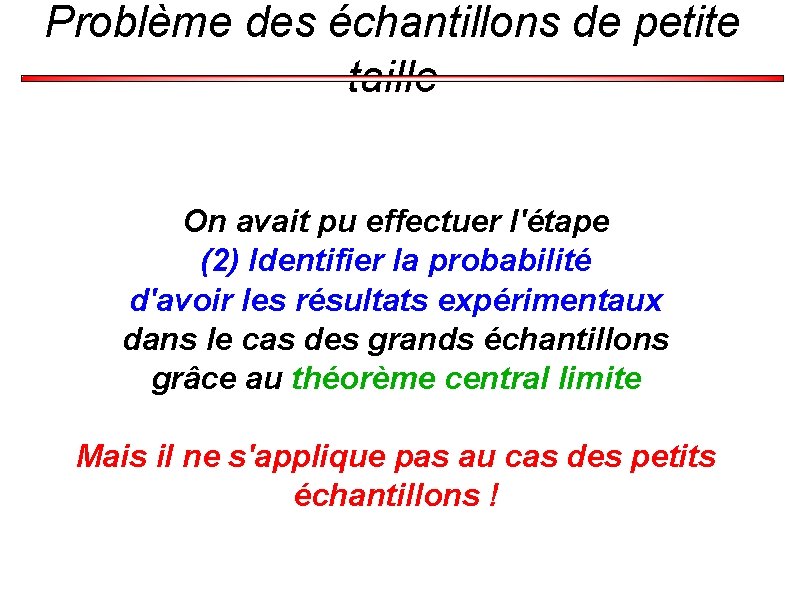

Problème des échantillons de petite taille On avait pu effectuer l'étape (2) Identifier la probabilité d'avoir les résultats expérimentaux dans le cas des grands échantillons grâce au théorème central limite Mais il ne s'applique pas au cas des petits échantillons !

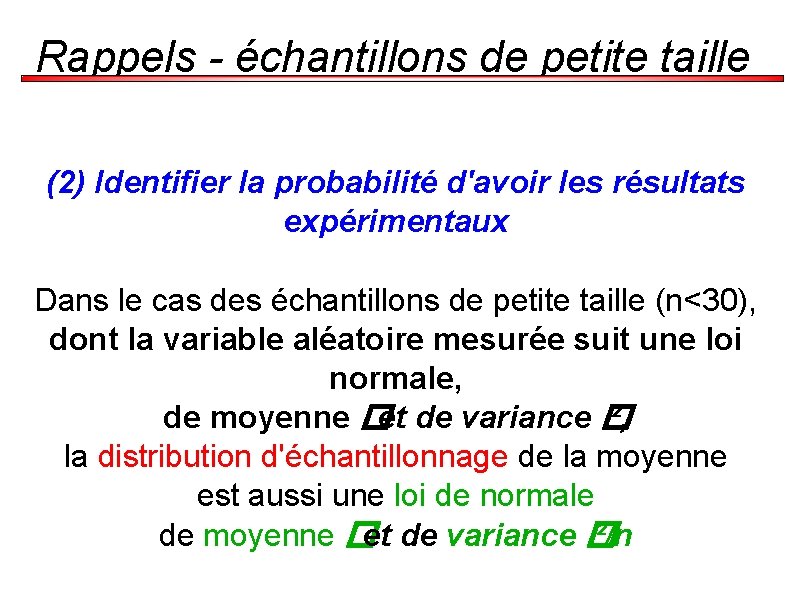

Rappels - échantillons de petite taille (2) Identifier la probabilité d'avoir les résultats expérimentaux Dans le cas des échantillons de petite taille (n<30), dont la variable aléatoire mesurée suit une loi normale, de moyenne �et de variance � ², la distribution d'échantillonnage de la moyenne est aussi une loi de normale de moyenne �et de variance � ²/n

Différence de 2 moyennes Les deux moyennes M 1 et M 2 sont dans ce cas. Alors on en déduit que M 1 -M 2 est aussi une variable aléatoire suivant une loi normale, de moyenne � 1 -� 2 et de variance � 1²/n 1+� 2²/n 2

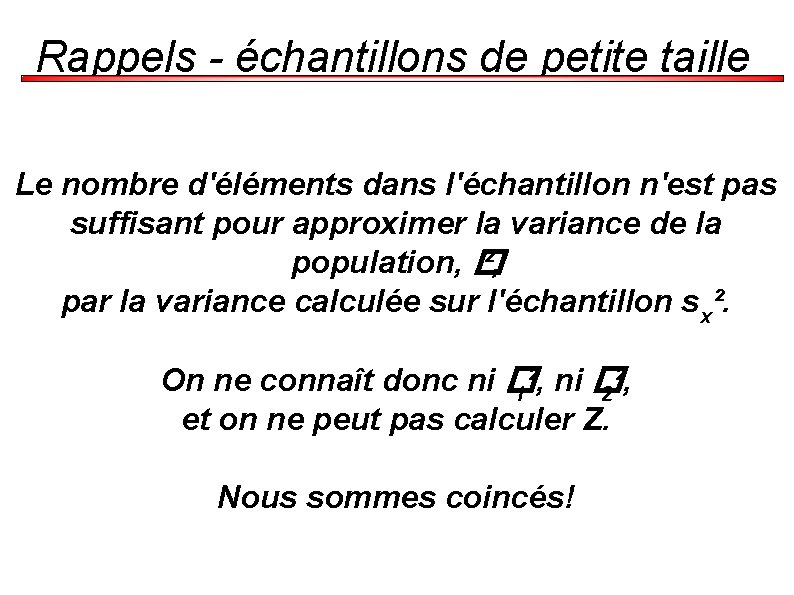

Rappels - échantillons de petite taille Le nombre d'éléments dans l'échantillon n'est pas suffisant pour approximer la variance de la population, � ², par la variance calculée sur l'échantillon sx². On ne connaît donc ni � 1², ni � 2², et on ne peut pas calculer Z. Nous sommes coincés!

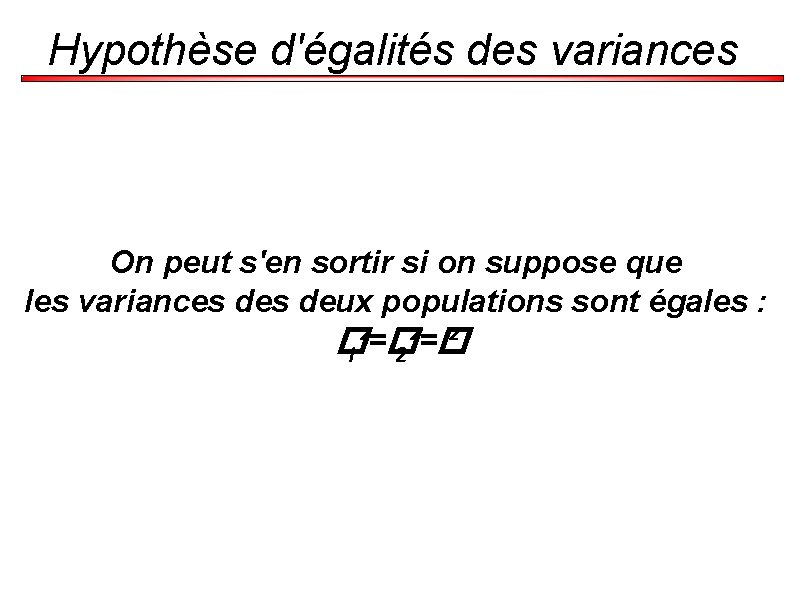

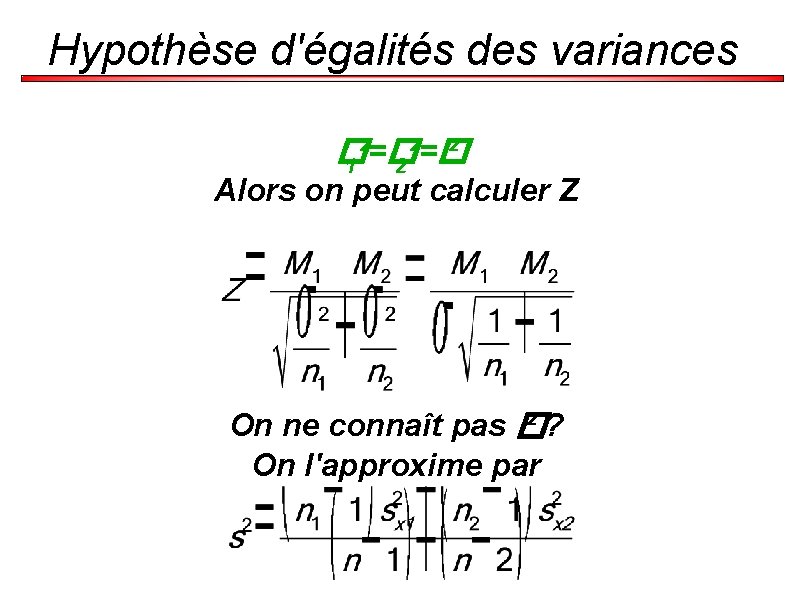

Hypothèse d'égalités des variances On peut s'en sortir si on suppose que les variances deux populations sont égales : � ² 1²=� 2²=�

Hypothèse d'égalités des variances � ² 1²=� 2²=� Alors on peut calculer Z On ne connaît pas � ²? On l'approxime par

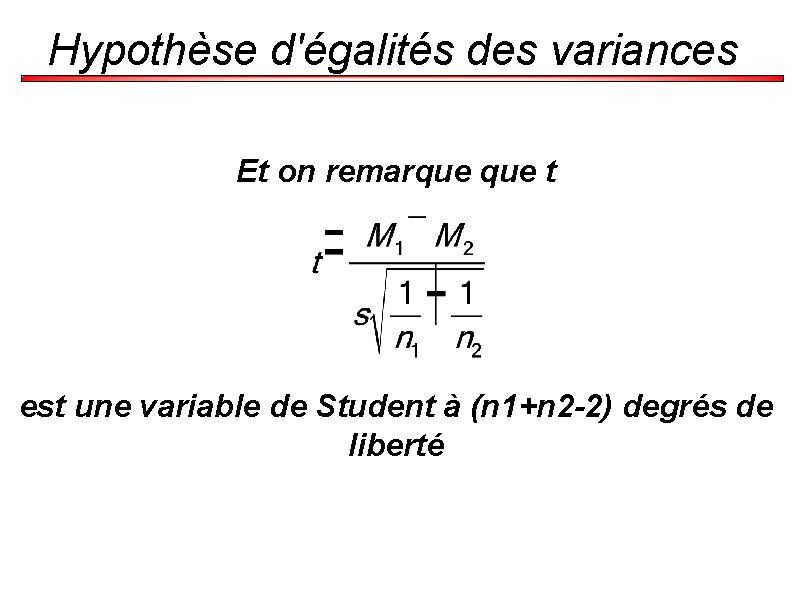

Hypothèse d'égalités des variances Et on remarque t est une variable de Student à (n 1+n 2 -2) degrés de liberté

Décision statistique (3) Estimer le seuil de signification � � H 1 : � <� 1 2 H 1 : � >� 1 2 � H 1 : � ≠� 1 2

Décision statistique (4) Décider On regarde si la valeur tombe dans l'intervalle d'acceptation de H 0 : � 1=� 2. Si non, on rejette H 0 et on prend l'hypothèse H 1 Si oui, on garde H 0. On n'aura pas prouvé H 0, tout ce qu'on peut dire c'est qu'on n'a pas assez d'élément pour rejeter H 0

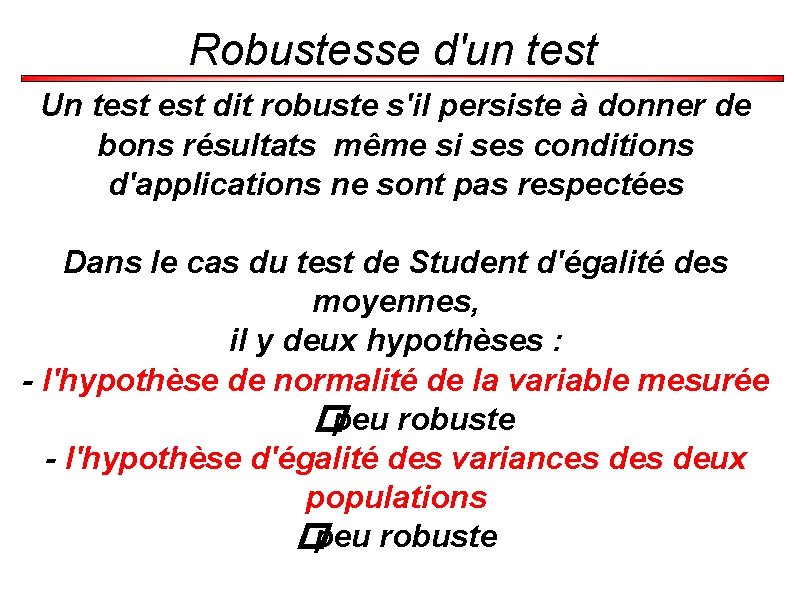

Robustesse d'un test Un test dit robuste s'il persiste à donner de bons résultats même si ses conditions d'applications ne sont pas respectées Dans le cas du test de Student d'égalité des moyennes, il y deux hypothèses : - l'hypothèse de normalité de la variable mesurée �peu robuste - l'hypothèse d'égalité des variances deux populations �peu robuste

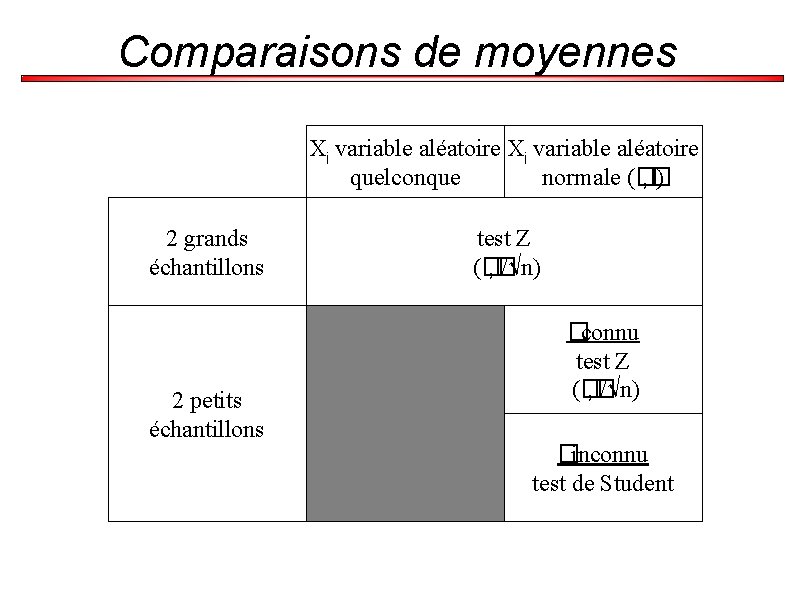

Comparaisons de moyennes Xi variable aléatoire quelconque normale (� , � ) 2 grands échantillons 2 petits échantillons test Z (� , � /√n) �connu test Z (� , � /√n) �inconnu test de Student

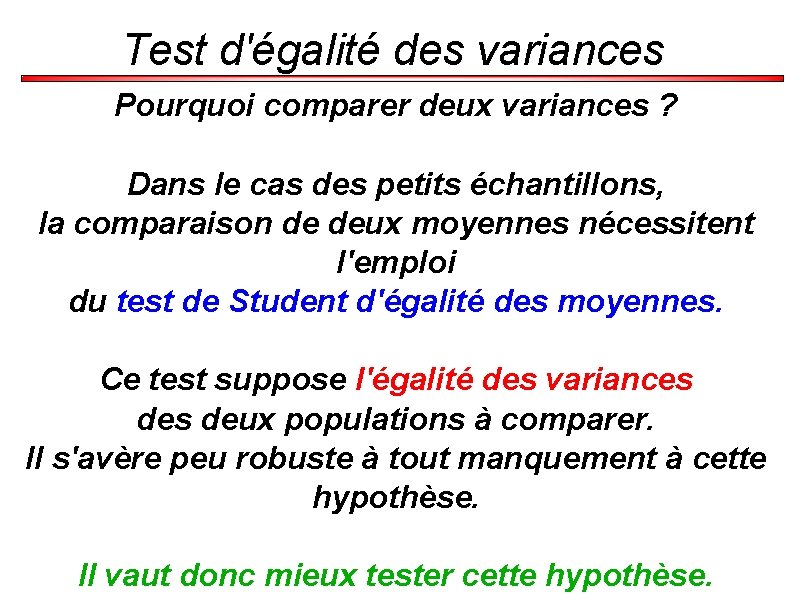

Test d'égalité des variances Pourquoi comparer deux variances ? Dans le cas des petits échantillons, la comparaison de deux moyennes nécessitent l'emploi du test de Student d'égalité des moyennes. Ce test suppose l'égalité des variances deux populations à comparer. Il s'avère peu robuste à tout manquement à cette hypothèse. Il vaut donc mieux tester cette hypothèse.

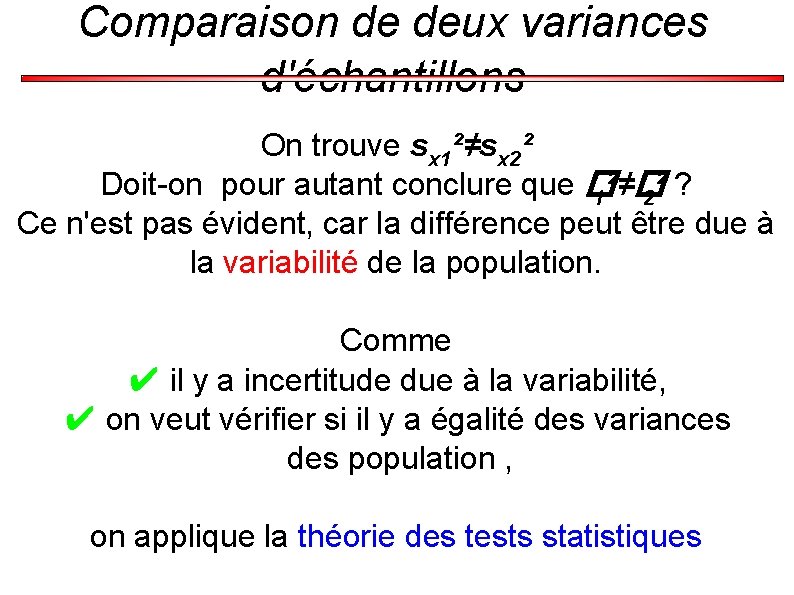

Comparaison de deux variances d'échantillons On trouve sx 1²≠sx 2² Doit-on pour autant conclure que � 1²≠� 2² ? Ce n'est pas évident, car la différence peut être due à la variabilité de la population. Comme ✔ il y a incertitude due à la variabilité, ✔ on veut vérifier si il y a égalité des variances des population , on applique la théorie des tests statistiques

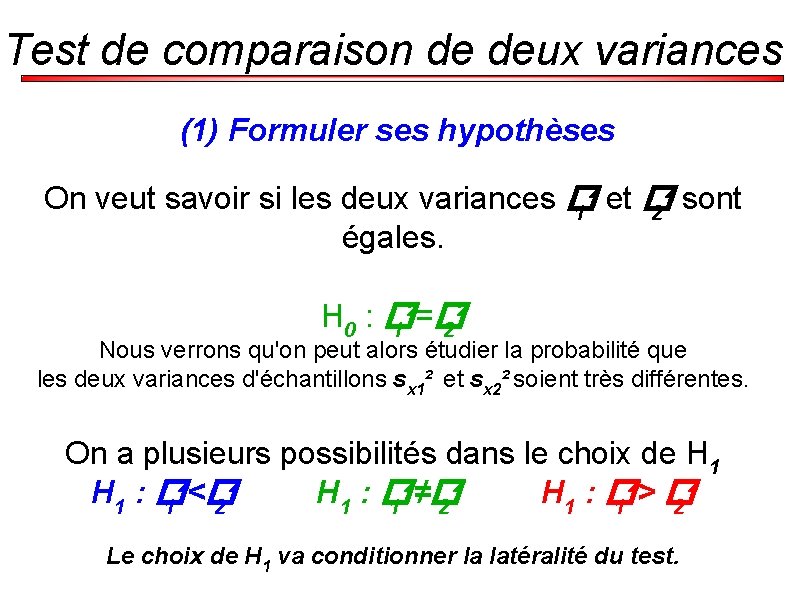

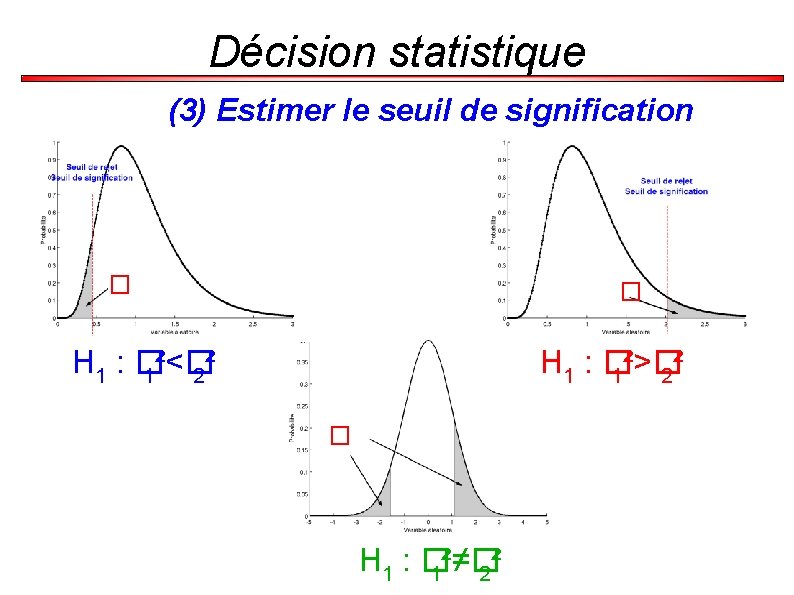

Test de comparaison de deux variances (1) Formuler ses hypothèses On veut savoir si les deux variances � 1² et � 2² sont égales. H 0 : � 1²=� 2² Nous verrons qu'on peut alors étudier la probabilité que les deux variances d'échantillons sx 1² et sx 2² soient très différentes. On a plusieurs possibilités dans le choix de H 1 : � 1²<� 2² 1²≠� 2² 1²> � 2² Le choix de H 1 va conditionner la latéralité du test.

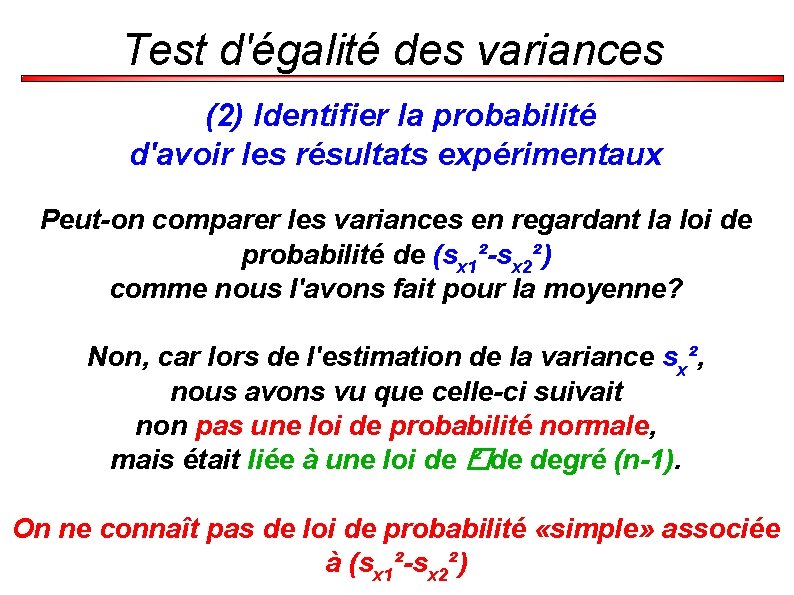

Test d'égalité des variances (2) Identifier la probabilité d'avoir les résultats expérimentaux Peut-on comparer les variances en regardant la loi de probabilité de (sx 1²-sx 2²) comme nous l'avons fait pour la moyenne? Non, car lors de l'estimation de la variance sx², nous avons vu que celle-ci suivait non pas une loi de probabilité normale, mais était liée à une loi de � ² de degré (n-1). On ne connaît pas de loi de probabilité «simple» associée à (sx 1²-sx 2²)

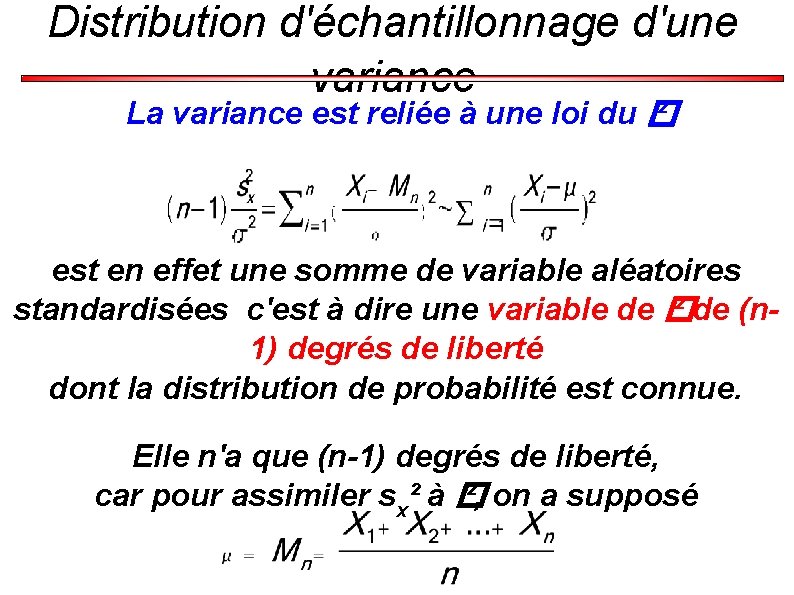

Distribution d'échantillonnage d'une variance La variance est reliée à une loi du � ² est en effet une somme de variable aléatoires standardisées c'est à dire une variable de � ² de (n 1) degrés de liberté dont la distribution de probabilité est connue. Elle n'a que (n-1) degrés de liberté, car pour assimiler sx² à � ², on a supposé

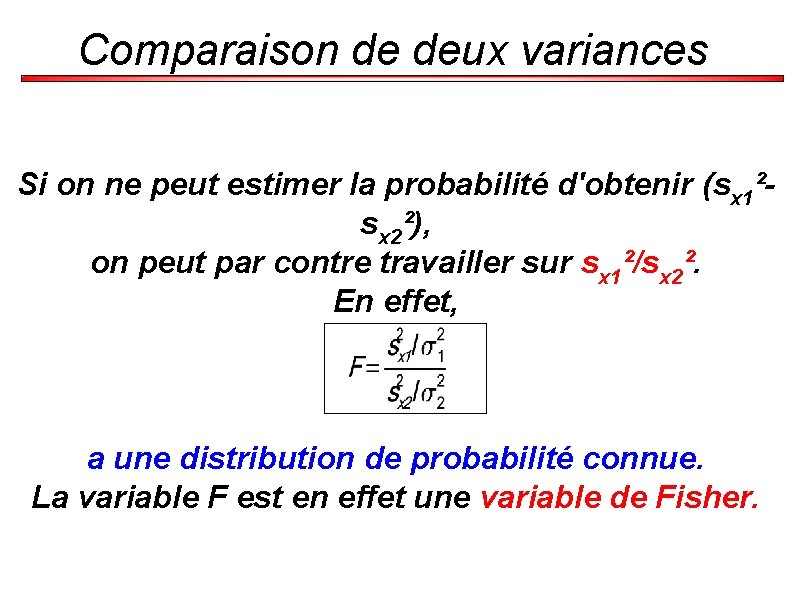

Comparaison de deux variances Si on ne peut estimer la probabilité d'obtenir (sx 1²sx 2²), on peut par contre travailler sur sx 1²/sx 2². En effet, a une distribution de probabilité connue. La variable F est en effet une variable de Fisher.

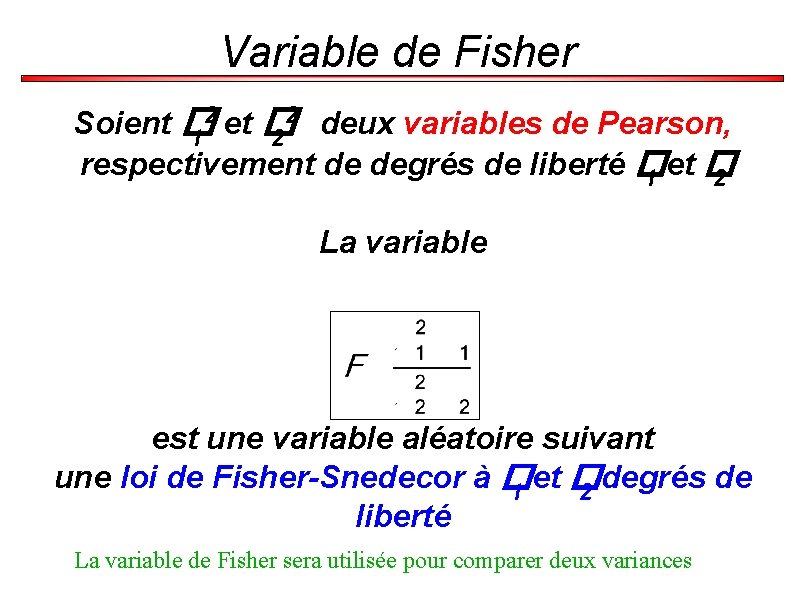

Variable de Fisher 2 et � 2 deux variables de Pearson, Soient � 1 2 respectivement de degrés de liberté � 1 et � 2 La variable est une variable aléatoire suivant une loi de Fisher-Snedecor à � et � degrés de 1 2 liberté La variable de Fisher sera utilisée pour comparer deux variances

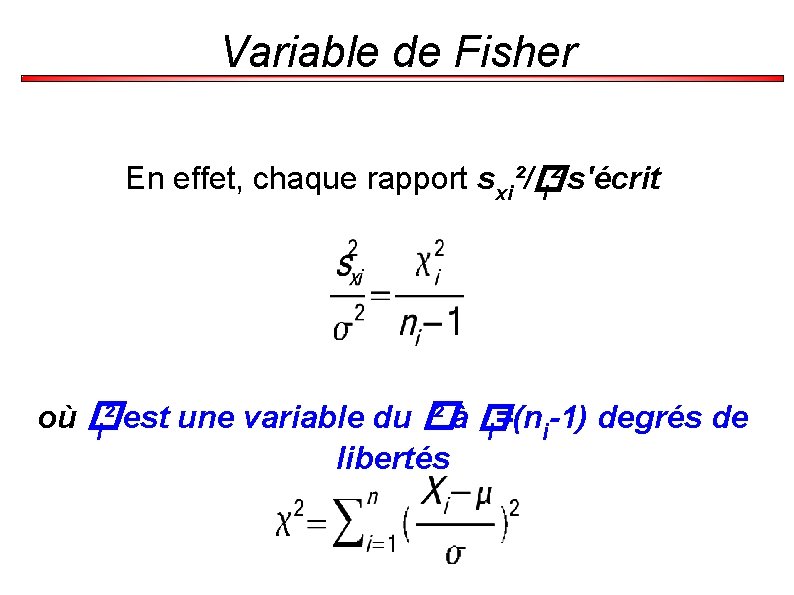

Variable de Fisher En effet, chaque rapport sxi²/� ² s'écrit i où � ² est une variable du � ²à� =(ni-1) degrés de i i libertés

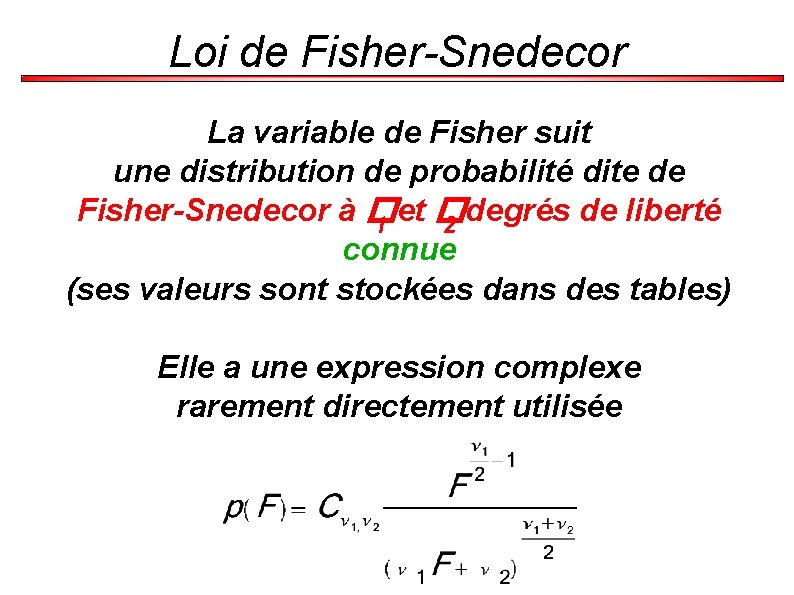

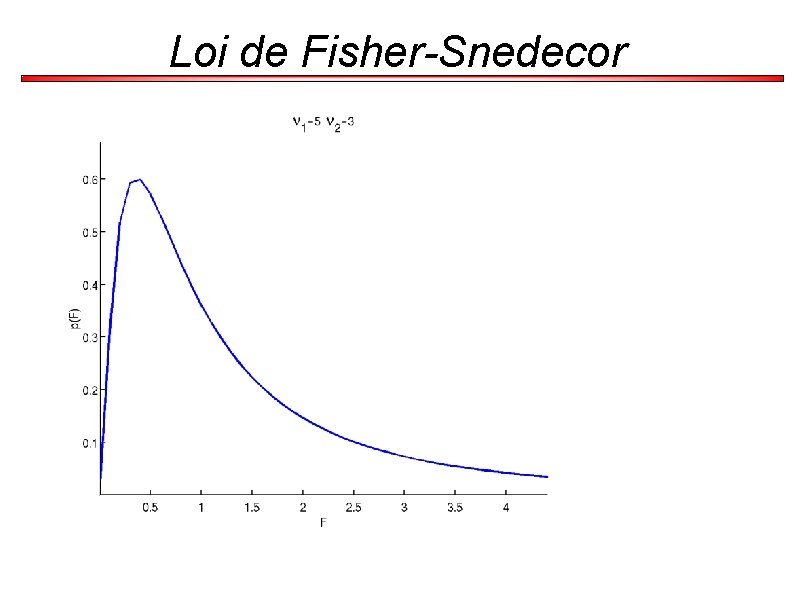

Loi de Fisher-Snedecor La variable de Fisher suit une distribution de probabilité dite de Fisher-Snedecor à � et � degrés de liberté 1 2 connue (ses valeurs sont stockées dans des tables) Elle a une expression complexe rarement directement utilisée

Loi de Fisher-Snedecor

Loi de Fisher-Snedecor La loi de Fisher-Snedecor est tabulée. Vous pouvez : ➢ Utiliser une table (TD) ➢ Utiliser un logiciel (Excel, Matlab)

Loi de Fisher-Snedecor (2) Identifier la probabilité d'avoir les résultats expérimentaux On connaît donc la loi de probabilité associée à la variable Malheureusement, on ne connaît pas F car on ne connaît ni sx 1², ni sx 2². Sauf si H 0 : � 1²=� 2²

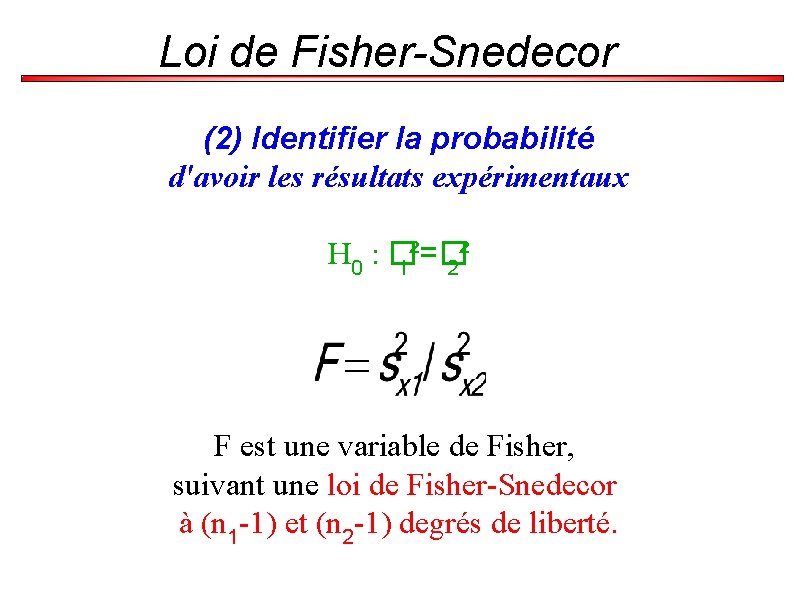

Loi de Fisher-Snedecor (2) Identifier la probabilité d'avoir les résultats expérimentaux H 0 : � 1²=� 2² F est une variable de Fisher, suivant une loi de Fisher-Snedecor à (n 1 -1) et (n 2 -1) degrés de liberté.

Décision statistique (3) Estimer le seuil de signification � � H 1 : � ²<� ² 1 2 H 1 : � ²>� ² 1 2 � H 1 : � ²≠� ² 1 2

Décision statistique (4) Décider On regarde si la valeur tombe dans l'intervalle d'acceptation de H 0 : � 1²=� 2². Si non, on rejette H 0 et on prend l'hypothèse H 1 Si oui, on garde H 0. On n'aura pas prouvé H 0, tout ce qu'on peut dire c'est qu'on n'a pas assez d'éléments pour rejeter H 0

Courbe de puissance Diminuer la tolérance de risque �entraîne une erreur �plus grande ✔ la distance entre les deux valeurs du paramètres �Mettre de fortes doses Pour estimer la dose limite à partir de laquelle le test pourra être concluant on peut dresser la courbe de puissance qui donne 1 -� =f(� )

Comparaison de moyennes Les cas sont différents suivant que l'on compare : une moyenne d'échantillon à une valeur référence deux moyennes d'échantillons de même variance deux moyennes d'échantillons de variances différentes

Comparaison d'une moyenne à une référence La pression artérielle est prise comme une variable 2 aléatoire de moyenne �et de variance � On veut tester si un médicament permet de baisser la pression artérielle. On suppose que la population traitée a la même 2 variance �

Comparaison d'une moyenne à une référence (1) Formuler ses hypothèses H 0: Même distribution X=� +� H 1 : Le traitement a modifié la valeur moyenne X=� +� +� On ne connaît pas la valeur de � , mais on suppose � <0

Hypothèse d'égalité des variances On suppose que la variance associée à la variabilité résiduelle est la même pour la population traitée et la population originale

Comparaison d'une moyenne à une référence Pour tester le médicament, on mesure la pression artérielle sur un échantillon traitée et on compare la moyenne de la population saine. On suppose H 0. Comme on connaît la probabilité d'obtention des résultats dans ce cas, on peut déterminer une valeur seuil. Si les résultats expérimentaux ne sont pas compatibles avec la valeur seuil, l'hypothèse H 0 est rejetée. Sinon elle est acceptée.

Comparaison d'une moyenne à une référence Puisque H 1 est asymétrique (� <0) le seuil est calculé par P

Étapes d'un test d'hypothèse (1) Formuler ses hypothèses Poser H 0 et H 1 (2) Choix du test approprié Le cours est là pour vous présenter les tests (3) Spécifier un niveau de signification (� ) et la taille de l'échantillon (N) (4) Trouver la distribution d'échantillonnage du test statistique (5) Calculer la région de rejet (6) Tirer une conclusion Si la probabilité est très faible, on rejette l'hypothèse

Hypothèse statistique ● Puissance statistique : (1 - – – – c’est l’aptitude à mettre en évidence une différence lorsqu’elle existe cf Test diagnostic : sensibilité on calcule un nombre de sujets nécessaire pour obtenir une puissance donnée

Hypothèse statistique 6. Le degré de signification ( « p » ) Ex : si les taux de succès sous corticoïdes et sous placebo sont identiques, la probabilité d’observer une telle différence (i. e. 51, 2% vs 23, 8%) ou une différence plus grande encore est de 0, 009

Hypothèse statistique ● Définition : – – quantifie le « désaccord » entre ce qu’on observe et l’hypothèse nulle H 0 la probabilité d’observer des résultats au moins aussi en désaccord avec l’hypothèse nulle H 0 que ceux qu’on a observés

Hypothèse statistique ● Interprétation : – plus le degré de signification est faible, plus on est convaincu que les résultats observés ne sont pas en cohérence avec l’hypothèse nulle

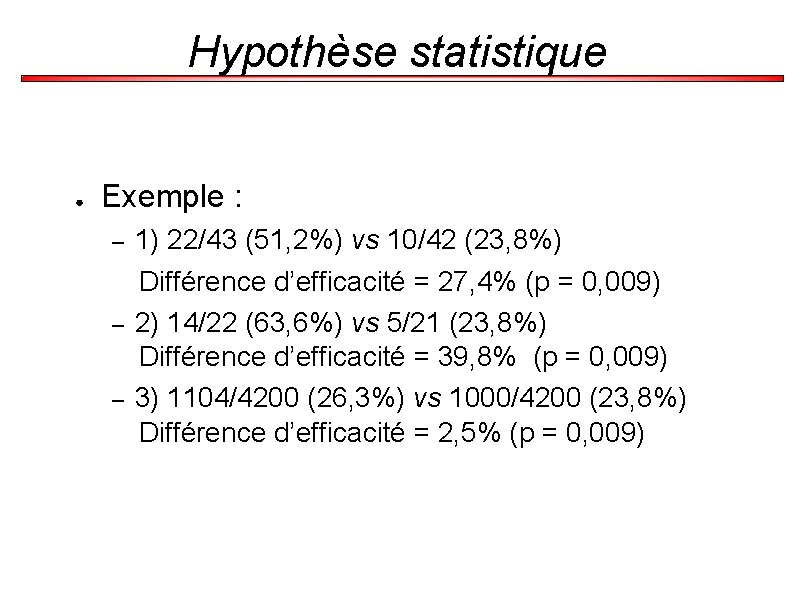

Hypothèse statistique ATTENTION !!!! (1) Le degré de signification nous permet d’affirmer avec plus ou moins de conviction qu’il y a une différence, mais en aucun cas il ne nous renseigne sur l’importance de cette différence

Hypothèse statistique ● Exemple : – – – 1) 22/43 (51, 2%) vs 10/42 (23, 8%) Différence d’efficacité = 27, 4% (p = 0, 009) 2) 14/22 (63, 6%) vs 5/21 (23, 8%) Différence d’efficacité = 39, 8% (p = 0, 009) 3) 1104/4200 (26, 3%) vs 1000/4200 (23, 8%) Différence d’efficacité = 2, 5% (p = 0, 009)

Test d'hypothèse = détermination de la plausibilité qu'un paramètre d'un modèle prenne des valeurs différentes dans des populations distinctes, afin de mettre en évidence, ou non, un effet d'un facteur expérimental sur une population.

Hypothèse statistique ● La valeur de p dépend : – – ● de la différence observée entre les deux groupes de la taille d’échantillon S’il existe une différence réelle, aussi infime soit-elle, entre 2 groupes, n’importe quel test statistique va aboutir à une valeur de p inférieure à 0, 05, dès lors que le nombre de sujets étudiés sera important

Hypothèse statistique La signification statistique n’implique pas la pertinence clinique

Courbe de puissance d'un test statistique Souvent on ne connaît pas la loi de probabilité de H 1 car il nous manque un seul paramètre. Dans le cas du dé, ce serait de connaître la probabilité de tirer un 1 Courbe de puissance (d'un test statistique) = Courbe caractéristique d'efficacité = Fonction donnant 1 -� pour chaque valeur du paramètre inconnu de H 1, pour �donné.

Hypothèse statistique ATTENTION !!!! (2) Ne pas mettre en évidence de différence statistiquement significative entre deux groupes ne signifie pas qu’il y ait équivalence entre les deux groupes

Hypothèse statistique ● Ex : 0/3 (0, 0%) vs 3/3 (100, 0%) Différence d’efficacité = 100, 0% p = 0, 010 (test exact de Fisher)

Hypothèse statistique ● Un résultat non statistiquement significatif peut avoir 2 causes : – – l’hypothèse H 0 est vraie (i. e. il y a équivalence entre les deux groupes) la puissance statistique n’est pas suffisante (i. e. nombre de sujets insuffisant)

III Inférence statistique en étudiant plusieurs paramètres

Sources de variabilité Imprécision ≠ Inexactitude Si la mesure effective diffère de la valeur réelle, on parle alors d'inexactitude. Elle souvent due à une erreur dans le protocole expérimental. Elle est aussi introduite lorsqu'on étudie un échantillon peu représentatif de la population. Attention : l'inexactitude peut être masquée

Sources de variabilité (2) Différences individuelles Les éléments de l'échantillon sont différents.

Sources de variabilité (3) Différences factorielles Les éléments placés dans un environnement différent ont des propriétés différentes. On cherche souvent à caractériser de telles différences.

Sources de variabilité Variabilité résiduelle = imprécision + variabilité individuelle Variabilité totale = variabilité résiduelle + variabilité factorielle

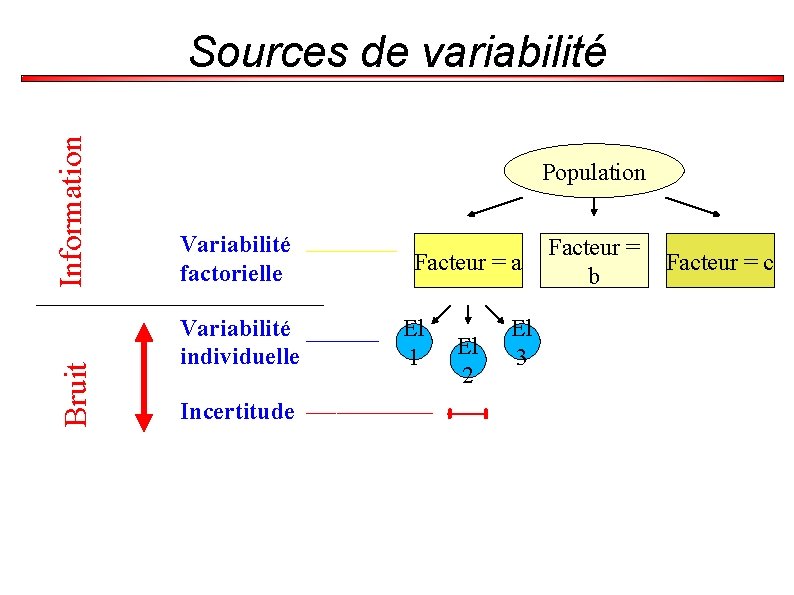

Bruit Information Sources de variabilité Population Variabilité factorielle Variabilité individuelle Incertitude Facteur = a El 1 El 2 El 3 Facteur = b Facteur = c

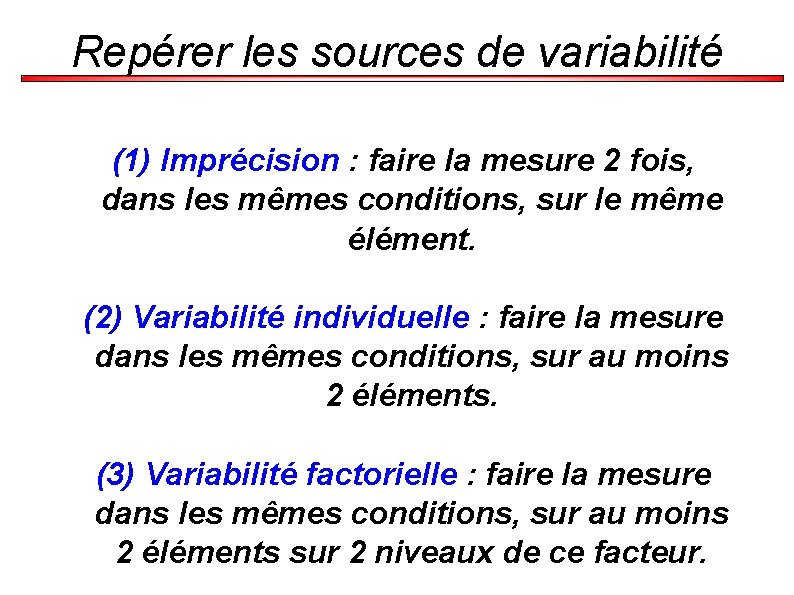

Repérer les sources de variabilité (1) Imprécision : faire la mesure 2 fois, dans les mêmes conditions, sur le même élément. (2) Variabilité individuelle : faire la mesure dans les mêmes conditions, sur au moins 2 éléments. (3) Variabilité factorielle : faire la mesure dans les mêmes conditions, sur au moins 2 éléments sur 2 niveaux de ce facteur.

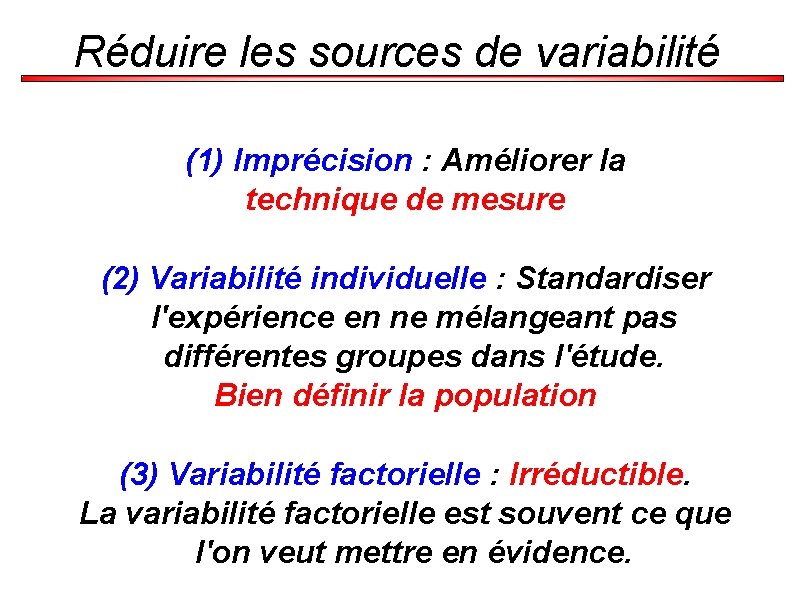

Réduire les sources de variabilité (1) Imprécision : Améliorer la technique de mesure (2) Variabilité individuelle : Standardiser l'expérience en ne mélangeant pas différentes groupes dans l'étude. Bien définir la population (3) Variabilité factorielle : Irréductible. La variabilité factorielle est souvent ce que l'on veut mettre en évidence.

Modélisation On identifie la variabilité factorielle sous-groupe i individu i, j de ce sous groupe X=� +a + e

Paradoxe des statistiques Une étude cherche à tester une hypothèse On pourra : - éventuellement prouver la validité de l'hypothèse - mais jamais l'infirmer ! Il faut donc choisir la bonne hypothèse

Unilatéral ou bilatéral ? Il y a beaucoup de façons de contredire H 0, ce qu'on retrouve dans le choix de la latéralité du test, ce qui se retrouve dans la formulation de H 1, Le test bilatéral si l'hypothèse H 1 est symétrique. Ex : « dé pipé » Le test latéral si l'hypothèse H 1 est dissymétrique. Ex : « dé pipé vers les petites valeurs »

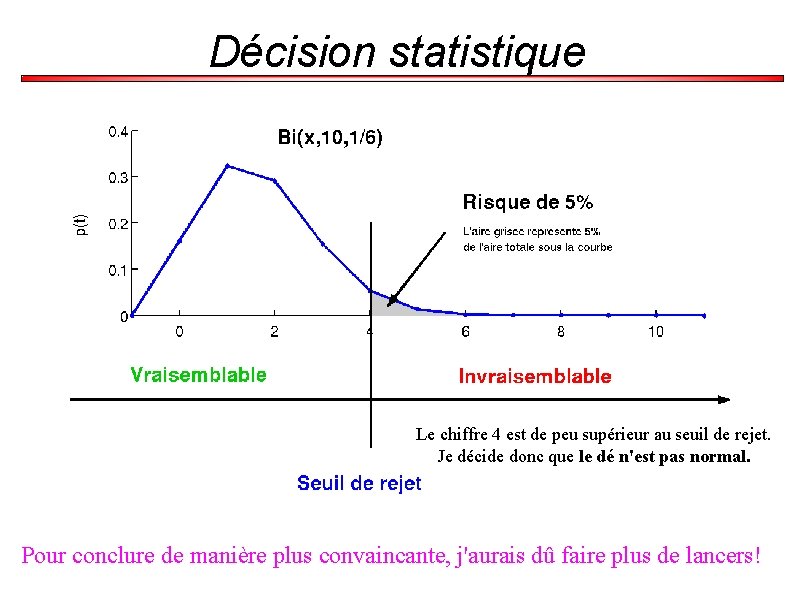

Décision statistique Le chiffre 4 est de peu supérieur au seuil de rejet. Je décide donc que le dé n'est pas normal. Pour conclure de manière plus convaincante, j'aurais dû faire plus de lancers!

- Slides: 158