Grammaires de dpendance et thorie SensTexte 4 Sylvain

![Analyse CKY (1) n [i, j, X] : segment du i-ème au j-ième mot Analyse CKY (1) n [i, j, X] : segment du i-ème au j-ième mot](https://slidetodoc.com/presentation_image_h/30170cc229ffcae235bc4a4691671839/image-13.jpg)

![Analyse CKY (2) -10 dét n [1, 1, D] + [2, 2, N] + Analyse CKY (2) -10 dét n [1, 1, D] + [2, 2, N] +](https://slidetodoc.com/presentation_image_h/30170cc229ffcae235bc4a4691671839/image-14.jpg)

- Slides: 55

Grammaires de dépendance et théorie Sens-Texte (4) Sylvain Kahane Lattice, Université Paris 7 TALN, 5 juillet 2001, Tours Sylvain Kahane, EHESS, 30 mars 2001

Plan du tutoriel (rappel) Séance 1. Dépendance et fonction syntaxiques Séance 2. Théorie Sens-Texte Séance 3. Gramm. d'Unification Sens-Texte Séance 4. Analyse en gramm. de dépendance Sylvain Kahane, EHESS, 30 mars 2001 2

Séance 4. Analyse en grammaire de dépendance Sylvain Kahane, EHESS, 30 mars 2001 3

Plan de la 4ème séance n n Analyse par contraintes Analyse CKY – comparaison avec HPSG Analyse incrémentale – garden-path et cognition – analyseur à pile – ambiguïtés – limitation du flux Conclusion Sylvain Kahane, EHESS, 30 mars 2001 4

4. 1 Analyse par contraintes Sylvain Kahane, EHESS, 30 mars 2001 5

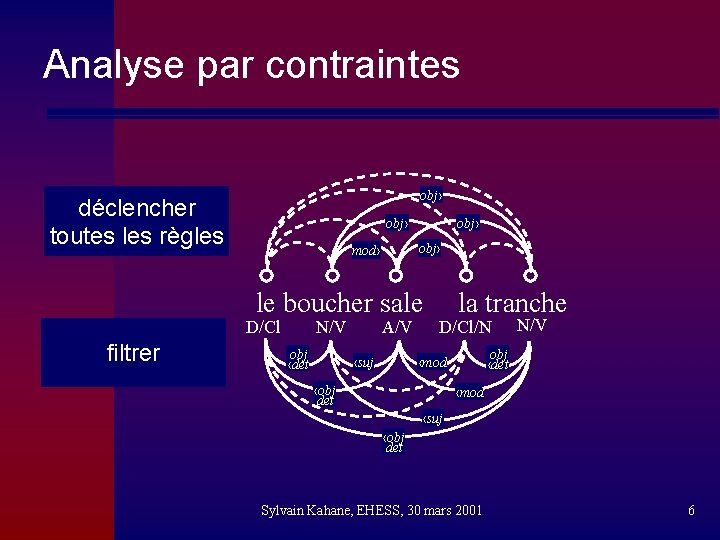

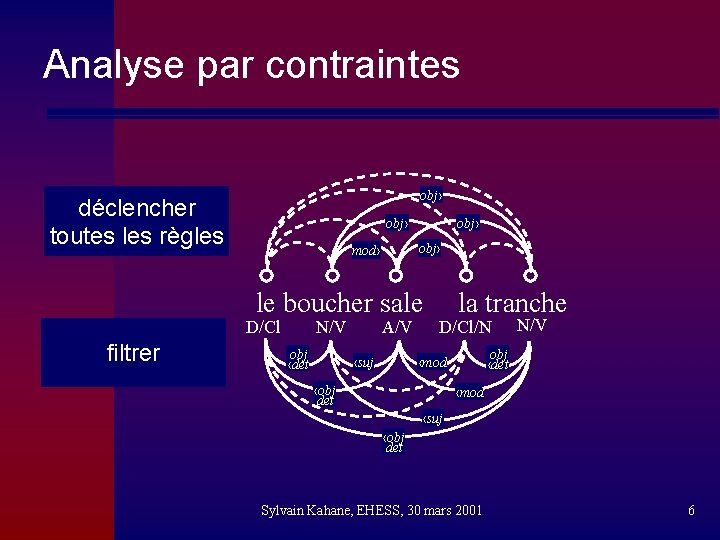

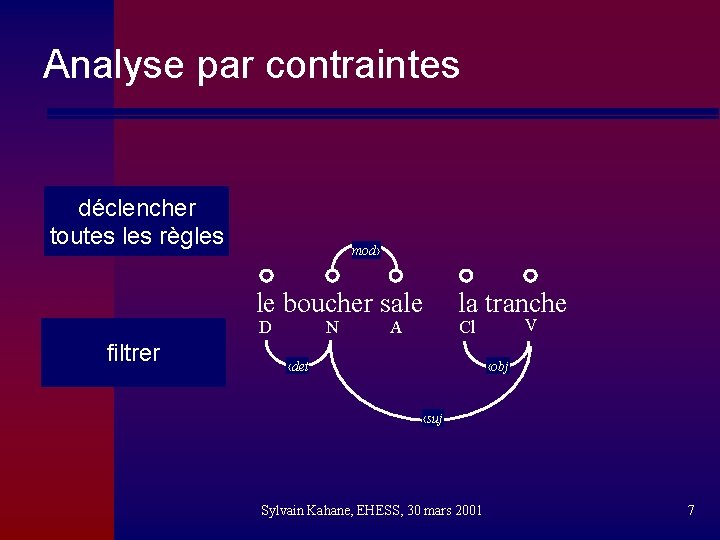

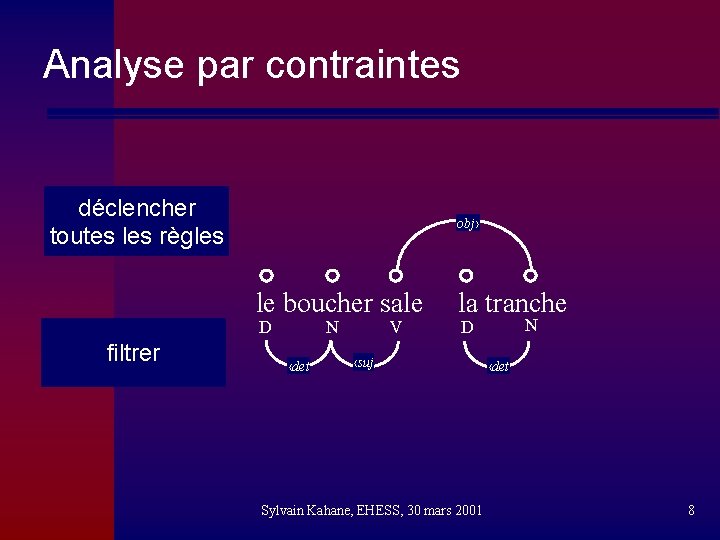

Analyse par contraintes obj› déclencher toutes les règles obj› mod› le boucher sale D/Cl filtrer N/V obj ‹det A/V la tranche D/Cl/N obj ‹det ‹mod ‹suj ‹obj det N/V ‹mod ‹suj ‹obj det Sylvain Kahane, EHESS, 30 mars 2001 6

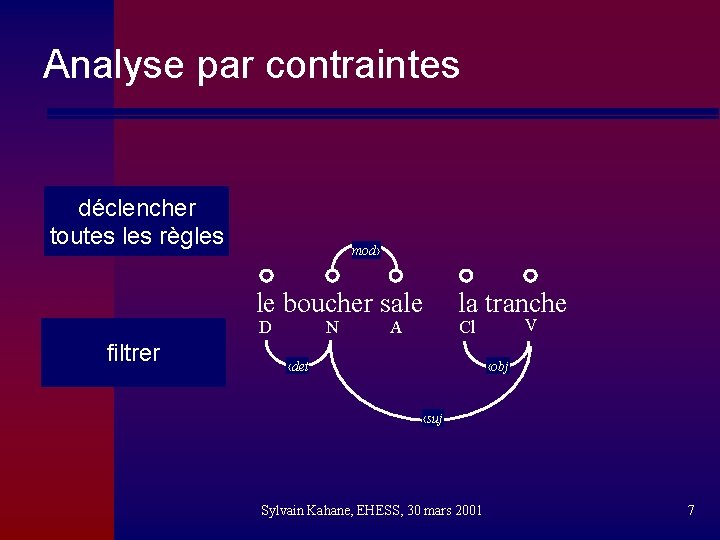

Analyse par contraintes déclencher toutes les règles mod› le boucher sale D filtrer N A la tranche V Cl ‹det ‹obj ‹suj Sylvain Kahane, EHESS, 30 mars 2001 7

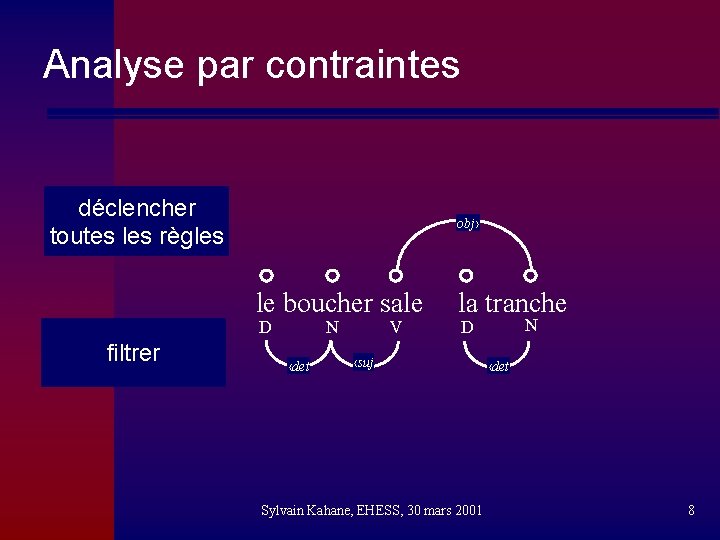

Analyse par contraintes déclencher toutes les règles obj› le boucher sale D filtrer N ‹det V la tranche N D ‹suj Sylvain Kahane, EHESS, 30 mars 2001 ‹det 8

Analyse par contraintes n n Maruyama 1990, Duchier 1999, Blache 1998 Avantage des grammaires de dépendance : on peut considérer une structure qui contient toutes les structures acceptables après filtrage Sylvain Kahane, EHESS, 30 mars 2001 9

Méthodes probabilistes n n n Règles pondérées : poids entre 0. 1 et 1 Chaque dépendance reçoit le poids de la règle qui la valide Score d'un arbre = produit du poids des dépendances Menzel & Schröder 1998 Eisner 1996, Collins 1997 Sylvain Kahane, EHESS, 30 mars 2001 10

4. 2 Analyse CKY Sylvain Kahane, EHESS, 30 mars 2001 11

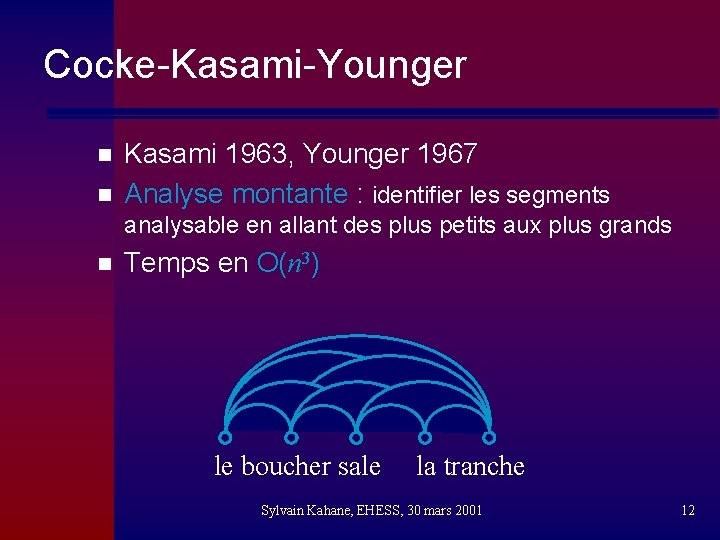

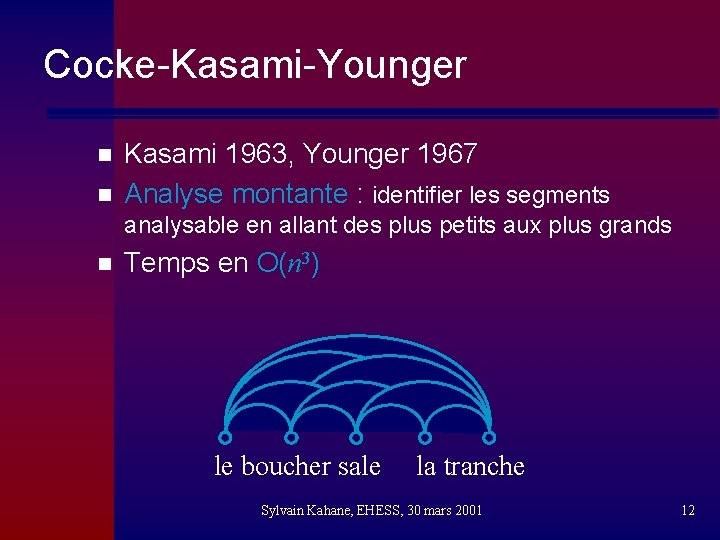

Cocke-Kasami-Younger n n Kasami 1963, Younger 1967 Analyse montante : identifier les segments analysable en allant des plus petits aux plus grands n Temps en O(n 3) le boucher sale la tranche Sylvain Kahane, EHESS, 30 mars 2001 12

![Analyse CKY 1 n i j X segment du ième au jième mot Analyse CKY (1) n [i, j, X] : segment du i-ème au j-ième mot](https://slidetodoc.com/presentation_image_h/30170cc229ffcae235bc4a4691671839/image-13.jpg)

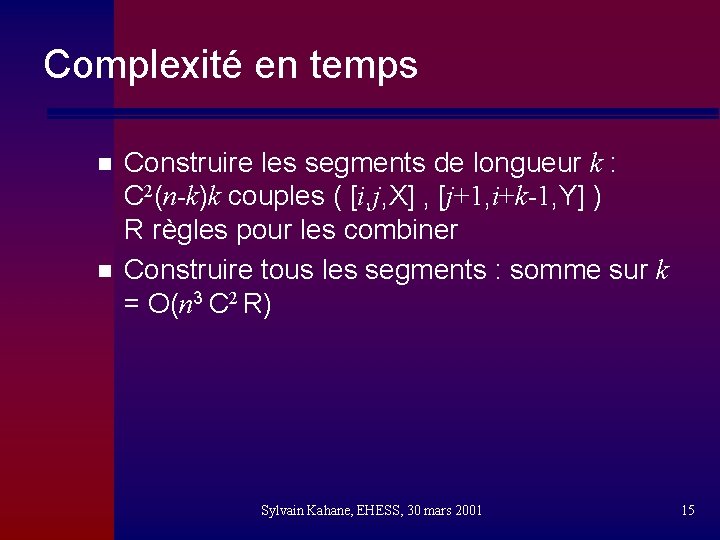

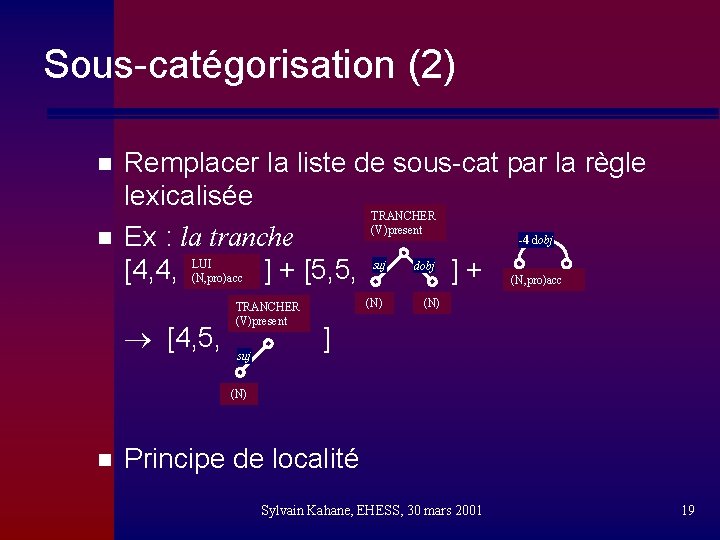

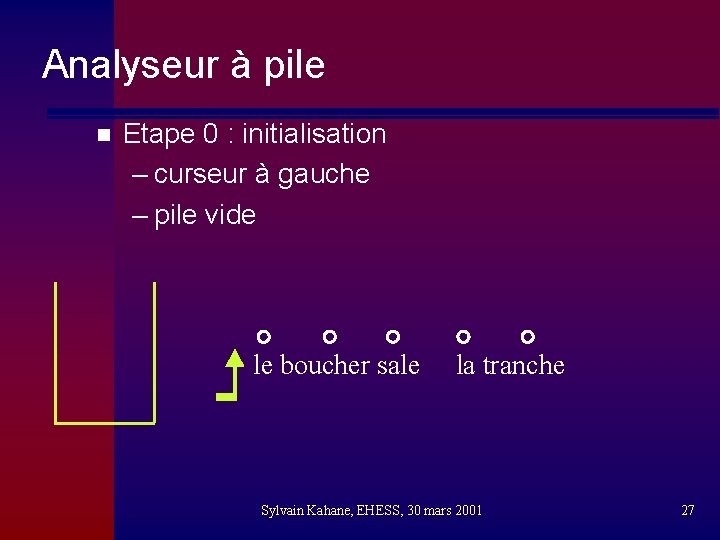

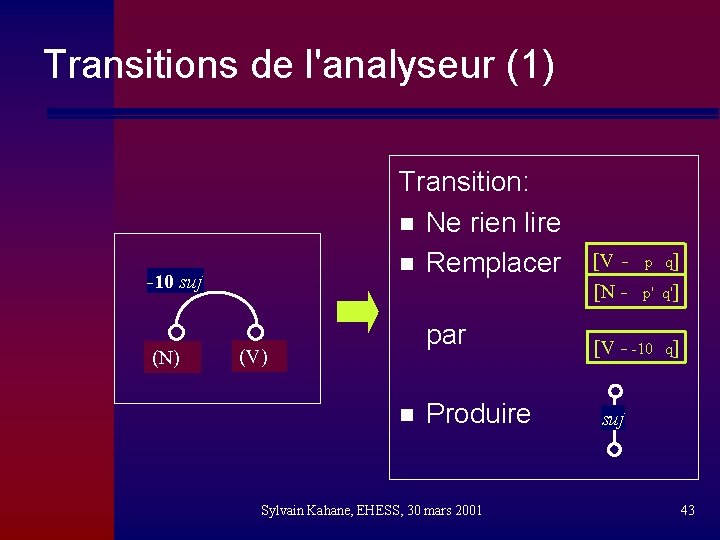

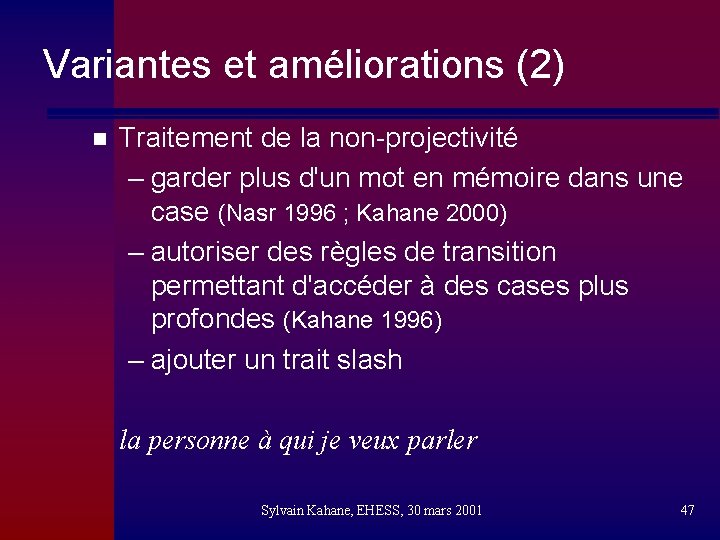

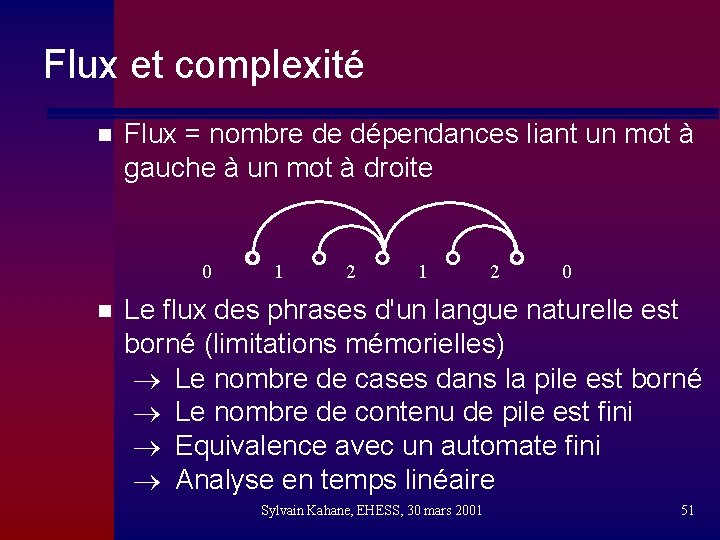

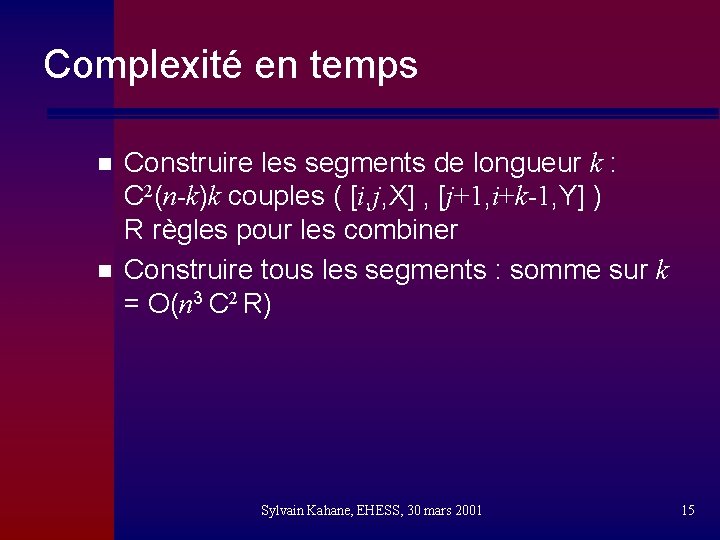

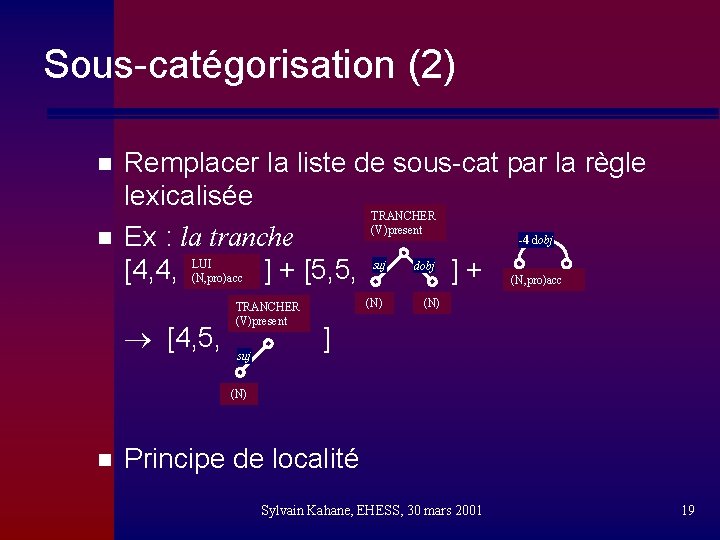

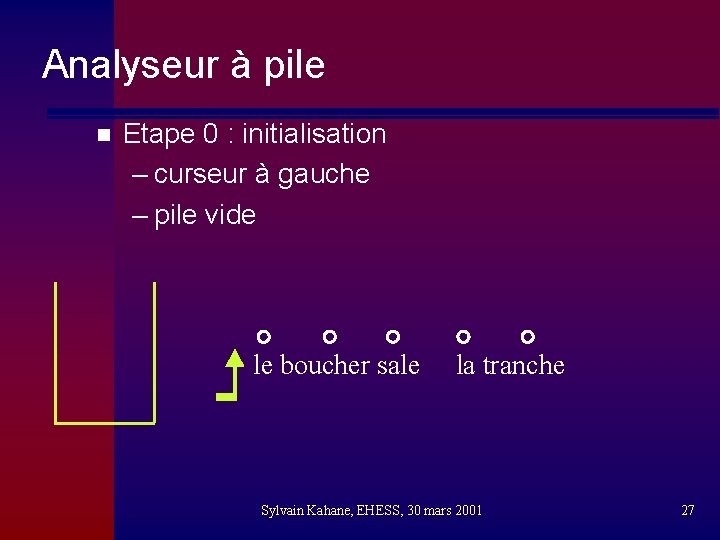

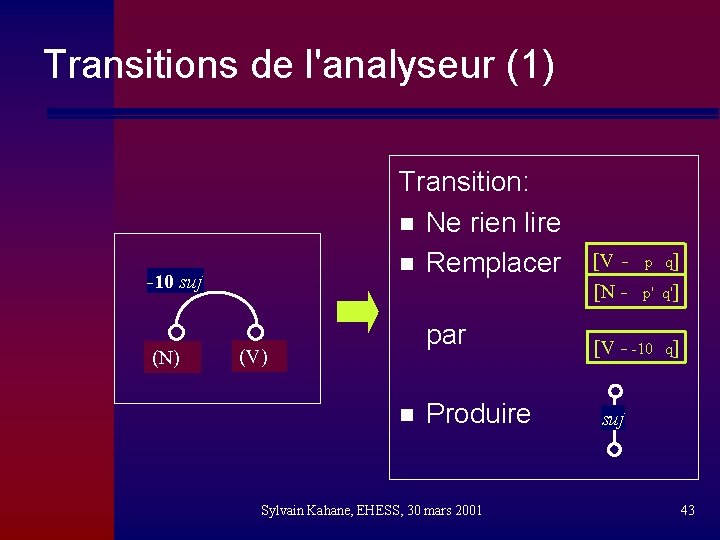

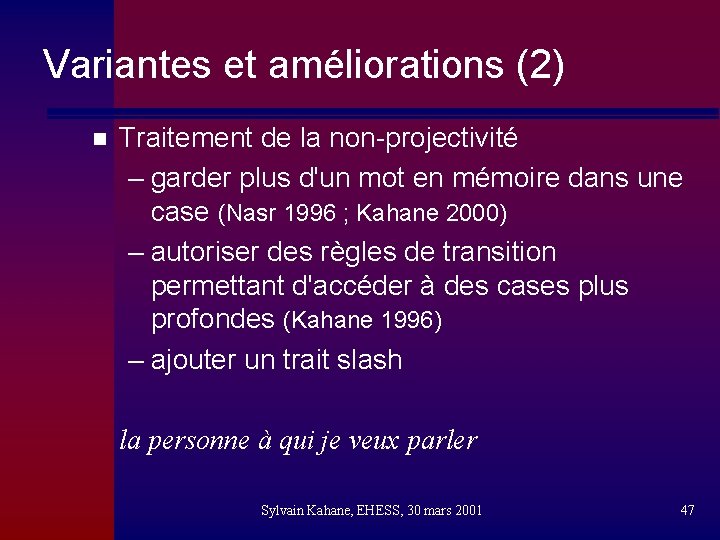

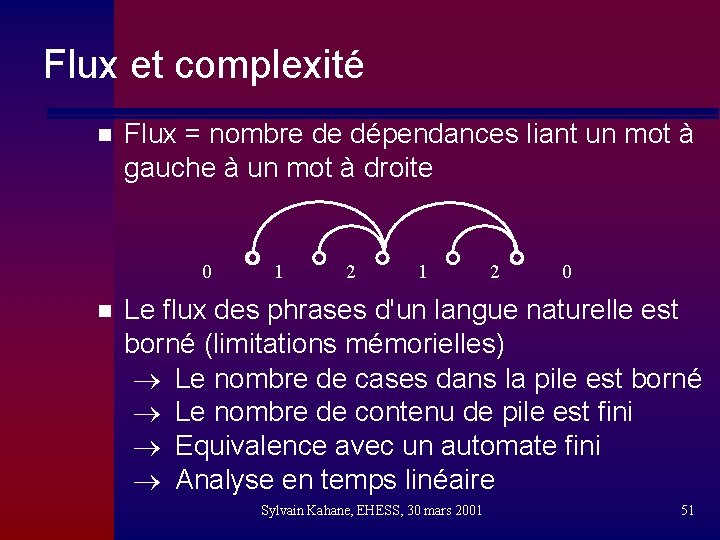

Analyse CKY (1) n [i, j, X] : segment du i-ème au j-ième mot de tête X n Segments de longueur 1 : [1, 1, D], [1, 1, Cl], [2, 2, N], [2, 2, V] …, [5, 5, N], [5, 5, V] n Segments de longueur 2 : [1, 2, N], [1, 2, V], [2, 3, N], [2, 3, V] …, [4, 5, N], [4, 5, V] le boucher sale 1 2 3 la tranche 4 Sylvain Kahane, EHESS, 30 mars 2001 5 13

![Analyse CKY 2 10 dét n 1 1 D 2 2 N Analyse CKY (2) -10 dét n [1, 1, D] + [2, 2, N] +](https://slidetodoc.com/presentation_image_h/30170cc229ffcae235bc4a4691671839/image-14.jpg)

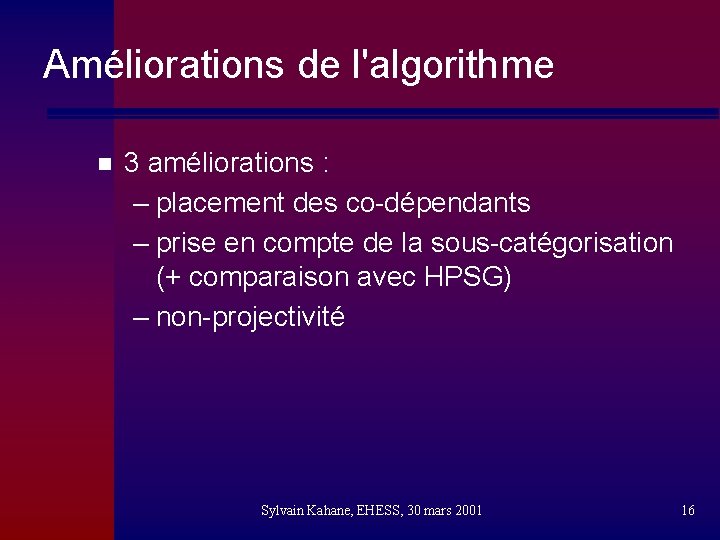

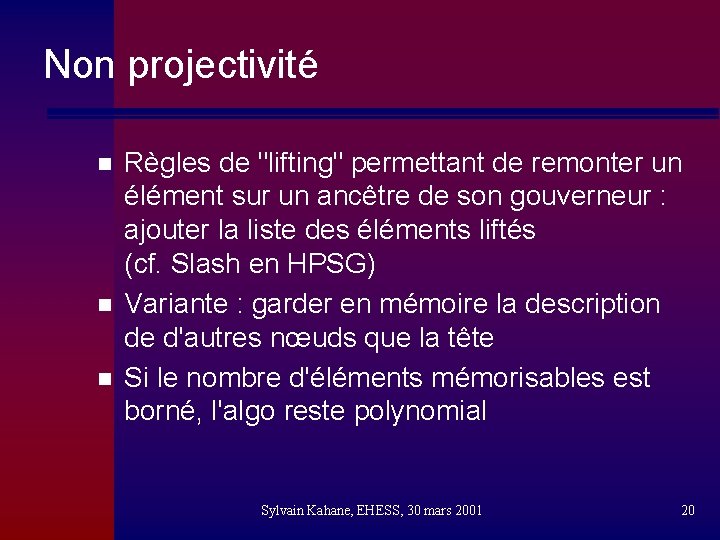

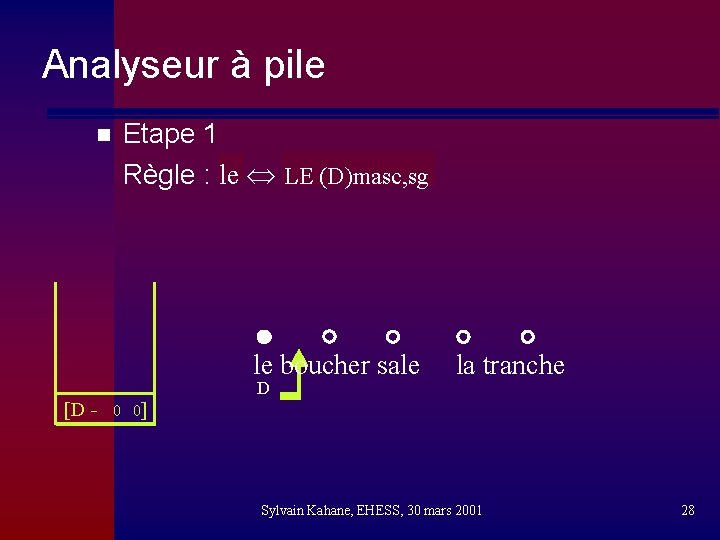

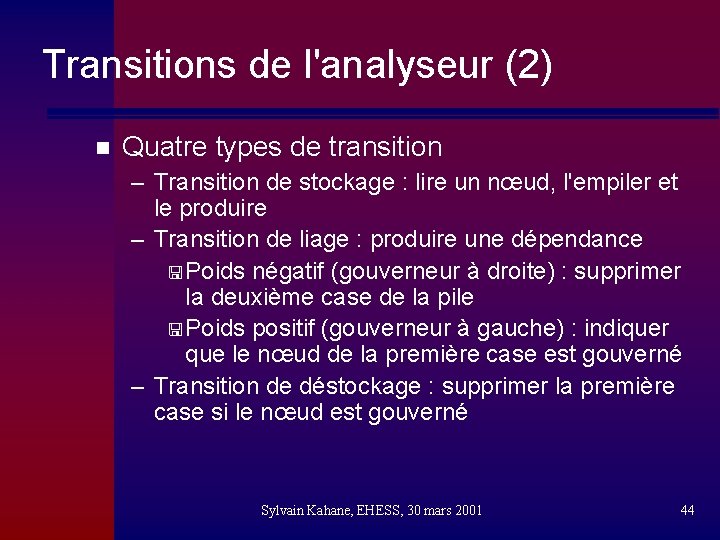

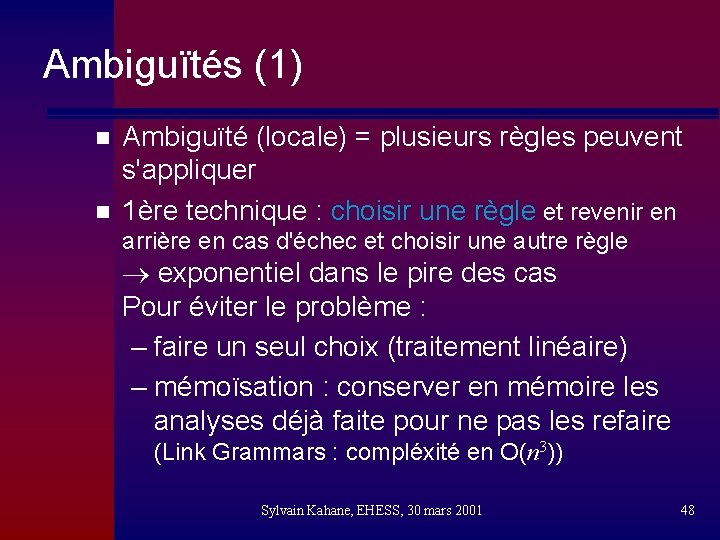

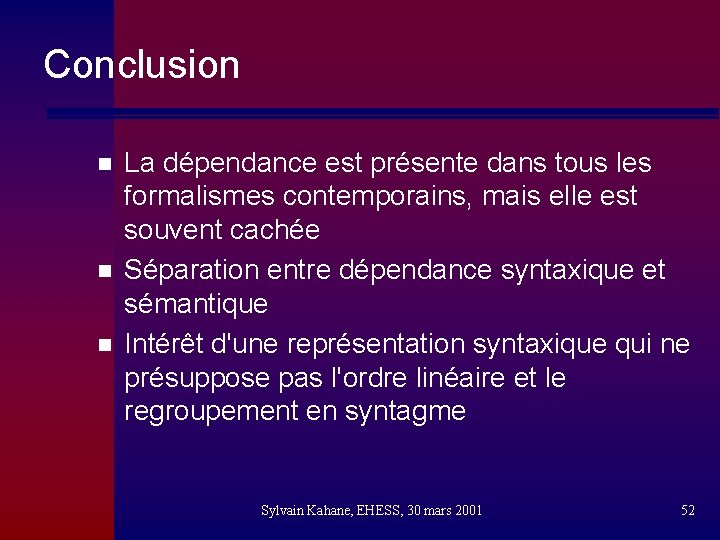

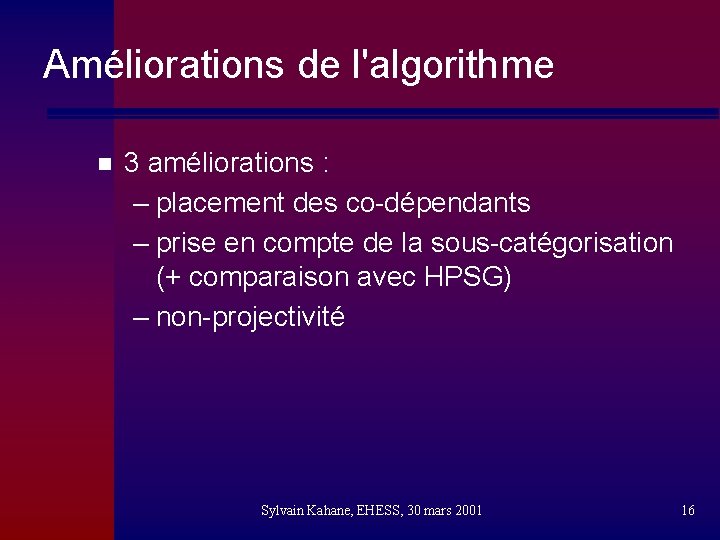

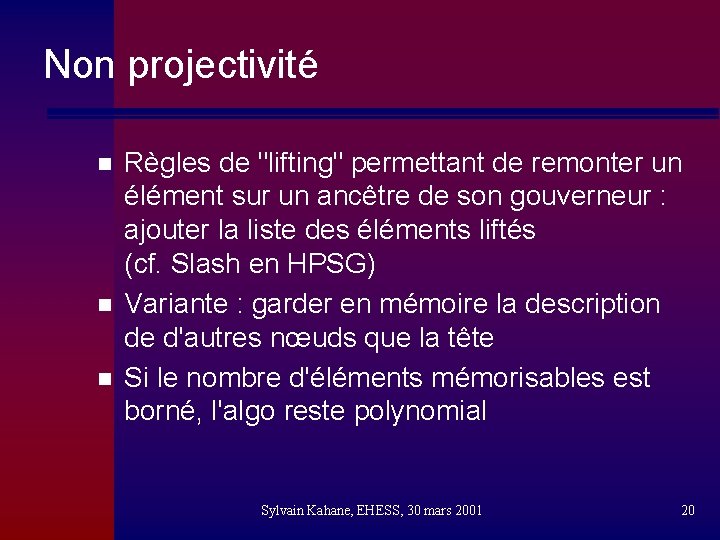

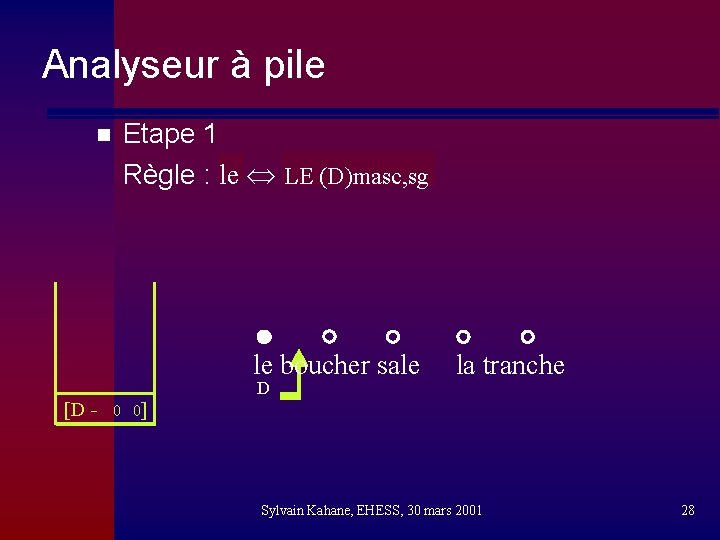

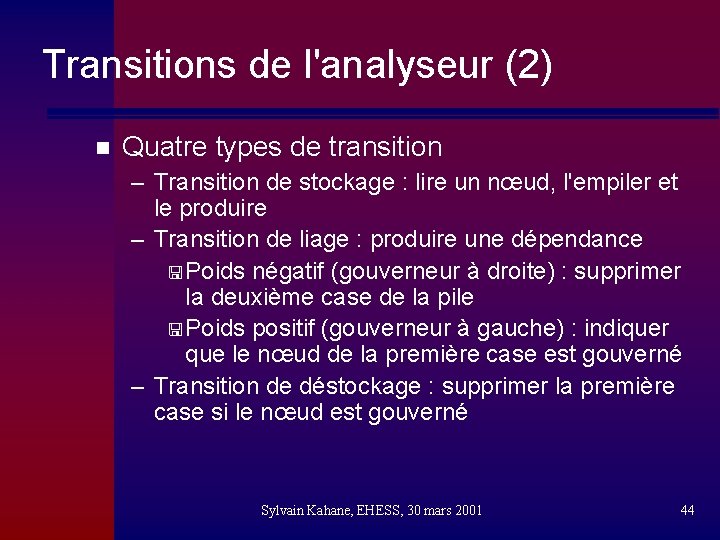

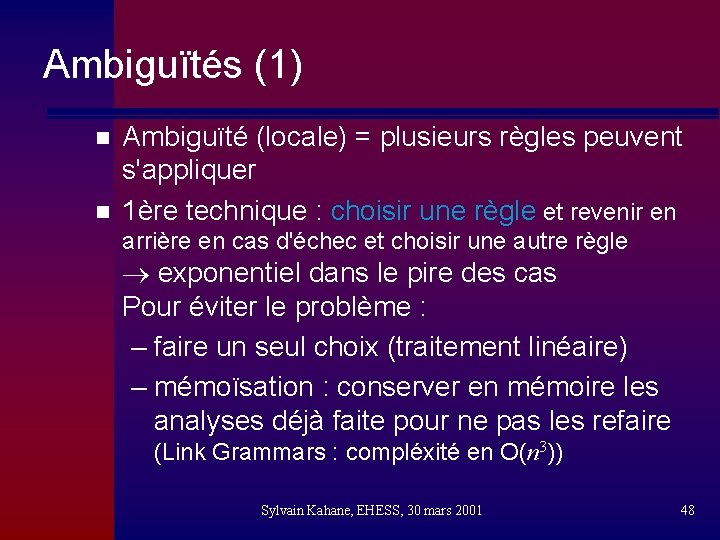

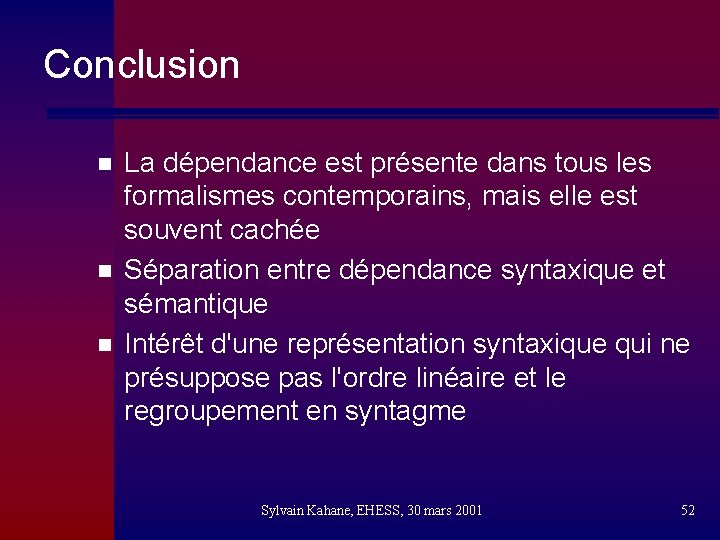

Analyse CKY (2) -10 dét n [1, 1, D] + [2, 2, N] + (N) (D) [1, 2, N] + r n [i, j, X] + [j+1, k, Y] + (X) (Y) [i, k, X] (Y) [i, k, Y] - r n [i, j, X] + [j+1, k, Y] + n Une phrase de longueur n est reconnue si on obtient [1, n, V] (X) Sylvain Kahane, EHESS, 30 mars 2001 14

Complexité en temps n n Construire les segments de longueur k : C 2(n-k)k couples ( [i, j, X] , [j+1, i+k-1, Y] ) R règles pour les combiner Construire tous les segments : somme sur k = O(n 3 C 2 R) Sylvain Kahane, EHESS, 30 mars 2001 15

Améliorations de l'algorithme n 3 améliorations : – placement des co-dépendants – prise en compte de la sous-catégorisation (+ comparaison avec HPSG) – non-projectivité Sylvain Kahane, EHESS, 30 mars 2001 16

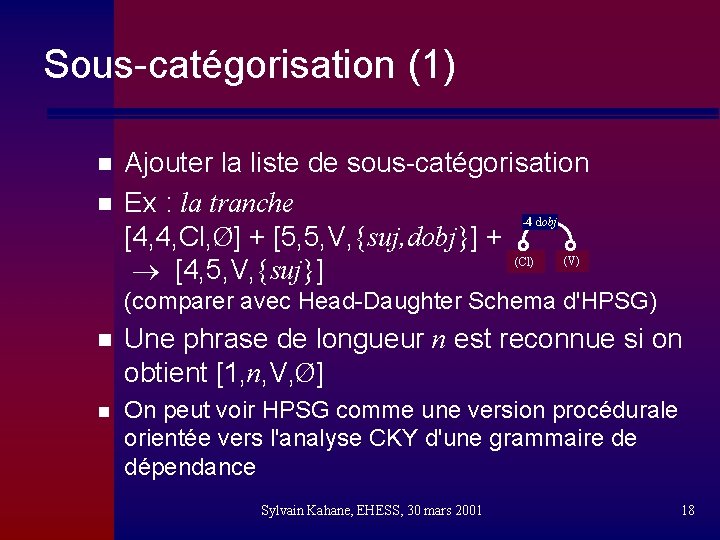

Placement des co-dépendants n n Le placement des co-dépendants est géré par le trait de position dans les règles Remplacer [i, j, X] par [i, j, X, p, q] avec : – p position du dernier dépendant à gauche – q position du dernier dépendant à droite n Ex : la tranche [4, 4, Cl, 0, 0] + [5, 5, V, 0, 0] + -4 dobj (Cl) Sylvain Kahane, EHESS, 30 mars 2001 (V) [4, 5, V, -4, 0] 17

Sous-catégorisation (1) n n Ajouter la liste de sous-catégorisation Ex : la tranche -4 dobj [4, 4, Cl, Ø] + [5, 5, V, {suj, dobj}] + (V) (Cl) [4, 5, V, {suj}] (comparer avec Head-Daughter Schema d'HPSG) n Une phrase de longueur n est reconnue si on obtient [1, n, V, Ø] n On peut voir HPSG comme une version procédurale orientée vers l'analyse CKY d'une grammaire de dépendance Sylvain Kahane, EHESS, 30 mars 2001 18

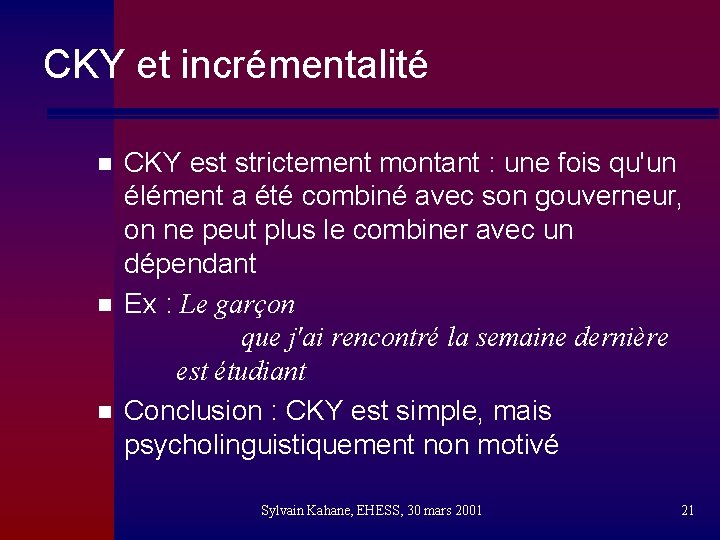

Sous-catégorisation (2) n n Remplacer la liste de sous-cat par la règle lexicalisée TRANCHER (V)present -4 dobj Ex : la tranche [4, 4, LUI ] + [5, 5, suj dobj ] + (N, pro)acc(V) (N, pro)acc [4, 5, TRANCHER (V)present suj (N) ] (N) n Principe de localité Sylvain Kahane, EHESS, 30 mars 2001 19

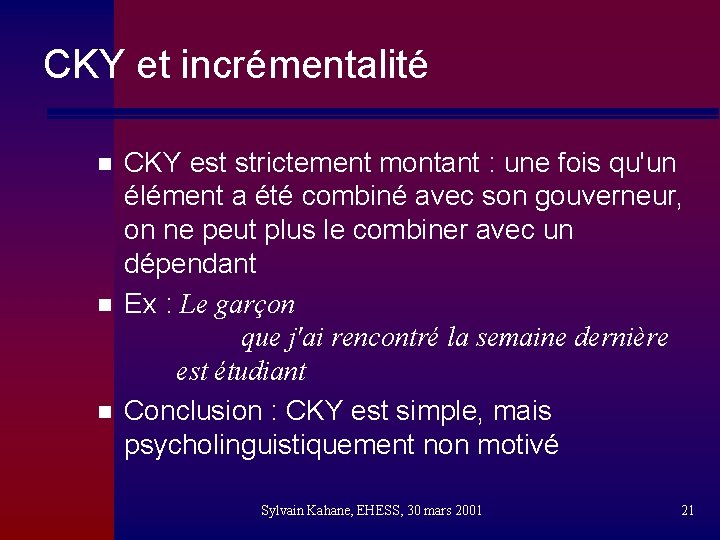

Non projectivité n n n Règles de "lifting" permettant de remonter un élément sur un ancêtre de son gouverneur : ajouter la liste des éléments liftés (cf. Slash en HPSG) Variante : garder en mémoire la description de d'autres nœuds que la tête Si le nombre d'éléments mémorisables est borné, l'algo reste polynomial Sylvain Kahane, EHESS, 30 mars 2001 20

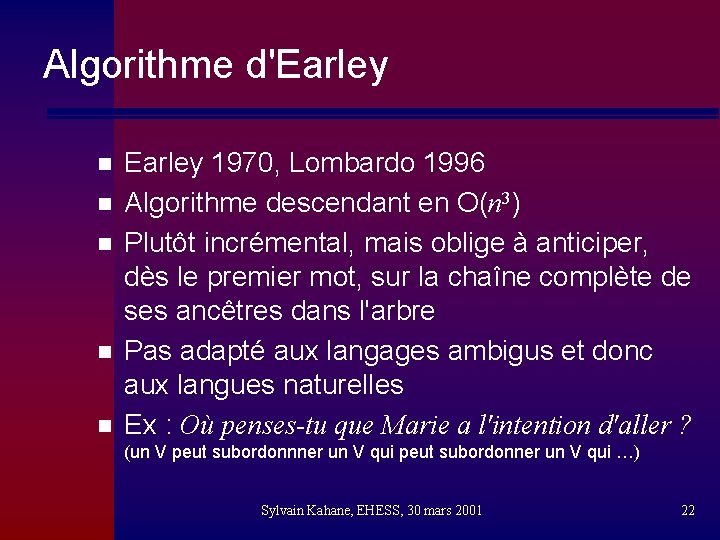

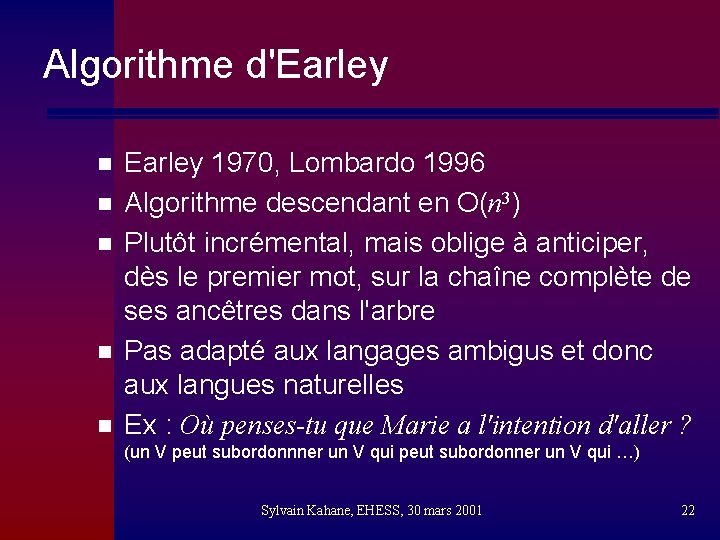

CKY et incrémentalité n n n CKY est strictement montant : une fois qu'un élément a été combiné avec son gouverneur, on ne peut plus le combiner avec un dépendant Ex : Le garçon que j'ai rencontré la semaine dernière est étudiant Conclusion : CKY est simple, mais psycholinguistiquement non motivé Sylvain Kahane, EHESS, 30 mars 2001 21

Algorithme d'Earley n n n Earley 1970, Lombardo 1996 Algorithme descendant en O(n 3) Plutôt incrémental, mais oblige à anticiper, dès le premier mot, sur la chaîne complète de ses ancêtres dans l'arbre Pas adapté aux langages ambigus et donc aux langues naturelles Ex : Où penses-tu que Marie a l'intention d'aller ? (un V peut subordonnner un V qui peut subordonner un V qui …) Sylvain Kahane, EHESS, 30 mars 2001 22

4. 3 Analyse incrémentale Sylvain Kahane, EHESS, 30 mars 2001 23

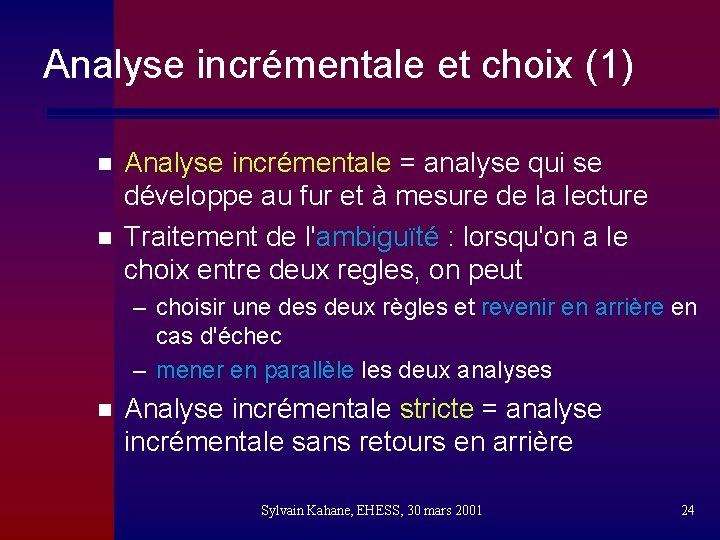

Analyse incrémentale et choix (1) n n Analyse incrémentale = analyse qui se développe au fur et à mesure de la lecture Traitement de l'ambiguïté : lorsqu'on a le choix entre deux regles, on peut – choisir une des deux règles et revenir en arrière en cas d'échec – mener en parallèle les deux analyses n Analyse incrémentale stricte = analyse incrémentale sans retours en arrière Sylvain Kahane, EHESS, 30 mars 2001 24

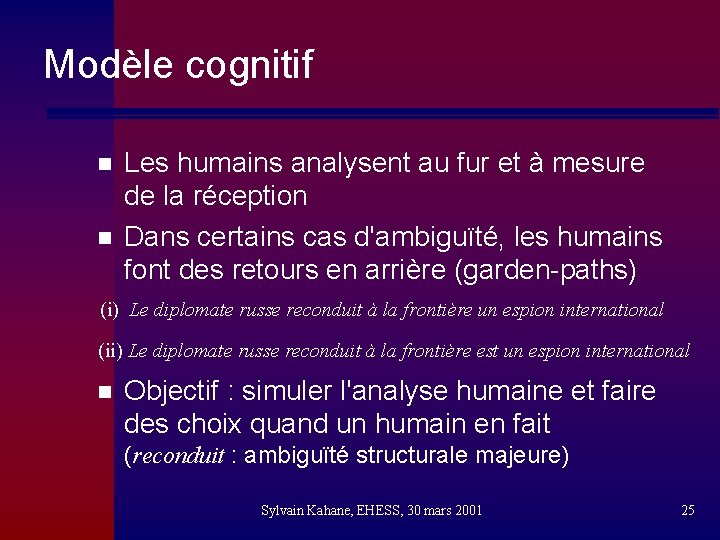

Modèle cognitif n n Les humains analysent au fur et à mesure de la réception Dans certains cas d'ambiguïté, les humains font des retours en arrière (garden-paths) (i) Le diplomate russe reconduit à la frontière un espion international (ii) Le diplomate russe reconduit à la frontière est un espion international n Objectif : simuler l'analyse humaine et faire des choix quand un humain en fait (reconduit : ambiguïté structurale majeure) Sylvain Kahane, EHESS, 30 mars 2001 25

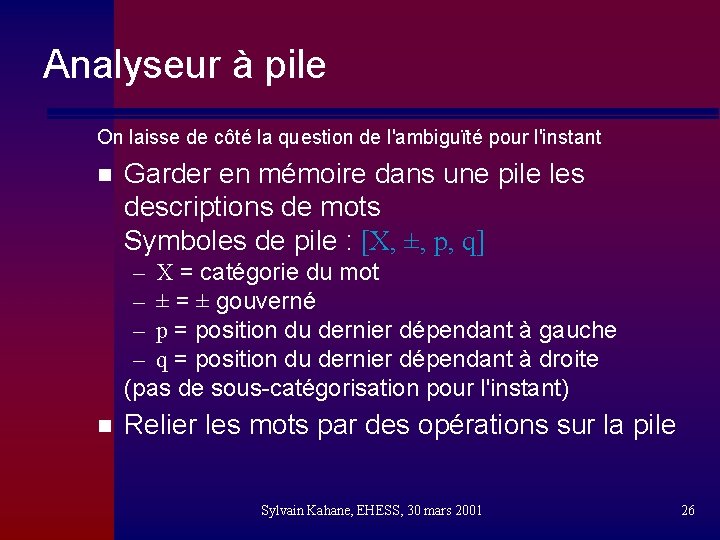

Analyseur à pile On laisse de côté la question de l'ambiguïté pour l'instant n Garder en mémoire dans une pile les descriptions de mots Symboles de pile : [X, ±, p, q] – X = catégorie du mot – ± = ± gouverné – p = position du dernier dépendant à gauche – q = position du dernier dépendant à droite (pas de sous-catégorisation pour l'instant) n Relier les mots par des opérations sur la pile Sylvain Kahane, EHESS, 30 mars 2001 26

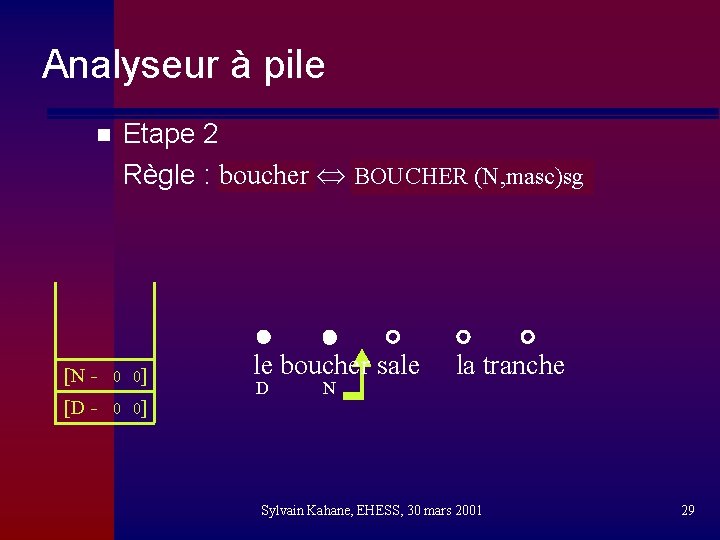

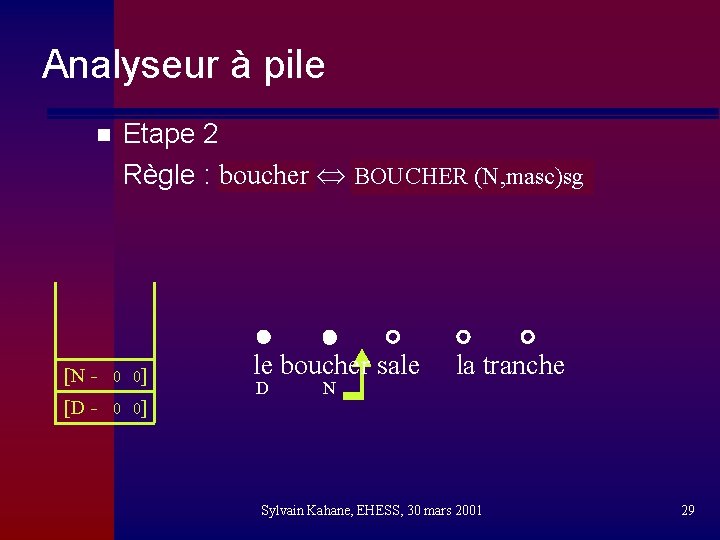

Analyseur à pile n Etape 0 : initialisation – curseur à gauche – pile vide le boucher sale la tranche Sylvain Kahane, EHESS, 30 mars 2001 27

Analyseur à pile n Etape 1 Règle : le LE (D)masc, sg le boucher sale D [D - la tranche 0 0] Sylvain Kahane, EHESS, 30 mars 2001 28

Analyseur à pile n Etape 2 Règle : boucher BOUCHER (N, masc)sg [N - 0 0] [D - 0 0] le boucher sale D N la tranche Sylvain Kahane, EHESS, 30 mars 2001 29

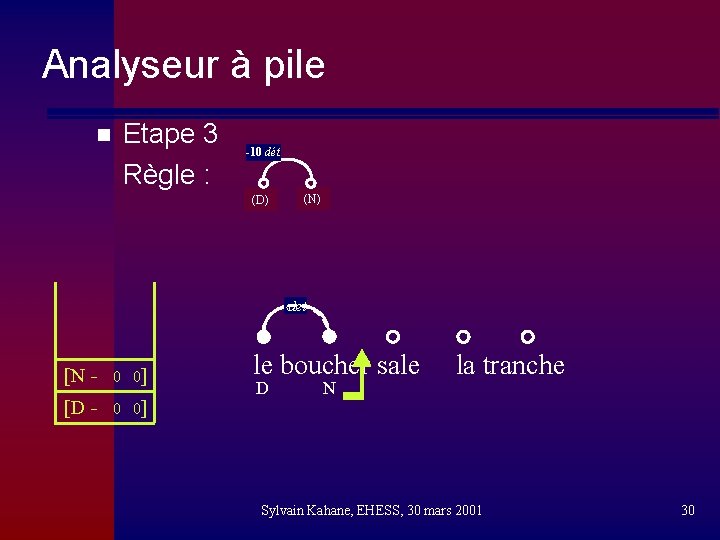

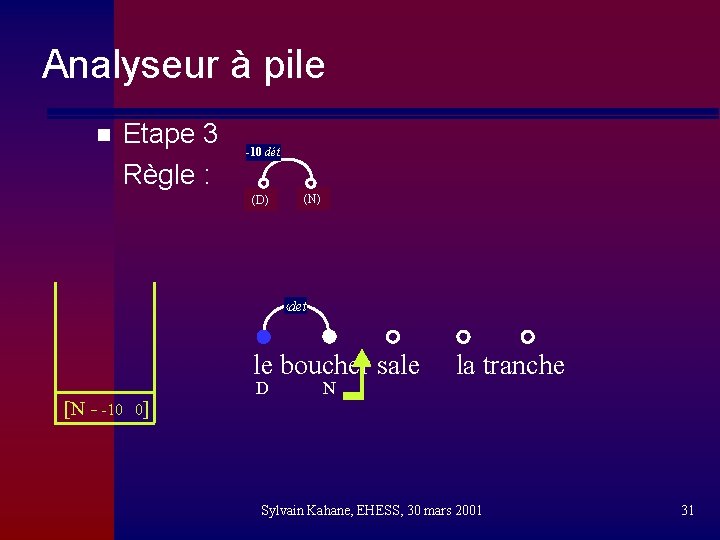

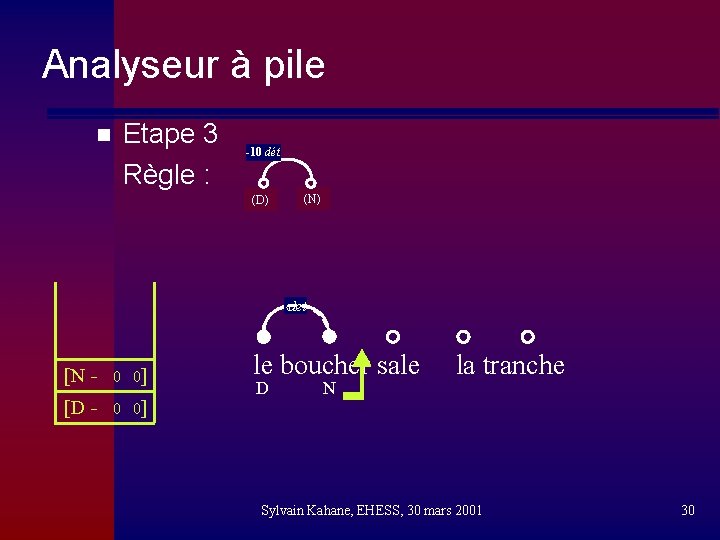

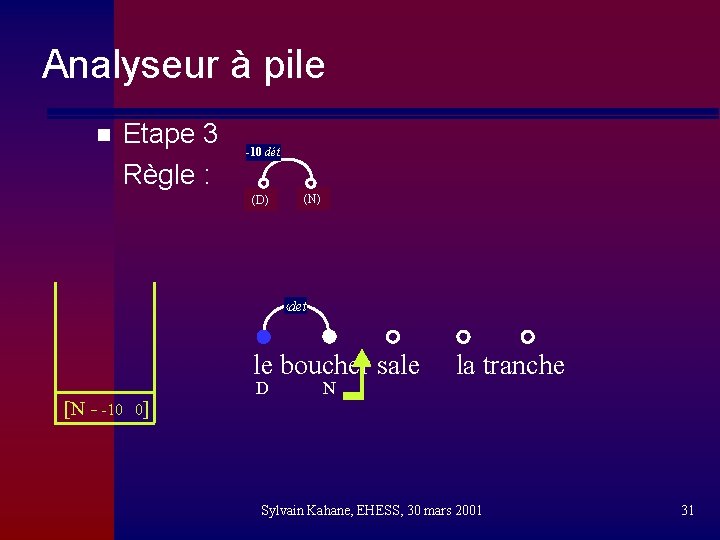

Analyseur à pile n Etape 3 Règle : -10 dét (D) (N) ‹det [N - 0 0] [D - 0 0] le boucher sale D N la tranche Sylvain Kahane, EHESS, 30 mars 2001 30

Analyseur à pile n Etape 3 Règle : -10 dét (D) (N) ‹det le boucher sale [N - -10 0] D N la tranche Sylvain Kahane, EHESS, 30 mars 2001 31

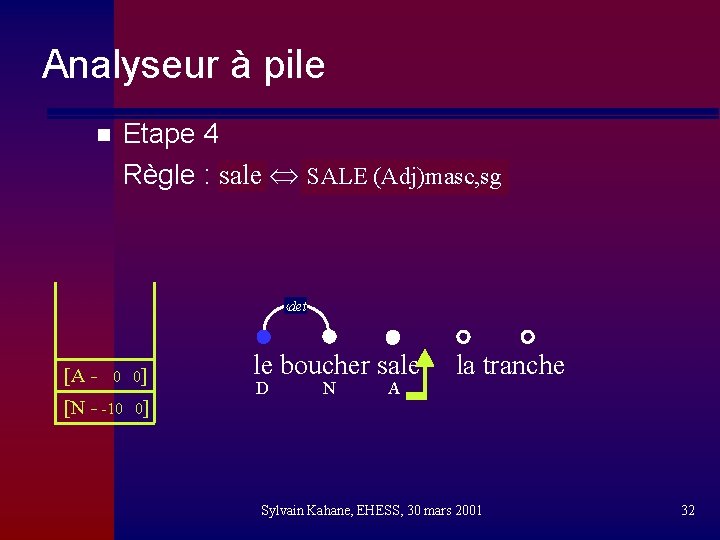

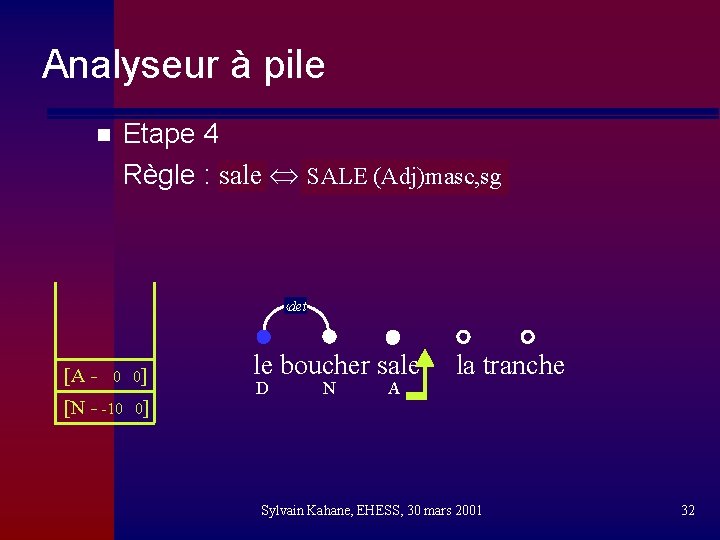

Analyseur à pile n Etape 4 Règle : sale SALE (Adj)masc, sg ‹det [A - 0 0] [N - -10 0] le boucher sale D N A la tranche Sylvain Kahane, EHESS, 30 mars 2001 32

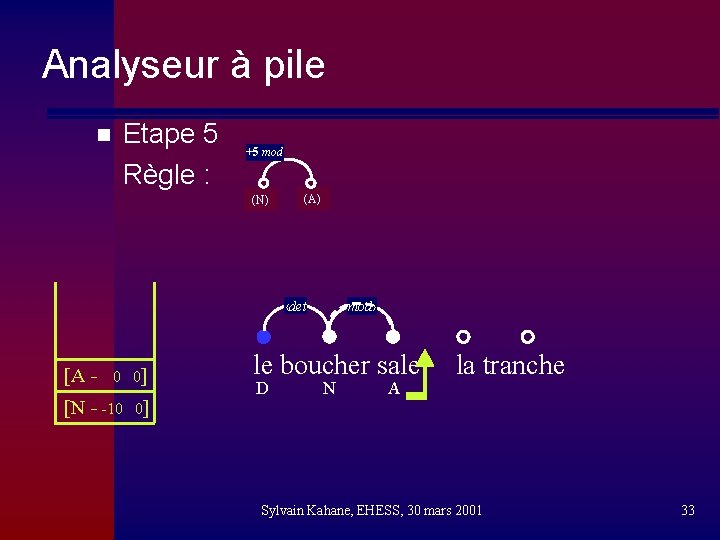

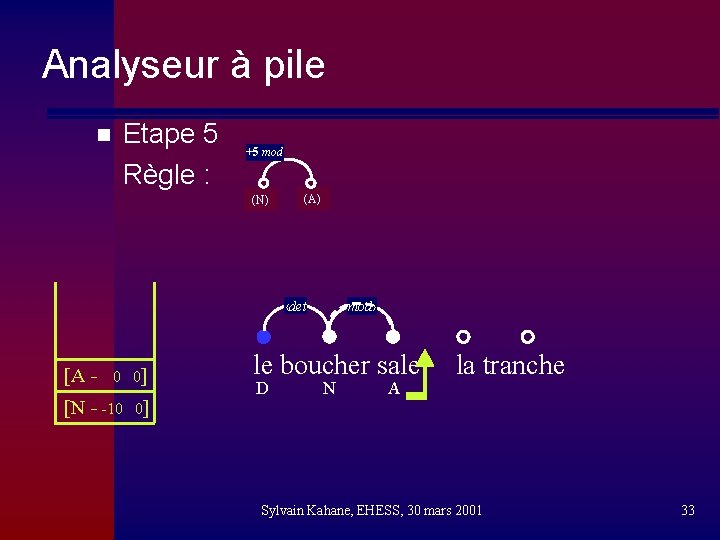

Analyseur à pile n Etape 5 Règle : +5 mod (N) (A) ‹det [A - 0 0] [N - -10 0] mod› le boucher sale D N A la tranche Sylvain Kahane, EHESS, 30 mars 2001 33

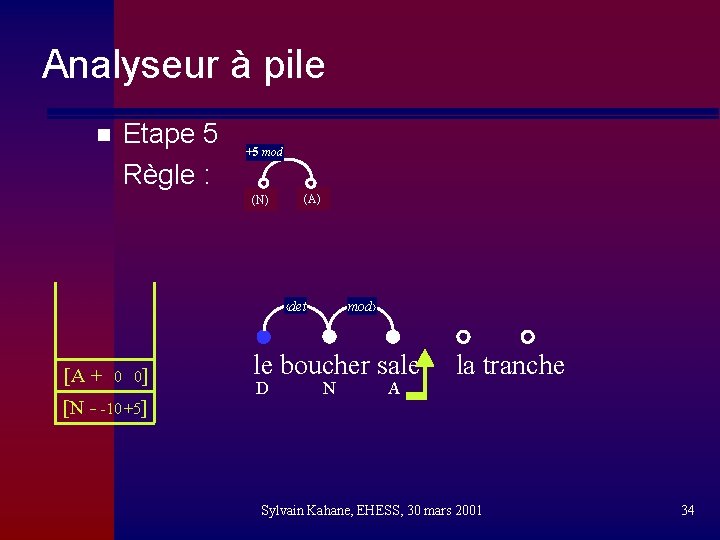

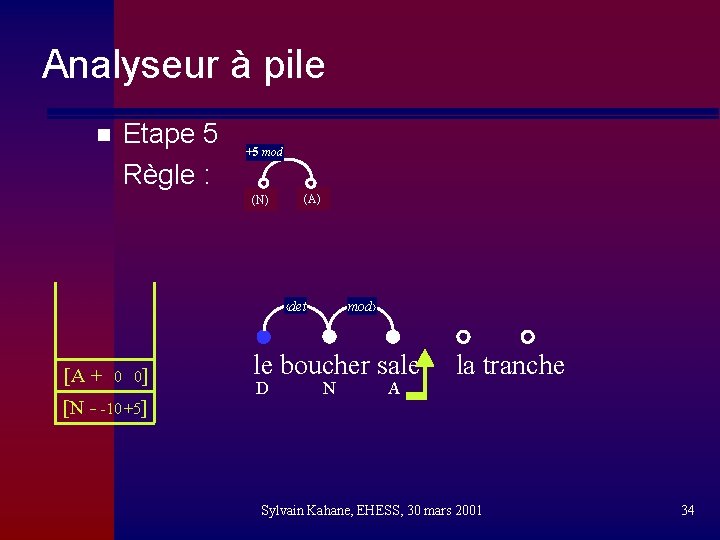

Analyseur à pile n Etape 5 Règle : +5 mod (N) (A) ‹det [A + 0 0] [N - -10 +5] mod› le boucher sale D N A la tranche Sylvain Kahane, EHESS, 30 mars 2001 34

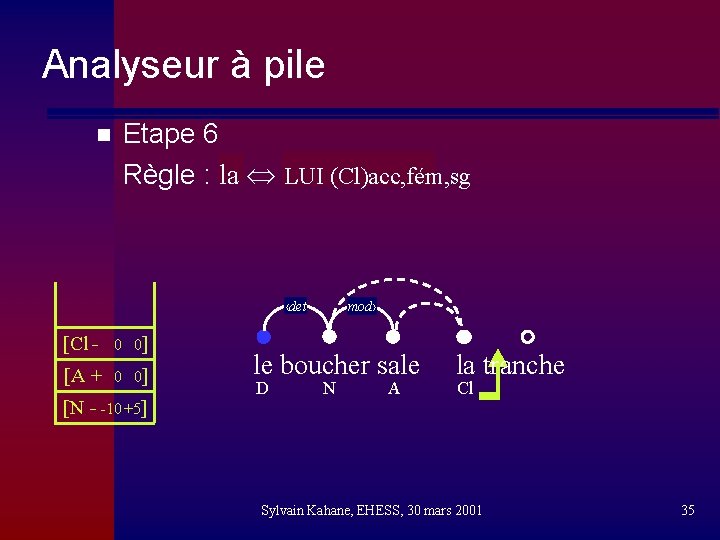

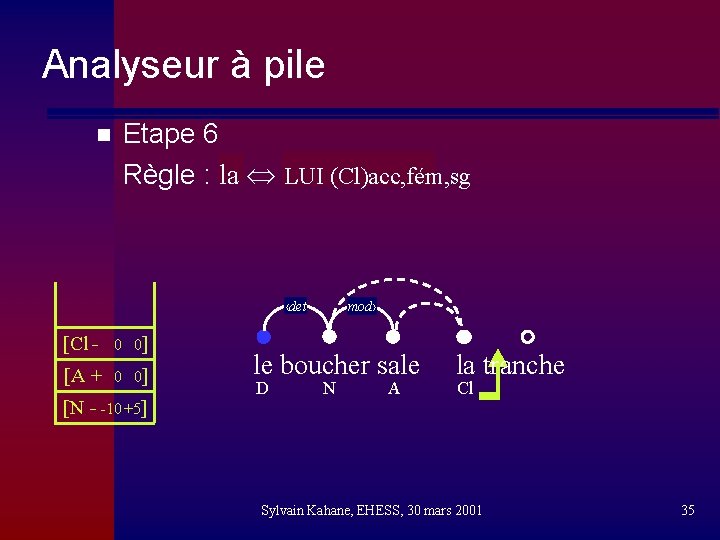

Analyseur à pile n Etape 6 Règle : la LUI (Cl)acc, fém, sg ‹det [Cl - 0 0] [A + 0 0] [N - -10 +5] mod› le boucher sale D N A la tranche Cl Sylvain Kahane, EHESS, 30 mars 2001 35

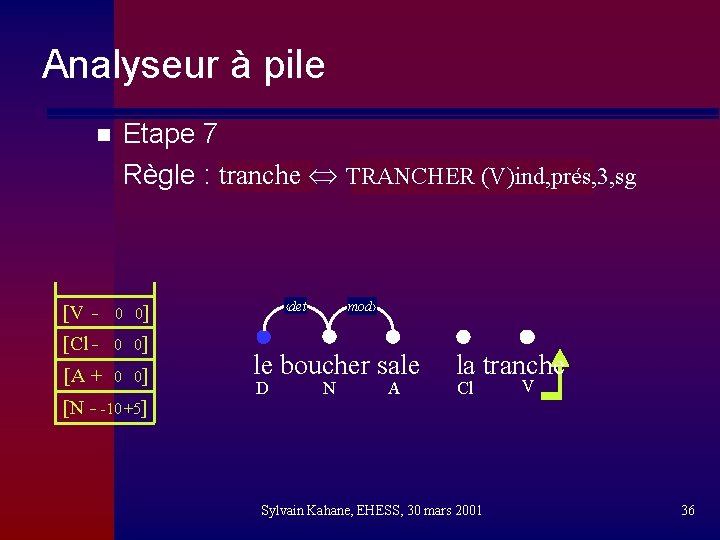

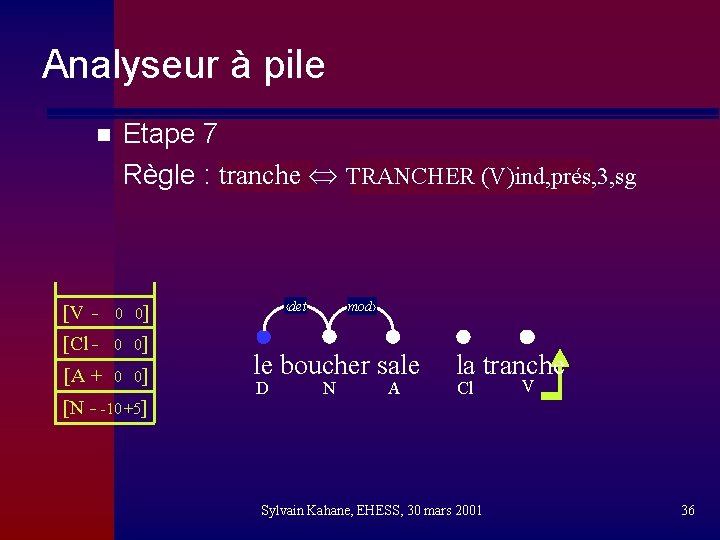

Analyseur à pile n Etape 7 Règle : tranche TRANCHER (V)ind, prés, 3, sg [V - 0 0] [Cl - 0 0] [A + 0 0] [N - -10 +5] ‹det mod› le boucher sale D N A la tranche Cl Sylvain Kahane, EHESS, 30 mars 2001 V 36

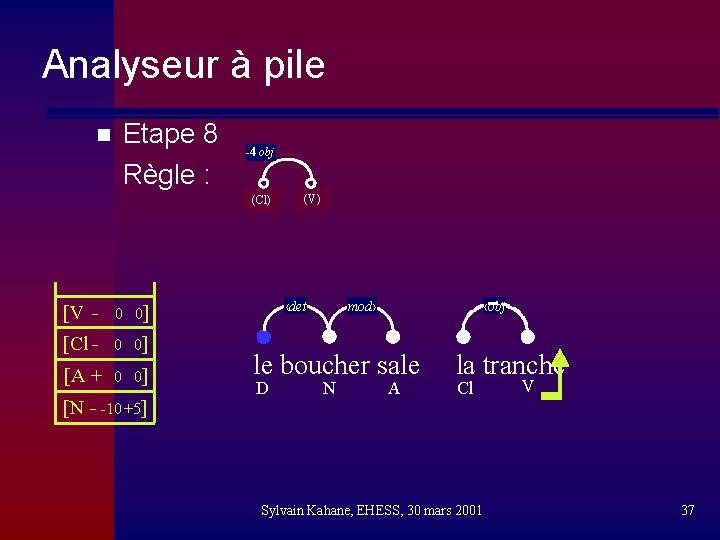

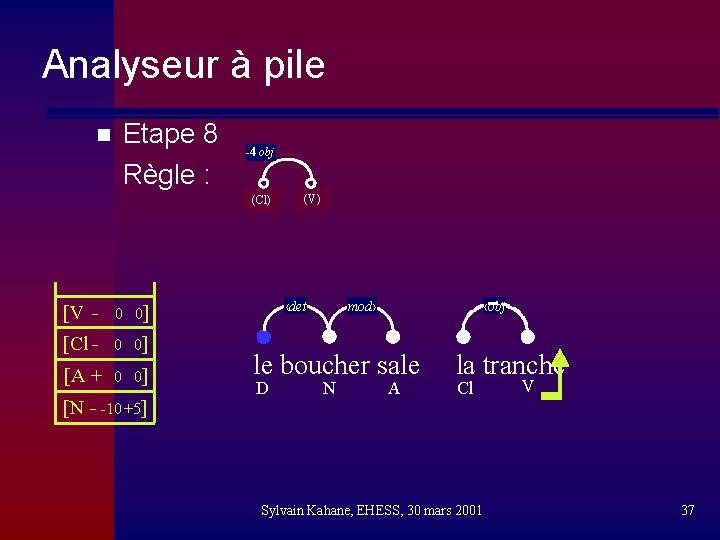

Analyseur à pile n Etape 8 Règle : -4 obj (Cl) [V - 0 0] [Cl - 0 0] [A + 0 0] [N - -10 +5] (V) ‹det ‹obj mod› le boucher sale D N A la tranche Cl Sylvain Kahane, EHESS, 30 mars 2001 V 37

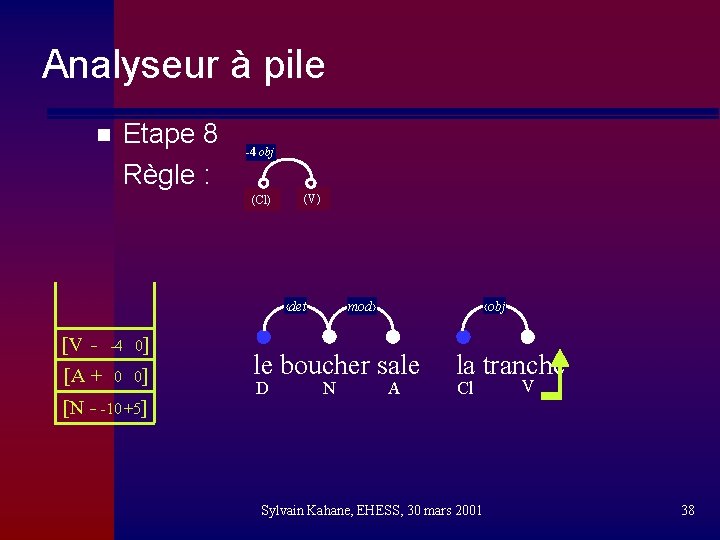

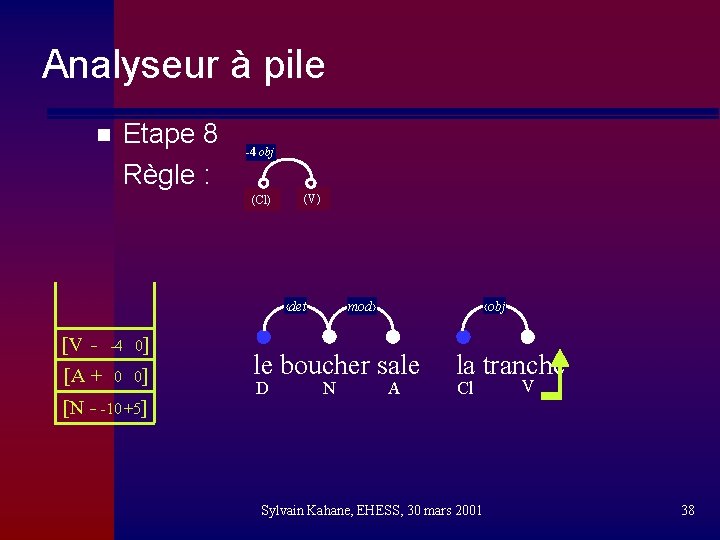

Analyseur à pile n Etape 8 Règle : -4 obj (Cl) (V) ‹det [V - -4 0] [A + 0 0] [N - -10 +5] ‹obj mod› le boucher sale D N A la tranche Cl Sylvain Kahane, EHESS, 30 mars 2001 V 38

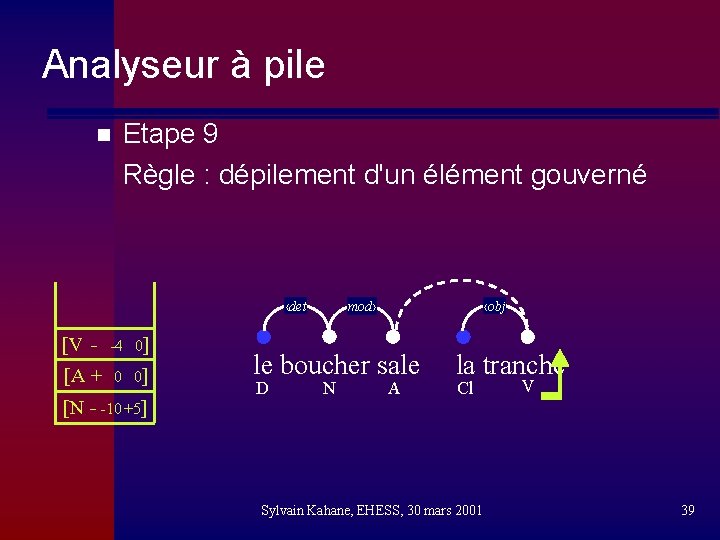

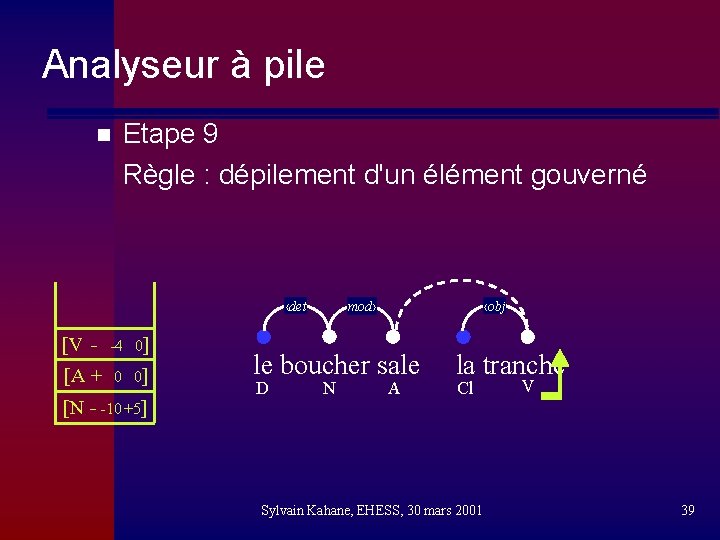

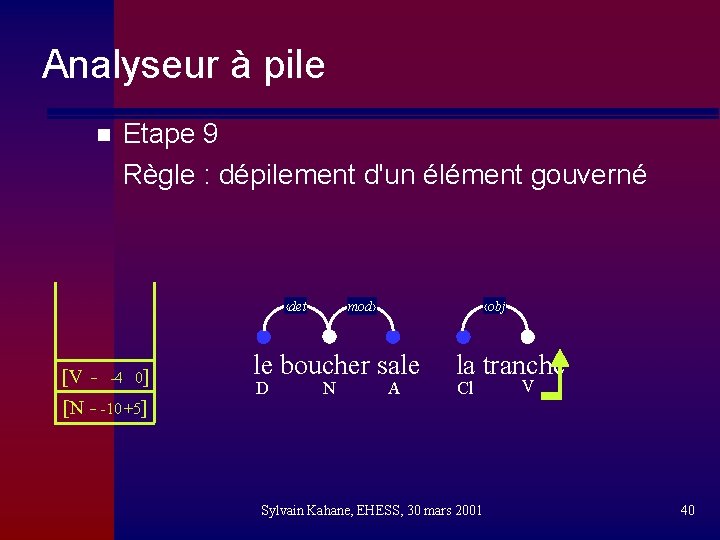

Analyseur à pile n Etape 9 Règle : dépilement d'un élément gouverné ‹det [V - -4 0] [A + 0 0] [N - -10 +5] ‹obj mod› le boucher sale D N A la tranche Cl Sylvain Kahane, EHESS, 30 mars 2001 V 39

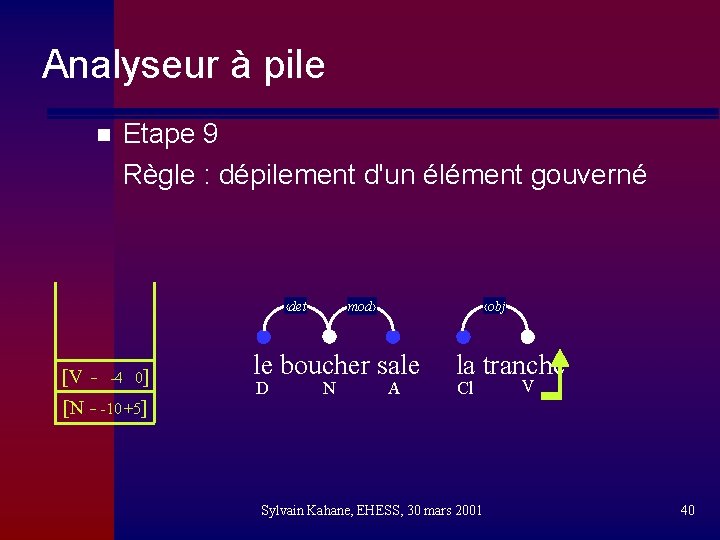

Analyseur à pile n Etape 9 Règle : dépilement d'un élément gouverné ‹det [V - -4 0] [N - -10 +5] ‹obj mod› le boucher sale D N A la tranche Cl Sylvain Kahane, EHESS, 30 mars 2001 V 40

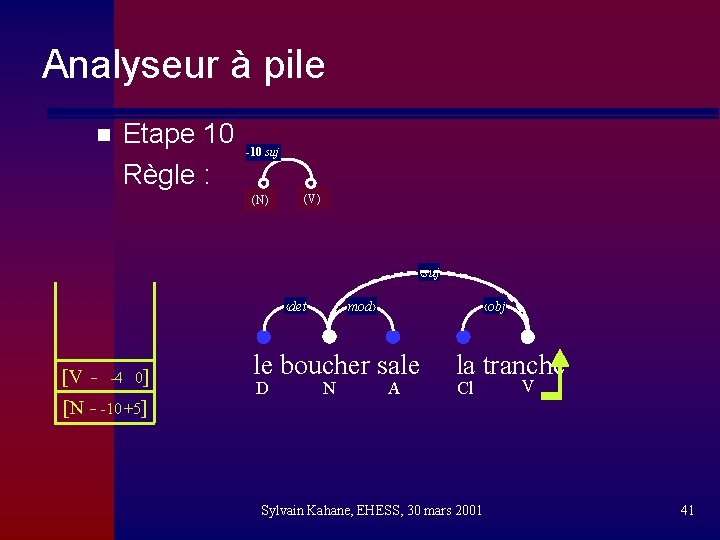

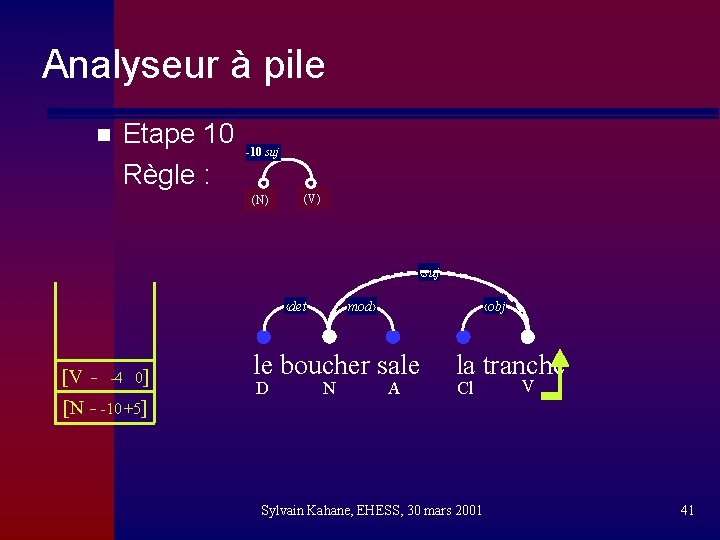

Analyseur à pile n Etape 10 Règle : -10 suj (N) (V) ‹suj ‹det [V - -4 0] [N - -10 +5] ‹obj mod› le boucher sale D N A la tranche Cl Sylvain Kahane, EHESS, 30 mars 2001 V 41

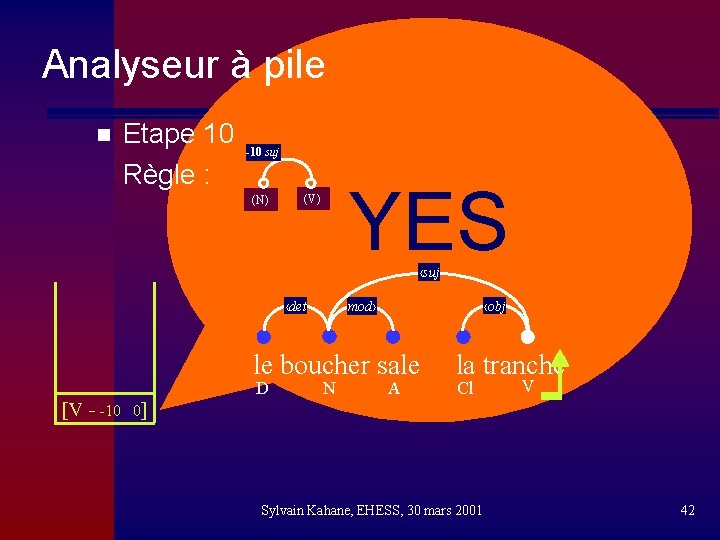

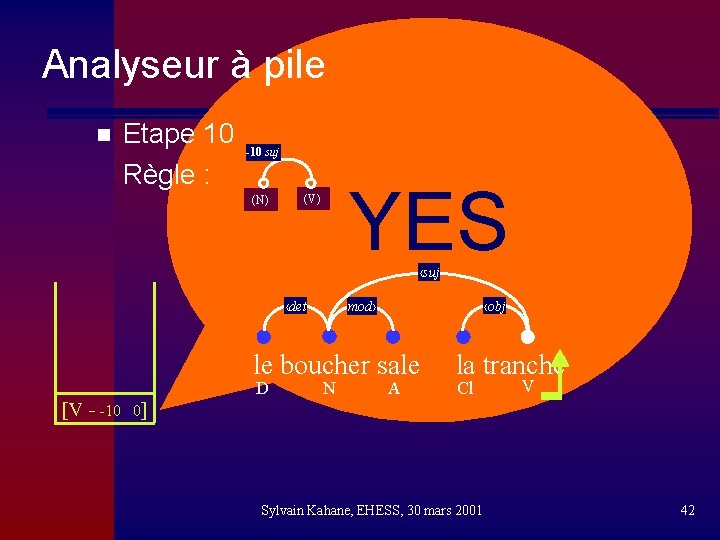

Analyseur à pile n Etape 10 Règle : -10 suj (N) YES (V) ‹suj ‹det ‹obj mod› le boucher sale D [V - -10 N A la tranche Cl V 0] Sylvain Kahane, EHESS, 30 mars 2001 42

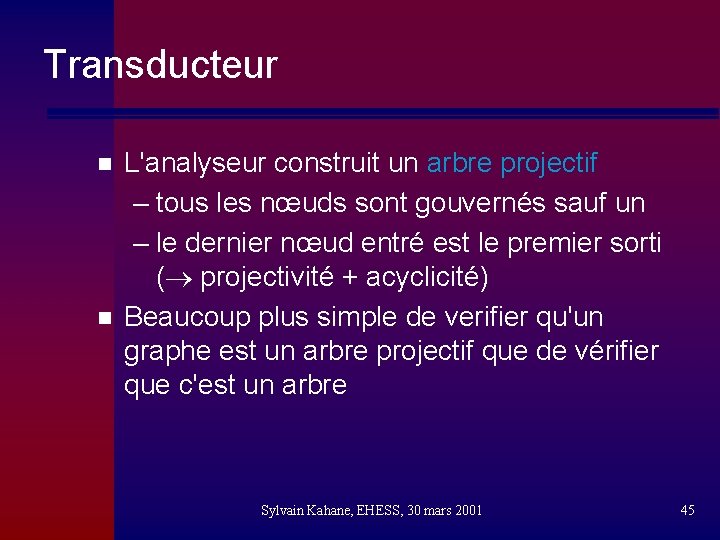

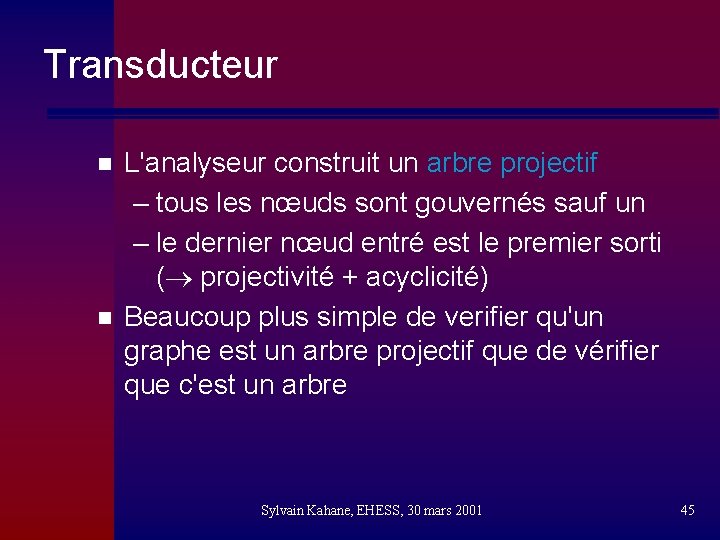

Transitions de l'analyseur (1) Transition: n Ne rien lire n Remplacer -10 suj (N) par (V) n Produire Sylvain Kahane, EHESS, 30 mars 2001 [V - p q] [N - p' q'] [V - -10 q] suj 43

Transitions de l'analyseur (2) n Quatre types de transition – Transition de stockage : lire un nœud, l'empiler et le produire – Transition de liage : produire une dépendance < Poids négatif (gouverneur à droite) : supprimer la deuxième case de la pile < Poids positif (gouverneur à gauche) : indiquer que le nœud de la première case est gouverné – Transition de déstockage : supprimer la première case si le nœud est gouverné Sylvain Kahane, EHESS, 30 mars 2001 44

Transducteur n n L'analyseur construit un arbre projectif – tous les nœuds sont gouvernés sauf un – le dernier nœud entré est le premier sorti ( projectivité + acyclicité) Beaucoup plus simple de verifier qu'un graphe est un arbre projectif que de vérifier que c'est un arbre Sylvain Kahane, EHESS, 30 mars 2001 45

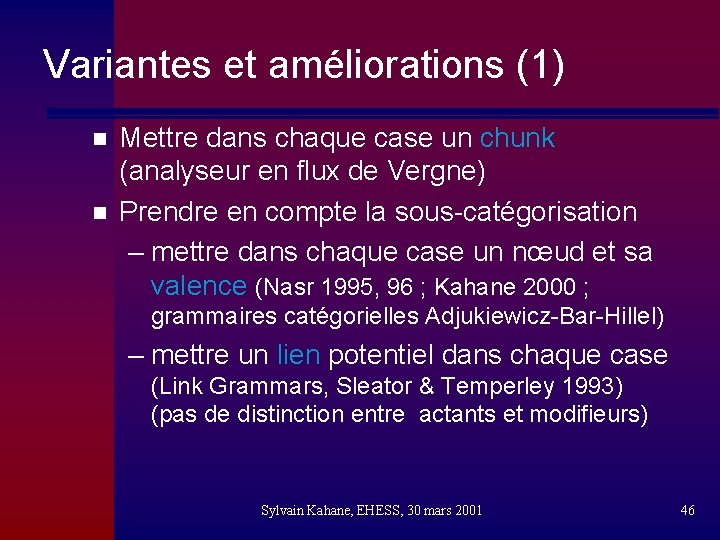

Variantes et améliorations (1) n n Mettre dans chaque case un chunk (analyseur en flux de Vergne) Prendre en compte la sous-catégorisation – mettre dans chaque case un nœud et sa valence (Nasr 1995, 96 ; Kahane 2000 ; grammaires catégorielles Adjukiewicz-Bar-Hillel) – mettre un lien potentiel dans chaque case (Link Grammars, Sleator & Temperley 1993) (pas de distinction entre actants et modifieurs) Sylvain Kahane, EHESS, 30 mars 2001 46

Variantes et améliorations (2) n Traitement de la non-projectivité – garder plus d'un mot en mémoire dans une case (Nasr 1996 ; Kahane 2000) – autoriser des règles de transition permettant d'accéder à des cases plus profondes (Kahane 1996) – ajouter un trait slash la personne à qui je veux parler Sylvain Kahane, EHESS, 30 mars 2001 47

Ambiguïtés (1) n n Ambiguïté (locale) = plusieurs règles peuvent s'appliquer 1ère technique : choisir une règle et revenir en arrière en cas d'échec et choisir une autre règle exponentiel dans le pire des cas Pour éviter le problème : – faire un seul choix (traitement linéaire) – mémoïsation : conserver en mémoire les analyses déjà faite pour ne pas les refaire (Link Grammars : compléxité en O(n 3)) Sylvain Kahane, EHESS, 30 mars 2001 48

Ambiguïtés (2) n n 2ème technique : mener en parallèle les différents choix exponentiel dans le pire des cas Pour éviter le problème : – dupliquer la pile à chaque ambiguïté et factoriser les opérations effectuées plusieurs fois (pile à structure de graphe : Tomita 1988, Nasr 1996) “ 3ème technique” : éviter de proposer des choix inutiles Sylvain Kahane, EHESS, 30 mars 2001 49

Ambiguïté (3) n Point de vue linguistique et cognitif : il existe des situation où un locuteur fait des choix (garden-path) et d'autres où il n'en fait pas – parler à Marie, parler de Jean, parler à Marie de Jean – Le diplomate reconduit à la frontière …. Conséquence : il faut travailler au niveau de la grammaire et pas seulement au niveau des algos d'analyse Sylvain Kahane, EHESS, 30 mars 2001 50

Flux et complexité n Flux = nombre de dépendances liant un mot à gauche à un mot à droite 0 n 1 2 0 Le flux des phrases d'un langue naturelle est borné (limitations mémorielles) Le nombre de cases dans la pile est borné Le nombre de contenu de pile est fini Equivalence avec un automate fini Analyse en temps linéaire Sylvain Kahane, EHESS, 30 mars 2001 51

Conclusion n La dépendance est présente dans tous les formalismes contemporains, mais elle est souvent cachée Séparation entre dépendance syntaxique et sémantique Intérêt d'une représentation syntaxique qui ne présuppose pas l'ordre linéaire et le regroupement en syntagme Sylvain Kahane, EHESS, 30 mars 2001 52

Conclusion n On peut réduire certains problème algorithmique en écrivant mieux les grammaires (et éviter l'explosion combinatoire du nombre de règles lors d'un analyse verticale ou d'un lexicalisation de la grammaire) n Pradoxalement, les grammaires syntagmatiques présupposent une analyse trop basée sur la dépendance (les seuls syntagmes considérés sont des projections des têtes) (cf. comparaison entre analyse CKY et HPSG) Sylvain Kahane, EHESS, 30 mars 2001 53

Conclusion n Rôle primordiale de structure communicative: – ordre des mots – prosodie – constructions particulières : clivage, dislocation, … n n Les syntagmes (constituants morphologiques) dépendent de la structure de dépendance, de la structure communicative et de la structure topologique (Gerdes & Kahane, ACL 2001) Synthèse de la prosodie (basée sur les constitunats morphologiques, chunks et autres): Mertens 1997, Vergne 2000 Sylvain Kahane, EHESS, 30 mars 2001 54

MERCI Sylvain Kahane, EHESS, 30 mars 2001