GPGPU CUDA 1 Hasznos weboldalak Videkrtya CUDA kompatibilits

GPGPU – CUDA 1.

Hasznos weboldalak � Videókártya - CUDA kompatibilitás: https: //developer. nvidia. com/cuda-gpus � CUDA weboldal: https: //developer. nvidia. com/cuda-zone � Példaterületek: �http: //www. nvidia. com/object/imaging_comp _vision. html �http: //www. nvidia. com/object/computational_ fluid_dynamics. html

CUDA (Compute Unified Device Architecture) � NVIDIA által fejlesztett GPGPU platform. � Fejleszthető: C, C++, Fortran nyelveken, de elérhető wrapper: Python, Perl, Fortran, Java, Ruby, Lua, Haskell, MATLAB

CUDA �A játékiparban nem csak grafikus renderelésre, de fizikai rendszerek számítására is alkalmazzák (Phys. X) � Könnyen létrehozható Open. GL-el együttműködés

CUDA vs. Open. CL � Általánosságban nem jelenthető ki, hogy egyik jobb lenne, mint a másik. � Különböző algoritmusok, különböző ‘vasakon’ más és más teljesítménnyel futnak. Néha CUDA-ban jobb, néha Open. CL-ben. � Cuda vs. Open. CL cikk: http: //cg. elte. hu/~gpgpu/cudavsop encl. pdf

CUDA vs. Open. CL Néhány gondolat nagyon intuitívan - Open. CL több hardveren futtatható, mint a CUDA A CUDA-hoz több debugging és profiler tool található A CUDA elsőre ‘könnyebben’ telepíthető, és indítható. Nem túl bonyolult egyik kódot a másikká alakítani. Stb.

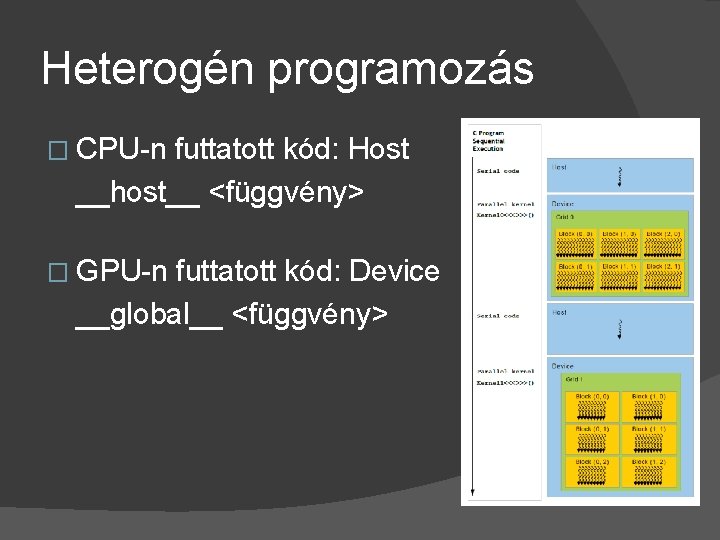

Heterogén programozás � CPU-n futtatott kód: Host __host__ <függvény> � GPU-n futtatott kód: Device __global__ <függvény>

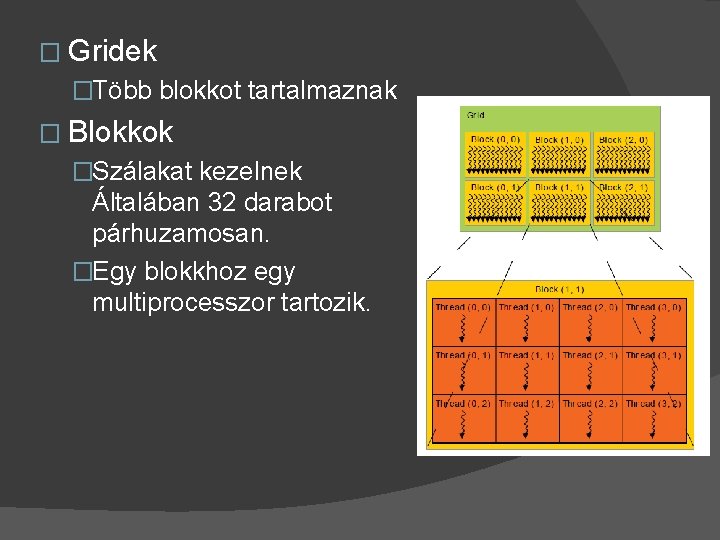

� Gridek �Több blokkot tartalmaznak � Blokkok �Szálakat kezelnek Általában 32 darabot párhuzamosan. �Egy blokkhoz egy multiprocesszor tartozik.

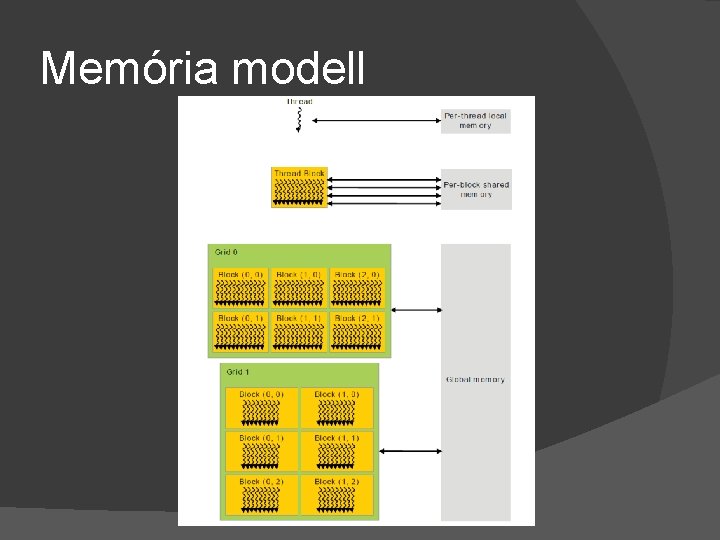

Memória modell

Memóriakezelés A host és device memória megkülönböztetése végett a pointernevek elé ‘h_’, és ‘d_’ prefixet szoktak tenni. � cuda. Malloc(void ** pointer, size_t, nbytes) // Device memória foglalása � cuda. Memset(void * pointer, int value, size_t count) // Device memória beállítása � cuda. Free(void * pointer); // Device memória felszabadítása �

Memóriakezelés példa int n = 1024; int nbytes = 1024 * sizeof(int); int *d_a = 0; cuda. Malloc( (void**) &d_a, nbytes ); cuda. Memset( d_a, 0, nbytes ); cuda. Free( d_a )

Host – Device memória cuda. Memcpy(void *dst, void *src, size_t nbytes, enum cuda. Memcpy. Kind direction) // Adatok másolása Host és Device memória között enum cuda. Memcpy. Kind �cuda. Memcpy. Host. To. Device �cuda. Memcpy. Device. To. Host �cuda. Memcpy. Device. To. Device

![Példa: Vektor összeadás � Sorosan: for (i = 0. . N-1) C[i] = A[i] Példa: Vektor összeadás � Sorosan: for (i = 0. . N-1) C[i] = A[i]](http://slidetodoc.com/presentation_image_h/19c13ef84afac5b3cd1977c9182991bf/image-13.jpg)

Példa: Vektor összeadás � Sorosan: for (i = 0. . N-1) C[i] = A[i] + B[i]; � Párhuzamosan szál végezhet. minden összeadást egy Vec. Add(A, B, C) { int i = thread. Idx; C[i] = A[i] + B[i]; }

Telepítés Visual Studio alá Visual Studio telepítése 2. CUDA Toolkit letöltése 3. Kész 1.

1. Példa projekt Elérhető device-ok lekérdezése http: //cg. elte. hu/~gpgpu/cuda/01_device. Q uery. zip

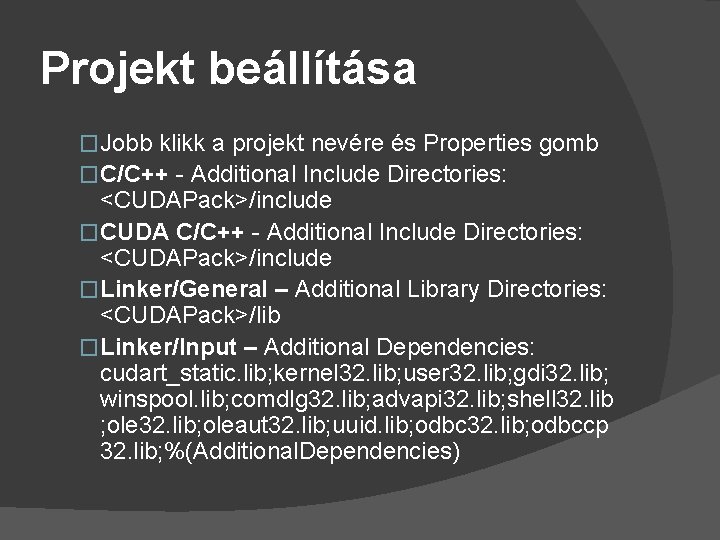

Projekt beállítása �Jobb klikk a projekt nevére és Properties gomb �C/C++ - Additional Include Directories: <CUDAPack>/include �CUDA C/C++ - Additional Include Directories: <CUDAPack>/include �Linker/General – Additional Library Directories: <CUDAPack>/lib �Linker/Input – Additional Dependencies: cudart_static. lib; kernel 32. lib; user 32. lib; gdi 32. lib; winspool. lib; comdlg 32. lib; advapi 32. lib; shell 32. lib ; ole 32. lib; oleaut 32. lib; uuid. lib; odbc 32. lib; odbccp 32. lib; %(Additional. Dependencies)

2. Projekt y = A*x + b egyenlet kiszámolása ismert A, x, b esetén. A – N*M-es mátrix x – M hosszú vektor b – N hosszú vektor y – N hosszú vektor Projekt váza:

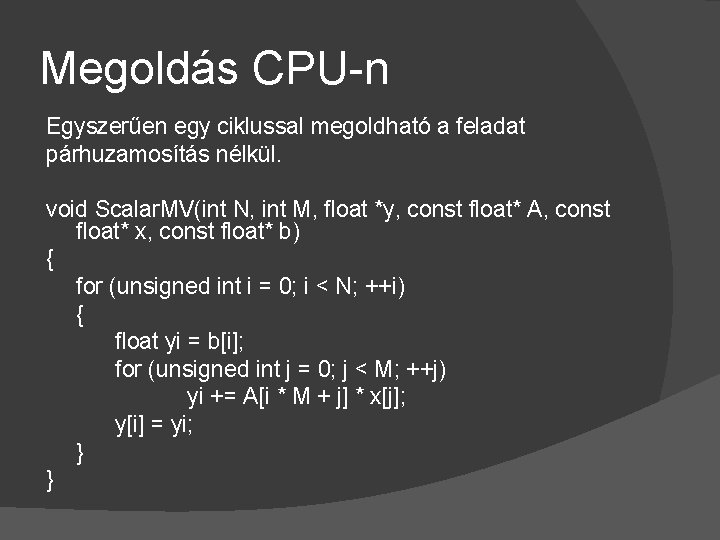

Megoldás CPU-n Egyszerűen egy ciklussal megoldható a feladat párhuzamosítás nélkül. void Scalar. MV(int N, int M, float *y, const float* A, const float* x, const float* b) { for (unsigned int i = 0; i < N; ++i) { float yi = b[i]; for (unsigned int j = 0; j < M; ++j) yi += A[i * M + j] * x[j]; y[i] = yi; } }

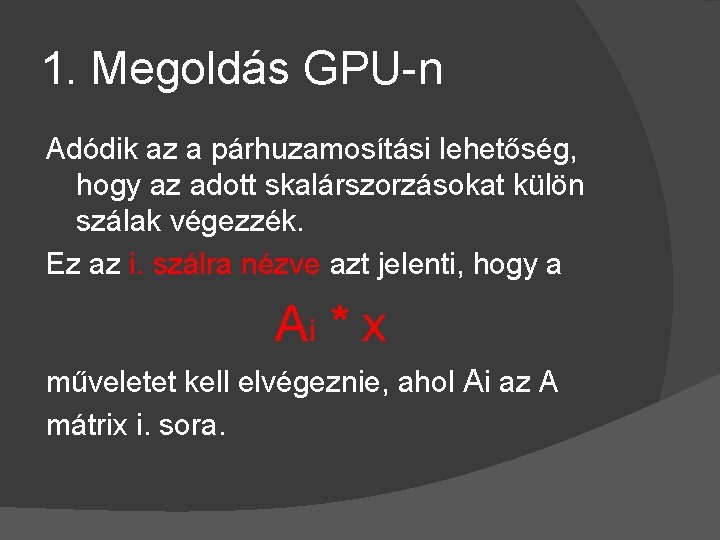

1. Megoldás GPU-n Adódik az a párhuzamosítási lehetőség, hogy az adott skalárszorzásokat külön szálak végezzék. Ez az i. szálra nézve azt jelenti, hogy a Ai * x műveletet kell elvégeznie, ahol Ai az A mátrix i. sora.

Simple. MV. cpp � Adatok generálása � Simple. MV(N, meghívása M, y, A, x, b) függvény

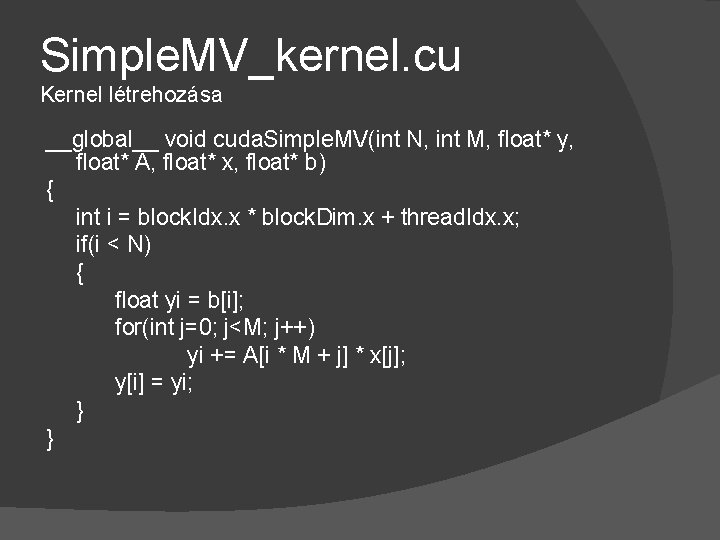

Simple. MV_kernel. cu Kernel létrehozása __global__ void cuda. Simple. MV(int N, int M, float* y, float* A, float* x, float* b) { int i = block. Idx. x * block. Dim. x + thread. Idx. x; if(i < N) { float yi = b[i]; for(int j=0; j<M; j++) yi += A[i * M + j] * x[j]; y[i] = yi; } }

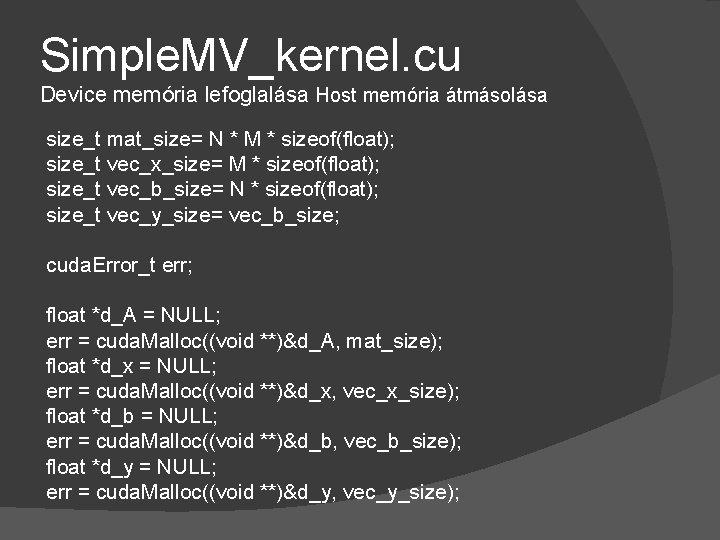

Simple. MV_kernel. cu Device memória lefoglalása Host memória átmásolása size_t mat_size= N * M * sizeof(float); size_t vec_x_size= M * sizeof(float); size_t vec_b_size= N * sizeof(float); size_t vec_y_size= vec_b_size; cuda. Error_t err; float *d_A = NULL; err = cuda. Malloc((void **)&d_A, mat_size); float *d_x = NULL; err = cuda. Malloc((void **)&d_x, vec_x_size); float *d_b = NULL; err = cuda. Malloc((void **)&d_b, vec_b_size); float *d_y = NULL; err = cuda. Malloc((void **)&d_y, vec_y_size);

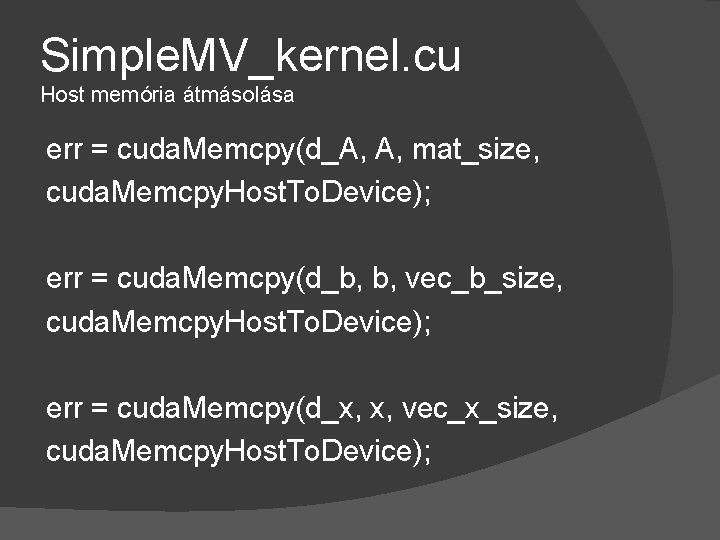

Simple. MV_kernel. cu Host memória átmásolása err = cuda. Memcpy(d_A, A, mat_size, cuda. Memcpy. Host. To. Device); err = cuda. Memcpy(d_b, b, vec_b_size, cuda. Memcpy. Host. To. Device); err = cuda. Memcpy(d_x, x, vec_x_size, cuda. Memcpy. Host. To. Device);

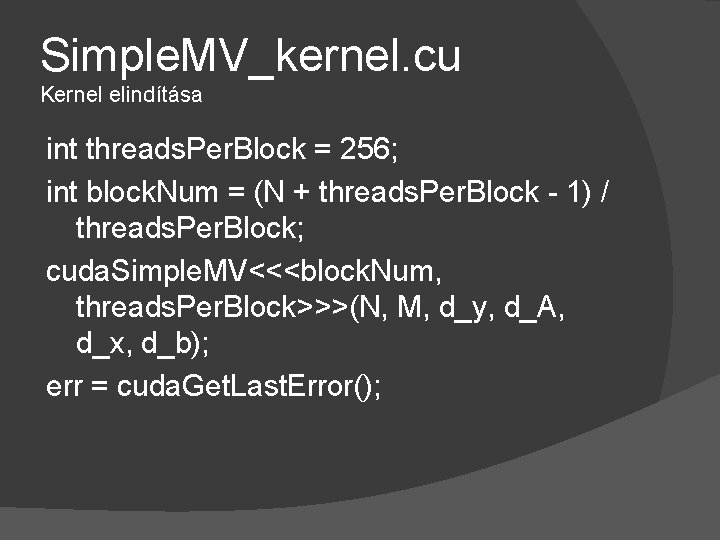

Simple. MV_kernel. cu Kernel elindítása int threads. Per. Block = 256; int block. Num = (N + threads. Per. Block - 1) / threads. Per. Block; cuda. Simple. MV<<<block. Num, threads. Per. Block>>>(N, M, d_y, d_A, d_x, d_b); err = cuda. Get. Last. Error();

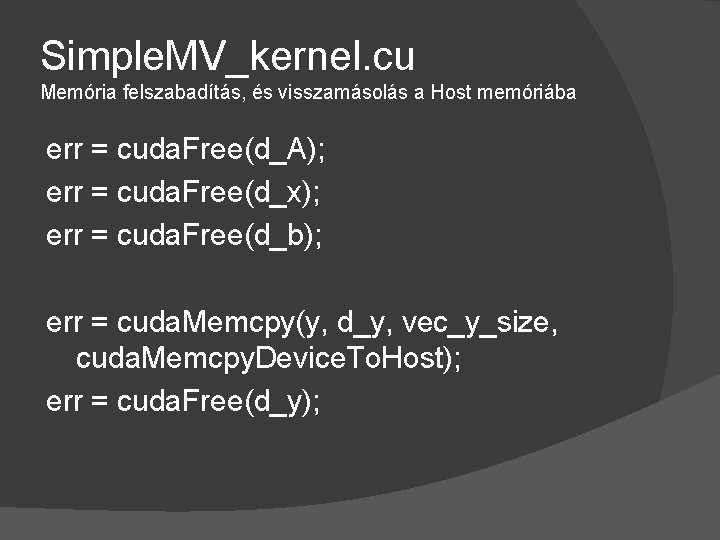

Simple. MV_kernel. cu Memória felszabadítás, és visszamásolás a Host memóriába err = cuda. Free(d_A); err = cuda. Free(d_x); err = cuda. Free(d_b); err = cuda. Memcpy(y, d_y, vec_y_size, cuda. Memcpy. Device. To. Host); err = cuda. Free(d_y);

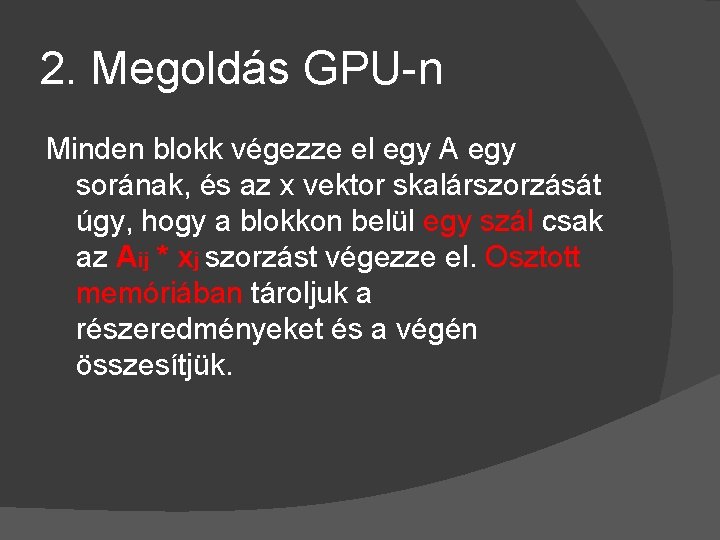

2. Megoldás GPU-n Az előző megoldása a skalárszorzásokat nem párhuzamosította. Tegyünk fel egy nem túl realisztikus feltételt a demonstráció kedvéért: Annyi szálat tudjon egy blokk indítani, amekkora az M (oszlopok száma)

2. Megoldás GPU-n Minden blokk végezze el egy A egy sorának, és az x vektor skalárszorzását úgy, hogy a blokkon belül egy szál csak az Aij * xj szorzást végezze el. Osztott memóriában tároljuk a részeredményeket és a végén összesítjük.

Simple. MV. cpp extern "C" void Reduce. MV(int N, float* y, float* A, float* x, float* b);

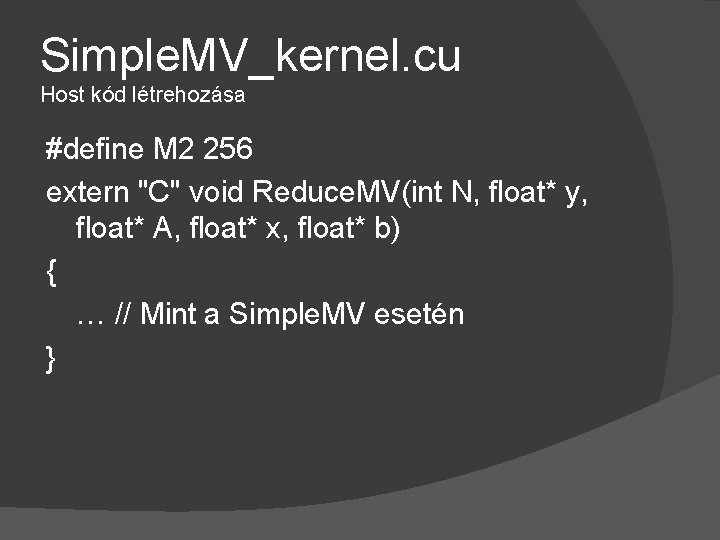

Simple. MV_kernel. cu Host kód létrehozása #define M 2 256 extern "C" void Reduce. MV(int N, float* y, float* A, float* x, float* b) { … // Mint a Simple. MV esetén }

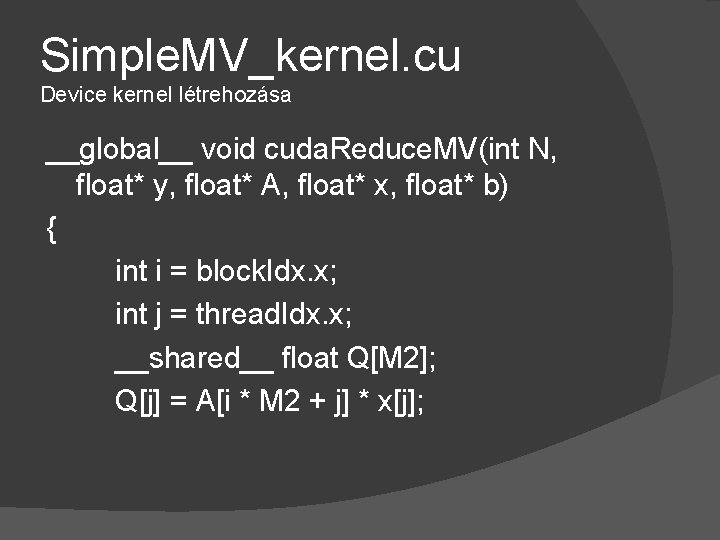

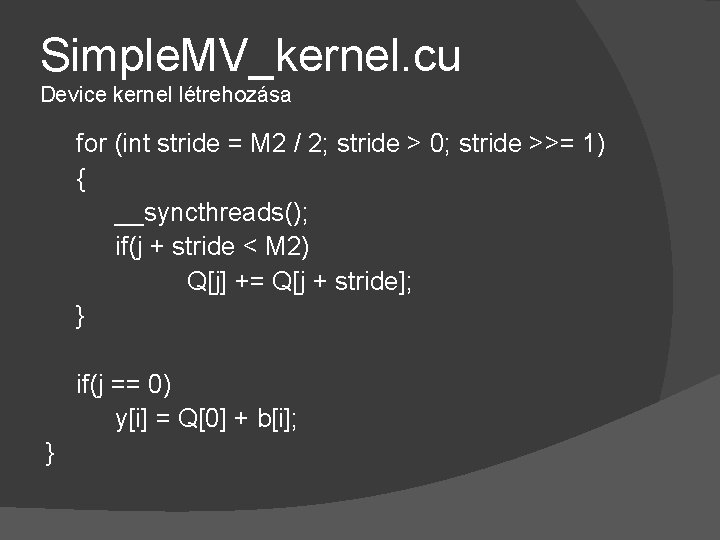

Simple. MV_kernel. cu Device kernel létrehozása __global__ void cuda. Reduce. MV(int N, float* y, float* A, float* x, float* b) { int i = block. Idx. x; int j = thread. Idx. x; __shared__ float Q[M 2]; Q[j] = A[i * M 2 + j] * x[j];

Simple. MV_kernel. cu Device kernel létrehozása for (int stride = M 2 / 2; stride > 0; stride >>= 1) { __syncthreads(); if(j + stride < M 2) Q[j] += Q[j + stride]; } if(j == 0) y[i] = Q[0] + b[i]; }

Köszönöm a figyelmet

- Slides: 32