Fragebeantwortung Von Erkan Kaz und Bjrn Baumann 08

Fragebeantwortung Von Erkan Kaz und Björn Baumann 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung

0. Gliederung 1. 2. 3. 4. 08. 04. 08 Einführung Methoden der Fragebeantwortung TREC Fazit PG isie (520): Vortrag Fragebeantwortung 2

1. Einführung 1. 2. 3. 08. 04. 08 Was ist eine Frage/Antwort Was ist Fragebeantwortung Beispielfrage PG isie (520): Vortrag Fragebeantwortung 3

1. Einführung 1. Was ist eine Frage/Antwort? l Definition Frage: l l „Eine Frage ist eine Äußerung, mit der Sprecher eine Antwort zwecks Beseitigung einer Wissenslücke herausfordert. “ (von Wikipedia) Definition Antwort: l 08. 04. 08 „Ein Satz, der die Leerstelle ausfüllt, die in einer Frage stets enthalten ist. “ (von Wikipedia) PG isie (520): Vortrag Fragebeantwortung 4

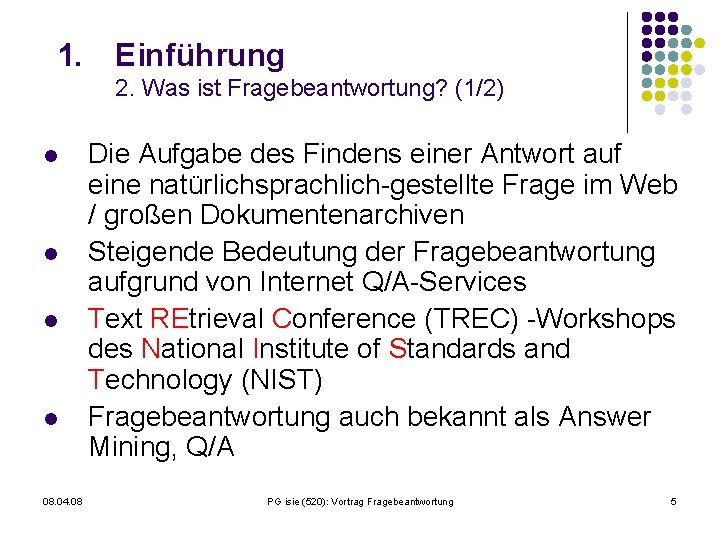

1. Einführung 2. Was ist Fragebeantwortung? (1/2) l l 08. 04. 08 Die Aufgabe des Findens einer Antwort auf eine natürlichsprachlich-gestellte Frage im Web / großen Dokumentenarchiven Steigende Bedeutung der Fragebeantwortung aufgrund von Internet Q/A-Services Text REtrieval Conference (TREC) -Workshops des National Institute of Standards and Technology (NIST) Fragebeantwortung auch bekannt als Answer Mining, Q/A PG isie (520): Vortrag Fragebeantwortung 5

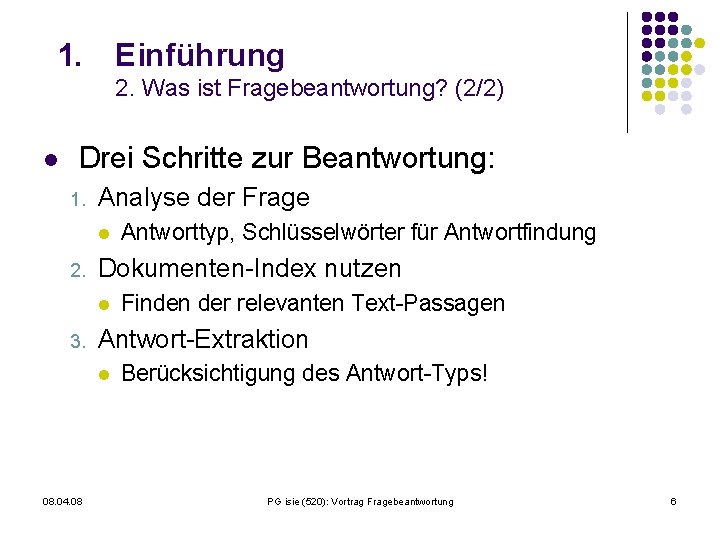

1. Einführung 2. Was ist Fragebeantwortung? (2/2) l Drei Schritte zur Beantwortung: 1. Analyse der Frage l 2. Dokumenten-Index nutzen l 3. Finden der relevanten Text-Passagen Antwort-Extraktion l 08. 04. 08 Antworttyp, Schlüsselwörter für Antwortfindung Berücksichtigung des Antwort-Typs! PG isie (520): Vortrag Fragebeantwortung 6

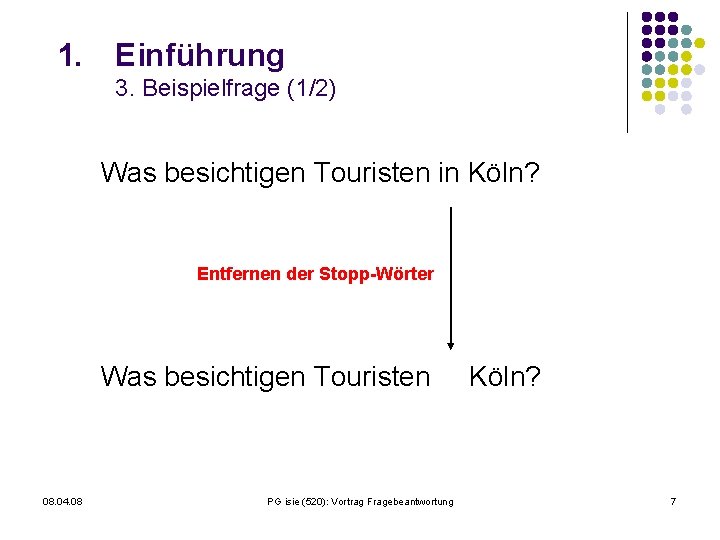

1. Einführung 3. Beispielfrage (1/2) Was besichtigen Touristen in Köln? Entfernen der Stopp-Wörter Was besichtigen Touristen 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung Köln? 7

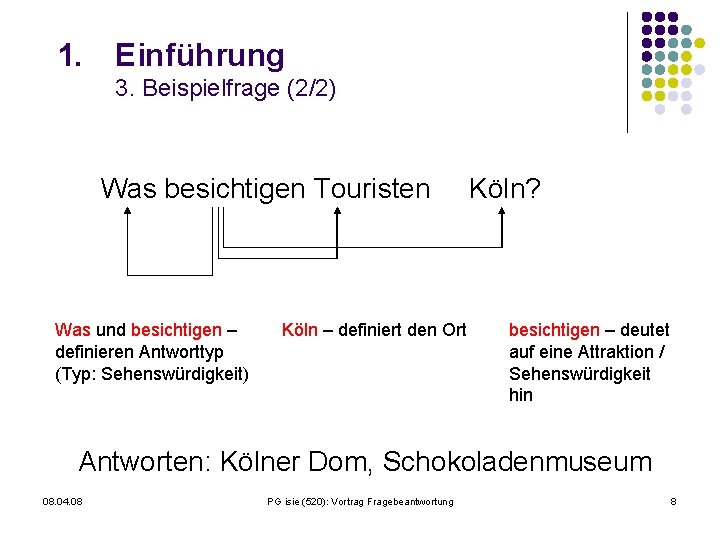

1. Einführung 3. Beispielfrage (2/2) Was besichtigen Touristen Was und besichtigen – definieren Antworttyp (Typ: Sehenswürdigkeit) Köln – definiert den Ort Köln? besichtigen – deutet auf eine Attraktion / Sehenswürdigkeit hin Antworten: Kölner Dom, Schokoladenmuseum 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 8

2. Methoden d. Fragebeantwortung Bestimmen der Fragekomplexität Bestimmung des Antworttyps 1. 2. 08. 04. 08 Modell der Antworttypen Ablauf der Fragebeantwortung PG isie (520): Vortrag Fragebeantwortung 9

2. Methoden d. Fragebeantwortung 1. Bestimmen der Fragekomplexität l Man teilt die Komplexität einer Frage in drei Frageklassen ein: l l l Klasse 1: Fragen nach Attributen, Events, NEs, Bedingungen, u. a. Klasse 2: Fragen, die anhand einer Vorlage, von verschiedenen Quellen agglomeriert werden Klasse 3: Fragen, die eine Zusammenfassung von versch. Quellen geben und nicht typgleich sind Nach M. Pasca / S. Harabagiu 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 10

2. Methoden d. Fragebeantwortung 1. 1. Beispiel Fragekomplexität l l l Klasse 1: Wem biss Mike Tyson in einem Boxkampf ein Stück Ohr ab? Klasse 2: Wer ist Bill Gates? Klasse 3: Welche Konsequenzen hat die Veruntreuung der UNICEF-Spenden gehabt? 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 11

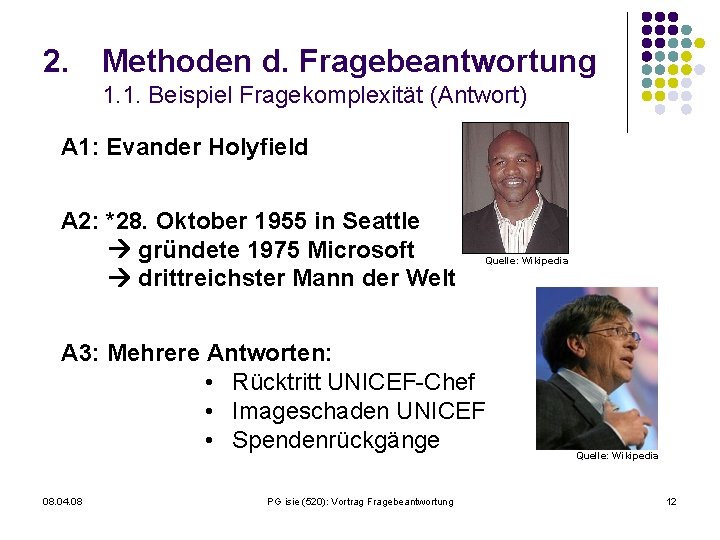

2. Methoden d. Fragebeantwortung 1. 1. Beispiel Fragekomplexität (Antwort) A 1: Evander Holyfield A 2: *28. Oktober 1955 in Seattle gründete 1975 Microsoft drittreichster Mann der Welt Quelle: Wikipedia A 3: Mehrere Antworten: • Rücktritt UNICEF-Chef • Imageschaden UNICEF • Spendenrückgänge 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung Quelle: Wikipedia 12

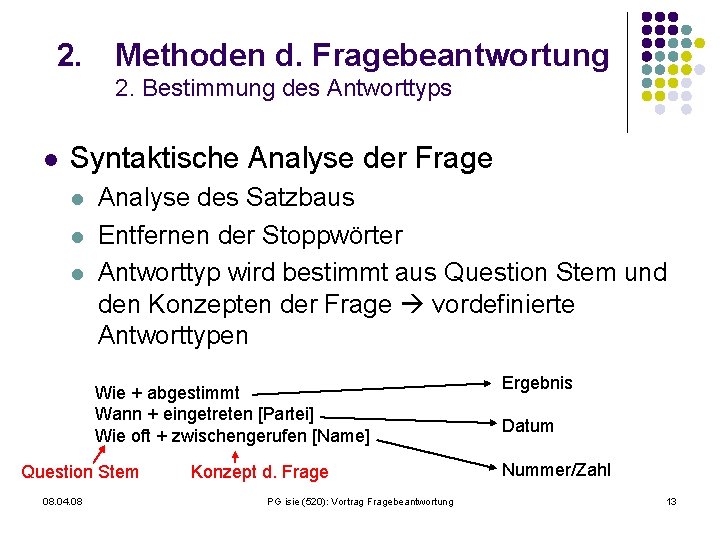

2. Methoden d. Fragebeantwortung 2. Bestimmung des Antworttyps l Syntaktische Analyse der Frage l l l Analyse des Satzbaus Entfernen der Stoppwörter Antworttyp wird bestimmt aus Question Stem und den Konzepten der Frage vordefinierte Antworttypen Wie + abgestimmt Wann + eingetreten [Partei] Wie oft + zwischengerufen [Name] Question Stem 08. 04. 08 Konzept d. Frage PG isie (520): Vortrag Fragebeantwortung Ergebnis Datum Nummer/Zahl 13

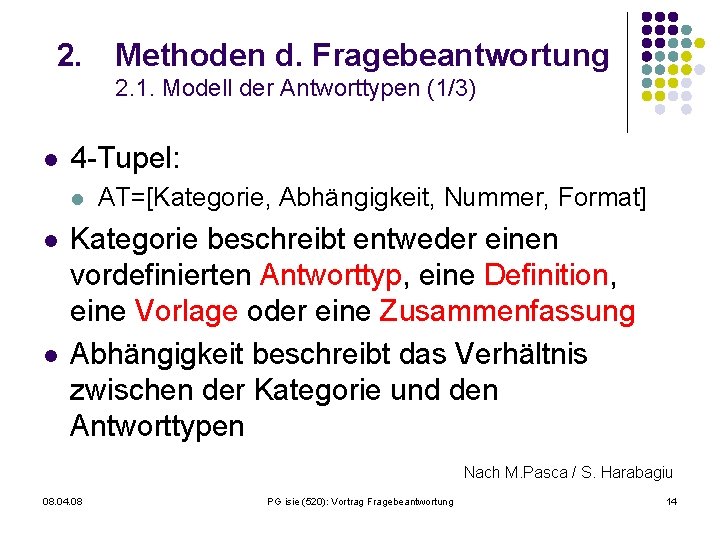

2. Methoden d. Fragebeantwortung 2. 1. Modell der Antworttypen (1/3) l 4 -Tupel: l l l AT=[Kategorie, Abhängigkeit, Nummer, Format] Kategorie beschreibt entweder einen vordefinierten Antworttyp, eine Definition, eine Vorlage oder eine Zusammenfassung Abhängigkeit beschreibt das Verhältnis zwischen der Kategorie und den Antworttypen Nach M. Pasca / S. Harabagiu 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 14

2. Methoden d. Fragebeantwortung 2. 1. Modell der Antworttypen (2/3) Beispiel für Abhängigkeit Wann wurde Kennedy erschossen? • Abhängigkeit beschreibt nun, dass wir als Antworttyp ein Datum erwarten • weitere Antworttypen: Person, Organisation, Ort, … Richtige Antwort vom Typ Datum: 22. 11. 1963 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 15

2. Methoden d. Fragebeantwortung 2. 1. Modell der Antworttypen (3/3) l l Nummer ist einfacher Boolean-Wert (Flag), der angibt, ob einzelner Wert oder eine Liste von Elementen gesucht ist Format definiert die genaue Struktur des Antworttyps l 08. 04. 08 z. B. bei einem Datum: dd. mm. yy PG isie (520): Vortrag Fragebeantwortung 16

2. Methoden d. Fragebeantwortung 2. 1. 1. Kategorie: Antworttyp l l l Question Stem bestimmt Grundfragetyp (Was, Wo, Wer, Warum oder Wie) Konzept der Frage (z. B. besichtigen) bestimmt zusammen mit Fragetyp den Antworttypen sind vordefiniert! (Person, Organisation, Ort, Datum, Nummer, . . ) l 08. 04. 08 Meistens als NEs in den Textquellen vorhanden PG isie (520): Vortrag Fragebeantwortung 17

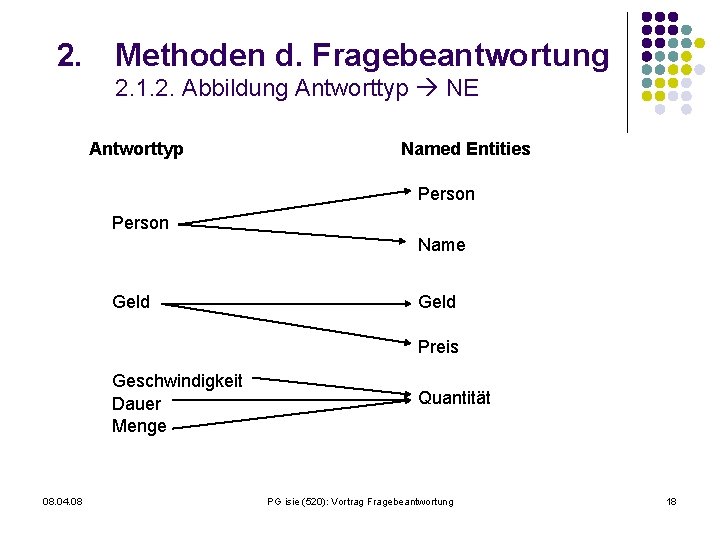

2. Methoden d. Fragebeantwortung 2. 1. 2. Abbildung Antworttyp NE Antworttyp Named Entities Person Name Geld Preis Geschwindigkeit Dauer Menge 08. 04. 08 Quantität PG isie (520): Vortrag Fragebeantwortung 18

2. Methoden d. Fragebeantwortung 2. 1. 3. Probleme! Um das Suchen nach NEs sinnvoll & schnell zu gewährleisten muss eine Vielzahl an semantischen Kategorien festgelegt werden! Fragen richten sich nicht nur nach NEs sondern auch nach Events! 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 19

2. Methoden d. Fragebeantwortung 2. 1. 4. Kategorie: Definition Auch für die Kategorie „Definition“ muss ein Antwortformat festgelegt werden l l Fragen nach Definitionen: 1. 2. Q 1: Was {ist | war} <Objekt_Name>? Q 2: Wie lautet die Definition für <Sachverhalt>? Das Format der Antwort ergibt sich nun aus der zuvor gestellten Frage l l Antworten: 1. 2. 08. 04. 08 A 1: <Objekt_Name> {ist | war} <Antwort> A 2: <Sachverhalt> {ist | sind | …} <Antwort> PG isie (520): Vortrag Fragebeantwortung 20

2. Methoden d. Fragebeantwortung 2. 1. 5. Kategorie: Vorlagen l l Wenn ein Fragetyp aus verschiedenen Antworttypen (z. B. Datum, Person, . . ) besteht, ergibt sich daraus automatisch die Kategorie „Vorlage“ Jede Vorlage enthält eine Menge von Antworttypen (Slots) 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 21

2. Methoden d. Fragebeantwortung 2. 1. 5. Bestimmen der Vorlagenslots (1/2) l Schritt 1: l l Schritt 2: l l Für eine Frage werden mögliche Antworten gesucht Für jede Antwort wird ein Frageabhängigkeitsgraph erstellt Darin wird bzgl. Der Antworttypen nach gemeinsamen Merkmalen gesucht Identifiziere die häufigsten Merkmale, die in den Antworttypen genannt werden Schritt 3: l 08. 04. 08 Sammle alle gemeinsamen Merkmale in der Vorlage und nutze diese als Namen für Slots PG isie (520): Vortrag Fragebeantwortung 22

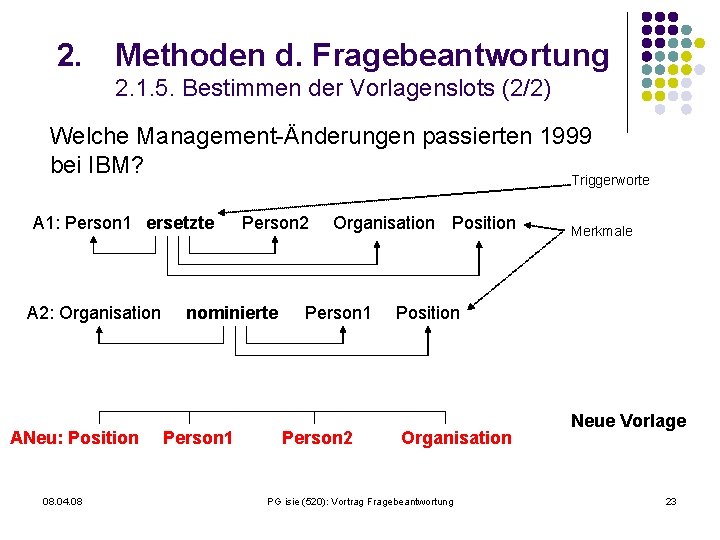

2. Methoden d. Fragebeantwortung 2. 1. 5. Bestimmen der Vorlagenslots (2/2) Welche Management-Änderungen passierten 1999 bei IBM? Triggerworte A 1: Person 1 ersetzte A 2: Organisation ANeu: Position 08. 04. 08 Person 2 nominierte Person 1 Organisation Position Person 1 Person 2 Merkmale Position Organisation PG isie (520): Vortrag Fragebeantwortung Neue Vorlage 23

2. Methoden d. Fragebeantwortung 2. 1. 6. Kategorie: Zusammenfassung l l Zusammenfassungen enthalten verschiedene Vorlagen, die nicht aus gemeinsamen Merkmalen bestehen Daher können diese nicht weiter zusammengefasst werden ( versch. Triggerwörter) 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 24

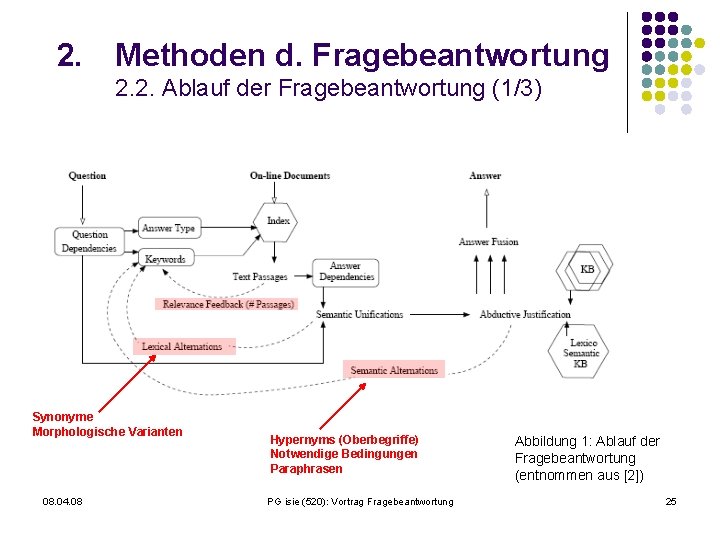

2. Methoden d. Fragebeantwortung 2. 2. Ablauf der Fragebeantwortung (1/3) Synonyme Morphologische Varianten 08. 04. 08 Hypernyms (Oberbegriffe) Notwendige Bedingungen Paraphrasen PG isie (520): Vortrag Fragebeantwortung Abbildung 1: Ablauf der Fragebeantwortung (entnommen aus [2]) 25

2. Methoden d. Fragebeantwortung 2. 2. Ablauf der Fragebeantwortung (2/3) Q/A- System: Um passende Antworten und Textpassagen zu finden Haben Feedback-loops (lexikalische u. semantische Alternativen) Eine Anfrage besteht aus Antworttyp und Schlüsselwörtern, diese werden durch Frageabhängigkeiten zusammengesetzt l l Zur Anfrage sind die Schlüsselwörter unbekannt, die mit den Antwortabhängigkeiten vereint werden können Relevance Feedbacks: abhängig von der Anzahl der Passagen (zu viele Spezialisiere Schlüsselwörter) l l 08. 04. 08 Endet, wenn keine neuen Schlüsselwörter hinzugefügt/gelöscht werden können PG isie (520): Vortrag Fragebeantwortung 26

2. Methoden d. Fragebeantwortung 2. 2. Ablauf der Fragebeantwortung (3/3) l l Frage- /Antwortabhängigkeiten produzieren lexikalische Alternativen neue Schlüsselwörter hinzunehmen Korrektheit der Antworten geprüft durch Prüfungssystem l l l Hat Wissensbasis Liefert semantische Alternativen zu Schlüsselwörtern Mögliche Antworten l l 08. 04. 08 Passende Textschnipsel Zusammengesetzte Antworten (Antwortfusion) PG isie (520): Vortrag Fragebeantwortung 27

2. Methoden d. Fragebeantwortung 2. 3. Was können wir isie nutzen? l l Bestimmen des Antworttyps und Prüfung, ob ausgegebene Antwort dem Typ entspricht Eventuell mehrere interne Schleifendurchläufe l l l Wenn gleiche & neue Trigger in den extrahierten Textpassagen/Events auftauchen Als neue Schlüsselwörter/Trigger aufnehmen Antworten-Fusion? 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 28

3. TREC 1. 2. 3. 4. 5. 6. 7. 08. 04. 08 Was ist TREC? Durchführung Welche Fragetypen gibt es? Nugget-Pyramide ci. QA-Durchführung Interaktion mit Nutzer Ergebnisse PG isie (520): Vortrag Fragebeantwortung 29

3. TREC 1. Was ist TREC? (1/2) l l Text REtrieval Conference (TREC) Workshops des National Institute of Standards and Technology (NIST) Seit 1999 abgehalten mit dem Ziel Techniken zur Fragebeantwortung zu entwickeln Fragetypen und Schwierigkeit der Fragen wurden seitdem ständig erhöht Zunächst wurden nur Fakten-Fragen (Factoid questions) beantwortet 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 30

3. TREC 1. Was ist TREC? (2/2) l l Seit 2003 Listen- und Weitere-Fragen (List and other questions) Ab 2006 komplexe, interaktive Fragen (complex, interactive QA - ci. QA) l l Interaktion mit Nutzer Quelldokumente bis 2006 nur Zeitungsartikel, ab 2007 auch Einbezug von Blogs 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 31

3. TREC 2. Durchführung (1/3) l l l Ziel ist es für eine bestimmte Interessentengruppe eine Liste von Fragen zu beantworten Fragen werden in Serien zu einem bestimmten Thema mit unterschiedlichen Fragetypen zusammengefasst Mögliche Themen für Frageserien: Person, Organisation, Objekt oder ein Event 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 32

3. TREC 2. Durchführung (2/3) l l Auswertung der Systemantworten erfolgt durch NIST -Mitglieder Teilnehmer haben 2 Wochen Zeit um automatisch generierte Antworten zu erstellen Fragen müssen in vorgegebener Reihenfolge abgearbeitet werden Innerhalb einer Serie dürfen vorherige Fragen/Antworten genutzt werden, aber nicht nachfolgende 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 33

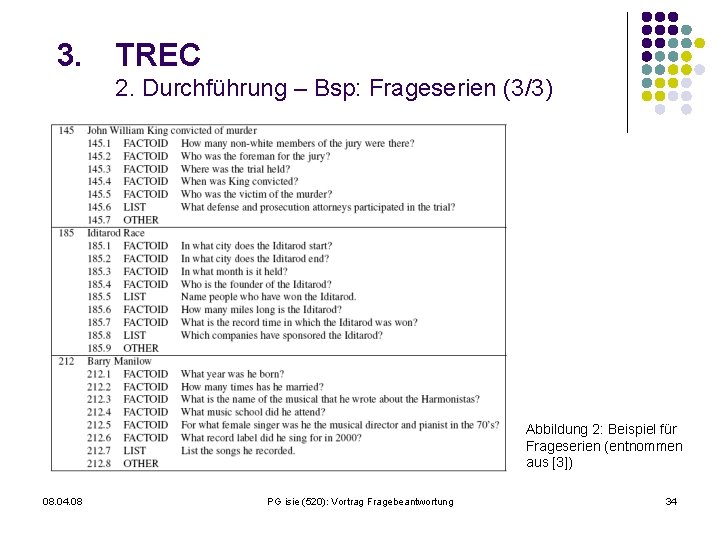

3. TREC 2. Durchführung – Bsp: Frageserien (3/3) Abbildung 2: Beispiel für Frageserien (entnommen aus [3]) 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 34

3. TREC 3. Welche Fragetypen gibt es? (1/5) Fakten-Fragen l l l Antwort ist ein 2 -Tupel [dok-id, Antwort-String] oder NIL Prüfung der Antwort durch eine Jury mit den Bewertungen: l l l 08. 04. 08 Incorrect Not Supported Not exact Locally correct Globally correct PG isie (520): Vortrag Fragebeantwortung 35

3. TREC 3. Welche Fragetypen gibt es? (2/5) l Listen-Fragen l l l 08. 04. 08 Korrekte Antwort ist eine unsortierte Liste mit unterschiedlichen(!) Antworten Bewertung der einzelnen Antworten wie bei Fakten-Fragen Zusammenfassung in Äquivalenzklassen für global korrekte Antworten Bewertung der Listen-Antworten nach F-Score PG isie (520): Vortrag Fragebeantwortung 36

3. TREC 3. Welche Fragetypen gibt es? (3/5) l F-Score (Listen-Fragen): l Precision = l Recall = l F-Score = 08. 04. 08 #Globally correct responses #responses from system #Globally correct responses #known distinct instances 2 x Precisionx Recall Precision + Recall PG isie (520): Vortrag Fragebeantwortung 37

3. TREC 3. Welche Fragetypen gibt es? (4/5) Weitere-Fragen l l l 08. 04. 08 Ungeordnetes Set aus [dok-id, Antwort-String] Antwort String muss relevante Stichworte (Nuggets) enthalten Relevante Stichworte werden vorher durch Prüfer ausgewählt und festgelegt Bewertung des Fragetyps dadurch relativ schwierig PG isie (520): Vortrag Fragebeantwortung 38

3. TREC 3. Welche Fragetypen gibt es? (5/5) Bewertung 1. Prüfer wählen Liste von „Vital“ und „Non-Vital“-Nuggets aus 2. Prüfer gehen Ausgabe durch und markieren Nuggets (doppelte Nuggets zählen nur einmal!) Ø Bewertungsmaß: 0, 1, #Nuggets 3. F-Score bestehend aus Recall (wie bisher) und einem veränderten Precision-Wert: Ø Längenbasierter Precision-Wert Ø 100 Zeichen sind pro Vital/Non-Vital Nugget erlaubt Ø Falls kompletter Antwortstring unter 100 Zeichen ausgibt: Precision = 1. 0, sonst 1 - 08. 04. 08 Länge - Begrenzung Länge PG isie (520): Vortrag Fragebeantwortung <1 39

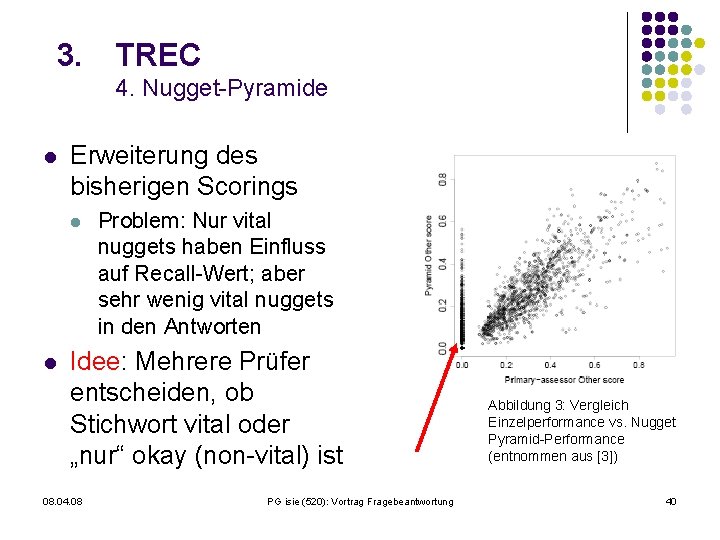

3. TREC 4. Nugget-Pyramide l Erweiterung des bisherigen Scorings l l Problem: Nur vital nuggets haben Einfluss auf Recall-Wert; aber sehr wenig vital nuggets in den Antworten Idee: Mehrere Prüfer entscheiden, ob Stichwort vital oder „nur“ okay (non-vital) ist 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung Abbildung 3: Vergleich Einzelperformance vs. Nugget Pyramid-Performance (entnommen aus [3]) 40

3. TREC 5. ci. QA-Durchführung (1/3) Ziel l 1. 2. l 08. 04. 08 Ausgabe von komplexeren Antworten bzgl. einer Nutzer-Anfrage (keine einfache Fakten. Frage) Keine einfache, in einem Schritt erhaltene Antwort, sondern interaktiver Dialog mit Nutzer Quelldokumente in 2006 nur Zeitungsartikel, 2007 auch Blogs! PG isie (520): Vortrag Fragebeantwortung 41

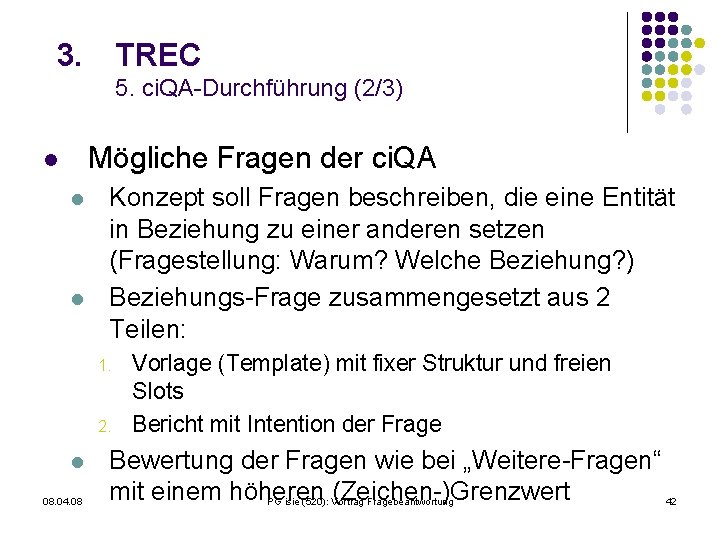

3. TREC 5. ci. QA-Durchführung (2/3) Mögliche Fragen der ci. QA l l l Konzept soll Fragen beschreiben, die eine Entität in Beziehung zu einer anderen setzen (Fragestellung: Warum? Welche Beziehung? ) Beziehungs-Frage zusammengesetzt aus 2 Teilen: 1. 2. l 08. 04. 08 Vorlage (Template) mit fixer Struktur und freien Slots Bericht mit Intention der Frage Bewertung der Fragen wie bei „Weitere-Fragen“ mit einem höheren (Zeichen-)Grenzwert PG isie (520): Vortrag Fragebeantwortung 42

3. TREC 5. ci. QA-Durchführung - Beispiel (3/3) Vorlage mit Intention 5 Vorlagen aus TREC 2006 ci. QA 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 43

3. TREC 6. Interaktion mit Nutzer (1/2) l l l Entwicklung eines Frameworks, das die Interaktion mit dem QA-System erlaubt 2007 webbasiert, davor auch lokale Applikation möglich Nutzung des Systems soll für jedes Thema maximal 5 Minuten in Anspruch nehmen 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 44

3. TREC 6. Interaktion mit Nutzer (2/2) Ablauf des Experiments l l Teilnehmer übermitteln 2 Initialläufe und URLs an das NIST Prüfer haben Möglichkeit 3 Tage mit jedem System zu interagieren l l Daten stehen Teilnehmern sofort zur Verfügung Teilnehmer haben danach 2 Wochen Zeit Endresultate zu bestimmen 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 45

3. TREC 7. Ergebnisse l l ci. QA 2007: 7 Teilnehmer mit 12 Läufen Vergleich zwischen Baseline und Endresultate der Teilnehmer l l l Baseline ist Anfrage an Lucene (Top 20), Tokenisierung, Entfernung der Stoppwörter, Auswertung falls Nicht-Stoppwort enthalten Baseline ist sogar teilweise besser als Endresultate der Teilnehmer Manuelle Abläufe sind besser als komplett automatisch generierte 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 46

![3. TREC 7. Ergebnisse Abbildung 4: Ergebnisse TREC 2007 QA-Track (entnommen aus [3]) 08. 3. TREC 7. Ergebnisse Abbildung 4: Ergebnisse TREC 2007 QA-Track (entnommen aus [3]) 08.](http://slidetodoc.com/presentation_image_h/ec14bcbb62bf82fa39a5f27ea59942ea/image-47.jpg)

3. TREC 7. Ergebnisse Abbildung 4: Ergebnisse TREC 2007 QA-Track (entnommen aus [3]) 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 47

4. Fazit l l Natürlichsprachliche Fragen von unterschiedlicher Komplexität konnten in den versch. Experimenten konsistent beantwortet werden TREC-Ergebnisse zeigen nur bedingt einen Erfolg des ci. QA 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 48

![Quellenverzeichnis [1] Wikipedia (Definition Frage/Antwort) [2] Marius Pasca, Sanda M. Harabigiu: Answer Mining from Quellenverzeichnis [1] Wikipedia (Definition Frage/Antwort) [2] Marius Pasca, Sanda M. Harabigiu: Answer Mining from](http://slidetodoc.com/presentation_image_h/ec14bcbb62bf82fa39a5f27ea59942ea/image-49.jpg)

Quellenverzeichnis [1] Wikipedia (Definition Frage/Antwort) [2] Marius Pasca, Sanda M. Harabigiu: Answer Mining from On-Line Documents, 2001 [3] Hoa Trang Dang, Jimmy Lin, Diane Kelly: Overview of the Trec 2006/2007 Question Answering Track, 2006/2007 [4] Jimmy Lin, Dina Demner-Fushman: Will pyramids topple over? [5] R. Srihari and W. Li: A Question Answering System Supported by IE, S. 171 -172, 1998 08. 04. 08 PG isie (520): Vortrag Fragebeantwortung 49

- Slides: 49