Feature Scaling Overfitting VS Underfitting Regularization Big Data

Feature Scaling / Overfitting VS Underfitting / Regularization 김나경 국내 최초 Big Data 연합동아리 BOAZ

목차 1 Feature Scaling 2 Overfitting VS Underfitting 김철수 김철수 팀장 팀장 팀장 프레젠테이션, 4 MIX CONTENTS A 컨텐츠에 대한 내용을 적어요 Enjoy your stylish business and campus life with BIZCAM 3 Regularization For Better Performance

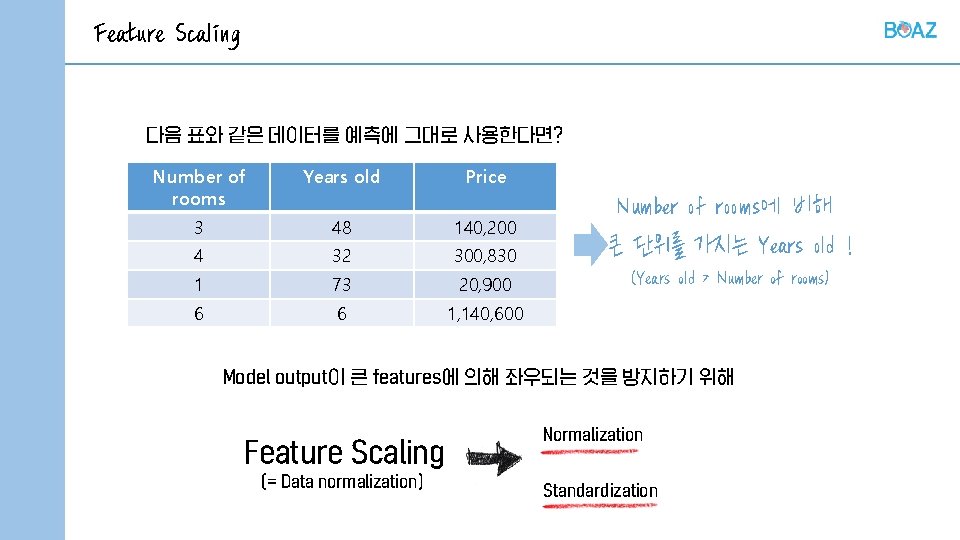

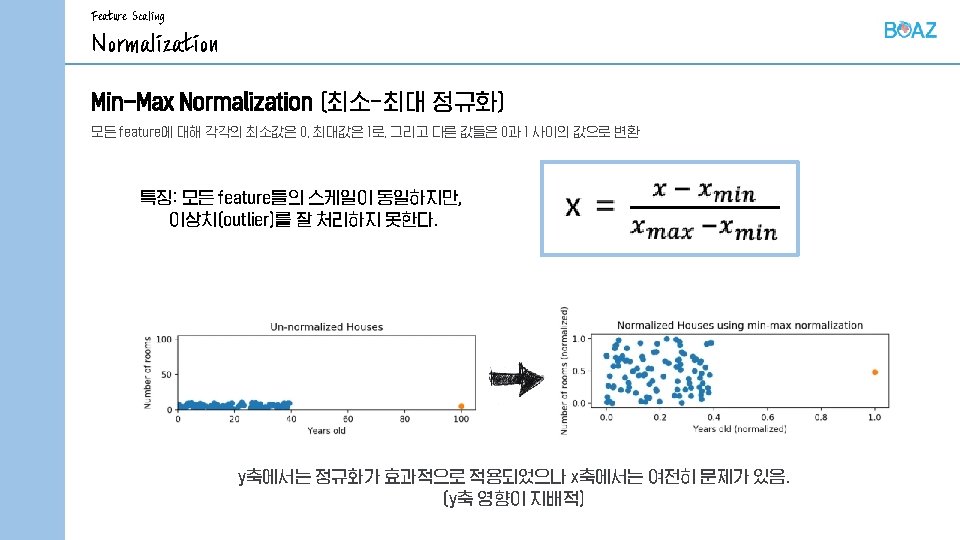

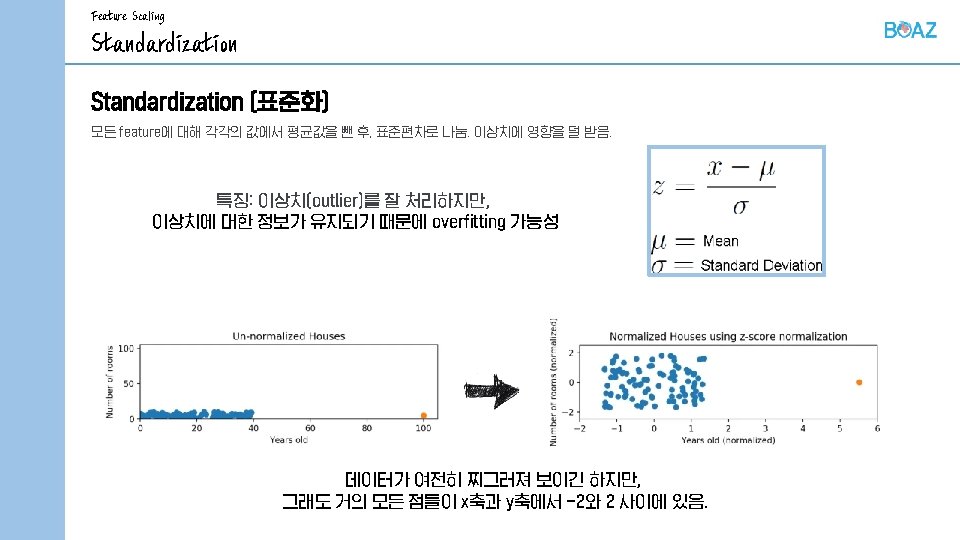

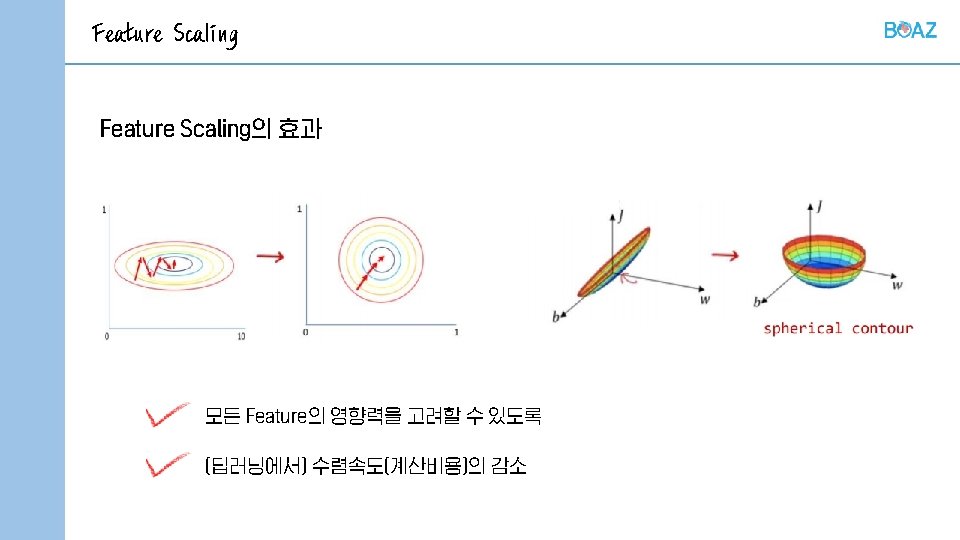

Feature Scaling 다음 표와 같은 데이터를 예측에 그대로 사용한다면? Number of rooms Years old Price 3 48 140, 200 4 32 300, 830 1 73 20, 900 6 6 1, 140, 600 Number of rooms에 비해 큰 단위를 가지는 Years old ! (Years old > Number of rooms) Model output이 큰 features에 의해 좌우되는 것을 방지하기 위해 Feature Scaling (= Data normalization) Normalization Standardization

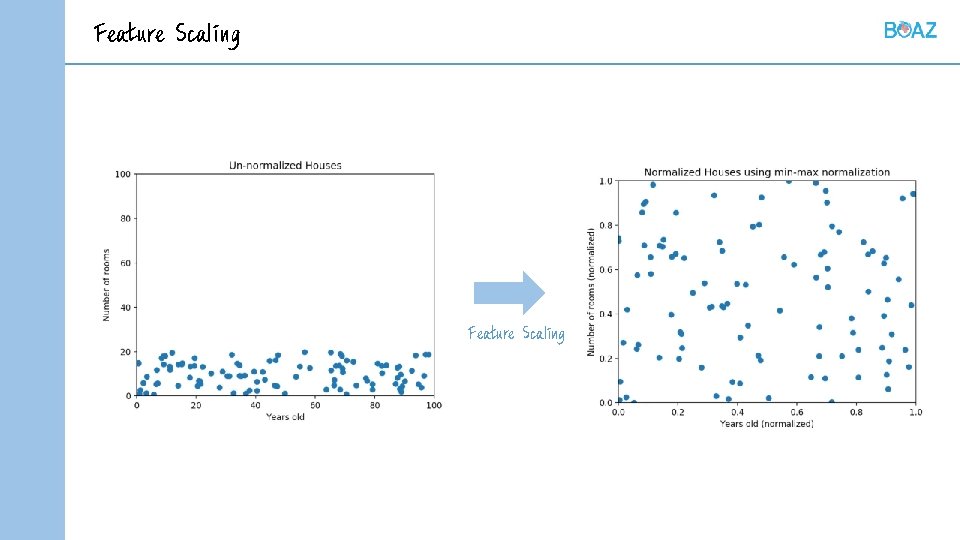

Feature Scaling

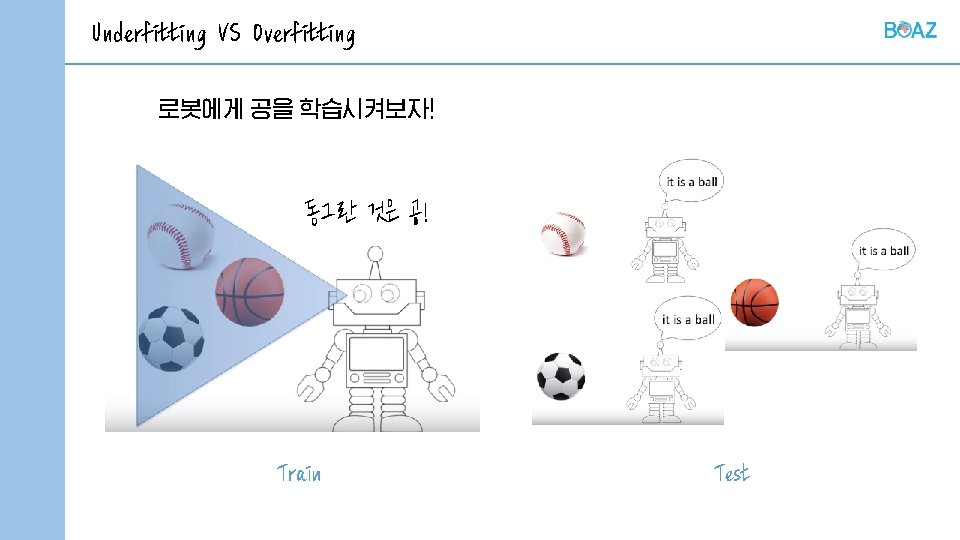

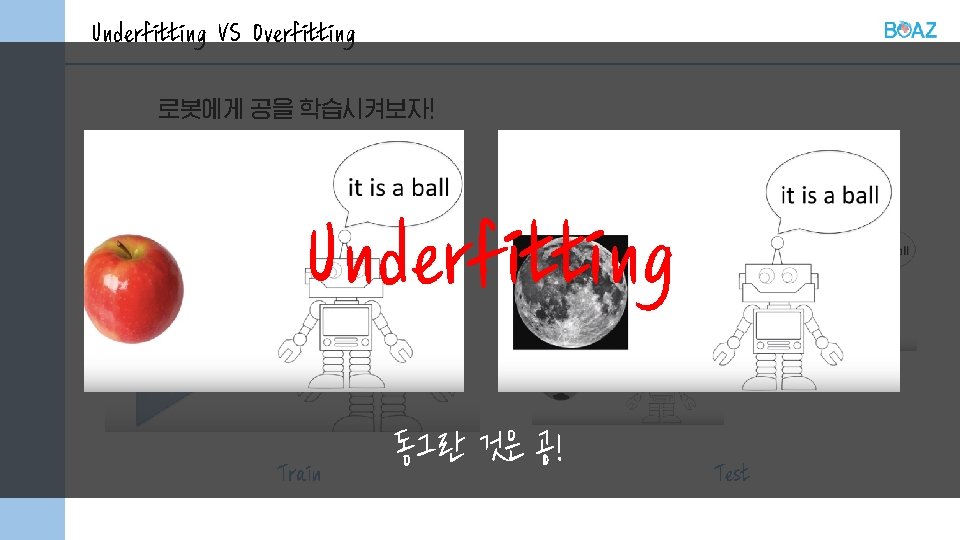

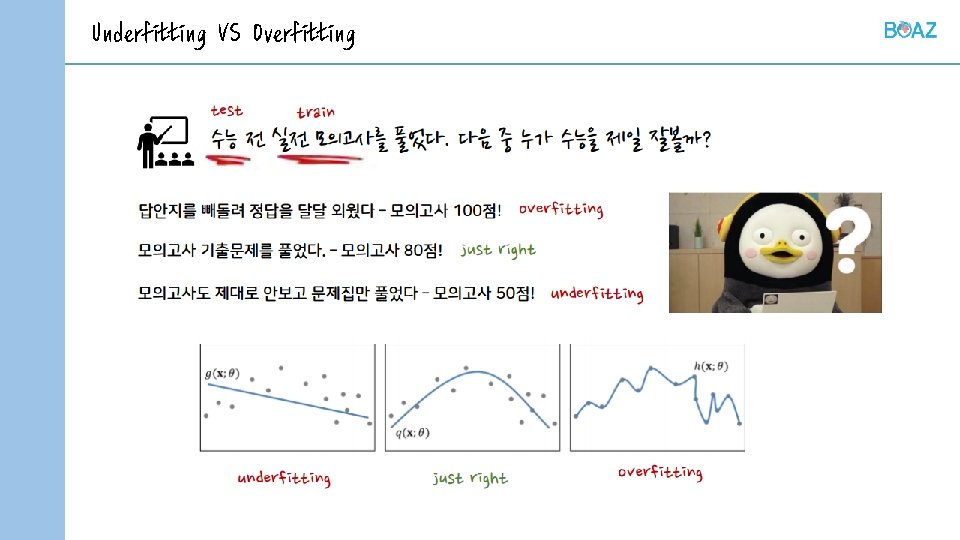

Underfitting VS Overfitting 로봇에게 공을 학습시켜보자! 동그란 것은 공! Train Test

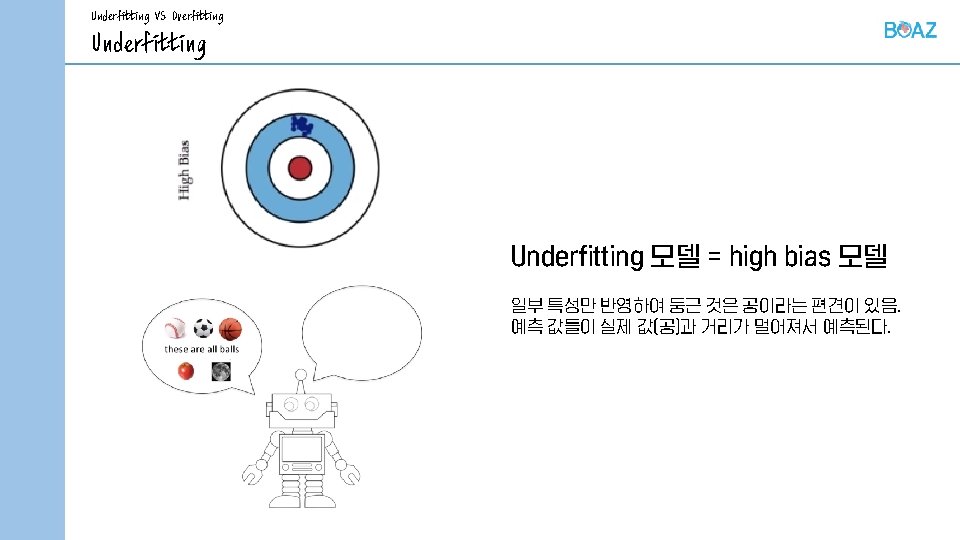

Underfitting VS Overfitting 로봇에게 공을 학습시켜보자! Underfitting Train 동그란 것은 공! Test

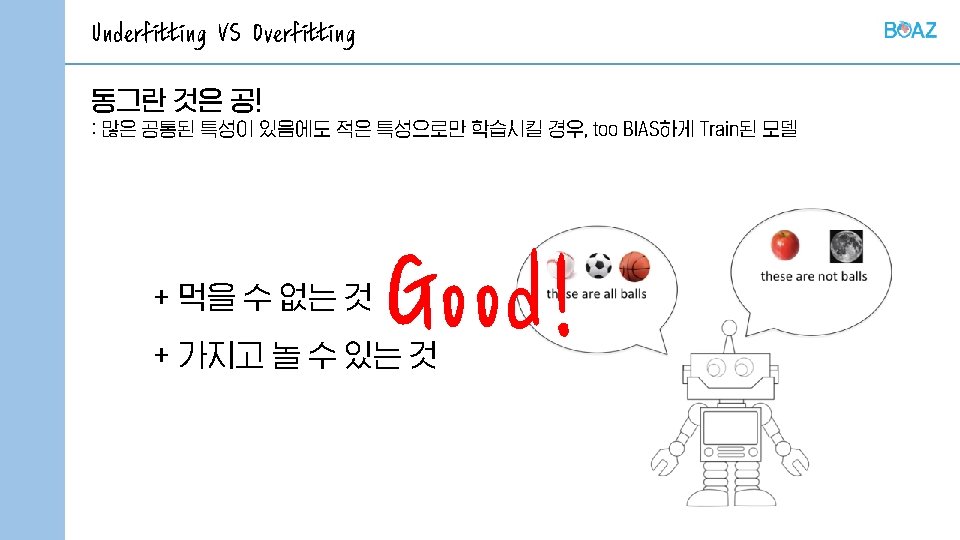

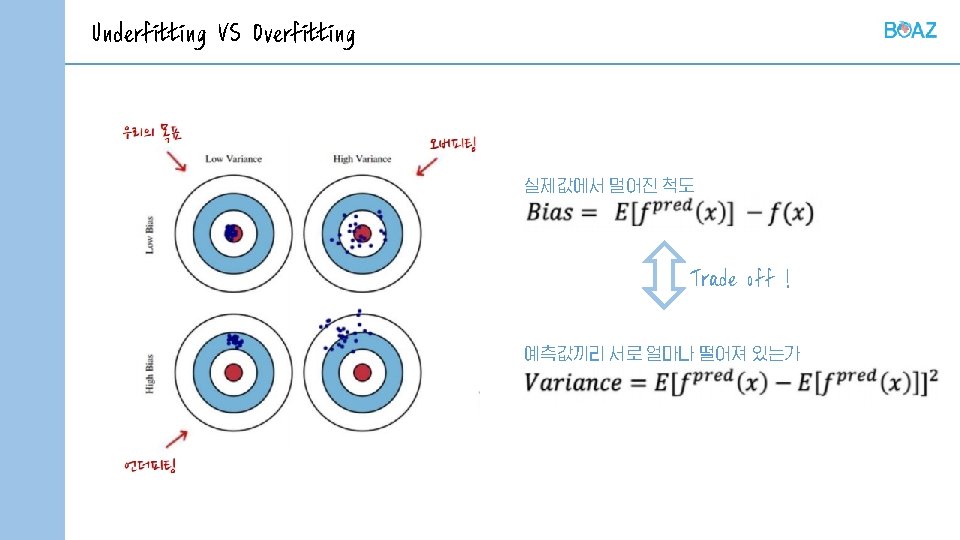

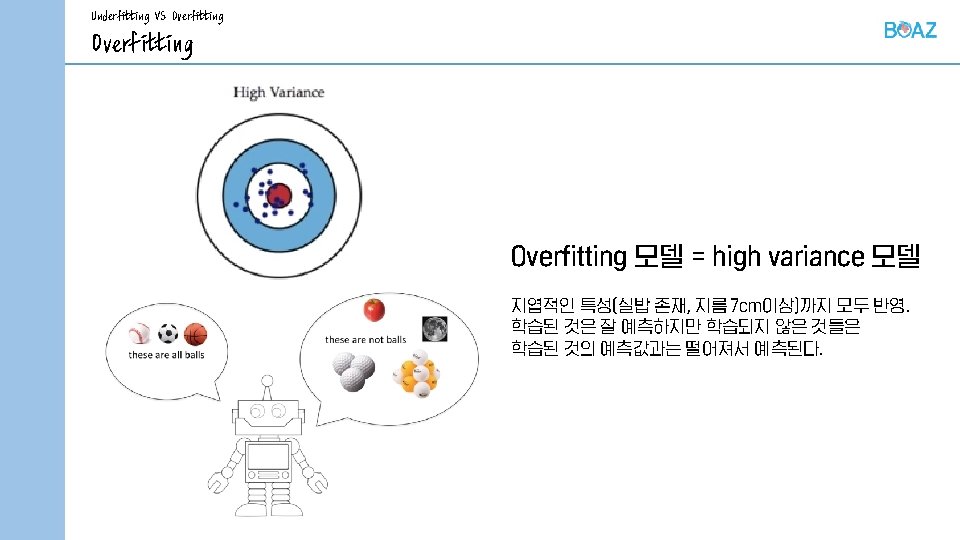

Underfitting VS Overfitting

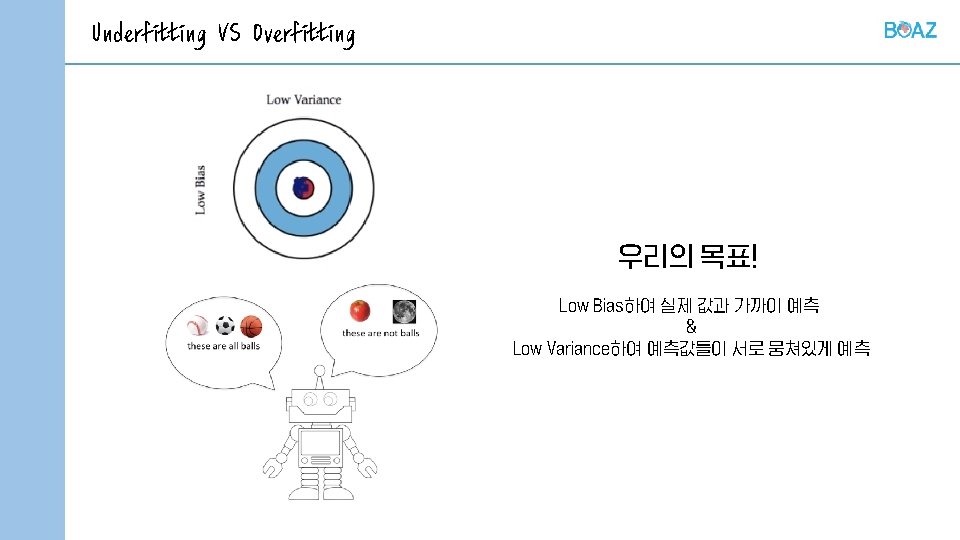

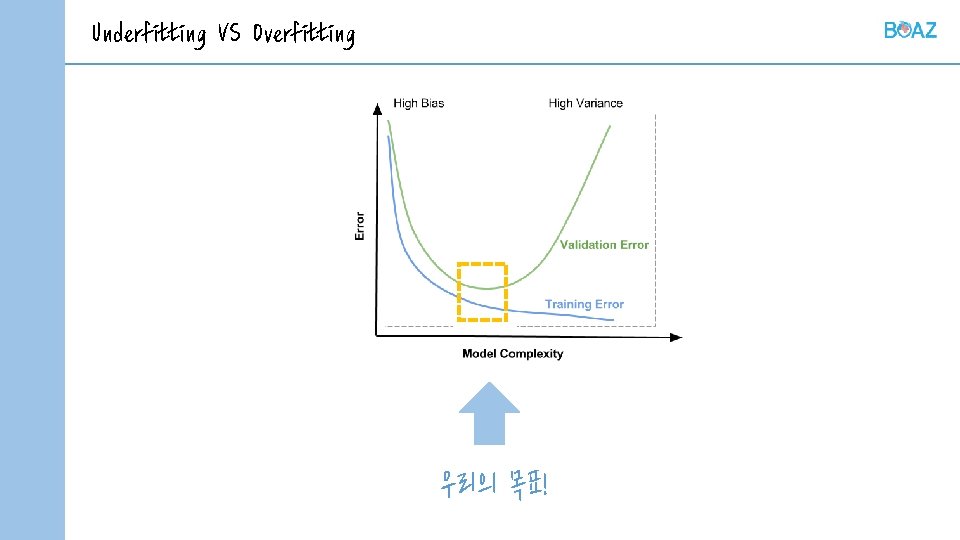

Underfitting VS Overfitting 우리의 목표!

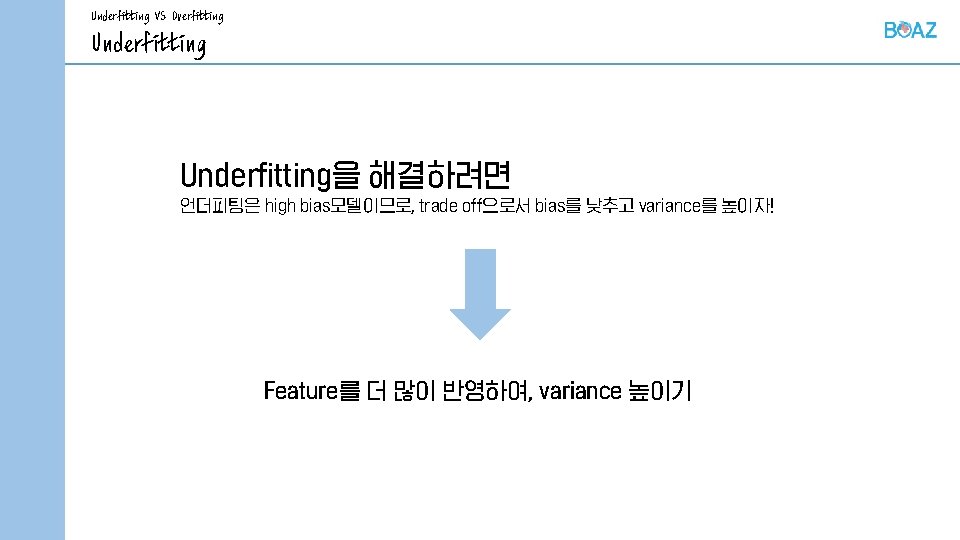

Underfitting VS Overfitting Underfitting을 해결하려면 언더피팅은 high bias모델이므로, trade off으로서 bias를 낮추고 variance를 높이자! Feature를 더 많이 반영하여, variance 높이기

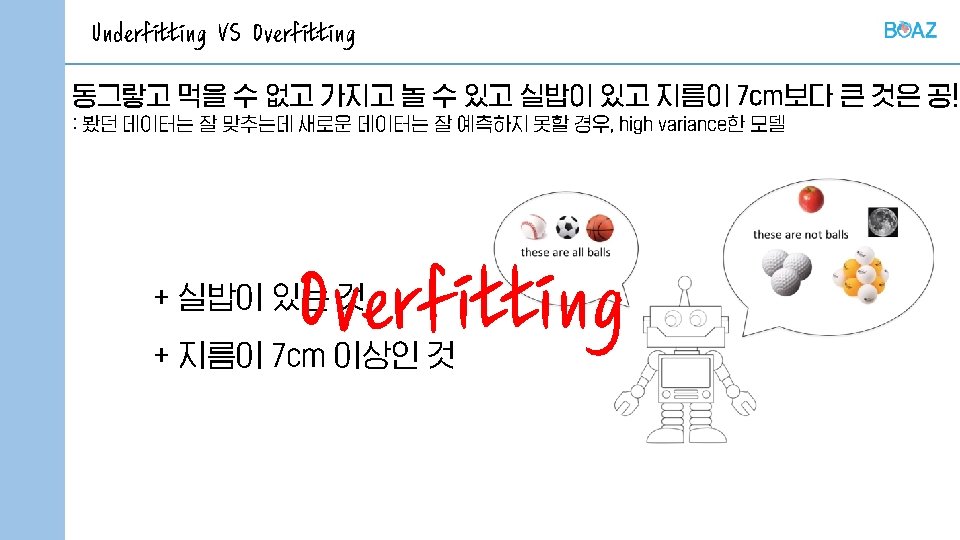

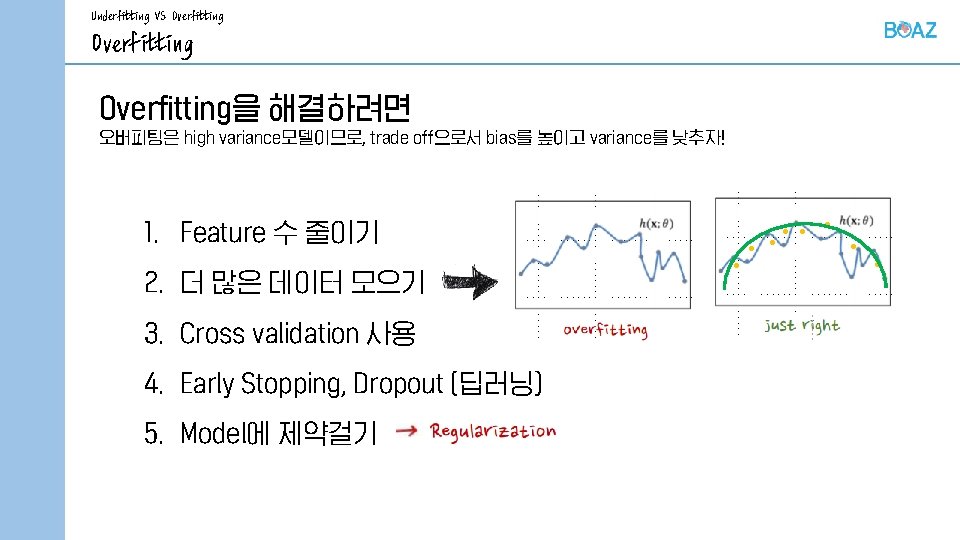

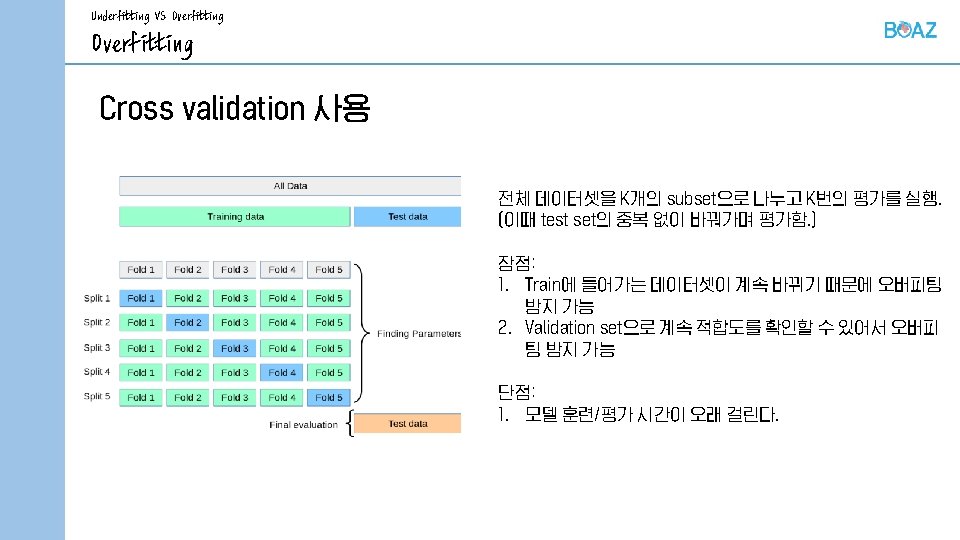

Underfitting VS Overfitting을 해결하려면 오버피팅은 high variance모델이므로, trade off으로서 bias를 높이고 variance를 낮추자! 1. Feature 수 줄이기 2. 더 많은 데이터 모으기 3. Cross validation 사용 4. Early Stopping, Dropout (딥러닝) 5. Model에 제약걸기 . . . .

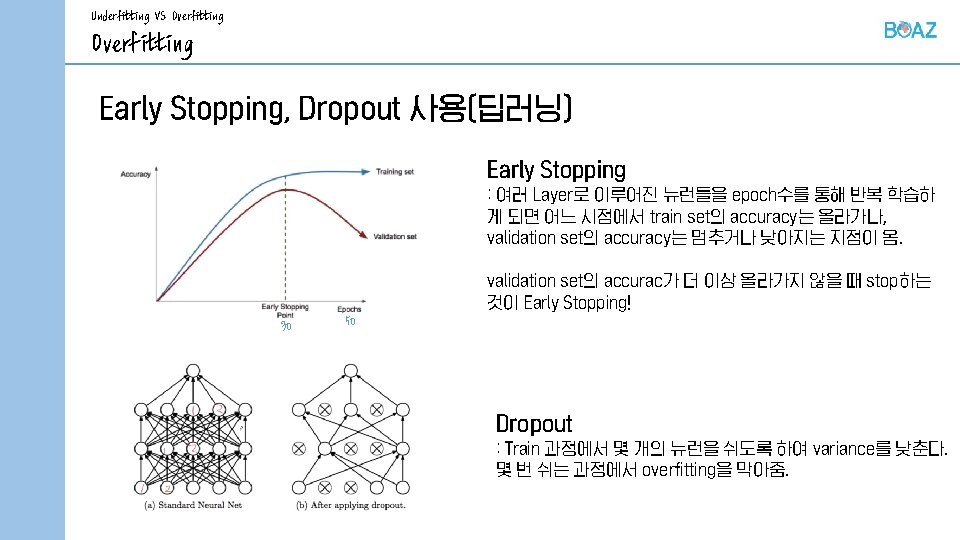

Underfitting VS Overfitting Early Stopping, Dropout 사용(딥러닝) Early Stopping : 여러 Layer로 이루어진 뉴런들을 epoch수를 통해 반복 학습하 게 되면 어느 시점에서 train set의 accuracy는 올라가나, validation set의 accuracy는 멈추거나 낮아지는 지점이 옴. 30 50 validation set의 accurac가 더 이상 올라가지 않을 때 stop하는 것이 Early Stopping! Dropout : Train 과정에서 몇 개의 뉴런을 쉬도록 하여 variance를 낮춘다. 몇 번 쉬는 과정에서 overfitting을 막아줌.

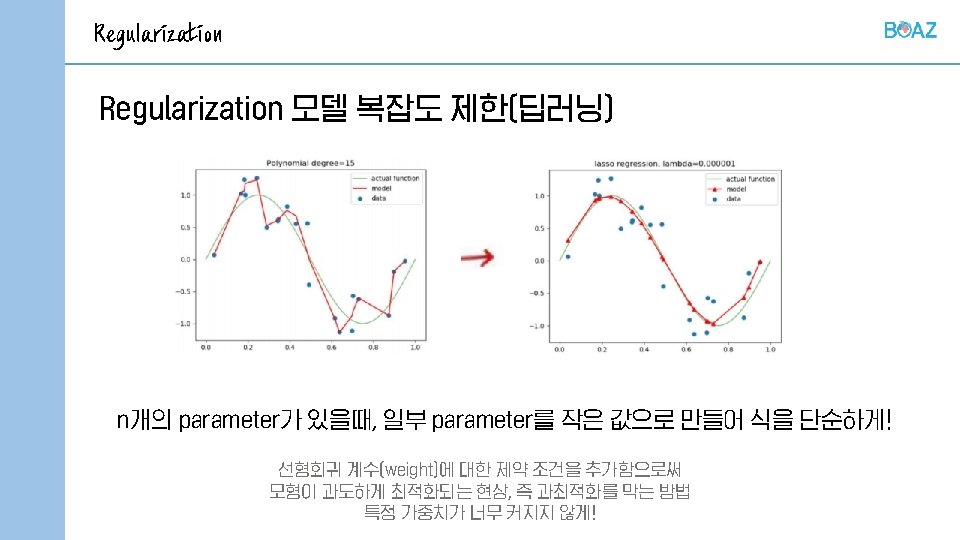

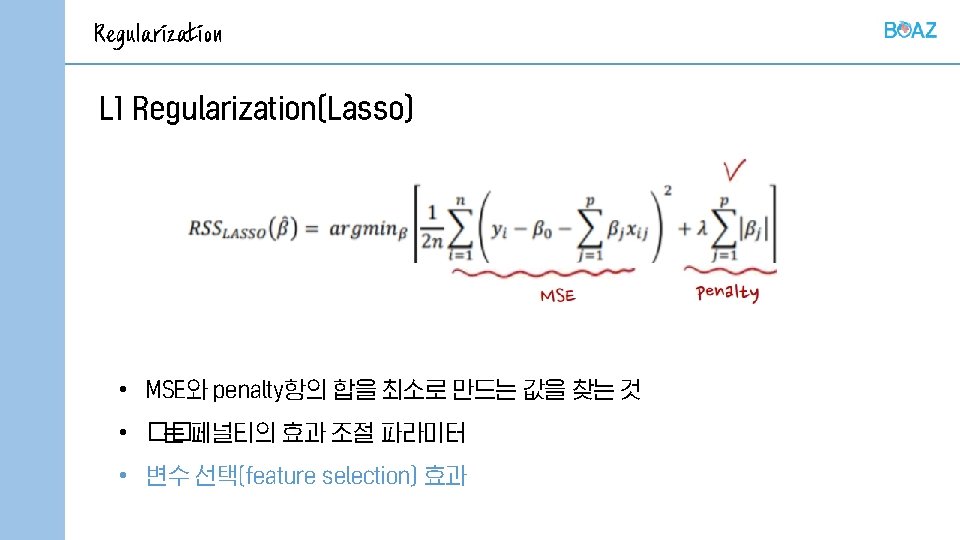

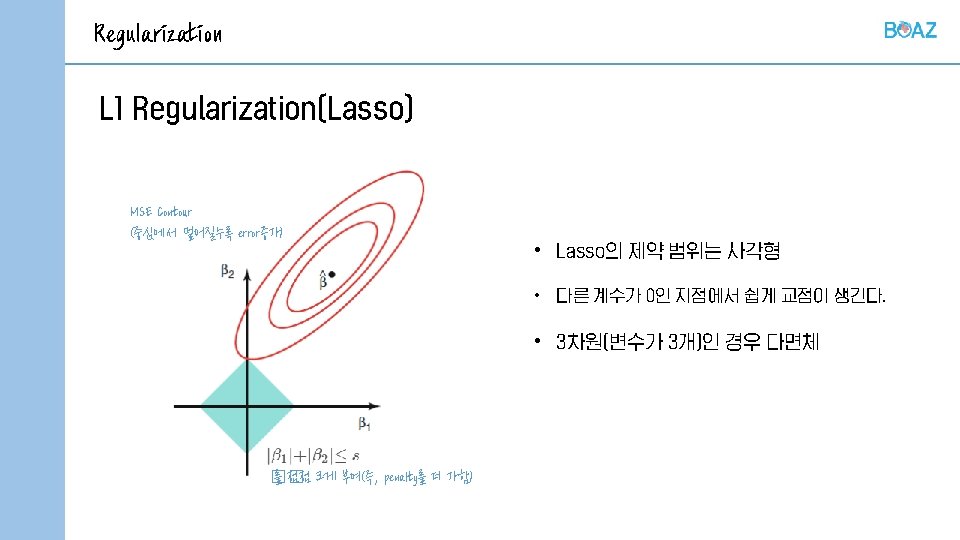

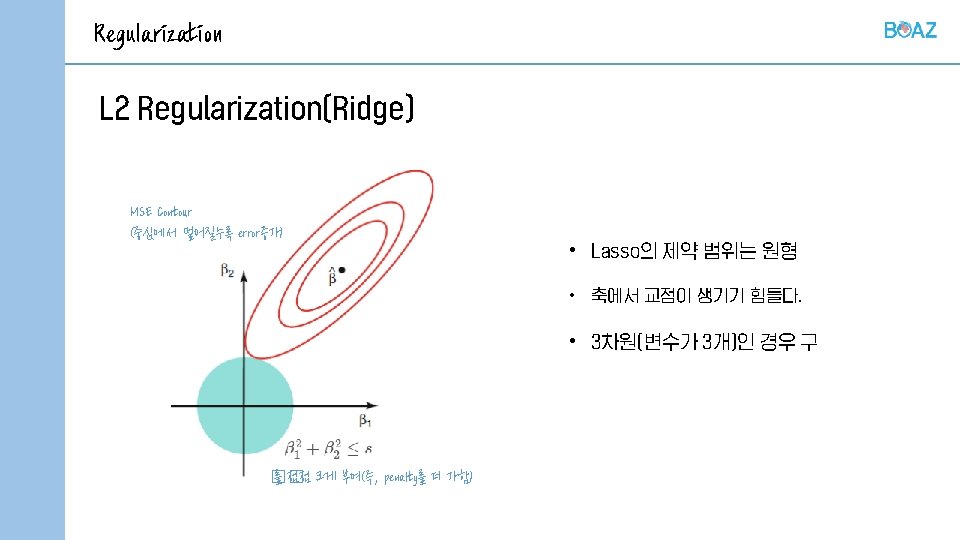

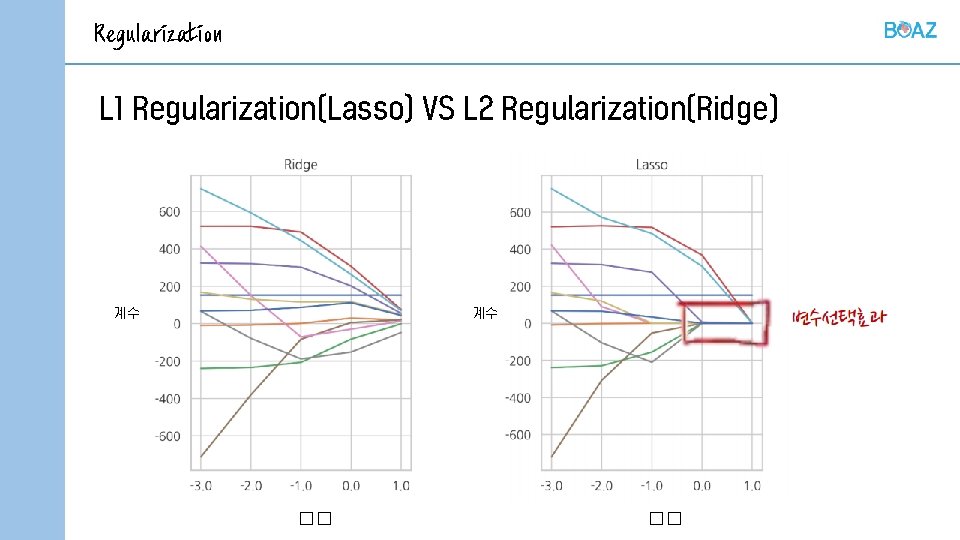

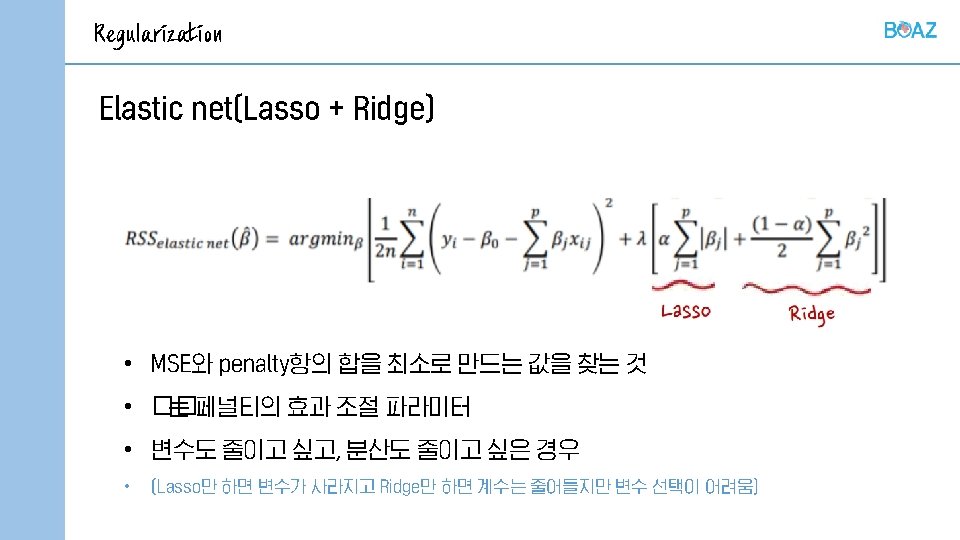

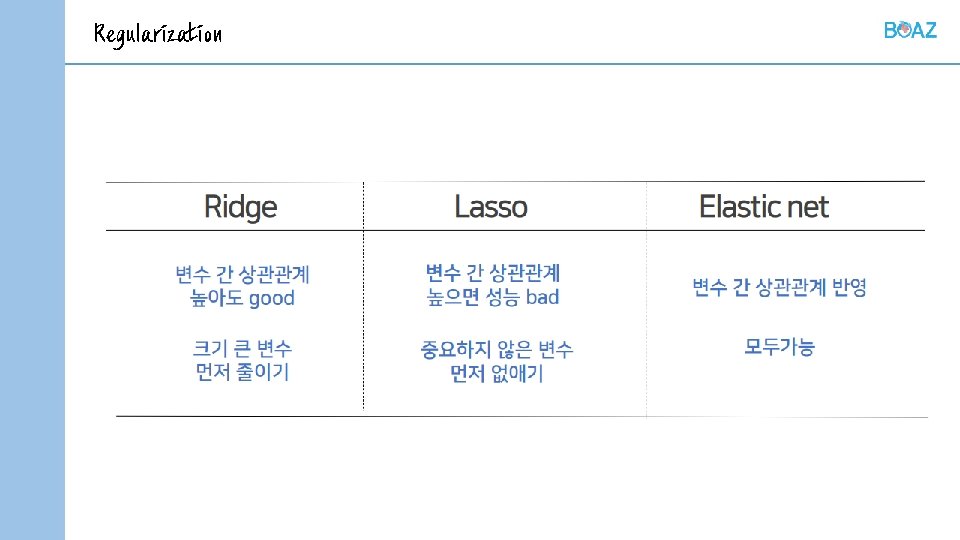

Regularization L 1 Regularization(Lasso) VS L 2 Regularization(Ridge) 계수 계수 �� ��

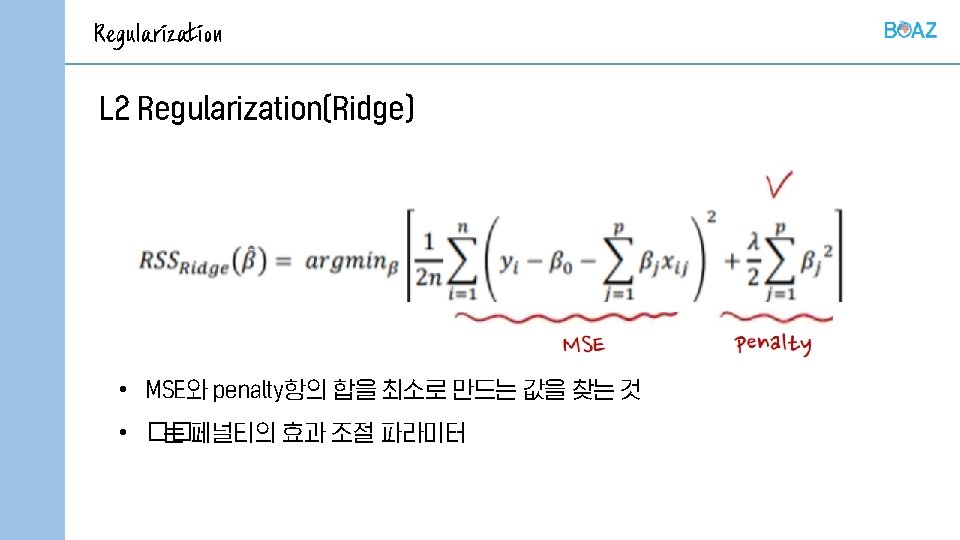

Regularization

THANK YOU

- Slides: 31