Evidencebased Education Corso di Pedagogia Sperimentale ed Evidencebased

Evidence-based Education Corso di Pedagogia Sperimentale ed Evidence-based education 1. L’istruzione informata dall’evidenza Roberto Trinchero roberto. trinchero@unito. it Ricevimento e altre info: www. edurete. org/ps 1 Versione 31. 10. 17 1

Testi di riferimento R. Trinchero, Manuale di ricerca educativa, Milano, Franco. Angeli, 2002. Riferimento per la Teoria e la progettazione e conduzione della ricerca (domanda 1). R. Trinchero, A. Parola, Educare ai processi e ai linguaggi dell'apprendimento, Milano, Franco. Angeli, 2017. Testo di approfondimento per indirizzo Epla – solo il capitolo 1: Evidence Informed Education. Per una scienza empirica dell'istruzione e dell'apprendimento (domanda 2). 2

Vi fidereste di un medico specialista non aggiornato sugli ultimi sviluppi diagnostici e terapeutici? Di un avvocato che non conosce la giurisprudenza recente? Di un architetto che non conosce i materiali messi a disposizione dall’industria edilizia odierna? 3

L’Evidence Based Education 4

Come vengono prese le decisioni in ambito educativo? • Criteri non basati sull’evidenza: – Tradizione (“Abbiamo sempre fatto così…”), – Pregiudizio (“Quelle tecniche non vanno bene, lo so io come fare…”), – Dogma (“Si fa così. ”), – Ideologia (“Tutti dicono che si fa così, quindi …”); • Criteri basati sull’evidenza: – Sistematicità (utilizzare metodi/strategie condivisi), – Controllabilità (assicurare la trasparenza del processo); – Riscontro nella realtà (dimostrare risultati); – Legittimazione da parte di una comunità scientifica (altri confermano ciò che abbiamo osservato e dedotto). 5

Evidence Based Education (Ebe) • L’espressione viene usata per la prima volta da Hargreaves nel 1996 in un celebre intervento alla Teacher Training Agency del Regno Unito; • Nasce come critica alla ricerca in ambito educativo: – Spesso focalizzata su problemi scarsamente significativi per gli insegnanti; – Che produce risultati difficilmente cumulabili tra di loro. D. H. Hargeaves, Teaching as a Research-based Profession. Possibilities and Prospects, Teacher Training Agency Annual Lecture, 1996, http: //eppi. ioe. ac. uk/cms/Portals/0/PDF%20 reviews%20 and%20 summaries/TTA%20 Hargreaves%20 lecture. pdf 6

Una buona ricerca in ambito educativo, dovrebbe … • Partire da problemi di chi opera «sul campo» ; • Tenere conto delle conoscenze già consolidate su quel tema e non perdere tempo nel ripercorrere strade già ampiamente battute (es. «Le tecnologie sono efficaci o no? » ) o perdersi in dispute di principio (es. «Sono meglio i metodi trasmissivi o quelli attivi? » ); • Puntare a costruire un corpus di conoscenze consolidate e affidabili, da ampliare ma non da rimettere costantemente in discussione. 7

L’Evidence Based Medicine come modello Evidence Based Medicine (Ebm): • «Il processo di apprendimento, basato su problemi e che dura per tutto l’arco della vita, nel quale il prendersi cura dei pazienti crea il bisogno di evidenza empirica riguardo alla diagnosi, prognosi, terapia e altre istanze cliniche e sanitarie» ; • La ricerca è condotta dai medici stessi che ne devono applicare i risultati. D. H. Hargeaves, Teaching as a Research-based Profession. Possibilities and Prospects, Teacher Training Agency Annual Lecture, 1996, http: //eppi. ioe. ac. uk/cms/Portals/0/PDF%20 reviews%20 and%20 summaries/TTA%20 Hargreaves%20 lecture. pdf 8

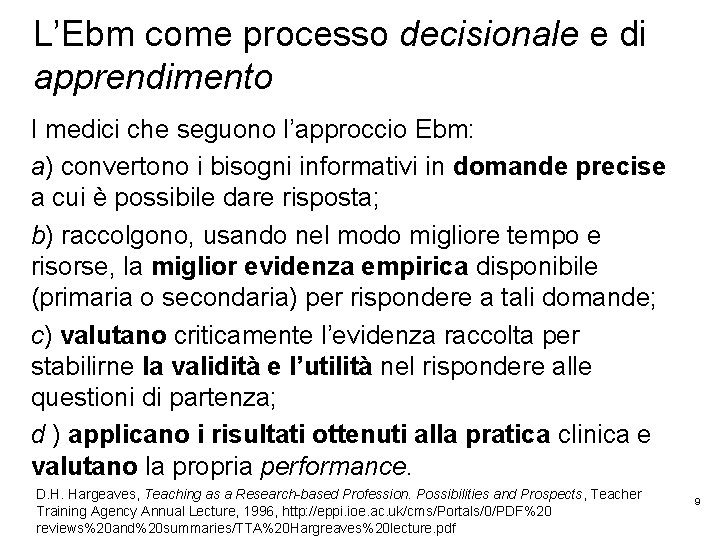

L’Ebm come processo decisionale e di apprendimento I medici che seguono l’approccio Ebm: a) convertono i bisogni informativi in domande precise a cui è possibile dare risposta; b) raccolgono, usando nel modo migliore tempo e risorse, la miglior evidenza empirica disponibile (primaria o secondaria) per rispondere a tali domande; c) valutano criticamente l’evidenza raccolta per stabilirne la validità e l’utilità nel rispondere alle questioni di partenza; d ) applicano i risultati ottenuti alla pratica clinica e valutano la propria performance. D. H. Hargeaves, Teaching as a Research-based Profession. Possibilities and Prospects, Teacher Training Agency Annual Lecture, 1996, http: //eppi. ioe. ac. uk/cms/Portals/0/PDF%20 reviews%20 and%20 summaries/TTA%20 Hargreaves%20 lecture. pdf 9

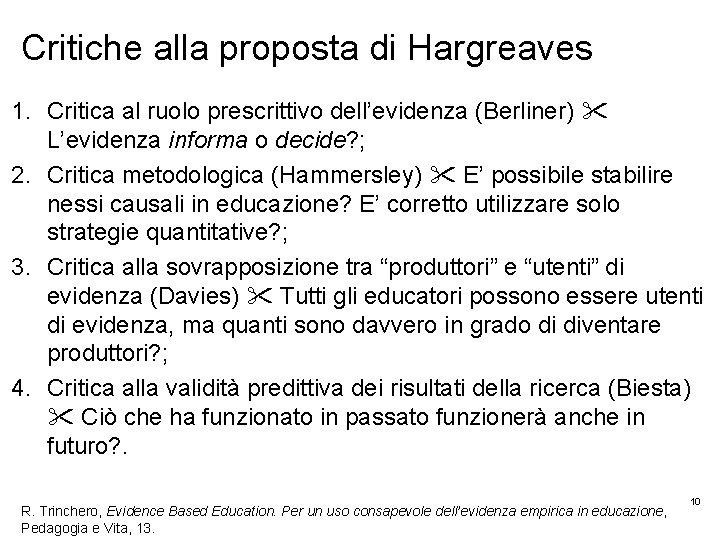

Critiche alla proposta di Hargreaves 1. Critica al ruolo prescrittivo dell’evidenza (Berliner) L’evidenza informa o decide? ; 2. Critica metodologica (Hammersley) E’ possibile stabilire nessi causali in educazione? E’ corretto utilizzare solo strategie quantitative? ; 3. Critica alla sovrapposizione tra “produttori” e “utenti” di evidenza (Davies) Tutti gli educatori possono essere utenti di evidenza, ma quanti sono davvero in grado di diventare produttori? ; 4. Critica alla validità predittiva dei risultati della ricerca (Biesta) Ciò che ha funzionato in passato funzionerà anche in futuro? . R. Trinchero, Evidence Based Education. Per un uso consapevole dell’evidenza empirica in educazione, Pedagogia e Vita, 13. 10

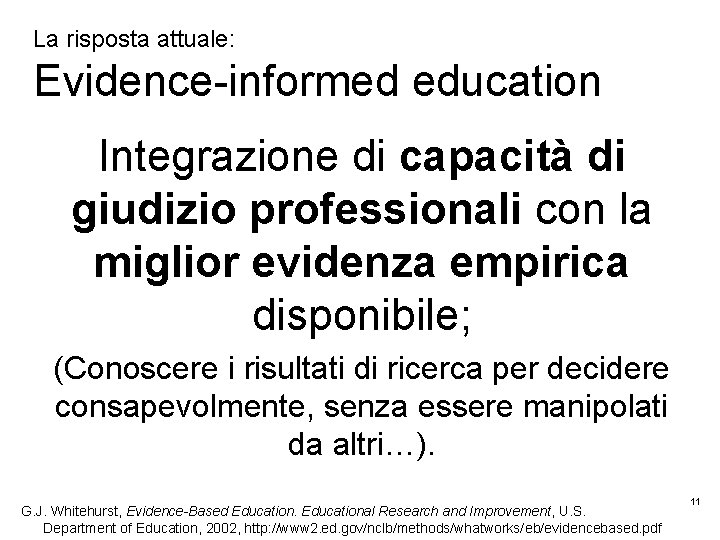

La risposta attuale: Evidence-informed education Integrazione di capacità di giudizio professionali con la miglior evidenza empirica disponibile; (Conoscere i risultati di ricerca per decidere consapevolmente, senza essere manipolati da altri…). G. J. Whitehurst, Evidence-Based Educational Research and Improvement, U. S. Department of Education, 2002, http: //www 2. ed. gov/nclb/methods/whatworks/eb/evidencebased. pdf 11

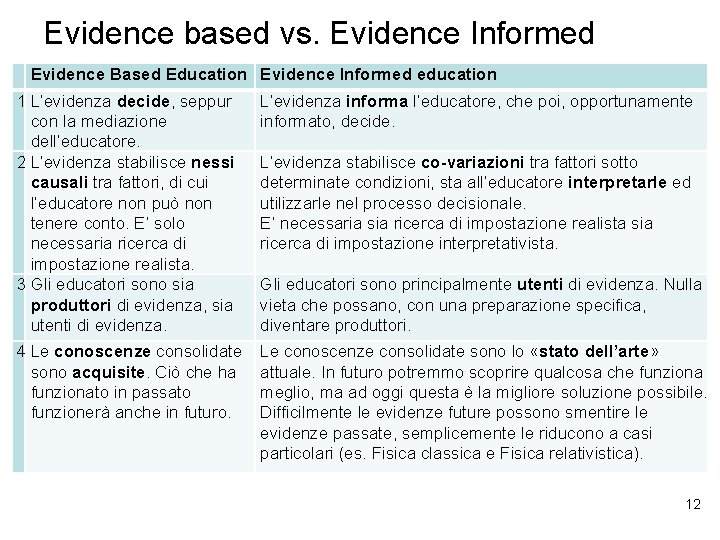

Evidence based vs. Evidence Informed Evidence Based Education Evidence Informed education 1 L’evidenza decide, seppur con la mediazione dell’educatore. 2 L’evidenza stabilisce nessi causali tra fattori, di cui l’educatore non può non tenere conto. E’ solo necessaria ricerca di impostazione realista. 3 Gli educatori sono sia produttori di evidenza, sia utenti di evidenza. L’evidenza informa l’educatore, che poi, opportunamente informato, decide. 4 Le conoscenze consolidate sono acquisite. Ciò che ha funzionato in passato funzionerà anche in futuro. Le conoscenze consolidate sono lo «stato dell’arte» attuale. In futuro potremmo scoprire qualcosa che funziona meglio, ma ad oggi questa è la migliore soluzione possibile. Difficilmente le evidenze future possono smentire le evidenze passate, semplicemente le riducono a casi particolari (es. Fisica classica e Fisica relativistica). L’evidenza stabilisce co-variazioni tra fattori sotto determinate condizioni, sta all’educatore interpretarle ed utilizzarle nel processo decisionale. E’ necessaria sia ricerca di impostazione realista sia ricerca di impostazione interpretativista. Gli educatori sono principalmente utenti di evidenza. Nulla vieta che possano, con una preparazione specifica, diventare produttori. 12

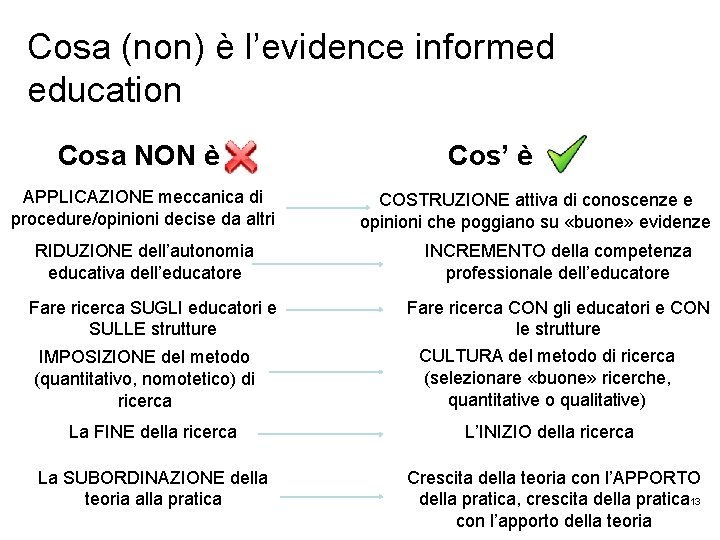

Cosa (non) è l’evidence informed education Cosa NON è APPLICAZIONE meccanica di procedure/opinioni decise da altri RIDUZIONE dell’autonomia educativa dell’educatore Fare ricerca SUGLI educatori e SULLE strutture IMPOSIZIONE del metodo (quantitativo, nomotetico) di ricerca Cos’ è COSTRUZIONE attiva di conoscenze e opinioni che poggiano su «buone» evidenze INCREMENTO della competenza professionale dell’educatore Fare ricerca CON gli educatori e CON le strutture CULTURA del metodo di ricerca (selezionare «buone» ricerche, quantitative o qualitative) La FINE della ricerca L’INIZIO della ricerca La SUBORDINAZIONE della teoria alla pratica Crescita della teoria con l’APPORTO della pratica, crescita della pratica 13 con l’apporto della teoria

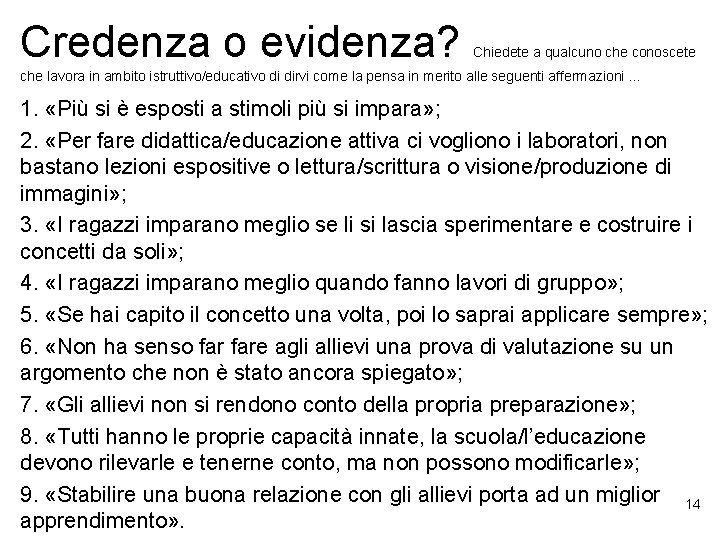

Credenza o evidenza? Chiedete a qualcuno che conoscete che lavora in ambito istruttivo/educativo di dirvi come la pensa in merito alle seguenti affermazioni … 1. «Più si è esposti a stimoli più si impara» ; 2. «Per fare didattica/educazione attiva ci vogliono i laboratori, non bastano lezioni espositive o lettura/scrittura o visione/produzione di immagini» ; 3. «I ragazzi imparano meglio se li si lascia sperimentare e costruire i concetti da soli» ; 4. «I ragazzi imparano meglio quando fanno lavori di gruppo» ; 5. «Se hai capito il concetto una volta, poi lo saprai applicare sempre» ; 6. «Non ha senso fare agli allievi una prova di valutazione su un argomento che non è stato ancora spiegato» ; 7. «Gli allievi non si rendono conto della propria preparazione» ; 8. «Tutti hanno le proprie capacità innate, la scuola/l’educazione devono rilevarle e tenerne conto, ma non possono modificarle» ; 9. «Stabilire una buona relazione con gli allievi porta ad un miglior 14 apprendimento» .

L’Evidence Informed Education nella pratica… 15

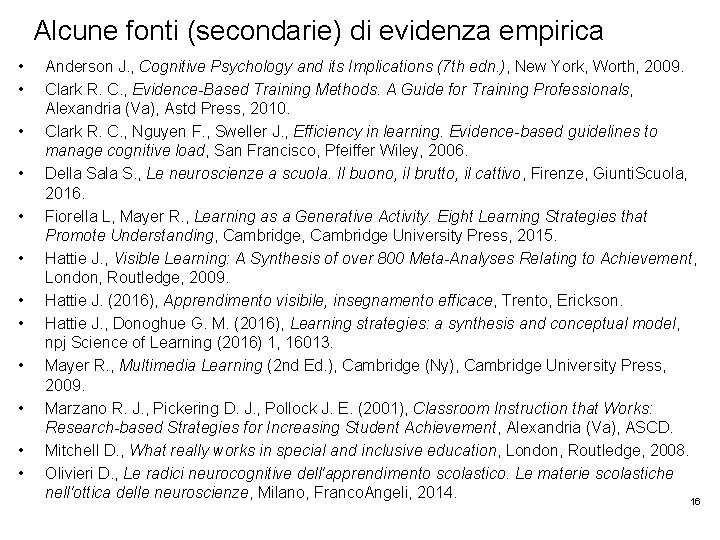

Alcune fonti (secondarie) di evidenza empirica • • • Anderson J. , Cognitive Psychology and its Implications (7 th edn. ), New York, Worth, 2009. Clark R. C. , Evidence-Based Training Methods. A Guide for Training Professionals, Alexandria (Va), Astd Press, 2010. Clark R. C. , Nguyen F. , Sweller J. , Efficiency in learning. Evidence-based guidelines to manage cognitive load, San Francisco, Pfeiffer Wiley, 2006. Della Sala S. , Le neuroscienze a scuola. Il buono, il brutto, il cattivo, Firenze, Giunti. Scuola, 2016. Fiorella L, Mayer R. , Learning as a Generative Activity. Eight Learning Strategies that Promote Understanding, Cambridge University Press, 2015. Hattie J. , Visible Learning: A Synthesis of over 800 Meta-Analyses Relating to Achievement, London, Routledge, 2009. Hattie J. (2016), Apprendimento visibile, insegnamento efficace, Trento, Erickson. Hattie J. , Donoghue G. M. (2016), Learning strategies: a synthesis and conceptual model, npj Science of Learning (2016) 1, 16013. Mayer R. , Multimedia Learning (2 nd Ed. ), Cambridge (Ny), Cambridge University Press, 2009. Marzano R. J. , Pickering D. J. , Pollock J. E. (2001), Classroom Instruction that Works: Research-based Strategies for Increasing Student Achievement, Alexandria (Va), ASCD. Mitchell D. , What really works in special and inclusive education, London, Routledge, 2008. Olivieri D. , Le radici neurocognitive dell'apprendimento scolastico. Le materie scolastiche nell'ottica delle neuroscienze, Milano, Franco. Angeli, 2014. 16

Le meta-analisi Analisi secondarie dei dati volte ad integrare tra di loro i risultati di precedenti analisi provenienti da studi singoli o da altre meta-analisi, allo scopo di assegnare senso a tali risultati anche attraverso la loro lettura alla luce di un quadro di ricerca più generale (Glass, 1976). 17

Duplice esigenza alla base delle metaanalisi… • Tenere in considerazione una mole di risultati di ricerca via crescente; • Renderli “operativi”, ossia utili come base conoscitiva per ulteriori ricerche sul tema e come base scientifica su cui fondare le pratiche istruttive. 18

Fasi di conduzione di una meta-analisi: 1. Selezione ed analisi preliminare delle ricerche empiriche sul tema, allo scopo di escludere ricerche presentano problemi metodologici rilevanti nel disegno della ricerca, nella raccolta e nell’analisi dei dati. 19

Fasi di conduzione di una meta-analisi: 2. Definizione dei costrutti • Definizione dei costrutti presenti nel tema. Se, ad esempio, la domanda a cui intende rispondere la meta-analisi è “Qual è l’effetto medio degli interventi sulle abilità di studio (study skills intervention) sul successo scolastico? ” è necessario definire - prima sul piano concettuale e poi su quello operativo - cosa si intende per “interventi sulle abilità di studio” e cosa si intende per “successo scolastico”; • La definizione può emergere anche a partire dagli studi considerati, come unione logica delle definizioni operative di tali costrutti adottate nei singoli studi. Ad esempio, la sovracategoria “interventi sulle abilità di studio” avrà un estensione semantica via più ampia mano che nuovi interventi verranno presi in considerazione nella meta-analisi. 20

Fasi di conduzione di una meta-analisi: 3. Calcolo dell’Effect Size Si definisce Effect size (ES) medio di un dato fattore sul successo scolastico la misura di quanto è ampio il cambiamento che si è prodotto nell’indice di successo scolastico (fattore dipendente) a seguito della somministrazione al campione considerato di un dato intervento (es. sulle strategie di studio; fattore indipendente), cambiamento che si suppone causato da tale fattore. 21

Calcolo dell’Effect Size L’effect size viene in genere quantificato con l’indice d di Cohen, pensato come misura standardizzata della distanza tra le medie di due gruppi (ad esempio gli incrementi medi pre-post di un gruppo sperimentale e di un gruppo di controllo, in un piano sperimentale a due gruppi) o di un gruppo unico testato in tempi differenti: d = (M 1 – M 2) / S dove (M 1 – M 2) è la differenza tra le due medie, e S è la stima dello scarto tipo (deviazione standard) aggregato delle popolazioni da cui sono tratti i due campioni. 22

Calcolo dell’Effect Size • Esistono vari modi per calcolare la stima dello scarto tipo aggregato e questo fa sì che gli effect size possano essere differenti a seconda delle scelte compiute dal ricercatore che conduce la meta-analisi; • Gli effect size ottenuti con la stessa modalità di stimare lo scarto tipo aggregato sono comunque comparabili tra di loro e questo è uno degli elementi più interessanti insiti nella tecnica della meta-analisi; • Gli effect size sono sempre accompagnati da un loro errore standard e questo rende possibile considerare opportuni intervalli di fiducia in queste comparazioni. 23

Effect Size come «dato di media» • Comunque venga svolto, il calcolo dell’effect size fornisce sempre un dato “di media” e come tale va trattato; • Se da due meta-analisi emerge, ad esempio, che il fattore “intervento sulle strategie di studio” risulta essere mediamente più efficace rispetto al fattore “riduzione dell’ansia degli studenti”, questo non significa che tutte le varie tipologie di intervento sulle strategie di studio abbiano efficacia maggiore rispetto a tutte le varie strategie di riduzione dell’ansia e non vi possano essere alcune strategie di riduzione dell’ansia che hanno dimostrato alta efficacia; • Ciò che la meta-analisi mette in luce è che mediamente gli interventi sulle strategie di studio hanno portato a scarti positivi più alti sugli indicatori di successo scolastico rispetto agli interventi sulla riduzione dell’ansia. 24

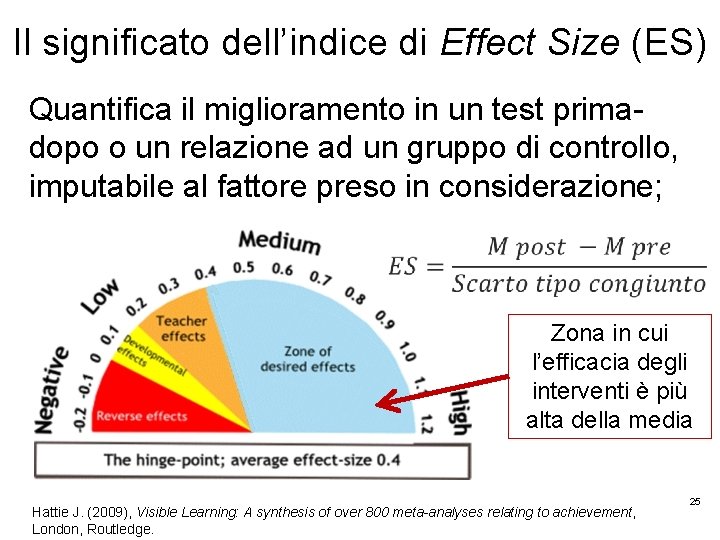

Il significato dell’indice di Effect Size (ES) Quantifica il miglioramento in un test primadopo o un relazione ad un gruppo di controllo, imputabile al fattore preso in considerazione; Zona in cui l’efficacia degli interventi è più alta della media Hattie J. (2009), Visible Learning: A synthesis of over 800 meta-analyses relating to achievement, London, Routledge. 25

Precauzioni nell’uso dell’Effect Size • Spesso dalle meta-analisi emerge un’alta variabilità degli effetti: studi che considerano gli stessi fattori, svolti in contesti differenti e con un quadro situazionale differente, portano a risultati anche radicalmente differenti; • E’ quindi importante non solo considerare l’effect size come ampiezza media dei vari effetti presi in considerazione (tratti dai singoli studi), ma anche la distribuzione dei singoli effetti (descrizione quantitativa) e la loro natura (descrizione qualitativa dell’effetto e del quadro situazionale in cui è stato prodotto). 26

Esempio: interventi sulle abilità di studio Nel caso degli interventi sulle abilità di studio (study skills intervention), tali interventi possono essere classificati in cognitivi, metacognitivi ed affettivi (Hattie, 2009, 189). • Gli interventi cognitivi fanno riferimento ad esempio alla presa di appunti e al riassumere testi o contenuti di un’esposizione; • Gli interventi metacognitivi fanno riferimento all’autoorganizzazione dello studio intesa come pianificazione, monitoraggio e studio tattico/strategico; • Gli interventi affettivi fanno leva su aspetti non cognitivi dell’apprendimento quali ad esempio la motivazione e il concetto di sé. 27

Provate a mettere in ordine le seguenti strategie di studio dalla più alla meno efficace …. 1. Controllare il proprio lavoro prima di consegnarlo al docente 2. Fare liste di “cosa fare, quando e come” nello studio seguirle 3. Fare una tabella di marcia dello studio con scansione giornaliera 4. Fare uno schema prima di scrivere una relazione 5. Immaginare le conseguenze del fallimento nello studio 6. Mettere da parte eventi distraenti fino a che il compito da svolgere non è finito 7. Prendere appunti in classe 8. Rivedere gli appunti precedenti prima di andare alla lezione successiva 9. Scrivere più volte una formula matematica finché non viene ricordata con facilità 10. Studiare con un compagno o avere qualcuno che possa dare aiuto 11. Studiare in un luogo appartato o tranquillo 12. Tenere un diario dello studio, con azioni ed esiti ottenuti 13. Utilizzare degli ausili mnemonici specifici per ricordare sequenze di fatti 14. Verbalizzare i passi da mettere in atto nel risolvere un problema di matematica. 28

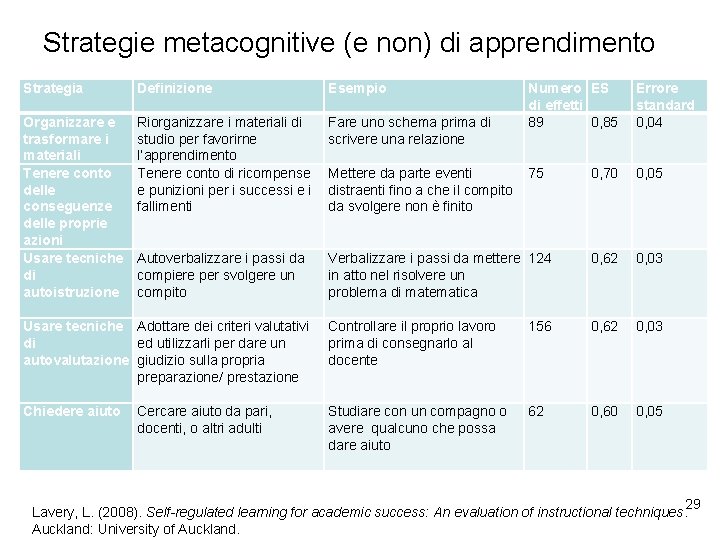

Strategie metacognitive (e non) di apprendimento Strategia Definizione Esempio Numero ES di effetti 89 0, 85 Errore standard 0, 04 Organizzare e trasformare i materiali Tenere conto delle conseguenze delle proprie azioni Usare tecniche di autoistruzione Riorganizzare i materiali di studio per favorirne l’apprendimento Tenere conto di ricompense e punizioni per i successi e i fallimenti Fare uno schema prima di scrivere una relazione 75 0, 70 0, 05 Autoverbalizzare i passi da compiere per svolgere un compito Verbalizzare i passi da mettere 124 in atto nel risolvere un problema di matematica 0, 62 0, 03 Usare tecniche Adottare dei criteri valutativi di ed utilizzarli per dare un autovalutazione giudizio sulla propria preparazione/ prestazione Controllare il proprio lavoro prima di consegnarlo al docente 156 0, 62 0, 03 Chiedere aiuto Studiare con un compagno o avere qualcuno che possa dare aiuto 62 0, 60 0, 05 Cercare aiuto da pari, docenti, o altri adulti Mettere da parte eventi distraenti fino a che il compito da svolgere non è finito 29 Lavery, L. (2008). Self-regulated learning for academic success: An evaluation of instructional techniques. Auckland: University of Auckland.

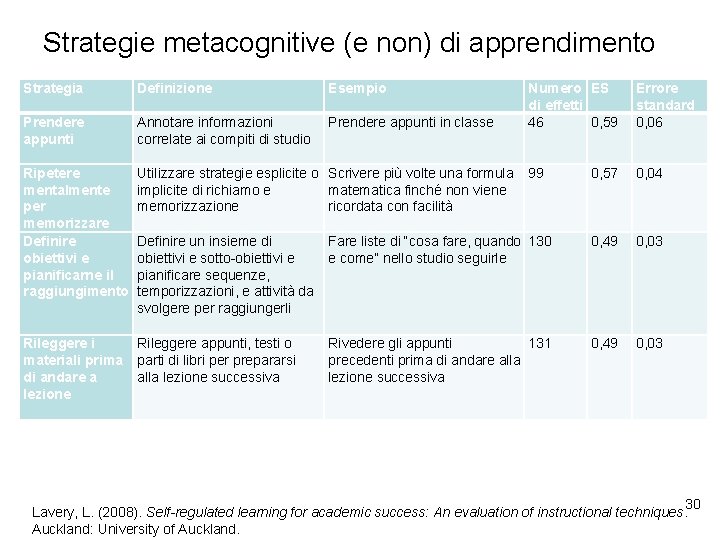

Strategie metacognitive (e non) di apprendimento Strategia Definizione Esempio Numero ES di effetti 46 0, 59 Errore standard 0, 06 Prendere appunti Annotare informazioni correlate ai compiti di studio Prendere appunti in classe Ripetere mentalmente per memorizzare Definire obiettivi e pianificarne il raggiungimento Utilizzare strategie esplicite o Scrivere più volte una formula implicite di richiamo e matematica finché non viene memorizzazione ricordata con facilità 99 0, 57 0, 04 Definire un insieme di obiettivi e sotto-obiettivi e pianificare sequenze, temporizzazioni, e attività da svolgere per raggiungerli Fare liste di “cosa fare, quando 130 e come” nello studio seguirle 0, 49 0, 03 Rileggere i materiali prima di andare a lezione Rileggere appunti, testi o parti di libri per prepararsi alla lezione successiva Rivedere gli appunti 131 precedenti prima di andare alla lezione successiva 0, 49 0, 03 30 Lavery, L. (2008). Self-regulated learning for academic success: An evaluation of instructional techniques. Auckland: University of Auckland.

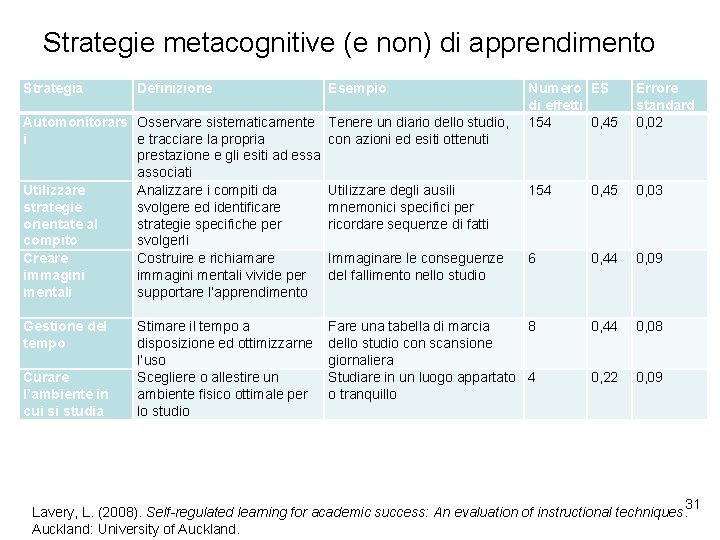

Strategie metacognitive (e non) di apprendimento Strategia Definizione Esempio Numero ES di effetti 154 0, 45 Errore standard 0, 02 Utilizzare degli ausili mnemonici specifici per ricordare sequenze di fatti 154 0, 45 0, 03 Immaginare le conseguenze del fallimento nello studio Automonitorars Osservare sistematicamente i e tracciare la propria prestazione e gli esiti ad essa associati Utilizzare Analizzare i compiti da strategie svolgere ed identificare orientate al strategie specifiche per compito svolgerli Creare Costruire e richiamare immagini mentali vivide per mentali supportare l’apprendimento Tenere un diario dello studio, con azioni ed esiti ottenuti 6 0, 44 0, 09 Gestione del tempo Fare una tabella di marcia 8 dello studio con scansione giornaliera Studiare in un luogo appartato 4 o tranquillo 0, 44 0, 08 0, 22 0, 09 Curare l’ambiente in cui si studia Stimare il tempo a disposizione ed ottimizzarne l’uso Scegliere o allestire un ambiente fisico ottimale per lo studio 31 Lavery, L. (2008). Self-regulated learning for academic success: An evaluation of instructional techniques. Auckland: University of Auckland.

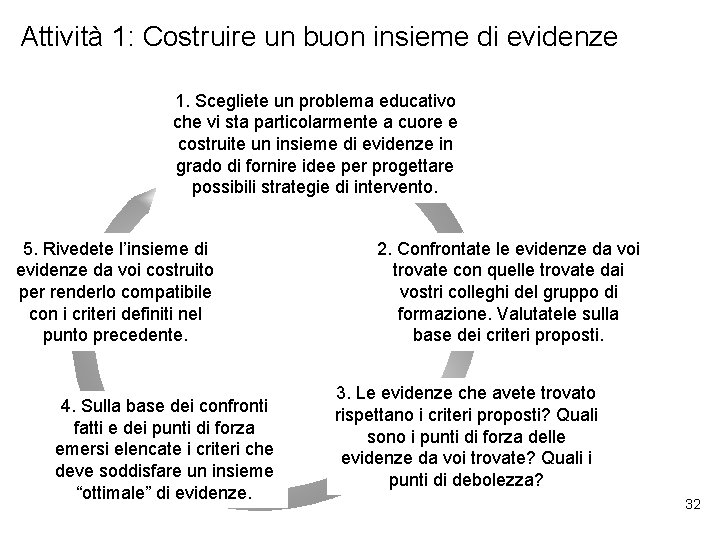

Attività 1: Costruire un buon insieme di evidenze 1. Scegliete un problema educativo che vi sta particolarmente a cuore e costruite un insieme di evidenze in grado di fornire idee per progettare possibili strategie di intervento. 5. Rivedete l’insieme di evidenze da voi costruito per renderlo compatibile con i criteri definiti nel punto precedente. 4. Sulla base dei confronti fatti e dei punti di forza emersi elencate i criteri che deve soddisfare un insieme “ottimale” di evidenze. 2. Confrontate le evidenze da voi trovate con quelle trovate dai vostri colleghi del gruppo di formazione. Valutatele sulla base dei criteri proposti. 3. Le evidenze che avete trovato rispettano i criteri proposti? Quali sono i punti di forza delle evidenze da voi trovate? Quali i punti di debolezza? 32

- Slides: 32